Les formulaires organisationnels servent d'outil commercial principal dans tous les secteurs, des services financiers aux soins de santé, etc. Considérons, par exemple, les formulaires de déclaration de revenus dans le secteur de la gestion fiscale, où de nouveaux formulaires sortent chaque année avec en grande partie les mêmes informations. Les clients AWS de tous les secteurs ont besoin de traiter et de stocker des informations dans des formulaires dans le cadre de leurs pratiques commerciales quotidiennes. Ces formulaires servent souvent de moyen principal pour que l'information circule dans une organisation où les moyens technologiques de saisie de données ne sont pas pratiques.

En plus d'utiliser des formulaires pour saisir des informations, au fil des années d'offre Extrait d'Amazon, nous avons observé que les clients AWS versionnent fréquemment leurs formulaires organisationnels en fonction des modifications structurelles apportées, des champs ajoutés ou modifiés, ou d'autres considérations telles qu'un changement d'année ou de version du formulaire.

Lorsque la structure ou le contenu d'un formulaire change, cela peut souvent poser des problèmes aux systèmes OCR traditionnels ou avoir un impact sur les outils en aval utilisés pour capturer des informations, même lorsque vous devez capturer les mêmes informations d'une année sur l'autre et agréger les données à utiliser quel que soit le format. du document.

Pour résoudre ce problème, dans cet article, nous montrons comment créer et déployer un pipeline d'analyse de documents multiformat, sans serveur et piloté par les événements avec Amazon Textract.

Vue d'ensemble de la solution

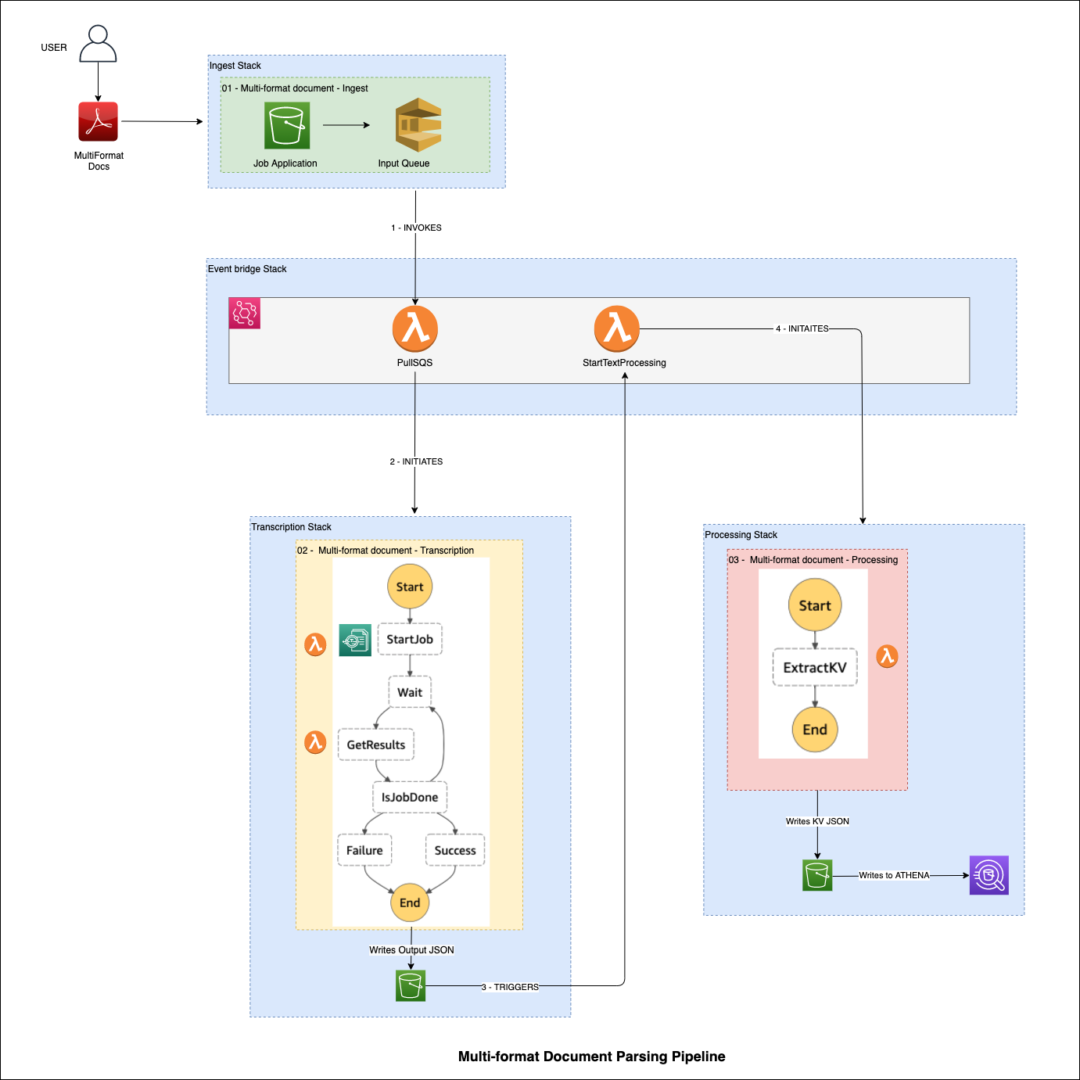

Le schéma suivant illustre l'architecture de notre solution :

Tout d'abord, la solution propose l'ingestion de pipeline à l'aide de Service de stockage simple Amazon (Amazon S3), les notifications d'événements Amazon S3 et un Service Amazon Simple Queue (Amazon SQS) afin que le traitement commence lorsqu'un formulaire arrive dans la partition Amazon S3 cible. Un événement sur Amazon Event Bridge est créé et envoyé à un AWS Lambda cible qui déclenche une tâche Amazon Textract.

Vous pouvez utiliser des services AWS sans serveur tels que Lambda et Fonctions d'étape AWS pour créer des intégrations de services asynchrones entre les services AWS AI et AWS Analytics et les services de base de données pour l'entreposage, l'analyse, l'IA et l'apprentissage automatique (ML). Dans cet article, nous montrons comment utiliser Step Functions pour contrôler et maintenir de manière asynchrone l'état des demandes aux API asynchrones Amazon Textract. Ceci est réalisé en utilisant une machine d'état pour gérer les appels et les réponses. Nous utilisons Lambda dans la machine d'état pour fusionner les données de réponse d'API paginées d'Amazon Textract en un seul objet JSON contenant des données de texte semi-structurées extraites à l'aide de l'OCR.

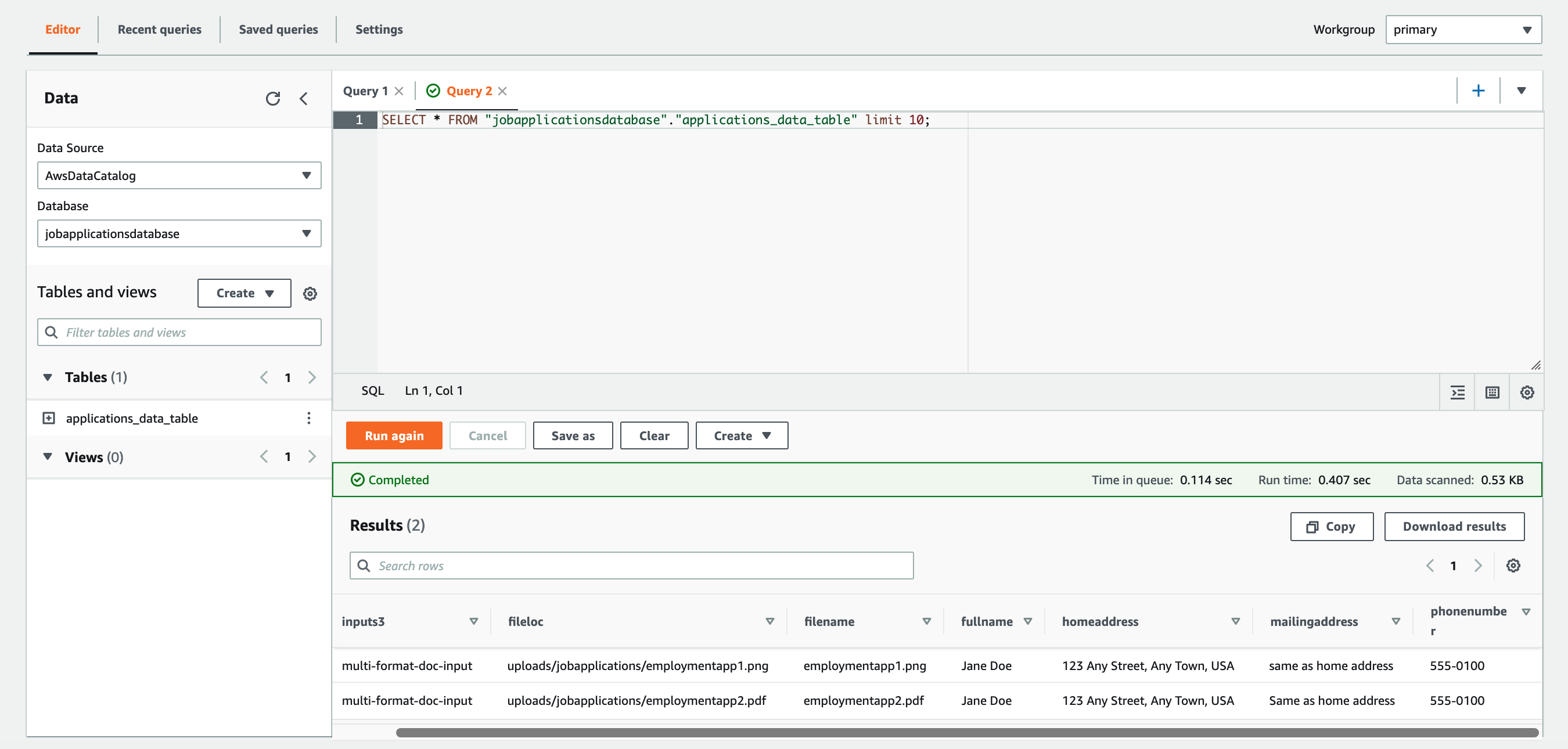

Ensuite, nous filtrons sur différents formulaires en utilisant une approche standardisée pour agréger ces données OCR dans un format structuré commun en utilisant Amazone Athéna et un JSON SQL Amazon Textract SerDe.

Vous pouvez suivre les étapes suivies dans ce pipeline à l'aide de Step Functions sans serveur pour suivre l'état de traitement et conserver la sortie de chaque état. C'est quelque chose que les clients de certains secteurs préfèrent faire lorsqu'ils travaillent avec des données où vous devez conserver les résultats de toutes les prédictions de services tels qu'Amazon Textract pour favoriser l'explicabilité des résultats de votre pipeline à long terme.

Enfin, vous pouvez interroger les données extraites dans les tables Athena.

Dans les sections suivantes, nous vous expliquons comment configurer le pipeline à l'aide de AWS CloudFormation, tester le pipeline et ajouter de nouvelles versions de formulaire. Ce pipeline fournit une solution maintenable car chaque composant (ingestion, extraction de texte, traitement de texte) est indépendant et isolé.

Définir les paramètres d'entrée par défaut pour les piles CloudFormation

Pour définir les paramètres d'entrée des piles CloudFormation, ouvrez default.properties sous le params dossier et entrez le code suivant:

Déployez la solution

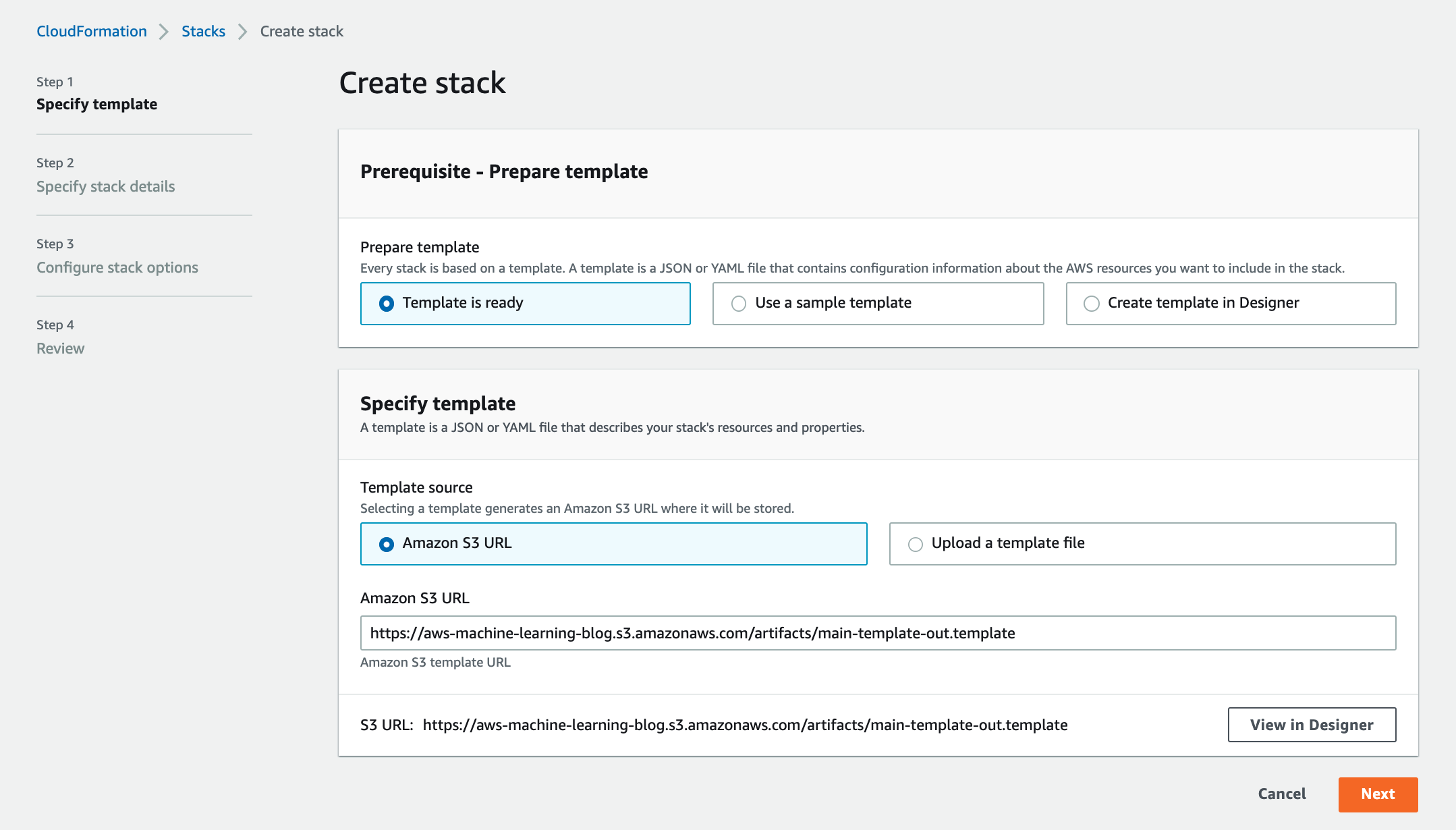

Pour déployer votre pipeline, procédez comme suit :

- Selectionnez Lancer la pile:

- Selectionnez Suivant.

- Spécifiez les détails de la pile comme indiqué dans la capture d'écran suivante et choisissez Suivant.

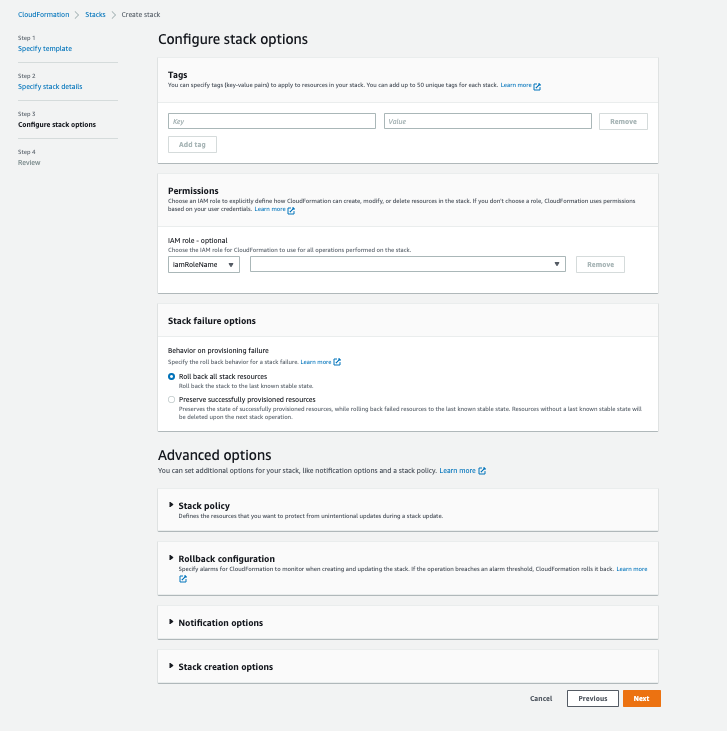

- Dans le Configurer les options de pile section, ajoutez des balises facultatives, des autorisations et d'autres paramètres avancés.

- Selectionnez Suivant.

- Vérifiez les détails de la pile et sélectionnez Je reconnais qu'AWS CloudFormation peut créer des ressources IAM avec des noms personnalisés.

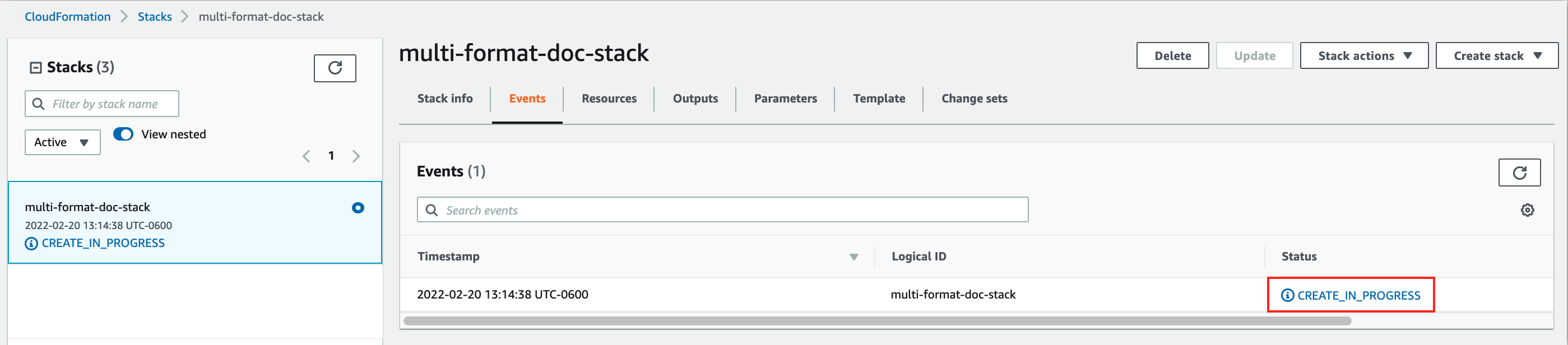

- Selectionnez Créer une pile.

Cela lance le déploiement de la pile dans votre compte AWS.

Une fois la pile déployée avec succès, vous pouvez commencer à tester le pipeline comme décrit dans la section suivante.

Tester le pipeline

Après un déploiement réussi, procédez comme suit pour tester votre pipeline :

- Télécharger exemples de fichiers sur votre ordinateur.

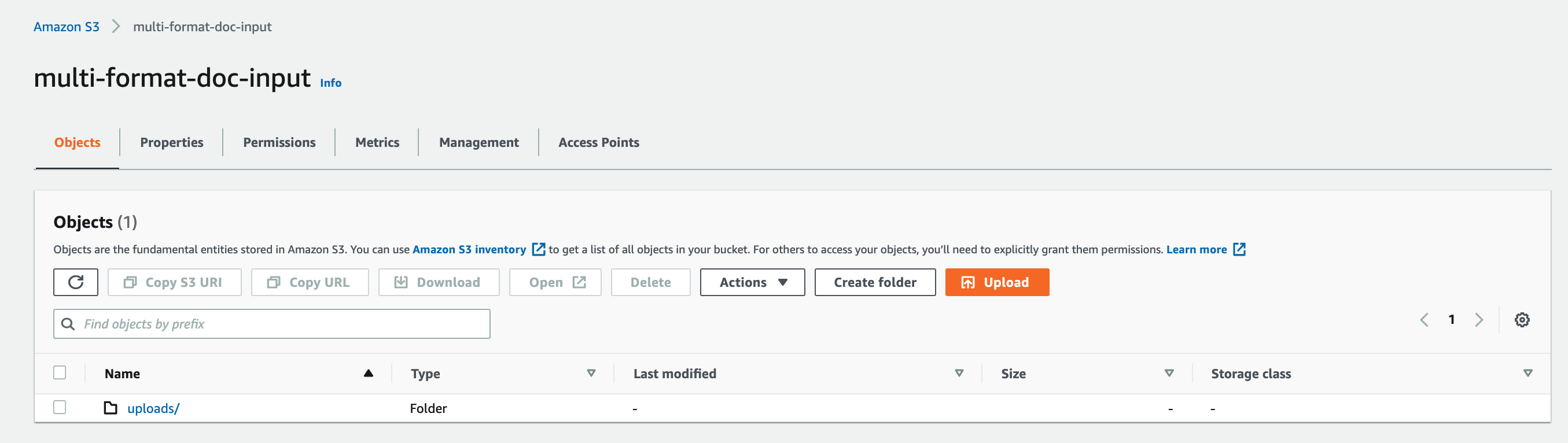

- Créer un

/uploadsdossier (partition) sous le compartiment S3 d'entrée nouvellement créé.

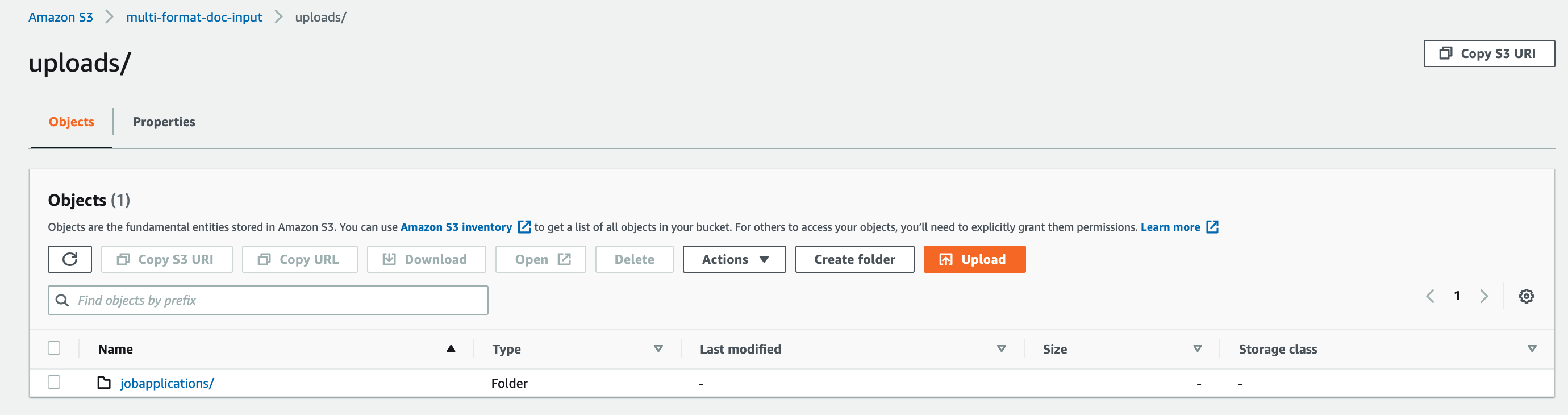

- Créez les dossiers séparés (partitions) comme

jobapplicationssous/uploads.

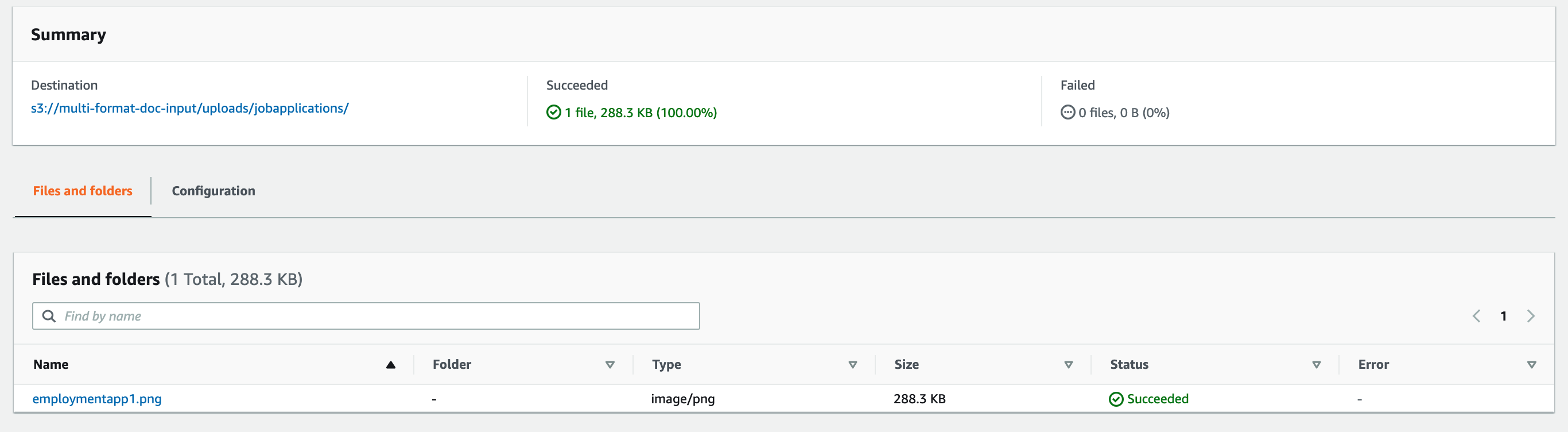

- Téléchargez la première version de la demande d'emploi à partir du dossier d'exemples de documents vers le

/uploads/jobapplicationscloison.

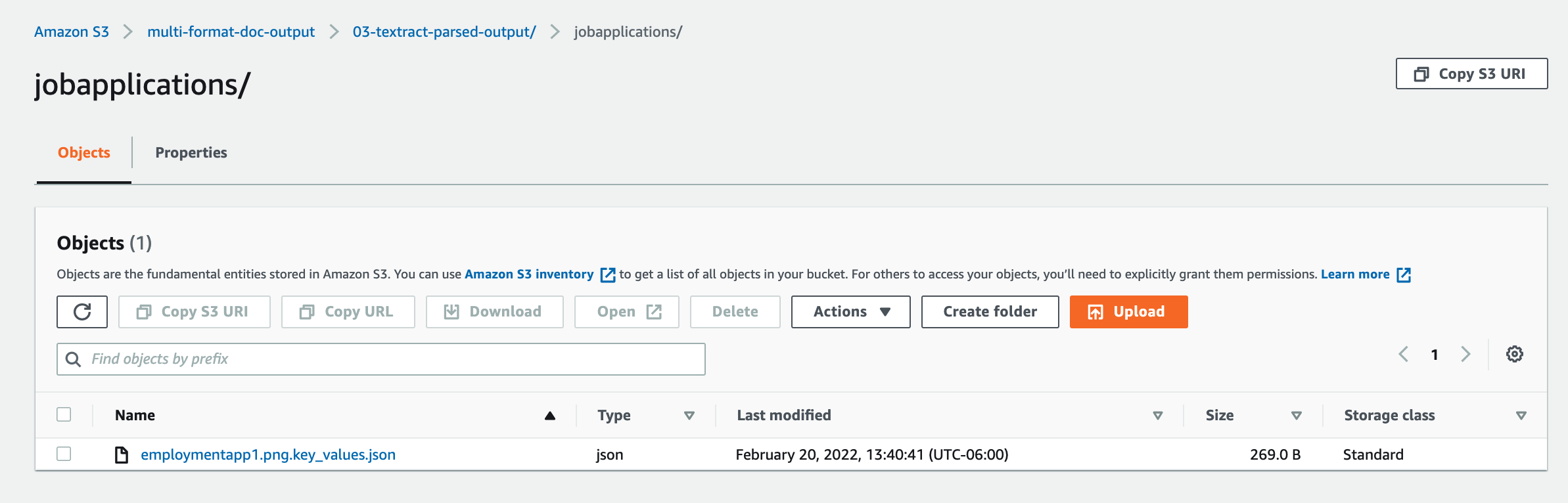

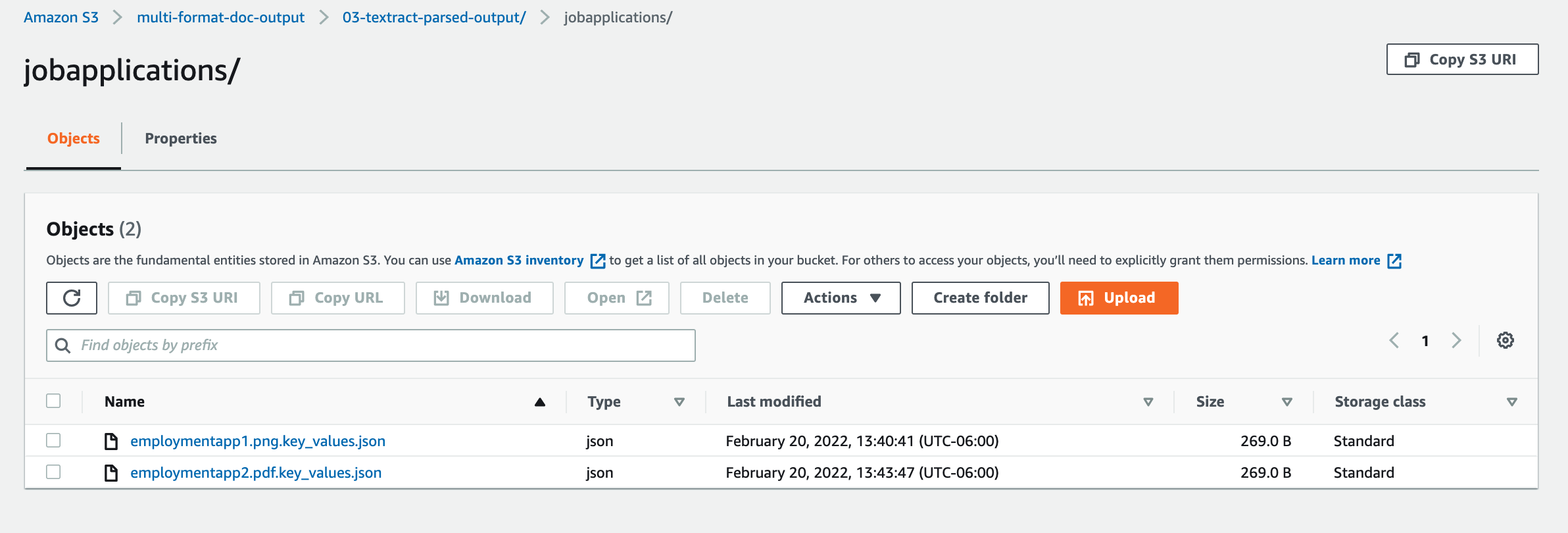

Lorsque le pipeline est terminé, vous pouvez trouver la valeur-clé extraite pour cette version du document dans /OuputS3/03-textract-parsed-output/jobapplications sur la console Amazon S3.

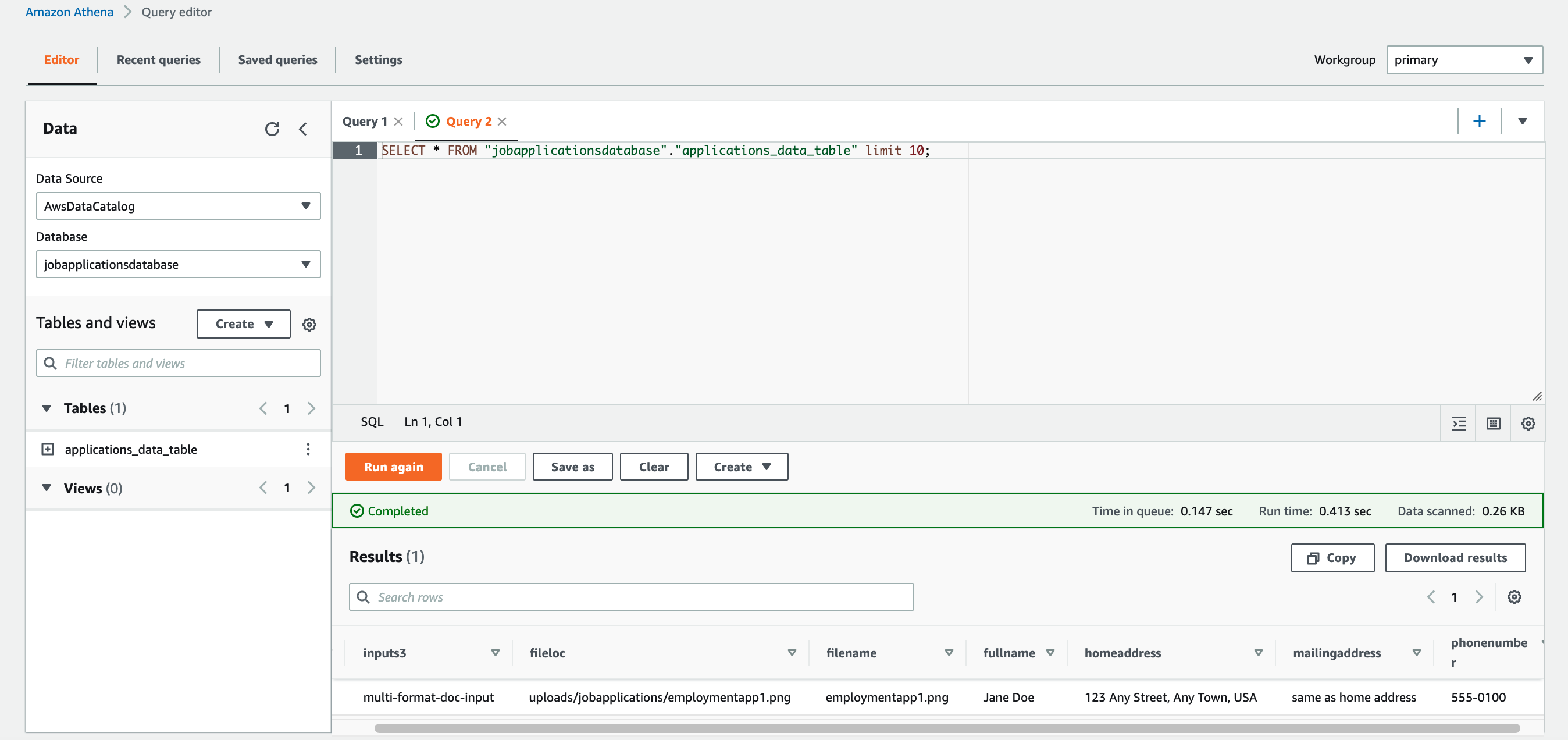

Vous pouvez également le trouver dans le tableau Athéna (applications_data_table) sur le Base de données menu (jobapplicationsdatabase).

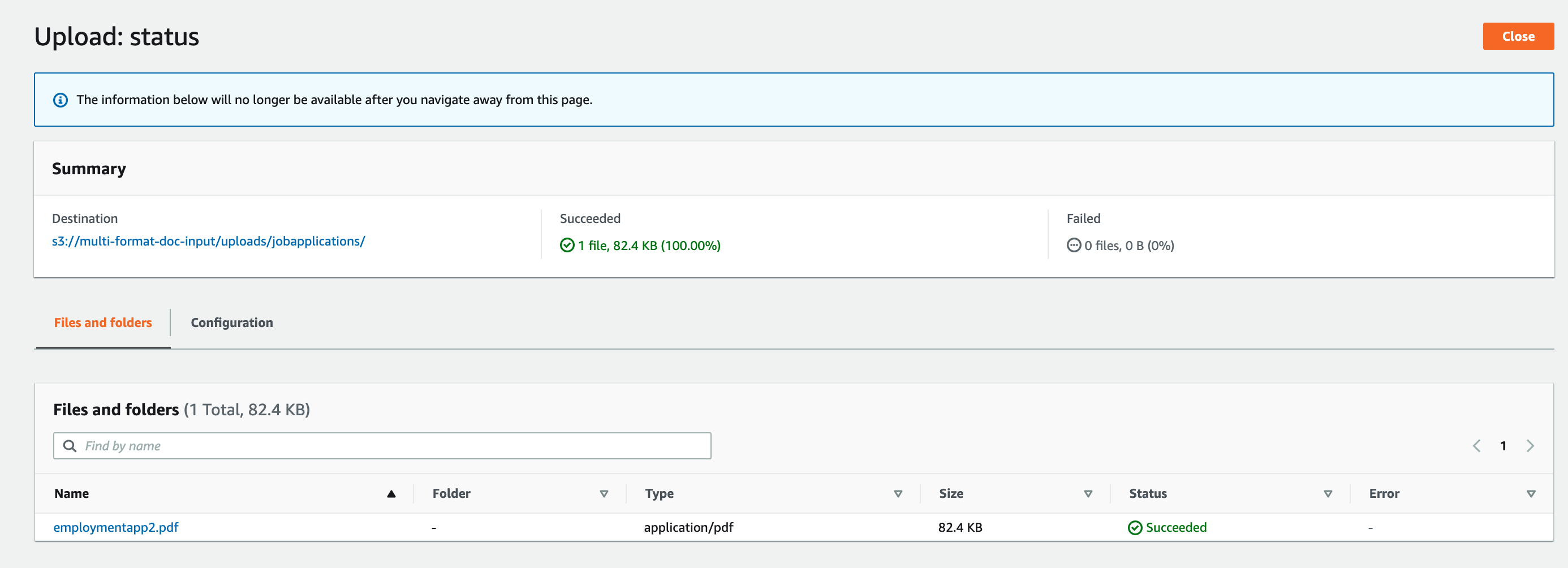

- Téléchargez la deuxième version de la demande d'emploi à partir du dossier d'exemples de documents vers le

/uploads/jobapplicationscloison.

Lorsque le pipeline est terminé, vous pouvez trouver la valeur-clé extraite pour cette version dans /OuputS3/03-textract-parsed-output/jobapplications sur la console Amazon S3.

Vous pouvez également le trouver dans le tableau Athéna (applications_data_table) sur le Base de données menu (jobapplicationsdatabase).

Vous avez terminé! Vous avez déployé votre pipeline avec succès.

Ajouter de nouvelles versions de formulaire

La mise à jour de la solution pour une nouvelle version de formulaire est simple : chaque version de formulaire ne doit être mise à jour qu'en testant les requêtes dans la pile de traitement.

Après avoir effectué les mises à jour, vous pouvez redéployer le pipeline mis à jour à l'aide des API AWS CloudFormation et traiter de nouveaux documents, en arrivant aux mêmes points de données standard pour votre schéma avec un minimum d'interruptions et d'efforts de développement nécessaires pour apporter des modifications à votre pipeline. Cette flexibilité, qui est obtenue en découplant le comportement d'analyse et d'extraction et en utilisant la fonctionnalité JSON SerDe dans Athena, fait de ce pipeline une solution maintenable pour n'importe quel nombre de versions de formulaire que votre organisation doit traiter pour collecter des informations.

Lorsque vous exécutez la solution d'ingestion, les données des formulaires entrants sont automatiquement renseignées dans Athena avec des informations sur les fichiers et les entrées qui leur sont associées. Lorsque les données de vos formulaires passent de données non structurées à des données structurées, elles sont prêtes à être utilisées pour des applications en aval telles que l'analyse, la modélisation ML, etc.

Nettoyer

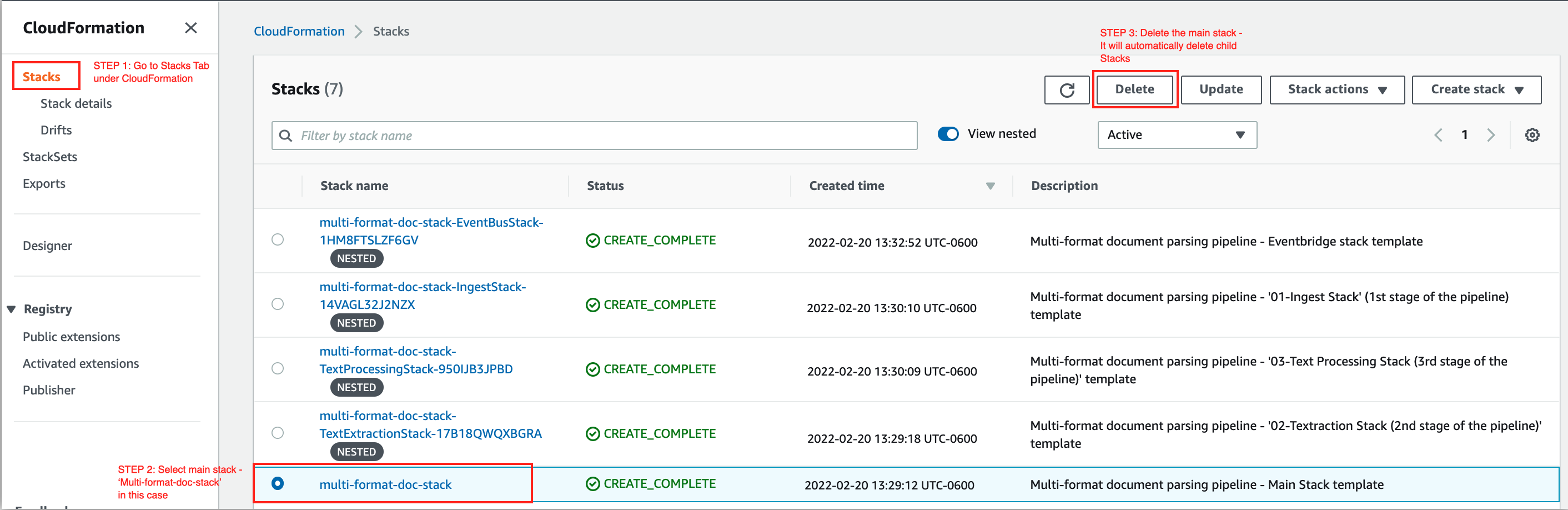

Pour éviter d'encourir des frais permanents, supprimez les ressources que vous avez créées dans le cadre de cette solution lorsque vous avez terminé.

- Sur la console Amazon S3, supprimez manuellement les compartiments que vous avez créés dans le cadre de la pile CloudFormation.

- Sur la console AWS CloudFormation, choisissez Combos dans le volet de navigation.

- Sélectionnez la pile principale et choisissez Supprimer.

Cela supprime automatiquement les piles imbriquées.

Conclusion

Dans cet article, nous avons démontré comment les clients cherchant à tracer et à personnaliser le traitement des documents peuvent créer et déployer un pipeline d'analyse de documents multiformat, sans serveur et piloté par les événements avec Amazon Textract. Ce pipeline fournit une solution maintenable car chaque composant (ingestion, extraction de texte, traitement de texte) est indépendant et isolé, ce qui permet aux organisations d'opérationnaliser leurs solutions pour répondre à divers besoins de traitement.

Essayez la solution aujourd'hui et laissez vos commentaires dans la section des commentaires.

À propos des auteurs

Emilie Soward est un Data Scientist avec AWS Professional Services. Elle est titulaire d'une maîtrise ès sciences avec distinction en intelligence artificielle de l'Université d'Édimbourg en Écosse, au Royaume-Uni, avec un accent sur le traitement du langage naturel (TAL). Emily a occupé des postes scientifiques et d'ingénierie appliqués axés sur la recherche et le développement de produits basés sur l'IA, l'excellence opérationnelle et la gouvernance des charges de travail d'IA exécutées dans des organisations des secteurs public et privé. Elle contribue à l'orientation des clients en tant que conférencière principale d'AWS et, récemment, en tant qu'auteur pour AWS Well-Architected dans l'objectif d'apprentissage automatique.

Emilie Soward est un Data Scientist avec AWS Professional Services. Elle est titulaire d'une maîtrise ès sciences avec distinction en intelligence artificielle de l'Université d'Édimbourg en Écosse, au Royaume-Uni, avec un accent sur le traitement du langage naturel (TAL). Emily a occupé des postes scientifiques et d'ingénierie appliqués axés sur la recherche et le développement de produits basés sur l'IA, l'excellence opérationnelle et la gouvernance des charges de travail d'IA exécutées dans des organisations des secteurs public et privé. Elle contribue à l'orientation des clients en tant que conférencière principale d'AWS et, récemment, en tant qu'auteur pour AWS Well-Architected dans l'objectif d'apprentissage automatique.

Sandeep Singh est un Data Scientist avec AWS Professional Services. Il est titulaire d'une maîtrise ès sciences en systèmes d'information avec concentration en IA et en science des données de l'Université d'État de San Diego (SDSU), en Californie. Il est un scientifique des données complet avec une solide formation en informatique et un conseiller de confiance spécialisé dans la conception de systèmes d'IA et de contrôle. Il se passionne pour aider les clients à orienter leurs projets à fort impact dans la bonne direction, en les conseillant et en les guidant dans leur parcours vers le Cloud et en créant des solutions de pointe compatibles avec l'IA/ML.

Sandeep Singh est un Data Scientist avec AWS Professional Services. Il est titulaire d'une maîtrise ès sciences en systèmes d'information avec concentration en IA et en science des données de l'Université d'État de San Diego (SDSU), en Californie. Il est un scientifique des données complet avec une solide formation en informatique et un conseiller de confiance spécialisé dans la conception de systèmes d'IA et de contrôle. Il se passionne pour aider les clients à orienter leurs projets à fort impact dans la bonne direction, en les conseillant et en les guidant dans leur parcours vers le Cloud et en créant des solutions de pointe compatibles avec l'IA/ML.

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/build-a-traceable-custom-multi-format-document-parsing-pipeline-with-amazon-texttract/

- "

- 100

- Qui sommes-nous

- Compte

- atteint

- à travers

- propos

- Avancée

- AI

- Services d'IA

- Tous

- Permettre

- Amazon

- analytique

- api

- Apis

- Application

- applications

- une approche

- architecture

- artificiel

- intelligence artificielle

- AWS

- fond

- frontière

- construire

- Développement

- la performance des entreprises

- Californie

- Causes

- globaux

- Change

- des charges

- le cloud

- code

- commentaires

- Commun

- composant

- Informatique

- concentration

- Console

- contenu

- des bactéries

- Clients

- données

- science des données

- Data Scientist

- Base de données

- démontré

- déployer

- déploiement

- Conception

- Développement

- différent

- Perturbation

- INSTITUTIONNELS

- ENGINEERING

- événement

- exemple

- Réactions

- Des champs

- la traduction de documents financiers

- services financiers

- Prénom

- Flexibilité

- flux

- concentré

- Abonnement

- formulaire

- le format

- document

- plein

- gouvernance

- la médecine

- Haute

- détient

- Comment

- How To

- HTTPS

- Impact

- secteurs

- industrie

- d'information

- intégrations

- Intelligence

- IT

- Emploi

- Royaume

- langue

- apprentissage

- Laisser

- Location

- click

- machine learning

- maintenir

- gestion

- les gérer

- manuellement

- ML

- Nature

- Navigation

- nombre

- offrant

- Offres Speciales

- ouvert

- organisation

- organisationnel

- organisations

- Autre

- pratique

- Prédictions

- primaire

- Privé

- Problème

- processus

- Produit

- professionels

- projets

- fournit

- public

- un article

- Recherche et développement

- Ressources

- réponse

- Résultats

- Courir

- pour le running

- San

- Sciences

- Scientifique

- secteur

- Secteurs

- recherche

- Sans serveur

- service

- Services

- set

- mise

- étapes

- So

- sur mesure

- Solutions

- RÉSOUDRE

- quelque chose

- Speaker

- empiler

- Commencer

- Région

- state-of-the-art

- storage

- Boutique

- STRONG

- réussi

- Avec succès

- Système

- Target

- impôt

- tester

- Essais

- Avec

- aujourd'hui

- outil

- les outils

- suivre

- traditionnel

- Uni

- Royaume Uni

- université

- Actualités

- utilisé

- Plus-value

- dans les

- de travail

- an

- années