Les entreprises cherchent à libérer rapidement le potentiel de l’IA générative en donnant accès aux modèles de base (FM) à différents secteurs d’activité (LOB). Les équipes informatiques sont chargées d'aider le secteur d'activité à innover avec rapidité et agilité tout en fournissant une gouvernance et une observabilité centralisées. Par exemple, ils peuvent avoir besoin de suivre l'utilisation des FM au sein des équipes, les coûts de rétrofacturation et de fournir une visibilité sur le centre de coûts concerné dans le secteur d'activité. De plus, ils devront peut-être réglementer l’accès à différents modèles par équipe. Par exemple, si seuls des FM spécifiques peuvent être approuvés pour une utilisation.

Socle amazonien est un service entièrement géré qui offre un choix de modèles de base très performants provenant de grandes sociétés d'IA telles que AI21 Labs, Anthropic, Cohere, Meta, Stability AI et Amazon via une seule API, ainsi qu'un large éventail de fonctionnalités pour créer une IA générative. applications avec sécurité, confidentialité et IA responsable. Étant donné qu'Amazon Bedrock est sans serveur, vous n'avez à gérer aucune infrastructure et vous pouvez intégrer et déployer en toute sécurité des fonctionnalités d'IA générative dans vos applications à l'aide des services AWS que vous connaissez déjà.

Une couche logiciel en tant que service (SaaS) pour les modèles de base peut fournir une interface simple et cohérente aux utilisateurs finaux, tout en maintenant une gouvernance centralisée de l'accès et de la consommation. Les passerelles API peuvent fournir un couplage lâche entre les consommateurs de modèles et le service de point de terminaison du modèle, ainsi qu'une flexibilité pour s'adapter à l'évolution du modèle, des architectures et des méthodes d'appel.

Dans cet article, nous vous montrons comment créer une couche SaaS interne pour accéder aux modèles de base avec Amazon Bedrock dans une architecture multi-tenant (équipe). Nous nous concentrons spécifiquement sur le suivi de l'utilisation et des coûts par locataire, ainsi que sur des contrôles tels que la limitation de l'utilisation par locataire. Nous décrivons comment la solution et les plans de consommation d'Amazon Bedrock correspondent au cadre général du parcours SaaS. Le code de la solution et un Kit de développement AWS Cloud (AWS CDK) est disponible dans le GitHub référentiel.

Défis

Un administrateur de plateforme d’IA doit fournir un accès standardisé et facile aux FM à plusieurs équipes de développement.

Voici quelques-uns des défis liés à la fourniture d’un accès gouverné aux modèles de fondation :

- Suivi des coûts et de l'utilisation – Suivre et auditer les coûts des locataires individuels et l'utilisation des modèles de base, et fournir les coûts de rétrofacturation à des centres de coûts spécifiques

- Contrôles du budget et de l'utilisation – Gérer le quota d'API, le budget et les limites d'utilisation pour l'utilisation autorisée des modèles de base sur une fréquence définie par locataire

- Contrôle d'accès et gouvernance des modèles – Définir des contrôles d’accès pour des modèles spécifiques répertoriés par locataire

- API standardisée multi-tenant – Fournir un accès cohérent aux modèles de fondation avec OpenAPI Normes

- Gestion centralisée des API – Fournir une seule couche pour gérer les clés API pour accéder aux modèles

- Versions et mises à jour du modèle – Gérer les déploiements de versions de modèles nouvelles et mises à jour

Vue d'ensemble de la solution

Dans cette solution, nous faisons référence à un multi-locataire approche. UN locataire il peut s'agir d'un utilisateur individuel, d'un projet spécifique, d'une équipe ou même d'un département entier. Lorsque nous discutons de l'approche, nous utilisons le terme équipe, parce que c'est le plus courant. Nous utilisons des clés API pour restreindre et surveiller l'accès aux API pour les équipes. Chaque équipe se voit attribuer une clé API pour accéder aux FM. Il peut y avoir différents mécanismes d’authentification et d’autorisation des utilisateurs déployés dans une organisation. Par souci de simplicité, nous ne les incluons pas dans cette solution. Vous pouvez également intégrer des fournisseurs d'identité existants à cette solution.

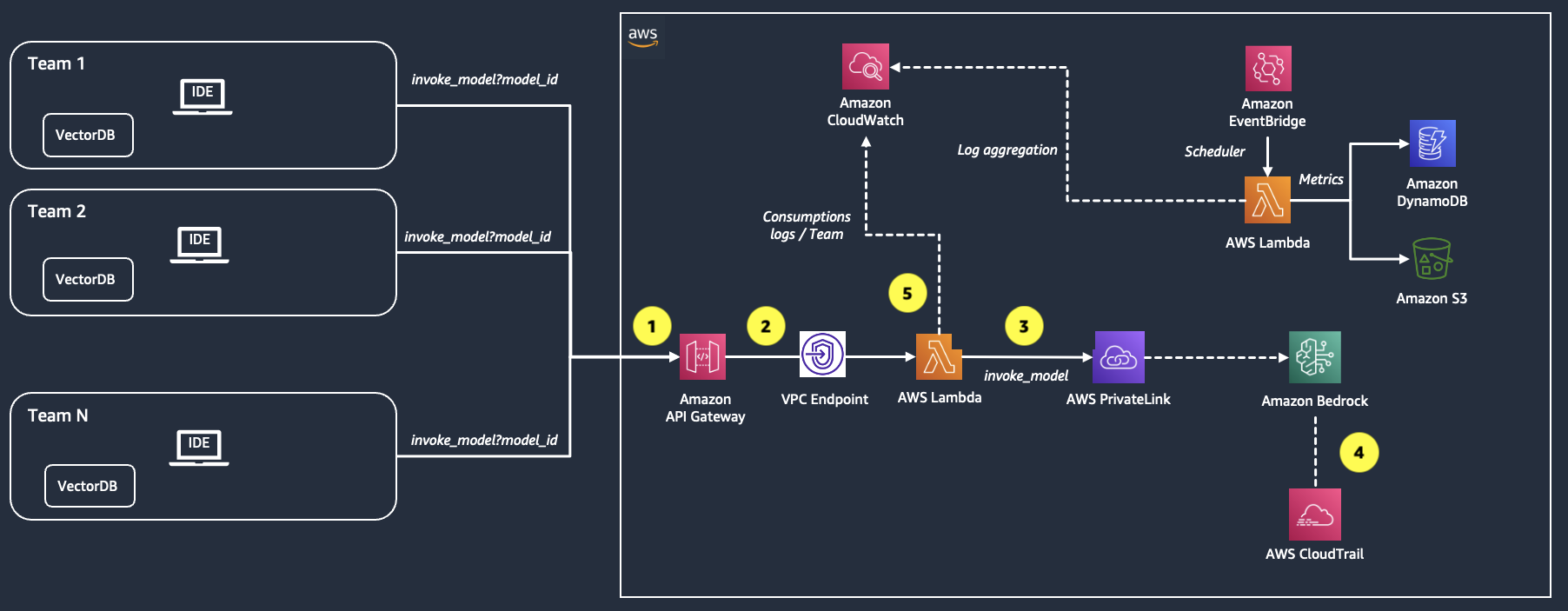

Le diagramme suivant résume l’architecture de la solution et ses composants clés. Les équipes (locataires) affectées à des centres de coûts distincts consomment les Amazon Bedrock FM via un service API. Pour suivre la consommation et le coût par équipe, la solution enregistre les données pour chaque appel individuel, y compris le modèle invoqué, le nombre de jetons pour les modèles de génération de texte et les dimensions de l'image pour les modèles multimodaux. De plus, il regroupe les invocations par modèle et les coûts par chaque équipe.

![]()

Vous pouvez déployer la solution dans votre propre compte à l'aide du AWS CDK. AWS CDK est un cadre de développement logiciel open source permettant de modéliser et de provisionner vos ressources d'application cloud à l'aide de langages de programmation familiers. Le code AWS CDK est disponible dans le GitHub référentiel.

Dans les sections suivantes, nous discutons plus en détail des composants clés de la solution.

Capturer l'utilisation du modèle de base par équipe

Le flux de travail pour capturer l'utilisation de FM par équipe comprend les étapes suivantes (numérotées dans le diagramme précédent) :

- La candidature d'une équipe envoie une requête POST à Passerelle d'API Amazon avec le modèle à invoquer dans le

model_idparamètre de requête et l'invite utilisateur dans le corps de la requête. - API Gateway achemine la requête vers un AWS Lambda fonction (

bedrock_invoke_model) qui est responsable de la journalisation des informations d'utilisation de l'équipe dans Amazon Cloud Watch et en invoquant le modèle Amazon Bedrock. - Amazon Bedrock fournit un point de terminaison VPC alimenté par Lien privé AWS. Dans cette solution, la fonction Lambda envoie la demande à Amazon Bedrock à l'aide de PrivateLink pour établir une connexion privée entre le VPC de votre compte et le compte de service Amazon Bedrock. Pour en savoir plus sur PrivateLink, consultez Utilisez AWS PrivateLink pour configurer un accès privé à Amazon Bedrock.

- Après l'invocation d'Amazon Bedrock, Amazon CloudTrail génère un Événement CloudTrail.

- Si l'appel Amazon Bedrock réussit, la fonction Lambda enregistre les informations suivantes en fonction du type de modèle appelé et renvoie la réponse générée à l'application :

- id_équipe – L’identifiant unique de l’équipe émettrice de la demande.

- ID de demande – L’identifiant unique de la demande.

- id_modèle – L'ID du modèle à appeler.

- jetons d'entrée – Le nombre de jetons envoyés au modèle dans le cadre de l'invite (pour les modèles de génération de texte et d'intégration).

- jetons de sortie – Le nombre maximum de jetons à générer par le modèle (pour les modèles de génération de texte).

- la taille – La hauteur de l’image demandée (pour les modèles multimodaux et les modèles d’intégrations multimodales).

- largeur – La largeur de l’image demandée (pour les modèles multimodaux uniquement).

- mesures – Les étapes demandées (pour les modèles Stability AI).

Suivi des coûts par équipe

Un flux différent regroupe les informations d'utilisation, puis calcule et enregistre quotidiennement les coûts à la demande par équipe. En disposant d'un flux distinct, nous garantissons que le suivi des coûts n'a pas d'impact sur la latence et le débit du flux d'appel du modèle. Les étapes du flux de travail sont les suivantes :

- An Amazon Event Bridge la règle déclenche une fonction Lambda (

bedrock_cost_tracking) du quotidien. - La fonction Lambda obtient les informations d'utilisation de CloudWatch pour la journée précédente, calcule les coûts associés et stocke les données agrégées par

team_idainsi que lesmodel_idin Service de stockage simple Amazon (Amazon S3) au format CSV.

Pour interroger et visualiser les données stockées dans Amazon S3, vous disposez de différentes options, notamment S3 Sélectionneret la Amazon Athena et Amazon QuickSight.

Contrôler l'utilisation par équipe

Un plan d'utilisation spécifie qui peut accéder à une ou plusieurs API déployées et définit éventuellement le taux de requêtes cible pour démarrer la limitation des requêtes. Le plan utilise des clés API pour identifier les clients API qui peuvent accéder à l'API associée pour chaque clé. Vous pouvez utiliser API Gateway plans d'utilisation pour limiter les demandes qui dépassent les seuils prédéfinis. Vous pouvez aussi utiliser Clés API et des limites de quota, qui vous permettent de définir le nombre maximum de requêtes par clé API que chaque équipe est autorisée à émettre dans un intervalle de temps spécifié. Ceci s'ajoute à Quotas de service Amazon Bedrock qui sont attribués uniquement au niveau du compte.

Pré-requis

Avant de déployer la solution, assurez-vous de disposer des éléments suivants :

Déployer la pile AWS CDK

Suivez les instructions du README du référentiel GitHub pour configurer et déployer la pile AWS CDK.

La pile déploie les ressources suivantes :

- Environnement de réseau privé (VPC, sous-réseaux privés, groupe de sécurité)

- Rôle IAM pour contrôler l'accès au modèle

- Couches Lambda pour les modules Python nécessaires

- Fonction Lambda

invoke_model - Fonction Lambda

list_foundation_models - Fonction Lambda

cost_tracking - API de repos (API Gateway)

- Plan d'utilisation d'API Gateway

- Clé API associée au plan d'utilisation

Intégrer une nouvelle équipe

Pour donner accès à de nouvelles équipes, vous pouvez soit partager la même clé API entre différentes équipes et suivre les consommations des modèles en fournissant une clé différente. team_id pour l'appel de l'API, ou créez des clés API dédiées utilisées pour accéder aux ressources Amazon Bedrock en suivant les instructions fournies dans le README.

La pile déploie les ressources suivantes :

- Plan d'utilisation d'API Gateway associé à l'API REST précédemment créée

- Clé API associée au plan d'utilisation pour la nouvelle équipe, avec des configurations de limitation et de rafale réservées pour l'API

Pour plus d'informations sur les configurations de limitation et de rafale d'API Gateway, reportez-vous à Limitez les requêtes API pour un meilleur débit.

Après avoir déployé la pile, vous pouvez voir que la nouvelle clé API pour team-2 est également créé.

![]()

Configurer le contrôle d'accès au modèle

L'administrateur de la plateforme peut autoriser l'accès à des modèles de fondation spécifiques en modifiant la stratégie IAM associée à la fonction Lambda. invoke_modelL’

Les autorisations IAM sont définies dans le fichier setup/stack_constructs/iam.py. Voir le code suivant:

Invoquer le service

Après avoir déployé la solution, vous pouvez appeler le service directement depuis votre code. Ce qui suit

est un exemple en Python pour consommer le invoke_model API de génération de texte via une requête POST :

Résultat : Amazon Bedrock est une plate-forme technologique interne développée par Amazon pour exécuter et exploiter bon nombre de leurs services et produits. Quelques éléments clés à propos de Bedrock…

Ce qui suit est un autre exemple en Python pour consommer le invoke_model API de génération d'intégrations via une requête POST :

model_id = "amazon.titan-embed-text-v1" #the model id for the Amazon Titan Embeddings Text model prompt = "What is Amazon Bedrock?" response = requests.post( f"{api_url}/invoke_model?model_id={model_id}", json={"inputs": prompt, "parameters": model_kwargs}, headers={ "x-api-key": api_key, #key for querying the API "team_id": team_id #unique tenant identifier, "embeddings": "true" #boolean value for the embeddings model }

) text = response.json()[0]["embedding"]

Sortie : 0.91796875, 0.45117188, 0.52734375, -0.18652344, 0.06982422, 0.65234375, -0.13085938, 0.056884766, 0.092285156, 0.06982422, 1.03125, 0.8515625, 0.16308594, 0.079589844, -0.033935547, 0.796875, -0.15429688, -0.29882812, -0.25585938, 0.45703125, 0.044921875 0.34570312, XNUMX…

Accès refusé aux modèles de fondation

Ce qui suit est un exemple en Python pour consommer le invoke_model API pour la génération de texte via une requête POST avec une réponse d'accès refusé :

"Traceback (dernier appel le plus récent) :n Fichier "/var/task/index.py", ligne 213, dans la réponse lambda_handlern = _invoke_text(bedrock_client, model_id, body, model_kwargs)n Fichier "/var/task/index.py ", ligne 146, dans _invoke_textn raise en File "/var/task/index.py", ligne 131, dans _invoke_textn réponse = bedrock_client.invoke_model(n File "/opt/python/botocore/client.py", ligne 535, dans _api_calln, retournez self._make_api_call(operation_name, kwargs)n File ”/opt/python/botocore/client.py”, ligne 980, dans _make_api_calln lève error_class(parsed_response, operation_name)nbotocore.errorfactory.AccessDeniedException : Une erreur s'est produite (AccessDeniedException) lors de l'appel de l'opération InvokeModel : Votre compte n'est pas autorisé à invoquer cette opération API.n »

Exemple d'estimation des coûts

Lors de l'appel de modèles Amazon Bedrock avec tarification à la demande, le coût total est calculé comme la somme des coûts d'entrée et de sortie. Les coûts d'entrée sont basés sur le nombre de jetons d'entrée envoyés au modèle, et les coûts de sortie sont basés sur les jetons générés. Les prix sont pour 1,000 1,000 jetons d’entrée et pour XNUMX XNUMX jetons de sortie. Pour plus de détails et les prix des modèles spécifiques, reportez-vous à Tarification du substrat rocheux d’Amazon.

Examinons un exemple dans lequel deux équipes, team1 et team2, accèdent à Amazon Bedrock via la solution présentée dans cet article. Les données d'utilisation et de coût enregistrées dans Amazon S3 au cours d'une seule journée sont présentées dans le tableau suivant.

Les colonnes input_tokens ainsi que les output_tokens stockez le total des jetons d'entrée et de sortie pour les appels de modèle par modèle et par équipe, respectivement, pour une journée donnée.

Les colonnes input_cost ainsi que les output_cost stocker les coûts respectifs par modèle et par équipe. Ceux-ci sont calculés à l'aide des formules suivantes :

input_cost = input_token_count * model_pricing["input_cost"] / 1000output_cost = output_token_count * model_pricing["output_cost"] / 1000

| id_équipe | id_modèle | jetons_d'entrée | jetons_de sortie | appels | coût_entrée | coût_sortie |

| Team1 | amazon.titan-tg1-large | 24000 | 2473 | 1000 | 0.0072 | 0.00099 |

| Team1 | anthropique.claude-v2 | 2448 | 4800 | 24 | 0.02698 | 0.15686 |

| Team2 | amazon.titan-tg1-large | 35000 | 52500 | 350 | 0.0105 | 0.021 |

| Team2 | ai21.j2-grande-instruct | 4590 | 9000 | 45 | 0.05738 | 0.1125 |

| Team2 | anthropique.claude-v2 | 1080 | 4400 | 20 | 0.0119 | 0.14379 |

Vue de bout en bout d'un environnement SaaS sans serveur multi-tenant fonctionnel

Comprenons à quoi pourrait ressembler un environnement SaaS sans serveur multi-tenant fonctionnel de bout en bout. Ce qui suit est un diagramme d'architecture de référence.

![]()

Ce diagramme d'architecture est une version agrandie du diagramme d'architecture précédent expliqué plus tôt dans l'article, où le diagramme d'architecture précédent explique les détails de l'un des microservices mentionnés (service de modèle fondamental). Ce diagramme explique que, outre le service de modèle de base, vous devez également disposer d'autres composants dans votre plate-forme SaaS multi-tenant pour implémenter une plate-forme fonctionnelle et évolutive.

Passons en revue les détails de l'architecture.

Demandes des locataires

Les applications client sont les applications frontales qui interagissent avec l'environnement. Ici, nous montrons plusieurs locataires accédant à partir de différents environnements locaux ou AWS. Les applications frontales peuvent être étendues pour inclure une page d'inscription permettant aux nouveaux locataires de s'inscrire eux-mêmes et une console d'administration pour les administrateurs de la couche de service SaaS. Si les applications locataires nécessitent l’implémentation d’une logique personnalisée nécessitant une interaction avec l’environnement SaaS, elles peuvent implémenter les spécifications du microservice de l’adaptateur d’application. Des exemples de scénarios pourraient consister à ajouter une logique d'autorisation personnalisée tout en respectant les spécifications d'autorisation de l'environnement SaaS.

Services partagés

Les services suivants sont partagés :

- Services de gestion des locataires et des utilisateurs –Ces services sont chargés de l’inscription et de la gestion des locataires. Ils fournissent des fonctionnalités transversales distinctes des services d’application et partagées par tous les locataires.

- Service de modèle de fondation –Le diagramme d'architecture de solution expliqué au début de cet article représente ce microservice, où l'interaction d'API Gateway vers les fonctions Lambda se produit dans le cadre de ce microservice. Tous les locataires utilisent ce microservice pour invoquer les modèles de base d'Anthropic, AI21, Cohere, Stability, Meta et Amazon, ainsi que des modèles affinés. Il capture également les informations nécessaires au suivi de l'utilisation dans les journaux CloudWatch.

- Service de suivi des coûts –Ce service suit le coût et l’utilisation de chaque locataire. Ce microservice s'exécute selon une planification pour interroger les journaux CloudWatch et générer le suivi de l'utilisation agrégé et le coût déduit pour le stockage de données. Le service de suivi des coûts peut être étendu pour créer d’autres rapports et visualisations.

Service d'adaptateur d'application

Ce service présente un ensemble de spécifications et d'API qu'un locataire peut implémenter afin d'intégrer sa logique personnalisée à l'environnement SaaS. En fonction du degré d'intégration personnalisée nécessaire, ce composant peut être facultatif pour les locataires.

Magasin de données multi-locataires

Les services partagés stockent leurs données dans un magasin de données qui peut être un seul stockage partagé. Amazon DynamoDB table avec une clé de partitionnement de locataire qui associe les éléments DynamoDB à des locataires individuels. Le service partagé de suivi des coûts envoie les données agrégées d'utilisation et de suivi des coûts vers Amazon S3. En fonction du cas d'utilisation, il peut également exister un magasin de données spécifique à l'application.

Un environnement SaaS multi-locataires peut comporter beaucoup plus de composants. Pour plus d'informations, reportez-vous à Création d'une solution SaaS multi-locataires à l'aide des services sans serveur AWS.

Prise en charge de plusieurs modèles de déploiement

Les frameworks SaaS décrivent généralement deux modèles de déploiement : pool et silo. Pour le modèle de pool, tous les locataires accèdent aux FM à partir d’un environnement partagé avec une infrastructure de stockage et de calcul commune. Dans le modèle en silo, chaque locataire dispose de son propre ensemble de ressources dédiées. Vous pouvez en savoir plus sur les modèles d'isolation dans le Livre blanc sur les stratégies d'isolation des locataires SaaS.

La solution proposée peut être adoptée pour les deux modèles de déploiement SaaS. Dans l'approche pool, un environnement AWS centralisé héberge les ressources d'API, de stockage et de calcul. En mode silo, chaque équipe accède aux API, au stockage et aux ressources de calcul dans un environnement AWS dédié.

La solution s'adapte également aux plans de consommation disponibles fournis par Amazon Bedrock. AWS propose un choix de deux plans de consommation pour l'inférence :

- À la demande – Ce mode vous permet d'utiliser des modèles de fondation sur une base de répartition sans avoir à prendre d'engagements à terme basés sur le temps.

- Débit provisionné – Ce mode vous permet de fournir un débit suffisant pour répondre aux exigences de performances de votre application en échange d'un engagement à terme basé sur le temps.

Pour plus d'informations sur ces options, reportez-vous à Tarification du substrat rocheux d’Amazon.

La solution de référence SaaS sans serveur décrite dans cet article peut appliquer les plans de consommation Amazon Bedrock pour fournir des options de hiérarchisation de base et premium aux utilisateurs finaux. Basic peut inclure la consommation à la demande ou à débit provisionné d'Amazon Bedrock et peut inclure des limites d'utilisation et de budget spécifiques. Les limites des locataires peuvent être activées en limitant les demandes en fonction des demandes, de la taille des jetons ou de l'allocation budgétaire. Les locataires du niveau Premium pourraient disposer de leurs propres ressources dédiées avec une consommation de débit provisionnée d'Amazon Bedrock. Ces locataires sont généralement associés à des charges de travail de production qui nécessitent un accès à haut débit et à faible latence aux Amazon Bedrock FM.

Conclusion

Dans cet article, nous avons expliqué comment créer une plate-forme SaaS interne pour accéder aux modèles de base avec Amazon Bedrock dans une configuration multi-locataire en mettant l'accent sur le suivi des coûts et de l'utilisation, ainsi que sur les limites de limitation pour chaque locataire. Les sujets supplémentaires à explorer incluent l'intégration des solutions d'authentification et d'autorisation existantes dans l'organisation, l'amélioration de la couche API pour inclure des sockets Web pour les interactions client-serveur bidirectionnelles, l'ajout de filtrage de contenu et d'autres garde-fous de gouvernance, la conception de plusieurs niveaux de déploiement, l'intégration d'autres microservices dans le SaaS. l'architecture, et bien d'autres encore.

Le code complet de cette solution est disponible dans le GitHub référentiel.

Pour plus d'informations sur les frameworks SaaS, reportez-vous à SaaS Journey Framework : créer une nouvelle solution SaaS sur AWS.

À propos des auteurs

![]() Hassan Poonawala est un architecte de solutions spécialisé senior en IA/ML chez AWS, travaillant avec des clients de la santé et des sciences de la vie. Hasan aide à concevoir, déployer et faire évoluer des applications d'IA générative et d'apprentissage automatique sur AWS. Il possède plus de 15 ans d'expérience professionnelle combinée dans l'apprentissage automatique, le développement de logiciels et la science des données sur le cloud. Dans ses temps libres, Hasan aime explorer la nature et passer du temps avec ses amis et sa famille.

Hassan Poonawala est un architecte de solutions spécialisé senior en IA/ML chez AWS, travaillant avec des clients de la santé et des sciences de la vie. Hasan aide à concevoir, déployer et faire évoluer des applications d'IA générative et d'apprentissage automatique sur AWS. Il possède plus de 15 ans d'expérience professionnelle combinée dans l'apprentissage automatique, le développement de logiciels et la science des données sur le cloud. Dans ses temps libres, Hasan aime explorer la nature et passer du temps avec ses amis et sa famille.

![]() Anastasia Tzeveleka est architecte senior de solutions spécialisées en IA/ML chez AWS. Dans le cadre de son travail, elle aide les clients de la région EMEA à élaborer des modèles de base et à créer des solutions évolutives d'IA générative et d'apprentissage automatique à l'aide des services AWS.

Anastasia Tzeveleka est architecte senior de solutions spécialisées en IA/ML chez AWS. Dans le cadre de son travail, elle aide les clients de la région EMEA à élaborer des modèles de base et à créer des solutions évolutives d'IA générative et d'apprentissage automatique à l'aide des services AWS.

![]() Brupas de piston est un architecte de solutions spécialisé en IA générative et en ML pour AWS basé à Milan. Il travaille avec de grands clients en les aidant à comprendre en profondeur leurs besoins techniques et à concevoir des solutions d'IA et d'apprentissage automatique qui tirent le meilleur parti du cloud AWS et de la pile Amazon Machine Learning. Son expertise comprend : l'apprentissage automatique de bout en bout, l'industrialisation de l'apprentissage automatique et l'IA générative. Il aime passer du temps avec ses amis et explorer de nouveaux endroits, ainsi que voyager vers de nouvelles destinations.

Brupas de piston est un architecte de solutions spécialisé en IA générative et en ML pour AWS basé à Milan. Il travaille avec de grands clients en les aidant à comprendre en profondeur leurs besoins techniques et à concevoir des solutions d'IA et d'apprentissage automatique qui tirent le meilleur parti du cloud AWS et de la pile Amazon Machine Learning. Son expertise comprend : l'apprentissage automatique de bout en bout, l'industrialisation de l'apprentissage automatique et l'IA générative. Il aime passer du temps avec ses amis et explorer de nouveaux endroits, ainsi que voyager vers de nouvelles destinations.

![]() Vikesh Pandey est un architecte de solutions génératives d'IA/ML, spécialisé dans les services financiers où il aide les clients financiers à créer et à faire évoluer des plates-formes et des solutions d'IA/ML génératives qui s'adaptent à des centaines, voire des milliers d'utilisateurs. Pendant son temps libre, Vikesh aime écrire sur divers forums de blogs et construire des legos avec son enfant.

Vikesh Pandey est un architecte de solutions génératives d'IA/ML, spécialisé dans les services financiers où il aide les clients financiers à créer et à faire évoluer des plates-formes et des solutions d'IA/ML génératives qui s'adaptent à des centaines, voire des milliers d'utilisateurs. Pendant son temps libre, Vikesh aime écrire sur divers forums de blogs et construire des legos avec son enfant.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-an-internal-saas-service-with-cost-and-usage-tracking-for-foundation-models-on-amazon-bedrock/

- :possède

- :est

- :ne pas

- :où

- $UP

- 000

- 1

- 120

- 15 ans

- 15%

- 160

- 26%

- 500

- 7

- a

- Qui sommes-nous

- accès

- accès

- Compte

- à travers

- adapter

- ajoutant

- ajout

- Supplémentaire

- En outre

- admin

- administrateurs

- adopté

- agrégats

- AI

- Modèles AI

- Plateforme IA

- AI / ML

- Tous

- allocation

- permettre

- permet

- le long de

- déjà

- aussi

- Amazon

- Apprentissage automatique d'Amazon

- Amazon QuickSight

- Amazon Web Services

- an

- ainsi que les

- Une autre

- Anthropique

- tous

- A PART

- api

- Accès API

- CLÉS API

- Apis

- Application

- applications

- Appliquer

- une approche

- ,

- architecture

- architectures

- SONT

- AS

- attribué

- associé

- associés

- At

- audit

- Authentification

- autorisation

- autorisé

- disponibles

- AWS

- basé

- Essentiel

- base

- BE

- car

- Début

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- Blog

- corps

- tous les deux

- vaste

- budget

- construire

- Développement

- la performance des entreprises

- by

- calculé

- calcule

- Appelez-nous

- appel

- CAN

- capacités

- capturer

- captures

- maisons

- Canaux centraux

- Centres

- centralisée

- globaux

- en changeant

- le choix

- client

- CLIENTS

- le cloud

- code

- Colonnes

- combiné

- Commun

- Sociétés

- composant

- composants électriques

- calcul

- configuration

- connexion

- cohérent

- consiste

- Console

- consommer

- Les consommateurs

- consommant

- consommation

- contenu

- des bactéries

- contrôle

- contrôles

- Prix

- Costs

- pourriez

- engendrent

- créée

- Customiser

- Clients

- Tous les jours

- données

- science des données

- stockage de données

- journée

- dévoué

- profondément

- Vous permet de définir

- défini

- dénié

- Département

- Selon

- déployer

- déployé

- déploiement

- déploie

- décrire

- décrit

- Conception

- conception

- destinations

- détail

- détails

- développé

- Développement

- équipes de développement

- diagramme

- différent

- dimensions

- directement

- discuter

- discuté

- do

- Ne fait pas

- Ne pas

- chacun

- Plus tôt

- Easy

- effet

- non plus

- enrobage

- EMEA

- permettre

- activé

- fin

- end-to-end

- Endpoint

- améliorer

- assurer

- Tout

- Environment

- environnements

- erreur

- établir

- Pourtant, la

- événement

- exemple

- dépassent

- échange

- existant

- d'experience

- nous a permis de concevoir

- expliqué

- Explique

- explorez

- Explorer

- express

- prolongé

- familier

- famille

- Déposez votre dernière attestation

- filtration

- la traduction de documents financiers

- services financiers

- fits

- Flexibilité

- flux

- Focus

- Abonnement

- suit

- Pour

- le format

- forums

- Fondation

- Fondationale

- Fondations

- Framework

- cadres

- La fréquence

- amis

- de

- avant

- L'extrémité avant

- d’étiquettes électroniques entièrement

- fonction

- fonctionnel

- fonctions

- plus

- porte

- passerelles

- Général

- généré

- génère

- génération

- génératif

- IA générative

- obtient

- GitHub

- donné

- Go

- gouvernance

- régie

- Réservation de groupe

- manipuler

- EN COURS

- Vous avez

- ayant

- he

- la médecine

- la taille

- aider

- aide

- ici

- ici

- Haute

- haute performance

- sa

- hôtes

- Comment

- How To

- HTML

- http

- HTTPS

- Des centaines

- ID

- identifiant

- identifier

- Identite

- if

- image

- Impact

- Mettre en oeuvre

- mis en œuvre

- in

- comprendre

- Y compris

- individuel

- inféré

- d'information

- Infrastructure

- innovons

- contribution

- entrées

- Des instructions

- intégrer

- Intégration

- l'intégration

- interagir

- l'interaction

- interactions

- Interfaces

- interne

- développement

- invoqué

- seul

- aide

- émission

- IT

- articles

- SES

- chemin

- jpg

- ACTIVITES

- clés

- Enfant

- Labs

- Langues

- gros

- Nom de famille

- Latence

- couche

- poules pondeuses

- conduisant

- APPRENTISSAGE

- apprentissage

- Niveau

- VIE

- Life Sciences

- comme

- aime

- limites

- Gamme

- lignes

- Listé

- locales

- enregistrement

- logique

- Style

- ressembler

- Lot

- aime

- Faible

- click

- machine learning

- Maintenir

- a prendre une

- gérer

- gérés

- gestion

- les gérer

- de nombreuses

- Localisation

- maximales

- Mai..

- mécanismes

- Découvrez

- mentionné

- Meta

- méthodes

- microservice

- microservices

- pourrait

- EAU DE COLOGNE MILAN

- ML

- Mode

- modèle

- numériques jumeaux (digital twin models)

- Surveiller

- PLUS

- (en fait, presque toutes)

- beaucoup

- plusieurs

- Nature

- nécessaire

- Besoin

- nécessaire

- Besoins

- de mise en réseau

- Nouveauté

- nombre

- numéroté

- a eu lieu

- of

- Offres Speciales

- on

- À la demande

- ONE

- uniquement

- ouvert

- open source

- fonctionner

- opération

- Options

- or

- de commander

- organisation

- Autre

- contour

- sortie

- sorties

- plus de

- propre

- page

- paramètre

- paramètres

- partie

- /

- performant

- autorisations

- Des endroits

- plan

- plans

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- politique

- pool

- Post

- défaillances

- alimenté

- précédant

- prédéfini

- Premium

- cadeaux

- précédent

- précédemment

- Tarifs

- établissement des prix

- la confidentialité

- Privé

- Vidéo

- Produits

- Programmation

- langages de programmation

- Projet

- proposé

- fournir

- à condition de

- fournisseurs

- fournit

- aportando

- disposition

- Python

- question

- vite.

- augmenter

- gamme

- Tarif

- Lire

- récent

- reportez-vous

- référence

- vous inscrire

- enregistrement

- Inscription

- Réglementer

- pertinent

- Rapports

- dépôt

- représente

- nécessaire

- demandes

- exigent

- Exigences

- réservé

- Resources

- respectant

- ceux

- respectivement

- réponse

- responsables

- REST

- restreindre

- retourner

- Retours

- Rôle

- routes

- Règle

- Courir

- fonctionne

- SaaS.

- même

- sauvé

- évolutive

- Escaliers intérieurs

- Balance

- scénarios

- calendrier

- Sciences

- STARFLEET SCIENCES

- portée

- les sections

- en toute sécurité

- sécurité

- sur le lien

- recherche

- AUTO

- envoie

- supérieur

- envoyé

- séparé

- serveur

- Sans serveur

- service

- Services

- set

- Sets

- installation

- Partager

- commun

- elle

- montrer

- montré

- étapes

- simplicité

- unique

- tailles

- Logiciels

- logiciel en tant que service

- développement de logiciels

- sur mesure

- Solutions

- quelques

- Identifier

- spécialisation

- spécialiste

- groupe de neurones

- spécifiquement

- caractéristiques

- spécifié

- vitesse

- passer

- Dépenses

- Stabilité

- empiler

- Commencer

- Étapes

- storage

- Boutique

- stockée

- STORES

- les stratégies

- sous-réseaux

- réussi

- tel

- suffisant

- sûr

- table

- Target

- équipe

- équipes

- Technique

- Technologie

- modèle

- locataire

- terme

- texte

- qui

- Les

- les informations

- leur

- Les

- se

- puis

- Là.

- Ces

- l'ont

- des choses

- this

- milliers

- Avec

- débit

- étage

- fiable

- Titan

- à

- jeton

- Tokens

- Les sujets

- Total

- suivre

- Tracking

- vos titres

- oui

- deux

- type

- typiquement

- comprendre

- expérience unique et authentique

- ouvrir

- a actualisé

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- v1

- Plus-value

- divers

- version

- versions

- via

- Voir

- définition

- visualisation

- visualiser

- we

- web

- services Web

- Prises Web

- WELL

- Quoi

- Qu’est ce qu'

- quand

- qui

- tout en

- WHO

- largeur

- comprenant

- dans les

- sans

- activités principales

- workflow

- de travail

- vos contrats

- pourra

- écrire

- années

- Vous n'avez

- Votre

- zéphyrnet