À mesure que les organisations grandissent en taille et en échelle, la complexité de l'exécution des charges de travail augmente et la nécessité de développer et d'opérationnaliser les processus et les flux de travail devient critique. Par conséquent, les organisations ont adopté les meilleures pratiques technologiques, notamment l'architecture de microservices, les MLOps, les DevOps, etc., pour améliorer les délais de livraison, réduire les défauts et augmenter la productivité des employés. Cet article présente une meilleure pratique pour gérer le code personnalisé dans votre Flux de travail Amazon SageMaker Data Wrangler.

Data Wrangler est un outil low-code qui facilite l'analyse, le prétraitement et la visualisation des données. Il contient plus de 300 étapes de transformation de données intégrées pour faciliter l'ingénierie, la normalisation et le nettoyage des fonctionnalités afin de transformer vos données sans avoir à écrire de code.

En plus des transformations intégrées, Data Wrangler contient un éditeur de code personnalisé qui vous permet d'implémenter du code personnalisé écrit en Python, PySpark ou SparkSQL.

Lorsque vous utilisez les étapes de transformation personnalisées de Data Wrangler pour implémenter vos fonctions personnalisées, vous devez mettre en œuvre les meilleures pratiques concernant le développement et le déploiement de code dans les flux Data Wrangler.

Cet article montre comment vous pouvez utiliser le code stocké dans Code AWSCommit dans l'étape de transformation personnalisée Data Wrangler. Cela vous offre des avantages supplémentaires, notamment :

- Améliorez la productivité et la collaboration entre le personnel et les équipes

- Versionnez votre code personnalisé

- Modifiez votre étape de transformation personnalisée Data Wrangler sans avoir à vous connecter à Amazon SageMakerStudio utiliser Data Wrangler

- Fichiers de paramètres de référence dans votre étape de transformation personnalisée

- Scanner le code dans CodeCommit en utilisant Amazon CodeGuru ou application tierce pour les vulnérabilités de sécurité avant de l'utiliser dans Data Wrangler flowssagemake

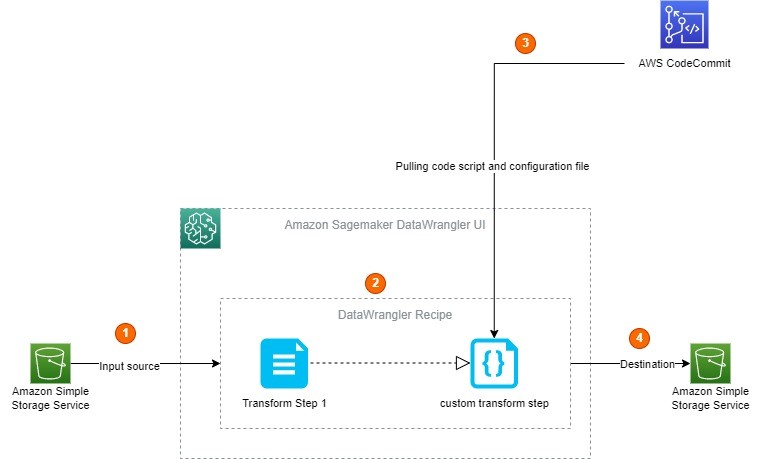

Vue d'ensemble de la solution

Cet article montre comment créer un fichier de flux Data Wrangler avec une étape de transformation personnalisée. Au lieu de coder en dur la fonction personnalisée dans votre étape de transformation personnalisée, vous extrayez un script contenant la fonction de CodeCommit, le chargez et appelez la fonction chargée dans votre étape de transformation personnalisée.

Pour cet article, nous utilisons le bank-full.csv données de la Référentiel d'apprentissage automatique Irving de l'Université de Californie pour démontrer ces fonctionnalités. Les données sont liées aux campagnes de marketing direct d'une institution bancaire. Souvent, plusieurs contacts avec le même client ont été nécessaires pour évaluer si le produit (dépôt à terme bancaire) serait souscrit (yes) ou non abonné (no).

Le schéma suivant illustre cette solution.

Le flux de travail est le suivant :

- Créez un fichier de flux Data Wrangler et importez l'ensemble de données à partir de Service de stockage simple Amazon (Amazon S3).

- Créez une série d'étapes de transformation Data Wrangler :

- Une étape de transformation personnalisée pour implémenter un code personnalisé stocké dans CodeCommit.

- Deux étapes de transformation intégrées.

Nous réduisons les étapes de transformation au minimum afin de ne pas nuire à l'objectif de cet article, qui se concentre sur l'étape de transformation personnalisée. Pour plus d'informations sur les étapes de transformation disponibles et la mise en œuvre, reportez-vous à Transformer les données et par Blog Data Wrangler.

- Dans l'étape de transformation personnalisée, écrivez du code pour extraire le script et le fichier de configuration de CodeCommit, chargez le script en tant que module Python et appelez une fonction dans le script. La fonction prend un fichier de configuration comme argument.

- Exécutez une tâche Data Wrangler et définissez Amazon S3 comme destination.

Les options de destination incluent également Magasin de fonctionnalités Amazon SageMaker.

Pré-requis

Comme condition préalable, nous configurons le référentiel CodeCommit, le flux Data Wrangler et les autorisations CodeCommit.

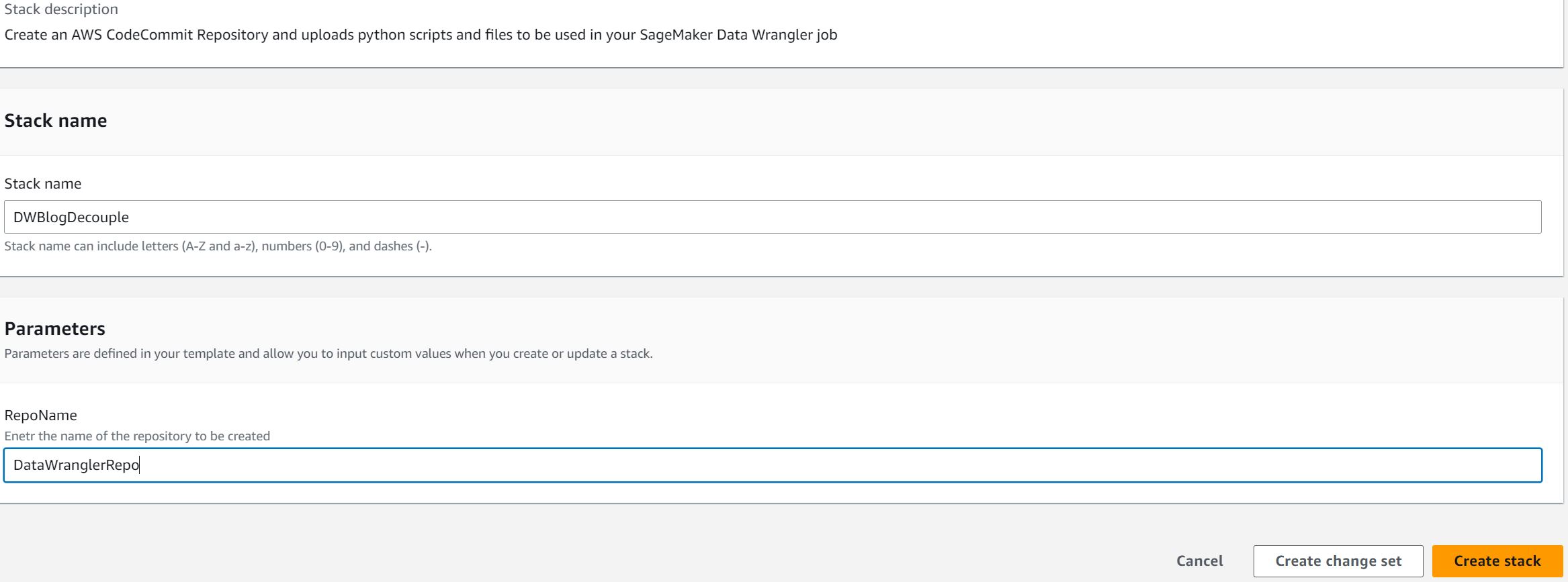

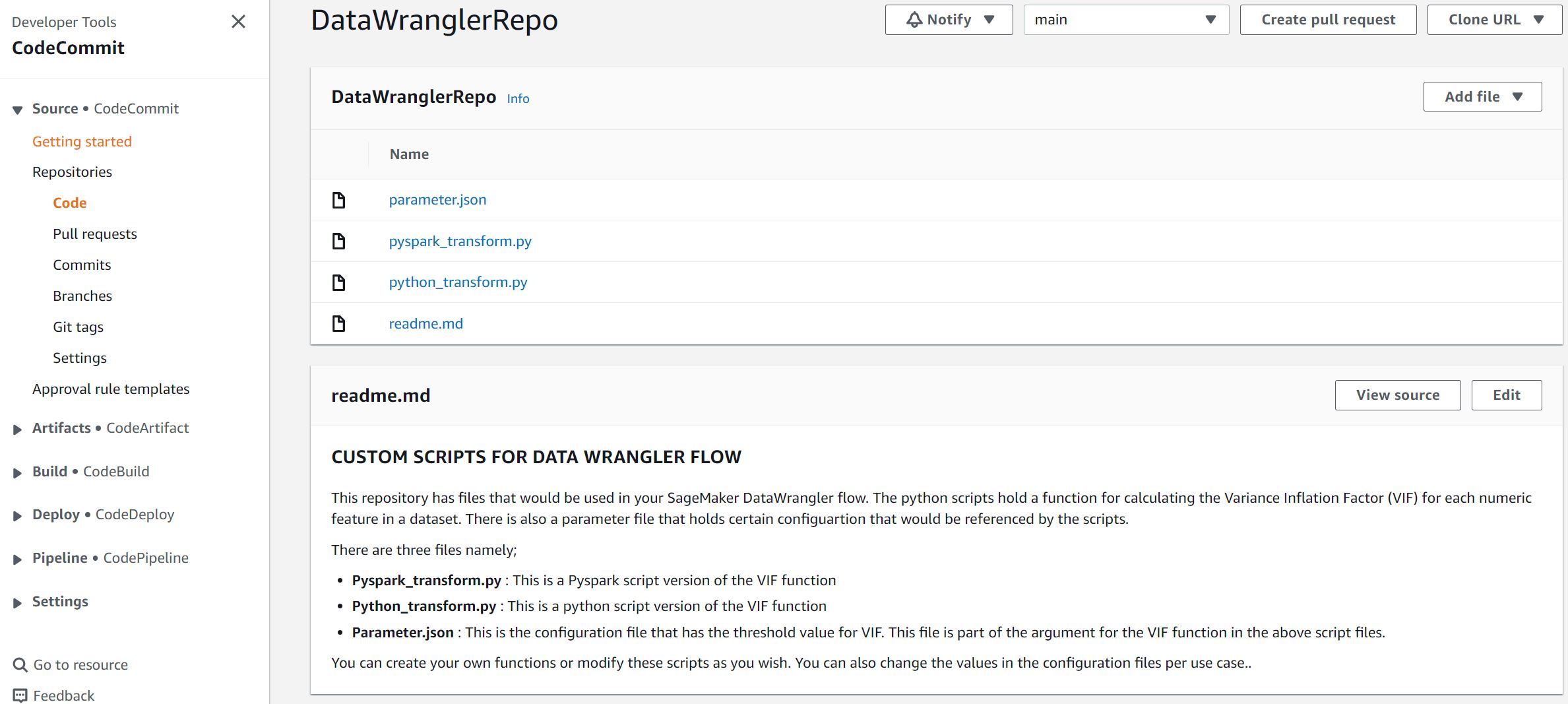

Créer un référentiel CodeCommit

Pour ce poste, nous utilisons un AWS CloudFormation modèle pour configurer un référentiel CodeCommit et copier les fichiers requis dans ce référentiel. Effectuez les étapes suivantes :

- Selectionnez Lancer la pile:

- Sélectionnez la région dans laquelle vous souhaitez créer le référentiel CodeCommit.

- Entrez un nom pour Nom de la pile.

- Entrez un nom pour le référentiel à créer pour Nom du dépôt.

- Selectionnez Créer une pile.

AWS CloudFormation prend quelques secondes pour provisionner votre référentiel CodeCommit. Après le CREATE_COMPLETE status apparaît, accédez à la console CodeCommit pour voir votre référentiel nouvellement créé.

Configurer DataWrangler

Télécharger bank.zip ensemble de données de Référentiel d'apprentissage automatique Irving de l'Université de Californie. Ensuite, extrayez le contenu de bank.zip ainsi que le télécharger bank-full.csv à Amazon S3.

Pour créer un fichier de flux Data Wrangler et importer le bank-full.csv ensemble de données d'Amazon S3, procédez comme suit :

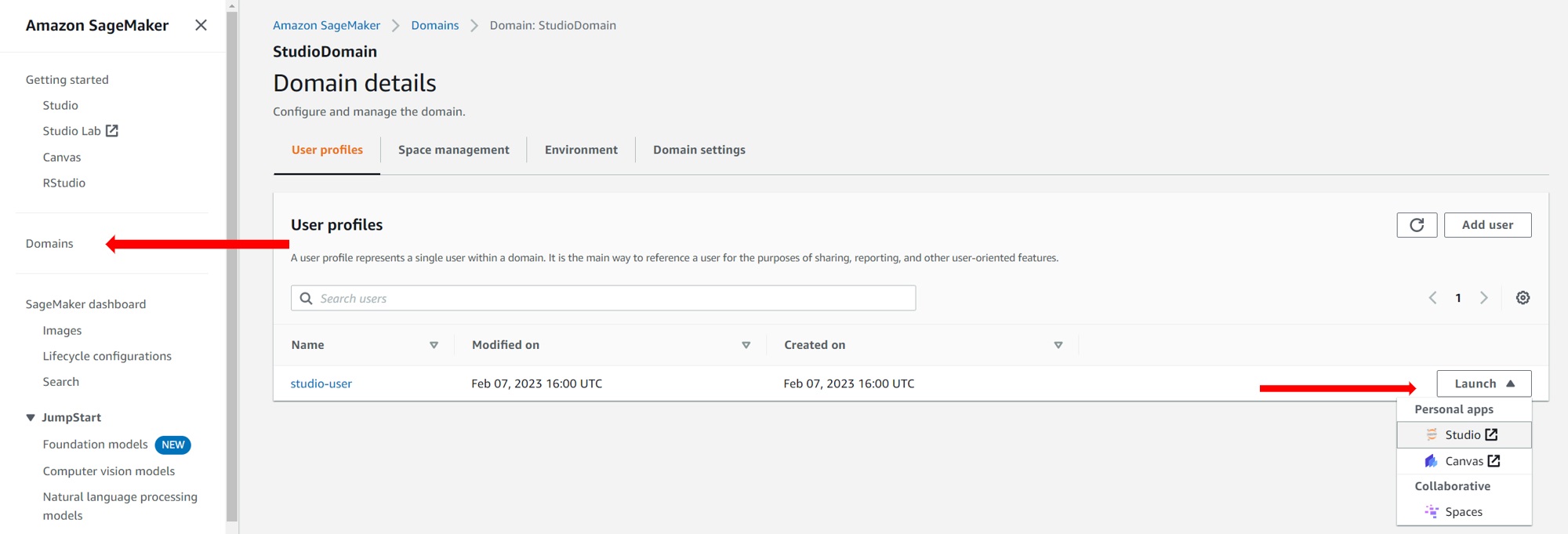

- Intégrer SageMaker Studio à l'aide du démarrage rapide pour les nouveaux utilisateurs de Studio.

- Sélectionnez votre domaine SageMaker et votre profil utilisateur et sur le Lancement menu, choisissez Studio.

- Sur la console Studio, sur le Déposez votre dernière attestation menu, choisissez Nouveauté, Puis choisissez Flux de Wrangler de données.

- Selectionnez Amazon S3 en Les sources de données.

- Accédez à votre compartiment S3 contenant le fichier et chargez le

bank-full.csvfichier.

A Erreur d'aperçu sera jeté.

- Changez le Délimiteur dans le Détails volet à droite pour POINT-virgule.

Un aperçu du jeu de données sera affiché dans la fenêtre de résultats.

- Dans le Détails volet, sur le Échantillonnage menu déroulant, choisissez Aucun.

Il s'agit d'un ensemble de données relativement petit, vous n'avez donc pas besoin d'échantillonner.

- Selectionnez L’.

Configurer les autorisations CodeCommit

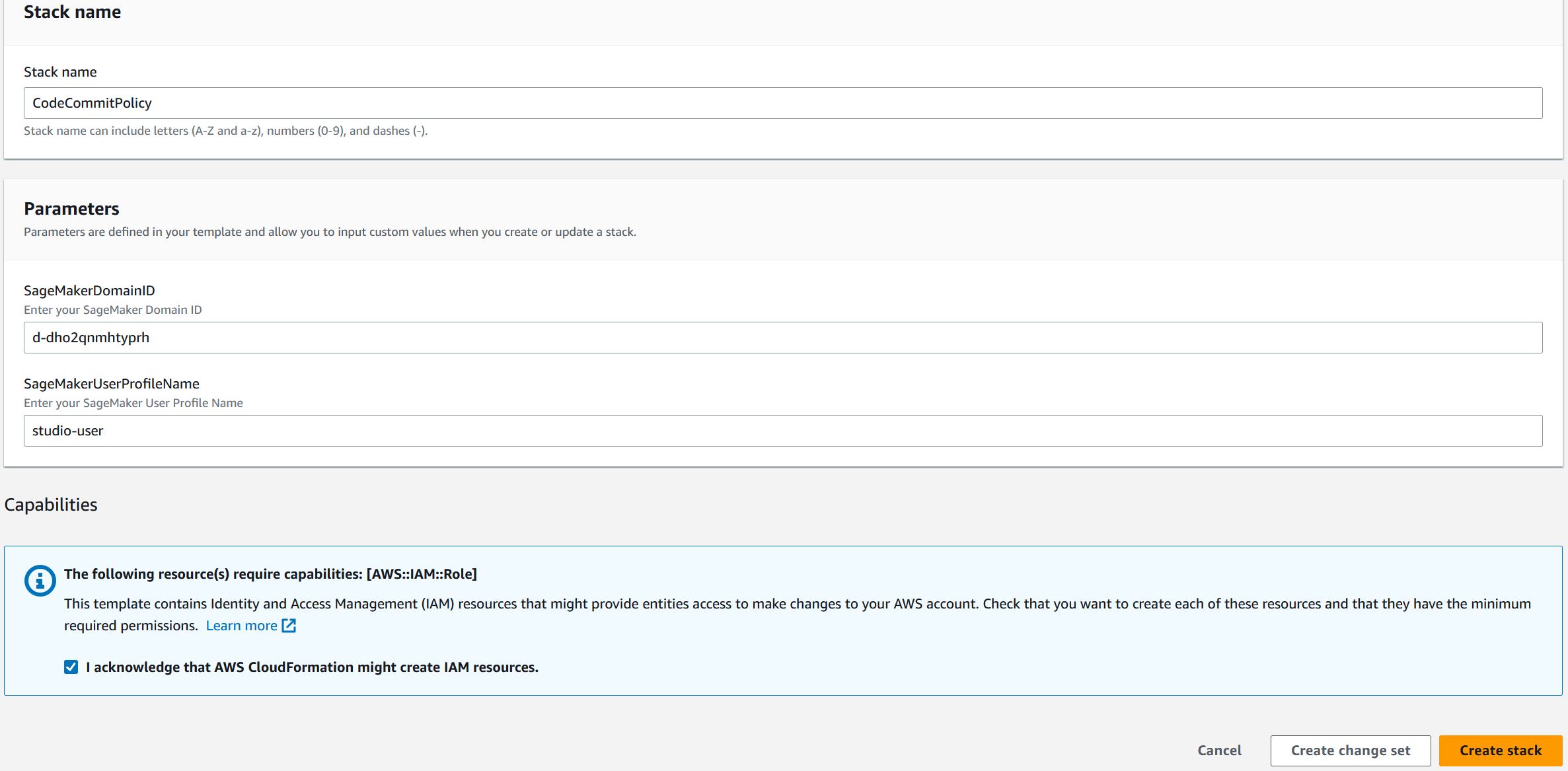

Vous devez fournir à Studio l'autorisation d'accéder à CodeCommit. Nous utilisons un modèle CloudFormation pour provisionner un Stratégie AWS Identity and Access Management (IAM) qui donne votre Rôle en studio l'autorisation d'accéder à CodeCommit. Effectuez les étapes suivantes :

- Selectionnez Lancer la pile:

- Sélectionnez la région dans laquelle vous travaillez.

- Entrez un nom pour Nom de la pile.

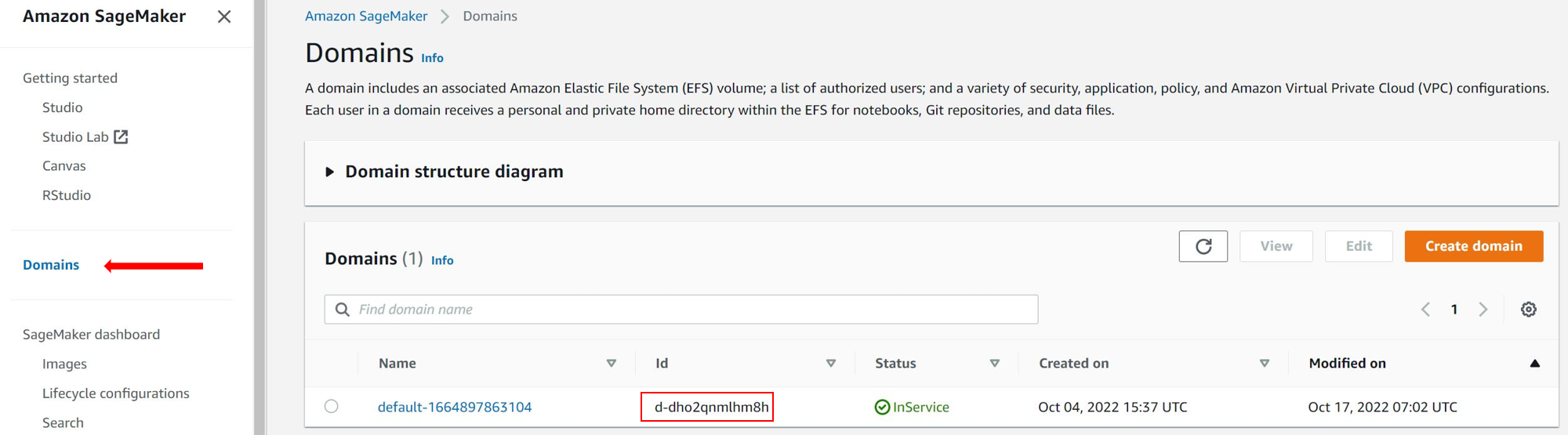

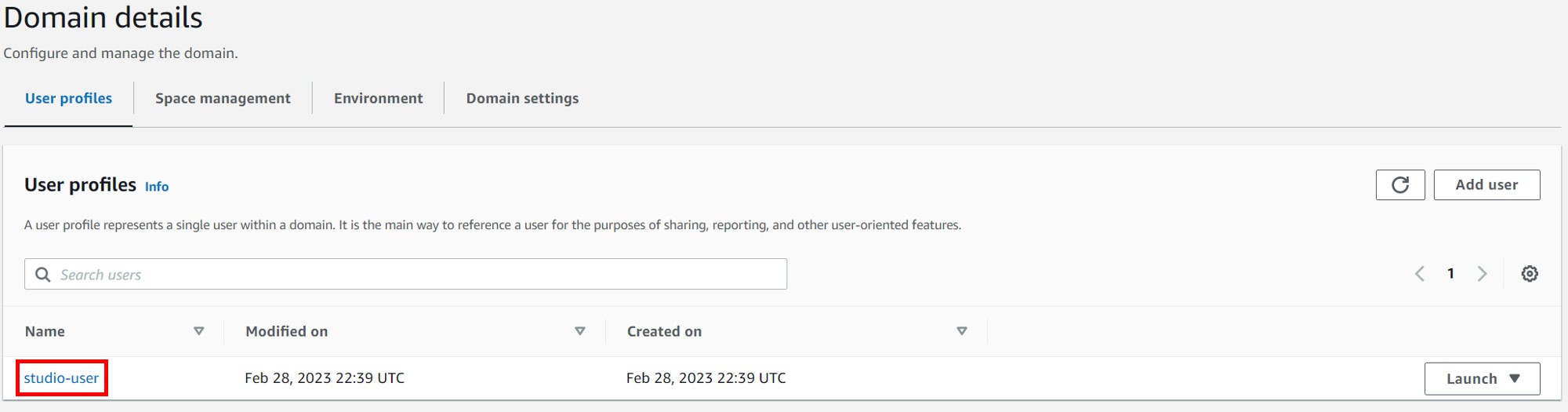

- Saisissez votre ID de domaine Studio pour ID de domaine SageMaker. Les informations de domaine sont disponibles sur la console SageMaker Domaines page, comme illustré dans la capture d'écran suivante.

- Saisissez le nom de votre profil utilisateur de domaine Studio pour Nom du profil utilisateur SageMaker. Vous pouvez afficher le nom de votre profil utilisateur en accédant à votre domaine Studio. Si vous avez plusieurs profils utilisateur dans votre domaine Studio, saisissez le nom du profil utilisateur utilisé pour lancer Studio.

- Sélectionnez la case d'accusé de réception.

Les ressources IAM utilisées par ce modèle CloudFormation fournissent les autorisations minimales pour créer avec succès la stratégie IAM attachée à votre rôle Studio pour l'accès à CodeCommit.

- Selectionnez Créer une pile.

Étapes de transformation

Ensuite, nous ajoutons des transformations pour traiter les données.

Étape de transformation personnalisée

Dans cet article, nous calculons le Variance Facteur d'inflation (VIF) pour chaque caractéristique numérique et caractéristiques de suppression qui dépassent un seuil VIF. Nous le faisons dans l'étape de transformation personnalisée car Data Wrangler n'a pas de transformation intégrée pour cette tâche à ce jour.

Cependant, nous ne codons pas en dur cette fonction VIF. Au lieu de cela, nous extrayons cette fonction du référentiel CodeCommit dans l'étape de transformation personnalisée. Ensuite, nous exécutons la fonction sur le jeu de données.

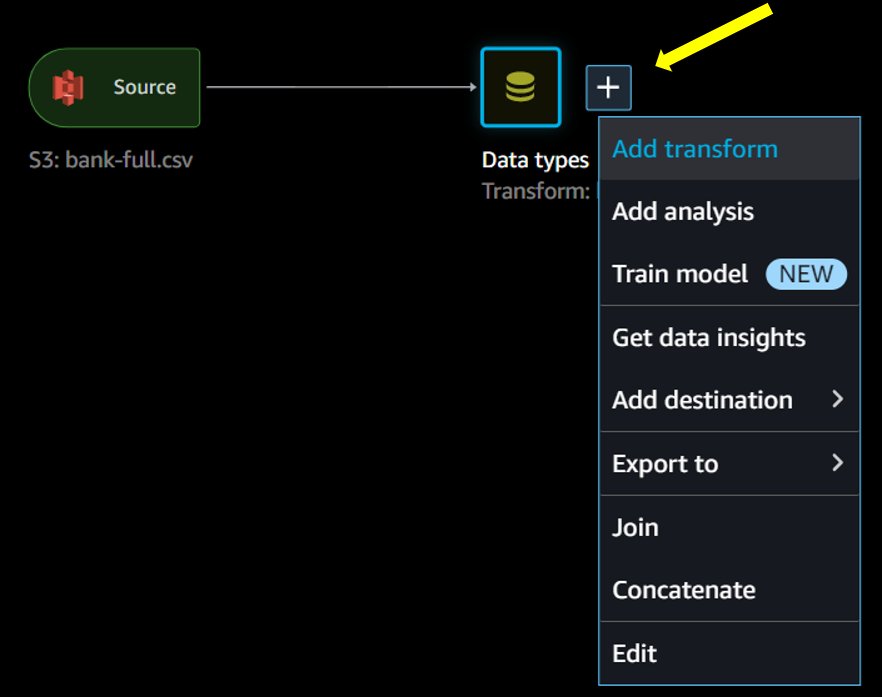

- Sur la console Data Wrangler, accédez à votre flux de données.

- Choisissez le signe plus à côté de Types de données et choisissez Ajouter une transformation.

- Selectionnez + Ajouter une étape.

- Selectionnez Transformation personnalisée.

- Facultativement, entrez un nom dans le champ Nom champ.

- Selectionnez Python (PySpark) dans le menu déroulant.

- Pour Votre transformation personnalisée, entrez le code suivant (indiquez le nom du référentiel CodeCommit et la région où se trouve le référentiel) :

Le code utilise le AWS SDK pour Python (Boto3) pour accéder aux fonctions de l'API CodeCommit. Nous utilisons le get_file Fonction API pour extraire les fichiers du référentiel CodeCommit dans l'environnement Data Wrangler.

- Selectionnez Aperçu.

Dans le Sortie volet, un tableau s'affiche montrant les différentes caractéristiques numériques et leur valeur VIF correspondante. Pour cet exercice, la valeur seuil VIF est définie sur 1.2. Cependant, vous pouvez modifier cette valeur de seuil dans le parameter.json fichier trouvé dans votre référentiel CodeCommit. Vous remarquerez que deux colonnes ont été supprimées (pdays ainsi que le previous), portant le nombre total de colonnes à 15.

- Selectionnez Ajouter.

Encoder les caractéristiques catégorielles

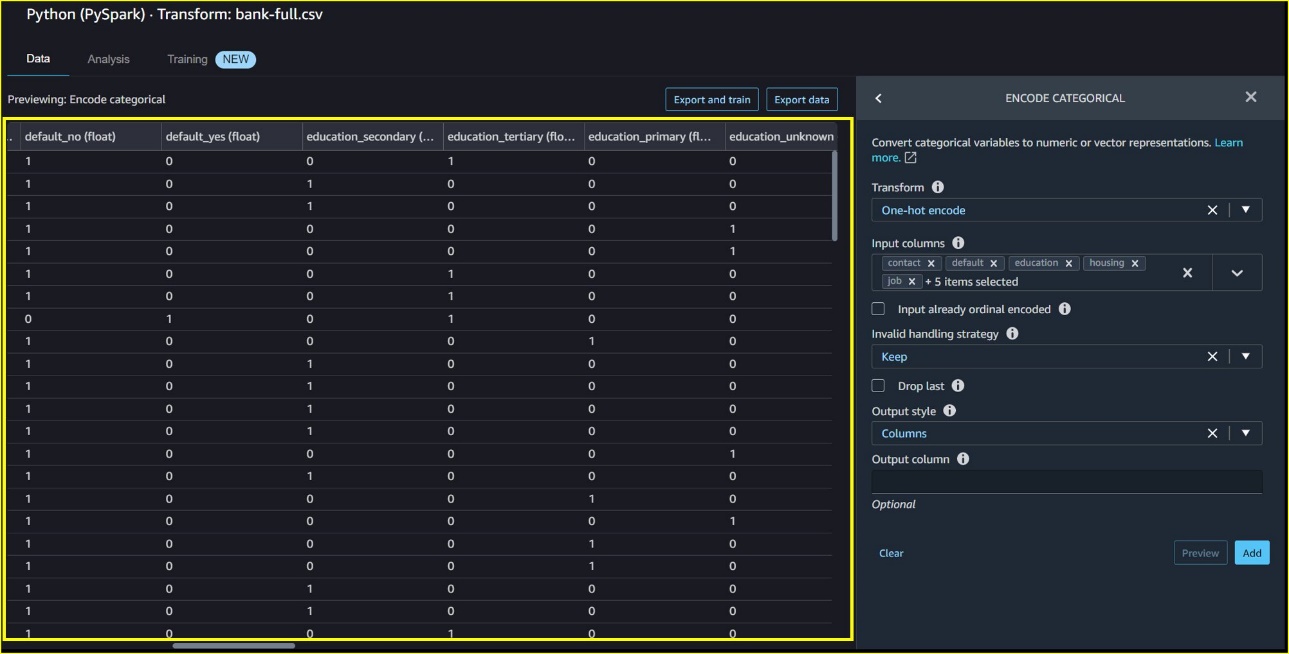

Certains types d'entités sont des variables catégorielles qui doivent être transformées en formes numériques. Utilisez la transformation intégrée d'encodage à chaud pour réaliser cette transformation de données. Créons des entités numériques représentant la valeur unique de chaque entité catégorique du jeu de données. Effectuez les étapes suivantes :

- Selectionnez + Ajouter une étape.

- Choisissez le Encoder catégorique transformer.

- Sur le Transformer menu déroulant, choisissez Encodage à chaud.

- Pour Colonne d'entrée, choisissez toutes les caractéristiques catégorielles, y compris

poutcome,y,month,marital,contact,default,education,housing,jobet uneloan. - Pour Style de sortie, choisissez Colonnes.

- Selectionnez Aperçu pour prévisualiser les résultats.

L'encodage à chaud peut prendre un certain temps pour générer des résultats, compte tenu du nombre de fonctionnalités et de valeurs uniques dans chaque fonctionnalité.

- Selectionnez Ajouter.

Pour chaque entité numérique créée avec un codage à chaud, le nom combine le nom de l'entité catégorique suivi d'un trait de soulignement (_) et la valeur catégorielle unique au sein de cette fonctionnalité.

Déposer la colonne

Les y_yes feature est la colonne cible de cet exercice, nous supprimons donc la y_no fonction.

- Selectionnez + Ajouter une étape.

- Selectionnez Gérer les colonnes.

- Selectionnez Déposer la colonne sous Transformer.

- Selectionnez

y_nosous Colonnes à supprimer. - Selectionnez Aperçu, Puis choisissez Ajouter.

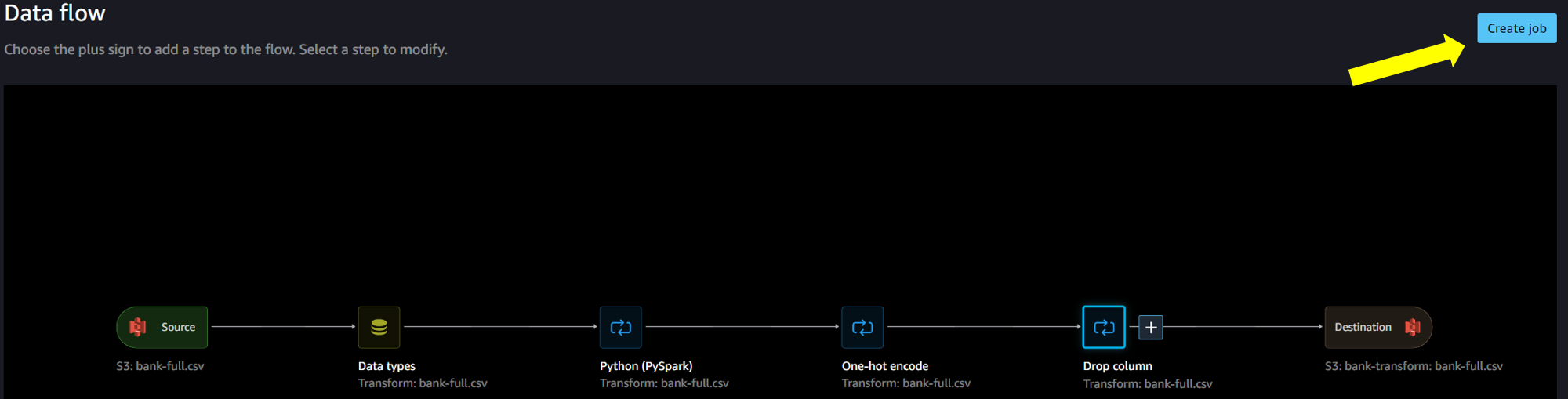

Créer une tâche Data Wrangler

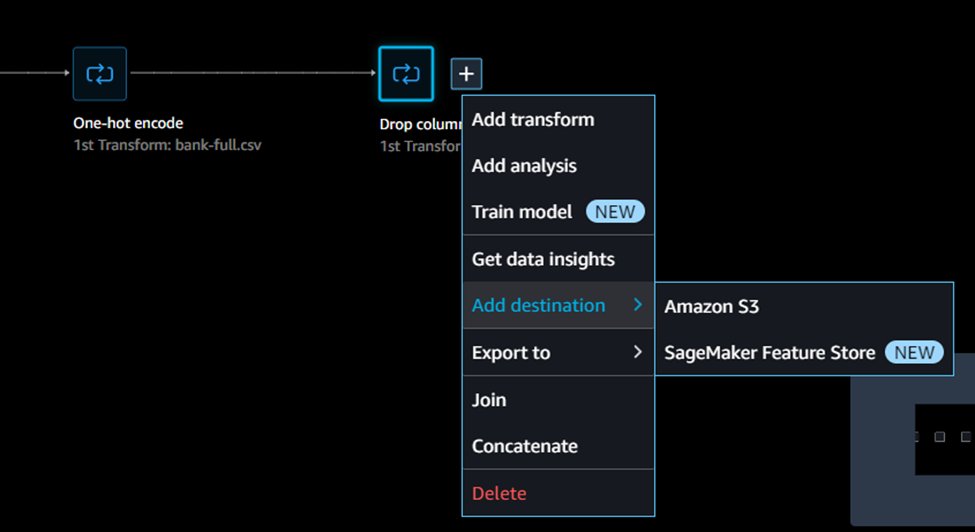

Maintenant que vous avez créé toutes les étapes de transformation, vous pouvez créer une tâche Data Wrangler pour traiter vos données d'entrée et stocker la sortie dans Amazon S3. Effectuez les étapes suivantes :

- Selectionnez Flux de données revenir à la Flux de données .

- Choisissez le signe plus sur la dernière vignette de votre visualisation de flux.

- Selectionnez Ajouter destination et choisissez Amazon S3.

- Entrez le nom du fichier de sortie pour Nom du jeu de données.

- Selectionnez Explorer et choisissez la destination du bucket pour Emplacement Amazon S3.

- Selectionnez Ajouter destination.

- Selectionnez Créer un emploi.

- Changez le Nom du travail valeur comme bon vous semble.

- Selectionnez Ensuite, 2. Configurer le travail.

- Modifier Nombre d'instances à 1, car nous travaillons avec un ensemble de données relativement petit, afin de réduire les coûts encourus.

- Selectionnez Création.

Cela va démarrer un Tâche de traitement Amazon SageMaker pour traiter votre fichier de flux Data Wrangler et stocker la sortie dans le compartiment S3 spécifié.

Automation

Maintenant que vous avez créé votre fichier de flux Data Wrangler, vous pouvez calendrier vos tâches Data Wrangler pour qu'elles s'exécutent automatiquement à des heures et à une fréquence spécifiques. Il s'agit d'une fonctionnalité prête à l'emploi avec Data Wrangler et qui simplifie le processus de planification des tâches Data Wrangler. De plus, les expressions CRON sont prises en charge et offrent une personnalisation et une flexibilité supplémentaires dans la planification de vos tâches Data Wrangler.

Cependant, cet article montre comment vous pouvez automatiser le travail Data Wrangler pour qu'il s'exécute chaque fois qu'il y a une modification des fichiers dans le référentiel CodeCommit. Cette technique d'automatisation garantit que toute modification des fonctions de code personnalisées ou des valeurs dans le fichier de configuration dans CodeCommit déclenche une tâche Data Wrangler pour refléter immédiatement ces modifications.

Par conséquent, vous n'avez pas besoin de démarrer manuellement une tâche Data Wrangler pour obtenir les données de sortie qui reflètent les modifications que vous venez d'apporter. Grâce à cette automatisation, vous pouvez améliorer l'agilité et l'évolutivité de vos charges de travail Data Wrangler. Pour automatiser vos tâches Data Wrangler, vous configurez les éléments suivants :

- Pipelines Amazon SageMaker – Pipelines vous aide à créer des flux de travail d'apprentissage automatique (ML) avec un SDK Python facile à utiliser, et vous pouvez visualiser et gérer votre flux de travail à l'aide de Studio

- Amazon Event Bridge – EventBridge facilite la connexion aux services AWS, aux applications logicielles en tant que service (SaaS) et aux applications personnalisées en tant que producteurs d'événements pour lancer des workflows.

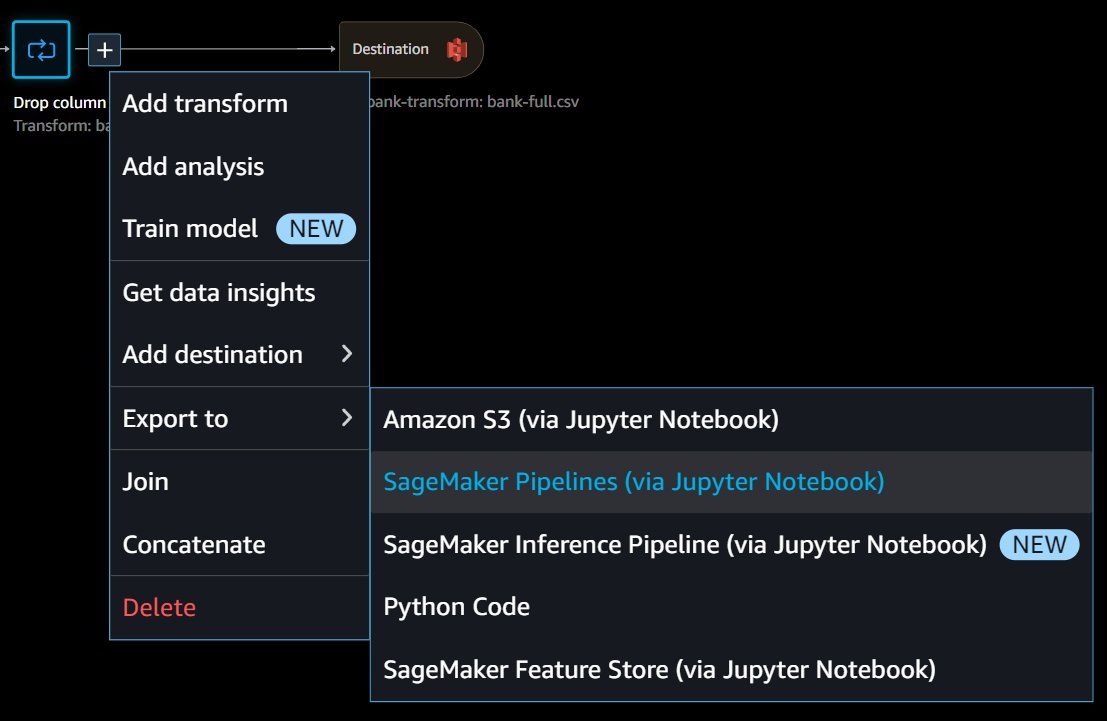

Créer un pipeline SageMaker

Tout d'abord, vous devez créer un pipeline SageMaker pour votre tâche Data Wrangler. Effectuez ensuite les étapes suivantes pour exportez votre flux Data Wrangler à Pipeline SageMaker:

- Choisissez le signe plus sur votre dernière tuile de transformation (la tuile de transformation avant le dentaire tuile).

- Selectionnez Exporter vers.

- Selectionnez Pipeline d'inférence SageMaker (via Jupyter Notebook).

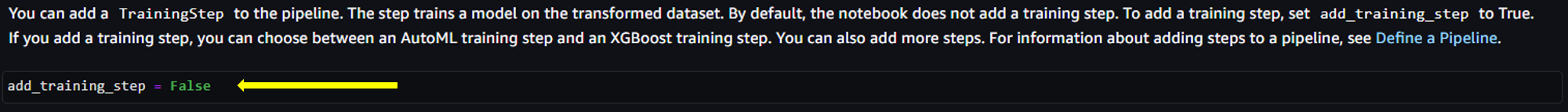

Cela crée un nouveau bloc-notes Jupyter prérempli avec du code pour créer un pipeline SageMaker pour votre tâche Data Wrangler. Avant d'exécuter toutes les cellules du bloc-notes, vous souhaiterez peut-être modifier certaines variables.

- Ajouter un étape de formation à votre pipeline, changez le

add_training_stepvariable àTrue.

Sachez que l'exécution d'une tâche d'entraînement entraînera des coûts supplémentaires sur votre compte.

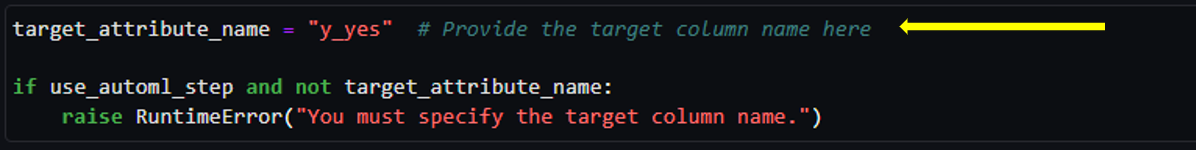

- Spécifiez une valeur pour le

target_attribute_namevariable ày_yes.

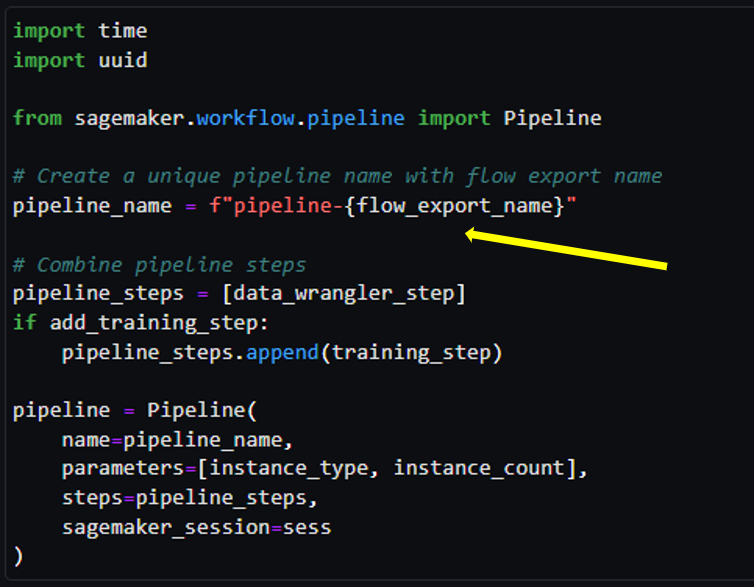

- Pour modifier le nom du pipeline, modifiez le

pipeline_namevariable.

- Enfin, exécutez l'intégralité du notebook en choisissant Courir ainsi que le Exécutez toutes les cellules.

Cela crée un pipeline SageMaker et exécute le travail Data Wrangler.

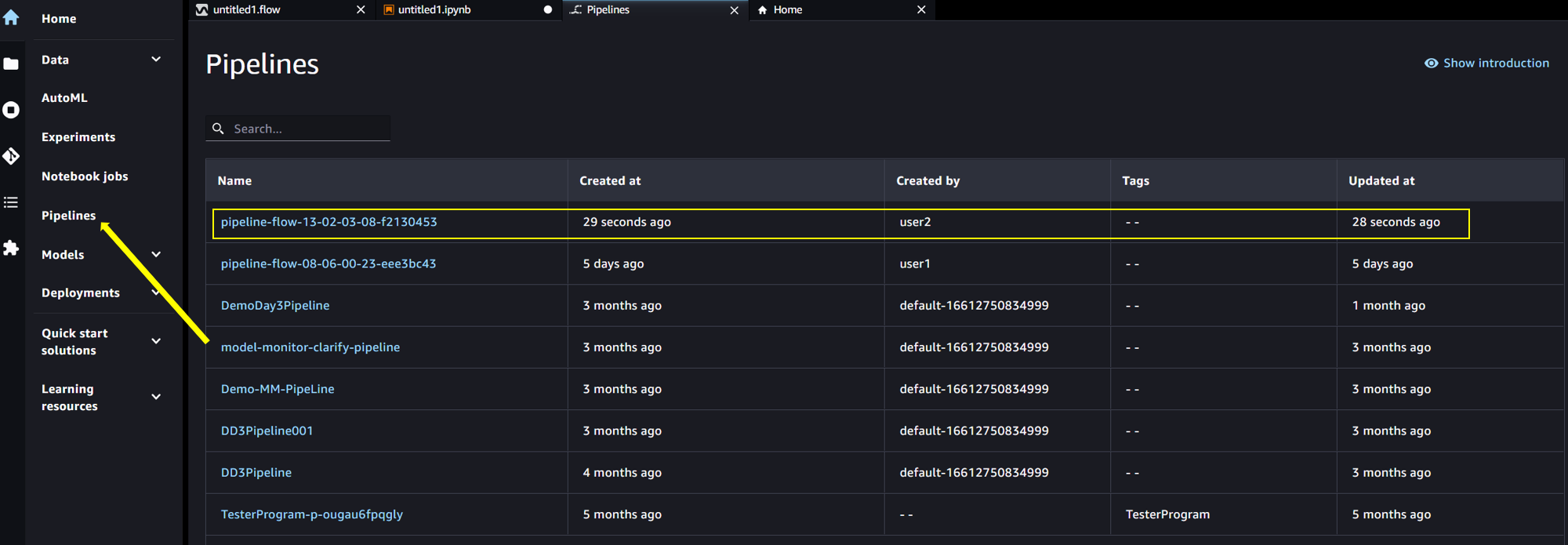

- Pour afficher votre pipeline, choisissez l'icône d'accueil dans le volet de navigation et choisissez Pipelines.

Vous pouvez voir le nouveau pipeline SageMaker créé.

- Choisissez le pipeline nouvellement créé pour voir la liste d'exécution.

- Notez le nom du pipeline SageMaker, car vous l'utiliserez plus tard.

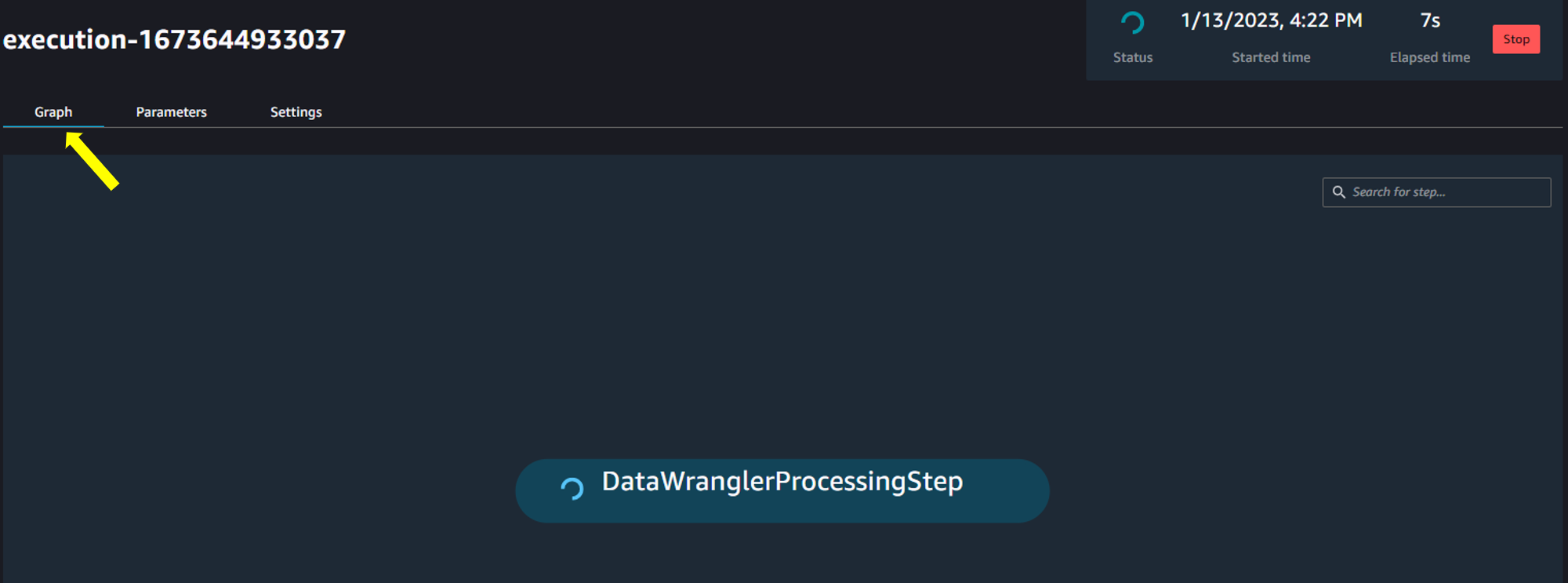

- Choisissez la première manche et choisissez Graphique voir un Graphe acyclique dirigé (DAG) flux de votre pipeline SageMaker.

Comme le montre la capture d'écran suivante, nous n'avons pas ajouté d'étape de formation à notre pipeline. Si vous avez ajouté une étape d'entraînement à votre pipeline, elle s'affichera dans l'exécution de votre pipeline Graphique onglet sous DataWranglerProcessingStep.

Créer une règle EventBridge

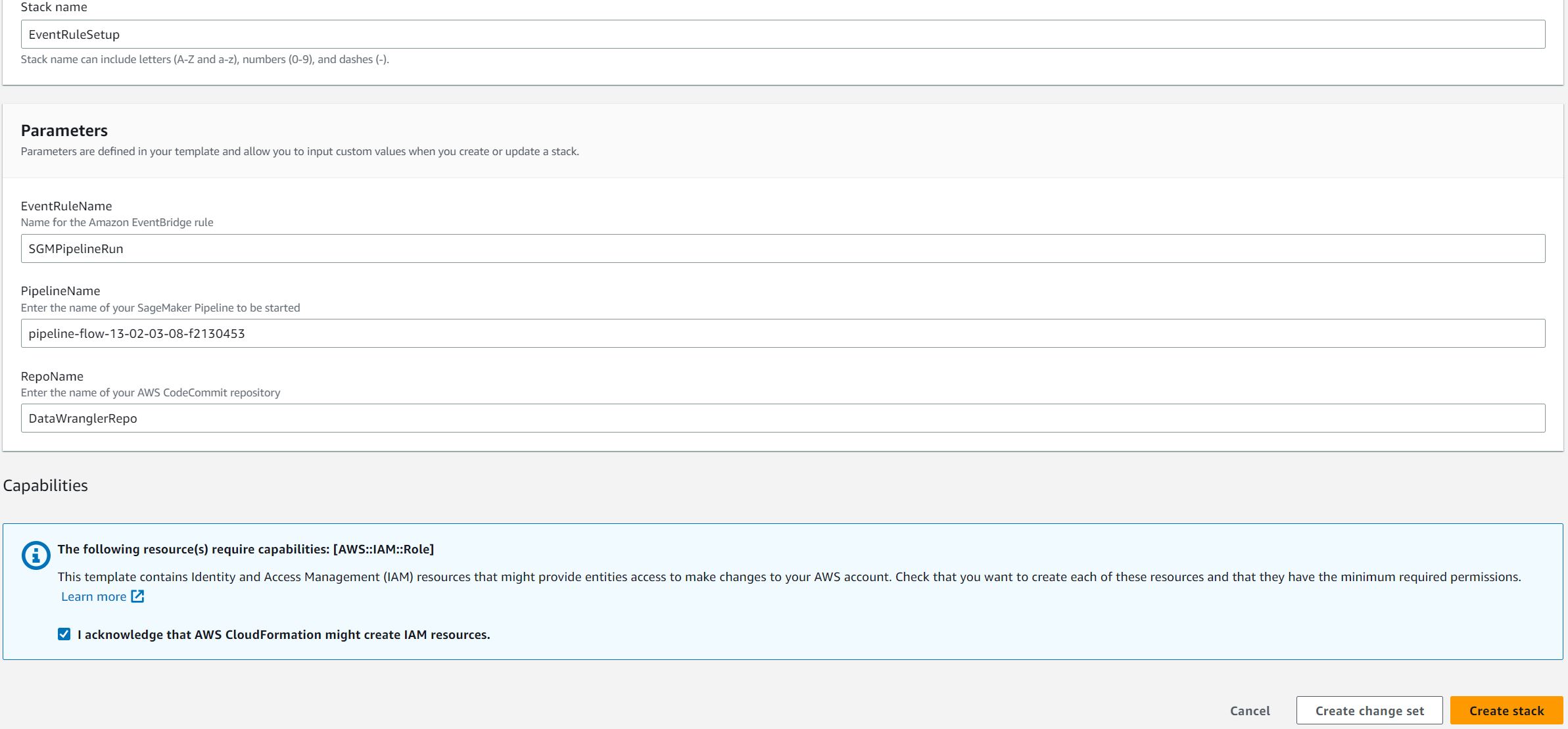

Après avoir créé avec succès votre pipeline SageMaker pour le travail Data Wrangler, vous pouvez passer à la configuration d'une règle EventBridge. Cette règle écoute les activités dans votre référentiel CodeCommit et déclenche l'exécution du pipeline en cas de modification d'un fichier dans le référentiel CodeCommit. Nous utilisons un modèle CloudFormation pour automatiser la création de ce Règle EventBridge. Effectuez les étapes suivantes :

- Selectionnez Lancer la pile:

- Sélectionnez la région dans laquelle vous travaillez.

- Entrez un nom pour Nom de la pile.

- Entrez un nom pour votre règle EventBridge pour Nom de la règle d'événement.

- Entrez le nom du pipeline que vous avez créé pour Nom du pipeline.

- Entrez le nom du référentiel CodeCommit avec lequel vous travaillez pour Nom du dépôt.

- Sélectionnez la case d'accusé de réception.

Les ressources IAM utilisées par ce modèle CloudFormation fournissent les autorisations minimales pour créer avec succès la règle EventBridge.

- Selectionnez Créer une pile.

L'exécution réussie du modèle CloudFormation prend quelques minutes. Quand le Statut change à CREATE_COMPLTE, vous pouvez accéder à la console EventBridge pour voir la règle créée.

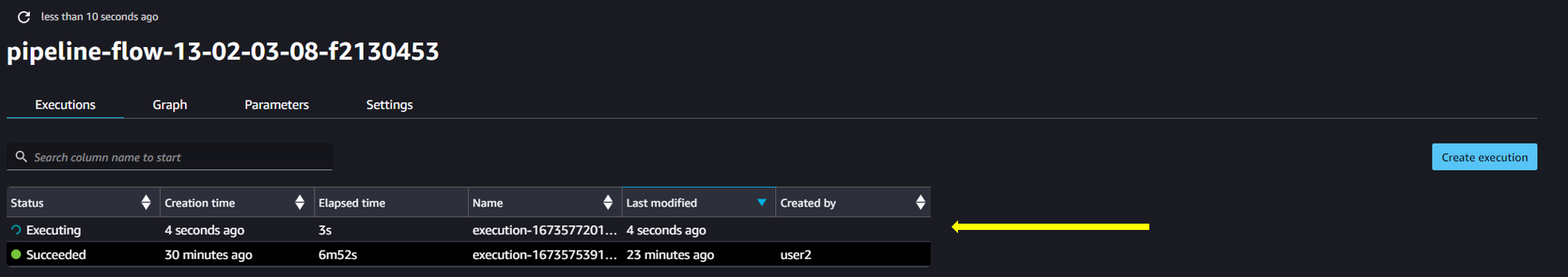

Maintenant que vous avez créé cette règle, toute modification apportée au fichier dans votre référentiel CodeCommit déclenchera l'exécution du pipeline SageMaker.

Pour tester le pipeline modifier un fichier dans votre référentiel CodeCommit, modifiez le seuil VIF dans votre parameter.json fichier à un numéro différent, et accédez à la page des détails du pipeline SageMaker pour voir une nouvelle exécution de votre pipeline créé.

Dans cette nouvelle exécution de pipeline, Data Wrangler supprime les fonctionnalités numériques qui ont une valeur VIF supérieure au seuil que vous avez spécifié dans votre parameter.json fichier dans CodeCommit.

Vous avez automatisé et découplé avec succès votre travail Data Wrangler. De plus, vous pouvez ajouter d'autres étapes à votre pipeline SageMaker. Vous pouvez également modifier les scripts personnalisés dans CodeCommit pour implémenter diverses fonctions dans votre flux Data Wrangler.

Il est également possible de stocker vos scripts et fichiers dans Amazon S3 et de les télécharger dans votre étape de transformation personnalisée Data Wrangler comme alternative à CodeCommit. De plus, vous avez exécuté votre étape de transformation personnalisée à l'aide de Python (PyScript) cadre. Cependant, vous pouvez également utiliser le Python (Pandas) framework pour votre étape de transformation personnalisée, vous permettant d'exécuter des scripts Python personnalisés. Vous pouvez tester cela en modifiant votre cadre dans l'étape de transformation personnalisée pour Python (Pandas) et modifier votre code d'étape de transformation personnalisé pour extraire et implémenter la version de script Python stockée dans votre référentiel CodeCommit. Cependant, l'option PySpark pour Data Wrangler offre de meilleures performances lorsque vous travaillez sur un grand ensemble de données par rapport à l'option Python Pandas.

Nettoyer

Une fois que vous avez terminé d'expérimenter ce cas d'utilisation, nettoyez les ressources que vous avez créées pour éviter que des frais supplémentaires ne soient facturés à votre compte :

- Arrêter l'instance sous-jacente utilisée pour créer votre flux Data Wrangler.

- Supprimer les ressources créées par les différents modèles CloudFormation.

- Si vous voyez un

DELETE_FAILEDétat, lors de la suppression du modèle CloudFormation, supprimez la pile une fois de plus pour réussir à la supprimer.

Résumé

Cet article vous a montré comment découpler votre étape de transformation personnalisée Data Wrangler en extrayant des scripts de CodeCommit. Nous avons également montré comment automatiser vos tâches Data Wrangler à l'aide de SageMaker Pipelines et EventBridge.

Vous pouvez désormais opérationnaliser et mettre à l'échelle vos tâches Data Wrangler sans modifier votre fichier de flux Data Wrangler. Vous pouvez également analyser votre code personnalisé dans CodeCommit à l'aide de CodeGuru ou de toute application tierce à la recherche de vulnérabilités avant de l'implémenter dans Data Wrangler. Pour en savoir plus sur les opérations d'apprentissage automatique de bout en bout (MLOps) sur AWS, consultez Amazon SageMaker pour MLOps.

À propos de l’auteur

Uchenna Egbé est architecte de solutions associé chez AWS. Il passe son temps libre à faire des recherches sur les herbes, les thés, les superaliments et comment les incorporer dans son alimentation quotidienne.

Uchenna Egbé est architecte de solutions associé chez AWS. Il passe son temps libre à faire des recherches sur les herbes, les thés, les superaliments et comment les incorporer dans son alimentation quotidienne.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-custom-code-libraries-for-your-amazon-sagemaker-data-wrangler-flows-using-aws-code-commit/

- :est

- $UP

- 1

- 100

- 7

- 8

- 9

- a

- Qui sommes-nous

- accès

- Compte

- atteindre

- à travers

- d'activités

- acyclique

- ajoutée

- ajout

- Supplémentaire

- adopté

- Après

- Aide

- Tous

- Permettre

- permet

- alternative

- Amazon

- Amazon Sage Maker

- Gestionnaire de données Amazon SageMaker

- selon une analyse de l’Université de Princeton

- ainsi que le

- api

- Application

- applications

- architecture

- SONT

- argument

- autour

- AS

- Associé(e)

- At

- automatiser

- Automatisation

- automatiquement

- Automation

- disponibles

- AWS

- RETOUR

- Banque

- Services bancaires

- BE

- car

- devient

- before

- avantages.

- LES MEILLEURS

- les meilleures pratiques

- Améliorée

- Box

- Apporter

- construire

- intégré

- by

- calculer

- Californie

- Appelez-nous

- Campagnes

- CAN

- maisons

- Cellules

- certaines

- Change

- Modifications

- en changeant

- des charges

- Selectionnez

- choose

- client

- code

- collaboration

- Colonne

- Colonnes

- moissonneuses-batteuses

- commettre

- par rapport

- complet

- complexités

- configuration

- connexion

- Console

- contact

- contient

- contenu

- Correspondant

- Prix

- Costs

- engendrent

- créée

- crée des

- La création

- critique

- Customiser

- personnalisation

- JOUR

- Tous les jours

- données

- l'analyse des données

- page de livraison.

- démontrer

- démontre

- déployer

- Dépôt

- destination

- détails

- développer

- développement

- Alimentation

- différent

- Commande

- Ne fait pas

- domaine

- Ne pas

- download

- Goutte

- chuté

- Drops

- chacun

- facile à utiliser

- éditeur

- Employés

- end-to-end

- ENGINEERING

- Assure

- Entrer

- Tout

- Environment

- événement

- Chaque

- dépassent

- exécution

- Exercises

- expressions

- extrait

- facilite

- Fonctionnalité

- Fonctionnalités:

- few

- champ

- Déposez votre dernière attestation

- Fichiers

- Prénom

- s'adapter

- Flexibilité

- flux

- Flux

- concentré

- Abonnement

- suit

- Pour

- document

- trouvé

- Framework

- Gratuit

- La fréquence

- De

- fonction

- fonctionnalités

- fonctions

- En outre

- générer

- obtenez

- gif

- donné

- donne

- Go

- graphique

- plus grand

- Croître

- Vous avez

- ayant

- aide

- appuyez en continu

- Accueil

- Comment

- How To

- Cependant

- HTML

- HTTPS

- ICON

- ID

- Identite

- immédiatement

- Mettre en oeuvre

- la mise en oeuvre

- la mise en œuvre

- importer

- l'importation

- améliorer

- in

- comprendre

- Y compris

- intégrer

- Améliore

- inflation

- d'information

- contribution

- instance

- plutôt ;

- Institution

- Introduit

- IT

- Emploi

- Emplois

- jpg

- json

- XNUMX éléments à

- Savoir

- gros

- Nom de famille

- lancer

- apprentissage

- bibliothèques

- Liste

- charge

- situé

- click

- machine learning

- LES PLANTES

- a prendre une

- gérer

- gestion

- les gérer

- manuellement

- Stratégie

- Mémoire

- Menu

- pourrait

- minimum

- Minutes

- ML

- MLOps

- modifier

- Module

- PLUS

- Bougez

- plusieurs

- prénom

- NAVIGUER

- navigation

- Navigation

- Besoin

- Nouveauté

- next

- cahier

- nombre

- numpy

- of

- on

- ONE

- Opérations

- Option

- Options

- organisations

- OS

- sortie

- page

- pandas

- pain

- paramètre

- chemin

- performant

- autorisation

- autorisations

- personnel

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- plus

- politique

- possible

- Post

- pratique

- pratiques

- Aperçu

- processus

- les process

- traitement

- Nos producteurs

- Produit

- productivité

- Profil

- Profils

- fournir

- fournit

- disposition

- tirant

- Python

- Rapide

- réduire

- refléter

- reflète

- région

- en relation

- relativement

- dépôt

- représentation

- conditions

- Resources

- réponse

- résultat

- Résultats

- Rôle

- Règle

- Courir

- pour le running

- SaaS.

- sagemaker

- Pipelines SageMaker

- même

- Escaliers intérieurs

- balayage

- ordonnancement

- scripts

- Sdk

- secondes

- sécurité

- Série

- service

- Services

- set

- mise

- montré

- Spectacles

- signer

- étapes

- Taille

- petit

- So

- Logiciels

- logiciel en tant que service

- sur mesure

- Solutions

- groupe de neurones

- spécifié

- empiler

- Commencer

- Région

- Statut

- étapes

- Étapes

- storage

- Boutique

- stockée

- studio

- Avec succès

- Appareils

- SYS

- table

- Prenez

- prend

- Target

- Tâche

- Technologie

- modèle

- tester

- qui

- Les

- leur

- Les

- donc

- Ces

- des tiers.

- порог

- fiable

- fois

- à

- outil

- Total

- Formation

- Transformer

- De La Carrosserie

- transformations

- transformé

- déclencher

- types

- sous

- sous-jacent

- expérience unique et authentique

- utilisé

- cas d'utilisation

- Utilisateur

- utilisateurs

- Plus-value

- Valeurs

- divers

- version

- via

- Voir

- Visiter

- visualisation

- vulnérabilités

- W

- qui

- tout en

- Wikipédia

- sera

- comprenant

- dans les

- sans

- activités principales

- workflows

- de travail

- pourra

- écrire

- écrire du code

- écriture

- code écrit

- Vous n'avez

- Votre

- zéphyrnet