Nous assistons à une augmentation rapide de l’adoption de grands modèles de langage (LLM) qui alimentent les applications d’IA générative dans tous les secteurs. Les LLM sont capables d'effectuer diverses tâches, telles que générer du contenu créatif, répondre aux demandes via des chatbots, générer du code, etc.

Les organisations qui cherchent à utiliser les LLM pour alimenter leurs applications se méfient de plus en plus de la confidentialité des données afin de garantir le maintien de la confiance et de la sécurité au sein de leurs applications d'IA générative. Cela inclut le traitement correct des données d’informations personnelles identifiables (PII) des clients. Il s’agit également d’empêcher la propagation de contenus abusifs et dangereux vers les LLM et de vérifier que les données générées par les LLM suivent les mêmes principes.

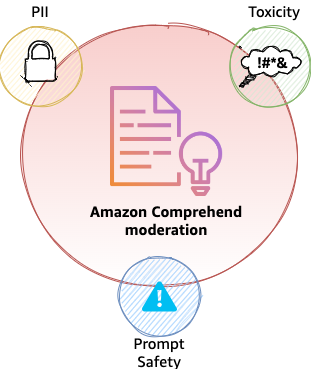

Dans cet article, nous discutons des nouvelles fonctionnalités optimisées par Amazon comprendre qui permettent une intégration transparente pour garantir la confidentialité des données, la sécurité du contenu et une sécurité rapide dans les applications d'IA générative nouvelles et existantes.

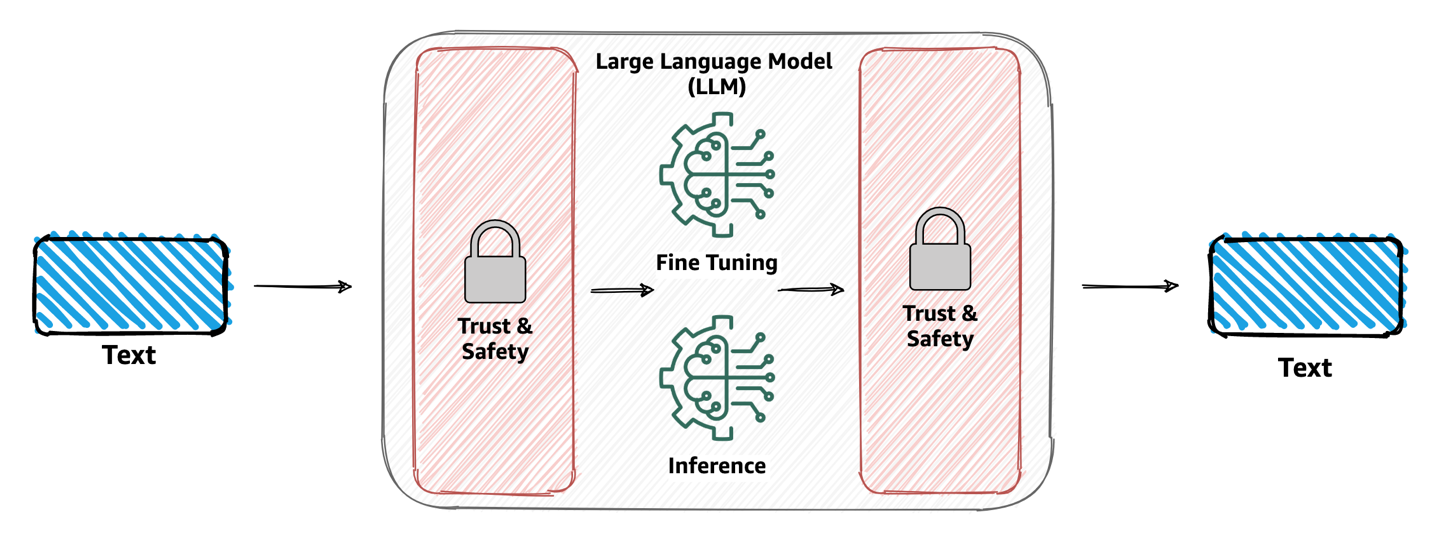

Amazon Comprehend est un service de traitement du langage naturel (NLP) qui utilise l'apprentissage automatique (ML) pour découvrir des informations dans les données non structurées et le texte des documents. Dans cet article, nous expliquons pourquoi la confiance et la sécurité avec les LLM sont importantes pour vos charges de travail. Nous approfondissons également la façon dont ces nouvelles capacités de modération sont utilisées avec le populaire cadre de développement d'IA générative. LangChaîne pour introduire un mécanisme de confiance et de sécurité personnalisable pour votre cas d'utilisation.

Pourquoi la confiance et la sécurité avec les LLM sont importantes

La confiance et la sécurité sont primordiales lorsque l'on travaille avec des LLM en raison de leur impact profond sur un large éventail d'applications, des chatbots de support client à la génération de contenu. À mesure que ces modèles traitent de grandes quantités de données et génèrent des réponses semblables à celles des humains, le risque d’utilisation abusive ou de résultats inattendus augmente. Il est crucial de garantir que ces systèmes d’IA fonctionnent dans des limites éthiques et fiables, non seulement pour la réputation des entreprises qui les utilisent, mais également pour préserver la confiance des utilisateurs finaux et des clients.

De plus, à mesure que les LLM s’intègrent davantage dans nos expériences numériques quotidiennes, leur influence sur nos perceptions, nos croyances et nos décisions augmente. Garantir la confiance et la sécurité avec les LLM va au-delà des simples mesures techniques ; cela témoigne de la responsabilité plus large des praticiens et des organisations de l’IA de respecter les normes éthiques. En donnant la priorité à la confiance et à la sécurité, les organisations protègent non seulement leurs utilisateurs, mais assurent également une croissance durable et responsable de l'IA dans la société. Cela peut également contribuer à réduire le risque de génération de contenu préjudiciable et à respecter les exigences réglementaires.

Dans le domaine de la confiance et de la sécurité, la modération du contenu est un mécanisme qui aborde divers aspects, notamment :

- Confidentialité – Les utilisateurs peuvent fournir par inadvertance un texte contenant des informations sensibles, mettant ainsi en danger leur vie privée. La détection et la suppression de toutes informations personnelles sont essentielles.

- Phytotoxicité – Il est de la plus haute importance de reconnaître et de filtrer les contenus préjudiciables, tels que les discours de haine, les menaces ou les abus.

- Intention de l'utilisateur – Il est essentiel d’identifier si l’entrée utilisateur (invite) est sûre ou non. Les invites non sécurisées peuvent exprimer explicitement ou implicitement une intention malveillante, comme demander des informations personnelles ou privées et générer du contenu offensant, discriminatoire ou illégal. Les invites peuvent également implicitement exprimer ou demander des conseils sur des questions médicales, juridiques, politiques, controversées, personnelles ou financières.

Modération de contenu avec Amazon Comprehend

Dans cette section, nous discutons des avantages de la modération de contenu avec Amazon Comprehend.

Respect de la vie privée

Amazon Comprehend aborde déjà la question de la confidentialité grâce à ses capacités existantes de détection et de rédaction des informations personnelles via le Détecter les PIIEntities et les ContientPIIEntities Apis. Ces deux API s'appuient sur des modèles NLP capables de détecter un grand nombre d'entités PII telles que les numéros de sécurité sociale (SSN), les numéros de carte de crédit, les noms, les adresses, les numéros de téléphone, etc. Pour une liste complète des entités, reportez-vous à Types d'entités universelles PII. DetectPII fournit également la position au niveau du caractère de l'entité PII dans un texte ; par exemple, la position du caractère de début de l'entité NAME (John Doe) dans la phrase « Mon nom est Joh faise" est 12 et la position du caractère de fin est 19. Ces décalages peuvent être utilisés pour effectuer le masquage ou la rédaction des valeurs, réduisant ainsi les risques de propagation de données privées dans les LLM.

Lutte contre la toxicité et sécurité rapide

Aujourd'hui, nous annonçons deux nouvelles fonctionnalités d'Amazon Comprehend sous forme d'API : Détection de toxicité via le DetectToxicContent API et classification de sécurité rapide via le ClassifyDocument API. Notez que DetectToxicContent est une nouvelle API, alors que ClassifyDocument est une API existante qui prend désormais en charge une classification de sécurité rapide.

Détection de toxicité

Avec la détection de toxicité Amazon Comprehend, vous pouvez identifier et signaler le contenu qui peut être nuisible, offensant ou inapproprié. Cette fonctionnalité est particulièrement précieuse pour les plateformes sur lesquelles les utilisateurs génèrent du contenu, telles que les sites de réseaux sociaux, les forums, les chatbots, les sections de commentaires et les applications qui utilisent les LLM pour générer du contenu. L’objectif principal est de maintenir un environnement positif et sûr en empêchant la diffusion de contenus toxiques.

À la base, le modèle de détection de toxicité analyse le texte pour déterminer la probabilité qu'il contienne du contenu haineux, des menaces, des obscénités ou d'autres formes de texte préjudiciable. Le modèle est formé sur de vastes ensembles de données contenant des exemples de contenus toxiques et non toxiques. L'API de toxicité évalue un morceau de texte donné pour fournir une classification de toxicité et un score de confiance. Les applications d'IA générative peuvent ensuite utiliser ces informations pour prendre les mesures appropriées, comme empêcher la propagation du texte vers les LLM. Au moment d'écrire ces lignes, les étiquettes détectées par l'API de détection de toxicité sont HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULTet une PROFANITY. Le code suivant illustre l'appel d'API avec Python Boto3 pour la détection de toxicité Amazon Comprehend :

Classification de sécurité rapide

La classification de sécurité des invites avec Amazon Comprehend permet de classer une invite de texte de saisie comme sûre ou dangereuse. Cette fonctionnalité est cruciale pour les applications telles que les chatbots, les assistants virtuels ou les outils de modération de contenu, où la compréhension de la sécurité d'une invite peut déterminer les réponses, les actions ou la propagation du contenu vers les LLM.

Essentiellement, une classification de sécurité rapide analyse les interventions humaines pour détecter toute intention malveillante explicite ou implicite, telle que la demande d'informations personnelles ou privées et la génération de contenu offensant, discriminatoire ou illégal. Il signale également les demandes de conseils sur des sujets médicaux, juridiques, politiques, controversés, personnels ou financiers. La classification rapide renvoie deux classes, UNSAFE_PROMPT et les SAFE_PROMPT, pour un texte associé, avec un score de confiance associé pour chacun. Le score de confiance est compris entre 0 et 1 et la somme combinée sera égale à 1. Par exemple, dans un chatbot de support client, le texte «Comment réinitialiser mon mot de passe?" signale une intention de demander conseil sur les procédures de réinitialisation de mot de passe et est étiqueté comme SAFE_PROMPT. De même, une déclaration comme «Je souhaite que quelque chose de mal t'arrive» peut être signalé comme ayant une intention potentiellement nuisible et étiqueté comme UNSAFE_PROMPT. Il est important de noter que la classification de sécurité des invites se concentre principalement sur la détection de l'intention à partir des entrées humaines (invites), plutôt que du texte généré par la machine (sorties LLM). Le code suivant montre comment accéder à la fonctionnalité d'invite de classification de sécurité avec le ClassifyDocument API:

Notez que endpoint_arn dans le code précédent est un fichier fourni par AWS Numéro de ressource Amazon (ARN) du motif arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safety, Où <region> est la région AWS de votre choix où Amazon Comprendre est disponible.

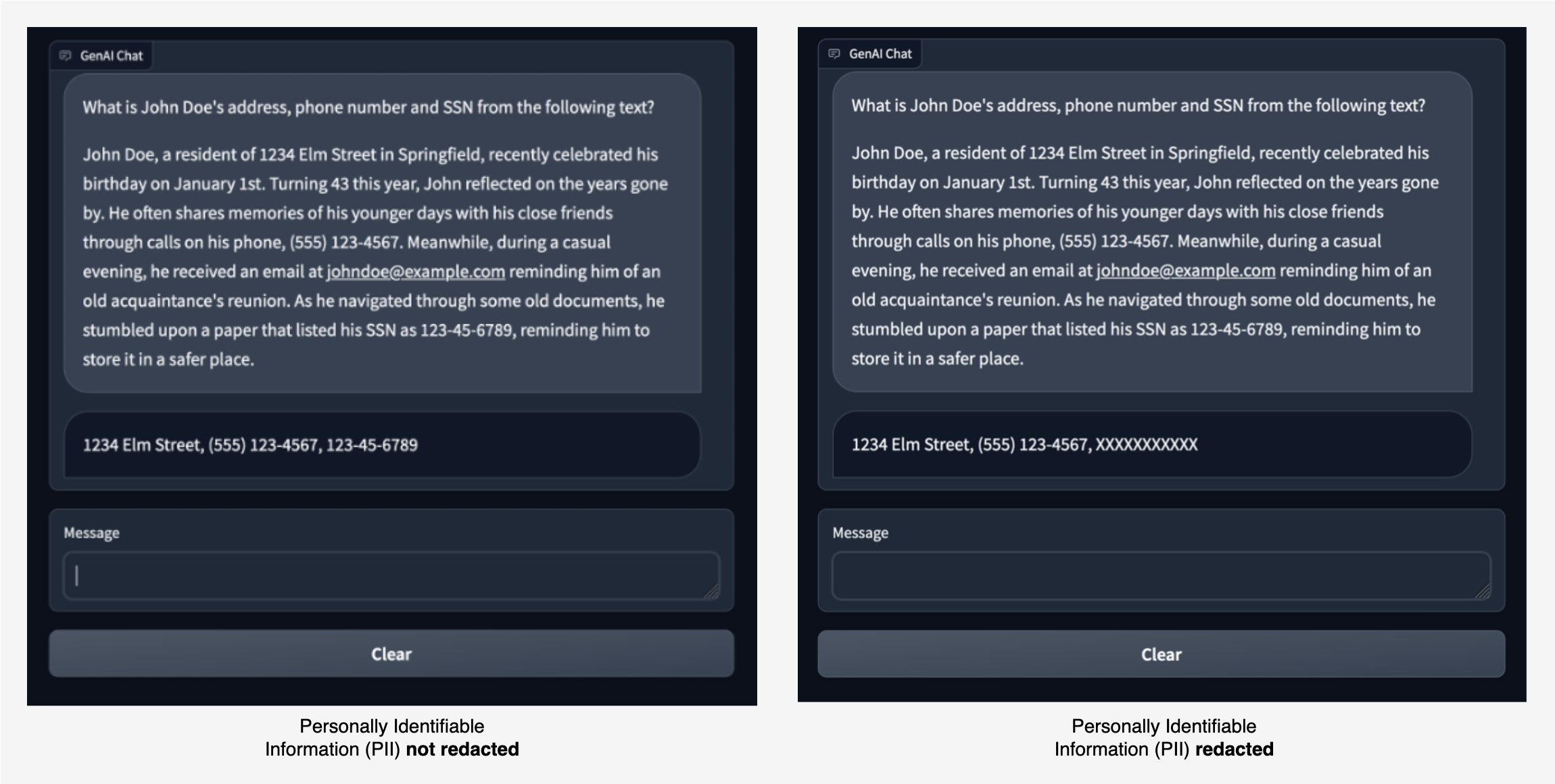

Pour démontrer ces capacités, nous avons créé un exemple d'application de chat dans lequel nous demandons à un LLM d'extraire des entités PII telles que l'adresse, le numéro de téléphone et le SSN à partir d'un morceau de texte donné. Le LLM recherche et renvoie les entités PII appropriées, comme indiqué dans l'image de gauche.

Avec la modération d'Amazon Comprehend, nous pouvons rédiger l'entrée du LLM et la sortie du LLM. Dans l'image de droite, la valeur SSN peut être transmise au LLM sans rédaction. Cependant, toute valeur SSN dans la réponse du LLM est expurgée.

Voici un exemple de la façon dont une invite contenant des informations PII peut être complètement empêchée d'atteindre le LLM. Cet exemple montre un utilisateur posant une question contenant des informations PII. Nous utilisons la modération Amazon Comprehend pour détecter les entités PII dans l'invite et afficher une erreur en interrompant le flux.

Les exemples de discussion précédents montrent comment la modération d'Amazon Comprehend applique des restrictions sur les données envoyées à un LLM. Dans les sections suivantes, nous expliquons comment ce mécanisme de modération est implémenté à l'aide de LangChain.

Intégration avec LangChain

Avec les possibilités infinies d’application des LLM dans divers cas d’utilisation, il est devenu tout aussi important de simplifier le développement d’applications d’IA générative. LangChaîne est un framework open source populaire qui facilite le développement d'applications d'IA générative. La modération Amazon Comprehend étend le cadre LangChain pour offrir des capacités d'identification et de rédaction des informations personnelles, de détection de la toxicité et de classification rapide de la sécurité via AmazonComprehendModerationChain.

AmazonComprehendModerationChain est une implémentation personnalisée de Chaîne de base LangChain interface. Cela signifie que les applications peuvent utiliser cette chaîne avec leurs propres Chaînes LLM pour appliquer la modération souhaitée à l'invite de saisie ainsi qu'au texte de sortie du LLM. Les chaînes peuvent être construites en fusionnant plusieurs chaînes ou en mélangeant des chaînes avec d'autres composants. Vous pouvez utiliser AmazonComprehendModerationChain avec d'autres chaînes LLM pour développer des applications d'IA complexes de manière modulaire et flexible.

Pour l’expliquer davantage, nous fournissons quelques exemples dans les sections suivantes. Le code source du AmazonComprehendModerationChain la mise en œuvre peut être trouvée dans le Dépôt open source LangChain. Pour une documentation complète de l'interface API, reportez-vous à la documentation de l'API LangChain pour le Chaîne de modération Amazon Comprehend. Utiliser cette chaîne de modération est aussi simple que d'initialiser une instance de la classe avec les configurations par défaut :

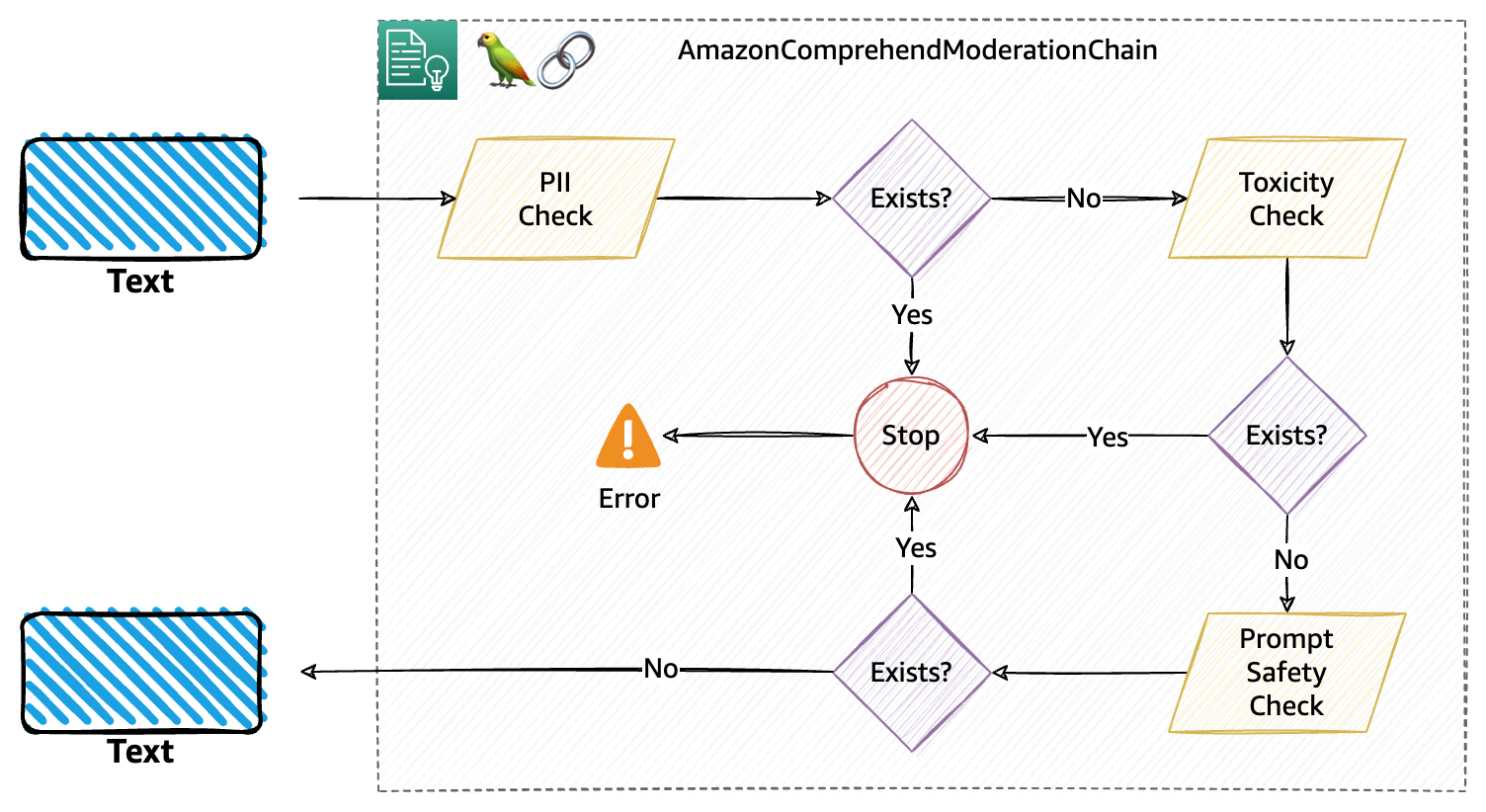

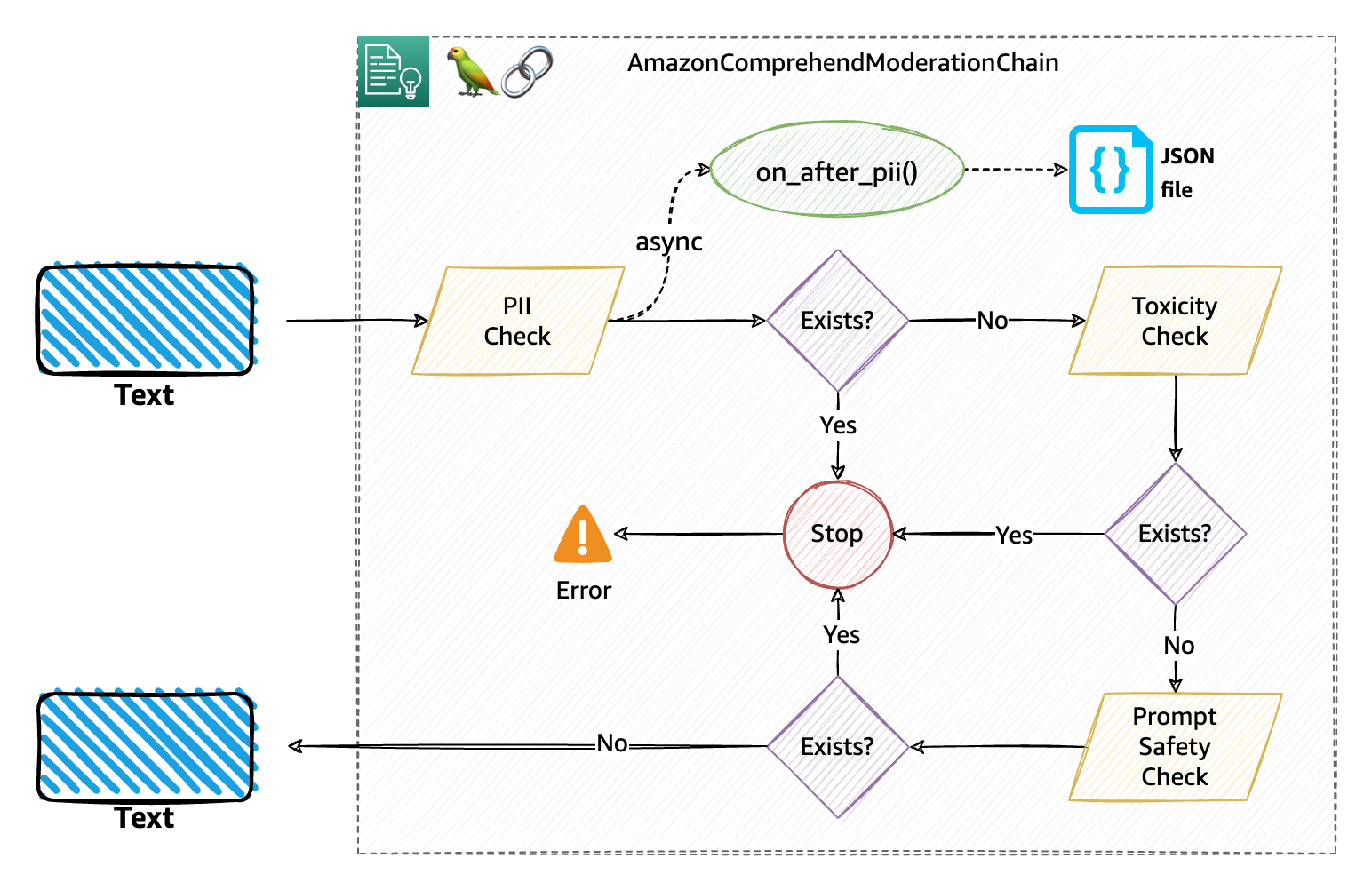

En coulisses, la chaîne de modération effectue trois contrôles de modération consécutifs, à savoir les informations personnelles, la toxicité et la sécurité rapide, comme expliqué dans le diagramme suivant. Il s'agit du flux par défaut pour la modération.

L'extrait de code suivant montre un exemple simple d'utilisation de la chaîne de modération avec le Amazon FalconLite LLM (qui est une version quantifiée du Modèle Falcon 40B SFT OASST-TOP1) hébergé dans Hugging Face Hub :

Dans l'exemple précédent, nous augmentons notre chaîne avec comprehend_moderation pour le texte entrant dans le LLM et le texte généré par le LLM. Cela effectuera une modération par défaut qui vérifiera les informations personnelles, la toxicité et la classification de sécurité rapide dans cette séquence.

Personnalisez votre modération avec les configurations de filtres

Vous pouvez utiliser le AmazonComprehendModerationChain avec des configurations spécifiques, ce qui vous donne la possibilité de contrôler les modérations que vous souhaitez effectuer dans votre application basée sur l'IA générative. Au cœur de la configuration, vous disposez de trois configurations de filtres disponibles.

- ModérationPiiConfig – Utilisé pour configurer le filtre PII.

- ModérationToxicitéConfig – Utilisé pour configurer le filtre de contenu toxique.

- ModerationIntentConfig – Utilisé pour configurer le filtre d’intention.

Vous pouvez utiliser chacune de ces configurations de filtres pour personnaliser le comportement de vos modérations. Les configurations de chaque filtre ont quelques paramètres communs et des paramètres uniques avec lesquels ils peuvent être initialisés. Après avoir défini les configurations, vous utilisez le BaseModerationConfig classe pour définir l’ordre dans lequel les filtres doivent s’appliquer au texte. Par exemple, dans le code suivant, nous définissons d'abord les trois configurations de filtres, puis spécifions l'ordre dans lequel elles doivent s'appliquer :

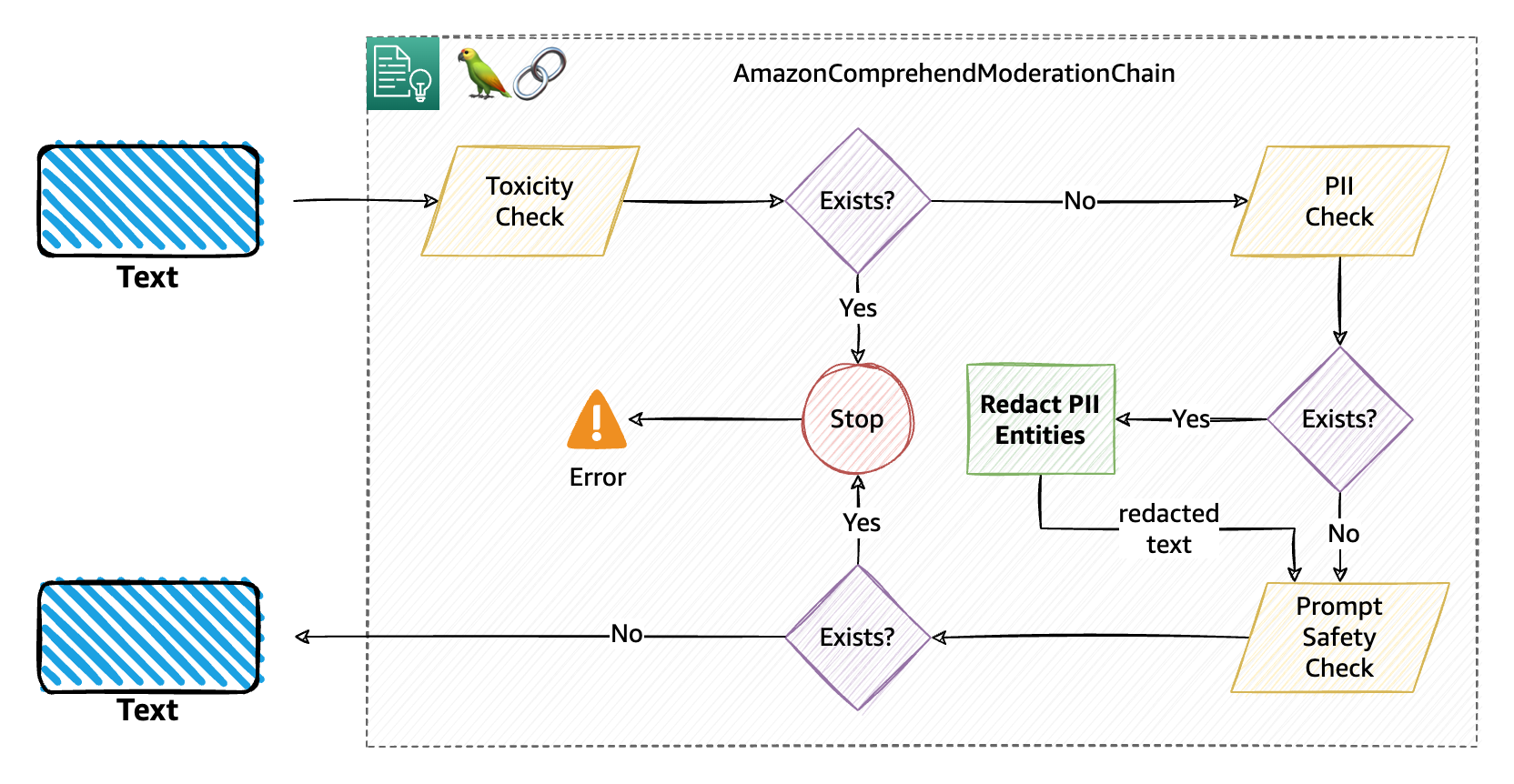

Allons un peu plus en profondeur pour comprendre ce que cette configuration permet :

- Premièrement, pour le filtre de toxicité, nous avons précisé un seuil de 0.6. Cela signifie que si le texte contient l’une des étiquettes toxiques disponibles ou des entités avec un score supérieur au seuil, toute la chaîne sera interrompue.

- Si aucun contenu toxique n'est trouvé dans le texte, une vérification PII est effectuée. Dans ce cas, nous souhaitons vérifier si le texte contient des valeurs SSN. Parce que le

redactparamètre est défini surTrue, la chaîne masquera les valeurs SSN détectées (le cas échéant) où le score de confiance de l'entité SSN est supérieur ou égal à 0.5, avec le caractère de masque spécifié (X). Siredactest fixé àFalse, la chaîne sera interrompue pour tout SSN détecté. - Enfin, la chaîne effectue une classification de sécurité rapide et empêchera le contenu de se propager plus loin dans la chaîne si le contenu est classé avec

UNSAFE_PROMPTavec un score de confiance supérieur ou égal à 0.8.

Le diagramme suivant illustre ce flux de travail.

En cas d'interruption de la chaîne de modération (dans cet exemple, applicable pour les filtres de toxicité et de classification rapide de sécurité), la chaîne soulèvera un Exception Python, arrêtant essentiellement la chaîne en cours et vous permettant d'intercepter l'exception (dans un bloc try-catch) et d'effectuer toute action pertinente. Les trois types d'exceptions possibles sont :

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Vous pouvez configurer un ou plusieurs filtres à l'aide de BaseModerationConfig. Vous pouvez également avoir le même type de filtre avec des configurations différentes au sein d’une même chaîne. Par exemple, si votre cas d'utilisation concerne uniquement les informations personnelles, vous pouvez spécifier une configuration qui doit interrompre la chaîne si un SSN est détecté ; sinon, il doit effectuer une rédaction sur l'âge et le nom des entités PII. Une configuration pour cela peut être définie comme suit :

Utiliser des rappels et des identifiants uniques

Si vous êtes familier avec le concept de workflows, vous connaissez peut-être également rappels. Les rappels au sein des workflows sont des morceaux de code indépendants qui s'exécutent lorsque certaines conditions sont remplies dans le workflow. Un rappel peut être bloquant ou non bloquant pour le flux de travail. Les chaînes LangChain sont, par essence, des flux de travail pour les LLM. AmazonComprehendModerationChain vous permet de définir vos propres fonctions de rappel. Initialement, l'implémentation est limitée aux fonctions de rappel asynchrones (non bloquantes).

Cela signifie effectivement que si vous utilisez des rappels avec la chaîne de modération, ils s'exécuteront indépendamment de l'exécution de la chaîne sans la bloquer. Pour la chaîne de modération, vous disposez d'options pour exécuter des morceaux de code, avec n'importe quelle logique métier, après l'exécution de chaque modération, indépendamment de la chaîne.

Vous pouvez également éventuellement fournir une chaîne d'identifiant unique arbitraire lors de la création d'un AmazonComprehendModerationChain pour activer la journalisation et l'analyse ultérieurement. Par exemple, si vous exploitez un chatbot alimenté par un LLM, vous souhaiterez peut-être suivre les utilisateurs qui sont constamment abusifs ou qui exposent délibérément ou inconsciemment des informations personnelles. Dans de tels cas, il devient nécessaire de suivre l'origine de ces invites et peut-être de les stocker dans une base de données ou de les enregistrer de manière appropriée pour une action ultérieure. Vous pouvez transmettre un identifiant unique qui identifie distinctement un utilisateur, tel que son nom d'utilisateur ou son adresse e-mail, ou un nom d'application qui génère l'invite.

La combinaison de rappels et d'identifiants uniques vous offre un moyen puissant de mettre en œuvre une chaîne de modération qui correspond à votre cas d'utilisation de manière beaucoup plus cohérente avec moins de code et plus facile à maintenir. Le gestionnaire de rappel est disponible via le BaseModerationCallbackHandler, avec trois rappels disponibles : on_after_pii(), on_after_toxicity()et une on_after_prompt_safety(). Chacune de ces fonctions de rappel est appelée de manière asynchrone après que la vérification de modération respective ait été effectuée au sein de la chaîne. Ces fonctions reçoivent également deux paramètres par défaut :

- moderation_beacon – Un dictionnaire contenant des détails tels que le texte sur lequel la modération a été effectuée, la sortie JSON complète de l'API Amazon Comprehend, le type de modération et si les étiquettes fournies (dans la configuration) ont été trouvées ou non dans le texte

- identifiant unique – L'ID unique que vous avez attribué lors de l'initialisation d'une instance du

AmazonComprehendModerationChain.

Ce qui suit est un exemple du fonctionnement d’une implémentation avec rappel. Dans ce cas, nous avons défini un seul rappel que nous souhaitons que la chaîne exécute après la vérification des PII :

Nous utilisons ensuite le my_callback objet lors de l'initialisation de la chaîne de modération et passez également un unique_id. Vous pouvez utiliser des rappels et des identifiants uniques avec ou sans configuration. Quand tu sous-classes BaseModerationCallbackHandler, vous devez implémenter une ou toutes les méthodes de rappel en fonction des filtres que vous comptez utiliser. Par souci de concision, l'exemple suivant montre une façon d'utiliser les rappels et unique_id sans aucune configuration :

Le schéma suivant explique le fonctionnement de cette chaîne de modération avec rappels et identifiants uniques. Plus précisément, nous avons implémenté le rappel PII qui doit écrire un fichier JSON avec les données disponibles dans le moderation_beacon et les terres parsemées de

unique_id transmis (l'email de l'utilisateur dans ce cas).

Dans ce qui suit Cahier Python, nous avons compilé différentes manières de configurer et d'utiliser la chaîne de modération avec différents LLM, tels que les LLM hébergés avec Amazon SageMaker JumpStart et hébergé dans Visage câlin. Nous avons également inclus l'exemple d'application de chat dont nous avons discuté précédemment avec les éléments suivants Cahier Python.

Conclusion

Le potentiel de transformation des grands modèles linguistiques et de l’IA générative est indéniable. Cependant, leur utilisation responsable et éthique dépend de la résolution des problèmes de confiance et de sécurité. En reconnaissant les défis et en mettant activement en œuvre des mesures pour atténuer les risques, les développeurs, les organisations et la société dans son ensemble peuvent exploiter les avantages de ces technologies tout en préservant la confiance et la sécurité qui sous-tendent leur intégration réussie. Utilisez Amazon Comprehend ContentModerationChain pour ajouter des fonctionnalités de confiance et de sécurité à n'importe quel flux de travail LLM, y compris les flux de travail de génération augmentée de récupération (RAG) implémentés dans LangChain.

Pour plus d'informations sur la création de solutions basées sur RAG à l'aide de LangChain et de la solution hautement précise basée sur l'apprentissage automatique (ML) d'Amazon Kendra. recherche intelligente, voir - Créez rapidement des applications d'IA générative de haute précision sur les données d'entreprise à l'aide d'Amazon Kendra, LangChain et de grands modèles de langage. Comme étape suivante, reportez-vous au exemples de code nous avons créé pour utiliser la modération Amazon Comprehend avec LangChain. Pour une documentation complète de l'API de la chaîne de modération Amazon Comprehend, reportez-vous au LangChain Documentation de l'API.

À propos des auteurs

Wrick Talukdar est architecte senior au sein de l'équipe Amazon Comprehend Service. Il travaille avec les clients d'AWS pour les aider à adopter l'apprentissage automatique à grande échelle. En dehors du travail, il aime lire et photographier.

Wrick Talukdar est architecte senior au sein de l'équipe Amazon Comprehend Service. Il travaille avec les clients d'AWS pour les aider à adopter l'apprentissage automatique à grande échelle. En dehors du travail, il aime lire et photographier.

Anjan Biswas est un architecte senior de solutions de services d'IA avec un accent sur l'IA/ML et l'analyse de données. Anjan fait partie de l'équipe mondiale des services d'IA et travaille avec les clients pour les aider à comprendre et à développer des solutions aux problèmes commerciaux liés à l'IA et au ML. Anjan a plus de 14 ans d'expérience de travail avec des organisations mondiales de chaîne d'approvisionnement, de fabrication et de vente au détail, et aide activement les clients à démarrer et à évoluer sur les services AWS AI.

Anjan Biswas est un architecte senior de solutions de services d'IA avec un accent sur l'IA/ML et l'analyse de données. Anjan fait partie de l'équipe mondiale des services d'IA et travaille avec les clients pour les aider à comprendre et à développer des solutions aux problèmes commerciaux liés à l'IA et au ML. Anjan a plus de 14 ans d'expérience de travail avec des organisations mondiales de chaîne d'approvisionnement, de fabrication et de vente au détail, et aide activement les clients à démarrer et à évoluer sur les services AWS AI.

Nikhil Jha est responsable de compte technique senior chez Amazon Web Services. Ses domaines d'intervention incluent l'IA/ML et l'analytique. Dans ses temps libres, il aime jouer au badminton avec sa fille et explorer le plein air.

Nikhil Jha est responsable de compte technique senior chez Amazon Web Services. Ses domaines d'intervention incluent l'IA/ML et l'analytique. Dans ses temps libres, il aime jouer au badminton avec sa fille et explorer le plein air.

Menton Rane est architecte de solutions spécialisées en IA/ML chez Amazon Web Services. Elle est passionnée par les mathématiques appliquées et l'apprentissage automatique. Elle se concentre sur la conception de solutions intelligentes de traitement de documents pour les clients AWS. En dehors du travail, elle aime danser la salsa et la bachata.

Menton Rane est architecte de solutions spécialisées en IA/ML chez Amazon Web Services. Elle est passionnée par les mathématiques appliquées et l'apprentissage automatique. Elle se concentre sur la conception de solutions intelligentes de traitement de documents pour les clients AWS. En dehors du travail, elle aime danser la salsa et la bachata.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- capacités

- capacité

- A Propos

- abus

- accès

- Compte

- Avec cette connaissance vient le pouvoir de prendre

- Atteint

- à travers

- Action

- actes

- activement

- ajouter

- propos

- adresses

- adresser

- adhérer

- adopter

- Adoption

- conseils

- Après

- âge

- AI

- Services d'IA

- Systèmes d'IA

- AI / ML

- Tous

- permis

- Permettre

- permet

- déjà

- aussi

- tout à fait

- Amazon

- Amazon comprendre

- Amazone Kendra

- Amazon Web Services

- quantités

- an

- analytique

- des analyses

- et les

- Annoncer

- répondre

- tous

- api

- Apis

- en vigueur

- Application

- applications

- appliqué

- s'applique

- Appliquer

- approprié

- de manière appropriée

- SONT

- domaines

- AS

- demander

- demandant

- aspects

- attribué

- assistants

- associé

- At

- augmenter

- augmentée

- disponibles

- AWS

- soutenu

- Mal

- base

- basé

- BE

- car

- devenez

- devient

- humain

- va

- croyances

- avantages.

- jusqu'à XNUMX fois

- Au-delà

- Block

- blocage

- tous les deux

- frontières

- plus large

- construire

- construire la confiance

- Développement

- construit

- la performance des entreprises

- entreprises

- mais

- by

- Appelez-nous

- rappels

- appelé

- CAN

- capacités

- aptitude

- capable

- capital

- carte

- maisons

- cas

- Attraper

- certaines

- chaîne

- Chaînes

- globaux

- caractère

- Chatbot

- Chatbots

- vérifier

- vérification

- Contrôles

- menton

- le choix

- classe

- les classes

- classification

- classifié

- Classer

- client

- code

- cohésif

- COM

- combinaison

- combiné

- commentaire

- Commun

- complexe

- composants électriques

- comprendre

- concept

- concerné

- Préoccupations

- conditions

- confiance

- configuration

- consécutif

- régulièrement

- contient

- contenu

- Génération de contenu

- des bactéries

- controversé

- Core

- créée

- La création

- Conception

- crédit

- carte de crédit

- critique

- crucial

- Customiser

- des clients

- Support à la clientèle

- Clients

- personnalisables

- personnaliser

- Tous les jours

- Danse

- données

- Analyse de Donnée

- confidentialité des données

- Base de données

- ensembles de données

- décisions

- profond

- Réglage par défaut

- Vous permet de définir

- défini

- delve

- démontrer

- démontre

- Selon

- conception

- voulu

- détails

- détecter

- détecté

- Détection

- Déterminer

- développer

- mobiles

- Développement

- différent

- numérique

- discuter

- discuté

- distinctement

- plongeon

- do

- document

- Documentation

- INSTITUTIONNELS

- biche

- down

- deux

- e

- chacun

- Plus tôt

- plus facilement

- de manière efficace

- sans effort

- non plus

- d'autre

- permettre

- fin

- Endless

- assurer

- assurer

- Entreprise

- entités

- entité

- Environment

- égal

- également

- erreur

- essence

- essential

- essentiellement

- éthique

- exemple

- exemples

- Sauf

- exception

- existant

- d'experience

- Expériences

- Expliquer

- expliqué

- Explique

- explicitement

- Explorer

- express

- S'étend

- extrait

- Visage

- familier

- Fonctionnalité

- Fonctionnalités:

- few

- Déposez votre dernière attestation

- une fonction filtre

- filtration

- filtres

- la traduction de documents financiers

- Trouvez

- trouve

- Prénom

- marqué

- drapeaux

- flexible

- flux

- Focus

- concentré

- se concentre

- Abonnement

- suit

- Pour

- formulaire

- le format

- document

- forums

- trouvé

- Framework

- France

- De

- plein

- fonctions

- plus

- générer

- généré

- générateur

- génération

- génératif

- IA générative

- obtenez

- gif

- Donner

- donné

- donne

- Global

- objectif

- Goes

- aller

- Bien

- plus grand

- Pousse

- Croissance

- l'orientation

- Maniabilité

- arrive

- nuisible

- harnais

- haine

- Vous avez

- ayant

- he

- vous aider

- aider

- aide

- très

- charnières

- sa

- organisé

- Comment

- How To

- Cependant

- HTML

- HTTPS

- Moyeu

- humain

- Humain-Comme

- i

- ID

- Identification

- identifiant

- Identificateurs

- identifie

- identifier

- identifier

- if

- Illégal

- illustre

- image

- Impact

- Mettre en oeuvre

- la mise en oeuvre

- mis en œuvre

- la mise en œuvre

- importer

- importance

- important

- in

- par inadvertance

- comprendre

- inclus

- inclut

- Y compris

- Améliore

- Augmente

- de plus en plus

- indépendant

- indépendamment

- secteurs

- influencer

- d'information

- possible

- contribution

- entrées

- Messages

- instance

- des services

- l'intégration

- Intelligent

- Traitement intelligent des documents

- l'intention

- intention

- intéressé

- Interfaces

- interrompu

- développement

- introduire

- IT

- SES

- John

- JOHN DOE

- jpg

- json

- juste

- Etiquettes

- langue

- gros

- plus tard

- apprentissage

- à gauche

- Légal

- moins

- comme

- probabilité

- limité

- Liste

- peu

- un peu plus profond

- LLM

- enregistrer

- enregistrement

- logique

- recherchez-

- click

- machine learning

- maintenir

- FAIT DU

- manager

- manière

- fabrication

- masque

- mathématiques

- Matière

- Mai..

- me

- veux dire

- les mesures

- mécanisme

- Médias

- médical

- fusion

- la ficelle d'étiquettes/étiquettes volantes en carton

- méthodes

- une mauvaise utilisation

- Réduire les

- Mixage audio

- ML

- modèle

- numériques jumeaux (digital twin models)

- modération

- application

- PLUS

- beaucoup

- must

- my

- prénom

- à savoir

- noms

- Nature

- Traitement du langage naturel

- nécessaire

- Nouveauté

- Nouvelles fonctionnalités

- next

- nlp

- aucune

- maintenant

- nombre

- numéros

- nombreux

- objet

- of

- offensive

- code

- compensations

- on

- ONE

- uniquement

- ouvert

- open source

- fonctionner

- d'exploitation

- Options

- or

- de commander

- organisations

- origine

- Autre

- autrement

- nos

- ande

- les résultats

- l'extérieur

- sortie

- sorties

- au contrôle

- plus de

- propre

- paramètre

- paramètres

- PARAMOUNT

- partie

- particulièrement

- pass

- passé

- passionné

- Mot de Passe

- réinitialiser le mot de passe

- Patron de Couture

- Effectuer

- effectué

- effectue

- être

- personnel

- Personnellement

- Téléphone

- photographie

- pièce

- pièces

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- politique

- Populaire

- position

- positif

- possibilités

- possible

- Post

- défaillances

- l'éventualité

- power

- alimenté

- solide

- conservation

- prévention

- qui se déroulent

- primaire

- principes

- priorisation

- la confidentialité

- Privé

- information privée

- d'ouvrabilité

- procédures

- processus

- traitement

- profond

- Progrès

- correctement

- protéger

- fournir

- fournit

- Python

- question

- augmenter

- gamme

- gammes

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- plutôt

- atteindre

- en cours

- royaume

- recevoir

- reconnaissant

- réduire

- réduire

- reportez-vous

- région

- régulateurs

- pertinent

- fiable

- réputation

- nécessaire

- Exigences

- ressource

- ceux

- réponse

- réponses

- responsabilité

- responsables

- restrictions

- détail

- Retours

- bon

- Analyse

- risques

- Courir

- s

- des

- Sécurité

- sagemaker

- même

- Escaliers intérieurs

- Scènes

- But

- fluide

- Section

- les sections

- sécurité

- sur le lien

- Chercher

- AUTO

- supérieur

- sensible

- envoyé

- phrase

- Séquence

- service

- Services

- set

- elle

- devrait

- montrer

- vitrine

- montré

- Spectacles

- signaux

- De même

- étapes

- simplifier

- unique

- Sites

- Fragment

- So

- Réseaux sociaux

- réseaux sociaux

- Société

- Solutions

- quelques

- quelque chose

- Identifier

- code source

- parle

- spécialiste

- groupe de neurones

- spécifiquement

- spécifié

- discours

- Normes

- Commencer

- j'ai commencé

- Déclaration

- étapes

- Arrêter

- arrêt

- Boutique

- Chaîne

- Par la suite

- réussi

- tel

- fourni

- la quantité

- chaîne d'approvisionnement

- Support

- Les soutiens

- durable

- Système

- Prenez

- tâches

- équipe

- Technique

- Les technologies

- modèle

- texte

- que

- qui

- Le

- Le Capital

- La Source

- leur

- Les

- puis

- Là.

- ainsi

- Ces

- l'ont

- this

- des menaces

- trois

- порог

- Avec

- fiable

- à

- les outils

- suivre

- qualifié

- transformation

- La confiance

- Essai

- deux

- type

- types

- devoiler

- indéniable

- étayer

- comprendre

- compréhension

- expérience unique et authentique

- Universel

- Défendre

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- utiliser

- utilisé

- Précieux

- Plus-value

- Valeurs

- variété

- divers

- Vaste

- version

- via

- Salle de conférence virtuelle

- W

- souhaitez

- était

- Façon..

- façons

- we

- web

- services Web

- WELL

- ont été

- Quoi

- Qu’est ce qu'

- quand

- Les

- que

- qui

- tout en

- WHO

- la totalité

- why

- large

- Large gamme

- sera

- souhaiter

- comprenant

- dans les

- sans

- Témoin

- activités principales

- workflow

- workflows

- de travail

- vos contrats

- écrire

- écriture

- X

- années

- Vous n'avez

- Votre

- zéphyrnet