Si vous avez été sur les réseaux sociaux cette semaine, vous avez probablement rencontré des photos d'images générées par l'IA de vos amis en tant qu'êtres féeriques, personnages animés, avatars et êtres magiques.

Cela est en partie dû à Lensa, une IA qui synthétise des portraits numériques basés sur les photos téléchargées par les utilisateurs. Les portraits de l'application ont pratiquement envahi Internet, Lensa devenant l'application la plus téléchargée de l'App Store d'Apple.

Lensa, comme toutes les applications d'intelligence artificielle qui rendent numériquement des images, a suscité à la fois l'admiration et la controverse pour sa sexualisation apparemment flagrante des images féminines. D'autres utilisateurs ont noté que l'application rendait leur peau plus pâle ou leur corps plus mince.

A lire également: Une technologie d'IA qui crée de fausses images profondes qui détruisent la vie

Comment obtenir votre propre 'avatar magique'

Les images qui font le tour sont une fière création de la fonction d'avatars magiques de Lensa. Pour s'en faire une idée, il faut télécharger l'application Lensa sur un téléphone. Un abonnement annuel coûte environ 35.99 $, mais ses services sont également disponibles, mais avec des limitations gratuites, sur un essai d'une semaine si l'on veut le vérifier en premier.

Cependant, la génération des avatars magiques populaires nécessite des frais supplémentaires en raison de ce que l'application dit être une "puissance de calcul énorme" à atteindre.

Lors d'un essai gratuit, on peut obtenir 50 avatars pour 3.99 $ et 200 avatars pour 7.99 $. Afin d'obtenir les meilleurs résultats, l'application encourage les utilisateurs à télécharger au moins 20 images en gros plan.

Idéalement, ces images devraient être des gros plans de son visage avec un éventail d'arrière-plans, d'expressions faciales et d'angles différents. L'application insiste sur le fait que les utilisateurs doivent avoir 13 ans et plus. Lensa n'est pas une application entièrement nouvelle.

Produit de Prisma, l'application est devenue populaire en 2016 grâce à une fonction qui permettait aux utilisateurs de transformer leurs selfies en photos dans le style d'artistes célèbres.

Comment fonctionne Lensa ?

Selon la société, elle utilise ce qu'elle appelle la «technologie API TrueDepth» où un utilisateur fournit des photos ou des «données faciales», puis l'IA est ensuite formée sur ses algorithmes pour mieux fonctionner et vous montrer de meilleurs résultats. La formation, c'est quand l'IA traite les données, valide et teste les modèles.

Pour utiliser l'application, vous pouvez organiser 20 selfies avec une variété d'expressions et d'angles et choisir l'option 100 avatars.

Il faut environ 20 minutes pour faire le travail. Une fois cela fait, l'IA renvoie des avatars qui se répartissent en 10 catégories telles que fantaisie, fée princesse, focus, pop, élégant, animé, léger, kawaii, irisé et cosmique.

"En général, j'avais l'impression que l'application faisait un travail décent en produisant des images artistiques basées sur mes selfies. Je ne pouvais pas vraiment me reconnaître dans la plupart des portraits, mais je pouvais voir d'où ils venaient. Zoé Sottile de CNN a écrit.

"Il semblait reconnaître et répéter certaines caractéristiques, comme ma peau pâle ou mon nez rond, plus que d'autres. Certaines d'entre elles étaient dans un style plus réaliste et étaient assez proches pour que je puisse penser qu'elles étaient en fait des photos de moi si je les voyais de loin. D'autres étaient nettement plus stylisés et artistiques, donc ils me semblaient moins spécifiques.

Sottile a remarqué que l'IA la rendait également plus légère.

Quant à moi, j'ai aussi senti que cela me rendait automatiquement plus léger et l'image que j'ai essayée dans ma galerie de moi et d'un ami à la peau légèrement plus foncée a renvoyé une version un peu beaucoup plus claire de nous, clairement une exagération, et a révélé une tendance à éclaircir tons de peau noire.

Sexualiser les femmes

D'autres qui l'ont utilisé avaient des préoccupations plus ou moins similaires.

Les femmes disent que l'IA sexualise rapidement leurs images. Mais dans un article précédent, nous expliqué cela a été rendu possible par le grand nombre d'images sexualisées trouvées dans les ensembles de données utilisés dans la formation à l'IA.

En d'autres termes, cela signifie que l'IA ne sait que trop comment générer ces images et devenir facilement pornographiques. Avec un peu de ruse, il peut être invité à produire involontairement du porno à partir de ces images si un utilisateur le souhaite.

sexualiser une jeune femme qui passait la plupart de son temps sous les yeux du public en portant des vêtements amples juste pour éviter ce type de sexualisation. interdire aux hommes d'utiliser l'IA https://t.co/YnNCurvYDS

— jeanne d'arc mais un coco (@postnuclearjoan) 13 décembre 2022

Dans d'autres histoires, nous avons expliqué comment les IA peuvent être trompées en fournissant des informations sur la façon de créer un bombe par exemple. Étrangement, la question de la sexualisation n'apparaissait pas dans les images d'hommes téléchargées sur la fonction Magic Avatar. Pour MIT Technology Review, Melissa Heikkilä écrit,

"Mes avatars ont été pornifiés de manière caricaturale, tandis que mes collègues masculins sont devenus des astronautes, des explorateurs et des inventeurs."

Sottile, d'autre part, a remarqué que l'IA avait "dans l'une des images les plus désorientantes" la faisait ressembler "à une version de mon visage sur un corps nu".

"Sur plusieurs photos, on aurait dit que j'étais nue mais avec une couverture stratégiquement placée, ou l'image juste coupée pour cacher quoi que ce soit d'explicite", a-t-elle déclaré.

"Et de nombreuses images, même lorsque j'étais entièrement habillée, comportaient une expression faciale sensuelle, un décolleté important et des vêtements étriqués qui ne correspondaient pas aux photos que j'avais soumises", ajoute Zoe Sottile.

D'autres ont exprimé leur crainte de devenir des stars du porno grâce à une technologie d'intelligence artificielle comme Lensa.

ALERTE: N'importe qui dans le monde peut avoir votre PORNO NON CONSENSUEL maintenant !!

Les gens sont impressionnés par les outils d'IA génératifs comme Lensa sans en comprendre les conséquences désastreuses.

🧵 LE PIRE ? voici ce que les entreprises ne veulent pas que vous sachiez : pic.twitter.com/gdS0h1FbXj

— Krithart Mittal | Ghostwriter 🖋️ (@kritarthmittal) 14 décembre 2022

Honte du corps

Pour les femmes en pleine forme, l'expérience était quelque peu différente et même pire dans certains cas. L'IA les a rendus plus minces et sexy.

"Pour Lmfao, si vous avez une dysmorphie corporelle, n'utilisez pas cette application Lensa pour les photos générées par l'IA. Ceci est votre avertissement », un utilisateur écrit.

Une autre a déclaré que l'application l'avait rendue asiatique.

J'ai essayé l'application AI Lensa. Dites-moi pourquoi l'IA m'a fait paraître plus asiatique que jamais ? 😂😂😂😂 pic.twitter.com/lveJNXaXHO

– Kristina🌴🌊🐚 (@kut1e) 9 décembre 2022

Un autre utilisateur s'est adressé à Twitter pour se plaindre d'avoir payé 8 $ pour souffrir de dysmorphie corporelle lorsqu'il a utilisé l'IA.

payé 8 $ à Lensa juste pour faire l'expérience de la dysmorphie corporelle pic.twitter.com/NRYfh5Jyej

– garrett (@dollhaus_x) 3 décembre 2022

La dysmorphie corporelle est un problème de santé mentale dans lequel une personne passe beaucoup de temps à s'inquiéter des défauts de son apparence. Ces défauts sont souvent imperceptibles pour les autres.

Une autre s'est plainte que l'IA perdait automatiquement un poids important sur ses images autrement pleines de chiffres.

"Une plainte que j'ai à propos de Lensa AI est qu'elle vous rendra maigre dans certaines images. En tant que grosse personne, ces images me dérangeaient vraiment. Faites donc attention à ne pas vous déclencher si vous êtes un gros gras qui n'a aucun intérêt à devenir maigre », a écrit Mariah Successful (@Shlatz) le 5 décembre 2022.

Bombe à retardement psychologique

Et les psychologues sont d'accord avec ses déclarations selon lesquelles l'IA pourrait déclencher des femmes pleinement figurées.

Un psychologue clinicien, le Dr. Toni Pikoos, un praticien de la santé mentale basé en Australie, qui fait des recherches et se spécialise dans le traitement des troubles dysmorphiques corporels, pensait que l'application pouvait faire plus de mal que de bien et n'était rien d'autre qu'un "outil de photo-filtrage" pour modifier la perception de soi.

"Lorsqu'il y a un plus grand écart entre l'apparence idéale et perçue, cela peut alimenter l'insatisfaction corporelle, la détresse et le désir de réparer ou de changer son apparence avec des moyens potentiellement malsains ou dangereux", comme des troubles de l'alimentation ou des procédures cosmétiques inutiles, dit Pikoos.

Elle s'est dite préoccupée par le fait que les images effaçaient des «détails complexes» tels que «des taches de rousseur et des lignes», ce qui pourrait accroître les inquiétudes concernant sa peau. Cela pourrait également déclencher psychologiquement une personne vulnérable, dit-elle.

« Voir une image extérieure leur refléter leur insécurité ne fait que renforcer l'idée 'Tu vois, ça ne va pas chez moi ! Et je ne suis pas le seul à pouvoir le voir !' », déclare Pikoos.

Du fait que l'IA introduit ses propres fonctionnalités qui ne représentent pas l'apparence réelle de l'utilisateur, l'application pourrait créer de nouvelles angoisses, dit-il.

Elle dit que les "avatars magiques" de l'IA étaient "particulièrement intéressants parce qu'ils semblent plus objectifs - comme si un être externe et omniscient avait généré cette image de ce à quoi vous ressemblez".

Cela, selon elle, serait réellement "utile" pour les personnes atteintes d'un trouble dysmorphique corporel et aiderait à faire la lumière sur un "décalage" entre "la vision négative qu'un individu a d'eux-mêmes et la façon dont les autres le voient".

Elle a cependant noté que l'IA n'était pas objective en raison de sa tentative de dépeindre une version sans faille et plus "améliorée et perfectionnée" de son visage.

Par exemple, une personne souffrant de trouble dysmorphique corporel, ou BDD, "peut éprouver un bref regain de confiance lorsqu'elle voit son image et souhaite partager cette version d'elle-même avec le monde", dit-elle, mais sera durement touchée par la réalité lorsqu'elle est éteinte. écran, sans filtre, dans le miroir ou une photo qu'ils prennent d'eux-mêmes.

Défendre les siens

Andrey Usoltsev, PDG de Prisma Labs, a déclaré que son entreprise était actuellement "submergée" de demandes de renseignements sur Lensa et a proposé un lien vers une page FAQ qui répond aux questions sur les images sexualisées, mais pas le type de réactions des utilisateurs décrit par Pikoos.

"Voir cela reflété dans l'application serait très confrontant et fournirait une sorte de" confirmation "de la façon dont ils se voient", les amenant à devenir "plus enracinés dans le désordre".

Diffusion stable

Lensa utilise également Stable Diffusion, qui utilise une synthèse d'apprentissage en profondeur qui peut créer de nouvelles images à partir de descriptions textuelles et peut fonctionner sur un PC Windows ou Linux, sur un Mac ou dans le cloud sur du matériel informatique loué.

Le réseau de neurones de Stable Diffusion a, à l'aide d'un apprentissage intensif, maîtrisé les mots associés et l'association statistique générale entre les positions des pixels dans les images.

Nous avons couvert dans un autre DE BOUBA comment la technologie pourrait avoir des conséquences dévastatrices en rendant et en représentant des images de personnes semblant être des criminels ou être impliquées dans des pratiques peu flatteuses telles que le vol.

Par exemple, on peut donner à Stable Diffusion open source une invite, telle que "Tom Hanks dans une salle de classe", et cela lui donnera une nouvelle image de Tom Hanks dans une salle de classe. Dans le cas de Tom Hank, c'est une promenade dans le parc car des centaines de ses photos sont déjà dans l'ensemble de données utilisé pour former Stable Diffusion.

Les artistes aussi

Côté art, certains artistes sont mécontents.

Ils craignent que l'IA ne menace leurs moyens de subsistance. En effet, les artistes, y compris les artistes numériques, ne peuvent pas non plus produire aussi rapidement que l'IA pour un portrait numérique.

Je les recadre pour des raisons de confidentialité/parce que je n'essaie pas d'appeler qui que ce soit. Ce sont tous des portraits de Lensa où les restes mutilés de la signature d'un artiste sont encore visibles. C'est le reste de la signature de l'un des multiples artistes qu'il a volé.

Le 🧵 https://t.co/0lS4WHmQfW pic.twitter.com/7GfDXZ22s1

– Lauryn Ipsum (@LaurynIpsum) 6 décembre 2022

La société mère de Lensa, Prisma, a tenté de masser les inquiétudes concernant sa technologie en éliminant le travail des artistes numériques.

"Alors que les humains et l'IA apprennent les styles artistiques de manière semi-similaire, il existe des différences fondamentales : l'IA est capable d'analyser et d'apprendre rapidement à partir de grands ensembles de données, mais elle n'a pas le même niveau d'attention et d'appréciation pour l'art. comme un être humain," écrit la société sur Twitter le 6 décembre.

Il dit "les sorties ne peuvent pas être décrites comme des répliques exactes d'une œuvre d'art particulière."

Est-ce de l'art généré par l'IA ou de l'art copié par l'IA ? L'IA Lensa vole-t-elle l'art humain ? Un expert explique la controverse https://t.co/cxi2t6URC7 pic.twitter.com/20xJgbHZgA

– John Chapman (@JChapman1729) 15 décembre 2022

Altérer l'image de soi

Kerry Bowman, bioéthicienne à l'Université de Toronto, affirme que l'IA a le potentiel d'affecter négativement l'image de soi, entre autres problèmes éthiques.

"À certains égards, cela peut être très amusant, mais ces images idéalisées sont motivées par des attentes sociales qui peuvent être très cruelles et très étroites", a déclaré Bowman lundi.

Bowman a déclaré que ces programmes d'IA utilisent des sources d'ensembles de données telles qu'Internet à la recherche de différents styles artistiques pour créer ces portraits. L'inconvénient est que lorsque AI fait cela, les artistes sont rarement rémunérés financièrement pour l'utilisation de leur travail ou crédités.

"Ce qui se passe avec l'IA émergente, c'est que les lois n'ont pas été en mesure de vraiment suivre cela en termes de droit d'auteur. C'est très difficile et très trouble et l'éthique est encore plus loin derrière les lois parce que je dirais que c'est fondamentalement injuste », a déclaré Bowman.

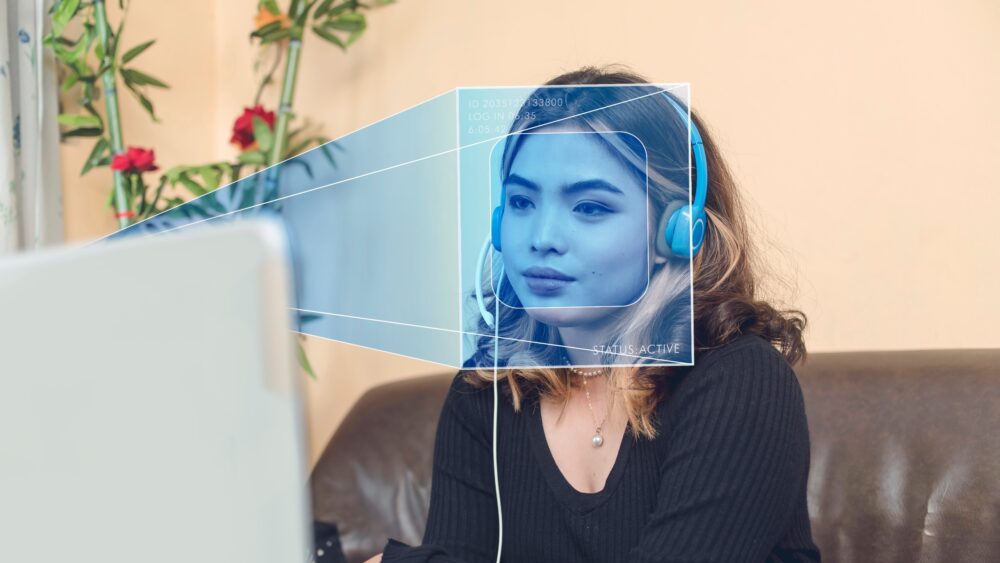

Préoccupations relatives aux données personnelles

Bowman a également soulevé des inquiétudes sur la manière dont les données personnelles des personnes sont stockées.

« Voulez-vous vraiment que votre visage figure dans une grande base de données ? Les gens doivent décider par eux-mêmes à ce sujet, mais ce n'est pas bénin, il n'y a rien à cela, ce n'est pas seulement amusant », a-t-il déclaré.

Lensa dit que les photos sont conservées sur les serveurs et dans les applications pendant 24 heures maximum. Avec des algorithmes d'apprentissage en profondeur et d'apprentissage automatique, l'IA recueille et fournit ensuite de meilleurs résultats à l'avenir, également sur la base des données supprimées. Cela, dit Bowman, entraînera des problèmes de sécurité concernant l'utilisation potentielle de la reconnaissance faciale, car ce type de données pourrait être utilisé illégalement par la police.

- AI

- Albright Stonebridge

- antitrust

- Barack Obama

- Bitcoin

- blockchain

- conformité de la blockchain

- Californie

- Chine

- coinbase

- cognitif

- Consensus

- conférence cryptographique

- extraction de crypto

- crypto-monnaie

- Administrateur du cyberespace de Chine

- Décentralisé

- deepfakes

- DeFi

- Actifs numériques

- Donald Trump

- Ethereum

- machine learning

- MétaActualités

- jeton non fongible

- Paul Trio

- Platon

- platon ai

- Intelligence des données Platon

- PlatonDonnées

- jeu de platogamie

- Polygone

- la preuve de la participation

- Règlement

- règlements

- Technologie

- W3

- Xi Jinping

- zéphyrnet