La saga Clearview AI continue !

Si vous n'avez jamais entendu parler de cette entreprise auparavant, voici un très récapitulatif clair et concis du régulateur français de la vie privée, la CNIL (Commission Nationale de l'Informatique et des Libertés), qui a très facilement publié ses conclusions et décisions dans cette longue histoire en français et en anglais :

Clearview AI collecte des photographies sur de nombreux sites Web, y compris les médias sociaux. Il collecte toutes les photographies directement accessibles sur ces réseaux (c'est-à-dire visualisables sans connexion à un compte). Les images sont également extraites de vidéos disponibles en ligne sur toutes les plateformes.

Ainsi, la société a collecté plus de 20 milliards d'images dans le monde.

Grâce à cette collecte, la société commercialise l'accès à sa banque d'images sous la forme d'un moteur de recherche dans lequel une personne peut être recherchée à partir d'une photographie. La société propose ce service aux forces de l'ordre afin d'identifier les auteurs ou les victimes d'actes criminels.

La technologie de reconnaissance faciale est utilisée pour interroger le moteur de recherche et trouver une personne sur la base de sa photo. Pour ce faire, l'entreprise construit un « gabarit biométrique », c'est-à-dire une représentation numérique des caractéristiques physiques d'une personne (le visage en l'occurrence). Ces données biométriques sont particulièrement sensibles, notamment parce qu'elles sont liées à notre identité physique (ce que nous sommes) et nous permettent de nous identifier de manière unique.

La grande majorité des personnes dont les images sont collectées dans le moteur de recherche ne connaissent pas cette fonctionnalité.

Clearview AI a suscité la colère des entreprises, des organisations de protection de la vie privée et des régulateurs au cours des dernières années, notamment en étant frappé par :

- Plaintes et recours collectifs déposé dans l'Illinois, le Vermont, New York et la Californie.

- Un défi juridique du American Civil Liberties Union (ACLU).

- Ordonnances de cesser et de s'abstenir de Facebook, Google et YouTube, qui ont estimé que Clearview activités de grattage violé leurs termes et conditions.

- Mesures de répression et amendes in Australie et Royaume-Uni.

- Un jugement déclarant son fonctionnement illégal en 2021, par la société française précitée régulateur.

Aucun intérêt légitime

En décembre 2021, la CNIL a déclaré, assez crûment, cette:

[C]ette société n'obtient pas le consentement des personnes concernées pour collecter et utiliser leurs photographies pour alimenter son logiciel.

Clearview AI n'a pas non plus d'intérêt légitime à collecter et utiliser ces données, notamment compte tenu du caractère intrusif et massif du procédé, qui permet de récupérer les images présentes sur Internet de plusieurs dizaines de millions d'internautes en France. Ces personnes, dont les photographies ou les vidéos sont accessibles sur divers sites internet, y compris les réseaux sociaux, ne s'attendent pas raisonnablement à ce que leurs images soient traitées par l'entreprise pour alimenter un système de reconnaissance faciale qui pourrait être utilisé par les États à des fins répressives.

La gravité de ce manquement a conduit la présidence de la CNIL à ordonner à Clearview AI de cesser, faute de base légale, la collecte et l'utilisation des données des personnes sur le territoire français, dans le cadre de l'exploitation du logiciel de reconnaissance faciale qu'elle commercialise.

Par ailleurs, la CNIL a émis l'avis que Clearview AI ne semblait pas très soucieux du respect des règles européennes en matière de collecte et de traitement des données personnelles :

Les réclamations reçues par la CNIL ont révélé les difficultés rencontrées par les plaignants pour exercer leurs droits auprès de Clearview AI.

D'une part, la société ne facilite pas l'exercice du droit d'accès de la personne concernée :

- en limitant l'exercice de ce droit aux données collectées au cours des douze mois précédant la demande ;

- en limitant l'exercice de ce droit à deux fois par an, sans justification ;

- en ne répondant à certaines demandes qu'après un nombre excessif de demandes d'une même personne.

En revanche, l'entreprise ne répond pas efficacement aux demandes d'accès et d'effacement. Il fournit des réponses partielles ou ne répond pas du tout aux demandes.

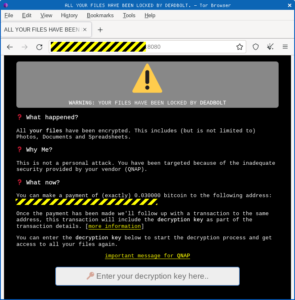

La CNIL a même publié une infographie qui résume sa décision, et son processus décisionnel :

Les commissaires à l'information australien et britannique sont arrivés à des conclusions similaires, avec des résultats similaires pour Clearview AI : votre collecte de données est illégale dans nos juridictions ; vous devez arrêter de le faire ici.

Cependant, comme nous l'avons dit en mai 2022, lorsque le Royaume-Uni a annoncé qu'il infligerait une amende à Clearview AI environ 7,500,000 £ (en bas de la Une amende de 17 millions de livres sterling proposée pour la première fois) et ordonnant à la société de ne plus collecter de données sur les résidents britanniques, "Comment cela sera contrôlé, et encore moins appliqué, n'est pas clair."

On est peut-être sur le point de savoir comment l'entreprise sera policière à l'avenir, avec la CNIL perdre patience avec Clearview AI pour ne pas avoir respecté sa décision d’arrêter de collecter les données biométriques des Français…

…et annonçant une amende de 20,000,000 XNUMX XNUMX € :

Suite à une mise en demeure restée sans suite, la CNIL a prononcé une astreinte de 20 millions d'euros et ordonné à CLEARVIEW AI de cesser de collecter et d'utiliser des données sur des personnes en France sans base légale et de supprimer les données déjà collectées.

Et ensuite?

Comme nous l'avons déjà écrit, Clearview AI semble non seulement heureux d'ignorer les décisions réglementaires prises à son encontre, mais aussi de s'attendre à ce que les gens se sentent désolés pour lui en même temps, et en fait d'être de son côté pour fournir ce qu'il pense. est un service vital pour la société.

Dans la décision britannique, où le régulateur a suivi une ligne similaire à celle de la CNIL en France, l'entreprise a été informée que son comportement était illégal, indésirable et devait cesser immédiatement.

Mais les rapports de l'époque suggéraient que loin de faire preuve d'humilité, le PDG de Clearview, Hoan Ton-That, avait réagi avec un sentiment d'ouverture ce ne serait pas déplacé dans une chanson d'amour tragique :

Cela me brise le cœur que Clearview AI n'ait pas été en mesure d'aider lors de la réception de demandes urgentes d'agences britanniques chargées de l'application des lois cherchant à utiliser cette technologie pour enquêter sur des cas d'abus sexuels graves sur des enfants au Royaume-Uni.

Comme nous l'avons suggéré en mai 2022, la société pourrait trouver ses nombreux adversaires répondre avec leurs propres paroles de chanson :

Séchez vos larmes. (N'agissez pas comme si vous ne le saviez pas.)

Que pensez-vous?

Clearview AI fournit-il vraiment un service bénéfique et socialement acceptable aux forces de l'ordre ?

Ou piétine-t-il avec désinvolture notre vie privée et notre présomption d'innocence en collectant illégalement des données biométriques et en les commercialisant à des fins de suivi d'enquête sans consentement (et, apparemment, sans limite) ?

Faites-nous savoir dans les commentaires ci-dessous… vous pouvez rester anonyme.

- blockchain

- Clearview

- IA Clearview

- cognitif

- portefeuilles de crypto-monnaie

- cryptoexchange

- la cyber-sécurité

- les cybercriminels

- Cybersécurité

- collecte de données

- département de la Sécurité intérieure

- portefeuilles numériques

- la reconnaissance faciale

- pare-feu

- Kaspersky

- La loi et l'ordre

- malware

- Mcafee

- Sécurité nue

- NexBLOC

- Platon

- platon ai

- Intelligence des données Platon

- Jeu de Platon

- PlatonDonnées

- jeu de platogamie

- la confidentialité

- VPN

- la sécurité d'un site web

- zéphyrnet

![S3 Ep118 : Devinez votre mot de passe ? Pas besoin si c'est déjà volé ! [Audio + Texte] S3 Ep118 : Devinez votre mot de passe ? Pas besoin si c'est déjà volé ! [Audio + Texte]](https://platoblockchain.com/wp-content/uploads/2023/01/s3-ep118-guess-your-password-no-need-if-its-stolen-already-audio-text-360x188.png)