Les clients des soins de santé et des sciences de la vie (HCLS) adoptent l’IA générative comme outil pour tirer le meilleur parti de leurs données. Les cas d'utilisation incluent le résumé de documents pour aider les lecteurs à se concentrer sur les points clés d'un document et la transformation de texte non structuré en formats standardisés pour mettre en évidence les attributs importants. Avec des formats de données uniques et des exigences réglementaires strictes, les clients recherchent des choix pour sélectionner le modèle le plus performant et le plus rentable, ainsi que la possibilité d'effectuer la personnalisation (réglage précis) nécessaire pour s'adapter à leur cas d'utilisation métier. Dans cet article, nous vous guidons dans le déploiement d'un grand modèle de langage (LLM) Falcon à l'aide de Amazon SageMaker JumpStart et utiliser le modèle pour résumer de longs documents avec LangChain et Python.

Vue d'ensemble de la solution

Amazon Sage Maker s'appuie sur les deux décennies d'expérience d'Amazon dans le développement d'applications ML réelles, notamment les recommandations de produits, la personnalisation, les achats intelligents, la robotique et les appareils à assistance vocale. SageMaker est un service géré éligible HIPAA qui fournit des outils permettant aux scientifiques des données, aux ingénieurs ML et aux analystes commerciaux d'innover avec le ML. Dans SageMaker se trouve Amazon SageMakerStudio, un environnement de développement intégré (IDE) spécialement conçu pour les flux de travail collaboratifs de ML, qui, à leur tour, contiennent une grande variété de solutions de démarrage rapide et de modèles de ML pré-entraînés dans un hub intégré appelé SageMaker JumpStart. Avec SageMaker JumpStart, vous pouvez utiliser des modèles pré-entraînés, tels que Falcon LLM, avec des exemples de blocs-notes prédéfinis et la prise en charge du SDK pour expérimenter et déployer ces puissants modèles de transformateur. Vous pouvez utiliser SageMaker Studio et SageMaker JumpStart pour déployer et interroger votre propre modèle génératif dans votre compte AWS.

Vous pouvez également vous assurer que les données de charge utile d'inférence ne quittent pas votre VPC. Vous pouvez provisionner des modèles en tant que points de terminaison à locataire unique et les déployer avec une isolation réseau. De plus, vous pouvez organiser et gérer l'ensemble sélectionné de modèles qui répondent à vos propres exigences de sécurité en utilisant la fonctionnalité de hub de modèles privés dans SageMaker JumpStart et en y stockant les modèles approuvés. SageMaker est dans la portée de HIPAA-BAA, SOC123et une HITRUST CSF.

La LLM Faucon est un grand modèle de langage, formé par des chercheurs du Technology Innovation Institute (TII) sur plus de 1 40 milliards de jetons à l'aide d'AWS. Falcon a de nombreuses variantes différentes, avec ses deux composants principaux Falcon 7B et Falcon 40B, composés respectivement de 7 milliards et XNUMX milliards de paramètres, avec des versions affinées et entraînées pour des tâches spécifiques, telles que suivre des instructions. Falcon s'acquitte bien d'une variété de tâches, notamment la synthèse de texte, l'analyse des sentiments, la réponse aux questions et la conversation. Cet article fournit une procédure pas à pas que vous pouvez suivre pour déployer Falcon LLM dans votre compte AWS, en utilisant une instance de notebook géré via SageMaker JumpStart pour expérimenter le résumé de texte.

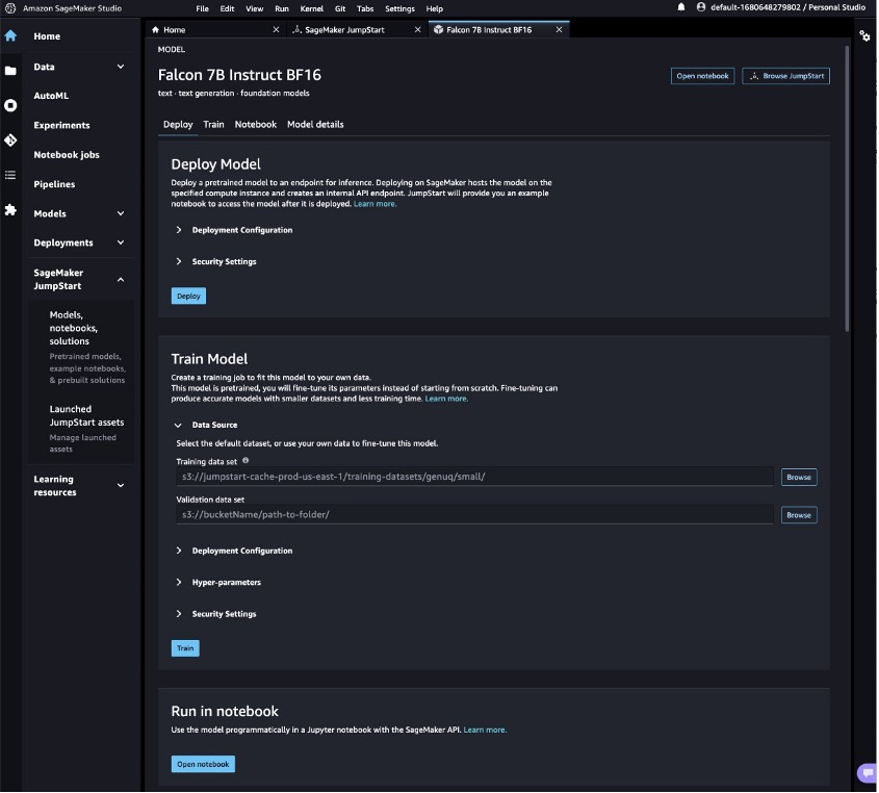

Le hub de modèles SageMaker JumpStart comprend des blocs-notes complets pour déployer et interroger chaque modèle. Au moment d'écrire ces lignes, six versions de Falcon sont disponibles dans le hub de modèles SageMaker JumpStart : Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 et Falcon 7B BF16. Cet article utilise le modèle Falcon 7B Instruct.

Dans les sections suivantes, nous montrons comment démarrer avec la synthèse de documents en déployant Falcon 7B sur SageMaker Jumpstart.

Pré-requis

Pour ce didacticiel, vous aurez besoin d'un compte AWS avec un domaine SageMaker. Si vous n'avez pas encore de domaine SageMaker, reportez-vous à Intégration au domaine Amazon SageMaker pour en créer un.

Déployer Falcon 7B à l'aide de SageMaker JumpStart

Pour déployer votre modèle, procédez comme suit:

- Accédez à votre environnement SageMaker Studio à partir de la console SageMaker.

- Au sein de l'IDE, sous SageMaker JumpStart dans le volet de navigation, choisissez Modèles, cahiers, solutions.

- Déployez le modèle Falcon 7B Instruct sur un point de terminaison pour l'inférence.

Cela ouvrira la carte de modèle pour le modèle Falcon 7B Instruct BF16. Sur cette page, vous trouverez le Déployer or Train options ainsi que des liens pour ouvrir les exemples de blocs-notes dans SageMaker Studio. Cet article utilisera l'exemple de notebook de SageMaker JumpStart pour déployer le modèle.

- Selectionnez Cahier ouvert.

- Exécutez les quatre premières cellules du bloc-notes pour déployer le point de terminaison Falcon 7B Instruct.

Vous pouvez voir vos modèles JumpStart déployés sur la page Lancement des ressources JumpStart .

- Dans le volet de navigation, sous Démarrage de SageMaker, choisissez Lancement des ressources JumpStart.

- Choisissez le Points de terminaison du modèle pour afficher l'état de votre point de terminaison.

Une fois le point de terminaison Falcon LLM déployé, vous êtes prêt à interroger le modèle.

Exécutez votre première requête

Pour exécuter une requête, procédez comme suit :

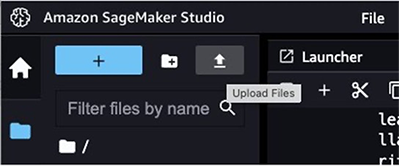

- Sur le Déposez votre dernière attestation menu, choisissez Nouveauté ainsi que Cahier pour ouvrir un nouveau bloc-notes.

Vous pouvez également télécharger le carnet complété ici.

- Sélectionnez l'image, le noyau et le type d'instance lorsque vous y êtes invité. Pour cet article, nous choisissons l'image Data Science 3.0, le noyau Python 3 et l'instance ml.t3.medium.

- Importez les modules Boto3 et JSON en saisissant les deux lignes suivantes dans la première cellule :

- Presse Maj + Entrée pour faire fonctionner la cellule.

- Ensuite, vous pouvez définir une fonction qui appellera votre point de terminaison. Cette fonction prend une charge utile de dictionnaire et l'utilise pour appeler le client d'exécution SageMaker. Ensuite, il désérialise la réponse et imprime l'entrée et le texte généré.

La charge utile inclut l'invite en tant qu'entrées, ainsi que les paramètres d'inférence qui seront transmis au modèle.

- Vous pouvez utiliser ces paramètres avec l'invite pour ajuster la sortie du modèle en fonction de votre cas d'utilisation :

Requête avec une invite de résumé

Cet article utilise un exemple de document de recherche pour démontrer le résumé. L'exemple de fichier texte concerne le résumé automatique de texte dans la littérature biomédicale. Effectuez les étapes suivantes :

- Télécharger le PDF et copiez le texte dans un fichier nommé

document.txt. - Dans SageMaker Studio, choisissez l'icône de téléchargement et téléchargez le fichier sur votre instance SageMaker Studio.

Prêt à l'emploi, Falcon LLM prend en charge le résumé de texte.

- Créons une fonction qui utilise des techniques d'ingénierie rapides pour résumer

document.txt:

Vous remarquerez que pour les documents plus longs, une erreur apparaît : Falcon, comme tous les autres LLM, a une limite sur le nombre de jetons transmis en entrée. Nous pouvons contourner cette limite en utilisant les capacités de synthèse améliorées de LangChain, qui permettent de transmettre une entrée beaucoup plus importante au LLM.

Importer et exécuter une chaîne de synthèse

LangChain est une bibliothèque de logiciels open source qui permet aux développeurs et aux data scientists de créer, régler et déployer rapidement des applications génératives personnalisées sans gérer des interactions ML complexes, couramment utilisées pour résumer de nombreux cas d'utilisation courants des modèles de langage d'IA génératifs en seulement quelques lignes de code. La prise en charge de LangChain pour les services AWS inclut la prise en charge des points de terminaison SageMaker.

LangChain fournit une interface accessible aux LLM. Ses fonctionnalités incluent des outils de création de modèles d'invites et de chaînage d'invites. Ces chaînes peuvent être utilisées pour résumer des documents texte plus longs que ce que le modèle de langage prend en charge en un seul appel. Vous pouvez utiliser une stratégie de réduction de carte pour résumer de longs documents en les décomposant en morceaux gérables, en les résumant et en les combinant (et en les résumant à nouveau, si nécessaire).

- Installons LangChain pour commencer :

- Importez les modules pertinents et décomposez le long document en morceaux :

- Pour que LangChain fonctionne efficacement avec Falcon, vous devez définir les classes de gestionnaire de contenu par défaut pour une entrée et une sortie valides :

- Vous pouvez définir des invites personnalisées comme

PromptTemplateobjets, le principal véhicule d'invite avec LangChain, pour l'approche de synthèse par réduction de carte. Il s'agit d'une étape facultative car les invites de mappage et de combinaison sont fournies par défaut si les paramètres de l'appel pour charger la chaîne de récapitulation (load_summarize_chain) ne sont pas définis.

- LangChain prend en charge les LLM hébergés sur les points de terminaison d'inférence SageMaker. Ainsi, au lieu d'utiliser le SDK AWS Python, vous pouvez initialiser la connexion via LangChain pour une plus grande accessibilité :

- Enfin, vous pouvez charger une chaîne de synthèse et exécuter un résumé sur les documents d'entrée en utilisant le code suivant :

Parce que le verbose paramètre est défini sur True, vous verrez tous les résultats intermédiaires de l'approche map-reduce. Ceci est utile pour suivre la séquence des événements afin d’arriver à un résumé final. Avec cette approche de réduction de mappage, vous pouvez efficacement résumer des documents beaucoup plus longtemps que ce qui est normalement autorisé par la limite maximale de jetons d'entrée du modèle.

Nettoyer

Une fois que vous avez fini d'utiliser le point de terminaison d'inférence, il est important de le supprimer pour éviter d'engager des coûts inutiles via les lignes de code suivantes :

Utilisation d'autres modèles de base dans SageMaker JumpStart

L'utilisation d'autres modèles de base disponibles dans SageMaker JumpStart pour la synthèse de documents nécessite une surcharge minimale de configuration et de déploiement. Les LLM varient parfois en fonction de la structure des formats d'entrée et de sortie, et à mesure que de nouveaux modèles et solutions prédéfinies sont ajoutés à SageMaker JumpStart, en fonction de l'implémentation de la tâche, vous devrez peut-être apporter les modifications de code suivantes :

- Si vous effectuez une synthèse via le

summarize()méthode (la méthode sans utiliser LangChain), vous devrez peut-être modifier la structure JSON dupayloadparamètre, ainsi que la gestion de la variable de réponse dans lequery_endpoint()fonction - Si vous effectuez une synthèse via LangChain

load_summarize_chain()méthode, vous devrez peut-être modifier leContentHandlerTextSummarizationclasse, en particulier letransform_input()ainsi quetransform_output()fonctions, pour gérer correctement la charge utile attendue par le LLM et la sortie renvoyée par le LLM

Les modèles de base varient non seulement en fonction de facteurs tels que la vitesse et la qualité de l'inférence, mais également en termes de formats d'entrée et de sortie. Reportez-vous à la page d'informations pertinente du LLM sur les entrées et sorties attendues.

Conclusion

Le modèle Falcon 7B Instruct est disponible sur le hub de modèles SageMaker JumpStart et fonctionne sur un certain nombre de cas d'utilisation. Cet article a montré comment vous pouvez déployer votre propre point de terminaison Falcon LLM dans votre environnement à l'aide de SageMaker JumpStart et réaliser vos premières expériences à partir de SageMaker Studio, vous permettant ainsi de prototyper rapidement vos modèles et de passer en toute transparence à un environnement de production. Avec Falcon et LangChain, vous pouvez résumer efficacement des documents longs sur les soins de santé et les sciences de la vie à grande échelle.

Pour plus d'informations sur l'utilisation de l'IA générative sur AWS, consultez Annonce de nouveaux outils pour créer avec l'IA générative sur AWS. Vous pouvez commencer à expérimenter et à créer des preuves de concept de synthèse de documents pour vos applications GenAI axées sur les soins de santé et les sciences de la vie en utilisant la méthode décrite dans cet article. Quand Socle amazonien est généralement disponible, nous publierons un article de suivi montrant comment vous pouvez mettre en œuvre la synthèse de documents à l'aide d'Amazon Bedrock et LangChain.

À propos des auteurs

John Kitaoka est architecte de solutions chez Amazon Web Services. John aide les clients à concevoir et à optimiser les charges de travail IA/ML sur AWS pour les aider à atteindre leurs objectifs commerciaux.

John Kitaoka est architecte de solutions chez Amazon Web Services. John aide les clients à concevoir et à optimiser les charges de travail IA/ML sur AWS pour les aider à atteindre leurs objectifs commerciaux.

Josh Famestad est architecte de solutions chez Amazon Web Services. Josh travaille avec des clients du secteur public pour créer et exécuter des approches basées sur le cloud afin de répondre aux priorités commerciales.

Josh Famestad est architecte de solutions chez Amazon Web Services. Josh travaille avec des clients du secteur public pour créer et exécuter des approches basées sur le cloud afin de répondre aux priorités commerciales.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :possède

- :est

- :ne pas

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- capacité

- RÉSUMÉ

- Accepte

- accessibilité

- accessible

- Compte

- atteindre

- ajoutée

- L'adoption d'

- encore

- AI

- AI / ML

- Tous

- permis

- Permettre

- permet

- aux côtés de

- déjà

- aussi

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- selon une analyse de l’Université de Princeton

- Analystes

- ainsi que

- animal

- animaux

- Application

- applications

- une approche

- approches

- ,

- SONT

- autour

- AS

- At

- attributs

- Automatique

- disponibles

- éviter

- AWS

- basé

- BE

- car

- commencer

- croit

- Milliards

- biomédical

- corps

- goupille

- Box

- Pause

- Rupture

- construire

- Développement

- construit

- la performance des entreprises

- mais

- by

- Appelez-nous

- appelé

- CAN

- Peut obtenir

- capacités

- aptitude

- carte

- maisons

- cas

- Cellules

- chaîne

- Chaînes

- Change

- Modifications

- choix

- Selectionnez

- choose

- classe

- les classes

- client

- le cloud

- code

- collaborative

- combiner

- combinant

- Commun

- communément

- par rapport

- complet

- Complété

- complexe

- Composé

- concept

- concis

- connexion

- Console

- contiennent

- contenu

- rentable

- Costs

- engendrent

- Customiser

- Clients

- personnalisation

- données

- science des données

- décennies

- Réglage par défaut

- Vous permet de définir

- livrer

- démontrer

- démontré

- Selon

- déployer

- déployé

- déployer

- déploiement

- Conception

- mobiles

- développement

- Développement

- Compatibles

- différent

- do

- document

- INSTITUTIONNELS

- Ne fait pas

- domaine

- Ne pas

- down

- download

- chacun

- Terre

- de manière efficace

- permettre

- Endpoint

- ENGINEERING

- Les ingénieurs

- améliorée

- assurer

- entrant

- Environment

- erreur

- événements

- exemple

- exécuter

- attendu

- attend

- d'experience

- expérience

- expériences

- Visage

- facteurs

- non

- Fonctionnalités:

- few

- Déposez votre dernière attestation

- finale

- Trouvez

- Prénom

- s'adapter

- Focus

- suivre

- Abonnement

- Pour

- Fondation

- quatre

- De

- fonction

- fonctions

- En outre

- généralement

- générer

- généré

- génératif

- IA générative

- obtenez

- Objectifs

- plus grand

- manipuler

- Maniabilité

- Vous avez

- la médecine

- vous aider

- aide

- Souligner

- organisé

- Comment

- How To

- HTML

- HTTPS

- Moyeu

- ICON

- if

- image

- Mettre en oeuvre

- la mise en oeuvre

- importer

- important

- in

- comprendre

- inclut

- Y compris

- d'information

- innovons

- Innovation

- contribution

- entrées

- installer

- instance

- plutôt ;

- Institut

- Des instructions

- des services

- Intelligent

- interactions

- Interfaces

- développement

- seul

- IT

- SES

- John

- json

- juste

- ACTIVITES

- langue

- gros

- plus importantes

- lancé

- Laisser

- Bibliothèque

- VIE

- Life Sciences

- LIMIT

- lignes

- Gauche

- littérature

- LLM

- charge

- Location

- plus long

- recherchez-

- Entrée

- a prendre une

- gérer

- maniable

- gérés

- les gérer

- de nombreuses

- cartographie

- maximales

- Mai..

- moyenne

- Menu

- méthode

- minimal

- ML

- modèle

- numériques jumeaux (digital twin models)

- modifier

- Modules

- PLUS

- (en fait, presque toutes)

- beaucoup

- Navigation

- nécessaire

- Besoin

- nécessaire

- réseau et

- Nouveauté

- NIH

- normalement

- cahier

- Remarquer..

- nombre

- objets

- of

- on

- ONE

- uniquement

- ouvert

- open source

- Logiciels open source

- Optimiser

- Options

- Autre

- décrit

- sortie

- plus de

- propre

- page

- pain

- Papier

- paramètre

- paramètres

- passé

- Effectuer

- effectuer

- effectue

- Personnalisation

- Platon

- Intelligence des données Platon

- PlatonDonnées

- des notes bonus

- Post

- solide

- Imprimé

- impressions

- Privé

- processus

- Produit

- Vidéo

- preuves

- prototype

- fournir

- à condition de

- fournit

- disposition

- public

- publier

- Python

- qualité

- question

- vite.

- rapidement

- lecteurs

- solutions

- monde réel

- recommandations

- reportez-vous

- régulateurs

- pertinent

- Exigences

- a besoin

- un article

- chercheurs

- respectivement

- réponse

- retourner

- robotique

- Courir

- sagemaker

- Inférence SageMaker

- Escaliers intérieurs

- Sciences

- STARFLEET SCIENCES

- scientifiques

- portée

- Sdk

- de façon transparente

- les sections

- secteur

- sécurité

- sur le lien

- choisi

- AUTO

- sentiment

- Séquence

- service

- Services

- set

- mise

- Shopping

- Shorts

- montrer

- unique

- SIX

- So

- Logiciels

- Solutions

- groupe de neurones

- spécifiquement

- vitesse

- Commencer

- j'ai commencé

- Statut

- étapes

- Étapes

- stockage

- de Marketing

- Strict

- structure

- studio

- tel

- résumé

- RÉSUMÉ

- Support

- Les soutiens

- prend

- Tâche

- tâches

- techniques

- Technologie

- Innovation technologique

- texte

- que

- qui

- La

- leur

- Les

- puis

- Là.

- Ces

- this

- Avec

- à

- ensemble

- jeton

- Tokens

- outil

- les outils

- qualifié

- transformateur

- transformer

- transition

- Billion

- oui

- TOUR

- tutoriel

- deux

- type

- indéfini

- expérience unique et authentique

- inutile

- Téléchargement

- utilisé

- cas d'utilisation

- d'utiliser

- Usages

- en utilisant

- variable

- variété

- véhicule

- versions

- via

- Voir

- marcher

- walkthrough

- we

- web

- services Web

- WELL

- Quoi

- quand

- qui

- large

- sera

- comprenant

- dans les

- sans

- activités principales

- workflows

- de travail

- vos contrats

- écrire

- écriture

- Vous n'avez

- Votre

- zéphyrnet