Dans cet article, nous introduisons une nouvelle analyse dans le Rapport sur la qualité des données et les informations of Gestionnaire de données Amazon SageMaker. Cette analyse vous aide à valider l'exactitude des caractéristiques textuelles et à découvrir les lignes invalides à réparer ou à omettre.

Data Wrangler réduit le temps nécessaire à l'agrégation et à la préparation des données pour l'apprentissage automatique (ML) de quelques semaines à quelques minutes. Vous pouvez simplifier le processus de préparation des données et d'ingénierie des fonctionnalités, et effectuer chaque étape du flux de travail de préparation des données, y compris la sélection, le nettoyage, l'exploration et la visualisation des données, à partir d'une interface visuelle unique.

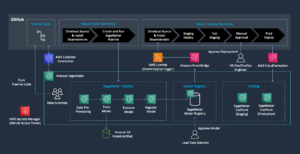

Vue d'ensemble de la solution

Le prétraitement des données implique souvent le nettoyage des données textuelles telles que les adresses e-mail, les numéros de téléphone et les noms de produits. Ces données peuvent avoir des contraintes d'intégrité sous-jacentes qui peuvent être décrites par des expressions régulières. Par exemple, pour être considéré comme valide, un numéro de téléphone local devra peut-être suivre un modèle tel que [1-9][0-9]{2}-[0-9]{4}, qui correspondrait à un chiffre différent de zéro, suivi de deux chiffres supplémentaires, suivi d'un tiret, suivi de quatre chiffres supplémentaires.

Les scénarios courants entraînant des données invalides peuvent inclure une saisie humaine incohérente, par exemple des numéros de téléphone dans différents formats (5551234 contre 555 1234 contre 555-1234) ou des données inattendues, telles que 0, 911 ou 411. Pour un centre d'appels client, il est important d'omettre les nombres tels que 0, 911 ou 411, et de valider (et potentiellement corriger) les entrées telles que 5551234 ou 555 1234.

Malheureusement, même si des contraintes textuelles existent, elles peuvent ne pas être fournies avec les données. Par conséquent, un data scientist préparant un ensemble de données doit découvrir manuellement les contraintes en examinant les données. Cela peut être fastidieux, sujet aux erreurs et prendre beaucoup de temps.

L'apprentissage de modèles analyse automatiquement vos données et fait apparaître les contraintes textuelles qui peuvent s'appliquer à votre ensemble de données. Pour l'exemple des numéros de téléphone, l'apprentissage de modèles peut analyser les données et identifier que la grande majorité des numéros de téléphone suivent la contrainte textuelle. [1-9][0-9]{2}-[0-9][4]. Il peut également vous alerter de l'existence d'exemples de données invalides afin que vous puissiez les exclure ou les corriger.

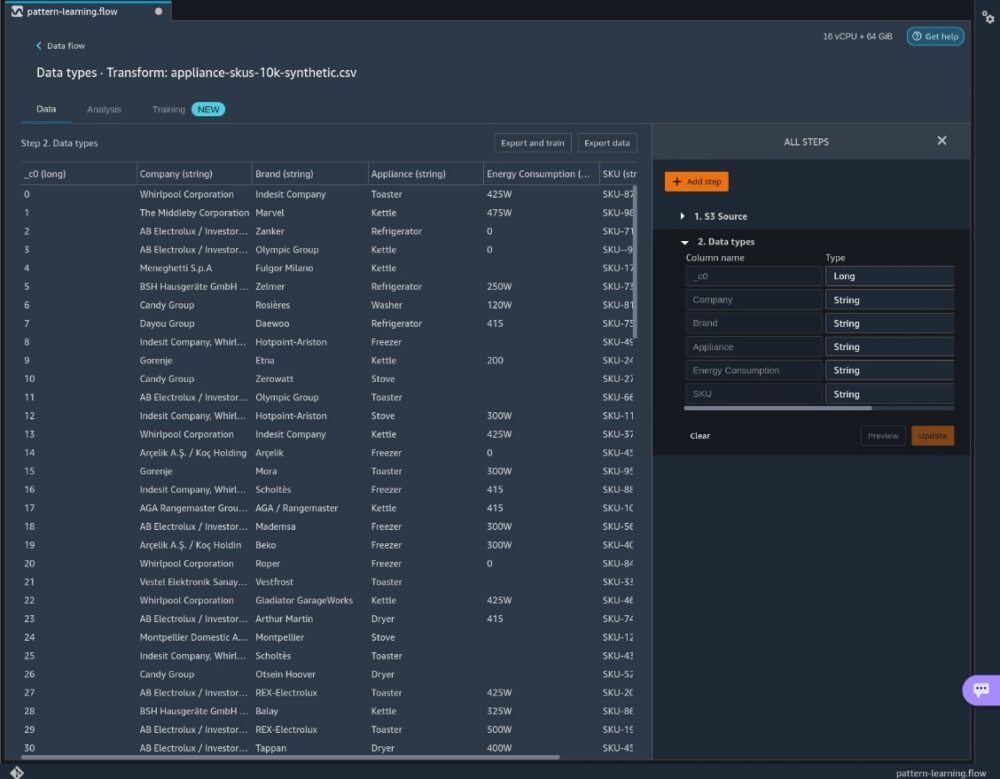

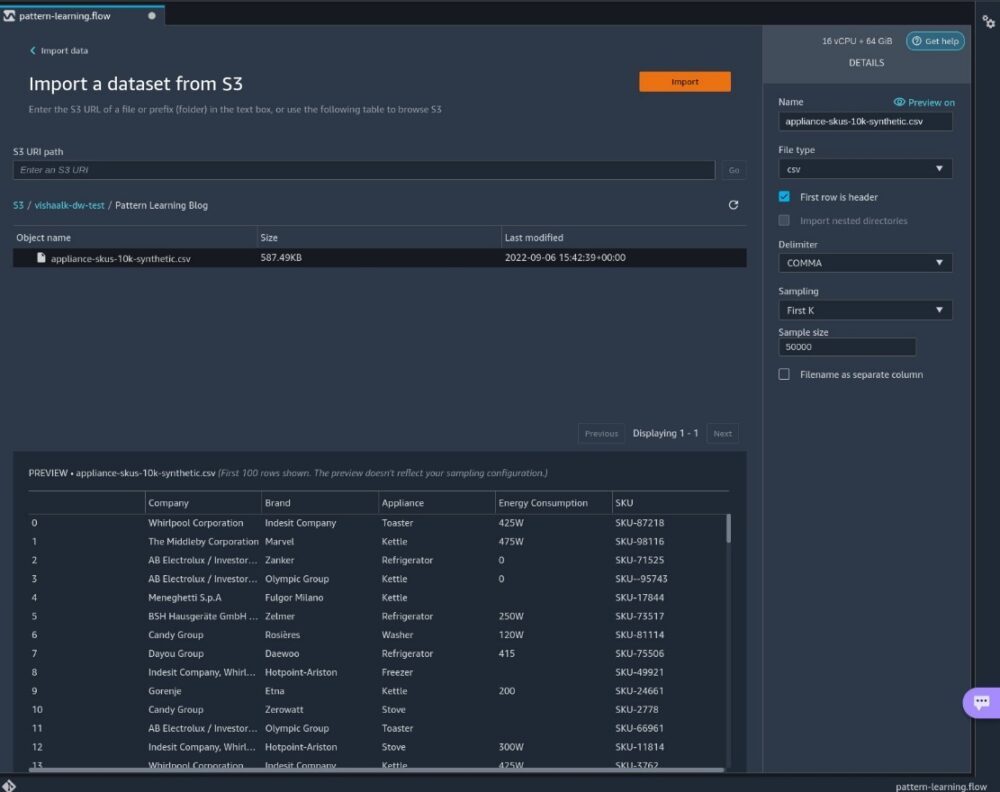

Dans les sections suivantes, nous montrons comment utiliser l'apprentissage de modèles dans Data Wrangler à l'aide d'un ensemble de données fictif de catégories de produits et de codes SKU (unité de gestion des stocks).

Cet ensemble de données contient des fonctionnalités qui décrivent les produits par entreprise, marque et consommation d'énergie. Notamment, il inclut un SKU de fonctionnalité mal formaté. Toutes les données de cet ensemble de données sont fictives et créées de manière aléatoire à l'aide de noms de marques et de noms d'appareils aléatoires.

Pré-requis

Avant de commencer à utiliser Data Wrangler, download l'exemple d'ensemble de données et téléchargez-le vers un emplacement dans Service de stockage simple Amazon (Amazon S3). Pour obtenir des instructions, reportez-vous à Téléchargement d'objets.

Importez votre jeu de données

Pour importer votre ensemble de données, procédez comme suit :

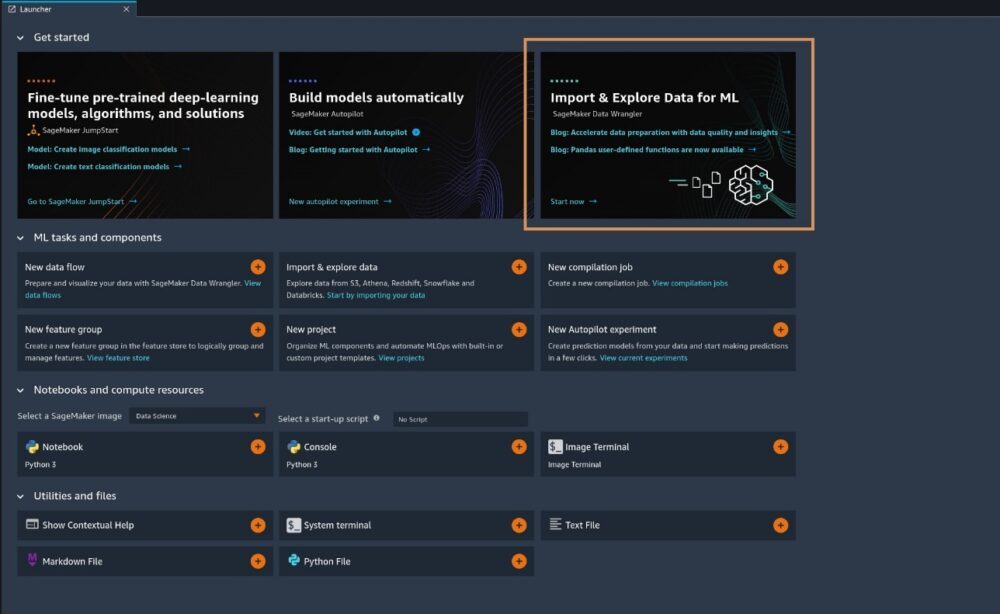

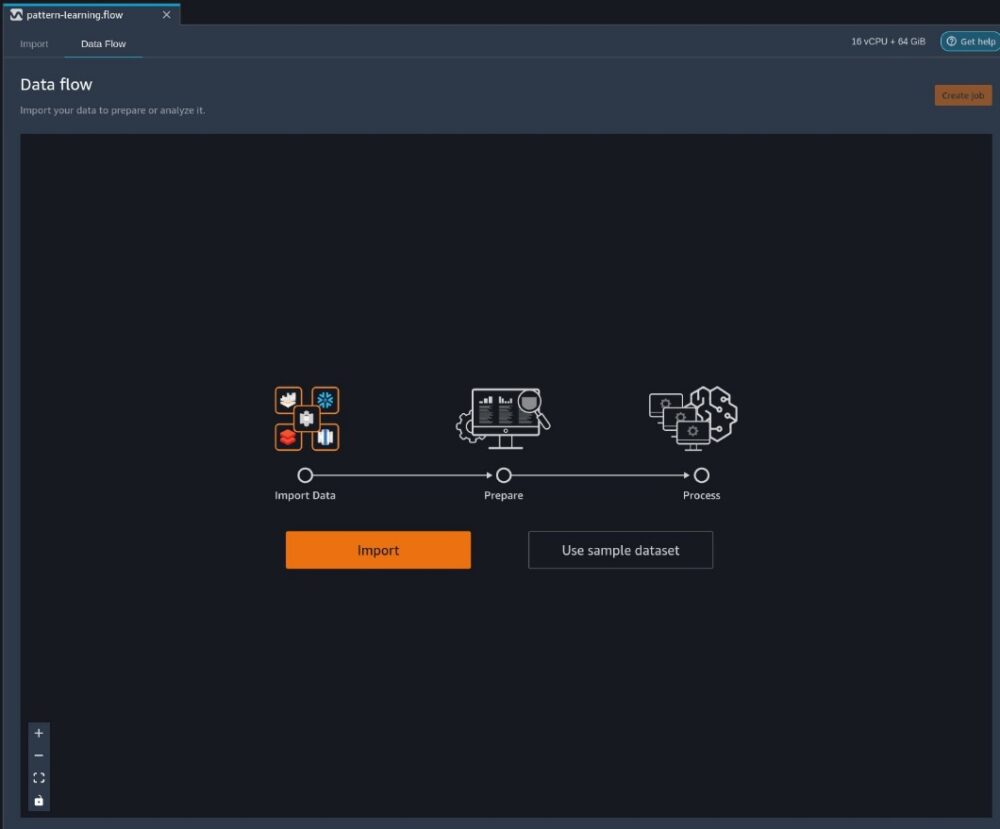

- Dans Data Wrangler, choisissez Importer et explorer des données pour le ML.

- Selectionnez L’.

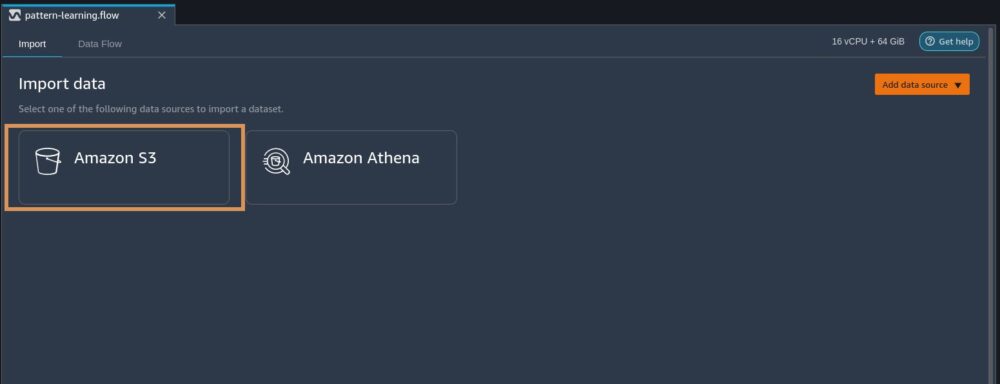

- Pour Importer des dates, choisissez Amazon S3.

- Localisez le fichier dans Amazon S3 et choisissez L’.

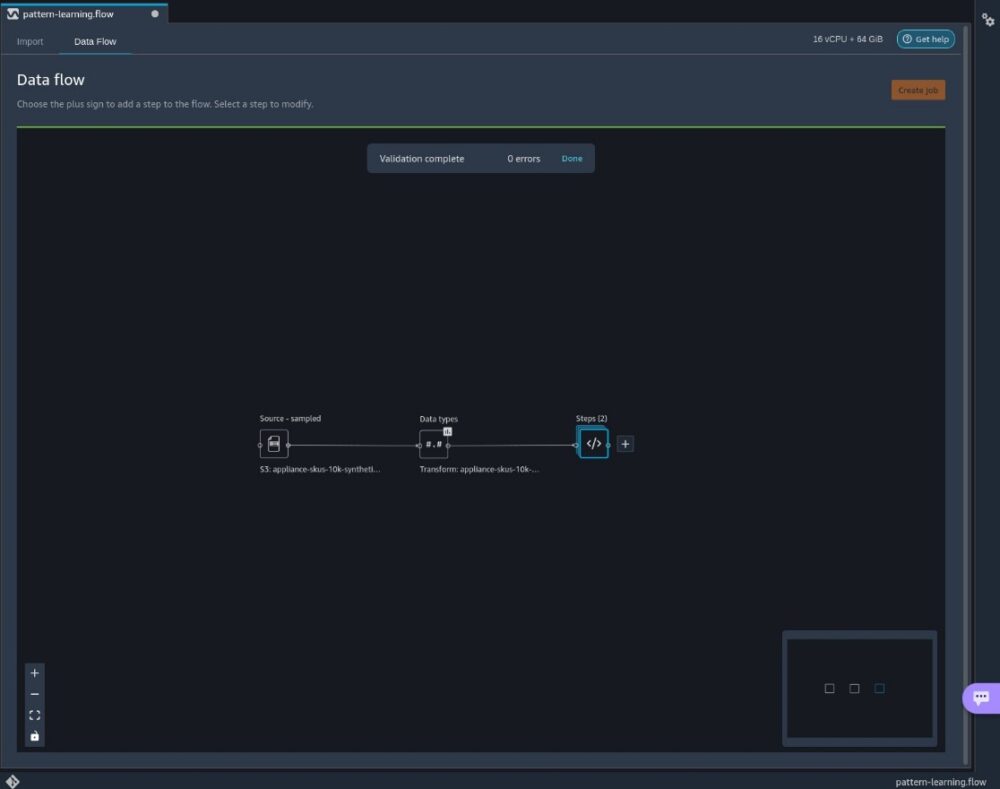

Après l'importation, nous pouvons accéder au flux de données.

Obtenez des informations sur les données

Au cours de cette étape, nous créons un rapport d'analyse des données qui comprend des informations sur la qualité des données. Pour plus d'informations, reportez-vous à Obtenez des informations sur les données et la qualité des données. Effectuez les étapes suivantes :

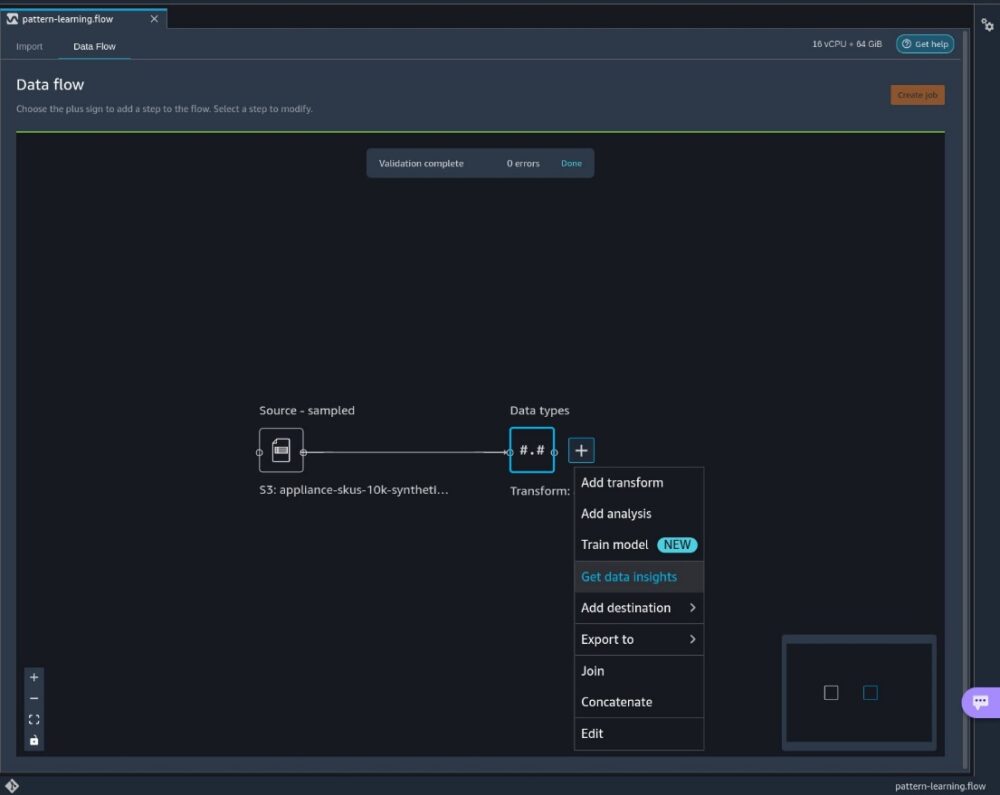

- Sur le Flux de données onglet, choisissez le signe plus à côté de Types de données.

- Selectionnez Obtenez des informations sur les données.

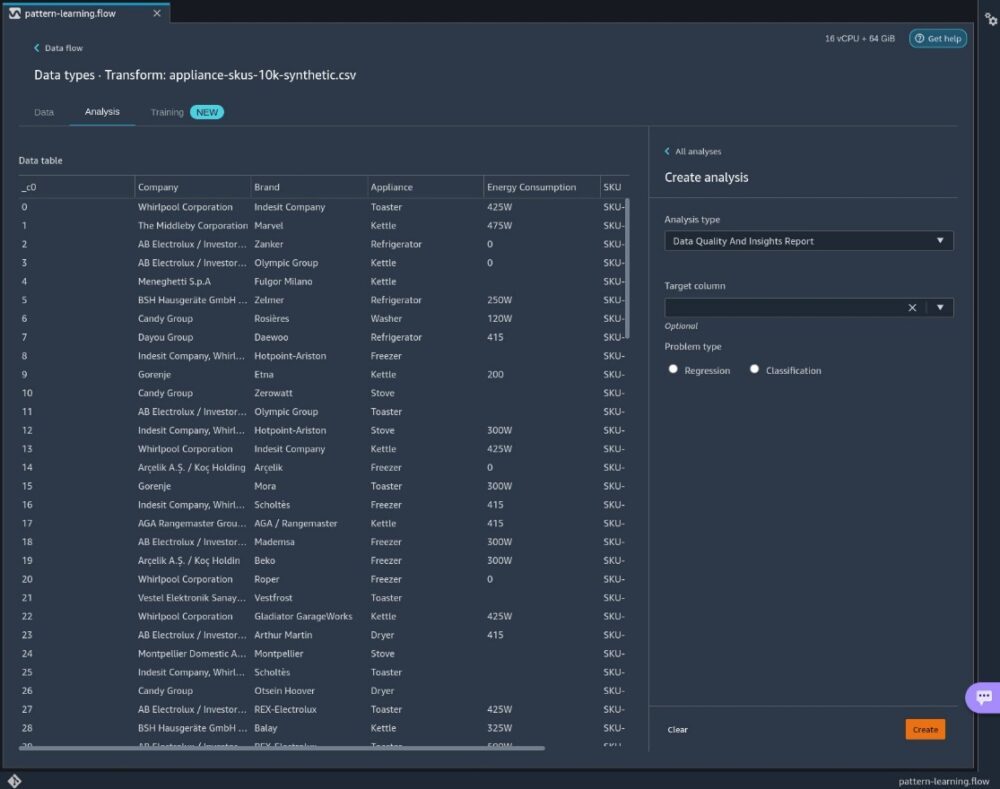

- Pour Type d'analyse, choisissez Rapport sur la qualité des données et les informations.

- Pour ce post, laissez Colonne cible ainsi que Type de problème vide. Si vous envisagez d'utiliser votre ensemble de données pour une tâche de régression ou de classification avec une entité cible, vous pouvez sélectionner ces options et le rapport inclura une analyse de la relation entre vos entités en entrée et votre cible. Par exemple, il peut produire des rapports sur les fuites de cibles. Pour plus d'informations, reportez-vous à Colonne cible.

- Selectionnez Création.

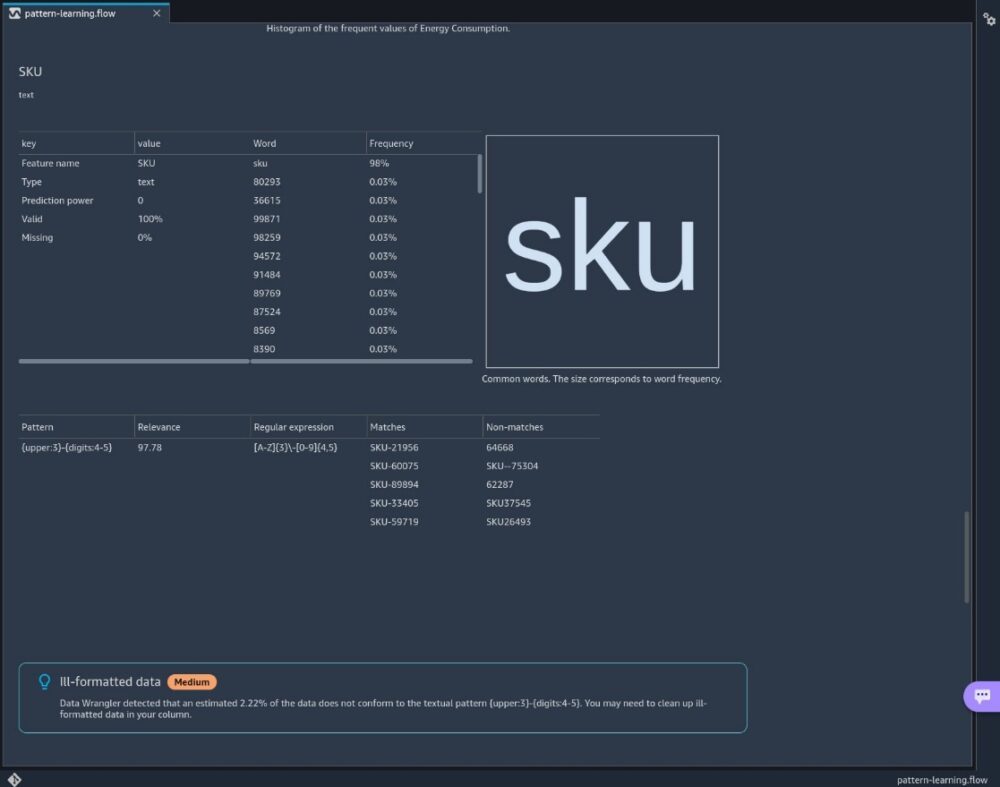

Nous disposons désormais d'un rapport sur la qualité des données et sur les informations sur les données. Si nous descendons jusqu'au SKU section, nous pouvons voir un exemple d’apprentissage de modèles décrivant le SKU. Cette fonctionnalité semble contenir des données non valides et une correction concrète est requise.

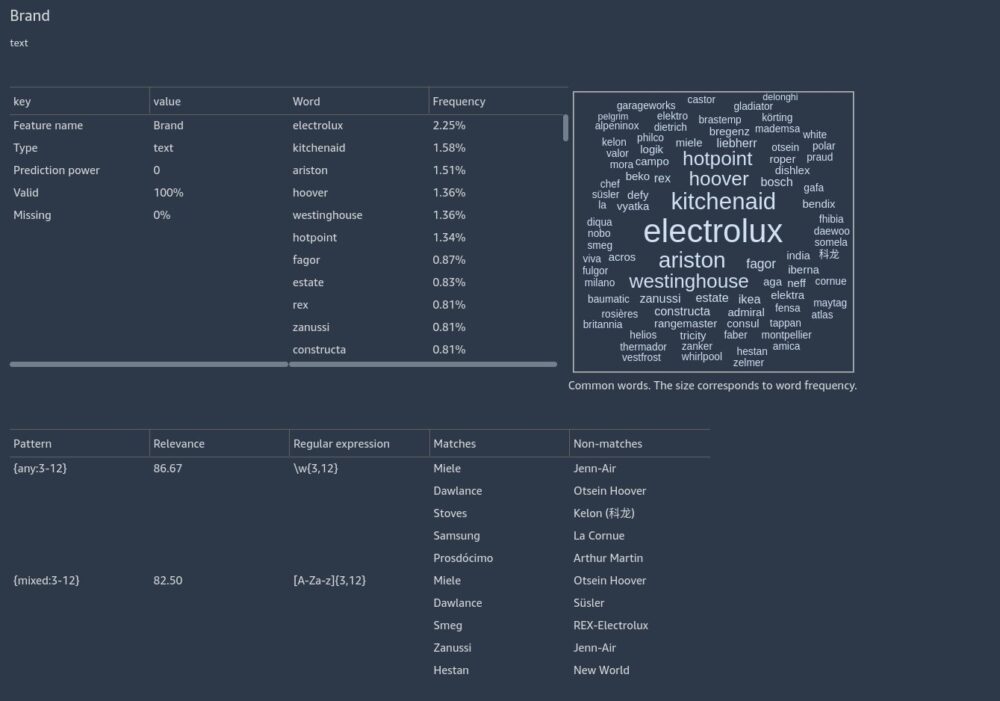

Avant de nettoyer la fonctionnalité SKU, faisons défiler jusqu'à Marque section pour voir plus d’informations. Ici, nous voyons que deux modèles ont été découverts, indiquant que la majorité des noms de marque sont des mots simples composés de caractères de mots ou de caractères alphabétiques. UN caractère de mot est soit un trait de soulignement, soit un caractère pouvant apparaître dans un mot dans n'importe quelle langue. Par exemple, les chaînes Hello_world ainsi que écoute les deux sont constitués de caractères de mots : H ainsi que é.

Pour cet article, nous ne nettoyons pas cette fonctionnalité.

Afficher les informations sur l'apprentissage de modèles

Revenons au nettoyage des SKU et zoomons sur le modèle et le message d'avertissement.

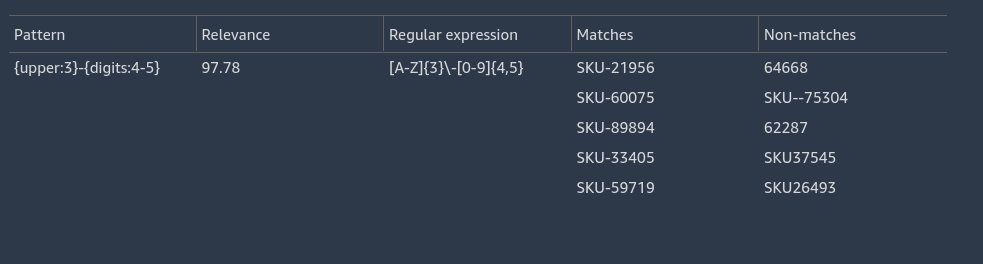

Comme le montre la capture d'écran suivante, l'apprentissage de modèles fait apparaître un modèle de haute précision correspondant à 97.78 % des données. Il affiche également quelques exemples correspondant au modèle ainsi que des exemples qui ne correspondent pas au modèle. Dans les non-correspondances, nous voyons des SKU invalides.

En plus des modèles affichés, un avertissement peut apparaître indiquant une action potentielle pour nettoyer les données s'il existe un modèle de haute précision ainsi que certaines données qui ne sont pas conformes au modèle.

Nous pouvons omettre les données invalides. Si on choisit (clic droit) sur l'expression régulière, on peut copier l'expression [A-Z]{3}-[0-9]{4,5}.

Supprimer les données invalides

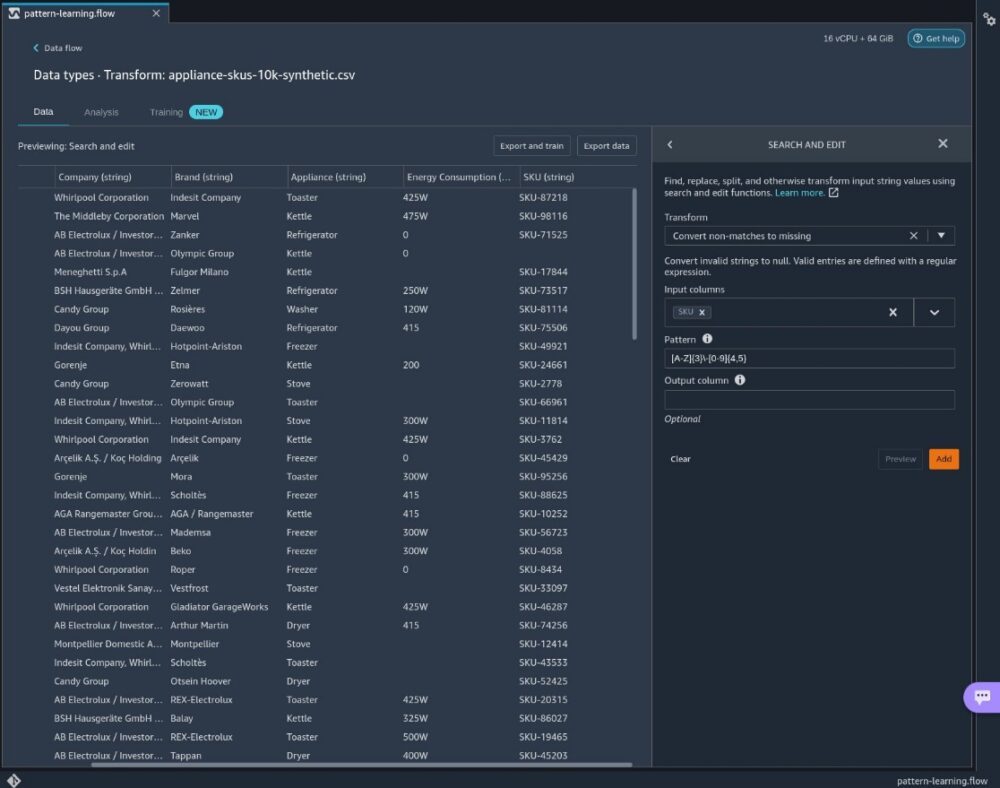

Créons une transformation pour omettre les données non conformes qui ne correspondent pas à ce modèle.

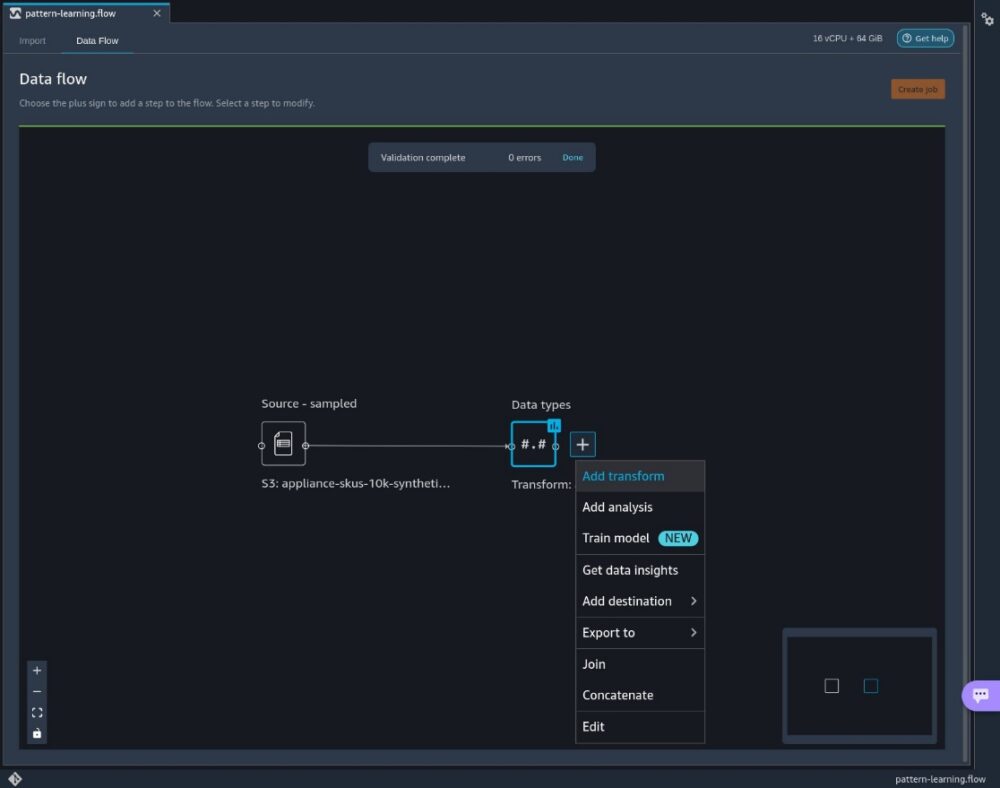

- Sur le Flux de données onglet, choisissez le signe plus à côté de Types de données.

- Selectionnez Ajouter une transformation.

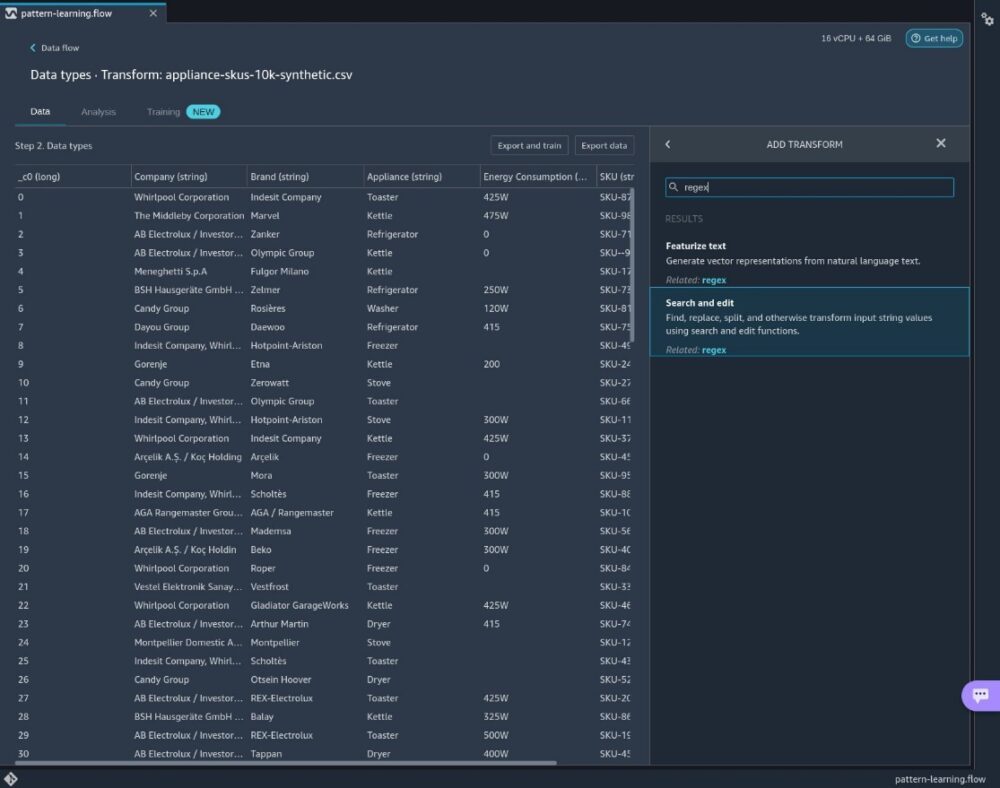

- Selectionnez Ajouter une étape.

- Rechercher

regexet choisissez Rechercher et modifier.

- Pour Transformer, choisissez Convertir les non-correspondances en manquants.

- Pour Colonnes d'entrée, choisissez

SKU. - Pour Patron de Couture, entrez notre expression régulière.

- Selectionnez Aperçu, Puis choisissez Ajouter.

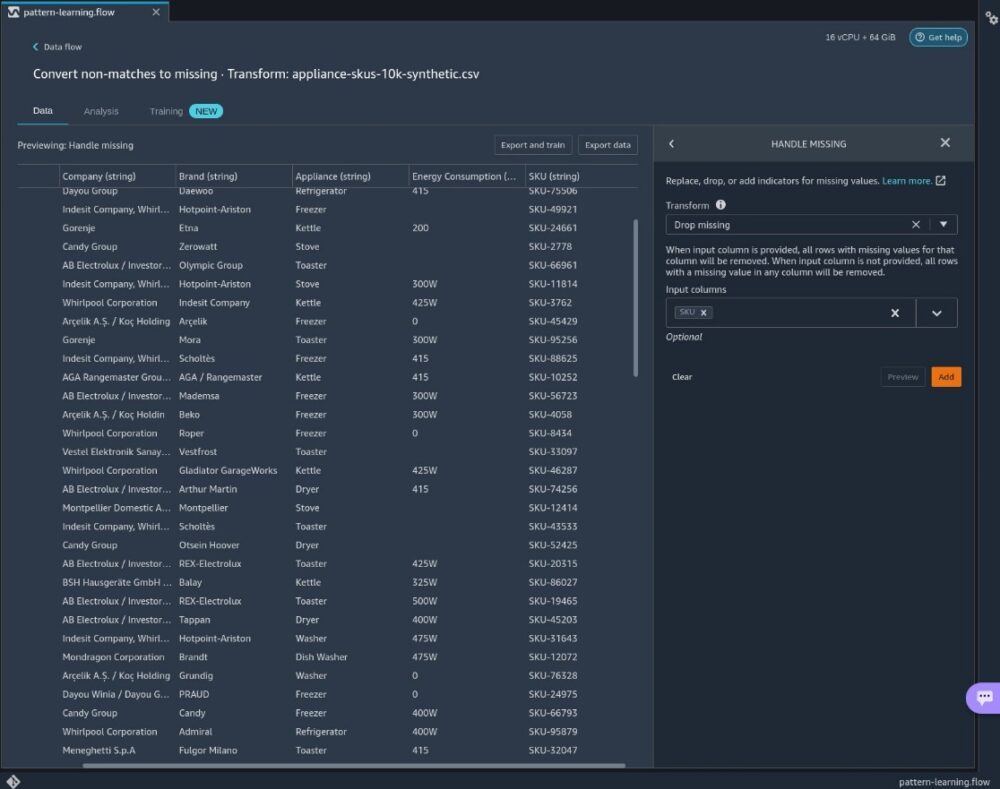

Désormais, les données superflues ont été supprimées des fonctionnalités. - Pour supprimer les lignes, ajoutez l'étape Poignée manquante et choisissez la transformation Goutte manquante.

- Selectionnez

SKUcomme colonne d'entrée.

Nous revenons à notre flux de données avec les données erronées supprimées.

Conclusion

Dans cet article, nous vous avons montré comment utiliser la fonctionnalité d'apprentissage de modèles dans Data Insights pour trouver des données textuelles non valides dans votre ensemble de données, ainsi que comment corriger ou omettre ces données.

Maintenant que vous avez nettoyé une colonne textuelle, vous pouvez visualiser votre ensemble de données à l'aide d'un selon une analyse de l’Université de Princeton ou vous pouvez postuler transformations intégrées pour traiter ultérieurement vos données. Lorsque vous êtes satisfait de vos données, vous pouvez former un modèle comprenant Pilote automatique Amazon SageMakerou exporter vos données à une source de données telle qu'Amazon S3.

Nous tenons à remercier Nikita Ivkin pour son avis réfléchi.

À propos des auteurs

Vishaal Kapoor est un scientifique appliqué senior avec AWS AI. Il se passionne pour aider les clients à comprendre leurs données dans Data Wrangler. Dans ses temps libres, il fait du VTT, du snowboard et passe du temps avec sa famille.

Vishaal Kapoor est un scientifique appliqué senior avec AWS AI. Il se passionne pour aider les clients à comprendre leurs données dans Data Wrangler. Dans ses temps libres, il fait du VTT, du snowboard et passe du temps avec sa famille.

Zohar Karnin est scientifique principal chez Amazon AI. Ses intérêts de recherche portent sur les algorithmes d’apprentissage automatique à grande échelle et en ligne. Il développe des algorithmes d'apprentissage automatique infiniment évolutifs pour Amazon SageMaker.

Zohar Karnin est scientifique principal chez Amazon AI. Ses intérêts de recherche portent sur les algorithmes d’apprentissage automatique à grande échelle et en ligne. Il développe des algorithmes d'apprentissage automatique infiniment évolutifs pour Amazon SageMaker.

Ajaï Sharma est chef de produit principal pour Amazon SageMaker où il se concentre sur Data Wrangler, un outil visuel de préparation de données pour les data scientists. Avant AWS, Ajai était expert en science des données chez McKinsey and Company, où il a dirigé des missions axées sur le ML pour de grandes sociétés de finance et d'assurance du monde entier. Ajai est passionné par la science des données et aime explorer les derniers algorithmes et techniques d'apprentissage automatique.

Ajaï Sharma est chef de produit principal pour Amazon SageMaker où il se concentre sur Data Wrangler, un outil visuel de préparation de données pour les data scientists. Avant AWS, Ajai était expert en science des données chez McKinsey and Company, où il a dirigé des missions axées sur le ML pour de grandes sociétés de finance et d'assurance du monde entier. Ajai est passionné par la science des données et aime explorer les derniers algorithmes et techniques d'apprentissage automatique.

Derek Baron est responsable du développement logiciel pour Amazon SageMaker Data Wrangler

Derek Baron est responsable du développement logiciel pour Amazon SageMaker Data Wrangler

- AI

- art de l'IA

- générateur d'art ai

- robot IA

- Amazon Sage Maker

- Gestionnaire de données Amazon SageMaker

- intelligence artificielle

- certification en intelligence artificielle

- intelligence artificielle en banque

- robot d'intelligence artificielle

- robots d'intelligence artificielle

- logiciel d'intelligence artificielle

- Apprentissage automatique AWS

- blockchain

- conférence blockchain ai

- cognitif

- intelligence artificielle conversationnelle

- crypto conférence ai

- de dall

- l'apprentissage en profondeur

- google ai

- Intermédiaire (200)

- machine learning

- Platon

- platon ai

- Intelligence des données Platon

- Jeu de Platon

- PlatonDonnées

- jeu de platogamie

- échelle ai

- syntaxe

- zéphyrnet