Les clients de secteurs tels que les biens de consommation emballés, la fabrication et la vente au détail recherchent toujours des moyens de renforcer leurs processus opérationnels en les enrichissant d'informations et d'analyses générées à partir de données. Des tâches telles que la prévision des ventes affectent directement les opérations telles que la planification des matières premières, l'approvisionnement, la fabrication, la distribution et la logistique entrante/sortante, et elles peuvent avoir de nombreux niveaux d'impact, d'un seul entrepôt jusqu'aux installations de production à grande échelle.

Les représentants commerciaux et les responsables utilisent les données de ventes historiques pour faire des prédictions éclairées sur les futures tendances des ventes. Les clients utilisent SAP ERP Central Component (ECC) pour gérer la planification de la fabrication, de la vente et de la distribution des marchandises. Le module Ventes et distribution (SD) de SAP ECC permet de gérer les commandes client. Les systèmes SAP sont la principale source de données historiques sur les ventes.

Les représentants commerciaux et les responsables ont la connaissance du domaine et une compréhension approfondie de leurs données de vente. Cependant, ils manquent de compétences en science des données et en programmation pour créer des modèles d'apprentissage automatique (ML) capables de générer des prévisions de ventes. Ils recherchent des outils intuitifs et simples à utiliser pour créer des modèles ML sans écrire une seule ligne de code.

Pour aider les organisations à atteindre l'agilité et l'efficacité recherchées par les analystes commerciaux, nous introduit Toile Amazon SageMaker, une solution de ML sans code qui vous aide à accélérer la livraison de solutions de ML en heures ou en jours. Canvas permet aux analystes d'utiliser facilement les données disponibles dans les lacs de données, les entrepôts de données et les magasins de données opérationnelles ; créer des modèles ML ; et utilisez-les pour faire des prédictions de manière interactive et pour la notation par lots sur des ensembles de données en masse, le tout sans écrire une seule ligne de code.

Dans cet article, nous montrons comment importer des données de commande client de SAP ECC pour générer des prévisions de ventes à l'aide d'un modèle ML construit à l'aide de Canvas.

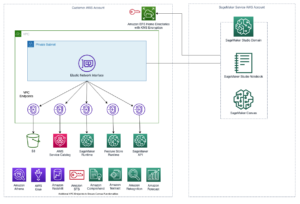

Vue d'ensemble de la solution

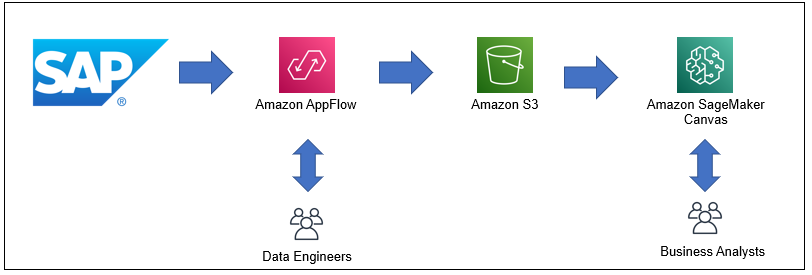

Pour générer des prévisions de ventes à partir des données de vente SAP, nous avons besoin de la collaboration de deux personnes : les ingénieurs de données et les analystes commerciaux (commerciaux et managers). Les ingénieurs de données sont responsables de la configuration de l'exportation des données du système SAP vers Service de stockage simple Amazon (Amazon S3) en utilisant Flux d'application Amazon, que les analystes métier peuvent ensuite exécuter à la demande ou automatiquement (basé sur la planification) pour actualiser les données SAP dans le compartiment S3. Les analystes commerciaux sont ensuite chargés de générer des prévisions avec les données exportées à l'aide de Canvas. Le diagramme suivant illustre ce flux de travail.

Pour ce poste, nous utilisons SAP Modèle d'approvisionnement d'entreprise NetWeaver (EPM) pour les exemples de données. EPM est généralement utilisé à des fins de démonstration et de test dans SAP. Il utilise un modèle de processus métier commun et suit le paradigme de l'objet métier (BO) pour prendre en charge une logique métier bien définie. Nous avons utilisé la transaction SAP SEPM_DG (générateur de données) pour générer environ 80,000 XNUMX commandes clients historiques et créé une vue HANA CDS pour agréger les données par ID de produit, date de vente et ville, comme indiqué dans le code suivant :

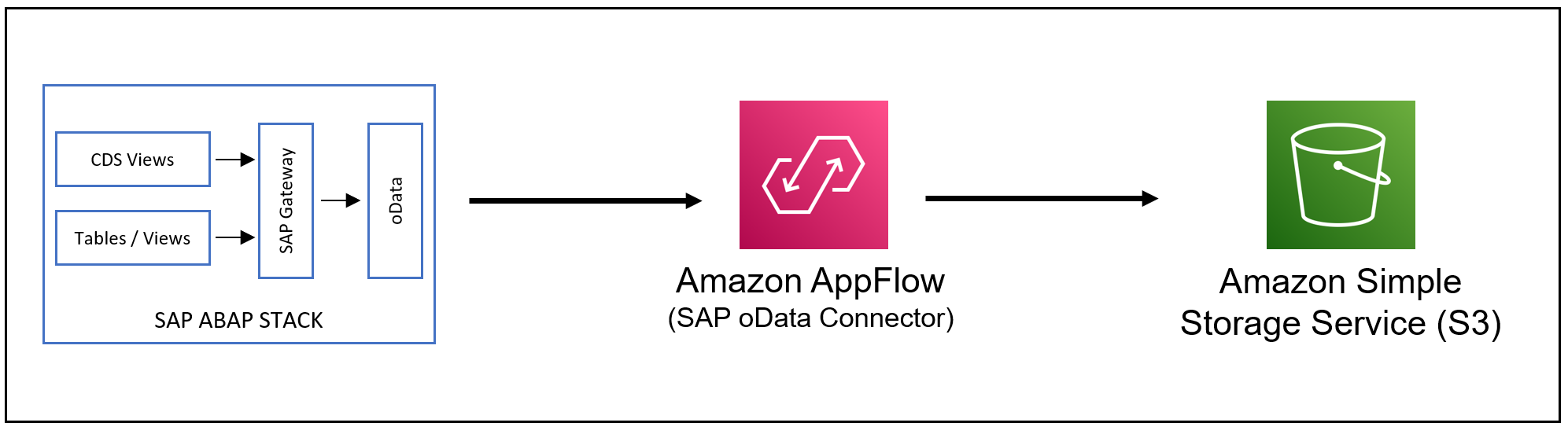

Dans la section suivante, nous exposons cette vue en utilisant les services SAP OData comme structure ABAP, ce qui nous permet d'extraire les données avec Amazon AppFlow.

Le tableau suivant présente les données de ventes historiques représentatives de SAP, que nous utilisons dans cet article.

| ID de produit | date de vente | ville | ventes totales |

| P-4 | 2013-01-02 00:00:00 | Quito | 1922.00 |

| P-5 | 2013-01-02 00:00:00 | Santo Domingo | 1903.00 |

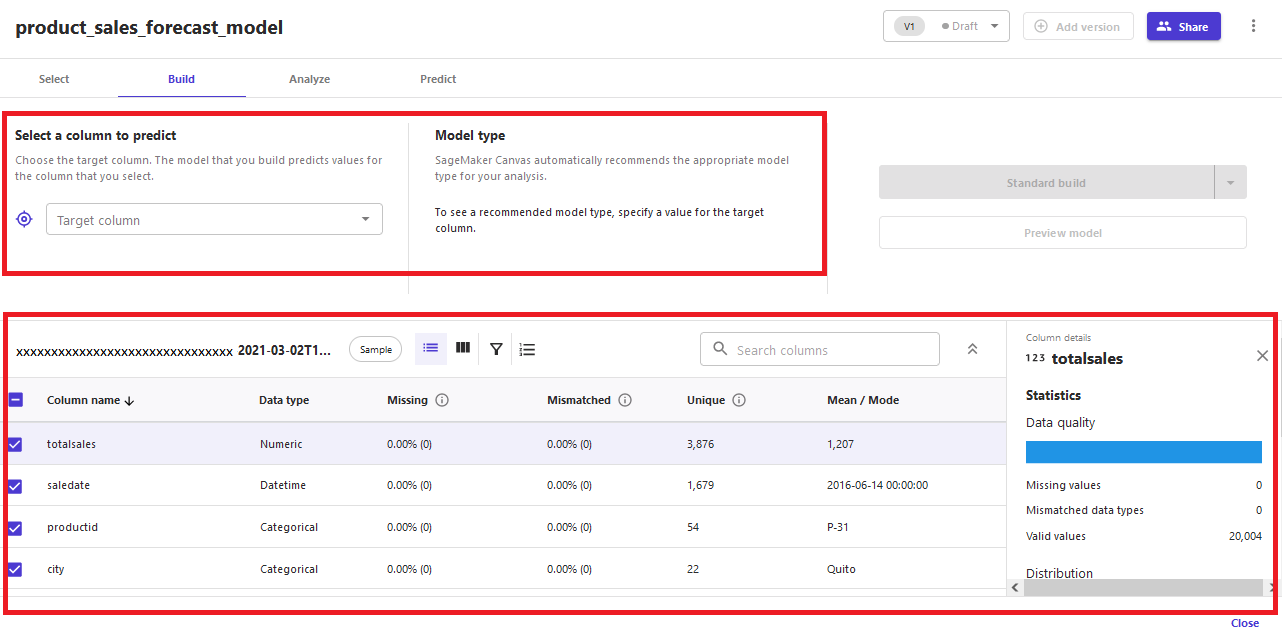

Le fichier de données est constitué de données historiques de fréquence quotidienne. Il comporte quatre colonnes (productid, saledate, cityet totalsales). Nous utilisons Canvas pour créer un modèle ML utilisé pour prévoir totalsales en productid dans une ville particulière.

Ce poste a été organisé pour montrer les activités et les responsabilités des ingénieurs de données et des analystes commerciaux pour générer des prévisions de ventes de produits.

Ingénieur de données : extrayez, transformez et chargez l'ensemble de données de SAP vers Amazon S3 avec Amazon AppFlow

La première tâche que vous effectuez en tant qu'ingénieur de données consiste à exécuter une tâche d'extraction, de transformation et de chargement (ETL) sur les données de ventes historiques de SAP ECC vers un compartiment S3, que l'analyste commercial utilise comme jeu de données source pour son modèle de prévision. Pour cela, nous utilisons Amazon AppFlow, car il fournit une solution prête à l'emploi Connecteur SAP OData pour ETL (comme illustré dans le schéma suivant), avec une interface utilisateur simple pour configurer tout ce qui est nécessaire pour configurer la connexion de SAP ECC au compartiment S3.

Pré-requis

Voici les conditions requises pour intégrer Amazon AppFlow à SAP :

- SAP NetWeaver Stack version 7.40 SP02 ou supérieure

- Service de catalogue (OData v2.0/v2.0) activé dans SAP Gateway pour la découverte de service

- Prise en charge de la pagination côté client et des options de requête pour SAP OData Service

- Connexion HTTPS activée à SAP

Authentification

Amazon AppFlow prend en charge deux mécanismes d'authentification pour se connecter à SAP :

- Basic – S'authentifie à l'aide du nom d'utilisateur et du mot de passe SAP OData.

- OAuth 2.0 – Utilise la configuration OAuth 2.0 avec un fournisseur d'identité. OAuth 2.0 doit être activé pour les services OData v2.0/v2.0.

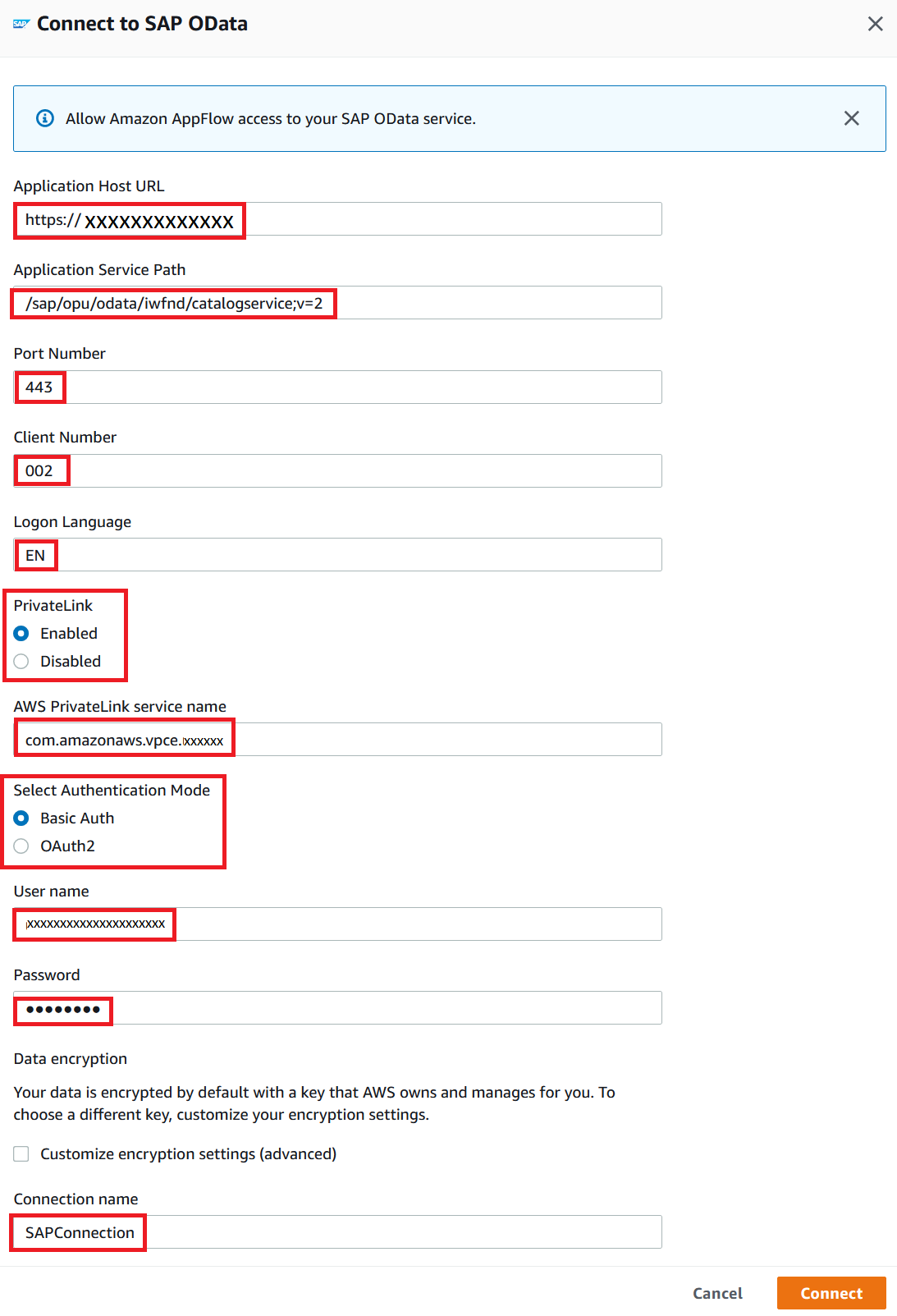

La connexion

Amazon AppFlow peut se connecter à SAP ECC à l'aide d'une interface SAP OData publique ou d'une connexion privée. Une connexion privée améliore la confidentialité et la sécurité des données en transférant les données via le réseau AWS privé au lieu de l'Internet public. Une connexion privée utilise le service de point de terminaison de VPC pour l'instance SAP OData exécutée dans un VPC. Le service de point de terminaison de VPC doit avoir le principal de service Amazon AppFlow appflow.amazonaws.com en tant que mandataire autorisé et doit être disponible dans au moins plus de 50 % des zones de disponibilité d'une région AWS.

Configurer un flux dans Amazon AppFlow

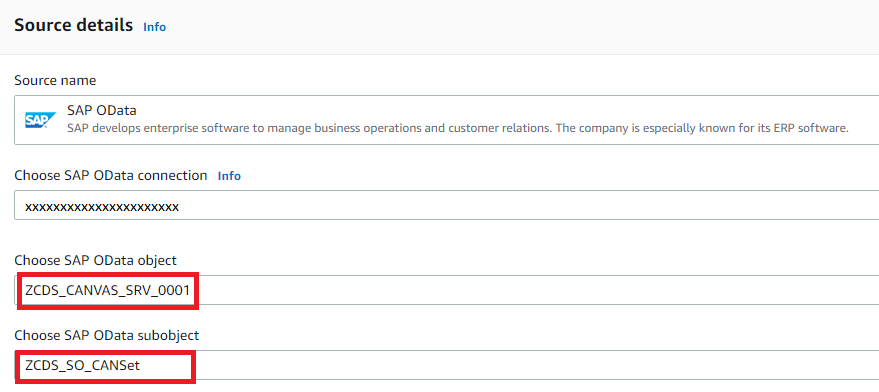

Nous configurons un nouveau flux dans Amazon AppFlow pour exécuter une tâche ETL sur les données de SAP vers un compartiment S3. Ce flux permet la configuration du connecteur SAP OData en tant que source, le compartiment S3 en tant que destination, la sélection d'objets OData, le mappage des données, la validation des données et le filtrage des données.

- Configurez le connecteur SAP OData en tant que source de données en fournissant les informations suivantes :

- Après avoir configuré la source, choisissez l'objet et le sous-objet OData pour les commandes client.

En règle générale, les données de vente de SAP sont exportées à une certaine fréquence, par exemple mensuellement ou trimestriellement pour la taille réelle. Pour cet article, choisissez l'option de sous-objet pour l'exportation en taille réelle.

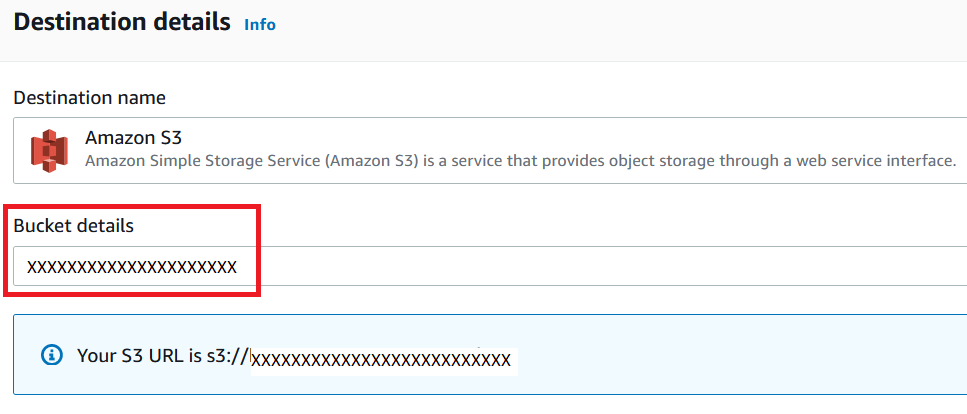

- Choisissez le compartiment S3 comme destination.

Le flux exporte des données vers ce bucket.

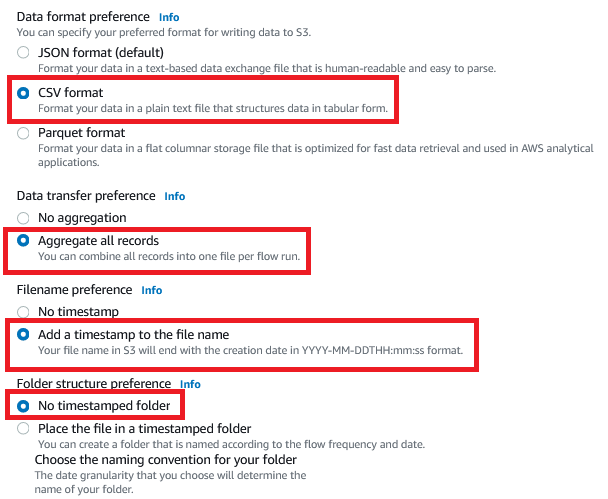

- Pour Préférence de format de données, sélectionnez Format CSV.

- Pour Préférence de transfert de données, sélectionnez Agréger tous les enregistrements.

- Pour Préférence de nom de fichier, sélectionnez Ajouter un horodatage au nom du fichier.

- Pour Préférence de structure de dossier, sélectionnez Pas de dossier horodaté.

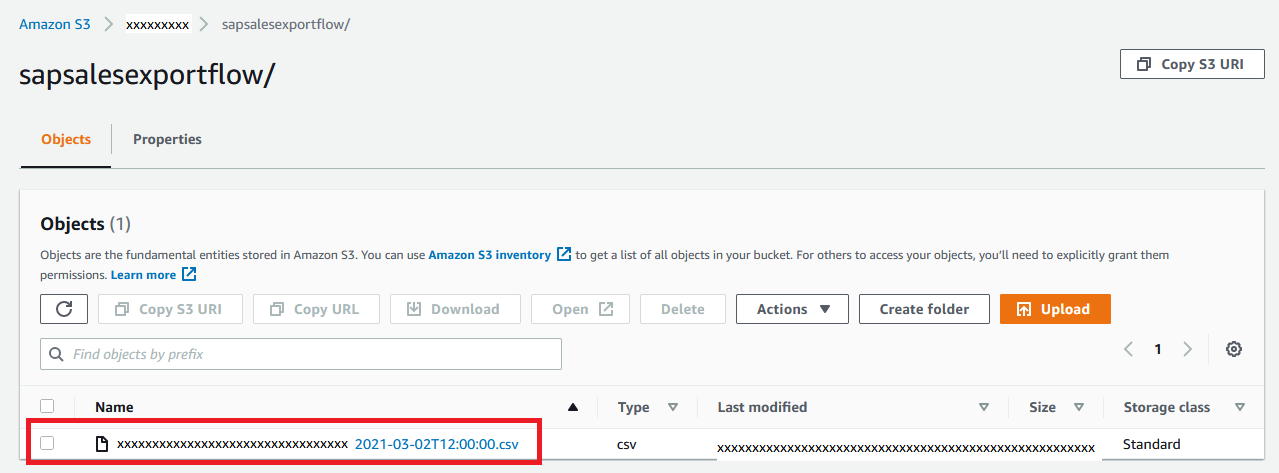

La configuration d'agrégation d'enregistrements exporte les données de vente complètes de SAP combinées dans un seul fichier. Le nom du fichier se termine par un horodatage au format AAAA-MM-JJTHH:mm:ss dans un seul dossier (nom du flux) dans le compartiment S3. Canvas importe les données de ce fichier unique pour la formation et la prévision du modèle.

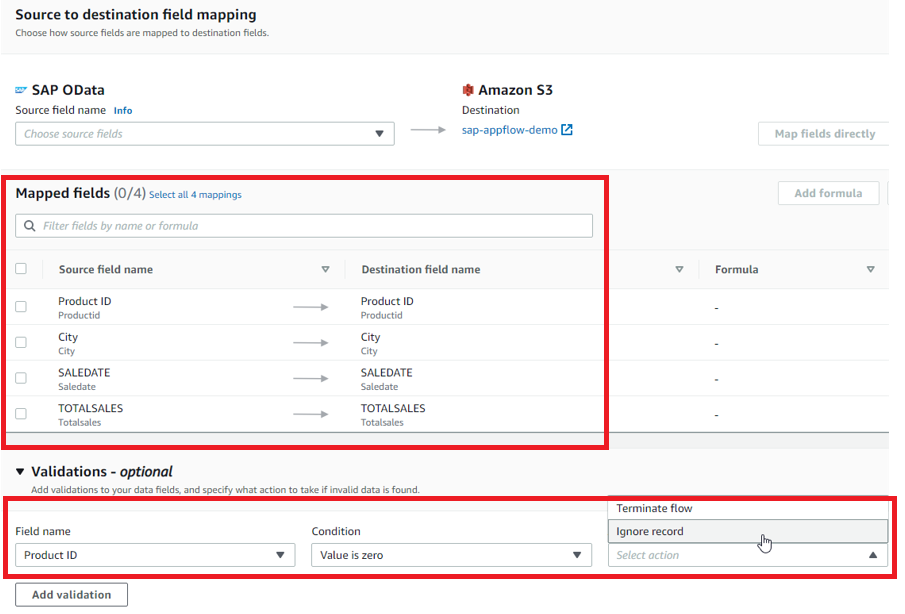

- Configurez le mappage et les validations de données pour mapper les champs de données source aux champs de données de destination et activez les règles de validation des données si nécessaire.

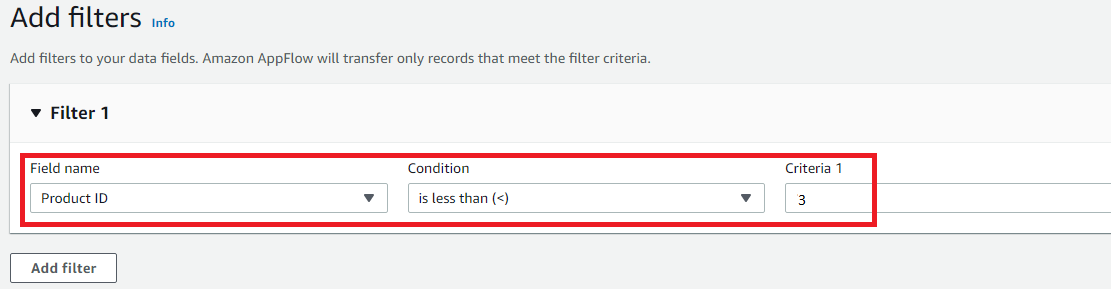

- Vous configurez également les conditions de filtrage des données pour filtrer des enregistrements spécifiques si vos besoins l'exigent.

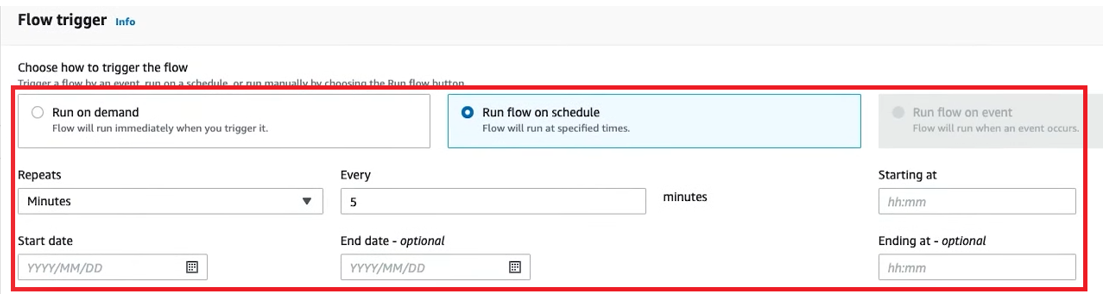

- Configurez votre déclencheur de flux pour décider si le flux s'exécute manuellement à la demande ou automatiquement en fonction d'un calendrier.

Lorsqu'elle est configurée pour un calendrier, la fréquence est basée sur la fréquence à laquelle la prévision doit être générée (généralement mensuelle, trimestrielle ou semestrielle).

Une fois le flux configuré, les analystes commerciaux peuvent l'exécuter à la demande ou en fonction de la planification pour effectuer une tâche ETL sur les données de commande client de SAP vers un compartiment S3.

Une fois le flux configuré, les analystes commerciaux peuvent l'exécuter à la demande ou en fonction de la planification pour effectuer une tâche ETL sur les données de commande client de SAP vers un compartiment S3. - En plus de la configuration d'Amazon AppFlow, les ingénieurs de données doivent également configurer un Gestion des identités et des accès AWS (IAM) pour Canvas afin qu'il puisse accéder à d'autres services AWS. Pour obtenir des instructions, reportez-vous à Autorisez vos utilisateurs à effectuer des prévisions de séries chronologiques.

Analyste commercial : utilisez les données de ventes historiques pour former un modèle de prévision

Changeons de vitesse et passons du côté des analystes commerciaux. En tant qu'analyste commercial, nous recherchons un service visuel pointer-cliquer qui facilite la création de modèles ML et génère des prédictions précises sans écrire une seule ligne de code ni avoir une expertise en ML. Canvas répond aux exigences en tant que solution ML sans code.

Tout d'abord, assurez-vous que votre rôle IAM est configuré de manière à ce que Canvas puisse accéder à d'autres services AWS. Pour plus d'informations, reportez-vous à Autorisez vos utilisateurs à effectuer des prévisions de séries chronologiques, ou vous pouvez demander de l'aide à votre équipe Cloud Engineering.

Lorsque l'ingénieur de données a terminé de configurer la configuration ETL basée sur Amazon AppFlow, les données de ventes historiques sont disponibles pour vous dans un compartiment S3.

Vous êtes maintenant prêt à former un modèle avec Canvas ! Cela implique généralement quatre étapes : importer des données dans le service, configurer la formation du modèle en sélectionnant le type de modèle approprié, former le modèle et enfin générer des prévisions à l'aide du modèle.

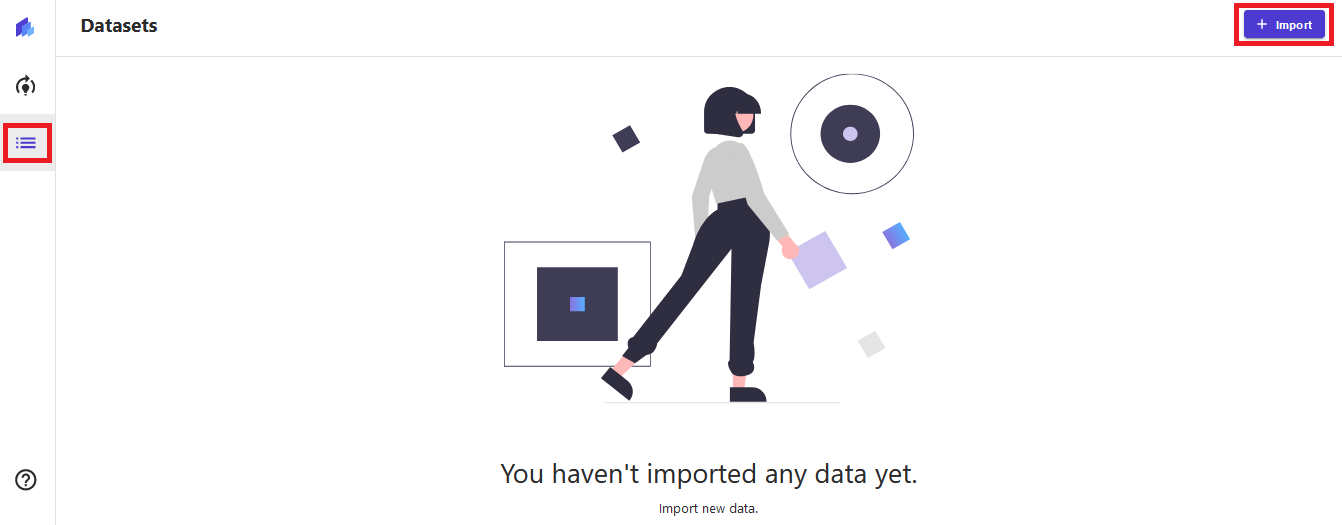

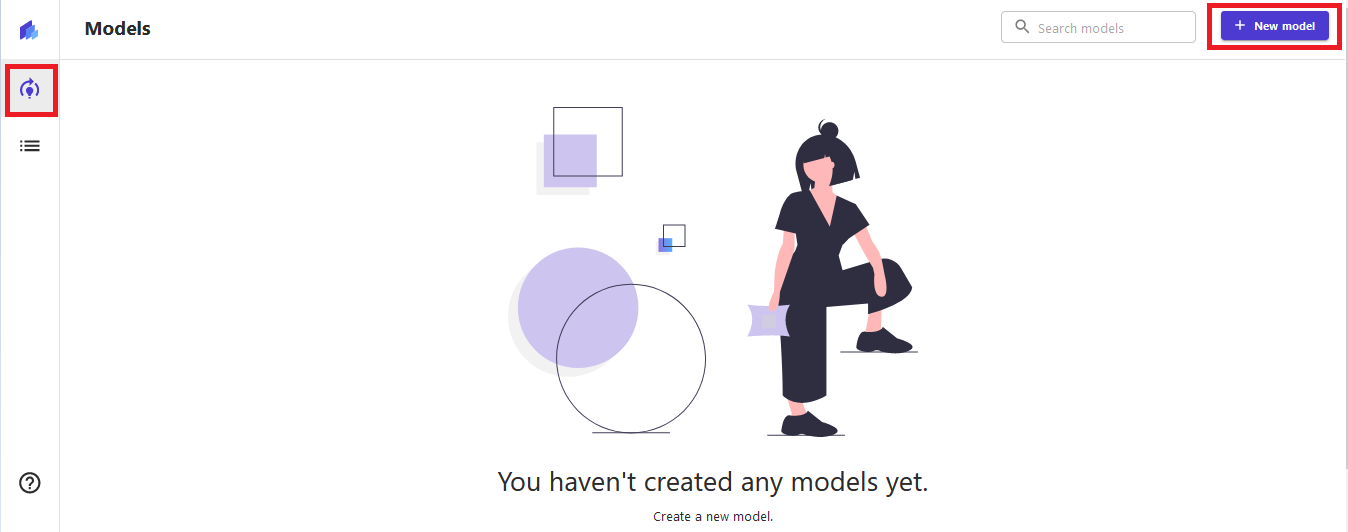

Importer des données dans Canvas

Tout d'abord, lancez l'application Canvas depuis le Amazon Sage Maker console ou depuis votre accès SSO. Si vous ne savez pas comment procéder, contactez votre administrateur afin qu'il puisse vous guider tout au long du processus de configuration de Canvas. Assurez-vous que vous accédez au service dans la même région que le compartiment S3 contenant l'ensemble de données historiques de SAP. Vous devriez voir un écran comme celui-ci.

Suivez ensuite les étapes suivantes:

- Dans Canvas, choisissez Jeux de données dans le volet de navigation.

- Selectionnez L’ pour commencer à importer des données à partir du compartiment S3.

- Sur l'écran d'importation, choisissez le fichier de données ou l'objet du compartiment S3 pour importer les données d'entraînement.

Vous pouvez importer plusieurs ensembles de données dans Canvas. Il prend également en charge la création de jointures entre les ensembles de données en choisissant Joindre des données, ce qui est particulièrement utile lorsque les données d'entraînement sont réparties sur plusieurs fichiers.

Configurer et entraîner le modèle

Après avoir importé les données, procédez comme suit :

- Selectionnez Des modèles photo dans le volet de navigation.

- Selectionnez Nouveau modèle pour démarrer la configuration pour la formation du modèle de prévision.

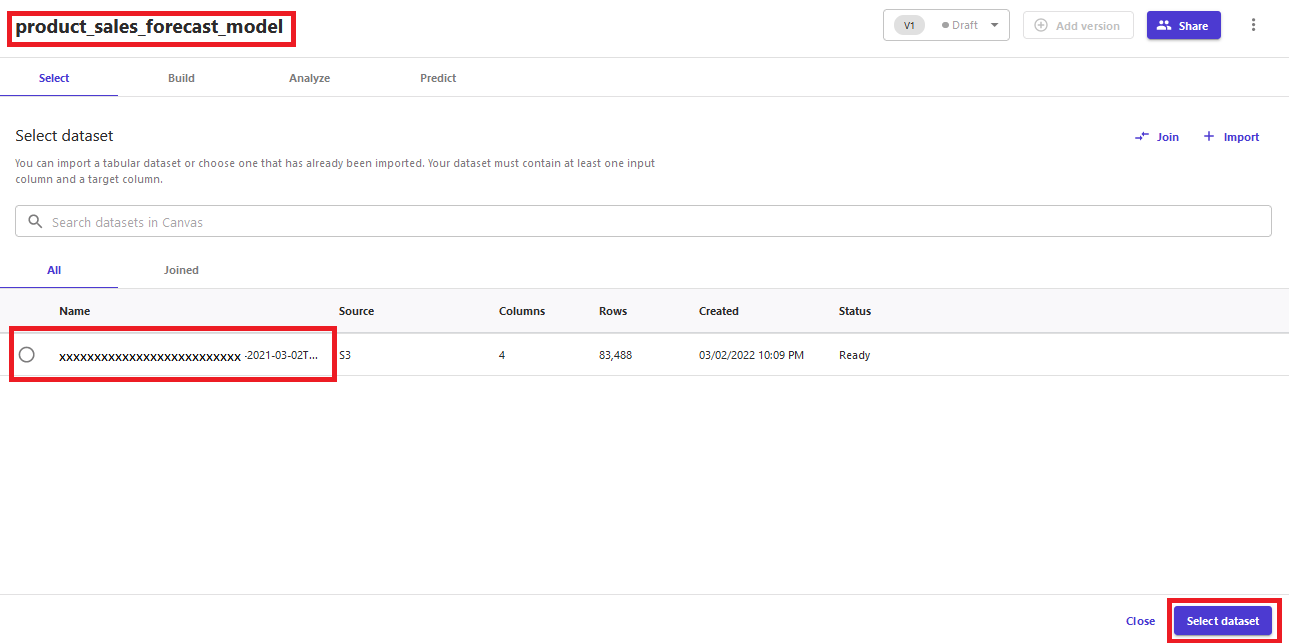

- Pour le nouveau modèle, donnez-lui un nom approprié, tel que

product_sales_forecast_model. - Sélectionnez l'ensemble de données de ventes et choisissez Sélectionnez un jeu de données.

Une fois le jeu de données sélectionné, vous pouvez voir les statistiques de données et configurer la formation du modèle dans l'onglet Générer.

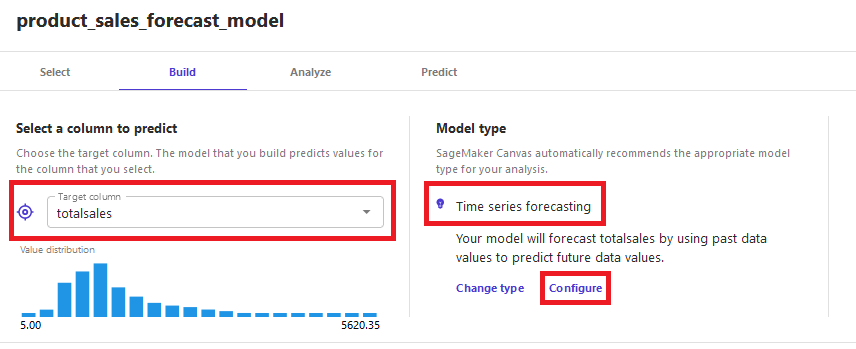

- Sélectionnez ventes totales comme colonne cible pour la prédiction.

Vous pouvez voir Prévisions de séries chronologiques est automatiquement sélectionné comme type de modèle. - Selectionnez Configurer.

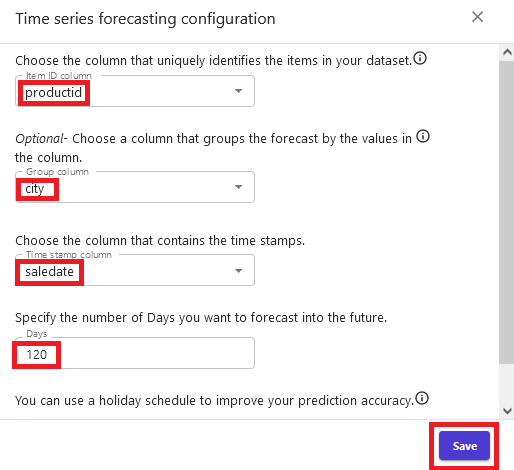

- Dans le Configuration des prévisions de séries chronologiques section, choisissez ID de produit en Colonne ID d'article.

- Selectionnez ville en Colonne de groupe.

- Selectionnez date de vente en Colonne d'horodatage.

- Pour jours, Entrer

120. - Selectionnez Épargnez.

Cela configure le modèle pour faire des prévisions pourtotalsalespendant 120 jours en utilisantsaledatesur la base de données historiques, qui peuvent être interrogées pourproductidainsi que lacity.

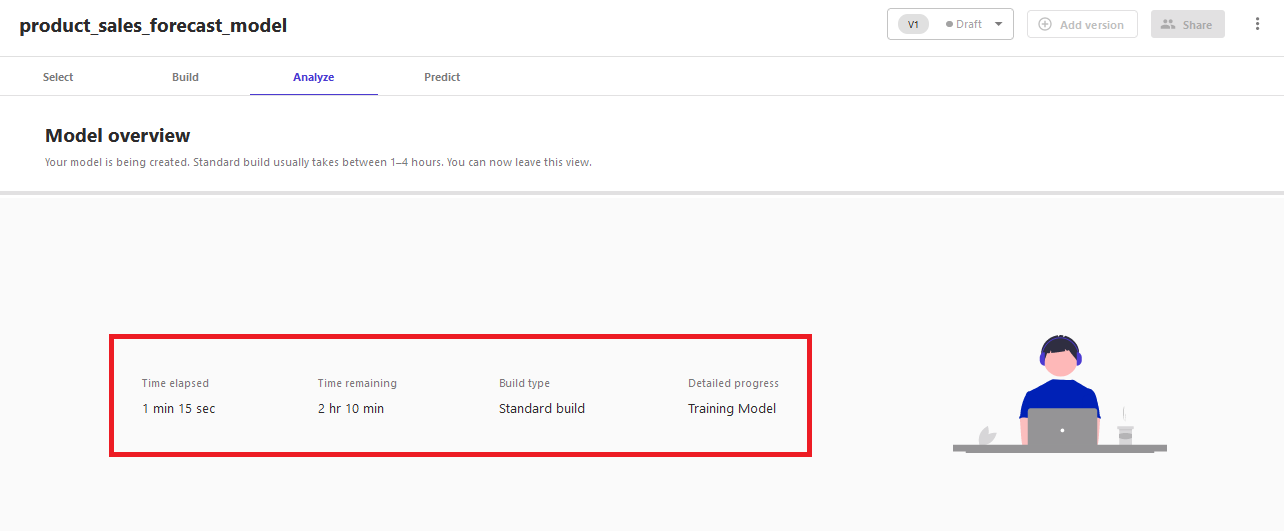

- Lorsque la configuration de la formation du modèle est terminée, choisissez Construction standard pour commencer la formation du modèle.

Les Aperçu du modèle l'option n'est pas disponible pour le type de modèle de prévision de série chronologique. Vous pouvez consulter le temps estimé pour la formation du modèle sur le Analysez languette.

La formation du modèle peut prendre de 1 à 4 heures, selon la taille des données. Lorsque le modèle est prêt, vous pouvez l'utiliser pour générer la prévision.

Générer une prévision

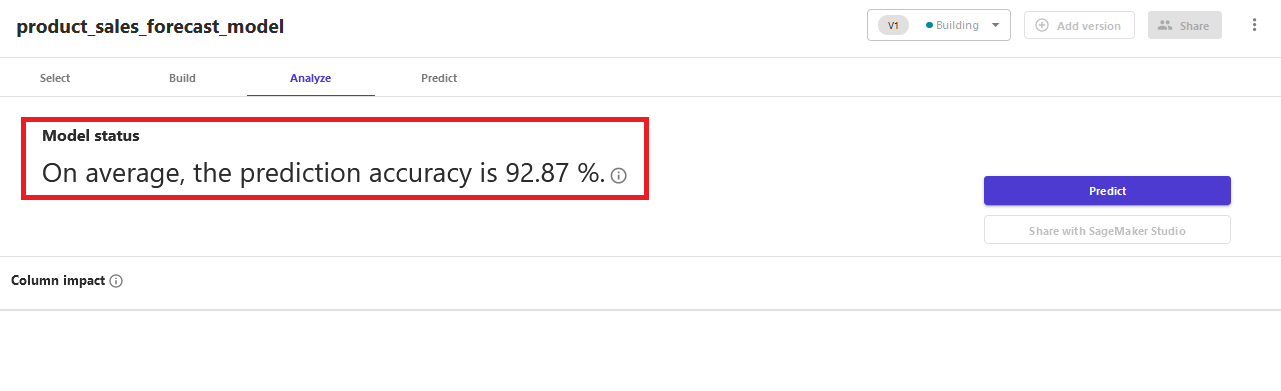

Lorsque l'entraînement du modèle est terminé, il affiche la précision de la prédiction du modèle sur le Analysez languette. Par exemple, dans cet exemple, il affiche une précision de prédiction de 92.87 %.

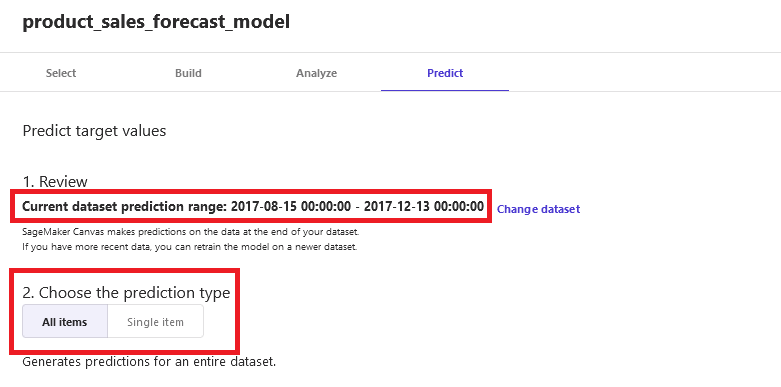

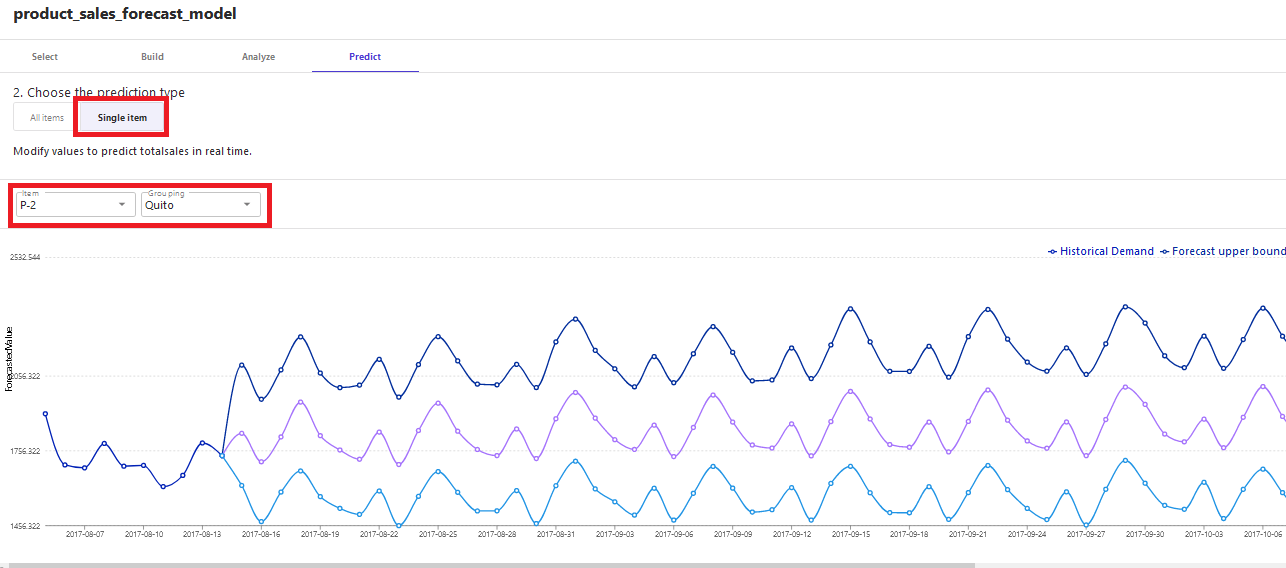

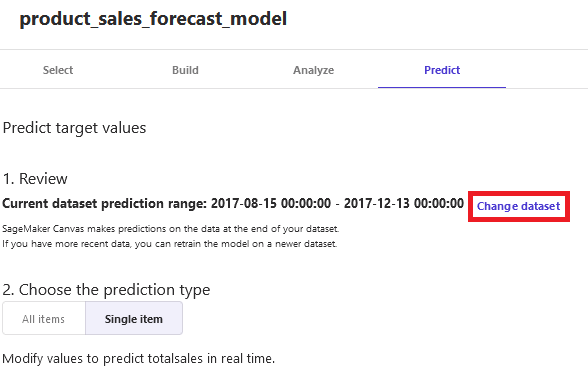

La prévision est générée sur le Prédire languette. Vous pouvez générer des prévisions pour tous les articles ou pour un seul article sélectionné. Il indique également la plage de dates pour laquelle la prévision peut être générée.

Par exemple, choisissez le Pièce unique option. Sélectionner P-2 en Produit ainsi que la Quito en Réservation de groupe pour générer une prédiction pour le produit P-2 pour la ville de Quito pour la plage de dates allant du 2017-08-15 00:00:00 au 2017-12-13 00:00:00.

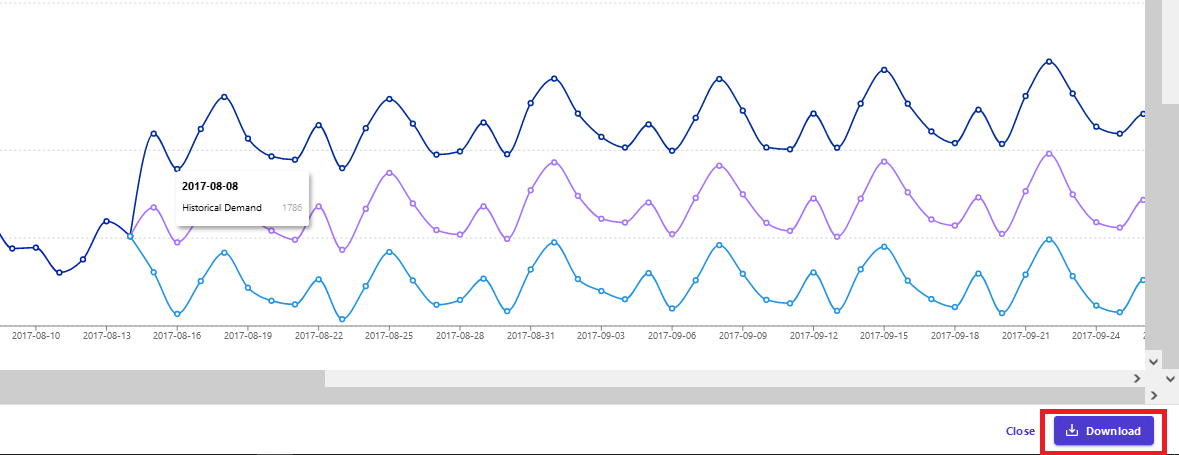

La prévision générée affiche la prévision moyenne ainsi que la limite supérieure et inférieure de la prévision. Les limites de prévision aident à configurer une approche agressive ou équilibrée pour la gestion des prévisions.

Vous pouvez également télécharger les prévisions générées sous forme de fichier CSV ou d'image. Le fichier CSV de prévision généré est généralement utilisé pour travailler hors ligne avec les données de prévision.

La prévision est maintenant générée pour les données de la série chronologique. Lorsqu'une nouvelle ligne de base de données devient disponible pour la prévision, vous pouvez modifier le jeu de données dans Canvas pour recycler le modèle de prévision à l'aide de la nouvelle ligne de base.

Vous pouvez réentraîner le modèle plusieurs fois au fur et à mesure que les données d'entraînement changent.

Conclusion

Dans cet article, vous avez appris comment le connecteur Amazon AppFlow SAP OData exporte les données de commande client du système SAP vers un compartiment S3, puis comment utiliser Canvas pour créer un modèle de prévision.

Vous pouvez utiliser Canvas pour tous les scénarios de données de série chronologique SAP, tels que la prévision des dépenses ou des revenus. L'ensemble du processus de génération de prévisions est piloté par la configuration. Les responsables commerciaux et les représentants peuvent générer des prévisions de ventes à plusieurs reprises par mois ou par trimestre avec un ensemble de données actualisé de manière rapide, simple et intuitive sans écrire une seule ligne de code. Cela contribue à améliorer la productivité et permet une planification et des décisions rapides.

Pour commencer, apprenez-en plus sur Canvas et Amazon AppFlow en utilisant les ressources suivantes :

- Guide du développeur Amazon SageMaker Canvas

- Présentation d'Amazon SageMaker Canvas, une capacité d'apprentissage automatique visuelle et sans code pour les analystes commerciaux

- Extraire des données de SAP ERP et BW avec Amazon AppFlow

- Configuration du connecteur SAP OData

À propos des auteurs

Brajendra Singh est architecte de solutions chez Amazon Web Services travaillant avec des entreprises clientes. Il possède une solide expérience en tant que développeur et est un passionné des solutions de données et d'apprentissage automatique.

Brajendra Singh est architecte de solutions chez Amazon Web Services travaillant avec des entreprises clientes. Il possède une solide expérience en tant que développeur et est un passionné des solutions de données et d'apprentissage automatique.

David Gallitelli est un architecte de solutions spécialisé pour l'IA/ML dans la région EMEA. Il est basé à Bruxelles et travaille en étroite collaboration avec des clients dans tout le Benelux. Il est développeur depuis qu'il est très jeune et a commencé à coder à l'âge de 7 ans. Il a commencé à apprendre l'IA/ML à l'université et en est tombé amoureux depuis.

David Gallitelli est un architecte de solutions spécialisé pour l'IA/ML dans la région EMEA. Il est basé à Bruxelles et travaille en étroite collaboration avec des clients dans tout le Benelux. Il est développeur depuis qu'il est très jeune et a commencé à coder à l'âge de 7 ans. Il a commencé à apprendre l'IA/ML à l'université et en est tombé amoureux depuis.

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/extract-insights-from-sap-erp-with-no-code-ml-solutions-with-amazon-appflow-and-amazon-sagemaker- Toile/

- '

- "

- 000

- 100

- 7

- a

- Qui sommes-nous

- accélérer

- accès

- Avec cette connaissance vient le pouvoir de prendre

- atteindre

- à travers

- activités

- ajout

- affecter

- Tous

- permet

- toujours

- Amazon

- Amazon Web Services

- analyste

- analytique

- appli

- une approche

- approprié

- autour

- authentifie

- Authentification

- automatiquement

- disponibilité

- disponibles

- moyen

- AWS

- fond

- Baseline

- car

- jusqu'à XNUMX fois

- frontière

- apporter

- Bruxelles

- construire

- la performance des entreprises

- la toile

- central

- certaines

- Change

- Selectionnez

- Ville

- le cloud

- code

- collaboration

- Colonne

- combiné

- Commun

- complet

- composant

- conditions

- configuration

- NOUS CONTACTER

- connexion

- Console

- consommateur

- contact

- engendrent

- créée

- La création

- Clients

- Tous les jours

- données

- confidentialité des données

- Confidentialité et sécurité des données

- science des données

- décisions

- page de livraison.

- Demande

- demandes

- Selon

- destination

- Développeur

- directement

- distribution

- domaine

- down

- download

- entraîné

- même

- efficacité

- vous accompagner

- permettre

- permet

- Endpoint

- se termine

- ingénieur

- ENGINEERING

- Les ingénieurs

- Entrer

- Entreprise

- estimé

- peut

- exemple

- nous a permis de concevoir

- RAPIDE

- Des champs

- filtration

- finalement

- Prénom

- flux

- Abonnement

- suit

- le format

- de

- plein

- avenir

- porte

- généralement

- générer

- générateur

- génération

- générateur

- pour les

- Réservation de groupe

- guide

- Maniabilité

- ayant

- la taille

- vous aider

- aide

- historique

- Comment

- How To

- Cependant

- HTTPS

- Active

- image

- Impact

- l'importation

- améliorer

- secteurs

- d'information

- Actualités

- idées.

- instance

- intégrer

- Interfaces

- Internet

- intuitif

- IT

- Emploi

- rejoindre

- Joint

- ACTIVITES

- Savoir

- spécialisées

- Libellé

- lancer

- APPRENTISSAGE

- savant

- apprentissage

- niveaux

- Gamme

- LINK

- charge

- logistique

- recherchez-

- love

- click

- machine learning

- a prendre une

- FAIT DU

- gérer

- Gestionnaires

- manuellement

- fabrication

- Localisation

- cartographie

- Matériel

- pourrait

- ML

- modèle

- numériques jumeaux (digital twin models)

- Mois

- mensuel

- PLUS

- Bougez

- plusieurs

- Navigation

- Besoins

- réseau et

- direct

- Opérations

- Option

- Options

- de commander

- passer commande

- organisations

- Organisé

- Autre

- paradigme

- particulier

- particulièrement

- Mot de Passe

- et la planification de votre patrimoine

- prédiction

- Prédictions

- Aperçu

- primaire

- Directeur

- la confidentialité

- Confidentialité et sécurité

- Privé

- processus

- les process

- Produit

- Vidéo

- productivité

- Programmation

- de voiture.

- fournit

- aportando

- public

- publier

- des fins

- Trimestre

- Rapide

- gamme

- raw

- record

- Articles

- région

- représentant

- conditions

- Exigences

- Ressources

- responsabilités

- responsables

- détail

- de revenus

- Avis

- Rôle

- Courir

- pour le running

- SOLDE

- vente

- même

- sève

- Sciences

- marquant

- pour écran

- sécurité

- choisi

- sélection

- Série

- service

- Services

- set

- mise

- montré

- étapes

- depuis

- unique

- Taille

- compétences

- So

- solide

- sur mesure

- Solutions

- spécialiste

- groupe de neurones

- propagation

- empiler

- Commencer

- j'ai commencé

- statistiques

- storage

- STORES

- STRONG

- Support

- Les soutiens

- Interrupteur

- combustion propre

- Système

- Target

- tâches

- équipe

- Essais

- Les

- La Source

- Avec

- tout au long de

- fiable

- fois

- les outils

- Formation

- transaction

- transférer

- Transfert

- Transformer

- Trends

- typiquement

- ui

- compréhension

- université

- us

- utilisé

- utilisateurs

- validation

- version

- Voir

- façons

- web

- services Web

- bien défini

- que

- dans les

- sans

- Activités principales

- de travail

- vos contrats

- écriture

- jeune

- Votre