Aujourd'hui, nous sommes ravis d'annoncer que le Gemme le modèle est maintenant disponible pour les clients utilisant Amazon SageMaker JumpStart. Gemma est une famille de modèles de langage basé sur les modèles Gemini de Google, formés sur jusqu'à 6 7 milliards de jetons de texte. La famille Gemma se compose de deux tailles : un modèle à 2 milliards de paramètres et un modèle à 2 milliards de paramètres. Désormais, vous pouvez utiliser les modèles Gemma 7B et Gemma XNUMXB pré-entraînés et réglés par les instructions dans SageMaker JumpStart. JumpStart est le hub d'apprentissage automatique (ML) de SageMaker qui donne accès aux modèles de base en plus des algorithmes intégrés et des modèles de solution de bout en bout pour vous aider à démarrer rapidement avec ML.

Dans cet article, nous expliquons comment déployer le modèle Gemma et l'affiner pour vos cas d'utilisation dans SageMaker JumpStart. Le cahier complet est disponible sur GitHub.

Modèle Gemma

Gemme est une famille de poids légers et à la pointe de la technologie numériques jumeaux (digital twin models) construit à partir de la même recherche et de la même technologie utilisée pour créer le GEMINI des modèles. Développé par Google DeepMind et d'autres équipes de Google, Gemma s'inspire de Gemini. Gemma présente de fortes capacités généralistes dans les domaines textuels et des compétences de pointe en matière de compréhension et de raisonnement à grande échelle. Il atteint de meilleures performances par rapport à d'autres modèles accessibles au public à des échelles similaires ou plus grandes dans différents domaines, notamment la réponse aux questions, le raisonnement de bon sens, les mathématiques et les sciences, ainsi que le codage. Gemma a publié les pondérations des modèles pour soutenir l'innovation des développeurs à l'aide des modèles Gemma. Gemma a été lancée avec un nouveau Boîte à outils d'IA générative responsable qui fournit des conseils et des outils essentiels pour créer des applications d'IA plus sûres avec Gemma.

Modèles de fondation dans SageMaker

JumpStart donne accès à une gamme de modèles issus de hubs de modèles populaires, notamment Hugging Face, PyTorch Hub et TensorFlow Hub, que vous pouvez utiliser dans votre workflow de développement ML dans SageMaker. Les progrès récents du ML ont donné naissance à une nouvelle classe de modèles connue sous le nom de modèles de fondation, qui sont généralement formés sur des milliards de paramètres et sont adaptables à une large catégorie de cas d'utilisation, tels que le résumé de texte, la génération d'art numérique et la traduction linguistique. Étant donné que ces modèles sont coûteux à former, les clients souhaitent utiliser des modèles de base pré-formés existants et les ajuster au besoin, plutôt que de former ces modèles eux-mêmes. SageMaker fournit une liste organisée de modèles parmi lesquels vous pouvez choisir sur la console SageMaker.

Vous pouvez désormais trouver des modèles de base auprès de différents fournisseurs de modèles dans JumpStart, ce qui vous permet de démarrer rapidement avec les modèles de base. Vous pouvez rechercher des modèles de base basés sur différentes tâches ou fournisseurs de modèles, et consulter les caractéristiques des modèles et les conditions d'utilisation. Vous pouvez également essayer ces modèles à l'aide d'un widget d'interface utilisateur de test. Lorsque vous souhaitez utiliser un modèle de base à grande échelle, vous pouvez le faire sans quitter SageMaker en utilisant des blocs-notes prédéfinis provenant de fournisseurs de modèles. Étant donné que les modèles sont hébergés et déployés sur AWS, vos données, qu'elles soient utilisées pour évaluer le modèle ou pour l'utiliser à grande échelle, ne sont jamais partagées avec des tiers.

Voyons comment utiliser le modèle Llama Guard dans JumpStart.

Explorez le modèle Gemma dans Jumpstart

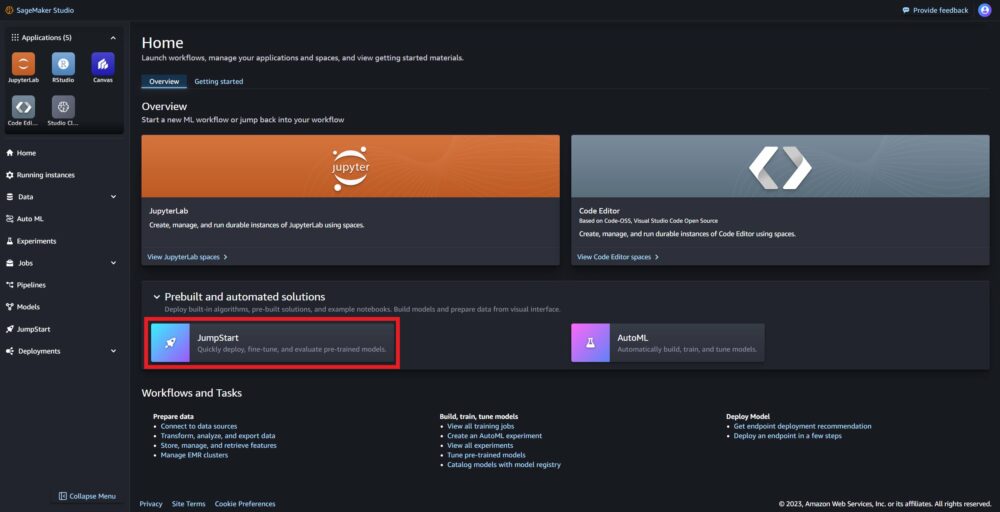

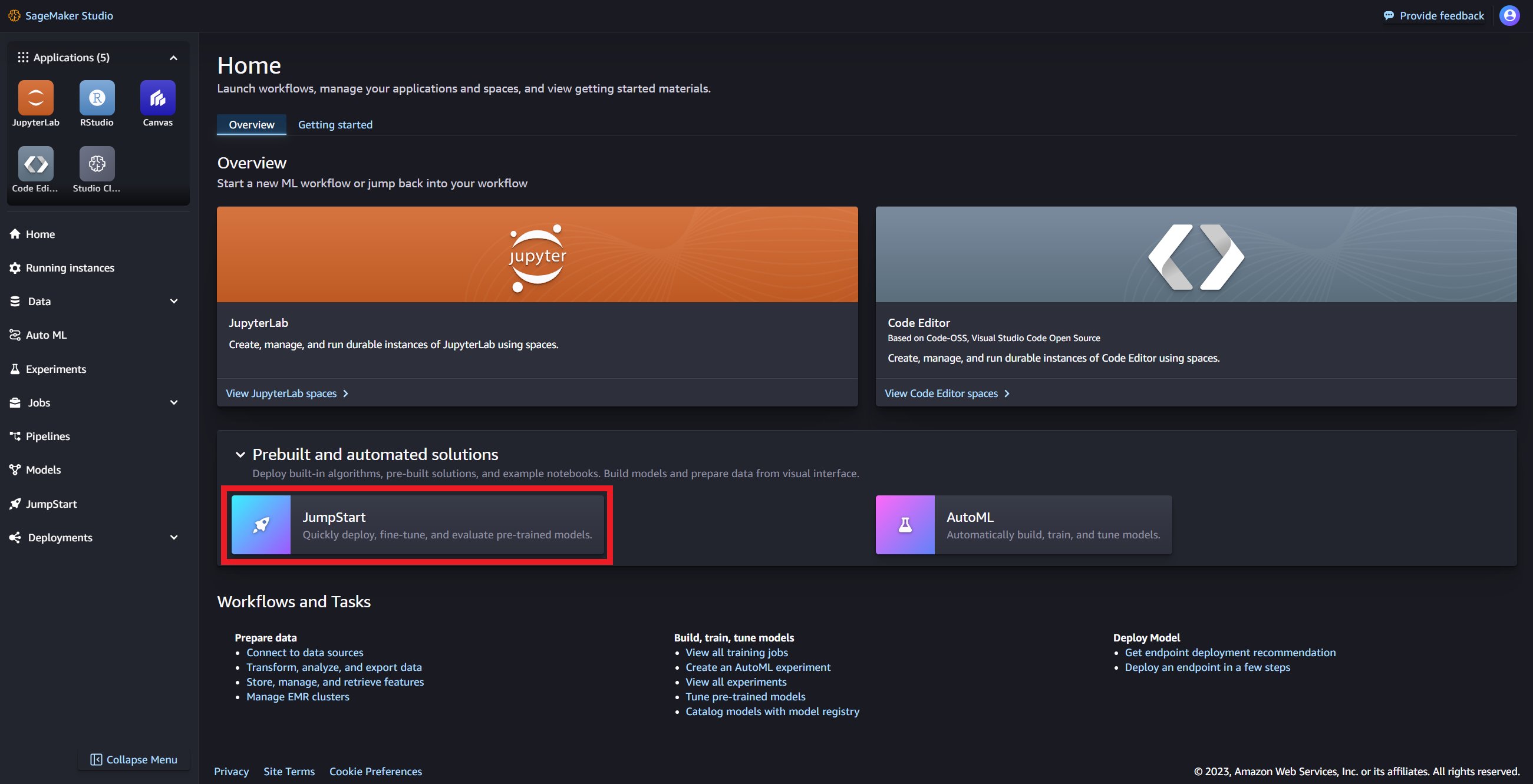

Vous pouvez accéder aux modèles de base Gemma via SageMaker JumpStart dans l'interface utilisateur de SageMaker Studio et le SDK SageMaker Python. Dans cette section, nous expliquons comment découvrir les modèles dans SageMaker Studio.

SageMaker Studio est un environnement de développement intégré (IDE) qui fournit une interface visuelle Web unique dans laquelle vous pouvez accéder à des outils spécialement conçus pour effectuer toutes les étapes de développement ML, de la préparation des données à la création, la formation et le déploiement de vos modèles ML. Pour plus de détails sur la façon de démarrer et de configurer SageMaker Studio, consultez Amazon SageMakerStudio.

Dans AWS Management Console pour SageMaker Studio, accédez à SageMaker JumpStart sous Solutions prédéfinies et automatisées. Jumpstart contient des modèles pré-entraînés, des blocs-notes et des solutions prédéfinies.

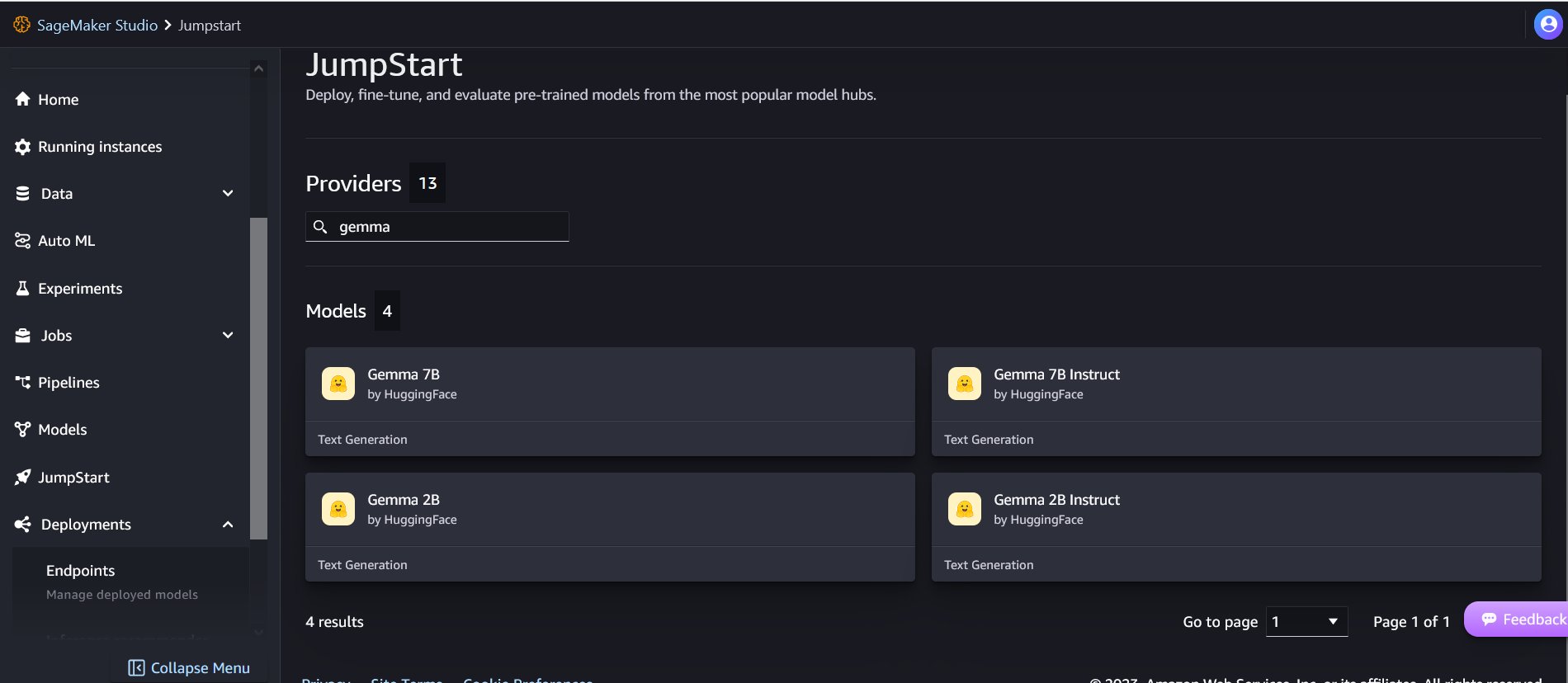

Sur la page de destination de SageMaker JumpStart, vous pouvez trouver le modèle Gemma en recherchant Gemma.

Vous pouvez ensuite choisir parmi une variété de variantes de modèles Gemma, notamment les instructions Gemma 2B, Gemma 7B, Gemma 2B et Gemma 7B.

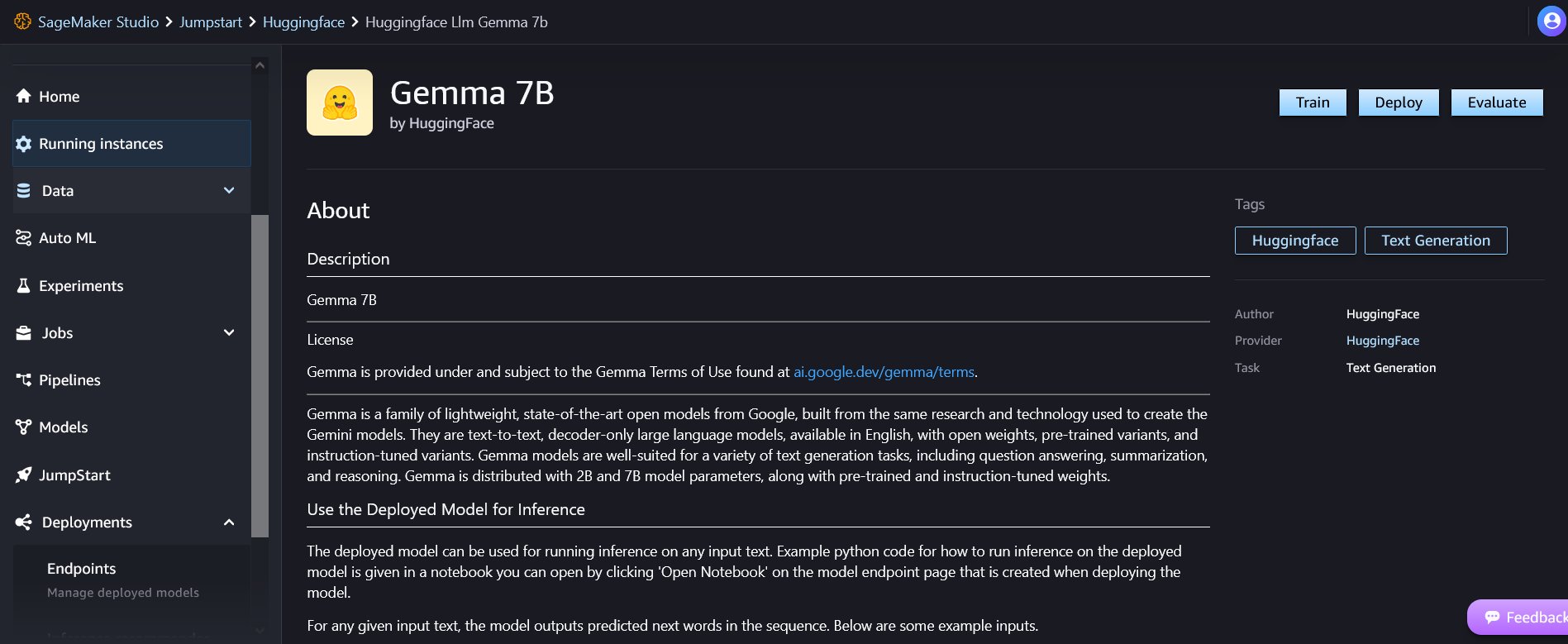

Choisissez la fiche de modèle pour afficher les détails du modèle, tels que la licence, les données utilisées pour l'entraînement et la manière d'utiliser le modèle. Vous trouverez également un Déployer qui vous amène à une page de destination où vous pouvez tester l'inférence avec un exemple de charge utile.

Déployer Gemma avec le SDK SageMaker Python

Vous pouvez trouver le code montrant le déploiement de Gemma sur JumpStart et un exemple d'utilisation du modèle déployé dans ce bloc-notes GitHub.

Commencez par sélectionner l’ID du modèle SageMaker Model Hub et la version du modèle à utiliser lors du déploiement de Gemma.

Choisissez un ID de modèle dans le tableau suivant, qui détaille les options de configuration par défaut pour le déploiement JumpStart. En raison de la grande taille du vocabulaire de 256 7 jetons, Gemma 10B ne peut tenir que sur un seul GPU A1G lorsqu'il prend en charge une longueur de 7 XNUMX contextes. Pour cette raison, JumpStart utilise une instance par défaut plus grande pour Gemma XNUMXB.

| ID du modèle | Instance d'inférence par défaut | Degré parallèle du tenseur | Contexte pris en charge Longueur |

| câlin-face-llm-gemma-2b | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-2b-instruct | ml.g5.xlarge | 1 | 8k |

| câlin-face-llm-gemma-7b | ml.g5.12xlarge | 4 | 8k |

| huggingface-llm-gemma-7b-instruct | ml.g5.12xlarge | 4 | 8k |

Vous pouvez maintenant déployer le modèle à l'aide de SageMaker JumpStart. Le code suivant utilise l'instance par défaut ml.g5.12xlarge pour le point de terminaison d'inférence Vous pouvez déployer le modèle sur d'autres types d'instance en passant instance_type dans les JumpStartModel classe. Le déploiement peut prendre 5 à 10 minutes.

Pour un déploiement réussi, vous devez modifier manuellement le accept_eula argument dans la méthode de déploiement du modèle pour True. Ce modèle est déployé à l'aide du conteneur d'apprentissage profond de génération de texte (TGI).

Appeler le point de terminaison

Vous pouvez récupérer par programme des exemples de charges utiles à partir du JumpStartModel objet. Cela vous aidera à démarrer en observant les invites d'instructions préformatées que Gemma peut ingérer.

Avant d'examiner des invites spécifiques, considérons le modèle de discussion pour les modèles Gemma Instruct.

Ici, vous placez votre invite dans le [USER_PROMPT] emplacement. Il n'y a pas de support pour une instruction système ; à la place, vous pouvez ajouter l'instruction souhaitée à l'invite utilisateur. De plus, si vous avez une conversation à plusieurs tours, l'invite du modèle peut alterner entre l'utilisateur et l'assistant selon les besoins.

Considérons maintenant quelques exemples d’instructions. Ici, vous demandez à Gemma d'écrire un programme Hello World.

Voici le résultat attendu :

Ensuite, invoquez Gemma pour la tâche créative d’écrire un poème.

Voici le résultat :

Cela a l'air plutôt bien !

Examinons maintenant l'analyse comparative des performances de latence et de débit pour la diffusion de modèles avec la configuration de déploiement JumpStart par défaut. Ici, nous montrons comment les performances du modèle peuvent différer pour votre charge de travail typique de point de terminaison. Dans les tableaux suivants, vous pouvez observer que les requêtes de petite taille (256 mots d'entrée et 256 jetons de sortie) sont assez performantes sous un grand nombre d'utilisateurs simultanés, atteignant un débit de jetons de l'ordre de mille à deux mille jetons par seconde. Cependant, à mesure que le nombre de mots d'entrée approche la longueur de contexte maximale prise en charge par Gemma, soit huit mille jetons, le point de terminaison sature sa capacité de traitement par lots (le nombre de requêtes simultanées pouvant être traitées simultanément) en raison de contraintes liées à la mémoire de l'instance.

Pour plus d'informations sur la façon de prendre en compte ces informations et d'ajuster les configurations de déploiement pour votre cas d'utilisation spécifique, consultez Comparez et optimisez le déploiement des points de terminaison dans Amazon SageMaker JumpStart.

| . | Débit (jetons/s) | ||||||||||

| Utilisateurs concurrents | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modèle | Type d'instance | Mots d'entrée | Jetons de sortie | . | . | . | . | . | . | . | . |

| gemma-2b-instruire | ml.g5.xlarge | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-instruire | ml.g5.12xlarge | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | Latence P50 (ms/jeton) | ||||||||||

| Utilisateurs concurrents | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modèle | Type d'instance | Mots d'entrée | Jetons de sortie | . | . | . | . | . | . | . | . |

| gemma-2b-instruire | ml.g5.xlarge | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| Gemma-7b-instruire | ml.g5.12xlarge | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

Affinez Gemma à l’aide du SDK SageMaker Python

Ensuite, nous vous montrons comment affiner le modèle d'instruction Gemma 7B sur un ensemble de données au format conversationnel en utilisant QLoRA technique. Comme mentionné précédemment, en raison de la grande taille du vocabulaire de 256 8 et de la longueur du contexte de XNUMX XNUMX, JumpStart propose les configurations par défaut suivantes pour le réglage fin de QLoRA.

| ID du modèle | Instance de formation par défaut | Longueur maximale de la séquence d'entrée | Taille du lot de formation par appareil | Étapes d'accumulation de dégradé |

| câlin-face-llm-gemma-2b | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-2b-instruct | ml.g5.2xlarge | 1024 | 1 | 4 |

| câlin-face-llm-gemma-7b | ml.g5.12xlarge | 2048 | 1 | 4 |

| huggingface-llm-gemma-7b-instruct | ml.g5.12xlarge | 2048 | 1 | 4 |

Chargeons et traitons l'ensemble de données au format conversationnel. L'exemple d'ensemble de données pour cette démonstration est Fils de conversation TOP-1 d'OpenAssistant.

Les données d'entraînement doivent être formulées en lignes JSON (.jsonl), où chaque ligne est un dictionnaire représentant un ensemble de conversations. Un exemple dans le fichier de lignes JSON est présenté ci-dessous. Pour plus de détails sur la façon de traiter l'ensemble de données, consultez le bloc-notes dans GitHub.

Sous-jacent aux scripts de formation, JumpStart utilise HuggingFace Formateur SFT comprenant QLoRA ainsi que les FlashAttention. Flash Attention permet une mise à l'échelle efficace, conduisant à une formation et une inférence plus rapides. Outre le réglage fin basé sur le chat, JumpStart prend également en charge le réglage fin des instructions et de l'adaptation de domaine avec QLoRA. Pour plus de détails, consultez le cahier dans GitHub.

Après le réglage fin, vous pouvez déployer le modèle affiné sur un point de terminaison SageMaker.

Vous pouvez choisir de déployer le modèle affiné sur les données de conversation dans le point de terminaison SageMaker avec Fonctionnalité API des messages HuggingFace comme approche alternative. L'avantage de l'utilisation de la fonctionnalité Message API est qu'elle permet aux utilisateurs de transmettre les exemples de requêtes au format brut, comme indiqué dans le tableau suivant, et chat_template dans le point de terminaison convertira les exemples de requêtes au format approprié avant de les envoyer dans le modèle. Pour plus de détails, consultez la section Déploiement après avoir affiné le cahier.

Après avoir déployé le modèle affiné dans un point de terminaison, vous pouvez comparer les réponses de sortie des modèles Gemma pré-entraînés et affinés. Les exemples sont collectés à partir de données de test, qui constituent un ensemble de données d'entraînement. Les paramètres d'inférence sont max_tokens comme 512, top_p comme 0.9, temperature à 0.4 ans, et top_k comme 50.

Comme vous pouvez le constater avec les résultats du réglage fin, les réponses des agents sont plus précises.

Pour évaluer davantage vos modèles affinés, vous pouvez explorer Évaluation FM avec Amazon SageMaker Clarify pour voir les performances de votre modèle optimisé par rapport au modèle de base.

| Contributions | Vérité terrain | Réponse de base modèle | Réponse d'un modèle affiné | |

| 1 |

Utilisateur : Je souhaite travailler mon vocabulaire, pouvez-vous me donner des moyens simples pour trouver de nouveaux mots à utiliser pour augmenter la diversité de mes phrases ? Assistant : Certainement ! L'amélioration de votre vocabulaire est un processus continu, mais voici quelques moyens simples de trouver de nouveaux mots et d'augmenter la diversité de vos phrases : 1. Lisez beaucoup : la lecture de livres, d'articles et de blogs sur différents genres et sujets vous expose à de nouveaux mots et expressions. Notez tous les mots inconnus que vous rencontrez et recherchez leur signification. 2. Utilisez un thésaurus : Chaque fois que vous écrivez ou lisez, utilisez un thésaurus pour trouver des synonymes de mots couramment utilisés. Cela vous aide non seulement à apprendre de nouveaux mots, mais améliore également votre compréhension de leurs subtiles différences de sens. 3. Calendriers ou applications mot par jour : abonnez-vous à un e-mail mot par jour ou téléchargez une application de création de vocabulaire. Ces outils vous présentent chaque jour un nouveau mot, ainsi que sa signification, sa prononciation et des exemples d'utilisation. 4. Rejoignez un club de lecture ou un groupe de discussion : S'engager dans des conversations et des discussions sur des livres, des articles ou tout autre sujet vous expose à différentes perspectives et à un nouveau vocabulaire. Écoutez attentivement les autres et essayez d'utiliser de nouveaux mots dans leur contexte. 5. Jouez à des jeux de mots : des jeux comme le Scrabble, le Boggle et les mots croisés mettent à l'épreuve vos compétences en vocabulaire et vous aident à apprendre de nouveaux mots de manière agréable. 6. Regardez des films, des émissions de télévision ou des documentaires : les médias visuels utilisent souvent un langage, un argot et un jargon divers. Regarder des films, des émissions de télévision ou des documentaires sous-titrés peut vous aider à mieux comprendre et mémoriser de nouveaux mots. 7. Entraînez-vous à écrire : écrire régulièrement des histoires, des essais ou des entrées de journal vous encourage à utiliser de nouveaux mots et expressions. Expérimentez avec différents styles et genres d'écriture pour élargir votre vocabulaire. 8. Apprenez l'étymologie d'un nouveau mot : Comprendre l'origine et l'histoire d'un mot peut faciliter sa mémorisation et son utilisation correcte. La recherche de l'étymologie vous expose également à des mots et des concepts associés. 9. Utilisez des flashcards ou un logiciel de répétition espacée : créez des flashcards avec de nouveaux mots, leur signification et des exemples de phrases. Révisez-les régulièrement ou utilisez un logiciel de répétition espacée comme Anki pour optimiser votre apprentissage. 10. Fixez-vous des objectifs personnels : fixez-vous des objectifs réalisables, comme apprendre cinq nouveaux mots par semaine. Suivez vos progrès et récompensez-vous pour avoir atteint vos objectifs. En intégrant systématiquement ces stratégies dans votre routine quotidienne, vous construirez progressivement un vocabulaire diversifié et solide. Utilisateur : Hm, j'aime vraiment l'idée de lire. Pouvez-vous me recommander un thriller de science-fiction sympa que je pourrais lire ? |

Assistant : Certainement ! Voici quelques recommandations de thrillers de science-fiction qui pourraient vous plaire : 1. « Le problème des trois corps » de Liu Cixin – Ce roman primé explore le premier contact entre l'humanité et une civilisation extraterrestre, ainsi que les ramifications politiques et personnelles qui en résultent. C'est une lecture captivante et stimulante qui plonge dans des questions profondes sur la nature de l'existence et de l'univers. 2. « Annihilation » de Jeff Vandermeer – Ce roman suit un groupe de scientifiques alors qu'ils s'aventurent dans une zone mystérieuse connue sous le nom de « Zone X », où ils rencontrent des phénomènes étranges et troublants. En approfondissant la région, ils commencent à découvrir de sombres secrets sur la nature de la réalité et du monde qui les entoure. 3. « Dark Matter » de Blake Crouch – Ce roman suit un brillant physicien nommé Jason Dessen, qui est enlevé et transporté dans un univers parallèle. Alors qu'il tente de retrouver son chemin vers sa propre réalité, il doit se confronter à ses propres choix et aux conséquences de ses actes. 4. « The Andromeda Strain » de Michael Crichton – Ce roman classique suit une équipe de scientifiques alors qu'ils tentent de contenir et d'étudier un microbe extraterrestre mortel qui a atterri sur Terre. Alors qu'ils courent contre la montre pour trouver un moyen de neutraliser le microbe, ils doivent également faire face à des intrigues politiques et à des conflits personnels. 5. « Ready Player One » d'Ernest Cline – Ce roman se déroule dans un futur dystopique où la majorité de la population passe son temps dans un monde de réalité virtuelle connu sous le nom d'OASIS. Lorsque le créateur de l'OASIS meurt et laisse derrière lui le défi de trouver un œuf de Pâques caché, un jeune protagoniste se lance dans une quête passionnante qui changera sa vie pour toujours. J’espère que l’une de ces recommandations suscitera votre intérêt ! |

Assistant : Le texte ne contient aucune information sur vos préférences ou intérêts de lecture, je ne peux donc pas fournir de recommandation de livre. |

Assistant : Bien sûr, voici quelques recommandations de thrillers de science-fiction qui pourraient vous plaire : – « Dune » de Frank Herbert : Ce roman épique de science-fiction se déroule sur la planète désertique d'Arrakis, où un jeune prince nommé Paul Atreides doit faire face aux défis d'un environnement hostile et d'un paysage politique perfide. – « The Martian » d’Andy Weir : Ce thriller de science-fiction captivant suit l’histoire de Mark Watney, un astronaute bloqué sur Mars après une tempête de poussière, alors qu’il utilise son ingéniosité et son ingéniosité pour survivre et finalement retourner sur Terre. – « The Time Machine » de HG Wells : Ce roman classique de science-fiction adopte une approche philosophique du concept de voyage dans le temps, explorant les conséquences de la modification du passé et du futur. – « The Blade Runner » de Philip K. Dick : Ce roman de science-fiction néo-noir, se déroulant dans un Los Angeles futuriste, explore l'intersection de l'intelligence humaine et artificielle, ainsi que son influence sur la société et la nature de la réalité. – « Les androïdes » d'Isaac Asimov : Ce roman de science-fiction explore le concept d'intelligence artificielle et ses conséquences potentielles, en particulier lorsque les humains développent des androïdes avancés qui remettent en question les valeurs et croyances humaines traditionnelles. Ce ne sont là que quelques suggestions, et en fin de compte, le meilleur livre pour vous dépendra de vos préférences personnelles et du type d'expérience que vous recherchez dans un thriller de science-fiction. Mais j'espère que ces recommandations vous donneront un bon point de départ pour explorer le genre. N'hésitez pas à me faire savoir si vous avez d'autres questions ou si je peux vous aider pour quelque chose. |

| 2 |

Utilisateur : Écrivez un programme Hello World en VB.NET Assistant : Et voilà : " `vbnet Utilisateur : faites en sorte qu'il prenne la saisie du $, puis dites « Bonjour, $ » au lieu de « Bonjour, Monde ! » |

Assistant : Module public HelloWorld Sous-principal public() System.Console.WriteLine (« Quel est votre nom ? ») Nom de la variable As String = System.Console.ReadLine() System.Console.WriteLine("Bonjour," & nom & "!") End Sub Module de fin |

Assistant : "`vbnet Module public HelloWorld Sous-principal public() Nom de la variable As String = Console.ReadLine() Console.WriteLine ("Bonjour", & nom) End Sub Module de fin |

Assistante : Bien sûr ! Voici un exemple: " `vbnet |

| 3 |

Utilisateur : Donnez-moi une liste d'éléments à faire lors du démarrage d'un projet pour former un grand modèle de langage capable de comprendre et de répondre aux questions humaines. Assistant : les étapes suivantes sont une liste condensée des étapes à suivre lors du démarrage d'un projet visant à former un grand modèle de langage capable de comprendre et de répondre aux demandes humaines : 1. Établir la portée et les objectifs du projet, le public cible. Cela devrait vous donner une idée de base des étapes requises. Dois-je entrer plus en détail sur un des points ? Utilisateur : Ces tâches doivent être décomposées davantage. Pourriez-vous s'il vous plaît fournir une liste de tâches à jour avec une répartition plus détaillée des tâches à venir |

Assistant : Voici une description plus détaillée de chaque étape : 1. Établir la portée et les objectifs du projet : Il est important de définir clairement les objectifs du projet et quel est le public cible. Cela vous aidera à prendre des décisions sur le type de données à collecter et sur l'architecture de modèle appropriée. 2. Rassembler et prétraiter les données : il s'agit d'une étape importante car la qualité et la diversité des données auront un impact direct sur les performances du modèle. Le prétraitement peut impliquer le nettoyage des données, la tokenisation du texte et la conversion des mots en représentations numériques. 3. Sélectionnez l'architecture du modèle : il existe de nombreux types de modèles parmi lesquels choisir, notamment les réseaux de neurones récurrents (RNN), les modèles de transformateur et les réseaux de neurones convolutifs (CNN). Le choix dépendra des exigences spécifiques du projet et de la quantité de données disponibles. 4. Divisez l'ensemble de données et mettez en œuvre l'augmentation des données : diviser les données en sous-ensembles de formation, de validation et de test est important pour surveiller les performances du modèle pendant la formation. L’augmentation des données peut être utilisée pour augmenter artificiellement la taille de l’ensemble de données et améliorer la robustesse du modèle. 5. Entraîner le modèle et surveiller les progrès : cette étape implique l'entraînement du modèle sur les données d'entraînement, en utilisant l'ensemble de validation pour surveiller les progrès et ajuster les hyperparamètres si nécessaire. Il peut être nécessaire de répéter ce processus plusieurs fois jusqu'à ce que le modèle fonctionne correctement sur l'ensemble de validation. 6. Évaluer le modèle sur un ensemble de tests : une fois le modèle formé, il est important d'évaluer ses performances sur un ensemble de tests distinct pour avoir une idée de sa capacité de généralisation. Cela peut être fait en comparant les prédictions du modèle aux résultats réels et en analysant les erreurs. 7. Affiner pour des tâches ou des domaines spécifiques : cette étape implique une formation plus approfondie du modèle sur des données spécifiques à une tâche afin d'améliorer ses performances pour un domaine particulier. Cela peut se faire par l'apprentissage par transfert, où un modèle pré-entraîné est affiné sur de nouvelles données, ou par un réglage fin, où le modèle est formé à partir de zéro sur les nouvelles données. 8. Créer une interface pour la saisie utilisateur : cela implique de concevoir une interface qui permet aux utilisateurs de saisir des questions ou des demandes et de recevoir des réponses du modèle. 9. Test dans un environnement contrôlé : Avant de déployer le modèle dans un environnement réel, il est important de le tester dans un environnement contrôlé et de recueillir les commentaires des utilisateurs. Cela aidera à identifier les erreurs ou les biais dans le modèle et offrira des opportunités d’amélioration. 10. Surveiller et améliorer en permanence les performances : Enfin, il est important de surveiller en permanence les performances du modèle et d'effectuer des mises à jour et des améliorations si nécessaire. Cela peut impliquer de recycler le modèle sur de nouvelles données, d'affiner les hyperparamètres ou de mettre à jour l'architecture. |

Assistant : ## Liste de tâches pour la formation d'un grand modèle de langage pour la réponse aux questions **1. Portée et objectifs du projet :** * Définir les objectifs du projet et les fonctionnalités souhaitées. **2. Acquisition et prétraitement des données :** * Identifiez les sources de données de formation et rassemblez un ensemble de données textuelles diversifiées. **3. Sélection et configuration du modèle :** * Sélectionnez une architecture de modèle appropriée en fonction de la complexité de la tâche et des performances souhaitées. **4. Formation et évaluation :** * Divisez les données de formation en sous-ensembles de formation, de validation et de test. **5. Mise au point et développement d'interfaces :** * Affinez le modèle pour des tâches ou des domaines spécifiques grâce à l'apprentissage par transfert. **6. Tests et améliorations :** * Testez le modèle dans un environnement contrôlé avec différents scénarios d'entrée. **Considérations supplémentaires:** * Établir un calendrier et un budget pour le projet. **Remarque :** Cette liste n'est pas exhaustive et peut devoir être adaptée en fonction des exigences spécifiques du projet. |

Assistant : Bien sûr, voici une répartition plus détaillée des tâches impliquées dans la formation d'un grand modèle de langage pour comprendre et répondre aux questions humaines : **1. Établir la portée et les objectifs du projet** **2. Rassembler et prétraiter un ensemble de données textuelles complètes/diversifiées** **3. Sélectionnez une architecture de modèle appropriée, ajustez les hyperparamètres pour la précision/la vitesse** **4. Divisez l'ensemble de données en sous-ensembles de formation, de validation et de test, mettez en œuvre l'augmentation des données** **5. Entraîner le modèle, surveiller les progrès sur l'ensemble de validation, ajuster si nécessaire** **6. Évaluez le modèle sur l'ensemble de tests, comparez-le aux références, analysez les erreurs et les biais** **7. Affinez des tâches ou des domaines spécifiques grâce à l'apprentissage par transfert ou à la mise au point** **8. Créer une interface pour la saisie utilisateur et la réponse du modèle** **9. Testez dans un environnement contrôlé, recueillez des commentaires pour l'amélioration** **dix. Surveiller et améliorer en permanence les performances grâce au recyclage et à l'ajustement** Ce sont les étapes impliquées dans la formation d’un grand modèle de langage pour comprendre et répondre aux questions humaines. S'il vous plaît laissez-moi savoir si vous avez des questions. |

Nettoyer

Après avoir testé les points de terminaison, supprimez les points de terminaison d'inférence SageMaker et le modèle pour éviter d'encourir des frais.

Conclusion

Dans cet article, nous vous avons montré comment démarrer avec Gemma dans SageMaker Studio et déployer le modèle pour l'inférence. Nous vous avons également montré comment affiner les modèles Gemma sur SageMaker Jumpstart.

Étant donné que les modèles de base sont pré-entraînés, ils peuvent contribuer à réduire les coûts de formation et d’infrastructure et permettre une personnalisation adaptée à votre cas d’utilisation. Visitez SageMaker JumpStart dans SageMaker Studio dès maintenant pour commencer.

Ce guide est fourni à titre informatif uniquement. Vous devez toujours effectuer votre propre évaluation indépendante et prendre des mesures pour vous assurer que vous vous conformez à vos propres pratiques et normes spécifiques de contrôle de la qualité, ainsi qu'aux règles, lois, réglementations, licences et conditions d'utilisation locales qui s'appliquent à vous, à votre contenu et à le modèle tiers référencé dans ce guide. AWS n'a aucun contrôle ou autorité sur le modèle tiers référencé dans ce guide, et ne fait aucune représentation ou garantie que le modèle tiers est sécurisé, sans virus, opérationnel ou compatible avec votre environnement et vos normes de production. AWS ne fait aucune représentation, garantie ou garantie que toute information contenue dans ce guide se traduira par un résultat ou un résultat particulier.

À propos des auteurs

Dr Kyle Ulrich est un scientifique appliqué avec le Algorithmes intégrés d'Amazon SageMaker équipe. Ses intérêts de recherche comprennent les algorithmes d'apprentissage automatique évolutifs, la vision par ordinateur, les séries chronologiques, les processus bayésiens non paramétriques et gaussiens. Son doctorat est de l'Université Duke et il a publié des articles dans NeurIPS, Cell et Neuron.

Dr Kyle Ulrich est un scientifique appliqué avec le Algorithmes intégrés d'Amazon SageMaker équipe. Ses intérêts de recherche comprennent les algorithmes d'apprentissage automatique évolutifs, la vision par ordinateur, les séries chronologiques, les processus bayésiens non paramétriques et gaussiens. Son doctorat est de l'Université Duke et il a publié des articles dans NeurIPS, Cell et Neuron.

Dr Xin Huang est un scientifique appliqué senior pour Amazon SageMaker JumpStart et les algorithmes intégrés d'Amazon SageMaker. Il se concentre sur le développement d'algorithmes d'apprentissage automatique évolutifs. Ses intérêts de recherche portent sur le traitement du langage naturel, l'apprentissage en profondeur explicable sur des données tabulaires et l'analyse robuste du clustering spatio-temporel non paramétrique. Il a publié de nombreux articles dans les conférences ACL, ICDM, KDD et Royal Statistical Society: Series A.

Dr Xin Huang est un scientifique appliqué senior pour Amazon SageMaker JumpStart et les algorithmes intégrés d'Amazon SageMaker. Il se concentre sur le développement d'algorithmes d'apprentissage automatique évolutifs. Ses intérêts de recherche portent sur le traitement du langage naturel, l'apprentissage en profondeur explicable sur des données tabulaires et l'analyse robuste du clustering spatio-temporel non paramétrique. Il a publié de nombreux articles dans les conférences ACL, ICDM, KDD et Royal Statistical Society: Series A.

Rachna Chadha est architecte de solutions principal IA/ML dans les comptes stratégiques chez AWS. Rachna est une optimiste qui croit qu’une utilisation éthique et responsable de l’IA peut améliorer la société à l’avenir et apporter la prospérité économique et sociale. Dans ses temps libres, Rachna aime passer du temps avec sa famille, faire de la randonnée et écouter de la musique.

Rachna Chadha est architecte de solutions principal IA/ML dans les comptes stratégiques chez AWS. Rachna est une optimiste qui croit qu’une utilisation éthique et responsable de l’IA peut améliorer la société à l’avenir et apporter la prospérité économique et sociale. Dans ses temps libres, Rachna aime passer du temps avec sa famille, faire de la randonnée et écouter de la musique.

Evan Kravitz est ingénieur logiciel chez Amazon Web Services, travaillant sur SageMaker JumpStart. Il aime cuisiner et courir à New York.

Evan Kravitz est ingénieur logiciel chez Amazon Web Services, travaillant sur SageMaker JumpStart. Il aime cuisiner et courir à New York.

Dr Ashish Khetan est un scientifique appliqué senior avec les algorithmes intégrés d'Amazon SageMaker et aide à développer des algorithmes d'apprentissage automatique. Il a obtenu son doctorat à l'Université de l'Illinois à Urbana-Champaign. Il est un chercheur actif en apprentissage automatique et en inférence statistique, et a publié de nombreux articles dans les conférences NeurIPS, ICML, ICLR, JMLR, ACL et EMNLP.

Dr Ashish Khetan est un scientifique appliqué senior avec les algorithmes intégrés d'Amazon SageMaker et aide à développer des algorithmes d'apprentissage automatique. Il a obtenu son doctorat à l'Université de l'Illinois à Urbana-Champaign. Il est un chercheur actif en apprentissage automatique et en inférence statistique, et a publié de nombreux articles dans les conférences NeurIPS, ICML, ICLR, JMLR, ACL et EMNLP.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- capacité

- Qui sommes-nous

- au dessus de

- Accepter

- accès

- accessibilité

- Compte

- hybrides

- accumulation

- précision

- Avec cette connaissance vient le pouvoir de prendre

- réalisable

- Atteint

- acquisition

- à travers

- actes

- infection

- présenter

- adaptation

- ajout

- En outre

- régler

- Avancée

- avances

- Après

- à opposer à

- Agent

- AI

- AI / ML

- avion

- algorithmes

- étranger

- Tous

- permettre

- permis

- permet

- le long de

- aussi

- alternative

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- montant

- an

- selon une analyse de l’Université de Princeton

- il analyse

- des analyses

- l'analyse

- ainsi que les

- et infrastructure

- Andromède

- Angeles

- Annoncer

- répondre

- répondre

- réponses

- tous

- quoi que ce soit d'artificiel

- api

- appli

- applications

- appliqué

- Appliquer

- une approche

- approches

- approprié

- applications

- architecture

- SONT

- Réservé

- domaines

- argument

- autour

- Art

- sur notre blog

- artificiel

- intelligence artificielle

- AS

- demander

- Évaluation de risque climatique

- Assistante gérante

- astronaute

- At

- public

- autorité

- Automatisation

- disponibles

- éviter

- primé

- AWS

- Console de gestion AWS

- RETOUR

- balanced

- base

- basé

- Essentiel

- mise en lot

- Bayésien

- BE

- car

- before

- commencer

- derrière

- va

- croyances

- croit

- ci-dessous

- analyse comparative

- repères

- profiter

- outre

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- biais

- biais

- Milliards

- milliards

- BLADE

- Block

- Blog

- blogue

- Bloom

- corps

- livre

- Livres

- Breakdown

- brillant

- apporter

- Apporter

- Apportez le

- Cassé

- budget

- construire

- Développement

- construit

- intégré

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- calendriers

- Appelez-nous

- appelé

- CAN

- ne peut pas

- la toile

- capacités

- capable

- carte

- maisons

- cas

- Catégories

- prudence

- cellule

- challenge

- globaux

- Change

- caractéristiques

- des charges

- le chat

- Contrôles

- le choix

- choix

- Selectionnez

- Ville

- Civilization

- classe

- classiques

- espace extérieur plus propre,

- Nettoyage

- clairement

- cliquez

- de

- regroupement

- code

- Codage

- collaboration

- vient

- communément

- comparer

- par rapport

- comparant

- Comparaison

- compatible

- complet

- complexités

- complexité

- se conformer

- ordinateur

- Vision par ordinateur

- concept

- concepts

- concurrent

- conférences

- configuration

- conflits

- Conséquences

- Considérer

- considérations

- considérant

- régulièrement

- consiste

- Console

- constant

- contraintes

- contact

- contiennent

- Contenant

- contient

- combattre

- contenu

- contexte

- continuellement

- des bactéries

- contrôlée

- Conversation

- de la conversation

- conversations

- convertir

- conversion

- Freddi

- correctement

- Costs

- pourriez

- engendrent

- La création

- Conception

- créateur

- mots croisés

- organisée

- curieux

- Courant

- Clients

- personnalisation

- Tous les jours

- danser

- Foncé

- données

- ensembles de données

- journée

- décisions

- profond

- l'apprentissage en profondeur

- profond

- DeepMind

- Réglage par défaut

- Vous permet de définir

- Définit

- delve

- Delves

- manifestation

- dépendre

- déployer

- déployé

- déployer

- déploiement

- DÉSERT

- Conception

- conception

- voulu

- détail

- détaillé

- détails

- Déterminer

- développer

- développé

- Développeur

- développement

- Développement

- dispositif

- diagnostiquer

- dialogue

- différer

- différences

- différent

- numérique

- Art numérique

- directement

- annuaire

- découvrez

- spirituelle

- discussions

- maladies

- plongeon

- plusieurs

- Diversité

- diviser

- do

- document

- documentaires

- domaine

- domaines

- fait

- down

- download

- deux

- Duc

- université de Duke

- pendant

- Poussière

- dystopique

- chacun

- Terre

- plus facilement

- efficace

- huit

- Empire

- permettre

- permet

- permettant

- rencontre

- encourage

- end-to-end

- Endpoint

- engageant

- ingénieur

- Améliore

- jouir

- agréable

- assurer

- Environment

- EPIC

- Erreurs

- essential

- établir

- éthique

- évaluer

- évaluer

- évaluation

- faire une éventuelle

- Chaque

- exemple

- exemples

- excité

- complet

- expositions

- existence

- existant

- Développer vous

- attendu

- cher

- d'experience

- expérience

- de santé

- explorez

- explore

- Explorer

- Visage

- justice

- non

- famille

- plus rapide

- Fonctionnalité

- Réactions

- Pieds

- few

- champ

- bats toi

- Déposez votre dernière attestation

- finalement

- Trouvez

- résultats

- fin

- Prénom

- premier contact

- s'adapter

- cinq

- Flash

- vol

- se concentre

- Abonnement

- suit

- Pour

- toujours

- le format

- Fondation

- Framework

- franc

- de

- fonction

- fonctionnalités

- fonctionnement

- plus

- avenir

- futuriste

- Games

- recueillir

- GEMINI

- générateur

- génératif

- IA générative

- genre

- genres

- obtenez

- GitHub

- Donner

- donné

- Go

- Objectifs

- aller

- Bien

- eu

- GPU

- grâce

- peu à peu

- l'

- grand pouvoir

- Réservation de groupe

- garantit

- Garde

- l'orientation

- guide

- guidage

- main

- harnais

- Vous avez

- he

- la taille

- hello

- vous aider

- aide

- ici

- ici

- caché

- sa

- Histoire

- d'espérance

- organisé

- Comment

- How To

- Cependant

- HTML

- HTTPS

- Moyeu

- hubs

- Étreindre

- humain

- Humanité

- Les êtres humains

- i

- ID

- idée

- identifier

- if

- Illinois

- satellite

- Impact

- Mettre en oeuvre

- la mise en oeuvre

- importer

- important

- améliorer

- amélioration

- améliorations

- l'amélioration de

- in

- comprendre

- Y compris

- incorporation

- Améliore

- indépendant

- industrie

- normes de l'industrie

- influencer

- d'information

- D'information

- Infrastructure

- ingéniosité

- Innovation

- contribution

- entrées

- Messages

- idées.

- inspiré

- instance

- plutôt ;

- intégrer

- des services

- Intelligence

- intention

- l'interaction

- intérêts

- Interfaces

- intersection

- développement

- introduire

- intuitif

- impliquer

- impliqué

- implique

- IT

- articles

- SES

- jargon

- rejoindre

- Journal

- chemin

- jpg

- json

- juste

- XNUMX éléments à

- Genre

- Savoir

- spécialisées

- connu

- kyle

- atterrissage

- paysage d'été

- langue

- gros

- plus importantes

- Latence

- lancé

- Lois

- conduisant

- APPRENTISSAGE

- apprentissage

- apprend

- départ

- Longueur

- laisser

- Niveau

- Levier

- Licence

- licences

- VIE

- foudre

- Vitesse de l'éclair

- léger

- comme

- aime

- Gamme

- lignes

- Liste

- écouter

- Écoute

- écoute

- Flamme

- charge

- locales

- emplacement

- Style

- recherchez-

- LOOKS

- les

- Los Angeles

- baisser

- click

- machine learning

- Majorité

- a prendre une

- malveillant

- gestion

- manuellement

- de nombreuses

- marque

- Mars

- mathématiques

- maximales

- Mai..

- me

- sens

- significations

- les mesures

- Médias

- médecine

- réunion

- mentionné

- message

- messages

- méthode

- Michael

- pourrait

- l'esprit

- Minutes

- ML

- modèle

- numériques jumeaux (digital twin models)

- Module

- Surveiller

- Stack monitoring

- PLUS

- (en fait, presque toutes)

- Films

- Musique

- must

- my

- mystérieux

- prénom

- Nommé

- Nature

- Traitement du langage naturel

- Nature

- nécessaire

- Besoin

- nécessaire

- Besoins

- réseaux

- neural

- les réseaux de neurones

- n'allons jamais

- Nouveauté

- New York

- New York City

- nuit

- aucune

- noter

- cahier

- roman

- maintenant

- nombre

- Oasis

- objet

- objectifs

- observer

- of

- Offres Speciales

- souvent

- on

- une fois

- ONE

- en cours

- uniquement

- opérationnel

- Opportunités

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- Options

- or

- de commander

- origine

- OS

- Autre

- Autres

- ande

- Résultat

- les résultats

- sortie

- plus de

- propre

- page

- papiers

- Parallèle

- paramètre

- paramètres

- particulier

- particulièrement

- les parties

- pass

- En passant

- passé

- chemin

- motifs

- paul

- Personnes

- /

- Effectuer

- performant

- effectuer

- effectue

- personnel

- perspectives

- phd

- les expressions clés

- physicien

- pilote

- Place

- planète

- plans

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Jouez

- joueur

- veuillez cliquer

- Point

- des notes bonus

- politique

- Populaire

- population

- Post

- défaillances

- power

- pratique

- pratiques

- Prédictions

- Predictor

- préférences

- en train de préparer

- assez

- précédemment

- Prince

- Directeur

- impressions

- processus

- Traité

- les process

- traitement

- Vidéo

- Programme

- Progrès

- Projet

- instructions

- correct

- prospérité

- fournir

- fournisseurs

- fournit

- public

- publiquement

- publié

- des fins

- Casse-têtes

- Python

- pytorch

- qualité

- requêtes

- question

- quête

- question

- fréquemment posées

- vite.

- assez

- Race

- ramifications

- gamme

- plutôt

- raw

- atteindre

- Lire

- en cours

- monde réel

- Réalité

- vraiment

- royaume

- raison

- recevoir

- récent

- Recommandation

- recommandations

- recommander

- récurrent

- référence

- référencé

- reflète

- régulièrement

- règlements

- en relation

- libéré

- pertinent

- rappeler

- répéter

- représentation

- demandes

- conditions

- Exigences

- un article

- chercheur

- Réagir

- répondre

- réponse

- réponses

- responsabilité

- responsables

- résultat

- Résultats

- Avis

- Récompenser

- Augmenter

- robuste

- solidité

- Rôle

- routine

- Royal

- Courir

- fonctionne

- s

- plus sûre

- sagemaker

- Inférence SageMaker

- même

- Épargnez

- dire

- évolutive

- Escaliers intérieurs

- Balance

- mise à l'échelle

- scénarios

- science-fiction

- Sciences

- Scientifique

- scientifiques

- portée

- gratter

- scénario

- scripts

- Sdk

- fluide

- recherche

- Deuxièmement

- secrets

- Section

- sécurisé

- sur le lien

- Sélectionner

- choisi

- la sélection

- sélection

- envoi

- supérieur

- séparé

- Séquence

- Série

- de série A

- Services

- service

- Session

- set

- Sets

- mise

- plusieurs

- commun

- devrait

- montrer

- montré

- montrant

- montré

- Spectacles

- côté

- similaires

- étapes

- unique

- Taille

- tailles

- compétences

- So

- Réseaux sociaux

- Société

- Logiciels

- Software Engineer

- sur mesure

- Solutions

- quelques

- Sources

- Étincelles Froides

- groupe de neurones

- vitesse

- Dépenses

- dépense

- Utilisation d'un

- Normes

- j'ai commencé

- Commencez

- Région

- state-of-the-art

- Déclaration

- statistique

- étapes

- Étapes

- Encore

- Stories

- tempête

- Histoire

- étrange

- Stratégique

- les stratégies

- Chaîne

- STRONG

- studio

- Étude

- inscrire

- les sous-titres

- réussi

- tel

- convient

- Support

- Appareils

- Appuyer

- Les soutiens

- sûr

- survivre

- combustion propre

- table

- Prenez

- prend

- conte

- Target

- objectifs

- Tâche

- tâches

- équipe

- équipes

- technique

- techniques

- Technologie

- modèle

- modèles

- tensorflow

- conditions

- tester

- examiné

- Essais

- texte

- que

- qui

- Les

- La Région

- El futuro

- le monde

- leur

- Les

- se

- puis

- Là.

- donc

- Ces

- l'ont

- Troisièmement

- des tiers

- des tiers.

- this

- ceux

- pensée

- suscitant la réflexion

- mille

- palpitant

- Avec

- débit

- fiable

- Des séries chronologiques

- voyage dans le temps

- calendrier

- fois

- à

- jeton

- tokenisation

- Tokens

- dit

- outil

- les outils

- sujet

- Total

- suivre

- traditionnel

- Train

- qualifié

- Formation

- transférer

- Transfert

- transformateur

- Traduction

- Voyage

- Billion

- oui

- Essai

- régler

- écoute

- réglage

- tv

- deux

- type

- types

- débutante

- typiquement

- ui

- En fin de compte

- devoiler

- sous

- comprendre

- compréhension

- inconnu

- Univers

- université

- incomparable

- jusqu'à

- dévoilement

- a actualisé

- Actualités

- la mise à jour

- us

- convivialité

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- convivial

- utilisateurs

- Usages

- en utilisant

- validation

- Valeurs

- variété

- divers

- entreprise

- version

- Voir

- Salle de conférence virtuelle

- La réalité virtuelle

- vision

- Visiter

- visuel

- média visuel

- le volume

- marcher

- souhaitez

- garanties

- était

- Montres

- personne(s) regarde(nt) cette fiche produit

- Façon..

- façons

- we

- web

- services Web

- Basé sur le Web

- semaine

- WELL

- Wells

- Quoi

- Qu’est ce qu'

- quand

- chaque fois que

- que

- qui

- WHO

- large

- largement

- un widget

- sera

- sagesse

- comprenant

- dans les

- sans

- Word

- des mots

- activités principales

- workflow

- de travail

- world

- écrire

- écriture

- X

- york

- Vous n'avez

- jeune

- Votre

- vous-même

- zéphyrnet