Vidéo Le plus grand modèle de langage d'IA de Google aide les robots à être plus flexibles dans la compréhension et l'interprétation des commandes humaines, selon les dernières recherches du géant du Web.

Les machines répondent généralement mieux à des demandes très spécifiques - des demandes ouvertes peuvent parfois les perturber et conduire à des résultats que les utilisateurs n'avaient pas en tête. Les gens apprennent à interagir avec les robots de manière rigide, comme poser des questions d'une manière particulière pour obtenir la réponse souhaitée.

Le dernier système de Google, baptisé PaLM-SayCan, promet cependant d'être plus intelligent. L'appareil physique d'Everyday Robots - une startup issue de Google X - a des caméras pour les yeux dans la tête et un bras avec une pince niché derrière son long corps droit, qui repose sur un ensemble de roues.

Vous pouvez voir le robot en action dans la vidéo ci-dessous :

Demander au robot, quelque chose comme "Je viens de m'entraîner, peux-tu m'apporter une collation saine ?" le poussera à aller chercher une pomme. "PaLM-SayCan [est] une approche interprétable et générale pour tirer parti des connaissances des modèles de langage qui permet à un robot de suivre des instructions textuelles de haut niveau pour effectuer des tâches physiques", ont déclaré des chercheurs de l'équipe Brain de Google. expliqué.

Google a présenté son plus grand modèle de langage Palmier en avril de cette année. PaLM a été formé sur des données extraites d'Internet, mais au lieu de cracher des réponses textuelles ouvertes, le système a été adapté pour générer une liste d'instructions à suivre par le robot.

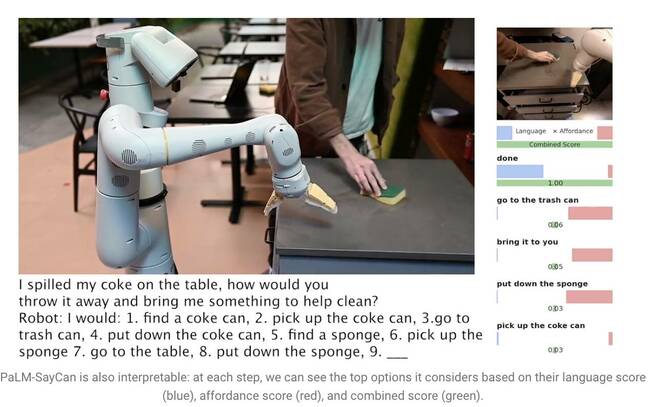

Dire "J'ai renversé mon coca sur la table, comment le jetteriez-vous et m'apporteriez-vous quelque chose pour m'aider à nettoyer ?", invite PaLM à comprendre la question et à générer une liste d'étapes que le robot peut suivre pour accomplir la tâche, comme passer en revue pour ramasser la canette, la jeter dans une poubelle et prendre une éponge.

Les grands modèles de langage (LLM) comme PaLM, cependant, ne comprennent pas le sens de tout ce qu'ils disent. Pour cette raison, les chercheurs ont formé un modèle distinct utilisant l'apprentissage par renforcement pour ancrer le langage abstrait dans des représentations visuelles et des actions. De cette façon, le robot apprend à associer le mot "Coke" à l'image d'une canette de boisson gazeuse.

PaLM-SayCan apprend également ce que l'on appelle les « fonctions d'affordance » - une méthode qui classe la possibilité d'accomplir une action spécifique en fonction des objets dans son environnement. Le robot est plus susceptible de ramasser une éponge qu'un aspirateur, par exemple s'il détecte une éponge mais pas d'aspirateur à proximité.

"Notre méthode, SayCan, extrait et exploite les connaissances des LLM dans des tâches physiques", a expliqué l'équipe dans un document de recherche. «Le LLM (Say) fournit une base de tâches pour déterminer les actions utiles pour un objectif de haut niveau et les fonctions d'affordance apprises (Can) fournissent une base mondiale pour déterminer ce qui est possible d'exécuter le plan. Nous utilisons l'apprentissage par renforcement (RL) comme moyen d'apprendre des fonctions de valeur conditionnées par le langage qui fournissent des affordances de ce qui est possible dans le monde. »

Pour empêcher le robot de dévier de sa tâche, il est entraîné à sélectionner des actions parmi 101 instructions différentes uniquement. Google l'a formé pour s'adapter à une cuisine – PaLM-SayCan peut obtenir des collations, des boissons et effectuer des tâches de nettoyage simples. Les chercheurs pensent que les LLM sont la première étape pour amener les robots à effectuer des tâches plus complexes en toute sécurité avec des instructions abstraites.

"Nos expériences sur un certain nombre de tâches robotiques du monde réel démontrent la capacité de planifier et de compléter des instructions abstraites en langage naturel à long horizon avec un taux de réussite élevé. Nous pensons que l'interprétabilité de PaLM-SayCan permet une interaction sécurisée des utilisateurs dans le monde réel avec les robots », ont-ils conclu. ®

- AI

- art de l'IA

- générateur d'art ai

- robot IA

- intelligence artificielle

- certification en intelligence artificielle

- intelligence artificielle en banque

- robot d'intelligence artificielle

- robots d'intelligence artificielle

- logiciel d'intelligence artificielle

- blockchain

- conférence blockchain ai

- cognitif

- intelligence artificielle conversationnelle

- crypto conférence ai

- de dall

- l'apprentissage en profondeur

- google ai

- machine learning

- Platon

- platon ai

- Intelligence des données Platon

- Jeu de Platon

- PlatonDonnées

- jeu de platogamie

- échelle ai

- syntaxe

- Le registre

- zéphyrnet