Les grands modèles linguistiques (LLM), grâce à leurs vastes connaissances, peuvent générer un texte de type humain sur presque tous les sujets. Cependant, leur formation sur des ensembles de données massifs limite également leur utilité pour des tâches spécialisées. Sans un apprentissage continu, ces modèles restent inconscients des nouvelles données et tendances qui émergent après leur formation initiale. De plus, le coût de formation de nouveaux LLM peut s’avérer prohibitif pour de nombreuses entreprises. Cependant, il est possible de croiser une réponse de modèle avec le contenu spécialisé d'origine, évitant ainsi d'avoir à former un nouveau modèle LLM, à l'aide de la génération de récupération augmentée (RAG).

RAG donne du pouvoir aux LLM en leur donnant la possibilité de récupérer et d'incorporer des connaissances externes. Au lieu de s'appuyer uniquement sur leurs connaissances pré-entraînées, RAG permet aux modèles d'extraire des données de documents, de bases de données, etc. Le modèle intègre ensuite habilement ces informations extérieures dans son texte généré. En recherchant des données pertinentes au contexte, le modèle peut fournir des réponses éclairées et actualisées adaptées à votre cas d'utilisation. L’augmentation des connaissances réduit également le risque d’hallucinations et de textes inexacts ou absurdes. Avec RAG, les modèles de base deviennent des experts adaptables qui évoluent à mesure que votre base de connaissances se développe.

Aujourd'hui, nous sommes ravis de dévoiler trois démos d'IA générative, sous licence Licence MIT-0:

- Amazon Kendra avec LLM fondamental – Utilise les capacités de recherche approfondie de Amazone Kendra combiné avec la connaissance approfondie des LLM. Cette intégration fournit des réponses précises et contextuelles à des requêtes complexes en s'appuyant sur un large éventail de sources.

- Modèle d'intégration avec LLM fondamental – Fusionne la puissance des intégrations (une technique permettant de capturer la signification sémantique des mots et des phrases) avec la vaste base de connaissances des LLM. Cette synergie permet une modélisation de sujet, une recommandation de contenu et des capacités de recherche sémantique plus précises.

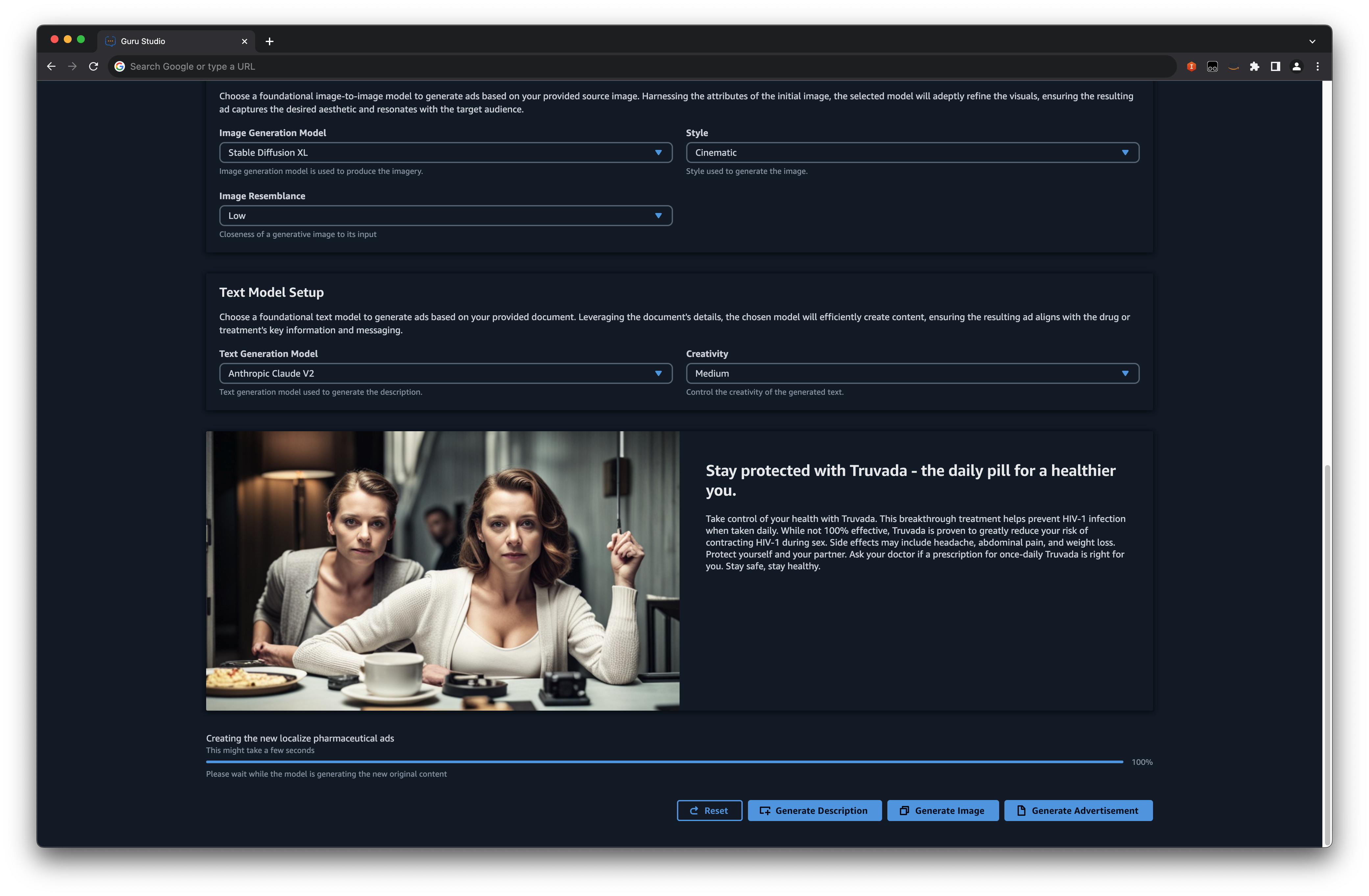

- Générateur de publicités pharmaceutiques Foundation Models – Une application spécialisée adaptée à l’industrie pharmaceutique. Exploitant les capacités génératives des modèles fondamentaux, cet outil crée des publicités pharmaceutiques convaincantes et conformes, garantissant que le contenu respecte les normes et réglementations de l'industrie.

Ces démos peuvent être déployées de manière transparente dans votre compte AWS, offrant des informations de base et des conseils sur l'utilisation des services AWS pour créer un robot de questions et réponses d'IA générative LLM de pointe et une génération de contenu.

Dans cet article, nous explorons comment RAG combiné à Amazon Kendra ou à des intégrations personnalisées peut surmonter ces défis et fournir des réponses affinées aux requêtes en langage naturel.

Vue d'ensemble de la solution

En adoptant cette solution, vous pouvez bénéficier des avantages suivants :

- Accès amélioré à l’information – RAG permet aux modèles d'extraire des informations provenant de vastes sources externes, ce qui peut être particulièrement utile lorsque les connaissances du modèle pré-entraîné sont obsolètes ou incomplètes.

- Évolutivité – Au lieu de former un modèle sur toutes les données disponibles, RAG permet aux modèles de récupérer des informations pertinentes à la volée. Cela signifie que lorsque de nouvelles données deviennent disponibles, elles peuvent être ajoutées à la base de données de récupération sans qu'il soit nécessaire de recycler l'intégralité du modèle.

- Efficacité mémoire – Les LLM nécessitent une mémoire importante pour stocker les paramètres. Avec RAG, le modèle peut être plus petit car il n'a pas besoin de mémoriser tous les détails ; il peut les récupérer en cas de besoin.

- Mise à jour dynamique des connaissances – Contrairement aux modèles conventionnels avec un point final de connaissances défini, la base de données externe de RAG peut subir des mises à jour régulières, accordant au modèle l'accès à des informations à jour. La fonction de récupération peut être affinée pour des tâches distinctes. Par exemple, une tâche de diagnostic médical peut extraire des données de revues médicales, garantissant ainsi que le modèle recueille des informations expertes et pertinentes.

- Atténuation des biais – La capacité de s’appuyer sur une base de données bien organisée offre la possibilité de minimiser les préjugés en garantissant des sources externes équilibrées et impartiales.

Avant de vous lancer dans l'intégration d'Amazon Kendra avec les LLM fondamentaux, il est crucial de vous équiper des outils et de la configuration système nécessaires. Avoir la bonne configuration en place est la première étape vers un déploiement transparent des démos.

Pré-requis

Vous devez avoir les prérequis suivants :

Bien qu'il soit possible de configurer et de déployer l'infrastructure détaillée dans ce didacticiel à partir de votre ordinateur local, AWSCloud9 offre une alternative pratique. Pré-équipé d'outils tels qu'AWS CLI, AWS CDK et Docker, AWS Cloud9 peut fonctionner comme votre poste de travail de déploiement. Pour utiliser ce service, il suffit mettre en place l'environnement via le Console AWS Cloud9.

Une fois les prérequis réglés, penchons-nous sur les fonctionnalités et capacités d'Amazon Kendra avec les LLM fondamentaux.

Amazon Kendra avec LLM fondamental

Amazon Kendra est un service de recherche d'entreprise avancé amélioré par l'apprentissage automatique (ML) qui offre des fonctionnalités de recherche sémantique prêtes à l'emploi. Grâce au traitement du langage naturel (NLP), Amazon Kendra comprend à la fois le contenu des documents et l'intention sous-jacente des requêtes des utilisateurs, le positionnant comme un outil de récupération de contenu pour les solutions basées sur RAG. En utilisant le contenu de recherche de haute précision de Kendra comme charge utile RAG, vous pouvez obtenir de meilleures réponses LLM. L'utilisation d'Amazon Kendra dans cette solution permet également une recherche personnalisée en filtrant les réponses en fonction des autorisations d'accès au contenu de l'utilisateur final.

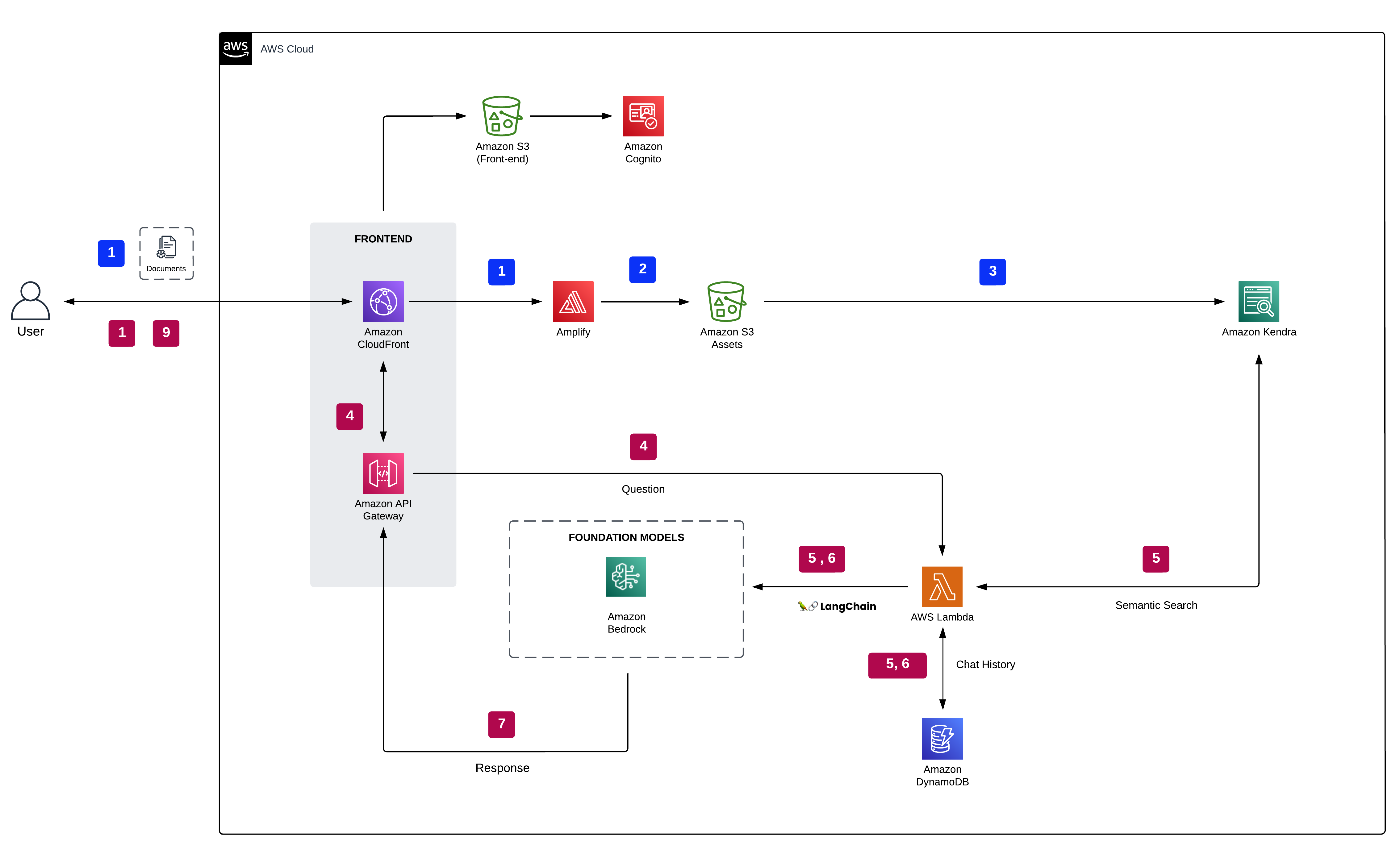

Le diagramme suivant montre l'architecture d'une application d'IA générative utilisant l'approche RAG.

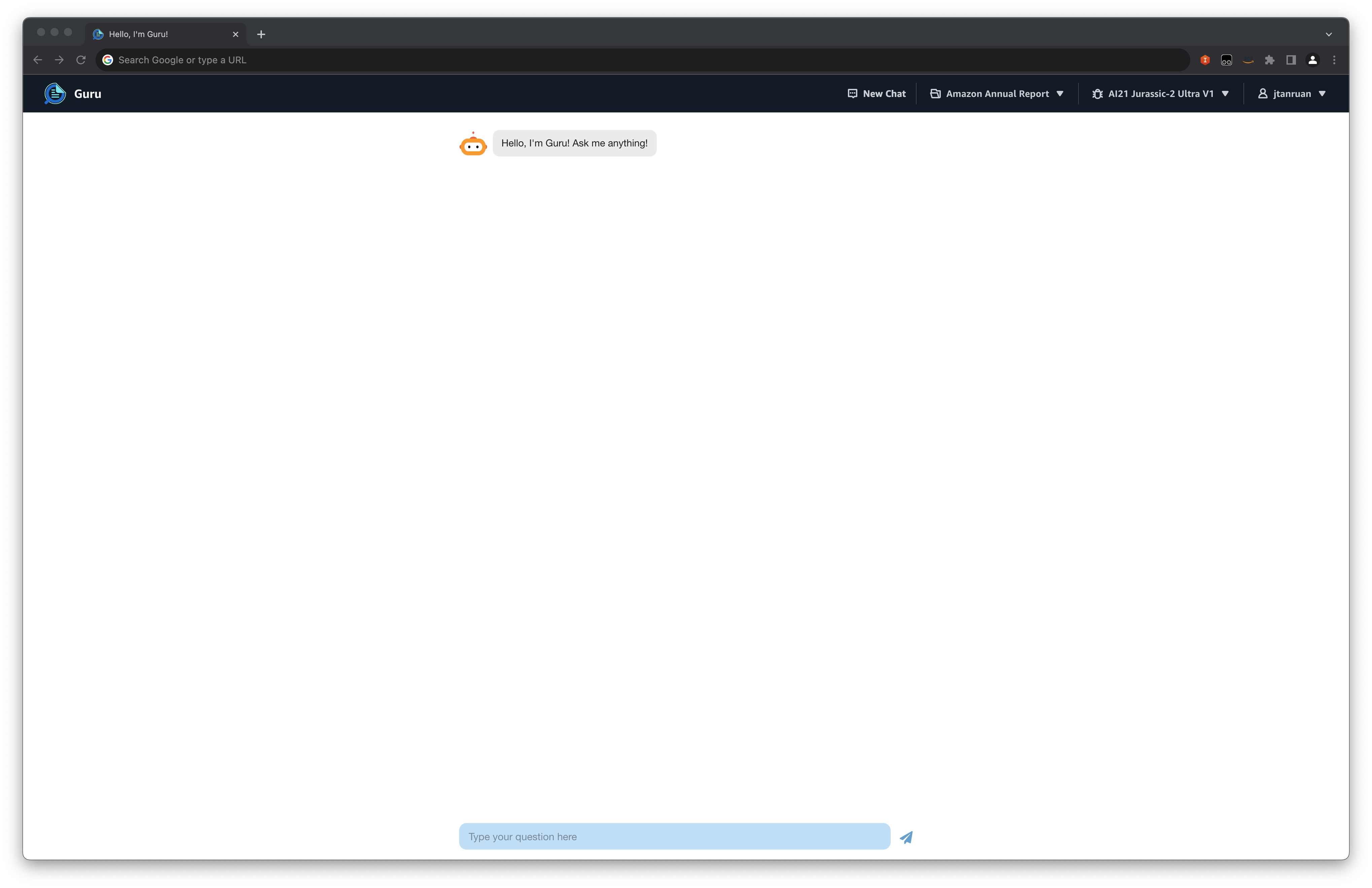

Les documents sont traités et indexés par Amazon Kendra via le Service de stockage simple Amazon (Amazon S3) connecteur. Les demandes des clients et les données contextuelles d'Amazon Kendra sont dirigées vers un Socle amazonien modèle de fondation. La démo vous permet de choisir entre les modèles Titan d'Amazon, Jurassic d'AI21 et Claude d'Anthropic pris en charge par Amazon Bedrock. L'historique des conversations est enregistré dans Amazon DynamoDB, offrant un contexte supplémentaire permettant au LLM de générer des réponses.

Nous avons fourni cette démo dans le GitHub repo. Reportez-vous aux instructions de déploiement dans le fichier Lisezmoi pour le déployer dans votre compte AWS.

Les étapes suivantes décrivent le processus lorsqu'un utilisateur interagit avec l'application d'IA générative :

- L'utilisateur se connecte à l'application web authentifié par Amazon Cognito.

- L'utilisateur télécharge un ou plusieurs documents dans Amazon S3.

- L'utilisateur exécute une tâche de synchronisation Amazon Kendra pour ingérer des documents S3 dans l'index Amazon Kendra.

- La question de l'utilisateur est acheminée via une API WebSocket sécurisée hébergée sur Passerelle d'API Amazon soutenu par un AWS Lambda la fonction.

- La fonction Lambda, renforcée par le LangChaîne framework, un outil polyvalent conçu pour créer des applications pilotées par des modèles de langage d'IA, se connecte au point de terminaison Amazon Bedrock pour reformuler la question de l'utilisateur en fonction de l'historique des discussions. Après reformulation, la question est transmise à Amazon Kendra à l'aide de l'API Retrieve. En réponse, l'index Amazon Kendra affiche les résultats de la recherche, fournissant des extraits de documents pertinents provenant des données ingérées par l'entreprise.

- La question de l'utilisateur ainsi que les données extraites de l'index sont envoyées comme contexte dans l'invite LLM. La réponse du LLM est stockée sous forme d'historique de discussion dans DynamoDB.

- Enfin, la réponse du LLM est renvoyée à l'utilisateur.

Flux de travail d'indexation de documents

Voici la procédure de traitement et d'indexation des documents :

- Les utilisateurs soumettent des documents via l'interface utilisateur (UI).

- Les documents sont transférés vers un compartiment S3 à l'aide du AWS Amplifier API.

- Amazon Kendra indexe les nouveaux documents dans le compartiment S3 via le connecteur Amazon Kendra S3.

Avantages

La liste suivante met en évidence les avantages de cette solution :

- Récupération au niveau de l'entreprise – Amazon Kendra est conçu pour la recherche d'entreprise, ce qui le rend adapté aux organisations disposant de grandes quantités de données structurées et non structurées.

- Compréhension sémantique – Les capacités ML d'Amazon Kendra garantissent que la récupération est basée sur une compréhension sémantique approfondie et pas seulement sur des correspondances de mots clés.

- Évolutivité – Amazon Kendra peut gérer des sources de données à grande échelle et fournit des résultats de recherche rapides et pertinents.

- Flexibilité – Le modèle fondamental peut générer des réponses basées sur un large éventail de contextes, garantissant ainsi la polyvalence du système.

- Capacités d'intégration – Amazon Kendra peut être intégré à divers services et sources de données AWS, ce qui le rend adaptable aux différents besoins organisationnels.

Modèle d'intégration avec LLM fondamental

An enrobage est un vecteur numérique qui représente l'essence même de divers types de données, notamment le texte, les images, l'audio et les documents. Cette représentation capture non seulement la signification intrinsèque des données, mais l'adapte également à un large éventail d'applications pratiques. Les modèles d'intégration, une branche du ML, transforment des données complexes, telles que des mots ou des phrases, en espaces vectoriels continus. Ces vecteurs saisissent intrinsèquement les connexions sémantiques entre les données, permettant des comparaisons plus approfondies et plus perspicaces.

RAG combine de manière transparente les atouts des modèles fondamentaux, tels que les transformateurs, avec la précision des intégrations pour passer au crible de vastes bases de données à la recherche d'informations pertinentes. Dès réception d'une requête, le système utilise des intégrations pour identifier et extraire les sections pertinentes d'un vaste ensemble de données. Le modèle fondateur formule ensuite une réponse contextuellement précise basée sur ces informations extraites. Cette synergie parfaite entre la récupération des données et la génération de réponses permet au système de fournir des réponses approfondies, en s'appuyant sur les vastes connaissances stockées dans de vastes bases de données.

Dans la présentation architecturale, en fonction de leur sélection d'interface utilisateur, les utilisateurs sont guidés soit vers Amazon Bedrock, soit vers Amazon Bedrock. Amazon SageMaker JumpStart modèles de fondation. Les documents subissent un traitement et des intégrations vectorielles sont produites par le modèle d'intégration. Ces intégrations sont ensuite indexées à l'aide de FAISS pour permettre une recherche sémantique efficace. Les historiques de conversation sont conservés dans DynamoDB, enrichissant le contexte permettant au LLM d'élaborer des réponses.

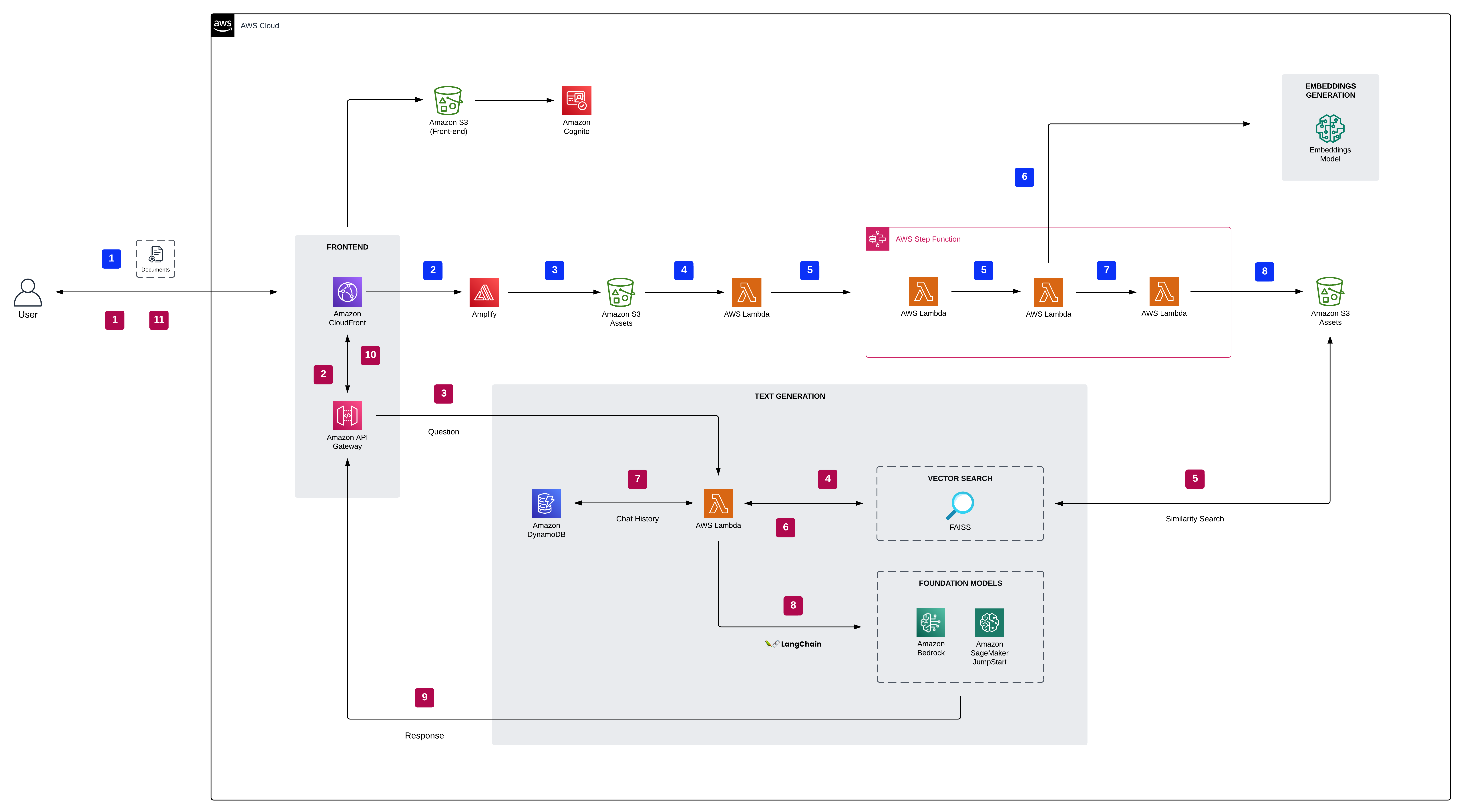

Le diagramme suivant illustre l'architecture et le flux de travail de la solution.

Nous avons fourni cette démo dans le GitHub repo. Reportez-vous aux instructions de déploiement dans le fichier Lisezmoi pour le déployer dans votre compte AWS.

Modèle d'intégration

Les responsabilités du modèle d'intégration sont les suivantes :

- Ce modèle est responsable de la conversion du texte (comme des documents ou des passages) en représentations vectorielles denses, communément appelées intégrations.

- Ces intégrations capturent la signification sémantique du texte, permettant des comparaisons efficaces et sémantiquement significatives entre différents morceaux de texte.

- Le modèle d'intégration peut être formé sur le même vaste corpus que le modèle fondateur ou peut être spécialisé pour des domaines spécifiques.

Flux de travail de questions et réponses

Les étapes suivantes décrivent le flux de travail de la réponse aux questions sur les documents :

- L'utilisateur se connecte à l'application Web authentifiée par Amazon Cognito.

- L'utilisateur télécharge un ou plusieurs documents sur Amazon S3.

- Lors du transfert de document, une notification d'événement S3 déclenche une fonction Lambda, qui appelle ensuite le point de terminaison du modèle d'intégration SageMaker pour générer des intégrations pour le nouveau document. Le modèle d'intégration convertit la question en une représentation vectorielle dense (intégration). Le fichier vectoriel résultant est stocké en toute sécurité dans le compartiment S3.

- Le récupérateur FAISS compare cette question d'intégration avec les intégrations de tous les documents ou passages de la base de données pour trouver les passages les plus pertinents.

- Les passages, ainsi que la question de l'utilisateur, sont fournis comme contexte au modèle fondateur. La fonction Lambda utilise la bibliothèque LangChain et se connecte au point de terminaison Amazon Bedrock ou SageMaker JumpStart avec une requête contextuelle.

- La réponse du LLM est stockée dans DynamoDB avec la requête de l'utilisateur, l'horodatage, un identifiant unique et d'autres identifiants arbitraires pour l'élément tel que la catégorie de question. Le stockage de la question et de la réponse sous forme d'éléments discrets permet à la fonction Lambda de recréer facilement l'historique des conversations d'un utilisateur en fonction de l'heure à laquelle les questions ont été posées.

- Enfin, la réponse est renvoyée à l'utilisateur via une requête HTTP via la réponse d'intégration de l'API API Gateway WebSocket.

Avantages

La liste suivante décrit les avantages de cette solution :

- Compréhension sémantique – Le modèle d'intégration garantit que le récupérateur sélectionne les passages sur la base d'une compréhension sémantique approfondie, et pas seulement des correspondances de mots clés.

- Évolutivité – Les intégrations permettent des comparaisons de similarité efficaces, ce qui permet de rechercher rapidement dans de vastes bases de données de documents.

- Flexibilité – Le modèle fondamental peut générer des réponses basées sur un large éventail de contextes, garantissant ainsi la polyvalence du système.

- Adaptabilité du domaine – Le modèle d'intégration peut être entraîné ou affiné pour des domaines spécifiques, permettant au système d'être adapté à diverses applications.

Générateur de publicités pharmaceutiques Foundation Models

Dans le secteur pharmaceutique actuel, en évolution rapide, une publicité efficace et localisée est plus cruciale que jamais. C’est là qu’une solution innovante entre en jeu, utilisant la puissance de l’IA générative pour créer des publicités pharmaceutiques localisées à partir d’images sources et de PDF. Au-delà de la simple accélération du processus de génération d'annonces, cette approche rationalise le processus d'examen médical et juridique (MLR). MLR est un mécanisme d'examen rigoureux dans lequel les équipes médicales, juridiques et réglementaires évaluent méticuleusement le matériel promotionnel pour garantir son exactitude, son soutien scientifique et sa conformité réglementaire. Les méthodes traditionnelles de création de contenu peuvent être lourdes, nécessitant souvent des ajustements manuels et des examens approfondis pour garantir l'alignement avec la conformité et la pertinence régionales. Cependant, avec l’avènement de l’IA générative, nous pouvons désormais automatiser la création de publicités qui trouvent réellement un écho auprès du public local, tout en respectant des normes et directives strictes.

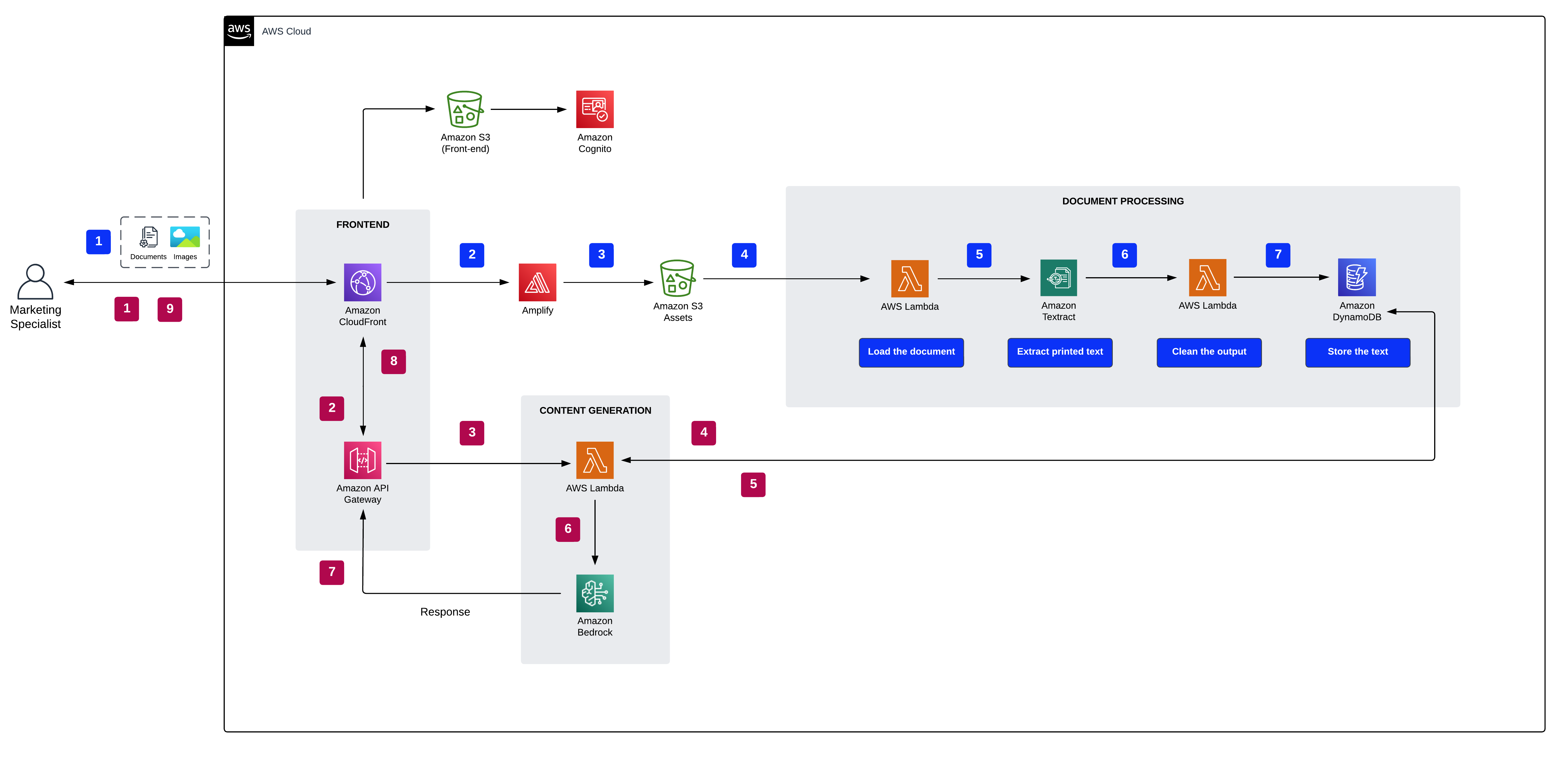

Le diagramme suivant illustre l'architecture de la solution.

Dans la présentation architecturale, en fonction du modèle sélectionné et des préférences publicitaires, les utilisateurs sont guidés de manière transparente vers les modèles de fondation Amazon Bedrock. Cette approche rationalisée garantit que les nouvelles annonces sont générées précisément en fonction de la configuration souhaitée. Dans le cadre du processus, les documents sont traités efficacement par Extrait d'Amazon, avec le texte résultant stocké en toute sécurité dans DynamoDB. Une fonctionnalité remarquable est la conception modulaire pour la génération d’images et de texte, vous offrant la flexibilité de régénérer indépendamment n’importe quel composant selon vos besoins.

Nous avons fourni cette démo dans le GitHub repo. Reportez-vous aux instructions de déploiement dans le fichier Lisezmoi pour le déployer dans votre compte AWS.

Flux de travail de génération de contenu

Les étapes suivantes décrivent le processus de génération de contenu :

- L'utilisateur choisit son document, son image source, son emplacement publicitaire, sa langue et son style d'image.

- L'accès sécurisé à l'application Web est assuré grâce à l'authentification Amazon Cognito.

- Le front-end de l'application Web est hébergé via Amplify.

- Une API WebSocket, gérée par API Gateway, facilite les requêtes des utilisateurs. Ces demandes sont authentifiées via Gestion des identités et des accès AWS (JE SUIS).

- L'intégration avec Amazon Bedrock comprend les étapes suivantes :

- Une fonction Lambda utilise la bibliothèque LangChain pour se connecter au point de terminaison Amazon Bedrock à l'aide d'une requête riche en contexte.

- Le modèle fondamental de texte à texte crée une annonce contextuellement appropriée en fonction du contexte et des paramètres donnés.

- Le modèle fondamental de conversion texte-image crée une image sur mesure, influencée par l'image source, le style choisi et l'emplacement.

- L'utilisateur reçoit la réponse via une requête HTTPS via l'API API Gateway WebSocket intégrée.

Flux de travail de traitement de documents et d'images

Voici la procédure de traitement des documents et des images :

- L'utilisateur télécharge des actifs via l'interface utilisateur spécifiée.

- L'API Amplify transfère les documents vers un compartiment S3.

- Une fois l'actif transféré vers Amazon S3, l'une des actions suivantes a lieu :

- S'il s'agit d'un document, une fonction Lambda utilise Amazon Textract pour traiter et extraire le texte en vue de la génération d'annonces.

- S'il s'agit d'une image, la fonction Lambda la convertit au format base64, adapté au modèle Stable Diffusion pour créer une nouvelle image à partir de la source.

- Le texte extrait ou la chaîne d'image base64 est enregistré en toute sécurité dans DynamoDB.

Avantages

La liste suivante décrit les avantages de cette solution :

- Efficacité – L'utilisation de l'IA générative accélère considérablement le processus de génération d'annonces, éliminant le besoin d'ajustements manuels.

- Respect de la conformité – La solution garantit que les publicités générées respectent les directives et réglementations spécifiques, telles que les directives de marketing de la FDA.

- Rentable – En automatisant la création d'annonces personnalisées, les entreprises peuvent réduire considérablement les coûts associés à la production et à la révision des annonces.

- Processus MLR rationalisé – La solution simplifie le processus MLR, réduisant les points de friction et garantissant des révisions plus fluides.

- Résonance localisée – L'IA générative produit des publicités qui trouvent un écho auprès du public local, garantissant ainsi leur pertinence et leur impact dans différentes régions.

- Standardisation – La solution maintient les normes et directives nécessaires, garantissant la cohérence de toutes les annonces générées.

- Évolutivité – L’approche basée sur l’IA peut gérer de vastes bases de données d’images sources et de PDF, ce qui rend possible la génération d’annonces à grande échelle.

- Intervention manuelle réduite – L’automatisation réduit le besoin d’intervention humaine, minimisant les erreurs et garantissant la cohérence.

Vous pouvez déployer l'infrastructure de ce didacticiel à partir de votre ordinateur local ou utiliser AWS Cloud9 comme poste de travail de déploiement. AWS Cloud9 est préchargé avec AWS CLI, AWS CDK et Docker. Si vous optez pour AWS Cloud9, créer l'environnement du Console AWS Cloud9.

Nettoyer

Pour éviter des coûts inutiles, nettoyez toute l'infrastructure créée via la console AWS CloudFormation ou en exécutant la commande suivante sur votre poste de travail :

De plus, n'oubliez pas d'arrêter tous les points de terminaison SageMaker que vous avez lancés via la console SageMaker. N'oubliez pas que la suppression d'un index Amazon Kendra ne supprime pas les documents originaux de votre stockage.

Conclusion

L'IA générative, incarnée par les LLM, annonce un changement de paradigme dans la façon dont nous accédons et générons l'information. Ces modèles, bien que puissants, sont souvent limités par les limites de leurs données d'entraînement. RAG relève ce défi en veillant à ce que les vastes connaissances contenues dans ces modèles soient systématiquement enrichies d'informations pertinentes et actuelles.

Nos démos basées sur RAG en fournissent un témoignage tangible. Ils mettent en valeur la synergie transparente entre Amazon Kendra, les intégrations vectorielles et les LLM, créant un système dans lequel les informations sont non seulement vastes, mais également précises et opportunes. En plongeant dans ces démos, vous explorerez par vous-même le potentiel de transformation de la fusion de connaissances pré-entraînées avec les capacités dynamiques de RAG, ce qui aboutira à des résultats à la fois fiables et adaptés au contenu de l'entreprise.

Bien que l’IA générative optimisée par les LLM ouvre une nouvelle façon d’obtenir des informations, ces informations doivent être fiables et limitées au contenu de l’entreprise utilisant l’approche RAG. Ces démos basées sur RAG vous permettent de disposer d'informations précises et à jour. La qualité de ces informations dépend de la pertinence sémantique, qui est rendue possible par l'utilisation d'Amazon Kendra et des intégrations vectorielles.

Si vous êtes prêt à explorer davantage et à exploiter la puissance de l’IA générative, voici vos prochaines étapes :

- Participez à nos démos – L’expérience pratique est inestimable. Explorez les fonctionnalités, comprenez les intégrations et familiarisez-vous avec l'interface.

- Approfondissez vos connaissances – Profitez des ressources disponibles. AWS propose une documentation approfondie, des didacticiels et une assistance communautaire pour vous aider dans votre parcours vers l'IA.

- Lancer un projet pilote – Envisagez de commencer par une mise en œuvre à petite échelle de l’IA générative dans votre entreprise. Cela fournira un aperçu de la praticité et de l’adaptabilité du système dans votre contexte spécifique.

Pour plus d'informations sur les applications d'IA générative sur AWS, reportez-vous à ce qui suit :

N'oubliez pas que le paysage de l'IA est en constante évolution. Restez à jour, restez curieux et soyez toujours prêt à vous adapter et à innover.

À propos des auteurs

Jin Tan Ruan est développeur de prototypage au sein de l'équipe AWS Industries Prototyping and Customer Engineering (PACE), spécialisé dans le NLP et l'IA générative. Avec une expérience en développement de logiciels et neuf certifications AWS, Jin apporte une riche expérience pour aider les clients AWS à matérialiser leurs visions d'IA/ML et d'IA générative à l'aide de la plateforme AWS. Il est titulaire d'une maîtrise en informatique et en génie logiciel de l'Université de Syracuse. En dehors du travail, Jin aime jouer à des jeux vidéo et se plonger dans le monde passionnant des films d’horreur.

Jin Tan Ruan est développeur de prototypage au sein de l'équipe AWS Industries Prototyping and Customer Engineering (PACE), spécialisé dans le NLP et l'IA générative. Avec une expérience en développement de logiciels et neuf certifications AWS, Jin apporte une riche expérience pour aider les clients AWS à matérialiser leurs visions d'IA/ML et d'IA générative à l'aide de la plateforme AWS. Il est titulaire d'une maîtrise en informatique et en génie logiciel de l'Université de Syracuse. En dehors du travail, Jin aime jouer à des jeux vidéo et se plonger dans le monde passionnant des films d’horreur.

Aravind Kodandaramaiah est un créateur de solutions full stack senior de prototypage au sein de l'équipe AWS Industries Prototyping and Customer Engineering (PACE). Il s'efforce d'aider les clients AWS à transformer des idées innovantes en solutions avec des résultats mesurables et agréables. Il est passionné par une gamme de sujets, notamment la sécurité du cloud, le DevOps et l'IA/ML, et on le trouve généralement en train de bricoler ces technologies.

Aravind Kodandaramaiah est un créateur de solutions full stack senior de prototypage au sein de l'équipe AWS Industries Prototyping and Customer Engineering (PACE). Il s'efforce d'aider les clients AWS à transformer des idées innovantes en solutions avec des résultats mesurables et agréables. Il est passionné par une gamme de sujets, notamment la sécurité du cloud, le DevOps et l'IA/ML, et on le trouve généralement en train de bricoler ces technologies.

Arjun Shakdher est un développeur de l'équipe AWS Industries Prototyping (PACE) passionné par l'intégration de la technologie dans le tissu de la vie. Titulaire d'une maîtrise de l'Université Purdue, le rôle actuel d'Arjun tourne autour de l'architecture et de la construction de prototypes de pointe qui couvrent un large éventail de domaines, mettant actuellement en évidence les domaines de l'IA/ML et de l'IoT. Lorsqu'il n'est pas immergé dans le code et les paysages numériques, vous verrez Arjun s'adonner au monde du café, explorer la mécanique complexe de l'horlogerie ou se délecter du talent artistique des automobiles.

Arjun Shakdher est un développeur de l'équipe AWS Industries Prototyping (PACE) passionné par l'intégration de la technologie dans le tissu de la vie. Titulaire d'une maîtrise de l'Université Purdue, le rôle actuel d'Arjun tourne autour de l'architecture et de la construction de prototypes de pointe qui couvrent un large éventail de domaines, mettant actuellement en évidence les domaines de l'IA/ML et de l'IoT. Lorsqu'il n'est pas immergé dans le code et les paysages numériques, vous verrez Arjun s'adonner au monde du café, explorer la mécanique complexe de l'horlogerie ou se délecter du talent artistique des automobiles.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :est

- :ne pas

- :où

- $UP

- 100

- 150

- 7

- a

- capacité

- A Propos

- accélère

- accès

- Selon

- Compte

- précision

- Avec cette connaissance vient le pouvoir de prendre

- à travers

- actes

- Ad

- adapter

- s'adapte

- ajoutée

- adresses

- adhérer

- ajustements

- L'adoption d'

- annonces

- Avancée

- Avantage

- avantages

- avènement

- Numérique

- Après

- AI

- AI / ML

- Aide

- alignement

- Tous

- permettre

- Permettre

- permet

- presque

- le long de

- aussi

- alternative

- toujours

- Amazon

- Amazon Cognito

- Amazone Kendra

- Extrait d'Amazon

- Amazon Web Services

- quantités

- amplifier

- an

- ainsi que

- répondre

- réponses

- tous

- api

- appli

- Application

- applications

- une approche

- approprié

- architectural

- architecture

- SONT

- autour

- tableau

- talent artistique

- AS

- atout

- Outils

- aider

- associé

- public

- acoustique

- authentifié

- Authentification

- automatiser

- automatiser

- Automation

- disponibles

- éviter

- en évitant

- AWS

- AWSCloud9

- AWS CloudFormation

- RETOUR

- soutenu

- fond

- support

- base

- basé

- BE

- car

- devenez

- devient

- avantages.

- Améliorée

- jusqu'à XNUMX fois

- Au-delà

- biais

- mélange

- corps

- Bot

- tous les deux

- Branche

- Apportez le

- vaste

- constructeur

- Développement

- mais

- by

- Appels

- CAN

- Peut obtenir

- capacités

- capturer

- captures

- maisons

- Catégories

- certifications

- challenge

- globaux

- Selectionnez

- choisi

- espace extérieur plus propre,

- le cloud

- Cloud Security

- Cloud9

- code

- Café

- combiné

- moissonneuses-batteuses

- vient

- communément

- Communautés

- Sociétés

- comparaisons

- complexe

- conformité

- composant

- comprend

- ordinateur

- Informatique

- configuration

- NOUS CONTACTER

- Connexions

- connecte

- Considérer

- régulièrement

- Console

- constamment

- contenu

- Génération de contenu

- création de contenu

- contexte

- contextes

- contextuel

- a continué

- continu

- Pratique

- conventionnel

- Conversation

- conversion

- Core

- Prix

- Costs

- élaborer

- engendrent

- créée

- crée des

- La création

- création

- crucial

- lourd

- curieux

- Courant

- Customiser

- des clients

- Clients

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- données

- Base de données

- bases de données

- ensembles de données

- Date

- profond

- profond

- Degré

- délicieux

- demo

- Démos

- dépendant

- déployer

- déployé

- déployer

- déploiement

- décrire

- Conception

- un

- voulu

- détruire

- détaillé

- détails

- Développeur

- Développement

- diagnostique

- différent

- La diffusion

- numérique

- dirigé

- affiche

- distinct

- plongeon

- plusieurs

- plongée

- Docker

- document

- Documentation

- INSTITUTIONNELS

- Ne fait pas

- domaines

- dessiner

- dessin

- entraîné

- Dynamic

- même

- efficace

- efficace

- efficacement

- non plus

- l'élimination

- enrobage

- émerger

- emploie

- empowered

- responsabilise

- permettre

- activé

- permet

- permettant

- fin

- Endpoint

- ENGINEERING

- améliorée

- enrichissant

- assurer

- assuré

- Assure

- assurer

- Entreprise

- Tout

- équipé

- Erreurs

- notamment

- essence

- évaluer

- événement

- JAMAIS

- évolue

- évolution

- exemple

- excité

- expansif

- d'experience

- expert

- de santé

- explorez

- Explorer

- les

- externe

- extrait

- .

- facilite

- se familiariser

- rapide

- FB

- réalisable

- Fonctionnalité

- Fonctionnalités:

- Doté d'

- Déposez votre dernière attestation

- filtration

- Trouvez

- Prénom

- Flexibilité

- se concentre

- Abonnement

- suit

- Pour

- le format

- trouvé

- Fondation

- frottement

- De

- avant

- L'extrémité avant

- plein

- Un paquet entier

- fonction

- fonctionnalités

- plus

- En outre

- Gain

- gagner

- Games

- porte

- générer

- généré

- génération

- génératif

- IA générative

- générateur

- obtenez

- donné

- Don

- octroi

- saisir

- Pousse

- guarantir

- l'orientation

- guidé

- lignes directrices

- manipuler

- hands-on

- harnais

- Exploiter

- Vous avez

- ayant

- he

- aider

- hérauts

- ici

- Faits saillants

- lui-même

- des histoires

- Histoire

- tenue

- détient

- horreur

- organisé

- Comment

- Cependant

- HTML

- http

- HTTPS

- humain

- et idées cadeaux

- identifiant

- Identificateurs

- identifier

- Identite

- if

- illustre

- image

- satellite

- immergé

- Impact

- la mise en oeuvre

- in

- en profondeur

- inexacte

- inclut

- Y compris

- intégrer

- indépendamment

- indice

- indexé

- index

- secteurs

- industrie

- normes de l'industrie

- influencé

- d'information

- Actualités

- Infrastructure

- intrinsèquement

- initiale

- initié

- innovons

- technologie innovante

- perspicace

- idées.

- plutôt ;

- Des instructions

- des services

- Intègre

- l'intégration

- intégrations

- intention

- interagit

- Interfaces

- intervention

- développement

- intrinsèque

- inestimable

- IOT

- IT

- articles

- SES

- Emploi

- chemin

- jpg

- juste

- spécialisées

- connu

- paysage d'été

- langue

- gros

- grande échelle

- Disposition

- apprentissage

- Légal

- Allons-y

- Bibliothèque

- Autorisé

- VIE

- comme

- probabilité

- limité

- limites

- Liste

- LLM

- locales

- emplacement

- click

- machine learning

- maintient

- Fabrication

- gérés

- Manuel

- de nombreuses

- Stratégie

- massif

- maîtrise

- allumettes

- matières premières.

- sens

- significative

- significations

- veux dire

- mécanique

- mécanisme

- médical

- Mémoire

- seulement

- fusionne

- fusion

- méthodes

- méticuleusement

- réduisant au minimum

- atténuation

- ML

- modèle

- modélisation statistique

- numériques jumeaux (digital twin models)

- application

- PLUS

- (en fait, presque toutes)

- Films

- must

- Nature

- Traitement du langage naturel

- nécessaire

- Besoin

- nécessaire

- besoin

- Besoins

- Nouveauté

- next

- neuf

- nlp

- déclaration

- maintenant

- of

- offrant

- Offres Speciales

- souvent

- on

- ONE

- uniquement

- ouvre

- or

- organisationnel

- organisations

- original

- Autre

- nos

- ande

- les résultats

- contour

- sorties

- au contrôle

- plus de

- Overcome

- Rythme

- paradigme

- paramètres

- partie

- passionné

- parfaite

- autorisations

- Personnalisé

- Pharmacie

- Pharmaceutique

- les expressions clés

- pièces

- pilote

- projet pilote

- Place

- placement

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Jouez

- jouer

- des notes bonus

- positionnement

- possible

- Post

- défaillances

- power

- alimenté

- solide

- Méthode

- précis

- précisément

- La précision

- préférences

- conditions préalables

- actuellement

- procédure

- processus

- Traité

- traitement

- Produit

- produit

- Vidéo

- Projet

- promotionnel

- prototypes

- prototypage

- Prouver

- fournir

- à condition de

- fournit

- aportando

- qualité

- requêtes

- question

- fréquemment posées

- Rapide

- vite.

- gamme

- solutions

- royaumes

- reçoit

- recevoir

- Recommandation

- réduire

- réduit

- réduire

- reportez-vous

- raffiné

- régional

- régions

- Standard

- règlements

- régulateurs

- Conformité réglementaire

- pertinence

- pertinent

- s'appuyer

- rester

- reste

- rappeler

- supprimez

- reformuler

- représentation

- représente

- nécessaire

- demandes

- exigent

- conditions

- Exigences

- Résonner

- Resources

- réponse

- réponses

- responsabilités

- responsables

- résultant

- résultant

- Résultats

- Avis

- Avis

- révisions

- tourne

- bon

- rigoureux

- Rôle

- pour le running

- fonctionne

- sagemaker

- même

- sauvé

- Sciences

- sur une base scientifique

- fluide

- de façon transparente

- Rechercher

- les sections

- sécurisé

- en toute sécurité

- sécurité

- choisi

- sélection

- supérieur

- envoyé

- service

- Services

- set

- Paramétres

- installation

- décalage

- vitrine

- Spectacles

- Tamiser

- significative

- de façon significative

- étapes

- simplement

- faibles

- plus lisse

- Logiciels

- développement de logiciels

- génie logiciel

- uniquement

- sur mesure

- Solutions

- Identifier

- source

- Sources

- Approvisionnement

- espaces

- envergure

- spécialisé

- spécialisation

- groupe de neurones

- spécifié

- stable

- empiler

- Normes

- Commencez

- state-of-the-art

- rester

- étapes

- Étapes

- Arrêter

- storage

- Boutique

- stockée

- stockage

- rationalisé

- forces

- Chaîne

- strict

- structuré

- Catégorie

- soumettre

- tel

- convient

- Support

- Appareils

- synergie

- combustion propre

- Prenez

- prend

- tangible

- Tâche

- tâches

- équipe

- équipes

- technique

- Les technologies

- Technologie

- testament

- texte

- que

- qui

- La

- Le paysage

- La Source

- le monde

- leur

- Les

- puis

- ainsi

- Ces

- l'ont

- this

- trois

- palpitant

- Avec

- fiable

- opportun

- horodatage

- Titan

- à

- aujourd'hui

- outil

- les outils

- sujet

- Les sujets

- vers

- traditionnel

- Train

- qualifié

- Formation

- transférer

- transféré

- transferts

- Transformer

- transformationnel

- transformateurs

- Trends

- vraiment

- digne de confiance

- TOUR

- tutoriel

- tutoriels

- types

- ui

- subir

- sous-jacent

- comprendre

- compréhension

- expérience unique et authentique

- université

- contrairement à

- inutile

- dévoiler

- mise à jour

- Mises à jour

- a actualisé

- Actualités

- maintien

- sur

- utilisé

- cas d'utilisation

- Utilisateur

- Interface utilisateur

- utilisateurs

- Usages

- en utilisant

- d'habitude

- utilise

- Utilisant

- divers

- Vaste

- polyvalente

- via

- Vidéo

- jeux vidéo

- visions

- Façon..

- we

- Richesse

- web

- application Web

- services Web

- Websocket

- ont été

- quand

- qui

- tout en

- WHO

- large

- Large gamme

- sera

- comprenant

- dans les

- sans

- des mots

- activités principales

- workflow

- poste de travail

- world

- Vous n'avez

- Votre

- vous-même

- zéphyrnet