Aujourd'hui, les clients peuvent générer des tickets d'assistance via plusieurs canaux tels que le Web, le mobile, les chat-bots, les e-mails ou les appels téléphoniques. Lorsqu'un ticket d'assistance est généré par un client, il est traité et affecté à une catégorie en fonction des informations fournies dans le ticket. Il est ensuite acheminé vers le groupe d'assistance pour résolution en fonction de la catégorie du ticket. On estime qu'un grand nombre de tickets d'assistance ne sont généralement pas acheminés vers le bon groupe en raison d'une catégorisation incorrecte des tickets. Des tickets mal attribués entraînent un retard dans le temps de résolution global, entraînant souvent une grave insatisfaction des clients. Cela peut également avoir d'autres impacts étendus tels que des répercussions financières, opérationnelles ou d'autres répercussions commerciales. Par conséquent, la classification des tickets est une tâche essentielle pour chaque organisation de nos jours. Bien que vous puissiez classer les tickets manuellement, cela est sujet aux erreurs, n'est pas rentable et n'évolue pas.

Services gérés AWS (AMS) utilise Amazon comprendre des classifications personnalisées pour classer les demandes entrantes par type de ressource et d'opération en fonction de la manière dont le client a décrit son problème. Amazon Comprehend est un service de traitement du langage naturel (NLP) qui utilise l'apprentissage automatique (ML) pour découvrir des informations et des connexions précieuses dans le texte. AMS utilise des classificateurs personnalisés pour étiqueter les demandes des clients avec les types de problème, le type de ressource et l'action de ressource appropriés, acheminant ainsi les tickets des clients vers les PME. La classification Amazon Comprehend est utilisée pour trouver des opportunités de nouveaux outils d'automatisation internes que les ingénieurs AMS peuvent utiliser pour répondre aux exigences des clients afin de réduire les efforts manuels et les risques d'erreurs manuelles. Les données de classification sont stockées dans un Redshift d'Amazon cluster et utilisé pour analyser les demandes des clients et trouver de nouveaux candidats à l'outil d'automatisation. Cette automatisation se traduit par une efficacité opérationnelle accrue et des coûts réduits.

Dans cet article, nous montrons comment les fournisseurs de services gérés peuvent utiliser Amazon Comprehend pour classer et acheminer les tickets, fournir des suggestions basées sur la classification et utiliser les données de classification.

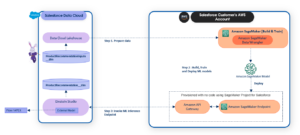

Vue d'ensemble de la solution

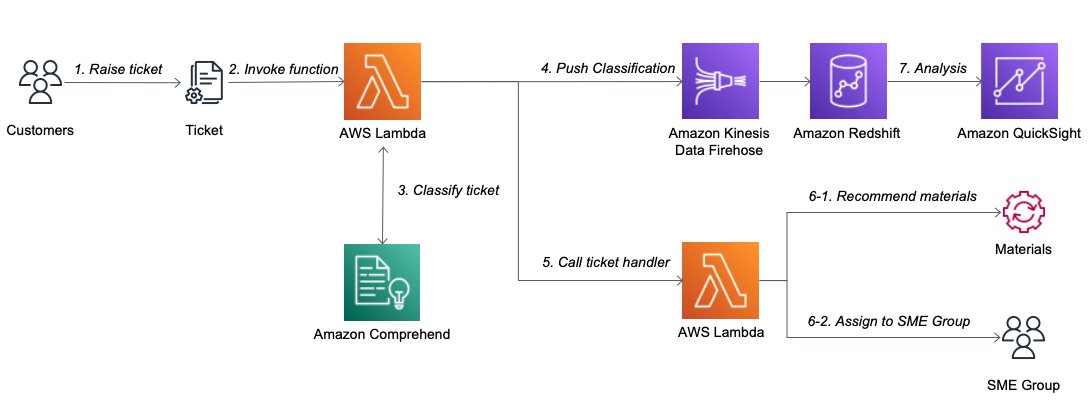

Le diagramme suivant montre l'architecture de la solution.

Le flux de travail est le suivant :

- Un client soumet le ticket.

- Le système de tickets reçoit le ticket du client et appelle le classificateur de tickets AWS Lambda fonction avec les détails du billet. Lambda est un service de calcul sans serveur et piloté par les événements qui vous permet d'exécuter du code pour pratiquement n'importe quel type d'application ou de service backend sans provisionner ni gérer de serveurs. Lambda est choisi comme solution pour réduire les coûts et les efforts de maintenance.

- La fonction Lambda de classificateur de tickets classe le ticket avec Amazon Comprehend à l'aide du titre et de la description du ticket. Avec Amazon Comprehend, vous pouvez former le modèle NLP et fournir des classificateurs par lots et en temps réel sans provisionner ni maintenir l'infrastructure.

- La fonction Lambda de classificateur de tickets transmet les données de classification des tickets au cluster Amazon Redshift via Firehose de données Amazon Kinesis. Kinesis Data Firehose est un service d'extraction, de transformation et de chargement (ETL) qui capture, transforme et fournit des données en continu aux lacs de données, aux magasins de données et aux services d'analyse. Amazon Redshift utilise SQL pour analyser les données structurées et semi-structurées dans les entrepôts de données, les bases de données opérationnelles et les lacs de données, en utilisant le matériel conçu par AWS et le ML pour offrir les meilleures performances de prix à n'importe quelle échelle. Kinesis Data Firehose fournit des données à un Service de stockage simple Amazon (Amazon S3) d'abord, puis émet une commande Amazon Redshift COPY pour charger les données dans un cluster Amazon Redshift.

- La fonction Lambda du classificateur de tickets appelle la fonction Lambda du gestionnaire de tickets.

- La fonction Lambda du gestionnaire de tickets exécute du code pour faciliter la gestion des tickets. Dans cet exemple, il renvoie les matériaux recommandés pour le traitement du ticket en fonction de la classification.

- L'analyse des tickets peut être effectuée avec Amazon QuickSight. À partir de l'analyse des tickets, vous pouvez découvrir le type de ticket le plus demandé. Sur la base de l'analyse, vous pouvez découvrir les tendances des tickets et les opportunités d'automatisation des principaux types de tickets. QuickSight est un service de Business Intelligence (BI) à l'échelle du cloud que vous pouvez utiliser pour fournir des informations faciles à comprendre aux personnes avec lesquelles vous travaillez, où qu'elles se trouvent.

Dans les sections suivantes, nous vous expliquons les étapes de mise en œuvre de la solution, d'intégration de l'infrastructure de classification des tickets à votre système de billetterie et d'utilisation des données de classification avec QuickSight.

Mettre en œuvre la solution

Dans cette section, nous passons en revue les étapes pour provisionner les ressources de votre solution et créer l'infrastructure nécessaire.

Configurer Amazon Comprehend

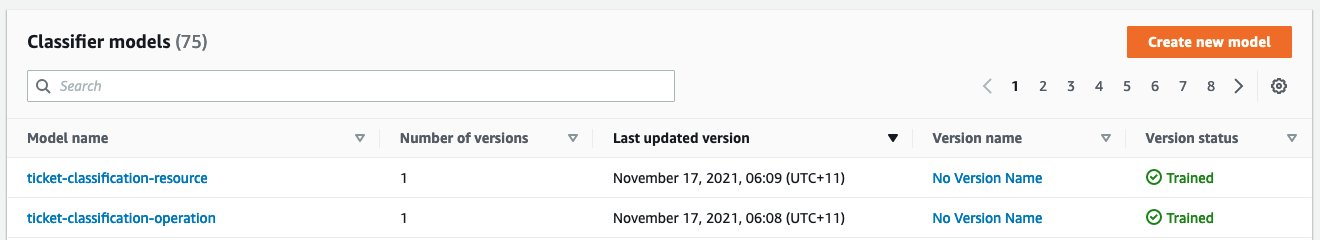

Au cours de cette étape, nous formons deux nouveaux modèles de classification personnalisés Amazon Comprehend : Opération et Ressource, et créons un point de terminaison d'analyse en temps réel pour chaque modèle.

Télécharger les données d'entraînement

Pour importer les données d'entraînement, procédez comme suit :

- Télécharger ticket_training_data.zip et décompressez le fichier.

Ce dossier contient les deux fichiers suivants :- training_data_operations.csv – Ce fichier est un fichier CSV à deux colonnes que nous utilisons pour entraîner le modèle de classification des opérations. La première colonne contient

class, et la deuxième colonne contientdocument. - training_data_resources.csv – Ce fichier est un fichier CSV à deux colonnes que nous utilisons pour former le modèle de classification des ressources. Comme le

training_data_operations.csvfichier, la première colonne contientclass, et la deuxième colonne contientdocument.

- training_data_operations.csv – Ce fichier est un fichier CSV à deux colonnes que nous utilisons pour entraîner le modèle de classification des opérations. La première colonne contient

- Sur la console Amazon S3, créez un nouveau compartiment pour Amazon Comprehend. Étant donné que les noms de compartiment S3 sont globalement uniques, vous devez créer un nom unique pour le compartiment. Pour ce poste, nous l'appelons

comprehend-ticket-training-data. Activez le chiffrement côté serveur et bloquez l'accès public lors de la création du compartiment. - Téléchargement

training_data_operations.csvainsi quetraining_data_resources.csvau nouveau compartiment S3.

Créer deux nouveaux modèles

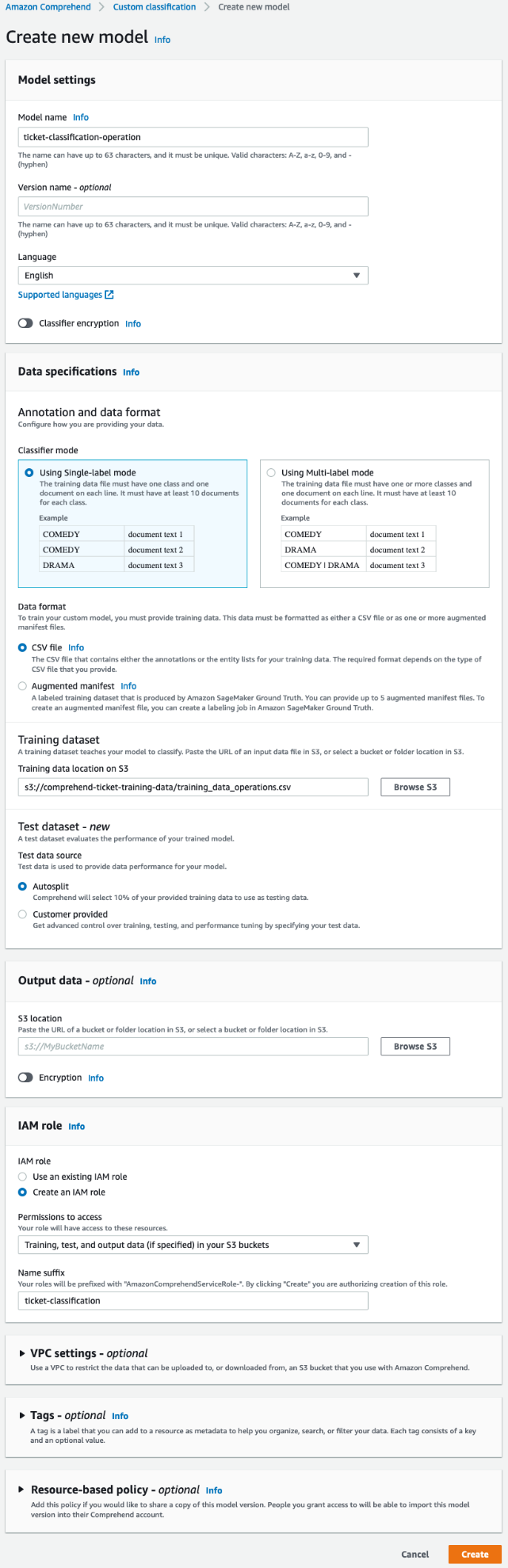

Pour créer vos modèles, procédez comme suit :

- Sur la console Amazon Comprehend, choisissez Classement personnalisé dans le volet de navigation.

- Selectionnez Créer un nouveau modèle.

- fournissez les informations suivantes:

- Pour Nom du modèle, Entrer

ticket-classification-operation. - Pour Langue, choisissez Anglais.

- Pour Mode classificateur, sélectionnez Utilisation du mode Étiquette unique.

- Pour Format de données, sélectionnez fichier CSV.

- Pour Ensemble de données d'entraînement, entrez le chemin S3 pour

training_data_operations.csv. - Pour Tester la source de données, sélectionnez Fractionnement automatique.

Autosplit sélectionne automatiquement 10 % de vos données d'entraînement fournies à utiliser comme données de test. - Pour Rôle IAM, sélectionnez Créer un rôle IAM.

- Pour Autorisations d'accès, choisissez les données d'entraînement, de test et de sortie (le cas échéant) dans vos compartiments S3.

- Pour Suffixe de nom, Entrer

ticket-classification.

- Pour Nom du modèle, Entrer

- Selectionnez Création.

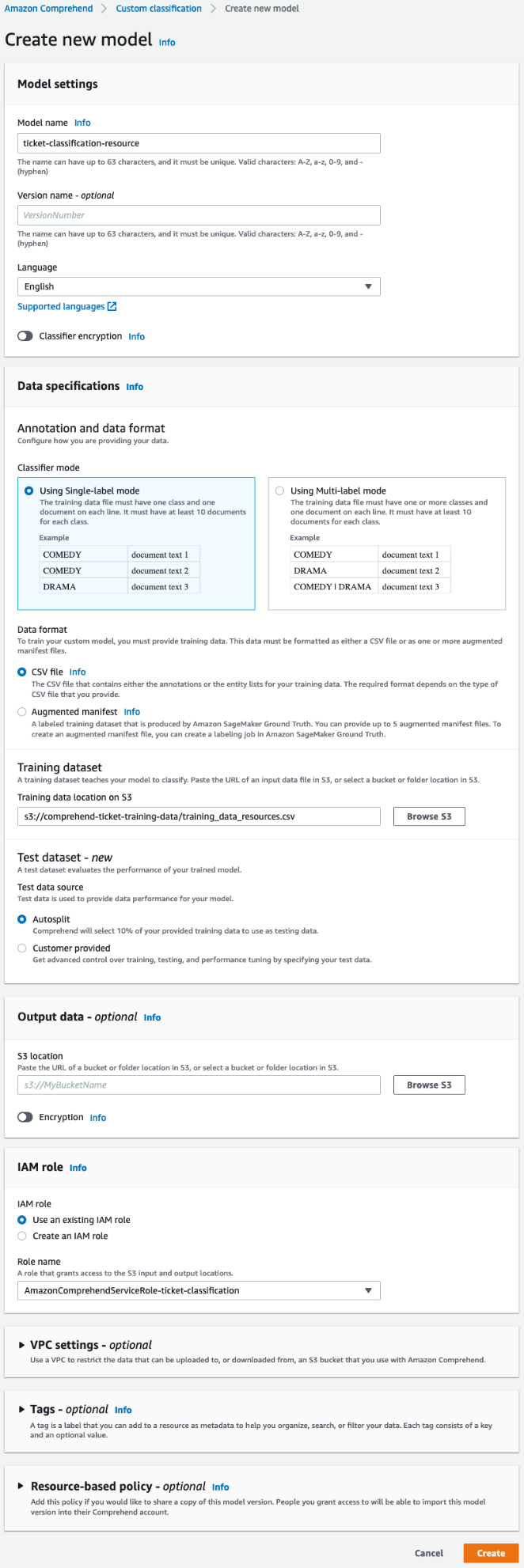

- Selectionnez Créer un nouveau modèle à nouveau pour créer votre modèle de classification des ressources.

- fournissez les informations suivantes:

- Pour Nom du modèle, Entrer

ticket-classification-resource. - Pour Langue, choisissez Anglais.

- Pour Mode classificateur, sélectionnez Utilisation du mode Étiquette unique.

- Pour Format de données, sélectionnez fichier CSV.

- Pour Ensemble de données d'entraînement, entrez le chemin S3 pour

training_data_resources.csv. - Pour Tester la source de données, sélectionnez Fractionnement automatique.

- Pour Rôle IAM, sélectionnez Utiliser un rôle IAM existant.

- Pour Nom de rôle, choisissez

AmazonComprehendServiceRole-ticket-classification.

- Pour Nom du modèle, Entrer

- Selectionnez Création.

Amazon Comprehend traite actuellement les fichiers CSV et les utilise pour former des classificateurs personnalisés. Nous les utilisons ensuite pour aider à classer les tickets des clients. Plus nos données d'entraînement sont grandes et précises, plus le classificateur sera précis.

Attendez que l'état de la version s'affiche comme Trained comme ci-dessous. Cela peut prendre jusqu'à 1 heure, selon la taille des données d'entraînement.

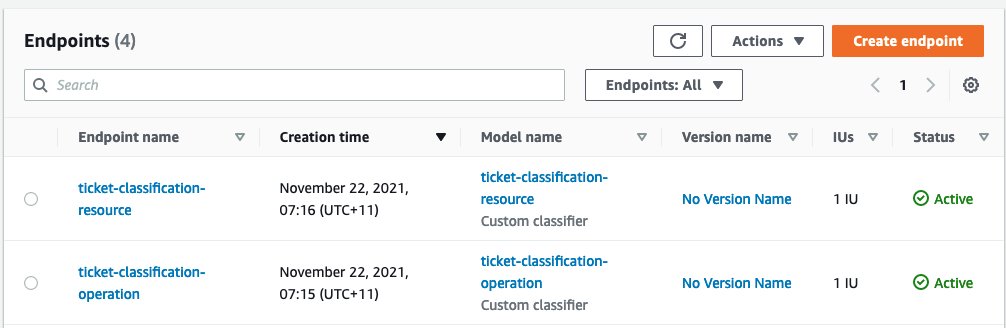

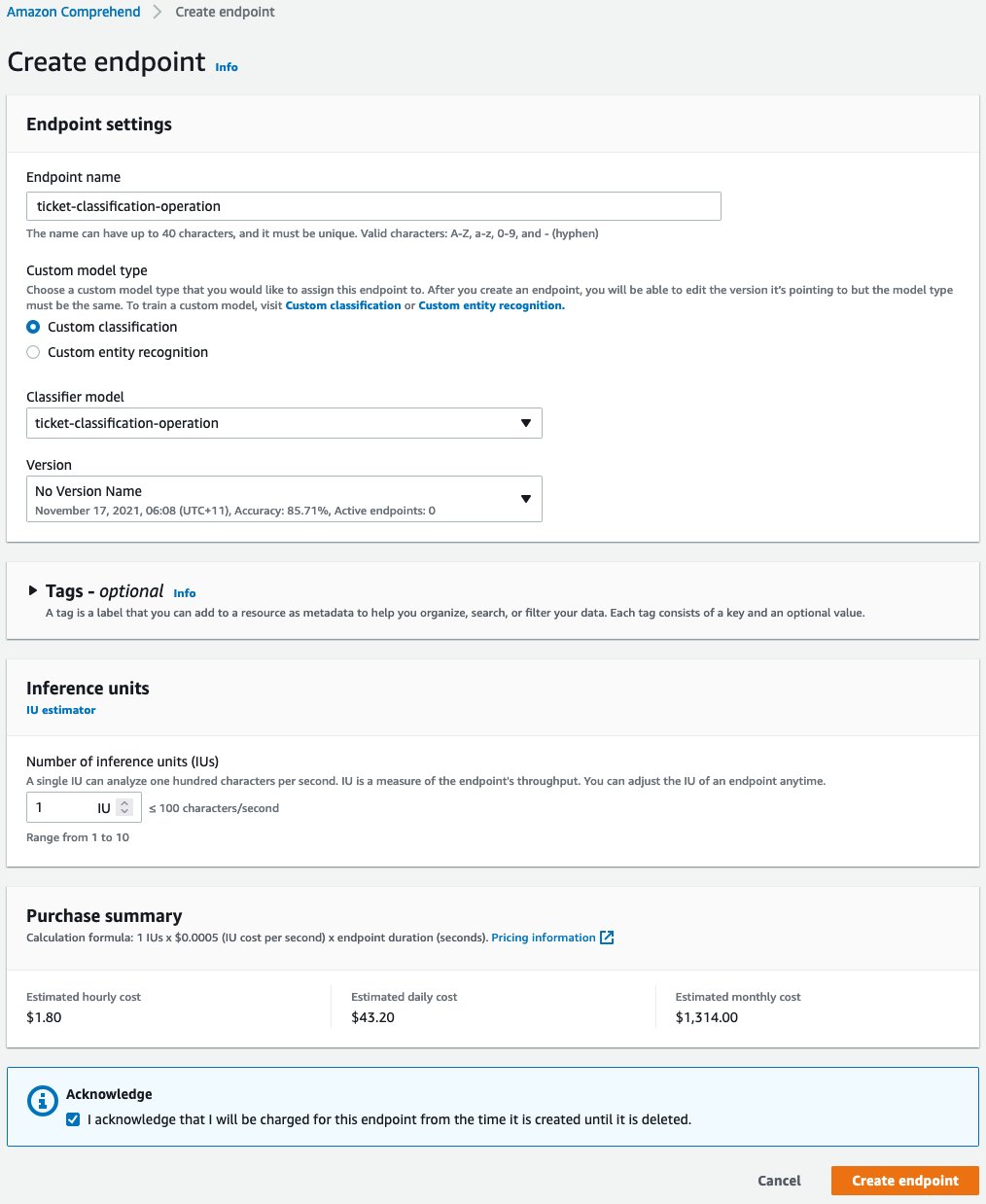

Créer des points de terminaison Amazon Comprehend

Les points de terminaison Amazon Comprehend sont facturés par tranches d'une seconde, avec un minimum de 1 secondes. Les frais continuent de s'appliquer à partir du moment où vous démarrez le point de terminaison jusqu'à ce qu'il soit supprimé, même si aucun document n'est analysé. Pour plus d'informations, voir Amazon comprendre les prix. Pour créer vos points de terminaison, procédez comme suit :

- Sur la console Amazon Comprehend, choisissez Endpoints dans le volet de navigation.

- Selectionnez Créer un point de terminaison pour créer votre point de terminaison de classification d'opération.

- fournissez les informations suivantes:

- Pour Nom du noeud final, Entrer

ticket-classification-operation. - Pour Type de modèle personnalisé, sélectionnez Classement personnalisé.

- Pour Modèle de classificateur, choisissez billet-classement-opération.

- Pour Version, choisissez Aucun nom de version.

- Pour Nombre d'unités d'inférence (UI), Entrer

1.

- Pour Nom du noeud final, Entrer

- Selectionnez Créer un point de terminaison.

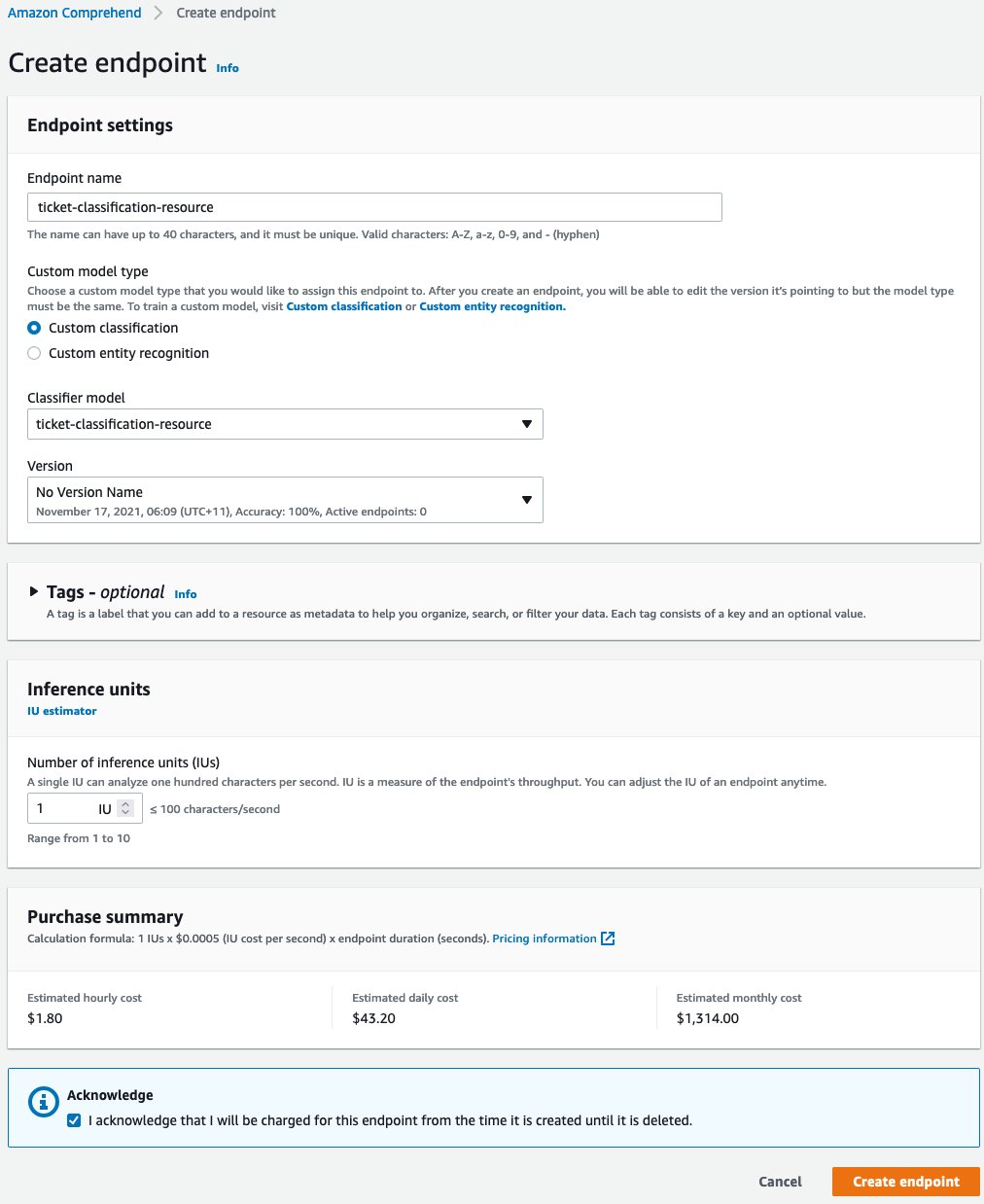

- Selectionnez Créer un point de terminaison à nouveau pour créer le point de terminaison de classification des ressources.

- fournissez les informations suivantes:

- Pour Nom du noeud final, Entrer

ticket-classification-resource. - Pour Type de modèle personnalisé, sélectionnez Classement personnalisé.

- Pour Modèle de classificateur, choisissez ticket-classification-ressource.

- Pour Version, choisissez Aucun nom de version.

- Pour Nombre d'unités d'inférence (UI), Entrer

1.

- Pour Nom du noeud final, Entrer

- Selectionnez Créer un point de terminaison.

Après avoir créé les deux points de terminaison, attendez que l'état des deux s'affiche comme Active.

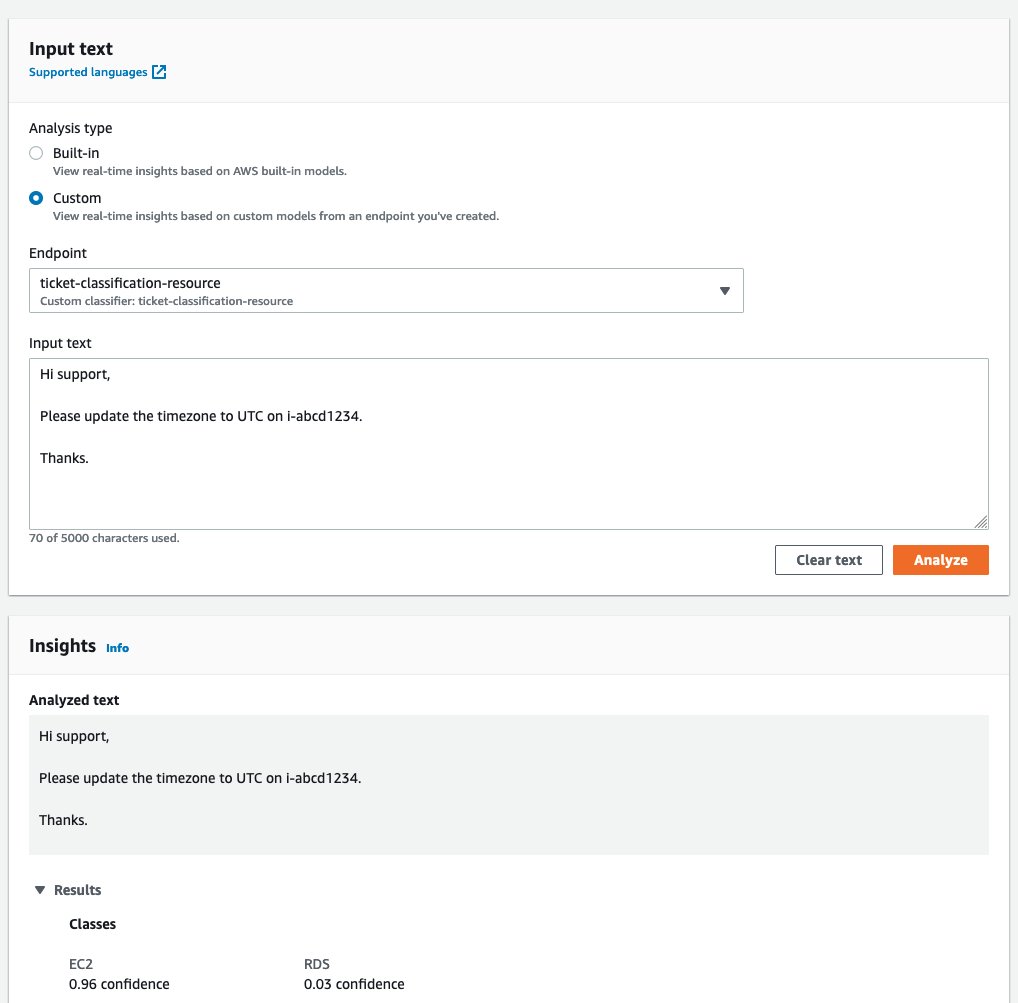

Testez les points de terminaison Amazon Comprehend avec une analyse en temps réel

Pour tester vos points de terminaison, procédez comme suit :

- Sur la console Amazon Comprehend, choisissez Analyse en temps réel dans le volet de navigation.

- Pour Type d'analysesélectionner Coutume.

- Pour Endpoint¸ choisissez billet-classement-opération.

- Pour Texte de saisie, entrez les informations suivantes:

- Selectionnez Analysez.

Les résultats montrent que leUpdateclasse a le score de confiance le plus élevé. - Modifier Endpoint à ticket-classification-ressource et choisissez Analysez nouveau.

Les résultats montrent que le EC2 classe a le score de confiance le plus élevé.

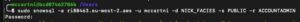

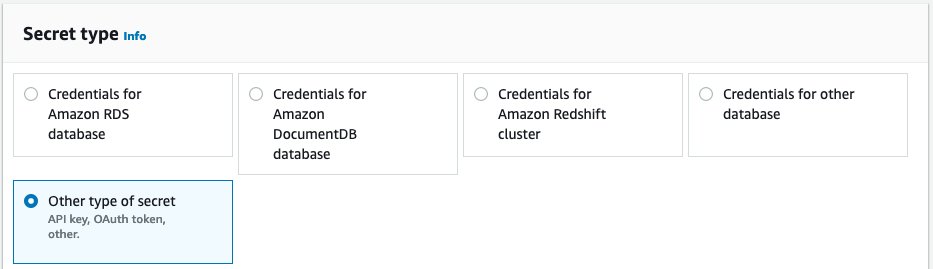

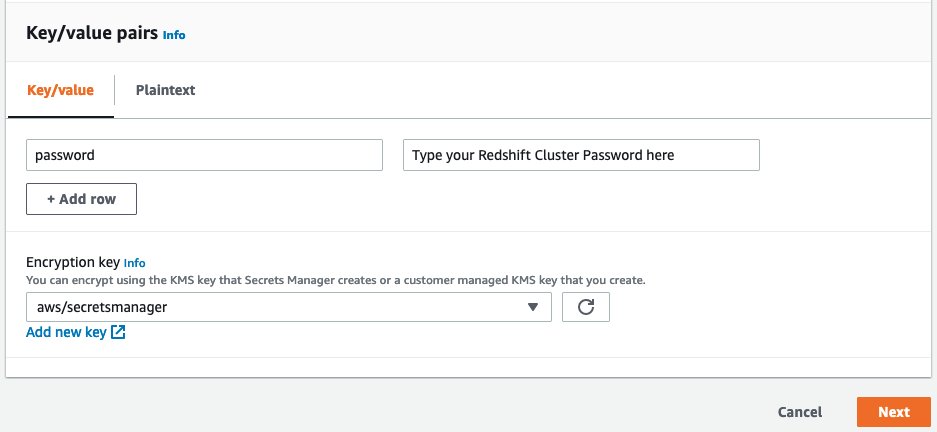

Créer un secret pour le mot de passe du cluster Amazon Redshift

Dans cette étape, nous créons un AWS Secrets Manager secret pour votre mot de passe de cluster Amazon Redshift. Secrets Manager vous aide à protéger les secrets nécessaires pour accéder à vos applications, services et ressources informatiques. Le service vous permet de faire pivoter, gérer et récupérer facilement les informations d'identification de la base de données, les clés API et d'autres secrets tout au long de leur cycle de vie. Dans cet article, nous stockons le mot de passe du cluster Amazon Redshift dans un secret Secrets Manager.

- Sur la console Secrets Manager, choisissez Secrets dans le volet de navigation.

- Selectionnez Stocker un nouveau secret.

- Pour Type secret, sélectionnez Autre type de secret.

- Sous Paires clé/valeur, définissez votre clé comme

passwordet valeur comme mot de passe de votre cluster Amazon Redshift.

Le mot de passe doit comporter entre 8 et 64 caractères et contenir au moins une lettre majuscule, une lettre minuscule et un chiffre. Il peut s'agir de n'importe quel caractère ASCII imprimable à l'exception de ' (guillemets simples), “ (guillemets doubles), , /, @ ou espace. - Selectionnez Suivant.

- Pour Nom secret, Entrer

ClassificationRedshiftClusterPassword. - Selectionnez Suivant.

- Dans le Rotation secrète section, choisissez Suivant.

- Passez en revue votre configuration secrète et choisissez Agence.

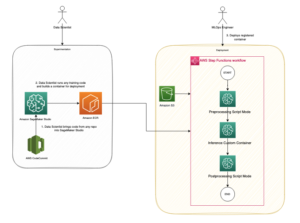

Provisionnez votre infrastructure avec AWS CloudFormation

Dans cette étape, nous provisionnons l'infrastructure de la solution à l'aide d'un AWS CloudFormation association.

Charger le code de la fonction Lambda

Avant de lancer la pile CloudFormation, importez le code de votre fonction Lambda :

- Télécharger lambda_code.zip

- Sur la console Amazon S3, ouvrez le compartiment que vous avez créé.

- Téléchargement

lambda_code.zip.

Créez votre pile CloudFormation

Pour provisionner des ressources avec AWS CloudFormation, procédez comme suit :

- Télécharger cloudformation_template.json.

- Sur la console AWS CloudFormation, choisissez Créer une pile.

- Sélectionnez Avec de nouvelles ressources (standard).

- Pour Source du modèle, choisissez Télécharger un fichier modèle.

- Choisissez le modèle CloudFormation téléchargé.

- Selectionnez Suivant.

- Pour Nom de la pile, Entrer

Ticket-Classification-Infrastructure. - Dans le Paramètres section, saisissez les valeurs suivantes :

- Pour ClassificationRedshiftClusterNodeType, entrez le type de nœud de cluster Amazon Redshift. dc2.large est la valeur par défaut.

- Pour ClassificationRedshiftClusterPasswordSecretName, entrez le nom secret Secrets Manager qui stocke le mot de passe du cluster Amazon Redshift.

- Pour ClassificationRedshiftClusterSubnetId, entrez l'ID de sous-réseau où le cluster Amazon Redshift est hébergé. Le sous-réseau doit se trouver dans le VPC que vous avez mentionné dans le

ClassificationRedshiftClusterVpcIdparamètre. - Pour ClassificationRedshiftClusterNom d'utilisateur, entrez le nom d'utilisateur du cluster Amazon Redshift.

- Pour ClassificationRedshiftClusterVpcId, entrez l'ID de VPC où le cluster Amazon Redshift est hébergé.

- Pour LambdaCodeS3Bucket, entrez le nom du compartiment S3 dans lequel vous avez chargé le code Lambda.

- Pour Clé LambdaCodeS3, entrez la clé Amazon S3 du package de déploiement.

- Pour Région QuickSight, entrez la région pour QuickSight. La région pour QuickSight doit être cohérente avec la région que vous utilisez pour Amazon Comprehend et le compartiment S3.

- Selectionnez Suivant.

- Dans le Configurer les options de pile section, choisissez Suivant.

- Dans le Avis section, sélectionnez Je reconnais qu'AWS CloudFormation peut créer des ressources IAM.

- Selectionnez Créer une pile.

Configurez votre cluster Amazon Redshift

Dans cette étape, vous activez la journalisation d'audit et ajoutez la nouvelle table au cluster Amazon Redshift créé via le modèle CloudFormation.

La journalisation d'audit n'est pas activée par défaut dans Amazon Redshift. Lorsque vous activez la journalisation sur votre cluster, Amazon Redshift exporte les journaux vers Amazon Cloud Watch, qui capturent les données depuis l'activation de la journalisation d'audit jusqu'à l'heure actuelle. Chaque mise à jour de journalisation est une continuation des journaux précédents.

Activer la journalisation d'audit

Vous pouvez ignorer cette étape si vous n'avez pas besoin de la journalisation d'audit pour votre cluster Amazon Redshift.

- Sur la console Amazon Redshift, choisissez Clusters dans le volet de navigation.

- Choisissez le cluster Amazon Redshift commençant par

classificationredshiftcluster-. - Sur le biens onglet, choisissez Modifier.

- Selectionnez Modifier la journalisation d'audit.

- Pour Configurer la journalisation d'audit¸ choisissez allumer.

- Pour Type d'expert du journal, choisissez CloudWatch.

- Sélectionnez tous les types de journaux.

- Selectionnez Enregistrer les modifications.

Créer un nouveau tableau

Pour créer une table, procédez comme suit :

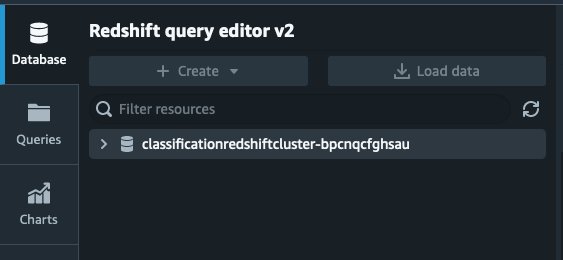

- Sur la console Amazon Redshift, choisissez Données de requête.

- Selectionnez Requête dans l'éditeur de requête v2.

- Sur le Base de données page, choisissez votre cluster.

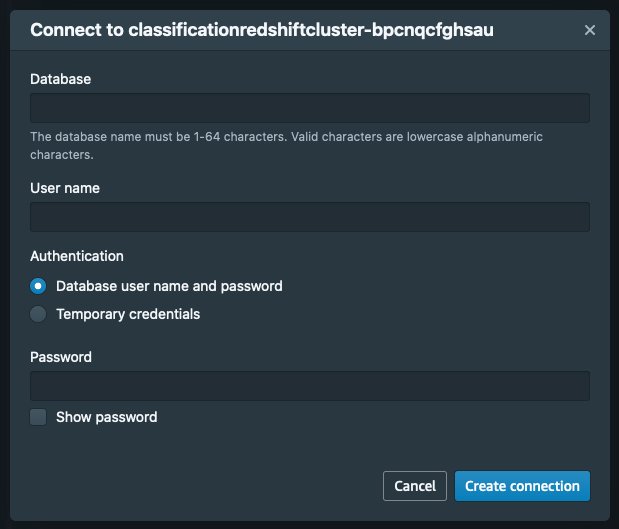

- Pour Base de données, Entrer

ticketclassification. - Entrez le nom d'utilisateur et le mot de passe que vous avez configurés dans les paramètres de la pile CloudFormation.

- Selectionnez Créer une connexion.

- Lorsque la connexion est établie, choisissez le signe plus et ouvrez une nouvelle fenêtre de requête.

- Saisissez la requête suivante :

- Selectionnez Courir.

Tester l'infrastructure de classification

L'infrastructure de classification des tickets est maintenant prête. Avant de l'intégrer à votre système de tickets, testons l'infrastructure de classification.

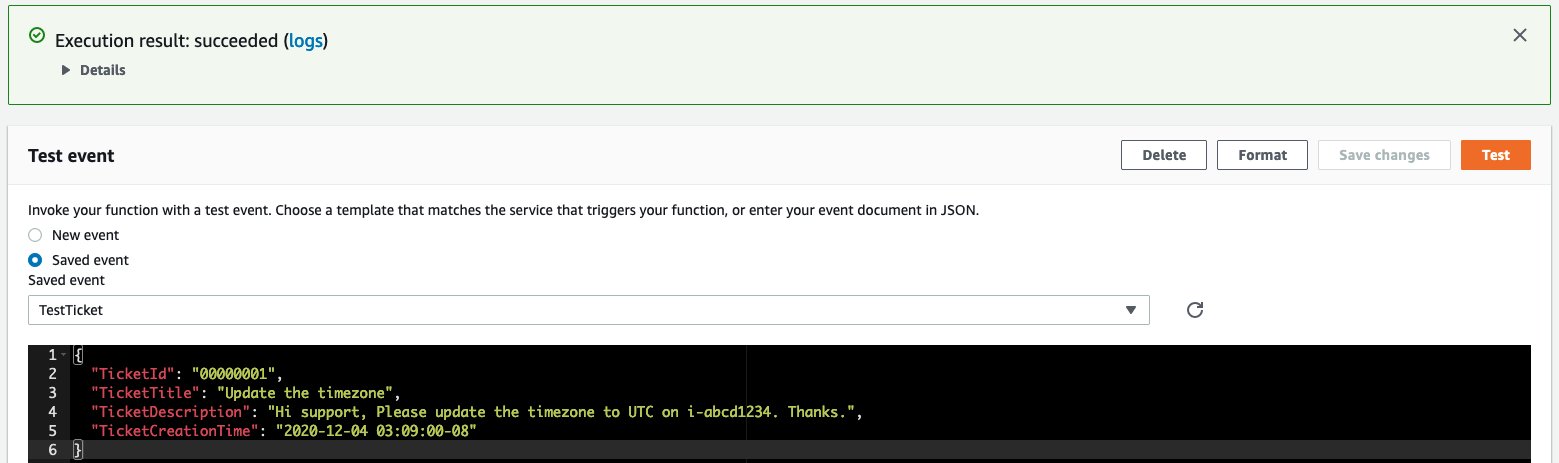

Exécutez le test

Pour exécuter le test, procédez comme suit :

- Sur la console Lambda, choisissez Les fonctions dans le volet de navigation.

- Choisissez la fonction qui commence par

Ticket-Classification-Inf-TicketClassifier. - Sur le Teste onglet, choisissez Événement test.

- Pour Nom, Entrer

TestTicket. - Saisissez les données de test suivantes :

- Selectionnez Teste.

Le ticket est classifié et les données de classification sont stockées dans le cluster Amazon Redshift. Après la classification, la fonction Lambda du gestionnaire de tickets s'exécute, qui gère le ticket en fonction de la classification, notamment en recommandant des matériaux pour aider les ingénieurs.

Vérifier le journal de test du classificateur de tickets

Pour vérifier le journal de test, procédez comme suit :

- Dans la section des résultats du test, choisissez Journauxou choisir Afficher les journaux dans CloudWatch sur le Surveiller languette.

- Choisissez le flux de journal.

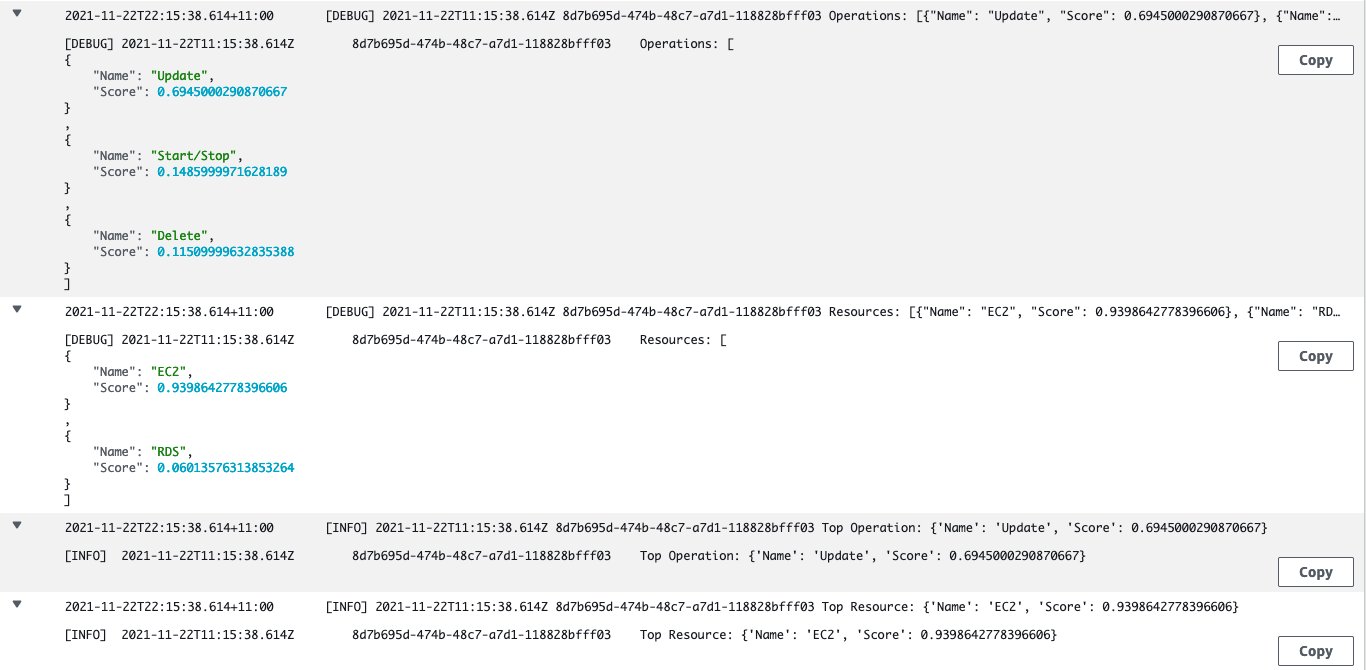

Vous pouvez afficher les journaux dans la capture d'écran suivante, qui montre la sortie d'Amazon Comprehend et la classification finale du ticket. Dans cet exemple, le ticket de test est classé comme Resource=EC2, Operation=Update.

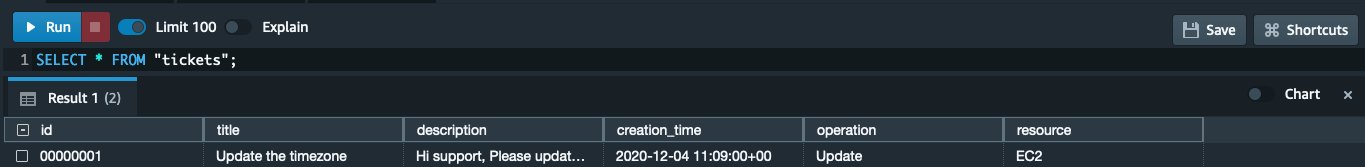

Vérifier la sortie de classification des tickets dans le cluster Amazon Redshift

Pour valider le résultat dans votre cluster, procédez comme suit :

- Sur la console de l'éditeur de requête Amazon Redshift v2, choisissez le signe plus pour ouvrir une nouvelle fenêtre de requête.

- Saisissez la requête suivante :

- Selectionnez Courir.

La capture d'écran suivante montre la classification du ticket. S'il n'est pas encore disponible, attendez quelques minutes et réessayez (Kinesis Data Firehose a besoin de temps pour envoyer les données). Nous pouvons maintenant utiliser ces données dans QuickSight.

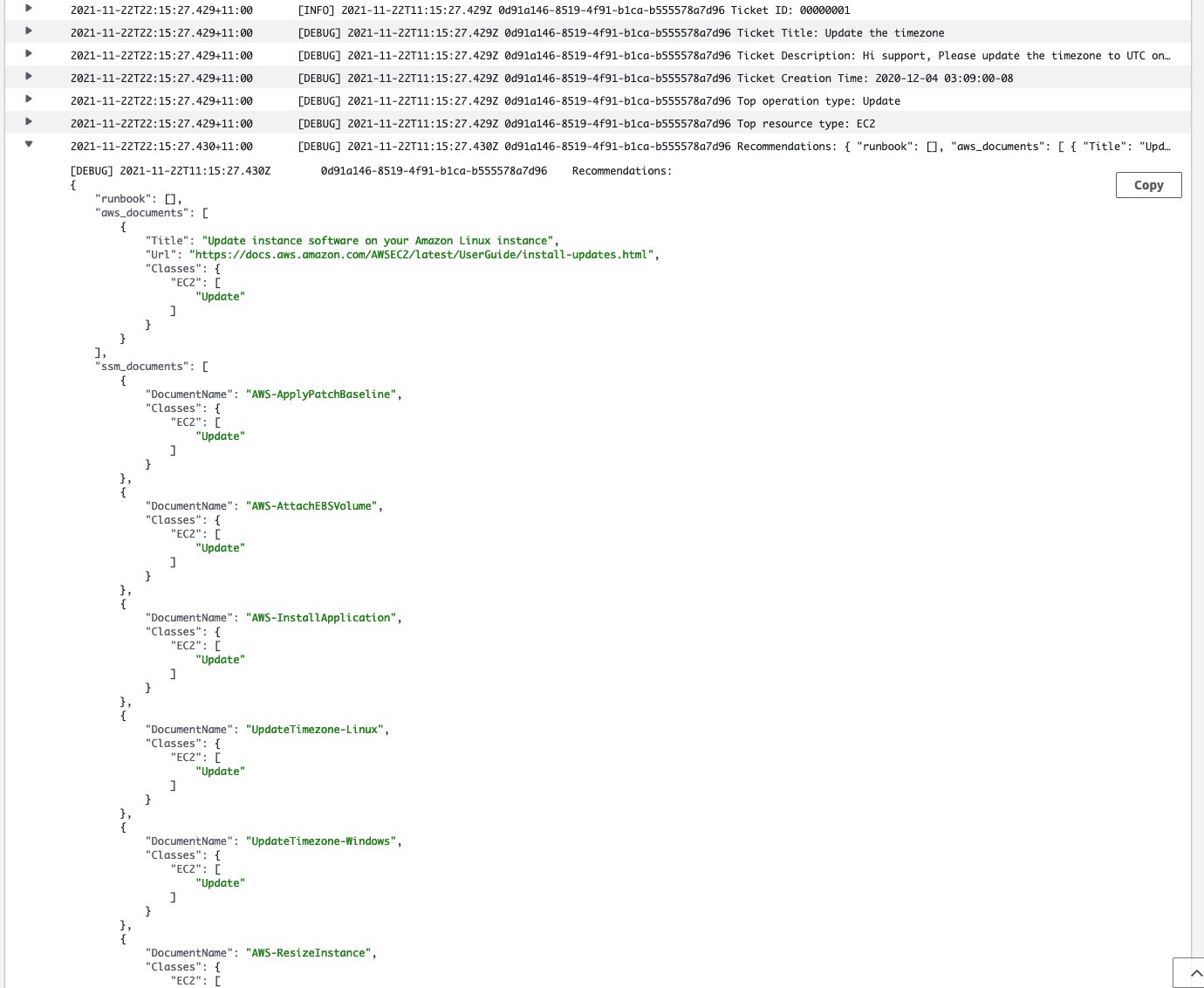

Vérifier le journal de test du gestionnaire de tickets

Une fois que le classificateur de tickets a envoyé les données de classification dans le cluster Amazon Redshift, la fonction Lambda du gestionnaire de tickets s'exécute, qui gère le ticket en fonction de la classification, notamment en recommandant des matériaux pour aider les ingénieurs. Dans cet exemple, le gestionnaire de tickets renvoie les documents recommandés, notamment le runbook, la documentation AWS et les documents SSM, afin que l'assistance puisse s'y référer lors du traitement du ticket. Vous pouvez intégrer la sortie à votre système de traitement des tickets et vous pouvez personnaliser les processus de traitement dans le code de la fonction Lambda. Dans cette étape, nous vérifions quelles recommandations ont été faites.

- Sur la console Lambda, choisissez Les fonctions dans le volet de navigation.

- Choisissez la fonction Lambda qui commence par

Ticket-Classification-Inf-TicketHandlerLambdaFunct. - Sur le Surveiller onglet, choisissez Afficher les journaux dans CloudWatch.

- Choisissez le flux de journal.

La capture d'écran suivante montre les journaux. Vous pouvez voir la sortie d'Amazon Comprehend et la liste des documents AWS et des documents SSM recommandés pour le ticket classé comme Update EC2. Vous pouvez ajouter vos propres runbooks, documents, documents SSM ou tout autre matériel dans le code de la fonction Lambda.

Intégrez l'infrastructure de classification des billets à votre système de billetterie

Dans cette section, nous passons en revue les étapes pour intégrer votre infrastructure de classification de billetterie à votre système de billetterie et personnaliser votre configuration.

La plupart des systèmes de billetterie ont une fonction de déclenchement, qui vous permet d'exécuter du code lorsque le billet est soumis. Configurez votre système de tickets pour appeler la fonction Lambda de classificateur de tickets avec l'entrée formatée suivante :

Si vous souhaitez personnaliser l'entrée, modifiez le code de la fonction Lambda du classificateur de tickets. Vous devez ajouter ou supprimer des paramètres (lignes 90 à 105) et personnaliser l'entrée pour Amazon Comprehend (lignes 15 à 17).

Vous pouvez personnaliser la fonction Lambda du gestionnaire de tickets pour exécuter l'automatisation ou modifier les recommandations. Par exemple, vous pouvez ajouter le commentaire interne au ticket avec les recommandations. Pour personnaliser, ouvrez le code Lambda du gestionnaire de tickets et modifiez les lignes 68–70 et 75–81.

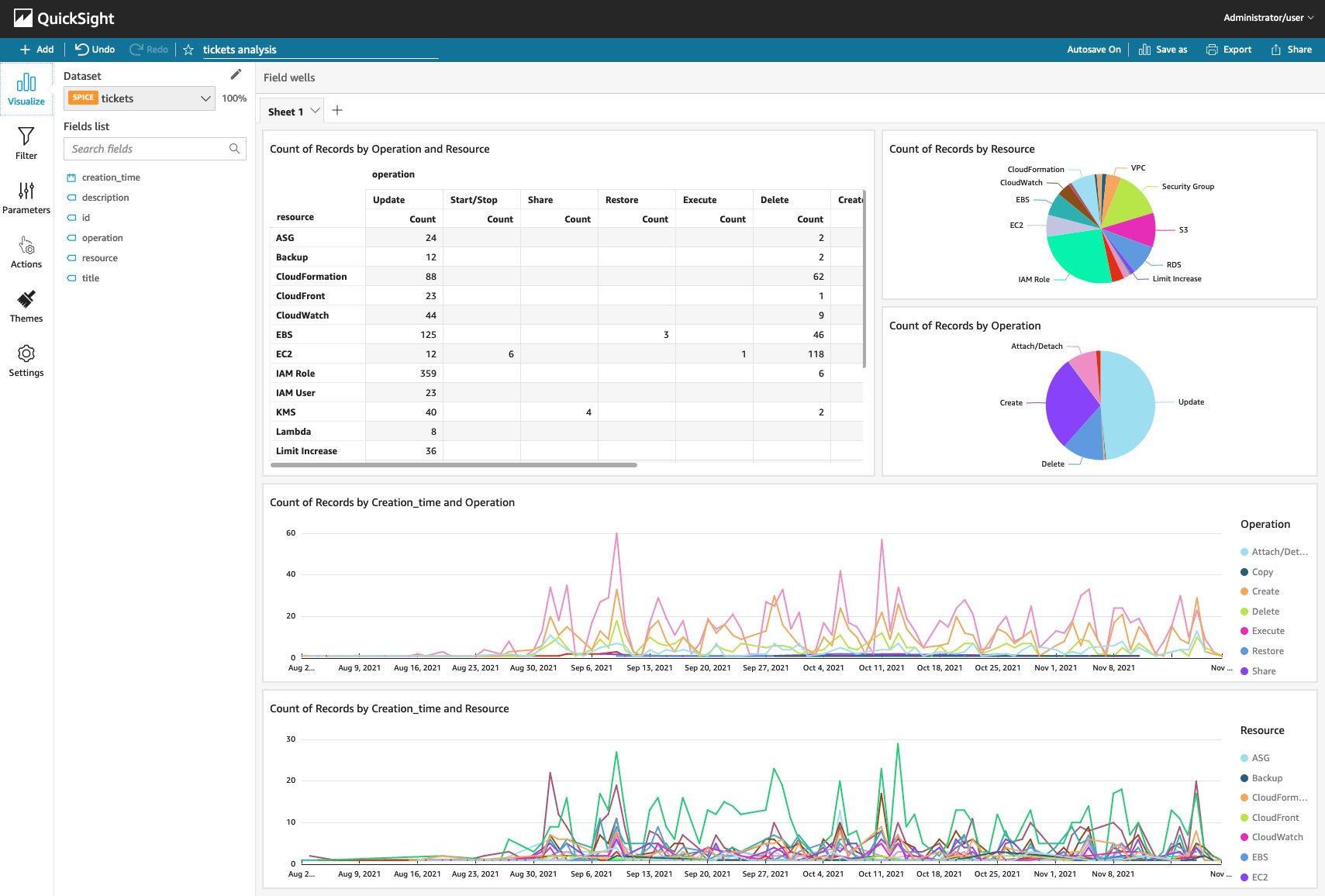

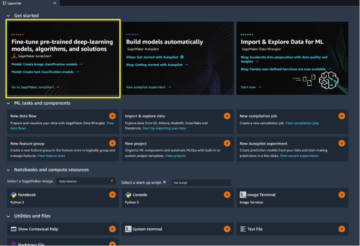

Utiliser les données de classification avec QuickSight

Après avoir intégré l'infrastructure de classification des tickets à votre système de tickets, les données de classification des tickets sont stockées dans le cluster Amazon Redshift. Vous pouvez utiliser QuickSight pour vérifier ces données et générer des rapports. Dans cet exemple, nous générons une analyse QuickSight avec les données de classification.

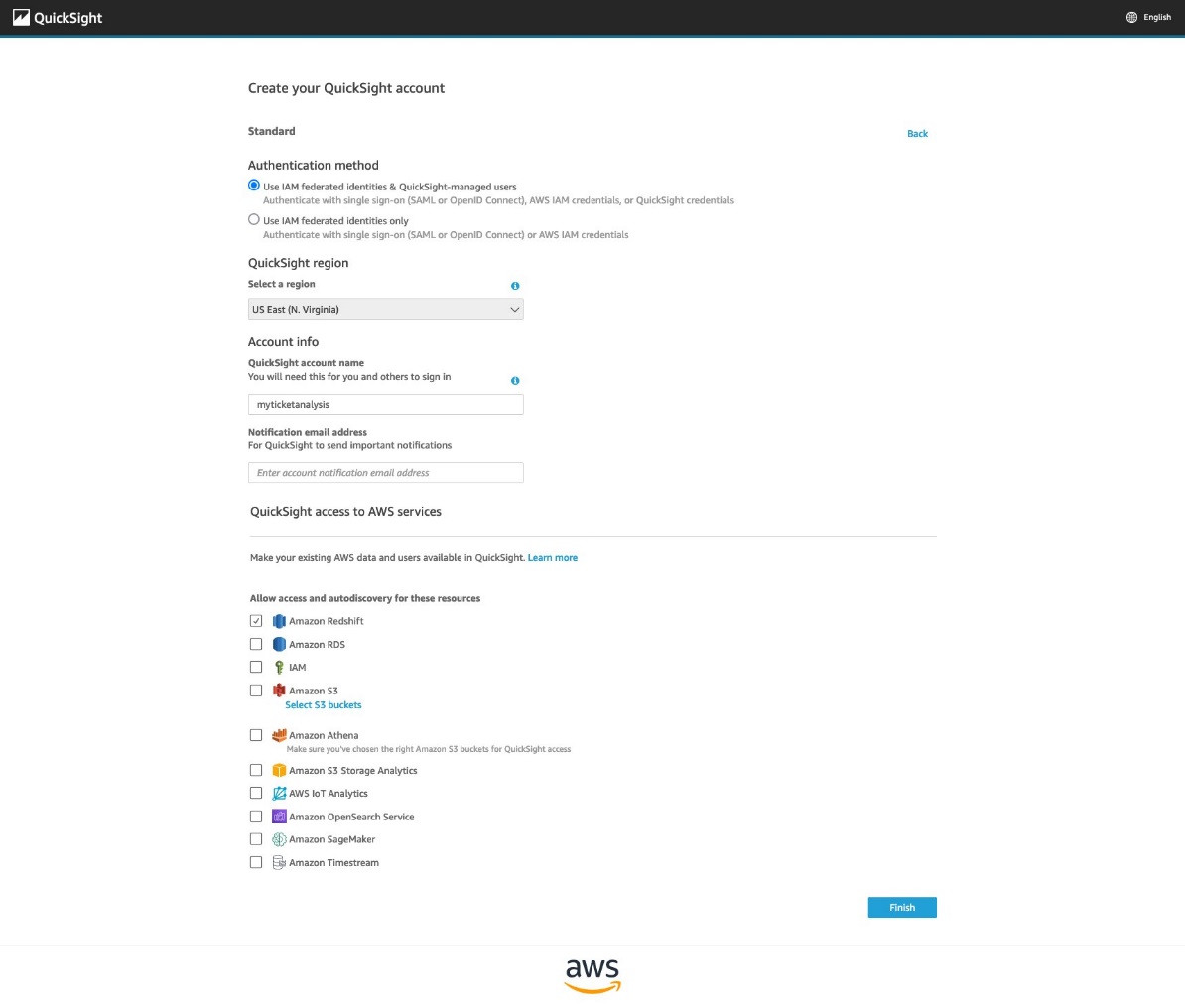

Inscrivez-vous à QuickSight

Si vous n'avez pas encore QuickSight, inscrivez-vous en procédant comme suit :

- Sur la console QuickSight, choisissez Inscrivez-vous à QuickSight.

- Selectionnez Standard.

- Sous Région QuickSight, choisissez la région que vous avez configurée dans le paramètre CloudFormation

QuickSightRegion. - Sous Informations de compte, saisissez le nom de votre compte QuickSight et l'adresse e-mail de notification.

- Sous Accès QuickSight aux services AWS, sélectionnez Redshift d'Amazon.

- Si vous souhaitez autoriser l'accès et la découverte automatique pour d'autres ressources, sélectionnez-les également.

- Selectionnez Finition.

- Selectionnez Accéder à Amazon QuickSight après votre inscription.

Connectez votre cluster Amazon Redshift à QuickSight

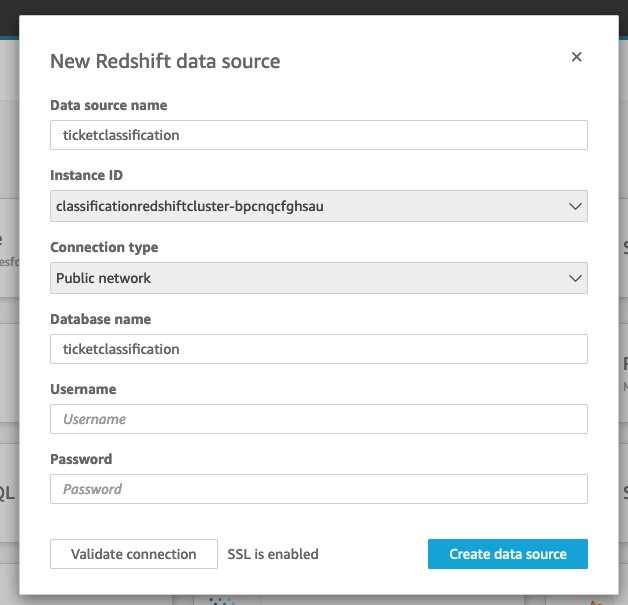

Pour connecter votre cluster à QuickSight en tant que source de données, procédez comme suit :

- Sur la console QuickSight, choisissez Jeux de données dans le volet de navigation.

- Selectionnez Nouveau jeu de données.

- Selectionnez Redshift Auto-découvert.

- fournissez les informations suivantes:

- Pour Nom de la source de données, Entrer

ticketclassification. - Pour Identifiant d'instance, choisissez le cluster Amazon Redshift commençant par

classificationredshiftcluster-. - Pour Type de connexion, choisissez Réseau public.

- Pour Nom de la base de données, Entrer

ticketclassification. - Entrez le nom d'utilisateur et le mot de passe du cluster Amazon Redshift que vous avez configurés dans les paramètres de la pile CloudFormation.

- Pour Nom de la source de données, Entrer

- Selectionnez Valider la connexion pour voir si la connexion fonctionne.

Si cela ne fonctionne pas, cela est probablement dû à l'utilisation d'un nom d'utilisateur et d'un mot de passe incorrects, ou à la région QuickSight différente de celle que vous avez spécifiée dans la pile CloudFormation. - Selectionnez Créer une source de données.

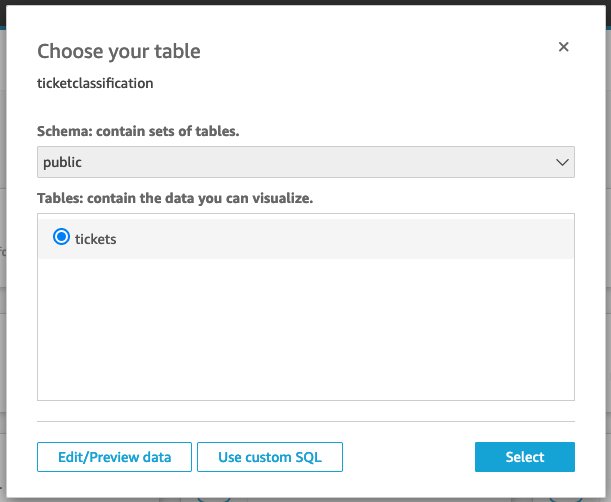

- Dans le Choisissez votre table section, sélectionnez

ticketstableau. - Selectionnez Sélectionnez.

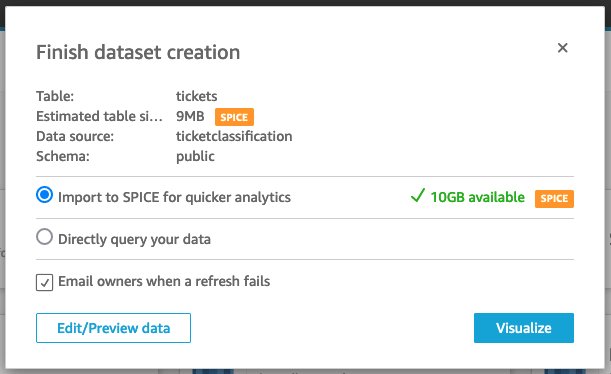

- Sélectionnez Importer dans SPICE pour des analyses plus rapides.

SPICE est le moteur de calcul rapide, parallèle et en mémoire de QuickSight. Il est conçu pour effectuer rapidement des calculs avancés et servir des données. Importation (également appelée ingérer) vos données dans SPICE peuvent vous faire gagner du temps et de l'argent. Pour plus d'informations sur SPICE, reportez-vous à Importation de données dans SPICE. Si vous obtenez l'erreur "Pas assez de capacité SPICE", achetez plus de capacité SPICE. Pour plus d'informations, reportez-vous à Achat de capacité SPICE dans une région AWS. - Selectionnez Visualiser.

Créer un rapport d'analyse de la classification des tickets

Une fois que vous avez terminé la création du jeu de données, vous pouvez voir la nouvelle analyse QuickSight. Dans cette section, nous passons en revue les étapes de création d'un rapport d'analyse de la classification des tickets, y compris un tableau croisé dynamique, des graphiques à secteurs et des graphiques linéaires.

- Selectionnez Un autographe.

- Sous Types visuels, choisissez le tableau croisé dynamique.

- Faites glisser

operationde Liste des champs à rangées. - Faites glisser

resourcede Liste des champs à Colonnes. - Sur le Ajouter menu, choisissez Ajouter un visuel.

- Sous Types visuels, choisissez le graphique à secteurs.

- Faites glisser

operationde Liste des champs à Groupe/Couleur. - Sur le Ajouter menu, choisissez Ajouter un visuel nouveau.

- Sous Types visuels, choisissez à nouveau le graphique à secteurs.

- Faites glisser

resourcede Liste des champs à Groupe/Couleur. - Sur le Ajouter menu, choisissez Ajouter un visuel nouveau.

- Sous Types visuels, choisissez le graphique en courbes.

- Faites glisser

creation_timede Liste des champs à axe des X,. - Faites glisser

operationde Liste des champs à Couleur. - Sur le Ajouter menu, choisissez Ajouter un visuel nouveau.

- Sous Types visuels, sélectionnez à nouveau le graphique en courbes.

- Faites glisser

creation_timede Liste des champs à axe des X,. - Faites glisser

operationde Liste des champs à Couleur. - Redimensionnez et réorganisez les graphiques selon vos besoins.

- Selectionnez Enregistrer sous.

- Entrez un nom pour votre analyse et choisissez Épargnez.

Toutes nos félicitations! Votre première analyse de ticket est prête. Une fois que vous avez plus de données, l'analyse ressemblera à la capture d'écran suivante.

Nettoyer

Dans cette étape, nous nettoyons les ressources que nous avons créées avec divers services.

Amazon comprendre

Pour supprimer vos points de terminaison, procédez comme suit :

- Sur la console Amazon Comprehend, choisissez Endpoints dans le volet de navigation.

- Sélectionnez le

endpoint ticket-classification-operation. - Selectionnez Supprimer et suivez les instructions.

- Répétez ces étapes pour supprimer le

ticket-classification-resourcepoint final.

Ensuite, supprimez les classifications personnalisées que vous avez créées. - Selectionnez Classement personnalisé dans le volet de navigation.

- Sélectionnez le

classification ticket-classification-operation. - Sélectionnez Aucun nom de version.

- Selectionnez Supprimer et suivez les instructions.

- Répétez ces étapes pour supprimer le

ticket-classification-resourceclassification.

Amazon S3

Ensuite, nettoyez le compartiment S3 que vous avez créé.

- Sur la console Amazon S3, sélectionnez le compartiment que vous avez créé.

- Supprimez tous les objets du bucket.

- Supprimez le seau.

Amazon QuickSight

Supprimez les analyses et le jeu de données QuickSight que vous avez créés.

- Sur la console QuickSight, choisissez Analyses dans le volet de navigation.

- Choisissez l'icône d'options (trois points) sur l'analyse que vous avez créée.

- Selectionnez Supprimer et suivez les instructions.

- Selectionnez Jeux de données dans le volet de navigation.

- Choisissez le

ticketsjeu de données. - Selectionnez Supprimer l'ensemble de données et suivez les instructions.

AWS CloudFormation

Nettoyez les ressources que vous avez créées dans le cadre de la pile CloudFormation.

- Sur la console AWS CloudFormation, choisissez Combos dans le volet de navigation.

- Choisissez le

Ticket-Classification-Infrastructureassociation. - Sur le Ressources onglet, choisissez l'ID physique de

ClassificationDeliveryStreamS3Bucket.

La console Amazon S3 s'ouvre. - Supprimez tous les objets de ce compartiment.

- Revenez à la console AWS CloudFormation, choisissez Supprimeret suivez les invites.

AWS Secrets Manager

Enfin, supprimez le secret Secrets Manager.

- Sur la console Secrets Manager, sélectionnez le secret

ClassificationRedshiftClusterPassword. - Sur le Actions menu, choisissez Supprimer le secret.

- Définissez la période d'attente sur 7 jours et choisissez Programmer la suppression.

Votre secret sera automatiquement supprimé après 7 jours.

Conclusion

Dans cet article, vous avez appris à utiliser les services AWS pour créer un système de classification et de recommandation automatique. Cette solution aidera vos organisations à créer le flux de travail suivant :

- Classer les demandes des clients.

- Recommander des solutions automatisées.

- Analysez les classifications des demandes des clients et découvrez les principales demandes des clients.

- Lancez une nouvelle solution automatisée et augmentez le taux d'automatisation.

Pour plus d'informations sur Amazon Comprehend, consultez Documentation d'Amazon Comprehend. Vous pouvez également découvrir d'autres fonctionnalités d'Amazon Comprehend et vous inspirer d'autres Articles de blog AWS sur l'utilisation d'Amazon Comprehend au-delà de la classification.

À propos des auteurs

Seongyeol Jerry Cho est ingénieur principal en développement de systèmes chez AWS Managed Services basé à Sydney, en Australie. Il se concentre sur la création de logiciels d'opérations cloud hautement évolutifs et automatisés utilisant une variété de technologies, y compris l'apprentissage automatique. En dehors du travail, il aime voyager, camper, lire, cuisiner et courir.

Seongyeol Jerry Cho est ingénieur principal en développement de systèmes chez AWS Managed Services basé à Sydney, en Australie. Il se concentre sur la création de logiciels d'opérations cloud hautement évolutifs et automatisés utilisant une variété de technologies, y compris l'apprentissage automatique. En dehors du travail, il aime voyager, camper, lire, cuisiner et courir.

Manu Sasikumar est un ingénieur système Sr. Manager avec AWS Managed Services. Manu et son équipe se concentrent sur la création d'automatisations puissantes et faciles à utiliser pour réduire les efforts manuels, et sur la création de solutions basées sur l'IA et le ML pour gérer les demandes des clients. En dehors du travail, il aime passer son temps libre avec sa famille, ainsi que participer à diverses activités humanitaires et bénévoles.

Manu Sasikumar est un ingénieur système Sr. Manager avec AWS Managed Services. Manu et son équipe se concentrent sur la création d'automatisations puissantes et faciles à utiliser pour réduire les efforts manuels, et sur la création de solutions basées sur l'IA et le ML pour gérer les demandes des clients. En dehors du travail, il aime passer son temps libre avec sa famille, ainsi que participer à diverses activités humanitaires et bénévoles.

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/how-service-providers-can-use-natural-language-processing-to-gain-insights-from-customer-tickets-with-amazon- comprendre/

- "

- 100

- 7

- a

- Qui sommes-nous

- accès

- Selon

- Compte

- Avec cette connaissance vient le pouvoir de prendre

- à travers

- Action

- activités

- propos

- Avancée

- AI

- Tous

- permet

- déjà

- Bien que

- Amazon

- selon une analyse de l’Université de Princeton

- analytique

- il analyse

- api

- Application

- applications

- approprié

- architecture

- attribué

- audit

- Australie

- automatiser

- Automatisation

- Automatique

- automatiquement

- Automation

- disponibles

- AWS

- car

- before

- va

- ci-dessous

- LES MEILLEURS

- jusqu'à XNUMX fois

- Au-delà

- Block

- BLOG

- frontière

- construire

- Développement

- la performance des entreprises

- l'intelligence d'entreprise

- Appelez-nous

- candidats

- Compétences

- capturer

- captures

- Catégories

- Causes

- chances

- Voies

- caractères

- des charges

- Charts

- Selectionnez

- choisi

- classe

- classification

- le cloud

- code

- Colonne

- complet

- calcul

- confiance

- configuration

- NOUS CONTACTER

- connexion

- Connexions

- cohérent

- Console

- contient

- continuer

- rentable

- engendrent

- créée

- La création

- création

- Lettres de créance

- Customiser

- des clients

- Clients

- personnaliser

- données

- Base de données

- bases de données

- retarder

- offre

- Selon

- déploiement

- décrit

- détails

- Développement

- différent

- découvrez

- INSTITUTIONNELS

- Ne fait pas

- double

- même

- facile à utiliser

- éditeur

- efficace

- effort

- permettre

- permet

- chiffrement

- Endpoint

- Moteur

- ingénieur

- Les ingénieurs

- Entrer

- essential

- estimé

- exemple

- Sauf

- existant

- expert

- famille

- Fonctionnalité

- Fonctionnalités:

- la traduction de documents financiers

- Prénom

- Focus

- se concentre

- suivre

- Abonnement

- suit

- de

- Remplir

- fonction

- générer

- À l'échelle mondiale

- Réservation de groupe

- Maniabilité

- Matériel

- aider

- aide

- Haute

- très

- organisé

- Comment

- How To

- HTTPS

- expert humanitaire

- ICON

- Mettre en oeuvre

- l'importation

- Y compris

- Améliore

- increased

- d'information

- Infrastructure

- contribution

- idées.

- Inspiration

- intégrer

- Intelligence

- aide

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- ACTIVITES

- clés

- Libellé

- langue

- gros

- plus importantes

- lancement

- savant

- apprentissage

- Probable

- Gamme

- lignes

- Liste

- charge

- Style

- click

- machine learning

- LES PLANTES

- facile

- gérer

- gérés

- manager

- les gérer

- Manuel

- manuellement

- matières premières.

- mentionné

- pourrait

- minimum

- ML

- Breeze Mobile

- modèle

- numériques jumeaux (digital twin models)

- de l'argent

- PLUS

- plusieurs

- noms

- Nature

- Navigation

- nécessaire

- Besoins

- déclaration

- nombre

- ouvert

- ouvre

- opération

- Opérations

- Opportunités

- Options

- organisation

- organisations

- Autre

- global

- propre

- paquet

- partie

- Mot de Passe

- Personnes

- performant

- période

- Physique

- Pivoter

- solide

- représentent

- précédent

- prix

- les process

- traitement

- protéger

- fournir

- à condition de

- fournisseurs

- public

- achat

- augmenter

- en cours

- en temps réel

- recommander

- réduire

- Prix Réduit

- région

- rapport

- Rapports

- nécessaire

- demandes

- Exigences

- ressource

- Ressources

- résultant

- Résultats

- Retours

- Itinéraire

- Courir

- pour le running

- évolutive

- Escaliers intérieurs

- secondes

- Sans serveur

- service

- Services

- set

- signer

- étapes

- unique

- Taille

- So

- Logiciels

- solide

- sur mesure

- Solutions

- quelques

- Space

- Dépenses

- empiler

- Standard

- Commencer

- départs

- Statut

- storage

- Boutique

- STORES

- courant

- streaming

- structuré

- soumis

- Support

- sydney

- combustion propre

- Système

- équipe

- Les technologies

- tester

- Essais

- La

- ainsi

- trois

- Avec

- tout au long de

- billet

- billets

- fiable

- Titre

- outil

- les outils

- top

- Formation

- Transformer

- Voyage

- Trends

- types

- devoiler

- unique

- unités

- Mises à jour

- utilisé

- d'habitude

- UTC

- utiliser

- Plus-value

- variété

- divers

- version

- Voir

- bénévole

- attendez

- web

- Quoi

- WHO

- répandu

- dans les

- sans

- Activités principales

- vos contrats

- Votre