Les organisations utilisent l'apprentissage automatique (ML) et les services d'IA pour améliorer l'expérience client, réduire les coûts opérationnels et ouvrir de nouvelles possibilités pour améliorer les résultats commerciaux. Les données sous-tendent les cas d'utilisation du ML et de l'IA et constituent un atout stratégique pour une organisation. Alors que les données augmentent à un rythme exponentiel, les organisations cherchent à mettre en place une plate-forme de données intégrée, rentable et performante afin de prétraiter les données, d'effectuer l'ingénierie des fonctionnalités et de créer, former et opérationnaliser des modèles ML à grande échelle. Pour y parvenir, AWS propose une plate-forme de données moderne unifiée alimentée par Service de stockage simple Amazon (Amazon S3) en tant que lac de données avec des outils et des moteurs de traitement spécialement conçus pour prendre en charge les charges de travail d'analyse et de ML. Pour une expérience de ML unifiée, vous pouvez utiliser Amazon SageMakerStudio, Qui offre intégration native avec les sessions interactives AWS Glue pour effectuer une ingénierie des fonctionnalités à grande échelle avec une protection des données sensibles. Dans cet article, nous montrons comment mettre en œuvre cette solution.

Amazon Sage Maker est un service ML entièrement géré qui vous permet de créer, d'entraîner et de déployer des modèles à grande échelle pour un large éventail de cas d'utilisation. Pour la formation de modèle, vous pouvez utiliser n'importe lequel des algorithmes intégrés dans SageMaker pour commencer à former et à déployer rapidement des modèles ML.

L'ingénierie des fonctionnalités est un élément clé du processus de création et de développement de modèles. Colle AWS est l'une des options recommandées pour réaliser l'ingénierie des fonctionnalités à grande échelle. AWS Glue vous permet d'exécuter l'intégration et la transformation de données de manière distribuée sur une infrastructure Apache Spark sans serveur et facilite l'utilisation de la célèbre bibliothèque Spark ML pour l'ingénierie des fonctionnalités et le développement de modèles. En outre, vous pouvez utiliser AWS Glue pour le traitement incrémentiel des données via signets de travail, ingérer des données provenant de plus de 100 sources à l'aide connecteurs, et exécutez des charges de travail sporadiques ou imprévisibles à l'aide de mise à l'échelle automatique.

Une autre exigence importante pour les applications basées sur ML est la sécurité des données et le contrôle d'accès. Il est courant d'avoir un contrôle plus strict sur qui peut accéder aux données les plus sensibles dans le cadre du processus d'ingénierie des fonctionnalités et de création de modèles en suivant le principe d'accès au moindre privilège. Pour ce faire, vous pouvez utiliser l'intégration AWS Glue avec Formation AWS Lake pour une gouvernance et une gestion accrues des actifs du lac de données. Avec Lake Formation, vous pouvez configurer des politiques de contrôle et de sécurité d'accès aux données précises au-dessus de votre lac de données Amazon S3. Les politiques sont définies dans un emplacement central, permettant plusieurs services d'analyse et de ML, tels qu'AWS Glue, Amazone Athéna, et SageMaker, pour interagir avec les données stockées dans Amazon S3.

AWS Glue inclut un détection des informations personnellement identifiables (PII) transform qui offre la possibilité de détecter, masquer ou supprimer des entités selon les besoins, pour une conformité et une gouvernance accrues. Avec la transformation PII, vous pouvez détecter les données PII dans les ensembles de données et appliquer automatiquement un contrôle d'accès précis à l'aide de Lake Formation pour restreindre les données sensibles pour différents groupes d'utilisateurs.

Cas d'utilisation

Nous nous concentrons sur un cas d'utilisation de modèle de propension qui inclut un ensemble de données de marketing client et implique deux utilisateurs : un ingénieur de données et un scientifique de données. L'ensemble de données contient des informations par client, y compris la source du prospect, les notes de contact, le rôle du poste, certains indicateurs, les pages vues par visite, etc. L'ensemble de données comprend également des informations sensibles telles que les numéros de téléphone personnels.

L'ingénieur de données est responsable de la construction du pipeline de traitement des données de bout en bout, y compris la préparation des données, le prétraitement et le contrôle d'accès. Le scientifique des données est responsable de l'ingénierie des fonctionnalités, ainsi que de la formation et du déploiement du modèle ML. Notez que le scientifique des données n'est pas autorisé à accéder aux données sensibles PII pour l'ingénierie des fonctionnalités ou la formation du modèle ML.

Dans le cadre de ce cas d'utilisation, l'ingénieur de données crée un pipeline de données pour prétraiter l'ensemble de données, analyse l'ensemble de données à la recherche de toute information PII et limite l'accès de la colonne PII à l'utilisateur data scientist. Par conséquent, lorsqu'un scientifique des données utilise l'ensemble de données pour effectuer l'ingénierie des fonctionnalités et créer des modèles ML, il n'a pas accès à la colonne PII sensible (numéros de téléphone, dans ce cas). Le processus d'ingénierie des fonctionnalités implique la conversion des colonnes de type chaîne dans un format optimal pour les modèles ML. En tant que cas d'utilisation avancé, vous pouvez étendre ce modèle d'accès pour implémenter la sécurité au niveau des lignes et des cellules à l'aide de Lake Formation.

Vue d'ensemble de la solution

La solution contient les étapes de haut niveau suivantes :

- Configurer des ressources avec AWS CloudFormation.

- Prétraitez l'ensemble de données, y compris la détection des PII et le contrôle d'accès précis, sur une session interactive AWS Glue.

- Effectuez l'ingénierie des fonctionnalités sur une session interactive AWS Glue.

- Entraînez et déployez un modèle ML à l'aide de l'algorithme XGBoost intégré à SageMaker.

- Évaluez le modèle ML.

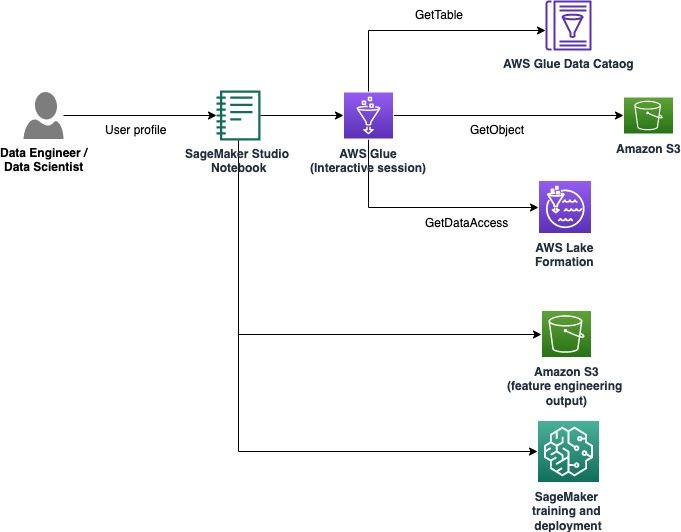

Le diagramme suivant illustre l'architecture de la solution.

Pré-requis

Pour suivre ce tutoriel, vous devez avoir les prérequis suivants :

Configurer des ressources avec AWS CloudFormation

Cet article inclut un modèle CloudFormation pour une configuration rapide. Vous pouvez le consulter et le personnaliser en fonction de vos besoins. Si vous préférez configurer des ressources sur le Console de gestion AWS et l'AWS CLI plutôt qu'AWS CloudFormation, consultez les instructions dans l'annexe à la fin de cet article.

Le modèle CloudFormation génère les ressources suivantes :

- Compartiments S3 avec un exemple d'ensemble de données

- An AWS Lambda fonction pour charger le jeu de données

- Gestion des identités et des accès AWS (IAM) groupe, utilisateurs, rôles et stratégies

- Paramètres et autorisations du lac de données Lake Formation

- Profils d'utilisateurs SageMaker

Pour créer vos ressources, procédez comme suit :

- Connectez-vous à la console.

- Selectionnez Lancer la pile:

- Selectionnez Suivant.

- Pour DataEngineerPwd ainsi que DataScientistPwd, saisissez votre propre mot de passe pour les utilisateurs Data Engineer et Data Scientist.

- Pour GlueDatabaseNameGlueDatabaseName, Entrer

demo. - Pour NomTableColle, Entrer

web_marketing. - Pour S3BucketNameForInput, Entrer

blog-studio-pii-dataset-. - Pour S3BucketNameForOutput, Entrer

blog-studio-output-. - Pour ID de domaine SageMaker, entrez votre ID de domaine SageMaker que vous avez préparé dans les étapes préalables.

- Selectionnez Suivant.

- Sur la page suivante, choisissez Suivant.

- Passez en revue les détails sur la dernière page et sélectionnez Je reconnais qu'AWS CloudFormation peut créer des ressources IAM.

- Selectionnez Création.

La création de la pile peut prendre jusqu'à 10 minutes. La pile crée des rôles IAM et des profils utilisateur SageMaker pour deux personnes : ingénieur de données et scientifique de données. Il crée également une démo de base de données et une table web_marketing avec un exemple de jeu de données.

Au moment de la création de la pile, le personnage de l'ingénieur de données a un accès complet à la table, mais le personnage du scientifique des données n'a pas encore accès à la table.

Prétraiter le jeu de données

Commençons le prétraitement des données sur une session interactive AWS Glue. Le personnage de l'ingénieur de données veut vérifier les données pour voir s'il y a des données sensibles ou non, et accorder une autorisation d'accès minimale au personnage du scientifique des données. Vous pouvez télécharger le bloc-notes à partir de ce lieu.

- Connectez-vous à la console à l'aide de l'utilisateur data-engineer.

- Sur la console SageMaker, choisissez Utilisateurs.

- Sélectionnez l'utilisateur data-engineer et choisissez Open Studio.

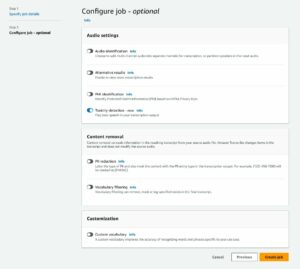

- Créez un nouveau bloc-notes et choisissez SparkAnalytics 1.0 en Image(s) ainsi que Colle PySpark en Noyau.

- Démarrez une session interactive avec la magie suivante pour installer la nouvelle version de Boto3 (nécessaire pour utiliser le

create_data_cells_filterméthode): - Initialisez la session :

- Créez un AWS Glue DynamicFrame à partir de la table nouvellement créée, et résoudre les types de choix basé sur le schéma du catalogue, car nous voulons utiliser le schéma défini dans le catalogue au lieu du schéma automatiquement déduit basé sur les données :

- Vérifiez dans le tableau s'il existe des données PII à l'aide de la détection AWS Glue PII :

- Vérifiez si les colonnes classées comme PII contiennent des données sensibles ou non (si ce n'est pas le cas, mettez à jour Classified_map pour supprimer les colonnes non sensibles) :

- Configurez les autorisations de Lake Formation à l'aide d'un filtre de cellule de données pour les colonnes détectées automatiquement et limitez les colonnes au personnage du scientifique des données :

- Connectez-vous à Studio en tant que data scientist pour voir que les colonnes PII ne sont pas visibles. Vous pouvez télécharger le bloc-notes à partir de ce lieu.

- Créez un nouveau bloc-notes et choisissez SparkAnalytics 1.0 en Image(s) ainsi que Colle PySpark en Noyau:

Réaliser l'ingénierie des fonctionnalités

Nous utilisons la bibliothèque Apache Spark ML pour effectuer l'ingénierie des fonctionnalités en tant qu'utilisateur scientifique des données, puis réécrivons la sortie sur Amazon S3.

- Dans la cellule suivante, nous appliquons les fonctionnalités de la Bibliothèque Apache Spark ML:

StringIndexermappe une colonne de chaînes d'étiquettes à une colonne d'index d'étiquettes.OneHotEncodermappe une caractéristique catégorielle, représentée sous la forme d'un indice d'étiquette, à un vecteur binaire avec au plus une seule valeur qui indique la présence d'une caractéristique catégorielle spécifique. Cette transformation est utilisée pour les algorithmes ML qui attendent des fonctionnalités continues.VectorAssemblerest un transformateur qui combine une liste donnée de colonnes en une seule colonne vectorielle, qui est ensuite utilisée dans la formation de modèles ML pour des algorithmes tels que la régression logistique et les arbres de décision.

- Le DataFrame transformé final peut être créé à l'aide de la bibliothèque Pipeline. Un pipeline est spécifié comme une séquence d'étapes. Ces étapes sont exécutées dans l'ordre et le DataFrame d'entrée est transformé au fur et à mesure qu'il passe par chaque étape.

- Ensuite, nous divisons l'ensemble de données en train, validons et testons DataFrame et l'enregistrons dans le compartiment S3 pour former le modèle ML (fournissez votre ID de compte AWS dans le code suivant) :

Former et déployer un modèle de ML

Dans la section précédente, nous avons terminé l'ingénierie des fonctionnalités, qui comprenait la conversion de colonnes de chaîne telles que region, jobroleet usedpromo dans un format optimal pour les modèles ML. Nous avons également inclus des colonnes telles que pageviewspervisit ainsi que totalwebvisits, ce qui nous aidera à prédire la propension d'un client à acheter un produit.

Nous entraînons maintenant un modèle ML en lisant l'ensemble de données d'entraînement et de validation à l'aide de l'algorithme XGBoost intégré de SageMaker. Ensuite, nous déployons le modèle et exécutons un contrôle de précision. Vous pouvez télécharger le bloc-notes à partir de ce lieu.

Dans la cellule suivante, nous lisons les données du deuxième compartiment S3, qui inclut la sortie de nos opérations d'ingénierie de fonctionnalités. Ensuite, nous utilisons l'algorithme intégré XGBoost pour entraîner le modèle.

- Ouvrez un nouveau bloc-notes. Choisir Sciences des données en Image(s) ainsi que Python 3 en Noyau (fournissez votre ID de compte AWS dans le code suivant) :

- Une fois la formation terminée, nous pouvons déployer le modèle à l'aide des services d'hébergement SageMaker :

Évaluer le modèle ML

Nous utilisons l'ensemble de données de test pour évaluer le modèle et supprimons le point de terminaison d'inférence lorsque nous avons terminé afin d'éviter tout frais continu.

- Évaluez le modèle avec le code suivant :

Le résultat de précision pour l'exécution de l'échantillon était de 84.6 %. Cela pourrait être légèrement différent pour votre exécution en raison de la répartition aléatoire de l'ensemble de données.

- Nous pouvons supprimer le point de terminaison d'inférence avec le code suivant :

Nettoyer

Passons maintenant à la dernière étape, le nettoyage des ressources.

- Videz les deux compartiments créés via la pile CloudFormation.

- Supprimer les applications associées à l'utilisateur

profiles data-scientistainsi quedata-engineerau sein de Studio. - Supprimez la pile CloudFormation.

Conclusion

Dans cet article, nous avons présenté une solution qui permet à des personnes telles que des ingénieurs de données et des scientifiques de données d'effectuer une ingénierie de fonctionnalités à grande échelle. Avec les sessions interactives AWS Glue, vous pouvez facilement réaliser une ingénierie des fonctionnalités à grande échelle avec une détection automatique des PII et un contrôle d'accès précis sans avoir à gérer une infrastructure sous-jacente. En utilisant Studio comme point d'entrée unique, vous pouvez bénéficier d'une expérience simplifiée et intégrée pour créer un workflow de ML de bout en bout : de la préparation et de la sécurisation des données à la création, la formation, le réglage et le déploiement de modèles de ML. Pour en savoir plus, visitez Premiers pas avec les sessions interactives AWS Glue ainsi que Amazon SageMakerStudio.

Nous sommes très enthousiastes à propos de cette nouvelle capacité et impatients de voir ce que vous allez construire avec !

Annexe : Configurer des ressources via la console et l'AWS CLI

Suivez les instructions de cette section pour configurer les ressources à l'aide de la console et de l'AWS CLI au lieu du modèle CloudFormation.

Pré-requis

Pour suivre ce didacticiel, vous devez avoir accès à l'AWS CLI (voir Premiers pas avec l'AWS CLI) ou utilisez l'accès à la ligne de commande à partir de AWS Cloud Shell.

Configurer le groupe, les utilisateurs, les rôles et les stratégies IAM

Dans cette section, nous créons deux utilisateurs IAM : data-engineer et data-scientist, qui appartiennent au groupe IAM data-platform-group. Ensuite, nous ajoutons une seule stratégie IAM au groupe IAM.

- Sur la console IAM, créer une stratégie sur l'onglet JSON pour créer une nouvelle stratégie gérée IAM nommée

DataPlatformGroupPolicy. La stratégie permet aux utilisateurs du groupe d'accéder à Studio, mais uniquement à l'aide d'un profil utilisateur SageMaker avec une balise correspondant à leur nom d'utilisateur IAM. Utilisez le document de stratégie JSON suivant pour fournir des autorisations : - Créer un groupe IAM appelé

data-platform-group. - Recherchez et attachez la stratégie gérée AWS nommée DataPlatformGroupPolicy au groupe.

- Créer des utilisateurs IAM appelé data-engineer et data-scientist sous le groupe IAM data-platform-group.

- Créer une nouvelle stratégie gérée nommée SageMakerExecutionPolicy (indiquez votre région et votre ID de compte dans le code suivant) :

- Créer une nouvelle stratégie gérée nommé

SageMakerAdminPolicy: - Créer un rôle IAM pour SageMaker pour l'ingénieur de données (data-engineer), qui est utilisé comme rôle d'exécution du profil utilisateur correspondant. Sur le Joindre la politique d'autorisations page, AmazonSageMakerFullAccess (stratégie gérée par AWS) est attaché par défaut. Vous supprimerez cette stratégie ultérieurement pour conserver un privilège minimum.

- Pour Nom de rôle, utilisez la convention de dénomination présentée au début de cette section pour nommer le rôle SageMakerStudioExecutionRole_data-engineer.

- Pour Tags, ajoutez la clé userprofilename et la valeur data-engineer.

- Selectionnez Créer un rôle.

- Pour ajouter les stratégies restantes, sur le Rôles page, choisissez le nom du rôle que vous venez de créer.

- Sous Permissions, supprimez la stratégie AmazonSageMakerFullAccess.

- Sur le Joindre la politique d'autorisations , sélectionnez la stratégie gérée AWS AwsGlueSessionUserRestrictedServiceRole et les stratégies gérées par le client SageMakerExecutionPolicy et SageMakerAdminPolicy que vous avez créées.

- Selectionnez Joindre des politiques.

- modifier la relation d'approbation de votre rôle :

- Créer un rôle IAM pour SageMaker pour le data scientist (data-scientist), qui est utilisé comme rôle d'exécution du profil utilisateur correspondant.

- Pour Nom de rôle, nommez le rôle SageMakerStudioExecutionRole_data-scientist.

- Pour Tags, ajoutez la clé userprofilename et la valeur data-scientist.

- Selectionnez Créer un rôle.

- Pour ajouter les stratégies restantes, sur le Rôles page, choisissez le nom du rôle que vous venez de créer.

- Sous Permissions, supprimez la stratégie AmazonSageMakerFullAccess.

- Sur le Joindre la politique d'autorisations , sélectionnez la stratégie gérée AWS AwsGlueSessionUserRestrictedServiceRole et la stratégie gérée par le client SageMakerExecutionPolicy que vous avez créée.

- Selectionnez Joindre des politiques.

- modifier la relation d'approbation de votre rôle :

Configurer les profils utilisateur SageMaker

Pour créer vos profils d'utilisateurs SageMaker avec le studiouserid balise, procédez comme suit :

- Utilisez l'AWS CLI ou CloudShell pour créer le profil utilisateur Studio pour l'ingénieur de données (fournissez votre ID de compte et votre ID de domaine Studio dans le code suivant) :

- Répétez l'étape pour créer un profil utilisateur pour le data scientist, en remplaçant l'ID de compte et l'ID de domaine Studio :

Créer des compartiments S3 et charger l'exemple d'ensemble de données

Dans cette section, vous créez deux compartiments S3. Le premier compartiment contient un exemple d'ensemble de données lié au marketing Web. Le deuxième compartiment est utilisé par le scientifique des données pour stocker la sortie des tâches d'ingénierie des fonctionnalités, et cet ensemble de données de sortie est utilisé pour former le modèle ML.

Commencez par créer le bucket S3 pour les données d'entrée :

- Télécharger le jeu de données.

- Sur la console Amazon S3, choisissez Chapeaux cloche dans le volet de navigation.

- Selectionnez Créer un seau.

- Pour Région, choisissez la région avec le domaine SageMaker qui inclut les profils utilisateur que vous avez créés.

- Pour Nom du compartiment, Entrer

blog-studio-pii-dataset-. - Selectionnez Créer un seau.

- Sélectionnez le bucket que vous avez créé et choisissez Téléchargement.

- Dans le Sélectionnez les fichiers section, choisissez Ajouter des fichiers et téléchargez le jeu de données que vous avez téléchargé.

Vous allez maintenant créer le bucket pour les données de sortie : - Sur le Chapeaux cloche page, choisissez Créer un seau.

- Pour Région, choisissez la région avec le domaine SageMaker qui inclut les profils utilisateur que vous avez créés.

- Pour Nom du compartiment, Entrer

blog-studio-output-. - Selectionnez Créer un seau.

Créer une base de données et une table AWS Glue

Dans cette section, vous créez une base de données et une table AWS Glue pour l'ensemble de données.

- Sur la console Lake Formation, sous Catalogue de données dans le volet de navigation, choisissez Bases de données.

- Selectionnez Ajouter une base de données.

- Pour Nom, entrez la démo.

- Selectionnez Créer une base de données.

- Sous Catalogue de données, choisissez Tables.

- Pour Nom, Entrer

web_marketing. - Pour Base de données, sélectionnez

demo. - Pour Inclure le chemin, entrez le chemin de votre compartiment S3 pour les données d'entrée.

- Pour Classification, choisissez CSV.

- Sous Programme, choisissez Télécharger le schéma.

- Saisissez le tableau JSON suivant dans la zone de texte :

- Selectionnez Téléchargement.

- Selectionnez Envoyer.

- Sous Détails du tableau, choisissez Modifier le tableau.

- Sous Propriétés du tableau, choisissez Ajouter.

- Pour ACTIVITES, Entrer

skip.header.line.count, Et pour Valeur, entrez 1. - Selectionnez Épargnez.

Configurer les autorisations de Lake Formation

Dans cette section, vous configurez les autorisations de Lake Formation pour autoriser le rôle IAM SageMakerStudioExecutionRole_data-engineer pour créer une base de données et enregistrer l'emplacement S3 dans Lake Formation.

Tout d'abord, enregistrez l'emplacement du lac de données pour gérer les tables sous l'emplacement dans les autorisations Lake Formation :

- Selectionnez Emplacements des lacs de données.

- Selectionnez Enregistrer l'emplacement.

- Pour Chemin Amazon S3, Entrer

s3://blog-studio-pii-dataset-/(le compartiment qui contient l'ensemble de données). - Selectionnez Enregistrer l'emplacement.

Vous accordez maintenant des autorisations de base de données et de table Lake Formation aux rôles IAMSageMakerStudioExecutionRole_data-engineerainsi queSageMakerStudioExecutionRole_data-scientist.Tout d'abord, accordez l'autorisation de base de données pourSageMakerStudioExecutionRole_data-engineer: - Sous Permissions, choisissez Autorisations du lac de données.

- Sous Autorisation de données, choisissez Subvention.

- Pour Directeurs d'école, choisissez Utilisateurs et rôles IAM, et sélectionnez le rôle

SageMakerStudioExecutionRole_data-engineer. - Pour Balises avec stratégie ou ressources de catalogue, choisissez Ressources de catalogue de données nommées.

- Pour Bases de données, choisissez démo.

- Pour Autorisations de base de données, Sélectionner Super.

- Selectionnez Subvention.

Ensuite, accordez l'autorisation de table pourSageMakerStudioExecutionRole_data-engineer: - Sous Autorisation de données, choisissez Subvention.

- Pour Directeurs d'école, choisissez Utilisateurs et rôles IAM, et sélectionnez le rôle

SageMakerStudioExecutionRole_data-engineer. - Pour Balises avec stratégie ou ressources de catalogue, choisissez Ressources de catalogue de données nommées.

- Pour Bases de données, choisissez

demo. - Pour Tables, choisissez

web_marketing. - Pour lampe de table autorisations, Sélectionner Super.

- Pour Accordable autorisations, Sélectionner Super.

- Selectionnez Subvention.

Enfin, accordez l'autorisation de base de données pourSageMakerStudioExecutionRole_data-scientist: - Sous Autorisation de données, choisissez Subvention.

- Pour Directeurs d'école, choisissez Utilisateurs et rôles IAM, et sélectionnez le rôle

SageMakerStudioExecutionRole_data-scientist. - Pour Balises avec stratégie ou ressources de catalogue, choisissez Ressources de catalogue de données nommées.

- Pour Bases de données, choisissez

demo. - Pour Autorisations de base de données, Sélectionner Décrire.

- Selectionnez Subvention.

À propos des auteurs

Praveen Kumar est un architecte de solutions d'analyse chez AWS avec une expertise dans la conception, la construction et la mise en œuvre de plates-formes modernes de données et d'analyse utilisant des services cloud natifs. Ses domaines d'intérêt sont la technologie sans serveur, les entrepôts de données cloud modernes, le streaming et les applications ML.

Noritaka Sekiyama est architecte Big Data principal au sein de l'équipe AWS Glue. Il aime collaborer avec différentes équipes pour obtenir des résultats comme celui-ci. Dans ses temps libres, il aime jouer à des jeux vidéo avec sa famille.

- Avancé (300)

- AI

- art de l'IA

- générateur d'art ai

- robot IA

- Amazon Sage Maker

- intelligence artificielle

- certification en intelligence artificielle

- intelligence artificielle en banque

- robot d'intelligence artificielle

- robots d'intelligence artificielle

- logiciel d'intelligence artificielle

- Big Data AWS

- Colle AWS

- Formation AWS Lake

- Apprentissage automatique AWS

- blockchain

- conférence blockchain ai

- cognitif

- intelligence artificielle conversationnelle

- crypto conférence ai

- de dall

- l'apprentissage en profondeur

- google ai

- machine learning

- Platon

- platon ai

- Intelligence des données Platon

- Jeu de Platon

- PlatonDonnées

- jeu de platogamie

- échelle ai

- syntaxe

- leadership éclairé

- zéphyrnet