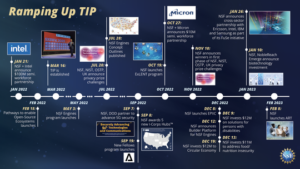

Le mois dernier, le programme Networking and Information Technology Research and Development (NITRD) a célébré son 30e anniversaire à Washington DC Vous pouvez lire le récapitulatif complet de l'événement ici. Afin de souligner l'impact des investissements fédéraux sur la communauté de la recherche en informatique, l'événement comprenait cinq panels au cours desquels les participants ont discuté des principales réalisations dans le domaine au cours de la dernière décennie et des orientations futures. Chaque panel s'est concentré sur un sous-domaine important de la recherche informatique : l'informatique à grande échelle, les réseaux et la sécurité, l'intelligence artificielle/l'apprentissage automatique, la confidentialité et l'Internet des objets et l'informatique socialement responsable.

La confidentialité est devenue un énorme sujet de conversation non seulement au sein de la communauté de la recherche informatique, mais dans toutes les disciplines, tant dans le milieu universitaire que dans l'industrie. Les effets négatifs sur la vie privée découlant de la disponibilité d'ensembles de données à grande échelle sont multipliés par la capteurs, dispositifs et actionneurs interconnectés qui composent l'Internet des objets (IoT). Modéré par Charles ("Chuck") Romine (NIST) et mettant en vedette les experts de terrain Ed Felten (Princeton), Marc Groman (Groman Consulting), Katerina Megas (NIST) et Sunoo Park (Cornell), Panel 4 : Confidentialité et IdO aborde des sujets importants tels que les compromis entre l'utilisation des données et la confidentialité et les objectifs de recherche potentiels pour aider à trouver des solutions politiques efficaces.

Romine a commencé par souligner un fil conducteur dans tous les panels : "parler à la fois des avantages et des capacités extraordinaires offertes par les investissements de financement fédéraux, ainsi que des risques associés". L'IdO n'est pas différent, il permet aux gens d'accéder à des informations insurmontables, permet des campagnes publicitaires réussies et adapte la technologie à vos goûts personnels, mais il met également en péril la vie privée des utilisateurs.

Comme l'a souligné Megas, "la raison pour laquelle nous entreprenons cet effort est que nous voulons être en mesure de voir l'IoT reconnu et que la société en récolte les bénéfices". Elle a ensuite partagé les avantages potentiels et l'importance de pouvoir partager des données via l'IoT. Il existe une échelle «phénoménale» d'appareils dans l'IoT qui peuvent être utilisés pour identifier les problèmes dans les ensembles de données, apprendre des choses qui ont un fort potentiel d'impact pour les individus et la société, former des technologies d'intelligence artificielle et permettre aux petites entreprises innovantes de tester leurs appareils. Romine a demandé aux panélistes quels sont réellement les risques associés à la vie privée dans ce contexte d'IdO et de partage d'informations.

Groman a répondu en expliquant d'abord l'interaction entre la confidentialité et l'IdO. Le côté confidentialité de l'IdO est un sous-ensemble de données au sein de l'ensemble plus large collecté, c'est-à-dire sur ou relatif aux personnes. Les gens savent-ils que des données sont collectées à leur sujet ? Existe-t-il une interface où vous pouvez interagir avec l'appareil, savoir ce qu'il collecte ou le modifier ? Les gens comprennent-ils quelles informations sont collectées ou quelles déductions sont faites par l'appareil ou l'entreprise à partir des données collectées ? En raison de la structure des incitations monétaires et de la "vaste" somme que les entreprises peuvent tirer de la capitalisation de ces données, Groman a exhorté les gens à se tourner vers la politique pour trouver une solution.

« Le but ici est de maximiser les avantages et de minimiser les dommages. Nous n'avons pas de cadre politique, juridique ou réglementaire dans ce pays qui incite à y arriver » - Marc Groman

Contre la position de Groman, Romine a interrogé le panel sur le potentiel d'une solution technologique.

Felten a suggéré que nous commencions par chercher à mieux comprendre et appliquer le contrôle des informations statistiques et à créer des outils qui permettent aux gens d'interagir avec leurs données et d'atténuer les impacts négatifs. Park, qui s'intéresse particulièrement aux outils de confidentialité cryptographique, a nommé un certain nombre de façons dont la cryptographie pourrait aider à cet égard.

"La cryptographie fournit une boîte à outils pour construire des systèmes qui ont des configurations de flux d'informations et incluent un contrôle plus fin de l'accès". – Parc Sunoo

L'un des outils pourrait être les preuves à connaissance nulle, qui permettent le partage partiel des données tout en gardant d'autres aspects secrets des entités. Elle a donné l'exemple d'un videur vérifiant les pièces d'identité pour entrer dans un bar - grâce à des preuves sans connaissance, vous pouvez prouver que vous avez 21 ans sans partager votre adresse ou votre date de naissance également indiquée sur la pièce d'identité.

Park a averti que si la cryptographie fournit "un espace de solution plus large que nous pouvons utiliser pour renforcer la confidentialité", elle ne répond pas à la question de savoir quels types de choses nous devrions construire à l'aide de ces outils, ou quelles formes d'informations nous considérons appropriées ou souhaitables à partager. C'est quelque chose que nous devons régler en tant que société et une question de politique.

Enfin, on a demandé aux panélistes pourquoi les gens devraient s'en soucier. Et s'ils n'avaient rien à cacher ? Gagnant un rire de la foule, Felten a plaisanté en disant que tout le monde avait quelque chose à cacher. Dans une note plus sérieuse, il a continué à souligner le préjudice potentiel du profilage des données.

"Les gens construisent un modèle complet de qui vous êtes et de ce que vous êtes susceptible de faire." –Ed Felten

Déjà une pensée terrifiante, ces hypothèses peuvent être erronées et parfois limiter les opportunités et la « liberté d'action » à l'avenir. Groman a souligné un autre fil conducteur tout au long des discussions des panels - l'importance de réaliser que certaines communautés sont touchées de manière disproportionnée. Les enjeux peuvent être plus importants pour garder certaines données privées, que ce soit pour l'orientation sexuelle, le sexe, la race ou les femmes ou les enfants maltraités.

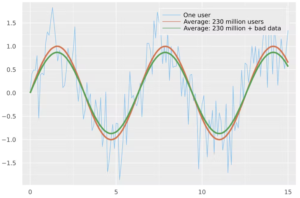

Au cours de la séance de questions-réponses, l'ancien conférencier du panel 3, Ben Zorn, est revenu sur les avantages de l'utilisation des données pour former l'IA. Il a demandé ce qui pouvait être fait en cas de fuite d'informations privées via les ensembles de données utilisés pour former l'IA.

Felten a souligné qu'à moins que vous n'utilisiez une méthode rigoureuse pour arrêter intentionnellement le ruissellement de l'information, l'information va circuler. C'est pourquoi il est si important de se concentrer sur la création de méthodes rigoureuses et démontrables telles que l'apprentissage automatique préservant la confidentialité et les interfaces pour contrôler l'effet de ruissellement.

Megas l'a parfaitement résumé, qu'au final on ne peut pas former tout le monde, mais on peut fournir aux gens un cadre qui leur permet de réfléchir au risque et leur donner des outils pour mieux contrôler leurs données. Vous pouvez regarder l'enregistrement complet sur le Page web du CCC ou Chaîne YouTube du NITRD.

Soyez à l'affût du dernier blog de la série, Panel 5 : Comment la technologie peut profiter à la société : Élargir les perspectives de la recherche fondamentale.