La source: rawpixel.com

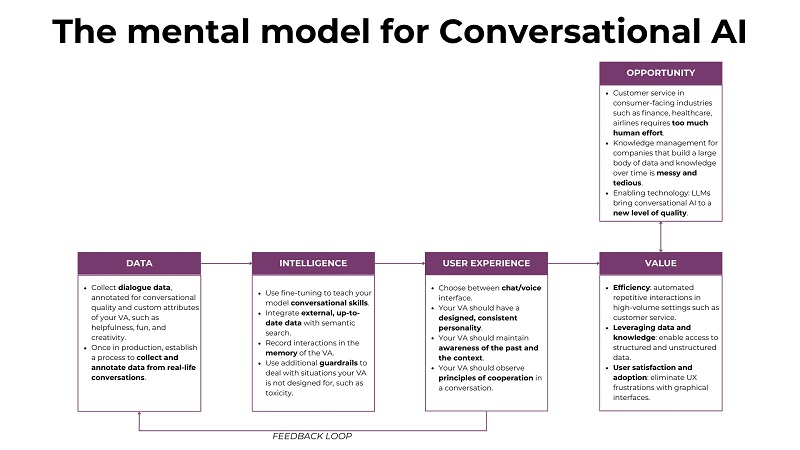

L'IA conversationnelle est une application des LLM qui a suscité beaucoup de buzz et d'attention en raison de son évolutivité dans de nombreux secteurs et cas d'utilisation. Bien que les systèmes conversationnels existent depuis des décennies, les LLM ont apporté l’impulsion de qualité nécessaire à leur adoption à grande échelle. Dans cet article, nous utiliserons le modèle mental présenté dans la figure 1 pour décortiquer les applications d'IA conversationnelle (cf. Créer des produits d'IA avec un modèle mental holistique pour une introduction au modèle mental). Après avoir examiné les opportunités de marché et la valeur commerciale des systèmes d'IA conversationnelle, nous expliquerons les « machines » supplémentaires en termes de données, de réglage fin du LLM et de conception conversationnelle qui doivent être mises en place pour rendre les conversations non seulement possibles mais également utiles. et agréable.

1. Opportunité, valeur et limites

La conception UX traditionnelle est construite autour d’une multitude d’éléments UX artificiels, de balayages, de tapotements et de clics, nécessitant une courbe d’apprentissage pour chaque nouvelle application. Grâce à l’IA conversationnelle, nous pouvons supprimer cette activité en la remplaçant par l’expérience élégante d’une conversation naturellement fluide dans laquelle nous pouvons oublier les transitions entre les différentes applications, fenêtres et appareils. Nous utilisons le langage, notre protocole de communication universel et familier, pour interagir avec différents assistants virtuels (AV) et accomplir nos tâches.

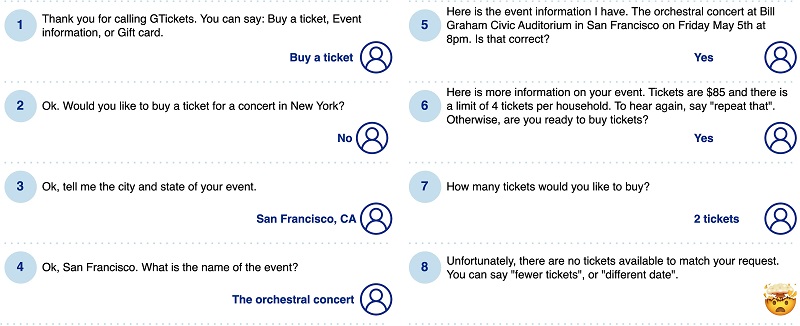

Les interfaces utilisateur conversationnelles ne sont pas exactement la nouvelle tendance. Les systèmes de réponse vocale interactive (RVI) et les chatbots existent depuis les années 1990, et les progrès majeurs de la PNL ont été suivis de près par des vagues d'espoir et de développement des interfaces vocales et de chat. Cependant, avant l’époque des LLM, la plupart des systèmes étaient implémentés selon le paradigme symbolique, s’appuyant sur des règles, des mots-clés et des modèles de conversation. Ils étaient également limités à un domaine de « compétence » spécifique et prédéfini, et les utilisateurs qui s’aventuraient en dehors de ceux-ci se retrouveraient bientôt dans une impasse. Dans l’ensemble, ces systèmes présentaient des points de défaillance potentiels et, après quelques tentatives frustrantes, de nombreux utilisateurs n’y sont jamais revenus. La figure suivante illustre un exemple de dialogue. Un utilisateur qui souhaite commander des billets pour un concert spécifique passe patiemment par un flux d'interrogations détaillé, pour découvrir à la fin que le concert est complet.

En tant que technologie habilitante, les LLM peuvent amener les interfaces conversationnelles à de nouveaux niveaux de qualité et de satisfaction des utilisateurs. Les systèmes conversationnels peuvent désormais afficher une connaissance du monde, une compétence linguistique et une capacité conversationnelle beaucoup plus larges. Tirant parti de modèles pré-entraînés, ils peuvent également être développés dans des délais beaucoup plus courts puisque le travail fastidieux de compilation de règles, de mots-clés et de flux de dialogue est désormais remplacé par les connaissances statistiques du LLM. Examinons deux applications importantes dans lesquelles l'IA conversationnelle peut apporter de la valeur à grande échelle :

- Service client et, plus généralement, les applications utilisées par un grand nombre d'utilisateurs qui formulent souvent des demandes similaires. Ici, l’entreprise fournissant le support client dispose d’un net avantage en matière d’information sur l’utilisateur et peut en tirer parti pour créer une expérience utilisateur plus intuitive et plus agréable. Prenons le cas d’une nouvelle réservation d’un vol. Pour moi, un voyageur plutôt fréquent, c'est quelque chose qui arrive 1 à 2 fois par an. Entre les deux, j’ai tendance à oublier les détails du processus, sans parler de l’interface utilisateur d’une compagnie aérienne spécifique. En revanche, le service client de la compagnie aérienne place les demandes de modification de réservation au premier plan de ses opérations. Au lieu d'exposer le processus de nouvelle réservation via une interface graphique complexe, sa logique peut être « cachée » aux clients qui contactent le support, et ils peuvent utiliser le langage comme canal naturel pour effectuer leur nouvelle réservation. Bien sûr, il restera encore une « longue traîne » de demandes moins familières. Par exemple, imaginez un changement d’humeur spontané qui pousse un client professionnel à ajouter son chien bien-aimé comme excédent de bagage sur un vol réservé. Ces demandes plus individuelles peuvent être transmises à des agents humains ou couvertes via un système interne de gestion des connaissances connecté à l'assistant virtuel.

- Gestion des connaissances qui repose sur une grande quantité de données. Pour de nombreuses entreprises modernes, les connaissances internes qu’elles accumulent au fil des années d’exploitation, d’itération et d’apprentissage constituent un atout essentiel et un différenciateur – si elles sont stockées, gérées et accessibles de manière efficace. S'appuyant sur une multitude de données cachées dans les outils de collaboration, les wikis internes, les bases de connaissances, etc., ils ne parviennent souvent pas à les transformer en connaissances exploitables. À mesure que les employés partent, de nouveaux employés sont intégrés et vous ne parvenez jamais à finaliser cette page de documentation que vous avez commencée il y a trois mois, des connaissances précieuses sont victimes de l'entropie. Il devient de plus en plus difficile de se frayer un chemin dans le labyrinthe interne des données et de mettre la main sur les informations nécessaires dans une situation commerciale spécifique. Cela entraîne d’énormes pertes d’efficacité pour les travailleurs du savoir. Pour résoudre ce problème, nous pouvons augmenter les LLM avec une recherche sémantique sur les sources de données internes. Les LLM permettent d'utiliser des questions en langage naturel au lieu de requêtes formelles complexes pour poser des questions sur cette base de données. Les utilisateurs peuvent ainsi se concentrer sur leurs besoins d'information plutôt que sur la structure de la base de connaissances ou la syntaxe d'un langage de requête tel que SQL. Étant basés sur du texte, ces systèmes fonctionnent avec des données dans un espace sémantique riche, établissant des liens significatifs « sous le capot ».

Au-delà de ces domaines d'application majeurs, il existe de nombreuses autres applications, telles que la télésanté, les assistants en santé mentale et les chatbots éducatifs, qui peuvent rationaliser l'UX et apporter de la valeur à leurs utilisateurs de manière plus rapide et plus efficace.

Si ce contenu éducatif approfondi vous est utile, vous pouvez abonnez-vous à notre liste de diffusion de recherche sur l'IA d'être alerté lorsque nous publierons du nouveau matériel.

2. Les données

Les LLM ne sont à l'origine pas formés pour s'engager dans des bavardages fluides ou des conversations plus substantielles. Au lieu de cela, ils apprennent à générer le jeton suivant à chaque étape d’inférence, aboutissant finalement à un texte cohérent. Cet objectif de bas niveau est différent du défi de la conversation humaine. La conversation est incroyablement intuitive pour les humains, mais elle devient incroyablement complexe et nuancée lorsque vous souhaitez apprendre à une machine à le faire. Par exemple, regardons la notion fondamentale d'intentions. Lorsque nous utilisons un langage, nous le faisons dans un but spécifique, qui est notre intention de communication : il peut s'agir de transmettre des informations, de socialiser ou de demander à quelqu'un de faire quelque chose. Alors que les deux premiers sont plutôt simples pour un LLM (à condition qu'il ait vu les informations requises dans les données), le second est déjà plus difficile. Non seulement le LLM doit combiner et structurer les informations associées de manière cohérente, mais il doit également donner le bon ton émotionnel en termes de critères souples tels que la formalité, la créativité, l'humour, etc. C'est un défi pour le design conversationnel. (cf. section 5), qui est étroitement liée à la tâche de création de données de mise au point.

Faire la transition de la génération de langage classique à la reconnaissance et à la réponse à des intentions de communication spécifiques est une étape importante vers une meilleure convivialité et acceptation des systèmes conversationnels. Comme pour tous les efforts de réglage fin, cela commence par la compilation d’un ensemble de données approprié.

Les données de réglage fin doivent être aussi proches que possible de la (future) distribution des données du monde réel. Premièrement, il doit s’agir de données conversationnelles (dialogue). Deuxièmement, si votre assistant virtuel est spécialisé dans un domaine spécifique, vous devez essayer de rassembler des données de mise au point qui reflètent les connaissances nécessaires du domaine. Troisièmement, s'il existe des flux et des demandes typiques qui seront récurrents dans votre application, comme dans le cas du support client, essayez d'en incorporer des exemples variés dans vos données de formation. Le tableau suivant présente un échantillon de données de réglage fin de la conversation provenant du Ensemble de données de conversations 3K pour ChatBot, qui est disponible gratuitement sur Kaggle :

La création manuelle de données conversationnelles peut devenir une entreprise coûteuse : le crowdsourcing et l'utilisation de LLM pour vous aider à générer des données sont deux façons d'évoluer. Une fois les données de dialogue collectées, les conversations doivent être évaluées et annotées. Cela vous permet de montrer des exemples à la fois positifs et négatifs à votre modèle et de l'inciter à reprendre les caractéristiques des « bonnes » conversations. L'évaluation peut se faire soit avec des scores absolus, soit avec un classement de différentes options entre elles. Cette dernière approche conduit à un réglage plus précis des données, car les humains sont généralement plus à même de classer plusieurs options que de les évaluer isolément.

Une fois vos données en place, vous êtes prêt à affiner votre modèle et à l'enrichir de fonctionnalités supplémentaires. Dans la section suivante, nous examinerons les réglages fins, l'intégration d'informations supplémentaires provenant de la mémoire et de la recherche sémantique, et la connexion des agents à votre système conversationnel pour lui permettre d'exécuter des tâches spécifiques.

3. Assemblage du système conversationnel

Un système conversationnel typique est construit avec un agent conversationnel qui orchestre et coordonne les composants et les capacités du système, tels que le LLM, la mémoire et les sources de données externes. Le développement de systèmes d'IA conversationnelle est une tâche hautement expérimentale et empirique, et vos développeurs seront dans un va-et-vient constant entre l'optimisation de vos données, l'amélioration de la stratégie de réglage fin, le jeu avec des composants et des améliorations supplémentaires et le test des résultats. . Les membres non techniques de l'équipe, notamment les chefs de produit et les concepteurs UX, testeront également en permanence le produit. Grâce à leurs activités de découverte de clients, ils sont bien placés pour anticiper le style et le contenu des conversations des futurs utilisateurs et devraient contribuer activement à ces connaissances.

3.1 Enseigner les compétences de conversation à votre LLM

Pour le réglage fin, vous avez besoin de vos données de réglage fin (cf. section 2) et d'un LLM pré-entraîné. Les LLM en savent déjà beaucoup sur la langue et le monde, et notre défi est de leur enseigner les principes de la conversation. Lors du réglage fin, les sorties cibles sont des textes, et le modèle sera optimisé pour générer des textes aussi similaires que possible aux cibles. Pour un réglage fin supervisé, vous devez d’abord définir clairement la tâche d’IA conversationnelle que vous souhaitez que le modèle exécute, rassembler les données, puis exécuter et parcourir le processus de réglage fin.

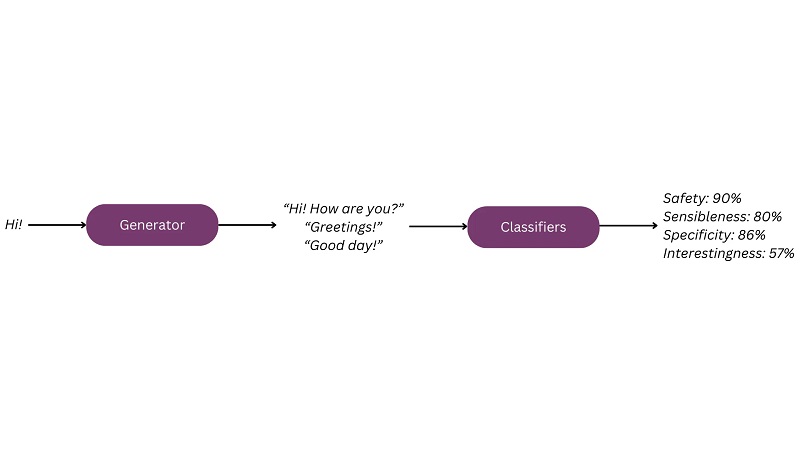

Avec le battage médiatique autour des LLM, diverses méthodes de réglage ont émergé. Pour un exemple plutôt traditionnel de réglage fin de la conversation, vous pouvez vous référer à la description du modèle LaMDA.[1] LaMDA a été affiné en deux étapes. Premièrement, les données de dialogue sont utilisées pour enseigner au modèle des compétences conversationnelles (réglage « génératif »). Ensuite, les étiquettes produites par les annotateurs lors de l'évaluation des données sont utilisées pour former des classificateurs capables d'évaluer les résultats du modèle en fonction des attributs souhaités, notamment la sensibilité, la spécificité, l'intérêt et la sécurité (réglage fin « discriminant »). Ces classificateurs sont ensuite utilisés pour orienter le comportement du modèle vers ces attributs.

De plus, le fondement factuel – la capacité de fonder leurs résultats sur des informations externes crédibles – est un attribut important des LLM. Pour garantir le fondement factuel et minimiser les hallucinations, LaMDA a été affiné avec un ensemble de données qui implique des appels à un système de recherche d'informations externe chaque fois que des connaissances externes sont requises. Ainsi, le modèle a appris à récupérer d’abord des informations factuelles chaque fois que l’utilisateur effectuait une requête nécessitant de nouvelles connaissances.

Une autre technique de réglage fin populaire est l’apprentissage par renforcement à partir de la rétroaction humaine (RLHF)[2]. RLHF « redirige » le processus d'apprentissage du LLM de la tâche de prédiction du prochain jeton simple mais artificielle vers l'apprentissage des préférences humaines dans une situation de communication donnée. Ces préférences humaines sont directement codées dans les données de formation. Au cours du processus d'annotation, les humains reçoivent des invites et écrivent la réponse souhaitée ou classent une série de réponses existantes. Le comportement du LLM est ensuite optimisé pour refléter les préférences humaines.

3.2 Ajout de données externes et recherche sémantique

Au-delà de la compilation des conversations pour affiner le modèle, vous souhaiterez peut-être améliorer votre système avec des données spécialisées qui peuvent être exploitées au cours de la conversation. Par exemple, votre système peut avoir besoin d'accéder à des données externes, telles que des brevets ou des articles scientifiques, ou à des données internes, telles que des profils clients ou votre documentation technique. Cela se fait normalement via une recherche sémantique (également connue sous le nom de génération augmentée par récupération, ou RAG)[3]. Les données supplémentaires sont enregistrées dans une base de données sous forme de plongements sémantiques (cf. cet article pour une explication des intégrations et des références supplémentaires). Lorsque la demande de l'utilisateur arrive, elle est prétraitée et transformée en une intégration sémantique. La recherche sémantique identifie ensuite les documents les plus pertinents pour la demande et les utilise comme contexte pour l'invite. En intégrant des données supplémentaires à la recherche sémantique, vous pouvez réduire les hallucinations et fournir des réponses plus utiles et fondées sur des faits. En mettant continuellement à jour la base de données d'intégration, vous pouvez également maintenir à jour les connaissances et les réponses de votre système sans avoir à réexécuter constamment votre processus de réglage fin.

3.3 Mémoire et conscience du contexte

Imaginez aller à une fête et rencontrer Peter, un avocat. Vous êtes enthousiasmé et commencez à présenter le chatbot légal que vous envisagez actuellement de créer. Peter a l'air intéressé, se penche vers vous, euh et hoche la tête. À un moment donné, vous voulez son avis pour savoir s'il souhaite utiliser votre application. Au lieu d’une déclaration informative qui compenserait votre éloquence, vous entendez : « Euh… qu’est-ce que cette application faisait encore ?

Le contrat non écrit de communication entre humains présuppose que nous écoutons nos interlocuteurs et construisons nos propres actes de langage sur le contexte que nous co-créons au cours de l’interaction. Dans les contextes sociaux, l’émergence de cette compréhension commune caractérise une conversation fructueuse et enrichissante. Dans des contextes plus banals comme réserver une table au restaurant ou acheter un billet de train, c'est une nécessité absolue pour accomplir la tâche et apporter la valeur attendue à l'utilisateur. Cela nécessite que votre assistant connaisse l'historique de la conversation en cours, mais également des conversations passées. Par exemple, il ne doit pas demander sans cesse le nom et d'autres informations personnelles d'un utilisateur chaque fois qu'il initie une conversation.

L'un des défis du maintien de la conscience du contexte est la résolution de coréférence, c'est-à-dire comprendre à quels objets font référence les pronoms. Les humains utilisent intuitivement de nombreux indices contextuels lorsqu'ils interprètent le langage. Par exemple, vous pouvez demander à un jeune enfant : « S'il vous plaît, sortez la balle verte de la boîte rouge et apportez-la-moi », et l'enfant saura que vous pensez à la balle. , pas la boîte. Pour les assistants virtuels, cette tâche peut s’avérer plutôt difficile, comme l’illustre le dialogue suivant :

Assistants : Merci, je vais maintenant réserver votre vol. Souhaitez-vous également commander un repas pour votre vol ?

Utilisateur: Euh… puis-je décider plus tard si je le veux ?

Assistants : Désolé, ce vol ne peut pas être modifié ou annulé ultérieurement.

Ici, l'assistant ne parvient pas à reconnaître que le pronom it de l'utilisateur ne fait pas référence au vol, mais au repas, nécessitant ainsi une autre itération pour résoudre ce malentendu.

3.4 Garde-corps supplémentaires

De temps en temps, même le meilleur LLM se comporte mal et hallucine. Dans de nombreux cas, les hallucinations sont de simples problèmes de précision – et vous devez accepter qu’aucune IA n’est précise à 100 %. Par rapport à d’autres systèmes d’IA, la « distance » entre l’utilisateur et l’IA est plutôt faible entre l’utilisateur et l’IA. Un simple problème de précision peut rapidement se transformer en quelque chose qui est perçu comme toxique, discriminant ou généralement nuisible. De plus, comme les LLM n'ont pas de compréhension inhérente de la confidentialité, ils peuvent également révéler des données sensibles telles que des informations personnellement identifiables (PII). Vous pouvez lutter contre ces comportements en utilisant des garde-fous supplémentaires. Des outils tels que Guardrails AI, Rebuff, NeMo Guardrails et Microsoft Guidance vous permettent de réduire les risques de votre système en formulant des exigences supplémentaires sur les sorties LLM et en bloquant les sorties indésirables.

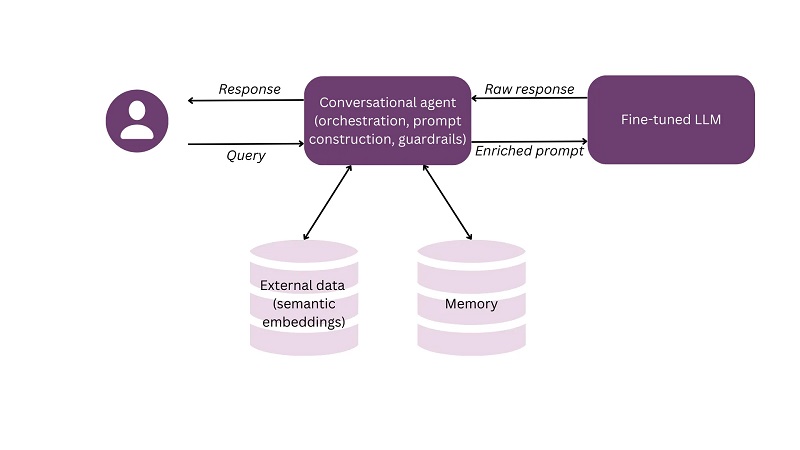

Plusieurs architectures sont possibles dans l’IA conversationnelle. Le schéma suivant montre un exemple simple de la façon dont le LLM affiné, les données externes et la mémoire peuvent être intégrés par un agent conversationnel, qui est également responsable de la construction des invites et des garde-corps.

4. Expérience utilisateur et conception conversationnelle

Le charme des interfaces conversationnelles réside dans leur simplicité et leur uniformité entre les différentes applications. Si l’avenir des interfaces utilisateur est que toutes les applications se ressemblent plus ou moins, le travail du concepteur UX est-il voué à l’échec ? Certainement pas : la conversation est un art à enseigner à votre LLM afin qu'il puisse mener des conversations utiles, naturelles et confortables pour vos utilisateurs. Une bonne conception conversationnelle émerge lorsque nous combinons nos connaissances en psychologie humaine, en linguistique et en conception UX. Dans ce qui suit, nous considérerons d'abord deux choix fondamentaux lors de la construction d'un système conversationnel, à savoir si vous utiliserez la voix et/ou le chat, ainsi que le contexte plus large de votre système. Ensuite, nous examinerons les conversations elles-mêmes et verrons comment vous pouvez façonner la personnalité de votre assistant tout en lui apprenant à s'engager dans des conversations utiles et coopératives.

4.1 Voix contre chat

Les interfaces conversationnelles peuvent être mises en œuvre par chat ou par voix. En un mot, la voix est plus rapide tandis que le chat permet aux utilisateurs de rester privés et de bénéficier de fonctionnalités d'interface utilisateur enrichies. Examinons un peu plus en profondeur les deux options, car il s'agit de l'une des premières et des plus importantes décisions auxquelles vous serez confronté lors de la création d'une application conversationnelle.

Pour choisir entre les deux alternatives, commencez par considérer le cadre physique dans lequel votre application sera utilisée. Par exemple, pourquoi presque tous les systèmes conversationnels embarqués dans les voitures, comme ceux proposés par Nuance Communications, sont-ils basés sur la voix ? Parce que les mains du conducteur sont déjà occupées et qu'il ne peut pas constamment basculer entre le volant et un clavier. Cela s'applique également à d'autres activités comme la cuisine, où les utilisateurs souhaitent rester dans le flux de leur activité tout en utilisant votre application. Les voitures et les cuisines sont pour la plupart des lieux privés, de sorte que les utilisateurs peuvent profiter de la joie de l'interaction vocale sans se soucier de leur vie privée ni de déranger les autres. En revanche, si votre application doit être utilisée dans un lieu public comme un bureau, une bibliothèque ou une gare, la voix n'est peut-être pas votre premier choix.

Après avoir compris le cadre physique, considérez le côté émotionnel. La voix peut être utilisée intentionnellement pour transmettre le ton, l’humeur et la personnalité : cela ajoute-t-il de la valeur dans votre contexte ? Si vous créez votre application pour vos loisirs, la voix peut augmenter le facteur de plaisir, tandis qu'un assistant pour la santé mentale pourrait accueillir plus d'empathie et permettre à un utilisateur potentiellement en difficulté un plus grand diapason d'expression. En revanche, si votre application doit aider les utilisateurs dans un cadre professionnel comme le trading ou le service client, une interaction textuelle plus anonyme pourrait contribuer à des décisions plus objectives et vous éviter d'avoir à concevoir une expérience trop émotionnelle.

Dans la prochaine étape, pensez à la fonctionnalité. L'interface textuelle vous permet d'enrichir les conversations avec d'autres médias comme des images et des éléments graphiques de l'interface utilisateur tels que des boutons. Par exemple, dans un assistant de commerce électronique, une application qui suggère des produits en publiant leurs images et leurs descriptions structurées sera bien plus conviviale qu'une application qui décrit les produits par la voix et fournit potentiellement leurs identifiants.

Enfin, parlons des défis supplémentaires en matière de conception et de développement liés à la création d'une interface utilisateur vocale :

- Il existe une étape supplémentaire de reconnaissance vocale qui se produit avant que les entrées de l'utilisateur puissent être traitées avec les LLM et le traitement du langage naturel (NLP).

- La voix est un moyen de communication plus personnel et émotionnel. Ainsi, les exigences pour concevoir une personnalité cohérente, appropriée et agréable derrière votre assistant virtuel sont plus élevées, et vous devrez prendre en compte des facteurs supplémentaires de « conception vocale » tels que le timbre. , le stress, le ton et la vitesse de parole.

- Les utilisateurs s'attendent à ce que votre conversation vocale se déroule à la même vitesse qu'une conversation humaine. Pour proposer une interaction naturelle via la voix, il faut une latence bien plus courte que pour le chat. Dans les conversations humaines, l'intervalle typique entre les tours est de 200 millisecondes. Cette réponse rapide est possible parce que nous commençons à construire nos tours tout en écoutant le discours de notre partenaire. Votre assistant vocal devra correspondre à ce degré de maîtrise de l’interaction. En revanche, pour les chatbots, vous êtes en concurrence avec des durées de quelques secondes, et certains développeurs introduisent même un délai supplémentaire pour que la conversation ressemble à une conversation dactylographiée entre humains.

- La communication vocale est une entreprise linéaire et ponctuelle : si votre utilisateur n'a pas compris ce que vous avez dit, vous vous retrouvez dans une boucle de clarification fastidieuse et sujette aux erreurs. Ainsi, vos tours doivent être aussi concis, clairs et informatifs que possible.

Si vous optez pour la solution vocale, assurez-vous non seulement que vous comprenez clairement les avantages par rapport au chat, mais que vous disposez également des compétences et des ressources nécessaires pour relever ces défis supplémentaires.

4.2 Où vivra votre IA conversationnelle ?

Considérons maintenant le contexte plus large dans lequel vous pouvez intégrer l’IA conversationnelle. Nous connaissons tous les chatbots sur les sites Web des entreprises, ces widgets situés à droite de votre écran qui apparaissent lorsque nous ouvrons le site Web d'une entreprise. Personnellement, le plus souvent, ma réaction intuitive est de rechercher le bouton Fermer. Pourquoi donc? Grâce aux premières tentatives de « conversation » avec ces robots, j’ai appris qu’ils ne pouvaient pas satisfaire des exigences d’information plus spécifiques et qu’en fin de compte, je devais encore parcourir le site Web. La morale de l'histoire? Ne créez pas un chatbot parce qu'il est cool et tendance, mais plutôt parce que vous êtes sûr qu'il peut créer de la valeur supplémentaire pour vos utilisateurs.

Au-delà du widget controversé sur le site Web d'une entreprise, il existe plusieurs contextes passionnants pour intégrer ces chatbots plus généraux devenus possibles avec les LLM :

- Copilotes: Ces assistants vous guident et vous conseillent à travers des processus et tâches spécifiques, comme GitHub CoPilot pour la programmation. Normalement, les copilotes sont « liés » à une application spécifique (ou à une petite suite d’applications connexes).

- Humains synthétiques (également les humains numériques) : Ces créatures « imitent » les vrais humains dans le monde numérique. Ils ressemblent, agissent et parlent comme des humains et ont donc également besoin de riches capacités de conversation. Les humains synthétiques sont souvent utilisés dans des applications immersives telles que les jeux et la réalité augmentée et virtuelle.

- Jumeaux numériques: Les jumeaux numériques sont des « copies » numériques de processus et d'objets du monde réel, tels que des usines, des voitures ou des moteurs. Ils sont utilisés pour simuler, analyser et optimiser la conception et le comportement de l'objet réel. Les interactions en langage naturel avec les jumeaux numériques permettent un accès plus fluide et plus polyvalent aux données et aux modèles.

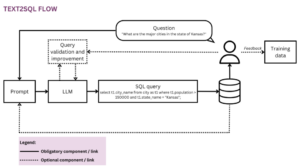

- Bases de données: De nos jours, les données sont disponibles sur n'importe quel sujet, qu'il s'agisse de recommandations d'investissement, d'extraits de code ou de matériel pédagogique. Ce qui est souvent difficile, c’est de trouver les données très spécifiques dont les utilisateurs ont besoin dans une situation spécifique. Les interfaces graphiques des bases de données sont soit trop grossières, soit couvertes de widgets de recherche et de filtrage sans fin. Les langages de requête polyvalents tels que SQL et GraphQL ne sont accessibles qu'aux utilisateurs possédant les compétences correspondantes. Les solutions conversationnelles permettent aux utilisateurs d'interroger les données en langage naturel, tandis que le LLM qui traite les requêtes les convertit automatiquement dans le langage d'interrogation correspondant (cf. cet article pour une explication de Text2SQL).

4.3 Imprimez une personnalité à votre assistant

En tant qu'humains, nous sommes programmés pour anthropomorphiser, c'est-à-dire pour infliger des traits humains supplémentaires lorsque nous voyons quelque chose qui ressemble vaguement à un humain. Le langage est l’une des capacités les plus uniques et les plus fascinantes de l’humanité, et les produits conversationnels seront automatiquement associés aux humains. Les gens imagineront une personne derrière leur écran ou leur appareil – et il est recommandé de ne pas laisser cette personne spécifique au hasard de l'imagination de vos utilisateurs, mais plutôt de lui donner une personnalité cohérente et alignée avec votre produit et votre marque. Ce processus est appelé « conception de personnalité ».

La première étape de la conception d’un personnage consiste à comprendre les traits de caractère que vous souhaitez que votre personnage affiche. Idéalement, cela se fait déjà au niveau des données de formation — par exemple, lorsque vous utilisez RLHF, vous pouvez demander à vos annotateurs de classer les données selon des traits comme la serviabilité, la politesse, l'amusement, etc., afin d'orienter le modèle vers les caractéristiques souhaitées. Ces caractéristiques peuvent être associées aux attributs de votre marque pour créer une image cohérente qui promeut continuellement votre image de marque via l'expérience produit.

Au-delà des caractéristiques générales, vous devez également réfléchir à la manière dont votre assistant virtuel va gérer des situations spécifiques au-delà du « chemin du bonheur ». Par exemple, comment va-t-il répondre aux demandes des utilisateurs qui dépassent sa portée, répondre aux questions sur lui-même et gérer les propos injurieux ou vulgaires ?

Il est important de développer des directives internes explicites sur votre personnalité qui peuvent être utilisées par les annotateurs de données et les concepteurs de conversations. Cela vous permettra de concevoir votre persona de manière ciblée et de le maintenir cohérent au sein de votre équipe et au fil du temps, à mesure que votre candidature subit de multiples itérations et améliorations.

4.4 Rendre les conversations utiles grâce au « principe de coopération »

Avez-vous déjà eu l'impression de parler à un mur de briques alors que vous parliez réellement avec un humain ? Parfois, nous constatons que nos interlocuteurs ne sont tout simplement pas intéressés à mener la conversation vers le succès. Heureusement, dans la plupart des cas, les choses se passent plus facilement et les humains suivront intuitivement le « principe de coopération » introduit par le philosophe du langage Paul Grice. Selon ce principe, les humains qui réussissent à communiquer entre eux suivent quatre maximes, à savoir la quantité, la qualité, la pertinence et la manière.

Maxime de quantité

La maxime de quantité demande à l'orateur d'être informatif et de rendre sa contribution aussi informative que nécessaire. Du côté de l’assistant virtuel, cela signifie aussi faire avancer activement la conversation. Par exemple, considérons cet extrait d'une application de mode e-commerce :

Assistants : Quel genre de vêtements recherchez-vous ?

Utilisateur: Je cherche une robe en orange.

Assistant : Ne faites pas : Désolé, nous n'avons pas de robes orange pour le moment.

À faire : Désolé, nous n'avons pas de robes en orange, mais nous avons cette superbe et très confortable robe en jaune : …

L'utilisateur espère quitter votre application avec un élément approprié. Arrêter la conversation parce que vous n'avez pas d'éléments qui correspondent exactement à la description tue toute possibilité de succès. Cependant, si votre application fait des suggestions sur des éléments alternatifs, elle apparaîtra plus utile et laissera ouverte l’option d’une interaction réussie.

En particulier dans les interactions vocales, il est important de trouver le bon équilibre entre fournir toutes les informations dont l'utilisateur pourrait avoir besoin pour réussir sans le submerger d'informations inutiles qui pourraient brouiller l'interaction.

Maxime de qualité

La maxime de qualité demande aux locuteurs d’être véridiques et de ne pas dire des choses qu’ils croient fausses ou pour lesquelles ils manquent de preuves adéquates. Il y a beaucoup de subjectivité et de croyances personnelles impliquées ici — donc, cette maxime ne peut pas être directement projetée sur les LLM. Comme nous l’avons vu, les LLM ont tendance à halluciner, et ce risque est particulièrement élevé lorsque la conversation s’éloigne vers des territoires moins familiers. Des garde-fous supplémentaires peuvent être utilisés afin d’éviter les déclarations trompeuses et de remettre la conversation sur les rails.

Maxime de pertinence

La maxime de pertinence nous demande d’être – enfin, pertinents. Comme condition préalable, l’assistant virtuel doit comprendre la véritable intention de l’utilisateur. Voici un exemple d’assistant d’une compagnie aérienne qui enfreint cette règle :

Utilisateur: J'ai besoin d'un vol de Berlin à Zurich demain matin.

Assistants : OK, j'ai trouvé les vols suivants de Berlin à Zurich pour demain matin. Le vol BZ36294 quitte Berlin à 6.30h8 et arrive à Zurich à 96294h. Le vol BZ8 quitte Berlin à 9.30h96294 et arrive à 8h9.30. Le vol BZ95614 quitte Berlin à 11h12.30 et arrive à Zurich à 11.45h3. Le vol BZXNUMX quitte Berlin à XNUMXhXNUMX et arrive à Zurich à XNUMXhXNUMX. Il existe également la possibilité d'un vol de correspondance, auquel cas vous quitterez Berlin à XNUMXhXNUMX et arriverez à Zurich à XNUMXhXNUMX.

Utilisateur: Désolé… pourriez-vous répéter ceci ?

L'assistant submerge l'utilisateur d'informations détaillées qui pourraient ne pas être pertinentes. En divisant cela et en guidant l'utilisateur à limiter son espace de recherche, le dialogue devient beaucoup plus facile à digérer :

Utilisateur: J'ai besoin d'un vol de Berlin à Zurich demain matin.

Assistants : Ok, j'ai trouvé des vols partant à 6.30h8, 11h et XNUMXh. À quelle heure souhaiteriez-vous partir ?

Utilisateur: Je dois être à Zurich avant 9h.

Assistants : OK, vous pouvez donc prendre le vol BZ36294. Il part à 6.30h8 et arrive à XNUMXh. Dois-je acheter le billet pour vous ?

Utilisateur: Oui merci.

Maxime de manière

Enfin, la maxime de manière stipule que nos actes de langage doivent être clairs, concis et ordonnés, évitant toute ambiguïté et obscurité d'expression. Votre assistant virtuel doit éviter le jargon technique ou interne et privilégier les formulations simples et universellement compréhensibles.

Bien que les principes de Grice soient valables pour toutes les conversations indépendamment d'un domaine spécifique, les LLM non formés spécifiquement pour la conversation ne parviennent souvent pas à les respecter. Ainsi, lors de la compilation de vos données de formation, il est important de disposer de suffisamment d'échantillons de dialogue permettant à votre modèle d'apprendre ces principes.

Le domaine du design conversationnel se développe assez rapidement. Que vous construisiez déjà des produits d'IA ou que vous réfléchissiez à votre parcours professionnel dans l'IA, je vous encourage à approfondir ce sujet (cf. les excellentes introductions dans [5] et [6]). À mesure que l’IA devient une marchandise, une bonne conception associée à une stratégie de données défendable deviendront deux différenciateurs importants pour les produits d’IA.

Résumé

Résumons les principaux points à retenir de l'article. De plus, la figure 5 propose une « aide-mémoire » avec les principaux points que vous pouvez télécharger comme référence.

- Les LLM améliorent l'IA conversationnelle : les grands modèles linguistiques (LLM) ont considérablement amélioré la qualité et l'évolutivité des applications d'IA conversationnelle dans divers secteurs et cas d'utilisation.

- L'IA conversationnelle peut ajouter beaucoup de valeur aux applications ayant de nombreuses demandes d'utilisateurs similaires (par exemple, le service client) ou qui doivent accéder à une grande quantité de données non structurées (par exemple, la gestion des connaissances).

- Données : le réglage fin des LLM pour les tâches conversationnelles nécessite des données conversationnelles de haute qualité qui reflètent fidèlement les interactions du monde réel. Les données générées par le crowdsourcing et le LLM peuvent être des ressources précieuses pour étendre la collecte de données.

- Assembler le système : le développement de systèmes d'IA conversationnelle est un processus itératif et expérimental impliquant une optimisation constante des données, des stratégies de réglage fin et l'intégration de composants.

- Enseigner les compétences de conversation aux LLM : La mise au point des LLM implique de les former à reconnaître et à répondre à des intentions et des situations de communication spécifiques.

- Ajout de données externes avec recherche sémantique : l'intégration de sources de données externes et internes à l'aide de la recherche sémantique améliore les réponses de l'IA en fournissant des informations contextuellement plus pertinentes.

- Mémoire et conscience du contexte : les systèmes conversationnels efficaces doivent maintenir une conscience du contexte, notamment en suivant l'historique de la conversation en cours et des interactions passées, pour fournir des réponses significatives et cohérentes.

- Mise en place de garde-fous : pour garantir un comportement responsable, les systèmes d'IA conversationnelle doivent utiliser des garde-fous pour éviter les inexactitudes, les hallucinations et les atteintes à la vie privée.

- Conception de personnalité : concevoir une personnalité cohérente pour votre assistant conversationnel est essentielle pour créer une expérience utilisateur cohérente et de marque. Les caractéristiques de la personnalité doivent correspondre aux attributs de votre produit et de votre marque.

- Voix ou chat : le choix entre les interfaces vocales et de chat dépend de facteurs tels que l'environnement physique, le contexte émotionnel, la fonctionnalité et les défis de conception. Tenez compte de ces facteurs lorsque vous décidez de l'interface de votre IA conversationnelle.

- Intégration dans divers contextes : l'IA conversationnelle peut être intégrée dans différents contextes, notamment les copilotes, les humains synthétiques, les jumeaux numériques et les bases de données, chacun avec des cas d'utilisation et des exigences spécifiques.

- Observer le principe de coopération : le respect des principes de quantité, de qualité, de pertinence et de manière dans les conversations peut rendre les interactions avec l'IA conversationnelle plus utiles et plus conviviales.

Bibliographie

[1] Heng-Tze Chen et al. 2022. LaMDA : vers des modèles de dialogue sûrs, ancrés et de haute qualité pour tout.

[2] OpenAI. 2022. ChatGPT : Optimiser les modèles linguistiques pour le dialogue. Consulté le 13 janvier 2022.

[3] Patrick Lewis et coll. 2020. Génération de récupération augmentée pour les tâches PNL à forte intensité de connaissances.

[4] Paul Grice. 1989. Études sur la voie des mots.

[5] Cathy Perle. 2016. Conception d'interfaces utilisateur vocales.

[6] Michael Cohen et coll. 2004. Conception de l'interface utilisateur vocale.

Remarque : toutes les images sont de l'auteur, sauf indication contraire.

Cet article a été publié initialement le Vers la science des données et republié sur TOPBOTS avec la permission de l'auteur.

Vous aimez cet article? Inscrivez-vous pour plus de mises à jour de recherche sur l'IA.

Nous vous informerons lorsque nous publierons d'autres articles résumés comme celui-ci.

Services Connexes

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://www.topbots.com/redefining-conversational-ai-with-large-language-models/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 11

- 12

- 125

- 13

- 14

- 17

- 200

- 2016

- 2020

- 2022

- 30

- 32

- 35%

- 41

- 7

- 70

- 8

- 9

- a

- capacités

- capacité

- Qui sommes-nous

- Absolute

- Accepter

- acceptation

- accès

- accédé

- accessible

- accommoder

- accomplir

- Selon

- Compte

- Accumuler

- précision

- Avec cette connaissance vient le pouvoir de prendre

- à travers

- Agis

- activement

- activités

- activité

- actes

- actually

- ajouter

- ajoutant

- Supplémentaire

- renseignements supplémentaires

- En outre

- propos

- Adoption

- avances

- Avantage

- avantages

- conseiller

- Après

- encore

- à opposer à

- Agent

- agents

- depuis

- AI

- recherche ai

- Systèmes d'IA

- compagnie aérienne

- AL

- aligner

- aligné

- Tous

- permettre

- permet

- presque

- le long de

- déjà

- aussi

- alternative

- des alternatives

- am

- Ambiguïté

- parmi

- an

- il analyse

- ainsi que les

- Témoignages

- Une autre

- anticiper

- tous

- appli

- apparaître

- Application

- applications

- s'applique

- une approche

- approprié

- applications

- SONT

- domaines

- autour

- Arrive

- Art

- article

- sur notre blog

- artificiel

- AS

- demander

- demandant

- Evaluer

- évalué

- Évaluation de risque climatique

- atout

- aider

- Assistante gérante

- assistants

- associé

- At

- Tentatives

- précaution

- attributs

- augmenter

- augmentée

- auteur

- automatiquement

- disponibles

- éviter

- en évitant

- et

- RETOUR

- de nouveau sur la bonne voie

- Balance

- balle

- base

- basé

- Essentiel

- BE

- car

- devenez

- devient

- était

- before

- humain

- comportements

- derrière

- va

- philosophie

- CROYONS

- aimé

- profiter

- Berlin

- LES MEILLEURS

- les meilleures pratiques

- Améliorée

- jusqu'à XNUMX fois

- Au-delà

- biais

- Bit

- blocage

- livre

- tous les deux

- les robots

- Box

- brand

- marqué

- l'image de marque

- infractions

- Rupture

- apporter

- plus large

- Apporté

- construire

- Développement

- construit

- la performance des entreprises

- occupé

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- acheter

- Achat

- by

- appelé

- Appels

- venu

- CAN

- ne peut pas

- capacités

- Carrière

- voitures

- maisons

- cas

- cathy

- Canaux centraux

- challenge

- globaux

- difficile

- Chance

- modifié

- Développement

- caractère

- caractéristiques

- caractérise

- Chatbot

- Chatbots

- ChatGPT

- chen

- enfant

- le choix

- choix

- choose

- clair

- clairement

- Fermer

- étroitement

- Vêtements

- le cloud

- code

- Cohen

- COHÉRENT

- cohésif

- collaboration

- collection

- combiner

- comment

- vient

- confortable

- marchandise

- communiquer

- Communication

- Communications

- Sociétés

- Société

- par rapport

- rivaliser

- complexe

- composant

- composants électriques

- concert

- concis

- Conduire

- connecté

- Connecter les

- Connexions

- Considérer

- considérant

- cohérent

- constant

- constamment

- la construction

- construction

- contact

- contenu

- contexte

- contextes

- contextuel

- continuellement

- contrat

- contraste

- contribuer

- contribuant

- contribution

- controversé

- Conversation

- de la conversation

- IA conversationnel

- conversations

- Freddi

- coopération

- coopérative

- Core

- Correspondant

- pourriez

- Couples

- Cours

- couvert

- engendrent

- La création

- notre créativité

- créatures

- crédible

- critères

- crowdsourcing

- Courant

- Lecture

- courbe

- des clients

- Service à la clientèle

- Support à la clientèle

- Clients

- données

- stratégie de données

- Base de données

- bases de données

- parfaite

- affaire

- décennies

- décider

- Décider

- décisions

- profond

- Vous permet de définir

- certainement, vraiment, définitivement

- Degré

- retarder

- dépend

- la description

- Conception

- Création de Design

- designers

- conception

- voulu

- détaillé

- détails

- développer

- développé

- mobiles

- développement

- Développement

- dispositif

- Compatibles

- dialogue

- Dialogue

- différent

- différenciateur

- difficile

- DIG

- Digérer

- numérique

- Jumeaux numériques

- monde numérique

- directement

- découverte

- Commande

- distribution

- plongeon

- do

- Documentation

- INSTITUTIONNELS

- Chien

- faire

- domaine

- fait

- Ne pas

- Doomed

- download

- driver

- deux

- pendant

- e

- e-commerce

- E & T

- chacun

- plus facilement

- pédagogique

- Efficace

- efficace

- efficace

- non plus

- éléments

- enrobage

- émergé

- émergence

- émerge

- empathie

- employés

- vous accompagner

- permettant

- encourager

- fin

- efforts

- Endless

- s'engager

- Moteurs

- de renforcer

- améliorations

- Améliore

- agréable

- assez

- enrichir

- enrichi

- enrichissant

- assurer

- Entreprise

- notamment

- essential

- etc

- évaluer

- Pourtant, la

- faire une éventuelle

- JAMAIS

- preuve

- exactement

- exemple

- exemples

- excellent

- Sauf

- excès

- excité

- passionnant

- exécuter

- existant

- attendre

- attendu

- cher

- d'experience

- expérimental

- Expliquer

- explication

- expression

- externe

- Visage

- facteur

- usines

- facteurs

- FAIL

- échoue

- Échec

- Chutes

- non

- familier

- fascinant

- Mode

- plus rapide

- Réactions

- ressentir

- Figure

- une fonction filtre

- finaliser

- Trouvez

- Prénom

- s'adapter

- Fixer

- vol

- Vols

- flux

- Écoulement

- Flux

- Focus

- suivre

- suivi

- Abonnement

- Pour

- formulaire

- formel

- formuler

- Heureusement

- Avant

- trouvé

- quatre

- fréquent

- fréquemment

- de

- avant

- frustrant

- Remplir

- amusement

- fondamental

- plus

- avenir

- jeux

- écart

- recueillir

- Général

- généralement

- générer

- génération

- obtenez

- GitHub

- donné

- Go

- Goes

- aller

- Bien

- l'

- Vert

- Sol

- l'orientation

- guide

- lignes directrices

- ait eu

- Mains

- arriver

- arrive

- Dur

- nuisible

- Vous avez

- he

- Health Santé

- entendre

- vous aider

- utile

- ici

- ici

- caché

- Haute

- de haute qualité

- augmentation

- très

- sa

- Histoire

- Frappé

- holistique

- d'espérance

- espoirs

- HOT

- Comment

- Cependant

- HTML

- http

- HTTPS

- majeur

- humain

- Les êtres humains

- humour

- Hype

- i

- idéalement

- Identificateurs

- identifie

- if

- illustre

- image

- satellite

- imagination

- image

- immersive

- mis en œuvre

- important

- amélioré

- l'amélioration de

- in

- en profondeur

- comprendre

- Y compris

- intégrer

- Améliore

- incroyablement

- indépendamment

- individuel

- secteurs

- infliger

- d'information

- informatif

- inhérent

- initiale

- initier

- entrées

- plutôt ;

- intégrer

- des services

- Intégration

- l'intégration

- intention

- intentionnellement

- interagir

- l'interaction

- interactions

- Interactif

- Systèmes de réponse vocale interactifs

- intéressé

- Interfaces

- interfaces

- interne

- entrelacé

- développement

- introduire

- introduit

- Introduction

- présentations

- intuitif

- un investissement

- recommandations d'investissement

- impliqué

- impliquant

- seul

- aide

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- articles

- itération

- itérations

- SES

- lui-même

- IVR

- Janvier

- jargon

- Emploi

- joint

- jpg

- juste

- XNUMX éléments à

- ACTIVITES

- mots clés

- Genre

- Savoir

- spécialisées

- Transfert de connaissances

- connu

- Etiquettes

- Peindre

- langue

- Langues

- gros

- grande échelle

- plus importantes

- Latence

- plus tard

- avocat

- conduisant

- Conduit

- APPRENTISSAGE

- savant

- apprentissage

- Laisser

- départ

- Legacy

- Légal

- prêter

- moins

- laisser

- Niveau

- niveaux

- Levier

- à effet de levier

- en tirant parti

- Lewis

- Bibliothèque

- se trouve

- comme

- LIMIT

- limité

- Écoute

- le travail

- LLM

- logique

- Location

- Style

- recherchez-

- LOOKS

- pertes

- Lot

- beaucoup

- click

- LES PLANTES

- mailing

- Entrée

- maintenir

- Maintenir

- majeur

- a prendre une

- FAIT DU

- Fabrication

- gérés

- gestion

- Gestionnaires

- manière

- de nombreuses

- Marché

- opportunités de marché

- Match

- appariés

- Matériel

- matières premières.

- largeur maximale

- maximum

- me

- signifier

- significative

- veux dire

- Médias

- moyenne

- réunion

- Membres

- Mémoire

- mental

- La santé mentale

- méthodes

- Michael

- Microsoft

- pourrait

- millisecondes

- miné

- trompeur

- malentendu

- modèle

- numériques jumeaux (digital twin models)

- Villas Modernes

- moment

- mois

- moral

- PLUS

- plus efficace

- Matin

- (en fait, presque toutes)

- la plupart

- en mouvement

- beaucoup

- plusieurs

- multitude

- must

- my

- moi-même

- prénom

- à savoir

- Nature

- Traitement du langage naturel

- nécessaire

- une nécessité

- Besoin

- nécessaire

- Besoins

- négatif

- n'allons jamais

- Nouveauté

- nouvelle application

- next

- nlp

- aucune

- non technique

- Aucun

- normalement

- noté

- Notion

- maintenant

- Nuance

- nombre

- nombreux

- Nutshell

- objet

- objectif

- objets

- of

- de rabais

- code

- présenté

- Offres Speciales

- Bureaux

- souvent

- on

- une fois

- ONE

- uniquement

- sur

- ouvert

- OpenAI

- d'exploitation

- Opérations

- Opinion

- Opportunités

- Opportunités

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- optimisé

- l'optimisation

- Option

- Options

- or

- Orange

- de commander

- initialement

- Autre

- Autres

- autrement

- nos

- ande

- sorties

- au contrôle

- plus de

- accablant

- propre

- page

- papiers

- paradigme

- partenaires,

- fête

- passé

- passé

- Brevets

- chemin

- patiemment

- patrick

- motifs

- paul

- Personnes

- /

- perçu

- Effectuer

- autorisation

- personne

- personnel

- Personnalité

- Personnellement

- Peter

- Physique

- en particulier pendant la préparation

- PHOTOS

- tangage

- Place

- Plaine

- et la planification de votre patrimoine

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- Point

- des notes bonus

- pauvres

- pop

- Populaire

- position

- positif

- possibilité

- possible

- défaillances

- l'éventualité

- pratique

- pratiques

- prédiction

- préférences

- présenté

- empêcher

- principe

- principes

- la confidentialité

- Privé

- procéder

- processus

- Traité

- les process

- traitement

- Produit

- Produit

- Produits

- professionels

- Profils

- Programmation

- projetée

- important

- favorise

- protocole

- fournir

- fournit

- aportando

- Psychologie

- public

- publié

- but

- Push

- pousse

- qualité

- Quantité

- requêtes

- fréquemment posées

- vite.

- classer

- Classement

- plutôt

- réaction

- solutions

- réal

- monde réel

- Réalité

- reconnaissance

- reconnaître

- reconnaissant

- recommandations

- récurrent

- Rouge

- Redéfinir

- réduire

- reportez-vous

- référence

- visée

- se réfère

- refléter

- reflète

- en relation

- libérer

- pertinence

- pertinent

- s'appuyer

- rester

- répéter

- remplacé

- répondre

- nécessaire

- demandes

- conditions

- Exigences

- a besoin

- un article

- Ressemble

- Résolution

- Resources

- Réagir

- répondre

- réponse

- réponses

- responsables

- au Deck restaurant

- résultant

- Résultats

- révéler

- Rich

- bon

- Analyse

- Règle

- Courir

- des

- Sécurité

- Saïd

- même

- client

- sauvé

- dire

- Évolutivité

- Escaliers intérieurs

- mise à l'échelle

- sur une base scientifique

- portée

- pour écran

- Rechercher

- Deuxièmement

- secondes

- Section

- sur le lien

- vu

- sensible

- Série

- service

- set

- mise

- Paramétres

- plusieurs

- devrait

- montrer

- montré

- Spectacles

- côté

- signer

- de façon significative

- similaires

- étapes

- simplicité

- depuis

- Séance

- situation

- situations

- compétences

- petit

- plus lisse

- Fragment

- So

- Réseaux sociaux

- socialiser

- Soft

- vendu

- sur mesure

- Solutions

- quelques

- Quelqu'un

- quelque chose

- parfois

- Bientôt

- Sources

- Space

- travées

- parler

- Speaker

- haut-parleurs

- parlant

- spécialisé

- groupe de neurones

- spécifiquement

- spécificité

- discours

- Reconnaissance vocale

- vitesse

- Commencer

- j'ai commencé

- départs

- Déclaration

- déclarations

- États

- station

- statistique

- rester

- diriger

- pilotage

- étapes

- Étapes

- Encore

- arrêt

- stockée

- Histoire

- simple

- les stratégies

- de Marketing

- rationaliser

- stress

- structure

- structuré

- études

- Catégorie

- Ces

- succès

- réussi

- Avec succès

- tel

- Suggère

- convient

- suite

- résumé

- RÉSUMÉ

- Support

- sûr

- Swing

- Interrupteur

- symbolique

- syntaxe

- haute

- combustion propre

- Système

- table

- Prenez

- Points clés à retenir

- discutons-en

- parlant

- Robinets

- Target

- objectifs

- Tâche

- tâches

- enseigné

- Enseignement

- équipe

- Membres de l'équipe

- Technique

- technique

- Technologie

- télésanté

- conditions

- territoires

- Essais

- texte

- que

- Merci

- qui

- Les

- El futuro

- les informations

- le monde

- leur

- Les

- se

- puis

- Là.

- Ces

- l'ont

- des choses

- penser

- En pensant

- Troisièmement

- this

- ceux

- trois

- Avec

- Ainsi

- billet

- billets

- fiable

- fois

- à

- ensemble

- jeton

- demain

- TON

- trop

- les outils

- TOPBOTS

- sujet

- vers

- vers

- suivre

- Tracking

- Commerce

- traditionnel

- Train

- qualifié

- Formation

- Transformer

- transformé

- transition

- transitions

- transmettre

- déclenché

- oui

- Essai

- TOUR

- Tournant

- se tourne

- Jumeaux

- deux

- débutante

- ui

- subit

- comprendre

- compréhensible

- compréhension

- expérience unique et authentique

- Universel

- Universellement

- inutile

- mise à jour

- Actualités

- la mise à jour

- us

- convivialité

- utilisé

- d'utiliser

- Utilisateur

- Expérience utilisateur

- Interface utilisateur

- Design de l'interface utilisateur

- convivial

- utilisateurs

- Usages

- en utilisant

- ux

- Design UX

- concepteur ux

- concepteurs ux

- Info de contact.

- Précieux

- Plus-value

- variété

- divers

- polyvalente

- Versus

- très

- via

- Victime

- Salle de conférence virtuelle

- assistant virtuel

- La réalité virtuelle

- Voix

- vs

- vulgaire

- W3

- Wall

- souhaitez

- veut

- était

- vagues

- Façon..

- façons

- we

- Richesse

- Site Web

- sites Internet

- WELL

- ont été

- Quoi

- Qu’est ce qu'

- Jante

- quand

- chaque fois que

- que

- qui

- tout en

- WHO

- why

- sera

- fenêtres

- comprenant

- sans

- des mots

- activités principales

- ouvriers

- world

- inquiétant

- pourra

- écrire

- an

- années

- Vous n'avez

- jeune

- Votre

- zéphyrnet

- Zurich