Cet article a été co-écrit avec Anthony Medeiros, responsable de l'ingénierie et de l'architecture de solutions pour l'intelligence artificielle en Amérique du Nord, et Blake Santschi, responsable de la Business Intelligence chez Schneider Electric. Parmi les autres experts de Schneider Electric figurent Jesse Miller, Somik Chowdhury, Shaswat Babhulgaonkar, David Watkins, Mark Carlson et Barbara Sleczkowski.

Les systèmes de planification des ressources d'entreprise (ERP) sont utilisés par les entreprises pour gérer plusieurs fonctions commerciales telles que la comptabilité, les ventes ou la gestion des commandes dans un seul système. Ils sont notamment couramment utilisés pour stocker des informations liées aux comptes clients. Différentes organisations au sein d'une entreprise peuvent utiliser différents systèmes ERP et leur fusion constitue un défi technique complexe à grande échelle qui nécessite des connaissances spécifiques à un domaine.

Schneider Electric est un leader de la transformation numérique de la gestion de l'énergie et de l'automatisation industrielle. Pour répondre au mieux aux besoins de ses clients, Schneider Electric doit assurer le suivi des liens entre les comptes clients associés dans ses systèmes ERP. À mesure que leur clientèle s'agrandit, de nouveaux clients sont ajoutés quotidiennement et leurs équipes de compte doivent trier manuellement ces nouveaux clients et les relier à l'entité mère appropriée.

La décision de liaison est basée sur les informations les plus récentes disponibles publiquement sur Internet ou dans les médias et peut être affectée par des acquisitions récentes, des nouvelles du marché ou une restructuration de division. Un exemple de liaison de compte serait d'identifier la relation entre Amazon et sa filiale Whole Foods Market [la source].

Schneider Electric déploie de grands modèles de langage en raison de leurs capacités à répondre à des questions dans divers domaines de connaissances spécifiques. La date à laquelle le modèle a été formé limite ses connaissances. Ils ont relevé ce défi en utilisant un grand modèle de langage open source Retriever-Augmented Generation disponible sur Amazon SageMaker JumpStart pour traiter de grandes quantités de connaissances externes extraites et exposer les relations d'entreprise ou publiques entre les enregistrements ERP.

Début 2023, lorsque Schneider Electric a décidé d'automatiser une partie de son processus de liaison de comptes grâce à l'intelligence artificielle (IA), l'entreprise s'est associée à l'AWS Machine Learning Solutions Lab (MLSL). Grâce à l'expertise de MLSL en matière de conseil et d'exécution de ML, Schneider Electric a pu développer une architecture d'IA qui réduirait l'effort manuel dans ses flux de travail de liaison et fournirait un accès plus rapide aux données à ses équipes d'analyse en aval.

IA générative

L'IA générative et les grands modèles linguistiques (LLM) transforment la façon dont les organisations commerciales sont capables de résoudre des défis traditionnellement complexes liés au traitement et à la compréhension du langage naturel. Certains des avantages offerts par les LLM incluent la capacité de comprendre de grandes portions de texte et de répondre à des questions connexes en produisant des réponses de type humain. AWS permet aux clients d'expérimenter et de produire facilement des charges de travail LLM en proposant de nombreuses options via Amazon SageMaker JumpStart, Socle amazonienet une Titan d'Amazonie.

Acquisition de connaissances externes

Les LLM sont connus pour leur capacité à compresser les connaissances humaines et ont démontré des capacités remarquables à répondre à des questions dans divers domaines de connaissances spécifiques, mais leurs connaissances sont limitées par la date à laquelle le modèle a été formé. Nous comblons cette coupure d'informations en couplant le LLM avec une API de recherche Google pour fournir un puissant LLM de récupération augmentée (RAG) qui répond aux défis de Schneider Electric. Le RAG est capable de traiter de grandes quantités de connaissances externes extraites de la recherche Google et de présenter des relations d'entreprise ou publiques entre les enregistrements ERP.

Voir l'exemple suivant:

Question: Qui est la société mère de One Medical ?

Requête Google : « Société mère One Medical » → informations → LLM

Réponse One Medical, filiale d'Amazon…

L'exemple précédent (tiré de la base de données clients de Schneider Electric) concerne une acquisition intervenue en février 2023 et qui ne serait donc pas prise en compte par le LLM seul en raison de coupures de connaissances. L'augmentation du LLM avec la recherche Google garantit les informations les plus à jour.

Modèle Flan-T5

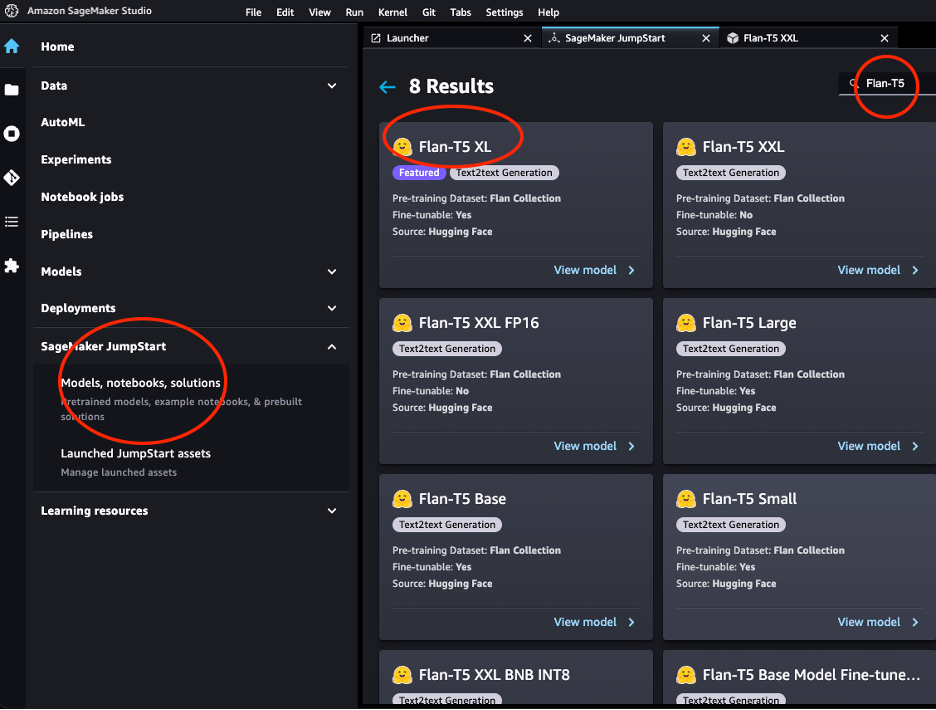

Dans ce projet, nous avons utilisé le modèle Flan-T5-XXL du Flan-T5 famille de modèles.

Les modèles Flan-T5 sont adaptés aux instructions et sont donc capables d'effectuer diverses tâches PNL sans tir. Dans notre tâche en aval, il n'était pas nécessaire de prendre en compte une grande quantité de connaissances mondiales, mais plutôt de bien répondre aux questions compte tenu d'un contexte de textes fournis via les résultats de recherche, et par conséquent, le modèle T11 à paramètres 5B a bien fonctionné.

JumpStart permet un déploiement pratique de cette famille de modèles via Amazon SageMakerStudio et le SDK SageMaker. Cela inclut Flan-T5 Small, Flan-T5 Base, Flan-T5 Large, Flan-T5 XL et Flan-T5 XXL. De plus, JumpStart propose quelques versions de Flan-T5 XXL à différents niveaux de quantification. Nous avons déployé Flan-T5-XXL sur un point final pour l'inférence en utilisant Démarrage d'Amazon SageMaker Studio.

Récupération augmentée LLM avec LangChain

LangChaîne est un framework populaire et en croissance rapide permettant le développement d'applications alimentées par des LLM. Il est basé sur la notion de Chaînes, qui sont des combinaisons de différents composants conçus pour améliorer la fonctionnalité des LLM pour une tâche donnée. Par exemple, cela nous permet de personnaliser instructions et intégrez les LLM avec différents outils tels que des moteurs de recherche externes ou des sources de données. Dans notre cas d'utilisation, nous avons utilisé Google Serper composant pour rechercher sur le Web, et déployé le modèle Flan-T5-XXL disponible sur Démarrage d'Amazon SageMaker Studio. LangChain effectue l'orchestration globale et permet aux pages de résultats de recherche d'être introduites dans l'instance Flan-T5-XXL.

La génération de récupération augmentée (RAG) se compose de deux étapes :

- Récupération de morceaux de texte pertinents provenant de sources externes

- Augmentation des morceaux avec le contexte dans l'invite donnée au LLM.

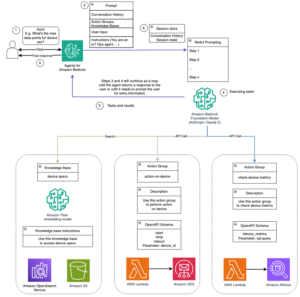

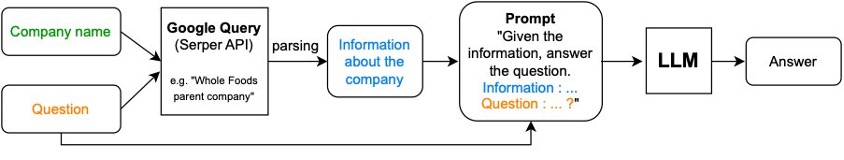

Pour le cas d'usage de Schneider Electric, le RAG procède comme suit :

- Le nom de l'entreprise donné est combiné avec une question du type « Qui est la société mère de X », où X est la société donnée) et transmis à une requête Google à l'aide de l'IA Serper.

- Les informations extraites sont combinées avec la question rapide et originale et transmises au LLM pour réponse.

Le schéma suivant illustre ce processus.

Utilisez le code suivant pour créer un point de terminaison :

Outil de recherche instancié :

Dans le code suivant, nous enchaînons les composants de récupération et d’augmentation :

L'ingénierie rapide

La combinaison du contexte et de la question s'appelle l'invite. Nous avons remarqué que l'invite générale que nous avons utilisée (variations autour de la demande de société mère) fonctionnait bien pour la plupart des secteurs publics (domaines), mais ne se généralisait pas bien à l'éducation ou à la santé, car la notion de société mère n'y a pas de sens. Pour l’éducation, nous avons utilisé « X » tandis que pour les soins de santé, nous avons utilisé « Y ».

Pour activer cette sélection d'invite spécifique à un domaine, nous avons également dû identifier le domaine auquel appartient un compte donné. Pour cela, nous avons également utilisé un RAG où une question à choix multiples « Quel est le domaine de {compte} ? » dans un premier temps, et sur la base de la réponse que nous avons demandée au parent du compte en utilisant l'invite correspondante dans un deuxième temps. Voir le code suivant :

Les invites spécifiques au secteur ont amélioré les performances globales de 55 % à 71 % de précision. Dans l’ensemble, les efforts et le temps investis pour développer des instructions semblent améliorer considérablement la qualité de la réponse LLM.

RAG avec données tabulaires (SEC-10k)

Les dépôts SEC 10K sont une autre source d'informations fiable pour les filiales et subdivisions déposées chaque année par une société cotée en bourse. Ces dépôts sont disponibles directement sur SEC EDGAR Ou à travers CorpWatch API.

Nous supposons que les informations sont fournies sous forme de tableau. Ci-dessous un pseudo csv ensemble de données qui imite le format original de l’ensemble de données SEC-10K. Il est possible de fusionner plusieurs csv sources de données dans une trame de données pandas combinée :

# A pseudo dataset similar by schema to the CorpWatch API dataset

df.head()

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/schneider-electric-leverages-retrieval-augmented-llms-on-sagemaker-to-ensure-real-time-updates-in-their-erp-systems/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 10K

- 11

- 15 ans

- 15%

- 160

- 17

- 2023

- 7

- 710

- a

- capacité

- Capable

- A Propos

- au dessus de

- abstraction

- accélérer

- accès

- accommoder

- Compte

- Comptabilité

- hybrides

- précision

- Avec cette connaissance vient le pouvoir de prendre

- acquisition

- acquisitions

- à travers

- Action

- ajoutée

- ajout

- Supplémentaire

- propos

- adressé

- adresses

- avantages

- affecté

- Agent

- AI

- AI / ML

- Permettre

- permet

- seul

- aussi

- Amazon

- Apprentissage automatique d'Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amérique

- parmi

- montant

- quantités

- an

- analytique

- et les

- Annuellement

- Une autre

- répondre

- Anthony

- api

- apparaître

- applications

- appliqué

- Application

- architecture

- SONT

- autour

- artificiel

- intelligence artificielle

- Intelligence artificielle (AI)

- AS

- demander

- demandant

- assumer

- At

- augmenter

- augmentée

- automatiser

- Automation

- disponibles

- disponible directement

- AWS

- Apprentissage automatique AWS

- Services bancaires

- base

- basé

- BE

- était

- before

- appartient

- ci-dessous

- avantages.

- LES MEILLEURS

- jusqu'à XNUMX fois

- Blocs

- Boosté

- Apportez le

- construire

- Développement

- la performance des entreprises

- Fonctions commerciales

- l'intelligence d'entreprise

- mais

- by

- appelé

- CAN

- capacités

- capable

- Carlson

- pris

- chaîne

- challenge

- globaux

- le choix

- Ville

- Classer

- CNBC

- code

- Colonne

- combinaison

- комбинации

- combiné

- Sociétés

- Société

- complexe

- composant

- composants électriques

- comprendre

- concept

- Préoccupations

- consiste

- consulting

- consommateur

- contexte

- Pratique

- Entreprises

- engendrent

- Créer de la valeur

- des clients

- Clients

- Tous les jours

- données

- accès aux données

- data-driven

- Base de données

- ensembles de données

- Date

- David

- décidé

- décision

- livrer

- livrer

- démontré

- déployé

- déployer

- déploiement

- Conception

- un

- détail

- détaillé

- développer

- développement

- Développement

- différent

- numérique

- Transformation numérique

- directement

- do

- document

- domaine

- domaines

- deux

- "Early Bird"

- Easy

- Éducation

- effort

- Électrique

- permettre

- Endpoint

- énergie

- ENGINEERING

- Moteurs

- assurer

- entrant

- entreprises

- entité

- ERP

- exemple

- exécution

- exposer

- d'experience

- expérience

- nous a permis de concevoir

- de santé

- étendre

- externe

- Exxon Mobil

- famille

- RAPIDE

- plus rapide

- Février

- Fed

- few

- déposé

- limailles

- finale

- Trouvez

- Prénom

- Focus

- concentré

- Abonnement

- suit

- aliments

- Pour

- le format

- Framework

- De

- fonctions

- plus

- En outre

- GAS

- génération

- génératif

- IA générative

- donné

- Global

- Recherche Google

- graphiques

- Croissance

- Pousse

- garantit

- ait eu

- arrivé

- Vous avez

- he

- la médecine

- aide

- ici

- augmentation

- sa

- Comment

- HTML

- http

- HTTPS

- humain

- i

- Identification

- identifier

- illustre

- améliorer

- l'amélioration de

- in

- comprendre

- inclut

- incubateur

- industriel

- industrie

- d'information

- initiale

- les initiatives

- contribution

- idées.

- instance

- intégrer

- Intelligence

- interagir

- intérêts

- Internet

- développement

- investi

- IT

- SES

- joshua

- jpg

- XNUMX éléments à

- ACTIVITES

- Savoir

- spécialisées

- connu

- laboratoire

- langue

- gros

- couche

- leader

- conduisant

- apprentissage

- niveaux

- les leviers

- prélèvement

- comme

- limité

- limiter

- LINK

- lien

- Gauche

- LLM

- click

- machine learning

- maintenir

- FAIT DU

- Fabrication

- gérer

- gestion

- manager

- Manuel

- manuellement

- de nombreuses

- marque

- Marché

- Nouvelles du marché

- significative

- Médias

- médical

- données médicales

- aller

- fusion

- méthodes

- pourrait

- Miller

- ML

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- (en fait, presque toutes)

- plusieurs

- prénom

- nommage

- Nature

- Traitement du langage naturel

- Besoin

- Besoins

- Nouveauté

- New York

- New York City

- nouvelles

- nlp

- aucune

- Nord

- Amérique du Nord

- Notion

- maintenant

- observation

- of

- présenté

- Huile

- PETROLE ET GAZ

- on

- ONE

- Un médical

- ouvert

- open source

- Options

- or

- orchestration

- de commander

- organisation

- organisationnel

- organisations

- original

- Autre

- nos

- ande

- sortie

- global

- propre

- pages

- pandas

- paramètres

- société mère

- partie

- particulier

- en partenariat

- passé

- passionné

- chemin

- Effectuer

- performant

- effectué

- effectuer

- effectue

- Pharmacie

- phd

- pipeline

- et la planification de votre patrimoine

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Populaire

- possible

- Post

- alimenté

- solide

- précédemment

- Directeur

- d'ouvrabilité

- produit

- processus

- traitement

- produire

- Projet

- correct

- à condition de

- fournit

- public

- publiquement

- qualité

- question

- fréquemment posées

- plutôt

- en temps réel

- récent

- Articles

- réduire

- en relation

- relation amoureuse

- Les relations

- pertinent

- fiable

- remarquables

- a besoin

- un article

- chercheur

- ressource

- réponse

- réponses

- résultat

- Résultats

- retourner

- robuste

- régulièrement

- RANGÉE

- Courir

- sagemaker

- vente

- Escaliers intérieurs

- Schneider Electric

- Sciences

- Scientifique

- Sdk

- Rechercher

- Les moteurs de recherche

- SEC

- Deuxièmement

- secteur

- Secteurs

- sécurisé

- sur le lien

- sélection

- supérieur

- besoin

- Services

- plusieurs

- elle

- de façon significative

- similaires

- depuis

- petit

- sur mesure

- Solutions

- RÉSOUDRE

- quelques

- Identifier

- Sources

- spécialise

- groupe de neurones

- Spin

- pivoté

- state-of-the-art

- statistique

- étapes

- Étapes

- Boutique

- structures

- studio

- subdivisions

- filiale

- tel

- Appuyer

- combustion propre

- Système

- tâches

- Tâche

- tâches

- équipe

- équipes

- Technique

- texte

- que

- qui

- Le

- les informations

- leur

- Les

- théorique

- Là.

- donc

- Ces

- l'ont

- this

- pensée

- Avec

- Ainsi

- fiable

- à

- ensemble

- outil

- les outils

- top

- suivre

- échangés

- traditionnellement

- qualifié

- De La Carrosserie

- transformer

- digne de confiance

- Twitch

- deux

- devoiler

- compréhension

- ouvrir

- mise à jour

- Actualités

- us

- utilisé

- d'utiliser

- en utilisant

- Plus-value

- divers

- Vaste

- versions

- verticales

- via

- était

- Façon..

- façons

- we

- Richesse

- web

- services Web

- WELL

- Quoi

- Qu’est ce qu'

- quand

- qui

- tout en

- WHO

- la totalité

- sera

- comprenant

- dans les

- workflow

- workflows

- vos contrats

- world

- pourra

- X

- années

- york

- Vous n'avez

- zéphyrnet

Antoine Medeiros est responsable de l'ingénierie et de l'architecture de solutions chez Schneider Electric. Il se spécialise dans la mise en œuvre d'initiatives d'IA/ML de grande valeur pour de nombreuses fonctions commerciales en Amérique du Nord. Avec 17 ans d'expérience chez Schneider Electric, il apporte à l'équipe une richesse de connaissances industrielles et d'expertise technique.

Antoine Medeiros est responsable de l'ingénierie et de l'architecture de solutions chez Schneider Electric. Il se spécialise dans la mise en œuvre d'initiatives d'IA/ML de grande valeur pour de nombreuses fonctions commerciales en Amérique du Nord. Avec 17 ans d'expérience chez Schneider Electric, il apporte à l'équipe une richesse de connaissances industrielles et d'expertise technique. Blake Sanstchi est Business Intelligence Manager chez Schneider Electric, à la tête d'une équipe d'analyse axée sur le soutien de l'organisation commerciale grâce à des informations basées sur les données.

Blake Sanstchi est Business Intelligence Manager chez Schneider Electric, à la tête d'une équipe d'analyse axée sur le soutien de l'organisation commerciale grâce à des informations basées sur les données. Josué Lévy est directeur principal des sciences appliquées au sein du laboratoire Amazon Machine Learning Solutions, où il aide les clients à concevoir et à créer des solutions d'IA/ML pour résoudre des problèmes commerciaux clés.

Josué Lévy est directeur principal des sciences appliquées au sein du laboratoire Amazon Machine Learning Solutions, où il aide les clients à concevoir et à créer des solutions d'IA/ML pour résoudre des problèmes commerciaux clés. Kosta Belz est un scientifique appliqué senior chez AWS MLSL, spécialisé dans l'IA générative et le traitement de documents. Il est passionné par la création d'applications à l'aide des Knowledge Graphs et du NLP. Il possède environ 10 ans d'expérience dans la création de solutions de données et d'IA pour créer de la valeur pour les clients et les entreprises.

Kosta Belz est un scientifique appliqué senior chez AWS MLSL, spécialisé dans l'IA générative et le traitement de documents. Il est passionné par la création d'applications à l'aide des Knowledge Graphs et du NLP. Il possède environ 10 ans d'expérience dans la création de solutions de données et d'IA pour créer de la valeur pour les clients et les entreprises. Aude Genèvey est scientifique appliquée au sein de l'incubateur Amazon GenAI, où elle aide les clients à résoudre des problèmes commerciaux clés grâce au ML et à l'IA. Elle était auparavant chercheuse en ML théorique et aime appliquer ses connaissances pour proposer des solutions de pointe aux clients.

Aude Genèvey est scientifique appliquée au sein de l'incubateur Amazon GenAI, où elle aide les clients à résoudre des problèmes commerciaux clés grâce au ML et à l'IA. Elle était auparavant chercheuse en ML théorique et aime appliquer ses connaissances pour proposer des solutions de pointe aux clients. Md Sirajus Salekin est un scientifique appliqué chez AWS Machine Learning Solution Lab. Il aide les clients AWS à accélérer leur activité en créant des solutions IA/ML. Ses intérêts de recherche portent sur l'apprentissage automatique multimodal, l'IA générative et les applications de ML dans le domaine de la santé.

Md Sirajus Salekin est un scientifique appliqué chez AWS Machine Learning Solution Lab. Il aide les clients AWS à accélérer leur activité en créant des solutions IA/ML. Ses intérêts de recherche portent sur l'apprentissage automatique multimodal, l'IA générative et les applications de ML dans le domaine de la santé. Zichen Wang, PhD, est un scientifique appliqué senior chez AWS. Fort de plusieurs années d'expérience en recherche dans le développement de méthodes de ML et de statistiques utilisant des données biologiques et médicales, il travaille avec des clients de divers secteurs verticaux pour résoudre leurs problèmes de ML.

Zichen Wang, PhD, est un scientifique appliqué senior chez AWS. Fort de plusieurs années d'expérience en recherche dans le développement de méthodes de ML et de statistiques utilisant des données biologiques et médicales, il travaille avec des clients de divers secteurs verticaux pour résoudre leurs problèmes de ML. Anton Gridin est un architecte de solutions principal soutenant les comptes industriels mondiaux, basé à New York. Il possède plus de 15 ans d’expérience dans la création d’applications sécurisées et dans la direction d’équipes d’ingénierie.

Anton Gridin est un architecte de solutions principal soutenant les comptes industriels mondiaux, basé à New York. Il possède plus de 15 ans d’expérience dans la création d’applications sécurisées et dans la direction d’équipes d’ingénierie.