आज सोशल मीडिया खबरों का बड़ा जरिया है। यूजर्स न्यूज देखने के लिए फेसबुक और ट्विटर जैसे प्लेटफॉर्म पर भरोसा करते हैं। बीमा कंपनियों, प्रथम उत्तरदाताओं, कानून प्रवर्तन, और सरकारी एजेंसियों जैसे कुछ उद्योगों के लिए, प्रासंगिक घटनाओं के बारे में समाचारों को त्वरित रूप से संसाधित करने में सक्षम होने से उन्हें कार्रवाई करने में मदद मिल सकती है, जबकि ये घटनाएं अभी भी सामने आ रही हैं।

ऐसे समाधान की तलाश में टेक्स्ट डेटा से मूल्य निकालने की कोशिश करने वाले संगठनों के लिए यह असामान्य नहीं है जिसमें जटिल एनएलपी (प्राकृतिक भाषा प्रसंस्करण) मॉडल का प्रशिक्षण शामिल नहीं है। उन संगठनों के लिए, पूर्व-प्रशिक्षित एनएलपी मॉडल का उपयोग करना अधिक व्यावहारिक है। इसके अलावा, यदि चुना गया मॉडल अपनी सफलता मीट्रिक को संतुष्ट नहीं करता है, तो संगठन आसानी से किसी अन्य मॉडल को चुनने और पुनर्मूल्यांकन करने में सक्षम होना चाहते हैं।

वर्तमान में, निम्नलिखित के कारण टेक्स्ट डेटा से जानकारी निकालना पहले से कहीं अधिक आसान है:

- अत्याधुनिक, सामान्य-उद्देश्य वाले एनएलपी आर्किटेक्चर जैसे ट्रांसफॉर्मर का उदय

- डेवलपर्स और डेटा वैज्ञानिकों को क्लाउड पर बड़े पैमाने पर मशीन लर्निंग (एमएल) मॉडल बनाने, प्रशिक्षित करने और तैनात करने की क्षमता जैसी सेवाओं के साथ अमेज़न SageMaker

- सैकड़ों भाषाओं में हजारों पूर्व-प्रशिक्षित एनएलपी मॉडल की उपलब्धता और जैसे प्लेटफार्मों में समुदाय द्वारा प्रदान किए गए कई ढांचे के समर्थन के साथ हगिंग फेस हब

इस पोस्ट में, हम आपको दिखाते हैं कि रीयल-टाइम अलर्ट सिस्टम कैसे बनाया जाता है जो ट्विटर से समाचारों का उपभोग करता है और हगिंग फेस हब से पूर्व-प्रशिक्षित मॉडल का उपयोग करके ट्वीट्स को वर्गीकृत करता है। आप इस समाधान का उपयोग शून्य-शॉट वर्गीकरण के लिए कर सकते हैं, जिसका अर्थ है कि आप ट्वीट्स को लगभग किसी भी श्रेणी में वर्गीकृत कर सकते हैं, और वास्तविक समय के अनुमान के लिए सेजमेकर के साथ मॉडल को तैनात कर सकते हैं।

वैकल्पिक रूप से, यदि आप अपने ग्राहक की बातचीत में अंतर्दृष्टि की तलाश कर रहे हैं और सोशल मीडिया इंटरैक्शन का विश्लेषण करके ब्रांड जागरूकता को गहरा कर रहे हैं, तो हम आपको इसकी जांच करने के लिए प्रोत्साहित करते हैं। एआई-संचालित सोशल मीडिया डैशबोर्ड. समाधान का उपयोग करता है Amazon Comprehend, एक पूरी तरह से प्रबंधित एनएलपी सेवा जो मशीन सीखने के अनुभव की आवश्यकता के बिना पाठ में मूल्यवान अंतर्दृष्टि और कनेक्शन को उजागर करती है।

जीरो शॉट सीखना

एनएलपी और प्राकृतिक भाषा समझ (एनएलयू) के क्षेत्र तेजी से विकसित हुए हैं, जिसमें टेक्स्ट वर्गीकरण, प्रश्न उत्तर, सारांशीकरण, टेक्स्ट जनरेशन आदि शामिल हैं। यह विकास, आंशिक रूप से, अत्याधुनिक, सामान्य-उद्देश्य वाले आर्किटेक्चर जैसे ट्रांसफॉर्मर के उदय के लिए धन्यवाद, लेकिन ऐसे मॉडलों के प्रशिक्षण के लिए उपलब्ध अधिक और बेहतर-गुणवत्ता वाले टेक्स्ट कॉर्पोरा की उपलब्धता के कारण संभव हुआ है।

ट्रांसफॉर्मर आर्किटेक्चर एक जटिल तंत्रिका नेटवर्क है जिसे स्क्रैच से प्रशिक्षित होने के लिए डोमेन विशेषज्ञता और बड़ी मात्रा में डेटा की आवश्यकता होती है। BERT, RoBERta, T5, GPT-2, या DistilBERT जैसे पूर्व-प्रशिक्षित अत्याधुनिक ट्रांसफॉर्मर और विशिष्ट उपयोग के मामले में मॉडल को फाइन-ट्यून (ट्रांसफर लर्निंग) लेना एक आम बात है।

फिर भी, पूर्व-प्रशिक्षित एनएलपी मॉडल पर स्थानांतरण सीखना भी अक्सर एक चुनौतीपूर्ण कार्य हो सकता है, जिसके लिए बड़ी मात्रा में लेबल किए गए टेक्स्ट डेटा और डेटा को क्यूरेट करने के लिए विशेषज्ञों की एक टीम की आवश्यकता होती है। यह जटिलता अधिकांश संगठनों को इन मॉडलों का प्रभावी ढंग से उपयोग करने से रोकती है, लेकिन शून्य-शॉट सीखने से एमएल चिकित्सकों और संगठनों को इस कमी को दूर करने में मदद मिलती है।

ज़ीरो-शॉट लर्निंग एक विशिष्ट एमएल कार्य है जिसमें एक क्लासिफायरियर प्रशिक्षण के दौरान लेबल के एक सेट पर सीखता है, और फिर अनुमान के दौरान लेबल के एक अलग सेट पर मूल्यांकन किया जाता है जिसे क्लासिफायर ने पहले कभी नहीं देखा है। एनएलपी में, आप बिना किसी फाइन-ट्यूनिंग के टेक्स्ट को वर्गीकृत करने के लिए प्राकृतिक भाषा अनुमान (एनएलआई) कार्य पर प्रशिक्षित शून्य-शॉट अनुक्रम क्लासिफायरियर का उपयोग कर सकते हैं। इस पोस्ट में, हम लोकप्रिय NLI . का उपयोग करते हैं बार्ट ट्वीट्स को वर्गीकृत करने के लिए मॉडल बार्ट-लार्ज-एमएनली। यह एक बड़ा पूर्व-प्रशिक्षित मॉडल (1.6 जीबी) है, जो हगिंग फेस मॉडल हब पर उपलब्ध है।

हगिंग फेस एक एआई कंपनी है जो 100 से अधिक विभिन्न भाषाओं में हजारों पूर्व-प्रशिक्षित एनएलपी मॉडल (ट्रांसफॉर्मर) के साथ एक ओपन-सोर्स प्लेटफॉर्म (हगिंग फेस हब) का प्रबंधन करती है और विभिन्न फ्रेमवर्क जैसे कि टेंसरफ्लो और पाइटोरच के समर्थन के साथ। ट्रांसफॉर्मर लाइब्रेरी डेवलपर्स और डेटा वैज्ञानिकों को जटिल एनएलपी और एनएलयू कार्यों जैसे वर्गीकरण, सूचना निष्कर्षण, प्रश्न उत्तर, सारांशीकरण, अनुवाद और टेक्स्ट जनरेशन में प्रारंभ करने में सहायता करती है।

एडब्ल्यूएस और हगिंग फेस एनएलपी मॉडल को अपनाने को सरल और तेज करने के लिए सहयोग कर रहे हैं। PyTorch या TensorFlow में प्रशिक्षण और अनुमान के लिए डीप लर्निंग कंटेनर्स (DLCs) का एक सेट, और SageMaker Python SDK के लिए हगिंग फेस एस्टिमेटर्स और प्रेडिक्टर्स अब उपलब्ध हैं। ये क्षमताएं सभी स्तरों की विशेषज्ञता वाले डेवलपर्स को आसानी से एनएलपी के साथ आरंभ करने में मदद करती हैं।

समाधान का अवलोकन

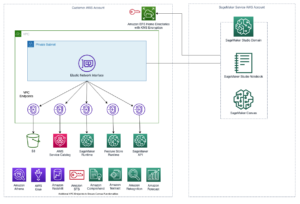

हम एक कार्यशील समाधान प्रदान करते हैं जो चयनित ट्विटर खातों से वास्तविक समय में ट्वीट प्राप्त करता है। हमारे समाधान के प्रदर्शन के लिए, हम तीन खातों का उपयोग करते हैं, Amazon Web Services (@awscloud), एडब्ल्यूएस सुरक्षा (@AWSSSecurityInfo), और अमेज़ॅन साइंस (@अमेजन साइंस), और उनकी सामग्री को निम्नलिखित श्रेणियों में से एक में वर्गीकृत करें: सुरक्षा, डेटाबेस, गणना, भंडारण और मशीन लर्निंग। यदि मॉडल 40% से अधिक विश्वास स्कोर वाली श्रेणी लौटाता है, तो एक सूचना भेजी जाती है।

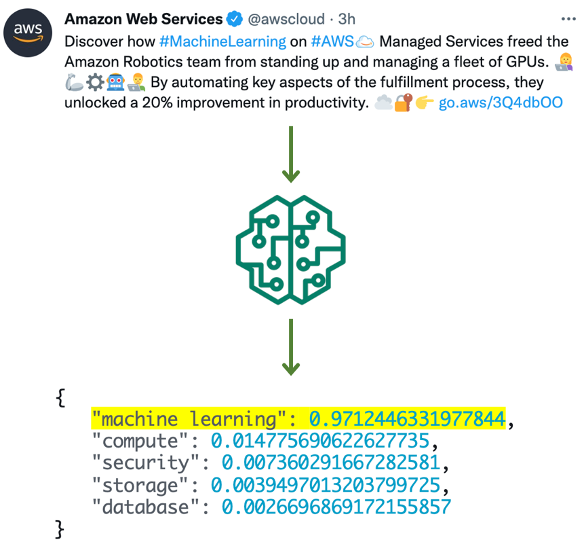

निम्नलिखित उदाहरण में, मॉडल ने अमेज़ॅन वेब सर्विसेज के एक ट्वीट को मशीन लर्निंग कैटेगरी में वर्गीकृत किया, जिसमें 97% का कॉन्फिडेंस स्कोर था, जो एक अलर्ट उत्पन्न करता था।

समाधान एक हगिंग फेस पूर्व-प्रशिक्षित ट्रांसफॉर्मर मॉडल (हगिंग फेस हब से) पर निर्भर करता है ताकि ट्वीट्स को लेबल के एक सेट के आधार पर वर्गीकृत किया जा सके जो कि अनुमान के समय प्रदान किए जाते हैं- मॉडल को प्रशिक्षित करने की आवश्यकता नहीं होती है। निम्नलिखित स्क्रीनशॉट अधिक उदाहरण दिखाते हैं और उन्हें कैसे वर्गीकृत किया गया था।

हम आपको अपने लिए समाधान का प्रयास करने के लिए प्रोत्साहित करते हैं। बस से स्रोत कोड डाउनलोड करें गिटहब भंडार और रीडमी फ़ाइल में परिनियोजन निर्देशों का पालन करें।

समाधान वास्तुकला

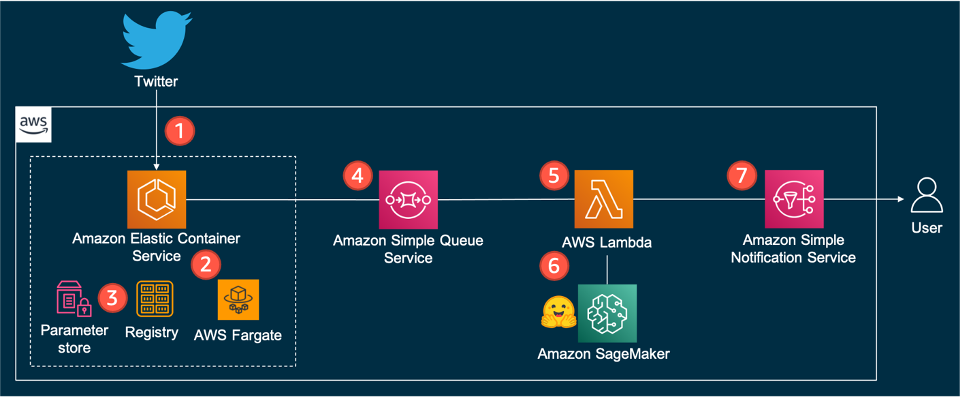

समाधान ट्विटर के एंडपॉइंट के लिए एक खुला कनेक्शन रखता है और जब कोई नया ट्वीट आता है, तो एक कतार में एक संदेश भेजता है। एक उपभोक्ता कतार से संदेश पढ़ता है, वर्गीकरण समापन बिंदु को कॉल करता है, और परिणामों के आधार पर, अंतिम उपयोगकर्ता को सूचित करता है।

निम्नलिखित समाधान का आर्किटेक्चर आरेख है।

समाधान वर्कफ़्लो में निम्नलिखित घटक होते हैं:

- समाधान वास्तविक समय में कॉन्फ़िगर किए गए नियमों (रुचि के खातों से ट्वीट) से मेल खाने वाले ट्वीट प्राप्त करने के लिए ट्विटर के स्ट्रीम एपीआई पर निर्भर करता है। ऐसा करने के लिए, कंटेनर के अंदर चलने वाला एप्लिकेशन ट्विटर के एंडपॉइंट से एक खुला कनेक्शन रखता है। को देखें ट्विटर एपीआई अधिक जानकारी के लिए.

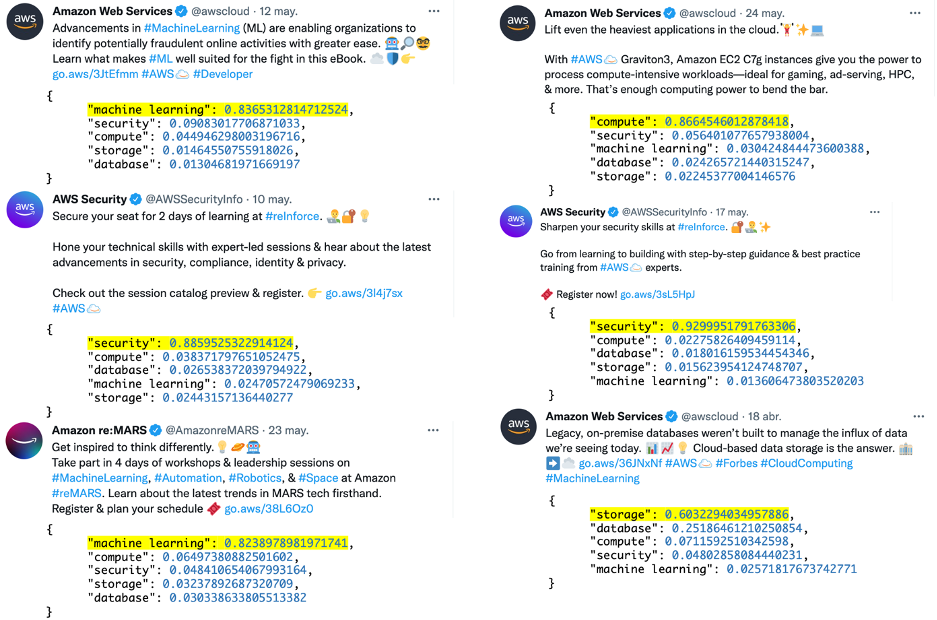

- कंटेनर चलता है अमेज़ॅन इलास्टिक कंटेनर सेवा (अमेज़ॅन ईसीएस), एक पूरी तरह से प्रबंधित कंटेनर ऑर्केस्ट्रेशन सेवा जो आपके लिए कंटेनरीकृत अनुप्रयोगों को तैनात, प्रबंधित और स्केल करना आसान बनाती है। एक एकल कार्य सर्वर रहित आधारभूत संरचना पर चलता है जिसे प्रबंधित किया जाता है AWS फरगेट.

- ट्विटर बियरर टोकन सुरक्षित रूप से संग्रहीत है एडब्ल्यूएस सिस्टम मैनेजर पैरामीटर स्टोर, की क्षमता एडब्ल्यूएस सिस्टम मैनेजर जो कॉन्फ़िगरेशन डेटा और रहस्यों के लिए सुरक्षित, श्रेणीबद्ध भंडारण प्रदान करता है। कंटेनर छवि को होस्ट किया गया है अमेज़ॅन इलास्टिक कंटेनर रजिस्ट्री (अमेज़ॅन ईसीआर), एक पूरी तरह से प्रबंधित कंटेनर रजिस्ट्री जो उच्च-प्रदर्शन होस्टिंग प्रदान करती है।

- जब भी कोई नया ट्वीट आता है, तो कंटेनर एप्लिकेशन ट्वीट को एक में डाल देता है अमेज़ॅन सरल कतार सेवा (अमेज़ॅन एसक्यूएस) कतार। अमेज़ॅन एसक्यूएस एक पूरी तरह से प्रबंधित संदेश कतार सेवा है जो आपको माइक्रोसर्विसेज, वितरित सिस्टम और सर्वर रहित अनुप्रयोगों को अलग करने और स्केल करने में सक्षम बनाता है।

- समाधान का तर्क a . में रहता है AWS लाम्बा समारोह। लैम्ब्डा एक सर्वर रहित, घटना-संचालित कंप्यूट सेवा है। फ़ंक्शन कतार से नए ट्वीट का उपभोग करता है और एक समापन बिंदु पर कॉल करके उन्हें वर्गीकृत करता है।

- एंडपॉइंट एक हगिंग फेस मॉडल पर निर्भर करता है और इसे सेजमेकर पर होस्ट किया जाता है। समापन बिंदु अनुमान चलाता है और ट्वीट के वर्ग को आउटपुट करता है।

- वर्गीकरण के आधार पर, फ़ंक्शन के माध्यम से एक अधिसूचना उत्पन्न करता है अमेज़न सरल अधिसूचना सेवा (अमेज़ॅन एसएनएस), एक पूरी तरह से प्रबंधित संदेश सेवा। आप एसएनएस विषय की सदस्यता ले सकते हैं, और कई गंतव्य उस अधिसूचना को प्राप्त कर सकते हैं (देखें अमेज़ॅन एसएनएस घटना स्थलों) उदाहरण के लिए, आप इनबॉक्स में ईमेल संदेशों के रूप में सूचना वितरित कर सकते हैं (देखें ईमेल सूचनाएं).

सेजमेकर के साथ हगिंग फेस मॉडल तैनात करें

आप सार्वजनिक रूप से उपलब्ध 10,000 से अधिक मॉडलों में से कोई भी चुन सकते हैं हगिंग फेस मॉडल हब और उन्हें उपयोग करके SageMaker के साथ परिनियोजित करें गले लगाना चेहरा अनुमान डीएलसी.

उपयोग करते समय एडब्ल्यूएस CloudFormation, आप सार्वजनिक रूप से उपलब्ध में से एक का चयन करें हगिंग फेस इंट्रेंस कंटेनर्स और मॉडल और कार्य को कॉन्फ़िगर करें। यह समाधान का उपयोग करता है facebook/bart-बड़े-mnli मॉडल और शून्य-शॉट-वर्गीकरण कार्य, लेकिन आप नीचे दिए गए किसी भी मॉडल को चुन सकते हैं जीरो-शॉट वर्गीकरण हगिंग फेस मॉडल हब पर। आप अपने CloudFormation टेम्प्लेट में HF_MODEL_ID और HF_TASK पर्यावरण चर सेट करके उन्हें कॉन्फ़िगर करते हैं, जैसा कि निम्न कोड में है:

वैकल्पिक रूप से, यदि आप AWS CloudFormation का उपयोग नहीं कर रहे हैं, तो आप कोड की कुछ पंक्तियों के साथ समान परिणाम प्राप्त कर सकते हैं। को देखें Amazon SageMaker में मॉडल डिप्लॉय करें अधिक जानकारी के लिए.

सामग्री को वर्गीकृत करने के लिए, आप बस सेजमेकर एंडपॉइंट को कॉल करें। निम्नलिखित एक पायथन कोड स्निपेट है:

ध्यान दें झूठा के लिए मूल्य बहु_वर्ग यह इंगित करने के लिए पैरामीटर कि प्रत्येक वर्ग के लिए सभी संभावनाओं का योग 1 तक जुड़ जाएगा।

समाधान सुधार

आप ट्वीट और मॉडल परिणामों को संग्रहीत करके यहां प्रस्तावित समाधान को बढ़ा सकते हैं। अमेज़न सरल भंडारण सेवा (अमेज़ॅन एस 3), एक वस्तु भंडारण सेवा, एक विकल्प है। आप ट्वीट, परिणाम और अन्य मेटाडेटा को JSON ऑब्जेक्ट के रूप में S3 बकेट में लिख सकते हैं। फिर आप का उपयोग करके उस सामग्री के विरुद्ध तदर्थ प्रश्न कर सकते हैं अमेज़न एथेना, एक इंटरैक्टिव क्वेरी सेवा जो मानक SQL का उपयोग करके Amazon S3 में डेटा का विश्लेषण करना आसान बनाती है।

आप इतिहास का उपयोग न केवल अंतर्दृष्टि निकालने के लिए कर सकते हैं बल्कि कस्टम मॉडल को प्रशिक्षित करने के लिए भी कर सकते हैं। आप सेजमेकर के साथ अपने स्वयं के डेटा के साथ एक मॉडल को प्रशिक्षित करने के लिए हगिंग फेस सपोर्ट का उपयोग कर सकते हैं। अधिक जानें अमेज़ॅन सेजमेकर पर प्रशिक्षण चलाएं.

वास्तविक-विश्व उपयोग के मामले

ग्राहक पहले से ही सेजमेकर पर हगिंग फेस मॉडल के साथ प्रयोग कर रहे हैं। सेगुरोस बोलिवार1939 में स्थापित एक कोलंबियाई वित्तीय और बीमा कंपनी, एक उदाहरण है।

"हमने ग्राहकों और बीमा दलालों के लिए एक खतरा अधिसूचना समाधान विकसित किया है। हम दावों को कम करने में मदद करने के लिए रोकथाम रणनीति के रूप में अपने ग्राहकों के लिए सूचनाएँ तैयार करने के लिए प्रासंगिक खातों से ट्वीट्स को वर्गीकृत करने के लिए हगिंग फेस पूर्व-प्रशिक्षित एनएलपी मॉडल का उपयोग करते हैं। दावा इसलिए होता है क्योंकि ग्राहकों को उनके जोखिम के स्तर के बारे में पता नहीं होता है। समाधान हमें अपने ग्राहकों में जागरूकता पैदा करने की अनुमति देता है, जोखिम को ठोस स्थितियों में मापने योग्य चीज़ में बदल देता है। ”

- जूलियन रिको, सेगुरोस बोलिवर में अनुसंधान और ज्ञान के प्रमुख।

Seguros Bolívar ने AWS के साथ अपने समाधान को फिर से बनाने के लिए काम किया; यह अब सेजमेकर पर निर्भर करता है और इस पोस्ट में वर्णित एक जैसा दिखता है।

निष्कर्ष

शून्य-शॉट वर्गीकरण आदर्श है जब आपके पास कस्टम टेक्स्ट क्लासिफायर को प्रशिक्षित करने के लिए बहुत कम डेटा होता है या जब आप कस्टम एनएलपी मॉडल को प्रशिक्षित करने का जोखिम नहीं उठा सकते हैं। विशेष उपयोग के मामलों के लिए, जब टेक्स्ट विशिष्ट शब्दों या शर्तों पर आधारित होता है, तो कस्टम प्रशिक्षण सेट के आधार पर पर्यवेक्षित वर्गीकरण मॉडल के साथ जाना बेहतर होता है।

इस पोस्ट में, हमने आपको दिखाया कि AWS पर हगिंग फेस जीरो-शॉट मॉडल का उपयोग करके एक समाचार क्लासिफायरियर कैसे बनाया जाता है। हमने अपने समाचार स्रोत के रूप में ट्विटर का उपयोग किया, लेकिन आप एक ऐसा समाचार स्रोत चुन सकते हैं जो आपकी विशिष्ट आवश्यकताओं के लिए अधिक उपयुक्त हो। इसके अलावा, आप आसानी से मॉडल को बदल सकते हैं, बस अपने चुने हुए मॉडल को CloudFormation टेम्पलेट में निर्दिष्ट करें।

स्रोत कोड के लिए, देखें गिटहब भंडार इसमें पूर्ण सेटअप निर्देश शामिल हैं। आप इसे स्वयं क्लोन कर सकते हैं, बदल सकते हैं, परिनियोजित कर सकते हैं और चला सकते हैं। आप इसे शुरुआती बिंदु के रूप में भी उपयोग कर सकते हैं और श्रेणियों और अलर्ट लॉजिक को अनुकूलित कर सकते हैं या समान उपयोग के मामले के लिए कोई अन्य समाधान बना सकते हैं।

कृपया इसे आज़माएं, और हमें बताएं कि आप क्या सोचते हैं। हमेशा की तरह, हम आपकी प्रतिक्रिया की प्रतीक्षा कर रहे हैं। आप इसे अपने सामान्य AWS सपोर्ट कॉन्टैक्ट्स, या में भेज सकते हैं SWSMaker के लिए AWS फोरम.

लेखक के बारे में

डेविड लारेडो LATAM में AWS Envision Engineering में प्रोटोटाइप आर्किटेक्ट हैं, जहाँ उन्होंने कई मशीन लर्निंग प्रोटोटाइप विकसित करने में मदद की है। पहले उन्होंने मशीन लर्निंग इंजीनियर के रूप में काम किया है और 5 वर्षों से अधिक समय से मशीन लर्निंग कर रहे हैं। उनकी रुचि के क्षेत्र एनएलपी, टाइम सीरीज़ और एंड-टू-एंड एमएल हैं।

डेविड लारेडो LATAM में AWS Envision Engineering में प्रोटोटाइप आर्किटेक्ट हैं, जहाँ उन्होंने कई मशीन लर्निंग प्रोटोटाइप विकसित करने में मदद की है। पहले उन्होंने मशीन लर्निंग इंजीनियर के रूप में काम किया है और 5 वर्षों से अधिक समय से मशीन लर्निंग कर रहे हैं। उनकी रुचि के क्षेत्र एनएलपी, टाइम सीरीज़ और एंड-टू-एंड एमएल हैं।

राफेल वर्नैक ब्राजील में स्थित एडब्ल्यूएस एनविजन इंजीनियरिंग में एक वरिष्ठ प्रोटोटाइप आर्किटेक्ट है। इससे पहले, उन्होंने Amazon.com.br और Amazon RDS Performance Insights पर सॉफ़्टवेयर डेवलपमेंट इंजीनियर के रूप में काम किया।

राफेल वर्नैक ब्राजील में स्थित एडब्ल्यूएस एनविजन इंजीनियरिंग में एक वरिष्ठ प्रोटोटाइप आर्किटेक्ट है। इससे पहले, उन्होंने Amazon.com.br और Amazon RDS Performance Insights पर सॉफ़्टवेयर डेवलपमेंट इंजीनियर के रूप में काम किया।

विक्रम एलंगो वर्जीनिया, यूएसए में स्थित Amazon Web Services में AI/ML विशेषज्ञ समाधान वास्तुकार हैं। विक्रम वित्तीय और बीमा उद्योग के ग्राहकों को बड़े पैमाने पर मशीन लर्निंग एप्लिकेशन बनाने और तैनात करने के लिए डिजाइन और विचारशील नेतृत्व के साथ मदद करता है। वह वर्तमान में पूरे उद्यम में प्राकृतिक भाषा प्रसंस्करण, जिम्मेदार एआई, अनुमान अनुकूलन और एमएल स्केलिंग पर केंद्रित है। अपने खाली समय में, उन्हें अपने परिवार के साथ यात्रा करना, लंबी पैदल यात्रा, खाना बनाना और शिविर लगाना पसंद है।

विक्रम एलंगो वर्जीनिया, यूएसए में स्थित Amazon Web Services में AI/ML विशेषज्ञ समाधान वास्तुकार हैं। विक्रम वित्तीय और बीमा उद्योग के ग्राहकों को बड़े पैमाने पर मशीन लर्निंग एप्लिकेशन बनाने और तैनात करने के लिए डिजाइन और विचारशील नेतृत्व के साथ मदद करता है। वह वर्तमान में पूरे उद्यम में प्राकृतिक भाषा प्रसंस्करण, जिम्मेदार एआई, अनुमान अनुकूलन और एमएल स्केलिंग पर केंद्रित है। अपने खाली समय में, उन्हें अपने परिवार के साथ यात्रा करना, लंबी पैदल यात्रा, खाना बनाना और शिविर लगाना पसंद है।

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़ॅन मशीन लर्निंग

- अमेज़न SageMaker

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- हगिंग फ़ेस

- यंत्र अधिगम

- प्राकृतिक भाषा संसाधन

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- तकनीकी

- पाठ वर्गीकरण

- जेफिरनेट

- जीरो-शॉट लर्निंग