मशीन लर्निंग (एमएल) प्रौद्योगिकी के सबसे सफल और व्यापक अनुप्रयोगों में से एक साबित हुआ है, जो उद्योगों की एक विस्तृत श्रृंखला को प्रभावित करता है और हर दिन अरबों उपयोगकर्ताओं को प्रभावित करता है। हर उद्योग में एमएल के इस तेजी से अपनाने के साथ, कंपनियों को कम विलंबता पूर्वानुमानों का समर्थन करने और संसाधन उपयोग को अधिकतम करने और संबंधित लागत को कम करने के दौरान उच्च उपलब्धता के साथ चुनौतियों का सामना करना पड़ रहा है। चूंकि प्रत्येक एमएल ढांचे की अपनी निर्भरताएं होती हैं, और प्रत्येक ढांचे के लिए परिनियोजन चरण अलग-अलग होते हैं, उत्पादन में विभिन्न ढांचे में निर्मित मॉडलों को तैनात करना और प्रत्येक समापन बिंदु का प्रबंधन अधिक से अधिक जटिल हो जाता है।

अमेज़न SageMaker मल्टी-कंटेनर एंडपॉइंट्स (एमसीई) हमें अलग-अलग फ्रेमवर्क पर मॉडल को समूहबद्ध करने और एक ही एंडपॉइंट बनाने के लिए एक ही होस्ट पर तैनात करने में सक्षम बनाता है। आप मॉडल बनाने के लिए उपयोग किए जा रहे विभिन्न ढांचे के लिए कंटेनर प्रदान कर सकते हैं, और सेजमेकर इन सभी कंटेनरों को लेता है और उन्हें एक एंडपॉइंट के पीछे रखता है। उदाहरण के लिए, आपके पास एक PyTorch और एक TensorFlow मॉडल हो सकता है जो समान या पूरी तरह से अलग-अलग उपयोग के मामलों की सेवा करने वाले दो समर्पित समापन बिंदुओं पर लोड किया गया हो, और इन दोनों मॉडलों में रुक-रुक कर आने वाला ट्रैफ़िक होता है जो संसाधनों का उपयोग अपनी सीमा तक नहीं करता है। ऐसे परिदृश्य में, आप एमसीई का उपयोग करके कंटेनरों का उपयोग करके उन्हें एक साथ जोड़ सकते हैं, संसाधनों के उपयोग में सुधार कर सकते हैं, जबकि दोनों मॉडलों को अलग-अलग समापन बिंदुओं से सेवा देने में होने वाली लागत को कम कर सकते हैं।

मल्टी-कंटेनर एंडपॉइंट अलग-अलग एमएल फ्रेमवर्क, मॉडल सर्वर और एल्गोरिदम पर बनाए गए 15 मॉडल तक तैनात करने के लिए एक स्केलेबल और लागत प्रभावी समाधान प्रदान करते हैं, जिसका अर्थ है कि आपके पास विविध एमएल फ्रेमवर्क या मध्यस्थ पर निर्मित मॉडल हो सकते हैं। इन सभी कंटेनरों और मॉडलों में कदम रखें। इन सभी मॉडलों को प्रत्यक्ष आमंत्रण के माध्यम से व्यक्तिगत रूप से एक्सेस किया जा सकता है या सीरियल इनवोकेशन का उपयोग करके एक पाइपलाइन में सिला जा सकता है, जहां एक मॉडल का आउटपुट अगले एक के लिए इनपुट होता है।

इस पोस्ट में, हम चर्चा करते हैं कि सेजमेकर पर मल्टी-फ्रेमवर्क मॉडल के साथ लागत-कुशल एमएल अनुमान कैसे करें।

एमसीई आमंत्रण पैटर्न

सेजमेकर एमसीई डायरेक्ट इनवोकेशन उन मामलों में उपयोगी है जहां आपने एमसीई एंडपॉइंट में असंबंधित मॉडल को क्लब किया है या आप उनके प्रदर्शन को मापने के लिए एमसीई एंडपॉइंट के पीछे मॉडल के बीच ए/बी टेस्ट चला रहे हैं। आप विशिष्ट कंटेनर को सीधे एपीआई कॉल में कॉल कर सकते हैं और उस मॉडल से भविष्यवाणी प्राप्त कर सकते हैं।

सीरियल इनवोकेशन के साथ, आप 2-15 कंटेनरों को एक साथ सिलाई कर सकते हैं, और एक का आउटपुट क्रम में अगले कंटेनर का इनपुट बन जाता है। यह एक आदर्श उपयोग का मामला है, उदाहरण के लिए, आपके पास एक बहु-चरण भविष्यवाणी पाइपलाइन है जहां एक स्किकिट-लर्न मॉडल का उपयोग मध्यवर्ती भविष्यवाणी के लिए किया जाता है और परिणाम अंतिम अनुमान के लिए एक TensorFlow मॉडल को खिलाया जाता है। उन्हें अलग-अलग एंडपॉइंट के रूप में तैनात करने और किसी अन्य एप्लिकेशन या जॉब को ऑर्केस्ट्रेट करने और कई एपीआई कॉल करने के बजाय, आप उन्हें सेजमेकर एमसीई के रूप में तैनात कर सकते हैं, तर्क को अमूर्त कर सकते हैं और उन्हें सीरियल इनवोकेशन के लिए सेट कर सकते हैं, जहां सेजमेकर एक कंटेनर के बीच डेटा ट्रांसफर का प्रबंधन करता है। दूसरे को स्वचालित रूप से और एपीआई अनुरोध करने वाले क्लाइंट को अंतिम कंटेनर के आउटपुट को उत्सर्जित करता है।

सेजमेकर एमसीई सीरियल इनवोकेशन सेजमेकर सीरियल इंट्रेंस पाइपलाइन (नीचे दिए गए सेक्शन में अधिक विवरण) से मौलिक रूप से अलग है। एक सीरियल इंट्रेंस पाइपलाइन को जटिल एमएल वर्कफ़्लो को ऑर्केस्ट्रेट करने के लिए अधिक लक्षित किया जाता है जैसे कि डेटा प्रीप्रोसेसिंग, एक मॉडल पहनावा का निर्माण, यह निर्धारित करने के लिए सशर्त जाँच को लागू करना कि किस मॉडल को लागू करना है, या भविष्यवाणी को पोस्टप्रोसेस करना है, भविष्यवाणी को डाउनस्ट्रीम अनुप्रयोगों में भेजे जाने से पहले व्यावसायिक तर्क को शामिल करना है। . इसके विपरीत, एमसीई सीरियल इनवोकेशन को 2-14 मॉडल को अनुमान के लिए एक पाइपलाइन में सिलाई करने के लिए डिज़ाइन किया गया है, प्रत्येक मॉडल पिछले मॉडल की भविष्यवाणी को इनपुट के रूप में लेता है।

एमसीई में सभी कंटेनर हमेशा सेवा में और मेमोरी में होते हैं, इसलिए एंडपॉइंट को लागू करते समय कोई ठंडी शुरुआत नहीं होती है। एमसीई भी एंडपॉइंट उपयोग में सुधार करते हैं और लागत में सुधार करते हैं क्योंकि मॉडल एक एंडपॉइंट के पीछे तैनात होते हैं और व्यक्तिगत गणना संसाधनों पर कब्जा करने वाले प्रत्येक मॉडल के बजाय अंतर्निहित गणना उदाहरण साझा करते हैं।

आइए कुछ उपयोग के मामलों को देखें और देखें कि आप एमएल अनुमान को अनुकूलित करने के लिए सेजमेकर एमसीई का उपयोग कैसे कर सकते हैं।

सेजमेकर एमसीई के लिए मामलों का प्रयोग करें

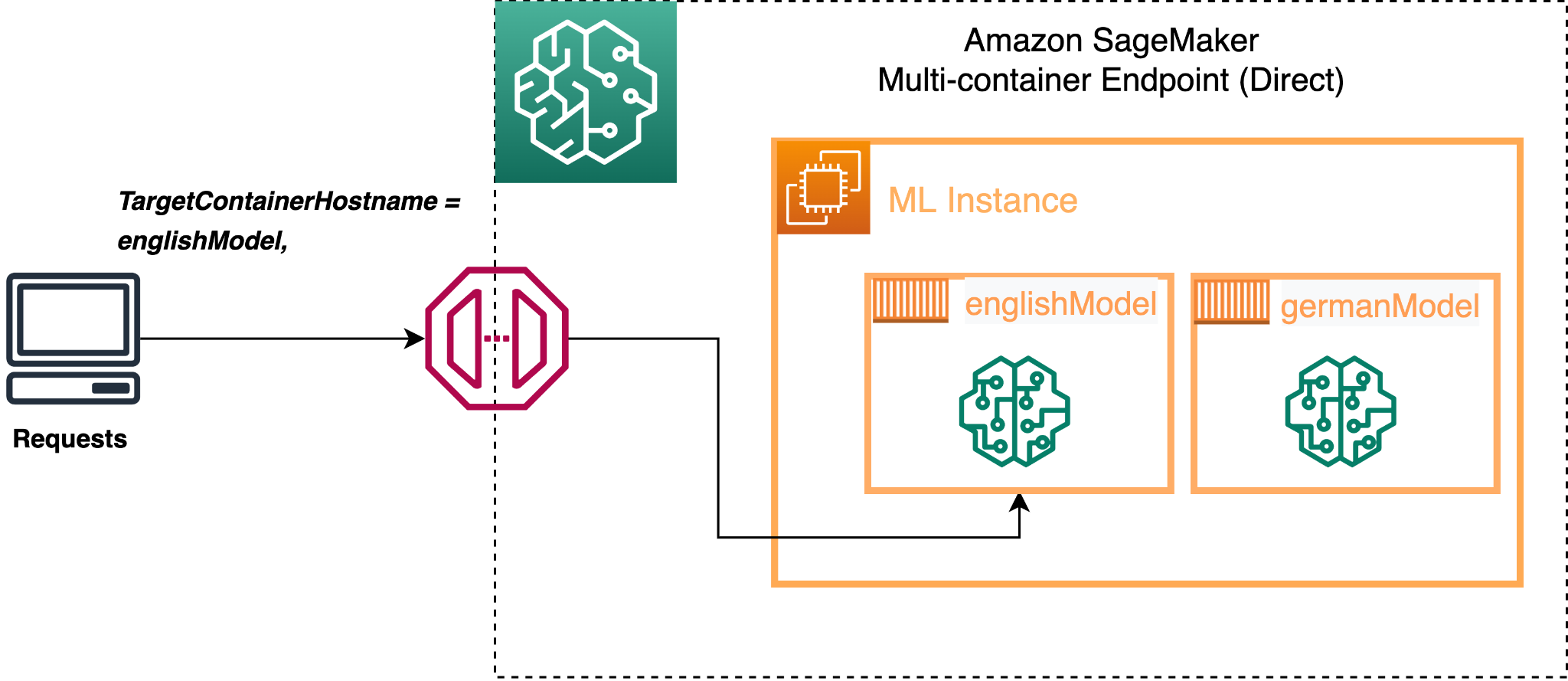

मान लीजिए कि आपके पास भावना वर्गीकरण के लिए दो मॉडल हैं, एक अंग्रेजी भाषा के लिए और दूसरा जर्मन भाषा के लिए, और ये मॉडल एक दिन में अलग-अलग समय पर आने वाले ट्रैफ़िक के साथ अलग-अलग भौगोलिक क्षेत्रों की सेवा कर रहे हैं। 24/7 चलने वाले दो एंडपॉइंट होने के बजाय, आप एमसीई का उपयोग करके दोनों को एक एंडपॉइंट में तैनात कर सकते हैं और सीधे आमंत्रण का उपयोग करके उन तक पहुंच सकते हैं, जिससे आपके संसाधन उपयोग और लागत का अनुकूलन हो सकता है। निम्नलिखित कोड देखें:

इस उदाहरण में, हमारे पास दो मॉडल हैं (englishModel और germanModel), और हम SageMaker . में कंटेनरों को परिभाषित करते हैं create_model निर्माण और परिभाषित करें InferenceExecutionConfig 'प्रत्यक्ष' के रूप में। अब हम निष्कर्ष के लिए समापन बिंदु कह सकते हैं और परिभाषित कर सकते हैं TargetContainerHostname किसी भी रूप में englishModel or germanModel एपीआई कॉल करने वाले क्लाइंट के आधार पर:

आप मॉडल के बीच प्रदर्शन की तुलना करने के लिए ए/बी परीक्षण चलाने के लिए एमसीई के भीतर प्रत्यक्ष आमंत्रण का भी उपयोग कर सकते हैं।

निम्नलिखित चित्र हमारी वास्तुकला को दर्शाता है।

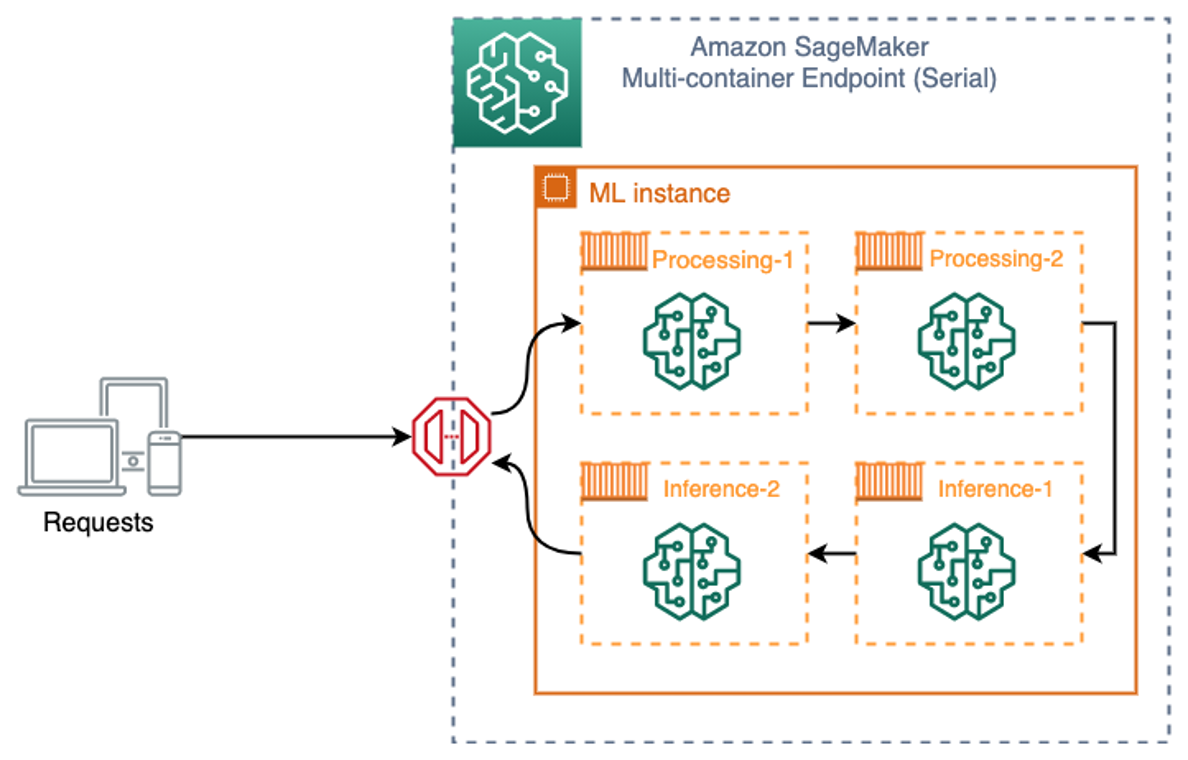

इसी तरह, अन्य एमएल उपयोग के मामलों में, जब एक अनुरोध को संसाधित करने के लिए प्रशिक्षित मॉडल का उपयोग किया जाता है, तो मॉडल को एक प्रारूप में डेटा प्राप्त होता है जिसे अनुमान के लिए एल्गोरिदम को पारित करने से पहले पूर्व-संसाधित (उदाहरण के लिए, चित्रित) की आवश्यकता होती है। जब एमएल एल्गोरिदम एक साथ जंजीर से बंधे होते हैं, तो अंतिम परिणाम तक पहुंचने से पहले एक मॉडल का आउटपुट अगले के लिए इनपुट के रूप में कार्य करता है। इस मामले में, आप एक सेजमेकर एमसीई सीरियल पाइपलाइन का निर्माण कर सकते हैं, जहां कंटेनर एक दूसरे से उस क्रम में बात करते हैं, जिसे परिभाषित किया गया है। create_model इन सभी मॉडलों और एपीआई कॉलों के बीच डेटा के प्रवाह को सुविधाजनक बनाने के लिए आप प्रत्येक मॉडल को अलग-अलग समापन बिंदुओं में तैनात करने और एक स्वतंत्र तर्क लिखने के बजाय निर्माण करें। निम्नलिखित चित्र इस वास्तुकला को दर्शाता है।

इस उपयोग के मामले के लिए, हम निम्नलिखित कोड का उपयोग करते हैं:

इस उदाहरण में, हमारे पास दो प्रोसेसिंग कंटेनर हैं (Processing-1 और Processing-2) फीचर प्रोसेसिंग और डेटा ट्रांसफॉर्मेशन के लिए, और दो इंट्रेंस कंटेनर (Inference-1 और Inference-2) पूर्वसंसाधित डेटा पर एमएल मॉडल की भविष्यवाणी चलाने के लिए। PipelineModel उदाहरण आपको चार कंटेनरों के रैखिक अनुक्रम से बना अनुमान पाइपलाइन को परिभाषित करने की अनुमति देता है जो डेटा पर अनुमान के लिए अनुरोध संसाधित करता है। कंटेनर एक ही उदाहरण पर सह-स्थित होते हैं, जिससे आप कम विलंबता के साथ अनुमान चला सकते हैं।

बड़ी संख्या में मॉडलों के लिए बहु-मॉडल समापन बिंदु स्केल करें

मॉडल समेकन के पैमाने के आधार पर सेजमेकर मल्टी-मॉडल एंडपॉइंट्स के लाभ बढ़ते हैं। एक समापन बिंदु के साथ दो मॉडलों की मेजबानी करते समय आप लागत बचत देख सकते हैं, और सैकड़ों या हजारों मॉडलों के उपयोग के मामलों के लिए, बचत बहुत अधिक है।

एमसीई एंडपॉइंट्स को स्केल करना भी इसका उपयोग करके सीधा है SageMakerVariantInvocationsPerInstance पूर्वनिर्धारित मीट्रिक, जो प्रति मिनट औसत संख्या देता है कि एक मॉडल समापन बिंदु के लिए प्रत्येक उदाहरण को परिभाषित करने के लिए लागू किया जाता है TargetScaling नीति। सेजमेकर आपके कार्यभार में परिवर्तन के जवाब में एक मॉडल के लिए प्रावधान किए गए उदाहरणों की संख्या को गतिशील रूप से समायोजित करता है। जब कार्यभार बढ़ता है, तो ऑटोस्केलिंग अधिक उदाहरण ऑनलाइन लाता है और अनुरोधों को पूरा करने के लिए लक्ष्य मॉडल और कंटेनरों के साथ लोड होता है। जब कार्यभार कम हो जाता है, तो ऑटोस्केलिंग अनावश्यक उदाहरणों को हटा देता है और मॉडल कंटेनरों को उतार देता है ताकि कंटेनर संसाधनों का उपभोग न करें, और आप उन उदाहरणों के लिए भुगतान नहीं करते हैं जिनका आप उपयोग नहीं कर रहे हैं। किसी दिए गए मॉडल के खिलाफ पहले अनुरोध को पूरा करने का समय मॉडल को डाउनलोड करने के लिए अतिरिक्त विलंबता (जिसे कोल्ड स्टार्ट कहा जाता है) का अनुभव करता है अमेज़न सरल भंडारण सेवा (अमेज़ॅन एस 3) और इसे मेमोरी में लोड करें। बाद के कॉल बिना किसी अतिरिक्त ओवरहेड के समाप्त हो जाते हैं क्योंकि मॉडल पहले ही लोड हो चुका है। निम्नलिखित कोड देखें:

पिछले उदाहरण नीति विन्यास के बाद, हम उपयोग करते हैं SageMakerVariantInvocationsPerInstance विभिन्न इंस्टेंस की संख्या को समायोजित करने के लिए पूर्वनिर्धारित मीट्रिक ताकि प्रत्येक इंस्टेंस में एक InvocationsPerInstance 70 का मीट्रिक।

हम अपने स्वयं के कस्टम मीट्रिक के आधार पर सेजमेकर एमसीई को भी स्केल कर सकते हैं, जैसे कि CPUUtilization, MemoryUtilization, GPUUtilization, GPUMemoryUtilizationया, DiskUtilization, किसी विशिष्ट संसाधन के उपयोग के आधार पर उदाहरणों की संख्या को बढ़ाना या घटाना। अधिक जानकारी के लिए देखें अमेज़ॅन सेजमेकर मॉडल को स्वचालित रूप से स्केल करें.

यह अनुशंसा की जाती है कि प्रत्येक कंटेनर में मॉडल प्रत्येक अनुमान अनुरोध पर समान गणना और विलंबता आवश्यकताओं को प्रदर्शित करता है, क्योंकि यदि MCE पर ट्रैफ़िक उच्च CPU उपयोग मॉडल से कम CPU उपयोग मॉडल में स्थानांतरित हो जाता है, लेकिन कुल कॉल वॉल्यूम समान रहता है, तो समापन बिंदु स्केल आउट नहीं होता है और उच्च CPU उपयोग मॉडल के सभी अनुरोधों को संभालने के लिए पर्याप्त उदाहरण नहीं हो सकते हैं।

सुरक्षित एमसीई

प्रत्यक्ष आह्वान वाले MCE के लिए, मेमोरी और स्टोरेज वॉल्यूम साझा करके एक ही उदाहरण में कई कंटेनरों को होस्ट किया जाता है। कंटेनरों को सुरक्षित करना, कंटेनरों को लक्षित करने के अनुरोधों की सही मैपिंग बनाए रखना और उपयोगकर्ताओं को लक्षित कंटेनरों तक सही पहुंच प्रदान करना महत्वपूर्ण है। आप प्रतिबंधित कर सकते हैं invoke_endpoint एमसीई के अंदर कंटेनरों के सीमित सेट तक पहुंच का उपयोग कर sagemaker:TargetContainerHostname AWS पहचान और अभिगम प्रबंधन (IAM) शर्त कुंजी। सेजमेकर उपयोग करता है IAM भूमिकाएं IAM पहचान-आधारित नीतियां प्रदान करने के लिए जिनका उपयोग आप अनुमत या अस्वीकृत कार्रवाइयों और संसाधनों और उन शर्तों को निर्दिष्ट करने के लिए करते हैं जिनके तहत कार्रवाई की अनुमति या इनकार किया जाता है। निम्नलिखित नीतियां बताती हैं कि किसी समापन बिंदु के भीतर विशिष्ट कंटेनरों तक कॉल को कैसे सीमित किया जाए:

Amazon CloudWatch मेट्रिक्स का उपयोग करके मल्टी-मॉडल एंडपॉइंट की निगरानी करें

मूल्य और प्रदर्शन में तालमेल बिठाने के लिए, आप अपने स्वयं के एप्लिकेशन से मॉडल और प्रतिनिधि ट्रैफ़िक के साथ बहु-मॉडल समापन बिंदुओं का परीक्षण करना चाहेंगे। सेजमेकर अतिरिक्त मेट्रिक्स प्रदान करता है अमेज़ॅन क्लाउडवॉच बहु-मॉडल समापन बिंदुओं के लिए ताकि आप समापन बिंदु उपयोग और कैश हिट दर निर्धारित कर सकें और अपने समापन बिंदु को अनुकूलित कर सकें। मेट्रिक्स इस प्रकार हैं:

- मॉडल लोड हो रहा है प्रतीक्षा समय - समय का अंतराल जब एक आमंत्रण अनुरोध लक्ष्य मॉडल को डाउनलोड करने या अनुमान लगाने के लिए लोड होने की प्रतीक्षा करता है।

- मॉडल अनलोडिंग टाइम - कंटेनर के माध्यम से मॉडल को उतारने में लगने वाले समय का अंतराल

UnloadModelएपीआई कॉल। - मॉडलडाउनलोडिंगसमय - Amazon S3 से मॉडल को डाउनलोड करने में लगने वाला समय।

- मॉडल लोडिंग समय - कंटेनर के माध्यम से मॉडल को लोड करने में लगने वाले समय का अंतराल

LoadModelएपीआई कॉल। - मॉडलकैशहिट - की संख्या

InvokeEndpointअनुरोध उस समापन बिंदु पर भेजे गए जहां मॉडल पहले ही लोड किया गया था। लेनाAverageआँकड़ा उन अनुरोधों का अनुपात दिखाता है जिनमें मॉडल पहले ही लोड हो चुका था। - लोडेडमॉडलकाउंट - समापन बिंदु में कंटेनरों में लोड किए गए मॉडल की संख्या। यह मीट्रिक प्रति उदाहरण उत्सर्जित होता है।

Average1 मिनट की अवधि के साथ आँकड़ा आपको प्रति उदाहरण लोड किए गए मॉडलों की औसत संख्या बताता है, औरSumआँकड़ा आपको समापन बिंदु में सभी उदाहरणों में लोड किए गए मॉडलों की कुल संख्या बताता है। यह मीट्रिक ट्रैक किए जाने वाले मॉडल अनिवार्य रूप से अद्वितीय नहीं हैं क्योंकि आप समापन बिंदु में एक से अधिक कंटेनरों में एक मॉडल लोड कर सकते हैं।

उदाहरण के लिए चलने वाले प्रत्येक कंटेनर द्वारा उपयोग किए जाने वाले कई अन्य मीट्रिक भी हैं, जैसे Invocations की संख्या का संकेत InvokeEndpoint एक समापन बिंदु के अंदर एक कंटेनर को भेजे गए अनुरोध, ContainerLatency SageMaker से देखे गए प्रतिक्रिया के लिए लक्षित कंटेनर या सीरियल आमंत्रण में सभी कंटेनरों के लिए एक अंतराल बिंदु देना, और CPUUtilization और MemoryUtilizaton सीपीयू इकाइयों और स्मृति के प्रतिशत का संकेत।

निष्कर्ष

पोस्ट में, हमने चर्चा की कि सेजमेकर मल्टी-कंटेनर एंडपॉइंट कैसे लागत और संसाधन उपयोग को अनुकूलित करने में सहायक हो सकते हैं। एमसीई का उपयोग कब करना है, इसके उदाहरणों में निम्नलिखित शामिल हैं, लेकिन इन्हीं तक सीमित नहीं हैं:

- विभिन्न ढांचे (जैसे TensorFlow, PyTorch, और Scikit-learn) में होस्टिंग मॉडल जिनके पास एक उदाहरण की पूरी क्षमता को संतृप्त करने के लिए पर्याप्त ट्रैफ़िक नहीं है

- विभिन्न एमएल एल्गोरिदम (जैसे सिफारिशें, पूर्वानुमान, या वर्गीकरण) और हैंडलर फ़ंक्शन के साथ एक ही ढांचे से होस्टिंग मॉडल

- A/B परीक्षण जैसे परिदृश्यों के लिए विभिन्न फ्रेमवर्क संस्करणों (जैसे TensorFlow 1.x बनाम TensorFlow 2.x) पर चलने वाले समान आर्किटेक्चर की तुलना

सेजमेकर एमसीई रीयल-टाइम एंडपॉइंट्स पर 15 कंटेनरों को तैनात करने और कम-विलंबता अनुमान और लागत बचत के लिए स्वतंत्र रूप से उन्हें लागू करने का समर्थन करता है। मॉडल पूरी तरह से विषमलैंगिक हो सकते हैं, उनके अपने स्वतंत्र सर्विंग स्टैक के साथ। आप प्रत्येक अनुरोध के लिए इन कंटेनरों को क्रमिक रूप से या स्वतंत्र रूप से लागू कर सकते हैं। अलग-अलग फ्रेमवर्क से कई मॉडलों को सुरक्षित रूप से एक ही उदाहरण पर होस्ट करने से आपको समर्पित सिंगल-इंस्टेंस एंडपॉइंट्स में होस्टिंग मॉडल की तुलना में लागत में 90% तक की बचत हो सकती है।

लेखक के बारे में

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और कृत्रिम बुद्धिमत्ता से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित गहन शिक्षण पर ध्यान केंद्रित करता है। वह ग्राहकों को Amazon SageMaker पर उच्च-प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और कृत्रिम बुद्धिमत्ता से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित गहन शिक्षण पर ध्यान केंद्रित करता है। वह ग्राहकों को Amazon SageMaker पर उच्च-प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

विक्रम एलंगो वर्जीनिया, यूएस में स्थित Amazon Web Services में वरिष्ठ AI/ML विशेषज्ञ समाधान आर्किटेक्ट हैं। विक्रम वैश्विक वित्तीय और बीमा उद्योग के ग्राहकों को बड़े पैमाने पर मशीन लर्निंग एप्लिकेशन बनाने और तैनात करने के लिए डिजाइन और विचारशील नेतृत्व के साथ मदद करता है। वह वर्तमान में पूरे उद्यम में प्राकृतिक भाषा प्रसंस्करण, जिम्मेदार एआई, अनुमान अनुकूलन और एमएल स्केलिंग पर केंद्रित है। अपने खाली समय में, उन्हें अपने परिवार के साथ यात्रा करना, लंबी पैदल यात्रा, खाना बनाना और शिविर लगाना पसंद है।

विक्रम एलंगो वर्जीनिया, यूएस में स्थित Amazon Web Services में वरिष्ठ AI/ML विशेषज्ञ समाधान आर्किटेक्ट हैं। विक्रम वैश्विक वित्तीय और बीमा उद्योग के ग्राहकों को बड़े पैमाने पर मशीन लर्निंग एप्लिकेशन बनाने और तैनात करने के लिए डिजाइन और विचारशील नेतृत्व के साथ मदद करता है। वह वर्तमान में पूरे उद्यम में प्राकृतिक भाषा प्रसंस्करण, जिम्मेदार एआई, अनुमान अनुकूलन और एमएल स्केलिंग पर केंद्रित है। अपने खाली समय में, उन्हें अपने परिवार के साथ यात्रा करना, लंबी पैदल यात्रा, खाना बनाना और शिविर लगाना पसंद है।

सौरभ त्रिकंडे Amazon SageMaker Inference के वरिष्ठ उत्पाद प्रबंधक हैं। उन्हें ग्राहकों के साथ काम करने का शौक है और वह मशीन लर्निंग को लोकतांत्रिक बनाने के लक्ष्य से प्रेरित हैं। वह जटिल एमएल अनुप्रयोगों, बहु-किरायेदार एमएल मॉडल, लागत अनुकूलन, और गहन शिक्षण मॉडल की तैनाती को और अधिक सुलभ बनाने से संबंधित मुख्य चुनौतियों पर ध्यान केंद्रित करता है। अपने खाली समय में, सौरभ को हाइकिंग, नवीन तकनीकों के बारे में सीखने, टेकक्रंच का अनुसरण करने और अपने परिवार के साथ समय बिताने का आनंद मिलता है।

सौरभ त्रिकंडे Amazon SageMaker Inference के वरिष्ठ उत्पाद प्रबंधक हैं। उन्हें ग्राहकों के साथ काम करने का शौक है और वह मशीन लर्निंग को लोकतांत्रिक बनाने के लक्ष्य से प्रेरित हैं। वह जटिल एमएल अनुप्रयोगों, बहु-किरायेदार एमएल मॉडल, लागत अनुकूलन, और गहन शिक्षण मॉडल की तैनाती को और अधिक सुलभ बनाने से संबंधित मुख्य चुनौतियों पर ध्यान केंद्रित करता है। अपने खाली समय में, सौरभ को हाइकिंग, नवीन तकनीकों के बारे में सीखने, टेकक्रंच का अनुसरण करने और अपने परिवार के साथ समय बिताने का आनंद मिलता है।

- उन्नत (300)

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़न SageMaker

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- यंत्र अधिगम

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट