का जादू साझा करने के लिए डैल · ई 2 व्यापक दर्शकों के साथ, हमें शक्तिशाली छवि निर्माण मॉडल से जुड़े जोखिमों को कम करने की आवश्यकता है। यह अंत करने के लिए, हम विभिन्न put रेलिंग उत्पन्न छवियों को हमारे . का उल्लंघन करने से रोकने के लिए जगह में सामग्री नीति. यह पोस्ट पर केंद्रित है पूर्व-प्रशिक्षण शमन, इन रेलिंगों का एक उपसमुच्चय जो उस डेटा को सीधे संशोधित करता है जिससे DALL·E 2 सीखता है। विशेष रूप से, DALL·E 2 को इंटरनेट से करोड़ों कैप्शन वाली छवियों पर प्रशिक्षित किया जाता है, और हम इनमें से कुछ छवियों को हटाते हैं और मॉडल द्वारा सीखी गई चीज़ों को बदलने के लिए उनका वजन करते हैं।

यह पोस्ट तीन खंडों में व्यवस्थित है, प्रत्येक एक अलग पूर्व-प्रशिक्षण शमन का वर्णन करता है:

- पहले खंड में, हम वर्णन करते हैं कि कैसे हमने DALL·E 2 के प्रशिक्षण डेटासेट से हिंसक और यौन छवियों को फ़िल्टर किया। इस शमन के बिना, मॉडल ग्राफिक या स्पष्ट छवियों का उत्पादन करना सीखेगा जब उनके लिए संकेत दिया जाएगा, और ऐसी छवियों को अनजाने में प्रतीत होने वाले सहज संकेतों के जवाब में वापस भी कर सकता है।

- दूसरे खंड में, हम पाते हैं कि फ़िल्टरिंग प्रशिक्षण डेटा पूर्वाग्रहों को बढ़ा सकता है, और इस प्रभाव को कम करने के लिए हमारी तकनीक का वर्णन कर सकता है। उदाहरण के लिए, इस शमन के बिना, हमने देखा कि फ़िल्टर किए गए डेटा पर प्रशिक्षित मॉडल कभी-कभी मूल डेटासेट पर प्रशिक्षित मॉडल की तुलना में पुरुषों को चित्रित करने वाली अधिक छवियां और महिलाओं को चित्रित करने वाली कम छवियां उत्पन्न करते हैं।

- अंतिम खंड में, हम याद रखने के मुद्दे की ओर मुड़ते हैं, यह पाते हुए कि DALL·E 2 जैसे मॉडल कभी-कभी उन छवियों को पुन: पेश कर सकते हैं जिन पर उन्हें प्रशिक्षित किया गया था न कि नई छवियां बनाने के लिए। व्यवहार में, हमने पाया कि यह छवि regurgitation डेटासेट में कई बार दोहराए गए चित्रों के कारण होता है, और डेटासेट में अन्य छवियों के समान दिखने वाली छवियों को हटाकर समस्या को कम करता है।

ग्राफिक और स्पष्ट प्रशिक्षण डेटा को कम करना

चूंकि प्रशिक्षण डेटा किसी भी सीखे हुए मॉडल की क्षमताओं को आकार देता है, इसलिए अवांछित मॉडल क्षमताओं को सीमित करने के लिए डेटा फ़िल्टरिंग एक शक्तिशाली उपकरण है। हमने इस दृष्टिकोण को दो श्रेणियों पर लागू किया- ग्राफिक हिंसा और यौन सामग्री को दर्शाने वाली छवियां- DALL·E को प्रशिक्षित करने से पहले इन श्रेणियों में छवियों को फ़िल्टर करने के लिए क्लासिफायर का उपयोग करके। हमने इन इमेज क्लासिफायर को इन-हाउस प्रशिक्षित किया है और इसका अध्ययन जारी है हमारे प्रशिक्षित मॉडल पर डेटासेट फ़िल्टरिंग का प्रभाव।

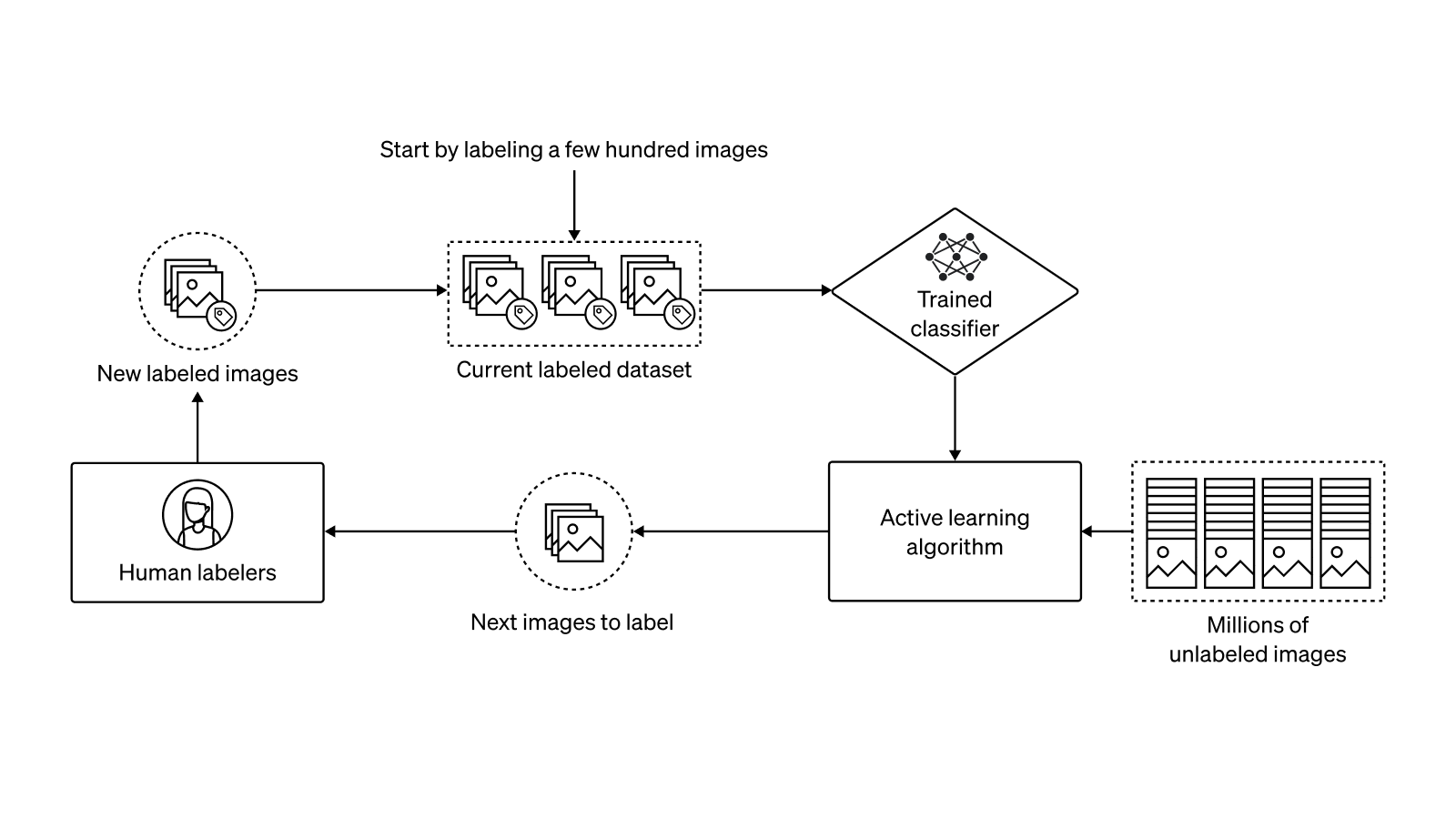

अपने इमेज क्लासिफायरियर को प्रशिक्षित करने के लिए, हमने उस दृष्टिकोण का पुन: उपयोग किया जिसे हमने पहले प्रशिक्षण डेटा को फ़िल्टर करने के लिए नियोजित किया था फिसलन. इस दृष्टिकोण के मूल चरण इस प्रकार हैं: सबसे पहले, हम उन छवि श्रेणियों के लिए एक विनिर्देश बनाते हैं जिन्हें हम लेबल करना चाहते हैं; दूसरा, हम प्रत्येक श्रेणी के लिए कुछ सौ सकारात्मक और नकारात्मक उदाहरण एकत्र करते हैं; तीसरा, हम अधिक डेटा एकत्र करने और सटीक/रिकॉल ट्रेड-ऑफ़ में सुधार करने के लिए एक सक्रिय शिक्षण प्रक्रिया का उपयोग करते हैं; और अंत में, हम परिणामी क्लासिफायर को संपूर्ण डेटासेट पर एक रूढ़िवादी वर्गीकरण सीमा के साथ चलाते हैं ताकि सटीकता पर वापस बुला सकें। इन थ्रेशोल्ड को सेट करने के लिए, हमने सभी को फ़िल्टर करने को प्राथमिकता दी है बुरा सभी में छोड़ने पर डेटा अच्छा जानकारी। ऐसा इसलिए है क्योंकि हम अपने मॉडल को बाद में नई चीजें सिखाने के लिए अधिक डेटा के साथ उसे हमेशा ठीक कर सकते हैं, लेकिन मॉडल को कुछ ऐसा भूलने के लिए मजबूर करना बहुत कठिन है जो उसने पहले ही सीखा है।

सक्रिय सीखने के चरण के दौरान, हमने संभावित रूप से कठिन या गलत वर्गीकृत छवियों के लिए मानव लेबल एकत्र करके अपने क्लासिफायरियर में सुधार किया। विशेष रूप से, हमने लेबलिंग के लिए मनुष्यों को प्रस्तुत करने के लिए अपने डेटासेट (जिसमें लाखों-करोड़ों बिना लेबल वाली छवियां शामिल हैं) से छवियों को चुनने के लिए दो सक्रिय शिक्षण तकनीकों का उपयोग किया। सबसे पहले, हमारे क्लासिफायरियर की झूठी सकारात्मक दर को कम करने के लिए (यानी, वह आवृत्ति जिसके साथ यह एक सौम्य छवि को हिंसक या यौन के रूप में गलत वर्गीकृत करता है), हमने उन छवियों को मानव लेबल सौंपा जिन्हें वर्तमान मॉडल सकारात्मक के रूप में वर्गीकृत किया गया है। इस कदम को अच्छी तरह से काम करने के लिए, हमने लगभग 100% रिकॉल के लिए हमारी वर्गीकरण सीमा को ट्यून किया लेकिन एक उच्च झूठी-सकारात्मक दर; इस तरह, हमारे लेबलर ज्यादातर वास्तव में नकारात्मक मामलों को लेबल कर रहे थे। हालांकि यह तकनीक झूठी सकारात्मकता को कम करने में मदद करती है और संभावित हानिकारक छवियों को देखने के लिए लेबलर्स की आवश्यकता को कम करती है, यह अधिक सकारात्मक मामलों को खोजने में मदद नहीं करती है जो मॉडल वर्तमान में गायब है।

हमारे क्लासिफायरियर की झूठी नकारात्मक दर को कम करने के लिए, हमने दूसरी सक्रिय सीखने की तकनीक को नियोजित किया: निकटतम पड़ोसी खोज। विशेष रूप से, हमने अपने वर्तमान लेबल किए गए डेटासेट में सकारात्मक नमूने खोजने के लिए कई गुना क्रॉस-सत्यापन चलाया, जिसे मॉडल ने नकारात्मक के रूप में गलत वर्गीकृत किया (ऐसा करने के लिए, हमने क्लासिफायर के सैकड़ों संस्करणों को अलग-अलग ट्रेन-सत्यापन विभाजन के साथ प्रशिक्षित किया)। फिर हमने एक अवधारणात्मक फीचर स्पेस में इन नमूनों के निकटतम पड़ोसियों के लिए बिना लेबल वाली छवियों के अपने बड़े संग्रह को स्कैन किया, और खोजी गई छवियों को मानव लेबल सौंपा। हमारे कंप्यूट इन्फ्रास्ट्रक्चर के लिए धन्यवाद, क्लासिफायर प्रशिक्षण और निकटतम पड़ोसी खोज दोनों को कई GPU तक बढ़ाना तुच्छ था, जिससे सक्रिय शिक्षण चरण घंटों या दिनों के बजाय कई मिनटों में हो सकता था।

हमारे डेटा फ़िल्टर की प्रभावशीलता को सत्यापित करने के लिए, हमने एक ही हाइपरपैरामीटर के साथ दो GLIDE मॉडल को प्रशिक्षित किया: एक अनफ़िल्टर्ड डेटा पर, और दूसरा फ़िल्टरिंग के बाद डेटासेट पर। हम पूर्व मॉडल को के रूप में संदर्भित करते हैं अनफ़िल्टर्ड मॉडल, और बाद वाले के रूप में फ़िल्टर्ड मॉडल. जैसा कि अपेक्षित था, हमने पाया कि इस तरह की सामग्री के अनुरोधों के जवाब में फ़िल्टर न किए गए मॉडल ने आम तौर पर कम स्पष्ट या ग्राफिक सामग्री का उत्पादन किया। हालांकि, हमें डेटा फ़िल्टरिंग का एक अप्रत्याशित दुष्प्रभाव भी मिला: इसने कुछ जनसांख्यिकी के प्रति मॉडल के पूर्वाग्रह को बनाया या बढ़ाया।

डेटा फ़िल्टर द्वारा प्रस्तुत पूर्वाग्रह को ठीक करना

जनरेटिव मॉडल अपने प्रशिक्षण डेटा के वितरण से मेल खाने का प्रयास करते हैं, जिसमें उनमें कोई पूर्वाग्रह भी शामिल है। नतीजतन, प्रशिक्षण डेटा को फ़िल्टर करने से डाउनस्ट्रीम मॉडल में पूर्वाग्रह बनाने या बढ़ाने की क्षमता होती है। सामान्य तौर पर, मूल डेटासेट में पूर्वाग्रहों को ठीक करना एक कठिन सामाजिक-तकनीकी कार्य है जिसका हम अध्ययन करना जारी रखते हैं, और यह इस पोस्ट के दायरे से बाहर है। हम यहां जिस समस्या का समाधान कर रहे हैं, वह विशेष रूप से डेटा फ़िल्टरिंग के कारण होने वाले पूर्वाग्रहों का प्रवर्धन है। हमारे दृष्टिकोण के साथ, हमारा लक्ष्य फ़िल्टर किए गए मॉडल को होने से रोकना है अधिक अनफ़िल्टर्ड मॉडल की तुलना में पक्षपाती, अनिवार्य रूप से डेटा फ़िल्टरिंग के कारण वितरण बदलाव को कम करता है।

फ़िल्टरिंग के कारण पूर्वाग्रह प्रवर्धन के एक ठोस उदाहरण के रूप में, संकेत "एक सीईओ" पर विचार करें। जब हमारे अनफ़िल्टर्ड मॉडल ने इस संकेत के लिए छवियां बनाईं, तो यह महिलाओं की तुलना में पुरुषों की अधिक छवियों का उत्पादन करने के लिए प्रवृत्त हुई, और हम उम्मीद करते हैं कि इस पूर्वाग्रह का अधिकांश हिस्सा हमारे वर्तमान प्रशिक्षण डेटा का प्रतिबिंब है। हालांकि, जब हमने अपने फ़िल्टर किए गए मॉडल के माध्यम से एक ही संकेत चलाया, तो पूर्वाग्रह बढ़ा हुआ प्रतीत हुआ; पीढ़ियां लगभग विशेष रूप से पुरुषों की छवियां थीं।

हम अनुमान लगाते हैं कि पूर्वाग्रह प्रवर्धन का यह विशेष मामला दो स्थानों से आता है: पहला, भले ही मूल डेटासेट में महिलाओं और पुरुषों का लगभग समान प्रतिनिधित्व हो, डेटासेट महिलाओं को अधिक कामुक संदर्भों में प्रस्तुत करने की ओर पक्षपाती हो सकता है; और दूसरा, हमारे क्लासिफायर स्वयं या तो कार्यान्वयन या वर्ग परिभाषा के कारण पक्षपाती हो सकते हैं, यह सुनिश्चित करने के हमारे प्रयासों के बावजूद कि डेटा संग्रह और सत्यापन चरणों के दौरान ऐसा नहीं था। इन दोनों प्रभावों के कारण, हमारा फ़िल्टर पुरुषों की तुलना में महिलाओं की अधिक छवियों को हटा सकता है, जो मॉडल द्वारा प्रशिक्षण में देखे जाने वाले लिंग अनुपात को बदल देता है।

फ़िल्टर-प्रेरित पूर्वाग्रह की अधिक अच्छी तरह से जाँच करने के लिए, हम यह मापने का एक तरीका चाहते थे कि हमारे डेटा फ़िल्टर विभिन्न अवधारणाओं के प्रति पूर्वाग्रह को कितना प्रभावित कर रहे हैं। विशेष रूप से, हमारे हिंसा और यौन सामग्री फ़िल्टर विशुद्ध रूप से छवि-आधारित हैं, लेकिन हमारे डेटासेट की बहुविध प्रकृति हमें पाठ पर इन फ़िल्टरों के प्रभावों को सीधे मापने की अनुमति देती है। चूंकि प्रत्येक छवि एक टेक्स्ट कैप्शन के साथ होती है, इसलिए हम यह अनुमान लगाने के लिए फ़िल्टर किए गए और अनफ़िल्टर्ड डेटासेट में हाथ से चयनित कीवर्ड की सापेक्ष आवृत्ति को देखने में सक्षम थे कि फ़िल्टर किसी भी अवधारणा को कितना प्रभावित कर रहे थे।

इसे व्यवहार में लाने के लिए, हमने अपने फ़िल्टर किए गए और अनफ़िल्टर्ड डेटासेट दोनों में सभी कैप्शन पर मुट्ठी भर कीवर्ड (जैसे, "पैरेंट", "महिला", "किड") की आवृत्तियों की गणना करने के लिए अपाचे स्पार्क का उपयोग किया। भले ही हमारे डेटासेट में करोड़ों टेक्स्ट-इमेज जोड़े हों, लेकिन इन कीवर्ड फ़्रीक्वेंसी की गणना करने में हमारे कंप्यूट क्लस्टर का उपयोग करने में केवल कुछ मिनट लगते हैं।

कीवर्ड फ़्रीक्वेंसी की गणना करने के बाद, हम यह पुष्टि करने में सक्षम थे कि हमारे डेटासेट फ़िल्टर ने वास्तव में कुछ कीवर्ड की फ़्रीक्वेंसी को दूसरों की तुलना में अधिक तिरछा कर दिया था। उदाहरण के लिए, फिल्टर ने "महिला" शब्द की आवृत्ति को 14% कम कर दिया, जबकि "पुरुष" शब्द की आवृत्ति केवल 6% कम हो गई। यह पुष्टि करता है, बड़े पैमाने पर, जो हमने पहले ही दोनों डेटासेट पर प्रशिक्षित GLIDE मॉडल से नमूना करके देखा था।

अब जबकि हमारे पास फ़िल्टर-प्रेरित पूर्वाग्रह को मापने के लिए एक प्रॉक्सी था, हमें इसे कम करने के लिए एक तरीके की आवश्यकता थी। इस समस्या से निपटने के लिए, हमने फ़िल्टर किए गए डेटासेट को फिर से भारित करने का लक्ष्य रखा ताकि इसका वितरण बेहतर ढंग से अनफ़िल्टर्ड छवियों के वितरण से मेल खा सके। इस विचार को स्पष्ट करने के लिए एक खिलौने के उदाहरण के रूप में, मान लीजिए कि हमारे डेटासेट में 50% बिल्ली की तस्वीरें और 50% कुत्ते की तस्वीरें हैं, लेकिन हमारे डेटा फ़िल्टर 75% कुत्तों को हटाते हैं लेकिन केवल 50% बिल्लियों को। अंतिम डेटासेट बिल्लियाँ और कुत्ते होंगे, और इस डेटासेट पर प्रशिक्षित एक संभावना-आधारित जनरेटिव मॉडल संभवतः कुत्तों की तुलना में बिल्लियों की अधिक छवियां उत्पन्न करेगा। हम कुत्ते की प्रत्येक छवि के प्रशिक्षण नुकसान को 2 से गुणा करके इस असंतुलन को ठीक कर सकते हैं, प्रत्येक कुत्ते की छवि को दो बार दोहराने के प्रभाव का अनुकरण करते हुए। यह पता चला है कि हम इस दृष्टिकोण को अपने वास्तविक डेटासेट और मॉडल में इस तरह से स्केल कर सकते हैं जो काफी हद तक स्वचालित है-अर्थात, हमें उन विशेषताओं का चयन करने की आवश्यकता नहीं है जिन्हें हम फिर से वजन करना चाहते हैं।

हम फ़िल्टर किए गए डेटासेट में छवियों के लिए एक विशेष क्लासिफायरियर से संभावनाओं का उपयोग करके वजन की गणना करते हैं, जैसा कि उपयोग किए गए दृष्टिकोण के समान है चोई एट अल। (2019). इस क्लासिफायरियर को प्रशिक्षित करने के लिए, हम दोनों डेटासेट से समान रूप से छवियों का नमूना लेते हैं और भविष्यवाणी करते हैं कि छवि किस डेटासेट से आई है। विशेष रूप से, यह मॉडल भविष्यवाणी करता है पी (अनफ़िल्टर्ड | छवि), पूर्व दिया गया पी (अनफ़िल्टर्ड) = 0.5. व्यवहार में, हम नहीं चाहते कि यह मॉडल बहुत शक्तिशाली हो, अन्यथा यह हमारे फ़िल्टर द्वारा लागू किए गए सटीक कार्य को पहले स्थान पर सीख सकता है। इसके बजाय, हम चाहते हैं कि मॉडल हमारे मूल डेटा फ़िल्टर की तुलना में अधिक चिकना हो, फ़िल्टर से प्रभावित व्यापक श्रेणियों को कैप्चर करता है, जबकि अभी भी इस बारे में अनिश्चित है कि कोई विशेष छवि फ़िल्टर की जाएगी या नहीं। यह अंत करने के लिए, हमने एक छोटे से ऊपर एक रैखिक जांच को प्रशिक्षित किया क्लिप मॉडल.

एक बार जब हमारे पास एक क्लासिफायरियर होता है जो इस संभावना की भविष्यवाणी करता है कि एक छवि अनफ़िल्टर्ड डेटासेट से है, तब भी हमें इस भविष्यवाणी को छवि के वजन में बदलने की आवश्यकता है। उदाहरण के लिए, मान लीजिए कि पी (अनफ़िल्टर्ड | छवि) = 0.8. इसका मतलब है कि फ़िल्टर किए गए डेटा की तुलना में फ़िल्टर किए गए डेटा की तुलना में नमूना 4 गुना अधिक होने की संभावना है, और 4 के वजन से असंतुलन को ठीक करना चाहिए। अधिक सामान्यतः, हम वज़न का उपयोग कर सकते हैं पी (अनफ़िल्टर्ड | छवि) / पी (फ़िल्टर्ड | छवि).[1]

यह पुनर्भार योजना वास्तव में बढ़े हुए पूर्वाग्रह को कितनी अच्छी तरह कम करती है? जब हमने अपने पिछले फ़िल्टर किए गए मॉडल को नई वेटिंग स्कीम के साथ फाइन-ट्यून किया, तो फाइन-ट्यून किए गए मॉडल का व्यवहार पहले से मिले पक्षपाती उदाहरणों पर अनफ़िल्टर्ड मॉडल से बहुत अधिक निकटता से मेल खाता था। हालांकि यह उत्साहजनक था, हम अपने कीवर्ड-आधारित पूर्वाग्रह अनुमानी का उपयोग करके इस शमन का अधिक अच्छी तरह से मूल्यांकन करना चाहते थे। हमारी नई वेटिंग स्कीम को ध्यान में रखते हुए कीवर्ड फ़्रीक्वेंसी को मापने के लिए, हम फ़िल्टर किए गए डेटासेट में किसी कीवर्ड के प्रत्येक उदाहरण को उस नमूने के भार से तौल सकते हैं जिसमें वह शामिल है। ऐसा करने से, हमें खोजशब्द आवृत्तियों का एक नया सेट मिलता है जो फ़िल्टर किए गए डेटासेट में नमूना भार को दर्शाता है।

हमारे द्वारा जाँचे गए अधिकांश खोजशब्दों में, पुनर्भार योजना ने फ़िल्टरिंग द्वारा प्रेरित आवृत्ति परिवर्तन को कम कर दिया। "पुरुष" और "महिला" के हमारे पिछले उदाहरणों के लिए, सापेक्ष आवृत्ति में कमी 1% और -1% हो गई, जबकि उनके पिछले मान क्रमशः 14% और 6% थे। हालांकि यह मीट्रिक वास्तविक फ़िल्टरिंग पूर्वाग्रह के लिए सिर्फ एक प्रॉक्सी है, यह आश्वस्त करता है कि हमारी छवि-आधारित रीवेटिंग योजना वास्तव में टेक्स्ट-आधारित मीट्रिक में काफी सुधार करती है।

हम मॉडल के व्यवहार के बड़े मूल्यांकन और फ़िल्टरिंग ने पूर्वाग्रह और क्षमता विकास को कैसे प्रभावित किया, इसकी जांच के माध्यम से, हम DALL·E 2 में शेष पूर्वाग्रहों की जांच करना जारी रख रहे हैं।

छवि regurgitation को रोकना

हमने देखा कि DALL·E 2 के हमारे आंतरिक पूर्ववर्ती कभी-कभी प्रशिक्षण छवियों को शब्दशः पुन: पेश करते हैं। यह व्यवहार अवांछनीय था, क्योंकि हम चाहते हैं कि DALL·E 2 डिफ़ॉल्ट रूप से मूल, अद्वितीय चित्र बनाए और न कि केवल मौजूदा छवियों के "एक साथ सिलाई" करें। इसके अतिरिक्त, प्रशिक्षण छवियों को शब्दशः पुन: प्रस्तुत करना कॉपीराइट उल्लंघन, स्वामित्व और गोपनीयता (यदि लोगों की तस्वीरें प्रशिक्षण डेटा में मौजूद थीं) के आसपास कानूनी प्रश्न उठा सकते हैं।

छवि पुनर्जीवन के मुद्दे को बेहतर ढंग से समझने के लिए, हमने संकेतों का एक डेटासेट एकत्र किया जिसके परिणामस्वरूप अक्सर डुप्लिकेट छवियां होती हैं। ऐसा करने के लिए, हमने अपने प्रशिक्षण डेटासेट से 50,000 संकेतों के लिए छवियों का नमूना लेने के लिए एक प्रशिक्षित मॉडल का उपयोग किया, और संबंधित प्रशिक्षण छवि के लिए अवधारणात्मक समानता के आधार पर नमूनों को क्रमबद्ध किया। अंत में, हमने हाथ से शीर्ष मैचों का निरीक्षण किया, 50k कुल संकेतों में से केवल कुछ सौ सच्चे डुप्लिकेट जोड़े ढूंढे। भले ही रेगुर्गिटेशन दर 1% से कम दिखाई दे, हमने महसूस किया कि ऊपर बताए गए कारणों के लिए दर को 0 से नीचे धकेलना आवश्यक था।

जब हमने regurgitated छवियों के अपने डेटासेट का अध्ययन किया, तो हमने दो पैटर्न देखे। सबसे पहले, छवियां लगभग सभी सरल वेक्टर ग्राफिक्स थीं, जिन्हें उनकी कम सूचना सामग्री के कारण याद रखना आसान था। दूसरा, और इससे भी महत्वपूर्ण बात यह है कि सभी छवियों के प्रशिक्षण डेटासेट में कई निकट-डुप्लिकेट थे। उदाहरण के लिए, एक वेक्टर ग्राफ़िक हो सकता है जो 1 बजे का समय दिखाने वाली घड़ी की तरह दिखता है - लेकिन फिर हम एक प्रशिक्षण नमूने की खोज करेंगे जिसमें उसी घड़ी में 2 बजे, और फिर 3 बजे, आदि दिखाया गया हो। एक बार हमने इसे महसूस किया, हमने यह सत्यापित करने के लिए एक वितरित निकटतम पड़ोसी खोज का उपयोग किया, वास्तव में, सभी regurgitated छवियों के डेटासेट में समान रूप से समान डुप्लिकेट थे। अन्य कार्य बड़े भाषा मॉडल में एक समान घटना देखी है, यह पाते हुए कि डेटा दोहराव दृढ़ता से याद रखने से जुड़ा हुआ है।

उपरोक्त खोज ने सुझाव दिया कि, यदि हमने अपने डेटासेट को काट दिया, तो हम पुनरुत्थान की समस्या को हल कर सकते हैं। इसे प्राप्त करने के लिए, हमने समान दिखने वाली छवियों के समूहों की पहचान करने के लिए एक तंत्रिका नेटवर्क का उपयोग करने की योजना बनाई, और फिर प्रत्येक समूह से एक छवि को छोड़कर सभी को हटा दिया।[2] हालाँकि, इसके लिए प्रत्येक छवि के लिए जाँच की आवश्यकता होगी, कि क्या यह डेटासेट में हर दूसरी छवि का डुप्लिकेट है। चूंकि हमारे पूरे डेटासेट में सैकड़ों लाखों छवियां हैं, इसलिए हमें सभी डुप्लीकेट खोजने के लिए सैकड़ों चौथाई छवि जोड़े की जांच करने की आवश्यकता होगी। जबकि यह तकनीकी रूप से पहुंच के भीतर है, विशेष रूप से एक बड़े कंप्यूट क्लस्टर पर, हमें एक अधिक कुशल विकल्प मिला है जो लागत के एक छोटे से अंश पर भी काम करता है।

विचार करें कि क्या होता है यदि हम डिडुप्लीकेशन करने से पहले अपने डेटासेट को क्लस्टर करते हैं। चूंकि आस-पास के नमूने अक्सर एक ही क्लस्टर में आते हैं, इसलिए अधिकांश डुप्लिकेट जोड़े क्लस्टर निर्णय सीमाओं को पार नहीं करेंगे। हम तब क्लस्टर के बाहर डुप्लिकेट की जाँच किए बिना प्रत्येक क्लस्टर के भीतर नमूनों को काट सकते थे, जबकि सभी डुप्लिकेट जोड़े का केवल एक छोटा अंश गायब था। यह भोले-भाले दृष्टिकोण की तुलना में बहुत तेज़ है, क्योंकि अब हमें छवियों की हर एक जोड़ी की जाँच नहीं करनी है।[3] जब हमने अपने डेटा के एक छोटे से सबसेट पर इस दृष्टिकोण का अनुभवजन्य परीक्षण किया, तो इसका उपयोग करते समय सभी डुप्लिकेट जोड़े का 85% पाया गया K = 1024 समूहों।

उपरोक्त एल्गोरिथम की सफलता दर में सुधार करने के लिए, हमने एक प्रमुख अवलोकन का लाभ उठाया: जब आप किसी डेटासेट के विभिन्न यादृच्छिक सबसेट को क्लस्टर करते हैं, तो परिणामी क्लस्टर निर्णय सीमाएं अक्सर काफी भिन्न होती हैं। इसलिए, यदि एक डुप्लिकेट जोड़ी डेटा के एक क्लस्टरिंग के लिए क्लस्टर सीमा को पार करती है, तो एक ही जोड़ी एक अलग क्लस्टरिंग में एक क्लस्टर के अंदर आ सकती है। आप जितने अधिक क्लस्टरिंग का प्रयास करेंगे, उतनी ही अधिक संभावना है कि आप किसी दिए गए डुप्लिकेट जोड़े की खोज करेंगे। व्यवहार में, हमने पांच क्लस्टरिंग का उपयोग करने पर समझौता किया, जिसका अर्थ है कि हम पांच अलग-अलग समूहों के संघ में प्रत्येक छवि के डुप्लिकेट की खोज करते हैं। व्यवहार में, यह हमारे डेटा के सबसेट पर सभी डुप्लिकेट जोड़े का 97% पाया गया।

आश्चर्यजनक रूप से, हमारे लगभग एक चौथाई डेटासेट को डुप्लीकेशन द्वारा हटा दिया गया था। जब हमने लगभग डुप्लीकेट जोड़ियों को देखा, जो पाए गए, उनमें से कई में सार्थक परिवर्तन शामिल थे। ऊपर से घड़ी के उदाहरण को याद करें: डेटासेट में दिन के अलग-अलग समय पर एक ही घड़ी की कई छवियां शामिल हो सकती हैं। हालांकि इन छवियों से मॉडल को इस विशेष घड़ी की उपस्थिति याद रखने की संभावना है, वे मॉडल को घड़ी पर दिन के समय के बीच अंतर करना सीखने में भी मदद कर सकते हैं। यह देखते हुए कि कितना डेटा हटाया गया था, हम चिंतित थे कि इस तरह की छवियों को हटाने से मॉडल के प्रदर्शन को नुकसान हो सकता है।

हमारे मॉडल पर डुप्लीकेशन के प्रभाव का परीक्षण करने के लिए, हमने समान हाइपरपैरामीटर वाले दो मॉडलों को प्रशिक्षित किया: एक पूर्ण डेटासेट पर, और दूसरा डेटासेट के डिडुप्लिकेट संस्करण पर। मॉडलों की तुलना करने के लिए, हमने उन्हीं मानवीय मूल्यांकनों का उपयोग किया जिनका उपयोग हमने अपने मूल GLIDE मॉडल का मूल्यांकन करने के लिए किया था। हैरानी की बात है कि हमने पाया कि मानव मूल्यांकनकर्ता थोड़ा वरीय डुप्लिकेट किए गए डेटा पर प्रशिक्षित मॉडल, यह सुझाव देता है कि डेटासेट में बड़ी मात्रा में अनावश्यक छवियां वास्तव में प्रदर्शन को नुकसान पहुंचा रही थीं।

एक बार जब हमारे पास डिडुप्लिकेट डेटा पर प्रशिक्षित एक मॉडल था, तो हम प्रशिक्षण डेटासेट से 50k से अधिक संकेतों को पहले किए गए पुनरुत्थान खोज को फिर से चलाते हैं। हमने पाया कि प्रशिक्षण डेटासेट से छवि के लिए सटीक संकेत दिए जाने पर नए मॉडल ने कभी भी प्रशिक्षण छवि को दोबारा नहीं बनाया। इस परीक्षण को एक और कदम आगे ले जाने के लिए, हमने 50k उत्पन्न छवियों में से प्रत्येक के लिए संपूर्ण प्रशिक्षण डेटासेट पर निकटतम पड़ोसी खोज भी की। इस तरह, हमने सोचा कि हम किसी दिए गए प्रॉम्प्ट से जुड़े मॉडल की तुलना में एक अलग छवि को पुन: उत्पन्न करने वाले मॉडल को पकड़ सकते हैं। इतनी गहन जांच के बाद भी, हमें कभी भी इमेज रिगर्जेटेशन का मामला नहीं मिला।

अगला चरण

जबकि ऊपर चर्चा की गई सभी शमन DALL·E 2 से जुड़े जोखिमों को कम करने के हमारे लक्ष्य की दिशा में महत्वपूर्ण प्रगति का प्रतिनिधित्व करते हैं, प्रत्येक शमन में अभी भी सुधार की गुंजाइश है:

- बेहतर पूर्व-प्रशिक्षण फ़िल्टर हमें DALL·E 2 को अधिक डेटा पर प्रशिक्षित करने और संभावित रूप से मॉडल में पूर्वाग्रह को कम करने की अनुमति दे सकते हैं। हमारे वर्तमान फ़िल्टर कई झूठी सकारात्मकताओं की कीमत पर कम मिस-रेट के लिए तैयार हैं। परिणामस्वरूप, हमने अपने संपूर्ण डेटासेट का लगभग 5% फ़िल्टर कर दिया, हालांकि इनमें से अधिकांश फ़िल्टर की गई छवियां हमारी सामग्री नीति का बिल्कुल भी उल्लंघन नहीं करती हैं। हमारे फ़िल्टर में सुधार करने से हम इस प्रशिक्षण डेटा में से कुछ को पुनः प्राप्त कर सकते हैं।

- पूर्वाग्रह को सिस्टम विकास और परिनियोजन के कई चरणों में पेश किया जाता है और संभावित रूप से बढ़ाया जाता है। DALL·E 2 जैसी प्रणालियों में पूर्वाग्रह का मूल्यांकन और उसे कम करना और इस पूर्वाग्रह से प्रेरित नुकसान एक महत्वपूर्ण अंतःविषय समस्या है जिसका हम अपने व्यापक मिशन के हिस्से के रूप में OpenAI में अध्ययन करना जारी रखते हैं। इस पर हमारे काम में समस्या को बेहतर ढंग से समझने के लिए मूल्यांकन का निर्माण, नए डेटासेट को क्यूरेट करना, और अधिक मजबूत और प्रतिनिधि प्रौद्योगिकियों के निर्माण के लिए मानव प्रतिक्रिया और फाइन-ट्यूनिंग जैसी तकनीकों को लागू करना शामिल है।

- यह भी महत्वपूर्ण है कि हम गहन शिक्षण प्रणालियों में संस्मरण और सामान्यीकरण का अध्ययन जारी रखें। जबकि डुप्लीकेशन याद रखने से रोकने की दिशा में एक अच्छा पहला कदम है, यह हमें यह नहीं बताता है कि DALL·E 2 जैसे मॉडल प्रशिक्षण डेटा को क्यों या कैसे याद करते हैं।

- 000

- 2019

- a

- About

- लेखा

- पाना

- के पार

- सक्रिय

- पता

- प्रभावित करने वाले

- कलन विधि

- सब

- की अनुमति दे

- की अनुमति देता है

- पहले ही

- वैकल्पिक

- हमेशा

- राशि

- अन्य

- छपी

- लागू

- लागू

- दृष्टिकोण

- चारों ओर

- सौंपा

- जुड़े

- दर्शक

- क्योंकि

- से पहले

- जा रहा है

- बेहतर

- के बीच

- परे

- निर्माण

- इमारत

- क्षमताओं

- कैप्शन

- मामला

- मामलों

- कुश्ती

- वर्ग

- के कारण होता

- कुछ

- परिवर्तन

- जाँच

- चुनें

- कक्षा

- वर्गीकरण

- वर्गीकृत

- घड़ी

- संग्रह

- तुलना

- गणना करना

- कंप्यूटिंग

- संकल्पना

- विचार करना

- शामिल हैं

- सामग्री

- संदर्भों

- जारी रखने के

- Copyright

- कॉपीराइट का उल्लंघन

- इसी

- सका

- बनाना

- बनाया

- बनाना

- महत्वपूर्ण

- वर्तमान

- वर्तमान में

- तिथि

- दिन

- दिन

- निर्णय

- गहरा

- जनसांख्यिकी

- तैनाती

- वर्णन

- के बावजूद

- विकास

- विभिन्न

- मुश्किल

- सीधे

- अन्य वायरल पोस्ट से

- की खोज

- दूरी

- वितरित

- वितरण

- नीचे

- डुप्लिकेट

- दौरान

- से प्रत्येक

- प्रभाव

- प्रभावी रूप से

- प्रभावशीलता

- प्रभाव

- कुशल

- प्रयासों

- को प्रोत्साहित करने

- विशेष रूप से

- अनिवार्य

- आकलन

- आदि

- मूल्यांकन करें

- सब कुछ

- उदाहरण

- उदाहरण

- अनन्य रूप से

- मौजूदा

- उम्मीद

- अपेक्षित

- और तेज

- Feature

- विशेषताएं

- प्रतिक्रिया

- आकृति

- छानने

- फ़िल्टर

- अंत में

- खोज

- प्रथम

- फिक्स

- केंद्रित

- इस प्रकार है

- पाया

- से

- पूर्ण

- समारोह

- आगे

- सभा

- लिंग

- सामान्य जानकारी

- आम तौर पर

- उत्पन्न

- उत्पन्न

- पीढ़ी

- पीढ़ियों

- उत्पादक

- लक्ष्य

- अच्छा

- GPUs

- ग्राफ़िक्स

- समूह

- समूह की

- गारंटी

- मुट्ठी

- मदद

- मदद करता है

- यहाँ उत्पन्न करें

- हाई

- कैसे

- तथापि

- HTTPS

- मानव

- मनुष्य

- सैकड़ों

- विचार

- पहचान करना

- की छवि

- छवियों

- कार्यान्वयन

- कार्यान्वित

- महत्वपूर्ण

- में सुधार

- उन्नत

- में सुधार लाने

- शामिल

- शामिल

- शामिल

- सहित

- करें-

- इंफ्रास्ट्रक्चर

- उदाहरण

- इंटरनेट

- जांच

- मुद्दा

- IT

- खुद

- कुंजी

- लेबल

- लेबलिंग

- लेबल

- भाषा

- बड़ा

- बड़ा

- जानें

- सीखा

- सीख रहा हूँ

- कानूनी

- संभावित

- देखिए

- देखा

- बनाना

- निशान

- मैच

- सार्थक

- साधन

- माप

- मापने

- पुरुषों

- हो सकता है

- सैन्य

- लाखों

- मिशन

- आदर्श

- मॉडल

- अधिक

- अधिकांश

- गुणा

- प्रकृति

- आवश्यक

- नकारात्मक

- नेटवर्क

- संख्या

- आदेश

- संगठित

- मूल

- अन्य

- स्वामित्व

- भाग

- विशेष

- प्रदर्शन

- प्रदर्शन

- चरण

- टुकड़े

- की योजना बनाई

- नीति

- सकारात्मक

- संभव

- संभावित

- शक्तिशाली

- अभ्यास

- भविष्यवाणी करना

- भविष्यवाणी

- वर्तमान

- रोकने

- पिछला

- एकांत

- जांच

- मुसीबत

- प्रक्रिया

- उत्पादन

- प्रस्तुत

- विरोध

- प्रतिनिधि

- तिमाही

- उठाना

- पहुंच

- एहसास हुआ

- कारण

- को कम करने

- घटी

- को कम करने

- प्रतिबिंबित

- प्रतिबिंब

- शेष

- हटाने

- प्रतिनिधित्व

- प्रतिनिधित्व

- प्रतिनिधि

- अनुरोधों

- की आवश्यकता होती है

- की आवश्यकता होती है

- प्रतिक्रिया

- जिसके परिणामस्वरूप

- वापसी

- जोखिम

- रन

- वही

- स्केल

- योजना

- Search

- सेट

- आकार

- Share

- पाली

- महत्वपूर्ण

- समान

- सरल

- के बाद से

- एक

- आकार

- छोटा

- So

- हल

- कुछ

- कुछ

- अंतरिक्ष

- विशेष

- विशेष रूप से

- विनिर्देश

- विभाजन

- चरणों

- प्रारंभ

- वर्णित

- फिर भी

- अध्ययन

- सफलता

- प्रणाली

- सिस्टम

- ले जा

- तकनीक

- टेक्नोलॉजीज

- परीक्षण

- RSI

- इसलिये

- चीज़ें

- बिलकुल

- तीन

- द्वार

- यहाँ

- पहर

- बार

- साधन

- ऊपर का

- की ओर

- रेलगाड़ी

- प्रशिक्षण

- समझना

- संघ

- अद्वितीय

- us

- उपयोग

- सत्यापन

- विभिन्न

- सत्यापित

- संस्करण

- जरूरत है

- क्या

- या

- जब

- अंदर

- बिना

- महिलाओं

- काम

- कार्य

- चिंतित

- होगा

- X