2021 में, फार्मास्युटिकल उद्योग ने अमेरिकी राजस्व में $550 बिलियन उत्पन्न किया. फार्मास्युटिकल कंपनियाँ बाज़ार में विभिन्न प्रकार की, अक्सर नवीन, दवाएँ बेचती हैं, जहाँ कभी-कभी अनपेक्षित लेकिन गंभीर प्रतिकूल घटनाएँ घटित हो सकती हैं।

इन घटनाओं की रिपोर्ट कहीं भी, अस्पतालों से या घर पर की जा सकती है, और जिम्मेदारीपूर्वक और कुशलता से निगरानी की जानी चाहिए। स्वास्थ्य डेटा की बढ़ती मात्रा और लागत के कारण प्रतिकूल घटनाओं का पारंपरिक मैन्युअल प्रसंस्करण चुनौतीपूर्ण हो गया है। कुल मिलाकर, 384 तक समग्र स्वास्थ्य सेवा उद्योग के लिए फार्माकोविजिलेंस गतिविधियों की लागत के रूप में $2022 बिलियन का अनुमान लगाया गया है। व्यापक फार्माकोविजिलेंस गतिविधियों का समर्थन करने के लिए, हमारे फार्मास्युटिकल ग्राहक विभिन्न डेटा स्रोतों से प्रतिकूल घटना का पता लगाने को स्वचालित करने के लिए मशीन लर्निंग (एमएल) की शक्ति का उपयोग करना चाहते हैं। , जैसे कि सोशल मीडिया फ़ीड, फ़ोन कॉल, ईमेल और हस्तलिखित नोट्स, और उचित कार्रवाइयां ट्रिगर करें।

इस पोस्ट में, हम दिखाते हैं कि एमएल-संचालित समाधान कैसे विकसित किया जाए अमेज़न SageMaker हगिंग फेस पर सार्वजनिक रूप से उपलब्ध प्रतिकूल दवा प्रतिक्रिया डेटासेट का उपयोग करके प्रतिकूल घटनाओं का पता लगाने के लिए। इस समाधान में, हम हगिंग फेस पर विभिन्न प्रकार के मॉडलों को ठीक करते हैं जो मेडिकल डेटा पर पूर्व-प्रशिक्षित थे और बायोबर्ट मॉडल का उपयोग करते हैं, जो कि मेडिकल डेटा पर पूर्व-प्रशिक्षित था। प्रकाशित डेटासेट और आज़माए गए लोगों में से सर्वश्रेष्ठ प्रदर्शन करता है।

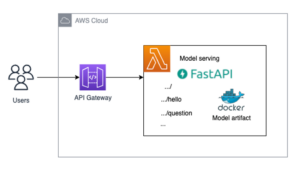

हमने इसका उपयोग करके समाधान लागू किया AWS क्लाउड डेवलपमेंट किट (एडब्ल्यूएस सीडीके)। हालाँकि, हम इस पोस्ट में समाधान के निर्माण की विशिष्टताओं को शामिल नहीं करते हैं। इस समाधान के कार्यान्वयन पर अधिक जानकारी के लिए देखें Amazon SageMaker और Amazon QuickSight का उपयोग करके वास्तविक समय में प्रतिकूल घटनाओं को पकड़ने के लिए एक प्रणाली बनाएं.

यह पोस्ट कई प्रमुख क्षेत्रों पर प्रकाश डालती है, जो निम्नलिखित विषयों की व्यापक खोज प्रदान करती है:

- AWS व्यावसायिक सेवाओं द्वारा सामना की जाने वाली डेटा चुनौतियाँ

- बड़े भाषा मॉडल (एलएलएम) का परिदृश्य और अनुप्रयोग:

- ट्रांसफार्मर, बीईआरटी, और जीपीटी

- गले लगना

- सुव्यवस्थित एलएलएम समाधान और उसके घटक:

- डेटा तैयारी

- मॉडल प्रशिक्षण

डेटा चुनौती

वर्गीकरण कार्य करते समय डेटा में गड़बड़ी अक्सर एक समस्या होती है। आप आदर्श रूप से एक संतुलित डेटासेट चाहेंगे, और यह उपयोग मामला कोई अपवाद नहीं है।

हम इस तिरछापन को संबोधित करते हैं जनरेटिव ए.आई. मॉडल (फाल्कन-7बी और फाल्कन-40बी), जिन्हें सिमेंटिक विविधता बढ़ाने और लेबल की गई प्रतिकूल घटनाओं के नमूना आकार को बढ़ाने के लिए प्रशिक्षण सेट से पांच उदाहरणों के आधार पर घटना नमूने उत्पन्न करने के लिए प्रेरित किया गया था। यहां फाल्कन मॉडल का उपयोग करना हमारे लिए फायदेमंद है क्योंकि, हगिंग फेस पर कुछ एलएलएम के विपरीत, फाल्कन आपको उनके द्वारा उपयोग किए जाने वाले प्रशिक्षण डेटासेट देता है, ताकि आप सुनिश्चित हो सकें कि आपका कोई भी परीक्षण सेट उदाहरण फाल्कन प्रशिक्षण सेट में शामिल नहीं है और डेटा से बचें दूषण।

स्वास्थ्य सेवा ग्राहकों के लिए अन्य डेटा चुनौती HIPAA अनुपालन आवश्यकताएँ हैं। इन आवश्यकताओं को पूरा करने के लिए आराम और पारगमन में एन्क्रिप्शन को समाधान में शामिल किया जाना चाहिए।

ट्रांसफार्मर, बीईआरटी, और जीपीटी

ट्रांसफार्मर आर्किटेक्चर एक तंत्रिका नेटवर्क आर्किटेक्चर है जिसका उपयोग प्राकृतिक भाषा प्रसंस्करण (एनएलपी) कार्यों के लिए किया जाता है। इसे सबसे पहले अखबार में पेश किया गया था "ध्यान आप सभी की जरूरत है" वासवानी एट अल द्वारा। (2017)। ट्रांसफॉर्मर आर्किटेक्चर ध्यान तंत्र पर आधारित है, जो मॉडल को शब्दों के बीच लंबी दूरी की निर्भरता सीखने की अनुमति देता है। जैसा कि मूल पेपर में बताया गया है, ट्रांसफार्मर में दो मुख्य घटक होते हैं: एनकोडर और डिकोडर। एनकोडर इनपुट अनुक्रम को इनपुट के रूप में लेता है और छिपी हुई स्थितियों का अनुक्रम उत्पन्न करता है। फिर डिकोडर इन छिपे हुए राज्यों को इनपुट के रूप में लेता है और आउटपुट अनुक्रम उत्पन्न करता है। ध्यान तंत्र का उपयोग एनकोडर और डिकोडर दोनों में किया जाता है। ध्यान तंत्र आउटपुट अनुक्रम उत्पन्न करते समय मॉडल को इनपुट अनुक्रम में विशिष्ट शब्दों पर ध्यान देने की अनुमति देता है। यह मॉडल को शब्दों के बीच लंबी दूरी की निर्भरता सीखने की अनुमति देता है, जो कई एनएलपी कार्यों, जैसे मशीन अनुवाद और पाठ सारांश के लिए आवश्यक है।

ट्रांसफार्मर आर्किटेक्चर के अधिक लोकप्रिय और उपयोगी में से एक, ट्रांसफार्मर से द्विदिश एनकोडर प्रतिनिधित्व (बीईआरटी), एक भाषा प्रतिनिधित्व मॉडल है जो था 2018 में पेश किया. BERT को उन अनुक्रमों पर प्रशिक्षित किया जाता है जहां एक वाक्य में कुछ शब्द छिपे हुए होते हैं, और उसे छिपे हुए शब्दों के पहले और बाद के दोनों शब्दों को ध्यान में रखते हुए उन शब्दों को भरना होता है। प्रश्न उत्तर, प्राकृतिक भाषा अनुमान और भावना विश्लेषण सहित विभिन्न एनएलपी कार्यों के लिए बीईआरटी को ठीक किया जा सकता है।

दूसरा लोकप्रिय ट्रांसफॉर्मर आर्किटेक्चर जिसने दुनिया में तहलका मचा दिया है, वह है जेनरेटिव प्री-ट्रेंड ट्रांसफॉर्मर (जीपीटी)। पहला GPT मॉडल था OpenAI द्वारा 2018 में पेश किया गया. यह एक अनुक्रम में अगले शब्द की सख्ती से भविष्यवाणी करने के लिए प्रशिक्षित होकर काम करता है, केवल शब्द से पहले संदर्भ के बारे में जागरूक होता है। जीपीटी मॉडल को टेक्स्ट और कोड के विशाल डेटासेट पर प्रशिक्षित किया जाता है, और उन्हें टेक्स्ट जेनरेशन, प्रश्न उत्तर और सारांश सहित एनएलपी कार्यों की एक श्रृंखला के लिए ठीक किया जा सकता है।

सामान्य तौर पर, BERT उन कार्यों में बेहतर होता है जिनमें शब्दों के संदर्भ की गहरी समझ की आवश्यकता होती है GPT उन कार्यों के लिए बेहतर अनुकूल है जिनमें टेक्स्ट जनरेट करने की आवश्यकता होती है.

गले लगना

हगिंग फेस एक कृत्रिम बुद्धिमत्ता कंपनी है जो एनएलपी में विशेषज्ञता रखती है। यह टूल और संसाधनों के साथ एक मंच प्रदान करता है जो डेवलपर्स को एनएलपी कार्यों पर केंद्रित एमएल मॉडल बनाने, प्रशिक्षित करने और तैनात करने में सक्षम बनाता है। हगिंग फेस की प्रमुख पेशकशों में से एक इसकी लाइब्रेरी है, ट्रान्सफ़ॉर्मर, जिसमें पूर्व-प्रशिक्षित मॉडल शामिल हैं जिन्हें पाठ वर्गीकरण, अनुवाद, सारांश और प्रश्न उत्तर जैसे विभिन्न भाषा कार्यों के लिए ठीक किया जा सकता है।

हगिंग फेस सेजमेकर के साथ सहजता से एकीकृत होता है, जो एक पूरी तरह से प्रबंधित सेवा है जो डेवलपर्स और डेटा वैज्ञानिकों को बड़े पैमाने पर एमएल मॉडल बनाने, प्रशिक्षित करने और तैनात करने में सक्षम बनाती है। यह तालमेल हगिंग फेस द्वारा पेश किए जाने वाले अत्याधुनिक मॉडलों के साथ एनएलपी कार्यों को संभालने के लिए एक मजबूत और स्केलेबल बुनियादी ढांचा प्रदान करके उपयोगकर्ताओं को लाभान्वित करता है, जो एडब्ल्यूएस की शक्तिशाली और लचीली एमएल सेवाओं के साथ संयुक्त है। आप हगिंग फेस मॉडल्स तक सीधे भी पहुंच सकते हैं अमेज़न SageMaker जम्पस्टार्ट, जिससे पूर्व-निर्मित समाधानों के साथ शुरुआत करना सुविधाजनक हो गया है।

समाधान अवलोकन

हमने प्रतिकूल घटना वर्गीकरण के कार्य के लिए सेजमेकर पर ट्रांसफॉर्मर मॉडल को फाइन-ट्यून करने के लिए हगिंग फेस ट्रांसफॉर्मर्स लाइब्रेरी का उपयोग किया। प्रशिक्षण कार्य SageMaker PyTorch अनुमानक का उपयोग करके बनाया गया है। सेजमेकर जंपस्टार्ट में हगिंग फेस के साथ कुछ पूरक एकीकरण भी हैं जो कार्यान्वयन को सरल बनाते हैं। इस अनुभाग में, हम डेटा तैयारी और मॉडल प्रशिक्षण में शामिल प्रमुख चरणों का वर्णन करते हैं।

डेटा तैयारी

हमने प्रतिकूल दवा प्रतिक्रिया डेटा का उपयोग किया (ade_corpus_v2) हगिंग फेस डेटासेट के भीतर 80/20 प्रशिक्षण/परीक्षण विभाजन के साथ। हमारे मॉडल प्रशिक्षण और अनुमान के लिए आवश्यक डेटा संरचना में दो कॉलम हैं:

- मॉडल इनपुट डेटा के रूप में टेक्स्ट सामग्री के लिए एक कॉलम।

- लेबल वर्ग के लिए एक और कॉलम। हमारे पास एक पाठ के लिए दो संभावित वर्ग हैं:

Not_AEऔरAdverse_Event.

मॉडल प्रशिक्षण और प्रयोग

प्रतिकूल घटनाओं के हमारे संयुक्त डेटा को ठीक करने के लिए संभावित हगिंग फेस मॉडल के स्थान का कुशलतापूर्वक पता लगाने के लिए, हमने एक सेजमेकर हाइपरपैरामीटर ऑप्टिमाइज़ेशन (एचपीओ) जॉब का निर्माण किया और हाइपरपैरामीटर के रूप में विभिन्न हगिंग फेस मॉडल में अन्य महत्वपूर्ण हाइपरपैरामीटर के साथ पारित किया। जैसे कि प्रशिक्षण बैच का आकार, अनुक्रम की लंबाई, मॉडल और सीखने की दर। प्रशिक्षण नौकरियों में ml.p3dn.24xlarge उदाहरण का उपयोग किया गया और उस उदाहरण प्रकार के साथ प्रति कार्य औसतन 30 मिनट लगे। हालांकि प्रशिक्षण मेट्रिक्स पर कब्जा कर लिया गया था अमेज़न SageMaker प्रयोग उपकरण, और प्रत्येक प्रशिक्षण कार्य 10 युगों तक चला।

हम अपने कोड में निम्नलिखित निर्दिष्ट करते हैं:

- प्रशिक्षण बैच का आकार - मॉडल भार अद्यतन होने से पहले एक साथ संसाधित किए गए नमूनों की संख्या

- अनुक्रम लंबाई - इनपुट अनुक्रम की अधिकतम लंबाई जिसे BERT संसाधित कर सकता है

- सीखने की दर - प्रशिक्षण के दौरान मॉडल कितनी जल्दी अपना वजन अपडेट करता है

- मॉडल - पूर्व-प्रशिक्षित मॉडलों को गले लगाना

परिणाम

हमारे उपयोग के मामले में जिस मॉडल ने सबसे अच्छा प्रदर्शन किया वह था monologg/biobert_v1.1_pubmed मॉडल को हगिंग फेस पर होस्ट किया गया है, जो बीईआरटी आर्किटेक्चर का एक संस्करण है जिसे पबमेड डेटासेट पर पूर्व-प्रशिक्षित किया गया है, जिसमें 19,717 वैज्ञानिक प्रकाशन शामिल हैं। जब चिकित्सकीय रूप से संबंधित वैज्ञानिक शब्दों के संदर्भ की पहचान करने की बात आती है तो इस डेटासेट पर BERT का पूर्व-प्रशिक्षण इस मॉडल को अतिरिक्त विशेषज्ञता प्रदान करता है। यह प्रतिकूल घटना का पता लगाने के कार्य के लिए मॉडल के प्रदर्शन को बढ़ाता है क्योंकि इसे चिकित्सकीय रूप से विशिष्ट सिंटैक्स पर पूर्व-प्रशिक्षित किया गया है जो अक्सर हमारे डेटासेट में दिखाई देता है।

निम्नलिखित तालिका हमारे मूल्यांकन मेट्रिक्स का सारांश प्रस्तुत करती है।

| आदर्श | शुद्धता | वापस बुलाना | F1 |

| बेस बर्ट | 0.87 | 0.95 | 0.91 |

| बायोबर्ट | 0.89 | 0.95 | 0.92 |

| एचपीओ के साथ बायोबर्ट | 0.89 | 0.96 | 0.929 |

| एचपीओ के साथ बायोबर्ट और कृत्रिम रूप से उत्पन्न प्रतिकूल घटना | 0.90 | 0.96 | 0.933 |

हालाँकि ये बेस BERT मॉडल की तुलना में अपेक्षाकृत छोटे और वृद्धिशील सुधार हैं, फिर भी यह इन तरीकों के माध्यम से मॉडल के प्रदर्शन को बेहतर बनाने के लिए कुछ व्यवहार्य रणनीतियों को प्रदर्शित करता है। फाल्कन के साथ सिंथेटिक डेटा जेनरेशन में प्रदर्शन में सुधार के लिए बहुत सारे वादे और संभावनाएं हैं, खासकर जब ये जेनरेटिव एआई मॉडल समय के साथ बेहतर हो जाते हैं।

क्लीन अप

भविष्य के शुल्कों से बचने के लिए, आपके द्वारा निम्नलिखित कोड के साथ बनाए गए मॉडल और मॉडल एंडपॉइंट जैसे सभी बनाए गए संसाधनों को हटा दें:

निष्कर्ष

आज कई फार्मास्युटिकल कंपनियां ग्राहक सुरक्षा और परिणामों को बेहतर बनाने में मदद करने के लिए व्यवस्थित तरीके से अपने ग्राहक इंटरैक्शन से प्रतिकूल घटनाओं की पहचान करने की प्रक्रिया को स्वचालित करना चाहती हैं। जैसा कि हमने इस पोस्ट में दिखाया है, डेटा में जोड़े गए कृत्रिम रूप से उत्पन्न प्रतिकूल घटनाओं के साथ फाइन-ट्यून एलएलएम बायोबीईआरटी उच्च एफ 1 स्कोर के साथ प्रतिकूल घटनाओं को वर्गीकृत करता है और इसका उपयोग हमारे ग्राहकों के लिए एचआईपीएए-अनुरूप समाधान बनाने के लिए किया जा सकता है।

हमेशा की तरह, AWS आपकी प्रतिक्रिया का स्वागत करता है। कृपया अपने विचार और प्रश्न टिप्पणी अनुभाग में छोड़ें।

लेखक के बारे में

जैक पीटरसन AWS प्रोफेशनल सर्विसेज में डेटा वैज्ञानिक हैं। वह कई वर्षों से ग्राहकों को मशीन लर्निंग समाधान प्रदान कर रहे हैं और उनके पास अर्थशास्त्र में मास्टर डिग्री है।

जैक पीटरसन AWS प्रोफेशनल सर्विसेज में डेटा वैज्ञानिक हैं। वह कई वर्षों से ग्राहकों को मशीन लर्निंग समाधान प्रदान कर रहे हैं और उनके पास अर्थशास्त्र में मास्टर डिग्री है।

डॉ. एडेवाले अकिनफैडेरिन AWS में हेल्थकेयर और लाइफ साइंसेज में एक वरिष्ठ डेटा वैज्ञानिक हैं। उनकी विशेषज्ञता प्रतिलिपि प्रस्तुत करने योग्य और एंड-टू-एंड एआई/एमएल तरीकों, व्यावहारिक कार्यान्वयन और वैश्विक स्वास्थ्य सेवा ग्राहकों को अंतःविषय समस्याओं के लिए स्केलेबल समाधान तैयार करने और विकसित करने में मदद करने में है। उनके पास भौतिकी में दो स्नातक डिग्री और इंजीनियरिंग में डॉक्टरेट की डिग्री है।

डॉ. एडेवाले अकिनफैडेरिन AWS में हेल्थकेयर और लाइफ साइंसेज में एक वरिष्ठ डेटा वैज्ञानिक हैं। उनकी विशेषज्ञता प्रतिलिपि प्रस्तुत करने योग्य और एंड-टू-एंड एआई/एमएल तरीकों, व्यावहारिक कार्यान्वयन और वैश्विक स्वास्थ्य सेवा ग्राहकों को अंतःविषय समस्याओं के लिए स्केलेबल समाधान तैयार करने और विकसित करने में मदद करने में है। उनके पास भौतिकी में दो स्नातक डिग्री और इंजीनियरिंग में डॉक्टरेट की डिग्री है।

एकता वालिया भुल्लर, पीएचडी, एडब्ल्यूएस हेल्थकेयर एंड लाइफ साइंसेज (एचसीएलएस) प्रोफेशनल सर्विसेज बिजनेस यूनिट के साथ एक वरिष्ठ एआई/एमएल सलाहकार हैं। उनके पास स्वास्थ्य सेवा क्षेत्र में एआई/एमएल के अनुप्रयोग का व्यापक अनुभव है, खासकर रेडियोलॉजी में। काम के बाहर, जब रेडियोलॉजी में एआई पर चर्चा नहीं होती, तो वह दौड़ना और लंबी पैदल यात्रा करना पसंद करती है।

एकता वालिया भुल्लर, पीएचडी, एडब्ल्यूएस हेल्थकेयर एंड लाइफ साइंसेज (एचसीएलएस) प्रोफेशनल सर्विसेज बिजनेस यूनिट के साथ एक वरिष्ठ एआई/एमएल सलाहकार हैं। उनके पास स्वास्थ्य सेवा क्षेत्र में एआई/एमएल के अनुप्रयोग का व्यापक अनुभव है, खासकर रेडियोलॉजी में। काम के बाहर, जब रेडियोलॉजी में एआई पर चर्चा नहीं होती, तो वह दौड़ना और लंबी पैदल यात्रा करना पसंद करती है।

हान यार सैन डिएगो, सीए स्थित AWS प्रोफेशनल सर्विसेज में एक वरिष्ठ डेटा साइंस और मशीन लर्निंग मैनेजर हैं। उन्होंने नॉर्थवेस्टर्न यूनिवर्सिटी से इंजीनियरिंग में पीएचडी की है और विनिर्माण, वित्तीय सेवाओं और ऊर्जा में ग्राहकों को सलाह देने वाले प्रबंधन सलाहकार के रूप में उनके पास कई वर्षों का अनुभव है। आज, वह AWS पर एमएल और जेनरेटिव एआई समाधान विकसित करने और लागू करने के लिए विभिन्न उद्योग क्षेत्रों के प्रमुख ग्राहकों के साथ लगन से काम कर रहे हैं।

हान यार सैन डिएगो, सीए स्थित AWS प्रोफेशनल सर्विसेज में एक वरिष्ठ डेटा साइंस और मशीन लर्निंग मैनेजर हैं। उन्होंने नॉर्थवेस्टर्न यूनिवर्सिटी से इंजीनियरिंग में पीएचडी की है और विनिर्माण, वित्तीय सेवाओं और ऊर्जा में ग्राहकों को सलाह देने वाले प्रबंधन सलाहकार के रूप में उनके पास कई वर्षों का अनुभव है। आज, वह AWS पर एमएल और जेनरेटिव एआई समाधान विकसित करने और लागू करने के लिए विभिन्न उद्योग क्षेत्रों के प्रमुख ग्राहकों के साथ लगन से काम कर रहे हैं।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- पहुँच

- लेखा

- एसीएम

- कार्रवाई

- गतिविधियों

- जोड़ा

- पता

- लाभदायक

- विपरीत

- सलाह दे

- बाद

- AI

- एआई मॉडल

- ऐ / एमएल

- AL

- सब

- की अनुमति देता है

- साथ में

- भी

- हमेशा

- वीरांगना

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- राशि

- an

- विश्लेषण

- और

- जवाब दे

- कोई

- कहीं भी

- आवेदन

- उपयुक्त

- स्थापत्य

- आर्किटेक्चर

- हैं

- क्षेत्रों के बारे में जानकारी का उपयोग करके ट्रेडिंग कर सकते हैं।

- चारों ओर

- कृत्रिम

- कृत्रिम बुद्धिमत्ता

- AS

- At

- भाग लेने के लिए

- ध्यान

- को स्वचालित रूप से

- उपलब्ध

- औसत

- से बचने

- जागरूक

- एडब्ल्यूएस

- AWS व्यावसायिक सेवाएँ

- संतुलित

- आधार

- आधारित

- BE

- क्योंकि

- किया गया

- से पहले

- जा रहा है

- लाभ

- BEST

- बेहतर

- के बीच

- द्विदिशिक

- बिलियन

- बूस्ट

- के छात्रों

- सीमाओं

- निर्माण

- इमारत

- बनाया गया

- व्यापार

- लेकिन

- by

- CA

- कॉल

- कर सकते हैं

- पर कब्जा कर लिया

- मामला

- चुनौती

- चुनौतियों

- चुनौतीपूर्ण

- प्रभार

- कक्षा

- कक्षाएं

- वर्गीकरण

- ग्राहकों

- बादल

- कोड

- स्तंभ

- स्तंभ

- संयुक्त

- आता है

- अ रहे है

- टिप्पणियाँ

- कंपनियों

- कंपनी

- पूरक

- अनुपालन

- घटकों

- व्यापक

- होते हैं

- निर्माण

- सलाहकार

- निहित

- सामग्री

- प्रसंग

- सुविधाजनक

- लागत

- लागत

- आवरण

- बनाना

- बनाया

- ग्राहक

- ग्राहक

- तिथि

- डेटा तैयारी

- डेटा विज्ञान

- आँकड़े वाला वैज्ञानिक

- डेटा संरचना

- और गहरा

- परिभाषित

- डिग्री

- पहुंचाने

- विशद जानकारी देता है

- दर्शाता

- निर्भरता

- तैनात

- वर्णन

- खोज

- विकसित करना

- डेवलपर्स

- विकास

- डिएगो

- विभिन्न

- सीधे

- पर चर्चा

- विविधता

- डोमेन

- dont

- दवा

- औषध

- दौरान

- ई एंड टी

- से प्रत्येक

- अर्थशास्त्र (इकोनॉमिक्स)

- कुशलता

- ईमेल

- सक्षम

- सक्षम बनाता है

- एन्क्रिप्शन

- शुरू से अंत तक

- ऊर्जा

- अभियांत्रिकी

- अवधियों को

- विशेष रूप से

- आवश्यक

- मूल्यांकन

- कार्यक्रम

- घटनाओं

- उदाहरण

- अपवाद

- अनुभव

- विशेषज्ञता

- अन्वेषण

- का पता लगाने

- व्यापक

- विस्तृत अनुभव

- अतिरिक्त

- f1

- चेहरा

- प्रतिक्रिया

- भरना

- वित्तीय

- वित्तीय सेवाओं

- प्रथम

- पांच

- लचीला

- ध्यान केंद्रित

- निम्नलिखित

- के लिए

- से

- पूरी तरह से

- भविष्य

- सामान्य जानकारी

- उत्पन्न

- उत्पन्न

- सृजन

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- मिल

- देता है

- वैश्विक

- स्नातक

- संभालना

- हाथ

- है

- he

- स्वास्थ्य

- स्वास्थ्य सेवा

- स्वास्थ्य देखभाल उद्योग

- हेल्थटेक

- मदद

- मदद

- यहाँ उत्पन्न करें

- छिपा हुआ

- हाई

- वृद्धि

- उसके

- पकड़

- होम

- अस्पतालों

- मेजबानी

- कैसे

- How To

- तथापि

- HTTPS

- हाइपरपरमेटर अनुकूलन

- आदर्श

- पहचान

- लागू करने के

- कार्यान्वयन

- कार्यान्वयन

- कार्यान्वित

- आयात

- महत्वपूर्ण

- में सुधार

- सुधार

- in

- शामिल

- सहित

- निगमित

- बढ़ना

- बढ़ती

- वृद्धिशील

- उद्योग

- करें-

- इंफ्रास्ट्रक्चर

- निवेश

- उदाहरण

- एकीकृत

- एकीकरण

- बुद्धि

- बातचीत

- में

- शुरू की

- शामिल

- IT

- आईटी इस

- काम

- नौकरियां

- जेपीजी

- कुंजी

- प्रमुख क्षेत्र

- लेबल

- रखी

- परिदृश्य

- भाषा

- बड़ा

- जानें

- सीख रहा हूँ

- छोड़ना

- लंबाई

- पुस्तकालय

- जीवन

- जीवन विज्ञान

- पसंद

- को यह पसंद है

- एलएलएम

- लॉट

- मशीन

- यंत्र अधिगम

- बनाया गया

- मुख्य

- प्रमुख

- बनाता है

- निर्माण

- आदमी

- कामयाब

- प्रबंध

- प्रबंधक

- गाइड

- विनिर्माण

- बहुत

- बाजार

- विशाल

- मास्टर की

- अधिकतम करने के लिए

- अधिकतम

- तंत्र

- मीडिया

- मेडिकल

- चिकित्सा डेटा

- मिलना

- तरीकों

- मेट्रिक्स

- मिनटों

- ML

- आदर्श

- मॉडल

- नजर रखी

- अधिक

- चाहिए

- नाम

- प्राकृतिक

- प्राकृतिक भाषा संसाधन

- नेटवर्क

- तंत्रिका

- तंत्रिका नेटवर्क

- फिर भी

- अगला

- NLP

- नहीं

- कोई नहीं

- नोट्स

- उपन्यास

- संख्या

- होते हैं

- of

- प्रसाद

- ऑफर

- अक्सर

- on

- ONE

- केवल

- इष्टतमीकरण

- or

- आदेश

- मूल

- अन्य

- हमारी

- आउट

- परिणामों

- उत्पादन

- बाहर

- के ऊपर

- कुल

- व्यापक

- काग़ज़

- पारित कर दिया

- पीडीएफ

- प्रति

- प्रदर्शन

- प्रदर्शन

- प्रदर्शन

- फार्मास्युटिकल

- पीएचडी

- फ़ोन

- फोन कॉल्स

- भौतिक विज्ञान

- मंच

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- कृप्या अ

- लोकप्रिय

- संभव

- पद

- संभावित

- बिजली

- शक्तिशाली

- व्यावहारिक

- भविष्यवाणी करना

- तैयारी

- मुसीबत

- समस्याओं

- प्रक्रिया

- प्रसंस्कृत

- प्रसंस्करण

- पैदा करता है

- पेशेवर

- प्रक्षेपित

- वादा

- प्रदान करता है

- प्रदान कर

- प्रकाशनों

- सार्वजनिक रूप से

- pytorch

- प्रश्न

- प्रशन

- जल्दी से

- रेंज

- मूल्यांकन करें

- प्रतिक्रिया

- वास्तविक समय

- उल्लेख

- regex

- सम्बंधित

- अपेक्षाकृत

- की सूचना दी

- प्रतिनिधित्व

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकताएँ

- उपयुक्त संसाधन चुनें

- जिम्मेदारी से

- बाकी

- मजबूत

- रन

- सुरक्षा

- sagemaker

- नमूना

- सेन

- सैन डिएगो

- स्केलेबल

- स्केल

- विज्ञान

- विज्ञान

- वैज्ञानिक

- वैज्ञानिक

- वैज्ञानिकों

- मूल

- अनुभाग

- लगता है

- बेचना

- अर्थ

- वरिष्ठ

- वाक्य

- भावुकता

- अनुक्रम

- गंभीर

- सेवा

- सेवाएँ

- सेट

- कई

- वह

- दिखाना

- पता चला

- दिखाता है

- आकार

- तिरछा

- छोटा

- So

- सोशल मीडिया

- सोशल मीडिया

- समाधान

- समाधान ढूंढे

- कुछ

- कभी कभी

- सूत्रों का कहना है

- अंतरिक्ष

- माहिर

- विशिष्ट

- बारीकियों

- विभाजित

- प्रारंभ

- राज्य के-the-कला

- राज्य

- कदम

- आंधी

- सरल

- रणनीतियों

- संरचना

- ऐसा

- समर्थन

- निश्चित

- तालमेल

- वाक्यविन्यास

- कृत्रिम

- सिंथेटिक डेटा

- कृत्रिम

- प्रणाली

- तालिका

- लिया

- लेता है

- ले जा

- कार्य

- कार्य

- शर्तों

- परीक्षण

- टेक्स्ट

- पाठ वर्गीकरण

- कि

- RSI

- दुनिया

- लेकिन हाल ही

- फिर

- इन

- वे

- इसका

- उन

- हालांकि?

- यहाँ

- पहर

- सेवा मेरे

- आज

- एक साथ

- ले गया

- साधन

- उपकरण

- विषय

- परंपरागत

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- ट्रांसफार्मर

- ट्रान्सफ़ॉर्मर

- पारगमन

- अनुवाद करें

- कोशिश

- ट्रिगर

- दो

- टाइप

- समझ

- इकाई

- विश्वविद्यालय

- भिन्न

- अपडेट

- us

- उपयोग

- उदाहरण

- प्रयुक्त

- उपयोगी

- उपयोगकर्ताओं

- का उपयोग

- विविधता

- विभिन्न

- संस्करण

- कार्यक्षेत्र

- व्यवहार्य

- करना चाहते हैं

- था

- मार्ग..

- we

- वेब

- वेब सेवाओं

- का स्वागत करते हैं

- थे

- कब

- जहाँ तक

- कौन कौन से

- साथ में

- अंदर

- शब्द

- शब्द

- काम

- काम कर रहे

- कार्य

- विश्व

- होगा

- साल

- आप

- आपका

- जेफिरनेट