अमेरिकी सीनेटर चक शूमर (डी-एनवाई) हाल ही में द्विदलीय कानून पारित करने पर तुले हुए हैं, जो वाणिज्यिक एआई उत्पादों के स्वतंत्र सार्वजनिक ऑडिट को सक्षम करते हैं, इससे पहले कि वे दुनिया में पहुंचें।

महीनों के परामर्श के बाद, सीनेट के बहुमत वाले नेता का कहना है कि उन्होंने उन्नत मशीन-लर्निंग तकनीक के विकास, परिनियोजन और उपयोग को विनियमित करने के लिए एक रूपरेखा तैयार की है। उन्होंने कहा कि जनरेटिव एआई में उछाल, इसके आस-पास के सभी प्रचार, और प्रौद्योगिकी को प्रतिबंधित करने के चीन के कदमों ने अमेरिका में इन मॉडलों और सॉफ्टवेयर को नियंत्रित करने के लिए इसे और अधिक जरूरी बना दिया है।

वह ढांचा, यदि शूमर की योजना सफल होती है, तो संयुक्त राज्य अमेरिका में "व्यापक" कानून का परिणाम होगा, जिसका संगठनों को कृत्रिम बुद्धिमत्ता को रोल आउट करते समय पालन करने की आवश्यकता होगी।

शूमर ने डिब्बाबंद बयान में कहा, "एआई का युग यहां है, और यहां रहना है।" "अब हमारे देश को पीढ़ियों तक लाभान्वित करने के लिए इसकी क्षमता को विकसित करने, उपयोग करने और आगे बढ़ाने का समय है।"

"एआई उद्योग के परिणामी और समाज, राष्ट्रीय सुरक्षा और वैश्विक अर्थव्यवस्था पर तेजी से बढ़ते प्रभाव को देखते हुए," उन्होंने जारी रखा, "मैंने कुछ प्रमुख एआई चिकित्सकों और विचारशील नेताओं के साथ काम किया है जो एक नई नियामक व्यवस्था की रूपरेखा तैयार करता है। यह हमारे देश को होने वाली संभावित विनाशकारी क्षति को रोकेगा और साथ ही यह सुनिश्चित करेगा कि अमेरिका इस परिवर्तनकारी तकनीक में आगे बढ़े और आगे बढ़े।

"लेकिन अभी बहुत काम करना बाकी है और हमें जल्दी से आगे बढ़ना चाहिए। मैं इस प्रस्ताव को आकार देने और बेहतर दुनिया बनाने के अपने वादे को पूरा करने के लिए एआई को सुनिश्चित करने के लिए कानून को परिष्कृत करने के लिए पूरे उद्योग और देश भर में और उससे आगे काम करने के लिए तत्पर हूं।

शूमर का प्रस्तावित ढाँचा, जिसे कैपिटल हिल के आसपास साझा किया गया है और अभी तक सार्वजनिक नहीं किया गया है, चार रेलिंगों के इर्द-गिर्द घूमता है: कौन, कहाँ, कैसे और रक्षा करता है।

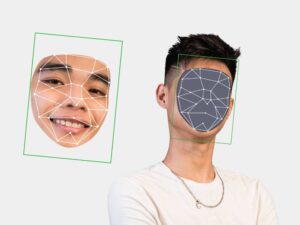

विशेष रूप से, इन प्रस्तावों के तहत, यह स्पष्ट होना चाहिए कि किसने एक मॉडल को प्रशिक्षित किया है और इसका उपयोग करने वाला कौन है, प्रशिक्षण डेटा कहाँ से आया है और सॉफ्टवेयर का उपयोग कैसे किया जाएगा। महत्वपूर्ण रूप से, पर्याप्त जानकारी प्रदान की जानी चाहिए ताकि बाहरी विशेषज्ञ मशीन-लर्निंग उत्पादों और तकनीकों को बाजार में लाने से पहले उनका ऑडिट, परीक्षण और समीक्षा कर सकें, और इन निष्कर्षों को सार्वजनिक किया जा सके।

अंत में, रक्षा के हिस्से के लिए, डेवलपर्स को अपने एआई सिस्टम को अमेरिकी मूल्यों के साथ गठबंधन करना होगा और यह दिखाना होगा कि "एआई डेवलपर्स एक बेहतर दुनिया बनाने के अपने वादे को पूरा करते हैं।"

शूमर शिक्षा, उद्योग और सरकार में नेताओं के साथ अपने ढांचे को साझा करने की योजना बना रहा है, यदि पहले से नहीं है, और कानून बिल पेश करने से पहले अपने प्रस्तावों को परिष्कृत करने के लिए थिंक टैंक और अनुसंधान संस्थानों के साथ काम करने का इरादा रखता है। रजिस्टर अधिक जानकारी के लिए सीनेटर के कार्यालय को दबाया, और एक प्रतिनिधि इससे ज्यादा कुछ नहीं दे सकता था एक प्रेस विज्ञप्ति.

यह रिलीज प्रस्तावित ढांचे को स्पष्ट करती है "कंपनियों को सार्वजनिक रिलीज या अपडेट से पहले एआई प्रौद्योगिकियों की समीक्षा और परीक्षण करने के लिए स्वतंत्र विशेषज्ञों को अनुमति देने और उपयोगकर्ताओं को उन परिणामों तक पहुंच प्रदान करने की आवश्यकता होगी।"

नौकरशाही की बात ... यूरोपियन डेटा प्रोटेक्शन बोर्ड, जो यूरोप के राष्ट्रीय गोपनीयता प्रहरी को एक ही पृष्ठ पर रखने में मदद करता है बनाया एक टास्क फोर्स यह सुनिश्चित करने के लिए कि वे नियामक OpenAI के ChatGPT पर किसी भी कार्रवाई की जानकारी और विवरण साझा करें। यह इटली द्वारा लिए जाने के बाद है के खिलाफ कड़ा रुख चैट बॉट, निजता और बाल सुरक्षा के डर से, और अन्य राष्ट्र उसी तरह की कार्रवाई पर विचार कर रहे हैं।

यह मूल रूप से इंगित करता है कि यूरोप अगली-पीढ़ी के AI सिस्टम के लिए एक एकीकृत प्रतिक्रिया पर अभिसरण कर रहा है जिसे Microsoft द्वारा चैंपियन बनाया गया है और आज की तकनीक के सभी कोनों में इंजेक्ट किया गया है।

यह सब चीन के साइबर स्पेस नियामक ने इसी तरह के नियमों का मसौदा तैयार करने के लिए किया है, जिसके लिए संगठनों को अपने एआई उत्पादों के संभावित सुरक्षा जोखिमों की जांच के लिए सुरक्षा आकलन प्रस्तुत करने की आवश्यकता होगी। डेवलपर्स को यह सुनिश्चित करना चाहिए कि उनके मॉडल को आकार देने के लिए उपयोग किए जाने वाले प्रशिक्षण डेटा से भेदभाव नहीं होगा, और देश के समाजवादी मूल्यों को दर्शाता है, रॉयटर्स की रिपोर्ट.

अमेरिकी वाणिज्य विभाग का राष्ट्रीय दूरसंचार और सूचना प्रशासन एआई उत्पादों और सेवाओं की जवाबदेही में सुधार लाने के उद्देश्य से संभावित नीतियों को तैयार करने में मदद के लिए सार्वजनिक टिप्पणियों की मांग कर रहा है। अभिकरण निर्गत इस सप्ताह इसकी औपचारिक एआई "टिप्पणी के लिए उत्तरदायित्व अनुरोध"। ®

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://go.theregister.com/feed/www.theregister.com/2023/04/13/chuck_schumer_ai_regulation/

- :है

- 7

- a

- About

- अकादमी

- पहुँच

- जवाबदेही

- के पार

- कार्य

- प्रशासन

- उन्नत

- उन्नत

- अग्रिमों

- बाद

- एजेंसी

- आगे

- AI

- गठबंधन

- सब

- पहले ही

- अमेरिका

- अमेरिकन

- और

- हैं

- चारों ओर

- कृत्रिम

- कृत्रिम बुद्धिमत्ता

- AS

- आकलन

- At

- आडिट

- आडिट

- मूल रूप से

- BE

- से पहले

- लाभ

- बेहतर

- परे

- बिल

- द्विदलीय

- मंडल

- उछाल

- बीओटी

- नौकरशाही

- by

- कर सकते हैं

- विपत्तिपूर्ण

- championed

- ChatGPT

- बच्चा

- बाल संरक्षण

- चीन

- स्पष्ट

- CO

- टिप्पणी

- टिप्पणियाँ

- कॉमर्स

- वाणिज्यिक

- कंपनियों

- व्यापक

- पर विचार

- निरंतर

- अभिसारी

- कोनों

- सका

- देश

- शिल्प

- बनाना

- महत्वपूर्ण

- साइबरस्पेस

- तिथि

- आँकड़ा रक्षण

- उद्धार

- बचाता है

- डेमोक्रेट

- दिखाना

- विभाग

- तैनाती

- विवरण

- विकसित करना

- डेवलपर्स

- विकास

- मसौदा तैयार

- अर्थव्यवस्था

- समर्थकारी

- पर्याप्त

- सुनिश्चित

- यूरोप

- यूरोप

- यूरोपीय

- यूरोपीय डेटा

- जांच

- विशेषज्ञों

- फास्ट

- भय

- का पालन करें

- के लिए

- सेना

- औपचारिक

- आगे

- ढांचा

- से

- स्वाद

- पीढ़ियों

- उत्पादक

- जनरेटिव एआई

- देना

- दी

- वैश्विक

- विश्व अर्थव्यवस्था

- सरकार

- कठिन

- साज़

- है

- मदद

- मदद करता है

- यहाँ उत्पन्न करें

- कैसे

- HTTPS

- प्रचार

- i

- विचारों

- प्रभाव

- में सुधार लाने

- in

- स्वतंत्र

- इंगित करता है

- उद्योग

- पता

- करें-

- संस्थानों

- बुद्धि

- का इरादा रखता है

- IT

- इटली

- आईटी इस

- जेपीजी

- रखना

- कानून

- नेतृत्व

- नेता

- नेताओं

- प्रमुख

- बिक्रीसूत्र

- विधान

- लाइन

- देखिए

- बनाया गया

- बहुमत

- बनाना

- बनाता है

- निर्माण

- बाजार

- माइक्रोसॉफ्ट

- आदर्श

- मॉडल

- महीने

- अधिक

- चाल

- चलती

- राष्ट्रीय

- राष्ट्रीय सुरक्षा

- राष्ट्र

- आवश्यकता

- नया

- of

- प्रस्ताव

- Office

- on

- OpenAI

- संगठनों

- अन्य

- रूपरेखा

- बाहर

- पृष्ठ

- भाग

- पासिंग

- योजनाओं

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- नीतियाँ

- संभावित

- संभावित

- दबाना

- को रोकने के

- एकांत

- उत्पाद

- वादा

- प्रस्ताव

- प्रस्ताव

- प्रस्तावित

- रक्षा करना

- सुरक्षा

- बशर्ते

- सार्वजनिक

- रखना

- जल्दी से

- RE

- को परिष्कृत

- दर्शाता है

- शासन

- नियामक

- विनियामक

- नियामक

- और

- प्रतिनिधि

- का अनुरोध

- की आवश्यकता होती है

- अनुसंधान

- अनुसंधान संस्थानों

- प्रतिक्रिया

- रोकना

- परिणाम

- परिणाम

- रायटर

- की समीक्षा

- जोखिम

- रोलिंग

- नियम

- s

- सुरक्षा

- कहा

- वही

- कहते हैं

- सुरक्षा

- मांग

- सीनेट

- सीनेटर

- सेवाएँ

- आकार

- Share

- साझा

- चाहिए

- समान

- एक साथ

- So

- समाज

- सॉफ्टवेयर

- कुछ

- कथन

- राज्य

- रहना

- कदम

- प्रस्तुत

- माना

- आसपास के

- प्रणाली

- सिस्टम

- टैंक

- कार्य

- कार्यदल

- तकनीक

- टेक्नोलॉजीज

- टेक्नोलॉजी

- दूरसंचार

- परीक्षण

- कि

- RSI

- दुनिया

- लेकिन हाल ही

- इन

- इस सप्ताह

- विचार

- विचारक नेता

- पहर

- सेवा मेरे

- आज

- प्रशिक्षित

- प्रशिक्षण

- परिवर्तनकारी

- के अंतर्गत

- एकीकृत

- यूनाइटेड

- संयुक्त राज्य अमेरिका

- अपडेट

- अति आवश्यक

- us

- उपयोग

- उपयोगकर्ताओं

- मान

- Ve

- सप्ताह

- कौन कौन से

- जब

- कौन

- मर्जी

- साथ में

- काम

- काम किया

- काम कर रहे

- विश्व

- होगा

- जेफिरनेट