"85% खरीदार ऑनलाइन समीक्षाओं पर उतना ही भरोसा करते हैं जितना कि एक व्यक्तिगत अनुशंसा" - गार्टनर

उपभोक्ता डिजिटल सतहों और कई टचप्वाइंट के माध्यम से व्यवसायों के साथ तेजी से जुड़ रहे हैं। आंकड़े बताते हैं कि अधिकांश खरीदार समीक्षाओं का उपयोग यह निर्धारित करने के लिए करते हैं कि कौन से उत्पाद खरीदने हैं और किन सेवाओं का उपयोग करना है। के अनुसार स्पीगल रिसर्च सेंटर, पांच समीक्षाओं वाले उत्पाद की खरीदारी की संभावना बिना समीक्षा वाले उत्पाद की खरीद संभावना से 270% अधिक है। समीक्षाओं में उपभोक्ता के निर्णयों को प्रभावित करने और ब्रांड मूल्य को मजबूत करने की शक्ति होती है।

इस पोस्ट में, हम उपयोग करते हैं Amazon Comprehend उत्पाद समीक्षाओं से सार्थक जानकारी निकालने के लिए, यह समझने के लिए इसका विश्लेषण करें कि विभिन्न जनसांख्यिकी के उपयोगकर्ता उत्पादों पर कैसे प्रतिक्रिया दे रहे हैं, और उत्पाद के प्रति उपयोगकर्ता आत्मीयता पर एकत्रित जानकारी की खोज करें। अमेज़ॅन कॉम्प्रिहेंड एक पूरी तरह से प्रबंधित और लगातार प्रशिक्षित प्राकृतिक भाषा प्रसंस्करण (एनएलपी) सेवा है जो किसी दस्तावेज़ या पाठ की सामग्री के बारे में अंतर्दृष्टि निकाल सकती है।

समाधान अवलोकन

आज, ग्राहक विभिन्न तरीकों से समीक्षाएं प्रदान कर सकते हैं, जैसे स्टार रेटिंग, मुफ्त टेक्स्ट या प्राकृतिक भाषा, या सोशल मीडिया शेयर। मुफ़्त टेक्स्ट या स्वाभाविक भाषा समीक्षाएँ विश्वास बनाने में मदद करती हैं, क्योंकि यह उपभोक्ताओं की एक स्वतंत्र राय है। यह अक्सर उत्पाद टीमों द्वारा समीक्षा चैनलों के माध्यम से ग्राहकों के साथ बातचीत करने के लिए उपयोग किया जाता है। यह एक सिद्ध तथ्य है कि जब ग्राहक सुना हुआ महसूस करते हैं, तो ब्रांड के बारे में उनकी भावना में सुधार होता है। जबकि स्टार रेटिंग या सोशल मीडिया शेयरों का विश्लेषण करना तुलनात्मक रूप से आसान है, प्राकृतिक भाषा या मुफ्त टेक्स्ट समीक्षाएं कई चुनौतियों का सामना करती हैं, जैसे कीवर्ड या वाक्यांशों, विषयों या अवधारणाओं, और भावना या इकाई-स्तरीय भावनाओं की पहचान करना। चुनौती मुख्य रूप से लिखित पाठ में लंबाई की परिवर्तनशीलता और संकेतों और शोर दोनों की प्रशंसनीय उपस्थिति के कारण है। इसके अलावा, जानकारी या तो बहुत स्पष्ट और स्पष्ट हो सकती है (उदाहरण के लिए, कीवर्ड और प्रमुख वाक्यांशों के साथ) या अस्पष्ट और अंतर्निहित (सार विषय और अवधारणाएं)। इससे भी अधिक चुनौतीपूर्ण विभिन्न प्रकार की भावनाओं को समझना और उन्हें उपयुक्त उत्पादों और सेवाओं से जोड़ना है। फिर भी, इस जानकारी और पाठ्य संकेतों को समझना बेहद महत्वपूर्ण है ताकि ग्राहक को एक घर्षण रहित अनुभव प्रदान किया जा सके।

इस पोस्ट में, हम सार्वजनिक रूप से उपलब्ध का उपयोग करते हैं एनएलपी - fast.ai ग्राहकों द्वारा प्रदान की गई उत्पाद समीक्षाओं का विश्लेषण करने के लिए डेटासेट। हम एक अनसुपरवाइज्ड मशीन लर्निंग (एमएल) तकनीक का उपयोग करके शुरू करते हैं जिसे विषय मॉडलिंग के रूप में जाना जाता है। यह एक लोकप्रिय गैर-पर्यवेक्षित तकनीक है जो एक पाठ समीक्षा संग्रह में होने वाले अमूर्त विषयों की खोज करती है। विषय मॉडलिंग एक क्लस्टरिंग समस्या है जो अनसुनी है, जिसका अर्थ है कि मॉडल को संभावित लक्ष्य चर (जैसे समीक्षा में विषय) पर कोई ज्ञान नहीं है। विषयों को समूहों के रूप में दर्शाया गया है। अक्सर, डोमेन विशेषज्ञों की मदद से या कुछ मानक सांख्यिकीय विश्लेषण का उपयोग करके दस्तावेजों के एक समूह में समूहों की संख्या तय की जाती है। मॉडल आउटपुट में आम तौर पर तीन घटक होते हैं: क्रमांकित क्लस्टर (विषय 0, विषय 1, और इसी तरह), प्रत्येक क्लस्टर से जुड़े कीवर्ड, और प्रत्येक दस्तावेज़ के लिए प्रतिनिधि क्लस्टर (या हमारे मामले में समीक्षा)। अपनी अंतर्निहित प्रकृति से, विषय मॉडल समूहों या विषयों के लिए मानव-पठनीय लेबल उत्पन्न नहीं करते हैं, जो एक आम गलत धारणा है। विषय मॉडलिंग के बारे में सामान्य रूप से ध्यान देने योग्य बात यह है कि यह एक मिश्रित सदस्यता मॉडल है- मॉडल के प्रत्येक दस्तावेज़ में प्रत्येक विषय से समानता हो सकती है। विषय मॉडल इस संभावना को निर्धारित करने के लिए एक पुनरावृत्त बायेसियन प्रक्रिया में सीखता है कि प्रत्येक दस्तावेज़ किसी दिए गए विषय या विषय से जुड़ा हुआ है। मॉडल आउटपुट इष्टतम रूप से विषयों की संख्या के चयन पर निर्भर करता है। विषयों की एक छोटी संख्या के परिणामस्वरूप विषय बहुत व्यापक हो सकते हैं, और बड़ी संख्या में विषयों के परिणामस्वरूप निरर्थक विषय या समानता वाले विषय हो सकते हैं। विषय मॉडल का मूल्यांकन करने के कई तरीके हैं:

- मानव निर्णय - अवलोकन-आधारित, व्याख्या-आधारित

- मात्रात्मक मेट्रिक्स - उलझन, सुसंगतता गणना

- मिश्रित दृष्टिकोण - निर्णय-आधारित और मात्रात्मक दृष्टिकोण का संयोजन

एक डेटासेट को दो भागों में विभाजित करके उलझन की गणना की जाती है-एक प्रशिक्षण सेट और एक परीक्षण सेट। संभावना की गणना आमतौर पर एक लघुगणक के रूप में की जाती है, इसलिए इस मीट्रिक को कभी-कभी होल्ड-आउट लॉग-संभावना के रूप में संदर्भित किया जाता है। Perplexity एक भविष्य कहनेवाला मीट्रिक है। यह एक प्रशिक्षण सेट पर प्रशिक्षित होने के बाद एक परीक्षण सेट की भविष्यवाणी करने के लिए एक विषय मॉडल की क्षमता का आकलन करता है। उलझन की कमियों में से एक यह है कि यह संदर्भ पर कब्जा नहीं करता है, जिसका अर्थ है कि यह किसी विषय में शब्दों या किसी दस्तावेज़ में विषयों के बीच संबंध को कैप्चर नहीं करता है। हालाँकि, मानव समझ के लिए शब्दार्थ संदर्भ का विचार महत्वपूर्ण है। किसी विषय में शब्दों के सह-घटना की सशर्त संभावना जैसे उपाय मददगार हो सकते हैं। इन दृष्टिकोणों को सामूहिक रूप से सुसंगतता के रूप में जाना जाता है। इस पोस्ट के लिए, हम मानवीय निर्णय (अवलोकन-आधारित) दृष्टिकोण पर ध्यान केंद्रित करते हैं, अर्थात् किसी विषय में शीर्ष n शब्दों का अवलोकन करना।

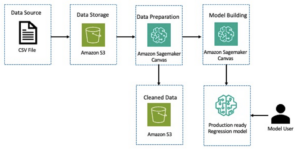

समाधान में निम्नलिखित उच्च-स्तरीय चरण शामिल हैं:

- सेट अप ए अमेज़न SageMaker नोटबुक उदाहरण।

- एक नोटबुक बनाएं।

- खोजपूर्ण डेटा विश्लेषण करें।

- अपना अमेज़ॅन कॉम्प्रिहेंड विषय मॉडलिंग कार्य चलाएं।

- विषय उत्पन्न करें और भावना को समझें।

- उपयोग अमेज़न क्विकसाइट डेटा की कल्पना करने और रिपोर्ट तैयार करने के लिए।

आप इस समाधान का उपयोग किसी भी AWS क्षेत्र में कर सकते हैं, लेकिन आपको यह सुनिश्चित करने की आवश्यकता है कि Amazon Comprehend API और SageMaker एक ही क्षेत्र में हैं। इस पोस्ट के लिए, हम रीजन यूएस ईस्ट (एन. वर्जीनिया) का उपयोग करते हैं।

अपना सेजमेकर नोटबुक इंस्टेंस सेट करें

आप अमेज़ॅन कॉम्प्रिहेंड के साथ बातचीत कर सकते हैं एडब्ल्यूएस प्रबंधन कंसोल, AWS कमांड लाइन इंटरफ़ेस (AWS CLI), या अमेज़ॅन कॉम्प्रिहेंड एपीआई। अधिक जानकारी के लिए देखें अमेज़ॅन कॉम्प्रिहेंड के साथ शुरुआत करना. अमेज़ॅन कॉम्प्रिहेंड एपीआई के साथ बातचीत करने के लिए हम इस पोस्ट में एक सेजमेकर नोटबुक और पायथन (Boto3) कोड का उपयोग करते हैं।

- Amazon SageMaker कंसोल पर, नेविगेशन फलक में नोटबुक के अंतर्गत, चुनें

नोटबुक उदाहरण। - नोटबुक इंस्टेंस बनाएं चुनें।

- एक नोटबुक इंस्टेंस नाम निर्दिष्ट करें और इंस्टेंस प्रकार को ml.r5.2xlarge के रूप में सेट करें।

- बाकी डिफ़ॉल्ट सेटिंग्स को छोड़ दें।

- एक बनाएं AWS पहचान और अभिगम प्रबंधन (IAM) के साथ भूमिका

AmazonSageMakerFullAccessऔर किसी भी आवश्यक तक पहुंच अमेज़न सरल भंडारण सेवा (अमेज़न S3) बकेट और अमेज़ॅन कॉम्प्रिहेंड एपीआई। - नोटबुक इंस्टेंस बनाएं चुनें।

कुछ मिनटों के बाद, आपकी नोटबुक इंस्टेंस तैयार है। - अमेज़ॅन कॉम्प्रिहेंड को नोटबुक इंस्टेंस से एक्सेस करने के लिए, आपको संलग्न करने की आवश्यकता है

ComprehendFullAccessआपकी IAM भूमिका के लिए नीति।

अमेज़ॅन कॉम्प्रिहेंड के सुरक्षा अवलोकन के लिए, देखें Amazon Comprehend में सुरक्षा.

आपके द्वारा प्रोविज़न की गई नोटबुक इंस्टेंस को खोलने के बाद, ज्यूपिटर कंसोल पर, नया और फिर पायथन 3 (डेटा साइंस) चुनें। वैकल्पिक रूप से, आप में नमूना कोड फ़ाइल का उपयोग कर सकते हैं गीथहब रेपो. आप फ़ाइल को सीधे चलाने के लिए या इसे क्लोन करने के लिए नोटबुक इंस्टेंस पर अपलोड कर सकते हैं।

GitHub रेपो में तीन नोटबुक हैं:

data_processing.ipynbmodel_training.ipynbtopic_mapping_sentiment_generation.ipynb

खोजपूर्ण डेटा विश्लेषण करें

हम पहली नोटबुक का उपयोग करते हैं (data_processing.ipynb) डेटा का पता लगाने और संसाधित करने के लिए। हम केवल S3 बकेट से डेटा को डेटाफ़्रेम में लोड करके शुरू करते हैं।

# Bucket containing the data

BUCKET = 'clothing-shoe-jewel-tm-blog'

# Item ratings and metadata

S3_DATA_FILE = 'Clothing_Shoes_and_Jewelry.json.gz' # Zip

S3_META_FILE = 'meta_Clothing_Shoes_and_Jewelry.json.gz' # Zip

S3_DATA = 's3://' + BUCKET + '/' + S3_DATA_FILE

S3_META = 's3://' + BUCKET + '/' + S3_META_FILE

# Transformed review, input for Comprehend

LOCAL_TRANSFORMED_REVIEW = os.path.join('data', 'TransformedReviews.txt')

S3_OUT = 's3://' + BUCKET + '/out/' + 'TransformedReviews.txt'

# Final dataframe where topics and sentiments are going to be joined

S3_FEEDBACK_TOPICS = 's3://' + BUCKET + '/out/' + 'FinalDataframe.csv'

def convert_json_to_df(path):

"""Reads a subset of a json file in a given path in chunks, combines, and returns

"""

# Creating chunks from 500k data points each of chunk size 10k

chunks = pd.read_json(path, orient='records',

lines=True,

nrows=500000,

chunksize=10000,

compression='gzip')

# Creating a single dataframe from all the chunks

load_df = pd.DataFrame()

for chunk in chunks:

load_df = pd.concat([load_df, chunk], axis=0)

return load_df

# Review data

original_df = convert_json_to_df(S3_DATA)

# Metadata

original_meta = convert_json_to_df(S3_META)निम्नलिखित अनुभाग में, हम डेटा को समझने के लिए खोजपूर्ण डेटा विश्लेषण (ईडीए) करते हैं। हम डेटा और मेटाडेटा के आकार की खोज करके शुरू करते हैं। प्रामाणिकता के लिए, हम केवल सत्यापित समीक्षाओं का उपयोग करते हैं।

# Shape of reviews and metadata

print('Shape of review data: ', original_df.shape)

print('Shape of metadata: ', original_meta.shape)

# We are interested in verified reviews only

# Also checking the amount of missing values in the review data

print('Frequency of verified/non verified review data: ', original_df['verified'].value_counts())

print('Frequency of missing values in review data: ', original_df.isna().sum())हम आगे प्रत्येक श्रेणी की गिनती का पता लगाते हैं, और देखते हैं कि कोई डुप्लिकेट डेटा मौजूद है या नहीं।

# Count of each categories for EDA.

print('Frequncy of different item categories in metadata: ', original_meta['category'].value_counts())

# Checking null values for metadata

print('Frequency of missing values in metadata: ', original_meta.isna().sum())

# Checking if there are duplicated data. There are indeed duplicated data in the dataframe.

print('Duplicate items in metadata: ', original_meta[original_meta['asin'].duplicated()])जब हम परिणामों से संतुष्ट हो जाते हैं, तो हम डेटा को पूर्व-संसाधित करने के अगले चरण की ओर बढ़ते हैं। अमेज़ॅन कॉम्प्रिहेंड प्रत्येक विषय मॉडलिंग कार्य में कम से कम 1,000 दस्तावेज़ प्रदान करने की अनुशंसा करता है, जिसमें प्रत्येक दस्तावेज़ कम से कम तीन वाक्य लंबा होता है। दस्तावेज़ UTF-8 स्वरूपित टेक्स्ट फ़ाइलों में होने चाहिए। अगले चरण में, हम सुनिश्चित करते हैं कि डेटा अनुशंसित UTF-8 प्रारूप में है और प्रत्येक इनपुट आकार में 5,000 बाइट्स से अधिक नहीं है।

def clean_text(df):

"""Preprocessing review text.

The text becomes Comprehend compatible as a result.

This is the most important preprocessing step.

"""

# Encode and decode reviews

df['reviewText'] = df['reviewText'].str.encode("utf-8", "ignore")

df['reviewText'] = df['reviewText'].str.decode('ascii')

# Replacing characters with whitespace

df['reviewText'] = df['reviewText'].replace(r'r+|n+|t+|u2028',' ', regex=True)

# Replacing punctuations

df['reviewText'] = df['reviewText'].str.replace('[^ws]','', regex=True)

# Lowercasing reviews

df['reviewText'] = df['reviewText'].str.lower()

return df

def prepare_input_data(df):

"""Encoding and getting reviews in byte size.

Review gets encoded to utf-8 format and getting the size of the reviews in bytes.

Comprehend requires each review input to be no more than 5000 Bytes

"""

df['review_size'] = df['reviewText'].apply(lambda x:len(x.encode('utf-8')))

df = df[(df['review_size'] > 0) & (df['review_size'] < 5000)]

df = df.drop(columns=['review_size'])

return df

# Only data points with a verified review will be selected and the review must not be missing

filter = (original_df['verified'] == True) & (~original_df['reviewText'].isna())

filtered_df = original_df[filter]

# Only a subset of fields are selected in this experiment.

filtered_df = filtered_df[['asin', 'reviewText', 'summary', 'unixReviewTime', 'overall', 'reviewerID']]

# Just in case, once again, dropping data points with missing review text

filtered_df = filtered_df.dropna(subset=['reviewText'])

print('Shape of review data: ', filtered_df.shape)

# Dropping duplicate items from metadata

original_meta = original_meta.drop_duplicates(subset=['asin'])

# Only a subset of fields are selected in this experiment.

original_meta = original_meta[['asin', 'category', 'title', 'description', 'brand', 'main_cat']]

# Clean reviews using text cleaning pipeline

df = clean_text(filtered_df)

# Dataframe where Comprehend outputs (topics and sentiments) will be added

df = prepare_input_data(df)फिर हम डेटा को Amazon S3 में सहेजते हैं और नोटबुक इंस्टेंस में एक स्थानीय प्रति भी रखते हैं।

# Saving dataframe on S3 df.to_csv(S3_FEEDBACK_TOPICS, index=False)

# Reviews are transformed per Comprehend guideline- one review per line

# The txt file will be used as input for Comprehend

# We first save the input file locally

with open(LOCAL_TRANSFORMED_REVIEW, "w") as outfile:

outfile.write("n".join(df['reviewText'].tolist()))

# Transferring the transformed review (input to Comprehend) to S3

!aws s3 mv {LOCAL_TRANSFORMED_REVIEW} {S3_OUT}

यह हमारे डेटा प्रोसेसिंग चरण को पूरा करता है।

अमेज़ॅन कॉम्प्रिहेंड टॉपिक मॉडलिंग जॉब चलाएं

फिर हम अगले चरण में जाते हैं, जहां हम अमेज़ॅन कॉम्प्रिहेंड का उपयोग करके विषय मॉडलिंग कार्य चलाने के लिए प्रीप्रोसेस्ड डेटा का उपयोग करते हैं। इस स्तर पर, आप या तो दूसरी नोटबुक का उपयोग कर सकते हैं (model_training.ipynb) या विषय मॉडलिंग कार्य को चलाने के लिए Amazon Comprehend कंसोल का उपयोग करें। कंसोल का उपयोग करने के निर्देशों के लिए, देखें कंसोल का उपयोग करके विश्लेषण कार्य चलाना. यदि आप नोटबुक का उपयोग कर रहे हैं, तो आप Boto3 का उपयोग करके Amazon Comprehend क्लाइंट बनाकर शुरू कर सकते हैं, जैसा कि निम्नलिखित उदाहरण में दिखाया गया है।

# Client and session information

session = boto3.Session()

s3 = boto3.resource('s3')

# Account id. Required downstream.

account_id = boto3.client('sts').get_caller_identity().get('Account')

# Initializing Comprehend client

comprehend = boto3.client(service_name='comprehend',

region_name=session.region_name)आप विषय मॉडलिंग के लिए अपने दस्तावेज़ दो तरह से जमा कर सकते हैं: प्रति फ़ाइल एक दस्तावेज़, या प्रति पंक्ति एक दस्तावेज़।

हम 5 विषयों (के-नंबर) से शुरू करते हैं, और प्रति पंक्ति एक दस्तावेज़ का उपयोग करते हैं। मानक अभ्यास के रूप में k या विषयों की संख्या का चयन करने का कोई एक सर्वोत्तम तरीका नहीं है। आप k के विभिन्न मानों को आज़मा सकते हैं और सबसे अधिक संभावना वाले मान का चयन कर सकते हैं।

# Number of topics set to 5 after having a human-in-the-loop

# This needs to be fully aligned with topicMaps dictionary in the third script

NUMBER_OF_TOPICS = 5

# Input file format of one review per line

input_doc_format = "ONE_DOC_PER_LINE"

# Role arn (Hard coded, masked)

data_access_role_arn = "arn:aws:iam::XXXXXXXXXXXX:role/service-role/AmazonSageMaker-ExecutionRole-XXXXXXXXXXXXXXX"हमारे अमेज़ॅन कॉम्प्रिहेंड टॉपिक मॉडलिंग जॉब के लिए आपको एक पास करना होगा InputDataConfig S3 के साथ शब्दकोश वस्तु, InputFormat, तथा DocumentReadAction आवश्यक मापदंडों के रूप में। इसी तरह, आपको प्रदान करने की आवश्यकता है OutputDataConfig S3 और के साथ वस्तु DataAccessRoleArn आवश्यक मापदंडों के रूप में। अधिक जानकारी के लिए, Boto3 दस्तावेज़ीकरण देखें start_topics_detection_job.

# Constants for S3 bucket and input data file

BUCKET = 'clothing-shoe-jewel-tm-blog'

input_s3_url = 's3://' + BUCKET + '/out/' + 'TransformedReviews.txt'

output_s3_url = 's3://' + BUCKET + '/out/' + 'output/'

# Final dataframe where we will join Comprehend outputs later

S3_FEEDBACK_TOPICS = 's3://' + BUCKET + '/out/' + 'FinalDataframe.csv'

# Local copy of Comprehend output

LOCAL_COMPREHEND_OUTPUT_DIR = os.path.join('comprehend_out', '')

LOCAL_COMPREHEND_OUTPUT_FILE = os.path.join(LOCAL_COMPREHEND_OUTPUT_DIR, 'output.tar.gz')

INPUT_CONFIG={

# The S3 URI where Comprehend input is placed.

'S3Uri': input_s3_url,

# Document format

'InputFormat': input_doc_format,

}

OUTPUT_CONFIG={

# The S3 URI where Comprehend output is placed.

'S3Uri': output_s3_url,

}फिर आप विषयों की संख्या, इनपुट कॉन्फ़िगरेशन ऑब्जेक्ट, आउटपुट कॉन्फ़िगरेशन ऑब्जेक्ट और एक IAM भूमिका पास करके एक अतुल्यकालिक विषय पहचान कार्य शुरू कर सकते हैं, जैसा कि निम्नलिखित उदाहरण में दिखाया गया है।

# Reading the Comprehend input file just to double check if number of reviews

# and the number of lines in the input file have an exact match.

obj = s3.Object(input_s3_url)

comprehend_input = obj.get()['Body'].read().decode('utf-8')

comprehend_input_lines = len(comprehend_input.split('n'))

# Reviews where Comprehend outputs will be merged

df = pd.read_csv(S3_FEEDBACK_TOPICS)

review_df_length = df.shape[0]

# The two lengths must be equal

assert comprehend_input_lines == review_df_length

# Start Comprehend topic modelling job.

# Specifies the number of topics, input and output config and IAM role ARN

# that grants Amazon Comprehend read access to data.

start_topics_detection_job_result = comprehend.start_topics_detection_job(

NumberOfTopics=NUMBER_OF_TOPICS,

InputDataConfig=INPUT_CONFIG,

OutputDataConfig=OUTPUT_CONFIG,

DataAccessRoleArn=data_access_role_arn)

print('start_topics_detection_job_result: ' + json.dumps(start_topics_detection_job_result))

# Job ID is required downstream for extracting the Comprehend results

job_id = start_topics_detection_job_result["JobId"]

print('job_id: ', job_id)आप कॉल करके नौकरी की वर्तमान स्थिति को ट्रैक कर सकते हैं DescribeTopicDetectionJob संचालन। नौकरी की स्थिति निम्न में से एक हो सकती है:

- प्रस्तुत - कार्य प्राप्त हो गया है और प्रसंस्करण के लिए कतारबद्ध है

- IN_PROGRESS - Amazon Comprehend कार्य को संसाधित कर रहा है

- पूर्ण - कार्य सफलतापूर्वक पूरा हुआ और आउटपुट उपलब्ध है

- विफल - कार्य पूरा नहीं हुआ

# Topic detection takes a while to complete.

# We can track the current status by calling Use the DescribeTopicDetectionJob operation.

# Keeping track if Comprehend has finished its job

description = comprehend.describe_topics_detection_job(JobId=job_id)

topic_detection_job_status = description['TopicsDetectionJobProperties']["JobStatus"]

print(topic_detection_job_status)

while topic_detection_job_status not in ["COMPLETED", "FAILED"]:

time.sleep(120)

topic_detection_job_status = comprehend.describe_topics_detection_job(JobId=job_id)['TopicsDetectionJobProperties']["JobStatus"]

print(topic_detection_job_status)

topic_detection_job_status = comprehend.describe_topics_detection_job(JobId=job_id)['TopicsDetectionJobProperties']["JobStatus"]

print(topic_detection_job_status)जब कार्य सफलतापूर्वक पूरा हो जाता है, तो यह दो फ़ाइलों वाला एक संपीड़ित संग्रह लौटाता है: topic-terms.csv और doc-topics.csv। पहली आउटपुट फ़ाइल, topic-terms.csv, संग्रह में विषयों की एक सूची है। प्रत्येक विषय के लिए, सूची में, डिफ़ॉल्ट रूप से, विषय के अनुसार शीर्ष पद उनके वजन के अनुसार शामिल होते हैं। दूसरी फाइल, doc-topics.csv, किसी विषय से जुड़े दस्तावेज़ों और विषय से संबंधित दस्तावेज़ के अनुपात को सूचीबद्ध करता है। क्योंकि हमने निर्दिष्ट किया है ONE_DOC_PER_LINE पहले में input_doc_format चर, दस्तावेज़ को फ़ाइल नाम और फ़ाइल के भीतर 0-अनुक्रमित लाइन नंबर द्वारा पहचाना जाता है। विषय मॉडलिंग के बारे में अधिक जानकारी के लिए देखें टॉपिक मॉडलिंग.

Amazon Comprehend के आउटपुट को हमारे अगले चरणों के लिए स्थानीय रूप से कॉपी किया जाता है।

# Bucket prefix where model artifacts are stored

prefix = f'{account_id}-TOPICS-{job_id}'

# Model artifact zipped file

artifact_file = 'output.tar.gz'

# Location on S3 where model artifacts are stored

target = f's3://{BUCKET}/out/output/{prefix}/{artifact_file}'

# Copy Comprehend output from S3 to local notebook instance

! aws s3 cp {target} ./comprehend-out/

# Unzip the Comprehend output file.

# Two files are now saved locally-

# (1) comprehend-out/doc-topics.csv and

# (2) comprehend-out/topic-terms.csv

comprehend_tars = tarfile.open(LOCAL_COMPREHEND_OUTPUT_FILE)

comprehend_tars.extractall(LOCAL_COMPREHEND_OUTPUT_DIR)

comprehend_tars.close()क्योंकि विषयों की संख्या दस्तावेज़ संग्रह से जुड़ी शब्दावली की तुलना में बहुत कम है, विषय स्थान प्रतिनिधित्व को एक आयामीता में कमी प्रक्रिया के रूप में भी देखा जा सकता है। क्लस्टरिंग करने के लिए आप इस विषय का उपयोग दस्तावेज़ों के स्थान प्रतिनिधित्व का कर सकते हैं। दूसरी ओर, आप प्रत्येक क्लस्टर से जुड़े विषय को निर्धारित करने के लिए प्रत्येक क्लस्टर में शब्दों की आवृत्ति का विश्लेषण कर सकते हैं। इस पोस्ट के लिए, हम क्लस्टरिंग जैसी कोई अन्य तकनीक नहीं करते हैं।

हम तीसरी नोटबुक का उपयोग करते हैं (topic_mapping_sentiment_generation.ipynb) यह पता लगाने के लिए कि विभिन्न जनसांख्यिकी के उपयोगकर्ता उत्पादों पर कैसे प्रतिक्रिया दे रहे हैं, और किसी विशेष उत्पाद के प्रति उपयोगकर्ता आत्मीयता पर एकत्रित जानकारी का विश्लेषण भी करते हैं।

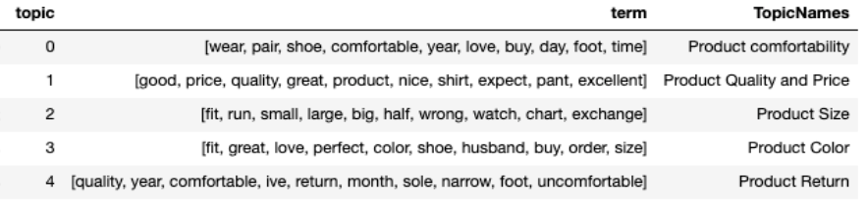

हम प्रत्येक विषय के लिए विषय और संबंधित शब्द प्राप्त करने के लिए पिछली नोटबुक के आउटपुट को जोड़ सकते हैं। हालाँकि, विषय गिने-चुने हैं और उनमें व्याख्यात्मकता का अभाव हो सकता है। इसलिए, हम पर्याप्त डोमेन ज्ञान और विषय वस्तु विशेषज्ञता के साथ मानव-इन-लूप का उपयोग करना पसंद करते हैं ताकि विषयों को उनकी संबंधित शर्तों को देखकर नाम दिया जा सके। इस प्रक्रिया को विषय संख्या से विषय के नामों के मानचित्रण के रूप में माना जा सकता है। हालांकि, यह उल्लेखनीय है कि विषयों के लिए शब्दों की अलग-अलग सूची परस्पर समावेशी हो सकती है और इसलिए कई मैपिंग बना सकती है। मानव-में-लूप को उपयोग के मामले के संदर्भ के आधार पर मैपिंग को औपचारिक रूप देना चाहिए। अन्यथा, डाउनस्ट्रीम प्रदर्शन प्रभावित हो सकता है।

हम चर घोषित करके शुरू करते हैं। प्रत्येक समीक्षा के लिए, कई विषय हो सकते हैं। हम उनकी बारंबारता की गणना करते हैं और अधिकतम तीन सबसे अधिक बार आने वाले विषयों का चयन करते हैं। इन विषयों को समीक्षा के प्रतिनिधि विषयों के रूप में रिपोर्ट किया जाता है। सबसे पहले, हम एक चर परिभाषित करते हैं TOP_TOPICS प्रतिनिधि विषयों की अधिकतम संख्या रखने के लिए। दूसरा, हम मूल्यों को परिभाषित और सेट करते हैं language_code अमेज़ॅन कॉम्प्रिहेंड के आवश्यक भाषा पैरामीटर का समर्थन करने के लिए चर। अंत में, हम बनाते हैं topicMaps, जो एक ऐसा शब्दकोश है जो विषय संख्याओं को विषय नामों से मैप करता है।

# boto3 session to access service

session = boto3.Session()

comprehend = boto3.client( 'comprehend',

region_name=session.region_name)

# S3 bucket

BUCKET = 'clothing-shoe-jewel-tm-blog'

# Local copy of doc-topic file

DOC_TOPIC_FILE = os.path.join('comprehend-out', 'doc-topics.csv')

# Final dataframe where we will join Comprehend outputs later

S3_FEEDBACK_TOPICS = 's3://' + BUCKET + '/out/' + 'FinalDataframe.csv'

# Final output

S3_FINAL_OUTPUT = 's3://' + BUCKET + '/out/' + 'reviewTopicsSentiments.csv'

# Top 3 topics per product will be aggregated

TOP_TOPICS = 3

# Working on English language only.

language_code = 'en'

# Topic names for 5 topics created by human-in-the-loop or SME feed

topicMaps = {

0: 'Product comfortability',

1: 'Product Quality and Price',

2: 'Product Size',

3: 'Product Color',

4: 'Product Return',

}

इसके बाद, हम प्रत्येक विषय से जुड़े अद्वितीय शब्दों को जोड़ने के लिए Amazon Comprehend द्वारा उत्पन्न topic-terms.csv फ़ाइल का उपयोग करते हैं। फिर, इस टॉपिक-टर्म एसोसिएशन पर मैपिंग डिक्शनरी को लागू करके, हम यूनिक टर्म्स को टॉपिक के नामों से जोड़ते हैं।

# Loading documents and topics assigned to each of them by Comprehend

docTopics = pd.read_csv(DOC_TOPIC_FILE)

docTopics.head()

# Creating a field with doc number.

# This doc number is the line number of the input file to Comprehend.

docTopics['doc'] = docTopics['docname'].str.split(':').str[1]

docTopics['doc'] = docTopics['doc'].astype(int)

docTopics.head()

# Load topics and associated terms

topicTerms = pd.read_csv(DOC_TOPIC_FILE)

# Consolidate terms for each topic

aggregatedTerms = topicTerms.groupby('topic')['term'].aggregate(lambda term: term.unique().tolist()).reset_index()

# Sneak peek

aggregatedTerms.head(10)यह मैपिंग अमेज़ॅन कॉम्प्रिहेंड द्वारा उत्पन्न विषयों की पठनीयता और व्याख्यात्मकता में सुधार करती है, जैसा कि हम निम्नलिखित डेटाफ़्रेम में देख सकते हैं।

इसके अलावा, हम प्रारंभिक इनपुट डेटा में विषय संख्या, शब्द और नाम जोड़ते हैं, जैसा कि निम्नलिखित चरणों में दिखाया गया है।

यह प्रत्येक समीक्षा के अनुरूप विषय के नियम और नाम देता है। विषय संख्या और शर्तें प्रत्येक समीक्षा के साथ जुड़ जाती हैं और फिर मूल डेटाफ़्रेम में वापस जुड़ जाती हैं जिसे हमने पहली नोटबुक में सहेजा था।

# Load final dataframe where Comprehend results will be merged to

feedbackTopics = pd.read_csv(S3_FEEDBACK_TOPICS)

# Joining topic numbers to main data

# The index of feedbackTopics is referring to doc field of docTopics dataframe

feedbackTopics = pd.merge(feedbackTopics,

docTopics,

left_index=True,

right_on='doc',

how='left')

# Reviews will now have topic numbers, associated terms and topics names

feedbackTopics = feedbackTopics.merge(aggregatedTerms,

on='topic',

how='left')

feedbackTopics.head()हम समीक्षा पाठ के लिए भावना उत्पन्न करते हैं detect_sentiment. यह पाठ का निरीक्षण करता है और प्रचलित भावना (सकारात्मक, तटस्थ, मिश्रित, या नकारात्मक) का अनुमान देता है।

def detect_sentiment(text, language_code):

"""Detects sentiment for a given text and language

"""

comprehend_json_out = comprehend.detect_sentiment(Text=text, LanguageCode=language_code)

return comprehend_json_out

# Comprehend output for sentiment in raw json

feedbackTopics['comprehend_sentiment_json_out'] = feedbackTopics['reviewText'].apply(lambda x: detect_sentiment(x, language_code))

# Extracting the exact sentiment from raw Comprehend Json

feedbackTopics['sentiment'] = feedbackTopics['comprehend_sentiment_json_out'].apply(lambda x: x['Sentiment'])

# Sneak peek

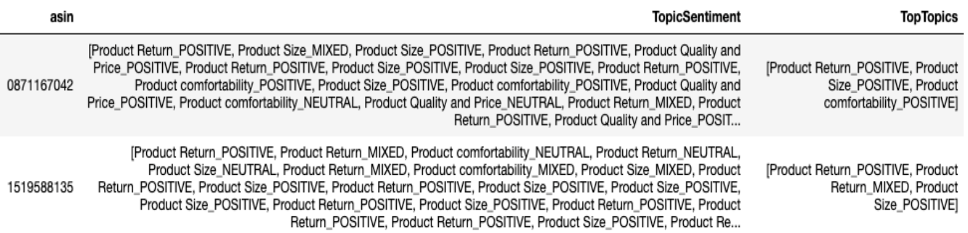

feedbackTopics.head(2)दोनों विषयों और भावनाओं को समीक्षाओं के साथ कसकर जोड़ा जाता है। चूंकि हम उत्पाद स्तर पर विषयों और भावनाओं को एकत्रित करेंगे, इसलिए हमें अमेज़ॅन कॉम्प्रिहेंड द्वारा उत्पन्न विषयों और भावनाओं को मिलाकर एक समग्र कुंजी बनाने की आवश्यकता है।

# Creating a composite key of topic name and sentiment.

# This is because we are counting frequency of this combination.

feedbackTopics['TopicSentiment'] = feedbackTopics['TopicNames'] + '_' + feedbackTopics['sentiment']बाद में, हम उत्पाद स्तर पर एकत्र होते हैं और प्रत्येक उत्पाद के लिए समग्र कुंजियों की गणना करते हैं।

यह अंतिम चरण हमें प्रति उत्पाद समीक्षाओं की बारीकियों को बेहतर ढंग से समझने में मदद करता है और इसे प्रति विषय समग्र रूप से वर्गीकृत करता है। उदाहरण के लिए, हम topicDF DataFrame के लिए दिखाए गए मानों पर विचार कर सकते हैं। पहले उत्पाद के लिए, इसके लिए सभी समीक्षाओं में से, कुल मिलाकर ग्राहकों को उत्पाद वापसी, आकार और आराम पर सकारात्मक अनुभव था। दूसरे उत्पाद के लिए, ग्राहकों को उत्पाद वापसी पर मिश्रित-से-सकारात्मक अनुभव और उत्पाद के आकार पर सकारात्मक अनुभव था।

# Create product id group

asinWiseDF = feedbackTopics.groupby('asin')

# Each product now has a list of topics and sentiment combo (topics can appear multiple times)

topicDF = asinWiseDF['TopicSentiment'].apply(lambda x:list(x)).reset_index()

# Count appreances of topics-sentiment combo for product

topicDF['TopTopics'] = topicDF['TopicSentiment'].apply(Counter)

# Sorting topics-sentiment combo based on their appearance

topicDF['TopTopics'] = topicDF['TopTopics'].apply(lambda x: sorted(x, key=x.get, reverse=True))

# Select Top k topics-sentiment combo for each product/review

topicDF['TopTopics'] = topicDF['TopTopics'].apply(lambda x: x[:TOP_TOPICS])

# Sneak peek

topicDF.head()

हमारे अंतिम डेटाफ़्रेम में इस विषय की जानकारी और भावना की जानकारी शामिल है, जिसे अंतिम डेटाफ़्रेम नाम दिया गया है feedbackTopics जिसे हमने अपनी पहली नोटबुक में Amazon S3 पर सेव किया था।

# Adding the topic-sentiment combo back to product metadata

finalDF = S3_FEEDBACK_TOPICS.merge(topicDF, on='asin', how='left')

# Only selecting a subset of fields

finalDF = finalDF[['asin', 'TopTopics', 'category', 'title']]

# Saving the final output locally

finalDF.to_csv(S3_FINAL_OUTPUT, index=False)डेटा की कल्पना करने के लिए Amazon QuickSight का उपयोग करें

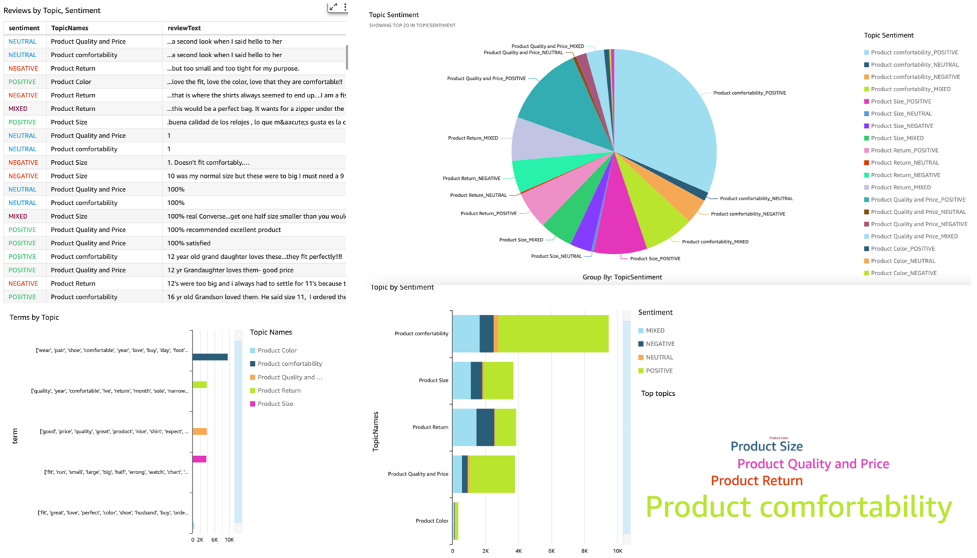

आप डेटा की कल्पना करने और रिपोर्ट तैयार करने के लिए QuickSight का उपयोग कर सकते हैं। क्विकसाइट एक बिजनेस इंटेलिजेंस (बीआई) सेवा है जिसका उपयोग आप कई अलग-अलग स्रोतों से डेटा का उपभोग करने और बुद्धिमान डैशबोर्ड बनाने के लिए कर सकते हैं। इस उदाहरण में, हम अपने द्वारा उत्पादित अंतिम डेटासेट का उपयोग करके एक क्विकसाइट विश्लेषण उत्पन्न करते हैं, जैसा कि निम्नलिखित उदाहरण विज़ुअलाइज़ेशन में दिखाया गया है।

Amazon QuickSight के बारे में अधिक जानने के लिए, देखें Amazon Quicksight के साथ शुरुआत करना.

साफ - सफाई

अंत में, हमें AWS कंसोल से इस प्रयोग में उपयोग किए गए नोटबुक इंस्टेंस को बंद करने की आवश्यकता है।

निष्कर्ष

इस पोस्ट में, हमने उत्पाद समीक्षाओं का विश्लेषण करने और एक तकनीक के रूप में विषय मॉडलिंग का उपयोग करके शीर्ष विषयों को खोजने के लिए अमेज़ॅन कॉम्प्रिहेंड का उपयोग करने का तरीका दिखाया। विषय मॉडलिंग आपको कई विषयों को देखने और उन्हें बड़े पैमाने पर व्यवस्थित करने, समझने और सारांशित करने में सक्षम बनाता है। आप पूरे डेटा में मौजूद छिपे हुए पैटर्न को जल्दी और आसानी से खोज सकते हैं, और फिर उस अंतर्दृष्टि का उपयोग डेटा-संचालित निर्णय लेने के लिए कर सकते हैं। आप कई व्यावसायिक समस्याओं को हल करने के लिए विषय मॉडलिंग का उपयोग कर सकते हैं, जैसे कि ग्राहक सहायता टिकटों को स्वचालित रूप से टैग करना, विषय के आधार पर सही टीमों के लिए बातचीत को रूट करना, समर्थन टिकटों की तात्कालिकता का पता लगाना, बातचीत से बेहतर अंतर्दृष्टि प्राप्त करना, डेटा-संचालित योजना बनाना, समस्या पैदा करना -केंद्रित सामग्री, बिक्री रणनीति में सुधार, और ग्राहक मुद्दों और घर्षणों की पहचान करना।

ये केवल कुछ उदाहरण हैं, लेकिन आप कई और व्यावसायिक समस्याओं के बारे में सोच सकते हैं जिनका आप अपने संगठन में दैनिक आधार पर सामना करते हैं, और आप उन्हें हल करने के लिए अन्य एमएल तकनीकों के साथ विषय मॉडलिंग का उपयोग कैसे कर सकते हैं।

लेखक के बारे में

गुरप्रीत कनाडा से बाहर स्थित AWS व्यावसायिक सेवाओं के साथ एक डेटा वैज्ञानिक हैं। वह ग्राहकों को मशीन लर्निंग और आर्टिफिशियल इंटेलिजेंस तकनीकों के साथ व्यापार मूल्य और डेटा से अंतर्दृष्टि प्राप्त करने में मदद करने के बारे में भावुक है। अपने खाली समय में, वह बाहर लंबी पैदल यात्रा और किताबें पढ़ने का आनंद लेती हैं

गुरप्रीत कनाडा से बाहर स्थित AWS व्यावसायिक सेवाओं के साथ एक डेटा वैज्ञानिक हैं। वह ग्राहकों को मशीन लर्निंग और आर्टिफिशियल इंटेलिजेंस तकनीकों के साथ व्यापार मूल्य और डेटा से अंतर्दृष्टि प्राप्त करने में मदद करने के बारे में भावुक है। अपने खाली समय में, वह बाहर लंबी पैदल यात्रा और किताबें पढ़ने का आनंद लेती हैं

रुश्दी शम्स एडब्ल्यूएस प्रोफेशनल सर्विसेज, कनाडा में डेटा साइंटिस्ट हैं। वह AWS ग्राहकों के लिए मशीन लर्निंग उत्पाद बनाता है। उन्हें साइंस फिक्शन पढ़ना और लिखना पसंद है।

रुश्दी शम्स एडब्ल्यूएस प्रोफेशनल सर्विसेज, कनाडा में डेटा साइंटिस्ट हैं। वह AWS ग्राहकों के लिए मशीन लर्निंग उत्पाद बनाता है। उन्हें साइंस फिक्शन पढ़ना और लिखना पसंद है।

Wrick तालुकदार अमेज़ॅन कॉम्प्रिहेंड सर्विस टीम के साथ एक वरिष्ठ वास्तुकार हैं। वह बड़े पैमाने पर मशीन लर्निंग को अपनाने में मदद करने के लिए AWS ग्राहकों के साथ काम करता है। काम के अलावा, उन्हें पढ़ना और फोटोग्राफी करना पसंद है।

Wrick तालुकदार अमेज़ॅन कॉम्प्रिहेंड सर्विस टीम के साथ एक वरिष्ठ वास्तुकार हैं। वह बड़े पैमाने पर मशीन लर्निंग को अपनाने में मदद करने के लिए AWS ग्राहकों के साथ काम करता है। काम के अलावा, उन्हें पढ़ना और फोटोग्राफी करना पसंद है।

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- ऐ / एमएल

- Amazon Comprehend

- अमेज़न क्विकसाइट

- अमेज़न SageMaker

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- यंत्र अधिगम

- प्राकृतिक भाषा संसाधन

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट