यह समझना कि मस्तिष्क कैसे स्थानिक जानकारी को व्यवस्थित और एक्सेस करता है - हम कहां हैं, कोने के आसपास क्या है, वहां कैसे पहुंचा जाए - एक उत्कृष्ट चुनौती बनी हुई है। इस प्रक्रिया में यादों के पूरे नेटवर्क को याद करना और दसियों अरबों न्यूरॉन्स से संग्रहीत स्थानिक डेटा शामिल है, जिनमें से प्रत्येक हजारों अन्य से जुड़ा हुआ है। न्यूरोसाइंटिस्ट्स ने प्रमुख तत्वों की पहचान की है जैसे ग्रिड सेल, न्यूरॉन्स जो स्थानों को मैप करते हैं। लेकिन गहराई तक जाना मुश्किल साबित होगा: ऐसा नहीं है कि शोधकर्ता मानव ग्रे पदार्थ के स्लाइस को हटा सकते हैं और अध्ययन कर सकते हैं कि छवियों, ध्वनियों और गंधों की स्थान-आधारित यादें कैसे प्रवाहित होती हैं और एक-दूसरे से जुड़ती हैं।

आर्टिफिशियल इंटेलिजेंस एक और रास्ता प्रदान करता है। वर्षों से, न्यूरोसाइंटिस्ट्स ने कई प्रकार के तंत्रिका नेटवर्क का उपयोग किया है - वे इंजन जो सबसे गहन शिक्षण अनुप्रयोगों को शक्ति देते हैं - मस्तिष्क में न्यूरॉन्स की फायरिंग को मॉडल करने के लिए। हाल के काम में, शोधकर्ताओं ने दिखाया है कि हिप्पोकैम्पस, स्मृति के लिए महत्वपूर्ण मस्तिष्क की संरचना, मूल रूप से एक विशेष प्रकार का तंत्रिका जाल है, जिसे एक के रूप में जाना जाता है ट्रांसफार्मर, भेष में। उनका नया मॉडल स्थानिक जानकारी को इस तरह से ट्रैक करता है जो मस्तिष्क के आंतरिक कामकाज के समानांतर हो। उन्होंने उल्लेखनीय सफलता देखी है।

"तथ्य यह है कि हम जानते हैं कि मस्तिष्क के ये मॉडल ट्रांसफार्मर के बराबर हैं, इसका मतलब है कि हमारे मॉडल बहुत बेहतर प्रदर्शन करते हैं और प्रशिक्षित करना आसान होता है," ने कहा जेम्स व्हिटिंगटन, एक संज्ञानात्मक तंत्रिका विज्ञानी जो स्टैनफोर्ड विश्वविद्यालय और की प्रयोगशाला के बीच अपना समय बांटता है टिम बेहरेंस ऑक्सफोर्ड विश्वविद्यालय में।

व्हिटिंगटन और अन्य लोगों के अध्ययन से संकेत मिलता है कि ट्रांसफार्मर तंत्रिका नेटवर्क मॉडल की क्षमता में सुधार कर सकते हैं ताकि ग्रिड कोशिकाओं और मस्तिष्क के अन्य भागों द्वारा किए गए संगणनाओं की नकल की जा सके। व्हिटिंगटन ने कहा कि ऐसे मॉडल हमारी समझ को आगे बढ़ा सकते हैं कि कृत्रिम तंत्रिका नेटवर्क कैसे काम करते हैं और इससे भी अधिक संभावना है कि मस्तिष्क में गणना कैसे की जाती है।

"हम मस्तिष्क को फिर से बनाने की कोशिश नहीं कर रहे हैं," कहा डेविड हा, Google ब्रेन में एक कंप्यूटर वैज्ञानिक जो ट्रांसफॉर्मर मॉडल पर भी काम करता है। "लेकिन क्या हम एक ऐसा तंत्र बना सकते हैं जो वह कर सके जो मस्तिष्क करता है?"

भाषा को संसाधित करने के लिए एआई के लिए एक नए तरीके के रूप में ट्रांसफॉर्मर पहली बार पांच साल पहले दिखाई दिए थे। वे उन शीर्षक-हथियाने वाले वाक्य-पूर्ण कार्यक्रमों में गुप्त सॉस हैं जैसे बर्ट और GPT-3, जो ठोस गीत के बोल उत्पन्न कर सकते हैं, शेक्सपियर के सॉनेट्स की रचना कर सकते हैं और ग्राहक सेवा प्रतिनिधियों का प्रतिरूपण कर सकते हैं।

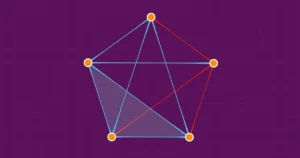

ट्रांसफॉर्मर आत्म-ध्यान नामक एक तंत्र का उपयोग करके काम करते हैं, जिसमें प्रत्येक इनपुट - एक शब्द, एक पिक्सेल, एक क्रम में एक संख्या - हमेशा हर दूसरे इनपुट से जुड़ा होता है। (अन्य तंत्रिका नेटवर्क इनपुट को केवल कुछ अन्य इनपुट से जोड़ते हैं।) लेकिन जब ट्रांसफॉर्मर को भाषा कार्यों के लिए डिज़ाइन किया गया था, तब से उन्होंने अन्य कार्यों जैसे कि छवियों को वर्गीकृत करने में उत्कृष्ट प्रदर्शन किया है - और अब, मस्तिष्क को मॉडलिंग करना।

2020 में, के नेतृत्व में एक समूह सेप होचराइटर, ऑस्ट्रिया में जोहान्स केपलर यूनिवर्सिटी लिंज़ के एक कंप्यूटर वैज्ञानिक ने होपफ़ील्ड नेटवर्क नामक मेमोरी रिट्रीवल के एक शक्तिशाली, लंबे समय तक चलने वाले मॉडल को फिर से तैयार करने के लिए एक ट्रांसफॉर्मर का उपयोग किया। पहली बार 40 साल पहले प्रिंसटन भौतिक विज्ञानी जॉन हॉपफील्ड द्वारा पेश किया गया था, ये नेटवर्क एक सामान्य नियम का पालन करते हैं: एक ही समय में सक्रिय न्यूरॉन्स एक दूसरे के साथ मजबूत संबंध बनाते हैं।

होचरेइटर और उनके सहयोगियों ने, यह देखते हुए कि शोधकर्ता स्मृति पुनर्प्राप्ति के बेहतर मॉडल की तलाश कर रहे हैं, ने देखा कि कैसे होपफील्ड नेटवर्क यादों को पुनः प्राप्त करते हैं और ट्रांसफार्मर कैसे ध्यान देते हैं। उन्होंने हॉपफील्ड नेटवर्क को अपग्रेड किया, अनिवार्य रूप से इसे एक ट्रांसफॉर्मर में बदल दिया। व्हिटिंगटन ने कहा कि उस बदलाव ने मॉडल को अधिक प्रभावी कनेक्शन के कारण अधिक यादों को संग्रहीत करने और पुनर्प्राप्त करने की इजाजत दी। हॉपफील्ड ने स्वयं एमआईटी-आईबीएम वाटसन एआई लैब में दिमित्री क्रोटोव के साथ मिलकर साबित किया कि ट्रांसफॉर्मर आधारित हॉपफील्ड नेटवर्क जैविक रूप से प्रशंसनीय था।

फिर, इस साल के शुरू, व्हिटिंगटन और बेहरेंस ने ट्रांसफॉर्मर को संशोधित करते हुए होच्रेइटर के दृष्टिकोण को और अधिक बदलने में मदद की ताकि यादों को एक रेखीय अनुक्रम के रूप में मानने के बजाय - एक वाक्य में शब्दों की एक स्ट्रिंग की तरह - यह उन्हें उच्च-आयामी रिक्त स्थान में निर्देशांक के रूप में एन्कोड करता है। शोधकर्ताओं ने इसे "ट्विस्ट" कहा, जिससे तंत्रिका विज्ञान कार्यों पर मॉडल के प्रदर्शन में और सुधार हुआ। उन्होंने यह भी दिखाया कि मॉडल गणितीय रूप से ग्रिड सेल फायरिंग पैटर्न के मॉडल के बराबर था जिसे न्यूरोसाइंटिस्ट एफएमआरआई स्कैन में देखते हैं।

यूनिवर्सिटी कॉलेज लंदन के एक न्यूरोसाइंटिस्ट कैसवेल बैरी ने कहा, "ग्रिड कोशिकाओं में इस तरह की रोमांचक, सुंदर, नियमित संरचना होती है, और हड़ताली पैटर्न के साथ यादृच्छिक रूप से पॉप अप करने की संभावना नहीं होती है।" नए काम ने दिखाया कि कैसे ट्रांसफॉर्मर हिप्पोकैम्पस में देखे गए पैटर्न को ठीक से दोहराते हैं। "उन्होंने माना कि एक ट्रांसफार्मर यह पता लगा सकता है कि यह पिछले राज्यों पर आधारित है और इसे कैसे स्थानांतरित किया गया है, और इस तरह से ग्रिड कोशिकाओं के पारंपरिक मॉडल में बंद है।"

अन्य हालिया काम से पता चलता है कि ट्रांसफॉर्मर अन्य मस्तिष्क कार्यों के बारे में भी हमारी समझ को आगे बढ़ा सकते हैं। पिछले साल, मैसाचुसेट्स इंस्टीट्यूट ऑफ टेक्नोलॉजी में एक कम्प्यूटेशनल न्यूरोसाइंटिस्ट मार्टिन श्रिम्पफ ने, 43 विभिन्न तंत्रिका नेट मॉडल का विश्लेषण किया यह देखने के लिए कि उन्होंने fMRI और इलेक्ट्रोकॉर्टिकोग्राफी द्वारा रिपोर्ट की गई मानव तंत्रिका गतिविधि के मापन की कितनी अच्छी भविष्यवाणी की है। ट्रांसफॉर्मर, उन्होंने पाया, वर्तमान अग्रणी, अत्याधुनिक तंत्रिका नेटवर्क हैं, जो इमेजिंग में पाए जाने वाले लगभग सभी भिन्नताओं की भविष्यवाणी करते हैं।

और हा, साथी कंप्यूटर वैज्ञानिक के साथ युजिन टैंगो, हाल ही में एक मॉडल तैयार किया गया है जो जानबूझकर एक ट्रांसफॉर्मर के माध्यम से बड़ी मात्रा में डेटा को यादृच्छिक, अनियंत्रित तरीके से भेज सकता है, यह नकल करते हुए कि मानव शरीर मस्तिष्क को संवेदी अवलोकन कैसे प्रसारित करता है। उनका ट्रांसफॉर्मर, हमारे दिमाग की तरह, सूचना के अव्यवस्थित प्रवाह को सफलतापूर्वक संभाल सकता है।

"तंत्रिका जाल एक विशेष इनपुट को स्वीकार करने के लिए कड़ी मेहनत कर रहे हैं," टैंग ने कहा। लेकिन वास्तविक जीवन में, डेटा सेट अक्सर तेज़ी से बदलते हैं, और अधिकांश AI के पास समायोजित करने का कोई तरीका नहीं होता है। "हम एक ऐसी वास्तुकला के साथ प्रयोग करना चाहते थे जो बहुत जल्दी अनुकूलित हो सके।"

प्रगति के इन संकेतों के बावजूद, बेहरेंस ट्रांसफॉर्मर को मस्तिष्क के एक सटीक मॉडल की ओर एक कदम के रूप में देखता है - खोज का अंत नहीं। "मुझे यहाँ एक संशयवादी न्यूरोसाइंटिस्ट बनना है," उन्होंने कहा। "मुझे नहीं लगता कि ट्रांसफॉर्मर समाप्त हो जाएगा जैसा कि हम मस्तिष्क में भाषा के बारे में सोचते हैं, उदाहरण के लिए, भले ही उनके पास वाक्यों का सबसे अच्छा वर्तमान मॉडल हो।"

"क्या यह भविष्यवाणी करने का सबसे कुशल आधार है कि मैं कहाँ हूँ और मैं आगे क्या देखूँगा? अगर मैं ईमानदार हूं, तो यह बताना जल्दबाजी होगी, ”बैरी ने कहा।

श्रिम्पफ ने यह भी नोट किया कि सबसे अच्छा प्रदर्शन करने वाले ट्रांसफॉर्मर भी सीमित हैं, उदाहरण के लिए, शब्दों और छोटे वाक्यांशों के लिए अच्छी तरह से काम कर रहे हैं, लेकिन कहानियों को बताने जैसे बड़े पैमाने पर भाषा कार्यों के लिए नहीं।

"मेरी समझ यह है कि यह वास्तुकला, यह ट्रांसफार्मर, आपको मस्तिष्क की संरचना को समझने के लिए सही जगह पर रखता है, और प्रशिक्षण के साथ इसे बेहतर बनाया जा सकता है," श्रिम्पफ ने कहा। "यह एक अच्छी दिशा है, लेकिन क्षेत्र बहुत जटिल है।"