शोधकर्ता सामान्य मशीन लर्निंग (एमएल) कार्यों के लिए नए मॉडल आर्किटेक्चर विकसित करना जारी रखते हैं। ऐसा ही एक कार्य छवि वर्गीकरण है, जहां छवियों को इनपुट के रूप में स्वीकार किया जाता है और मॉडल ऑब्जेक्ट लेबल आउटपुट के साथ छवि को समग्र रूप से वर्गीकृत करने का प्रयास करता है। आज उपलब्ध कई मॉडलों के साथ जो इस छवि वर्गीकरण कार्य को करते हैं, एक एमएल व्यवसायी इस तरह के प्रश्न पूछ सकता है: "मुझे किस मॉडल को ठीक करना चाहिए और फिर अपने डेटासेट पर सर्वश्रेष्ठ प्रदर्शन प्राप्त करने के लिए तैनात करना चाहिए?" और एक एमएल शोधकर्ता इस तरह के प्रश्न पूछ सकता है: "मैं जीपीयू, सीपीयू और रैम जैसे प्रशिक्षण हाइपरपरमेटर्स और कंप्यूटर विशिष्टताओं को नियंत्रित करते हुए एक निर्दिष्ट डेटासेट के खिलाफ कई मॉडल आर्किटेक्चर की अपनी उचित तुलना कैसे उत्पन्न कर सकता हूं?" पूर्व प्रश्न मॉडल आर्किटेक्चर में मॉडल चयन को संबोधित करता है, जबकि बाद वाला प्रश्न टेस्ट डेटासेट के खिलाफ प्रशिक्षित मॉडल को बेंचमार्क करने से संबंधित है।

इस पोस्ट में आप देखेंगे कि कैसे TensorFlow छवि वर्गीकरण का एल्गोरिदम अमेज़न SageMaker जम्पस्टार्ट इन सवालों के समाधान के लिए आवश्यक कार्यान्वयन को सरल बना सकता है। एक संगत में कार्यान्वयन विवरण के साथ उदाहरण ज्यूपिटर नोटबुक, आपके पास पारेटो फ्रंटियर्स की खोज करके मॉडल चयन करने के लिए उपकरण उपलब्ध होंगे, जहां एक प्रदर्शन मीट्रिक में सुधार करना, जैसे कि सटीकता, किसी अन्य मीट्रिक, जैसे थ्रूपुट को खराब किए बिना संभव नहीं है।

समाधान अवलोकन

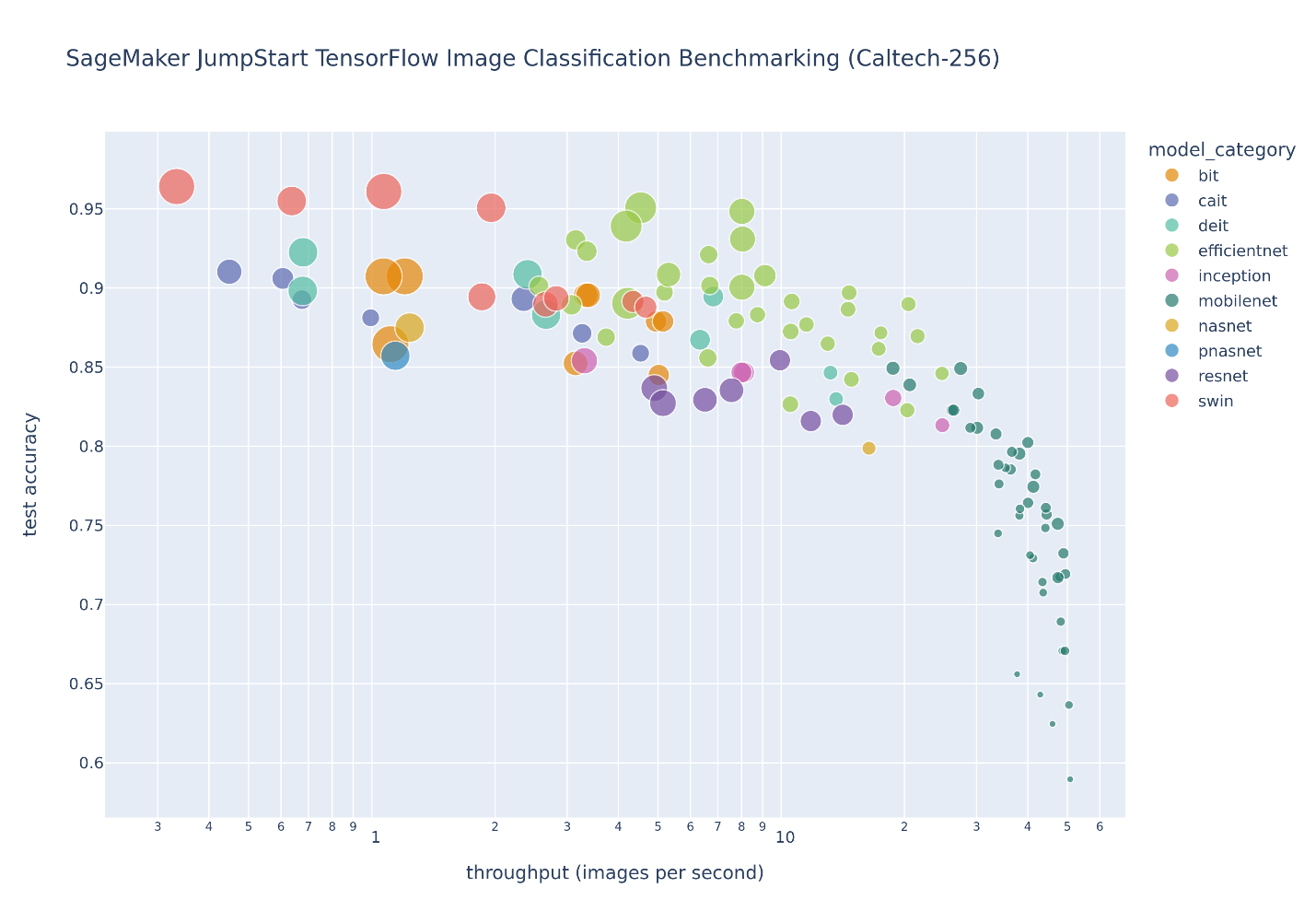

निम्नलिखित आंकड़ा बड़ी संख्या में छवि वर्गीकरण मॉडल के लिए ठीक-ठीक मॉडल चयन व्यापार-बंद दिखाता है कैल्टेक -256 डेटासेट, जो 30,607 वस्तु श्रेणियों में फैली 256 वास्तविक दुनिया की छवियों का एक चुनौतीपूर्ण सेट है। प्रत्येक बिंदु एक एकल मॉडल का प्रतिनिधित्व करता है, बिंदु आकार को मॉडल में शामिल मापदंडों की संख्या के संबंध में बढ़ाया जाता है, और अंक उनके मॉडल आर्किटेक्चर के आधार पर रंग-कोडित होते हैं। उदाहरण के लिए, हल्के हरे बिंदु एफिशिएंटनेट आर्किटेक्चर का प्रतिनिधित्व करते हैं; प्रत्येक हल्का हरा बिंदु अद्वितीय फ़ाइन-ट्यून मॉडल प्रदर्शन मापन के साथ इस आर्किटेक्चर का एक अलग कॉन्फ़िगरेशन है। यह आंकड़ा मॉडल चयन के लिए पारेटो फ्रंटियर के अस्तित्व को दर्शाता है, जहां निम्न थ्रूपुट के लिए उच्च सटीकता का आदान-प्रदान किया जाता है। अंततः, पैरेटो फ्रंटियर के साथ एक मॉडल का चयन, या पारेटो कुशल समाधानों का सेट, आपके मॉडल परिनियोजन प्रदर्शन आवश्यकताओं पर निर्भर करता है।

यदि आप परीक्षण सटीकता का निरीक्षण करते हैं और रुचि के थ्रूपुट सीमाओं का परीक्षण करते हैं, तो पूर्ववर्ती आंकड़े पर पारेटो कुशल समाधानों का सेट निम्न तालिका में निकाला जाता है। पंक्तियों को इस प्रकार क्रमबद्ध किया जाता है कि परीक्षण प्रवाह बढ़ रहा है और परीक्षण सटीकता कम हो रही है।

| मॉडल का नाम | पैरामीटर्स की संख्या | परीक्षण सटीकता | शीर्ष 5 सटीकता का परीक्षण करें | थ्रूपुट (छवियां) | अवधि प्रति युग |

| स्वाइन-लार्ज-पैच 4-विंडो12-384 | 195.6M | 96.4% तक | 99.5% तक | 0.3 | 2278.6 |

| स्वाइन-लार्ज-पैच 4-विंडो7-224 | 195.4M | 96.1% तक | 99.5% तक | 1.1 | 698.0 |

| कुशलनेट-v2-imagenet21k-ft1k-l | 118.1M | 95.1% तक | 99.2% तक | 4.5 | 1434.7 |

| कुशलनेट-v2-imagenet21k-ft1k-m | 53.5M | 94.8% तक | 99.1% तक | 8.0 | 769.1 |

| कुशलनेट-v2-imagenet21k-m | 53.5M | 93.1% तक | 98.5% तक | 8.0 | 765.1 |

| कुशलनेट-b5 | 29.0M | 90.8% तक | 98.1% तक | 9.1 | 668.6 |

| कुशलनेट-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% तक | 97.3% तक | 14.6 | 54.3 |

| कुशलनेट-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% तक | 97.0% तक | 20.5 | 38.3 |

| कुशलनेट-v2-imagenet21k-b0 | 6.2M | 87.0% तक | 95.6% तक | 21.5 | 38.2 |

| Mobilenet-v3-बड़ा-100-224 | 4.6M | 84.9% तक | 95.4% तक | 27.4 | 28.8 |

| Mobilenet-v3-बड़ा-075-224 | 3.1M | 83.3% तक | 95.2% तक | 30.3 | 26.6 |

| Mobilenet-v2-100-192 | 2.6M | 80.8% तक | 93.5% तक | 33.5 | 23.9 |

| Mobilenet-v2-100-160 | 2.6M | 80.2% तक | 93.2% तक | 40.0 | 19.6 |

| Mobilenet-v2-075-160 | 1.7M | 78.2% तक | 92.8% तक | 41.8 | 19.3 |

| Mobilenet-v2-075-128 | 1.7M | 76.1% तक | 91.1% तक | 44.3 | 18.3 |

| Mobilenet-v1-075-160 | 2.0M | 75.7% तक | 91.0% तक | 44.5 | 18.2 |

| Mobilenet-v1-100-128 | 3.5M | 75.1% तक | 90.7% तक | 47.4 | 17.4 |

| Mobilenet-v1-075-128 | 2.0M | 73.2% तक | 90.0% तक | 48.9 | 16.8 |

| Mobilenet-v2-075-96 | 1.7M | 71.9% तक | 88.5% तक | 49.4 | 16.6 |

| Mobilenet-v2-035-96 | 0.7M | 63.7% तक | 83.1% तक | 50.4 | 16.3 |

| Mobilenet-v1-025-128 | 0.3M | 59.0% तक | 80.7% तक | 50.8 | 16.2 |

यह पोस्ट बड़े पैमाने पर लागू करने के तरीके के बारे में विवरण प्रदान करती है अमेज़न SageMaker बेंचमार्किंग और मॉडल चयन कार्य। सबसे पहले, हम जम्पस्टार्ट और बिल्ट-इन TensorFlow छवि वर्गीकरण एल्गोरिदम पेश करते हैं। इसके बाद हम उच्च-स्तरीय कार्यान्वयन संबंधी विचारों पर चर्चा करते हैं, जैसे जम्पस्टार्ट हाइपरपैरामीटर कॉन्फ़िगरेशन, से मीट्रिक निष्कर्षण अमेज़न CloudWatch लॉग, और एसिंक्रोनस हाइपरपैरामीटर ट्यूनिंग जॉब लॉन्च करना। अंत में, हम पूर्ववर्ती तालिका और आंकड़े में पारेटो कुशल समाधान के लिए अग्रणी कार्यान्वयन पर्यावरण और पैरामीटराइजेशन को कवर करते हैं।

जम्पस्टार्ट टेंसरफ्लो छवि वर्गीकरण का परिचय

जम्पस्टार्ट लोकप्रिय एमएल कार्यों के साथ-साथ आम व्यावसायिक समस्याओं को हल करने वाले एंड-टू-एंड समाधानों के चयन के साथ-साथ एक-क्लिक फ़ाइन-ट्यूनिंग और विभिन्न प्रकार के पूर्व-प्रशिक्षित मॉडलों की तैनाती प्रदान करता है। ये सुविधाएँ एमएल प्रक्रिया के प्रत्येक चरण से भारी भार को हटाती हैं, जिससे उच्च-गुणवत्ता वाले मॉडल विकसित करना और तैनाती के समय को कम करना आसान हो जाता है। जम्पस्टार्ट एपीआई आपको अपने स्वयं के डेटासेट पर पूर्व-प्रशिक्षित मॉडलों के विशाल चयन को प्रोग्रामेटिक रूप से परिनियोजित करने और फाइन-ट्यून करने की अनुमति देता है।

जम्पस्टार्ट मॉडल हब बड़ी संख्या में पहुँच प्रदान करता है TensorFlow छवि वर्गीकरण मॉडल जो कस्टम डेटासेट पर ट्रांसफर लर्निंग और फाइन-ट्यूनिंग को सक्षम करता है। इस लेखन के समय, जम्पस्टार्ट मॉडल हब में 135 TensorFlow छवि वर्गीकरण मॉडल शामिल हैं जो विभिन्न प्रकार के लोकप्रिय मॉडल आर्किटेक्चर में हैं। टेंसरफ्लो हब, अवशिष्ट नेटवर्क शामिल करने के लिए (रेसनेट), मोबाइलनेट, कुशल, आरंभ, तंत्रिका वास्तुकला खोज नेटवर्क (NASनेट), बिग ट्रांसफर (अंश), स्थानांतरित खिड़की (स्वाइन) ट्रांसफॉर्मर, इमेज ट्रांसफॉर्मर में क्लास-अटेंशन (सीआईटी), और डेटा-कुशल इमेज ट्रांसफॉर्मर (डीईआईटी).

अत्यधिक भिन्न आंतरिक संरचनाओं में प्रत्येक मॉडल वास्तुकला शामिल है। उदाहरण के लिए, ResNet मॉडल पर्याप्त रूप से गहरे नेटवर्क की अनुमति देने के लिए स्किप कनेक्शन का उपयोग करते हैं, जबकि ट्रांसफ़ॉर्मर-आधारित मॉडल आत्म-ध्यान तंत्र का उपयोग करते हैं जो अधिक वैश्विक ग्रहणशील क्षेत्रों के पक्ष में कनवल्शन ऑपरेशन के आंतरिक स्थानीयता को समाप्त करते हैं। इन विभिन्न संरचनाओं द्वारा प्रदान किए जाने वाले विविध फीचर सेट के अलावा, प्रत्येक मॉडल आर्किटेक्चर में कई कॉन्फ़िगरेशन होते हैं जो उस आर्किटेक्चर के भीतर मॉडल के आकार, आकार और जटिलता को समायोजित करते हैं। इसके परिणामस्वरूप जम्पस्टार्ट मॉडल हब पर सैकड़ों अद्वितीय छवि वर्गीकरण मॉडल उपलब्ध हैं। बिल्ट-इन ट्रांसफर लर्निंग और इंट्रेंस स्क्रिप्ट्स के साथ संयुक्त, जिसमें कई सेजमेकर विशेषताएं शामिल हैं, जम्पस्टार्ट एपीआई एमएल चिकित्सकों के लिए प्रशिक्षण शुरू करने और मॉडल को जल्दी से तैनात करने के लिए एक शानदार लॉन्चिंग पॉइंट है।

का संदर्भ लें Amazon SageMaker में TensorFlow छवि वर्गीकरण मॉडल के लिए स्थानांतरण सीखना और निम्नलिखित उदाहरण नोटबुक SageMaker TensorFlow छवि वर्गीकरण के बारे में अधिक गहराई से जानने के लिए, जिसमें पूर्व-प्रशिक्षित मॉडल पर अनुमान लगाने के साथ-साथ कस्टम डेटासेट पर पूर्व-प्रशिक्षित मॉडल को फ़ाइन-ट्यून करना शामिल है।

बड़े पैमाने पर मॉडल चयन विचार

मॉडल चयन उम्मीदवार मॉडल के एक सेट से सर्वश्रेष्ठ मॉडल का चयन करने की प्रक्रिया है। यह प्रक्रिया एक ही प्रकार के विभिन्न पैरामीटर भार और विभिन्न प्रकार के मॉडलों के साथ एक ही प्रकार के मॉडल पर लागू की जा सकती है। एक ही प्रकार के मॉडलों में मॉडल चयन के उदाहरणों में एक ही मॉडल को अलग-अलग हाइपरपरमेटर्स (उदाहरण के लिए, सीखने की दर) के साथ फिट करना और ट्रेन डेटासेट में मॉडल वेट के ओवरफिटिंग को रोकने के लिए जल्दी रोकना शामिल है। विभिन्न प्रकार के मॉडलों में मॉडल चयन में सर्वश्रेष्ठ मॉडल आर्किटेक्चर (उदाहरण के लिए, स्वाइन बनाम मोबाइलनेट) का चयन करना और एकल मॉडल आर्किटेक्चर के भीतर सर्वश्रेष्ठ मॉडल कॉन्फ़िगरेशन का चयन करना शामिल है (उदाहरण के लिए, mobilenet-v1-025-128 बनाम mobilenet-v3-large-100-224).

इस खंड में उल्लिखित विचार इन सभी मॉडल चयन प्रक्रियाओं को सत्यापन डेटासेट पर सक्षम करते हैं।

हाइपरपैरामीटर कॉन्फ़िगरेशन चुनें

जम्पस्टार्ट में TensorFlow छवि वर्गीकरण में बड़ी संख्या में उपलब्ध हैं हाइपरपैरामीटर जो सभी मॉडल आर्किटेक्चर के लिए समान रूप से ट्रांसफर लर्निंग स्क्रिप्ट व्यवहार को समायोजित कर सकता है। ये हाइपरपैरामीटर डेटा वृद्धि और प्रीप्रोसेसिंग, ऑप्टिमाइज़र विनिर्देश, ओवरफिटिंग नियंत्रण और ट्रेन करने योग्य परत संकेतकों से संबंधित हैं। आपको इन हाइपरपैरामीटर के डिफ़ॉल्ट मानों को अपने आवेदन के लिए आवश्यकतानुसार समायोजित करने के लिए प्रोत्साहित किया जाता है:

इस विश्लेषण और संबंधित नोटबुक के लिए, सीखने की दर, युगों की संख्या और प्रारंभिक रोक विनिर्देश को छोड़कर सभी हाइपरपैरामीटर डिफ़ॉल्ट मानों पर सेट होते हैं। सीखने की दर को एक के रूप में समायोजित किया जाता है श्रेणीबद्ध पैरामीटर द्वारा SageMaker स्वचालित मॉडल ट्यूनिंग काम। क्योंकि प्रत्येक मॉडल में अद्वितीय डिफ़ॉल्ट हाइपरपैरामीटर मान होते हैं, संभावित सीखने की दरों की असतत सूची में डिफ़ॉल्ट सीखने की दर के साथ-साथ डिफ़ॉल्ट सीखने की दर का पांचवां हिस्सा भी शामिल होता है। यह एकल हाइपरपैरामीटर ट्यूनिंग कार्य के लिए दो प्रशिक्षण कार्य लॉन्च करता है, और सत्यापन डेटासेट पर सर्वोत्तम रिपोर्ट किए गए प्रदर्शन के साथ प्रशिक्षण कार्य का चयन किया जाता है। क्योंकि युगों की संख्या 10 पर सेट है, जो कि डिफ़ॉल्ट हाइपरपरमीटर सेटिंग से अधिक है, चयनित सर्वोत्तम प्रशिक्षण कार्य हमेशा डिफ़ॉल्ट सीखने की दर के अनुरूप नहीं होता है। अंत में, एक प्रारंभिक रोक मानदंड का उपयोग धैर्य के साथ किया जाता है, या तीन युगों में बिना किसी सुधार के प्रशिक्षण जारी रखने के लिए युगों की संख्या का उपयोग किया जाता है।

विशेष महत्व की एक डिफ़ॉल्ट हाइपरपैरामीटर सेटिंग है train_only_on_top_layer, जहां, यदि सेट किया गया है True, प्रदान किए गए प्रशिक्षण डेटासेट पर मॉडल की सुविधा निष्कर्षण परतें फ़ाइन-ट्यून नहीं हैं। ऑप्टिमाइज़र केवल डेटासेट में वर्ग लेबल की संख्या के बराबर आउटपुट आयाम के साथ शीर्ष पूरी तरह से जुड़े वर्गीकरण परत में पैरामीटर को प्रशिक्षित करेगा। डिफ़ॉल्ट रूप से, यह हाइपरपरमीटर सेट है True, जो छोटे डेटासेट पर सीखने के हस्तांतरण के लिए लक्षित एक सेटिंग है। आपके पास एक कस्टम डेटासेट हो सकता है जहां इमेजनेट डेटासेट पर पूर्व-प्रशिक्षण से सुविधा निष्कर्षण पर्याप्त नहीं है। इन मामलों में, आपको सेट करना चाहिए train_only_on_top_layer सेवा मेरे False. यद्यपि यह सेटिंग प्रशिक्षण के समय को बढ़ाएगी, आप अपनी रुचि की समस्या के लिए अधिक सार्थक सुविधाएँ निकालेंगे, जिससे सटीकता बढ़ेगी।

CloudWatch लॉग से मेट्रिक्स निकालें

जम्पस्टार्ट TensorFlow छवि वर्गीकरण एल्गोरिथम प्रशिक्षण के दौरान विभिन्न प्रकार के मेट्रिक्स को मज़बूती से लॉग करता है जो SageMaker के लिए सुलभ हैं Estimator और हाइपरपैरामीटर ट्यूनर ऑब्जेक्ट। एक सैजमेकर का निर्माता Estimator एक है metric_definitions कीवर्ड तर्क, जिसका उपयोग दो कुंजी वाले शब्दकोशों की सूची प्रदान करके प्रशिक्षण कार्य का मूल्यांकन करने के लिए किया जा सकता है: मीट्रिक के नाम के लिए नाम, और Regex लॉग से मीट्रिक निकालने के लिए उपयोग किए जाने वाले रेगुलर एक्सप्रेशन के लिए। के साथ नोटबुक कार्यान्वयन विवरण दिखाता है। निम्न तालिका सभी जम्पस्टार्ट TensorFlow छवि वर्गीकरण मॉडल के लिए उपलब्ध मीट्रिक और संबंधित रेगुलर एक्सप्रेशंस को सूचीबद्ध करती है।

| मीट्रिक नाम | नियमित अभिव्यक्ति |

| मापदंडों की संख्या | "- पैरामीटर की संख्या: ([0-9\.]+)" |

| प्रशिक्षित मापदंडों की संख्या | "- प्रशिक्षित करने योग्य मापदंडों की संख्या: ([0-9\.]+)" |

| गैर-प्रशिक्षित मापदंडों की संख्या | "- गैर-प्रशिक्षित मापदंडों की संख्या: ([0-9\।]+)" |

| ट्रेन डेटासेट मीट्रिक | f”- {मीट्रिक}: ([0-9\.]+)” |

| सत्यापन डेटासेट मीट्रिक | f”- वैल_{मीट्रिक}: ([0-9\.]+)” |

| परीक्षण डेटासेट मीट्रिक | f”- टेस्ट {मीट्रिक}: ([0-9\.]+)” |

| ट्रेन की अवधि | "- कुल प्रशिक्षण अवधि: ([0-9\.]+)" |

| ट्रेन की अवधि प्रति युग | "- औसत प्रशिक्षण अवधि प्रति युग: ([0-9\.]+)" |

| परीक्षण मूल्यांकन विलंबता | "- परीक्षण मूल्यांकन विलंबता: ([0-9\.]+)" |

| प्रति नमूना परीक्षण विलंबता | "- प्रति नमूना औसत परीक्षण विलंबता: ([0-9\.]+)" |

| परीक्षण थ्रूपुट | "- औसत परीक्षण क्षमता: ([0-9\.]+)" |

बिल्ट-इन ट्रांसफर लर्निंग स्क्रिप्ट इन परिभाषाओं के भीतर विभिन्न प्रकार की ट्रेन, सत्यापन और परीक्षण डेटासेट मेट्रिक्स प्रदान करती है, जैसा कि एफ-स्ट्रिंग प्रतिस्थापन मूल्यों द्वारा दर्शाया गया है। उपलब्ध सटीक मेट्रिक्स प्रदर्शन किए जा रहे वर्गीकरण के प्रकार के आधार पर भिन्न होते हैं। सभी संकलित मॉडलों में एक है loss मेट्रिक, जिसे बाइनरी या श्रेणीबद्ध वर्गीकरण समस्या के लिए क्रॉस-एन्ट्रॉपी हानि द्वारा दर्शाया जाता है। पूर्व का उपयोग तब किया जाता है जब एक वर्ग लेबल होता है; बाद वाले का उपयोग तब किया जाता है जब दो या दो से अधिक वर्ग लेबल हों। यदि केवल एक वर्ग लेबल है, तो निम्नलिखित मेट्रिक्स की गणना, लॉगिंग और पिछली तालिका में एफ-स्ट्रिंग रेगुलर एक्सप्रेशन के माध्यम से निकालने योग्य है: वास्तविक सकारात्मक की संख्या (true_pos), झूठे सकारात्मक की संख्या (false_pos), सच्चे नकारात्मक की संख्या (true_neg), झूठे नकारात्मक की संख्या (false_neg), precision, recall, रिसीवर ऑपरेटिंग विशेषता (आरओसी) वक्र के तहत क्षेत्र (auc), और सटीक-रिकॉल (PR) वक्र के अंतर्गत क्षेत्र (prc). इसी तरह, यदि छह या अधिक वर्ग लेबल हैं, तो एक शीर्ष-5 सटीकता मीट्रिक (top_5_accuracy) पिछले रेगुलर एक्सप्रेशन के माध्यम से गणना, लॉग और निकालने योग्य भी है।

प्रशिक्षण के दौरान, सैजमेकर को निर्दिष्ट मेट्रिक्स Estimator CloudWatch लॉग्स में उत्सर्जित होते हैं। जब प्रशिक्षण पूरा हो जाए, तो आप आह्वान कर सकते हैं सेजमेकर ने प्रशिक्षण जॉब एपीआई का वर्णन किया और निरीक्षण किया FinalMetricDataList JSON प्रतिक्रिया में कुंजी:

इस एपीआई को क्वेरी को केवल नौकरी का नाम प्रदान करने की आवश्यकता है, इसलिए, एक बार पूरा हो जाने पर, मेट्रिक्स को भविष्य के विश्लेषणों में प्राप्त किया जा सकता है, जब तक कि प्रशिक्षण नौकरी का नाम उचित रूप से लॉग और पुनर्प्राप्त करने योग्य हो। इस मॉडल चयन कार्य के लिए, हाइपरपैरामीटर ट्यूनिंग जॉब नाम संग्रहीत किए जाते हैं और बाद के विश्लेषणों को फिर से जोड़ते हैं HyperparameterTuner ऑब्जेक्ट को ट्यूनिंग कार्य का नाम दिया गया है, संलग्न हाइपरपैरामीटर ट्यूनर से सर्वोत्तम प्रशिक्षण कार्य का नाम निकालें, और फिर आह्वान करें DescribeTrainingJob एपीआई जैसा कि पहले वर्णित किया गया है, सर्वोत्तम प्रशिक्षण कार्य से जुड़े मेट्रिक्स प्राप्त करने के लिए।

एसिंक्रोनस हाइपरपैरामीटर ट्यूनिंग जॉब लॉन्च करें

संबंधित का संदर्भ लें नोटबुक एसिंक्रोनसली लॉन्चिंग हाइपरपैरामीटर ट्यूनिंग जॉब्स पर कार्यान्वयन विवरण के लिए, जो पायथन मानक पुस्तकालय का उपयोग करता है समवर्ती वायदा मॉड्यूल, एसिंक्रोनस रूप से चलने वाले कॉलेबल के लिए एक उच्च-स्तरीय इंटरफ़ेस। इस समाधान में SageMaker से संबंधित कई विचार लागू किए गए हैं:

- प्रत्येक AWS खाता संबद्ध है सेजमेकर सेवा कोटा. आपको अपने संसाधनों का पूर्ण उपयोग करने के लिए अपनी वर्तमान सीमाएँ देखनी चाहिए और संभावित रूप से आवश्यकतानुसार संसाधन सीमा बढ़ाने का अनुरोध करना चाहिए।

- कई एक साथ हाइपरपैरामीटर ट्यूनिंग जॉब बनाने के लिए बार-बार एपीआई कॉल कर सकते हैं पायथन एसडीके दर से अधिक और थ्रॉटलिंग अपवादों को फेंक दें. इसका एक संकल्प कस्टम रीट्री कॉन्फ़िगरेशन के साथ SageMaker Boto3 क्लाइंट बनाना है।

- यदि आपकी स्क्रिप्ट में कोई त्रुटि आती है या स्क्रिप्ट पूरी होने से पहले ही रुक जाती है तो क्या होता है? इतने बड़े मॉडल चयन या बेंचमार्किंग अध्ययन के लिए, आप ट्यूनिंग जॉब नामों को लॉग कर सकते हैं और सुविधा कार्यों को प्रदान कर सकते हैं हाइपरपैरामीटर ट्यूनिंग जॉब को फिर से जोड़ें जो पहले से मौजूद है:

विश्लेषण विवरण और चर्चा

इस पोस्ट में विश्लेषण के लिए स्थानांतरण सीखने का प्रदर्शन करता है मॉडल आईडी Caltech-256 डाटासेट पर जम्पस्टार्ट TensorFlow छवि वर्गीकरण एल्गोरिथ्म में। सभी प्रशिक्षण कार्य SageMaker प्रशिक्षण उदाहरण ml.g4dn.xlarge पर किए गए थे, जिसमें एक एकल NVIDIA T4 GPU शामिल है।

प्रशिक्षण के अंत में प्रशिक्षण के उदाहरण पर परीक्षण डेटासेट का मूल्यांकन किया जाता है। सर्वश्रेष्ठ सत्यापन सेट प्रदर्शन के साथ युग के लिए मॉडल वजन सेट करने के लिए परीक्षण डेटासेट मूल्यांकन से पहले मॉडल चयन किया जाता है। टेस्ट थ्रूपुट अनुकूलित नहीं है: डेटासेट बैच आकार डिफ़ॉल्ट प्रशिक्षण हाइपरपैरामीटर बैच आकार पर सेट है, जिसे GPU मेमोरी उपयोग को अधिकतम करने के लिए समायोजित नहीं किया गया है; रिपोर्ट किए गए परीक्षण थ्रूपुट में डेटा लोडिंग समय शामिल है क्योंकि डेटासेट प्री-कैश नहीं है; और एकाधिक जीपीयू में वितरित निष्कर्ष का उपयोग नहीं किया जाता है। इन कारणों से, यह थ्रूपुट एक अच्छा सापेक्ष माप है, लेकिन वास्तविक थ्रूपुट प्रशिक्षित मॉडल के लिए आपके अनुमान समापन बिंदु परिनियोजन कॉन्फ़िगरेशन पर बहुत अधिक निर्भर करेगा।

हालांकि जम्पस्टार्ट मॉडल हब में कई छवि वर्गीकरण आर्किटेक्चर प्रकार शामिल हैं, यह पेरेटो फ्रंटियर चुनिंदा स्वाइन, एफिशिएंटनेट और मोबाइलनेट मॉडल का प्रभुत्व है। स्वाइन मॉडल बड़े और अपेक्षाकृत अधिक सटीक होते हैं, जबकि मोबाइलनेट मॉडल छोटे, अपेक्षाकृत कम सटीक और मोबाइल उपकरणों की संसाधन बाधाओं के लिए उपयुक्त होते हैं। यह ध्यान रखना महत्वपूर्ण है कि यह सीमा विभिन्न कारकों पर निर्भर है, जिसमें उपयोग किए गए सटीक डेटासेट और चयनित फाइन-ट्यूनिंग हाइपरपैरामीटर शामिल हैं। आप पा सकते हैं कि आपका कस्टम डेटासेट पारेटो कुशल समाधानों का एक अलग सेट तैयार करता है, और आप अलग-अलग हाइपरपैरामीटर के साथ लंबे समय तक प्रशिक्षण की इच्छा कर सकते हैं, जैसे कि अधिक डेटा वृद्धि या मॉडल की शीर्ष वर्गीकरण परत से अधिक ठीक-ट्यूनिंग।

निष्कर्ष

इस पोस्ट में, हमने जम्पस्टार्ट मॉडल हब का उपयोग करके बड़े पैमाने पर मॉडल चयन या बेंचमार्किंग कार्यों को चलाने का तरीका दिखाया। यह समाधान आपको अपनी आवश्यकताओं के लिए सर्वश्रेष्ठ मॉडल चुनने में मदद कर सकता है। हम आपको इसे आजमाने और इसका पता लगाने के लिए प्रोत्साहित करते हैं समाधान अपने स्वयं के डेटासेट पर।

संदर्भ

अधिक जानकारी निम्नलिखित संसाधनों पर उपलब्ध है:

लेखक के बारे में

डॉ काइल उलरिच के साथ एक अनुप्रयुक्त वैज्ञानिक है अमेज़ॅन सेजमेकर बिल्ट-इन एल्गोरिदम टीम। उनके शोध के हितों में स्केलेबल मशीन लर्निंग एल्गोरिदम, कंप्यूटर विज़न, टाइम सीरीज़, बायेसियन नॉन-पैरामेट्रिक्स और गॉसियन प्रोसेस शामिल हैं। उनकी पीएचडी ड्यूक यूनिवर्सिटी से है और उन्होंने न्यूरआईपीएस, सेल और न्यूरॉन में पत्र प्रकाशित किए हैं।

डॉ काइल उलरिच के साथ एक अनुप्रयुक्त वैज्ञानिक है अमेज़ॅन सेजमेकर बिल्ट-इन एल्गोरिदम टीम। उनके शोध के हितों में स्केलेबल मशीन लर्निंग एल्गोरिदम, कंप्यूटर विज़न, टाइम सीरीज़, बायेसियन नॉन-पैरामेट्रिक्स और गॉसियन प्रोसेस शामिल हैं। उनकी पीएचडी ड्यूक यूनिवर्सिटी से है और उन्होंने न्यूरआईपीएस, सेल और न्यूरॉन में पत्र प्रकाशित किए हैं।

डॉ आशीष खेतानी के साथ एक वरिष्ठ अनुप्रयुक्त वैज्ञानिक हैं अमेज़ॅन सेजमेकर बिल्ट-इन एल्गोरिदम और मशीन लर्निंग एल्गोरिदम विकसित करने में मदद करता है। उन्होंने इलिनोइस विश्वविद्यालय अर्बाना चैंपियन से पीएचडी की उपाधि प्राप्त की। वह मशीन लर्निंग और सांख्यिकीय अनुमान में एक सक्रिय शोधकर्ता हैं और उन्होंने न्यूरआईपीएस, आईसीएमएल, आईसीएलआर, जेएमएलआर, एसीएल और ईएमएनएलपी सम्मेलनों में कई पत्र प्रकाशित किए हैं।

डॉ आशीष खेतानी के साथ एक वरिष्ठ अनुप्रयुक्त वैज्ञानिक हैं अमेज़ॅन सेजमेकर बिल्ट-इन एल्गोरिदम और मशीन लर्निंग एल्गोरिदम विकसित करने में मदद करता है। उन्होंने इलिनोइस विश्वविद्यालय अर्बाना चैंपियन से पीएचडी की उपाधि प्राप्त की। वह मशीन लर्निंग और सांख्यिकीय अनुमान में एक सक्रिय शोधकर्ता हैं और उन्होंने न्यूरआईपीएस, आईसीएमएल, आईसीएलआर, जेएमएलआर, एसीएल और ईएमएनएलपी सम्मेलनों में कई पत्र प्रकाशित किए हैं।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- About

- पहुँच

- सुलभ

- लेखा

- शुद्धता

- सही

- पाना

- के पार

- सक्रिय

- इसके अलावा

- पता

- पतों

- समायोजित

- सम्बद्ध

- के खिलाफ

- कलन विधि

- एल्गोरिदम

- सब

- पहले ही

- हालांकि

- हमेशा

- वीरांगना

- अमेज़न SageMaker

- अमेज़न SageMaker जम्पस्टार्ट

- का विश्लेषण करती है

- विश्लेषण

- और

- अन्य

- एपीआई

- आवेदन

- लागू

- उचित रूप से

- स्थापत्य

- क्षेत्र

- तर्क

- जुड़े

- संलग्न करना

- प्रयास

- स्वचालित

- उपलब्ध

- औसत

- एडब्ल्यूएस

- आधारित

- बायेसियन

- क्योंकि

- से पहले

- जा रहा है

- बेंच मार्किंग

- BEST

- बड़ा

- में निर्मित

- व्यापार

- कॉल

- उम्मीदवार

- मामलों

- श्रेणियाँ

- चुनौतीपूर्ण

- विशेषता

- चुनें

- कक्षा

- वर्गीकरण

- वर्गीकृत

- ग्राहक

- संयुक्त

- सामान्य

- तुलना

- पूरा

- पूरा

- समापन

- जटिलता

- कंप्यूटर

- Computer Vision

- चिंताओं

- सम्मेलनों

- विन्यास

- जुड़ा हुआ

- कनेक्शन

- विचार

- की कमी

- शामिल हैं

- जारी रखने के

- नियंत्रित

- नियंत्रण

- सुविधा

- इसी

- आवरण

- बनाना

- वर्तमान

- वक्र

- रिवाज

- तिथि

- डेटासेट

- और गहरा

- चूक

- निर्भर करता है

- तैनात

- तैनाती

- तैनाती

- गहराई

- वर्णित

- विवरण

- विवरण

- विकसित करना

- डिवाइस

- विभिन्न

- चर्चा करना

- वितरित

- कई

- नहीं करता है

- ड्यूक

- ड्यूक विश्वविद्यालय

- दौरान

- से प्रत्येक

- पूर्व

- शीघ्र

- आसान

- कुशल

- भी

- को खत्म करने

- सक्षम

- प्रोत्साहित करना

- प्रोत्साहित किया

- शुरू से अंत तक

- endpoint

- वातावरण

- युग

- अवधियों को

- त्रुटि

- मूल्यांकन करें

- मूल्यांकित

- मूल्यांकन

- उदाहरण

- उदाहरण

- सिवाय

- का पता लगाने

- तलाश

- भाव

- उद्धरण

- कारकों

- निष्पक्ष

- एहसान

- Feature

- विशेषताएं

- फ़ील्ड

- आकृति

- अंत में

- खोज

- प्रथम

- फिटिंग

- निम्नलिखित

- पूर्व

- से

- सीमांत

- फ्रंटियर्स

- पूरी तरह से

- कार्यों

- भविष्य

- भावी सौदे

- उत्पन्न

- मिल

- दी

- वैश्विक

- अच्छा

- GPU

- GPUs

- महान

- अधिक से अधिक

- हरा

- हो जाता

- भारी

- मदद

- मदद करता है

- उच्च स्तर

- उच्च गुणवत्ता

- उच्चतर

- कैसे

- How To

- एचटीएमएल

- HTTPS

- हब

- सैकड़ों

- हाइपरपरमेटर ट्यूनिंग

- इलेनॉइस

- की छवि

- छवि वर्गीकरण

- छवियों

- लागू करने के

- कार्यान्वयन

- कार्यान्वित

- महत्व

- महत्वपूर्ण

- सुधार

- में सुधार लाने

- in

- शामिल

- शामिल

- सहित

- बढ़ना

- बढ़ जाती है

- बढ़ती

- संकेतक

- करें-

- निवेश

- उदाहरण

- ब्याज

- रुचियों

- इंटरफेस

- आंतरिक

- आंतरिक

- परिचय कराना

- IT

- काम

- नौकरियां

- JSON

- कुंजी

- Instagram पर

- लेबल

- लेबल

- बड़ा

- बड़े पैमाने पर

- बड़ा

- विलंब

- शुरूआत

- शुरू करने

- परत

- परतों

- प्रमुख

- जानें

- सीख रहा हूँ

- उत्तोलक

- प्रकाश

- सीमा

- सीमाएं

- सूची

- सूचियाँ

- लोड हो रहा है

- लंबा

- लंबे समय तक

- बंद

- मशीन

- यंत्र अधिगम

- निर्माण

- बहुत

- अधिकतम करने के लिए

- सार्थक

- माप

- याद

- मीट्रिक

- मेट्रिक्स

- ML

- मोबाइल

- मोबाइल उपकरणों

- आदर्श

- मॉडल

- मॉड्यूल

- अधिक

- विभिन्न

- नाम

- नामों

- आवश्यक

- की जरूरत है

- नेटवर्क

- नया

- नोटबुक

- संख्या

- Nvidia

- वस्तु

- वस्तुओं

- निरीक्षण

- प्राप्त

- प्राप्त

- ONE

- परिचालन

- संचालन

- अनुकूलित

- उल्लिखित

- अपना

- कागजात

- प्राचल

- पैरामीटर

- विशेष

- धैर्य

- पीडीएफ

- निष्पादन

- प्रदर्शन

- प्रदर्शन

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- बिन्दु

- अंक

- लोकप्रिय

- संभव

- पद

- संभावित

- pr

- को रोकने के

- पूर्व

- मुसीबत

- समस्याओं

- प्रक्रिया

- प्रक्रियाओं

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- प्रकाशित

- अजगर

- प्रश्न

- प्रशन

- जल्दी से

- रैम

- मूल्यांकन करें

- दरें

- असली दुनिया

- कारण

- को कम करने

- नियमित

- अपेक्षाकृत

- हटाना

- की सूचना दी

- प्रतिनिधित्व

- प्रतिनिधित्व

- का प्रतिनिधित्व करता है

- का अनुरोध

- अपेक्षित

- आवश्यकताएँ

- की आवश्यकता होती है

- अनुसंधान

- शोधकर्ता

- संकल्प

- संसाधन

- उपयुक्त संसाधन चुनें

- प्रतिक्रिया

- परिणाम

- रन

- दौड़ना

- sagemaker

- वही

- स्केलेबल

- वैज्ञानिक

- लिपियों

- एसडीके

- Search

- अनुभाग

- चयनित

- का चयन

- चयन

- वरिष्ठ

- कई

- सेवा

- सत्र

- सेट

- सेट

- की स्थापना

- कई

- आकार

- चाहिए

- दिखाता है

- उसी प्रकार

- को आसान बनाने में

- एक

- छह

- आकार

- आकार

- छोटा

- छोटे

- So

- समाधान

- समाधान ढूंढे

- हल

- विनिर्देश

- विनिर्देशों

- विनिर्दिष्ट

- मानक

- शुरू

- सांख्यिकीय

- कदम

- रोक

- रोक

- संग्रहित

- अध्ययन

- आगामी

- ऐसा

- पर्याप्त

- उपयुक्त

- तालिका

- लक्षित

- कार्य

- कार्य

- टीम

- tensorflow

- परीक्षण

- RSI

- लेकिन हाल ही

- जिसके चलते

- तीन

- THROUGHPUT

- पहर

- समय श्रृंखला

- बार

- सेवा मेरे

- आज

- एक साथ

- उपकरण

- ऊपर का

- शीर्ष 5

- कुल

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- स्थानांतरण

- ट्रान्सफ़ॉर्मर

- <strong>उद्देश्य</strong>

- प्रकार

- अंत में

- के अंतर्गत

- अद्वितीय

- विश्वविद्यालय

- प्रयोग

- उपयोग

- उपयोग

- उपयोग किया

- सत्यापन

- मान

- विविधता

- व्यापक

- के माध्यम से

- देखें

- दृष्टि

- कौन कौन से

- जब

- पूरा का पूरा

- चौड़ा

- मर्जी

- अंदर

- बिना

- होगा

- लिख रहे हैं

- आप

- आपका

- जेफिरनेट