नवंबर 2022 में, हम की घोषणा कि AWS ग्राहक टेक्स्ट से इमेज जेनरेट कर सकते हैं स्थिर प्रसार मॉडल का उपयोग अमेज़न SageMaker जम्पस्टार्ट. आज, हम एक नई सुविधा शुरू करने के लिए उत्साहित हैं जो उपयोगकर्ताओं को स्थिर प्रसार मॉडल के साथ छवियों को पेंट करने में सक्षम बनाती है। इनपेंटिंग एक टेक्स्ट प्रांप्ट के आधार पर एक छवि के एक हिस्से को दूसरी छवि के साथ बदलने की प्रक्रिया को संदर्भित करता है। मूल छवि प्रदान करके, एक मुखौटा छवि जो प्रतिस्थापित किए जाने वाले हिस्से को रेखांकित करती है, और एक शाब्दिक संकेत, स्थिर प्रसार मॉडल एक नई छवि उत्पन्न कर सकता है जो पाठ्य संकेत में वर्णित वस्तु, विषय या वातावरण के साथ नकाबपोश क्षेत्र को बदल देता है।

आप खराब छवियों को पुनर्स्थापित करने या कुछ वर्गों में उपन्यास विषयों या शैलियों के साथ नई छवियां बनाने के लिए इनपेंटिंग का उपयोग कर सकते हैं। आर्किटेक्चरल डिज़ाइन के दायरे में, बिल्डिंग ब्लूप्रिंट के अधूरे या क्षतिग्रस्त क्षेत्रों की मरम्मत के लिए पेंटिंग में स्थिर प्रसार को लागू किया जा सकता है, निर्माण कर्मचारियों के लिए सटीक जानकारी प्रदान करता है। क्लिनिकल एमआरआई इमेजिंग के मामले में, रोगी के सिर को संयमित किया जाना चाहिए, जिससे डेटा हानि या कम नैदानिक सटीकता के कारण क्रॉपिंग आर्टिफैक्ट के कारण खराब परिणाम हो सकते हैं। इमेज इनपेंटिंग प्रभावी रूप से इन उप-इष्टतम परिणामों को कम करने में मदद कर सकती है।

इस पोस्ट में, हम दो तरीकों में स्थिर प्रसार इनपेंटिंग मॉडल का उपयोग करके अनुमान लगाने और चलाने पर एक व्यापक मार्गदर्शिका प्रस्तुत करते हैं: जम्पस्टार्ट के यूजर इंटरफेस (यूआई) के माध्यम से अमेज़ॅन सैजमेकर स्टूडियो, और प्रोग्राम के माध्यम से जम्पस्टार्ट एपीआई में उपलब्ध है सेजमेकर पायथन एसडीके.

समाधान अवलोकन

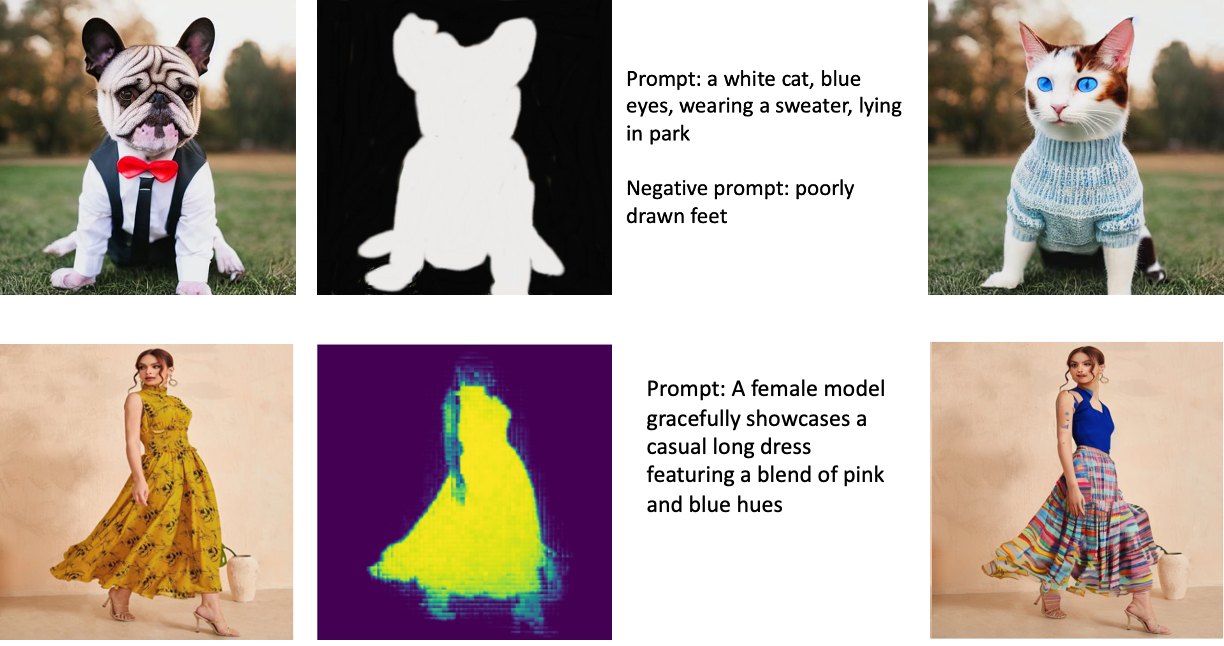

निम्नलिखित चित्र इनपेंटिंग के उदाहरण हैं। मूल छवियां बाईं ओर हैं, मुखौटा छवि केंद्र में है, और मॉडल द्वारा बनाई गई चित्रित छवि दाईं ओर है। पहले उदाहरण के लिए, मॉडल को मूल छवि, एक मुखौटा छवि, और शाब्दिक संकेत "एक सफेद बिल्ली, नीली आँखें, एक स्वेटर पहने हुए, पार्क में पड़ा हुआ" के साथ-साथ नकारात्मक संकेत "खराब ढंग से खींचे गए पैर" के साथ प्रदान किया गया था। ” दूसरे उदाहरण के लिए, पाठ्य संकेत था "एक महिला मॉडल गुलाबी और नीले रंग के मिश्रण वाली एक आरामदायक लंबी पोशाक दिखाती है,"

स्टेबल डिफ्यूजन जैसे बड़े मॉडल को चलाने के लिए कस्टम इंट्रेंस स्क्रिप्ट की आवश्यकता होती है। आपको यह सुनिश्चित करने के लिए एंड-टू-एंड टेस्ट चलाना होगा कि स्क्रिप्ट, मॉडल और वांछित उदाहरण एक साथ कुशलता से काम करते हैं। जम्पस्टार्ट उपयोग के लिए तैयार स्क्रिप्ट प्रदान करके इस प्रक्रिया को सरल बनाता है जिनका मजबूत परीक्षण किया गया है। आप इन स्क्रिप्ट को स्टूडियो UI के माध्यम से एक क्लिक के साथ या कोड की बहुत कम पंक्तियों के साथ एक्सेस कर सकते हैं जम्पस्टार्ट एपीआई.

निम्नलिखित खंड आपको स्टूडियो यूआई या जम्पस्टार्ट एपीआई का उपयोग करके मॉडल की तैनाती और अनुमान चलाने के माध्यम से मार्गदर्शन करते हैं।

ध्यान दें कि इस मॉडल का उपयोग करके, आप इससे सहमत हैं क्रिएटिवएमएल ओपन रेल++-एम लाइसेंस.

Studio UI के माध्यम से जम्पस्टार्ट तक पहुँचें

इस खंड में, हम स्टूडियो यूआई का उपयोग करके जम्पस्टार्ट मॉडल के परिनियोजन का वर्णन करते हैं। संलग्न वीडियो जम्पस्टार्ट पर पेंटिंग मॉडल में पूर्व-प्रशिक्षित स्थिर प्रसार का पता लगाने और इसे तैनात करने को प्रदर्शित करता है। मॉडल पृष्ठ मॉडल और उसके उपयोग के बारे में आवश्यक विवरण प्रदान करता है। अनुमान लगाने के लिए, हम ml.p3.2xlarge उदाहरण प्रकार का उपयोग करते हैं, जो कम-विलंबता अनुमान के लिए उचित मूल्य पर आवश्यक GPU त्वरण प्रदान करता है। SageMaker होस्टिंग आवृत्ति कॉन्फ़िगर होने के बाद, चुनें तैनाती. समापन बिंदु चालू होगा और लगभग 10 मिनट के भीतर अनुमान अनुरोधों को संभालने के लिए तैयार होगा।

जम्पस्टार्ट एक नमूना नोटबुक प्रदान करता है जो नए बनाए गए समापन बिंदु पर अनुमान लगाने में लगने वाले समय में तेजी लाने में मदद कर सकता है। स्टूडियो में नोटबुक तक पहुँचने के लिए, चुनें नोटबुक खोलें में Studio से एंडपॉइंट का इस्तेमाल करें मॉडल समापन बिंदु पृष्ठ का अनुभाग।

सेजमेकर एसडीके के साथ प्रोग्रामेटिक रूप से जम्पस्टार्ट का उपयोग करें

जम्पस्टार्ट यूआई का उपयोग करने से आप केवल कुछ ही क्लिक के साथ एक पूर्व-प्रशिक्षित मॉडल को अंतःक्रियात्मक रूप से परिनियोजित कर सकते हैं। वैकल्पिक रूप से, आप SageMaker Python SDK के भीतर एकीकृत API का उपयोग करके जम्पस्टार्ट मॉडल को प्रोग्रामेटिक रूप से नियोजित कर सकते हैं।

इस खंड में, हम जम्पस्टार्ट में एक उपयुक्त पूर्व-प्रशिक्षित मॉडल चुनते हैं, इस मॉडल को एक SageMaker समापन बिंदु पर परिनियोजित करते हैं, और सभी SageMaker Python SDK का उपयोग करके परिनियोजित समापन बिंदु पर निष्कर्ष निकालते हैं। निम्नलिखित उदाहरणों में कोड स्निपेट हैं। इस प्रदर्शन में शामिल सभी चरणों के साथ पूर्ण कोड तक पहुँचने के लिए, देखें जम्पस्टार्ट इमेज एडिटिंग का परिचय - पेंटिंग में स्थिर प्रसार उदाहरण नोटबुक।

पूर्व-प्रशिक्षित मॉडल को तैनात करें

सेजमेकर विभिन्न बिल्ड और रनटाइम कार्यों के लिए डॉकटर कंटेनरों का उपयोग करता है। जम्पस्टार्ट इसका उपयोग करता है सेजमेकर डीप लर्निंग कंटेनर (डीएलसी) जो ढांचे-विशिष्ट हैं। हम पहले किसी भी अतिरिक्त पैकेज के साथ-साथ चयनित कार्य के लिए प्रशिक्षण और अनुमान को संभालने के लिए स्क्रिप्ट प्राप्त करते हैं। फिर पूर्व-प्रशिक्षित मॉडल कलाकृतियों को अलग से लाया जाता है model_uris, जो प्लेटफॉर्म को लचीलापन प्रदान करता है। यह कई पूर्व-प्रशिक्षित मॉडलों को एकल अनुमान स्क्रिप्ट के साथ उपयोग करने की अनुमति देता है। निम्नलिखित कोड इस प्रक्रिया को दिखाता है:

अगला, हम उन संसाधनों को a को प्रदान करते हैं सेजमेकर मॉडल उदाहरण और एक समापन बिंदु तैनात करें:

मॉडल को तैनात करने के बाद, हम इससे वास्तविक समय की भविष्यवाणी प्राप्त कर सकते हैं!

निवेश

इनपुट आधार छवि, एक मुखौटा छवि, और मुखौटा-बाहर भाग में प्रतिस्थापित किए जाने वाले विषय, वस्तु, या पर्यावरण का वर्णन करने वाला संकेत है। इन-पेंटिंग प्रभावों के लिए सही मुखौटा छवि बनाने में कई सर्वोत्तम अभ्यास शामिल हैं। एक विशिष्ट संकेत के साथ प्रारंभ करें, और वांछित परिणाम प्राप्त करने के लिए विभिन्न स्थिर प्रसार सेटिंग्स के साथ प्रयोग करने में संकोच न करें। ऐसी मास्क छवि का उपयोग करें जो उस छवि से बहुत मिलती-जुलती हो जिसे आप पेंट करना चाहते हैं। यह दृष्टिकोण इनपेंटिंग एल्गोरिदम को छवि के लापता वर्गों को पूरा करने में सहायता करता है, जिसके परिणामस्वरूप अधिक प्राकृतिक उपस्थिति होती है। उच्च-गुणवत्ता वाली छवियां आमतौर पर बेहतर परिणाम देती हैं, इसलिए सुनिश्चित करें कि आपकी आधार और मुखौटा छवियां अच्छी गुणवत्ता वाली हैं और एक-दूसरे से मिलती-जुलती हैं। इसके अतिरिक्त, विस्तार को संरक्षित करने और कलाकृतियों को कम करने के लिए एक बड़ी और चिकनी मुखौटा छवि का चयन करें।

समापन बिंदु आधार छवि और मुखौटा को कच्चे आरजीबी मान या बेस 64 एन्कोडेड छवि के रूप में स्वीकार करता है। इंट्रेंस हैंडलर इमेज के आधार पर डिकोड करता है content_type:

- के लिए

content_type = “application/json”, इनपुट पेलोड अपरिष्कृत आरजीबी वैल्यू, टेक्स्टुअल प्रॉम्प्ट और अन्य वैकल्पिक पैरामीटर के साथ एक JSON डिक्शनरी होना चाहिए - के लिए

content_type = “application/json;jpeg”, इनपुट पेलोड एक JSON डिक्शनरी होना चाहिए जिसमें बेस 64 एन्कोडेड इमेज, एक टेक्स्टुअल प्रॉम्प्ट और अन्य वैकल्पिक पैरामीटर हों

उत्पादन

समापन बिंदु दो प्रकार के आउटपुट उत्पन्न कर सकता है: एक बेस 64-एन्कोडेड आरजीबी छवि या उत्पन्न छवियों का एक JSON शब्दकोश। आप निर्दिष्ट कर सकते हैं कि आप कौन सा आउटपुट स्वरूप सेट करके चाहते हैं accept करने के लिए शीर्ष लेख "application/json" or "application/json;jpeg" जेपीईजी छवि या बेस 64 के लिए क्रमशः।

- के लिए

accept = “application/json”, समापन बिंदु छवि के लिए RGB मानों के साथ एक JSON शब्दकोश लौटाता है - के लिए

accept = “application/json;jpeg”, एंडपॉइंट JPEG छवि के साथ एक JSON डिक्शनरी लौटाता है, जो बेस64.b64 एन्कोडिंग के साथ एन्कोडेड बाइट है

ध्यान दें कि कच्चे आरजीबी मूल्यों के साथ पेलोड भेजने या प्राप्त करने से इनपुट पेलोड और प्रतिक्रिया आकार के लिए डिफ़ॉल्ट सीमाएं प्रभावित हो सकती हैं। इसलिए, हम सेटिंग करके बेस 64 एन्कोडेड छवि का उपयोग करने की सलाह देते हैं content_type = “application/json;jpeg” और स्वीकार करें = "आवेदन/जेसन; जेपीईजी"।

निम्नलिखित कोड एक उदाहरण अनुमान अनुरोध है:

समर्थित पैरामीटर

पेंटिंग मॉडल में स्थिर प्रसार छवि निर्माण के लिए कई मापदंडों का समर्थन करता है:

- की छवि - मूल छवि।

- मुखौटा - एक छवि जहां छवि निर्माण के दौरान काले रंग का भाग अपरिवर्तित रहता है और सफेद भाग को बदल दिया जाता है।

- शीघ्र - छवि निर्माण का मार्गदर्शन करने के लिए एक संकेत। यह एक स्ट्रिंग या स्ट्रिंग्स की सूची हो सकती है।

- num_inference_steps (वैकल्पिक) - छवि निर्माण के दौरान denoising कदमों की संख्या। अधिक कदम उच्च गुणवत्ता वाली छवि की ओर ले जाते हैं। यदि निर्दिष्ट किया गया है, तो यह एक धनात्मक पूर्णांक होना चाहिए। ध्यान दें कि अधिक निष्कर्ष कदमों से प्रतिक्रिया समय लंबा हो जाएगा।

- मार्गदर्शन_स्केल (वैकल्पिक) - एक उच्च मार्गदर्शन पैमाना छवि गुणवत्ता की कीमत पर एक छवि को संकेत से अधिक निकटता से संबंधित बनाता है। यदि निर्दिष्ट किया गया है, तो यह एक फ्लोट होना चाहिए।

guidance_scale<=1नजरअंदाज कर दिया है। - नकारात्मक_प्रॉम्प्ट (वैकल्पिक) - यह इस संकेत के खिलाफ छवि निर्माण का मार्गदर्शन करता है। यदि निर्दिष्ट किया गया है, तो यह एक स्ट्रिंग या स्ट्रिंग्स की सूची होनी चाहिए और इसके साथ प्रयोग किया जाना चाहिए

guidance_scale. अगरguidance_scaleअक्षम है, यह भी अक्षम है। इसके अलावा, अगर प्रॉम्प्ट स्ट्रिंग्स की एक सूची है, तोnegative_promptतार की एक सूची भी होनी चाहिए। - बीज (वैकल्पिक) - यह पुनरुत्पादन के लिए यादृच्छिक स्थिति को ठीक करता है। यदि निर्दिष्ट किया गया है, तो यह एक पूर्णांक होना चाहिए। जब भी आप एक ही बीज के साथ एक ही संकेत का उपयोग करते हैं, परिणामी छवि हमेशा एक जैसी होगी।

- बैच_साइज़ (वैकल्पिक) - एकल फ़ॉरवर्ड पास में उत्पन्न होने वाली छवियों की संख्या। यदि एक छोटे उदाहरण का उपयोग कर रहे हैं या कई छवियां बना रहे हैं, तो कम करें

batch_sizeएक छोटी संख्या होना (1-2)। छवियों की संख्या = संकेतों की संख्या*num_images_per_prompt.

सीमाएं और पक्षपात

भले ही स्टेबल डिफ्यूजन का इनपेंटिंग में प्रभावशाली प्रदर्शन है, यह कई सीमाओं और पूर्वाग्रहों से ग्रस्त है। इनमें शामिल हैं लेकिन इन तक सीमित नहीं हैं:

- मॉडल सटीक चेहरे या अंग उत्पन्न नहीं कर सकता है क्योंकि प्रशिक्षण डेटा में इन सुविधाओं के साथ पर्याप्त चित्र शामिल नहीं हैं।

- मॉडल को प्रशिक्षित किया गया था LAION-5B डेटासेट, जिसमें वयस्क सामग्री है और बिना किसी और विचार के उत्पाद के उपयोग के लिए उपयुक्त नहीं हो सकता है।

- मॉडल गैर-अंग्रेजी भाषाओं के साथ अच्छी तरह से काम नहीं कर सकता क्योंकि मॉडल को अंग्रेजी भाषा के पाठ पर प्रशिक्षित किया गया था।

- मॉडल छवियों के भीतर अच्छा पाठ उत्पन्न नहीं कर सकता।

- पेंटिंग में स्थिर प्रसार आमतौर पर 256×256 या 512×512 पिक्सेल जैसे कम रिज़ॉल्यूशन वाली छवियों के साथ सबसे अच्छा काम करता है। उच्च-रिज़ॉल्यूशन छवियों (768 × 768 या उच्चतर) के साथ काम करते समय, गुणवत्ता और विवरण के वांछित स्तर को बनाए रखने के लिए विधि संघर्ष कर सकती है।

- यद्यपि एक बीज का उपयोग पुनरुत्पादन को नियंत्रित करने में मदद कर सकता है, फिर भी इनपुट या पैरामीटर में मामूली बदलाव के साथ स्थिर प्रसार में विभिन्न परिणाम उत्पन्न हो सकते हैं। यह विशिष्ट आवश्यकताओं के लिए आउटपुट को फ़ाइन-ट्यून करना चुनौतीपूर्ण बना सकता है।

- विधि जटिल बनावट और पैटर्न उत्पन्न करने के साथ संघर्ष कर सकती है, विशेष रूप से जब वे छवि के भीतर बड़े क्षेत्रों में फैले हों या चित्रित क्षेत्र की समग्र सुसंगतता और गुणवत्ता को बनाए रखने के लिए आवश्यक हों।

सीमाओं और पक्षपात के बारे में अधिक जानकारी के लिए देखें स्थिर प्रसार इनपेंटिंग मॉडल कार्ड.

एक संकेत के माध्यम से उत्पन्न मास्क के साथ इनपेंटिंग समाधान

CLIPSeq एक उन्नत गहन शिक्षण तकनीक है जो इनपुट छवियों से मास्क उत्पन्न करने के लिए पूर्व-प्रशिक्षित CLIP (कंट्रास्टिव लैंग्वेज-इमेज प्रीट्रेनिंग) मॉडल की शक्ति का उपयोग करती है। यह दृष्टिकोण छवि विभाजन, पेंटिंग और हेरफेर जैसे कार्यों के लिए मास्क बनाने का एक कुशल तरीका प्रदान करता है। CLIPSeq इनपुट छवि का पाठ विवरण उत्पन्न करने के लिए CLIP का उपयोग करता है। पाठ विवरण का उपयोग तब एक मुखौटा उत्पन्न करने के लिए किया जाता है जो छवि में उन पिक्सेल की पहचान करता है जो पाठ विवरण के लिए प्रासंगिक हैं। आगे की प्रक्रिया के लिए छवि के प्रासंगिक भागों को अलग करने के लिए मुखौटा का उपयोग किया जा सकता है।

इनपुट छवियों से मास्क बनाने के अन्य तरीकों की तुलना में CLIPSeq के कई फायदे हैं। सबसे पहले, यह एक अधिक कुशल विधि है, क्योंकि इसमें छवि को एक अलग छवि विभाजन एल्गोरिथम द्वारा संसाधित करने की आवश्यकता नहीं होती है। दूसरा, यह अधिक सटीक है, क्योंकि यह ऐसे मास्क उत्पन्न कर सकता है जो छवि के पाठ विवरण के साथ अधिक निकटता से संरेखित हों। तीसरा, यह अधिक बहुमुखी है, क्योंकि आप इसका उपयोग विभिन्न प्रकार की छवियों से मास्क बनाने के लिए कर सकते हैं।

हालाँकि, CLIPSeq के कुछ नुकसान भी हैं। सबसे पहले, तकनीक की विषय वस्तु के संदर्भ में सीमाएँ हो सकती हैं, क्योंकि यह पूर्व-प्रशिक्षित CLIP मॉडल पर निर्भर करती है जो विशिष्ट डोमेन या विशेषज्ञता के क्षेत्रों को शामिल नहीं कर सकती है। दूसरा, यह एक संवेदनशील तरीका हो सकता है, क्योंकि यह छवि के पाठ विवरण में त्रुटियों के प्रति संवेदनशील है।

अधिक जानकारी के लिए, देखें Amazon SageMaker का उपयोग करके जनरेटिव AI के साथ वर्चुअल फ़ैशन स्टाइलिंग.

क्लीन अप

नोटबुक चलाने के बाद, यह सुनिश्चित करने के लिए कि बिलिंग बंद हो गई है, प्रक्रिया में बनाए गए सभी संसाधनों को हटाना सुनिश्चित करें। एंडपॉइंट को साफ करने के लिए कोड संबंधित में उपलब्ध है नोटबुक.

निष्कर्ष

इस पोस्ट में, हमने दिखाया कि जम्पस्टार्ट का उपयोग करके पेंटिंग मॉडल में पूर्व-प्रशिक्षित स्थिर प्रसार को कैसे तैनात किया जाए। हमने इस पोस्ट में कोड स्निपेट दिखाया है—इस डेमो के सभी चरणों के साथ पूरा कोड जम्पस्टार्ट का परिचय - संकेत द्वारा निर्देशित छवि गुणवत्ता बढ़ाएँ उदाहरण नोटबुक। अपने आप समाधान का प्रयास करें और हमें अपनी टिप्पणियां भेजें।

मॉडल के बारे में और यह कैसे काम करता है, इसके बारे में अधिक जानने के लिए, निम्नलिखित संसाधन देखें:

जम्पस्टार्ट के बारे में अधिक जानने के लिए, निम्नलिखित पोस्ट देखें:

लेखक के बारे में

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

अल्फ्रेड शेन AWS में एक वरिष्ठ AI/ML विशेषज्ञ हैं। वह सिलिकॉन वैली में स्वास्थ्य सेवा, वित्त और उच्च तकनीक सहित विभिन्न क्षेत्रों में तकनीकी और प्रबंधकीय पदों पर काम कर रहे हैं। वह सीवी, एनएलपी और मल्टीमॉडलिटी पर ध्यान केंद्रित करने वाला एक समर्पित एप्लाइड एआई/एमएल शोधकर्ता है। उनके काम को ईएमएनएलपी, आईसीएलआर और पब्लिक हेल्थ जैसे प्रकाशनों में प्रदर्शित किया गया है।

अल्फ्रेड शेन AWS में एक वरिष्ठ AI/ML विशेषज्ञ हैं। वह सिलिकॉन वैली में स्वास्थ्य सेवा, वित्त और उच्च तकनीक सहित विभिन्न क्षेत्रों में तकनीकी और प्रबंधकीय पदों पर काम कर रहे हैं। वह सीवी, एनएलपी और मल्टीमॉडलिटी पर ध्यान केंद्रित करने वाला एक समर्पित एप्लाइड एआई/एमएल शोधकर्ता है। उनके काम को ईएमएनएलपी, आईसीएलआर और पब्लिक हेल्थ जैसे प्रकाशनों में प्रदर्शित किया गया है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/inpaint-images-with-stable-diffusion-using-amazon-sagemaker-jumpstart/

- :है

- $यूपी

- 10

- 100

- 2022

- 7

- a

- About

- में तेजी लाने के

- स्वीकार करें

- स्वीकार करता है

- पहुँच

- शुद्धता

- सही

- पाना

- सक्रिय

- अतिरिक्त

- इसके अतिरिक्त

- वयस्क

- उन्नत

- फायदे

- सस्ती

- बाद

- के खिलाफ

- AI

- ऐ / एमएल

- एड्स

- कलन विधि

- गठबंधन

- सब

- की अनुमति देता है

- हमेशा

- वीरांगना

- अमेज़न SageMaker

- अमेज़न SageMaker जम्पस्टार्ट

- और

- अन्य

- एपीआई

- एपीआई

- लागू

- दृष्टिकोण

- उपयुक्त

- लगभग

- वास्तु

- हैं

- क्षेत्र

- क्षेत्रों के बारे में जानकारी का उपयोग करके ट्रेडिंग कर सकते हैं।

- AS

- At

- स्वतः

- उपलब्ध

- एडब्ल्यूएस

- आधार

- आधारित

- BE

- क्योंकि

- BEST

- सर्वोत्तम प्रथाओं

- बेहतर

- पूर्वाग्रह

- बिलिंग

- मिश्रण

- नीला

- निर्माण

- इमारत

- by

- कर सकते हैं

- मामला

- आकस्मिक

- कैट

- के कारण

- केंद्र

- कुछ

- चुनौतीपूर्ण

- चेक

- चुनें

- कक्षा

- क्लिक करें

- क्लिनिकल

- निकट से

- कोड

- टिप्पणियाँ

- पूरा

- पूरा

- व्यापक

- सम्मेलनों

- विचार

- निर्माण

- शामिल

- कंटेनर

- कंटेनरों

- सामग्री

- नियंत्रण

- बनाना

- बनाया

- बनाना

- रिवाज

- ग्राहक

- तिथि

- डेटा हानि

- समर्पित

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- चूक

- बचाता है

- दर्शाता

- तैनात

- तैनात

- तैनाती

- तैनाती

- वर्णित

- विवरण

- डिज़ाइन

- वांछित

- विस्तार

- विवरण

- प्रसार

- विकलांग

- कई

- डाक में काम करनेवाला मज़दूर

- नहीं करता है

- डोमेन

- dont

- दौरान

- से प्रत्येक

- प्रभावी रूप से

- प्रभाव

- कुशल

- कुशलता

- भी

- सक्षम बनाता है

- शुरू से अंत तक

- endpoint

- अंग्रेज़ी

- सुनिश्चित

- प्रविष्टि

- वातावरण

- त्रुटियाँ

- विशेष रूप से

- आवश्यक

- उदाहरण

- उदाहरण

- उत्तेजित

- प्रयोग

- विशेषज्ञता

- आंखें

- चेहरे के

- फैशन

- Feature

- विशेषताएं

- की विशेषता

- पैर

- महिला

- लाए गए

- कुछ

- पट्टिका

- वित्त

- प्रथम

- फिट

- लचीलापन

- नाव

- निम्नलिखित

- के लिए

- प्रारूप

- आगे

- से

- पूर्ण

- आगे

- आम तौर पर

- उत्पन्न

- उत्पन्न

- सृजन

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- जॉर्जिया

- अच्छा

- GPU

- मार्गदर्शन

- गाइड

- मार्गदर्शिकाएँ

- संभालना

- है

- सिर

- स्वास्थ्य

- स्वास्थ्य सेवा

- मदद

- उच्च गुणवत्ता

- उच्च संकल्प

- उच्चतर

- मारो

- पकड़े

- होस्टिंग

- कैसे

- How To

- एचटीएमएल

- HTTPS

- पहचानती

- इलेनॉइस

- की छवि

- छवियों

- इमेजिंग

- प्रभावशाली

- in

- शामिल

- शामिल

- सहित

- करें-

- निवेश

- उदाहरण

- एकीकृत

- इंटरफेस

- परिचय कराना

- IT

- आईटी इस

- जेपीजी

- JSON

- भाषा

- भाषाऐं

- बड़ा

- नेतृत्व

- जानें

- सीख रहा हूँ

- स्तर

- पसंद

- सीमाओं

- सीमित

- सीमाएं

- पंक्तियां

- सूची

- लंबा

- लंबे समय तक

- बंद

- मशीन

- यंत्र अधिगम

- बनाए रखना

- को बनाए रखने के

- बनाना

- प्रबंधकीय

- जोड़ - तोड़

- बहुत

- मुखौटा

- मास्क

- बात

- मई..

- तरीका

- तरीकों

- हो सकता है

- मिनटों

- लापता

- कम करना

- ML

- आदर्श

- मॉडल

- अधिक

- अधिक कुशल

- और भी

- एम आर आई

- विभिन्न

- प्राकृतिक

- आवश्यकता

- नकारात्मक

- नया

- NLP

- नोटबुक

- उपन्यास

- नवंबर

- संख्या

- वस्तु

- प्राप्त

- of

- ऑफर

- on

- ONE

- खुला

- परिचालन

- आदेश

- मूल

- अन्य

- रूपरेखा

- उत्पादन

- कुल

- अपना

- संकुल

- पृष्ठ

- कागजात

- पैरामीटर

- पार्क

- भागों

- पास

- पैटर्न उपयोग करें

- उत्तम

- निष्पादन

- प्रदर्शन

- मंच

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- बिन्दु

- पदों

- सकारात्मक

- पद

- पोस्ट

- बिजली

- प्रथाओं

- ठीक

- भविष्यवाणियों

- Predictor

- तैयार

- वर्तमान

- मूल्य

- प्रक्रिया

- प्रसंस्कृत

- प्रसंस्करण

- उत्पादन

- एस्ट्रो मॉल

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- सार्वजनिक

- सार्वजनिक स्वास्थ्य

- प्रकाशनों

- प्रकाशित

- अजगर

- गुणवत्ता

- यादृच्छिक

- कच्चा

- वास्तविक समय

- क्षेत्र

- प्राप्त

- की सिफारिश

- को कम करने

- घटी

- संदर्भित करता है

- क्षेत्र

- सम्बंधित

- प्रासंगिक

- बाकी है

- मरम्मत

- प्रतिस्थापित

- का अनुरोध

- अनुरोधों

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकताएँ

- की आवश्यकता होती है

- शोधकर्ता

- जैसा दिखता है

- उपयुक्त संसाधन चुनें

- प्रतिक्रिया

- बहाल

- जिसके परिणामस्वरूप

- परिणाम

- वापसी

- रिटर्न

- आरजीबी

- रन

- दौड़ना

- sagemaker

- वही

- स्केल

- वैज्ञानिक

- लिपियों

- एसडीके

- दूसरा

- अनुभाग

- वर्गों

- सेक्टर्स

- बीज

- विभाजन

- चयनित

- भेजना

- वरिष्ठ

- संवेदनशील

- अलग

- की स्थापना

- सेटिंग्स

- कई

- सिलिकॉन

- सिलिकॉन वैली

- एक

- आकार

- छोटा

- छोटे

- So

- समाधान

- कुछ

- विस्तार

- विशेषज्ञ

- विशिष्ट

- विनिर्दिष्ट

- स्थिर

- प्रारंभ

- राज्य

- कदम

- फिर भी

- रोक

- तार

- संघर्ष

- स्टूडियो

- विषय

- ऐसा

- पीड़ित

- पर्याप्त

- समर्थन

- उपयुक्त

- लेता है

- कार्य

- कार्य

- टीम

- तकनीक

- तकनीकी

- शर्तों

- परीक्षण

- कि

- RSI

- इसलिये

- इन

- तीसरा

- यहाँ

- पहर

- सेवा मेरे

- आज

- एक साथ

- प्रशिक्षित

- प्रशिक्षण

- प्रकार

- आम तौर पर

- ui

- विश्वविद्यालय

- us

- प्रयोग

- उपयोग

- उपयोगकर्ता

- यूजर इंटरफेस

- उपयोगकर्ताओं

- उपयोग

- इस्तेमाल

- घाटी

- मान

- विविधता

- विभिन्न

- बहुमुखी

- के माध्यम से

- वीडियो

- मार्ग..

- कुंआ

- कौन कौन से

- सफेद

- चौड़ा

- मर्जी

- साथ में

- अंदर

- बिना

- काम

- एक साथ काम करो

- काम कर रहे

- कार्य

- प्राप्ति

- आप

- आपका

- जेफिरनेट