आज, हमें यह घोषणा करते हुए खुशी हो रही है कि मेटा द्वारा विकसित लामा 2 फाउंडेशन मॉडल ग्राहकों के लिए उपलब्ध हैं अमेज़न SageMaker जम्पस्टार्ट. बड़े भाषा मॉडल (एलएलएम) का लामा 2 परिवार 7 अरब से 70 अरब मापदंडों के पैमाने पर पूर्व-प्रशिक्षित और ठीक-ठीक जेनरेटिव टेक्स्ट मॉडल का एक संग्रह है। फाइन-ट्यून किए गए एलएलएम, जिन्हें लामा-2-चैट कहा जाता है, संवाद उपयोग के मामलों के लिए अनुकूलित हैं। आप इन मॉडलों को आसानी से आज़मा सकते हैं और सेजमेकर जंपस्टार्ट के साथ उनका उपयोग कर सकते हैं, जो एक मशीन लर्निंग (एमएल) हब है जो एल्गोरिदम, मॉडल और एमएल समाधान तक पहुंच प्रदान करता है ताकि आप जल्दी से एमएल के साथ शुरुआत कर सकें।

इस पोस्ट में, हम सेजमेकर जम्पस्टार्ट के माध्यम से लामा 2 मॉडल का उपयोग करने के तरीके के बारे में जानेंगे।

लामा 2 क्या है?

लामा 2 एक ऑटो-रिग्रेसिव भाषा मॉडल है जो एक अनुकूलित ट्रांसफार्मर आर्किटेक्चर का उपयोग करता है। लामा 2 अंग्रेजी में व्यावसायिक और अनुसंधान उपयोग के लिए है। यह पैरामीटर आकारों की श्रेणी में आता है - 7 अरब, 13 अरब, और 70 अरब - साथ ही पूर्व-प्रशिक्षित और सुव्यवस्थित विविधताएं। मेटा के अनुसार, ट्यून किए गए संस्करण सहायता और सुरक्षा के लिए मानवीय प्राथमिकताओं को संरेखित करने के लिए पर्यवेक्षित फाइन-ट्यूनिंग (एसएफटी) और मानव प्रतिक्रिया (आरएलएचएफ) के साथ सुदृढीकरण सीखने का उपयोग करते हैं। लामा 2 को सार्वजनिक रूप से उपलब्ध स्रोतों से 2 ट्रिलियन टोकन डेटा पर पूर्व-प्रशिक्षित किया गया था। ट्यून किए गए मॉडल सहायक-जैसी चैट के लिए अभिप्रेत हैं, जबकि पूर्व-प्रशिक्षित मॉडल को विभिन्न प्राकृतिक भाषा निर्माण कार्यों के लिए अनुकूलित किया जा सकता है। इस बात पर ध्यान दिए बिना कि डेवलपर मॉडल के किस संस्करण का उपयोग करता है मेटा से जिम्मेदार उपयोग मार्गदर्शिका अतिरिक्त फ़ाइन-ट्यूनिंग का मार्गदर्शन करने में सहायता कर सकता है जो उचित सुरक्षा शमन के साथ मॉडलों को अनुकूलित और अनुकूलित करने के लिए आवश्यक हो सकता है।

सेजमेकर जम्पस्टार्ट क्या है?

सेजमेकर जम्पस्टार्ट के साथ, एमएल व्यवसायी ओपन सोर्स फाउंडेशन मॉडल के व्यापक चयन में से चुन सकते हैं। एमएल प्रैक्टिशनर फाउंडेशन मॉडल को समर्पित करने के लिए तैनात कर सकते हैं अमेज़न SageMaker नेटवर्क पृथक वातावरण से उदाहरण और मॉडल प्रशिक्षण और तैनाती के लिए सेजमेकर का उपयोग करके मॉडल को अनुकूलित करें।

अब आप कुछ ही क्लिक में लामा 2 को खोज और तैनात कर सकते हैं अमेज़ॅन सैजमेकर स्टूडियो या सेजमेकर पायथन एसडीके के माध्यम से प्रोग्रामेटिक रूप से, आपको सेजमेकर सुविधाओं के साथ मॉडल प्रदर्शन और एमएलओपीएस नियंत्रण प्राप्त करने में सक्षम बनाता है जैसे अमेज़न SageMaker पाइपलाइन, अमेज़न SageMaker डिबगर, या कंटेनर लॉग। मॉडल को AWS सुरक्षित वातावरण में और आपके VPC नियंत्रण में तैनात किया गया है, जिससे डेटा सुरक्षा सुनिश्चित करने में मदद मिलती है। लामा 2 मॉडल आज शुरुआत में अमेज़न सेजमेकर स्टूडियो में उपलब्ध हैं us-east 1 और us-west 2 क्षेत्रों के।

मॉडल खोजें

आप सेजमेकर स्टूडियो यूआई और सेजमेकर पायथन एसडीके में सेजमेकर जम्पस्टार्ट के माध्यम से फाउंडेशन मॉडल तक पहुंच सकते हैं। इस अनुभाग में, हम सेजमेकर स्टूडियो में मॉडलों की खोज कैसे करें, इसके बारे में जानेंगे।

सेजमेकर स्टूडियो एक एकीकृत विकास वातावरण (आईडीई) है जो एकल वेब-आधारित विज़ुअल इंटरफ़ेस प्रदान करता है जहां आप डेटा तैयार करने से लेकर निर्माण, प्रशिक्षण और अपने एमएल मॉडल को तैनात करने तक सभी एमएल विकास चरणों को करने के लिए उद्देश्य-निर्मित टूल तक पहुंच सकते हैं। सेजमेकर स्टूडियो कैसे शुरू करें और स्थापित करें, इसके बारे में अधिक जानकारी के लिए देखें अमेज़ॅन सैजमेकर स्टूडियो.

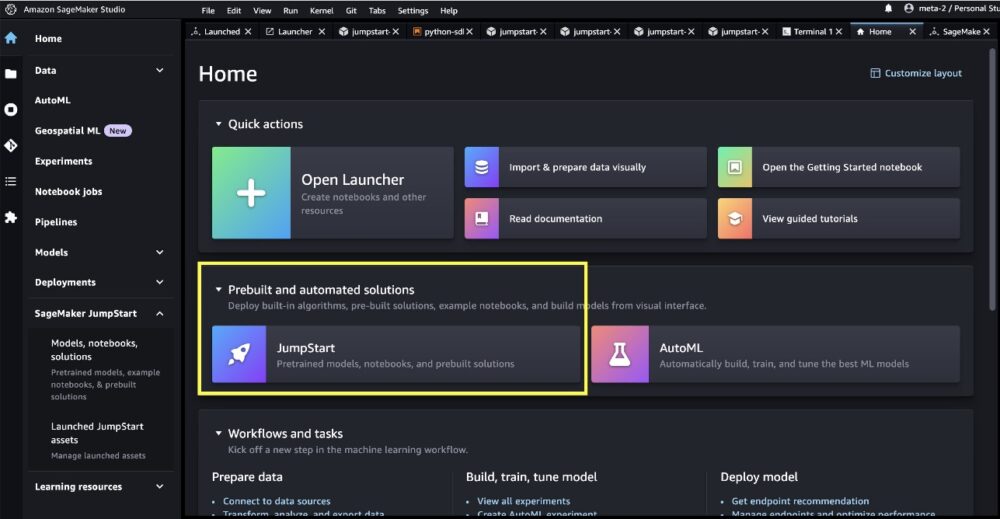

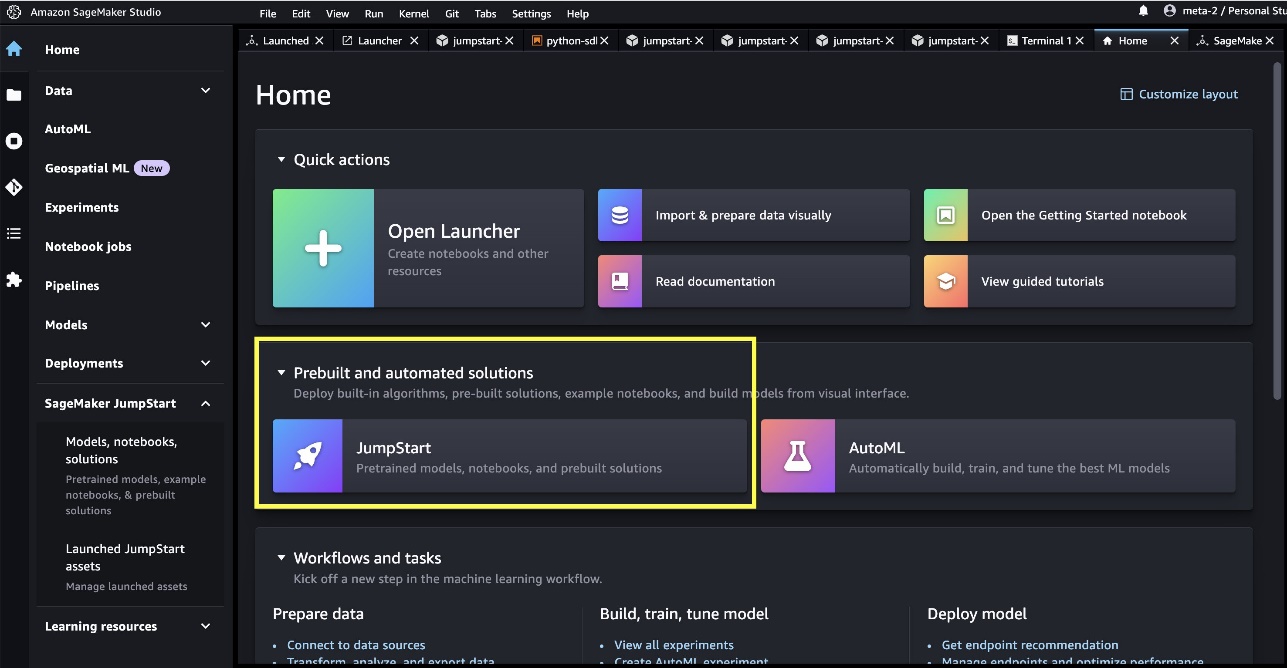

एक बार जब आप सेजमेकर स्टूडियो पर हों, तो आप सेजमेकर जम्पस्टार्ट तक पहुंच सकते हैं, जिसमें पूर्व-प्रशिक्षित मॉडल, नोटबुक और पूर्वनिर्मित समाधान शामिल हैं। पूर्वनिर्मित और स्वचालित समाधान.

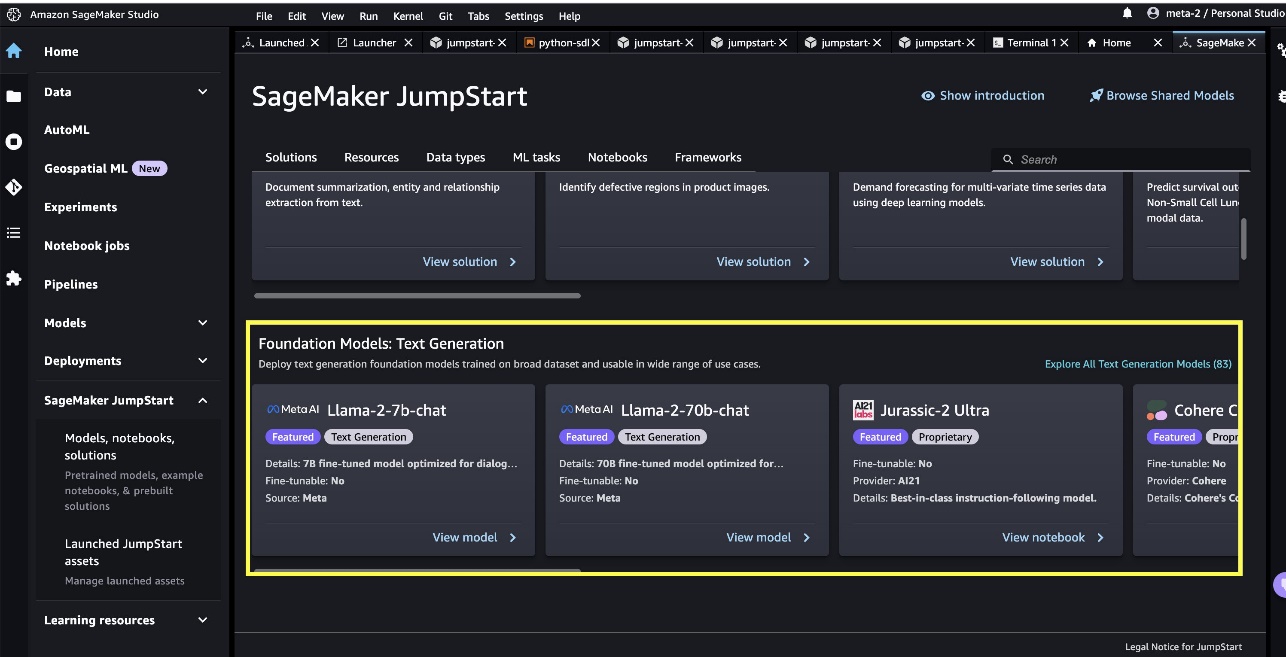

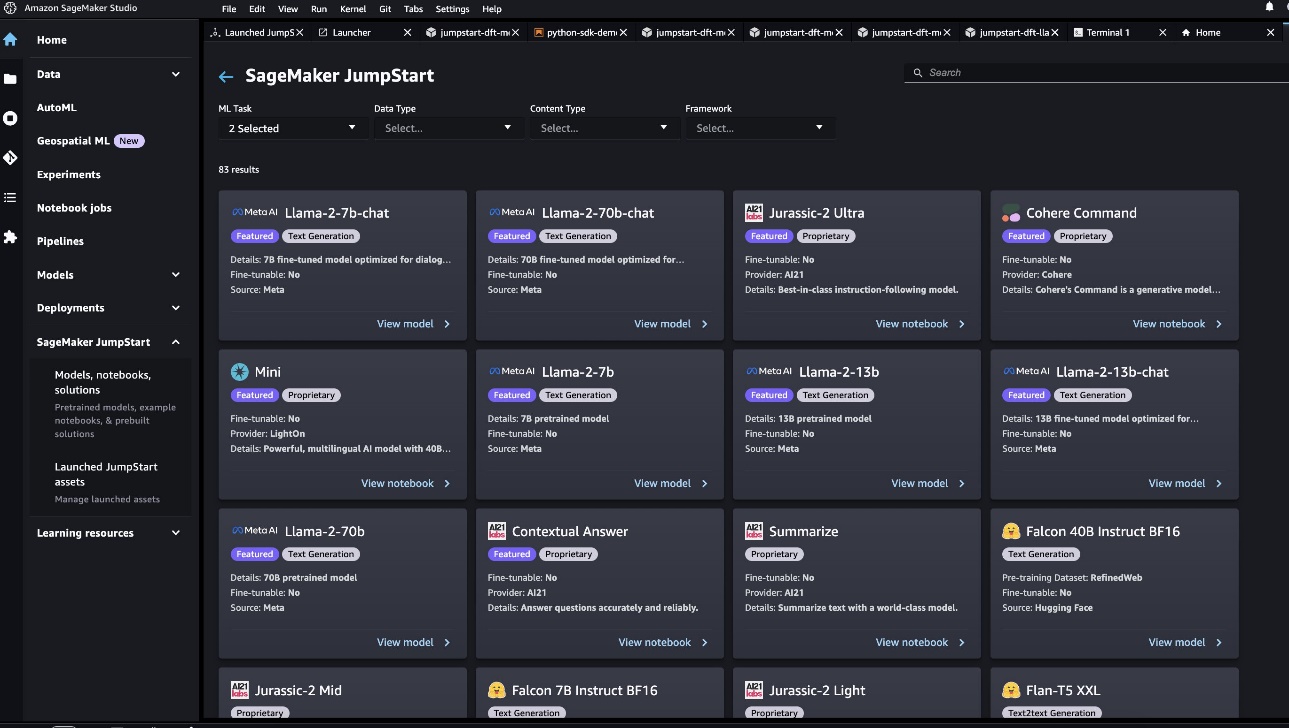

सेजमेकर जम्पस्टार्ट लैंडिंग पृष्ठ से, आप समाधान, मॉडल, नोटबुक और अन्य संसाधन ब्राउज़ कर सकते हैं। आप इसमें दो प्रमुख लामा 2 मॉडल पा सकते हैं फाउंडेशन मॉडल: टेक्स्ट जनरेशन हिंडोला. यदि आपको लामा 2 मॉडल दिखाई नहीं देते हैं, तो बंद करके और पुनः आरंभ करके अपने सेजमेकर स्टूडियो संस्करण को अपडेट करें। संस्करण अपडेट के बारे में अधिक जानकारी के लिए देखें स्टूडियो ऐप्स बंद करें और अपडेट करें.

आप चुनकर अन्य चार मॉडल वेरिएंट भी पा सकते हैं सभी टेक्स्ट जेनरेशन मॉडल का अन्वेषण करें या खोज रहे हैं llama खोज बॉक्स में

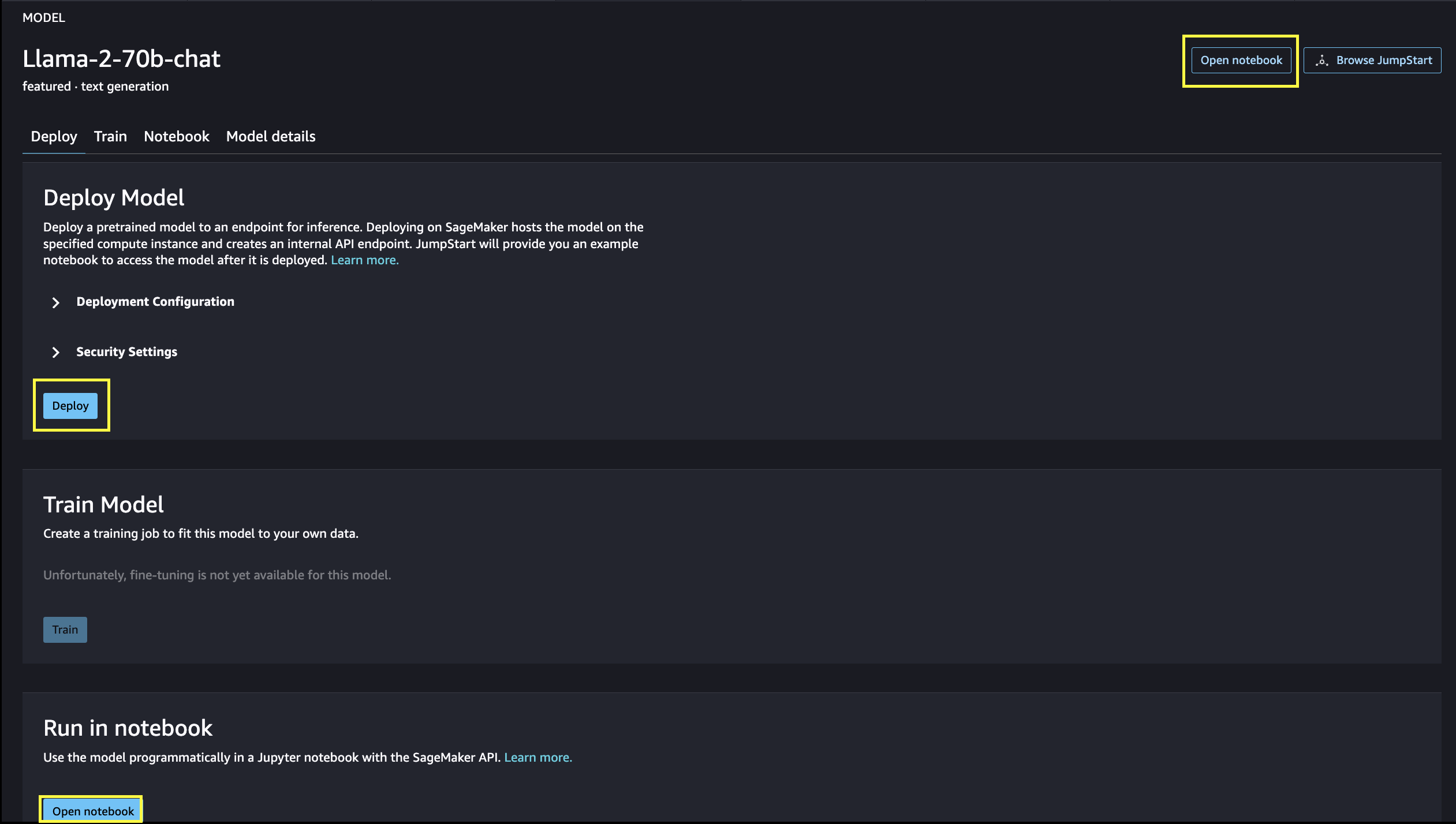

आप मॉडल के बारे में विवरण देखने के लिए मॉडल कार्ड चुन सकते हैं जैसे लाइसेंस, प्रशिक्षण के लिए उपयोग किया गया डेटा और उपयोग कैसे करें। आप दो बटन भी पा सकते हैं, तैनाती और नोटबुक खोलें, जो आपको मॉडल का उपयोग करने में मदद करता है।

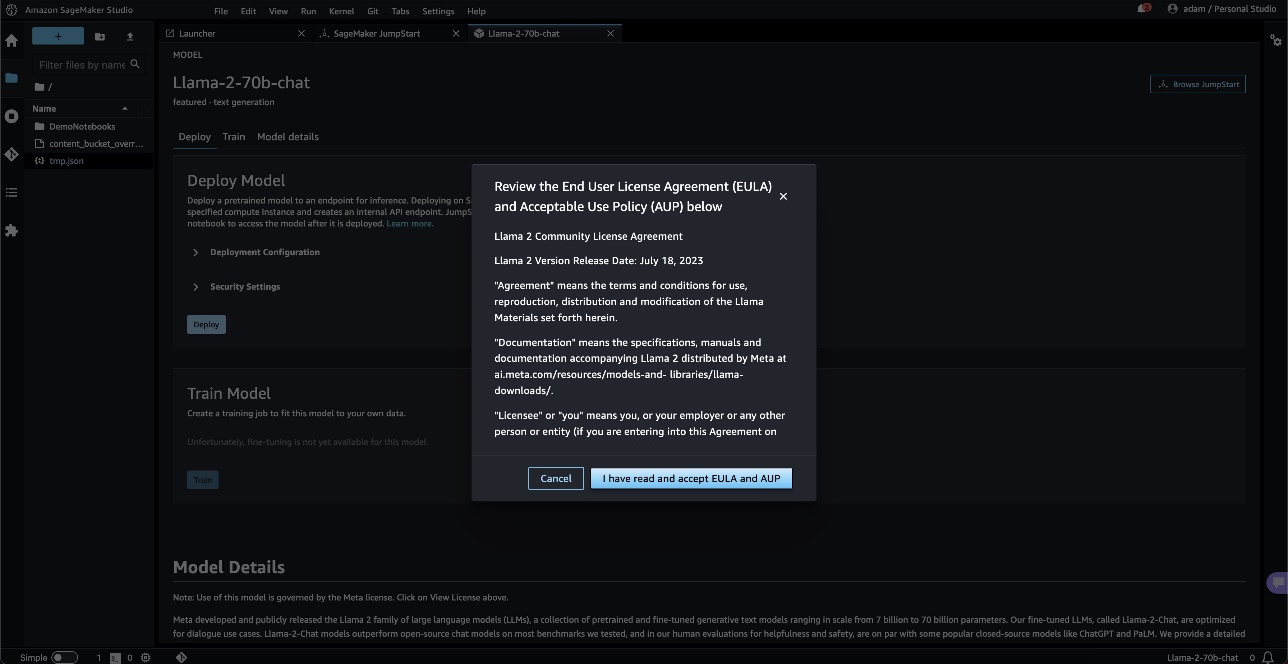

जब आप कोई भी बटन चुनते हैं, तो एक पॉप-अप आपको स्वीकार करने के लिए अंतिम-उपयोगकर्ता लाइसेंस अनुबंध और स्वीकार्य उपयोग नीति दिखाएगा।

स्वीकार करने पर, आप मॉडल का उपयोग करने के लिए अगले चरण पर आगे बढ़ेंगे।

एक मॉडल तैनात करें

जब आप चुनते हैं तैनाती और शर्तें स्वीकार करें, मॉडल परिनियोजन शुरू हो जाएगा। वैकल्पिक रूप से, आप उदाहरण नोटबुक के माध्यम से तैनात कर सकते हैं जो चुनने पर दिखाई देता है नोटबुक खोलें. उदाहरण नोटबुक अनुमान लगाने और संसाधनों को साफ करने के लिए मॉडल को कैसे तैनात किया जाए, इस पर शुरू से अंत तक मार्गदर्शन प्रदान करता है।

नोटबुक का उपयोग करके तैनात करने के लिए, हम द्वारा निर्दिष्ट एक उपयुक्त मॉडल का चयन करके शुरुआत करते हैं model_id. आप निम्नलिखित कोड के साथ सेजमेकर पर किसी भी चयनित मॉडल को तैनात कर सकते हैं:

यह मॉडल को सेजमेकर पर डिफ़ॉल्ट कॉन्फ़िगरेशन के साथ तैनात करता है, जिसमें डिफ़ॉल्ट इंस्टेंस प्रकार और डिफ़ॉल्ट वीपीसी कॉन्फ़िगरेशन शामिल हैं। आप गैर-डिफ़ॉल्ट मान निर्दिष्ट करके इन कॉन्फ़िगरेशन को बदल सकते हैं जम्पस्टार्टमॉडल. इसे तैनात करने के बाद, आप सेजमेकर भविष्यवक्ता के माध्यम से तैनात समापन बिंदु के खिलाफ अनुमान चला सकते हैं:

फाइन-ट्यून किए गए चैट मॉडल (Llama-2-7b-chat, Llama-2-13b-chat, Llama-2-70b-chat) उपयोगकर्ता और चैट सहायक के बीच चैट के इतिहास को स्वीकार करते हैं, और बाद की चैट उत्पन्न करते हैं। पूर्व-प्रशिक्षित मॉडल (Llama-2-7b, Llama-2-13b, Llama-2-70b) को एक स्ट्रिंग प्रॉम्प्ट की आवश्यकता होती है और दिए गए प्रॉम्प्ट पर टेक्स्ट पूरा करना होता है। निम्नलिखित कोड देखें:

ध्यान दें कि डिफ़ॉल्ट रूप से, accept_eula गलत पर सेट है. आपको सेट करना होगा accept_eula=true समापन बिंदु को सफलतापूर्वक लागू करने के लिए। ऐसा करके, आप उपयोगकर्ता लाइसेंस अनुबंध और स्वीकार्य उपयोग नीति को स्वीकार करते हैं जैसा कि पहले बताया गया है। आप भी कर सकते हैं डाउनलोड लाइसेंस समझौता.

Custom_attributes EULA को पास करने के लिए कुंजी/मूल्य जोड़े का उपयोग किया जाता है। कुंजी और मान को अलग किया जाता है = और जोड़ियों को अलग किया जाता है ;. यदि उपयोगकर्ता एक ही कुंजी को एक से अधिक बार पास करता है, तो अंतिम मान रखा जाता है और स्क्रिप्ट हैंडलर को भेज दिया जाता है (यानी, इस मामले में, सशर्त तर्क के लिए उपयोग किया जाता है)। उदाहरण के लिए, यदि accept_eula=false; accept_eula=true फिर सर्वर को भेज दिया जाता है accept_eula=true रखा जाता है और स्क्रिप्ट हैंडलर को भेज दिया जाता है।

अनुमान पैरामीटर अंतिम बिंदु पर पाठ निर्माण प्रक्रिया को नियंत्रित करते हैं। अधिकतम नए टोकन नियंत्रण मॉडल द्वारा उत्पन्न आउटपुट के आकार को संदर्भित करता है। ध्यान दें कि यह शब्दों की संख्या के समान नहीं है क्योंकि मॉडल की शब्दावली अंग्रेजी भाषा की शब्दावली के समान नहीं है, और प्रत्येक टोकन अंग्रेजी भाषा का शब्द नहीं हो सकता है। तापमान आउटपुट में यादृच्छिकता को नियंत्रित करता है। उच्च तापमान के परिणामस्वरूप अधिक रचनात्मक और मतिभ्रमपूर्ण आउटपुट मिलते हैं। सभी अनुमान पैरामीटर वैकल्पिक हैं.

निम्नलिखित तालिका सेजमेकर जम्पस्टार्ट में उपलब्ध सभी लामा मॉडलों को सूचीबद्ध करती है model_ids, डिफ़ॉल्ट उदाहरण प्रकार, और इनमें से प्रत्येक मॉडल के लिए समर्थित कुल टोकन की अधिकतम संख्या (इनपुट टोकन की संख्या और उत्पन्न टोकन की संख्या का योग)।

| मॉडल का नाम | मॉडल आईडी | अधिकतम कुल टोकन | डिफ़ॉल्ट इंस्टेंस प्रकार |

| लामा-2-7बी | मेटा-टेक्स्टजेनरेशन-लामा-2-7बी | 4096 | एमएल.g5.2xबड़ा |

| लामा-2-7बी-चैट | मेटा-टेक्स्टजेनरेशन-लामा-2-7बी-एफ | 4096 | एमएल.g5.2xबड़ा |

| लामा-2-13बी | मेटा-टेक्स्टजेनरेशन-लामा-2-13बी | 4096 | एमएल.g5.12xबड़ा |

| लामा-2-13बी-चैट | मेटा-टेक्स्टजेनरेशन-लामा-2-13बी-एफ | 4096 | एमएल.g5.12xबड़ा |

| लामा-2-70बी | मेटा-टेक्स्टजेनरेशन-लामा-2-70बी | 4096 | एमएल.g5.48xबड़ा |

| लामा-2-70बी-चैट | मेटा-टेक्स्टजेनरेशन-लामा-2-70बी-एफ | 4096 | एमएल.g5.48xबड़ा |

ध्यान दें कि सेजमेकर एंडपॉइंट्स की टाइमआउट सीमा 60s है। इस प्रकार, भले ही मॉडल 4096 टोकन उत्पन्न करने में सक्षम हो, यदि पाठ निर्माण में 60 से अधिक समय लगता है, तो अनुरोध विफल हो जाएगा। 7बी, 13बी और 70बी मॉडल के लिए, हम सेट करने की अनुशंसा करते हैं max_new_tokens टोकन की कुल संख्या 1500K से कम रखते हुए क्रमशः 1000, 500 और 4 से अधिक नहीं।

लामा-2-70बी के लिए अनुमान और उदाहरण संकेत

आप पाठ के किसी भी भाग को पूरा करने के लिए लामा मॉडल का उपयोग कर सकते हैं। पाठ निर्माण के माध्यम से, आप विभिन्न प्रकार के कार्य कर सकते हैं, जैसे प्रश्नों का उत्तर देना, भाषा अनुवाद, भावना विश्लेषण और भी बहुत कुछ। समापन बिंदु पर इनपुट पेलोड निम्नलिखित कोड जैसा दिखता है:

निम्नलिखित कुछ नमूना उदाहरण संकेत और मॉडल द्वारा उत्पन्न पाठ हैं। सभी आउटपुट अनुमान मापदंडों के साथ उत्पन्न होते हैं {"max_new_tokens":256, "top_p":0.9, "temperature":0.6}.

अगले उदाहरण में, हम दिखाते हैं कि कुछ-शॉट-इन-संदर्भ सीखने के साथ लामा मॉडल का उपयोग कैसे करें, जहां हम मॉडल के लिए उपलब्ध प्रशिक्षण नमूने प्रदान करते हैं। ध्यान दें कि हम केवल तैनात मॉडल पर अनुमान लगाते हैं और इस प्रक्रिया के दौरान, मॉडल का वजन नहीं बदलता है।

लामा-2-70बी-चैट के लिए अनुमान और उदाहरण संकेत

लामा-2-चैट मॉडल के साथ, जो संवाद उपयोग के मामलों के लिए अनुकूलित हैं, चैट मॉडल एंडपॉइंट का इनपुट चैट सहायक और उपयोगकर्ता के बीच का पिछला इतिहास है। आप अब तक हुई बातचीत से संबंधित प्रश्न पूछ सकते हैं। आप सिस्टम कॉन्फ़िगरेशन भी प्रदान कर सकते हैं, जैसे कि व्यक्तित्व जो चैट सहायक के व्यवहार को परिभाषित करते हैं। समापन बिंदु पर इनपुट पेलोड निम्नलिखित कोड जैसा दिखता है:

निम्नलिखित कुछ नमूना उदाहरण संकेत और मॉडल द्वारा उत्पन्न पाठ हैं। सभी आउटपुट अनुमान मापदंडों के साथ उत्पन्न होते हैं {"max_new_tokens": 512, "top_p": 0.9, "temperature": 0.6}.

निम्नलिखित उदाहरण में, उपयोगकर्ता ने सहायक के साथ पेरिस में पर्यटक स्थलों के बारे में बातचीत की है। इसके बाद, उपयोगकर्ता चैट सहायक द्वारा अनुशंसित पहले विकल्प के बारे में पूछताछ कर रहा है।

निम्नलिखित उदाहरणों में, हम सिस्टम का कॉन्फ़िगरेशन सेट करते हैं:

क्लीन अप

नोटबुक चलाने के बाद, सभी संसाधनों को हटाना सुनिश्चित करें ताकि प्रक्रिया में आपके द्वारा बनाए गए सभी संसाधन हटा दिए जाएं और आपकी बिलिंग बंद हो जाए:

निष्कर्ष

इस पोस्ट में, हमने आपको दिखाया कि सेजमेकर स्टूडियो में लामा 2 मॉडल के साथ शुरुआत कैसे करें। इसके साथ, आपके पास छह लामा 2 फाउंडेशन मॉडल तक पहुंच है जिसमें अरबों पैरामीटर शामिल हैं। क्योंकि फाउंडेशन मॉडल पूर्व-प्रशिक्षित होते हैं, वे प्रशिक्षण और बुनियादी ढांचे की लागत को कम करने और आपके उपयोग के मामले में अनुकूलन को सक्षम करने में भी मदद कर सकते हैं। सेजमेकर जम्पस्टार्ट के साथ शुरुआत करने के लिए, निम्नलिखित संसाधनों पर जाएँ:

लेखक के बारे में

जून जीता सेजमेकर जम्पस्टार्ट में एक उत्पाद प्रबंधक है। वह ग्राहकों को जेनरेटिव एआई एप्लिकेशन बनाने में मदद करने के लिए फाउंडेशन मॉडल को आसानी से खोजने योग्य और प्रयोग करने योग्य बनाने पर ध्यान केंद्रित करता है। अमेज़ॅन में उनके अनुभव में मोबाइल शॉपिंग एप्लिकेशन और लास्ट माइल डिलीवरी भी शामिल है।

जून जीता सेजमेकर जम्पस्टार्ट में एक उत्पाद प्रबंधक है। वह ग्राहकों को जेनरेटिव एआई एप्लिकेशन बनाने में मदद करने के लिए फाउंडेशन मॉडल को आसानी से खोजने योग्य और प्रयोग करने योग्य बनाने पर ध्यान केंद्रित करता है। अमेज़ॅन में उनके अनुभव में मोबाइल शॉपिंग एप्लिकेशन और लास्ट माइल डिलीवरी भी शामिल है।

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।  डॉ काइल उलरिच अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक एप्लाइड साइंटिस्ट हैं। उनकी शोध रुचियों में स्केलेबल मशीन लर्निंग एल्गोरिदम, कंप्यूटर विज़न, टाइम सीरीज़, बायेसियन नॉन-पैरामीट्रिक्स और गॉसियन प्रक्रियाएं शामिल हैं। उनकी पीएचडी ड्यूक यूनिवर्सिटी से है और उन्होंने न्यूरिप्स, सेल और न्यूरॉन में पेपर प्रकाशित किए हैं।

डॉ काइल उलरिच अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक एप्लाइड साइंटिस्ट हैं। उनकी शोध रुचियों में स्केलेबल मशीन लर्निंग एल्गोरिदम, कंप्यूटर विज़न, टाइम सीरीज़, बायेसियन नॉन-पैरामीट्रिक्स और गॉसियन प्रक्रियाएं शामिल हैं। उनकी पीएचडी ड्यूक यूनिवर्सिटी से है और उन्होंने न्यूरिप्स, सेल और न्यूरॉन में पेपर प्रकाशित किए हैं।  डॉ आशीष खेतानी अमेज़ॅन सेजमेकर जम्पस्टार्ट के साथ एक वरिष्ठ एप्लाइड वैज्ञानिक हैं और मशीन लर्निंग एल्गोरिदम विकसित करने में मदद करते हैं। उन्होंने इलिनोइस विश्वविद्यालय अर्बाना-शैंपेन से पीएचडी की उपाधि प्राप्त की। वह मशीन लर्निंग और सांख्यिकीय अनुमान में एक सक्रिय शोधकर्ता हैं, और उन्होंने न्यूरिप्स, आईसीएमएल, आईसीएलआर, जेएमएलआर, एसीएल और ईएमएनएलपी सम्मेलनों में कई पत्र प्रकाशित किए हैं।

डॉ आशीष खेतानी अमेज़ॅन सेजमेकर जम्पस्टार्ट के साथ एक वरिष्ठ एप्लाइड वैज्ञानिक हैं और मशीन लर्निंग एल्गोरिदम विकसित करने में मदद करते हैं। उन्होंने इलिनोइस विश्वविद्यालय अर्बाना-शैंपेन से पीएचडी की उपाधि प्राप्त की। वह मशीन लर्निंग और सांख्यिकीय अनुमान में एक सक्रिय शोधकर्ता हैं, और उन्होंने न्यूरिप्स, आईसीएमएल, आईसीएलआर, जेएमएलआर, एसीएल और ईएमएनएलपी सम्मेलनों में कई पत्र प्रकाशित किए हैं।  सुंदर रंगनाथन AWS में GenAI/फ्रेमवर्क GTM विशेषज्ञों के वैश्विक प्रमुख हैं। वह अमेज़ॅन ईसी2, ईकेएस, ईएफए, एडब्ल्यूएस बैच और अमेज़ॅन सेजमेकर जैसी एडब्ल्यूएस सेवाओं में बड़े भाषा मॉडल, जेनएआई और बड़े पैमाने पर एमएल वर्कलोड के लिए जीटीएम रणनीति विकसित करने पर ध्यान केंद्रित करते हैं। उनके अनुभव में नेटएप, माइक्रोन टेक्नोलॉजी, क्वालकॉम और मेंटर ग्राफिक्स में उत्पाद प्रबंधन और उत्पाद विकास में नेतृत्व भूमिकाएं शामिल हैं।

सुंदर रंगनाथन AWS में GenAI/फ्रेमवर्क GTM विशेषज्ञों के वैश्विक प्रमुख हैं। वह अमेज़ॅन ईसी2, ईकेएस, ईएफए, एडब्ल्यूएस बैच और अमेज़ॅन सेजमेकर जैसी एडब्ल्यूएस सेवाओं में बड़े भाषा मॉडल, जेनएआई और बड़े पैमाने पर एमएल वर्कलोड के लिए जीटीएम रणनीति विकसित करने पर ध्यान केंद्रित करते हैं। उनके अनुभव में नेटएप, माइक्रोन टेक्नोलॉजी, क्वालकॉम और मेंटर ग्राफिक्स में उत्पाद प्रबंधन और उत्पाद विकास में नेतृत्व भूमिकाएं शामिल हैं।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. ऑटोमोटिव/ईवीएस, कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- BlockOffsets. पर्यावरणीय ऑफसेट स्वामित्व का आधुनिकीकरण। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/llama-2-foundation-models-from-meta-are-now-available-in-amazon-sagemaker-jumpstart/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 1

- 10

- 100

- 11

- 13

- 15% तक

- 17

- 19

- 20

- 30

- 31

- 33

- 360-डिग्री

- 40

- 4k

- 500

- 7

- 70

- 8

- 9

- a

- योग्य

- About

- स्वीकार करें

- स्वीकार्य

- पहुँच

- एक्सेसिबिलिटी

- सुलभ

- अनुसार

- स्वीकार करना

- के पार

- सक्रिय

- जोड़ना

- जोड़ने

- अतिरिक्त

- पता

- बाद

- फिर

- के खिलाफ

- समझौता

- AI

- कलन विधि

- एल्गोरिदम

- संरेखित करें

- सब

- अनुमति देना

- साथ में

- भी

- हमेशा

- am

- वीरांगना

- अमेज़ॅन EC2

- अमेज़न SageMaker

- अमेज़न SageMaker जम्पस्टार्ट

- अमेज़ॅन सैजमेकर स्टूडियो

- अमेज़ॅन वेब सेवा

- अमेरिकन

- an

- विश्लेषण

- और

- और बुनियादी ढांचे

- की घोषणा

- अन्य

- जवाब

- कोई

- किसी

- आवेदन

- अनुप्रयोगों

- लागू

- सराहना

- उपयुक्त

- आर्क

- स्थापत्य

- हैं

- कला

- AS

- सहायता

- सहायक

- At

- वातावरण

- आकर्षण

- स्वचालित

- उपलब्ध

- एडब्ल्यूएस

- केले

- बुनियादी

- लड़ाई

- बायेसियन

- BE

- सुंदर

- सुंदरता

- बन गया

- क्योंकि

- बन

- किया गया

- बीयर

- से पहले

- व्यवहार

- बीजिंग

- मानना

- माना

- BEST

- के बीच

- बिलिंग

- बिलियन

- अरबों

- काली

- मुक्केबाज़ी

- टूटना

- दम भरनेवाला

- विस्तृत

- निर्माण

- इमारत

- बनाया गया

- लेकिन

- बटन

- by

- बुलाया

- कर सकते हैं

- राजधानी

- कार

- कार्ड

- हिंडोला

- मामला

- मामलों

- कैट

- परिवर्तन

- चॉकलेट

- चुनें

- चुनने

- City

- क्लासिक

- कोड

- संग्रह

- संयुक्त

- जोड़ती

- आता है

- अ रहे है

- वाणिज्यिक

- कंपनी

- समापन

- कंप्यूटर

- Computer Vision

- सम्मेलनों

- आश्वस्त

- विन्यास

- माना

- स्थिर

- निर्माण

- शामिल

- कंटेनर

- शामिल हैं

- सामग्री

- प्रासंगिक

- जारी रखने के

- लगातार

- नियंत्रण

- नियंत्रण

- सुविधाजनक

- कन्वर्सेशन (Conversation)

- लागत

- देश

- साहस

- आवरण

- बनाना

- बनाया

- क्रिएटिव

- सांस्कृतिक

- संस्कृति

- कप

- ग्राहक

- अनुकूलन

- अनुकूलित

- तिथि

- डाटा सुरक्षा

- समर्पित

- समर्पण

- चूक

- परिभाषित

- प्रसव

- तैनात

- तैनात

- तैनाती

- तैनाती

- तैनात

- डिज़ाइन

- बनाया गया

- वांछित

- गंतव्य

- स्थलों

- विवरण

- विकसित करना

- विकसित

- डेवलपर

- विकासशील

- विकास

- बातचीत

- अंतर

- विभिन्न

- मुश्किल

- अन्य वायरल पोस्ट से

- विशिष्ट

- do

- वृत्तचित्र

- कर

- किया

- dont

- दोगुनी

- नीचे

- ड्यूक

- ड्यूक विश्वविद्यालय

- दौरान

- e

- से प्रत्येक

- पूर्व

- आसानी

- आसान

- एडवर्ड

- आइंस्टीन

- भी

- ईमेल

- सक्षम

- समर्थकारी

- समाप्त

- शुरू से अंत तक

- endpoint

- अभियांत्रिकी

- अंग्रेज़ी

- का आनंद

- पर्याप्त

- सुनिश्चित

- वातावरण

- उपकरण

- ईथर

- और भी

- घटनाओं

- हर कोई

- उदाहरण

- उदाहरण

- उत्तेजित

- अनुभव

- प्रयोग

- प्रयोगों

- व्यक्त

- असफल

- विफल रहे

- निष्पक्ष

- असत्य

- परिवार

- प्रसिद्ध

- दूर

- करतब

- चित्रित किया

- विशेषताएं

- प्रतिक्रिया

- पैर

- कुछ

- फिल्मों

- अंतिम

- अंत में

- खोज

- प्रथम

- प्रमुख

- नाव

- प्रवाह

- केंद्रित

- निम्नलिखित

- के लिए

- आगे

- पाया

- बुनियाद

- चार

- फ्रांस

- फ्रेंच

- से

- पूरी तरह से

- आगे

- भविष्य

- सामान्य जानकारी

- उत्पन्न

- उत्पन्न

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- जॉर्जिया

- मिल

- देना

- कांच

- वैश्विक

- Go

- जा

- ग्राफ़िक्स

- महान

- अधिक से अधिक

- अभूतपूर्व

- आगे बढ़ें

- मार्गदर्शन

- गाइड

- था

- हैंडल

- हुआ

- खुश

- कठिन

- कड़ी मेहनत

- है

- होने

- he

- सिर

- मदद

- मदद

- मदद करता है

- यहाँ उत्पन्न करें

- hi

- हाई

- उच्चतर

- उसके

- ऐतिहासिक

- इतिहास

- आवासन

- कैसे

- How To

- एचटीएमएल

- HTTPS

- हब

- मानव

- i

- प्रतिष्ठित

- विचार

- if

- ii

- इलेनॉइस

- प्रभाव

- आयात

- महत्वपूर्ण

- प्रभावशाली

- in

- शामिल

- शामिल

- सहित

- निगमित

- करें-

- इंफ्रास्ट्रक्चर

- शुरू में

- निवेश

- प्रेरित

- प्रेरणादायक

- उदाहरण

- तुरन्त

- निर्देश

- एकीकृत

- इरादा

- रुचियों

- इंटरफेस

- में

- पृथक

- IT

- आईटी इस

- यात्रा

- जेपीजी

- केवल

- रखना

- रखा

- कुंजी

- बच्चा

- जानना

- जानने वाला

- अवतरण

- मील का पत्थर

- भाषा

- बड़ा

- बड़े पैमाने पर

- सबसे बड़ा

- पिछली बार

- देर से

- लांच

- कानून

- नेतृत्व

- जानें

- जानें और बढ़ें

- सीख रहा हूँ

- कम से कम

- कम

- स्तर

- लाइसेंस

- जीवन

- प्रकाश

- पसंद

- सीमा

- सूचियाँ

- साहित्य

- ll

- लामा

- तर्क

- लंबा

- लंबे समय तक

- देख

- लग रहा है

- मोहब्बत

- प्यार करता था

- कम

- मशीन

- यंत्र अधिगम

- बनाया गया

- बनाना

- बनाता है

- निर्माण

- प्रबंध

- प्रबंधक

- बहुत

- चमत्कार

- बात

- अधिकतम

- मई..

- अर्थ

- माप

- मीडिया

- मध्यम

- उल्लेख किया

- message

- मेटा

- माइक्रोन

- मिनट

- मिनटों

- मिश्रण

- ML

- एमएलओपीएस

- मोबाइल

- आदर्श

- मॉडल

- पल

- महीने

- अधिक

- अधिकांश

- सबसे लोकप्रिय

- प्रस्ताव

- चलचित्र

- बहुत

- संग्रहालय

- संग्रहालय

- संगीत

- नाम

- प्राकृतिक

- आवश्यक

- आवश्यकता

- जरूरत

- नेटवर्क

- नया

- न्यूयॉर्क

- अगला

- नहीं

- नोटबुक

- अभी

- संख्या

- अनेक

- NY

- of

- प्रस्ताव

- की पेशकश

- ऑफर

- तेल

- on

- एक बार

- ONE

- केवल

- खुला

- खुला स्रोत

- ऑप्टिमाइज़ करें

- अनुकूलित

- विकल्प

- or

- अन्य

- अन्य

- अन्यथा

- हमारी

- आउट

- उत्पादन

- के ऊपर

- कुल

- पृष्ठ

- जोड़े

- काग़ज़

- कागजात

- प्राचल

- पैरामीटर

- पेरिस

- भाग

- पास

- पारित कर दिया

- गुजरता

- अतीत

- शांति

- निष्पादन

- प्रदर्शन

- स्थायी

- फ़ोन

- तस्वीरें

- भौतिक विज्ञान

- टुकड़ा

- पिज़्ज़ा

- प्लास्टिक

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- खेला

- नीति

- पॉप - अप

- लोकप्रिय

- पद

- डाक का

- Predictor

- वरीयताओं

- तैयारी

- वर्तमान

- पिछला

- प्रक्रिया

- प्रक्रियाओं

- एस्ट्रो मॉल

- उत्पाद विकास

- उत्पाद प्रबंधन

- उत्पादन प्रबंधक

- प्रस्ताव

- गर्व

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- सार्वजनिक

- सार्वजनिक परिवहन

- सार्वजनिक रूप से

- प्रकाशित

- उद्देश्य

- रखना

- अजगर

- जो भी

- प्रशन

- त्वरित

- जल्दी से

- रैंप

- अनियमितता

- रेंज

- लेकर

- तैयार

- कारण

- प्राप्त करना

- नुस्खा

- की सिफारिश

- की सिफारिश की

- संदर्भित करता है

- भले ही

- क्षेत्रों

- सापेक्ष

- सापेक्षता

- दोहराया गया

- प्रतिनिधित्व

- का अनुरोध

- की आवश्यकता होती है

- अनुसंधान

- शोधकर्ता

- उपयुक्त संसाधन चुनें

- क्रमश

- प्रतिक्रिया

- बाकी

- परिणाम

- परिणाम

- नदी

- भूमिका

- भूमिकाओं

- रन

- दौड़ना

- s

- सुरक्षा

- sagemaker

- नमक

- वही

- स्केलेबल

- स्केल

- वैज्ञानिक

- वैज्ञानिकों

- एसडीके

- एसईए

- Search

- खोज

- अनुभाग

- सुरक्षित

- सुरक्षा

- देखना

- देखकर

- लग रहा था

- चयनित

- का चयन

- चयन

- भेजें

- वरिष्ठ

- भावुकता

- कई

- सेवाएँ

- सेवारत

- सेट

- की स्थापना

- आकार

- शार्क

- खरीदारी

- चाहिए

- दिखाना

- पता चला

- दिखाता है

- बंद करना

- महत्व

- महत्वपूर्ण

- सरल

- केवल

- एक

- साइट

- साइटें

- छह

- आकार

- धीरे से

- छोटा

- So

- अब तक

- सोशल मीडिया

- सोशल मीडिया

- समाधान ढूंढे

- कुछ

- स्रोत

- सूत्रों का कहना है

- विशेष

- विशेषज्ञों

- विनिर्दिष्ट

- गति

- खड़ा

- प्रारंभ

- शुरू

- राज्य

- राज्य

- सांख्यिकीय

- कदम

- कदम

- रोक

- स्ट्रेटेजी

- तार

- संरचना

- स्टूडियो

- तेजस्वी

- विषय

- आगामी

- सफलता

- सफलतापूर्वक

- ऐसा

- समर्थित

- निश्चित

- प्रतीक

- प्रणाली

- तालिका

- लेना

- लेता है

- कार्य

- स्वाद

- टीम

- तकनीक

- टेक्नोलॉजी

- अस्थायी

- शर्तों

- से

- धन्यवाद

- कि

- RSI

- राजधानी

- भविष्य

- स्रोत

- दुनिया

- लेकिन हाल ही

- उन

- सिद्धांत

- वहाँ।

- इन

- वे

- चीज़ें

- सोचना

- इसका

- हालांकि?

- यहाँ

- टाइगर

- पहर

- समय श्रृंखला

- बार

- शीर्षक

- सेवा मेरे

- आज

- एक साथ

- टोकन

- टोकन

- उपकरण

- ऊपर का

- कुल

- मीनार

- रेलगाड़ी

- प्रशिक्षण

- ट्रांसफार्मर

- अनुवाद करना

- अनुवाद करें

- परिवहन

- खरब

- कोशिश

- दो

- टाइप

- प्रकार

- ui

- के अंतर्गत

- अविस्मरणीय

- अद्वितीय

- विश्वविद्यालय

- जब तक

- अपडेट

- अपडेट

- प्रयोग करने योग्य

- उपयोग

- उदाहरण

- प्रयुक्त

- उपयोगकर्ता

- उपयोगकर्ताओं

- का उपयोग करता है

- का उपयोग

- मूल्य

- मान

- विविधता

- संस्करण

- संस्करणों

- बहुत

- के माध्यम से

- देखें

- विचारों

- दृष्टि

- भेंट

- आगंतुकों

- आयतन

- जरूरत है

- युद्ध

- था

- we

- वेब

- वेब सेवाओं

- वेब आधारित

- वेबसाइट

- कुंआ

- व्हेल

- क्या

- एचएमबी क्या है?

- कब

- जहाँ तक

- कौन कौन से

- जब

- क्यों

- मर्जी

- खिड़कियां

- साथ में

- शब्द

- शब्द

- काम

- कार्य

- विश्व

- विश्व प्रसिद्ध

- लपेटो

- साल

- यॉर्क

- आप

- आपका

- स्वयं

- जेफिरनेट

- ज़िप