उद्योगों में एलएलएम को अजेय रूप से अपनाने के बावजूद, वे एक व्यापक प्रौद्योगिकी पारिस्थितिकी तंत्र का एक घटक हैं जो नई एआई लहर को शक्ति प्रदान कर रहा है। कई संवादी एआई उपयोग मामलों में उपयोगकर्ता के प्रश्नों का उत्तर देने के लिए लामा 2, फ़्लान टी5 और ब्लूम जैसे एलएलएम की आवश्यकता होती है। ये मॉडल सवालों के जवाब देने के लिए पैरामीट्रिक ज्ञान पर भरोसा करते हैं। मॉडल प्रशिक्षण के दौरान इस ज्ञान को सीखता है और इसे मॉडल मापदंडों में एन्कोड करता है। इस ज्ञान को अद्यतन करने के लिए, हमें एलएलएम को फिर से प्रशिक्षित करना होगा, जिसमें बहुत समय और पैसा लगता है।

सौभाग्य से, हम अपने एलएलएम को सूचित करने के लिए स्रोत ज्ञान का भी उपयोग कर सकते हैं। स्रोत ज्ञान एक इनपुट प्रॉम्प्ट के माध्यम से एलएलएम में दी गई जानकारी है। स्रोत ज्ञान प्रदान करने का एक लोकप्रिय तरीका रिट्रीवल ऑगमेंटेड जेनरेशन (आरएजी) है। आरएजी का उपयोग करके, हम बाहरी डेटा स्रोत से प्रासंगिक जानकारी प्राप्त करते हैं और उस जानकारी को एलएलएम में फीड करते हैं।

इस ब्लॉग पोस्ट में, हम यह पता लगाएंगे कि अमेज़ॅन सेजमेकर जम्पस्टार्ट का उपयोग करके एलएलएम जैसे लामा -2 को कैसे तैनात किया जाए और एआई मतिभ्रम को रोकने के लिए पाइनकोन वेक्टर डेटाबेस का उपयोग करके रिट्रीवल ऑगमेंटेड जेनरेशन (आरएजी) के माध्यम से हमारे एलएलएम को प्रासंगिक जानकारी के साथ अद्यतन रखा जाए। .

अमेज़ॅन सेजमेकर में पुनर्प्राप्ति संवर्धित पीढ़ी (आरएजी)।

पाइनकोन आरएजी के पुनर्प्राप्ति घटक को संभाल लेगा, लेकिन आपको दो और महत्वपूर्ण घटकों की आवश्यकता है: कहीं एलएलएम अनुमान को चलाने के लिए और कहीं एम्बेडिंग मॉडल को चलाने के लिए।

अमेज़ॅन सेजमेकर स्टूडियो एक एकीकृत विकास वातावरण (आईडीई) है जो एकल वेब-आधारित विज़ुअल इंटरफ़ेस प्रदान करता है जहां आप सभी मशीन लर्निंग (एमएल) विकास करने के लिए उद्देश्य-निर्मित टूल तक पहुंच सकते हैं। यह सेजमेकर जम्पस्टार्ट प्रदान करता है जो एक मॉडल हब है जहां उपयोगकर्ता अपने स्वयं के सेजमेकर खाते में एक विशेष मॉडल का पता लगा सकते हैं, पूर्वावलोकन कर सकते हैं और लॉन्च कर सकते हैं। यह फाउंडेशन मॉडल सहित विभिन्न प्रकार की समस्या के लिए पूर्व-प्रशिक्षित, सार्वजनिक रूप से उपलब्ध और मालिकाना मॉडल प्रदान करता है।

अमेज़ॅन सेजमेकर स्टूडियो आरएजी-सक्षम एलएलएम पाइपलाइन विकसित करने के लिए आदर्श वातावरण प्रदान करता है। सबसे पहले, AWS कंसोल का उपयोग करके, Amazon SageMaker पर जाएं और एक SageMaker Studio डोमेन बनाएं और एक Jupyter Studio नोटबुक खोलें।

.. पूर्वापेक्षाएँ

निम्नलिखित पूर्वापेक्षा चरणों को पूरा करें:

- अमेज़ॅन सेजमेकर स्टूडियो स्थापित करें।

- अमेज़ॅन सेजमेकर डोमेन पर ऑनबोर्ड।

- एक फ्री-टियर पाइनकोन वेक्टर डेटाबेस के लिए साइन अप करें।

- आवश्यक लाइब्रेरी: सेजमेकर पायथन एसडीके, पाइनकोन क्लाइंट

समाधान पूर्वाभ्यास

सेजमेकर स्टूडियो नोटबुक का उपयोग करते हुए, हमें सबसे पहले आवश्यक लाइब्रेरी स्थापित करनी होगी:

एलएलएम की तैनाती

इस पोस्ट में, हम एलएलएम को तैनात करने के दो तरीकों पर चर्चा करते हैं। प्रथम के माध्यम से है HuggingFaceModel वस्तु। आप इसका उपयोग सीधे हगिंग फेस मॉडल हब से एलएलएम तैनात करते समय (और मॉडल एम्बेड करते समय) कर सकते हैं।

उदाहरण के लिए, आप इसके लिए एक परिनियोजन योग्य कॉन्फ़िगरेशन बना सकते हैं गूगल/फ़्लान-t5-xl मॉडल जैसा कि निम्नलिखित स्क्रीन कैप्चर में दिखाया गया है:

हगिंग फेस से सीधे मॉडल तैनात करते समय, इनिशियलाइज़ करें my_model_configuration निम्नलिखित के साथ:

- An

envconfig हमें बताता है कि हम किस मॉडल का उपयोग करना चाहते हैं और किस कार्य के लिए। - हमारा सेजमेकर निष्पादन

roleहमें अपना मॉडल तैनात करने की अनुमति देता है। - An

image_uriहगिंग फेस से एलएलएम को तैनात करने के लिए विशेष रूप से एक छवि कॉन्फ़िगरेशन है।

वैकल्पिक रूप से, सेजमेकर के पास सरल लोगों के साथ सीधे संगत मॉडलों का एक सेट है JumpStartModel वस्तु। लामा 2 जैसे कई लोकप्रिय एलएलएम इस मॉडल द्वारा समर्थित हैं, जिन्हें निम्नलिखित स्क्रीन कैप्चर में दिखाए अनुसार प्रारंभ किया जा सकता है:

के दोनों संस्करणों के लिए my_model, उन्हें निम्न स्क्रीन कैप्चर में दिखाए अनुसार तैनात करें:

हमारे प्रारंभिक एलएलएम समापन बिंदु के साथ, आप पूछताछ शुरू कर सकते हैं। हमारे प्रश्नों का प्रारूप भिन्न हो सकता है (विशेषकर संवादी और गैर-संवादात्मक एलएलएम के बीच), लेकिन प्रक्रिया आम तौर पर एक ही होती है। हगिंग फेस मॉडल के लिए, निम्नलिखित कार्य करें:

आप इसका समाधान इसमें पा सकते हैं गिटहब भंडार.

यहां हमें जो उत्पन्न उत्तर मिल रहा है उसका कोई खास मतलब नहीं है - यह एक मतिभ्रम है।

एलएलएम को अतिरिक्त संदर्भ प्रदान करना

लामा 2 पूरी तरह से आंतरिक पैरामीट्रिक ज्ञान के आधार पर हमारे प्रश्न का उत्तर देने का प्रयास करता है। स्पष्ट रूप से, मॉडल पैरामीटर इस बात का ज्ञान संग्रहीत नहीं करते हैं कि हम सेजमेकर में प्रबंधित स्पॉट प्रशिक्षण के साथ किन उदाहरणों का उपयोग कर सकते हैं।

इस प्रश्न का सही उत्तर देने के लिए, हमें स्रोत ज्ञान का उपयोग करना चाहिए। यानी हम प्रॉम्प्ट के जरिए एलएलएम को अतिरिक्त जानकारी देते हैं। आइए उस जानकारी को सीधे मॉडल के अतिरिक्त संदर्भ के रूप में जोड़ें।

अब हम प्रश्न का सही उत्तर देखते हैं; वो आसान था! हालाँकि, किसी उपयोगकर्ता द्वारा अपने संकेतों में संदर्भ सम्मिलित करने की संभावना नहीं है, उन्हें अपने प्रश्न का उत्तर पहले से ही पता होगा।

किसी एकल संदर्भ को मैन्युअल रूप से सम्मिलित करने के बजाय, जानकारी के अधिक व्यापक डेटाबेस से स्वचालित रूप से प्रासंगिक जानकारी की पहचान करें। उसके लिए, आपको पुनर्प्राप्ति संवर्धित पीढ़ी की आवश्यकता होगी।

पुनर्प्राप्ति संवर्धित पीढ़ी

रिट्रीवल ऑगमेंटेड जेनरेशन के साथ, आप जानकारी के डेटाबेस को एक वेक्टर स्पेस में एनकोड कर सकते हैं जहां वैक्टर के बीच निकटता उनकी प्रासंगिकता/शब्दार्थ समानता का प्रतिनिधित्व करती है। ज्ञान आधार के रूप में इस वेक्टर स्पेस के साथ, आप एक नई उपयोगकर्ता क्वेरी को परिवर्तित कर सकते हैं, इसे उसी वेक्टर स्पेस में एन्कोड कर सकते हैं, और पहले अनुक्रमित सबसे प्रासंगिक रिकॉर्ड पुनर्प्राप्त कर सकते हैं।

इन प्रासंगिक रिकॉर्डों को पुनः प्राप्त करने के बाद, उनमें से कुछ का चयन करें और उन्हें अतिरिक्त संदर्भ के रूप में एलएलएम प्रॉम्प्ट में शामिल करें, जिससे एलएलएम को अत्यधिक प्रासंगिक स्रोत ज्ञान प्रदान किया जा सके। यह दो चरणों वाली प्रक्रिया है जहां:

- इंडेक्सिंग एक डेटासेट से जानकारी के साथ वेक्टर इंडेक्स को पॉप्युलेट करता है।

- पुनर्प्राप्ति एक क्वेरी के दौरान होती है और वह जगह है जहां हम वेक्टर इंडेक्स से प्रासंगिक जानकारी प्राप्त करते हैं।

दोनों चरणों में हमारे मानव-पठनीय सादे पाठ को सिमेंटिक वेक्टर स्पेस में अनुवाद करने के लिए एक एम्बेडिंग मॉडल की आवश्यकता होती है। हगिंग फेस से अत्यधिक कुशल मिनीएलएम वाक्य ट्रांसफार्मर का उपयोग करें जैसा कि निम्नलिखित स्क्रीन कैप्चर में दिखाया गया है। यह मॉडल एलएलएम नहीं है और इसलिए इसे हमारे लामा 2 मॉडल की तरह प्रारंभ नहीं किया गया है।

में hub_config, ऊपर स्क्रीन कैप्चर में दिखाए अनुसार मॉडल आईडी निर्दिष्ट करें लेकिन कार्य के लिए, फीचर-एक्सट्रैक्शन का उपयोग करें क्योंकि हम अपने एलएलएम की तरह टेक्स्ट नहीं बल्कि वेक्टर एम्बेडिंग उत्पन्न कर रहे हैं। इसके बाद, मॉडल कॉन्फिगरेशन को इनिशियलाइज़ करें HuggingFaceModel पहले की तरह, लेकिन इस बार एलएलएम छवि के बिना और कुछ संस्करण मापदंडों के साथ।

आप मॉडल को फिर से तैनात कर सकते हैं deploy, के छोटे (केवल सीपीयू) उदाहरण का उपयोग करना ml.t2.large. मिनीएलएम मॉडल छोटा है, इसलिए इसमें बहुत अधिक मेमोरी की आवश्यकता नहीं होती है और जीपीयू की आवश्यकता नहीं होती है क्योंकि यह सीपीयू पर भी जल्दी से एम्बेडिंग बना सकता है। यदि चाहें, तो आप मॉडल को GPU पर तेज़ी से चला सकते हैं।

एम्बेडिंग बनाने के लिए, का उपयोग करें predict विधि और इसके माध्यम से एन्कोड करने के लिए संदर्भों की एक सूची पास करें inputs कुंजी जैसा दिखाया गया है:

दो इनपुट संदर्भ पारित किए गए हैं, दो संदर्भ वेक्टर एम्बेडिंग लौटाए गए हैं जैसा कि दिखाया गया है:

len(out)

2

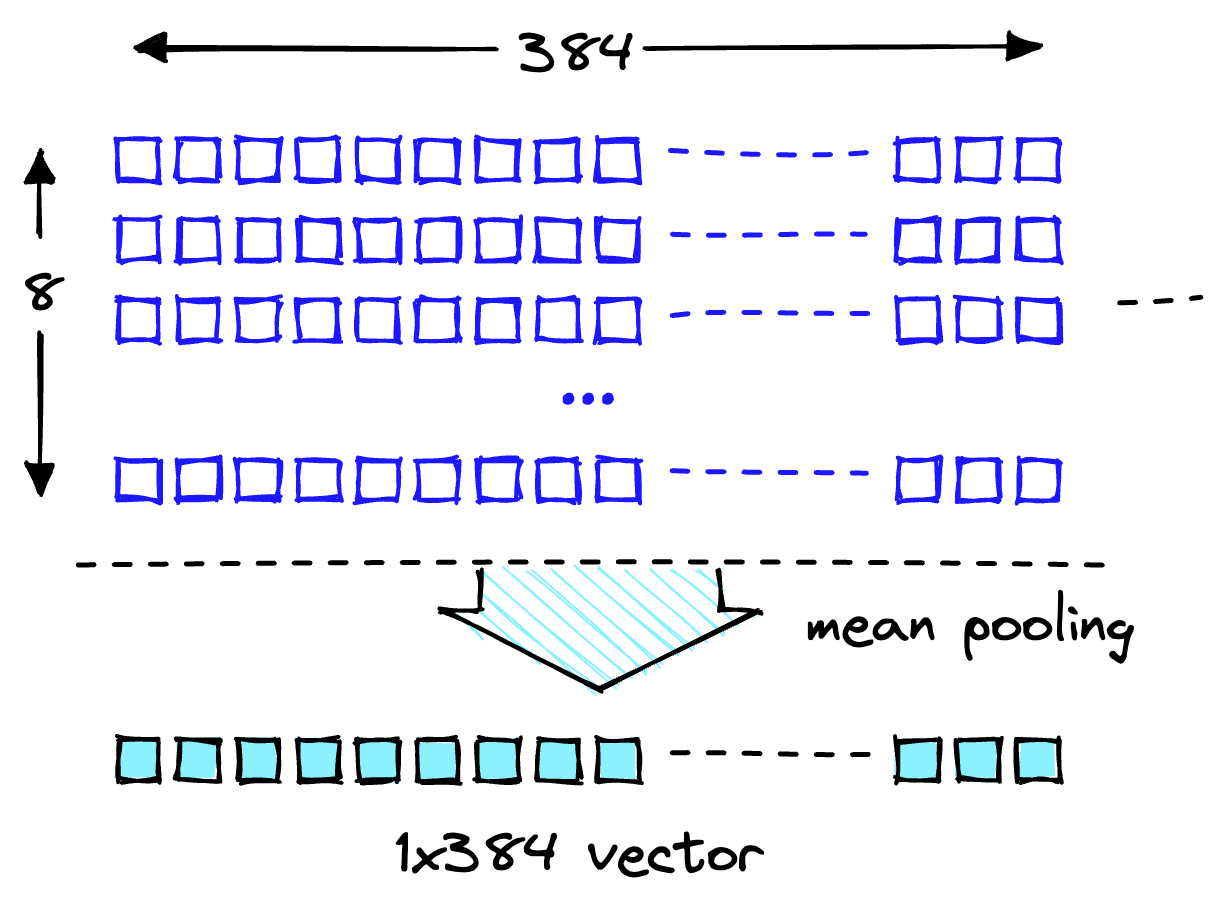

मिनीएलएम मॉडल की एम्बेडिंग आयामीता है 384 जिसका अर्थ है कि प्रत्येक वेक्टर एम्बेडिंग MiniLM आउटपुट की एक आयामीता होनी चाहिए 384. हालाँकि, हमारी एम्बेडिंग की लंबाई को देखते हुए, आप निम्नलिखित देखेंगे:

len(out[0]), len(out[1])

(8, 8)

दो सूचियों में प्रत्येक में आठ आइटम हैं। मिनीएलएम पहले टोकनाइजेशन चरण में टेक्स्ट को प्रोसेस करता है। यह टोकनाइजेशन हमारे मानव-पठनीय सादे पाठ को मॉडल-पठनीय टोकन आईडी की सूची में बदल देता है। मॉडल की आउटपुट सुविधाओं में, आप टोकन-स्तरीय एम्बेडिंग देख सकते हैं। इनमें से एक एम्बेडिंग अपेक्षित आयामीता को दर्शाती है 384 के रूप में दिखाया:

len(out[0][0])

384

प्रत्येक वेक्टर आयाम में माध्य मानों का उपयोग करके इन टोकन-स्तरीय एम्बेडिंग को दस्तावेज़-स्तरीय एम्बेडिंग में बदलें, जैसा कि निम्नलिखित चित्रण में दिखाया गया है।

एकल 384-आयामी वेक्टर प्राप्त करने के लिए माध्य पूलिंग ऑपरेशन।

दो 384-आयामी वेक्टर एम्बेडिंग के साथ, प्रत्येक इनपुट टेक्स्ट के लिए एक। हमारे जीवन को आसान बनाने के लिए, एन्कोडिंग प्रक्रिया को एक ही फ़ंक्शन में लपेटें जैसा कि निम्नलिखित स्क्रीन कैप्चर में दिखाया गया है:

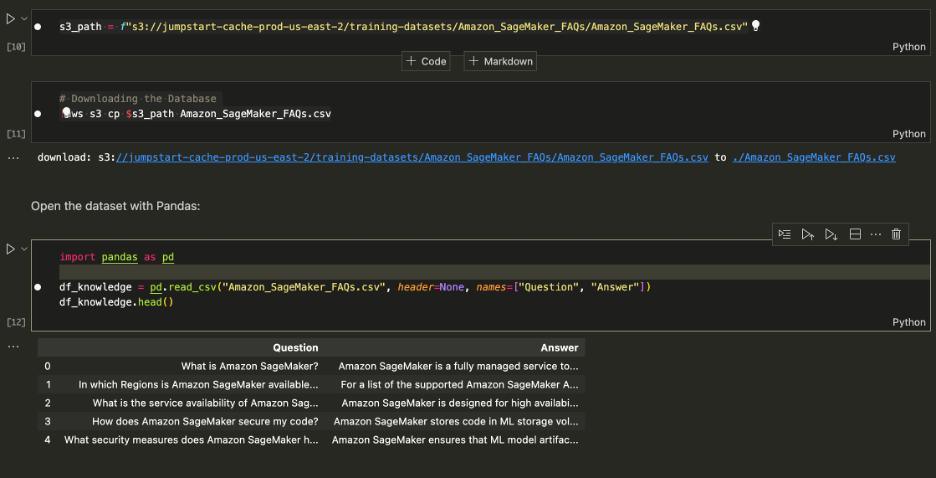

डेटासेट डाउनलोड करना

डेटा प्राप्त करने के लिए ज्ञान आधार के रूप में अमेज़ॅन सेजमेकर एफएक्यू डाउनलोड करें जिसमें प्रश्न और उत्तर दोनों कॉलम शामिल हैं।

अमेज़ॅन सेजमेकर एफएक्यू डाउनलोड करें

खोज करते समय, केवल उत्तर देखें, ताकि आप प्रश्न कॉलम को हटा सकें। विवरण के लिए नोटबुक देखें.

हमारा डेटासेट और एम्बेडिंग पाइपलाइन तैयार है। अब हमें उन एंबेडिंग्स को संग्रहीत करने के लिए बस एक जगह की आवश्यकता है।

सूचीकरण

पाइनकोन वेक्टर डेटाबेस वेक्टर एम्बेडिंग को संग्रहीत करता है और उन्हें बड़े पैमाने पर कुशलतापूर्वक खोजता है। डेटाबेस बनाने के लिए, आपको पाइनकोन से एक निःशुल्क एपीआई कुंजी की आवश्यकता होगी।

पाइनकोन वेक्टर डेटाबेस से कनेक्ट होने के बाद, एक एकल वेक्टर इंडेक्स बनाएं (पारंपरिक डीबी में एक तालिका के समान)। सूचकांक को नाम दें retrieval-augmentation-aws और सूचकांक को संरेखित करें dimension और metric एम्बेडिंग मॉडल (इस मामले में मिनीएलएम) के लिए आवश्यक पैरामीटर।

डेटा सम्मिलित करना शुरू करने के लिए, निम्नलिखित चलाएँ:

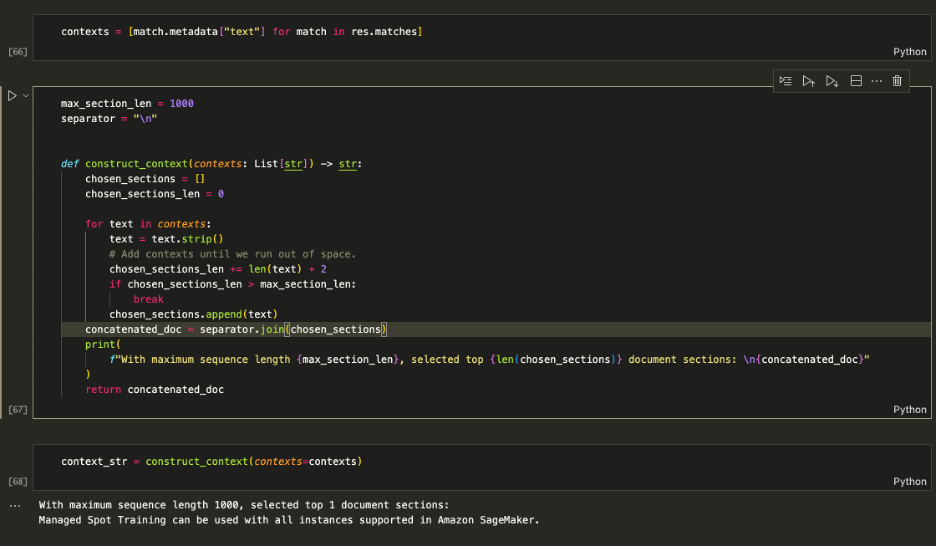

आप इस पोस्ट में पहले से दिए गए प्रश्न के साथ सूचकांक पर सवाल उठाना शुरू कर सकते हैं।

उपरोक्त आउटपुट से पता चलता है कि हम अपने प्रश्न का उत्तर देने में सहायता के लिए प्रासंगिक संदर्भ लौटा रहे हैं। जबसे हम top_k = 1, index.query मेटाडेटा के साथ शीर्ष परिणाम लौटाया जो पढ़ता है Managed Spot Training can be used with all instances supported in Amazon.

प्रॉम्प्ट को बढ़ाना

संकेत को बढ़ाने के लिए पुनर्प्राप्त संदर्भों का उपयोग करें और एलएलएम में फ़ीड करने के लिए संदर्भ की अधिकतम मात्रा तय करें। उपयोग 1000 जब तक आप सामग्री की लंबाई पार नहीं कर लेते, तब तक वर्णों की सीमा प्रत्येक लौटाए गए संदर्भ को पुनरावृत्त रूप से प्रॉम्प्ट में जोड़ने की होती है।

प्रॉम्प्ट को बढ़ाना

खिलाएं context_str एलएलएम प्रॉम्प्ट में जैसा कि निम्नलिखित स्क्रीन कैप्चर में दिखाया गया है:

[Input]: Which instances can I use with Managed Spot Training in SageMaker? [Output]: Based on the context provided, you can use Managed Spot Training with all instances supported in Amazon SageMaker. Therefore, the answer is: All instances supported in Amazon SageMaker.

तर्क काम करता है, इसलिए चीजों को साफ़ रखने के लिए इसे एक ही फ़ंक्शन में लपेटें।

अब आप निम्नलिखित जैसे प्रश्न पूछ सकते हैं:

क्लीन अप

किसी भी अवांछित शुल्क को रोकने के लिए, मॉडल और एंडपॉइंट हटाएं।

निष्कर्ष

इस पोस्ट में, हमने आपको सेजमेकर पर ओपन-एक्सेस एलएलएम के साथ आरएजी से परिचित कराया। हमने यह भी दिखाया कि लामा 2 के साथ अमेज़ॅन सेजमेकर जम्पस्टार्ट मॉडल, फ़्लान टी5 के साथ हगिंग फेस एलएलएम और मिनीएलएम के साथ एम्बेडिंग मॉडल कैसे तैनात किए जाएं।

हमने अपने ओपन-एक्सेस मॉडल और पाइनकोन वेक्टर इंडेक्स का उपयोग करके एक संपूर्ण एंड-टू-एंड आरएजी पाइपलाइन लागू की। इसका उपयोग करके, हमने दिखाया कि मतिभ्रम को कैसे कम किया जाए, और एलएलएम ज्ञान को अद्यतन कैसे रखा जाए, और अंततः हमारे सिस्टम में उपयोगकर्ता अनुभव और विश्वास को कैसे बढ़ाया जाए।

इस उदाहरण को स्वयं चलाने के लिए, इस GitHub रिपॉजिटरी को क्लोन करें और इसका उपयोग करके पिछले चरणों का पालन करें GitHub पर प्रश्न उत्तर नोटबुक.

लेखक के बारे में

वेदांत जैन एक वरिष्ठ एआई/एमएल विशेषज्ञ हैं, जो रणनीतिक जेनरेटिव एआई पहल पर काम कर रहे हैं। AWS में शामिल होने से पहले, वेदांत ने डेटाब्रिक्स, हॉर्टनवर्क्स (अब क्लौडेरा) और जेपी मॉर्गन चेज़ जैसी विभिन्न कंपनियों में एमएल/डेटा साइंस स्पेशलिटी पदों पर कार्य किया है। अपने काम के अलावा, वेदांत को संगीत बनाने, रॉक क्लाइंबिंग, सार्थक जीवन जीने के लिए विज्ञान का उपयोग करने और दुनिया भर के व्यंजनों की खोज करने का शौक है।

वेदांत जैन एक वरिष्ठ एआई/एमएल विशेषज्ञ हैं, जो रणनीतिक जेनरेटिव एआई पहल पर काम कर रहे हैं। AWS में शामिल होने से पहले, वेदांत ने डेटाब्रिक्स, हॉर्टनवर्क्स (अब क्लौडेरा) और जेपी मॉर्गन चेज़ जैसी विभिन्न कंपनियों में एमएल/डेटा साइंस स्पेशलिटी पदों पर कार्य किया है। अपने काम के अलावा, वेदांत को संगीत बनाने, रॉक क्लाइंबिंग, सार्थक जीवन जीने के लिए विज्ञान का उपयोग करने और दुनिया भर के व्यंजनों की खोज करने का शौक है।

जेम्स ब्रिग्स पाइनकोन में स्टाफ डेवलपर एडवोकेट हैं, जो वेक्टर खोज और एआई/एमएल में विशेषज्ञता रखते हैं। वह ऑनलाइन शिक्षा के माध्यम से अपने स्वयं के GenAI समाधान विकसित करने में डेवलपर्स और व्यवसायों का मार्गदर्शन करता है। पाइनकोन से पहले जेम्स ने छोटे तकनीकी स्टार्टअप से लेकर स्थापित वित्त निगमों के लिए एआई पर काम किया था। काम के अलावा, जेम्स को यात्रा करने और सर्फिंग और स्कूबा से लेकर मय थाई और बीजेजे तक नए रोमांच अपनाने का शौक है।

जेम्स ब्रिग्स पाइनकोन में स्टाफ डेवलपर एडवोकेट हैं, जो वेक्टर खोज और एआई/एमएल में विशेषज्ञता रखते हैं। वह ऑनलाइन शिक्षा के माध्यम से अपने स्वयं के GenAI समाधान विकसित करने में डेवलपर्स और व्यवसायों का मार्गदर्शन करता है। पाइनकोन से पहले जेम्स ने छोटे तकनीकी स्टार्टअप से लेकर स्थापित वित्त निगमों के लिए एआई पर काम किया था। काम के अलावा, जेम्स को यात्रा करने और सर्फिंग और स्कूबा से लेकर मय थाई और बीजेजे तक नए रोमांच अपनाने का शौक है।

शिन हुआंग Amazon SageMaker JumpStart और Amazon SageMaker बिल्ट-इन एल्गोरिदम के लिए एक वरिष्ठ एप्लाइड साइंटिस्ट हैं। वह स्केलेबल मशीन लर्निंग एल्गोरिदम विकसित करने पर ध्यान केंद्रित करता है। उनकी शोध रुचि प्राकृतिक भाषा प्रसंस्करण, सारणीबद्ध डेटा पर व्याख्यात्मक गहन शिक्षा और गैर-पैरामीट्रिक स्पेस-टाइम क्लस्टरिंग के मजबूत विश्लेषण के क्षेत्र में है। उन्होंने एसीएल, आईसीडीएम, केडीडी सम्मेलनों और रॉयल स्टैटिस्टिकल सोसाइटी: सीरीज़ ए में कई पत्र प्रकाशित किए हैं।

शिन हुआंग Amazon SageMaker JumpStart और Amazon SageMaker बिल्ट-इन एल्गोरिदम के लिए एक वरिष्ठ एप्लाइड साइंटिस्ट हैं। वह स्केलेबल मशीन लर्निंग एल्गोरिदम विकसित करने पर ध्यान केंद्रित करता है। उनकी शोध रुचि प्राकृतिक भाषा प्रसंस्करण, सारणीबद्ध डेटा पर व्याख्यात्मक गहन शिक्षा और गैर-पैरामीट्रिक स्पेस-टाइम क्लस्टरिंग के मजबूत विश्लेषण के क्षेत्र में है। उन्होंने एसीएल, आईसीडीएम, केडीडी सम्मेलनों और रॉयल स्टैटिस्टिकल सोसाइटी: सीरीज़ ए में कई पत्र प्रकाशित किए हैं।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 1

- 10

- 100

- 11

- 12

- 14

- 15% तक

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- About

- ऊपर

- पहुँच

- अनुसार

- लेखा

- के पार

- जोड़ना

- अतिरिक्त

- अतिरिक्त जानकारी

- दत्तक ग्रहण

- रोमांच

- वकील

- फिर

- AI

- ऐ मामलों का उपयोग करें

- ऐ / एमएल

- एल्गोरिदम

- संरेखित करें

- सब

- साथ में

- पहले ही

- भी

- वीरांगना

- अमेज़न SageMaker

- अमेज़न SageMaker जम्पस्टार्ट

- अमेज़ॅन सैजमेकर स्टूडियो

- अमेज़ॅन वेब सेवा

- राशि

- an

- विश्लेषण

- और

- जवाब

- जवाब

- कोई

- एपीआई

- अनुप्रयोग

- लागू

- दृष्टिकोण

- दृष्टिकोण

- हैं

- क्षेत्र

- चारों ओर

- AS

- पूछना

- At

- प्रयास

- बढ़ाना

- संवर्धित

- स्वत:

- स्वतः

- उपलब्ध

- एडब्ल्यूएस

- आधार

- आधारित

- BE

- क्योंकि

- से पहले

- शुरू करना

- के बीच

- ब्लॉग

- फूल का खिलना

- के छात्रों

- व्यापक

- निर्माण

- में निर्मित

- व्यवसायों

- लेकिन

- by

- कर सकते हैं

- कब्जा

- मामला

- मामलों

- अक्षर

- प्रभार

- पीछा

- स्वच्छ

- स्पष्ट रूप से

- क्लाइम्बिंग

- Cloudera

- गुच्छन

- स्तंभ

- स्तंभ

- कंपनियों

- संगत

- पूरा

- अंग

- घटकों

- सम्मेलनों

- जुड़ा हुआ

- कंसोल

- शामिल

- शामिल हैं

- सामग्री

- प्रसंग

- संदर्भों

- संवादी

- संवादी ऐ

- बदलना

- निगमों

- सही

- ठीक प्रकार से

- बनाना

- महत्वपूर्ण

- वर्तमान में

- तिथि

- डाटाबेस

- तारीख

- डीबीएस

- तय

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- तैनात

- तैनाती

- डेवलपर

- डेवलपर्स

- विकासशील

- विकास

- आयाम

- सीधे

- चर्चा करना

- do

- कर देता है

- नहीं करता है

- नहीं करता है

- डोमेन

- डॉन

- बूंद

- दौरान

- से प्रत्येक

- पूर्व

- आसान

- पारिस्थितिकी तंत्र

- शिक्षा

- कुशल

- कुशलता

- embedding

- गले

- एन्कोडिंग

- समाप्त

- शुरू से अंत तक

- endpoint

- बढ़ाना

- वातावरण

- स्थापित

- और भी

- उदाहरण

- से अधिक

- निष्पादन

- अपेक्षित

- अनुभव

- का पता लगाने

- तलाश

- व्यापक

- बाहरी

- उद्धरण

- चेहरा

- और तेज

- विशेषताएं

- फेड

- कुछ

- वित्त

- खोज

- खत्म

- प्रथम

- नाव

- केंद्रित

- निम्नलिखित

- के लिए

- प्रारूप

- बुनियाद

- मुक्त

- से

- समारोह

- आम तौर पर

- उत्पन्न

- सृजन

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- मिल

- GitHub

- देना

- दी

- देता है

- Go

- चला जाता है

- GPU

- मार्गदर्शिकाएँ

- संभालना

- हो जाता

- है

- he

- धारित

- मदद

- यहाँ उत्पन्न करें

- अत्यधिक

- उसके

- कैसे

- How To

- तथापि

- HTTPS

- हुआंग

- हब

- हगिंग फ़ेस

- मानव पठनीय

- i

- ID

- आदर्श

- पहचान करना

- आईडी

- if

- की छवि

- कार्यान्वित

- आयात

- in

- शामिल

- सहित

- बढ़ना

- अनुक्रमणिका

- अनुक्रमित

- उद्योगों

- सूचित करना

- करें-

- पहल

- निवेश

- निविष्टियां

- स्थापित

- उदाहरण

- एकीकृत

- रुचियों

- इंटरफेस

- आंतरिक

- में

- शुरू की

- IT

- आइटम

- जेम्स

- शामिल होने

- jp

- जे। पी. मौरगन

- जेपी मॉर्गन चेस

- जेपीजी

- रखना

- कुंजी

- जानना

- ज्ञान

- भाषा

- बड़ा

- बड़ा

- लांच

- नेतृत्व

- सीख रहा हूँ

- सीखता

- लंबाई

- पुस्तकालयों

- जीवन

- पसंद

- सीमा

- सूची

- सूचियाँ

- लाइव्स

- लामा

- एलएलएम

- तर्क

- देखिए

- देख

- लॉट

- मशीन

- यंत्र अधिगम

- बनाना

- निर्माण

- कामयाब

- मैन्युअल

- बहुत

- मैच

- मैच

- अधिकतम

- अधिकतम राशि

- मई..

- मतलब

- सार्थक

- साधन

- याद

- मेटाडाटा

- तरीका

- कम करना

- ML

- आदर्श

- मॉडल

- धन

- अधिक

- मॉर्गन

- अधिकांश

- बहुत

- विभिन्न

- संगीत

- चाहिए

- नाम

- प्राकृतिक

- प्राकृतिक भाषा संसाधन

- आवश्यकता

- की जरूरत है

- नया

- अगला

- NLP

- नोटबुक

- अभी

- numpy

- वस्तु

- of

- on

- ONE

- ऑनलाइन

- केवल

- खुला

- आपरेशन

- or

- आदेश

- OS

- अन्यथा

- हमारी

- आउट

- उत्पादन

- outputs के

- बाहर

- अपना

- कागजात

- पैरामीटर

- विशेष

- विशेष रूप से

- पास

- पारित कर दिया

- जुनून

- आवेशपूर्ण

- निष्पादन

- प्रदर्शन

- अनुमतियाँ

- चित्र

- पाइपलाइन

- मैदान

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- लोकप्रिय

- पदों

- पद

- शक्ति

- भविष्यवाणी

- भविष्यवाणियों

- Predictor

- वरीय

- को रोकने के

- पूर्वावलोकन

- पिछला

- पहले से

- पूर्व

- मुसीबत

- प्रक्रिया

- प्रक्रियाओं

- प्रसंस्करण

- प्रोफाइल

- संकेतों

- मालिकाना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- सार्वजनिक रूप से

- प्रकाशित

- अजगर

- pytorch

- प्रश्नों

- प्रश्न

- प्रशन

- जल्दी से

- रेंज

- लेकर

- तैयार

- प्राप्त

- अभिलेख

- क्षेत्रों

- प्रासंगिक

- भरोसा करना

- कोष

- का प्रतिनिधित्व करता है

- की आवश्यकता होती है

- अपेक्षित

- अनुसंधान

- प्रतिक्रिया

- परिणाम

- परिणाम

- वापसी

- लौटने

- मजबूत

- चट्टान

- भूमिका

- शाही

- रन

- चलाता है

- sagemaker

- वही

- कहना

- स्केलेबल

- स्केल

- विज्ञान

- वैज्ञानिक

- स्कोर

- स्क्रीन

- एसडीके

- Search

- खोजें

- देखना

- मालूम होता है

- चयन

- वरिष्ठ

- भावना

- वाक्य

- कई

- श्रृंखला ए

- सेवाएँ

- सेट

- चाहिए

- दिखाना

- पता चला

- दिखाया

- दिखाता है

- पक्ष

- समान

- सरल

- के बाद से

- एक

- आकार

- छोटा

- छोटे

- So

- समाज

- केवल

- समाधान

- समाधान ढूंढे

- कुछ

- कहीं न कहीं

- स्रोत

- अंतरिक्ष

- विशेषज्ञ

- विशेषज्ञता

- विशेषता

- विशेष रूप से

- Spot

- कर्मचारी

- स्टार्टअप

- सांख्यिकीय

- कदम

- कदम

- रुकें

- की दुकान

- भंडार

- सामरिक

- तार

- स्टूडियो

- ऐसा

- समर्थन

- समर्थित

- समर्थन करता है

- प्रणाली

- सिस्टम

- तालिका

- लेता है

- कार्य

- तकनीक

- टेक startups

- टेक्नोलॉजी

- बताता है

- टेक्स्ट

- थाई

- से

- कि

- RSI

- क्षेत्र

- दुनिया

- लेकिन हाल ही

- उन

- इसलिये

- इन

- वे

- चीज़ें

- इसका

- उन

- यहाँ

- पहर

- सेवा मेरे

- टोकन

- tokenization

- भी

- उपकरण

- ऊपर का

- परंपरागत

- प्रशिक्षण

- ट्रांसफार्मर

- ट्रान्सफ़ॉर्मर

- रूपांतरण

- अनुवाद करना

- यात्रा का

- ट्रस्ट

- दो

- प्रकार

- अंत में

- संभावना नहीं

- अजेय।

- जब तक

- अवांछित

- अपडेट

- us

- उपयोग

- प्रयुक्त

- उपयोगकर्ता

- उपयोगकर्ता अनुभव

- उपयोगकर्ताओं

- का उपयोग

- मान

- विभिन्न

- संस्करण

- संस्करणों

- के माध्यम से

- दृश्य

- प्रतीक्षा

- walkthrough

- करना चाहते हैं

- था

- लहर

- मार्ग..

- we

- वेब

- वेब सेवाओं

- वेब आधारित

- क्या

- कब

- कौन कौन से

- जब

- चौड़ा

- विस्तृत श्रृंखला

- मर्जी

- साथ में

- बिना

- काम

- काम किया

- काम कर रहे

- कार्य

- विश्व

- होगा

- लपेटो

- X

- हाँ

- आप

- आपका

- जेफिरनेट