पिछले एक दशक में, हमने देखा है डीप लर्निंग (डीएल) विज्ञान एडब्ल्यूएस ग्राहकों द्वारा जबरदस्त गति से अपनाया गया. डीएल मॉडल के भरपूर और संयुक्त रूप से प्रशिक्षित मापदंडों में एक बड़ी प्रतिनिधित्व क्षमता है जो कई ग्राहक उपयोग के मामलों में सुधार लाती है, जिसमें छवि और भाषण विश्लेषण, प्राकृतिक भाषा प्रसंस्करण (एनएलपी), समय श्रृंखला प्रसंस्करण, और बहुत कुछ शामिल हैं। इस पोस्ट में, हम आमतौर पर डीएल प्रशिक्षण में विशेष रूप से रिपोर्ट की जाने वाली चुनौतियों पर प्रकाश डालते हैं, और कैसे ओपन-सोर्स लाइब्रेरी मोज़ेकएमएल संगीतकार उन्हें हल करने में मदद करता है।

डीएल प्रशिक्षण के साथ चुनौती

डीएल मॉडल को नेस्टेड फॉर लूप में पुनरावृत्त रूप से प्रशिक्षित किया जाता है। एक लूप प्रशिक्षण डेटासेट चंक के माध्यम से चंक द्वारा पुनरावृत्त होता है और, यदि आवश्यक हो, तो यह लूप पूरे डेटासेट पर कई बार दोहराया जाता है। डीएल प्रशिक्षण पर काम कर रहे एमएल प्रैक्टिशनर्स को कई चुनौतियों का सामना करना पड़ता है:

- प्रशिक्षण की अवधि डेटा आकार के साथ बढ़ती है। स्थायी रूप से बढ़ते डेटासेट के साथ, प्रशिक्षण समय और लागत भी बढ़ती है, और वैज्ञानिक खोज की लय धीमी हो जाती है।

- डीएल स्क्रिप्ट को अक्सर बॉयलरप्लेट कोड की आवश्यकता होती है, विशेष रूप से लूप संरचना के लिए उपरोक्त डबल जो डेटासेट को मिनीबैच और प्रशिक्षण को युगों में विभाजित करता है।

- पसंद का विरोधाभास: कई प्रशिक्षण अनुकूलन पत्र और पुस्तकालय प्रकाशित होते हैं, फिर भी यह स्पष्ट नहीं है कि पहले किसका परीक्षण किया जाए, और उनके प्रभावों को कैसे संयोजित किया जाए।

पिछले कुछ वर्षों में, कई ओपन-सोर्स लाइब्रेरी जैसे Keras, PyTorch लाइटनिंग, हगिंग फेस ट्रांसफॉर्मर, तथा रे ट्रेन डीएल प्रशिक्षण को और अधिक सुलभ बनाने का प्रयास कर रहे हैं, विशेष रूप से कोड वर्बोसिटी को कम करके, जिससे तंत्रिका नेटवर्क को कैसे प्रोग्राम किया जाता है, इसे सरल बनाया गया है। उन पुस्तकालयों में से अधिकांश ने डेवलपर अनुभव और कोड कॉम्पैक्टनेस पर ध्यान केंद्रित किया है।

इस पोस्ट में, हम एक नया ओपन-सोर्स लाइब्रेरी प्रस्तुत करते हैं जो डीएल प्रशिक्षण पर एक अलग स्टैंड लेता है: मोज़ेकएमएल संगीतकार एक गति-केंद्रित पुस्तकालय है जिसका प्राथमिक उद्देश्य एल्गोरिथम नवाचार के माध्यम से तंत्रिका नेटवर्क प्रशिक्षण स्क्रिप्ट को तेज बनाना है। क्लाउड डीएल की दुनिया में, गति पर ध्यान देना बुद्धिमानी है, क्योंकि कंप्यूट इन्फ्रास्ट्रक्चर अक्सर प्रति उपयोग के लिए भुगतान किया जाता है-यहां तक कि दूसरे पर भी नीचे अमेज़ॅन सेजमेकर प्रशिक्षण-और गति में सुधार पैसे की बचत में तब्दील हो सकता है।

ऐतिहासिक रूप से, डीएल प्रशिक्षण को गति देना ज्यादातर समानांतर में मॉडल पुनरावृत्तियों की गणना करने वाली मशीनों की संख्या में वृद्धि करके किया गया है, जिसे एक तकनीक कहा जाता है। डेटा समानता. हालांकि डेटा समानांतरवाद कभी-कभी प्रशिक्षण को तेज करता है (गारंटी नहीं है क्योंकि यह अभिसरण को परेशान करता है, जैसा कि इसमें प्रकाश डाला गया है गोयल एट अल।), यह समग्र कार्य लागत को कम नहीं करता है। व्यवहार में, यह इंटर-मशीन संचार ओवरहेड और उच्च मशीन यूनिट लागत के कारण इसे बढ़ाने के लिए जाता है, क्योंकि वितरित डीएल मशीनें हाई-एंड नेटवर्किंग और इन-सर्वर जीपीयू इंटरकनेक्ट से लैस हैं।

हालांकि MosaicML Composer डेटा समानांतरवाद का समर्थन करता है, लेकिन इसका मूल दर्शन डेटा समानांतरवाद आंदोलन से अलग है। इसका लक्ष्य विज्ञान कार्यान्वयन स्तर पर नवाचार करके अधिक मशीनों की आवश्यकता के बिना प्रशिक्षण में तेजी लाना है। इसलिए, इसका उद्देश्य समय की बचत प्राप्त करना है जिसके परिणामस्वरूप एडब्ल्यूएस के भुगतान-प्रति-उपयोग शुल्क संरचना के कारण लागत बचत होगी।

पेश है ओपन-सोर्स लाइब्रेरी MosaicML Composer

MosaicML Composer एक ओपन-सोर्स DL प्रशिक्षण पुस्तकालय है, जिसका उद्देश्य नवीनतम एल्गोरिदम लाना आसान बनाना है और उन्हें नए व्यंजनों में शामिल करना है जो मॉडल प्रशिक्षण को गति देते हैं और मॉडल की गुणवत्ता में सुधार करने में मदद करते हैं। इस लेखन के समय, यह PyTorch का समर्थन करता है और इसमें 25 तकनीकें शामिल हैं—जिन्हें कहा जाता है तरीकों MosaicML दुनिया में—मानक मॉडल, डेटासेट और बेंचमार्क के साथ

संगीतकार है pip . के माध्यम से उपलब्ध:

pip install mosaicmlकंपोजर में लागू स्पीडअप तकनीकों को इसके कार्यात्मक एपीआई के साथ एक्सेस किया जा सकता है। उदाहरण के लिए, निम्न स्निपेट लागू होता है ब्लरपूल TorchVision ResNet की तकनीक:

import logging

from composer import functional as CF

import torchvision.models as models

logging.basicConfig(level=logging.INFO)

model = models.resnet50()

CF.apply_blurpool(model)वैकल्पिक रूप से, आप a . का भी उपयोग कर सकते हैं ट्रेनर तकनीकों का अपना संयोजन बनाने के लिए:

from composer import Trainer

from composer.algorithms import LabelSmoothing, CutMix, ChannelsLast

trainer = Trainer(

model=.. # must be a composer.ComposerModel

train_dataloader=...,

max_duration="2ep", # can be a time, a number of epochs or batches

algorithms=[

LabelSmoothing(smoothing=0.1),

CutMix(alpha=1.0),

ChannelsLast(),

]

)

trainer.fit()संगीतकार में लागू विधियों के उदाहरण

संगीतकार में उपलब्ध कुछ विधियां कंप्यूटर दृष्टि के लिए विशिष्ट हैं, उदाहरण के लिए छवि वृद्धि तकनीक कोलआउट, कट आउटया, प्रगतिशील छवि का आकार बदलना. अन्य अनुक्रम मॉडलिंग के लिए विशिष्ट हैं, जैसे अनुक्रम लंबाई वार्मअप or अन्यत्र उपस्थिति. दिलचस्प है, कई उपयोग के मामले से अज्ञेय हैं और कंप्यूटर दृष्टि और एनएलपी से परे विभिन्न प्रकार के PyTorch तंत्रिका नेटवर्क पर लागू किए जा सकते हैं। उन सामान्य तंत्रिका नेटवर्क प्रशिक्षण त्वरण विधियों में शामिल हैं लेबल चौरसाई, चयनात्मक बैकप्रॉप, स्टोकेस्टिक वजन औसत, परत जमना, तथा शार्पनेस अवेयर मिनिमाइजेशन (एसएएम).

आइए उनमें से कुछ के बारे में गहराई से जानें जो MosaicML टीम द्वारा विशेष रूप से प्रभावी पाए गए हैं:

- शार्पनेस अवेयर मिनिमाइजेशन (एसएएम) प्रत्येक अनुकूलन चरण के लिए दो बार एक ढाल की गणना करके मॉडल हानि फ़ंक्शन और इसकी तीक्ष्णता दोनों को कम करने की तुलना में एक अनुकूलक है। थ्रूपुट को दंडित करने के लिए अतिरिक्त गणना को सीमित करने के लिए, सैम को समय-समय पर चलाया जा सकता है।

- रैखिक पूर्वाग्रहों के साथ ध्यान (ALiBi), से प्रेरित प्रेस एट अल।, ट्रांसफॉर्मर मॉडल के लिए विशिष्ट है। यह स्थितिगत एम्बेडिंग की आवश्यकता को हटा देता है, उन्हें गैर-सीखा पूर्वाग्रह के साथ ध्यान भार के साथ बदल देता है।

- चयनात्मक बैकप्रॉप, से प्रेरित जियांग एट अल।, आपको केवल उच्च हानि फ़ंक्शन वाले रिकॉर्ड पर बैक-प्रोपेगेशन (एल्गोरिदम जो इसकी त्रुटि ढलान का पालन करके मॉडल वजन में सुधार करता है) चलाने की अनुमति देता है। यह विधि आपको अनावश्यक गणना से बचने में मदद करती है और थ्रूपुट को बेहतर बनाने में मदद करती है।

एकल कॉम्पैक्ट प्रशिक्षण ढांचे में उन तकनीकों का उपलब्ध होना एमएल प्रैक्टिशनरों के लिए एक महत्वपूर्ण मूल्य वर्धित है। MosaicML टीम द्वारा परीक्षण और मूल्यांकन की गई प्रत्येक तकनीक के लिए कार्रवाई योग्य फील्ड फीडबैक भी मूल्यवान है। हालाँकि, इस तरह के एक समृद्ध टूलबॉक्स को देखते हुए, आप सोच सकते हैं: मैं किस विधि का उपयोग करूँ? क्या कई विधियों के उपयोग को संयोजित करना सुरक्षित है? मोज़ेकएमएल एक्सप्लोरर दर्ज करें।

मोज़ेकएमएल एक्सप्लोरर

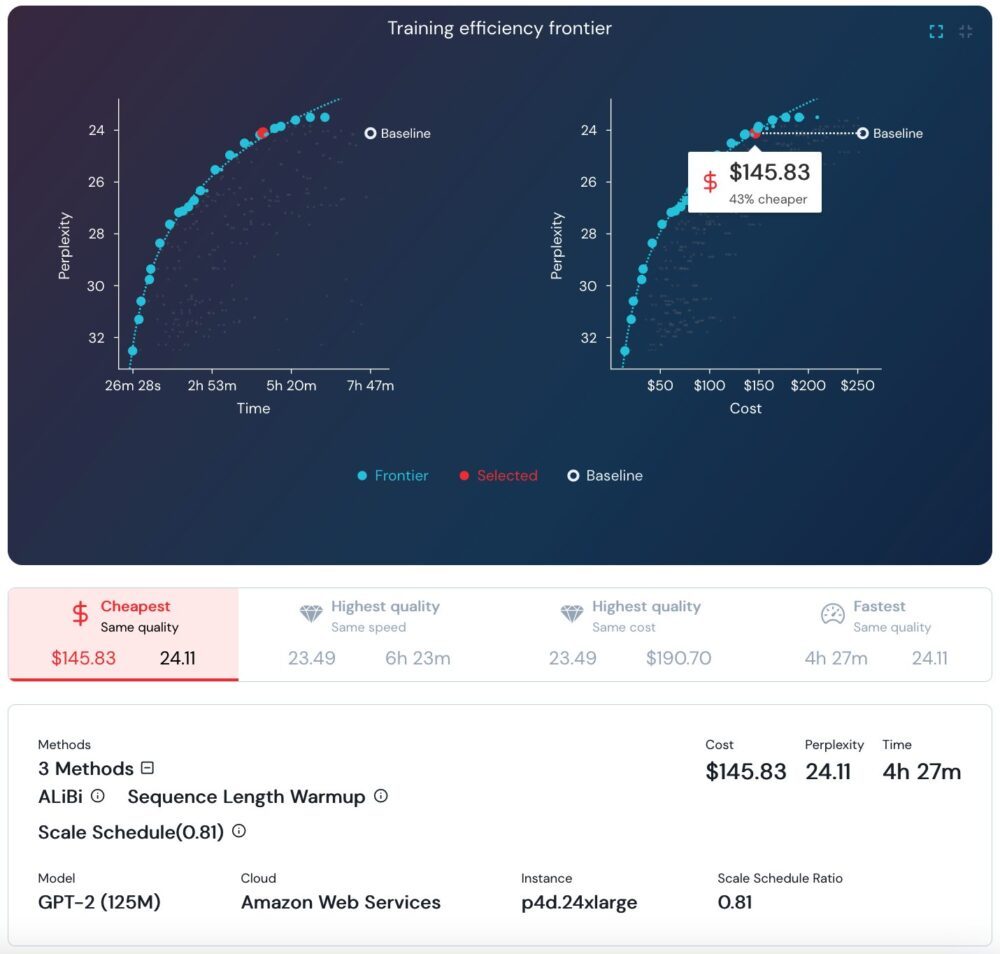

DL प्रशिक्षण विधियों के मूल्य और अनुकूलता की मात्रा निर्धारित करने के लिए, MosaicML टीम बनाए रखती है एक्सप्लोरर, अपनी तरह का पहला लाइव डैशबोर्ड है जिसमें पांच डेटासेट और सात मॉडलों पर दर्जनों डीएल प्रशिक्षण प्रयोगों का चित्रण किया गया है। डैशबोर्ड चित्र परेतो इष्टतम सीमा लागत/समय/गुणवत्ता ट्रेड-ऑफ़ में, और आपको विधियों के शीर्ष-स्कोरिंग संयोजनों को ब्राउज़ करने और खोजने की अनुमति देता है—जिन्हें कहा जाता है व्यंजनों MosaicML दुनिया में—किसी दिए गए मॉडल और डेटासेट के लिए। उदाहरण के लिए, निम्नलिखित ग्राफ़ दिखाते हैं कि 125M पैरामीटर GPT2 प्रशिक्षण के लिए, 24.11 की जटिलता को बनाए रखने वाला सबसे सस्ता प्रशिक्षण, AliBi, अनुक्रम लंबाई वार्मअप और स्केल शेड्यूल को मिलाकर प्राप्त किया जाता है, जो AWS क्लाउड में लगभग $ 145.83 की लागत तक पहुंचता है! हालांकि, कृपया ध्यान दें कि यह लागत गणना और जो इस पोस्ट में अनुसरण करती हैं वे केवल ईसी 2 ऑन-डिमांड गणना पर आधारित हैं, आपके पर्यावरण और व्यावसायिक आवश्यकताओं के आधार पर अन्य लागत विचार लागू हो सकते हैं।

GPT-2 प्रशिक्षण के लिए MosaicML Explorer का स्क्रीनशॉट

एडब्ल्यूएस पर संगीतकार के साथ उल्लेखनीय उपलब्धियां

AWS पर संगीतकार पुस्तकालय चलाकर, MosaicML टीम ने कई प्रभावशाली परिणाम प्राप्त किए। ध्यान दें कि MosaicML टीम द्वारा रिपोर्ट किए गए लागत अनुमानों में केवल ऑन-डिमांड गणना शुल्क शामिल है।

निष्कर्ष

आप अपने लैपटॉप से लेकर बड़े GPU से लैस क्लाउड सर्वर तक, किसी भी संगत प्लेटफॉर्म पर संगीतकार के साथ शुरुआत कर सकते हैं। पुस्तकालय में सहज ज्ञान युक्त विशेषताएं हैं स्वागत यात्रा और Getting Started प्रलेखन पृष्ठ। एडब्ल्यूएस में संगीतकार का उपयोग करने से आप स्पॉट कंप्यूट सहित एडब्ल्यूएस लागत-अनुकूलन सेवाओं और कार्यक्रमों के साथ संगीतकार लागत-अनुकूलन विज्ञान को संचयित कर सकते हैं (अमेज़ॅन EC2, अमेज़न SageMaker), बचत योजना, SageMaker स्वचालित मॉडल ट्यूनिंग, और अधिक। MosaicML टीम बनाए रखती है a ट्यूटोरियल एडब्ल्यूएस पर संगीतकार की। यह एक चरण-दर-चरण प्रदर्शन प्रदान करता है कि आप एमएलपीआरएफ परिणामों को कैसे पुन: पेश कर सकते हैं और एडब्ल्यूएस पर रेसनेट -50 को मानक 76.6% शीर्ष -1 सटीकता के लिए केवल 27 मिनट में प्रशिक्षित कर सकते हैं।

यदि आप तंत्रिका नेटवर्क के साथ संघर्ष कर रहे हैं जो बहुत धीमी गति से प्रशिक्षण दे रहे हैं, या यदि आप अपनी DL प्रशिक्षण लागत को नियंत्रण में रखना चाहते हैं, तो AWS पर MosaicML को आज़माएं और हमें बताएं कि आपने क्या बनाया है!

लेखक के बारे में

बंदिश शाही MosaicML में एक इंजीनियरिंग प्रबंधक है, जो बड़े पैमाने पर वितरित सिस्टम और प्रदर्शन कंप्यूटिंग के साथ कुशल गहन शिक्षण को पाटने के लिए काम कर रहा है। बंदिश के पास मशीन लर्निंग और उद्यम अनुप्रयोगों के लिए एक दशक से अधिक का अनुभव निर्माण प्रणाली है। उन्हें प्रेरणा के लिए दोस्तों और परिवार के साथ समय बिताना, खाना बनाना और स्टार ट्रेक को रिपीट देखना पसंद है।

बंदिश शाही MosaicML में एक इंजीनियरिंग प्रबंधक है, जो बड़े पैमाने पर वितरित सिस्टम और प्रदर्शन कंप्यूटिंग के साथ कुशल गहन शिक्षण को पाटने के लिए काम कर रहा है। बंदिश के पास मशीन लर्निंग और उद्यम अनुप्रयोगों के लिए एक दशक से अधिक का अनुभव निर्माण प्रणाली है। उन्हें प्रेरणा के लिए दोस्तों और परिवार के साथ समय बिताना, खाना बनाना और स्टार ट्रेक को रिपीट देखना पसंद है।

ओलिवियर क्रूचांट फ्रांस में स्थित एडब्ल्यूएस में एक मशीन लर्निंग स्पेशलिस्ट सॉल्यूशंस आर्किटेक्ट है। ओलिवियर एडब्ल्यूएस ग्राहकों की मदद करता है - छोटे स्टार्टअप से लेकर बड़े उद्यमों तक - प्रोडक्शन-ग्रेड मशीन लर्निंग एप्लिकेशन को विकसित और तैनात करता है। अपने खाली समय में, उन्हें शोध पत्र पढ़ने और दोस्तों और परिवार के साथ जंगल की खोज करने में आनंद आता है।

ओलिवियर क्रूचांट फ्रांस में स्थित एडब्ल्यूएस में एक मशीन लर्निंग स्पेशलिस्ट सॉल्यूशंस आर्किटेक्ट है। ओलिवियर एडब्ल्यूएस ग्राहकों की मदद करता है - छोटे स्टार्टअप से लेकर बड़े उद्यमों तक - प्रोडक्शन-ग्रेड मशीन लर्निंग एप्लिकेशन को विकसित और तैनात करता है। अपने खाली समय में, उन्हें शोध पत्र पढ़ने और दोस्तों और परिवार के साथ जंगल की खोज करने में आनंद आता है।

- उन्नत (300)

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़ॅन मशीन लर्निंग

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- Computer Vision

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- यंत्र अधिगम

- NLP

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- pytorch

- एडब्ल्यूएस पर PyTorch

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट