दिसंबर 2020 में, एडब्ल्यूएस की घोषणा की की सामान्य उपलब्धता अमेज़न SageMaker जम्पस्टार्ट, की क्षमता अमेज़न SageMaker जो आपको मशीन लर्निंग (एमएल) के साथ जल्दी और आसानी से आरंभ करने में मदद करता है। जम्पस्टार्ट लोकप्रिय एमएल कार्यों में पूर्व-प्रशिक्षित मॉडलों की एक विस्तृत विविधता की एक-क्लिक फ़ाइन-ट्यूनिंग और परिनियोजन प्रदान करता है, साथ ही सामान्य व्यावसायिक समस्याओं को हल करने वाले एंड-टू-एंड समाधानों का चयन भी करता है। ये सुविधाएँ एमएल प्रक्रिया के प्रत्येक चरण से भारी भारोत्तोलन को हटा देती हैं, जिससे उच्च-गुणवत्ता वाले मॉडल विकसित करना आसान हो जाता है और तैनाती के लिए समय कम हो जाता है।

विशिष्ट एमएल कार्यों के लिए जम्पस्टार्ट का उपयोग करने पर यह पोस्ट श्रृंखला में तीसरी है। में पहिला पद, हमने दिखाया कि आप जम्पस्टार्ट पर छवि वर्गीकरण उपयोग के मामले कैसे चला सकते हैं। में दूसरी पोस्ट, हमने दिखाया कि आप जम्पस्टार्ट पर टेक्स्ट वर्गीकरण उपयोग के मामले कैसे चला सकते हैं। इस पोस्ट में, हम एमएक्सनेट से प्रशिक्षित मॉडल का उपयोग करके छवि विभाजन मॉडल को ठीक करने और तैनात करने के बारे में चरण-दर-चरण पूर्वाभ्यास प्रदान करते हैं। हम एक ही परिणाम प्राप्त करने के दो तरीकों का पता लगाते हैं: जम्पस्टार्ट के ग्राफिकल इंटरफेस के माध्यम से अमेज़ॅन सैजमेकर स्टूडियो, और प्रोग्राम के माध्यम से जम्पस्टार्ट एपीआई.

यदि आप सीधे जम्पस्टार्ट एपीआई कोड में कूदना चाहते हैं जिसे हम इस पोस्ट में समझाते हैं, तो आप निम्नलिखित नमूना जुपिटर नोटबुक का उल्लेख कर सकते हैं:

जम्पस्टार्ट सिंहावलोकन

जम्पस्टार्ट आपको कोड की एक भी पंक्ति लिखे बिना विभिन्न कार्यों के लिए एमएल मॉडल के साथ आरंभ करने में मदद करता है। लेखन के समय, जम्पस्टार्ट आपको निम्नलिखित कार्य करने में सक्षम बनाता है:

- सामान्य एमएल कार्यों के लिए पूर्व-प्रशिक्षित मॉडल तैनात करें - जम्पस्टार्ट आपको बड़े, सार्वजनिक रूप से उपलब्ध डेटासेट पर पूर्व-प्रशिक्षित मॉडलों की आसान तैनाती प्रदान करके बिना किसी विकास प्रयास के सामान्य एमएल कार्यों को संबोधित करने में सक्षम बनाता है। एमएल अनुसंधान समुदाय ने हाल ही में विकसित किए गए अधिकांश मॉडलों को सार्वजनिक रूप से उपयोग के लिए उपलब्ध कराने में बड़ी मात्रा में प्रयास किया है। जम्पस्टार्ट 300 से अधिक मॉडलों का एक संग्रह होस्ट करता है, जिसमें ऑब्जेक्ट डिटेक्शन, टेक्स्ट वर्गीकरण और टेक्स्ट जनरेशन जैसे 15 सबसे लोकप्रिय एमएल कार्य शामिल हैं, जिससे शुरुआती लोगों के लिए उनका उपयोग करना आसान हो जाता है। ये मॉडल लोकप्रिय मॉडल हब जैसे कि TensorFlow, PyTorch, Hugging Face और MXNet से लिए गए हैं।

- पूर्व-प्रशिक्षित मॉडल को फाइन-ट्यून करें - जम्पस्टार्ट आपको अपने स्वयं के प्रशिक्षण एल्गोरिथम को लिखने की आवश्यकता के बिना पूर्व-प्रशिक्षित मॉडल को ठीक करने की अनुमति देता है। एमएल में, एक डोमेन में सीखे गए ज्ञान को दूसरे डोमेन में स्थानांतरित करने की क्षमता को कहा जाता है सीखने का स्थानांतरण. आप अपने छोटे डेटासेट पर सटीक मॉडल तैयार करने के लिए ट्रांसफर लर्निंग का उपयोग कर सकते हैं, जिसमें मूल मॉडल के प्रशिक्षण में शामिल लोगों की तुलना में बहुत कम प्रशिक्षण लागत होती है। जम्पस्टार्ट में लाइटजीबीएम, कैटबॉस्ट, एक्सजीबूस्ट और स्किकिट-लर्न पर आधारित लोकप्रिय प्रशिक्षण एल्गोरिदम भी शामिल हैं, जिन्हें आप सारणीबद्ध प्रतिगमन और वर्गीकरण के लिए खरोंच से प्रशिक्षित कर सकते हैं।

- पूर्व-निर्मित समाधानों का उपयोग करें - जम्पस्टार्ट आम एमएल उपयोग के मामलों के लिए 17 समाधानों का एक सेट प्रदान करता है, जैसे मांग पूर्वानुमान और औद्योगिक और वित्तीय अनुप्रयोग, जिन्हें आप कुछ ही क्लिक के साथ तैनात कर सकते हैं। समाधान एंड-टू-एंड एमएल एप्लिकेशन हैं जो एक विशेष व्यावसायिक उपयोग के मामले को हल करने के लिए विभिन्न एडब्ल्यूएस सेवाओं को एक साथ जोड़ते हैं। वे उपयोग करते हैं एडब्ल्यूएस CloudFormation त्वरित परिनियोजन के लिए टेम्प्लेट और संदर्भ आर्किटेक्चर, जिसका अर्थ है कि वे पूरी तरह से अनुकूलन योग्य हैं।

- सेजमेकर एल्गोरिदम के लिए नोटबुक उदाहरण देखें - सेजमेकर डेटा वैज्ञानिकों और एमएल प्रैक्टिशनरों को प्रशिक्षण और एमएल मॉडल को जल्दी से तैनात करने में मदद करने के लिए बिल्ट-इन एल्गोरिदम का एक सूट प्रदान करता है। जम्पस्टार्ट नमूना नोटबुक प्रदान करता है जिसका उपयोग आप इन एल्गोरिदम का शीघ्रता से उपयोग करने के लिए कर सकते हैं।

- प्रशिक्षण वीडियो और ब्लॉग की समीक्षा करें - जम्पस्टार्ट कई ब्लॉग पोस्ट और वीडियो भी प्रदान करता है जो आपको सिखाते हैं कि सेजमेकर के भीतर विभिन्न कार्यात्मकताओं का उपयोग कैसे करें।

जम्पस्टार्ट कस्टम वीपीसी सेटिंग्स को स्वीकार करता है और AWS प्रमुख प्रबंधन सेवा (AWS KMS) एन्क्रिप्शन कुंजियाँ, ताकि आप अपने एंटरप्राइज़ परिवेश में उपलब्ध मॉडलों और समाधानों का सुरक्षित रूप से उपयोग कर सकें। आप अपनी सुरक्षा सेटिंग्स को स्टूडियो के भीतर या सेजमेकर पायथन एसडीके के माध्यम से जम्पस्टार्ट में पास कर सकते हैं।

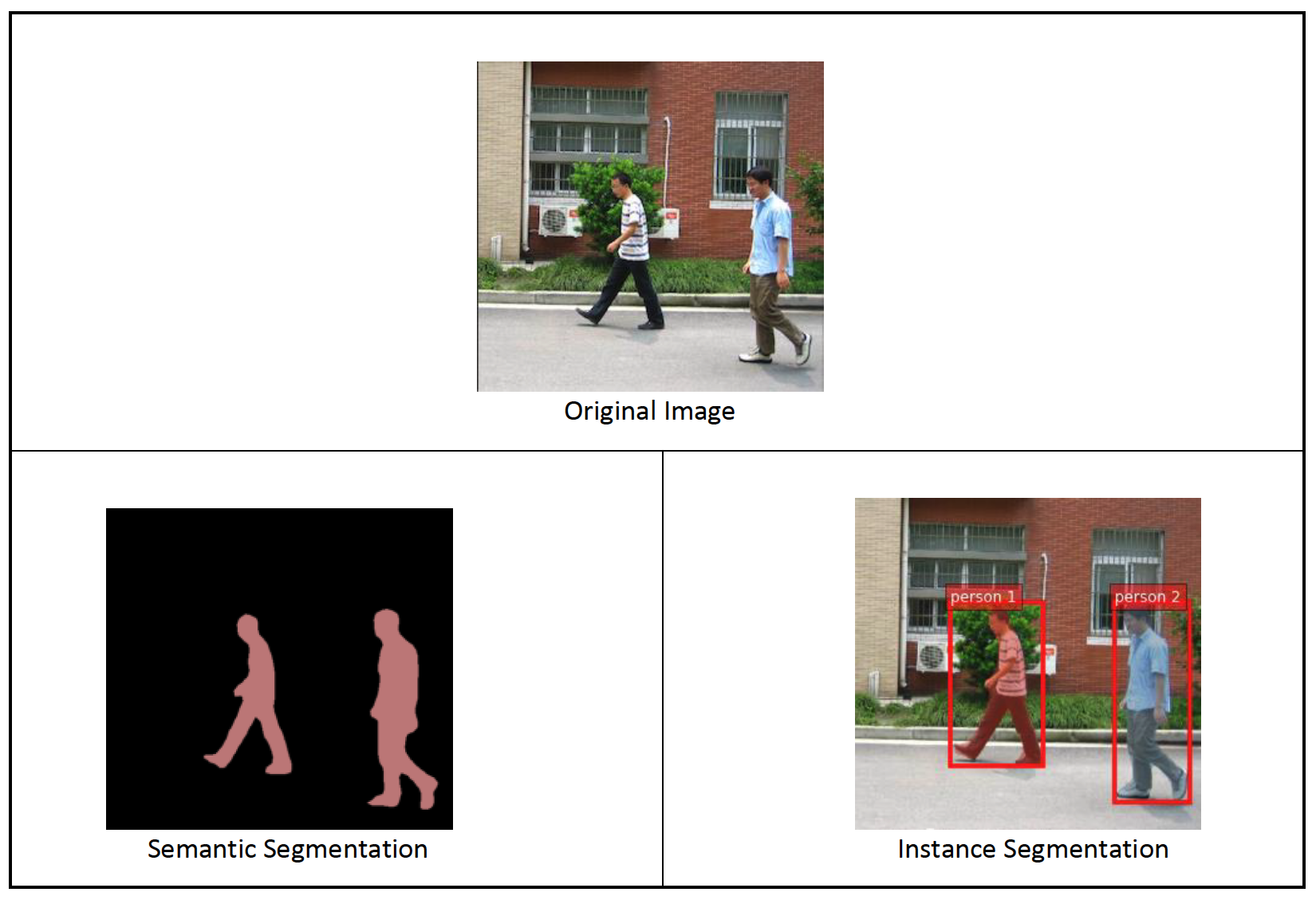

शब्दार्थ विभाजन

सिमेंटिक सेगमेंटेशन एक इनपुट इमेज में दिखाई देने वाली वस्तुओं के प्रत्येक वर्ग को चित्रित करता है। यह इनपुट छवि के प्रत्येक पिक्सेल को कक्षाओं के पूर्वनिर्धारित सेट से क्लास लेबल के साथ टैग (वर्गीकृत) करता है। एक ही वर्ग की कई वस्तुओं को एक ही मुखौटा में मैप किया जाता है।

फ़ाइन-ट्यूनिंग के लिए उपलब्ध मॉडल बेस नेटवर्क के शीर्ष पर एक पूरी तरह से दृढ़ नेटवर्क (FCN) "हेड" बनाता है। फ़ाइन-ट्यूनिंग चरण FCHead को फ़ाइन-ट्यून करता है, जबकि बाकी मॉडल के मापदंडों को स्थिर रखता है, और फ़ाइन-ट्यून किए गए मॉडल को लौटाता है। इसका उद्देश्य FCN को प्रशिक्षित करने के लिए प्रति-पिक्सेल सॉफ्टमैक्स क्रॉस एन्ट्रापी हानि को कम करना है। फ़ाइन-ट्यूनिंग द्वारा लौटाए गए मॉडल को आगे अनुमान के लिए तैनात किया जा सकता है।

यदि प्रशिक्षण डेटा में दो चित्र हैं, तो इनपुट निर्देशिका निम्न कोड की तरह दिखनी चाहिए। .png फाइलों के नाम कुछ भी हो सकते हैं।

मुखौटा फाइलों में प्रत्येक पिक्सेल के लिए कक्षा लेबल की जानकारी होनी चाहिए।

उदाहरण विभाजन

इंस्टेंस सेगमेंटेशन एक छवि में दिखाई देने वाली रुचि की प्रत्येक विशिष्ट वस्तु का पता लगाता है और उसे चित्रित करता है। यह प्रत्येक पिक्सेल को एक इंस्टेंस लेबल के साथ टैग करता है। जबकि सिमेंटिक सेगमेंटेशन एक ही टैग को एक ही क्लास के कई ऑब्जेक्ट्स के पिक्सल्स को असाइन करता है, इंस्टेंस सेगमेंटेशन एक अलग टैग के साथ इमेज पर किसी ऑब्जेक्ट की प्रत्येक घटना के अनुरूप पिक्सल को आगे लेबल करता है।

वर्तमान में, जम्पस्टार्ट इंस्टेंस सेगमेंटेशन के लिए केवल अनुमान मॉडल पेश करता है और फ़ाइन-ट्यूनिंग का समर्थन नहीं करता है।

निम्नलिखित छवियां सिमेंटिक सेगमेंटेशन और इंस्टेंस सेगमेंटेशन में अनुमान के बीच अंतर को दर्शाती हैं। मूल छवि में छवि में दो लोग हैं। सिमेंटिक सेगमेंटेशन छवि में कई लोगों को एक इकाई के रूप में मानता है: Person. हालांकि, इंस्टेंस सेगमेंटेशन के भीतर अलग-अलग लोगों की पहचान करता है Person वर्ग.

समाधान अवलोकन

निम्नलिखित खंड जम्पस्टार्ट के साथ सिमेंटिक विभाजन करने के लिए एक चरण-दर-चरण डेमो प्रदान करते हैं, दोनों स्टूडियो यूआई और जम्पस्टार्ट एपीआई के माध्यम से।

हम निम्नलिखित चरणों से गुजरते हैं:

- स्टूडियो यूआई के माध्यम से जम्पस्टार्ट तक पहुँचें:

- पूर्व-प्रशिक्षित मॉडल पर अनुमान चलाएँ।

- पूर्व-प्रशिक्षित मॉडल को फाइन-ट्यून करें।

- सेजमेकर पायथन एसडीके के साथ प्रोग्रामेटिक रूप से जम्पस्टार्ट का प्रयोग करें:

- पूर्व-प्रशिक्षित मॉडल पर अनुमान चलाएँ।

- पूर्व-प्रशिक्षित मॉडल को फाइन-ट्यून करें।

हम जम्पस्टार्ट की अतिरिक्त उन्नत विशेषताओं पर भी चर्चा करते हैं।

Studio UI के माध्यम से जम्पस्टार्ट तक पहुँचें

इस खंड में, हम स्टूडियो यूआई के माध्यम से जम्पस्टार्ट मॉडल को प्रशिक्षित और तैनात करने का तरीका प्रदर्शित करते हैं।

पूर्व-प्रशिक्षित मॉडल पर अनुमान चलाएं

निम्नलिखित वीडियो आपको दिखाता है कि जम्पस्टार्ट पर एक पूर्व-प्रशिक्षित सिमेंटिक सेगमेंटेशन मॉडल कैसे खोजा जाए और इसे कैसे परिनियोजित किया जाए। मॉडल पृष्ठ में मॉडल के बारे में मूल्यवान जानकारी, इसका उपयोग कैसे करें, अपेक्षित डेटा प्रारूप और कुछ फ़ाइन-ट्यूनिंग विवरण शामिल हैं। आप जम्पस्टार्ट में उपलब्ध किसी भी पूर्व-प्रशिक्षित मॉडल को तैनात कर सकते हैं। अनुमान के लिए, हम ml.g4dn.xlarge इंस्टेंस प्रकार चुनते हैं। यह कम अनुमान विलंबता के लिए आवश्यक GPU त्वरण प्रदान करता है, लेकिन कम कीमत बिंदु पर। सेजमेकर होस्टिंग इंस्टेंस को कॉन्फ़िगर करने के बाद, चुनें तैनाती. आपका स्थायी समापन बिंदु उठने और चलने में 5-10 मिनट लग सकते हैं।

कुछ मिनटों के बाद, आपका समापन बिंदु चालू है और अनुमान अनुरोधों का जवाब देने के लिए तैयार है।

इसी तरह, आप जम्पस्टार्ट सर्च बार में सिमेंटिक सेगमेंटेशन के बजाय इंस्टेंस सेगमेंटेशन की खोज करते समय पिछले वीडियो में समान चरणों का पालन करके एक पूर्व-प्रशिक्षित इंस्टेंस सेगमेंटेशन मॉडल को तैनात कर सकते हैं।

पूर्व-प्रशिक्षित मॉडल को फाइन-ट्यून करें

निम्न वीडियो दिखाता है कि जम्पस्टार्ट में सिमेंटिक सेगमेंटेशन मॉडल को कैसे ढूंढा और ठीक किया जाए। वीडियो में, हम मॉडल का उपयोग करके फाइन-ट्यून करते हैं PennFudanPed डेटासेट, जम्पस्टार्ट में डिफ़ॉल्ट रूप से प्रदान किया जाता है, जिसे आप के अंतर्गत डाउनलोड कर सकते हैं अपाचे 2.0 लाइसेंस.

अपने स्वयं के डेटासेट पर फ़ाइन-ट्यूनिंग में डेटा का सही स्वरूपण लेना (जैसा कि मॉडल पृष्ठ पर बताया गया है) को अपलोड करना शामिल है अमेज़न सरल भंडारण सेवा (अमेज़ॅन एस 3), और डेटा स्रोत कॉन्फ़िगरेशन में अपना स्थान निर्दिष्ट करना। हम डिफ़ॉल्ट रूप से सेट किए गए समान हाइपरपैरामीटर मानों का उपयोग करते हैं (युगों की संख्या, सीखने की दर और बैच आकार)। हम अपने सेजमेकर प्रशिक्षण उदाहरण के रूप में GPU समर्थित ml.p3.2xlarge का भी उपयोग करते हैं।

आप सीधे स्टूडियो कंसोल पर चल रहे अपने प्रशिक्षण कार्य की निगरानी कर सकते हैं, और इसके पूरा होने पर सूचित किया जाता है। प्रशिक्षण पूरा होने के बाद, आप उसी पृष्ठ से फ़ाइन-ट्यून किए गए मॉडल को परिनियोजित कर सकते हैं जिसमें प्रशिक्षण कार्य विवरण होता है। परिनियोजन वर्कफ़्लो पूर्व-प्रशिक्षित मॉडल को परिनियोजित करने के समान है।

सेजमेकर एसडीके के साथ प्रोग्रामेटिक रूप से जम्पस्टार्ट का उपयोग करें

पिछले अनुभागों में, हमने दिखाया था कि कैसे आप एक पूर्व-प्रशिक्षित मॉडल को परिनियोजित करने के लिए जम्पस्टार्ट UI का उपयोग कर सकते हैं और कुछ ही क्लिक में इसे अंतःक्रियात्मक रूप से ठीक कर सकते हैं। हालांकि, आप सेजमेकर एसडीके में एकीकृत एपीआई का उपयोग करके जम्पस्टार्ट के मॉडल और प्रोग्रामेटिक रूप से आसान फाइन-ट्यूनिंग का भी उपयोग कर सकते हैं। अब हम एक त्वरित उदाहरण पर चलते हैं कि आप पिछली प्रक्रिया को कैसे दोहरा सकते हैं। इस डेमो के सभी चरण संलग्न नोटबुक में उपलब्ध हैं जम्पस्टार्ट का परिचय - उदाहरण विभाजन और जम्पस्टार्ट का परिचय - सिमेंटिक सेगमेंटेशन.

पूर्व-प्रशिक्षित मॉडल पर अनुमान चलाएं

इस खंड में, हम जम्पस्टार्ट में एक उपयुक्त पूर्व-प्रशिक्षित मॉडल का चयन करते हैं, इस मॉडल को सेजमेकर समापन बिंदु पर तैनात करते हैं, और परिनियोजित समापन बिंदु पर अनुमान चलाते हैं।

सेजमेकर डॉकर कंटेनरों पर आधारित एक प्लेटफॉर्म है। जम्पस्टार्ट उपलब्ध ढांचे-विशिष्ट का उपयोग करता है सेजमेकर डीप लर्निंग कंटेनर (डीएलसी)। हम चयनित कार्य के लिए प्रशिक्षण और अनुमान को संभालने के लिए कोई अतिरिक्त पैकेज, साथ ही स्क्रिप्ट प्राप्त करते हैं। अंत में, पूर्व-प्रशिक्षित मॉडल कलाकृतियों को अलग से लाया जाता है model_uris, जो मंच को लचीलापन प्रदान करता है। आप एकल प्रशिक्षण या अनुमान स्क्रिप्ट के साथ एक ही कार्य के लिए पूर्व-प्रशिक्षित किसी भी मॉडल का उपयोग कर सकते हैं। निम्नलिखित कोड देखें:

उदाहरण के लिए विभाजन, हम सेट कर सकते हैं model_id सेवा मेरे mxnet-semseg-fcn-resnet50-ade. पहचानकर्ता में है उदाहरण विभाजन से मेल खाता है।

इसके बाद, हम संसाधनों को a . में फीड करते हैं सेजमेकर मॉडल उदाहरण और एक समापन बिंदु तैनात करें:

कुछ मिनटों के बाद, हमारा मॉडल तैनात हो जाता है और हम वास्तविक समय में इससे पूर्वानुमान प्राप्त कर सकते हैं!

निम्नलिखित कोड स्निपेट आपको एक झलक देता है कि सिमेंटिक सेगमेंटेशन कैसा दिखता है। प्रत्येक पिक्सेल के लिए अनुमानित मास्क की कल्पना की जाती है। एक परिनियोजित मॉडल से निष्कर्ष प्राप्त करने के लिए, एक इनपुट छवि को बाइनरी प्रारूप में आपूर्ति करने की आवश्यकता होती है। समापन बिंदु की प्रतिक्रिया छवि में प्रत्येक पिक्सेल के लिए एक अनुमानित लेबल है। हम उपयोग करते हैं query_endpoint और parse_response सहायक कार्य, जिन्हें परिभाषित किया गया है नोटबंदी के साथ:

पूर्व-प्रशिक्षित मॉडल को फाइन-ट्यून करें

किसी चयनित मॉडल को फाइन-ट्यून करने के लिए, हमें उस मॉडल का URI, साथ ही प्रशिक्षण स्क्रिप्ट और प्रशिक्षण के लिए उपयोग की जाने वाली कंटेनर छवि प्राप्त करने की आवश्यकता है। शुक्र है, ये तीन इनपुट पूरी तरह से मॉडल के नाम, संस्करण पर निर्भर करते हैं (उपलब्ध मॉडलों की सूची के लिए, देखें जम्पस्टार्ट उपलब्ध मॉडल तालिका), और जिस प्रकार का उदाहरण आप प्रशिक्षित करना चाहते हैं। यह निम्नलिखित कोड स्निपेट में प्रदर्शित किया गया है:

हम पुनः प्राप्त करते हैं model_id उसी मॉडल के अनुरूप जो हमने पहले इस्तेमाल किया था। अब आप इस जम्पस्टार्ट मॉडल को सेजमेकर एसडीके का उपयोग करके अपने स्वयं के कस्टम डेटासेट पर फाइन-ट्यून कर सकते हैं। हम एक ऐसे डेटासेट का उपयोग करते हैं जिसे सार्वजनिक रूप से Amazon S3 पर होस्ट किया जाता है, जो आसानी से सिमेंटिक सेगमेंटेशन पर केंद्रित होता है। डेटासेट को फाइन-ट्यूनिंग के लिए संरचित किया जाना चाहिए जैसा कि पिछले अनुभाग में बताया गया है। निम्नलिखित उदाहरण कोड देखें:

हम अपने चयनित मॉडल के लिए वही डिफ़ॉल्ट हाइपरपैरामीटर प्राप्त करते हैं जो हमने पिछले अनुभाग में देखे थे, का उपयोग करते हुए sagemaker.hyperparameters.retrieve_default(). फिर हम एक सेजमेकर अनुमानक को इंस्टेंट करते हैं और कॉल करते हैं .fit हमारे मॉडल को फाइन-ट्यूनिंग शुरू करने का तरीका, इसे हमारे प्रशिक्षण डेटा के लिए Amazon S3 URI पास करना। entry_point प्रदान की गई स्क्रिप्ट को transfer_learning.py (अन्य कार्यों और मॉडलों के लिए समान) नाम दिया गया है, और इनपुट डेटा चैनल को पास किया गया है .fit नाम होना चाहिए training.

एल्गोरिथम प्रशिक्षण के दौरान, आप या तो सेजमेकर नोटबुक में इसकी प्रगति की निगरानी कर सकते हैं, जहां आप स्वयं कोड चला रहे हैं, या अमेज़ॅन क्लाउडवॉच. जब प्रशिक्षण पूरा हो जाता है, तो फ़ाइन-ट्यून किए गए मॉडल कलाकृतियों को प्रशिक्षण कॉन्फ़िगरेशन में निर्दिष्ट अमेज़ॅन S3 आउटपुट स्थान पर अपलोड किया जाता है। अब आप मॉडल को पूर्व-प्रशिक्षित मॉडल की तरह ही तैनात कर सकते हैं।

उन्नत सुविधाओं

पूर्व-प्रशिक्षित मॉडलों को ठीक-ट्यूनिंग और परिनियोजित करने के अलावा, जम्पस्टार्ट कई उन्नत सुविधाएँ प्रदान करता है।

पहला है स्वचालित मॉडल ट्यूनिंग। यह आपको सेजमेकर एपीआई के माध्यम से प्रदान की गई सीमा के भीतर उच्चतम सटीकता के साथ हाइपरपैरामीटर मूल्यों को खोजने के लिए अपने एमएल मॉडल को स्वचालित रूप से ट्यून करने की अनुमति देता है।

दूसरे नंबर पर है वृद्धिशील प्रशिक्षण. यह आपको एक ऐसे मॉडल को प्रशिक्षित करने की अनुमति देता है जिसे आपने पहले से ही एक विस्तारित डेटासेट का उपयोग करके ठीक-ठीक किया है जिसमें एक अंतर्निहित पैटर्न शामिल है जिसे पिछले फ़ाइन-ट्यूनिंग रन में शामिल नहीं किया गया था, जिसके परिणामस्वरूप खराब मॉडल प्रदर्शन हुआ था। इंक्रीमेंटल ट्रेनिंग से समय और संसाधन दोनों की बचत होती है क्योंकि आपको मॉडल को नए सिरे से प्रशिक्षित करने की आवश्यकता नहीं होती है।

निष्कर्ष

इस पोस्ट में, हमने दिखाया कि कैसे एक पूर्व-प्रशिक्षित सिमेंटिक सेगमेंटेशन मॉडल को फ़ाइन-ट्यून और परिनियोजित किया जाए, और इसे जम्पस्टार्ट का उपयोग करके सेगमेंटेशन के लिए कैसे अनुकूलित किया जाए। आप कोड लिखने की आवश्यकता के बिना इसे पूरा कर सकते हैं। अपने आप समाधान का प्रयास करें और हमें अपनी टिप्पणी भेजें।

जम्पस्टार्ट के बारे में अधिक जानने के लिए और आप विभिन्न प्रकार के अन्य एमएल कार्यों के लिए ओपन-सोर्स पूर्व-प्रशिक्षित मॉडल का उपयोग कैसे कर सकते हैं, निम्नलिखित देखें एडब्ल्यूएस पुन: आविष्कार 2020 वीडियो.

लेखक के बारे में

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

संतोष कुलकर्णी Amazon वेब सर्विसेज में एंटरप्राइज सॉल्यूशंस आर्किटेक्ट हैं जो ऑस्ट्रेलिया में खेल ग्राहकों के साथ काम करते हैं। उन्हें एआई/एमएल, बिग डेटा और सॉफ्टवेयर विकास में अपने ज्ञान का उपयोग करके व्यावसायिक समस्याओं को हल करने के लिए बड़े पैमाने पर वितरित एप्लिकेशन बनाने का शौक है।

संतोष कुलकर्णी Amazon वेब सर्विसेज में एंटरप्राइज सॉल्यूशंस आर्किटेक्ट हैं जो ऑस्ट्रेलिया में खेल ग्राहकों के साथ काम करते हैं। उन्हें एआई/एमएल, बिग डेटा और सॉफ्टवेयर विकास में अपने ज्ञान का उपयोग करके व्यावसायिक समस्याओं को हल करने के लिए बड़े पैमाने पर वितरित एप्लिकेशन बनाने का शौक है।

लियोनार्डो बचेगा अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम में एक वरिष्ठ वैज्ञानिक और प्रबंधक हैं। उन्हें कंप्यूटर विजन के लिए एआई सेवाओं के निर्माण का शौक है।

लियोनार्डो बचेगा अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम में एक वरिष्ठ वैज्ञानिक और प्रबंधक हैं। उन्हें कंप्यूटर विजन के लिए एआई सेवाओं के निर्माण का शौक है।

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़न SageMaker

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- यंत्र अधिगम

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट