जैसे-जैसे फाउंडेशन मॉडल (एफएम) का लोकतंत्रीकरण अधिक प्रचलित होता जा रहा है और एआई-संवर्धित सेवाओं की मांग बढ़ रही है, एक सेवा के रूप में सॉफ्टवेयर (सास) प्रदाता मशीन लर्निंग (एमएल) प्लेटफार्मों का उपयोग करना चाह रहे हैं जो कई किरायेदारों का समर्थन करते हैं - उनके संगठन के आंतरिक डेटा वैज्ञानिकों के लिए और बाहरी ग्राहक। अधिक से अधिक कंपनियां अपने ग्राहकों के लिए अत्यधिक वैयक्तिकृत और प्रभावी सामग्री तैयार करने के लिए एफएम का उपयोग करने के मूल्य को समझ रही हैं। आपके स्वयं के डेटा पर फाइन-ट्यूनिंग एफएम आपके विशिष्ट उपयोग के मामले के लिए मॉडल सटीकता को काफी हद तक बढ़ा सकता है, चाहे वह पृष्ठ विज़िट संदर्भ का उपयोग करके बिक्री ईमेल उत्पन्न करना हो, कंपनी की सेवाओं के अनुरूप खोज उत्तर उत्पन्न करना हो, या ऐतिहासिक वार्तालापों पर प्रशिक्षण द्वारा ग्राहक सहायता को स्वचालित करना हो।

एक सेवा के रूप में जेनेरिक एआई मॉडल होस्टिंग प्रदान करना किसी भी संगठन को इन-हाउस एआई विशेषज्ञता की आवश्यकता के बिना, लागत प्रभावी तरीके से बड़े पैमाने पर एफएम को आसानी से एकीकृत करने, पायलट परीक्षण करने और तैनात करने में सक्षम बनाता है। यह कंपनियों को हाइपर-वैयक्तिकृत बिक्री और विपणन सामग्री, बुद्धिमान खोज और अनुकूलित ग्राहक सेवा वर्कफ़्लो जैसे एआई उपयोग मामलों के साथ प्रयोग करने की अनुमति देता है। विश्वसनीय ग्राहक डेटा पर आधारित होस्टेड जेनरेटिव मॉडल का उपयोग करके, व्यवसाय अपने ग्राहकों को बेहतर ढंग से संलग्न करने और सेवा देने के लिए व्यक्तिगत और प्रभावी एआई अनुप्रयोगों के अगले स्तर को वितरित कर सकते हैं।

अमेज़न SageMaker वास्तविक समय, अतुल्यकालिक और बैच परिवर्तन सहित विभिन्न एमएल अनुमान विकल्प प्रदान करता है। यह पोस्ट बड़े पैमाने पर लागत प्रभावी ढंग से एफएम की मेजबानी पर अनुदेशात्मक मार्गदर्शन प्रदान करने पर केंद्रित है। विशेष रूप से, हम वास्तविक समय अनुमान की त्वरित और प्रतिक्रियाशील दुनिया पर चर्चा करते हैं, एफएम के लिए वास्तविक समय अनुमान के लिए विभिन्न विकल्पों की खोज करते हैं।

अनुमान के लिए, मल्टी-टेनेंट एआई/एमएल आर्किटेक्चर को डेटा और मॉडल की आवश्यकताओं के साथ-साथ उन गणना संसाधनों पर विचार करने की आवश्यकता है जो इन मॉडलों से अनुमान लगाने के लिए आवश्यक हैं। यह विचार करना महत्वपूर्ण है कि बहु-किरायेदार एआई/एमएल मॉडल कैसे तैनात किए जाते हैं - आदर्श रूप से, सीपीयू और जीपीयू का इष्टतम उपयोग करने के लिए, आपको एक अनुमानित समाधान तैयार करने में सक्षम होना होगा जो सेवा थ्रूपुट को बढ़ा सकता है और यह सुनिश्चित करके लागत कम कर सकता है कि मॉडल वितरित हैं एक कुशल तरीके से गणना बुनियादी ढांचे में। इसके अलावा, ग्राहक ऐसे समाधानों की तलाश में हैं जो उन्हें स्क्रैच से सब कुछ बनाने की आवश्यकता के बिना सर्वोत्तम-अभ्यास अनुमान वास्तुकला को तैनात करने में मदद करें।

SageMaker Inference एक पूरी तरह से प्रबंधित ML होस्टिंग सेवा है। यह FedRAMP जैसे नियामक मानकों को पूरा करते हुए जेनेरिक AI अनुप्रयोगों के निर्माण का समर्थन करता है। सेजमेकर उच्च-थ्रूपुट अनुमान कार्यभार के लिए लागत-कुशल स्केलिंग सक्षम करता है। यह AWS Inferentia, AWS Graviton, NVIDIA GPU और Intel CPU जैसे हार्डवेयर पर रीयल-टाइम, एसिंक्रोनस और बैच अनुमान सहित विविध वर्कलोड का समर्थन करता है। सेजमेकर आपको अनुकूलन, कार्यभार अलगाव और कंटेनरीकरण पर पूर्ण नियंत्रण देता है। यह आपको मल्टी-मॉडल और मल्टी-कंटेनर परिनियोजन के समर्थन के साथ बड़े पैमाने पर सेवा समाधान के रूप में जेनरेटिव एआई बनाने में सक्षम बनाता है।

बड़े पैमाने पर फाउंडेशन मॉडल की मेजबानी की चुनौतियाँ

बड़े पैमाने पर अनुमान लगाने के लिए एफएम की मेजबानी में कुछ चुनौतियाँ निम्नलिखित हैं:

- बड़ी स्मृति पदचिह्न - दसियों या सैकड़ों अरबों मॉडल मापदंडों वाले एफएम अक्सर एकल त्वरक चिप की मेमोरी क्षमता से अधिक होते हैं।

- ट्रांसफार्मर धीमे हैं - एफएम में ऑटोरेग्रेसिव डिकोडिंग, विशेष रूप से लंबे इनपुट और आउटपुट अनुक्रमों के साथ, मेमोरी I/O संचालन को बढ़ा देता है। यह अस्वीकार्य विलंबता अवधि में परिणत होता है, जो वास्तविक समय के अनुमान पर प्रतिकूल प्रभाव डालता है।

- लागत - एफएम को एमएल त्वरक की आवश्यकता होती है जो उच्च मेमोरी और उच्च कम्प्यूटेशनल शक्ति दोनों प्रदान करते हैं। किसी भी तरह का त्याग किए बिना उच्च थ्रूपुट और कम विलंबता प्राप्त करना एक विशेष कार्य है, जिसके लिए हार्डवेयर-सॉफ्टवेयर त्वरण सह-अनुकूलन की गहरी समझ की आवश्यकता होती है।

- बाजार में आने में अधिक समय - एफएम से इष्टतम प्रदर्शन कठोर ट्यूनिंग की मांग करता है। यह विशेष ट्यूनिंग प्रक्रिया, बुनियादी ढांचे के प्रबंधन की जटिलताओं के साथ मिलकर, बाजार-समय चक्र को लंबा कर देती है।

- कार्यभार अलगाव - बड़े पैमाने पर एफएम की मेजबानी विस्फोट-त्रिज्या को कम करने और शोर करने वाले पड़ोसियों को संभालने में चुनौतियों का परिचय देती है। मॉडल-विशिष्ट ट्रैफ़िक पैटर्न के जवाब में प्रत्येक एफएम को स्केल करने की क्षमता के लिए भारी भारोत्तोलन की आवश्यकता होती है।

- सैकड़ों एफएम तक स्केलिंग - एक साथ सैकड़ों एफएम का संचालन पर्याप्त परिचालन ओवरहेड का परिचय देता है। प्रभावी समापन बिंदु प्रबंधन, उचित स्लाइसिंग और त्वरक आवंटन, और मॉडल-विशिष्ट स्केलिंग ऐसे कार्य हैं जो अधिक मॉडल तैनात किए जाने पर जटिलता में बढ़ जाते हैं।

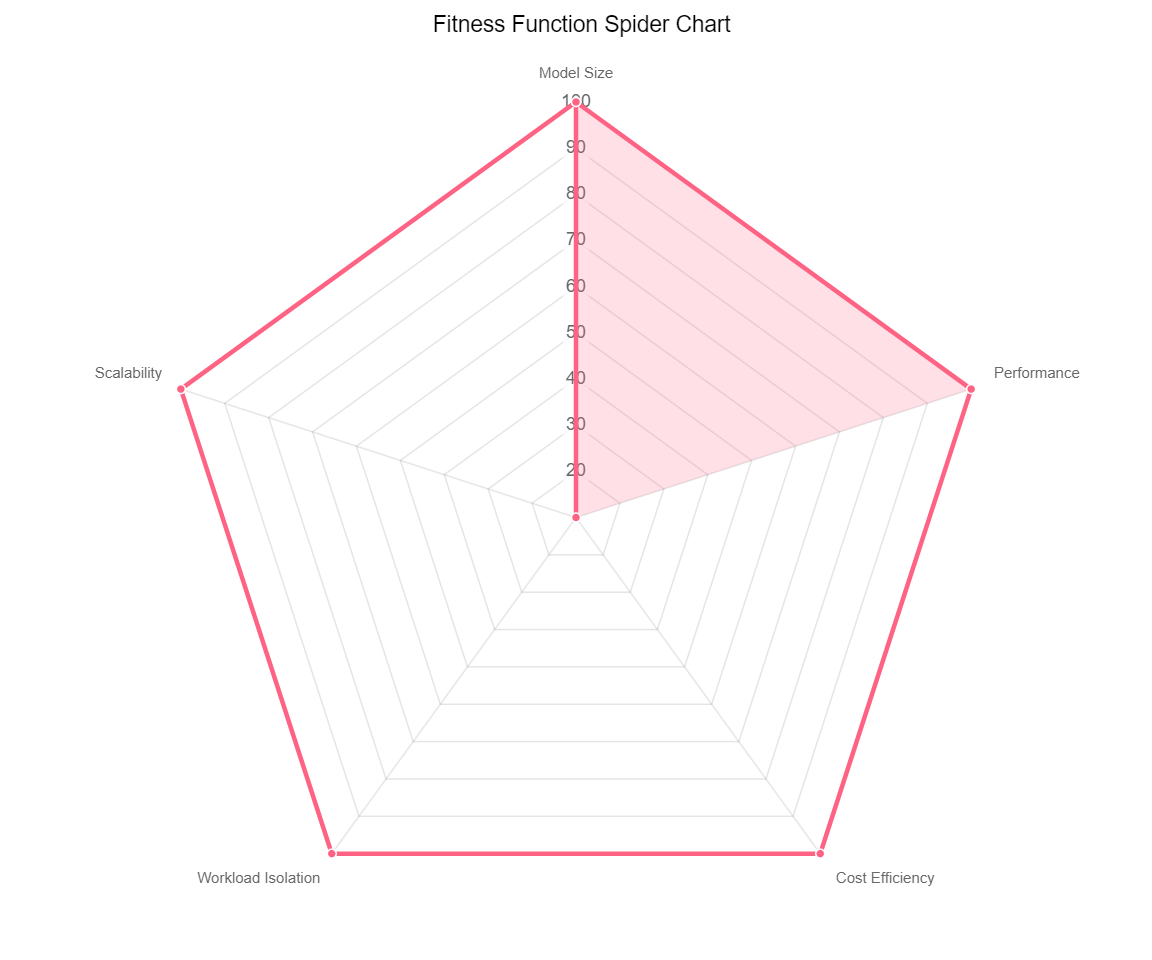

फिटनेस कार्य

सही होस्टिंग विकल्प पर निर्णय लेना महत्वपूर्ण है क्योंकि यह आपके एप्लिकेशन द्वारा प्रदान किए गए अंतिम-उपयोगकर्ताओं को प्रभावित करता है। इस प्रयोजन के लिए, हम की अवधारणा उधार ले रहे हैं फिटनेस कार्य, जिसे AWS पार्टनर थॉट वर्क्स के नील फोर्ड और उनके सहयोगियों ने अपने काम में गढ़ा था विकासवादी वास्तुकला का निर्माण. फिटनेस फ़ंक्शन आपके उद्देश्यों के आधार पर विभिन्न होस्टिंग विकल्पों का एक निर्देशात्मक मूल्यांकन प्रदान करते हैं। फिटनेस फ़ंक्शन आपके आर्किटेक्चर के नियोजित विकास के लिए आवश्यक डेटा प्राप्त करने में आपकी सहायता करते हैं। वे यह आकलन करने के लिए मापने योग्य मान निर्धारित करते हैं कि आपका समाधान आपके निर्धारित लक्ष्यों को प्राप्त करने के कितना करीब है। वांछित परिवर्तन प्रक्रिया का मार्गदर्शन करने के लिए वास्तुकला विकसित होने पर फिटनेस कार्यों को अनुकूलित किया जा सकता है और किया जाना चाहिए। यह आर्किटेक्ट्स को टीम की स्वायत्तता बनाए रखते हुए अपनी टीमों का मार्गदर्शन करने के लिए एक उपकरण प्रदान करता है।

जब बड़े पैमाने पर और लागत प्रभावी ढंग से सही एफएम अनुमान विकल्प का चयन करने की बात आती है तो हम निम्नलिखित फिटनेस कार्यों पर विचार करने का प्रस्ताव करते हैं:

- फाउंडेशन मॉडल का आकार - एफएम ट्रांसफार्मर पर आधारित होते हैं। मॉडलों के विशाल आकार के कारण ट्रांसफॉर्मर लंबे पाठ अनुक्रम उत्पन्न करने में धीमे और मेमोरी-भूखे होते हैं। बड़े भाषा मॉडल (एलएलएम) एक प्रकार के एफएम हैं, जिनका उपयोग जब पाठ अनुक्रम उत्पन्न करने के लिए किया जाता है, तो भारी मात्रा में कंप्यूटिंग शक्ति की आवश्यकता होती है और उपलब्ध उच्च बैंडविड्थ मेमोरी (एचबीएम) और गणना क्षमता तक पहुंचने में कठिनाई होती है। ऐसा इसलिए है क्योंकि उपलब्ध मेमोरी बैंडविड्थ का एक बड़ा हिस्सा मॉडल के मापदंडों को लोड करने और द्वारा उपभोग किया जाता है ऑटो-रिग्रेसिव डिकोडिंग प्रक्रिया. परिणामस्वरूप, भारी मात्रा में गणना शक्ति के साथ भी, एफएम मेमोरी I/O और गणना सीमाओं द्वारा सीमित हैं। इसलिए, मॉडल का आकार बहुत सारे निर्णय निर्धारित करता है, जैसे कि क्या मॉडल एकल त्वरक पर फिट होगा या उच्च थ्रूपुट पर अनुमान को चलाने के लिए उदाहरण पर मॉडल शार्डिंग का उपयोग करके एकाधिक एमएल त्वरक की आवश्यकता होगी। 3 बिलियन से अधिक पैरामीटर वाले मॉडल को आम तौर पर एकाधिक एमएल त्वरक की आवश्यकता शुरू हो जाएगी क्योंकि मॉडल एक एकल त्वरक डिवाइस में फिट नहीं हो सकता है।

- प्रदर्शन और एफएम अनुमान विलंबता - कई एमएल मॉडल और एप्लिकेशन विलंबता महत्वपूर्ण हैं, जिसमें अनुमान विलंबता सेवा-स्तरीय उद्देश्य द्वारा निर्दिष्ट सीमा के भीतर होनी चाहिए। एफएम अनुमान विलंबता कई कारकों पर निर्भर करती है, जिनमें शामिल हैं:

- एफएम मॉडल का आकार - मॉडल आकार, रनटाइम पर परिमाणीकरण सहित।

- हार्डवेयर - कंप्यूट (टीएफएलओपीएस), एचबीएम आकार और बैंडविड्थ, नेटवर्क बैंडविड्थ, इंट्रा-इंस्टेंस इंटरकनेक्ट स्पीड और स्टोरेज बैंडविड्थ।

- सॉफ्टवेयर वातावरण - मॉडल सर्वर, मॉडल समानांतर लाइब्रेरी, मॉडल अनुकूलन इंजन, सामूहिक संचार प्रदर्शन, मॉडल नेटवर्क वास्तुकला, परिमाणीकरण और एमएल ढांचा।

- शीघ्र - इनपुट और आउटपुट लंबाई और हाइपरपैरामीटर।

- स्केलिंग विलंबता - ट्रैफ़िक के जवाब में स्केल करने का समय।

- शीत प्रारंभ विलंबता - मॉडल लोड को प्री-वार्म करने जैसी सुविधाएं एफएम लोड करने में कोल्ड स्टार्ट विलंबता को कम कर सकती हैं।

- कार्यभार अलगाव - यह विनियामक और अनुपालन परिप्रेक्ष्य से कार्यभार अलगाव आवश्यकताओं को संदर्भित करता है, जिसमें एआई मॉडल और एल्गोरिदम की गोपनीयता और अखंडता की रक्षा करना, एआई अनुमान के दौरान डेटा की गोपनीयता, और एआई बौद्धिक संपदा (आईपी) को अनधिकृत पहुंच से या जोखिम प्रबंधन परिप्रेक्ष्य से बचाना शामिल है। उदाहरण के लिए, आप विस्फोट-त्रिज्या को जानबूझकर कम करके या शोर मचाने वाले पड़ोसियों को रोककर किसी सुरक्षा घटना के प्रभाव को कम कर सकते हैं।

- कीमत का सामर्थ्य - एक स्केलेबल फ्रेमवर्क पर एफएम मॉडल और एमएल एप्लिकेशन को तैनात करना और बनाए रखना एक महत्वपूर्ण व्यावसायिक प्रक्रिया है, और मॉडल होस्टिंग इंफ्रास्ट्रक्चर, होस्टिंग विकल्प, एमएल फ्रेमवर्क, एमएल मॉडल विशेषताओं, अनुकूलन, स्केलिंग नीति के बारे में किए गए विकल्पों के आधार पर लागत काफी भिन्न हो सकती है। , और अधिक। यह सुनिश्चित करने के लिए कि लागत नियंत्रण में रहे, कार्यभार को हार्डवेयर बुनियादी ढांचे का इष्टतम उपयोग करना चाहिए। यह फिटनेस फ़ंक्शन विशेष रूप से बुनियादी ढांचे की लागत को संदर्भित करता है, जो स्वामित्व की कुल लागत (टीसीओ) का हिस्सा है। बुनियादी ढांचे की लागत भंडारण, नेटवर्क और गणना की संयुक्त लागत है। परिचालन लागत और सुरक्षा और अनुपालन लागत सहित टीसीओ के अन्य घटकों को समझना भी महत्वपूर्ण है। परिचालन लागत एमएल बुनियादी ढांचे के संचालन, निगरानी और रखरखाव की संयुक्त लागत है। परिचालन लागत की गणना प्रत्येक परिदृश्य के आधार पर आवश्यक इंजीनियरों की संख्या और एक विशिष्ट अवधि में एकत्रित इंजीनियरों के वार्षिक वेतन के आधार पर की जाती है। जब लागत बचाने के लिए कोई ट्रैफ़िक नहीं होता है तो वे स्वचालित रूप से प्रति मॉडल शून्य पर स्केल कर देते हैं।

- अनुमापकता - यह भी शामिल है:

- एक बहु-किरायेदार मंच में अनुमान के लिए सैकड़ों एफएम के प्रबंधन में परिचालन ओवरहेड।

- एक ही समापन बिंदु और प्रति मॉडल स्केल में एकाधिक एफएम पैक करने की क्षमता।

- कार्यभार पैटर्न के आधार पर इंस्टेंस-स्तर और मॉडल कंटेनर-स्तरीय स्केलिंग को सक्षम करना।

- प्रति समापन बिंदु सैकड़ों एफएम तक स्केलिंग के लिए समर्थन।

- बेड़े में मॉडलों की प्रारंभिक नियुक्ति और अपर्याप्त त्वरक को संभालने के लिए समर्थन।

फिटनेस कार्यों में आयामों का प्रतिनिधित्व करना

हम फिटनेस कार्यों में आयामों को दर्शाने के लिए स्पाइडर चार्ट का उपयोग करते हैं, जिसे कभी-कभी रडार चार्ट भी कहा जाता है। स्पाइडर चार्ट का उपयोग अक्सर तब किया जाता है जब आप कई अद्वितीय आयामों में डेटा प्रदर्शित करना चाहते हैं। ये आयाम आम तौर पर मात्रात्मक होते हैं, और आम तौर पर शून्य से अधिकतम मान तक होते हैं। प्रत्येक आयाम की सीमा को एक-दूसरे के लिए सामान्यीकृत किया जाता है, ताकि जब हम अपना स्पाइडर चार्ट बनाएं, तो शून्य से एक आयाम के अधिकतम मान तक की रेखा की लंबाई हर आयाम के लिए समान होगी।

निम्नलिखित चार्ट सेजमेकर पर अपना आर्किटेक्चर चुनते समय शामिल निर्णय लेने की प्रक्रिया को दर्शाता है। स्पाइडर चार्ट पर प्रत्येक त्रिज्या फिटनेस कार्यों में से एक है जिसे आप अपना अनुमान समाधान बनाते समय प्राथमिकता देंगे।

आदर्श रूप से, आप एक ऐसी आकृति चाहेंगे जो सभी तरफ से समबाहु हो (एक पंचकोण)। इससे पता चलता है कि आप सभी फिटनेस कार्यों को अनुकूलित करने में सक्षम हैं। लेकिन वास्तविकता यह है कि उस आकार को हासिल करना चुनौतीपूर्ण होगा - जैसे ही आप एक फिटनेस फ़ंक्शन को प्राथमिकता देंगे, यह दूसरे दायरे की रेखाओं को प्रभावित करेगा। इसका मतलब यह है कि आपके जेनेरिक एआई एप्लिकेशन के लिए सबसे महत्वपूर्ण क्या है, इसके आधार पर हमेशा ट्रेड-ऑफ होगा, और आपके पास एक ग्राफ होगा जो एक विशिष्ट दायरे की ओर झुका होगा। यह वह मानदंड है जिसे आप प्रत्येक कार्य को कैसे देखते हैं इसके आधार पर दूसरों के पक्ष में प्राथमिकता कम करने के इच्छुक हो सकते हैं। हमारे चार्ट में, प्रत्येक फिटनेस फ़ंक्शन के मीट्रिक वजन को इस प्रकार परिभाषित किया गया है - मूल्य जितना कम होगा, उस फिटनेस फ़ंक्शन के लिए उतना ही कम इष्टतम होगा (मॉडल आकार के अपवाद के साथ, इस मामले में मूल्य जितना अधिक होगा, उतना बड़ा आकार होगा) नमूना)।

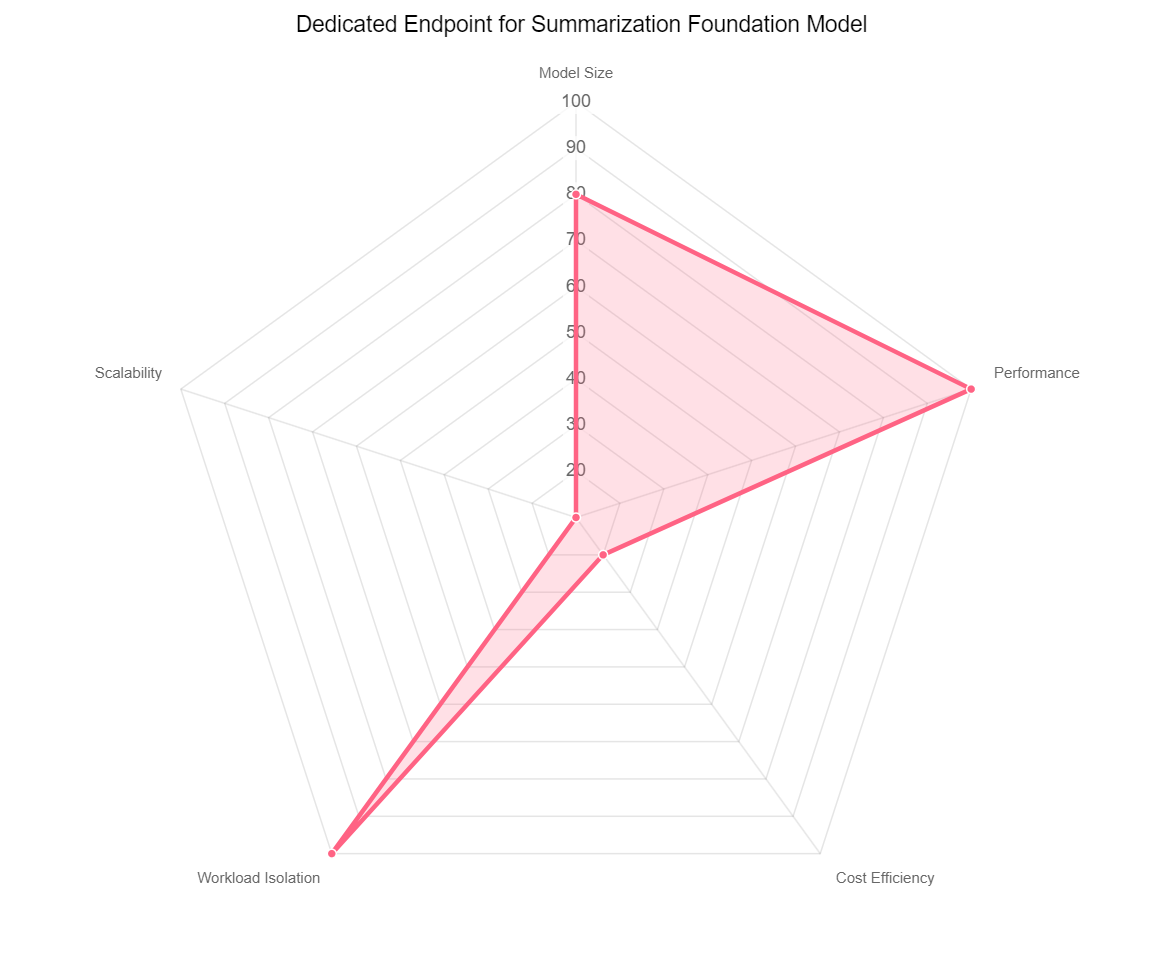

उदाहरण के लिए, आइए एक उपयोग का मामला लें जहां आप केस डेटा और ग्राहक इतिहास के आधार पर सेवा मामलों और ग्राहक संलग्नताओं के कार्य सारांश बनाने के लिए एक बड़े सारांश मॉडल (जैसे एंथ्रोपिक क्लाउड) का उपयोग करना चाहेंगे। हमारे पास निम्नलिखित स्पाइडर चार्ट है।

क्योंकि इसमें संवेदनशील ग्राहक डेटा शामिल हो सकता है, आप इस कार्यभार को अन्य मॉडलों से अलग करना और इसे एकल-मॉडल एंडपॉइंट पर होस्ट करना चुन रहे हैं, जिससे इसे स्केल करना चुनौतीपूर्ण हो सकता है क्योंकि आपको प्रत्येक एफएम के लिए अलग-अलग एंडपॉइंट को स्पिन और प्रबंधित करना होगा। आप जिस जेनेरिक एआई एप्लिकेशन के साथ मॉडल का उपयोग कर रहे हैं, उसका उपयोग वास्तविक समय में सेवा एजेंटों द्वारा किया जा रहा है, इसलिए विलंबता और थ्रूपुट एक प्राथमिकता है, इसलिए P4De जैसे बड़े इंस्टेंस प्रकारों का उपयोग करने की आवश्यकता है। इस स्थिति में, लागत अधिक हो सकती है क्योंकि प्राथमिकता अलगाव, विलंबता और थ्रूपुट है।

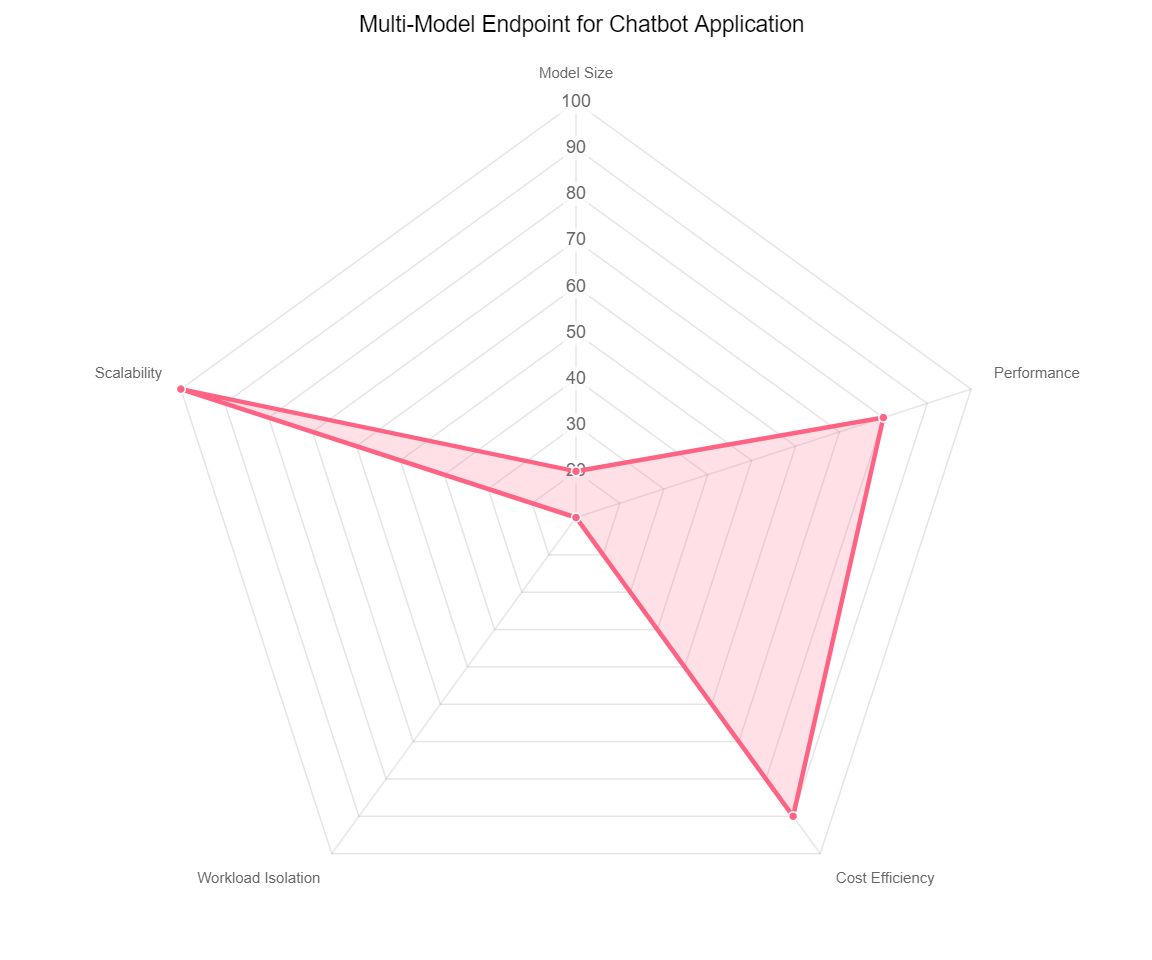

एक अन्य उपयोग का मामला एक सेवा संगठन होगा जो एक प्रश्नोत्तर चैटबॉट एप्लिकेशन का निर्माण करेगा जो बड़ी संख्या में ग्राहकों के लिए अनुकूलित है। निम्नलिखित स्पाइडर चार्ट उनकी प्राथमिकताओं को दर्शाता है।

प्रत्येक चैटबॉट अनुभव को प्रत्येक विशिष्ट ग्राहक के अनुरूप बनाने की आवश्यकता हो सकती है। उपयोग किए जा रहे मॉडल अपेक्षाकृत छोटे हो सकते हैं (FLAN-T5-XXL, Llama 7B, और k-NN), और प्रत्येक चैटबॉट प्रत्येक दिन अलग-अलग समय क्षेत्रों के लिए निर्धारित घंटों पर काम करता है। समाधान में रिट्रीवल ऑगमेंटेड जेनरेशन (आरएजी) को एक डेटाबेस के साथ शामिल किया जा सकता है जिसमें वास्तविक समय में अनुमान के साथ उपयोग किए जाने वाले सभी ज्ञान आधार आइटम शामिल होंगे। इस चैटबॉट के माध्यम से किसी भी ग्राहक-विशिष्ट डेटा का आदान-प्रदान नहीं किया जा रहा है। कोल्ड स्टार्ट विलंबताएं सहनीय हैं क्योंकि चैटबॉट एक निर्धारित समय पर काम करते हैं। इस उपयोग के मामले के लिए, आप एक मल्टी-मॉडल एंडपॉइंट आर्किटेक्चर चुन सकते हैं, और छोटे इंस्टेंस प्रकारों (जैसे जी 5) का उपयोग करके लागत को कम करने में सक्षम हो सकते हैं और संभावित रूप से प्रत्येक एंडपॉइंट पर पैमाने पर कई मॉडल होस्ट करके परिचालन ओवरहेड को कम कर सकते हैं। कार्यभार अलगाव के अपवाद के साथ, इस उपयोग के मामले में फिटनेस कार्यों में एक समान प्राथमिकता हो सकती है, और व्यापार-बंद को एक हद तक कम किया जा सकता है।

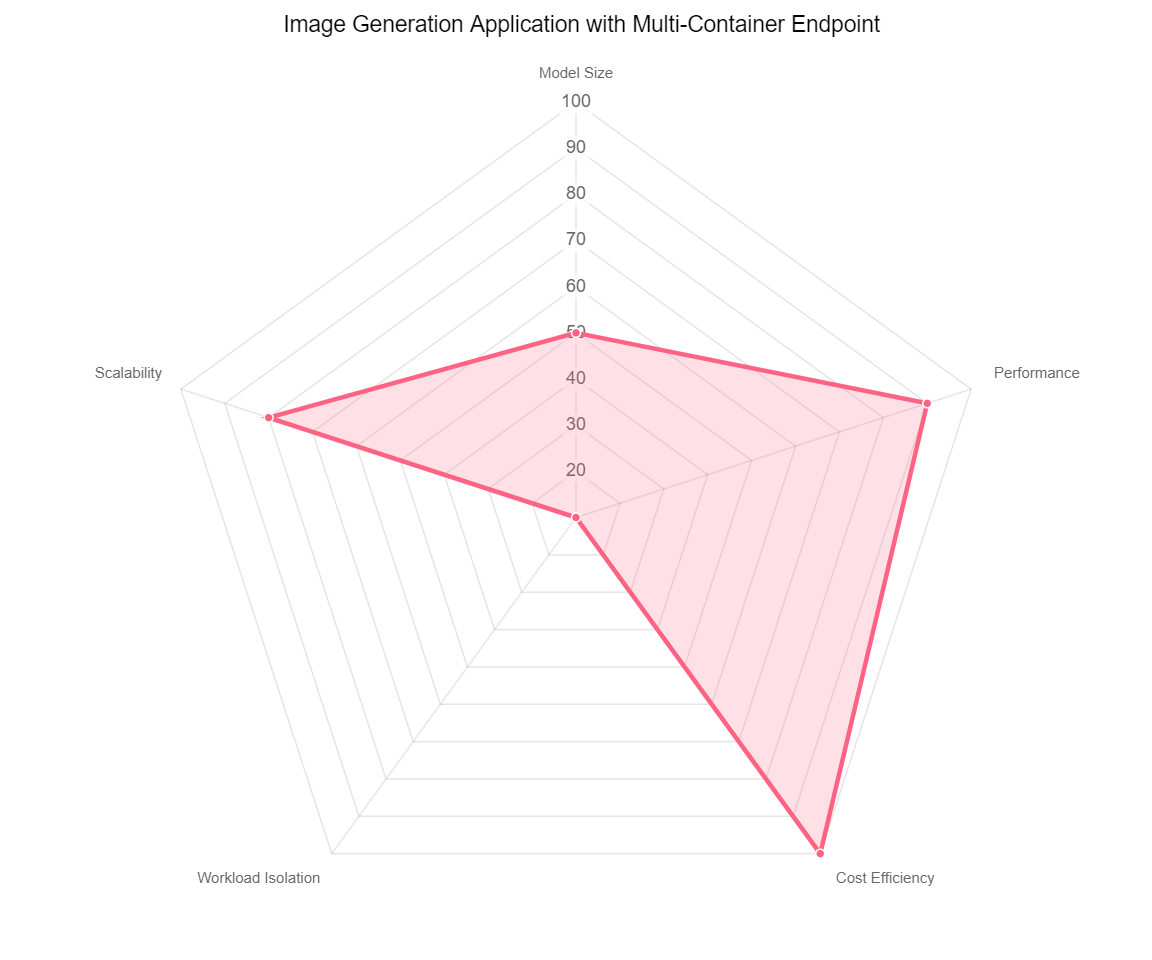

एक अंतिम उदाहरण स्टेबल डिफ्यूजन 2.0 जैसे मॉडल का उपयोग करके एक छवि निर्माण अनुप्रयोग होगा, जो 3.5-बिलियन-पैरामीटर मॉडल है। हमारा स्पाइडर चार्ट इस प्रकार है।

यह एक सदस्यता-आधारित एप्लिकेशन है जो हजारों एफएम और ग्राहकों को सेवा प्रदान करता है। प्रतिक्रिया समय त्वरित होना चाहिए क्योंकि प्रत्येक ग्राहक छवि आउटपुट में तेजी से बदलाव की उम्मीद करता है। थ्रूपुट भी महत्वपूर्ण है क्योंकि किसी भी सेकंड में सैकड़ों हजारों अनुरोध होंगे, इसलिए इंस्टेंस प्रकार को एक बड़ा इंस्टेंस प्रकार होना चाहिए, जैसे कि पी4डी जिसमें पर्याप्त जीपीयू और मेमोरी हो। इसके लिए आप एक अनुरोध सेट से दूसरे अनुरोध सेट तक छवि निर्माण को दर्शाने के लिए मॉडल की कई प्रतियों की मेजबानी करने वाले मल्टी-कंटेनर एंडपॉइंट के निर्माण पर विचार कर सकते हैं। इस उपयोग के मामले में, विलंबता और थ्रूपुट को प्राथमिकता देने और उपयोगकर्ता की मांग को समायोजित करने के लिए, गणना और कार्यभार अलगाव की लागत व्यापार-बंद होगी।

एफएम होस्टिंग विकल्प का चयन करने के लिए फिटनेस फ़ंक्शन लागू करना

इस अनुभाग में, हम आपको दिखाते हैं कि सेजमेकर एफएम पर बड़े पैमाने पर सही एफएम होस्टिंग विकल्प का चयन करने में पूर्ववर्ती फिटनेस फ़ंक्शन को कैसे लागू किया जाए।

सेजमेकर सिंगल-मॉडल एंडपॉइंट

सेजमेकर सिंगल-मॉडल एंडपॉइंट आपको कम विलंबता और उच्च थ्रूपुट के लिए समर्पित उदाहरणों पर होस्ट किए गए कंटेनर पर एक एफएम होस्ट करने की अनुमति देता है। ये समापन बिंदु पूरी तरह से प्रबंधित हैं और ऑटो स्केलिंग का समर्थन करते हैं। आप एकल-मॉडल एंडपॉइंट को एक प्रावधानित एंडपॉइंट के रूप में कॉन्फ़िगर कर सकते हैं जहां आप एंडपॉइंट इंफ्रास्ट्रक्चर कॉन्फ़िगरेशन जैसे कि इंस्टेंस प्रकार और गिनती में पास होते हैं, जहां सेजमेकर स्वचालित रूप से गणना संसाधनों को लॉन्च करता है और ऑटो स्केलिंग नीति के आधार पर उन्हें अंदर और बाहर स्केल करता है। आप एकाधिक एकल-मॉडल समापन बिंदुओं का उपयोग करके सैकड़ों मॉडलों की मेजबानी करने का पैमाना बना सकते हैं और एक को नियोजित कर सकते हैं कोशिका आधारित वास्तुकला बढ़ी हुई लचीलापन और कम ब्लास्ट-त्रिज्या के लिए।

प्रावधानित एकल-मॉडल समापन बिंदु के लिए फिटनेस कार्यों का मूल्यांकन करते समय, निम्नलिखित पर विचार करें:

- फाउंडेशन मॉडल का आकार - यह उपयुक्त है यदि आपके पास ऐसे मॉडल हैं जो एकल एमएल त्वरक की मेमोरी में फिट नहीं हो सकते हैं और इसलिए एक उदाहरण में एकाधिक त्वरक की आवश्यकता है।

- प्रदर्शन और एफएम अनुमान विलंबता - यह विलंबता-महत्वपूर्ण जेनरेटिव एआई अनुप्रयोगों के लिए प्रासंगिक है।

- कार्यभार अलगाव - आपके आवेदन की आवश्यकता हो सकती है अमेज़ॅन इलास्टिक कम्प्यूट क्लाउड (अमेज़ॅन EC2) सुरक्षा अनुपालन कारणों से इंस्टेंस-स्तरीय अलगाव। प्रत्येक एफएम को एक अलग अनुमान समापन बिंदु मिलेगा और EC2 उदाहरण को किसी अन्य मॉडल के साथ साझा नहीं किया जाएगा। उदाहरण के लिए, आप HIPAA-संबंधित मॉडल अनुमान कार्यभार (जैसे PHI डिटेक्शन मॉडल) को नेटवर्क अलगाव के साथ एक समर्पित सुरक्षा समूह कॉन्फ़िगरेशन के साथ एक अलग समापन बिंदु में अलग कर सकते हैं। आप अपने GPU-आधारित मॉडल अनुमान कार्यभार को कम विश्वसनीय कार्यभार से अलग करने के लिए p2dn जैसे नाइट्रो-आधारित EC4 उदाहरणों के आधार पर दूसरों से अलग कर सकते हैं। नाइट्रो सिस्टम-आधारित EC2 इंस्टेंसेस वर्चुअलाइजेशन और आइसोलेशन के लिए एक अद्वितीय दृष्टिकोण प्रदान करता है, जो आपको हर समय AWS ऑपरेटरों और सॉफ़्टवेयर से संवेदनशील डेटा प्रोसेसिंग को सुरक्षित और अलग करने में सक्षम बनाता है। यह का सबसे महत्वपूर्ण आयाम प्रदान करता है गोपनीय कंप्यूटिंग सिस्टम सॉफ़्टवेयर और क्लाउड ऑपरेटरों से सुरक्षा के एक आंतरिक, ऑन-बाय-डिफ़ॉल्ट सेट के रूप में। यह विकल्प सेजमेकर पर तृतीय-पक्ष मॉडल प्रदाताओं द्वारा प्रदान किए गए AWS मार्केटप्लेस मॉडल को तैनात करने का भी समर्थन करता है।

सेजमेकर बहु-मॉडल समापन बिंदु

SageMaker बहु-मॉडल समापन बिंदु (एमएमई) आपको एक जीपीयू कोर पर कई मॉडलों को सह-होस्ट करने, कई मॉडलों में एक एंडपॉइंट के पीछे जीपीयू इंस्टेंस को साझा करने और आने वाले ट्रैफ़िक के आधार पर मॉडल को गतिशील रूप से लोड और अनलोड करने की अनुमति देता है। इससे, आप लागत में उल्लेखनीय रूप से बचत कर सकते हैं और सर्वोत्तम मूल्य-प्रदर्शन प्राप्त कर सकते हैं।

यदि आपको छोटे मॉडल होस्ट करने की आवश्यकता है जो एक उदाहरण पर एक ही एमएल त्वरक में फिट हो सकते हैं तो एमएमई सबसे अच्छा विकल्प हैं। इस रणनीति पर विचार किया जाना चाहिए यदि आपके पास बड़ी संख्या में (हजारों तक) समान आकार (1 बिलियन पैरामीटर से कम) मॉडल हैं जिन्हें आप एक उदाहरण के भीतर एक साझा कंटेनर के माध्यम से सेवा दे सकते हैं और सभी मॉडलों तक पहुंचने की आवश्यकता नहीं है उसी समय। आप उस मॉडल को लोड कर सकते हैं जिसे उपयोग करने की आवश्यकता है और फिर उसे किसी भिन्न मॉडल के लिए अनलोड कर सकते हैं।

एमएमई को सह-होस्टिंग मॉडल के लिए भी डिज़ाइन किया गया है जो समान एमएल फ्रेमवर्क का उपयोग करते हैं क्योंकि वे कई मॉडल लोड करने के लिए साझा कंटेनर का उपयोग करते हैं। इसलिए, यदि आपके मॉडल बेड़े में एमएल फ्रेमवर्क का मिश्रण है (जैसे कि PyTorch और TensorFlow), तो एक सेजमेकर एंडपॉइंट InferenceComponents एक बेहतर विकल्प है. हम चर्चा करते हैं InferenceComponents इस पोस्ट में और अधिक बाद में।

अंत में, एमएमई उन अनुप्रयोगों के लिए उपयुक्त हैं जो कभी-कभार कोल्ड स्टार्ट विलंबता दंड को सहन कर सकते हैं क्योंकि कम उपयोग किए जाने वाले मॉडल को बार-बार लागू किए गए मॉडल के पक्ष में ऑफ-लोड किया जा सकता है। यदि आपके पास कभी-कभार एक्सेस किए जाने वाले मॉडलों की एक लंबी श्रृंखला है, तो एक मल्टी-मॉडल एंडपॉइंट कुशलतापूर्वक इस ट्रैफ़िक की सेवा कर सकता है और महत्वपूर्ण लागत बचत को सक्षम कर सकता है।

एमएमई का उपयोग कब करना है इसका आकलन करते समय निम्नलिखित पर विचार करें:

- फाउंडेशन मॉडल का आकार - आपके पास ऐसे मॉडल हो सकते हैं जो एक उदाहरण पर एकल एमएल त्वरक के एचबीएम में फिट होते हैं और इसलिए उन्हें एकाधिक त्वरक की आवश्यकता नहीं होती है।

- प्रदर्शन और एफएम अनुमान विलंबता - आपके पास जेनरेटिव एआई एप्लिकेशन हो सकते हैं जो मॉडल के अनुरोध पर और मेमोरी में नहीं होने पर कोल्ड स्टार्ट विलंबता को सहन कर सकते हैं।

- कार्यभार अलगाव - सभी मॉडलों में एक ही कंटेनर रखने पर विचार करें।

- अनुमापकता - निम्न पर विचार करें:

- आप एक ही एंडपॉइंट में कई मॉडल पैक कर सकते हैं और प्रति मॉडल और एमएल इंस्टेंस स्केल कर सकते हैं।

- आप कार्यभार पैटर्न के आधार पर इंस्टेंस-स्तरीय ऑटो स्केलिंग सक्षम कर सकते हैं।

- एमएमई प्रति समापन बिंदु हजारों मॉडल तक स्केलिंग का समर्थन करते हैं। आपको प्रति-मॉडल ऑटो स्केलिंग और परिनियोजन कॉन्फ़िगरेशन बनाए रखने की आवश्यकता नहीं है।

- जब भी मॉडल का अनुमान अनुरोध द्वारा अनुरोध किया जाता है तो आप हॉट परिनियोजन का उपयोग कर सकते हैं।

- आप अनुमान अनुरोध के अनुसार मॉडलों को गतिशील रूप से लोड कर सकते हैं और मेमोरी दबाव के जवाब में अनलोड कर सकते हैं।

- आप समय-समय पर अंतर्निहित संसाधनों को मॉडलों के साथ साझा कर सकते हैं।

- कीमत का सामर्थ्य - मॉडलों की गतिशील लोडिंग और अनलोडिंग द्वारा सभी मॉडलों में संसाधन को समय पर साझा करने पर विचार करें, जिसके परिणामस्वरूप लागत बचत होगी।

InferenceComponents के साथ SageMaker अनुमान समापन बिंदु

नया सेजमेकर अनुमान समापन बिंदु InferenceComponents एक ही एंडपॉइंट में कई एफएम होस्ट करने और प्रति मॉडल स्केलिंग के लिए एक स्केलेबल दृष्टिकोण प्रदान करता है। यह आपको संसाधनों (त्वरक, मेमोरी, सीपीयू) को आवंटित करने और सुनिश्चित थ्रूपुट और पूर्वानुमानित प्रदर्शन प्राप्त करने के लिए प्रति-मॉडल आधार पर ऑटो स्केलिंग नीतियों को सेट करने के लिए बढ़िया नियंत्रण प्रदान करता है, और आप व्यक्तिगत रूप से कई मॉडलों में गणना के उपयोग का प्रबंधन कर सकते हैं। यदि आपके पास अलग-अलग आकार और ट्रैफ़िक पैटर्न के बहुत सारे मॉडल हैं जिन्हें आपको होस्ट करने की आवश्यकता है, और मॉडल आकार उन्हें एक ही त्वरक की मेमोरी में फिट होने की अनुमति नहीं देते हैं, तो यह सबसे अच्छा विकल्प है। यह आपको लागत बचाने के लिए शून्य तक स्केल करने की भी अनुमति देता है, लेकिन मॉडलों के लिए ठंडे प्रारंभ समय को ध्यान में रखते हुए आपकी एप्लिकेशन विलंबता आवश्यकताओं को पर्याप्त लचीला होना चाहिए। यह विकल्प आपको अपनी गणना का उपयोग करने में सबसे अधिक लचीलेपन की अनुमति देता है जब तक कि प्रति ग्राहक या एफएम कंटेनर-स्तरीय अलगाव पर्याप्त है। नए सेजमेकर एंडपॉइंट पर अधिक जानकारी के लिए InferenceComponents, विस्तृत पोस्ट देखें अमेज़ॅन सेजमेकर की नवीनतम सुविधाओं का उपयोग करके मॉडल परिनियोजन लागत को औसतन 50% कम करें.

यह निर्धारित करते समय निम्नलिखित पर विचार करें कि आपको समापन बिंदु का उपयोग कब करना चाहिए InferenceComponents:

- फाउंडेशन मॉडल का आकार - यह उन मॉडलों के लिए उपयुक्त है जो एकल एमएल त्वरक की मेमोरी में फिट नहीं हो सकते हैं और इसलिए एक उदाहरण में एकाधिक त्वरक की आवश्यकता होती है।

- प्रदर्शन और एफएम अनुमान विलंबता - यह विलंबता-महत्वपूर्ण जेनरेटिव एआई अनुप्रयोगों के लिए उपयुक्त है।

- कार्यभार अलगाव - आपके पास ऐसे एप्लिकेशन हो सकते हैं जहां कंटेनर-स्तरीय अलगाव पर्याप्त है।

- अनुमापकता - निम्न पर विचार करें:

- आप एक ही एंडपॉइंट और प्रति मॉडल स्केल में कई एफएम पैक कर सकते हैं।

- आप कार्यभार पैटर्न के आधार पर इंस्टेंस-स्तर और मॉडल कंटेनर-स्तरीय स्केलिंग सक्षम कर सकते हैं।

- यह विधि प्रति समापन बिंदु पर सैकड़ों एफएम तक स्केलिंग का समर्थन करती है। आपको प्रत्येक मॉडल या कंटेनर के लिए ऑटो स्केलिंग नीति को कॉन्फ़िगर करने की आवश्यकता नहीं है।

- यह बेड़े में मॉडलों की प्रारंभिक नियुक्ति और अपर्याप्त त्वरक को संभालने का समर्थन करता है।

- कीमत का सामर्थ्य - जब लागत बचाने के लिए कोई ट्रैफ़िक न हो तो आप प्रति मॉडल शून्य तक स्केल कर सकते हैं।

एक ही समापन बिंदु पर एकाधिक एफएम पैक करना: मॉडल ग्रुपिंग

यह निर्धारित करना कि आप सेजमेकर पर कौन सी अनुमान आर्किटेक्चर रणनीति अपनाते हैं, यह आपके एप्लिकेशन की प्राथमिकताओं और आवश्यकताओं पर निर्भर करता है। कुछ SaaS प्रदाता विनियमित वातावरण में बिक्री कर रहे हैं जो सख्त अलगाव आवश्यकताओं को लागू करते हैं - उन्हें एक विकल्प की आवश्यकता होती है जो उन्हें अपने कुछ या सभी एफएम को एक समर्पित मॉडल में तैनात होने का विकल्प प्रदान करने में सक्षम बनाता है। लेकिन लागत को अनुकूलित करने और पैमाने की अर्थव्यवस्था हासिल करने के लिए, SaaS प्रदाताओं के पास बहु-किरायेदार वातावरण भी होना चाहिए जहां वे SageMaker संसाधनों के एक साझा सेट में कई एफएम की मेजबानी करते हैं। अधिकांश संगठनों के पास संभवतः एक हाइब्रिड होस्टिंग वातावरण होगा जहां उनके सेजमेकर आर्किटेक्चर के हिस्से के रूप में सिंगल-मॉडल एंडपॉइंट और मल्टी-मॉडल या मल्टी-कंटेनर एंडपॉइंट दोनों होंगे।

एक महत्वपूर्ण अभ्यास जो आपको इस वितरित अनुमान वातावरण को आर्किटेक्चर करते समय करने की आवश्यकता होगी, वह है प्रत्येक प्रकार के आर्किटेक्चर के लिए अपने मॉडलों को समूहित करना, आपको अपने सेजमेकर एंडपॉइंट्स में सेट अप करने की आवश्यकता होगी। पहला निर्णय जो आपको करना होगा वह कार्यभार अलगाव आवश्यकताओं के आसपास है - आपको उन एफएम को अलग करने की आवश्यकता होगी जिन्हें अपने स्वयं के समर्पित समापन बिंदुओं में होना चाहिए, चाहे वह सुरक्षा कारणों से हो, विस्फोट-त्रिज्या और शोर पड़ोसी जोखिम को कम करना हो, या बैठक करना हो विलंबता के लिए सख्त एसएलए।

दूसरे, आपको यह निर्धारित करने की आवश्यकता होगी कि क्या एफएम एक एकल एमएल त्वरक में फिट होते हैं या एकाधिक त्वरक की आवश्यकता होती है, मॉडल आकार क्या हैं, और उनके ट्रैफ़िक पैटर्न क्या हैं। समान आकार के मॉडल जो सामूहिक रूप से एक केंद्रीय फ़ंक्शन का समर्थन करते हैं, तार्किक रूप से एक समापन बिंदु पर कई मॉडलों को सह-होस्ट करके एक साथ समूहीकृत किया जा सकता है, क्योंकि ये एक एकल व्यावसायिक एप्लिकेशन का हिस्सा होंगे जो एक केंद्रीय टीम द्वारा प्रबंधित किया जाता है। एक ही समापन बिंदु पर कई मॉडलों की सह-मेजबानी के लिए, यह निर्धारित करने के लिए एक समूहीकरण अभ्यास करने की आवश्यकता है कि कौन से मॉडल एक ही उदाहरण, एक कंटेनर या एकाधिक कंटेनर में बैठ सकते हैं।

एमएमई के लिए मॉडलों को समूहीकृत करना

एमएमई छोटे मॉडल (1 बिलियन से कम पैरामीटर जो एकल त्वरक में फिट हो सकते हैं) के लिए सबसे उपयुक्त हैं और आकार और आह्वान विलंबता में समान हैं। मॉडल आकार में कुछ भिन्नता स्वीकार्य है; उदाहरण के लिए, ज़ेंडेस्क का मॉडल 10-50 एमबी तक के होते हैं, जो ठीक काम करता है, लेकिन आकार में 10, 50, या 100 गुना अधिक भिन्नता उपयुक्त नहीं है। बड़े मॉडल पर्याप्त मेमोरी स्थान को समायोजित करने के लिए छोटे मॉडलों की अधिक संख्या में लोड और अनलोड का कारण बन सकते हैं, जिसके परिणामस्वरूप एंडपॉइंट पर अतिरिक्त विलंबता हो सकती है। बड़े मॉडलों की प्रदर्शन विशेषताओं में अंतर भी सीपीयू जैसे संसाधनों का असमान रूप से उपभोग कर सकता है, जो उदाहरण के अन्य मॉडलों को प्रभावित कर सकता है।

जिन मॉडलों को एमएमई पर एक साथ समूहीकृत किया गया है, उनमें क्रमबद्ध ट्रैफ़िक पैटर्न होना आवश्यक है ताकि आप अनुमान के लिए सभी मॉडलों में गणना साझा कर सकें। जब आप मॉडलों के बीच स्विच करते हैं तो आपके एक्सेस पैटर्न और अनुमान विलंबता को भी कुछ ठंडे प्रारंभ समय की अनुमति देने की आवश्यकता होती है।

एमएमई के लिए मॉडलों को समूहीकृत करने के लिए कुछ अनुशंसित मानदंड निम्नलिखित हैं:

- छोटे मॉडल - 1 बिलियन से कम पैरामीटर वाले मॉडल का उपयोग करें

- मॉडल का आकार - समान आकार के मॉडलों को समूहित करें और एक ही समापन बिंदु पर सह-होस्ट करें

- मंगलाचरण विलंबता - समान मंगलाचरण विलंबता आवश्यकताओं वाले समूह मॉडल जो कोल्ड स्टार्ट को सहन कर सकते हैं

- हार्डवेयर - समान अंतर्निहित EC2 इंस्टेंस प्रकार का उपयोग करके मॉडलों को समूहित करें

InferenceComponents के साथ समापन बिंदु के लिए मॉडलों को समूहीकृत करना

एक सेजमेकर एंडपॉइंट के साथ InferenceComponents बड़े पैमाने पर एफएम (1 बिलियन से अधिक पैरामीटर) की मेजबानी के लिए सबसे उपयुक्त है जिसके लिए EC2 उदाहरण में कई एमएल त्वरक या उपकरणों की आवश्यकता होती है। यह विकल्प विलंबता-संवेदनशील वर्कलोड और अनुप्रयोगों के लिए उपयुक्त है जहां कंटेनर-स्तरीय अलगाव पर्याप्त है। एकाधिक के साथ समापन बिंदु के लिए मॉडलों को समूहीकृत करने के लिए कुछ अनुशंसित मानदंड निम्नलिखित हैं InferenceComponents:

- हार्डवेयर - समान अंतर्निहित EC2 इंस्टेंस प्रकार का उपयोग करके मॉडलों को समूहित करें

- मॉडल का आकार - मॉडल आकार के आधार पर मॉडल को समूहीकृत करने की अनुशंसा की जाती है लेकिन अनिवार्य नहीं है

सारांश

इस पोस्ट में, हमने तीन वास्तविक समय एमएल अनुमान विकल्पों (एकल समापन बिंदु, बहु-मॉडल समापन बिंदु, और समापन बिंदु) को देखा InferenceComponents) सेजमेकर में लागत-प्रभावी पैमाने पर एफएम को कुशलतापूर्वक होस्ट करने के लिए। आप बड़े पैमाने पर एफएम के लिए सही सेजमेकर होस्टिंग विकल्प चुनने में मदद के लिए पांच फिटनेस फ़ंक्शन का उपयोग कर सकते हैं। एफएम को समूहित करें और अनुशंसित समूहीकरण मानदंडों का उपयोग करके उन्हें सेजमेकर अनुमान समापन बिंदुओं पर सह-होस्ट करें। हमारे द्वारा चर्चा की गई फिटनेस फ़ंक्शंस के अलावा, आप यह तय करने के लिए निम्न तालिका का उपयोग कर सकते हैं कि आपके उपयोग के मामले में कौन सा साझा सेजमेकर होस्टिंग विकल्प सबसे अच्छा है। आप निम्नलिखित GitHub रिपोज़ में SageMaker पर प्रत्येक FM होस्टिंग विकल्प के लिए कोड नमूने पा सकते हैं: एकल सेजमेकर समापन बिंदु, बहु-मॉडल समापन बिंदु, तथा InferenceComponents समापन बिंदु।

| . | एकल-मॉडल समापन बिंदु | बहु-मॉडल समापन बिंदु | InferenceComponents के साथ समापन बिंदु |

| मॉडल जीवनचक्र | प्रबंधन के लिए एपीआई | अमेज़ॅन S3 पथ के माध्यम से गतिशील | प्रबंधन के लिए एपीआई |

| उदाहरण प्रकार समर्थित | सीपीयू, सिंगल और मल्टी जीपीयू, एडब्ल्यूएस इनफेरेंटिया आधारित इंस्टेंस | सीपीयू, एकल जीपीयू आधारित उदाहरण | सीपीयू, सिंगल और मल्टी जीपीयू, एडब्ल्यूएस इनफेरेंटिया आधारित इंस्टेंस |

| मीट्रिक ग्रैन्युलैरिटी | endpoint | endpoint | समापन बिंदु और कंटेनर |

| स्केलिंग ग्रैन्युलैरिटी | एमएल उदाहरण | एमएल उदाहरण | कंटेनर |

| स्केलिंग व्यवहार | स्वतंत्र एमएल उदाहरण स्केलिंग | मॉडल को मेमोरी से लोड और अनलोड किया जाता है | स्वतंत्र कंटेनर स्केलिंग |

| मॉडल पिनिंग | . | मॉडल को मेमोरी के आधार पर अनलोड किया जा सकता है | प्रत्येक कंटेनर को हमेशा लोड या अनलोड करने के लिए कॉन्फ़िगर किया जा सकता है |

| कंटेनर आवश्यकताएँ | सेजमेकर पूर्व-निर्मित, सेजमेकर-संगत अपना खुद का कंटेनर लाओ (बीवाईओसी) | एमएमई अनुबंधों के साथ एमएमएस, ट्राइटन, बीवाईओसी | सेजमेकर पूर्व-निर्मित, सेजमेकर संगत BYOC |

| रूटिंग विकल्प | यादृच्छिक या न्यूनतम कनेक्शन | लोकप्रियता खिड़की के साथ यादृच्छिक, चिपचिपा | यादृच्छिक या न्यूनतम कनेक्शन |

| मॉडल के लिए हार्डवेयर आवंटन | एकल मॉडल को समर्पित | साझा | प्रत्येक कंटेनर के लिए समर्पित |

| समर्थित मॉडलों की संख्या | एक | हजारों | सैकड़ों |

| प्रतिक्रिया स्ट्रीमिंग | समर्थित | समर्थित नहीं | समर्थित |

| डेटा कैप्चर | समर्थित | समर्थित नहीं | समर्थित नहीं |

| छाया परीक्षण | समर्थित | समर्थित नहीं | समर्थित नहीं |

| मल्टी-वेरिएंट | समर्थित | लागू नहीं होता | समर्थित नहीं |

| AWS मार्केटप्लेस मॉडल | समर्थित | लागू नहीं होता | समर्थित नहीं |

लेखक के बारे में

मेहरान नजफी, पीएचडी, एडब्ल्यूएस के लिए एक वरिष्ठ समाधान वास्तुकार है जो एआई/एमएल और सास समाधानों पर बड़े पैमाने पर केंद्रित है।

मेहरान नजफी, पीएचडी, एडब्ल्यूएस के लिए एक वरिष्ठ समाधान वास्तुकार है जो एआई/एमएल और सास समाधानों पर बड़े पैमाने पर केंद्रित है।

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और आर्टिफिशियल इंटेलिजेंस से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित डीप लर्निंग पर ध्यान केंद्रित करता है। वह ग्राहकों को सेजमेकर पर उच्च प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और आर्टिफिशियल इंटेलिजेंस से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित डीप लर्निंग पर ध्यान केंद्रित करता है। वह ग्राहकों को सेजमेकर पर उच्च प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

रीला डीजेसस AWS में एक प्रमुख समाधान वास्तुकार हैं जिन्होंने DC, मैरीलैंड और वर्जीनिया क्षेत्र में विभिन्न उद्यम ग्राहकों को क्लाउड पर जाने में सफलतापूर्वक मदद की है। एक ग्राहक वकील और तकनीकी सलाहकार, वह हेरोकू/सेल्सफोर्स जैसे संगठनों को AWS प्लेटफॉर्म पर सफलता हासिल करने में मदद करती है। वह आईटी में महिलाओं की कट्टर समर्थक हैं और रोजमर्रा की चुनौतियों को हल करने के लिए प्रौद्योगिकी और डेटा का रचनात्मक उपयोग करने के तरीके खोजने के प्रति बहुत भावुक हैं।

रीला डीजेसस AWS में एक प्रमुख समाधान वास्तुकार हैं जिन्होंने DC, मैरीलैंड और वर्जीनिया क्षेत्र में विभिन्न उद्यम ग्राहकों को क्लाउड पर जाने में सफलतापूर्वक मदद की है। एक ग्राहक वकील और तकनीकी सलाहकार, वह हेरोकू/सेल्सफोर्स जैसे संगठनों को AWS प्लेटफॉर्म पर सफलता हासिल करने में मदद करती है। वह आईटी में महिलाओं की कट्टर समर्थक हैं और रोजमर्रा की चुनौतियों को हल करने के लिए प्रौद्योगिकी और डेटा का रचनात्मक उपयोग करने के तरीके खोजने के प्रति बहुत भावुक हैं।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/scale-foundation-model-inference-to-hundreds-of-models-with-amazon-sagemaker-part-1/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 1

- 10

- 100

- 11

- 25

- 50

- 7

- a

- क्षमता

- योग्य

- About

- त्वरण

- त्वरक

- त्वरक

- स्वीकार्य

- पहुँच

- पहुँचा

- तक पहुँचने

- समायोजित

- लेखा

- शुद्धता

- पाना

- प्राप्त करने

- के पार

- जोड़ा

- इसके अलावा

- प्रतिकूल

- सलाहकार

- वकील

- को प्रभावित

- प्रभावित करने वाले

- एजेंटों

- AI

- एआई मॉडल

- ऐ मामलों का उपयोग करें

- ऐ / एमएल

- एल्गोरिदम

- सब

- आवंटित

- आवंटन

- अनुमति देना

- की अनुमति देता है

- भी

- हमेशा

- वीरांगना

- अमेज़ॅन EC2

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- राशियाँ

- an

- और

- वार्षिक

- अन्य

- जवाब

- anthropic

- कोई

- आवेदन

- अनुप्रयोगों

- लागू करें

- दृष्टिकोण

- उपयुक्त

- आर्किटेक्ट

- स्थापत्य

- हैं

- क्षेत्र

- चारों ओर

- कृत्रिम

- कृत्रिम बुद्धिमत्ता

- AS

- आकलन

- आकलन

- मूल्यांकन

- आश्वासन

- At

- संवर्धित

- स्वत:

- स्वतः

- स्वचालित

- स्वायत्तता

- उपलब्ध

- औसत

- एडब्ल्यूएस

- एडब्ल्यूएस इन्फेंटेंटिया

- एडब्ल्यूएस बाज़ार

- बैंडविड्थ

- आधार

- आधारित

- आधार

- BE

- क्योंकि

- हो जाता है

- पीछे

- जा रहा है

- BEST

- बेहतर

- के बीच

- बिलियन

- अरबों

- बढ़ावा

- उधार

- के छात्रों

- सीमा

- लाना

- निर्माण

- इमारत

- व्यापार

- व्यापार प्रक्रिया

- व्यवसायों

- लेकिन

- by

- परिकलित

- बुलाया

- कर सकते हैं

- क्षमता

- मामला

- मामलों

- कारण

- केंद्रीय

- चुनौतियों

- चुनौतीपूर्ण

- परिवर्तन

- विशेषताएँ

- चार्ट

- chatbot

- chatbots

- चेक

- टुकड़ा

- चुनाव

- विकल्प

- चुनें

- चुनने

- समापन

- बादल

- सह मेजबान

- कोड

- गढ़ा

- ठंड

- सहयोगियों

- सामूहिक

- सामूहिक रूप से

- संयुक्त

- आता है

- संचार

- कंपनियों

- कंपनी का है

- संगत

- जटिलताओं

- जटिलता

- अनुपालन

- घटकों

- यौगिक

- गणना

- कम्प्यूटेशनल

- कम्प्यूटेशनल शक्ति

- गणना करना

- कंप्यूटर

- Computer Vision

- कंप्यूटिंग

- संगणन शक्ति

- संकल्पना

- गोपनीयता

- विन्यास

- कॉन्फ़िगर किया गया

- विचार करना

- माना

- पर विचार

- उपभोग

- प्रयुक्त

- कंटेनर

- कंटेनरों

- सामग्री

- प्रसंग

- नियंत्रण

- बातचीत

- मूल

- लागत

- लागत बचत

- प्रभावी लागत

- लागत

- सका

- युग्मित

- बनाना

- मापदंड

- महत्वपूर्ण

- ग्राहक

- ग्राहक डेटा

- ग्राहक सेवा

- ग्राहक सहयोग

- ग्राहक

- अनुकूलित

- चक्र

- तिथि

- डेटा संसाधन

- डाटाबेस

- दिन

- dc

- तय

- निर्णय

- निर्णय

- निर्णय

- डिकोडिंग

- समर्पित

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- परिभाषित

- उद्धार

- मांग

- मांग

- जनतंत्रीकरण

- निर्भर करता है

- निर्भर करता है

- तैनात

- तैनात

- तैनाती

- तैनाती

- तैनाती

- निर्दिष्ट

- बनाया गया

- वांछित

- विस्तृत

- विवरण

- खोज

- निर्धारित करना

- निर्धारित

- निर्धारित करने

- युक्ति

- डिवाइस

- मतभेद

- विभिन्न

- कठिनाई

- प्रसार

- आयाम

- आयाम

- चर्चा करना

- चर्चा की

- डिस्प्ले

- वितरित

- वितरित अभिकलन

- कई

- डोमेन

- dont

- खींचना

- दो

- दौरान

- गतिशील

- गतिशील

- से प्रत्येक

- आसानी

- अर्थव्यवस्थाओं

- पैमाने की अर्थव्यवस्थाएं

- प्रभावी

- कुशल

- कुशलता

- भी

- ईमेल

- सक्षम

- सक्षम बनाता है

- समर्थकारी

- endpoint

- लगाना

- सगाई

- इंजन

- इंजीनियर्स

- बढ़ाना

- पर्याप्त

- सुनिश्चित

- सुनिश्चित

- उद्यम

- उद्यम

- वातावरण

- वातावरण

- विशेष रूप से

- का मूल्यांकन

- और भी

- कार्यक्रम

- प्रत्येक

- हर रोज़

- सब कुछ

- विकास

- विकसित

- उदाहरण

- से अधिक

- अपवाद

- आदान-प्रदान किया

- व्यायाम

- उम्मीद

- अनुभव

- प्रयोग

- विशेषज्ञता

- तलाश

- सीमा

- बाहरी

- कारक

- कारकों

- फास्ट

- एहसान

- विशेषताएं

- कम

- अंतिम

- खोज

- खोज

- अंत

- प्रथम

- फिट

- फिटनेस

- पांच

- बेड़ा

- लचीलापन

- लचीला

- ध्यान केंद्रित

- केंद्रित

- निम्नलिखित

- इस प्रकार है

- के लिए

- पायाब

- बुनियाद

- ढांचा

- चौखटे

- अक्सर

- से

- पूर्ण

- पूरी तरह से

- समारोह

- कार्यों

- लाभ

- आम तौर पर

- उत्पन्न

- सृजन

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- मिल

- GitHub

- दी

- देता है

- लक्ष्यों

- GPU

- GPUs

- ग्राफ

- अधिक से अधिक

- बहुत

- समूह

- मार्गदर्शन

- गाइड

- हैंडलिंग

- हार्डवेयर

- है

- होने

- he

- mmmmm

- भार उठाना

- मदद

- मदद की

- मदद करता है

- इसलिये

- हाई

- उच्चतर

- अत्यधिक

- उसके

- ऐतिहासिक

- इतिहास

- मेजबान

- मेजबानी

- होस्टिंग

- गरम

- घंटे

- कैसे

- How To

- http

- HTTPS

- सैकड़ों

- संकर

- if

- दिखाता है

- की छवि

- अत्यधिक

- प्रभाव

- Impacts

- महत्वपूर्ण

- लगाया

- in

- शामिल

- सहित

- आवक

- निगमित

- वृद्धि हुई

- बढ़ जाती है

- व्यक्तिगत रूप से

- इंफ्रास्ट्रक्चर

- प्रारंभिक

- निवेश

- उदाहरण

- एकीकृत

- ईमानदारी

- इंटेल

- बौद्धिक

- बौद्धिक संपदा

- बुद्धि

- बुद्धिमान

- आंतरिक

- में

- आंतरिक

- द्वारा प्रस्तुत

- लागू

- शामिल करना

- शामिल

- IP

- अलगाव

- IT

- आइटम

- जेपीजी

- ज्ञान

- भाषा

- बड़ा

- बड़े उद्यम

- बड़ा

- विलंब

- बाद में

- ताज़ा

- शुरूआत

- सीख रहा हूँ

- कम से कम

- लंबाई

- कम

- स्तर

- पुस्तकालय

- उत्तोलक

- पसंद

- सीमित

- सीमाएं

- लाइन

- पंक्तियां

- लामा

- भार

- लोड हो रहा है

- भार

- तर्क में

- लंबा

- देखा

- देख

- लॉट

- निम्न

- कम

- मशीन

- यंत्र अधिगम

- बनाया गया

- बनाए रखना

- को बनाए रखने के

- बनाना

- प्रबंधन

- कामयाब

- प्रबंध

- प्रबंध

- ढंग

- बहुत

- विपणन (मार्केटिंग)

- बाजार

- मेरीलैंड

- विशाल

- अधिकतम

- मई..

- साधन

- बैठक

- याद

- तरीका

- मीट्रिक

- हो सकता है

- कम से कम

- मिश्रण

- ML

- आदर्श

- मॉडल

- निगरानी

- अधिक

- अधिकांश

- चाल

- बहु

- बहु-मॉडल समापन बिंदु

- विभिन्न

- भीड़

- चाहिए

- आवश्यक

- आवश्यकता

- ज़रूरत

- की जरूरत है

- पड़ोसियों

- नेटवर्क

- नया

- अगला

- निट्रो

- NLP

- नहीं

- संख्या

- Nvidia

- उद्देश्य

- उद्देश्य

- प्राप्त

- प्रासंगिक

- of

- प्रस्ताव

- ऑफर

- अक्सर

- on

- ONE

- संचालित

- संचालित

- परिचालन

- परिचालन

- संचालन

- ऑपरेटरों

- इष्टतम

- इष्टतमीकरण

- ऑप्टिमाइज़ करें

- विकल्प

- ऑप्शंस

- or

- आदेश

- संगठन

- संगठनों

- अन्य

- अन्य

- हमारी

- आउट

- उत्पादन

- outputs के

- के ऊपर

- कुल

- अपना

- स्वामित्व

- पैक

- पृष्ठ

- समानांतर

- पैरामीटर

- भाग

- साथी

- पास

- आवेशपूर्ण

- पैटर्न उपयोग करें

- पीडीएफ

- पंचकोण

- प्रति

- निष्पादन

- प्रदर्शन

- प्रदर्शन

- अवधि

- अवधि

- निजीकृत

- परिप्रेक्ष्य

- पीएचडी

- पायलट

- प्लेसमेंट

- की योजना बनाई

- मंच

- प्लेटफार्म

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- नीतियाँ

- नीति

- लोकप्रियता

- हिस्सा

- पद

- संभावित

- बिजली

- उम्मीद के मुताबिक

- दबाव

- प्रचलित

- रोकने

- प्रिंसिपल

- प्राथमिकता

- प्राथमिकता

- शायद

- समस्याओं

- प्रक्रिया

- प्रसंस्करण

- संपत्ति

- प्रस्ताव

- संरक्षण

- प्रदान करना

- बशर्ते

- प्रदाताओं

- प्रदान करता है

- प्रदान कर

- उद्देश्य

- pytorch

- क्यू एंड ए

- मात्रात्मक

- त्वरित

- राडार

- रेंज

- लेकर

- वास्तविक

- वास्तविक समय

- वास्तविकता

- साकार

- कारण

- की सिफारिश की

- को कम करने

- घटी

- को कम करने

- उल्लेख

- संदर्भित करता है

- दर्शाता है

- विनियमित

- नियामक

- सम्बंधित

- अपेक्षाकृत

- प्रासंगिक

- बाकी है

- गाया

- प्रतिनिधित्व

- का अनुरोध

- अनुरोधों

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकताएँ

- की आवश्यकता होती है

- संसाधन

- उपयुक्त संसाधन चुनें

- प्रतिक्रिया

- उत्तरदायी

- परिणाम

- जिसके परिणामस्वरूप

- परिणाम

- सही

- कठिन

- जोखिम

- जोखिम प्रबंधन

- रन

- क्रम

- सास

- त्याग

- sagemaker

- सेजमेकर अनुमान

- वेतन

- विक्रय

- वही

- सहेजें

- बचत

- स्केलेबल

- स्केल

- तराजू

- स्केलिंग

- परिदृश्य

- अनुसूची

- वैज्ञानिकों

- खरोंच

- Search

- दूसरा

- अनुभाग

- सुरक्षित

- सुरक्षा

- का चयन

- बेचना

- वरिष्ठ

- संवेदनशील

- अलग

- सेवा

- सर्वर

- सेवा

- सेवाएँ

- सेवारत

- सेट

- कई

- आकार

- sharding

- Share

- साझा

- बांटने

- वह

- चाहिए

- दिखाना

- दिखाता है

- साइड्स

- महत्वपूर्ण

- काफी

- समान

- एक साथ

- एक

- बैठना

- स्थिति

- आकार

- आकार

- आकार

- धीमा

- छोटे

- So

- सॉफ्टवेयर

- एक सेवा के रूप में सॉफ्टवेयर

- समाधान

- समाधान ढूंढे

- हल

- कुछ

- कभी कभी

- अंतरिक्ष

- विशेषीकृत

- विशिष्ट

- विशेष रूप से

- विनिर्दिष्ट

- गति

- स्पिन

- स्थिर

- मानकों

- प्रारंभ

- स्टार्टअप

- चिपचिपा

- भंडारण

- स्ट्रेटेजी

- कठोर

- पर्याप्त

- सफलता

- सफलतापूर्वक

- ऐसा

- पर्याप्त

- उपयुक्त

- समर्थन

- समर्थक

- समर्थन करता है

- स्विच

- प्रणाली

- तालिका

- अनुरूप

- लेना

- कार्य

- कार्य

- टीम

- टीमों

- तकनीकी

- टेक्नोलॉजी

- है

- tensorflow

- परीक्षण

- टेक्स्ट

- से

- कि

- RSI

- लेकिन हाल ही

- उन

- फिर

- वहाँ।

- इसलिये

- इन

- वे

- तीसरे दल

- इसका

- विचार

- हजारों

- तीन

- यहाँ

- THROUGHPUT

- पहर

- बार

- सेवा मेरे

- एक साथ

- साधन

- कुल

- की ओर

- यातायात

- प्रशिक्षण

- बदालना

- ट्रान्सफ़ॉर्मर

- नरमीन

- विश्वस्त

- ट्यूनिंग

- टाइप

- प्रकार

- आम तौर पर

- अनधिकृत

- आधारभूत

- समझना

- समझ

- अद्वितीय

- उपयोग

- उदाहरण

- प्रयुक्त

- उपयोगकर्ता

- का उपयोग

- आमतौर पर

- उपयोग

- उपयोग

- मूल्य

- मान

- विभिन्न

- परिवर्तनीय

- बहुत

- देखें

- वर्जीनिया

- दृष्टि

- भेंट

- करना चाहते हैं

- था

- तरीके

- we

- वेब

- वेब सेवाओं

- भार

- कुंआ

- क्या

- एचएमबी क्या है?

- कब

- जब कभी

- या

- कौन कौन से

- जब

- कौन

- मर्जी

- तैयार

- साथ में

- अंदर

- बिना

- महिलाओं

- काम

- काम किया

- workflows

- कार्य

- विश्व

- होगा

- आप

- आपका

- जेफिरनेट

- शून्य

- क्षेत्र