चिड़ियाघर डिजिटल मूल टीवी और मूवी सामग्री को विभिन्न भाषाओं, क्षेत्रों और संस्कृतियों के अनुकूल बनाने के लिए संपूर्ण स्थानीयकरण और मीडिया सेवाएं प्रदान करता है। यह दुनिया के सर्वश्रेष्ठ सामग्री निर्माताओं के लिए वैश्वीकरण को आसान बनाता है। मनोरंजन के सबसे बड़े नामों द्वारा विश्वसनीय, ZOO डिजिटल डबिंग, उपशीर्षक, स्क्रिप्टिंग और अनुपालन सहित बड़े पैमाने पर उच्च गुणवत्ता वाली स्थानीयकरण और मीडिया सेवाएं प्रदान करता है।

विशिष्ट स्थानीयकरण वर्कफ़्लो के लिए मैन्युअल स्पीकर डायराइज़ेशन की आवश्यकता होती है, जिसमें स्पीकर की पहचान के आधार पर एक ऑडियो स्ट्रीम को खंडित किया जाता है। सामग्री को किसी अन्य भाषा में डब करने से पहले इस समय लेने वाली प्रक्रिया को पूरा किया जाना चाहिए। मैन्युअल तरीकों से, 30 मिनट के एपिसोड को स्थानीयकृत होने में 1-3 घंटे का समय लग सकता है। स्वचालन के माध्यम से, ज़ू डिजिटल का लक्ष्य 30 मिनट से कम समय में स्थानीयकरण प्राप्त करना है।

इस पोस्ट में, हम मीडिया सामग्री का उपयोग करने के लिए स्केलेबल मशीन लर्निंग (एमएल) मॉडल को तैनात करने पर चर्चा करते हैं अमेज़न SageMaker, पर ध्यान केंद्रित करने के साथ व्हिस्परएक्स मॉडल.

पृष्ठभूमि

ज़ू डिजिटल का दृष्टिकोण स्थानीयकृत सामग्री का तेजी से बदलाव प्रदान करना है। यह लक्ष्य कुशल लोगों के छोटे कार्यबल द्वारा मिश्रित अभ्यास की मैन्युअल रूप से गहन प्रकृति से बाधित है जो सामग्री को मैन्युअल रूप से स्थानीयकृत कर सकता है। ज़ू डिजिटल 11,000 से अधिक फ्रीलांसरों के साथ काम करता है और अकेले 600 में 2022 मिलियन से अधिक शब्दों का स्थानीयकरण किया है। हालाँकि, सामग्री की बढ़ती मांग के कारण कुशल लोगों की आपूर्ति कम हो रही है, स्थानीयकरण वर्कफ़्लो में सहायता के लिए स्वचालन की आवश्यकता है।

मशीन लर्निंग के माध्यम से सामग्री वर्कफ़्लो के स्थानीयकरण में तेजी लाने के उद्देश्य से, ZOO डिजिटल ने AWS प्रोटोटाइपिंग को शामिल किया, जो ग्राहकों के साथ वर्कलोड के सह-निर्माण के लिए AWS का एक निवेश कार्यक्रम है। यह जुड़ाव स्थानीयकरण प्रक्रिया के लिए एक कार्यात्मक समाधान प्रदान करने पर केंद्रित है, जबकि सेजमेकर पर ज़ू डिजिटल डेवलपर्स को व्यावहारिक प्रशिक्षण प्रदान करता है। Amazon Transcribe, तथा अमेज़न अनुवाद.

ग्राहक चुनौती

एक शीर्षक (एक फिल्म या एक टीवी श्रृंखला का एक एपिसोड) को प्रतिलेखित किए जाने के बाद, भाषण के प्रत्येक खंड के लिए वक्ताओं को नियुक्त किया जाना चाहिए ताकि उन्हें पात्रों को निभाने के लिए चुने गए आवाज कलाकारों को सही ढंग से सौंपा जा सके। इस प्रक्रिया को स्पीकर डायराइजेशन कहा जाता है। ज़ू डिजिटल को आर्थिक रूप से व्यवहार्य होते हुए भी बड़े पैमाने पर सामग्री को व्यवस्थित करने की चुनौती का सामना करना पड़ता है।

समाधान अवलोकन

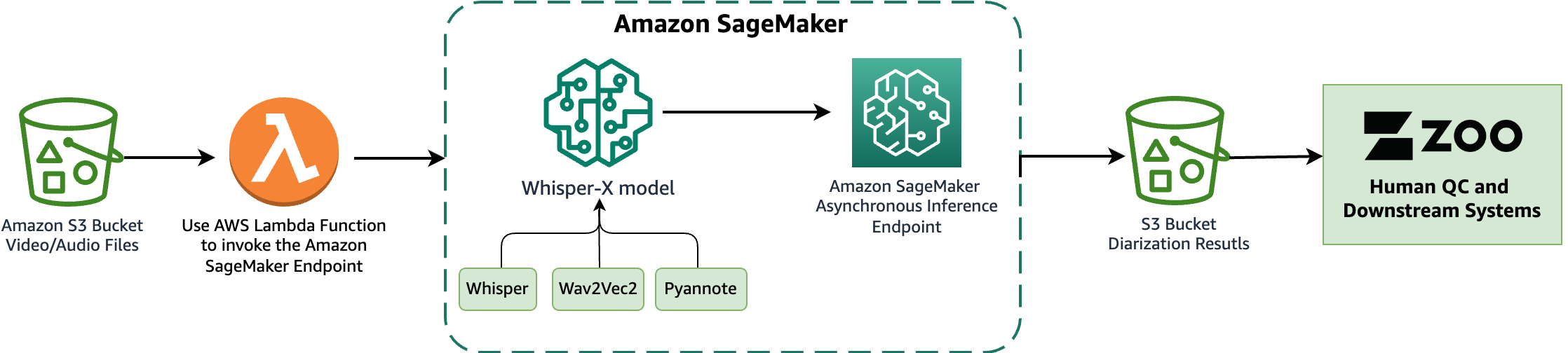

इस प्रोटोटाइप में, हमने मूल मीडिया फ़ाइलों को एक निर्दिष्ट में संग्रहीत किया है अमेज़न सरल भंडारण सेवा (अमेज़ॅन S3) बाल्टी। इस S3 बकेट को एक इवेंट उत्सर्जित करने के लिए कॉन्फ़िगर किया गया था जब इसके भीतर नई फ़ाइलों का पता लगाया जाता है, जिससे एक ट्रिगर होता है AWS लाम्बा समारोह। इस ट्रिगर को कॉन्फ़िगर करने के निर्देशों के लिए, ट्यूटोरियल देखें लैम्ब्डा फ़ंक्शन को शुरू करने के लिए अमेज़ॅन S3 ट्रिगर का उपयोग करना. इसके बाद, लैम्ब्डा फ़ंक्शन ने अनुमान लगाने के लिए सेजमेकर एंडपॉइंट का आह्वान किया Boto3 सेजमेकर रनटाइम क्लाइंट.

RSI व्हिस्परएक्स मॉडल, पर आधारित OpenAI की कानाफूसी, मीडिया परिसंपत्तियों के लिए प्रतिलेखन और डायरीकरण करता है। यह पर बनाया गया है तेज़ फुसफुसाहट पुन: कार्यान्वयन, व्हिस्पर की तुलना में बेहतर शब्द-स्तरीय टाइमस्टैम्प संरेखण के साथ चार गुना तेज प्रतिलेखन की पेशकश करता है। इसके अतिरिक्त, यह स्पीकर डायराइजेशन का परिचय देता है, जो मूल व्हिस्पर मॉडल में मौजूद नहीं है। व्हिस्परएक्स ट्रांसक्रिप्शन के लिए व्हिस्पर मॉडल का उपयोग करता है Wav2Vec2 टाइमस्टैम्प संरेखण को बढ़ाने के लिए मॉडल (ऑडियो टाइमस्टैम्प के साथ लिखित पाठ का सिंक्रनाइज़ेशन सुनिश्चित करना), और piannote डायरीकरण के लिए मॉडल. FFmpeg विभिन्न का समर्थन करते हुए, स्रोत मीडिया से ऑडियो लोड करने के लिए उपयोग किया जाता है मीडिया प्रारूप. पारदर्शी और मॉड्यूलर मॉडल आर्किटेक्चर लचीलेपन की अनुमति देता है, क्योंकि मॉडल के प्रत्येक घटक को भविष्य में आवश्यकतानुसार बदला जा सकता है। हालाँकि, यह ध्यान रखना आवश्यक है कि व्हिस्परएक्स में पूर्ण प्रबंधन सुविधाओं का अभाव है और यह एंटरप्राइज़-स्तरीय उत्पाद नहीं है। रखरखाव और समर्थन के बिना, यह उत्पादन परिनियोजन के लिए उपयुक्त नहीं हो सकता है।

इस सहयोग में, हमने एक का उपयोग करके सेजमेकर पर व्हिस्परएक्स को तैनात और मूल्यांकन किया अतुल्यकालिक अनुमान समापन बिंदु मॉडल को होस्ट करने के लिए. सेजमेकर एसिंक्रोनस एंडपॉइंट 1 जीबी तक अपलोड आकार का समर्थन करता है और इसमें ऑटो स्केलिंग सुविधाएं शामिल होती हैं जो ट्रैफिक स्पाइक्स को कुशलतापूर्वक कम करती हैं और ऑफ-पीक समय के दौरान लागत बचाती हैं। हमारे उपयोग के मामले में एसिंक्रोनस एंडपॉइंट बड़ी फ़ाइलों, जैसे फिल्मों और टीवी श्रृंखला को संसाधित करने के लिए विशेष रूप से उपयुक्त हैं।

निम्नलिखित चित्र इस सहयोग में हमारे द्वारा किए गए प्रयोगों के मुख्य तत्वों को दर्शाता है।

निम्नलिखित अनुभागों में, हम सेजमेकर पर व्हिस्परएक्स मॉडल को तैनात करने के विवरण में उतरेंगे, और डायराइजेशन प्रदर्शन का मूल्यांकन करेंगे।

मॉडल और उसके घटकों को डाउनलोड करें

व्हिस्परएक्स एक ऐसी प्रणाली है जिसमें ट्रांसक्रिप्शन, फोर्स्ड अलाइनमेंट और डायराइजेशन के लिए कई मॉडल शामिल हैं। अनुमान के दौरान मॉडल कलाकृतियों को लाने की आवश्यकता के बिना सेजमेकर के सुचारू संचालन के लिए, सभी मॉडल कलाकृतियों को पहले से डाउनलोड करना आवश्यक है। फिर इन कलाकृतियों को दीक्षा के दौरान सेजमेकर सर्विंग कंटेनर में लोड किया जाता है। क्योंकि ये मॉडल सीधे पहुंच योग्य नहीं हैं, हम व्हिस्परएक्स स्रोत से विवरण और नमूना कोड प्रदान करते हैं, जो मॉडल और उसके घटकों को डाउनलोड करने के निर्देश प्रदान करते हैं।

व्हिस्परएक्स छह मॉडल का उपयोग करता है:

इनमें से अधिकांश मॉडल यहां से प्राप्त किए जा सकते हैं गले लगना हगिंगफेस_हब लाइब्रेरी का उपयोग करना। हम निम्नलिखित का उपयोग करते हैं download_hf_model() इन मॉडल कलाकृतियों को पुनः प्राप्त करने का कार्य। निम्नलिखित पायनोट मॉडल के लिए उपयोगकर्ता समझौतों को स्वीकार करने के बाद उत्पन्न हगिंग फेस से एक एक्सेस टोकन आवश्यक है:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

VAD मॉडल Amazon S3 से प्राप्त किया गया है, और Wav2Vec2 मॉडल torchaudio.pipelines मॉड्यूल से पुनर्प्राप्त किया गया है। निम्नलिखित कोड के आधार पर, हम हगिंग फेस सहित सभी मॉडलों की कलाकृतियों को पुनः प्राप्त कर सकते हैं, और उन्हें निर्दिष्ट स्थानीय मॉडल निर्देशिका में सहेज सकते हैं:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

मॉडल परोसने के लिए उपयुक्त AWS डीप लर्निंग कंटेनर का चयन करें

पूर्ववर्ती नमूना कोड का उपयोग करके मॉडल कलाकृतियों को सहेजे जाने के बाद, आप पूर्व-निर्मित चुन सकते हैं AWS डीप लर्निंग कंटेनर (डीएलसी) निम्नलिखित से गीथहब रेपो. डॉकर छवि का चयन करते समय, निम्नलिखित सेटिंग्स पर विचार करें: फ्रेमवर्क (हगिंग फेस), कार्य (अनुमान), पायथन संस्करण, और हार्डवेयर (उदाहरण के लिए, जीपीयू)। हम निम्नलिखित छवि का उपयोग करने की अनुशंसा करते हैं: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 इस छवि में सभी आवश्यक सिस्टम पैकेज पहले से इंस्टॉल हैं, जैसे कि ffmpeg। [क्षेत्र] को आपके द्वारा उपयोग किए जा रहे AWS क्षेत्र से बदलना याद रखें।

अन्य आवश्यक पायथन पैकेजों के लिए, एक बनाएं requirements.txt पैकेजों और उनके संस्करणों की सूची वाली फ़ाइल। AWS DLC बनने पर ये पैकेज इंस्टॉल किए जाएंगे। सेजमेकर पर व्हिस्परएक्स मॉडल को होस्ट करने के लिए आवश्यक अतिरिक्त पैकेज निम्नलिखित हैं:

मॉडलों को लोड करने और अनुमान चलाने के लिए एक अनुमान स्क्रिप्ट बनाएं

इसके बाद, हम एक कस्टम बनाते हैं inference.py व्हिस्परएक्स मॉडल और उसके घटकों को कंटेनर में कैसे लोड किया जाता है और अनुमान प्रक्रिया को कैसे चलाया जाना चाहिए, इसकी रूपरेखा तैयार करने के लिए स्क्रिप्ट। स्क्रिप्ट में दो कार्य हैं: model_fn और transform_fn। model_fn मॉडलों को उनके संबंधित स्थानों से लोड करने के लिए फ़ंक्शन को लागू किया जाता है। इसके बाद, इन मॉडलों को पास कर दिया जाता है transform_fn अनुमान के दौरान कार्य, जहां प्रतिलेखन, संरेखण और डायराइजेशन प्रक्रियाएं निष्पादित की जाती हैं। निम्नलिखित के लिए एक कोड नमूना है inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

मॉडल की निर्देशिका के भीतर, के साथ requirements.txt फ़ाइल, की उपस्थिति सुनिश्चित करें inference.py एक कोड उपनिर्देशिका में। models निर्देशिका निम्नलिखित के समान होनी चाहिए:

मॉडलों का एक टारबॉल बनाएं

मॉडल और कोड निर्देशिका बनाने के बाद, आप मॉडल को टारबॉल (.tar.gz फ़ाइल) में संपीड़ित करने और इसे अमेज़ॅन S3 पर अपलोड करने के लिए निम्न कमांड लाइन का उपयोग कर सकते हैं। लेखन के समय, तेज़-फुसफुसाने वाले बड़े V2 मॉडल का उपयोग करते हुए, सेजमेकर मॉडल का प्रतिनिधित्व करने वाला परिणामी टारबॉल आकार में 3 जीबी है। अधिक जानकारी के लिए देखें Amazon SageMaker, भाग 2 में मॉडल होस्टिंग पैटर्न: SageMaker पर रियल टाइम मॉडल को तैनात करने के साथ शुरुआत करना.

एक सेजमेकर मॉडल बनाएं और एक एसिंक्रोनस प्रेडिक्टर के साथ एक एंडपॉइंट तैनात करें

अब आप सेजमेकर मॉडल, एंडपॉइंट कॉन्फ़िगरेशन और एसिंक्रोनस एंडपॉइंट बना सकते हैं AsyncPredictor पिछले चरण में बनाए गए मॉडल टारबॉल का उपयोग करना। निर्देशों के लिए, देखें एक अतुल्यकालिक निष्कर्ष समापन बिंदु बनाएँ.

डायराइजेशन प्रदर्शन का मूल्यांकन करें

विभिन्न परिदृश्यों में व्हिस्परएक्स मॉडल के डायराइजेशन प्रदर्शन का आकलन करने के लिए, हमने दो अंग्रेजी शीर्षकों में से प्रत्येक में से तीन एपिसोड का चयन किया: एक नाटक शीर्षक जिसमें 30 मिनट के एपिसोड शामिल हैं, और एक वृत्तचित्र शीर्षक जिसमें 45 मिनट के एपिसोड शामिल हैं। हमने पायनोट के मेट्रिक्स टूलकिट का उपयोग किया, pyannote.metrics, गणना करने के लिए डायराइजेशन त्रुटि दर (डीईआर). मूल्यांकन में, चिड़ियाघर द्वारा प्रदान की गई मैन्युअल रूप से लिखित और डायरीकृत प्रतिलेखों को जमीनी सच्चाई के रूप में प्रस्तुत किया गया।

हमने डीईआर को इस प्रकार परिभाषित किया है:

कुल जमीनी सच्चाई वाले वीडियो की लंबाई इतनी है। FA (झूठा अलार्म) उन खंडों की लंबाई है जिन्हें भविष्यवाणियों में भाषण के रूप में माना जाता है, लेकिन जमीनी सच्चाई में नहीं। कुमारी र उन खंडों की लंबाई है जिन्हें जमीनी सच्चाई में भाषण के रूप में माना जाता है, लेकिन भविष्यवाणी में नहीं। त्रुटिभी कहा जाता है भ्रांति, खंडों की लंबाई है जो भविष्यवाणी और जमीनी सच्चाई में विभिन्न वक्ताओं को सौंपी गई है। सभी इकाइयों को सेकंड में मापा जाता है। डीईआर के लिए विशिष्ट मान विशिष्ट एप्लिकेशन, डेटासेट और डायराइजेशन सिस्टम की गुणवत्ता के आधार पर भिन्न हो सकते हैं। ध्यान दें कि DER 1.0 से बड़ा हो सकता है। कम DER बेहतर है.

मीडिया के एक टुकड़े के लिए डीईआर की गणना करने में सक्षम होने के लिए, जमीनी सच्चाई डायराइजेशन के साथ-साथ व्हिस्परएक्स ट्रांसक्राइब्ड और डायराइज्ड आउटपुट की आवश्यकता होती है। इन्हें पार्स किया जाना चाहिए और मीडिया में भाषण के प्रत्येक खंड के लिए स्पीकर लेबल, भाषण खंड प्रारंभ समय और भाषण खंड समाप्ति समय वाले टुपल्स की सूची में परिणामित होना चाहिए। स्पीकर लेबल को व्हिस्परएक्स और जमीनी सच्चाई डायराइजेशन के बीच मेल खाने की आवश्यकता नहीं है। परिणाम अधिकतर खंडों के समय पर आधारित होते हैं। pyannote.metrics जमीनी सच्चाई डायराइजेशन और आउटपुट डायराइजेशन के इन टुपल्स को लेता है (pyannote.metrics दस्तावेज़ में संदर्भित) संदर्भ और परिकल्पना) डीईआर की गणना करने के लिए। निम्न तालिका हमारे परिणामों का सारांश प्रस्तुत करती है।

| वीडियो प्रकार | डीईआर | सही बात | कुमारी र | त्रुटि | झूठी चेतावनी |

| नाटक | 0.738 | 44.80% तक | 21.80% तक | 33.30% तक | 18.70% तक |

| वृत्तचित्र | 1.29 | 94.50% तक | 5.30% तक | 0.20% तक | 123.40% तक |

| औसत | 0.901 | 71.40% तक | 13.50% तक | 15.10% तक | 61.50% तक |

इन परिणामों से नाटक और वृत्तचित्र शीर्षकों के बीच एक महत्वपूर्ण प्रदर्शन अंतर का पता चलता है, जिसमें मॉडल वृत्तचित्र शीर्षक की तुलना में नाटक एपिसोड के लिए उल्लेखनीय रूप से बेहतर परिणाम (एक समग्र मीट्रिक के रूप में डीईआर का उपयोग करके) प्राप्त कर रहा है। शीर्षकों का बारीकी से विश्लेषण इस प्रदर्शन अंतर में योगदान देने वाले संभावित कारकों की अंतर्दृष्टि प्रदान करता है। एक प्रमुख कारक डॉक्यूमेंट्री शीर्षक में भाषण के साथ पृष्ठभूमि संगीत की लगातार उपस्थिति हो सकती है। हालांकि डायराइजेशन सटीकता को बढ़ाने के लिए प्रीप्रोसेसिंग मीडिया, जैसे कि भाषण को अलग करने के लिए पृष्ठभूमि शोर को हटाना, इस प्रोटोटाइप के दायरे से परे था, यह भविष्य के काम के लिए रास्ते खोलता है जो संभावित रूप से व्हिस्परएक्स के प्रदर्शन को बढ़ा सकता है।

निष्कर्ष

इस पोस्ट में, हमने AWS और ZOO डिजिटल के बीच सहयोगात्मक साझेदारी का पता लगाया, डायराइजेशन वर्कफ़्लो को बढ़ाने के लिए सेजमेकर और व्हिस्परएक्स मॉडल के साथ मशीन लर्निंग तकनीकों को नियोजित किया। AWS टीम ने विशेष रूप से डायराइजेशन के लिए डिज़ाइन किए गए कस्टम एमएल मॉडल की प्रभावी तैनाती को प्रोटोटाइप करने, मूल्यांकन करने और समझने में ZOO की सहायता करने में महत्वपूर्ण भूमिका निभाई। इसमें सेजमेकर का उपयोग करके स्केलेबिलिटी के लिए ऑटो स्केलिंग को शामिल करना शामिल था।

डायरीकरण के लिए एआई का उपयोग करने से चिड़ियाघर के लिए स्थानीयकृत सामग्री तैयार करते समय लागत और समय दोनों में पर्याप्त बचत होगी। तेजी से और सटीक रूप से स्पीकर बनाने और पहचानने में प्रतिलेखकों की सहायता करके, यह तकनीक कार्य की पारंपरिक रूप से समय लेने वाली और त्रुटि-प्रवण प्रकृति को संबोधित करती है। पारंपरिक प्रक्रिया में अक्सर त्रुटियों को कम करने के लिए वीडियो के माध्यम से कई बार गुजरना और अतिरिक्त गुणवत्ता नियंत्रण चरण शामिल होते हैं। डायराइजेशन के लिए एआई को अपनाने से अधिक लक्षित और कुशल दृष्टिकोण संभव हो जाता है, जिससे कम समय सीमा के भीतर उत्पादकता में वृद्धि होती है।

हमने सेजमेकर एसिंक्रोनस एंडपॉइंट पर व्हिस्परएक्स मॉडल को तैनात करने के लिए महत्वपूर्ण चरणों की रूपरेखा तैयार की है, और आपको दिए गए कोड का उपयोग करके इसे स्वयं आज़माने के लिए प्रोत्साहित किया है। ज़ू डिजिटल की सेवाओं और प्रौद्योगिकी के बारे में अधिक जानकारी के लिए, यहाँ जाएँ चिड़ियाघर डिजिटल की आधिकारिक साइट. सेजमेकर पर ओपनएआई व्हिस्पर मॉडल को तैनात करने और विभिन्न अनुमान विकल्पों के विवरण के लिए, देखें अमेज़ॅन सेजमेकर पर व्हिस्पर मॉडल होस्ट करें: अनुमान विकल्प तलाशना. बेझिझक अपने विचार टिप्पणियों में साझा करें।

लेखक के बारे में

यिंग होउ, पीएचडी, AWS में मशीन लर्निंग प्रोटोटाइपिंग आर्किटेक्ट हैं। उनकी रुचि के प्राथमिक क्षेत्रों में जेनएआई, कंप्यूटर विजन, एनएलपी और समय श्रृंखला डेटा भविष्यवाणी पर ध्यान देने के साथ डीप लर्निंग शामिल है। अपने खाली समय में, वह अपने परिवार के साथ अच्छे पल बिताना, उपन्यासों में डूबना और यूके के राष्ट्रीय उद्यानों में घूमना पसंद करती हैं।

यिंग होउ, पीएचडी, AWS में मशीन लर्निंग प्रोटोटाइपिंग आर्किटेक्ट हैं। उनकी रुचि के प्राथमिक क्षेत्रों में जेनएआई, कंप्यूटर विजन, एनएलपी और समय श्रृंखला डेटा भविष्यवाणी पर ध्यान देने के साथ डीप लर्निंग शामिल है। अपने खाली समय में, वह अपने परिवार के साथ अच्छे पल बिताना, उपन्यासों में डूबना और यूके के राष्ट्रीय उद्यानों में घूमना पसंद करती हैं।

एथन कंबरलैंड ज़ू डिजिटल में एक एआई रिसर्च इंजीनियर हैं, जहां वह भाषण, भाषा और स्थानीयकरण में वर्कफ़्लो को बेहतर बनाने के लिए सहायक प्रौद्योगिकियों के रूप में एआई और मशीन लर्निंग का उपयोग करने पर काम करते हैं। उनके पास सुरक्षा और पुलिसिंग क्षेत्र में सॉफ्टवेयर इंजीनियरिंग और अनुसंधान की पृष्ठभूमि है, जो वेब से संरचित जानकारी निकालने और एकत्रित डेटा का विश्लेषण और समृद्ध करने के लिए ओपन-सोर्स एमएल मॉडल का लाभ उठाने पर ध्यान केंद्रित करते हैं।

एथन कंबरलैंड ज़ू डिजिटल में एक एआई रिसर्च इंजीनियर हैं, जहां वह भाषण, भाषा और स्थानीयकरण में वर्कफ़्लो को बेहतर बनाने के लिए सहायक प्रौद्योगिकियों के रूप में एआई और मशीन लर्निंग का उपयोग करने पर काम करते हैं। उनके पास सुरक्षा और पुलिसिंग क्षेत्र में सॉफ्टवेयर इंजीनियरिंग और अनुसंधान की पृष्ठभूमि है, जो वेब से संरचित जानकारी निकालने और एकत्रित डेटा का विश्लेषण और समृद्ध करने के लिए ओपन-सोर्स एमएल मॉडल का लाभ उठाने पर ध्यान केंद्रित करते हैं।

गौरव कैला यूके और आयरलैंड के लिए AWS प्रोटोटाइपिंग टीम का नेतृत्व करता है। उनकी टीम AWS सेवाओं को अपनाने में तेजी लाने के उद्देश्य से व्यावसायिक महत्वपूर्ण कार्यभार पर विचार करने और सह-विकास करने के लिए विभिन्न उद्योगों में ग्राहकों के साथ काम करती है।

गौरव कैला यूके और आयरलैंड के लिए AWS प्रोटोटाइपिंग टीम का नेतृत्व करता है। उनकी टीम AWS सेवाओं को अपनाने में तेजी लाने के उद्देश्य से व्यावसायिक महत्वपूर्ण कार्यभार पर विचार करने और सह-विकास करने के लिए विभिन्न उद्योगों में ग्राहकों के साथ काम करती है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- योग्य

- में तेजी लाने के

- को स्वीकार

- पहुँच

- सुलभ

- शुद्धता

- पाना

- प्राप्त करने

- के पार

- अनुकूलन

- अतिरिक्त

- इसके अतिरिक्त

- पतों

- दत्तक ग्रहण

- बाद

- कुल

- समझौतों

- AI

- ai शोध

- उद्देश्य

- करना

- अलार्म

- संरेखित करें

- पंक्ति में करनेवाला

- संरेखण

- सब

- की अनुमति देता है

- अकेला

- साथ - साथ

- भी

- हालांकि

- वीरांगना

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- an

- का विश्लेषण

- विश्लेषण

- और

- अन्य

- आवेदन

- दृष्टिकोण

- उपयुक्त

- स्थापत्य

- हैं

- क्षेत्रों के बारे में जानकारी का उपयोग करके ट्रेडिंग कर सकते हैं।

- कलाकार

- AS

- आकलन

- संपत्ति

- सौंपा

- सहायता

- की सहायता

- At

- ऑडियो

- अधिकृत

- स्वत:

- स्वचालन

- रास्ते

- एडब्ल्यूएस

- पृष्ठभूमि

- आधारित

- BE

- क्योंकि

- किया गया

- से पहले

- जा रहा है

- BEST

- बेहतर

- के बीच

- परे

- सबसे बड़ा

- बिन

- के छात्रों

- बनाया गया

- व्यापार

- लेकिन

- by

- गणना

- बुलाया

- कर सकते हैं

- मामला

- चुनौती

- अक्षर

- चुनें

- करीब

- कोड

- सहयोग

- सहयोगी

- टिप्पणियाँ

- तुलना

- पूरा

- अनुपालन

- अंग

- घटकों

- चक्रवृद्धि

- कंप्यूटर

- Computer Vision

- संचालित

- कॉन्फ़िगर किया गया

- को विन्यस्त

- विचार करना

- माना

- मिलकर

- कंटेनर

- शामिल हैं

- सामग्री

- सामग्री निर्माता

- योगदान

- नियंत्रण

- परम्परागत

- मूल

- ठीक प्रकार से

- लागत

- लागत

- सका

- बनाना

- बनाया

- बनाना

- रचनाकारों

- महत्वपूर्ण

- संस्कृतियों

- रिवाज

- ग्राहक

- तिथि

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- परिभाषित

- पहुंचाने

- बचाता है

- गड्ढा

- मांग

- निर्भर करता है

- तैनात

- तैनात

- तैनाती

- तैनाती

- बनाया गया

- विवरण

- पता चला

- डेवलपर्स

- युक्ति

- आरेख

- dict

- अंतर

- विभिन्न

- डिजिटल

- डिजिटल कैमरें

- सीधे

- निर्देशिकाओं

- डायरेक्टरी

- चर्चा करना

- कई

- डाक में काम करनेवाला मज़दूर

- वृत्तचित्र

- दस्तावेज़ीकरण

- डोमेन

- dont

- डाउनलोड

- डाउनलोडिंग

- नाटक

- करार दिया

- दौरान

- से प्रत्येक

- आसान

- प्रभावी

- कुशल

- कुशलता

- तत्व

- अन्य

- embedding

- रोजगार

- सक्षम बनाता है

- धरना

- प्रोत्साहित करना

- समाप्त

- शुरू से अंत तक

- endpoint

- लगे हुए

- सगाई

- इंजीनियर

- अभियांत्रिकी

- अंग्रेज़ी

- बढ़ाना

- समृद्ध

- सुनिश्चित

- सुनिश्चित

- उद्यम स्तर

- मनोरंजन

- प्रकरण

- त्रुटि

- त्रुटियाँ

- आवश्यक

- मूल्यांकन करें

- मूल्यांकित

- का मूल्यांकन

- मूल्यांकन

- कार्यक्रम

- प्रत्येक

- उदाहरण

- व्यायाम

- प्रयोगों

- पता लगाया

- तलाश

- चेहरा

- चेहरे के

- कारक

- कारकों

- असत्य

- परिवार

- और तेज

- विशेषताएं

- लग रहा है

- लाए गए

- पट्टिका

- फ़ाइलें

- लचीलापन

- फोकस

- ध्यान केंद्रित

- ध्यान केंद्रित

- निम्नलिखित

- इस प्रकार है

- के लिए

- मजबूर

- चार

- ढांचा

- मुक्त

- बारंबार

- से

- पूर्ण

- समारोह

- कार्यात्मक

- कार्यों

- आगे

- भविष्य

- अन्तर

- जेनाई

- उत्पन्न

- सृजन

- मिल रहा

- GitHub

- भूमंडलीकरण

- लक्ष्य

- GPU

- जमीन

- हाथों पर

- हार्डवेयर

- he

- उसे

- उच्च गुणवत्ता

- उसके

- मेजबान

- होस्टिंग

- घंटे

- कैसे

- तथापि

- एचटीएमएल

- http

- HTTPS

- हगिंग फ़ेस

- पहचान

- पहचान

- if

- दिखाता है

- की छवि

- आयात

- में सुधार

- उन्नत

- in

- शामिल

- शामिल

- सहित

- सम्मिलित

- शामिल

- बढ़ती

- उद्योगों

- करें-

- शुरूआत

- अंतर्दृष्टि

- installed

- निर्देश

- ब्याज

- में

- द्वारा प्रस्तुत

- निवेश

- लागू

- शामिल

- आयरलैंड

- IT

- आईटी इस

- जेपीजी

- JSON

- कुंजी

- महत्वपूर्ण कारक

- लेबल

- लेबल

- भाषा

- भाषाऐं

- बड़ा

- बड़ा

- नेतृत्व

- बिक्रीसूत्र

- सीख रहा हूँ

- लंबाई

- लाभ

- पुस्तकालय

- पंक्तियां

- सूची

- सूचियाँ

- भार

- लोड हो रहा है

- स्थानीय

- स्थानीयकरण

- स्थानीय स्तर पर

- स्थानों

- लॉग इन

- लॉगिंग

- लंबा

- कम

- मशीन

- यंत्र अधिगम

- रखरखाव

- बनाता है

- प्रबंध

- अधिदेश

- गाइड

- मैन्युअल

- मैच

- मई..

- मीडिया

- मेटाडाटा

- तरीकों

- मीट्रिक

- मेट्रिक्स

- दस लाख

- कम से कम

- मिनटों

- कम करना

- ML

- आदर्श

- मॉडल

- मॉड्यूलर

- मॉड्यूल

- लम्हें

- अधिक

- अधिकतर

- चलचित्र

- चलचित्र

- विभिन्न

- संगीत

- चाहिए

- नाम

- नामों

- राष्ट्रीय

- प्रकृति

- आवश्यक

- आवश्यकता

- जरूरत

- नया

- NLP

- शोर

- विशेष रूप से

- नोट

- प्राप्त

- of

- प्रस्ताव

- की पेशकश

- सरकारी

- अक्सर

- on

- ONE

- खुला स्रोत

- OpenAI

- खोलता है

- आपरेशन

- ऑप्शंस

- or

- मूल

- OS

- अन्य

- हमारी

- आउट

- रूपरेखा

- उल्लिखित

- उत्पादन

- outputs के

- के ऊपर

- संकुल

- भाग

- विशेष रूप से

- पार्टनर

- पारित कर दिया

- गुजरता

- पथ

- पथ

- पैटर्न उपयोग करें

- स्टाफ़

- निष्पादन

- प्रदर्शन

- प्रदर्शन

- प्रदर्शन

- टुकड़ा

- पाइपलाइन

- केंद्रीय

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- प्ले

- खेला

- पुलिस

- पद

- संभावित

- संभावित

- पूर्ववर्ती

- ठीक - ठीक

- भविष्यवाणी

- भविष्यवाणियों

- उपस्थिति

- वर्तमान

- पिछला

- प्राथमिक

- प्रक्रिया

- प्रक्रियाओं

- प्रसंस्करण

- एस्ट्रो मॉल

- उत्पादन

- उत्पादकता

- कार्यक्रम

- प्रोटोटाइप

- प्रोटोटाइप

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- अजगर

- गुणवत्ता

- R

- मूल्यांकन करें

- पढ़ना

- वास्तविक

- वास्तविक समय

- की सिफारिश

- उल्लेख

- निर्दिष्ट

- क्षेत्र

- क्षेत्रों

- याद

- हटाने

- की जगह

- का प्रतिनिधित्व

- का अनुरोध

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकताएँ

- अनुसंधान

- कि

- परिणाम

- जिसके परिणामस्वरूप

- परिणाम

- वापसी

- रिटर्न

- प्रकट

- भूमिका

- रन

- दौड़ना

- क्रम

- s

- sagemaker

- नमूना

- सहेजें

- बचाया

- बचत

- अनुमापकता

- स्केलेबल

- स्केल

- स्केलिंग

- परिदृश्यों

- क्षेत्र

- लिपि

- सेकंड

- वर्गों

- सुरक्षा

- खंड

- विभाजन

- खंड

- चयनित

- का चयन

- कई

- सेवा की

- सेवाएँ

- सेवारत

- सेटिंग्स

- Share

- वह

- चाहिए

- महत्वपूर्ण

- सरल

- छह

- आकार

- आकार

- कुशल

- छोटा

- चिकनी

- So

- सॉफ्टवेयर

- सॉफ्टवेयर इंजीनियरिंग

- समाधान

- स्रोत

- वक्ता

- वक्ताओं

- विशिष्ट

- विशेष रूप से

- विनिर्दिष्ट

- भाषण

- खर्च

- spikes के

- प्रारंभ

- शुरू

- कदम

- कदम

- भंडारण

- संग्रहित

- कहानी

- धारा

- सुवीही

- संरचित

- इसके बाद

- पर्याप्त

- ऐसा

- उपयुक्त

- आपूर्ति

- समर्थन

- सहायक

- बदली

- तेजी से

- तुल्यकालन

- प्रणाली

- तालिका

- लेना

- लेता है

- लक्षित

- कार्य

- टीम

- तकनीक

- टेक्नोलॉजीज

- टेक्नोलॉजी

- अस्थायी

- टेक्स्ट

- से

- कि

- RSI

- भविष्य

- यूके

- लेकिन हाल ही

- उन

- फिर

- जिसके चलते

- इन

- वे

- इसका

- उन

- तीन

- यहाँ

- पहर

- समय श्रृंखला

- बहुत समय लगेगा

- समय-सीमा

- बार

- टाइमस्टैम्प

- समय

- शीर्षक

- खिताब

- सेवा मेरे

- टोकन

- ले गया

- टूलकिट

- मशाल

- पारंपरिक रूप से

- यातायात

- प्रशिक्षण

- पारदर्शी

- ट्रिगर

- ट्रिगर

- विश्वस्त

- सच

- कोशिश

- ट्यूटोरियल

- tv

- दो

- ठेठ

- Uk

- के अंतर्गत

- 30 दौरान

- समझ

- इकाइयों

- अपडेट

- के ऊपर

- उपयोग

- उदाहरण

- प्रयुक्त

- उपयोगकर्ता

- का उपयोग करता है

- का उपयोग

- उपयोग किया

- इस्तेमाल

- मान

- विभिन्न

- अलग-अलग

- संस्करण

- संस्करणों

- व्यवहार्य

- वीडियो

- दृष्टि

- भेंट

- आवाज़

- W

- था

- we

- वेब

- वेब सेवाओं

- कुंआ

- कब

- जब

- फुसफुसाना

- मर्जी

- साथ में

- अंदर

- बिना

- शब्द

- काम

- वर्कफ़्लो

- workflows

- कार्यबल

- कार्य

- दुनिया की

- लिख रहे हैं

- यमलो

- आप

- आपका

- स्वयं

- जेफिरनेट

- चिड़ियाघर