Mesterséges intelligencia (AI) has created a furor recently with its possibility to revolutionize how people approach and solve different tasks and complex problems. From healthcare to finance, AI and its associated machine-learning models have demonstrated their potential to streamline intricate processes, enhance decision-making patterns and uncover valuable insights.

A technológiában rejlő hatalmas lehetőségek ellenére azonban egy elhúzódó „fekete doboz” probléma továbbra is jelentős kihívást jelent az elfogadás során, és kérdéseket vet fel e kifinomult rendszerek átláthatóságával és értelmezhetőségével kapcsolatban.

Röviden, a fekete doboz probléma abból ered, hogy nehéz megérteni, hogyan dolgozzák fel az AI-rendszerek és a gépi tanulási modellek az adatokat, és hogyan generálnak előrejelzéseket vagy döntéseket. Ezek a modellek gyakran bonyolult algoritmusokra támaszkodnak, amelyek nem könnyen érthetők az emberek számára, ami az elszámoltathatóság és a bizalom hiányához vezet.

Ezért, ahogy a mesterséges intelligencia egyre inkább integrálódik életünk különböző területeibe, ennek a problémának a kezelése kulcsfontosságú e hatékony technológia felelősségteljes és etikus használatának biztosításához.

A fekete doboz: Áttekintés

A „fekete doboz” metafora abból az elképzelésből ered, hogy az AI-rendszerek és a gépi tanulási modellek az emberi megértés elől eltitkolt módon működnek, hasonlóan egy lezárt, átlátszatlan doboz tartalmaihoz. Ezek a rendszerek összetett matematikai modellekre és nagydimenziós adatkészletekre épülnek, amelyek bonyolult kapcsolatokat és mintákat hoznak létre, amelyek irányítják döntéshozatali folyamataikat. Ezek a belső működések azonban nem könnyen hozzáférhetők vagy érthetők az emberek számára.

Gyakorlatilag a mesterséges intelligencia fekete dobozának problémája az AI-rendszer előrejelzései vagy döntései mögött meghúzódó indokok megfejtésének nehézsége. Ez a probléma különösen gyakori a mély tanulási modellekben, például a neurális hálózatokban, ahol az egymással összekapcsolt csomópontok több rétege dolgozza fel és alakítja át az adatokat hierarchikus módon. E modellek bonyolultsága és az általuk végrehajtott nemlineáris transzformációk rendkívüli kihívást jelentenek a kimeneteik mögött meghúzódó okok felkutatása.

Nikita Brudnov, a BR Group – egy mesterséges intelligencia-alapú marketingelemző műszerfal – vezérigazgatója a Cointelegraph-nak elmondta, hogy az AI-modellek bizonyos döntésekhez és előrejelzésekhez való átláthatatlansága számos kontextusban problémát jelenthet, például az orvosi diagnózis, a pénzügyi döntéshozatal és a jogi eljárások, amelyek jelentősen befolyásolják a mesterséges intelligencia folyamatos alkalmazását.

Magazin: Joe Lubin: Az igazság az ETH alapítóinak szakításáról és a „Crypto Google”-ról

"Az elmúlt években nagy figyelmet fordítottak az AI-modellek által hozott döntések értelmezésére és magyarázatára szolgáló technikák fejlesztésére, mint például a fontossági pontszámok generálására, a döntési határok megjelenítésére és a tények ellentétes hipotetikus magyarázatainak azonosítására" - mondta, hozzátéve:

"Azonban ezek a technikák még gyerekcipőben járnak, és nincs garancia arra, hogy minden esetben hatékonyak lesznek."

Brudnov úgy véli továbbá, hogy a további decentralizációval a szabályozók megkövetelhetik, hogy az AI-rendszerek döntései átláthatóbbak és elszámoltathatóbbak legyenek, hogy biztosítsák azok etikai érvényességét és általános igazságosságát. Azt is javasolta, hogy a fogyasztók habozzák használni az AI-alapú termékeket és szolgáltatásokat, ha nem értik azok működését és döntéshozatali folyamatukat.

James Wo, a DFG – egy mesterséges intelligencia-technológiákba aktívan befektető befektetési cég – alapítója úgy véli, hogy a fekete doboz kérdése a belátható jövőben nem fogja befolyásolni az elfogadást. Wo szerint a legtöbb felhasználót nem feltétlenül érdekli, hogyan működnek a meglévő mesterséges intelligencia-modellek, és szívesen merítenek belőlük hasznosságot, legalábbis egyelőre.

„Középtávon, amint ezeknek a platformoknak az újdonsága elmúlik, minden bizonnyal több lesz a szkepticizmus a fekete doboz módszertanával kapcsolatban. A kérdések megnövekednek majd, ahogy az MI-használat belép a kriptográfiai és a Web3-ba, ahol pénzügyi téttel és következményekkel kell számolni” – ismerte el.

Hatás a bizalomra és az átláthatóságra

Az egyik terület, ahol az átláthatóság hiánya jelentősen befolyásolhatja a bizalmat, az AI-vezérelt orvosi diagnosztika. Például az AI-modellek képesek összetett egészségügyi adatok elemzésére az egészségügyben diagnózisok vagy kezelési javaslatok létrehozása érdekében. Ha azonban a klinikusok és a betegek nem tudják felfogni e javaslatok mögött rejlő indokot, megkérdőjelezhetik e meglátások megbízhatóságát és érvényességét. Ez a szkepticizmus tovább vezethet a mesterséges intelligencia-megoldások elfogadása iránti tétovázáshoz, ami potenciálisan akadályozhatja a betegellátás és a személyre szabott orvoslás fejlődését.

A pénzügyi területen a mesterséges intelligencia rendszerek használhatók hitelbírálatra, csalások felderítésére és kockázatértékelésre. A fekete doboz-probléma azonban bizonytalanságot kelthet ezen kreditpontszámok igazságosságát és pontosságát, vagy a csalási riasztások mögött meghúzódó indokokat illetően, korlátozva a technológia azon képességét, hogy digitalizálja az iparágat.

A kriptoipar is szembesül a fekete doboz-probléma következményeivel. Például a digitális eszközök és a blokklánc technológia a decentralizációban, a nyitottságban és az ellenőrizhetőségben gyökerezik. Az átláthatóságot és értelmezhetőséget hiányzó mesterséges intelligencia rendszerek ezen a téren elszakítják a felhasználói elvárásokat és az AI-vezérelt megoldások valóságát.

A szabályozással kapcsolatos aggályok

Szabályozási szempontból az AI fekete doboz problémája egyedi kihívásokat jelent. Először is, az AI-folyamatok átlátszatlansága egyre nehezebbé teheti a szabályozók számára annak értékelését, hogy ezek a rendszerek megfelelnek-e a meglévő szabályoknak és irányelveknek. Ezenkívül az átláthatóság hiánya megnehezítheti a szabályozók azon képességét, hogy új kereteket dolgozzanak ki, amelyek képesek kezelni az AI-alkalmazások jelentette kockázatokat és kihívásokat.

A törvényhozók nehezen tudják értékelni az AI-rendszerek tisztességességét, elfogultságát és adatvédelmi gyakorlatát, valamint a fogyasztói jogokra és a piac stabilitására gyakorolt lehetséges hatásukat. Ezenkívül a mesterséges intelligencia által vezérelt rendszerek döntéshozatali folyamatainak világos ismerete nélkül a szabályozók nehézségekbe ütközhetnek a lehetséges sebezhetőségek azonosítása és a kockázatok mérséklésére szolgáló megfelelő biztosítékok biztosításában.

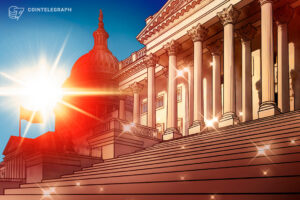

One notable regulatory development regarding this technology has been the European Union’s Artificial Intelligence Act, which is moving closer to becoming part of the bloc’s statute book after reaching a provisional political agreement on April 27.

Az AI-törvény lényege, hogy megbízható és felelősségteljes környezetet teremtsen az AI-fejlesztéshez az EU-n belül. A törvényhozók olyan osztályozási rendszert fogadtak el, amely a különböző típusú mesterséges intelligenciákat kockázatok szerint kategorizálja: elfogadhatatlan, magas, korlátozott és minimális. Ez a keretrendszer a mesterséges intelligencia feketedoboz-problémájával kapcsolatos különféle aggályok kezelésére szolgál, beleértve az átláthatósággal és az elszámoltathatósággal kapcsolatos kérdéseket.

Az AI-rendszerek hatékony nyomon követésének és szabályozásának képtelensége már eddig is feszültté tette a kapcsolatokat a különböző iparágak és szabályozó testületek között.

Early last month, the popular AI chatbot ChatGPT was banned in Italy for 29 days, primarily due to privacy concerns raised by the country’s data protection agency for suspected violations of the EU’s General Data Protection Regulations (GDPR). However, the platform was allowed to resume its services on April 29 after CEO Sam Altman announced that he and his team had taken specific steps to comply with the regulator’s demands, including the revelation of its data processing practices and implementation of its implementation of age-gating measures.

A mesterséges intelligencia-rendszerek nem megfelelő szabályozása alááshatja a közvélemény AI-alkalmazásokba vetett bizalmát, mivel a felhasználók egyre inkább aggódnak a benne rejlő torzítások, pontatlanságok és etikai vonatkozások miatt.

A fekete doboz probléma megoldása

A mesterséges intelligencia feketedoboz-problémájának hatékony megoldásához elengedhetetlen az átláthatóságot, értelmezhetőséget és elszámoltathatóságot elősegítő megközelítések kombinációjának alkalmazása. Két ilyen kiegészítő stratégia a magyarázható AI (XAI) és a nyílt forráskódú modellek.

Az XAI egy olyan kutatási terület, amely az AI-rendszerek összetettsége és az emberi értelmezhetőség iránti igény közötti szakadék áthidalására irányul. Az XAI olyan technikák és algoritmusok fejlesztésére összpontosít, amelyek ember számára érthető magyarázatot adnak a mesterséges intelligencia által vezérelt döntésekre, betekintést nyújtva e döntések okaiba.

Az XAI-ban gyakran alkalmazott módszerek közé tartoznak a helyettesítő modellek, a jellemzők fontosságának elemzése, az érzékenységelemzés és a lokálisan értelmezhető modell-agnosztikus magyarázatok. Az XAI iparágakban történő bevezetése segíthet az érdekelt feleknek jobban megérteni a mesterséges intelligencia által vezérelt folyamatokat, növeli a technológiába vetett bizalmat és megkönnyíti a szabályozási követelményeknek való megfelelést.

Az XAI-val párhuzamosan a nyílt forráskódú mesterséges intelligencia modellek elfogadásának elősegítése hatékony stratégia lehet a fekete doboz probléma megoldására. A nyílt forráskódú modellek teljes hozzáférést biztosítanak az AI-rendszereket mozgató algoritmusokhoz és adatokhoz, lehetővé téve a felhasználóknak és a fejlesztőknek a mögöttes folyamatok alapos vizsgálatát és megértését.

Ez a megnövekedett átláthatóság segíthet a bizalom kiépítésében, és elősegítheti a fejlesztők, kutatók és felhasználók közötti együttműködést. Ezenkívül a nyílt forráskódú megközelítés robusztusabb, elszámoltathatóbb és hatékonyabb AI-rendszereket hozhat létre.

A fekete doboz probléma a kriptotérben

A fekete doboz problémája jelentős következményekkel jár a kriptográfiai tér különböző aspektusaiban, beleértve a kereskedési stratégiákat, a piaci előrejelzéseket, a biztonsági intézkedéseket, a tokenizálást és az intelligens szerződéseket.

A kereskedési stratégiák és a piaci előrejelzések terén az AI-vezérelt modellek egyre népszerűbbek, mivel a befektetők igyekeznek kamatoztatni az algoritmikus kereskedést. A fekete doboz-probléma azonban akadályozza a felhasználókat ezen modellek működésének megértésében, és megnehezíti azok hatékonyságának és lehetséges kockázatainak felmérését. Következésképpen ez az átlátszatlanság indokolatlan bizalmat eredményezhet a mesterséges intelligencia által vezérelt befektetési döntésekben, vagy túlzottan az automatizált rendszerekre teheti a befektetőket.

A mesterséges intelligencia kulcsfontosságú szerepet játszik a biztonsági intézkedések fokozásában a blokklánc-ökoszisztémán belül a csalárd tranzakciók és gyanús tevékenységek észlelésével. Mindazonáltal a fekete doboz probléma bonyolítja az AI-vezérelt biztonsági megoldások ellenőrzési folyamatát. A döntéshozatal átláthatóságának hiánya alááshatja a biztonsági rendszerekbe vetett bizalmat, ami aggodalmat kelt azzal kapcsolatban, hogy képesek-e megvédeni a felhasználói eszközöket és információkat.

A tokenizálás és az intelligens szerződések – a blokklánc-ökoszisztéma két létfontosságú összetevője – szintén az AI fokozott integrációjának tanúi. A fekete doboz probléma azonban elhomályosíthatja a mesterséges intelligencia által generált tokenek vagy az intelligens szerződésvégrehajtás mögötti logikát.

Ahogy a mesterséges intelligencia forradalmasítja a különböző iparágakat, a fekete doboz problémájának kezelése egyre sürgetőbbé válik. A kutatók, fejlesztők, döntéshozók és iparági érdekelt felek közötti együttműködés előmozdításával megoldások dolgozhatók ki az átláthatóság, az elszámoltathatóság és az AI-rendszerekbe vetett bizalom előmozdítására. Így érdekes lesz látni, hogyan fejlődik tovább ez az újszerű technológiai paradigma.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoAiStream. Web3 adatintelligencia. Felerősített tudás. Hozzáférés itt.

- A jövő pénzverése – Adryenn Ashley. Hozzáférés itt.

- Részvények vásárlása és eladása PRE-IPO társaságokban a PREIPO® segítségével. Hozzáférés itt.

- Forrás: https://cointelegraph.com/news/ai-s-black-box-problem-challenges-and-solutions-for-a-transparent-future

- :van

- :is

- :nem

- :ahol

- 2023

- 27

- a

- képesség

- Rólunk

- hozzáférés

- hozzáférhető

- felelősségre vonhatóság

- felelős

- pontosság

- át

- törvény

- aktívan

- tevékenységek

- hozzáadásával

- Ezen kívül

- cím

- címzés

- fogadott

- Elfogadása

- Örökbefogadás

- fejlesztések

- érint

- Után

- ügynökség

- Megállapodás

- AI

- AI törvény

- AI chatbot

- AI-hajtású

- célok

- Figyelmeztetések

- algoritmikus

- algoritmikus kereskedés

- algoritmusok

- Minden termék

- már

- Is

- között

- an

- elemzés

- analitika

- elemez

- és a

- bejelentés

- alkalmazások

- megközelítés

- megközelít

- megfelelő

- április

- VANNAK

- TERÜLET

- körül

- mesterséges

- mesterséges intelligencia

- AS

- szempontok

- értékelés

- Eszközök

- társult

- At

- figyelem

- Automatizált

- BE

- válik

- válik

- egyre

- óta

- mögött

- úgy gondolja,

- Jobb

- között

- előítélet

- torzítások

- Fekete

- blockchain

- blokklánc ökoszisztéma

- Blockchain technológia

- testületek

- könyv

- határait

- Doboz

- áthidaló

- épít

- bizalmat építeni

- épült

- vállalkozások

- by

- TUD

- nem tud

- tőkésít

- ami

- esetek

- vezérigazgató

- bizonyos

- kihívás

- kihívások

- kihívást

- chatbot

- ChatGPT

- választás

- besorolás

- osztályozási rendszer

- világos

- klinikusok

- Cointelegraph

- együttműködés

- kombináció

- kiegészítő

- bonyolult

- bonyolultság

- teljesítés

- alkatrészek

- megért

- az érintett

- aggodalmak

- Következmények

- Következésképpen

- Fontolja

- fogyasztó

- Fogyasztói jogok

- Fogyasztók

- tartalom

- kontextusok

- tovább

- tovább

- szerződés

- szerződések

- Mag

- tudott

- ország

- teremt

- készítette

- hitel

- kritikus

- crypto

- Kriptoipar

- kriptográfiai tér

- műszerfal

- dátum

- Adatvédelem

- adatfeldolgozás

- adat védelem

- adatkészletek

- Decentralizálás

- döntés

- Döntéshozatal

- határozatok

- elszánt

- mély

- mély tanulás

- minden bizonnyal

- igények

- igazolták

- tervezett

- Ellenére

- Érzékelés

- Fejleszt

- fejlett

- fejlesztők

- fejlesztése

- Fejlesztés

- különböző

- nehéz

- nehézségek

- Nehézség

- digitális

- Digitális eszközök

- digitalizálni

- do

- domain

- ne

- hajtás

- két

- könnyen

- ökoszisztéma

- Hatékony

- hatékonyan

- hatékonyság

- munkavállaló

- lehetővé téve

- növelése

- fokozása

- biztosítására

- biztosítása

- belép

- Környezet

- alapvető

- ETH

- etikai

- EU

- európai

- értékelni

- fejlődik

- példa

- végrehajtás

- létező

- várakozások

- magyarázó

- Arc

- arcok

- megkönnyítését

- méltányosság

- Funkció

- finanszíroz

- pénzügyi

- Cég

- koncentrál

- A

- a belátható

- forma

- Foster

- elősegítése

- alapító

- alapítók

- Keretrendszer

- keretek

- csalás

- csalások felderítése

- csaló

- ból ből

- Tele

- funkció

- további

- Továbbá

- jövő

- egyre

- rés

- GDPR

- általános

- Általános adatok

- generál

- generáló

- biztosít

- Csoport

- garancia

- útmutató

- irányelvek

- kellett

- boldog

- Legyen

- he

- egészségügyi

- segít

- Magas

- akadályozza

- övé

- Hogyan

- azonban

- HTTPS

- emberi

- Az emberek

- azonosító

- if

- óriási

- Hatás

- ütköztető

- végrehajtás

- végrehajtási

- következményei

- fontosság

- in

- képtelenség

- tartalmaz

- Beleértve

- Növelje

- <p></p>

- egyre inkább

- iparágak

- ipar

- információ

- velejáró

- meglátások

- integrált

- integráció

- Intelligencia

- összekapcsolt

- kamat

- érdekes

- bele

- beruházás

- Befektetők

- fektet

- kérdés

- kérdések

- IT

- Olaszország

- ITS

- hiány

- keresztnév

- törvényhozók

- tojók

- vezet

- vezető

- tanulás

- legkevésbé

- Jogi

- jogi eljárások

- mint

- Korlátozott

- életek

- helyi

- logika

- gép

- gépi tanulás

- készült

- csinál

- Gyártás

- mód

- sok

- piacára

- piaci előrejelzések

- Marketing

- matematikai

- Lehet..

- intézkedések

- orvosi

- orvosi adatok

- orvostudomány

- Módszertan

- esetleg

- minimális

- Enyhít

- modellek

- monitor

- Hónap

- több

- Ráadásul

- a legtöbb

- mozgó

- sok

- többszörös

- szükségszerűen

- Szükség

- hálózatok

- neurális hálózatok

- Mindazonáltal

- Új

- nem

- csomópontok

- figyelemre méltó

- fogalom

- regény

- újdonság

- Most

- of

- kedvezmény

- felajánlás

- gyakran

- on

- egyszer

- átlátszatlan

- nyílt forráskódú

- Nyitottság

- működik

- or

- mi

- átfogó

- fizetett

- paradigma

- rész

- különösen

- beteg

- betegek

- minták

- Emberek (People)

- Teljesít

- Személyre

- Hely

- emelvény

- Platformok

- Plató

- Platón adatintelligencia

- PlatoData

- játszani

- politikusok

- politikai

- Népszerű

- népszerűség

- lehetőség

- potenciális

- potenciálisan

- erős

- Gyakorlati

- gyakorlat

- Tippek

- be

- ajándékot

- uralkodó

- elsősorban

- magánélet

- Probléma

- problémák

- Eljárás

- folyamat

- Folyamatok

- feldolgozás

- Termékek

- kellene támogatnia,

- támogatása

- védelem

- ad

- ideiglenes

- nyilvános

- közbizalom

- kérdés

- Kérdések

- emelt

- emelés

- logika

- elérése

- Valóság

- birodalom

- új

- nemrég

- ajánlások

- tekintettel

- Szabályoz

- Szabályozás

- előírások

- Szabályozók

- szabályozók

- összefüggő

- Kapcsolatok

- megbízhatóság

- támaszkodnak

- következményei

- szükség

- követelmények

- kutatás

- kutatók

- felelős

- eredményez

- folytatás

- forradalmasítani

- forradalmasítja

- jogok

- Kockázat

- kockázatértékelés

- kockázatok

- erős

- Szerep

- szabályok

- biztosítékok

- Mondott

- Sam

- Sam Altman

- pontozás

- biztonság

- Biztonsági intézkedések

- lát

- Keresnek

- Érzékenység

- Szolgáltatások

- Szettek

- előadás

- jelentős

- jelentősen

- egyszerűen

- Szkepticizmus

- okos

- okos szerződés

- Intelligens szerződések

- Megoldások

- SOLVE

- kifinomult

- forrás

- Hely

- különleges

- osztott

- Stabilitás

- érdekeltek

- állvány

- állványok

- szárak

- Lépései

- Még mindig

- stratégiák

- Stratégia

- áramvonal

- Küzdelem

- ilyen

- gyanús

- rendszer

- Systems

- Tandem

- feladatok

- csapat

- tech

- technikák

- Technologies

- Technológia

- feltételek

- hogy

- A

- azok

- Őket

- Ott.

- Ezek

- ők

- ezt

- nak nek

- tokenizálás

- tokenek

- Nyom

- Kereskedés

- Trading Strategies

- Tranzakciók

- Átalakítás

- transzformációk

- Átláthatóság

- átlátszó

- kezelés

- Bízzon

- megbízható

- igazság

- kettő

- típusok

- Bizonytalanság

- feltárni

- mögöttes

- megért

- érthető

- megértés

- egyedi

- upon

- us

- használ

- használó

- Felhasználók

- hasznosság

- Értékes

- különféle

- Igazolás

- jogsértések

- fontos

- sérülékenységek

- volt

- Web3

- amikor

- ami

- lesz

- val vel

- belül

- nélkül

- tanúi

- wo

- Munka

- működésébe

- év

- zephyrnet