Továbbra is nagy kihívást jelent annak megértése, hogy az agy hogyan szervezi és éri el a térinformációkat – hol vagyunk, mi van a sarkon, hogyan juthatunk el oda. A folyamat magában foglalja az emlékek és a tárolt téradatok teljes hálózatának felidézését több tízmilliárd neuronról, amelyek mindegyike több ezer másik neuronhoz kapcsolódik. Az idegtudósok olyan kulcselemeket azonosítottak, mint pl rácscellák, helyeket térképező neuronok. De a mélyebbre menni bonyolultnak bizonyul: nem mintha a kutatók eltávolítanák és tanulmányoznák az emberi szürkeállomány szeleteit, hogy megnézzék, hogyan áramlanak át és hogyan kapcsolódnak egymáshoz a képek, hangok és szagok helyfüggő emlékei.

A mesterséges intelligencia egy másik utat kínál a bejutáshoz. Az idegtudósok évek óta sokféle neurális hálózatot – a legtöbb mély tanulási alkalmazást működtető motort – hasznosítottak az agy neuronjainak tüzelésének modellezésére. A közelmúltban végzett munkájuk során a kutatók kimutatták, hogy a hippokampusz, az agynak a memória szempontjából kritikus szerkezete alapvetően egy speciális idegháló, transzformátor, álcázva, álruhában. Az új modelljük a térbeli információkat olyan módon követi nyomon, amely párhuzamos az agy belső működésével. Figyelemre méltó sikereket értek el.

"Az a tény, hogy tudjuk, hogy ezek az agymodellek egyenértékűek a transzformátorral, azt jelenti, hogy modelljeink sokkal jobban teljesítenek, és könnyebben taníthatók" - mondta. James Whittington, egy kognitív idegtudós, aki megosztja idejét a Stanford Egyetem és a laboratórium között Tim Behrens az Oxfordi Egyetemen.

Whittington és mások tanulmányai arra utalnak, hogy a transzformátorok nagymértékben javíthatják a neurális hálózati modellek azon képességét, hogy utánozzák a rácssejtek és az agy más részei által végzett számításokat. Az ilyen modellek elősegíthetik a mesterséges neurális hálózatok működésének megértését, és még valószínűbb, hogy az agyban hogyan végeznek számításokat, mondta Whittington.

"Nem próbáljuk újra létrehozni az agyat" - mondta David Ha, a Google Brain informatikusa, aki transzformátormodelleken is dolgozik. "De tudunk-e olyan mechanizmust létrehozni, amely képes arra, amit az agy?"

A transzformátorok először öt éve jelentek meg a mesterséges intelligencia nyelvfeldolgozásának új módjaként. Ők jelentik a titkos szószot azokban a címsor-megragadó mondatkiegészítő programokban, mint pl BERTI és a GPT-3, amely meggyőző dalszövegeket generál, Shakespeare-szonetteket komponál, és megszemélyesíti az ügyfélszolgálati képviselőket.

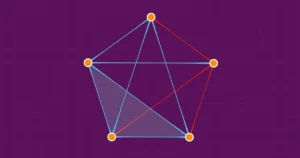

A transzformátorok az önfigyelemnek nevezett mechanizmussal működnek, amelyben minden bemenet – egy szó, egy pixel, egy szám egy sorozatban – mindig minden más bemenethez kapcsolódik. (Más neurális hálózatok csak bizonyos más bemenetekhez kapcsolják a bemeneteket.) De míg a transzformátorokat nyelvi feladatokra tervezték, azóta kiválóan teljesítenek más feladatokban, például a képek osztályozásában – és most az agy modellezésében.

2020-ban az általa vezetett csoport Sepp Hochreiter, az ausztriai Linzi Johannes Kepler Egyetem informatikusa egy transzformátor segítségével újraszerelte a memória-visszakeresés egy nagy teljesítményű, régóta fennálló modelljét, az úgynevezett Hopfield-hálózatot. Ezeket a hálózatokat először 40 évvel ezelőtt vezette be John Hopfield princetoni fizikus, és egy általános szabályt követnek: az egyidejűleg aktív neuronok erős kapcsolatokat építenek ki egymással.

Hochreiter és munkatársai megjegyezték, hogy a kutatók jobb memória-visszakeresési modelleket kerestek, összefüggést láttak a Hopfield-hálózatok emlékek előhívása és a transzformátorok figyelemfelkeltése között. Frissítették a Hopfield hálózatot, lényegében transzformátorrá alakítva. Ez a változás lehetővé tette a modell számára, hogy több emléket tároljon és nyerjen vissza a hatékonyabb kapcsolatok miatt, mondta Whittington. Maga Hopfield és Dmitrij Krotov az MIT-IBM Watson AI Laborban bebizonyította, hogy a transzformátor alapú Hopfield hálózat biológiailag elfogadható.

Ezután korábban ebben az évben, Whittington és Behrens segített tovább finomítani Hochreiter megközelítésén, úgy módosították a transzformátort, hogy ahelyett, hogy lineáris sorozatként kezelné az emlékeket – mint egy mondatban lévő szavakat –, magasabb dimenziós terekben koordinátákként kódolta azokat. Ez a „csavar”, ahogy a kutatók nevezték, tovább javította a modell teljesítményét az idegtudományi feladatokban. Azt is kimutatták, hogy a modell matematikailag egyenértékű a rácssejtek tüzelési mintáinak modelljeivel, amelyeket az idegtudósok az fMRI-vizsgálatokban látnak.

"A rácssejteknek ilyen izgalmas, gyönyörű, szabályos szerkezetük van, és feltűnő mintázatai vannak, amelyek nem valószínű, hogy véletlenszerűen bukkannak fel" - mondta Caswell Barry, a University College London idegkutatója. Az új munka megmutatta, hogy a transzformátorok hogyan replikálják pontosan a hippokampuszban megfigyelt mintákat. "Felismertek, hogy a transzformátor képes kitalálni, hogy hol van a korábbi állapotok alapján, és hogyan mozgatják, méghozzá oly módon, hogy ez beépüljön a hálózati cellák hagyományos modelljébe."

Más újabb munkák azt sugallják, hogy a transzformátorok elősegíthetik más agyi funkciók megértését is. Tavaly Martin Schrimpf, a Massachusetts Institute of Technology számítógépes idegtudósa 43 különböző neurális háló modellt elemzett hogy lássák, mennyire jósolták meg az emberi idegi aktivitás méréseit az fMRI és elektrokortikográfia szerint. Megállapította, hogy a transzformátorok a jelenlegi vezető, legkorszerűbb neurális hálózatok, amelyek a képalkotásban fellelhető szinte minden eltérést előre jeleznek.

És Ha, valamint egy informatikus kollégám Yujin Tang, a közelmúltban olyan modellt tervezett, amely szándékosan nagy mennyiségű adatot tud küldeni egy transzformátoron keresztül véletlenszerűen, rendezetlen módon, utánozva azt, ahogy az emberi test az érzékszervi megfigyeléseket továbbítja az agynak. A transzformátoruk, akárcsak a mi agyunk, sikeresen képes kezelni a rendezetlen információáramlást.

„A neurális hálók be vannak kötve egy adott bemenet fogadására” – mondta Tang. A való életben azonban az adatkészletek gyakran gyorsan változnak, és a legtöbb mesterséges intelligencia nincs mód a beállításra. "Olyan építészettel akartunk kísérletezni, amely nagyon gyorsan tud alkalmazkodni."

A haladás jelei ellenére Behrens úgy látja, hogy a transzformátorok csak egy lépés az agy pontos modellje felé, nem pedig a küldetés vége. – Itt szkeptikus idegtudósnak kell lennem – mondta. „Nem hinném, hogy a transzformátorok a végén úgy alakulnak majd, ahogyan az agyban a nyelvről gondolkodunk, még akkor sem, ha a jelenlegi legjobb mondatmodelljük van.”

„Ez a leghatékonyabb alap arra, hogy előrejelzéseket készítsek arról, hogy hol vagyok, és mit fogok látni legközelebb? Ha őszinte akarok lenni, még túl korai megmondani” – mondta Barry.

Schrimpf is megjegyezte, hogy még a legjobban teljesítő transzformátorok is korlátozottak, jól működnek például szavakra és rövid kifejezésekre, de nem olyan nagyobb szabású nyelvi feladatoknál, mint a történetmesélés.

"Az az érzésem, hogy ez az architektúra, ez a transzformátor a megfelelő helyre helyezi az agy szerkezetének megértéséhez, és edzéssel javítható" - mondta Schrimpf. "Ez egy jó irány, de a mezőny rendkívül összetett."