A vizuális jelenetben különálló objektumok kiválasztása intuitívnak tűnik számunkra, de a gépek küzdenek ezzel a feladattal. A Meta új mesterséges intelligencia-modellje átfogó képet alkotott arról, hogy mi is az objektum, lehetővé téve az objektumok elkülönítését még akkor is, ha korábban soha nem látta őket.

Meglehetősen prózai számítógépes látási feladatnak tűnhet, de egy kép elemzése és annak meghatározása, hogy az egyik objektum hol végződik, és hol kezdődik a másik, meglehetősen alapvető készség, amely nélkül egy sor bonyolultabb feladat megoldhatatlan lenne.

Az „objektumszegmentáció” nem újdonság; Az AI-kutatók évek óta dolgoznak rajta. Ám ezeknek a modelleknek az építése általában időigényes folyamat volt, amely sok emberi annotációt és jelentős számítási erőforrást igényel a képeken. Az eredményül kapott modellek pedig jellemzően nagymértékben specializálódtak bizonyos felhasználási esetekre.

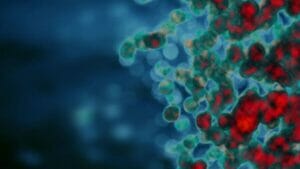

Most azonban a Meta kutatói bemutatták a Segment Anything Model (SAM) modellt, amely bármilyen tárgyat képes kivágni bármilyen jelenetben, függetlenül attól, hogy látott-e már hasonlót korábban. A modell ezt számos különféle felszólításra is képes megtenni, a szöveges leírástól az egérkattintásig vagy akár a szemkövetési adatokig.

"A SAM megtanulta az objektumok általános fogalmát, és bármilyen képen vagy videón lévő objektumhoz képes maszkot generálni" - írták a kutatók egy blog Hozzászólás. „Úgy gondoljuk, hogy a lehetőségek szélesek, és izgatottak vagyunk a sok lehetséges felhasználási eset miatt, amelyekről még nem is gondoltunk.”

A modell fejlesztésének kulcsa egy hatalmas új, 1.1 milliárd szegmentációs maszkból álló adatkészlet volt, amely a kép azon részeire vonatkozik, amelyeket elkülönítettek és megjegyzésekkel jeleztek, hogy egy adott objektumot tartalmaznak. A képek manuális emberi megjegyzéseinek és automatizált folyamatok kombinációjával hozták létre, és ez messze az eddigi legnagyobb ilyen típusú gyűjtemény.

A Meta kutatói szerint egy ilyen hatalmas adathalmazra oktatva egy általános fogalmat alakított ki arról, hogy mi is az objektum, ami lehetővé teszi, hogy olyan dolgokat is szegmentáljon, amelyeket korábban még nem is látott. Ez az általánosítási képesség arra késztette a kutatókat, hogy a SAM-ot „alapmodellnek” nevezzék, a ellentmondásos kifejezés más masszív előre betanított modellek leírására szolgál, mint pl OpenAI GPT sorozat, amelyek képességei állítólag annyira általánosak, hogy számos alkalmazás alapjául szolgálhatnak.

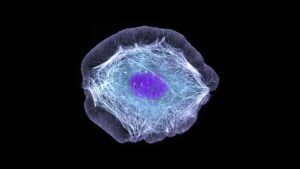

A képszegmentálás határozottan kulcsfontosságú összetevője a számítógépes látási feladatok széles skálájának. Ha nem tudod szétválasztani a jelenet különböző összetevőit, akkor nehéz ennél bonyolultabb dolgot csinálni. A kutatók blogjukban azt mondják, hogy felbecsülhetetlen értékűnek bizonyulhat a videó- és képszerkesztésben, vagy segíthet a tudományos képek elemzésében.

A vállalat metaverzum-ambicióihoz talán még helyénvalóbb, hogy bemutatják, hogyan használható virtuális valóság-headsettel együtt, hogy a felhasználó tekintete alapján válasszon ki konkrét objektumokat. Azt is mondják, hogy potenciálisan egy nagy nyelvi modellel párosítható egy multimodális rendszer létrehozása érdekében, amely képes megérteni egy weboldal vizuális és szöveges tartalmát.

A felszólítások széles körének kezelésére való képessége különösen rugalmassá teszi a rendszert. Az a weboldal Az új modell bemutatója során a cég megmutatja, hogy egy kép elemzése után arra kérheti, hogy különítsen el bizonyos objektumokat úgy, hogy egyszerűen rákattint az egérkurzorral, beírja, hogy mit szeretne szegmentálni, vagy egyszerűen felosztja a teljes képet. külön objektumok.

És ami a legfontosabb, a vállalat kutatási célokra nyílt forrásból szerzi be mind a modellt, mind az adatkészletet, hogy mások építhessenek munkájukra. Ugyanezt a megközelítést alkalmazta a vállalat a LLaMA nagynyelvű modelljénél, ami ahhoz vezetett, hogy gyorsan szivárgott az interneten és sarkallva a kísérletezési hullám amatőrök és hackerek.

Hogy ez megtörténik-e a SAM-mel, az még nem látható, de akárhogy is, ez egy ajándék az AI-kutatói közösségnek, amely felgyorsíthatja az előrehaladást számos fontos számítógépes látási probléma megoldásában.

Kép: Meta AI

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- Platoblockchain. Web3 metaverzum intelligencia. Felerősített tudás. Hozzáférés itt.

- Forrás: https://singularityhub.com/2023/04/10/metas-new-ai-can-identify-and-remove-objects-in-images/

- :is

- $ UP

- 1

- a

- képesség

- Képes

- gyorsul

- Után

- AI

- ai kutatás

- lehetővé téve

- lehetővé teszi, hogy

- ambíciók

- elemzés

- elemzése

- és a

- Másik

- alkalmazások

- megközelítés

- VANNAK

- AS

- összeszerelt

- At

- Automatizált

- alapján

- BE

- előtt

- hogy

- Hisz

- Billió

- Blog

- Törés

- széles

- épít

- Épület

- by

- TUD

- képességek

- esetek

- gyűjtemény

- kombináció

- közösség

- vállalat

- Társaságé

- bonyolult

- alkatrészek

- számítógép

- Számítógépes látás

- számítástechnika

- koncepció

- tekintélyes

- tartalmaz

- tartalom

- tudott

- teremt

- készítette

- hitel

- vágás

- dátum

- találka

- üzlet

- minden bizonnyal

- leírni

- leírás

- fejlett

- Fejlesztés

- különböző

- bármelyik

- vége

- Egész

- Még

- izgatott

- meglehetősen

- rugalmas

- A

- Alapok

- ból ből

- alapvető

- általános

- generál

- ajándék

- hackerek

- történik

- Kemény

- Legyen

- headset

- segít

- nagyon

- vendéglátó

- Hogyan

- HTTPS

- emberi

- ötlet

- kép

- képek

- fontos

- in

- intuitív

- felbecsülhetetlen

- izolált

- IT

- ITS

- Kulcs

- nyelv

- nagy

- legnagyobb

- tanult

- Led

- mint

- Láma

- gép

- KÉSZÍT

- kézikönyv

- sok

- maszkok

- tömeges

- meta

- metaverse

- esetleg

- modell

- modellek

- több

- a legtöbb

- Új

- fogalom

- tárgy

- objektumok

- of

- on

- ONE

- Más

- Egyéb

- oldal

- párosított

- különös

- különösen

- vedd

- Plató

- Platón adatintelligencia

- PlatoData

- lehetőségek

- potenciális

- potenciálisan

- szép

- problémák

- folyamat

- Folyamatok

- Haladás

- Bizonyít

- ad

- célokra

- hatótávolság

- gyorsan

- Valóság

- kifejezés

- Tekintet nélkül

- régiók

- maradványok

- kutatás

- kutatók

- Tudástár

- válasz

- kapott

- Sam

- azonos

- színhely

- tudományos

- Úgy tűnik,

- részes

- szegmentáció

- különálló

- Series of

- Műsorok

- egyszerűen

- jártasság

- So

- specializált

- különleges

- Küzdelem

- ilyen

- rendszer

- Feladat

- feladatok

- hogy

- A

- azok

- Őket

- Ezek

- dolgok

- Keresztül

- időigényes

- nak nek

- Képzések

- jellemzően

- megért

- bemutatta

- us

- használ

- fajta

- videó

- Tényleges

- Virtuális valóság

- látomás

- Út..

- háló

- Mit

- vajon

- ami

- széles

- Széleskörű

- lesz

- val vel

- nélkül

- Munka

- dolgozzanak ki

- dolgozott

- lenne

- év

- te

- zephyrnet