Az egyén egészsége hihetetlenül személyes téma, és az orvoshoz fordulás megfélemlítő és megterhelő élmény lehet. Ez különösen igaz azokra az emberekre, akik olyan csoportokhoz tartoznak, amelyekben az orvosi rendszer történelmileg kudarcot vallott. Az egészségügyi rendszer ezen strukturális problémái áthatják azokat az algoritmusokat, amelyeket egyre gyakrabban használnak a betegek diagnózisában és kezelésében. A CCC panelt szervezett „Egészségügyi méltányosság: Hogyan csökkenthetik az algoritmusok és az adatok a károkat, nem pedig súlyosbíthatják?” amely ezeket a kérdéseket kezelte. A panel résztvevői Dr. Amaka Eneanya (Fresenius Medical Care), Dr. Mona Singh (Princeton Egyetem), Dr. Melanie Moses (New Mexico Egyetem) és Dr. Katie Siek (Indiana Egyetem) voltak.

Az egyén egészsége hihetetlenül személyes téma, és az orvoshoz fordulás megfélemlítő és megterhelő élmény lehet. Ez különösen igaz azokra az emberekre, akik olyan csoportokhoz tartoznak, amelyekben az orvosi rendszer történelmileg kudarcot vallott. Az egészségügyi rendszer ezen strukturális problémái áthatják azokat az algoritmusokat, amelyeket egyre gyakrabban használnak a betegek diagnózisában és kezelésében. A CCC panelt szervezett „Egészségügyi méltányosság: Hogyan csökkenthetik az algoritmusok és az adatok a károkat, nem pedig súlyosbíthatják?” amely ezeket a kérdéseket kezelte. A panel résztvevői Dr. Amaka Eneanya (Fresenius Medical Care), Dr. Mona Singh (Princeton Egyetem), Dr. Melanie Moses (New Mexico Egyetem) és Dr. Katie Siek (Indiana Egyetem) voltak.

Dr. Eneanya azzal kezdte a panelt, hogy megvitatja, hogy egy egyenlet szisztematikusan alábecsülte a vesebetegségetse a fekete amerikaiakban évtizedek óta. Elmagyarázta, hogy az Egyesült Államokban minden vesebetegségben szenvedő beteget nyilvántartásba vesznek. A betegség prevalenciája az elmúlt évtizedekben összességében nőtt, a fekete egyének esetében pedig még gyakoribb és súlyosabb.

Dr. Eneanya felvázolta ezeket a faji/etnikai különbségeket a krónikus vesebetegség (CKD) kockázati tényezőiben és kimenetelében (Eneanya ND et al. Nature Rev Neph. 2021, Egyesült Államok veseadatrendszere.):

- A cukorbetegség prevalenciája a feketék körében a legmagasabb a többi faji csoporthoz képest

- A fekete és spanyol egyéneket fiatalabb korban diagnosztizálják, mint a fehéreket

- A fekete egyéneknél szignifikánsan magasabb a magas vérnyomás aránya, mint a fehéreknél

- A magas vérnyomás kontrollja kevésbé a fekete és a spanyol egyéneknél, mint a fehéreknél

- A fekete bőrűek más faji csoportokhoz képest kisebb valószínűséggel részesülnek nefrológiai ellátásban a dialízis megkezdése előtt

- Veseelégtelenség kialakulásának kockázata, amely dialízist vagy veseátültetést igényel

- 4-szer magasabb a feketéknél, mint a fehéreknél

- 1.3-szor magasabb a spanyol, mint a fehér egyéneknél

- A fekete egyének kisebb valószínűséggel kapnak veseátültetést, mint más faji csoportok

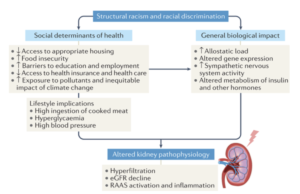

Dr. Eneanya kifejtette, hogy a strukturális rasszizmus rontja a vesebetegségekkel kapcsolatos rossz egészségügyi következményeket (Eneanya ND et al. Nature Rev Neph. 2021.):

Milyen életmódbeli szokásokat engedhet meg magának – például mit eszik, és az olyan biológiai hatások, mint a rasszizmus és a diszkrimináció okozta stressz – mind-mind metabolikus változásokhoz vezetnek a szervezetben, ami a veseműködés csökkenéséhez vezethet.

Dr. Eneanya egy példát mutatott be arra vonatkozóan, hogy a klinikusok által jelenleg használt algoritmusnak milyen következményei vannak a való világban. Az eGFR egyenlet egy algoritmus, amellyel meghatározható, hogy mennyire erős a beteg veseműködése. A magasabb eGFR jobb veseműködést jelent. A páciens eGFR-szintje határozza meg, hogy jogosult-e bizonyos kezelésekre, és ami talán a legfontosabb, a veseátültetésre. Az algoritmus azonban azt mutatja, hogy az azonos korú, nemű és azonos kreatininszintű (a veseműködést mérő vérvizsgálat) fekete és nem fekete személy eGFR-szintje eltérő. Az algoritmus kiszámítja, hogy egy fekete embernek magasabb az eGFR-je, állítólag jobb a veseműködése, mint a nem feketének. Ez korlátozza azt a kezelést, amelyre jogosultak, és azt jelenti, hogy betegebbnek kell lenniük ahhoz, hogy megkapják a nekik járó segítséget.

Dr. Eneanya elmagyarázta az algoritmus történetét, amely felfedi, miért számol ilyen téves módon: egy 1999-es tanulmány magasabb szérum kreatinint tulajdonított a feketéknek, mert téves feltételezés volt, hogy nagyobb izomtömegük van. A tanulmány kidolgozta az Egyesült Államokban használt első eGFR-egyenletet, és beépített egy „fekete faj” szorzótényezőt, amely magasabb eGFR-t okoz a feketék körében. Az eGFR használata problémás, mert a klinikusoknak meg kell ítélniük valaki faji hovatartozását a megjelenés vagy az orvosi feljegyzések alapján (amelyek esetében előfordulhat, hogy a faj egy korábbi klinikustól megmaradt feltételezésként szerepel). Nincs különbség a vegyes fajú egyének között, vagy nincs módszer az osztályozásukra.

Dr. Eneanya egy olyan cikk szerzője volt, amely megváltoztatta az eGFR számítási módját az egészségügyben azáltal, hogy olyan egyenletet szorgalmazott, amely nem veszi figyelembe a versenyt a becslésben (Inker LA, Eneanya ND, et al. NEJM 2021, Delgado C, et al. JASN 2021). Dr. Eneanya és kollégái visszatértek az eredeti, 1999-es tanulmányhoz, és eltávolították a fajt az egyenletből, és más bemenetekkel kiegészítették. Ma az Egyesült Államokban a kórházak és klinikák egyharmada használja az új egyenletet, és a United Network for Organ Sharing (UNOS) 2022 júniusában minden transzplantációs központot korlátozott a fajalapú egyenlet használatában. Januárban egy lépéssel tovább léptek. 2023-ban, és kijelentette, hogy minden egyesült államokbeli transzplantációs központ köteles felülvizsgálni a vesetranszplantációs várólistán szereplő összes fekete bőrű beteget, és módosítani kell a várólista idejét, ha azt a faji alapú eGFR egyenlet befolyásolta. Dr. Eneanya pontosította, hogy bár az UNOS a szövetségi kormány része, a kormány nem vett részt közvetlenül a faji alapú egyenlet használatának betiltására vonatkozó döntésben.

Az új eGFR-egyenlet egyetemes elfogadásán kívül Dr. Eneanya volt néhány további jövőbeli megközelítés, amelyeket kulcsfontosságúnak tart a vesebetegségek kezeléséhez való egyenlő hozzáféréshez:

- Irányelvek és folyamatok kidolgozása a krónikus vesebetegségek megelőző ellátásához való hozzáférés javítása érdekében

- Irányelvek kidolgozása a veseátültetéshez való hozzáférés növelésére

- Vizsgálja meg a környezeti hatásokat (pl. stressz, diszkrimináció) a veseműködésre és a betegség progressziójára

- Átláthatóság a vesefunkció meghatározásának a betegekkel folytatott megbeszélésében (beleértve az eGFR egyenletek korlátait)

Dr. Eneanya kifejtette, hogy a fekete fajjal kapcsolatos sztereotípiák kigúnyolása a tévedések és az álhírek kiküszöbölését jelenti, amelyeknek nincs tudományos alapja. Például az orvosi egyetemek tantervei módosulnak, hogy megmutassák, nincs antropológiai alapja annak, hogy az egyik fajban nagyobb az izomtömeg, mint a másikban. A média is jó munkát végzett ennek a megdöntött mítosznak a megosztásával, és Dr. Eneanya még egy Grey's Anatomy epizódról is konzultált, amely rávilágított az eGFR-egyenlet pusztító hatásaira a veseátültetésre szoruló fekete bőrű betegekre.

Dr. Singh az egészségi egyenlőtlenségekről szóló beszélgetést azzal folytatta, hogy elmagyarázta, hogy az Egyesült Államokban a feketék körében magasabb a rákos halálozási arány, mint a fehéreknél. Ez a tény jól példázza, hogy számos kihívással kell szembenézniük az egészségügyi szakembereknek és a számítástechnikai kutatóknak, valamint számos lehetőség kínálkozik olyan módszerek kidolgozására, amelyek nem növelik a meglévő különbségeket.

Dr. Singh először elmagyarázta a rák biológiáját: „A rák olyan betegség, amelyben saját sejtjeink olyan mutációkat szereznek, amelyek lehetővé teszik számukra, hogy ellenőrizhetetlenül növekedjenek. Tehát, ha meg akarjuk érteni a rák molekuláris hátterét EGY egyedben, akkor megvizsgálhatjuk rákos sejtjei és nem rákos sejtjei genomját és szekvenciáját. Miután szekvenáltuk a normál és a rákos sejteket, összehasonlíthatjuk a genomokat, és feltárhatjuk, hogy mely mutációkat szereztük meg a rákos sejtekben, és ez utalhat arra, hogy milyen változások lehetnek azok, amelyek relevánsak az adott egyén rákja szempontjából. Pontosan ezt tették az elmúlt 15 évben, amikor több tízezer egyed daganatait szekvenálták, és a bennük lévő mutációkat azonosították.”

Szinte mindenki ismer valakit, akinél rákot diagnosztizáltak, és nincs univerzális gyógymód. Dr. Singh azonban a következő lépésben a precíziós onkológia ígéretét taglalta, ahol egy tudós szekvenálja a páciens daganatát, azonosítja a DNS-mutációkat, és számítási elemzést végez annak meghatározására, hogy mely elváltozások célozhatók meg. Az immunterápia egy olyan megközelítés, amellyel valaki saját immunrendszerét kihasználja a daganatok megcélzására. Ígéretesnek ígérkező immunterápia olyan vakcinák tervezése, amelyek személyre szabottak minden egyénre, és ezek a vakcinák immunválaszt váltanak ki a daganatokra.

Dr. Singh elmagyarázza ennek működését, hogy mindegyik immunrendszerünk a klasszikus major hisztokompatibilitási komplex (MHC) I. osztályú génjének 6 különböző másolatával rendelkezik. Ezeknek a géneknek több mint 13,000 XNUMX különböző MHC-változata létezik, tehát minden ember más-más MHC-génkészlettel rendelkezik. A rákos sejteken belüli egyes mutációk „idegen” fehérjéket eredményeznek, és ezek egy részét az egyén MHC-jei megköthetik. A rákos eredetű fehérje fragmenséhez kötött MHC-komplexeket az immunsejtek felismerik, és aktiválhatják az immunválaszt. Ez erősen személyre szabott, mivel minden egyén daganatának különböző mutációi lehetnek, és minden egyén más-más MHC-vel rendelkezik. A tudósok gépi tanulást használnak annak előrejelzésére, hogy mely MHC-variánsok kötik meg mely peptideket, ami remélhetőleg előmozdítja az immunterápia hatékonyságát, és végső soron személyre szabott neoantigén vakcinák kidolgozásához vezet.

Az MHC-gének sokfélesége nagymértékben eltér a világon, részletezi Dr. Singh. A legtöbb MHC allélhez nem kapcsolódnak kötődési adatok, és azok, amelyeknek van adatuk a kötődésükről, elfogultak bizonyos faji csoportok javára. Egy adathalmaz tesztelésekor fontos, hogy ne csak az általános teljesítményre összpontosítsunk, hanem vegyük figyelembe az adatok alcsoportjait is, hogy mindenki egyenlő hozzáféréssel rendelkezzen a kutatás lehetséges előnyeihez.

Alkalmazás előtt elemezni kell a képzési készlet torzítását. Ezenkívül a nem látott adatokon végzett teljesítménybecslési módszerek torzítást mutathatnak a betanított adatokban. Az elfogulatlan adatgyűjtés elengedhetetlen ahhoz, hogy korlátozzuk a torzítás lehetőségét az algoritmus későbbi használata során. A témával kapcsolatos jövőbeni munka területei az alternatív képzési eljárásokra és a célzott adatgyűjtés algoritmikus stratégiáira összpontosítanak. Összességében kulcsfontosságú a méltányos precíziós orvoslási megközelítések fejlesztésének prioritása, hogy a terápiák és a későbbi kutatások méltányosak legyenek.

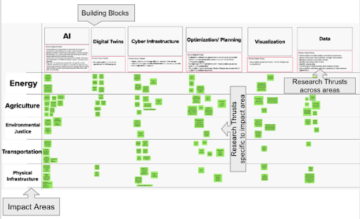

Dr. Moses ezután beszélt, és kontextusba helyezte, hogy az eGFR- és MHC-peptid-kötő algoritmusok hogyan illeszkednek egy nagyobb ökoszisztémába, amelyben az orvosi algoritmusok hogyan befolyásolják a társadalmi eredményeket. Elmagyarázza, hogy a tudósok algoritmusokat és mesterséges intelligenciát használnak arra, hogy előre jelezzék a számunkra fontos eredményeket a könnyen mérhető proxykon keresztül, és ezek a proxyk pontatlanok lehetnek. Az orvosi algoritmusok még bonyolultabbá tétele érdekében folyamatosan, előre nem látható módon kölcsönhatásba lépnek egymással, így a páciens diagnózisára szolgáló algoritmusok teljes terjedelme jellemzően nem világos. Ezért kulcsfontosságú, hogy óvatosan használjuk az algoritmusokat, különösen azért, mert ha az algoritmusok kudarcot vallanak, a leginkább károsak lehetnek a legsebezhetőbbekre.

Az orvosi méltányosság fontos része annak kiderítése, hogy egy algoritmus kit és miért érint. Dr. Moses hátrál egy lépést, és meghatározza a méltányosságot. A közös grafika A méltányosság és az egyenlőség megkülönböztetésére használt 3 különböző magasságú egyének küzdenek azért, hogy egy baseball-mérkőzést lássanak, és különböző módokon támogassák őket, még a 3. képben is hibás, amely eltávolítja az akadályt, mert azt sugallja, hogy van valami velejárója a személynek miért van szükségük a támogatásra, nem pedig a társadalmi okokra, amelyek az egyenlőtlenséget elsősorban okozhatták.

Dr. Moses egy alternatív grafikát mutatott be annak meghatározására, hogy hogyan néz ki a méltányosság egy rendszerszintű igazságtalanságokkal küzdő társadalomban (Copyright 2020, Nicolás E. Barceló és Sonya Shadravan (művész: Aria Ghalili)):

Ez az ábra azt mutatja, hogy nem mindenki profitálhat abból, hogy az akadályt eltávolítják, de vannak mélyen gyökerező problémák, amelyeket kezelni kell a méltányosság elérése érdekében.

A számítástechnikai tudósoknak mindig szem előtt kell tartaniuk ezt a fontos összefüggést, érvel Dr. Moses. Sokszor nehéz azonosítani azokat a feltételezéseket, amelyek az algoritmusok létrehozása során jelen voltak, még a legegyszerűbb algoritmusok esetén is. Könnyű statisztikai korrelációt is használni az eredmény előrejelzésére, és feltételezni, hogy a korreláció egyenlő oksággal, de ez tévedés.

Dr. Moses folytatja, konkrét példákat hozva az egyenlőtlen algoritmusokra, amelyek ma a társadalomban más területeken is használatosak. Például a büntető igazságszolgáltatási rendszer algoritmusai, amelyek a pénzbeli óvadékot helyettesítik az előzetes letartóztatáshoz. A cél az, hogy az eljárás egy adatvezérelt, elfogulatlan módszer legyen, hogy őrizetbe vegyék azokat, akik veszélyben vannak vagy nagy a kockázata annak, hogy nem jelennek meg a tárgyaláson. Az algoritmusoknak azonban számos hiányossága van mind az algoritmus tisztességes és pontos előrejelzéseinek képességében, mind a rendszer torzításaiban, amelynek az algoritmus része, beleértve a torzított bemeneteket és a kimenetek torzított értelmezéseit. Egy másik példa arra, hogy a faji elfogultságot hogyan tartják fenn az algoritmusok a büntető igazságszolgáltatásban, az arcfelismerő szoftver. Míg az arcfelismerés bizonyítottan a legkevésbé pontos a sötétebb bőrű női arcok azonosításában, ezek az algoritmusok leggyakrabban a fekete férfiarcokat azonosították félre, ami hamis letartóztatásokhoz vezetett. Ez azt mutatja be, hogy az elfogultság, amely leginkább érinti az egyik csoportot (fekete nők) a pontos besorolás szempontjából, hogyan lehet a legnagyobb hatással egy másik csoportra (fekete férfiakra) a büntető igazságszolgáltatási rendszer elfogultságai miatt.

Az algoritmusok súlyosbíthatják az emberi elfogultságot, és el is vethetők, ha nem erősítik meg azt az ítéletet, amelyet az algoritmus megkérdezése nélkül hozott volna meg. Ez igaz az orvostudomány elfogult algoritmusaira is. Például a pulzoximéterek kevésbé pontosak a sötétebb bőr oxigénszintjének kimutatására, ami a légúti betegségek, például a súlyos COVID aluldiagnosztizálását eredményezheti. Egy másik méltánytalan mérce az egészségügyre költött pénz mennyiségének felhasználása annak meghatározására, hogy valaki egészséges. A Dr. Eneanya és Dr. Singh által leírt példák, az afro-amerikaiak eGFR vese-kedvezményes vesekárosodása, valamint az európai ősöket felülreprezentáló genomiális adatkészletek más kiemelkedő példái az elfogult algoritmusoknak az orvostudományban, amelyek veszélyes következményekkel járnak az érintett emberek számára. Az eGFR egyenletet arra használták, hogy azonosítsák azokat a foglyokat, akik eléggé betegek ahhoz, hogy kiengedjék a börtönből a COVID során, ami azt eredményezte, hogy egy afroamerikai férfit nem engedtek szabadon, mert túlbecsülték a veseműködését.

A visszajelzés javíthatja az algoritmusokat, vagy súlyosbíthatja a károkat. Az algoritmusok nem egyirányúak, mivel célja az adatok viselkedésének előrejelzése, és az egy évre vonatkozó előrejelzés hatással van a következő évre. Az algoritmusoknak arra kell törekedniük, hogy idővel csökkentsék a torzításokat; például az óvadékról szóló tárgyalásoknak segíteniük kell a vádlottaknak a tárgyaláson való megjelenését, nem pedig a kudarcok előrejelzését; a rendõrségnek mind a bûnözés, mind a hamis letartóztatások számának csökkentésére kell törekednie. A tartományok között használt algoritmusokat soha nem szabad kőbe vésni, mert visszacsatolás lesz az emberek, az algoritmusok és a társadalmi kontextus között.

Dr. Moses további előrehaladási utakat is javasolt: távolítsa el az adathalmazokból a torzítást, kérdőjelezi meg a feltételezéseket, fordítsa meg (nem erősítse meg) a szisztémás torzítást, értékelje sokféle szempont alapján, átlátható és magyarázható algoritmusokat igényel, és fokozatos, adaptív telepítéseket használjon. Az általános felfogás az, hogy az algoritmusok valamilyen módon eltávolítják a torzítást, a valóságban azonban gyakran kódolják a torzítást, és óvakodnunk kell az algoritmusoktól és azok kimenetelétől.

A panel utolsó része a Q&A volt. Dr. Siek moderátor azzal indította az ülést, hogy megkérdezte: „Hogyan nem fokozhatják az algoritmusok és az adatok a károkat?”

- Dr. Eneanya: Ha egy kutató megáll a rassz mellett, amikor megkülönböztető elemeket keres egy algoritmusban, az lusta és tudományosan érvénytelen. Genetikailag az emberek jobban hasonlítanak a fajok között, mint belül. Sokkal fontosabb azokra a biológiai jellemzőkre gondolni, amelyek ténylegesen befolyásolják az emberi rendszert, például a veséket. Például a pulzoximéter tesztelésekor a kutatóknak konzultálniuk kellett volna egy bőrgyógyászral, hogy teszteljék és validálják a pulzoximétereket különböző bőrtónusok alapján – ahelyett, hogy egyfajta eszközt használnának különböző bőrtónusú emberek számára.

- Dr. Moses: Ugyanezt a megközelítést kell alkalmaznunk az algoritmusok érvényesítésére, miután használatba vették őket. A faj társadalmi konstrukcióként való felismerése lehetővé teszi, hogy észrevegyük a fajvak vizsgálatok hatását. Fontos különbséget keresni a csoportok között, hogy azonosítsuk azokat a lehetséges különbségeket, amelyeket az algoritmus megerősít. Fel kell mérni, hogy az algoritmus minimalizálja-e a problémákat, vagy javítja?

- Dr. Singh: A fajt soha nem szabad bemenetként használni, de felhasználható a kimenetek torzításának értékelésére. Ha nem gondolnánk a fajra, még azt sem mondhatnánk, hogy vannak egészségügyi különbségek. A genomikai adatok gyűjtése és a származás szerinti kategorizálás szintén hibás módszertan. Fel kell mérnünk, hogy a módszerek jól működnek-e a populációk között.

- Dr. Eneanya: Amikor diverzifikálunk egy vizsgálati populációt, el kell távolodnunk attól, hogy csak fehér vagy feketék csoportjait vonjuk be. Több különbséget kell megvizsgálnunk ezeken a csoportokon belül, például olyan tényezőket, mint a társadalmi státusz, a nem, a szexualitás stb. A teljes képet kell néznünk, nem csak a faji alapú sokszínűségi adatkészleteket.

- Dr. Moses: Az algoritmusok pontosan azok az eszközök, amelyeknek ebben segíteniük kell, sok lehetséges számítási stratégia segíthet.

- Dr. Singh: Egyetértek azzal, hogy az algoritmusok óriási szerepet játszanak itt, tehát hogyan rangsoroljuk az adatgyűjtést? Nagyon alaposan át kell gondolnunk, hogyan tesszük ezt.

A közönség egyik tagja ezt követően megkérdezte: „Tekintettel a jelenlegi torzításokkal rendelkező adatkészleteken alapuló algoritmusok fejlesztésére irányuló nagy rohanásra, van-e mód az algoritmus torzításának ellensúlyozására azon túl, hogy megszabadulunk az adathalmaz torzításaitól?”

- Dr. Singh: Nehéz leküzdeni az adathalmaz torzítását; ez egy aktív kutatási terület. Könnyen túl- vagy alul a mintaadatok. Az ML modellek betanításának különböző módjai vannak, ahol az átfogó cél (jellemzően egy olyan függvény, amelyet minimalizálni próbál, általában a teljes adatkészletet használva) az, hogy az optimalizálásnak hogyan kell kinéznie.

- Dr. Eneanya: Sok orvosi algoritmust úgy tekintenek, hogy pontosabban bele kell foglalni a fajt is. Azonban az embereknek kritikusan meg kell vizsgálniuk, hogy miért vezetik be a fajt? Előfordulhat, hogy a faj mint változó eltávolítása nem változtatja meg annyira az algoritmus teljesítményét, mint gondolná. Jelent valamit (klinikailag), ha az eredmények csak egy kicsit változnak egy változó, például a rassz eltávolítása után?

- Dr. Singh: Különösen nem jelent semmit, ha az edzéskészleted és a készleted, amelyen használod, nagyon különbözik.

Dr. Siek egy újabb kérdéssel késztette a panel résztvevőit: „Ha újra meg tudnánk csinálni, mit tennénk másképp?”

- Dr. Eneanya: Nem lett volna szabad abbahagyni a fajt, amikor az egészségügyi eredmények közötti különbségek okait értékeljük. Például a kreatininszinttel kapcsolatban el kell gondolkodnunk azon, hogy mi befolyásolhatja még a kreatinint? Jobb adatkészletekre van szükségünk, amihez a közösségekbe vetett bizalom kiépítése szükséges. Ez úgy tűnhet, mint a kísérleti populációk sokféleségének javítása, a vizsgálati személyzet kinézetének értékelése stb. Az Országos Egészségügyi Intézet ösztöndíjai egyre inkább közösségi alapú partnereket és egészségügyi méltányossági szakembereket igényelnek a kutatócsoport részeként. Változtatnunk kell a régi készleteken, de a jövőben jobb készleteket is kell készítenünk. Csak annyit tehetünk, ha megpróbáljuk újrakonfigurálni azt, ami odakint van.

- Dr. Moses: Azon túl, hogy mit tehetnénk, ha újrakezdenénk, szeretek az algoritmusokra a társadalom tükreként gondolni. Mindenki képzi őket az interneten. Ezt az algoritmus következő szintjének bemeneteként használva meghatározhatjuk, hol vannak a torzítások, miért vannak ott, és mi a jövőbeli hatás. Fel kell tennünk a kérdést, hogyan használjuk ezeket a mennyiségi eszközöket, hogy kitaláljuk, hogyan lehet ezeket a helyzeteket javítani, nem pedig súlyosbítani.

- Dr. Singh: Sok genom, amelyet összegyűjtöttek, nem reprezentálja a lakosságot. A különféle emberek bevonásával kell kezdenünk.

A közönség utolsó kérdése a következő volt: „Amíg el nem érjük azt a pontot, ahol teljes genomikai képünk lesz minden emberről, addig lelkesedni fogunk az ML és az algoritmusok használatáért. Mik azok a valós dolgok a szakértői értékelés szintjén, amelyeket most megtehetünk, hogy ne 30 év múlva kelljen megjavítanunk őket?”

- Dr. Eneanya: A tökéletes a jó ellensége. A tőlünk telhető legjobbat kell megtennünk. Felismerhetjük az elfogultságokat, majd megteszünk minden tőlünk telhetőt, hogy továbblépjünk. Vannak olyan akadályok, amelyeknek semmi közük a klinikai algoritmusokhoz. Csak az eGFR algoritmus javítása a fajtól való megszabadulással nem oldja meg a vesebetegségek közötti különbségeket. Sokat kell dolgozni az elnyomás többváltozós vonatkozásain.

- Dr. Mózes: Az Ön által végzett munka [Dr. Eneanya] mindent megtett az algoritmus újratervezéséért, hogy pontosan hogyan haladjunk előre. Javítanunk kell a rendszert. Azt is kihasználva, hogy javítani kellett; könnyű volt látni az egyenletbe írt torzítást. A veseegyenlet tükörként szolgál egy olyan társadalom számára, amely lehetővé tette a faj olyan kódolását, amely évtizedeken keresztül hátrányos helyzetbe hozta az afroamerikaiakat. Ebben az egyenletben az elfogultság kifejezett és szándékos volt. A jövőben sokkal nehezebb lesz a torzítás azonosítása bonyolultabb algoritmusokban.

Maradjon velünk az újabb AAAS 2023 CCC által támogatott panelösszefoglalóval!

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- Platoblockchain. Web3 metaverzum intelligencia. Felerősített tudás. Hozzáférés itt.

- Forrás: https://feeds.feedblitz.com/~/733934357/0/cccblog~Health-Equity-How-Can-Algorithms-and-Data-Mitigate-Not-Exacerbate-Harms-AAAS-Panel-Recap/

- :is

- $ UP

- 000

- 1

- 1999

- 2020

- 2021

- 2022

- 2023

- 7

- a

- képesség

- Képes

- Rólunk

- hozzáférés

- pontos

- Elérése

- szerez

- szerzett

- át

- aktív

- tulajdonképpen

- További

- Hozzáteszi

- Örökbefogadás

- előre

- támogatja

- érint

- afrikai

- Után

- Korosztály

- AI

- AL

- algoritmus

- algoritmikus

- algoritmusok

- Minden termék

- lehetővé teszi, hogy

- alternatív

- mindig

- Amerikai

- Amerikaiak

- között

- összeg

- elemzés

- anatómia

- és a

- Másik

- megjelenik

- alkalmazott

- megközelítés

- megközelít

- VANNAK

- TERÜLET

- területek

- azt állítja,

- terület

- letartóztatások

- cikkben

- művész

- AS

- szempontok

- társult

- feltevés

- At

- közönség

- szerző

- vissza

- bérlet

- Tilalom

- korlát

- akadályok

- Baseball

- alapján

- alap

- BE

- mert

- kezdődött

- hogy

- haszon

- Előnyök

- BEST

- Jobb

- között

- Túl

- előítélet

- kötődik

- kötés

- biológia

- Bit

- Fekete

- vér

- test

- Köteles

- Bringing

- épít

- Épület

- by

- számított

- kiszámítja

- TUD

- Rák

- Ráksejtek

- ami

- gondosan

- kategorizálása

- okozott

- okai

- ccc

- Cellák

- Centers

- bizonyos

- kihívások

- változik

- Változások

- változó

- jellemzők

- osztály

- besorolás

- osztályoz

- Klinikai

- klinikusok

- munkatársai

- Gyűjtő

- gyűjtemény

- érkező

- Közös

- Közösségek

- Közösségi alapú

- összehasonlítani

- képest

- teljes

- bonyolult

- bonyolult

- számítástechnika

- Következmények

- Fontolja

- állandóan

- konstrukció

- tanácsadó

- kontextus

- tovább

- tovább

- ellenőrzés

- Beszélgetés

- copyright

- Összefüggés

- tudott

- Covidien

- teremtés

- Bűncselekmény

- Bűnügyi

- kritikus

- döntően

- gyógyít

- Jelenlegi

- Jelenleg

- VESZÉLY

- Veszélyes

- dátum

- adatkészlet

- adatkészletek

- adatkészletek

- évtizedek

- döntés

- csökkenés

- mély

- vádlottak

- Annak meghatározása,

- Kereslet

- mutatja

- bevetések

- leírt

- Design

- fogva tartás

- meghatározás

- Határozzuk meg

- meghatározza

- pusztító

- Fejleszt

- fejlett

- fejlesztése

- Fejlesztés

- eszköz

- Cukorbetegség

- különbségek

- különböző

- különbséget

- nehéz

- közvetlenül

- kedvezményes

- tárgyalt

- megbeszélése

- betegség

- betegségek

- számos

- Sokféleség

- dna

- Orvos

- Nem

- domainek

- ne

- le-

- hajtott

- alatt

- e

- minden

- könnyen

- eszik

- ökoszisztéma

- hatások

- kidolgozott

- választható

- megszüntetése

- elég

- lépett

- lelkesedés

- környezeti

- egyenlőség

- Egyenlő

- egyenletek

- részvény

- különösen

- alapvető

- becslés

- stb.

- európai

- értékelni

- értékelő

- Még

- mindenki

- pontosan

- példa

- példák

- példázza

- létező

- tapasztalat

- magyarázható

- magyarázó

- Elmagyarázza

- Arc

- arcok

- arc

- arcfelismerő

- tényezők

- FAIL

- Sikertelen

- Kudarc

- igazságos

- hamisítvány

- hamis hírek

- kedvez

- Szövetségi

- Szövetségi kormány

- Visszacsatolás

- női

- kevés

- Ábra

- utolsó

- vezetéknév

- megfelelő

- Rögzít

- rögzített

- hibás

- Összpontosít

- összpontosítás

- A

- Előre

- ból ből

- Tele

- funkció

- további

- Továbbá

- jövő

- játék

- nem

- kap

- szerzés

- Ad

- Giving

- földgolyó

- cél

- megy

- jó

- jó munkát

- Kormány

- fokozatos

- támogatások

- Grafikus

- legnagyobb

- Csoport

- Csoportok

- Nő

- történt

- Kemény

- káros

- ártalmak

- hám

- Legyen

- Egészség

- egészségügyi támogatások

- egészségügyi

- egészséges

- Magasság

- segít

- itt

- magas kockázatú

- <p></p>

- legnagyobb

- Kiemelt

- nagyon

- történelmileg

- történelem

- remélhetőleg

- kórházak

- Hogyan

- How To

- azonban

- HTTPS

- hatalmas

- emberi

- Az emberek

- Magas vérnyomás

- i

- azonosított

- azonosítja

- azonosítani

- azonosító

- kép

- Immunrendszer

- immunterápia

- Hatás

- befolyásolta

- Hatások

- értékvesztés

- fontos

- javul

- javuló

- in

- Más

- pontatlan

- tartalmaz

- Beleértve

- Bejegyzett

- Növelje

- <p></p>

- egyre inkább

- hihetetlenül

- egyéni

- egyének

- velejáró

- bemenet

- példa

- Intézet

- A szándék

- kölcsönható

- Internet

- megfélemlítő

- Bevezetett

- részt

- bevonása

- kérdések

- IT

- január

- Munka

- bíró

- Igazság

- Tart

- Kulcs

- vese

- nagy

- nagyobb

- vezet

- vezető

- tanulás

- Maradék

- szint

- szintek

- életmód

- mint

- Valószínű

- LIMIT

- korlátozások

- határértékek

- Listázott

- néz

- hasonló

- keres

- MEGJELENÉS

- Sok

- gép

- gépi tanulás

- készült

- fontos

- csinál

- Gyártás

- férfi

- mód

- sok

- Tömeg

- max-width

- eszközök

- intézkedés

- intézkedések

- Média

- orvosi

- egészségügyi ellátás

- orvostudomány

- tag

- Férfi

- módszer

- Módszertan

- mód

- Mexikó

- esetleg

- bánja

- minimalizálása

- tükör

- Enyhít

- vegyes

- ML

- modellek

- módosítása

- molekuláris

- Pénzügyi

- pénz

- több

- a legtöbb

- mozog

- menj tovább

- mozgó

- nemzeti

- Természet

- Szükség

- igénylő

- igények

- hálózat

- Új

- hír

- következő

- normális

- nevezetesen

- of

- gyakorta

- Régi

- on

- ONE

- Lehetőségek

- Alkalom

- optimalizálás

- érdekében

- Szervezett

- eredeti

- Más

- Eredmény

- vázolt

- átfogó

- Overcome

- saját

- Oxigén

- panel

- rész

- partnerek

- múlt

- beteg

- betegek

- egyenrangú

- Emberek (People)

- észlelés

- tökéletes

- teljesítmény

- Előadja

- talán

- person

- személyes

- Személyre

- perspektívák

- kép

- Hely

- Plató

- Platón adatintelligencia

- PlatoData

- játszani

- pont

- Politikák

- rendfenntartás

- szegény

- népesség

- populációk

- potenciális

- pontos

- pontosan

- Pontosság

- előre

- előrejelzés

- Tippek

- be

- uralkodó

- előző

- Előzetes

- Fontossági sorrendet

- börtön

- foglyok

- problémák

- eljárások

- folyamat

- Folyamatok

- tehetséges alkalmazottal

- kiemelkedő

- ígéret

- biztató

- javasolt

- Fehérje

- Fehérjék

- meghatalmazott

- impulzus

- tesz

- Kérdések és válaszok

- mennyiségi

- kérdés

- Futam

- faji elfogultság

- rasszizmus

- Az árak

- Inkább

- igazi

- való Világ

- Valóság

- miatt

- újrafutóz

- kap

- új

- elismerés

- elismert

- nyilvántartások

- csökkenteni

- iktató hivatal

- megerősítése

- engedje

- felszabaduló

- eltávolítása

- eltávolított

- eltávolítása

- cserélni

- képvisel

- jelentése

- kötelező

- megköveteli,

- kutatás

- kutató

- kutatók

- válasz

- újraindítása

- korlátozott

- eredményez

- Eredmények

- mutatják

- felfedi

- fordított

- Kritika

- megszabadít

- Kockázat

- kockázati tényezők

- Szerep

- rohanás

- azonos

- Iskola

- tudományos

- Tudós

- tudósok

- lát

- Sorozat

- Szérum

- szolgálja

- ülés

- készlet

- Szettek

- szigorú

- megosztás

- kellene

- előadás

- mutatott

- Műsorok

- jelentősen

- hasonló

- helyzetek

- Bőr

- So

- Közösség

- Társadalom

- szoftver

- SOLVE

- néhány

- Valaki

- valami

- szakemberek

- meghatározott

- költött

- Személyzet

- kezdet

- Kezdve

- Államok

- statisztikai

- Állapot

- Lépés

- STONE

- megállítás

- egyértelmű

- stratégiák

- utca

- feszültség

- erős

- szerkezeti

- küzd

- tanulmányok

- Tanulmány

- tárgy

- ilyen

- javasolja,

- felettes

- támogatás

- rendszer

- szisztémás

- Systems

- Vesz

- tart

- cél

- célzott

- csapat

- feltételek

- teszt

- Tesztelés

- hogy

- A

- A jövő

- azok

- Őket

- ebből adódóan

- Ezek

- dolgok

- ezer

- idő

- nak nek

- Ma

- is

- szerszámok

- téma

- Vonat

- kiképzett

- Képzések

- átlátszó

- kezelés

- próba

- igaz

- Bízzon

- típusok

- jellemzően

- Végül

- feltárni

- alatt

- alátámasztások

- megért

- Egyesült

- Egyesült Államok

- Egyetemes

- egyetemi

- kiszámíthatatlan

- us

- Használat

- használ

- rendszerint

- ÉRVÉNYESÍT

- fajta

- Ellen

- Sebezhető

- Út..

- módon

- JÓL

- Mit

- Mi

- ami

- míg

- fehér

- WHO

- egész

- lesz

- val vel

- belül

- nélkül

- Női

- Munka

- művek

- lenne

- írott

- év

- te

- fiatalabb

- A te

- zephyrnet