Hari ini, kami mengumumkan ketersediaan publik Amazon yang canggih Model Guru Alexa dengan 20 miliar parameter (AlexaTM 20B) melalui Mulai Lompatan Amazon SageMaker, pusat pembelajaran mesin SageMaker. AlexaTM 20B adalah model bahasa sequence-to-sequence (seq2seq) skala besar multibahasa yang dikembangkan oleh Amazon. Anda dapat menggunakan AlexaTM 20B untuk berbagai kasus penggunaan industri, mulai dari meringkas laporan keuangan hingga menjawab pertanyaan untuk chatbot layanan pelanggan. Itu dapat diterapkan bahkan ketika hanya ada sedikit contoh pelatihan yang tersedia, atau bahkan tidak ada sama sekali. AlexaTM 20B mengungguli 175 miliar Model GPT-3 pada tugas pembelajaran zero-shot seperti SuperGLUE dan menunjukkan performa canggih untuk tugas zero-shot multibahasa seperti XNLI.

Dalam postingan ini, kami memberikan ikhtisar tentang cara menerapkan dan menjalankan inferensi dengan model AlexaTM 20B secara terprogram melalui JumpStart API, tersedia di SDK Python SageMaker. Kami mencontohkan bagaimana Anda dapat menggunakan model ini untuk menerjemahkan antara beberapa bahasa, meringkas teks bentuk panjang, menjawab pertanyaan berdasarkan konteks tertentu, dan menghasilkan teks yang tampaknya tidak dapat dibedakan dari teks tulisan manusia.

AlexaTM 20B dan pembelajaran dalam konteks

Program Alexa Teacher Model (AlexaTM) oleh Amazon Alexa AI dirancang untuk membangun model pembelajaran mendalam multibahasa skala besar (terutama berbasis Transformer), yang bertujuan untuk meningkatkan generalisasi dan menangani kelangkaan data untuk tugas hilir. Dengan pra-pelatihan skala besar, model guru dapat menggeneralisasi dengan baik untuk mempelajari tugas baru dari data yang jarang dan membantu pengembang meningkatkan kinerja pada tugas hilir. AlexaTM 20B telah menunjukkan kinerja kompetitif pada tolok ukur dan tugas pemrosesan bahasa alami (NLP) umum, seperti terjemahan mesin, pembuatan data, dan peringkasan.

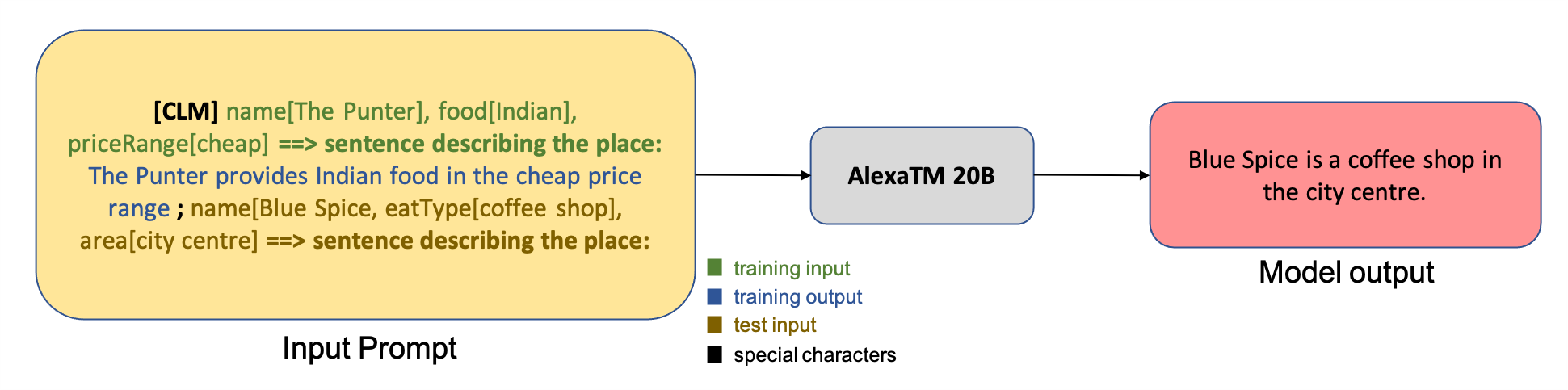

Menggunakan model dasar seperti AlexaTM 20B mengurangi kebutuhan pra-pelatihan model yang mahal dan memberikan titik awal yang canggih untuk mengembangkan model tugas dengan lebih sedikit usaha dan lebih sedikit data pelatihan khusus tugas. Salah satu kemampuan utama model dasar adalah kita dapat mengajarkan model untuk melakukan tugas-tugas baru seperti pertanyaan dan jawaban dalam bahasa yang berbeda, dengan jumlah contoh input yang sangat sedikit dan tidak diperlukan penyempurnaan atau pembaruan gradien. Ini dikenal sebagai pembelajaran dalam konteks. Dengan hanya beberapa contoh tugas baru yang disediakan sebagai konteks untuk inferensi, model AlexaTM 20B dapat mentransfer pengetahuan dari apa yang telah dipelajari selama pra-pelatihan berskala besar, bahkan lintas bahasa. Ini disebut pembelajaran dengan beberapa pukulan. Dalam beberapa kasus, model dapat bekerja dengan baik tanpa data pelatihan sama sekali, hanya dengan penjelasan tentang apa yang harus diprediksi. Ini disebut pembelajaran zero-shot. Sebagai contoh, katakanlah kita menggunakan AlexaTM 20B untuk pembuatan bahasa alami sekali pakai. Input yang diteruskan ke model adalah contoh pelatihan dalam bentuk pasangan atribut-nilai, beserta output teks naratif yang sesuai. Contoh pengujian kemudian ditambahkan untuk membentuk perintah input lengkap, seperti yang ditunjukkan pada gambar berikut.

Untuk mempelajari lebih lanjut tentang model, lihat Model Alexa parameter 20B menetapkan nilai baru dalam pembelajaran beberapa langkah atau asli kertas.

Penggunaan AlexaTM 20B tersedia untuk penggunaan non-komersial dan tercakup dalam Perjanjian Lisensi Model Guru Alexa.

Ikhtisar solusi

Bagian berikut menyediakan demo langkah demi langkah tentang cara menerapkan model, menjalankan inferensi, dan melakukan pembelajaran dalam konteks untuk menyelesaikan beberapa tugas pembelajaran.

Perhatikan bahwa bagian berikut berisi cuplikan kode; kode lengkap dengan semua langkah dalam demo ini tersedia di notebook terlampir: Pembelajaran dalam konteks dengan AlexaTM 20B di SageMaker JumpStart.

Menyebarkan model

Untuk menggunakan model bahasa besar di SageMaker, Anda memerlukan skrip inferensi khusus untuk model tersebut, yang mencakup langkah-langkah seperti pemuatan model, paralelisasi, dan lainnya. Anda juga perlu membuat pengujian end-to-end untuk skrip, model, dan jenis instans yang diinginkan untuk memvalidasi bahwa ketiganya dapat bekerja bersama. JumpStart menghilangkan upaya ini dengan menyediakan skrip siap pakai yang telah diuji dengan kuat.

SageMaker memberi Anda kemampuan untuk menjalankan kontainer Docker secara ekstensif untuk pelatihan dan inferensi. JumpStart menggunakan framework-spesifik yang tersedia ini Wadah Pembelajaran Mendalam SageMaker (DLC). Kami mulai dengan mengambil DLC yang dioptimalkan (deploy_image_uri) menggunakan model_id. Kemudian kami mengambil model_uri berisi parameter model, bersama dengan skrip penanganan inferensi dan semua dependensi terkait. Selanjutnya, kita membuat contoh model di SageMaker dan menerapkannya ke titik akhir waktu nyata. Lihat kode berikut:

Menerapkan AlexaTM 20B memerlukan instans yang didukung GPU dengan setidaknya 50 GB memori CPU dan setidaknya 42 GB memori GPU. SageMaker menyediakan banyak contoh yang mendukung inferensi real-time. Kami menguji solusi ini pada tiga contoh: ml.g4dn.12xlarge, ml.p3.8xlarge, ml.p3.16xlarge. Lihat kode berikut:

Selanjutnya, kami menerapkan model ke titik akhir waktu-nyata SageMaker:

AlexaTM 20B membutuhkan 40 GB ruang disk dalam wadah inferensi. Instance ml.g4dn.12xlarge memenuhi persyaratan ini. Misal tipe ml.p3.8xlarge dan ml.p3.16xlarge kami lampirkan an Toko Blok Elastis Amazon (Amazon EBS) volume untuk menangani ukuran model yang besar. Oleh karena itu, kami menetapkan volume_size = None saat men-deploy di ml.g4dn.12xlarge dan volume_size=256 saat men-deploy di ml.p3.8xlarge atau ml.p3.16xlarge.

Menerapkan model dapat memakan waktu hingga 10 menit. Setelah model di-deploy, kita bisa mendapatkan prediksi darinya secara real time!

Jalankan inferensi

AlexaTM 20B adalah model pembuatan teks yang, dengan urutan parsial (kalimat atau potongan teks), menghasilkan rangkaian kata berikutnya. Cuplikan kode berikut memberi Anda gambaran sekilas tentang cara mengkueri titik akhir yang kami terapkan dan mengurai output untuk tugas penyelesaian otomatis. Untuk mengirim permintaan ke model yang diterapkan, kami menggunakan kamus JSON yang dikodekan dalam format UTF-8. Respons titik akhir adalah objek JSON yang berisi daftar teks yang dihasilkan.

Selanjutnya, kami mengkueri titik akhir dan mem-parsing respons pada contoh teks masukan:

AlexaTM 20B saat ini mendukung 10 parameter pembuatan teks selama inferensi: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_p, dan seed. Untuk informasi mendetail tentang nilai yang valid untuk setiap parameter dan pengaruhnya terhadap keluaran, lihat buku catatan terlampir: Pembelajaran dalam konteks dengan AlexaTM 20B di SageMaker JumpStart.

Pembelajaran dalam konteks

Pembelajaran dalam konteks mengacu pada hal-hal berikut: kami menyediakan model bahasa dengan prompt, yang terdiri dari pasangan masukan-keluaran pelatihan yang mendemonstrasikan tugas. Kami menambahkan input pengujian ke prompt dan mengizinkan model bahasa membuat prediksi dengan mengkondisikan prompt dan memprediksi token atau kata berikutnya. Ini adalah teknik yang sangat efektif untuk menyelesaikan beberapa masalah pembelajaran tembakan, di mana kami mempelajari tugas dari beberapa sampel pelatihan.

Selanjutnya, kami menunjukkan bagaimana Anda dapat menggunakan AlexaTM 20B untuk beberapa tugas 1-shot dan zero-shot melalui pembelajaran dalam konteks. Tidak seperti model urutan-ke-urutan sebelumnya, AlexaTM 20B dilatih tentang pemodelan bahasa kausal selain denoising, yang menjadikannya model yang bagus untuk pembelajaran dalam konteks.

Peringkasan teks 1-shot

Peringkasan teks adalah tugas memperpendek data dan membuat ringkasan yang mewakili informasi terpenting yang ada dalam teks asli. Peringkasan teks 1-shot mengacu pada pengaturan tempat kita belajar meringkas teks berdasarkan satu sampel pelatihan. Kode berikut adalah contoh peringkasan teks dari kumpulan data XSUM:

Kami menggunakan prompt berikut untuk meringkas ketika hanya satu sampel pelatihan yang disediakan. Teks yang dihasilkan dari model diinterpretasikan sebagai prediksi ringkasan artikel uji.

Outputnya adalah sebagai berikut:

Generasi bahasa alami 1-shot

Natural language generation adalah tugas memproduksi teks naratif yang diberikan input teks. Contoh berikut menunjukkan contoh pelatihan dari kumpulan data E2E:

Kami menggunakan permintaan berikut untuk pembuatan bahasa alami ketika hanya satu sampel pelatihan (1-shot) disediakan. Teks yang dihasilkan dari model diinterpretasikan sebagai prediksi teks naratif untuk input tes (test_inp).

Outputnya adalah sebagai berikut:

Terjemahan mesin 1-shot

Terjemahan mesin adalah tugas menerjemahkan teks dari satu bahasa ke bahasa lain. Contoh berikut menunjukkan contoh pelatihan dari kumpulan data WMT19 di mana kita perlu menerjemahkan dari bahasa Jerman ke bahasa Inggris:

Kami menggunakan prompt berikut untuk terjemahan mesin ketika hanya satu sampel pelatihan (1-shot) disediakan. Teks yang dihasilkan dari model ditafsirkan sebagai terjemahan dari input tes (test_inp).

Outputnya adalah sebagai berikut:

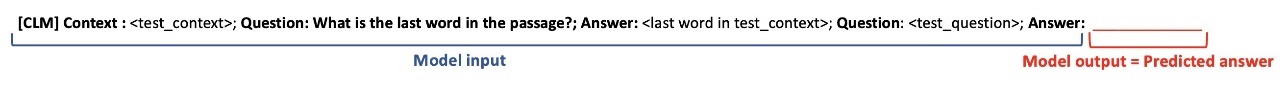

Menjawab pertanyaan ekstraktif zero-shot

Menjawab pertanyaan ekstraktif adalah tugas menemukan jawaban atas pertanyaan dari paragraf konteks. Berikut ini adalah contoh konteks dan pertanyaan dari Kumpulan data SQuAD v2:

Perhatikan bahwa kami tidak memiliki sampel pelatihan untuk tugas kami. Sebagai gantinya, kami membuat pertanyaan tiruan tentang kata terakhir di prompt , berdasarkan pada test_context (dummy-tembakan). Oleh karena itu, kami benar-benar melakukan penjawaban pertanyaan ekstraktif zero-shot.

Kami menggunakan petunjuk berikut untuk menjawab pertanyaan ekstraktif saat tidak ada sampel pelatihan yang diberikan. Generate text dari model diinterpretasikan sebagai jawaban dari soal tes.

Outputnya adalah sebagai berikut:

Rekayasa Cepat

Rekayasa cepat terkadang bisa menjadi seni. Bahkan perubahan kecil pada template perintah dapat mengakibatkan perubahan signifikan pada performa model pada tugas tertentu. Berikut ini adalah beberapa saran untuk menulis template prompt yang baik. Pertama, penting untuk diingat bahwa model dilatih untuk mempelajari struktur kalimat nyata (causal language modeling). Karena itu, yang terbaik adalah memastikan bahwa templat perintah Anda benar secara tata bahasa dan struktur dalam bahasa alami. Kedua, model khusus ini mendapat manfaat dari bidikan boneka untuk membantu mengajarkannya struktur yang diharapkan dalam jawaban, seperti yang ditunjukkan di atas. Ketiga, selalu disarankan untuk memeriksa kinerja tugas melalui berbagai templat prompt kandidat. Sumber Prompt dan Instruksi Alami adalah dua kerangka kerja open-source untuk menstandarkan template prompt, dan mereka menyediakan berbagai contoh prompt yang digunakan untuk tugas pemodelan yang ada. Selain itu, Lampiran B dari Kertas AlexaTM 20B menyediakan prompt template yang digunakan untuk menghasilkan hasil yang disajikan di kertas. Ada sub-bidang berkembang yang didedikasikan untuk pembuatan dan pembelajaran otomatis petunjuk terbaik untuk suatu tugas, termasuk bahasa alami dan petunjuk berkelanjutan. Ini di luar cakupan tutorial ini.

Kesimpulan

Dalam postingan ini, kami menunjukkan cara menerapkan model AlexaTM 20B pada titik akhir SageMaker dan menjalankan inferensi. Anda dapat menggunakan model AlexaTM 20B untuk pembelajaran dalam konteks untuk berbagai tugas pembelajaran beberapa langkah. Untuk mempelajari lebih lanjut tentang AlexaTM 20B, lihat Model Alexa parameter 20B menetapkan nilai baru dalam pembelajaran beberapa langkah atau asli kertas.

Penulis ingin mengucapkan terima kasih atas kontribusi teknis dari Maciej Rudnicki, Jakub Debski, Ashish Khetan, Anastasiia Dubinina, Vitaliy Korolev, Karl Albertsen, Saleh Soltan, dan Mariusz Momotko untuk memungkinkan peluncuran ini.

Tentang JumpStart

JumpStart adalah pusat pembelajaran mesin (ML) dari Amazon SageMaker yang menawarkan lebih dari 350 model terlatih, algoritme bawaan, dan templat solusi bawaan untuk membantu Anda memulai ML dengan cepat. JumpStart menghosting model canggih dari hub model populer seperti TensorFlow, PyTorch, Hugging Face, dan MXNet, yang mendukung tugas ML populer seperti deteksi objek, klasifikasi teks, dan pembuatan teks. Komunitas riset ML telah berupaya keras untuk membuat sebagian besar model yang dikembangkan baru-baru ini tersedia untuk umum. JumpStart bertujuan untuk membantu Anda menemukan model dan algoritme ML yang tepat, dan segera mulai membuat model. Secara khusus, JumpStart memberikan keuntungan sebagai berikut:

- Akses mudah dengan UI dan SDK – Anda dapat mengakses model dan algoritme di JumpStart secara terprogram menggunakan SageMaker Python SDK atau melalui UI JumpStart di Amazon SageMaker Studio. Saat ini, AlexaTM 20B hanya dapat diakses melalui SageMaker Python SDK.

- Algoritme bawaan SageMaker – JumpStart menyediakan lebih dari 350 algoritme bawaan dan model terlatih, beserta skrip pelatihan terkait (jika didukung), skrip inferensi, dan buku catatan contoh. Skrip dioptimalkan untuk setiap kerangka kerja dan tugas, dan menyediakan fitur seperti dukungan GPU, penyetelan model otomatis, dan pelatihan tambahan. Skrip juga diuji terhadap instans dan fitur SageMaker sehingga Anda tidak mengalami masalah kompatibilitas.

- Solusi siap pakai – JumpStart menyediakan 23 solusi untuk kasus penggunaan ML umum, seperti perkiraan permintaan dan aplikasi industri dan keuangan, yang dapat Anda terapkan hanya dengan beberapa klik. Solusi adalah aplikasi ML end-to-end yang menyatukan berbagai layanan AWS untuk menyelesaikan kasus penggunaan bisnis tertentu. Mereka menggunakan template AWS CloudFormation dan arsitektur referensi untuk penerapan cepat, yang berarti dapat disesuaikan sepenuhnya.

- Dukungan – SageMaker menyediakan berbagai dukungan, seperti mempertahankan versi terbaru saat fitur SageMaker baru atau versi Wadah Pembelajaran Jauh dirilis, dan membuat dokumentasi tentang cara menggunakan konten JumpStart di lingkungan SageMaker.

Untuk mempelajari lebih lanjut tentang JumpStart dan bagaimana Anda dapat menggunakan model terlatih sumber terbuka untuk berbagai tugas ML lainnya, lihat yang berikut ini Video AWS re:Invent 2020.

Tentang Penulis

Dr Vivek Madan adalah Ilmuwan Terapan dengan tim JumpStart Amazon SageMaker. Dia mendapatkan gelar PhD dari University of Illinois di Urbana-Champaign dan merupakan Peneliti Pasca Doktoral di Georgia Tech. Dia adalah peneliti aktif dalam pembelajaran mesin dan desain algoritma dan telah menerbitkan makalah di konferensi EMNLP, ICLR, COLT, FOCS, dan SODA.

Dr Vivek Madan adalah Ilmuwan Terapan dengan tim JumpStart Amazon SageMaker. Dia mendapatkan gelar PhD dari University of Illinois di Urbana-Champaign dan merupakan Peneliti Pasca Doktoral di Georgia Tech. Dia adalah peneliti aktif dalam pembelajaran mesin dan desain algoritma dan telah menerbitkan makalah di konferensi EMNLP, ICLR, COLT, FOCS, dan SODA.

Jack FitzGerald adalah ilmuwan terapan senior di Alexa AI, di mana dia saat ini berfokus pada pemodelan bahasa besar, pemodelan teks multibahasa, dan operasi pembelajaran mesin.

Jack FitzGerald adalah ilmuwan terapan senior di Alexa AI, di mana dia saat ini berfokus pada pemodelan bahasa besar, pemodelan teks multibahasa, dan operasi pembelajaran mesin.

João Moura adalah Arsitek Solusi Spesialis AI/ML di Amazon Web Services. Dia sebagian besar berfokus pada kasus penggunaan NLP dan membantu pelanggan mengoptimalkan pelatihan dan penerapan model pembelajaran mendalam. Dia juga merupakan pendukung aktif solusi ML kode rendah dan perangkat keras khusus ML.

João Moura adalah Arsitek Solusi Spesialis AI/ML di Amazon Web Services. Dia sebagian besar berfokus pada kasus penggunaan NLP dan membantu pelanggan mengoptimalkan pelatihan dan penerapan model pembelajaran mendalam. Dia juga merupakan pendukung aktif solusi ML kode rendah dan perangkat keras khusus ML.

Juni Won adalah manajer produk dengan SageMaker JumpStart dan Algoritma Bawaan. Dia berfokus untuk membuat konten ML mudah ditemukan dan digunakan oleh pelanggan SageMaker.

Juni Won adalah manajer produk dengan SageMaker JumpStart dan Algoritma Bawaan. Dia berfokus untuk membuat konten ML mudah ditemukan dan digunakan oleh pelanggan SageMaker.

Pulkit Kapur adalah pemimpin produk untuk program Model Guru Alexa dengan Alexa AI, berfokus pada kecerdasan umum dan penerapan model fondasi multimodal multitugas Alexa.

Pulkit Kapur adalah pemimpin produk untuk program Model Guru Alexa dengan Alexa AI, berfokus pada kecerdasan umum dan penerapan model fondasi multimodal multitugas Alexa.

- AI

- ai seni

- generator seni ai

- punya robot

- Amazon SageMaker

- Mulai Lompatan Amazon SageMaker

- kecerdasan buatan

- sertifikasi kecerdasan buatan

- kecerdasan buatan dalam perbankan

- robot kecerdasan buatan

- robot kecerdasan buatan

- perangkat lunak kecerdasan buatan

- Pembelajaran Mesin AWS

- blockchain

- konferensi blockchain

- kecerdasan

- kecerdasan buatan percakapan

- konferensi kripto

- dall's

- belajar mendalam

- Dasar (100)

- google itu

- Mesin belajar

- plato

- plato ai

- Kecerdasan Data Plato

- Permainan Plato

- Data Plato

- permainan plato

- skala ai

- sintaksis

- zephyrnet.dll