Untuk berbagi keajaiban DALL E 2 dengan khalayak luas, kami perlu mengurangi risiko yang terkait dengan model pembuatan gambar yang kuat. Untuk tujuan ini, kami menempatkan berbagai pagar pembatas di tempat untuk mencegah gambar yang dihasilkan melanggar kebijakan konten. Posting ini berfokus pada mitigasi pra-pelatihan, bagian dari pagar pembatas ini yang secara langsung memodifikasi data yang dipelajari DALL·E 2. Secara khusus, DALL·E 2 dilatih tentang ratusan juta gambar yang diberi teks dari internet, dan kami menghapus dan menimbang ulang beberapa gambar ini untuk mengubah apa yang dipelajari model.

Pos ini disusun dalam tiga bagian, masing-masing menjelaskan mitigasi pra-pelatihan yang berbeda:

- Di bagian pertama, kami menjelaskan bagaimana kami memfilter gambar kekerasan dan seksual dari set data pelatihan DALL·E 2. Tanpa mitigasi ini, model akan belajar menghasilkan gambar grafis atau eksplisit saat diminta, dan bahkan mungkin mengembalikan gambar tersebut secara tidak sengaja sebagai respons terhadap perintah yang tampaknya tidak berbahaya.

- Di bagian kedua, kami menemukan bahwa memfilter data pelatihan dapat memperkuat bias, dan menjelaskan teknik kami untuk mengurangi efek ini. Misalnya, tanpa mitigasi ini, kami melihat bahwa model yang dilatih pada data yang difilter terkadang menghasilkan lebih banyak gambar yang menggambarkan pria dan lebih sedikit gambar yang menggambarkan wanita dibandingkan dengan model yang dilatih pada kumpulan data asli.

- Di bagian terakhir, kita beralih ke masalah menghafal, menemukan bahwa model seperti DALL·E 2 terkadang dapat mereproduksi gambar yang dilatihnya daripada membuat gambar baru. Dalam praktiknya, kami menemukan bahwa ini regurgitasi gambar disebabkan oleh gambar yang direplikasi berkali-kali dalam kumpulan data, dan mitigasi masalah dengan menghapus gambar yang secara visual mirip dengan gambar lain dalam kumpulan data.

Mengurangi Data Pelatihan Grafis dan Eksplisit

Karena data pelatihan membentuk kemampuan model yang dipelajari, pemfilteran data adalah alat yang ampuh untuk membatasi kemampuan model yang tidak diinginkan. Kami menerapkan pendekatan ini pada dua kategori—gambar yang menggambarkan kekerasan grafis dan konten seksual—dengan menggunakan pengklasifikasi untuk memfilter gambar dalam kategori ini dari kumpulan data sebelum melatih DALL·E 2. Kami melatih pengklasifikasi gambar ini secara internal dan terus mempelajari efek pemfilteran kumpulan data pada model terlatih kami.

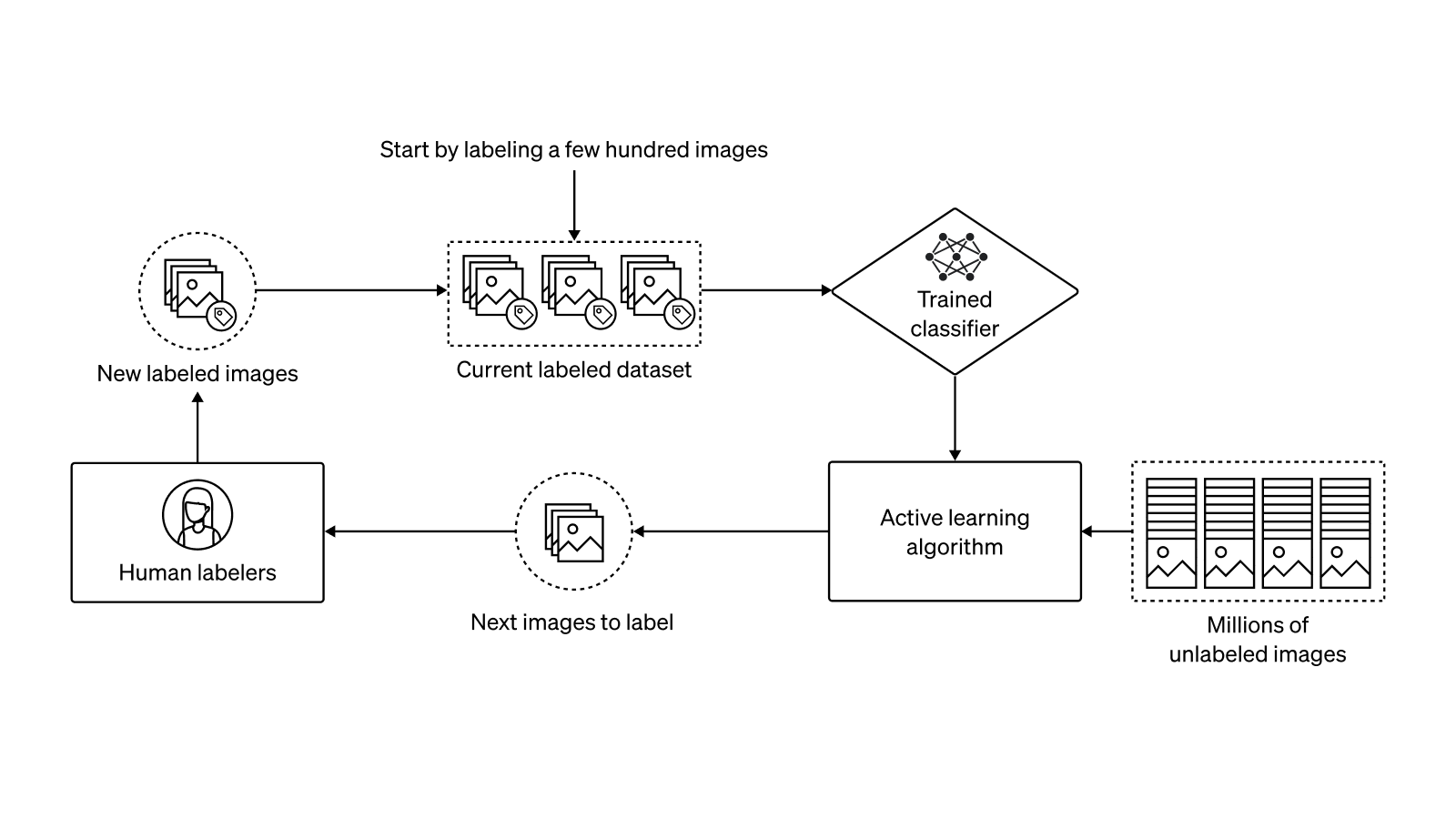

Untuk melatih pengklasifikasi gambar kami, kami menggunakan kembali pendekatan yang sebelumnya kami gunakan untuk memfilter data pelatihan untuk MELUNCUR. Langkah-langkah dasar untuk pendekatan ini adalah sebagai berikut: pertama, kita membuat spesifikasi untuk kategori gambar yang ingin kita beri label; kedua, kami mengumpulkan beberapa ratus contoh positif dan negatif untuk setiap kategori; ketiga, kami menggunakan prosedur pembelajaran aktif untuk mengumpulkan lebih banyak data dan meningkatkan presisi/recall trade-off; dan akhirnya, kami menjalankan pengklasifikasi yang dihasilkan pada seluruh dataset dengan ambang klasifikasi konservatif untuk mendukung penarikan daripada presisi. Untuk menetapkan ambang batas ini, kami memprioritaskan memfilter semua buruk data selama meninggalkan di semua baik data. Ini karena kita selalu dapat menyempurnakan model kita dengan lebih banyak data nanti untuk mengajarkannya hal-hal baru, tetapi jauh lebih sulit untuk membuat model melupakan sesuatu yang telah dipelajarinya.

Selama fase pembelajaran aktif, kami secara berulang meningkatkan pengklasifikasi kami dengan mengumpulkan label manusia untuk gambar yang berpotensi sulit atau salah diklasifikasikan. Khususnya, kami menggunakan dua teknik pembelajaran aktif untuk memilih gambar dari kumpulan data kami (yang berisi ratusan juta gambar tanpa label) untuk disajikan kepada manusia untuk diberi label. Pertama, untuk mengurangi tingkat positif palsu pengklasifikasi kami (yaitu, frekuensi yang salah mengklasifikasikan gambar jinak sebagai kekerasan atau seksual), kami menetapkan label manusia untuk gambar yang model saat ini diklasifikasikan sebagai positif. Agar langkah ini bekerja dengan baik, kami menyetel ambang klasifikasi kami untuk penarikan hampir 100% tetapi tingkat positif palsu yang tinggi; dengan cara ini, pemberi label kami kebanyakan melabeli kasus yang benar-benar negatif. Meskipun teknik ini membantu mengurangi positif palsu dan mengurangi kebutuhan pemberi label untuk melihat gambar yang berpotensi berbahaya, teknik ini tidak membantu menemukan lebih banyak kasus positif yang saat ini hilang dari model.

Untuk mengurangi tingkat negatif palsu pengklasifikasi kami, kami menggunakan teknik pembelajaran aktif kedua: pencarian tetangga terdekat. Secara khusus, kami menjalankan validasi silang berlipat ganda untuk menemukan sampel positif dalam kumpulan data berlabel kami saat ini yang cenderung salah diklasifikasikan oleh model sebagai negatif (untuk melakukan ini, kami benar-benar melatih ratusan versi pengklasifikasi dengan pemisahan validasi kereta yang berbeda). Kami kemudian memindai koleksi besar gambar tidak berlabel kami untuk tetangga terdekat dari sampel ini dalam ruang fitur persepsi, dan menetapkan label manusia ke gambar yang ditemukan. Berkat infrastruktur komputasi kami, sangat mudah untuk meningkatkan pelatihan pengklasifikasi dan pencarian tetangga terdekat ke banyak GPU, memungkinkan langkah pembelajaran aktif berlangsung selama beberapa menit, bukan berjam-jam atau berhari-hari.

Untuk memverifikasi keefektifan filter data kami, kami melatih dua model GLIDE dengan hyperparameter yang sama: satu pada data yang tidak difilter, dan satu pada kumpulan data setelah pemfilteran. Kami menyebut model sebelumnya sebagai model tanpa filter, dan yang terakhir sebagai model yang difilter. Seperti yang diharapkan, kami menemukan bahwa model tanpa filter umumnya menghasilkan konten yang kurang eksplisit atau grafis sebagai tanggapan atas permintaan konten semacam ini. Namun, kami juga menemukan efek samping yang tidak terduga dari pemfilteran data: hal itu menciptakan atau memperkuat bias model terhadap demografi tertentu.

Memperbaiki Bias yang Diperkenalkan oleh Filter Data

Model generatif berusaha untuk mencocokkan distribusi data pelatihan mereka, termasuk setiap bias di dalamnya. Akibatnya, memfilter data pelatihan berpotensi menciptakan atau memperkuat bias dalam model hilir. Secara umum, memperbaiki bias dalam kumpulan data asli adalah tugas sosioteknik yang sulit yang terus kami pelajari, dan berada di luar cakupan posting ini. Masalah yang kami bahas di sini adalah penguatan bias yang disebabkan secara khusus oleh penyaringan data itu sendiri. Dengan pendekatan kami, kami bertujuan untuk mencegah model yang difilter menjadi lebih bias daripada model tanpa filter, pada dasarnya mengurangi pergeseran distribusi yang disebabkan oleh penyaringan data.

Sebagai contoh konkret amplifikasi bias karena penyaringan, pertimbangkan prompt "a ceo". Saat model tanpa filter kami menghasilkan gambar untuk permintaan ini, model ini cenderung menghasilkan lebih banyak gambar pria daripada wanita, dan kami berharap bahwa sebagian besar bias ini merupakan cerminan dari data pelatihan kami saat ini. Namun, ketika kami menjalankan perintah yang sama melalui model terfilter kami, bias tampaknya diperkuat; generasi hampir secara eksklusif gambar laki-laki.

Kami berhipotesis bahwa kasus khusus dari penguatan bias ini berasal dari dua tempat: pertama, bahkan jika perempuan dan laki-laki memiliki representasi yang kurang lebih sama dalam kumpulan data asli, kumpulan data tersebut mungkin bias untuk menghadirkan perempuan dalam konteks yang lebih seksual; dan kedua, pengklasifikasi kami sendiri mungkin bias karena implementasi atau definisi kelas, meskipun kami berupaya untuk memastikan bahwa hal ini tidak terjadi selama fase pengumpulan dan validasi data. Karena kedua efek ini, filter kami dapat menghapus lebih banyak gambar wanita daripada pria, yang mengubah rasio gender yang diamati model dalam pelatihan.

Untuk menyelidiki bias yang diinduksi filter secara lebih menyeluruh, kami menginginkan cara untuk mengukur seberapa besar filter data kami memengaruhi bias terhadap berbagai konsep. Khususnya, filter konten kekerasan dan seksual kami murni berbasis gambar, tetapi sifat multimodal dari kumpulan data kami memungkinkan kami untuk secara langsung mengukur efek filter ini pada teks. Karena setiap gambar disertai dengan keterangan teks, kami dapat melihat frekuensi relatif dari kata kunci yang dipilih sendiri di seluruh kumpulan data yang difilter dan tidak difilter untuk memperkirakan seberapa besar pengaruh filter terhadap konsep tertentu.

Untuk mempraktikkannya, kami menggunakan Apache Spark untuk menghitung frekuensi beberapa kata kunci (misalnya, "orang tua", "wanita", "anak") di semua teks di kumpulan data kami yang difilter dan tidak difilter. Meskipun kumpulan data kami berisi ratusan juta pasangan teks-gambar, menghitung frekuensi kata kunci ini hanya membutuhkan waktu beberapa menit menggunakan cluster komputasi kami.

Setelah menghitung frekuensi kata kunci, kami dapat mengonfirmasi bahwa filter kumpulan data kami memang lebih mencondongkan frekuensi kata kunci tertentu daripada yang lain. Misalnya, filter mengurangi frekuensi kata "wanita" sebesar 14%, sedangkan frekuensi kata "pria" hanya berkurang 6%. Ini mengkonfirmasi, dalam skala besar, apa yang telah kami amati secara anekdot dengan mengambil sampel dari model GLIDE yang dilatih pada kedua kumpulan data.

Sekarang kami memiliki proxy untuk mengukur bias yang disebabkan oleh filter, kami membutuhkan cara untuk menguranginya. Untuk mengatasi masalah ini, kami bertujuan untuk menimbang ulang kumpulan data yang difilter sehingga distribusinya lebih cocok dengan distribusi gambar yang tidak difilter. Sebagai contoh mainan untuk mengilustrasikan ide ini, misalkan kumpulan data kami terdiri dari 50% foto kucing dan 50% foto anjing, tetapi filter data kami menghapus 75% anjing tetapi hanya 50% kucing. Dataset terakhir adalah kucing dan anjing, dan model generatif berbasis kemungkinan yang dilatih pada dataset ini kemungkinan akan menghasilkan lebih banyak gambar kucing daripada anjing. Kami dapat memperbaiki ketidakseimbangan ini dengan mengalikan hilangnya latihan setiap gambar anjing dengan 2, meniru efek pengulangan setiap gambar anjing dua kali. Ternyata kami dapat menskalakan pendekatan ini ke kumpulan data dan model nyata kami dengan cara yang sebagian besar otomatis—yaitu, kami tidak perlu memilih sendiri fitur yang ingin kami bobot ulang.

Kami menghitung bobot untuk gambar dalam kumpulan data yang difilter menggunakan probabilitas dari pengklasifikasi khusus, mirip dengan pendekatan yang digunakan oleh Choi et al. (2019). Untuk melatih pengklasifikasi ini, kami secara seragam mengambil sampel gambar dari kedua kumpulan data dan memprediksi dari kumpulan data mana gambar itu berasal. Secara khusus, model ini memprediksi P(tanpa filter|gambar), diberikan sebelumnya P (tanpa filter) = 0.5. Dalam praktiknya, kami tidak ingin model ini menjadi terlalu kuat, atau model ini mungkin mempelajari fungsi yang tepat yang diterapkan oleh filter kami sejak awal. Sebagai gantinya, kami ingin model menjadi lebih halus daripada filter data asli kami, menangkap kategori luas yang dipengaruhi oleh filter sambil tetap tidak yakin apakah gambar tertentu akan difilter atau tidak. Untuk tujuan ini, kami melatih probe linier di atas kecil CLIP Model.

Setelah kami memiliki pengklasifikasi yang memprediksi probabilitas bahwa suatu gambar berasal dari kumpulan data yang tidak difilter, kami masih perlu mengubah prediksi ini menjadi bobot untuk gambar tersebut. Misalnya, anggaplah P(tanpa filter|gambar) = 0.8. Ini berarti bahwa sampel 4 kali lebih mungkin ditemukan dalam data yang tidak difilter daripada data yang difilter, dan bobot 4 akan memperbaiki ketidakseimbangan. Secara umum, kita dapat menggunakan bobot P(tidak difilter|gambar)/P(difilter|gambar).[1]

Seberapa baik skema pembobotan ulang ini benar-benar mengurangi bias yang diperkuat? Saat kami menyempurnakan model terfilter kami sebelumnya dengan skema pembobotan baru, perilaku model yang disempurnakan jauh lebih cocok dengan model tanpa filter pada contoh bias yang kami temukan sebelumnya. Meskipun hal ini menggembirakan, kami juga ingin mengevaluasi mitigasi ini secara lebih menyeluruh menggunakan heuristik bias berbasis kata kunci kami. Untuk mengukur frekuensi kata kunci sambil mempertimbangkan skema pembobotan baru kami, kami cukup menimbang setiap kata kunci dalam kumpulan data yang difilter berdasarkan bobot sampel yang berisi kata kunci tersebut. Dengan melakukan ini, kami mendapatkan kumpulan frekuensi kata kunci baru yang mencerminkan bobot sampel dalam kumpulan data yang difilter.

Di sebagian besar kata kunci yang kami periksa, skema pembobotan ulang mengurangi perubahan frekuensi yang disebabkan oleh pemfilteran. Untuk contoh "pria" dan "wanita" kami sebelumnya, pengurangan frekuensi relatif menjadi 1% dan -1%, sedangkan nilai sebelumnya masing-masing adalah 14% dan 6%. Meskipun metrik ini hanyalah proksi untuk bias pemfilteran yang sebenarnya, ini meyakinkan bahwa skema pembobotan ulang berbasis gambar kami benar-benar meningkatkan metrik berbasis teks secara signifikan.

Kami terus menyelidiki bias yang tersisa di DALL·E 2, sebagian melalui evaluasi yang lebih besar dari perilaku model dan investigasi tentang bagaimana penyaringan berdampak pada bias dan pengembangan kemampuan.

Mencegah Regurgitasi Gambar

Kami mengamati bahwa pendahulu internal kami untuk DALL·E 2 terkadang mereproduksi gambar pelatihan kata demi kata. Perilaku ini tidak diinginkan, karena kami ingin DALL·E 2 membuat gambar asli dan unik secara default dan bukan hanya "menjahit bersama" bagian dari gambar yang ada. Selain itu, mereproduksi gambar pelatihan kata demi kata dapat menimbulkan pertanyaan hukum seputar pelanggaran hak cipta, kepemilikan, dan privasi (jika foto orang ada dalam data pelatihan).

Untuk lebih memahami masalah regurgitasi gambar, kami mengumpulkan kumpulan data permintaan yang sering kali menghasilkan gambar duplikat. Untuk melakukan ini, kami menggunakan model terlatih untuk mengambil sampel gambar untuk 50,000 petunjuk dari dataset pelatihan kami, dan mengurutkan sampel berdasarkan kesamaan persepsi dengan gambar pelatihan yang sesuai. Akhirnya, kami memeriksa kecocokan teratas dengan tangan, menemukan hanya beberapa ratus pasangan duplikat yang benar dari total 50k permintaan. Meskipun angka regurgitasi tampaknya kurang dari 1%, kami merasa perlu untuk menurunkan angka tersebut ke 0 karena alasan yang disebutkan di atas.

Ketika kami mempelajari kumpulan data gambar yang dimuntahkan, kami melihat dua pola. Pertama, gambarnya hampir semuanya berupa grafik vektor sederhana, yang kemungkinan mudah diingat karena kandungan informasinya yang rendah. Kedua, dan yang lebih penting, semua gambar memiliki banyak duplikat dalam set data pelatihan. Misalnya, mungkin ada grafik vektor yang terlihat seperti jam yang menunjukkan waktu pukul 1—tetapi kemudian kita akan menemukan sampel pelatihan yang berisi jam yang sama yang menunjukkan pukul 2, lalu pukul 3, dst. kami menyadari hal ini, kami menggunakan pencarian tetangga terdekat terdistribusi untuk memverifikasi bahwa, memang, semua gambar yang dimuntahkan memiliki duplikat yang serupa dalam kumpulan data. Lainnya bekerja telah mengamati fenomena serupa dalam model bahasa besar, menemukan bahwa duplikasi data sangat terkait dengan menghafal.

Temuan di atas menunjukkan bahwa, jika kami menghapus dataset kami, kami mungkin menyelesaikan masalah regurgitasi. Untuk mencapai ini, kami berencana menggunakan jaringan saraf untuk mengidentifikasi kelompok gambar yang tampak serupa, dan kemudian menghapus semua kecuali satu gambar dari setiap kelompok.[2] Namun, ini akan memerlukan pemeriksaan, untuk setiap gambar, apakah itu duplikat dari setiap gambar lain dalam kumpulan data. Karena seluruh kumpulan data kami berisi ratusan juta gambar, kami secara naif perlu memeriksa ratusan kuadriliun pasangan gambar untuk menemukan semua duplikat. Meskipun secara teknis hal ini dapat dijangkau, terutama pada klaster komputasi besar, kami menemukan alternatif yang jauh lebih efisien yang bekerja hampir sama baiknya dengan biaya yang lebih murah.

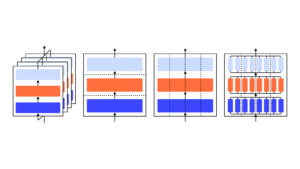

Pertimbangkan apa yang terjadi jika kita mengelompokkan dataset kita sebelum melakukan deduplikasi. Karena sampel terdekat sering jatuh ke dalam cluster yang sama, sebagian besar pasangan duplikat tidak akan melewati batas keputusan cluster. Kami kemudian dapat menghapus duplikat sampel dalam setiap cluster tanpa memeriksa duplikat di luar cluster, sementara hanya kehilangan sebagian kecil dari semua pasangan duplikat. Ini jauh lebih cepat daripada pendekatan naif, karena kita tidak lagi harus memeriksa setiap pasangan gambar.[3] Ketika kami menguji pendekatan ini secara empiris pada sebagian kecil data kami, ditemukan 85% dari semua pasangan duplikat saat menggunakan K = 1024 kelompok.

Untuk meningkatkan tingkat keberhasilan algoritme di atas, kami memanfaatkan satu pengamatan utama: ketika Anda mengelompokkan himpunan bagian acak yang berbeda dari kumpulan data, batas keputusan klaster yang dihasilkan seringkali sangat berbeda. Oleh karena itu, jika pasangan duplikat melintasi batas cluster untuk satu pengelompokan data, pasangan yang sama mungkin berada di dalam satu cluster dalam pengelompokan yang berbeda. Semakin banyak pengelompokan yang Anda coba, semakin besar kemungkinan Anda menemukan pasangan duplikat yang diberikan. Dalam praktiknya, kami memutuskan untuk menggunakan lima pengelompokan, yang berarti kami mencari duplikat dari setiap gambar dalam gabungan lima pengelompokan yang berbeda. Dalam praktiknya, ini menemukan 97% dari semua pasangan duplikat pada subset data kami.

Anehnya, hampir seperempat dari kumpulan data kami telah dihapus oleh deduplikasi. Ketika kami melihat pasangan hampir duplikat yang ditemukan, banyak dari mereka termasuk perubahan yang berarti. Ingat contoh jam dari atas: kumpulan data mungkin menyertakan banyak gambar dari jam yang sama pada waktu yang berbeda dalam sehari. Meskipun gambar-gambar ini kemungkinan akan membuat model mengingat tampilan jam khusus ini, gambar-gambar ini juga dapat membantu model belajar membedakan waktu dalam satu hari pada sebuah jam. Mengingat banyaknya data yang dihapus, kami khawatir bahwa menghapus gambar seperti ini dapat merusak kinerja model.

Untuk menguji efek deduplikasi pada model kami, kami melatih dua model dengan hyperparameter yang identik: satu pada kumpulan data lengkap, dan satu pada versi kumpulan data yang dideduplikasi. Untuk membandingkan model, kami menggunakan evaluasi manusia yang sama yang kami gunakan untuk mengevaluasi model GLIDE asli kami. Anehnya, kami menemukan bahwa evaluator manusia sedikit disukai model dilatih pada data yang dideduplikasi, menunjukkan bahwa sejumlah besar gambar yang berlebihan dalam kumpulan data sebenarnya merusak kinerja.

Setelah kami memiliki model yang dilatih pada data yang dideduplikasi, kami menjalankan ulang pencarian regurgitasi yang sebelumnya telah kami lakukan lebih dari 50 ribu perintah dari kumpulan data pelatihan. Kami menemukan bahwa model baru tidak pernah memuntahkan gambar pelatihan saat diberi perintah yang tepat untuk gambar dari set data pelatihan. Untuk melakukan pengujian ini selangkah lebih maju, kami juga melakukan pencarian tetangga terdekat di seluruh dataset pelatihan untuk masing-masing 50k gambar yang dihasilkan. Dengan cara ini, kami pikir kami mungkin menangkap model yang memuntahkan gambar yang berbeda dari yang terkait dengan prompt yang diberikan. Bahkan dengan pemeriksaan yang lebih teliti ini, kami tidak pernah menemukan kasus regurgitasi gambar.

Langkah Selanjutnya

Sementara semua mitigasi yang dibahas di atas mewakili kemajuan signifikan menuju tujuan kami untuk mengurangi risiko yang terkait dengan DALL·E 2, setiap mitigasi masih memiliki ruang untuk ditingkatkan:

- Filter pra-pelatihan yang lebih baik memungkinkan kami melatih DALL·E 2 pada lebih banyak data dan berpotensi mengurangi bias lebih lanjut dalam model. Filter kami saat ini disetel untuk tingkat kesalahan yang rendah dengan mengorbankan banyak kesalahan positif. Akibatnya, kami memfilter sekitar 5% dari seluruh kumpulan data kami meskipun sebagian besar gambar yang difilter ini sama sekali tidak melanggar kebijakan konten kami. Meningkatkan filter kami dapat memungkinkan kami untuk mendapatkan kembali beberapa data pelatihan ini.

- Bias diperkenalkan dan berpotensi diperkuat pada banyak tahap pengembangan dan penerapan sistem. Mengevaluasi dan mengurangi bias dalam sistem seperti DALL·E 2 dan kerugian yang ditimbulkan oleh bias ini merupakan masalah interdisipliner penting yang terus kami pelajari di OpenAI sebagai bagian dari misi kami yang lebih luas. Pekerjaan kami dalam hal ini termasuk membangun evaluasi untuk lebih memahami masalah, menyusun kumpulan data baru, dan menerapkan teknik seperti umpan balik manusia dan menyempurnakan untuk membangun teknologi yang lebih kuat dan representatif.

- Penting juga bagi kita untuk terus mempelajari penghafalan dan generalisasi dalam sistem pembelajaran yang mendalam. Meskipun deduplikasi adalah langkah pertama yang baik untuk mencegah penghafalan, deduplikasi tidak memberi tahu kita semua yang perlu dipelajari tentang mengapa atau bagaimana model seperti DALL·E 2 menghafal data pelatihan.

- 000

- 2019

- a

- Tentang Kami

- Akun

- Mencapai

- di seluruh

- aktif

- alamat

- mempengaruhi

- algoritma

- Semua

- Membiarkan

- memungkinkan

- sudah

- alternatif

- selalu

- jumlah

- Lain

- Muncul

- terapan

- Menerapkan

- pendekatan

- sekitar

- ditugaskan

- terkait

- para penonton

- karena

- sebelum

- makhluk

- Lebih baik

- antara

- Luar

- membangun

- Bangunan

- kemampuan

- keterangan

- kasus

- kasus

- gulat

- Kategori

- disebabkan

- tertentu

- perubahan

- memeriksa

- Pilih

- kelas

- klasifikasi

- tergolong

- Clock

- koleksi

- dibandingkan

- menghitung

- komputasi

- konsep

- Mempertimbangkan

- mengandung

- Konten

- Konteks

- terus

- hak cipta

- pelanggaran hak cipta

- Sesuai

- bisa

- membuat

- dibuat

- membuat

- sangat penting

- terbaru

- Sekarang

- data

- hari

- Hari

- keputusan

- mendalam

- Demografi

- penyebaran

- menggambarkan

- Meskipun

- Pengembangan

- berbeda

- sulit

- langsung

- menemukan

- ditemukan

- jarak

- didistribusikan

- distribusi

- turun

- duplikat

- selama

- setiap

- efek

- efektif

- efektivitas

- efek

- efisien

- upaya

- mendorong

- terutama

- dasarnya

- memperkirakan

- dll

- mengevaluasi

- segala sesuatu

- contoh

- contoh

- khusus

- ada

- mengharapkan

- diharapkan

- lebih cepat

- Fitur

- Fitur

- umpan balik

- Angka

- penyaringan

- filter

- Akhirnya

- temuan

- Pertama

- Memperbaiki

- berfokus

- berikut

- ditemukan

- dari

- penuh

- fungsi

- lebih lanjut

- pertemuan

- Gender

- Umum

- umumnya

- menghasilkan

- dihasilkan

- generasi

- Generasi

- generatif

- tujuan

- baik

- GPU

- grafis

- Kelompok

- Grup

- terjamin

- segenggam

- membantu

- membantu

- di sini

- High

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTTPS

- manusia

- Manusia

- Ratusan

- ide

- mengenali

- gambar

- gambar

- implementasi

- diimplementasikan

- penting

- memperbaiki

- ditingkatkan

- meningkatkan

- memasukkan

- termasuk

- termasuk

- Termasuk

- informasi

- Infrastruktur

- contoh

- Internet

- menyelidiki

- isu

- IT

- Diri

- kunci

- label

- pelabelan

- Label

- bahasa

- besar

- lebih besar

- BELAJAR

- belajar

- pengetahuan

- Informasi

- Mungkin

- melihat

- tampak

- membuat

- tanda

- Cocok

- berarti

- cara

- mengukur

- ukur

- Pria

- mungkin

- Militer

- jutaan

- Misi

- model

- model

- lebih

- paling

- mengalikan

- Alam

- perlu

- negatif

- jaringan

- jumlah

- urutan

- terorganisir

- asli

- Lainnya

- kepemilikan

- bagian

- tertentu

- prestasi

- melakukan

- tahap

- potongan-potongan

- berencana

- kebijaksanaan

- positif

- mungkin

- potensi

- kuat

- praktek

- meramalkan

- ramalan

- menyajikan

- mencegah

- sebelumnya

- pribadi

- penyelidikan

- Masalah

- proses

- menghasilkan

- Diproduksi

- protes

- wakil

- Perempat

- menaikkan

- mencapai

- menyadari

- alasan

- menurunkan

- mengurangi

- mengurangi

- mencerminkan

- refleksi

- yang tersisa

- menghapus

- mewakili

- perwakilan

- wakil

- permintaan

- membutuhkan

- membutuhkan

- tanggapan

- dihasilkan

- kembali

- risiko

- Run

- sama

- Skala

- skema

- Pencarian

- set

- bentuk

- Share

- bergeser

- penting

- mirip

- Sederhana

- sejak

- tunggal

- Ukuran

- kecil

- So

- MEMECAHKAN

- beberapa

- sesuatu

- Space

- khusus

- Secara khusus

- spesifikasi

- Berpisah

- magang

- awal

- menyatakan

- Masih

- Belajar

- sukses

- sistem

- sistem

- pengambilan

- teknik

- Teknologi

- uji

- Grafik

- karena itu

- hal

- sepenuhnya

- tiga

- ambang

- Melalui

- waktu

- kali

- alat

- puncak

- terhadap

- Pelatihan VE

- Pelatihan

- memahami

- serikat

- unik

- us

- menggunakan

- pengesahan

- berbagai

- memeriksa

- versi

- ingin

- Apa

- apakah

- sementara

- dalam

- tanpa

- Wanita

- Kerja

- bekerja

- cemas

- akan

- X