Dalam lanskap perawatan kesehatan yang berkembang pesat saat ini, dokter dihadapkan pada sejumlah besar data klinis dari berbagai sumber, seperti catatan pengasuh, catatan kesehatan elektronik, dan laporan pencitraan. Informasi yang banyak ini, meskipun penting untuk perawatan pasien, juga dapat membuat kewalahan dan menghabiskan waktu bagi profesional medis untuk menyaring dan menganalisis. Meringkas dan mengekstrak wawasan secara efisien dari data ini sangat penting untuk perawatan pasien dan pengambilan keputusan yang lebih baik. Informasi pasien yang diringkas dapat berguna untuk sejumlah proses hilir seperti agregasi data, pengkodean pasien secara efektif, atau pengelompokan pasien dengan diagnosis serupa untuk ditinjau.

Model kecerdasan buatan (AI) dan pembelajaran mesin (ML) telah menunjukkan harapan besar dalam mengatasi tantangan ini. Model dapat dilatih untuk menganalisis dan menginterpretasikan volume besar data teks, yang secara efektif memadatkan informasi menjadi ringkasan singkat. Dengan mengotomatiskan proses peringkasan, dokter dapat dengan cepat mendapatkan akses ke informasi yang relevan, memungkinkan mereka untuk fokus pada perawatan pasien dan membuat keputusan yang lebih tepat. Lihat yang berikut ini studi kasus untuk mempelajari lebih lanjut tentang kasus penggunaan dunia nyata.

Amazon SageMaker, layanan ML yang dikelola sepenuhnya, menyediakan platform yang ideal untuk menghosting dan mengimplementasikan berbagai model dan pendekatan peringkasan berbasis AI/ML. Dalam postingan ini, kami menjelajahi berbagai opsi untuk mengimplementasikan teknik peringkasan di SageMaker, termasuk menggunakan Mulai Lompatan Amazon SageMaker model dasar, menyempurnakan model pra-terlatih dari Hugging Face, dan membuat model peringkasan kustom. Kami juga membahas pro dan kontra dari setiap pendekatan, memungkinkan profesional kesehatan untuk memilih solusi yang paling cocok untuk menghasilkan ringkasan data klinis yang kompleks dan ringkas.

Dua istilah penting untuk diketahui sebelum kita mulai: terlatih dan mencari setelan. Model pra-terlatih atau dasar adalah model yang telah dibangun dan dilatih pada korpus data yang besar, biasanya untuk pengetahuan bahasa umum. Penyesuaian halus adalah proses di mana model pra-terlatih diberi kumpulan data lain yang lebih spesifik domain untuk meningkatkan kinerjanya pada tugas tertentu. Dalam pengaturan perawatan kesehatan, ini berarti memberi model beberapa data termasuk frasa dan terminologi yang berkaitan khusus dengan perawatan pasien.

Bangun model peringkasan khusus di SageMaker

Meskipun merupakan pendekatan dengan upaya paling tinggi, beberapa organisasi mungkin lebih suka membangun model peringkasan khusus di SageMaker dari awal. Pendekatan ini memerlukan pengetahuan yang lebih mendalam tentang model AI/ML dan mungkin melibatkan pembuatan arsitektur model dari awal atau mengadaptasi model yang ada untuk memenuhi kebutuhan tertentu. Membangun model khusus dapat menawarkan fleksibilitas dan kontrol yang lebih besar atas proses peringkasan, tetapi juga memerlukan lebih banyak waktu dan sumber daya dibandingkan dengan pendekatan yang dimulai dari model yang telah dilatih sebelumnya. Sangat penting untuk mempertimbangkan keuntungan dan kerugian dari opsi ini dengan hati-hati sebelum melanjutkan, karena mungkin tidak cocok untuk semua kasus penggunaan.

Model dasar SageMaker JumpStart

Pilihan bagus untuk mengimplementasikan peringkasan di SageMaker adalah menggunakan model dasar JumpStart. Model ini, dikembangkan oleh organisasi riset AI terkemuka, menawarkan serangkaian model bahasa terlatih yang dioptimalkan untuk berbagai tugas, termasuk peringkasan teks. SageMaker JumpStart menyediakan dua jenis model dasar: model berpemilik dan model sumber terbuka. SageMaker JumpStart juga memberikan kelayakan HIPAA, sehingga berguna untuk beban kerja perawatan kesehatan. Pada akhirnya tergantung pada pelanggan untuk memastikan kepatuhan, jadi pastikan untuk mengambil langkah yang tepat. Melihat Merancang untuk Keamanan dan Kepatuhan HIPAA di Amazon Web Services lebih lanjut.

Model pondasi eksklusif

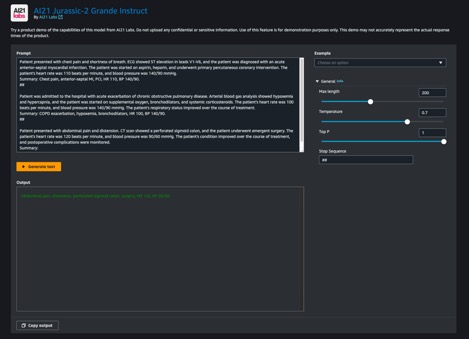

Model berpemilik, seperti model Jurassic dari AI21 dan model Cohere Generate dari Cohere, dapat ditemukan melalui SageMaker JumpStart di Konsol Manajemen AWS dan saat ini sedang dalam pratinjau. Memanfaatkan model berpemilik untuk peringkasan sangat ideal saat Anda tidak perlu menyempurnakan model Anda pada data khusus. Ini menawarkan solusi out-of-the-box yang mudah digunakan yang dapat memenuhi kebutuhan ringkasan Anda dengan konfigurasi minimal. Dengan menggunakan kemampuan model terlatih ini, Anda dapat menghemat waktu dan sumber daya yang seharusnya dihabiskan untuk melatih dan menyempurnakan model kustom. Selain itu, model berpemilik biasanya dilengkapi dengan API dan SDK yang mudah digunakan, menyederhanakan proses integrasi dengan sistem dan aplikasi Anda yang sudah ada. Jika kebutuhan peringkasan Anda dapat dipenuhi oleh model berpemilik yang telah dilatih sebelumnya tanpa memerlukan penyesuaian atau penyesuaian khusus, mereka menawarkan solusi yang nyaman, hemat biaya, dan efisien untuk tugas peringkasan teks Anda. Karena model ini tidak dilatih secara khusus untuk kasus penggunaan perawatan kesehatan, kualitas tidak dapat dijamin untuk bahasa medis langsung tanpa penyempurnaan.

Jurassic-2 Grande Instruct adalah model bahasa besar (LLM) oleh AI21 Labs, dioptimalkan untuk instruksi bahasa alami dan berlaku untuk berbagai tugas bahasa. Ini menawarkan API dan Python SDK yang mudah digunakan, menyeimbangkan kualitas dan keterjangkauan. Penggunaan populer termasuk menghasilkan salinan pemasaran, memberdayakan chatbots, dan meringkas teks.

Di konsol SageMaker, navigasikan ke SageMaker JumpStart, temukan model AI21 Jurassic-2 Grande Instruct, dan pilih Mencoba model.

Jika ingin menerapkan model ke titik akhir SageMaker yang Anda kelola, Anda dapat mengikuti langkah-langkah dalam contoh ini buku catatan, yang menunjukkan cara menerapkan Jurassic-2 Large menggunakan SageMaker.

Model pondasi sumber terbuka

Model sumber terbuka mencakup model FLAN T5, Bloom, dan GPT-2 yang dapat ditemukan melalui SageMaker JumpStart di Studio Amazon SageMaker UI, SageMaker JumpStart di konsol SageMaker, dan SageMaker JumpStart API. Model ini dapat disesuaikan dan diterapkan ke titik akhir di bawah akun AWS Anda, memberi Anda kepemilikan penuh atas bobot model dan kode skrip.

Flan-T5 XL adalah model yang kuat dan serbaguna yang dirancang untuk berbagai tugas bahasa. Dengan menyempurnakan model dengan data khusus domain, Anda dapat mengoptimalkan kinerjanya untuk kasus penggunaan tertentu, seperti peringkasan teks atau tugas NLP lainnya. Untuk detail tentang cara menyempurnakan Flan-T5 XL menggunakan UI SageMaker Studio, lihat Instruksi penyempurnaan untuk FLAN T5 XL dengan Amazon SageMaker Jumpstart.

Menyempurnakan model terlatih dengan Hugging Face di SageMaker

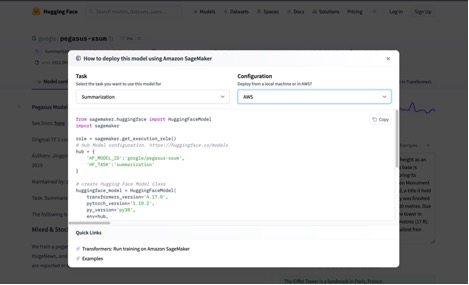

Salah satu opsi paling populer untuk mengimplementasikan peringkasan di SageMaker adalah menyempurnakan model pra-terlatih menggunakan Hugging Face transformer perpustakaan. Hugging Face menyediakan berbagai model transformator terlatih yang dirancang khusus untuk berbagai tugas pemrosesan bahasa alami (NLP), termasuk peringkasan teks. Dengan library Hugging Face Transformers, Anda dapat dengan mudah menyempurnakan model yang telah dilatih sebelumnya ini pada data khusus domain Anda menggunakan SageMaker. Pendekatan ini memiliki beberapa keunggulan, seperti waktu pelatihan yang lebih cepat, kinerja yang lebih baik pada domain tertentu, dan pengemasan dan penerapan model yang lebih mudah menggunakan alat dan layanan SageMaker bawaan. Jika Anda tidak dapat menemukan model yang cocok di SageMaker JumpStart, Anda dapat memilih model apa pun yang ditawarkan oleh Hugging Face dan menyempurnakannya menggunakan SageMaker.

Untuk mulai bekerja dengan model guna mempelajari kemampuan ML, yang perlu Anda lakukan hanyalah membuka SageMaker Studio, temukan model terlatih yang ingin Anda gunakan di Memeluk Wajah Model Hub, dan pilih SageMaker sebagai metode penerapan Anda. Hugging Face akan memberi Anda kode untuk disalin, ditempel, dan dijalankan di buku catatan Anda. Semudah itu! Tidak diperlukan pengalaman teknik ML.

Pustaka Hugging Face Transformers memungkinkan pembuat untuk beroperasi pada model yang telah dilatih sebelumnya dan melakukan tugas tingkat lanjut seperti penyetelan halus, yang akan kita jelajahi di bagian berikut.

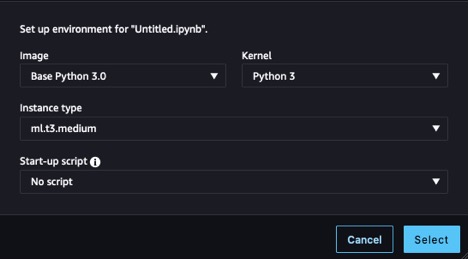

Sumber daya penyediaan

Sebelum memulai, kita perlu menyediakan buku catatan. Untuk instruksi, lihat Langkah 1 dan 2 di Bangun dan Latih Model Pembelajaran Mesin Secara Lokal. Untuk contoh ini, kami menggunakan pengaturan yang ditunjukkan pada tangkapan layar berikut.

Kita juga perlu membuat sebuah Layanan Penyimpanan Sederhana Amazon (Amazon S3) bucket untuk menyimpan data pelatihan dan artefak pelatihan. Untuk instruksi, lihat Membuat ember.

Siapkan kumpulan datanya

Untuk menyempurnakan model kita agar memiliki pengetahuan domain yang lebih baik, kita perlu mendapatkan data yang sesuai untuk tugas tersebut. Saat melatih untuk kasus penggunaan perusahaan, Anda harus melalui sejumlah tugas rekayasa data untuk menyiapkan data Anda sendiri agar siap untuk pelatihan. Tugas-tugas itu berada di luar cakupan posting ini. Untuk contoh ini, kami telah membuat beberapa data sintetik untuk meniru catatan keperawatan dan menyimpannya di Amazon S3. Menyimpan data kami di Amazon S3 memungkinkan kami melakukannya merancang beban kerja kami untuk kepatuhan HIPAA. Kita mulai dengan mendapatkan catatan tersebut dan memuatnya di instans tempat notebook kita berjalan:

Catatan terdiri dari kolom yang berisi entri lengkap, catatan, dan kolom yang berisi versi singkat yang mencontohkan output yang diinginkan, ringkasan. Tujuan penggunaan kumpulan data ini adalah untuk meningkatkan kosa kata biologis dan medis model kami sehingga lebih selaras dengan meringkas dalam konteks perawatan kesehatan, yang disebut penyempurnaan domain, dan tunjukkan model kami bagaimana menyusun output yang dirangkum. Dalam beberapa kasus peringkasan, kami mungkin ingin membuat abstrak dari artikel atau sinopsis satu baris ulasan, tetapi dalam kasus ini, kami mencoba membuat model kami menampilkan versi singkat dari gejala dan tindakan yang diambil untuk pasien selama ini.

Muat modelnya

Model yang kami gunakan sebagai fondasi kami adalah versi Pegasus Google, yang tersedia di Hugging Face Hub, yang disebut pegasus-xsum. Ini sudah dilatih sebelumnya untuk peringkasan, sehingga proses penyempurnaan kami dapat berfokus pada perluasan pengetahuan domainnya. Memodifikasi tugas yang dijalankan model kami adalah jenis penyesuaian yang berbeda yang tidak tercakup dalam posting ini. Pustaka Transformer memberi kita kelas untuk memuat definisi model dari model_checkpoint: google/pegasus-xsum. Ini akan memuat model dari hub dan membuat instance-nya di notebook kita sehingga kita dapat menggunakannya nanti. Karena pegasus-xsum adalah model urutan-ke-urutan, kami ingin menggunakan jenis Seq2Seq dari Model Otomatis kelas:

Sekarang setelah kita memiliki model kita, saatnya untuk memperhatikan komponen lain yang akan memungkinkan kita menjalankan loop pelatihan kita.

Buat tokenizer

Yang pertama dari komponen ini adalah tokenizer. Tokenisasi adalah proses di mana kata-kata dari data input diubah menjadi representasi numerik yang dapat dipahami oleh model kita. Sekali lagi, pustaka Transformer menyediakan kelas bagi kita untuk memuat definisi tokenizer dari pos pemeriksaan yang sama dengan yang kita gunakan untuk membuat model:

Dengan objek tokenizer ini, kita dapat membuat fungsi preprocessing dan memetakannya ke dataset kita untuk memberi kita token yang siap dimasukkan ke dalam model. Terakhir, kami memformat keluaran yang ditoken dan menghapus kolom yang berisi teks asli kami, karena model tidak akan dapat menafsirkannya. Sekarang kita memiliki input tokenized yang siap dimasukkan ke dalam model. Lihat kode berikut:

Dengan tokenisasi data kami dan model kami dibuat, kami hampir siap untuk menjalankan putaran pelatihan. Komponen selanjutnya yang ingin kita buat adalah pengumpul data dan pengoptimal. Pengumpul data adalah kelas lain yang disediakan oleh Hugging Face melalui pustaka Transformers, yang kami gunakan untuk membuat kumpulan data token kami untuk pelatihan. Kita dapat dengan mudah membuat ini menggunakan tokenizer dan objek model yang sudah kita miliki hanya dengan menemukan tipe kelas yang sesuai yang telah kita gunakan sebelumnya untuk model kita (Seq2Seq) untuk kelas collator. Fungsi pengoptimal adalah mempertahankan status pelatihan dan memperbarui parameter berdasarkan kehilangan pelatihan saat kami bekerja melalui loop. Untuk membuat pengoptimal, kita dapat mengimpor file optimal paket dari modul obor, di mana sejumlah algoritme pengoptimalan tersedia. Beberapa yang umum yang mungkin Anda temui sebelumnya adalah Stochastic Gradient Descent dan Adam, yang terakhir diterapkan dalam contoh kita. Konstruktor Adam memasukkan parameter model dan kecepatan pembelajaran berparameter untuk proses pelatihan yang diberikan. Lihat kode berikut:

Langkah terakhir sebelum kita memulai pelatihan adalah membuat akselerator dan penjadwal laju pembelajaran. Akselerator berasal dari perpustakaan yang berbeda (kami terutama menggunakan Transformers) yang diproduksi oleh Hugging Face, tepatnya bernama Accelerate, dan akan menghilangkan logika yang diperlukan untuk mengelola perangkat selama pelatihan (menggunakan beberapa GPU misalnya). Untuk komponen terakhir, kami mengunjungi kembali pustaka Transformers yang selalu berguna untuk mengimplementasikan penjadwal laju pembelajaran kami. Dengan menentukan jenis penjadwal, jumlah total langkah pelatihan di loop kami, dan pengoptimal yang dibuat sebelumnya, the get_scheduler function mengembalikan objek yang memungkinkan kita menyesuaikan laju pembelajaran awal selama proses pelatihan:

Kami sekarang sepenuhnya siap untuk pelatihan! Mari siapkan tugas pelatihan, dimulai dengan membuat instance pelatihan_args menggunakan pustaka Transformers dan memilih nilai parameter. Kami dapat meneruskan ini, bersama dengan komponen dan kumpulan data lain yang kami siapkan, langsung ke pelatih dan mulai pelatihan, seperti yang ditunjukkan pada kode berikut. Bergantung pada ukuran kumpulan data Anda dan parameter yang dipilih, ini mungkin memerlukan banyak waktu.

Kemas model untuk inferensi

Setelah pelatihan dijalankan, objek model siap digunakan untuk inferensi. Sebagai praktik terbaik, mari simpan pekerjaan kita untuk digunakan di masa mendatang. Kita perlu membuat artefak model kita, menyatukannya, dan mengunggah tarbal kita ke Amazon S3 untuk penyimpanan. Untuk menyiapkan model kita untuk di-zip, kita perlu membuka model yang sekarang sudah disetel dengan baik, lalu menyimpan biner model dan file konfigurasi terkait. Kami juga perlu menyimpan tokenizer kami ke direktori yang sama dengan tempat kami menyimpan artefak model kami sehingga tersedia saat kami menggunakan model untuk inferensi. Kita model_dir folder sekarang akan terlihat seperti kode berikut:

Yang tersisa hanyalah menjalankan perintah tar untuk meng-zip direktori kami dan mengunggah file tar.gz ke Amazon S3:

Model kami yang baru disempurnakan kini siap dan tersedia untuk digunakan sebagai inferensi.

Melakukan inferensi

Untuk menggunakan artefak model ini untuk inferensi, buka file baru dan gunakan kode berikut, ubah file model_data parameter agar sesuai dengan lokasi penyimpanan artefak Anda di Amazon S3. Itu HuggingFaceModel konstruktor akan membangun kembali model kami dari pos pemeriksaan yang kami simpan model.tar.gz, yang kemudian dapat kita terapkan untuk inferensi menggunakan metode penerapan. Menyebarkan titik akhir akan memakan waktu beberapa menit.

Setelah titik akhir disebarkan, kita dapat menggunakan prediktor yang telah kita buat untuk mengujinya. Melewati predict metode payload data dan jalankan sel, dan Anda akan mendapatkan respons dari model yang disetel dengan baik:

Untuk melihat manfaat menyempurnakan model, mari lakukan tes cepat. Tabel berikut menyertakan prompt dan hasil penerusan prompt tersebut ke model sebelum dan sesudah penyempurnaan.

| Cepat | Respons tanpa Penyesuaian Sempurna | Respons dengan Penyetelan Halus |

| Ringkaslah gejala-gejala yang dialami pasien. Pasien laki-laki berusia 45 tahun dengan keluhan nyeri dada substernal menjalar ke lengan kiri. Nyeri timbul secara tiba-tiba saat dia sedang melakukan pekerjaan pekarangan, berhubungan dengan sesak napas ringan dan diaforesis. Detak jantung pasien saat kedatangan adalah 120, laju pernapasan 24, tekanan darah 170/95. Elektrokardiogram 12 sadapan dilakukan saat tiba di unit gawat darurat dan tiga nitrogliserin sublingual diberikan tanpa meredakan nyeri dada. Elektrokardiogram menunjukkan elevasi ST pada sadapan anterior yang menunjukkan infark miokard akut anterior. Kami telah menghubungi lab kateterisasi jantung dan persiapan kateterisasi jantung oleh ahli jantung. | Kami menyajikan kasus infark miokard akut. | Nyeri dada, MI anterior, PCI. |

Seperti yang Anda lihat, model kami yang telah disesuaikan menggunakan terminologi kesehatan secara berbeda, dan kami dapat mengubah struktur respons agar sesuai dengan tujuan kami. Perhatikan bahwa hasil bergantung pada kumpulan data Anda dan pilihan desain yang dibuat selama pelatihan. Versi model Anda dapat menawarkan hasil yang sangat berbeda.

Membersihkan

Setelah Anda selesai menggunakan notebook SageMaker, pastikan untuk mematikannya untuk menghindari biaya dari sumber daya yang berjalan lama. Perhatikan bahwa mematikan instans akan menyebabkan Anda kehilangan data apa pun yang disimpan di memori singkat instans, jadi Anda harus menyimpan semua pekerjaan Anda ke penyimpanan persisten sebelum pembersihan. Anda juga harus pergi ke Titik akhir halaman di konsol SageMaker dan hapus semua titik akhir yang diterapkan untuk inferensi. Untuk menghapus semua artefak, Anda juga perlu membuka konsol Amazon S3 untuk menghapus file yang diunggah ke bucket Anda.

Kesimpulan

Dalam postingan ini, kami menjelajahi berbagai opsi untuk menerapkan teknik peringkasan teks di SageMaker untuk membantu profesional kesehatan memproses dan mengekstrak wawasan secara efisien dari sejumlah besar data klinis. Kita membahas penggunaan model dasar SageMaker Jumpstart, menyempurnakan model pra-terlatih dari Hugging Face, dan membuat model peringkasan khusus. Setiap pendekatan memiliki kelebihan dan kekurangannya sendiri, melayani kebutuhan dan persyaratan yang berbeda.

Membangun model peringkasan khusus di SageMaker memungkinkan banyak fleksibilitas dan kontrol, tetapi membutuhkan lebih banyak waktu dan sumber daya daripada menggunakan model terlatih. Model fondasi Jumpstart SageMaker memberikan solusi yang mudah digunakan dan hemat biaya untuk organisasi yang tidak memerlukan penyesuaian atau penyesuaian khusus, serta beberapa opsi untuk penyesuaian halus yang disederhanakan. Menyempurnakan model pra-terlatih dari Hugging Face menawarkan waktu pelatihan yang lebih cepat, kinerja khusus domain yang lebih baik, dan integrasi tanpa hambatan dengan alat dan layanan SageMaker di seluruh katalog model yang luas, tetapi memerlukan upaya implementasi. Pada saat menulis posting ini, Amazon telah mengumumkan opsi lain, Batuan Dasar Amazon, yang akan menawarkan kemampuan peringkasan dalam lingkungan yang bahkan lebih terkelola.

Dengan memahami pro dan kontra dari setiap pendekatan, profesional dan organisasi perawatan kesehatan dapat membuat keputusan berdasarkan informasi tentang solusi yang paling cocok untuk menghasilkan ringkasan data klinis yang kompleks dan ringkas. Pada akhirnya, menggunakan model peringkasan berbasis AI/ML pada SageMaker dapat secara signifikan meningkatkan perawatan pasien dan pengambilan keputusan dengan memungkinkan profesional medis mengakses informasi yang relevan dengan cepat dan fokus pada penyediaan perawatan berkualitas.

Sumber

Untuk skrip lengkap yang dibahas dalam posting ini dan beberapa contoh data, lihat GitHub repo. Untuk informasi selengkapnya tentang cara menjalankan beban kerja ML di AWS, lihat sumber daya berikut:

Tentang penulis

Cody Collins adalah Arsitek Solusi berbasis di New York di Amazon Web Services. Dia bekerja dengan pelanggan ISV untuk membangun solusi terdepan di industri di cloud. Dia telah berhasil menyelesaikan proyek kompleks untuk beragam industri, mengoptimalkan efisiensi dan skalabilitas. Di waktu senggangnya, ia senang membaca, jalan-jalan, dan melatih jiu jitsu.

Cody Collins adalah Arsitek Solusi berbasis di New York di Amazon Web Services. Dia bekerja dengan pelanggan ISV untuk membangun solusi terdepan di industri di cloud. Dia telah berhasil menyelesaikan proyek kompleks untuk beragam industri, mengoptimalkan efisiensi dan skalabilitas. Di waktu senggangnya, ia senang membaca, jalan-jalan, dan melatih jiu jitsu.

Amir Hakme adalah Arsitek Solusi AWS yang tinggal di Pennsylvania. Fokus profesionalnya melibatkan kolaborasi dengan vendor perangkat lunak Independen di seluruh Timur Laut, membimbing mereka dalam merancang dan membangun platform canggih yang dapat diskalakan di AWS Cloud.

Amir Hakme adalah Arsitek Solusi AWS yang tinggal di Pennsylvania. Fokus profesionalnya melibatkan kolaborasi dengan vendor perangkat lunak Independen di seluruh Timur Laut, membimbing mereka dalam merancang dan membangun platform canggih yang dapat diskalakan di AWS Cloud.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Otomotif / EV, Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- BlockOffset. Modernisasi Kepemilikan Offset Lingkungan. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Sanggup

- Tentang Kami

- ABSTRAK

- mempercepat

- akselerator

- mengakses

- Akun

- tepat

- di seluruh

- tindakan

- Adam

- menangani

- diberikan

- maju

- keuntungan

- Setelah

- lagi

- pengumpulan

- AI

- ai penelitian

- AI / ML

- algoritma

- Semua

- Membiarkan

- memungkinkan

- sepanjang

- sudah

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- jumlah

- jumlah

- an

- menganalisa

- dan

- mengumumkan

- Lain

- Apa pun

- api

- Lebah

- berlaku

- aplikasi

- terapan

- pendekatan

- pendekatan

- sesuai

- arsitektur

- ADALAH

- ARM

- kedatangan

- artikel

- AS

- terkait

- At

- perhatian

- mengotomatisasi

- tersedia

- menghindari

- jauh

- AWS

- balancing

- berdasarkan

- BE

- karena

- menjadi

- sebelum

- mulai

- manfaat

- Manfaat

- TERBAIK

- Lebih baik

- BIN

- darah

- Tekanan darah

- Berkembang

- Kotak

- Nafas

- luas

- membangun

- pembangun

- Bangunan

- dibangun di

- built-in

- tapi

- by

- panggilan

- bernama

- CAN

- kemampuan

- yang

- hati-hati

- kasus

- kasus

- katalog

- Menyebabkan

- tantangan

- perubahan

- chatbots

- pilihan

- Pilih

- memilih

- terpilih

- kelas

- Klinis

- awan

- kode

- Kode

- Pengkodean

- berkolaborasi

- Kolom

- Kolom

- bagaimana

- datang

- Umum

- dibandingkan

- keluhan

- kompleks

- pemenuhan

- komponen

- komponen

- tersusun

- ringkas

- konfigurasi

- Kekurangan

- konsul

- membangun

- konteks

- kontrol

- Mudah

- Sesuai

- hemat biaya

- Biaya

- bisa

- tercakup

- membuat

- dibuat

- membuat

- sangat penting

- Sekarang

- adat

- pelanggan

- pelanggan

- kustomisasi

- data

- kumpulan data

- Pengambilan Keputusan

- keputusan

- definisi

- disampaikan

- menunjukkan

- Departemen

- tergantung

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- Mendesain

- dirancang

- merancang

- diinginkan

- rincian

- dikembangkan

- Devices

- berbeda

- langsung

- ditemukan

- membahas

- dibahas

- beberapa

- do

- dokter

- melakukan

- domain

- domain

- dilakukan

- Dont

- turun

- kekurangannya

- selama

- setiap

- mudah

- mudah

- Mudah

- mudah digunakan

- efektif

- efisiensi

- efisien

- efisien

- usaha

- Elektronik

- Catatan Kesehatan Elektronik

- kelayakan

- keadaan darurat

- aktif

- memungkinkan

- memungkinkan

- Titik akhir

- Teknik

- mempertinggi

- memastikan

- Enterprise

- masuk

- Lingkungan Hidup

- masa

- penting

- Bahkan

- berkembang

- contoh

- ada

- pengalaman

- mengalami

- menyelidiki

- Dieksplorasi

- Menjelajahi

- memperpanjang

- ekstrak

- Menghadapi

- dihadapi

- jauh

- lebih cepat

- Fed

- beberapa

- File

- File

- terakhir

- Akhirnya

- Menemukan

- temuan

- Pertama

- cocok

- keluwesan

- Fokus

- mengikuti

- berikut

- Untuk

- format

- Prinsip Dasar

- dari

- penuh

- sepenuhnya

- fungsi

- Selanjutnya

- masa depan

- Mendapatkan

- Umum

- menghasilkan

- dihasilkan

- menghasilkan

- mendapatkan

- mendapatkan

- Memberikan

- diberikan

- Pemberian

- Go

- GPU

- besar

- lebih besar

- terjamin

- Memiliki

- he

- Kesehatan

- kesehatan

- Hati

- membantu

- -nya

- tuan

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- http

- HTTPS

- Pusat

- MemelukWajah

- ideal

- if

- Pencitraan

- melaksanakan

- implementasi

- mengimplementasikan

- mengimpor

- penting

- memperbaiki

- in

- secara mendalam

- memasukkan

- termasuk

- Termasuk

- independen

- industri

- industri

- informasi

- informasi

- mulanya

- memasukkan

- input

- wawasan

- contoh

- instruksi

- integrasi

- Intelijen

- ke

- melibatkan

- IT

- NYA

- Pekerjaan

- json

- hanya

- Tahu

- pengetahuan

- laboratorium

- Labs

- pemandangan

- bahasa

- besar

- Terakhir

- kemudian

- memimpin

- terkemuka

- Memimpin

- BELAJAR

- pengetahuan

- meninggalkan

- Perpustakaan

- 'like'

- LLM

- memuat

- pemuatan

- tempat

- logika

- melihat

- kehilangan

- lepas

- mesin

- Mesin belajar

- terbuat

- memelihara

- membuat

- Membuat

- mengelola

- berhasil

- pengelolaan

- peta

- Marketing

- Mungkin..

- berarti

- medis

- Pelajari

- Memori

- bertemu

- metode

- mungkin

- minimal

- menit

- ML

- model

- model

- Modul

- lebih

- paling

- Paling Populer

- beberapa

- Bernama

- Alam

- Pengolahan Bahasa alami

- Arahkan

- Perlu

- kebutuhan

- New

- NY

- baru saja

- berikutnya

- nLP

- tidak

- buku catatan

- Catatan

- sekarang

- jumlah

- obyek

- objek

- of

- menawarkan

- ditawarkan

- Penawaran

- Tua

- on

- ONE

- yang

- serangan

- ke

- Buka

- open source

- beroperasi

- optimasi

- Optimize

- dioptimalkan

- mengoptimalkan

- pilihan

- Opsi

- or

- urutan

- organisasi

- asli

- Lainnya

- jika tidak

- kami

- di luar

- keluaran

- di luar

- lebih

- sendiri

- kepemilikan

- paket

- pengemasan

- halaman

- Sakit

- parameter

- parameter

- tertentu

- lulus

- Lewat

- pasien

- pasien

- Pegasus

- Pennsylvania

- prestasi

- berkaitan

- frase

- Platform

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- Populer

- Pos

- kuat

- Powering

- praktek

- Predictor

- lebih suka

- Mempersiapkan

- siap

- menyajikan

- tekanan

- Preview

- sebelumnya

- terutama

- proses

- proses

- pengolahan

- Diproduksi

- profesional

- profesional

- memprojeksikan

- janji

- hak milik

- PROS

- memberikan

- disediakan

- menyediakan

- menyediakan

- ketentuan

- tujuan

- tujuan

- menempatkan

- Ular sanca

- kualitas

- Cepat

- segera

- jarak

- cepat

- Penilaian

- Bacaan

- siap

- dunia nyata

- arsip

- relevan

- bantuan

- menghapus

- laporan

- membutuhkan

- wajib

- Persyaratan

- membutuhkan

- penelitian

- Sumber

- tanggapan

- Hasil

- Pengembalian

- ulasan

- Peran

- Run

- berjalan

- berjalan

- pembuat bijak

- sama

- Save

- Skalabilitas

- terukur

- cakupan

- menggaruk

- SDK

- SDK

- mulus

- bagian

- keamanan

- melihat

- terpisah

- layanan

- Layanan

- set

- pengaturan

- pengaturan

- beberapa

- dipersingkat

- harus

- Menunjukkan

- ditunjukkan

- Pertunjukkan

- mematikan

- Menyaring

- penting

- signifikan

- mirip

- Sederhana

- disederhanakan

- Ukuran

- So

- sejauh ini

- Perangkat lunak

- larutan

- Solusi

- beberapa

- sesuatu

- sumber

- tertentu

- Secara khusus

- menghabiskan

- awal

- Mulai

- Negara

- state-of-the-art

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- menyimpan

- pelurusan

- struktur

- studio

- sublingual

- berhasil

- seperti itu

- tiba-tiba

- setelan

- cocok

- RINGKASAN

- yakin

- Gejala

- ringkasan

- sintetis

- data sintetis

- sistem

- tabel

- Mengambil

- diambil

- Dibutuhkan

- tugas

- tugas

- teknik

- terminologi

- istilah

- uji

- dari

- bahwa

- Grafik

- hub

- Mereka

- kemudian

- Ini

- mereka

- ini

- itu

- tiga

- Melalui

- di seluruh

- waktu

- membuang-buang waktu

- kali

- untuk

- hari ini

- bersama

- dipatok

- Token

- alat

- obor

- Total

- Pelatihan VE

- terlatih

- Pelatihan

- berubah

- transformator

- transformer

- Perjalanan

- dua

- mengetik

- jenis

- khas

- ui

- Akhirnya

- tidak mampu

- bawah

- memahami

- pemahaman

- Memperbarui

- upload

- us

- menggunakan

- gunakan case

- bekas

- user-friendly

- kegunaan

- menggunakan

- Memanfaatkan

- pengesahan

- Nilai - Nilai

- berbagai

- Luas

- vendor

- serba guna

- versi

- sangat

- volume

- ingin

- adalah

- we

- Kekayaan

- jaringan

- layanan web

- Menimbang

- BAIK

- Apa

- ketika

- yang

- sementara

- lebar

- Rentang luas

- akan

- dengan

- tanpa

- kata

- Kerja

- kerja

- bekerja

- akan

- penulisan

- tahun

- York

- Kamu

- Anda

- zephyrnet.dll

- Zip