Pembelajaran mesin (ML) mengganggu banyak industri dengan kecepatan yang belum pernah terjadi sebelumnya. Industri perawatan kesehatan dan ilmu kehidupan (HCLS) telah mengalami evolusi yang cepat dalam beberapa tahun terakhir dengan merangkul ML di banyak kasus penggunaan untuk memberikan perawatan berkualitas dan meningkatkan hasil pasien.

Dalam siklus hidup ML biasa, insinyur dan ilmuwan data menghabiskan sebagian besar waktu mereka untuk persiapan data dan langkah-langkah rekayasa fitur bahkan sebelum memulai proses pembuatan model dan pelatihan. Memiliki alat yang dapat menurunkan hambatan masuk untuk persiapan data, sehingga meningkatkan produktivitas, adalah permintaan yang sangat diinginkan untuk persona ini. Pengatur Data Amazon SageMaker adalah tujuan yang dibangun oleh AWS untuk mengurangi kurva pembelajaran dan memungkinkan praktisi data menyelesaikan tugas persiapan, pembersihan, dan fitur rekayasa data dengan lebih sedikit usaha dan waktu. Ini menawarkan antarmuka GUI dengan banyak fungsi dan integrasi bawaan dengan layanan AWS lainnya seperti Layanan Penyimpanan Sederhana Amazon (Amazon S3) dan Toko Fitur Amazon SageMaker, serta sumber data mitra termasuk Snowflake dan Databricks.

Dalam posting ini, kami mendemonstrasikan cara menggunakan Data Wrangler untuk menyiapkan data perawatan kesehatan untuk melatih model untuk memprediksi gagal jantung, mengingat demografi pasien, kondisi medis sebelumnya, dan riwayat hasil tes lab.

Ikhtisar solusi

Solusinya terdiri dari langkah-langkah berikut:

- Dapatkan set data perawatan kesehatan sebagai input ke Data Wrangler.

- Gunakan fungsi transformasi bawaan Data Wrangler untuk mengubah kumpulan data. Ini termasuk jatuhkan kolom, tampilkan data/waktu, gabungkan kumpulan data, hitung nilai yang hilang, enkode variabel kategori, skala nilai numerik, seimbangkan kumpulan data, dan banyak lagi.

- Gunakan fungsi transformasi kustom Data Wrangler (kode Panda atau PySpark) untuk melengkapi transformasi tambahan yang diperlukan di luar transformasi bawaan dan mendemonstrasikan ekstensibilitas Data Wrangler. Ini termasuk baris filter, data grup, bentuk kerangka data baru berdasarkan kondisi, dan banyak lagi.

- Gunakan fungsi visualisasi bawaan Data Wrangler untuk melakukan analisis visual. Ini termasuk kebocoran target, korelasi fitur, model cepat, dan banyak lagi.

- Gunakan opsi ekspor bawaan Data Wrangler untuk mengekspor kumpulan data yang diubah ke Amazon S3.

- Luncurkan notebook Jupyter untuk menggunakan kumpulan data yang diubah di Amazon S3 sebagai input untuk melatih model.

Buat kumpulan data

Sekarang setelah kami menyelesaikan pernyataan masalah ML, pertama-tama kami mengarahkan pandangan kami untuk memperoleh data yang kami butuhkan. Studi penelitian seperti Prediksi Gagal Jantung dapat memberikan data yang sudah dalam kondisi baik. Namun, kami sering menghadapi skenario di mana datanya cukup berantakan dan memerlukan penggabungan, pembersihan, dan beberapa transformasi lain yang sangat spesifik untuk domain perawatan kesehatan sebelum dapat digunakan untuk pelatihan ML. Kami ingin menemukan atau menghasilkan data yang cukup berantakan dan memandu Anda melalui langkah-langkah mempersiapkannya menggunakan Data Wrangler. Dengan mengingat hal itu, kami memilih Synthea sebagai alat untuk menghasilkan data sintetis yang sesuai dengan tujuan kami. Sintea adalah generator pasien sintetis sumber terbuka yang memodelkan riwayat medis pasien sintetis. Untuk membuat kumpulan data Anda, selesaikan langkah-langkah berikut:

- Ikuti instruksi sesuai mulai cepat dokumentasi untuk membuat Studio Amazon SageMaker domain dan meluncurkan Studio.

Ini adalah langkah prasyarat. Ini opsional jika Studio sudah disiapkan di akun Anda. - Setelah Studio diluncurkan, pada peluncur tab, pilih Terminal sistem.

Ini meluncurkan sesi terminal yang memberi Anda antarmuka baris perintah untuk digunakan. - Untuk menginstal Synthea dan menghasilkan dataset dalam format CSV, jalankan perintah berikut di sesi terminal yang diluncurkan:

Kami menyediakan parameter untuk menghasilkan kumpulan data dengan ukuran populasi 10,000. Perhatikan parameter ukuran menunjukkan jumlah anggota populasi yang hidup. Selain itu, Synthea juga menghasilkan data untuk anggota populasi yang mati yang mungkin menambahkan beberapa titik data tambahan di atas ukuran sampel yang ditentukan.

Tunggu hingga pembuatan data selesai. Langkah ini biasanya memakan waktu sekitar satu jam atau kurang. Synthea menghasilkan beberapa kumpulan data, termasuk patients, medications, allergies, conditions, dan banyak lagi. Untuk posting ini, kami menggunakan tiga dari kumpulan data yang dihasilkan:

- pasien.csv – Dataset ini berukuran sekitar 3.2 MB dan berisi sekitar 11,000 baris data pasien (25 kolom termasuk ID pasien, tanggal lahir, jenis kelamin, alamat, dan lainnya)

- condition.csv – Dataset ini berukuran sekitar 47 MB dan berisi sekitar 370,000 baris data kondisi medis (enam kolom termasuk ID pasien, tanggal mulai kondisi, kode kondisi, dan banyak lagi)

- observasi.csv – Dataset ini berukuran sekitar 830 MB dan berisi sekitar 5 juta baris data observasi (delapan kolom termasuk ID pasien, tanggal observasi, kode observasi, nilai, dan banyak lagi)

Ada hubungan satu-ke-banyak antara patients dan conditions kumpulan data. Ada juga hubungan satu-ke-banyak antara patients dan observations kumpulan data. Untuk kamus data terperinci, lihat Kamus Data File CSV.

- Untuk mengunggah set data yang dihasilkan ke bucket sumber di Amazon S3, jalankan perintah berikut di sesi terminal:

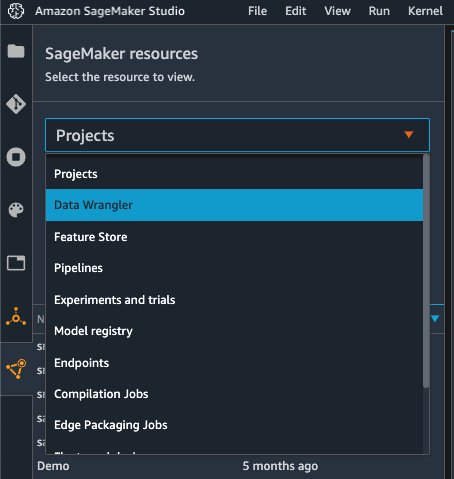

Luncurkan Data Wrangler

Pilih Sumber daya SageMaker di halaman navigasi di Studio dan di Proyek menu, pilih Pengatur Data untuk membuat aliran data Data Wrangler. Untuk langkah-langkah mendetail cara meluncurkan Data Wrangler dari dalam Studio, lihat Memulai dengan Data Wrangler.

Impor data

Untuk mengimpor data Anda, selesaikan langkah-langkah berikut:

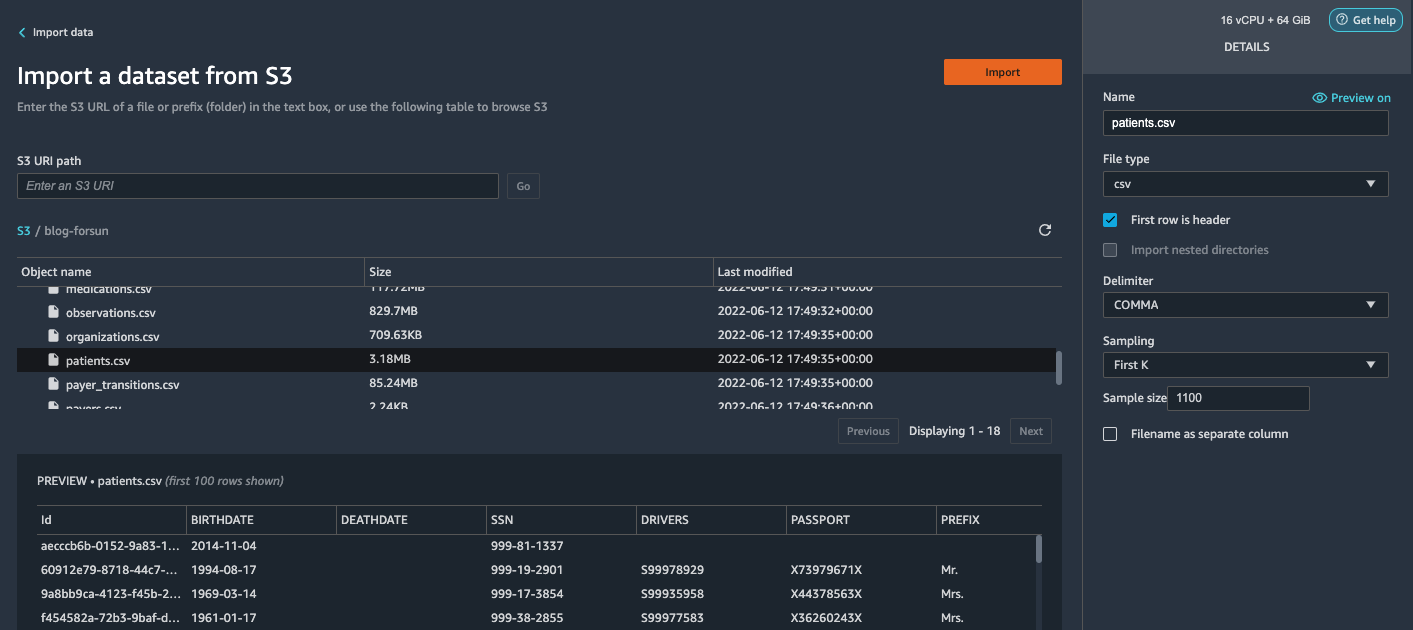

- Pilih Amazon S3 dan temukan file patient.csv di bucket S3.

- Dalam majalah Rincian panel, pilih K . pertama untuk Sampling.

- Enter

1100untuk Ukuran sampel.

Di panel pratinjau, Data Wrangler menarik 100 baris pertama dari kumpulan data dan mencantumkannya sebagai pratinjau. - Pilih impor.

Data Wrangler memilih 1,100 pasien pertama dari total pasien (11,000 baris) yang dihasilkan oleh Synthea dan mengimpor data. Pendekatan sampling memungkinkan Data Wrangler hanya memproses data sampel. Ini memungkinkan kami untuk mengembangkan aliran data kami dengan kumpulan data yang lebih kecil, yang menghasilkan pemrosesan yang lebih cepat dan putaran umpan balik yang lebih pendek. Setelah kami membuat aliran data, kami dapat mengirimkan resep yang dikembangkan ke a Pemrosesan SageMaker pekerjaan untuk menskalakan pemrosesan secara horizontal untuk kumpulan data penuh atau lebih besar secara terdistribusi.

- Ulangi proses ini untuk

conditionsdanobservationsdataset.- Untuk

conditionskumpulan data, masukkan37000untuk Ukuran sampel, yang merupakan 1/10 dari total 370,000 baris yang dihasilkan oleh Synthea. - Untuk

observationskumpulan data, masukkan500000untuk Ukuran sampel, yang merupakan 1/10 dari total pengamatan 5 juta baris yang dihasilkan oleh Synthea.

- Untuk

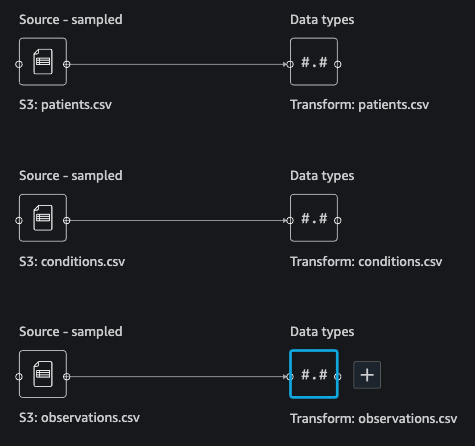

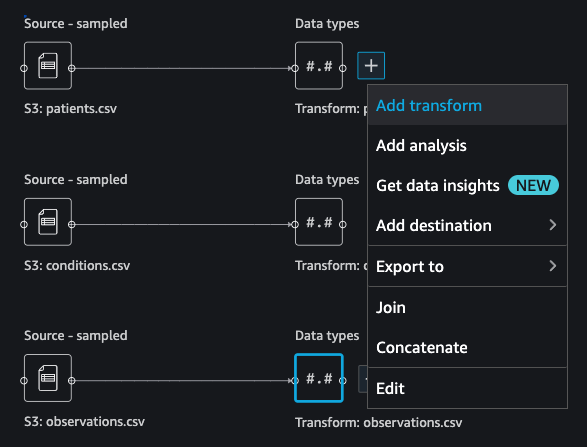

Anda akan melihat tiga kumpulan data seperti yang ditunjukkan pada tangkapan layar berikut.

Ubah datanya

Transformasi data adalah proses mengubah struktur, nilai, atau format dari satu atau lebih kolom dalam kumpulan data. Proses ini biasanya dikembangkan oleh seorang insinyur data dan dapat menjadi tantangan bagi orang-orang dengan keahlian teknik data yang lebih kecil untuk menguraikan logika yang diusulkan untuk transformasi. Transformasi data adalah bagian dari proses rekayasa fitur yang lebih luas, dan urutan langkah yang benar adalah kriteria penting lainnya yang perlu diingat saat merancang resep semacam itu.

Data Wrangler dirancang untuk menjadi alat kode rendah untuk mengurangi hambatan masuk untuk persiapan data yang efektif. Muncul dengan lebih dari 300 transformasi data yang telah dikonfigurasikan untuk Anda pilih tanpa menulis satu baris kode pun. Di bagian berikut, kita melihat cara mengubah set data yang diimpor di Data Wrangler.

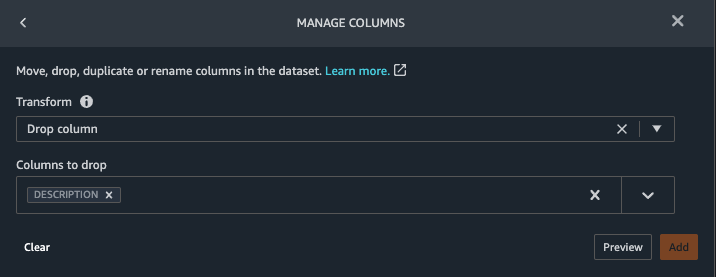

Jatuhkan kolom di patient.csv

Kami pertama-tama menjatuhkan beberapa kolom dari patients Himpunan data. Menghapus kolom yang berlebihan akan menghapus informasi yang tidak relevan dari kumpulan data dan membantu kami mengurangi jumlah sumber daya komputasi yang diperlukan untuk memproses kumpulan data dan melatih model. Di bagian ini, kami menjatuhkan kolom seperti SSN atau nomor paspor berdasarkan akal sehat bahwa kolom ini tidak memiliki nilai prediksi. Dengan kata lain, mereka tidak membantu model kami memprediksi gagal jantung. Studi kami juga tidak mempermasalahkan kolom lain seperti tempat lahir atau pengaruh biaya perawatan kesehatan terhadap gagal jantung pasien, jadi kami juga menghapusnya. Kolom redundan juga dapat diidentifikasi dengan menjalankan analisis bawaan seperti kebocoran target, korelasi fitur, multikolinearitas, dan banyak lagi, yang dibangun ke dalam Data Wrangler. Untuk detail lebih lanjut tentang jenis analisis yang didukung, lihat Analisis dan Visualisasikan. Selain itu, Anda dapat menggunakan Kualitas Data dan Laporan Wawasan untuk melakukan analisis otomatis pada kumpulan data untuk sampai pada daftar kolom yang berlebihan untuk dihilangkan.

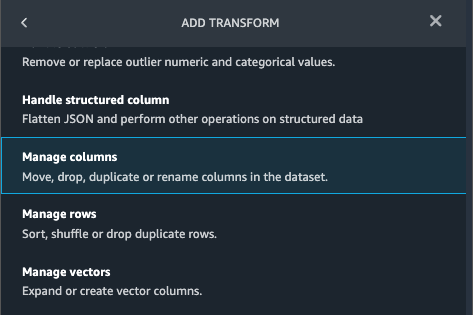

- Pilih tanda plus di sebelah Tipe data untuk dataset patient.csv dan pilih Tambahkan transformasi.

- Pilih Tambahkan langkah Dan pilihlah Kelola kolom.

- Untuk Mengubah¸ pilih Jatuhkan kolom.

- Untuk Kolom untuk dijatuhkan, pilih kolom berikut:

SSNDRIVERSPASSPORTPREFIXFIRSTLASTSUFFIXMAIDENRACEETHNICITYBIRTHPLACEADDRESSCITYSTATECOUNTYZIPLATLONHEALTHCARE_EXPENSESHEALTHCARE_COVERAGE

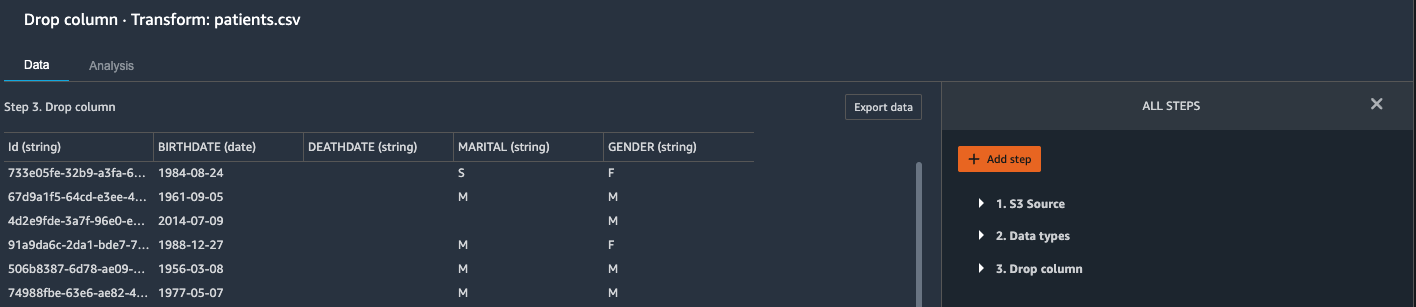

- Pilih Preview untuk meninjau kumpulan data yang diubah, lalu pilih Add.

Anda harus melihat langkahnya Jatuhkan kolom dalam daftar transformasi Anda.

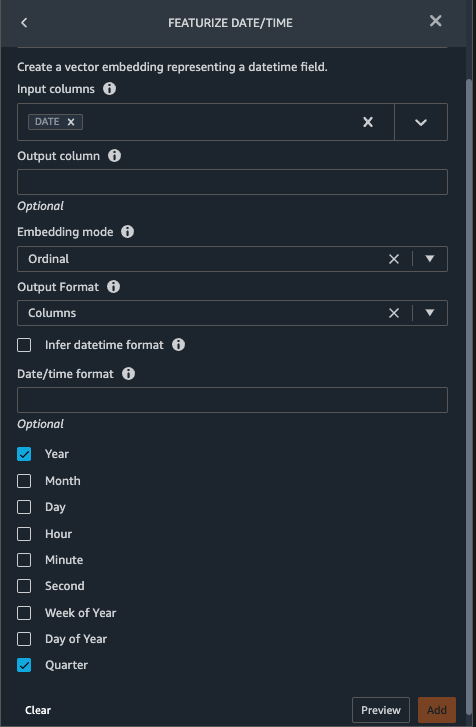

Menampilkan tanggal/waktu di patient.csv

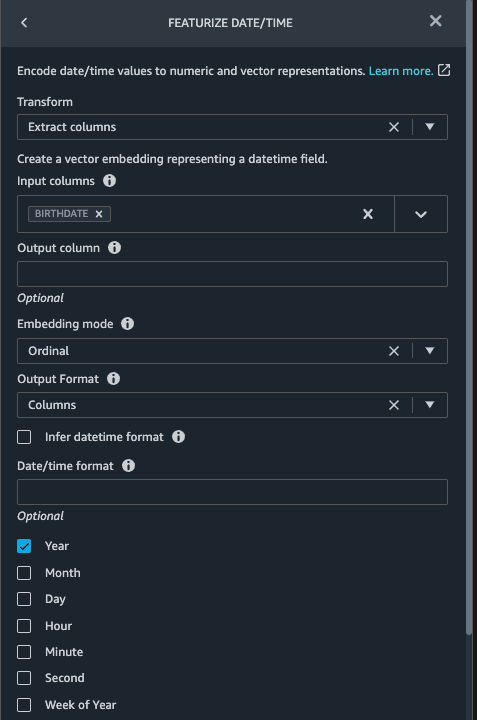

Sekarang kami menggunakan fungsi Feature date/time untuk menghasilkan fitur baru Year dari BIRTHDATE kolom di patients Himpunan data. Kami menggunakan fitur baru pada langkah selanjutnya untuk menghitung usia pasien pada saat observasi berlangsung.

- Dalam majalah Transformasi panel Anda Jatuhkan kolom halaman untuk

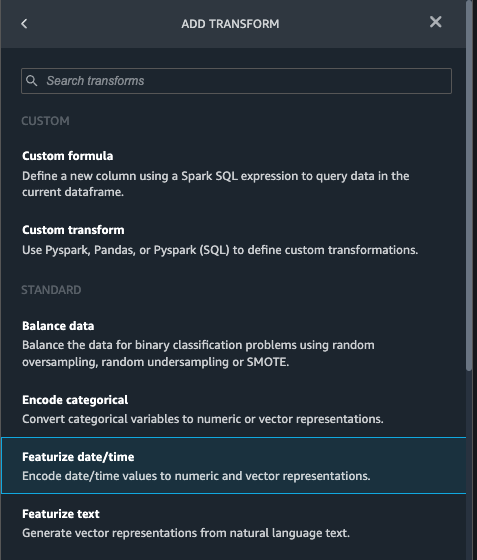

patientskumpulan data, pilih Tambahkan langkah. - Pilih Menampilkan tanggal/waktu mengubah.

- Pilih Ekstrak kolom.

- Untuk Kolom masukan, tambahkan kolom

BIRTHDATE. - Pilih Tahun dan hapus pilihan Bulan, Hari, jam, Menit, Kedua.

- Pilih Preview, Lalu pilih Add.

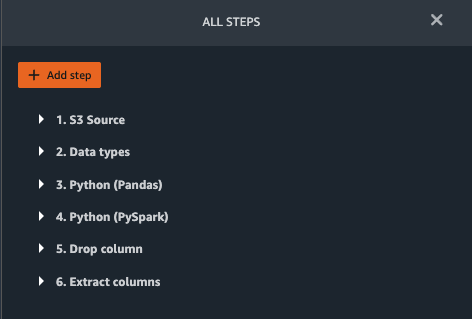

Tambahkan transformasi di observasi.csv

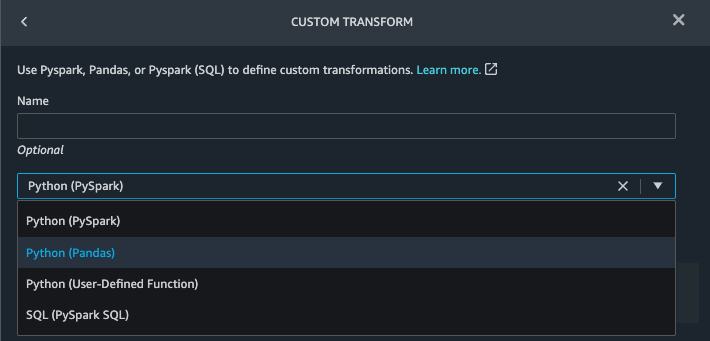

Data Wrangler mendukung transformasi kustom menggunakan Python (fungsi yang ditentukan pengguna), PySpark, Pandas, atau PySpark (SQL). Anda dapat memilih jenis transformasi Anda berdasarkan keakraban Anda dengan setiap opsi dan preferensi. Untuk tiga opsi terakhir, Data Wrangler mengekspos variabel df bagi Anda untuk mengakses kerangka data dan menerapkan transformasi di atasnya. Untuk penjelasan rinci dan contoh, lihat Transformasi Kustom. Di bagian ini, kami menambahkan tiga transformasi khusus ke observations Himpunan data.

- Tambahkan transformasi ke observasi.csv dan lepaskan

DESCRIPTIONkolom.

- Pilih Preview, Lalu pilih Add.

- Dalam majalah Transformasi panel, pilih Tambahkan langkah Dan pilihlah Transformasi kustom.

- Di menu drop-down, pilih Python (Panda).

- Masukkan kode berikut:

Ini adalah kode LONIC yang sesuai dengan pengamatan berikut yang ingin kami gunakan sebagai fitur untuk memprediksi gagal jantung:

- Pilih Preview, Lalu pilih Add.

- Tambahkan transformasi untuk mengekstrak

YeardanQuarterdariDATEkolom.

- Pilih Preview, Lalu pilih Add.

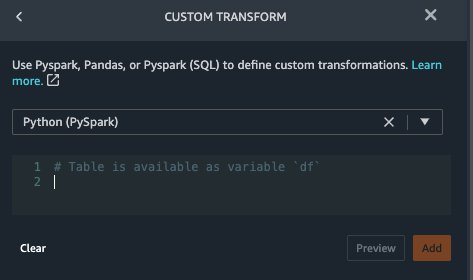

- Pilih Tambahkan langkah Dan pilihlah Transformasi kustom.

- Di menu drop-down, pilih Piton (PySpark).

Lima jenis pengamatan mungkin tidak selalu dicatat pada tanggal yang sama. Misalnya, seorang pasien dapat mengunjungi dokter keluarga mereka pada tanggal 21 Januari dan mengukur dan mencatat tekanan darah sistolik, tekanan darah diastolik, detak jantung, dan indeks massa tubuh. Namun, tes laboratorium yang mencakup trombosit dapat dilakukan di kemudian hari pada 2 Februari. Oleh karena itu, tidak selalu mungkin untuk menggabungkan kerangka data pada tanggal pengamatan. Di sini kami menggabungkan kerangka data dengan perincian kasar pada basis kuartal. - Masukkan kode berikut:

- Pilih Preview, Lalu pilih Add.

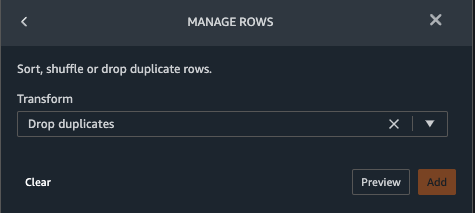

- Pilih Tambahkan langkah, Lalu pilih Kelola baris.

- Untuk Mengubah, pilih Jatuhkan duplikat.

- Pilih Preview, Lalu pilih Add.

- Pilih Tambahkan langkah Dan pilihlah Transformasi kustom.

- Di menu drop-down, pilih Python (Panda).

- Masukkan kode berikut untuk mengambil rata-rata titik data yang memiliki nilai waktu yang sama:

- Pilih Preview, Lalu pilih Add.

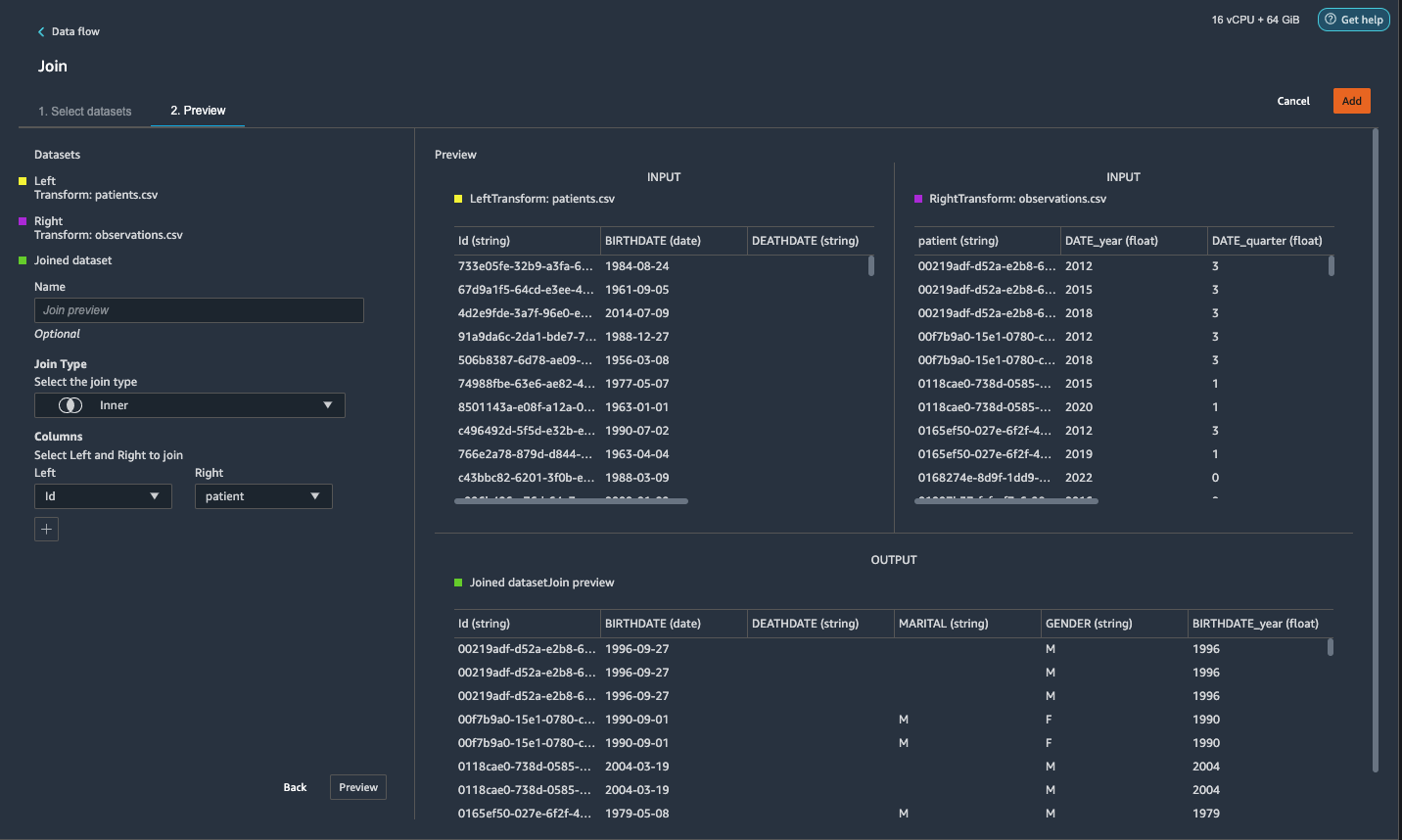

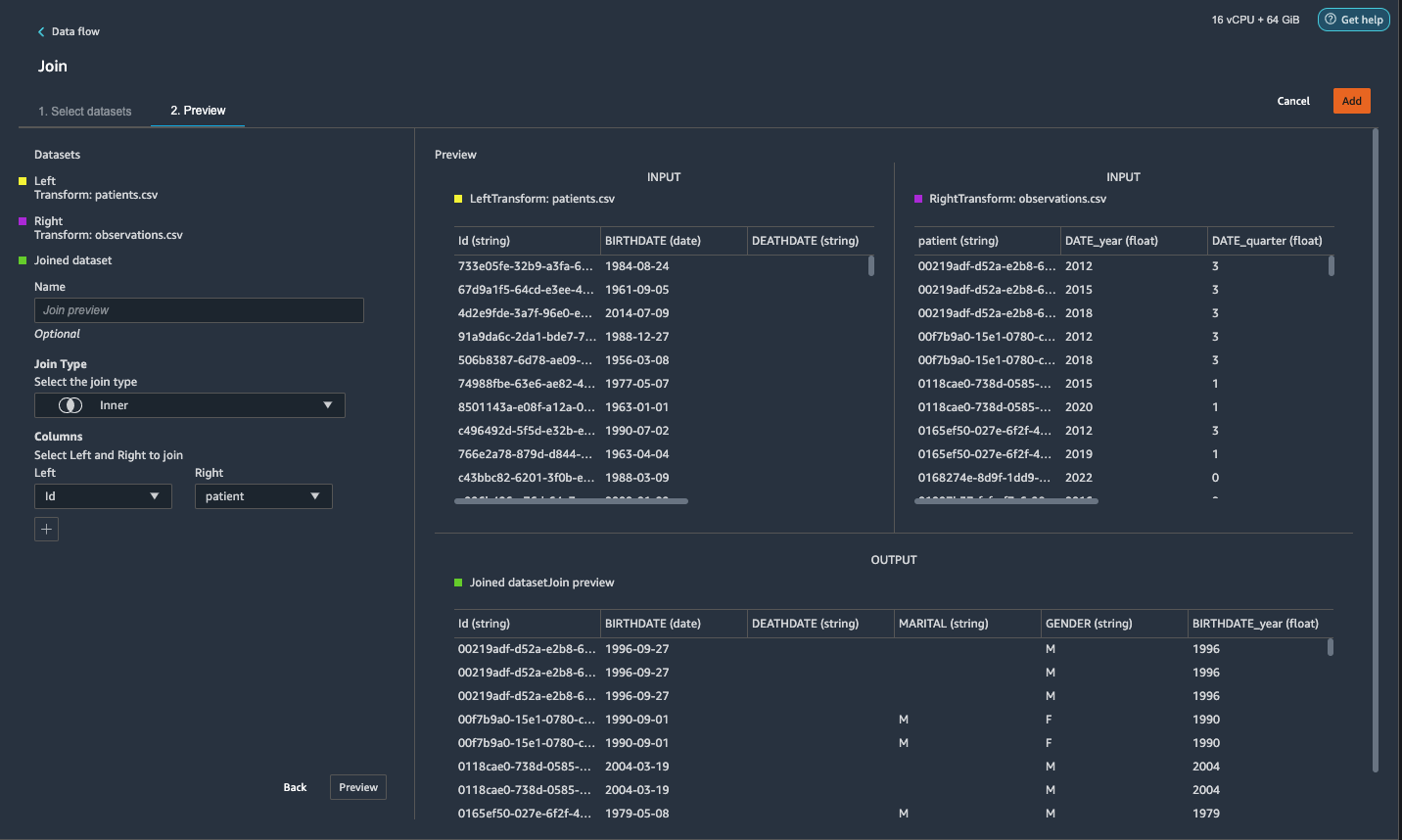

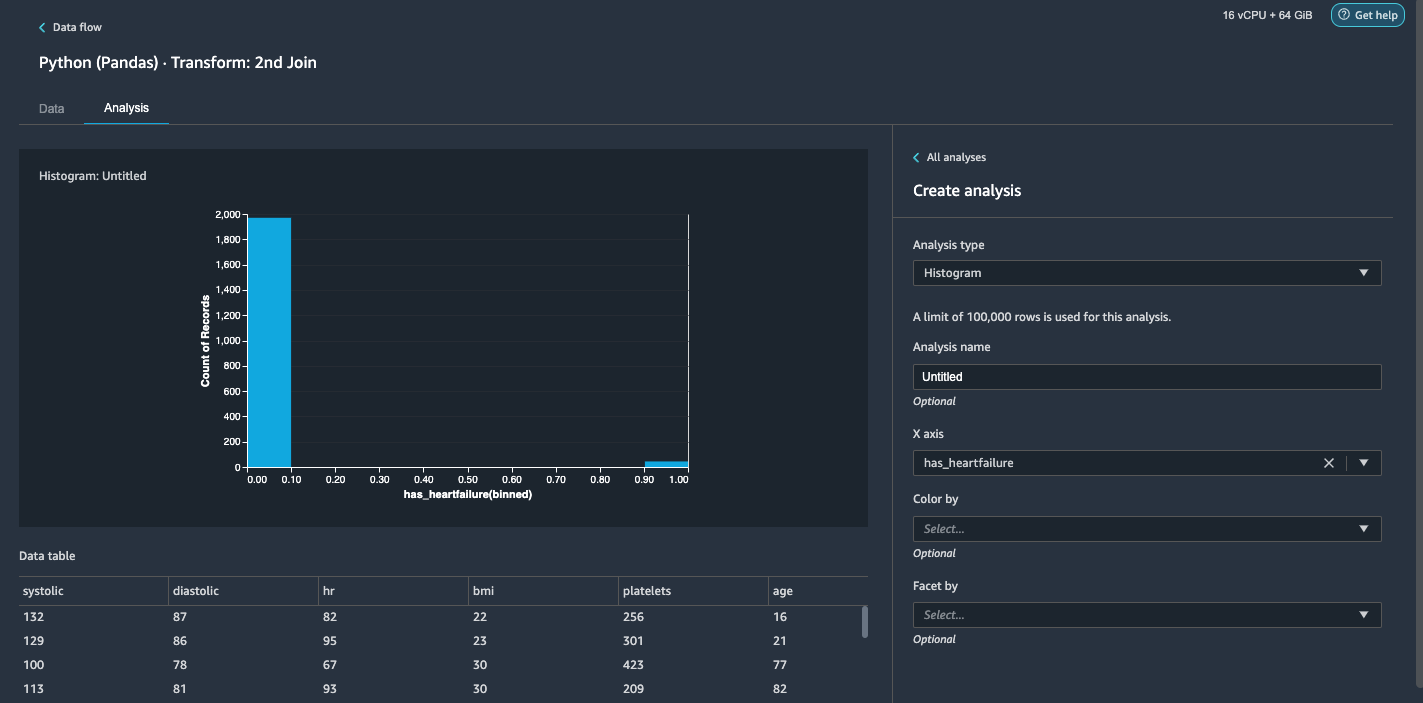

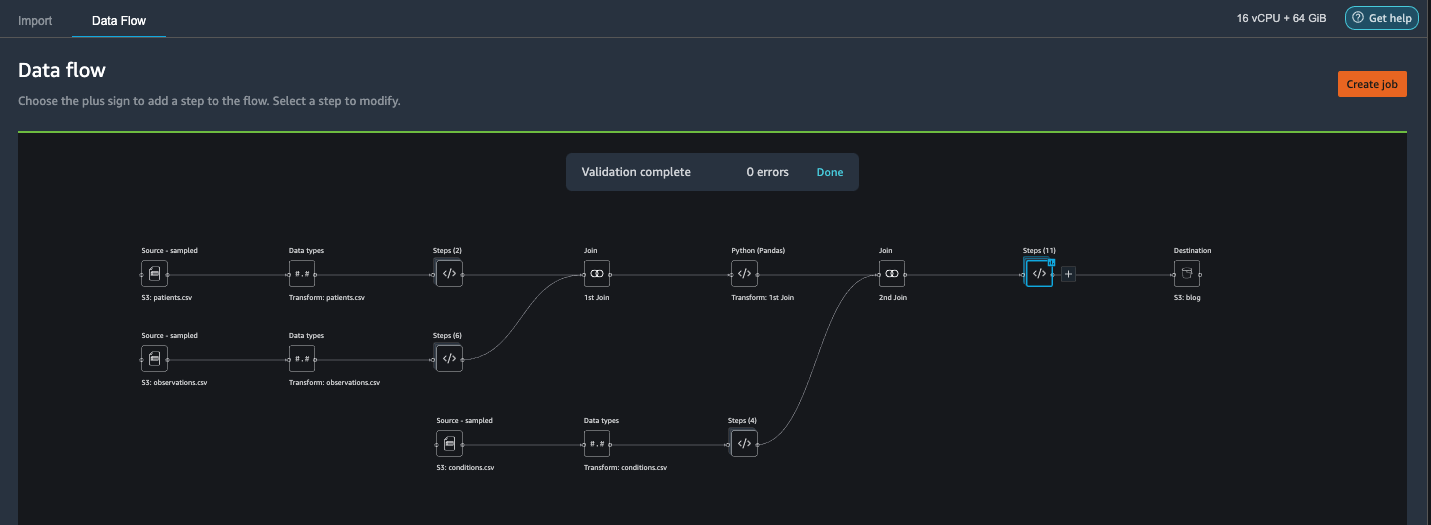

Bergabunglah dengan patient.csv dan observasi.csv

Pada langkah ini, kami menunjukkan cara melakukan penggabungan kompleks secara efektif dan mudah pada kumpulan data tanpa menulis kode apa pun melalui UI Data Wrangler yang kuat. Untuk mempelajari lebih lanjut tentang jenis gabungan yang didukung, lihat Transformasi Data.

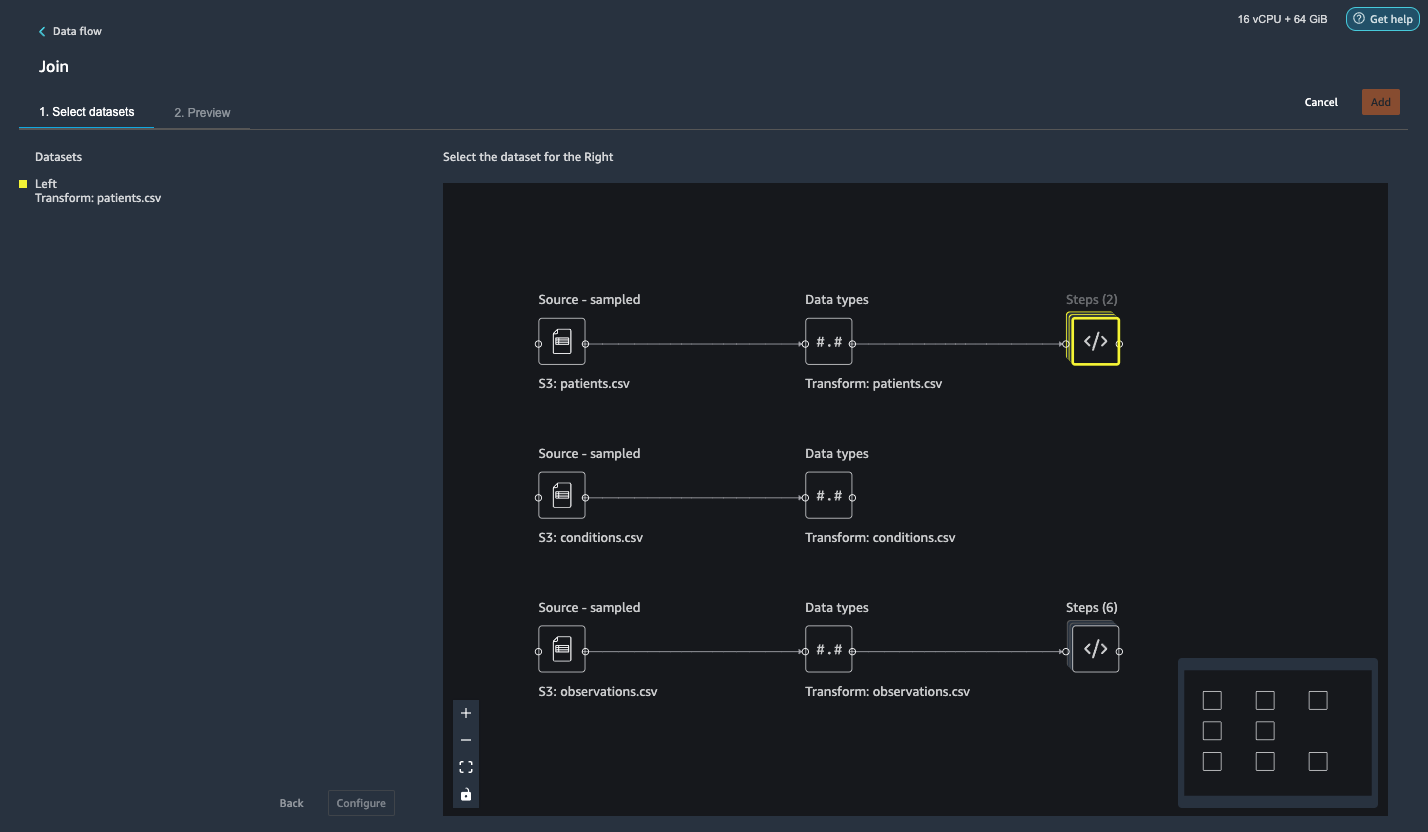

- Di sebelah kanan dari Transform: patient.csv, pilih tanda plus di sebelah Tangga Dan pilihlah Ikuti seminar.

Anda dapat melihat file patient.csv yang diubah terdaftar di bawah Dataset di sebelah kiri.

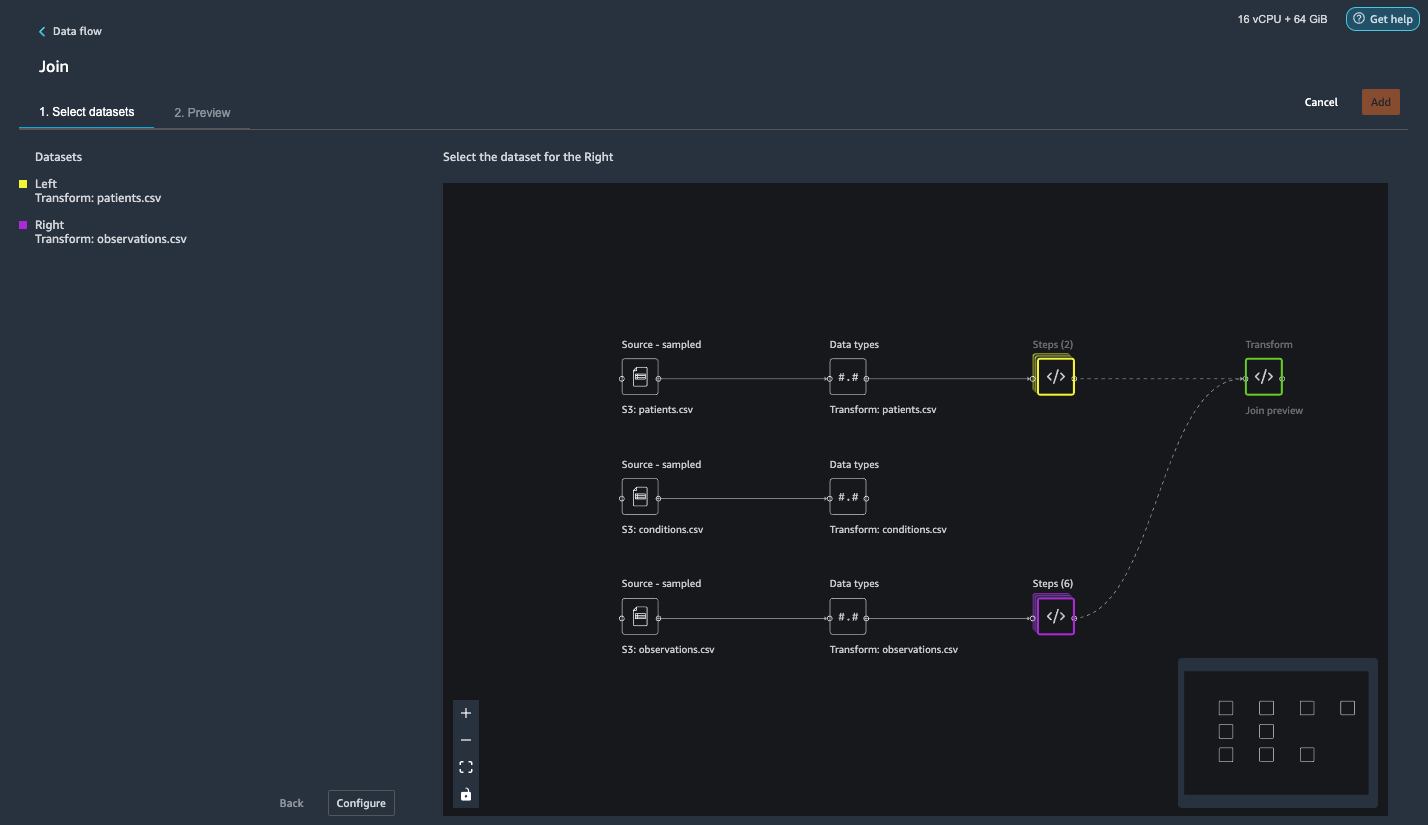

- Di sebelah kanan dari Transformasi: observasi.csv, Klik pada Tangga untuk memulai operasi gabungan.

File observasi.csv yang diubah sekarang terdaftar di bawah Dataset di sebelah kiri.

- Pilih Konfigurasi.

- Untuk Tipe Gabung, pilih Batin.

- Untuk kiri, pilih Id.

- Untuk Kanan, pilih pasien.

- Pilih Preview, Lalu pilih Add.

Tambahkan transformasi khusus ke kumpulan data yang digabungkan

Pada langkah ini, kami menghitung usia pasien pada saat observasi. Kami juga menjatuhkan kolom yang tidak lagi diperlukan.

- Pilih tanda plus di sebelah Gabung Pertama Dan pilihlah Tambahkan transformasi.

- Tambahkan transformasi khusus di Pandas:

- Pilih Preview, Lalu pilih Add.

Tambahkan transformasi khusus ke conditions.csv

- Pilih tanda plus di sebelah Transformasi: condition.csv Dan pilihlah Tambahkan transformasi.

- Tambahkan transformasi khusus di Pandas:

Catatan: Seperti yang kami tunjukkan sebelumnya, Anda dapat menghapus kolom baik menggunakan kode kustom atau menggunakan transformasi bawaan yang disediakan oleh Data Wrangler. Transformasi khusus dalam Data Wrangler memberikan fleksibilitas untuk menghadirkan logika transformasi Anda sendiri dalam bentuk cuplikan kode dalam kerangka kerja yang didukung. Cuplikan ini nantinya dapat dicari dan diterapkan jika diperlukan.

Kode dalam transformasi sebelumnya adalah kode SNOMED-CT yang sesuai dengan kondisi berikut. Itu heart failure or chronic congestive heart failure kondisi menjadi label. Kami menggunakan kondisi yang tersisa sebagai fitur untuk memprediksi gagal jantung. Kami juga menjatuhkan beberapa kolom yang tidak lagi diperlukan.

- Selanjutnya, mari tambahkan transformasi khusus di PySpark:

Kami melakukan gabungan luar kiri untuk menyimpan semua entri dalam kerangka data gagal jantung. Kolom baru

has_xxxdihitung untuk setiap kondisi selain gagal jantung berdasarkan tanggal mulai kondisi tersebut. Kami hanya tertarik pada kondisi medis yang dicatat sebelum gagal jantung dan menggunakannya sebagai fitur untuk memprediksi gagal jantung. - Tambahkan built-in Kelola kolom transform untuk membuang kolom redundan yang tidak lagi diperlukan:

hypertensiondiabetescoronarysmokeatrial

- Ekstrak

YeardanQuarterdariheartfailurekolom.

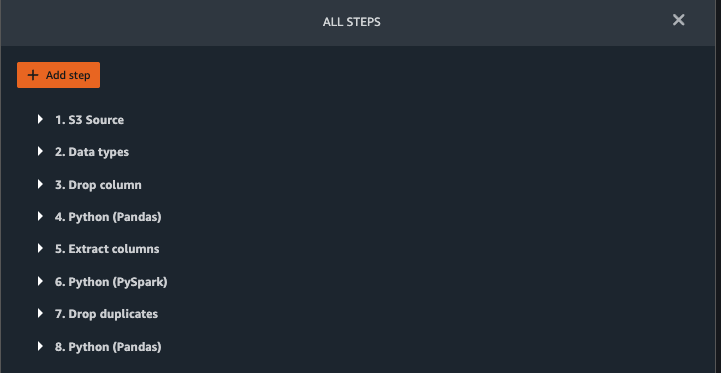

Ini cocok dengan perincian yang kami gunakan sebelumnya dalam transformasiobservationsHimpunan data. - Kita harus memiliki total 6 langkah untuk conditions.csv.

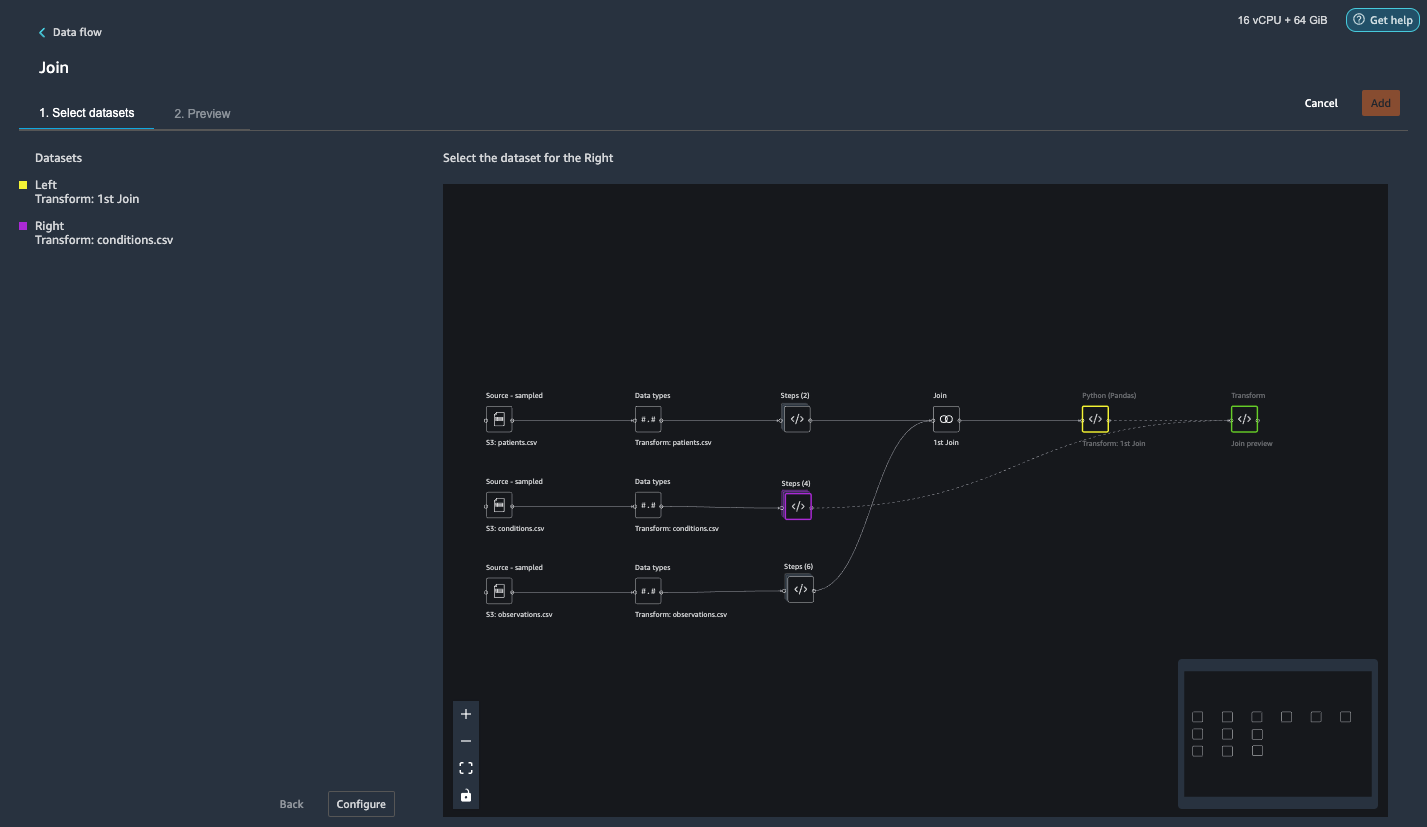

Bergabunglah dengan conditions.csv ke kumpulan data yang digabungkan

Kami sekarang melakukan penggabungan baru untuk menggabungkan kumpulan data kondisi ke yang bergabung patients dan observations Himpunan data.

- Pilih Transformasi: Gabung Pertama.

- Pilih tanda plus dan pilih Ikuti seminar.

- Pilih Tangga sebelah Transformasi: condition.csv.

- Pilih Konfigurasi.

- Untuk Tipe Gabung, pilih Kiri luar.

- Untuk kiri, pilih Id.

- Untuk Kanan, pilih pasien.

- Pilih Preview, Lalu pilih Add.

Tambahkan transformasi ke kumpulan data yang digabungkan

Sekarang kita telah menggabungkan ketiga kumpulan data, mari kita terapkan beberapa transformasi tambahan.

- Tambahkan transformasi khusus berikut di PySpark jadi

has_heartfailuremenjadi kolom label kami: - Tambahkan transformasi khusus berikut di PySpark:

- Jatuhkan kolom berlebihan yang tidak lagi diperlukan:

IdDATE_yearDATE_quarterpatientheartfailureheartfailure_yearheartfailure_quarter

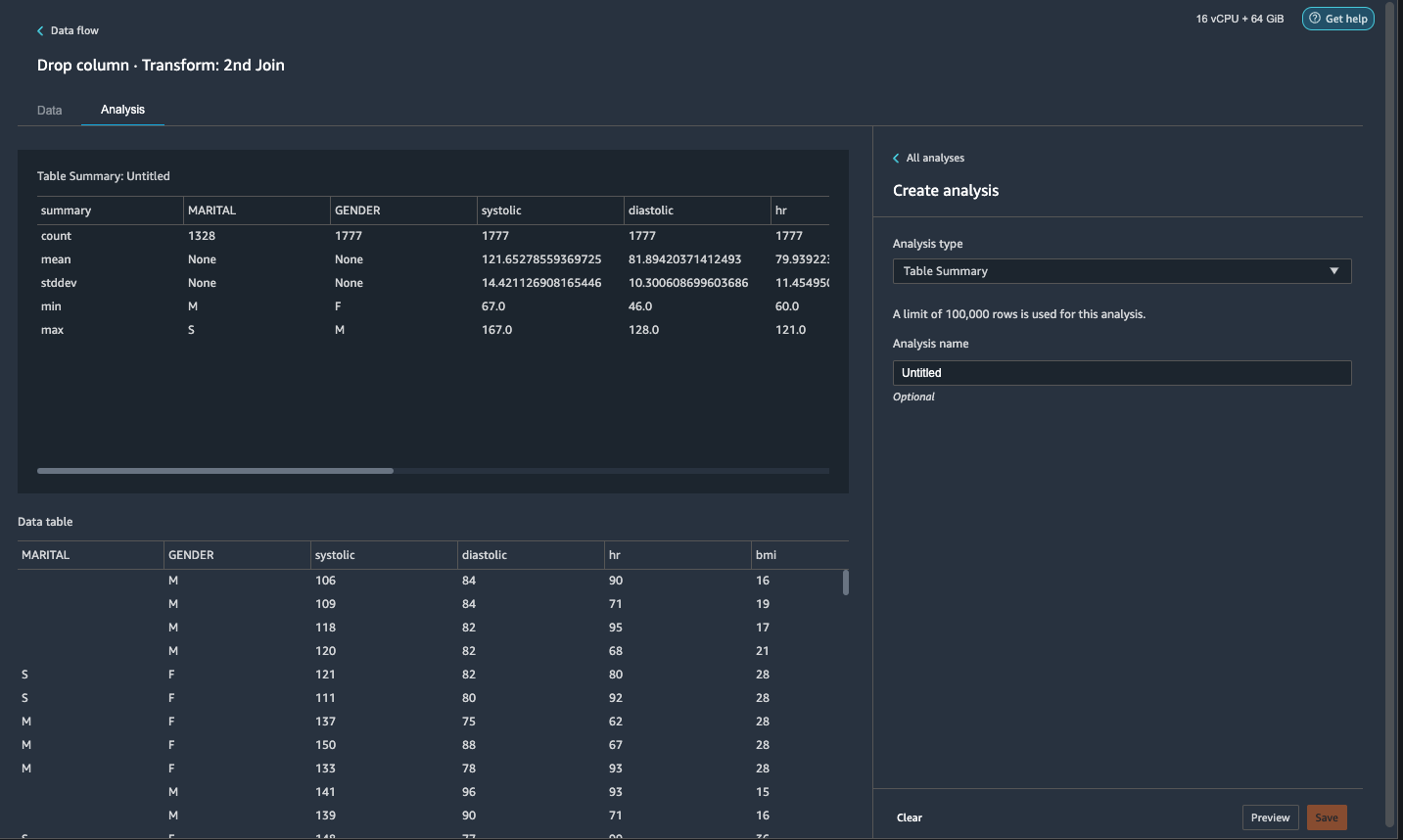

- pada Analisis tab, untuk Jenis analisis¸ pilih Ringkasan tabel.

Pemindaian cepat melalui ringkasan menunjukkan bahwaMARITALkolom memiliki data yang hilang.

- Pilih Data tab dan tambahkan satu langkah.

- Pilih Menangani Hilang.

- Untuk Mengubah, pilih Isi yang hilang.

- Untuk Kolom masukan, pilih PERNIKAHAN.

- Untuk Isi nilai, Masuk

S.

Strategi kami di sini adalah menganggap pasien lajang jika status perkawinan memiliki nilai yang hilang. Anda dapat memiliki strategi yang berbeda.

- Pilih Preview, Lalu pilih Add.

- Isi nilai yang hilang sebagai 0 untuk

has_hypertension,has_diabetes,has_coronary,has_smoke,has_atrial.

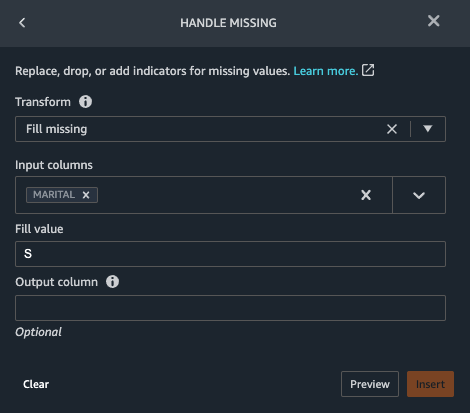

Marital dan Gender adalah variabel kategori. Data Wrangler memiliki fungsi bawaan untuk mengkodekan variabel kategori.

- Tambahkan satu langkah dan pilih Enkode kategori.

- Untuk Mengubah, pilih Enkode satu-panas.

- Untuk Kolom masukan, pilih PERNIKAHAN.

- Untuk Gaya keluaran, pilih Kolom.

Gaya keluaran ini menghasilkan nilai yang disandikan dalam kolom terpisah.

- Pilih Preview, Lalu pilih Add.

- Ulangi langkah ini untuk Gender kolom.

Pengkodean satu-panas membagi kolom Perkawinan menjadi Marital_M (menikah) dan Marital_S (tunggal), dan membagi kolom Gender menjadi Gender_M (laki-laki) dan Gender_F (Perempuan). Karena Marital_M dan Marital_S saling eksklusif (seperti Gender_M dan Gender_F), kita dapat menjatuhkan satu kolom untuk menghindari fitur yang berlebihan.

- Menjatuhkan

Marital_SdanGender_F.

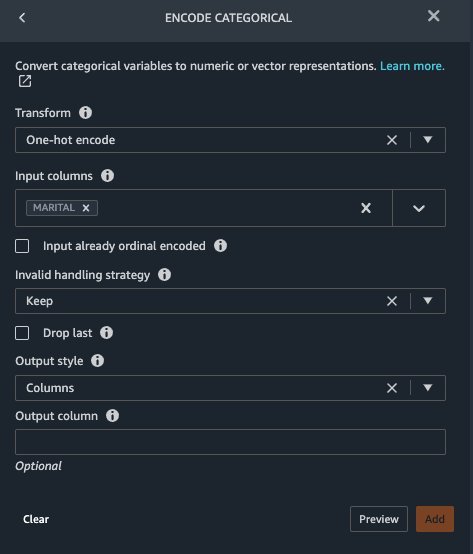

Fitur numerik seperti sistolik, detak jantung, dan usia memiliki standar satuan yang berbeda. Untuk model berbasis regresi linier, kita perlu menormalkan fitur numerik ini terlebih dahulu. Jika tidak, beberapa fitur dengan nilai absolut yang lebih tinggi mungkin memiliki keunggulan yang tidak beralasan dibandingkan fitur lain dengan nilai absolut yang lebih rendah dan menghasilkan kinerja model yang buruk. Data Wrangler memiliki built-in transform min-max scaler untuk menormalkan data. Untuk model klasifikasi berbasis pohon keputusan, normalisasi tidak diperlukan. Studi kami adalah masalah klasifikasi sehingga kami tidak perlu menerapkan normalisasi. Kelas yang tidak seimbang adalah masalah umum dalam klasifikasi. Ketidakseimbangan terjadi ketika dataset pelatihan berisi distribusi kelas yang sangat miring. Misalnya, ketika dataset kami berisi lebih banyak pasien tanpa gagal jantung secara tidak proporsional daripada pasien dengan gagal jantung, ini dapat menyebabkan model menjadi bias dalam memprediksi tidak ada gagal jantung dan berkinerja buruk. Data Wrangler memiliki fungsi bawaan untuk mengatasi masalah tersebut.

- Tambahkan transformasi khusus di Pandas untuk mengonversi tipe data kolom dari tipe "objek" ke tipe numerik:

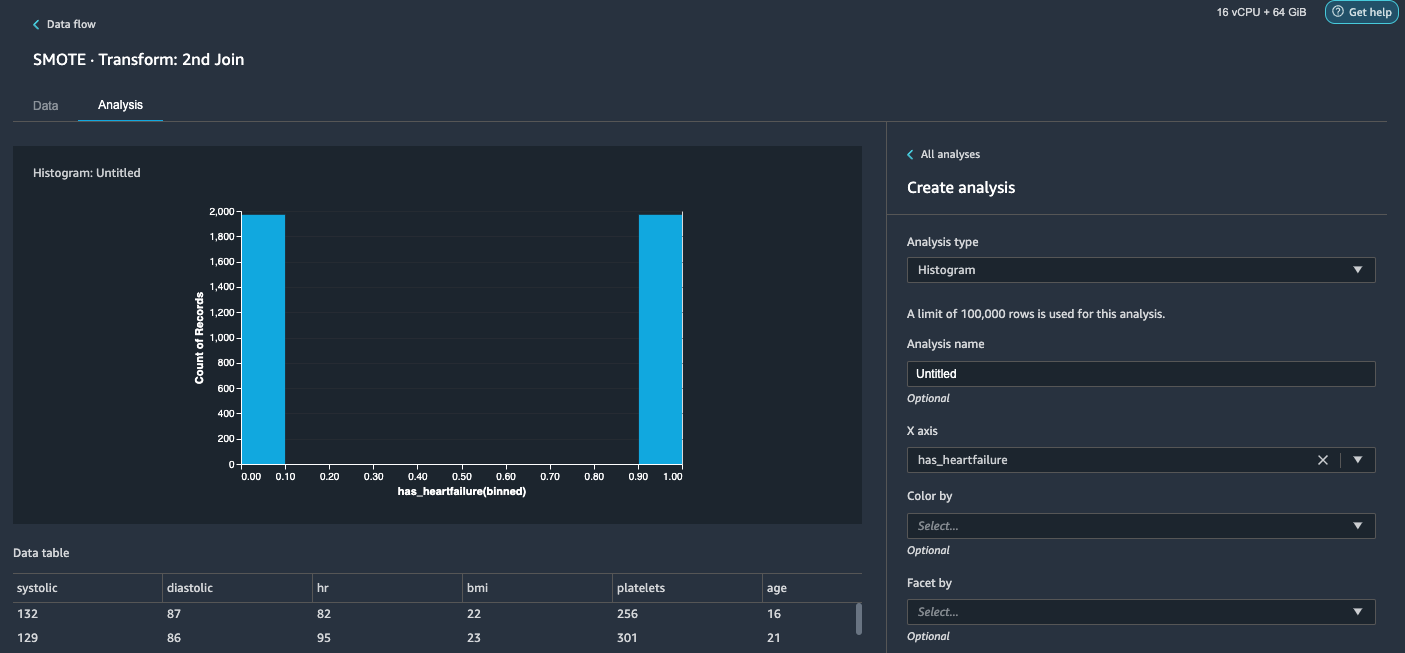

- Pilih Analisis Tab.

- Untuk Jenis analisis¸ pilih Histogram.

- Untuk sumbu X, pilih memiliki_gagal jantung.

- Pilih Preview.

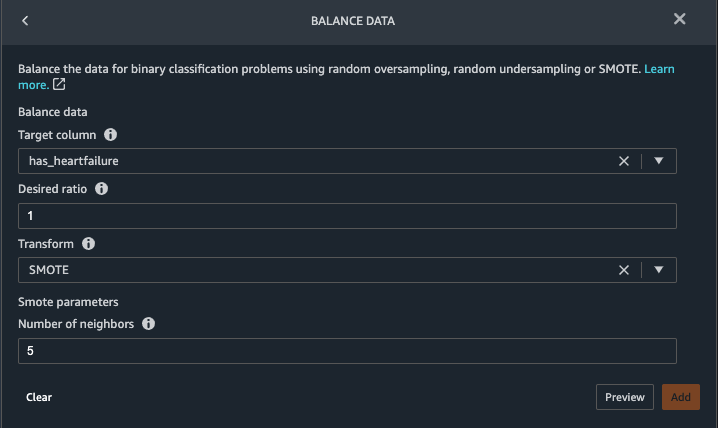

Jelas bahwa kami memiliki kelas yang tidak seimbang (lebih banyak titik data yang diberi label tidak ada gagal jantung daripada titik data yang diberi label gagal jantung). - Kembali ke Data tab. Memilih Tambahkan langkah Dan pilihlah data saldo.

- Untuk Kolom sasaran, pilih memiliki_gagal jantung.

- Untuk Rasio yang diinginkan, Masuk

1. - Untuk Mengubah, pilih HALUS.

SMOTE adalah singkatan dari Synthetic Minority Over-sampling Technique. Ini adalah teknik untuk membuat instance minoritas baru dan menambah dataset untuk mencapai keseimbangan kelas. Untuk informasi rinci, lihat SMOTE: Teknik Over-sampling Minoritas Sintetis. - Pilih Preview, Lalu pilih Add.

- Ulangi analisis histogram pada langkah 20-23. Hasilnya adalah kelas yang seimbang.

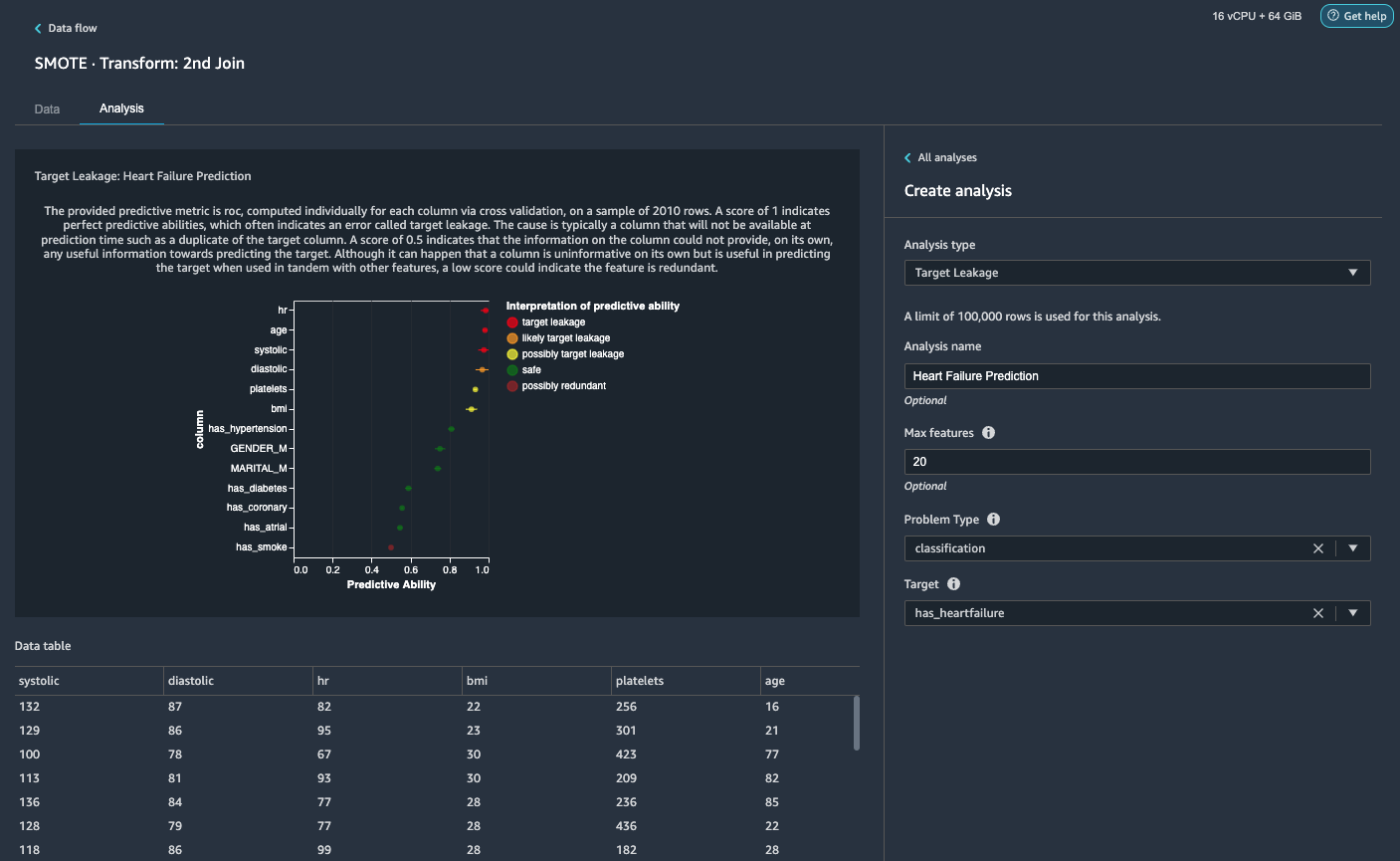

Visualisasikan kebocoran target dan korelasi fitur

Selanjutnya, kita akan melakukan beberapa analisis visual menggunakan perangkat yang kaya dari Data Wrangler untuk jenis analisis yang didukung ML tingkat lanjut. Pertama, kita melihat target kebocoran. Kebocoran target terjadi ketika data dalam set data pelatihan berkorelasi kuat dengan label target, tetapi tidak tersedia dalam data dunia nyata pada waktu inferensi.

- pada tab analisis, Untuk Jenis analisis¸ pilih Kebocoran Target.

- Untuk Jenis Masalah, pilih klasifikasi.

- Untuk target, pilih memiliki_gagal jantung.

- Pilih Preview.

Berdasarkan analisis tersebut,hradalah kebocoran target. Kami akan menjatuhkannya di langkah berikutnya.ageditandai sebagai kebocoran target. Masuk akal untuk mengatakan bahwa usia pasien akan tersedia selama waktu inferensi, jadi kami menjaga usia sebagai fitur.Systolicdandiastolicjuga ditandai sebagai kemungkinan kebocoran target. Kami berharap memiliki dua pengukuran selama waktu inferensi, jadi kami menyimpannya sebagai fitur. - Pilih Add untuk menambahkan analisis.

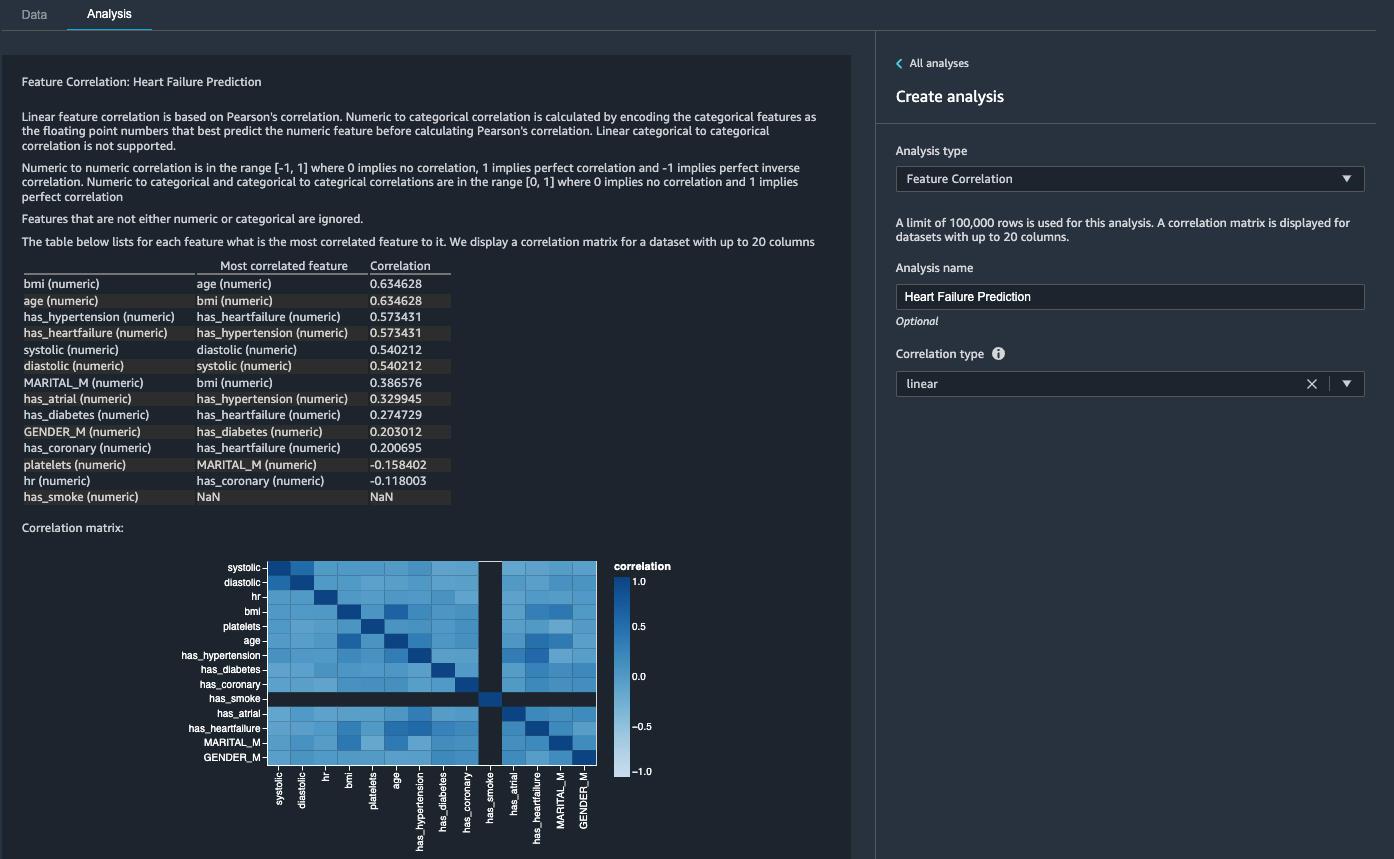

Kemudian, kita melihat korelasi fitur. Kami ingin memilih fitur yang berkorelasi dengan target tetapi tidak berkorelasi di antara mereka sendiri.

- pada tab analisis, Untuk Jenis analisis¸ pilih Korelasi Fitur.

- Untuk Jenis Korelasi¸ pilih linear.

- Pilih Preview.

Skor koefisien menunjukkan korelasi yang kuat antara pasangan berikut:

systolicdandiastolicbmidanagehas_hypertensiondanhas_heartfailure(label)

Untuk fitur yang berkorelasi kuat, matriks sulit untuk dibalik secara komputasi, yang dapat menyebabkan perkiraan yang tidak stabil secara numerik. Untuk mengurangi korelasi, kita cukup menghapus satu dari pasangan. Kami menjatuhkan diastolic dan bmi dan menjaga systolic dan age dalam langkah selanjutnya.

Jatuhkan kolom diastolik dan bmi

Tambahkan langkah transformasi tambahan untuk menjatuhkan hr, diastolic dan bmi kolom menggunakan transformasi bawaan.

Hasilkan Kualitas Data dan Laporan Wawasan

AWS baru-baru ini mengumumkan fitur Kualitas Data dan Laporan Wawasan baru di Data Wrangler. Laporan ini secara otomatis memverifikasi kualitas data dan mendeteksi kelainan pada data Anda. Ilmuwan data dan insinyur data dapat menggunakan alat ini untuk secara efisien dan cepat menerapkan pengetahuan domain guna memproses set data untuk pelatihan model ML. Langkah ini opsional. Untuk membuat laporan ini pada kumpulan data kami, selesaikan langkah-langkah berikut:

- pada Analisis tab, untuk Jenis analisis, pilih Kualitas Data dan Laporan Wawasan.

- Untuk Kolom sasaran, pilih memiliki_gagal jantung.

- Untuk Jenis masalah, pilih Klasifikasi.

- Pilih membuat.

Dalam beberapa menit, ini menghasilkan laporan dengan ringkasan, visual, dan rekomendasi.

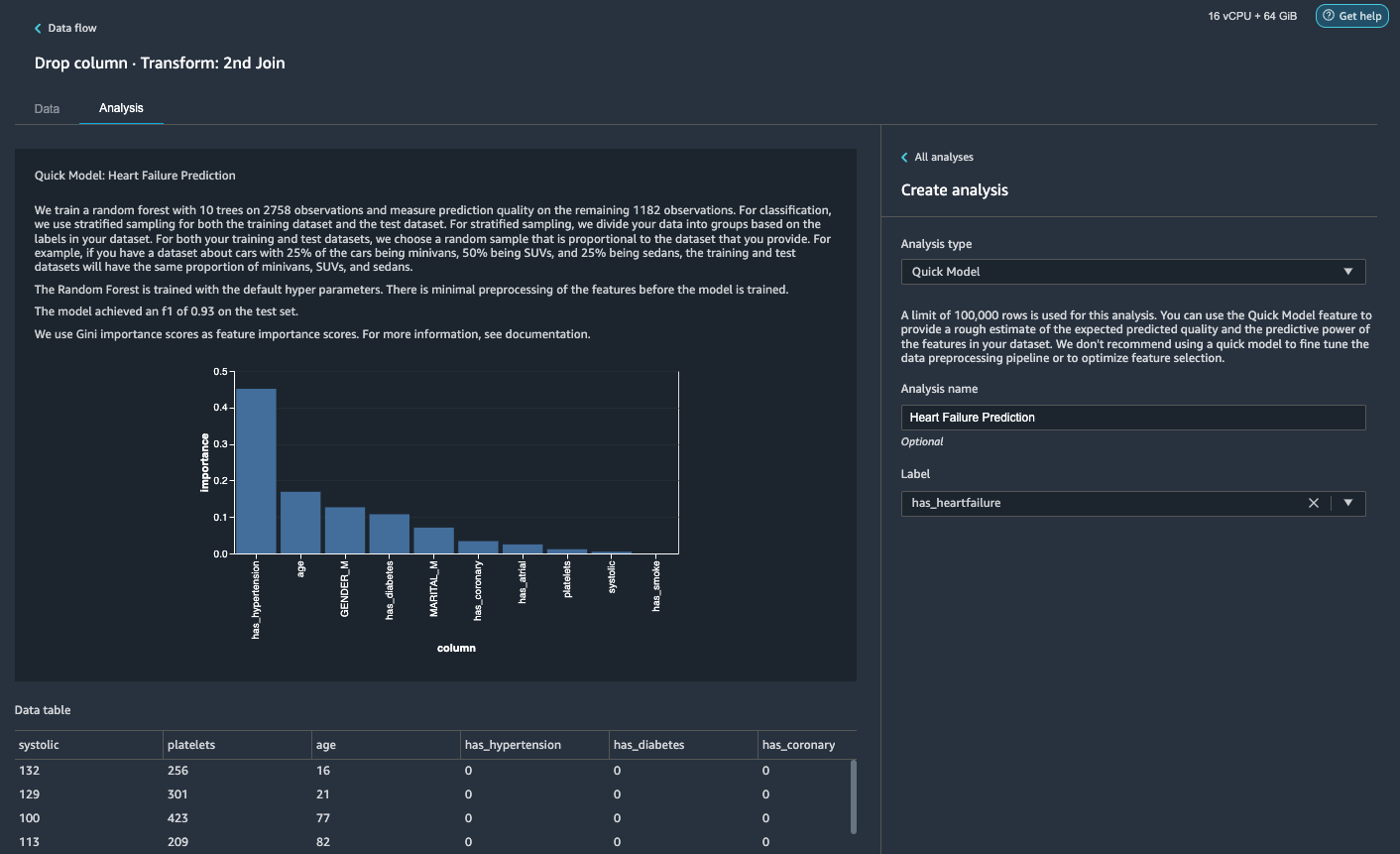

Hasilkan analisis Model Cepat

Kami telah menyelesaikan persiapan data, pembersihan, dan rekayasa fitur. Data Wrangler memiliki fungsi bawaan yang memberikan perkiraan kasar tentang kualitas prediksi yang diharapkan dan kekuatan prediksi fitur dalam kumpulan data kami.

- pada Analisis tab, untuk Jenis analisis¸ pilih Model Cepat.

- Untuk label, pilih memiliki_gagal jantung.

- Pilih Preview.

Sesuai analisis Model Cepat kami, kami dapat melihat fitur has_hypertension memiliki skor kepentingan fitur tertinggi di antara semua fitur.

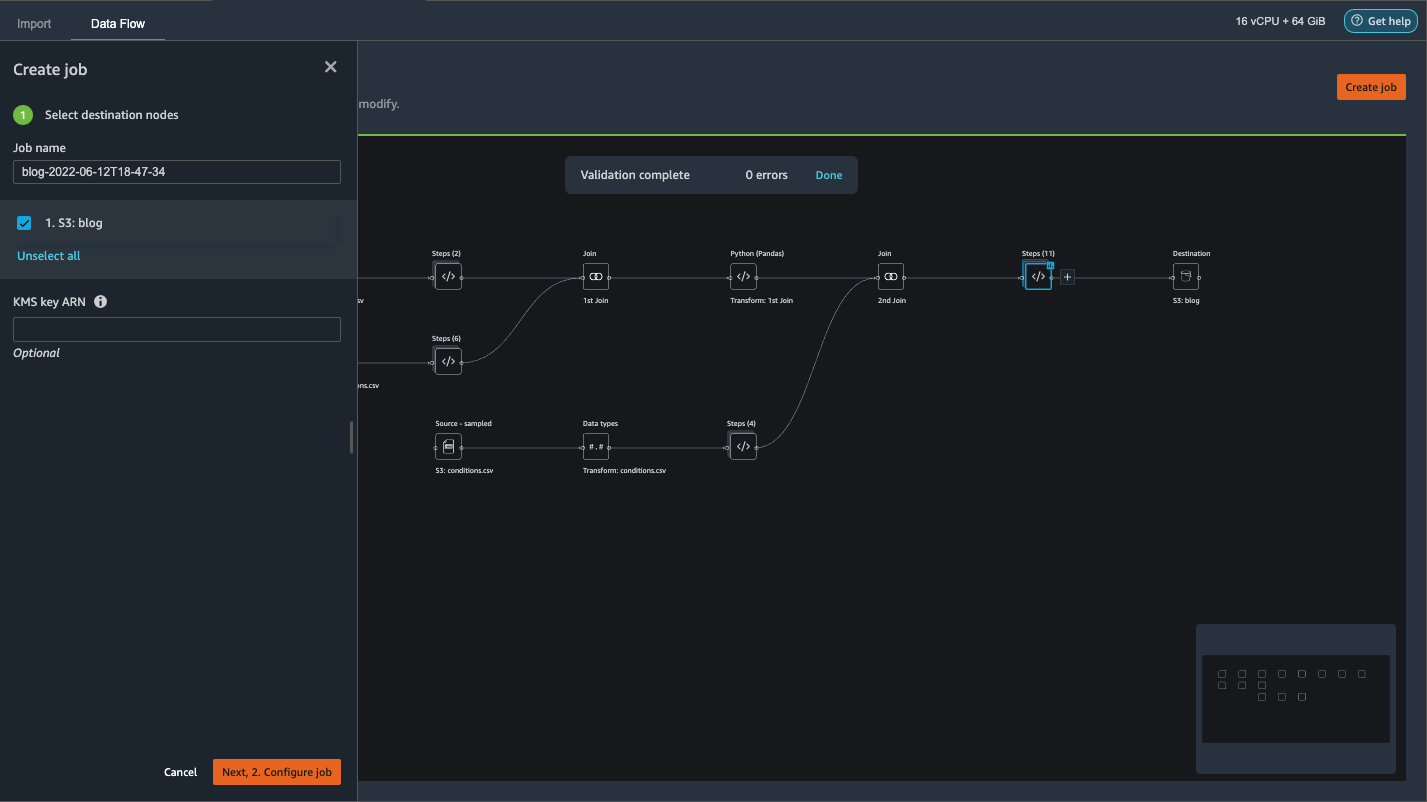

Ekspor data dan latih modelnya

Sekarang mari mengekspor fitur siap-ML yang telah diubah ke bucket S3 tujuan dan menskalakan seluruh alur rekayasa fitur yang telah kita buat sejauh ini menggunakan sampel ke seluruh kumpulan data secara terdistribusi.

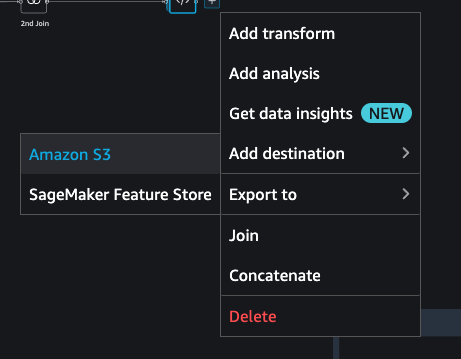

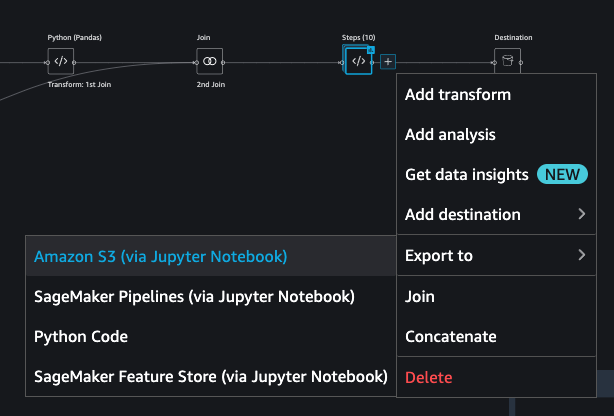

- Pilih tanda plus di sebelah kotak terakhir dalam aliran data dan pilih Tambahkan tujuan.

- Pilih Amazon S3.

- Masukkan Nama kumpulan data. Forum Lokasi Amazon S3, pilih ember S3, lalu pilih Tambahkan Tujuan.

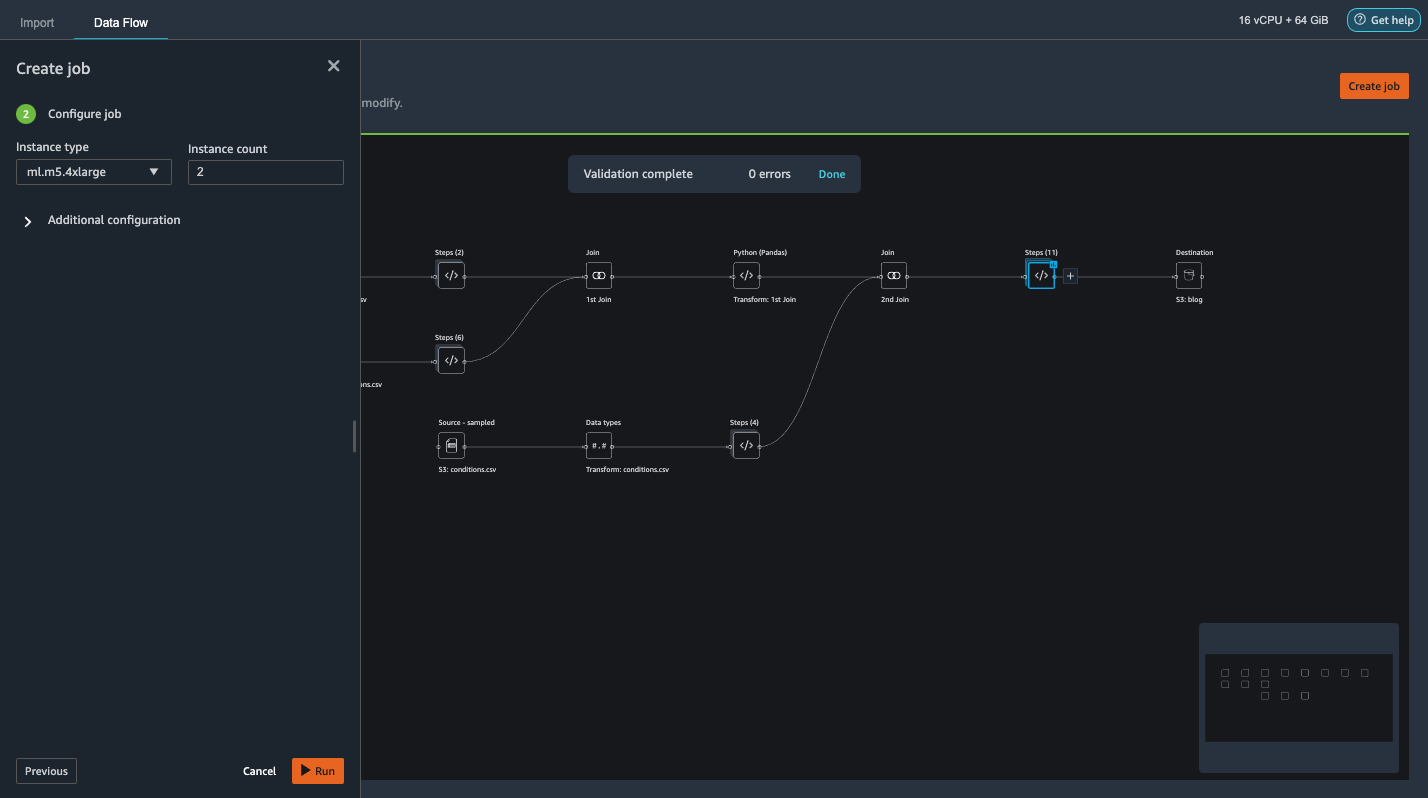

- Pilih Ciptakan pekerjaan untuk meluncurkan tugas pemrosesan PySpark terdistribusi untuk melakukan transformasi dan mengeluarkan data ke bucket S3 tujuan.

Bergantung pada ukuran kumpulan data, opsi ini memungkinkan kita mengonfigurasi cluster dengan mudah dan menskalakan secara horizontal tanpa kode. Kami tidak perlu khawatir tentang mempartisi kumpulan data atau mengelola klaster dan internal Spark. Semua ini secara otomatis diurus oleh kami oleh Data Wrangler. - Di panel kiri, pilih Selanjutnya, 2. Konfigurasi pekerjaan.

- Lalu pilih Run.

Atau, kami juga dapat mengekspor output yang diubah ke S3 melalui Notebook Jupyter. Dengan pendekatan ini, Data Wrangler secara otomatis menghasilkan notebook Jupyter dengan semua kode yang diperlukan untuk memulai pekerjaan pemrosesan untuk menerapkan langkah-langkah aliran data (dibuat menggunakan sampel) pada kumpulan data lengkap yang lebih besar dan menggunakan kumpulan data yang diubah sebagai fitur untuk memulai dari pekerjaan pelatihan nanti. Kode notebook dapat dengan mudah dijalankan dengan atau tanpa membuat perubahan. Sekarang mari kita telusuri langkah-langkah tentang cara menyelesaikannya melalui UI Data Wrangler.

- Pilih tanda plus di sebelah langkah terakhir dalam aliran data dan pilih Ekspor ke.

- Pilih Amazon S3 (melalui Notebook Jupyter).

- Secara otomatis membuka tab baru dengan notebook Jupyter.

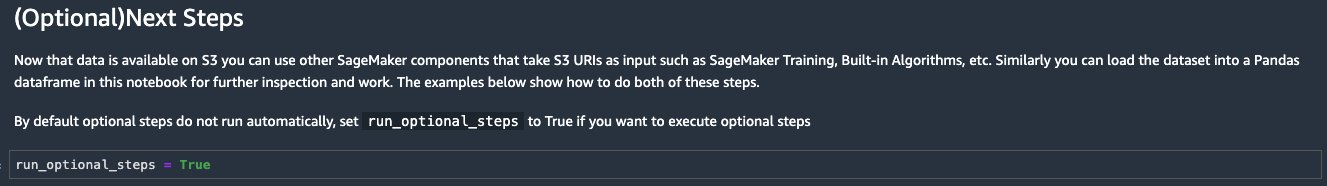

- Di buku catatan Jupyter, cari sel di (Opsional) Langkah Selanjutnya bagian dan ubah

run_optional_stepsdariFalseuntukTrue.

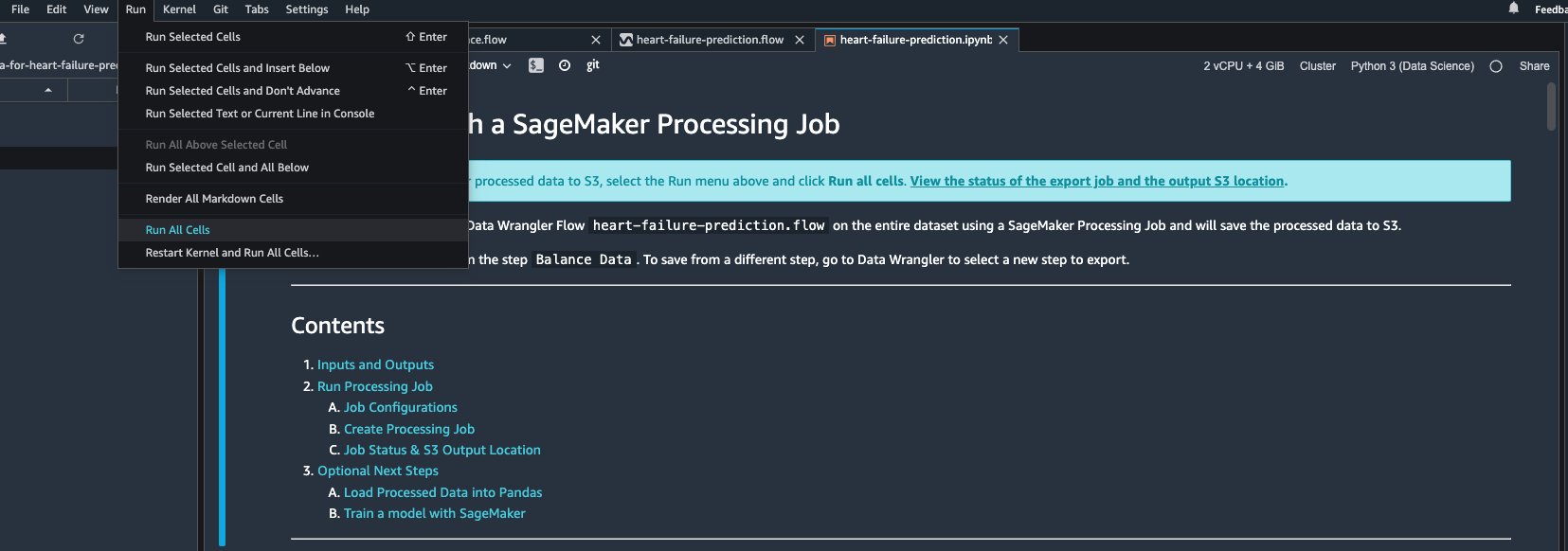

Langkah-langkah opsional yang diaktifkan di buku catatan melakukan hal berikut: - Kembali ke bagian atas buku catatan dan di Run menu, pilih Jalankan Semua Sel.

Jika Anda menggunakan notebook yang dihasilkan apa adanya, ini akan meluncurkan pekerjaan pemrosesan SageMaker yang menskalakan pemrosesan di dua instans m5.4xlarge untuk memproses set data lengkap pada bucket S3. Anda dapat menyesuaikan jumlah instans dan jenis instans berdasarkan ukuran set data dan waktu yang Anda perlukan untuk menyelesaikan pekerjaan.

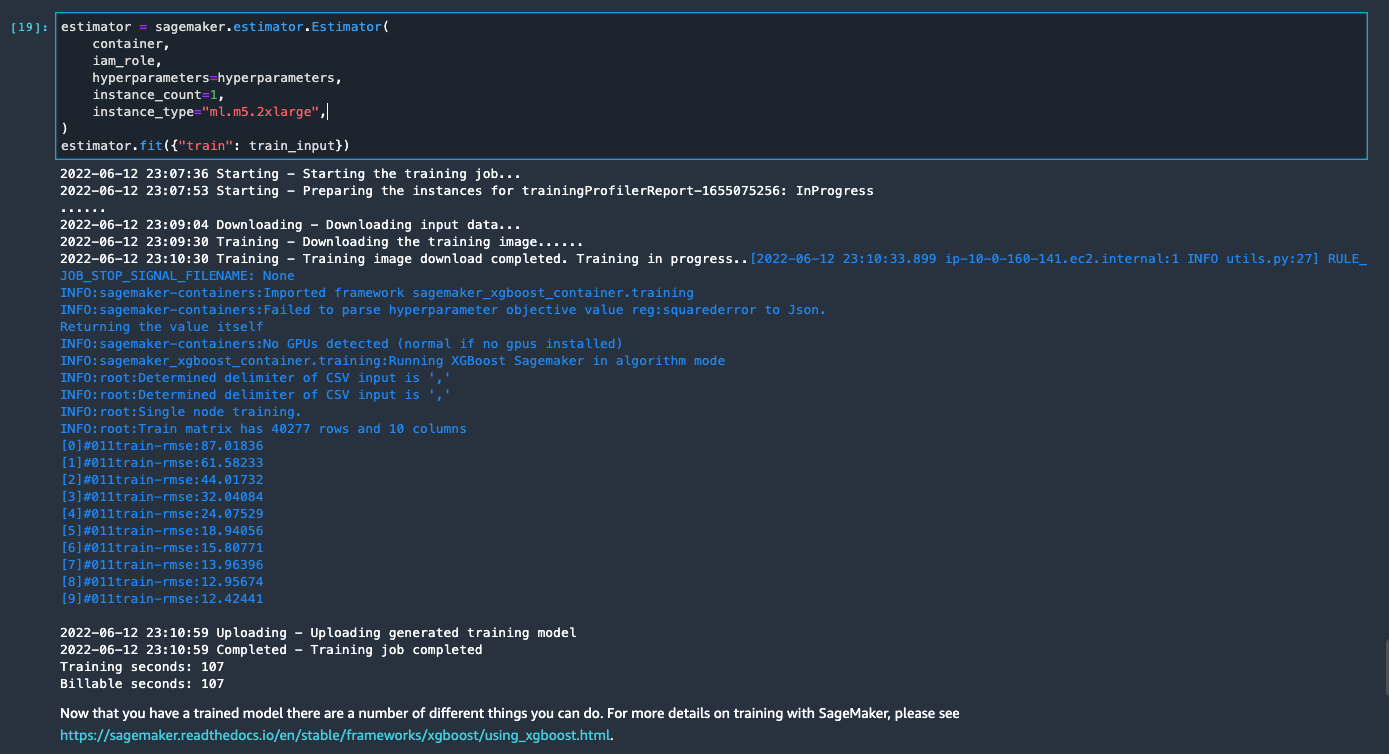

Tunggu hingga pekerjaan pelatihan dari sel terakhir selesai. Ini menghasilkan model di bucket S3 default SageMaker.

Model terlatih siap untuk diterapkan baik untuk inferensi real-time atau transformasi batch. Perhatikan bahwa kami menggunakan data sintetis untuk mendemonstrasikan fungsionalitas di Data Wrangler dan menggunakan data yang diproses untuk model pelatihan. Mengingat bahwa data yang kami gunakan adalah sintetis, hasil inferensi dari model terlatih tidak dimaksudkan untuk diagnosis kondisi medis dunia nyata atau substitusi penilaian dari praktisi medis.

Anda juga dapat langsung mengekspor kumpulan data yang telah diubah ke Amazon S3 dengan memilih Ekspor di atas halaman pratinjau transformasi. Opsi ekspor langsung hanya mengekspor sampel yang diubah jika pengambilan sampel diaktifkan selama impor. Opsi ini paling cocok jika Anda berurusan dengan kumpulan data yang lebih kecil. Data yang diubah juga dapat diserap langsung ke penyimpanan fitur. Untuk informasi lebih lanjut, lihat Toko Fitur Amazon SageMaker. Aliran data juga dapat diekspor sebagai saluran SageMaker yang dapat diatur dan dijadwalkan sesuai kebutuhan Anda. Untuk informasi lebih lanjut, lihat Pipa Amazon SageMaker.

Kesimpulan

Dalam posting ini, kami menunjukkan cara menggunakan Data Wrangler untuk memproses data perawatan kesehatan dan melakukan rekayasa fitur yang dapat diskalakan dengan cara yang digerakkan oleh alat dan kode rendah. Kami mempelajari cara menerapkan transformasi dan analisis bawaan dengan tepat di mana pun diperlukan, menggabungkannya dengan transformasi khusus untuk menambahkan lebih banyak fleksibilitas pada alur kerja persiapan data kami. Kami juga menelusuri berbagai opsi untuk menskalakan resep aliran data melalui tugas pemrosesan terdistribusi. Kami juga mempelajari bagaimana data yang diubah dapat dengan mudah digunakan untuk melatih model untuk memprediksi gagal jantung.

Ada banyak fitur lain di Data Wrangler yang belum kami bahas dalam posting ini. Jelajahi apa yang mungkin di Siapkan Data ML dengan Amazon SageMaker Data Wrangler dan pelajari cara memanfaatkan Data Wrangler untuk ilmu data atau proyek pembelajaran mesin Anda berikutnya.

Tentang Penulis

Matahari Hutan adalah Arsitek Solusi Senior dengan tim Sektor Publik AWS di Toronto, Kanada. Dia telah bekerja di industri kesehatan dan keuangan selama dua dekade terakhir. Di luar pekerjaan, ia menikmati berkemah bersama keluarganya.

Matahari Hutan adalah Arsitek Solusi Senior dengan tim Sektor Publik AWS di Toronto, Kanada. Dia telah bekerja di industri kesehatan dan keuangan selama dua dekade terakhir. Di luar pekerjaan, ia menikmati berkemah bersama keluarganya.

Arunprasath Shankar adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin (AI / ML) dengan AWS, membantu pelanggan global menskalakan solusi AI mereka secara efektif dan efisien di cloud. Di waktu senggangnya, Arun suka menonton film sci-fi dan mendengarkan musik klasik.

Arunprasath Shankar adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin (AI / ML) dengan AWS, membantu pelanggan global menskalakan solusi AI mereka secara efektif dan efisien di cloud. Di waktu senggangnya, Arun suka menonton film sci-fi dan mendengarkan musik klasik.

- AI

- ai seni

- generator seni ai

- punya robot

- Amazon SageMaker

- Pengatur Data Amazon SageMaker

- kecerdasan buatan

- sertifikasi kecerdasan buatan

- kecerdasan buatan dalam perbankan

- robot kecerdasan buatan

- robot kecerdasan buatan

- perangkat lunak kecerdasan buatan

- Pembelajaran Mesin AWS

- blockchain

- konferensi blockchain

- kecerdasan

- kecerdasan buatan percakapan

- konferensi kripto

- dall's

- belajar mendalam

- google itu

- Mesin belajar

- plato

- plato ai

- Kecerdasan Data Plato

- Permainan Plato

- Data Plato

- permainan plato

- skala ai

- sintaksis

- zephyrnet.dll