Pengantar

Guru sekolah dasar Anda mungkin tidak menunjukkan cara menjumlahkan 20 digit angka. Namun jika Anda tahu cara menjumlahkan angka yang lebih kecil, yang Anda butuhkan hanyalah kertas dan pensil serta sedikit kesabaran. Mulailah dengan satu tempat dan lanjutkan ke kiri langkah demi langkah, dan Anda akan segera mengumpulkan triliunan dengan mudah.

Masalah seperti ini mudah dihadapi manusia, namun hanya jika kita menyikapinya dengan cara yang benar. “Cara kita sebagai manusia mengatasi permasalahan ini bukanlah dengan 'menatapnya lalu menuliskan jawabannya',” ungkapnya Eran Malach, seorang peneliti pembelajaran mesin di Universitas Harvard. “Kami benar-benar menjalani langkah-langkahnya.”

Wawasan tersebut telah menginspirasi para peneliti untuk mempelajari model bahasa besar yang mendukung chatbot seperti ChatGPT. Meskipun sistem ini mungkin berhasil menyelesaikan soal-soal yang memerlukan beberapa langkah aritmatika, sistem ini sering kali gagal dalam soal-soal yang melibatkan banyak langkah, seperti menghitung jumlah dua bilangan besar. Namun pada tahun 2022, tim peneliti Google menunjukkan bahwa meminta model bahasa untuk menghasilkan solusi langkah demi langkah memungkinkan model tersebut memecahkan masalah yang sebelumnya tampak di luar jangkauan mereka. Teknik mereka, yang disebut dorongan rantai pemikiran, segera menyebar luas, bahkan ketika para peneliti kesulitan memahami apa yang membuatnya berhasil.

Saat ini, beberapa tim telah mengeksplorasi kekuatan penalaran rantai pemikiran dengan menggunakan teknik dari cabang ilmu komputer teoretis yang disebut teori kompleksitas komputasi. Ini adalah bab terbaru dari serangkaian penelitian yang menggunakan teori kompleksitas untuk mempelajari kemampuan intrinsik dan keterbatasan model bahasa. Upaya-upaya ini memperjelas di mana kita memperkirakan model akan gagal, dan upaya-upaya ini mungkin mengarah pada pendekatan baru untuk membangun model tersebut.

“Mereka menghilangkan sebagian keajaibannya,” kata Dimitris Papailiopoulos, seorang peneliti pembelajaran mesin di Universitas Wisconsin, Madison. “Itu hal yang bagus.”

Pelatihan Transformer

Model bahasa besar dibangun berdasarkan struktur matematika yang disebut jaringan saraf tiruan. Banyaknya “neuron” di dalam jaringan ini melakukan operasi matematika sederhana pada rangkaian angka panjang yang mewakili kata-kata individual, mengubah setiap kata yang melewati jaringan menjadi kata lain. Detail alkimia matematika ini bergantung pada kumpulan angka lain yang disebut parameter jaringan, yang mengukur kekuatan koneksi antar neuron.

Untuk melatih model bahasa agar menghasilkan keluaran yang koheren, peneliti biasanya memulai dengan jaringan saraf yang semua parameternya memiliki nilai acak, lalu memasukkannya ke dalam banyak data dari internet. Setiap kali model melihat blok teks baru, model tersebut mencoba memprediksi setiap kata secara bergantian: Model menebak kata kedua berdasarkan kata pertama, kata ketiga berdasarkan dua kata pertama, dan seterusnya. Ia membandingkan setiap prediksi dengan teks sebenarnya, lalu mengubah parameternya untuk mengurangi perbedaannya. Setiap penyesuaian hanya mengubah sedikit prediksi model, namun efek kolektifnya memungkinkan model merespons masukan yang belum pernah terlihat secara koheren.

Para peneliti telah melatih jaringan saraf untuk memproses bahasa selama 20 tahun. Namun penelitian ini benar-benar berkembang pesat pada tahun 2017, ketika para peneliti di Google memperkenalkan a jaringan jenis baru disebut transformator.

“Ini diusulkan tujuh tahun lalu, sepertinya sudah prasejarah,” katanya Pablo Barcelona, seorang peneliti pembelajaran mesin di Universitas Katolik Kepausan Chili.

Apa yang membuat transformator begitu transformatif adalah kemudahannya untuk ditingkatkan skalanya — untuk meningkatkan jumlah parameter dan jumlah data pelatihan — tanpa membuat pelatihan menjadi terlalu mahal. Sebelum transformator, jaringan saraf memiliki paling banyak beberapa ratus juta parameter; saat ini, model berbasis transformator terbesar memiliki lebih dari satu triliun. Sebagian besar peningkatan kinerja model bahasa selama lima tahun terakhir berasal dari peningkatan skala saja.

Transformers mewujudkan hal ini dengan menggunakan struktur matematika khusus yang disebut kepala perhatian, yang memberi mereka semacam pandangan luas terhadap teks yang mereka baca. Saat transformator membaca blok teks baru, kepala perhatiannya dengan cepat memindai semuanya dan mengidentifikasi hubungan yang relevan antar kata — mungkin mencatat bahwa kata keempat dan kedelapan kemungkinan besar paling berguna untuk memprediksi kata ke-10. Kemudian kepala perhatian meneruskan kata-kata ke jaringan neuron yang sangat besar yang disebut jaringan feedforward, yang melakukan penghitungan angka-angka besar yang diperlukan untuk menghasilkan prediksi yang membantunya belajar.

Transformator nyata memiliki beberapa lapisan kepala perhatian yang dipisahkan oleh jaringan feedforward, dan hanya mengeluarkan prediksi setelah lapisan terakhir. Namun di setiap lapisan, kepala perhatian telah mengidentifikasi konteks yang paling relevan untuk setiap kata, sehingga langkah umpan maju yang intensif secara komputasi dapat terjadi secara bersamaan untuk setiap kata dalam teks. Hal ini mempercepat proses pelatihan, sehingga memungkinkan untuk melatih transformator pada kumpulan data yang semakin besar. Yang lebih penting lagi, hal ini memungkinkan para peneliti untuk menyebarkan beban komputasi yang sangat besar dari pelatihan jaringan saraf yang sangat besar ke banyak prosesor yang bekerja bersama-sama.

Untuk mendapatkan hasil maksimal dari kumpulan data yang sangat besar, “Anda harus membuat modelnya menjadi sangat besar,” katanya David Chiang, seorang peneliti pembelajaran mesin di Universitas Notre Dame. “Tidak akan praktis untuk melatih mereka kecuali jika dilakukan secara paralel.”

Namun, struktur paralel yang membuatnya mudah untuk melatih transformator tidak membantu setelah pelatihan — pada saat itu, tidak perlu memprediksi kata-kata yang sudah ada. Selama operasi biasa, transformator mengeluarkan satu kata pada satu waktu, memasukkan setiap keluaran kembali ke masukan sebelum menghasilkan kata berikutnya, namun mereka masih terjebak dengan arsitektur yang dioptimalkan untuk pemrosesan paralel.

Seiring dengan berkembangnya model berbasis transformator dan tugas-tugas tertentu yang terus menimbulkan masalah, beberapa peneliti mulai bertanya-tanya apakah dorongan menuju model yang lebih dapat diparalelkan memerlukan biaya. Apakah ada cara untuk memahami perilaku transformator secara teoritis?

Kompleksitas Transformer

Studi teoritis tentang jaringan saraf menghadapi banyak kesulitan, terutama ketika mereka mencoba memperhitungkan pelatihan. Jaringan saraf menggunakan prosedur terkenal untuk mengubah parameternya di setiap langkah proses pelatihan. Namun mungkin sulit untuk memahami mengapa prosedur sederhana ini menyatu pada serangkaian parameter yang baik.

Daripada mempertimbangkan apa yang terjadi selama pelatihan, beberapa peneliti mempelajari kemampuan intrinsik transformator dengan membayangkan bahwa parameternya dapat disesuaikan ke nilai apa pun. Hal ini berarti memperlakukan trafo sebagai jenis komputer khusus yang dapat diprogram.

“Anda mempunyai perangkat komputasi, dan Anda ingin tahu, 'Apa fungsinya? Fungsi apa yang dapat dihitungnya?'” kata Chiang.

Ini adalah pertanyaan sentral dalam studi formal komputasi. Lapangan ini dimulai pada tahun 1936, ketika Alan Turing pertama kali membayangkan a perangkat yang fantastis, sekarang disebut mesin Turing, yang dapat melakukan perhitungan apa pun dengan membaca dan menulis simbol pada pita tak terbatas. Para ahli teori kompleksitas komputasi kemudian mengembangkan karya Turing dengan membuktikan bahwa masalah komputasi secara alami terbagi dalam berbagai masalah kelas kompleksitas ditentukan oleh sumber daya yang dibutuhkan untuk menyelesaikannya.

Pada tahun 2019, Barceló dan dua peneliti lainnya terbukti bahwa versi transformator yang diidealkan dengan sejumlah parameter tetap bisa sama kuatnya dengan mesin Turing. Jika Anda mengatur transformator untuk berulang kali memasukkan keluarannya kembali sebagai masukan dan mengatur parameter ke nilai yang sesuai untuk masalah spesifik yang ingin Anda selesaikan, pada akhirnya ia akan mengeluarkan jawaban yang benar.

Hasil tersebut merupakan sebuah titik awal, namun hal ini bergantung pada beberapa asumsi yang tidak realistis yang mungkin akan melebih-lebihkan kekuatan transformator. Bertahun-tahun sejak itu, para peneliti telah berupaya mengembangkan kerangka teori yang lebih realistis.

Salah satu upaya tersebut dimulai pada tahun 2021, ketika William Merril, yang sekarang menjadi mahasiswa pascasarjana di New York University, meninggalkan program fellowship selama dua tahun di Allen Institute for Artificial Intelligence di Seattle. Saat berada di sana, dia menganalisis jenis jaringan saraf lainnya menggunakan teknik yang sepertinya kurang cocok untuk arsitektur paralel transformator. Sesaat sebelum berangkat, dia memulai percakapan dengan peneliti Allen Institute for AI Asish Sabharwal, yang telah mempelajari teori kompleksitas sebelum beralih ke penelitian AI. Mereka mulai curiga bahwa teori kompleksitas dapat membantu mereka memahami batasan transformator.

“Sepertinya ini adalah model yang sederhana; pasti ada beberapa batasan yang bisa diselesaikan,” kata Sabharwal.

Pasangan ini menganalisis transformator menggunakan cabang teori kompleksitas komputasi, yang disebut kompleksitas rangkaian, yang sering digunakan untuk mempelajari komputasi paralel dan telah baru-baru ini diterapkan ke versi transformator yang disederhanakan. Pada tahun berikutnya, mereka menyempurnakan beberapa asumsi yang tidak realistis dalam penelitian sebelumnya. Untuk mempelajari bagaimana struktur paralel transformator dapat membatasi kemampuannya, pasangan ini mempertimbangkan kasus di mana transformator tidak memasukkan keluarannya kembali ke masukannya – sebaliknya, keluaran pertama harus menjadi jawaban akhir. Mereka terbukti bahwa transformator dalam kerangka teoretis ini tidak dapat menyelesaikan masalah komputasi apa pun yang berada di luar kelas kompleksitas tertentu. Dan banyak soal matematika, termasuk soal yang relatif sederhana seperti menyelesaikan persamaan linier, dianggap berada di luar kelas ini.

Pada dasarnya, mereka menunjukkan bahwa paralelisme memang memerlukan konsekuensi – setidaknya ketika transformator harus segera memberikan jawabannya. “Transformator cukup lemah jika cara Anda menggunakannya adalah dengan memberikan masukan, dan Anda hanya mengharapkan jawaban segera,” kata Merrill.

Eksperimen Pikiran

Hasil penelitian Merrill dan Sabharwal menimbulkan pertanyaan alami – seberapa kuatkah transformator jika dibiarkan mendaur ulang keluarannya? Barceló dan rekan penulisnya telah mempelajari kasus ini dalam analisis transformator ideal mereka pada tahun 2019, tetapi dengan asumsi yang lebih realistis, pertanyaannya tetap terbuka. Dan pada tahun-tahun berikutnya, para peneliti telah menemukan rangkaian pemikiran yang mendorong pertanyaan tersebut menjadi relevansi baru.

Merrill dan Sabharwal tahu bahwa pendekatan matematis murni mereka tidak dapat menangkap semua aspek penalaran rantai pemikiran dalam model bahasa nyata, di mana kata-kata dalam prompt bisa menjadi sangat penting. Namun tidak peduli bagaimana sebuah prompt diutarakan, selama hal tersebut menyebabkan model bahasa mengeluarkan solusi langkah demi langkah, model tersebut pada prinsipnya dapat menggunakan kembali hasil langkah perantara pada lintasan selanjutnya melalui transformator. Hal ini dapat memberikan cara untuk menghindari batasan komputasi paralel.

Sementara itu, tim dari Universitas Peking juga mempunyai pemikiran serupa, dan hasil awal mereka positif. Dalam makalah Mei 2023, mereka mengidentifikasi beberapa soal matematika yang seharusnya mustahil dilakukan pada transformator biasa dalam kerangka Merrill dan Sabharwal, dan menunjukkan bahwa langkah-langkah perantara memungkinkan transformator untuk memecahkan masalah ini.

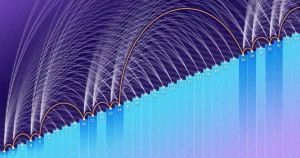

Pada bulan Oktober, Merrill dan Sabharwal menindaklanjuti pekerjaan mereka sebelumnya dengan a studi teoritis rinci dari kekuatan komputasi rantai pemikiran. Mereka menghitung bagaimana daya komputasi ekstra tersebut bergantung pada jumlah langkah perantara yang boleh digunakan oleh transformator sebelum harus mengeluarkan jawaban akhir. Secara umum, peneliti mengharapkan jumlah langkah perantara yang tepat untuk menyelesaikan suatu masalah bergantung pada besarnya masukan terhadap masalah tersebut. Misalnya, strategi paling sederhana untuk menjumlahkan dua bilangan 20 digit memerlukan langkah penjumlahan antara dua kali lebih banyak dibandingkan pendekatan yang sama untuk menjumlahkan dua bilangan 10 digit.

Contoh seperti ini menunjukkan bahwa transformator tidak akan memperoleh banyak manfaat hanya dengan menggunakan beberapa langkah perantara. Memang benar, Merrill dan Sabharwal membuktikan bahwa rantai pemikiran hanya benar-benar mulai membantu ketika jumlah langkah-langkah perantara bertambah sebanding dengan ukuran masukan, dan banyak masalah memerlukan jumlah langkah-langkah perantara untuk bertambah lebih besar lagi.

Ketelitian hasilnya membuat para peneliti terkesan. “Mereka benar-benar mencatat hal ini,” kata Daniel Hsu, seorang peneliti pembelajaran mesin di Universitas Columbia.

Penelitian terbaru Merrill dan Sabharwal menunjukkan bahwa rantai pemikiran bukanlah obat mujarab – pada prinsipnya, hal ini dapat membantu transformator memecahkan masalah yang lebih sulit, namun hanya dengan mengorbankan banyak upaya komputasi.

“Kami tertarik pada berbagai cara untuk mengatasi keterbatasan trafo dengan satu langkah,” kata Merrill. “Rantai pemikiran adalah salah satu cara, namun makalah ini menunjukkan bahwa ini mungkin bukan cara yang paling ekonomis.”

Kembali pada kenyataan

Namun, para peneliti mengingatkan bahwa analisis teoretis semacam ini hanya dapat mengungkap banyak hal tentang model bahasa sebenarnya. Hasil positif — bukti bahwa transformator pada prinsipnya dapat memecahkan masalah tertentu — tidak berarti bahwa model bahasa akan benar-benar mempelajari solusi tersebut selama pelatihan.

Dan bahkan hasil yang mengatasi keterbatasan trafo juga disertai dengan peringatan: Hasil tersebut menunjukkan bahwa tidak ada trafo yang dapat menyelesaikan masalah tertentu dengan sempurna dalam semua kasus. Tentu saja, itu standar yang cukup tinggi. “Mungkin ada kasus-kasus khusus yang dapat ditangani dengan baik,” kata Hsu.

Terlepas dari peringatan ini, karya baru ini menawarkan templat untuk menganalisis berbagai jenis arsitektur jaringan saraf yang pada akhirnya mungkin menggantikan transformator. Jika analisis teori kompleksitas menunjukkan bahwa jenis jaringan tertentu lebih kuat dibandingkan yang lain, hal ini akan menjadi bukti bahwa jaringan tersebut mungkin juga bekerja lebih baik di dunia nyata.

Chiang juga menekankan bahwa penelitian tentang keterbatasan transformator menjadi lebih berharga karena semakin banyak model bahasa yang digunakan dalam berbagai aplikasi dunia nyata, sehingga mudah untuk melebih-lebihkan kemampuan mereka.

“Sebenarnya ada banyak hal yang tidak mereka lakukan dengan baik, dan kita harus sangat sadar akan batasannya,” kata Chiang. “Itulah mengapa pekerjaan seperti ini sangat penting.”

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://www.quantamagazine.org/how-chain-of-thought-reasoning-helps-neural-networks-compute-20240321/

- :memiliki

- :adalah

- :bukan

- :Di mana

- ][P

- $NAIK

- 10th

- 20

- 20 tahun

- 2017

- 2019

- 2021

- 2022

- 2023

- a

- kemampuan

- Tentang Kami

- Akun

- di seluruh

- sebenarnya

- sebenarnya

- menambahkan

- menambahkan

- tambahan

- alamat

- menyesuaikan

- Setelah

- silam

- AI

- ai penelitian

- Alan

- Alan Turing

- Alkimia

- Semua

- allen

- diizinkan

- memungkinkan

- sepanjang

- sudah

- juga

- jumlah

- jumlah

- an

- analisis

- dianalisis

- menganalisis

- dan

- Lain

- menjawab

- Apa pun

- aplikasi

- pendekatan

- pendekatan

- sesuai

- sewenang-wenang

- Batin

- arsitektur

- arsitektur

- ADALAH

- sekitar

- buatan

- kecerdasan buatan

- AS

- meminta

- aspek

- asumsi

- At

- perhatian

- jauh

- kembali

- bar

- berdasarkan

- BE

- menjadi

- menjadi

- menjadi

- sebelum

- mulai

- dimulai

- laku

- Lebih baik

- antara

- Luar

- Bit

- Memblokir

- Cabang

- membangun

- Bangunan

- dibangun di

- tapi

- by

- menghitung

- bernama

- CAN

- kemampuan

- menangkap

- kasus

- kasus

- penyebab

- hati-hati

- pusat

- tertentu

- rantai

- Perubahan

- Bab

- chatbots

- ChatGPT

- Chili

- kelas

- KOHEREN

- Kolektif

- COLUMBIA

- bagaimana

- datang

- kompleksitas

- komputasi

- komputasi

- kekuatan komputasi

- secara komputasi

- menghitung

- komputer

- Komputer Ilmu

- komputasi

- Koneksi

- Mempertimbangkan

- dianggap

- konteks

- terus

- Percakapan

- benar

- Biaya

- bisa

- Kelas

- data

- set data

- Tanggal

- didefinisikan

- tergantung

- tergantung

- rincian

- mengembangkan

- alat

- MELAKUKAN

- perbedaan

- berbeda

- sulit

- kesulitan

- ditemukan

- do

- tidak

- Tidak

- Dont

- turun

- selama

- setiap

- Terdahulu

- memudahkan

- Mudah

- efek

- usaha

- upaya

- Kedelapan

- diaktifkan

- memungkinkan

- besar sekali

- persamaan

- terutama

- melarikan diri

- Bahkan

- akhirnya

- Setiap

- bukti

- contoh

- ada

- mengharapkan

- mahal

- Dieksplorasi

- tambahan

- Menghadapi

- GAGAL

- Jatuh

- beberapa

- bidang

- terakhir

- akhir

- Pertama

- cocok

- lima

- tetap

- diikuti

- berikut

- Untuk

- resmi

- Keempat

- Kerangka

- kerangka

- dari

- fungsi

- Mendapatkan

- Umum

- menghasilkan

- menghasilkan

- mendapatkan

- mendapatkan

- Memberikan

- Pemberian

- akan

- baik

- mendapat

- kelas

- lulus

- tumbuh

- Tumbuh

- tumbuh

- memiliki

- menangani

- terjadi

- Terjadi

- sulit

- harvard

- Universitas Harvard

- Memiliki

- he

- kepala

- berat

- membantu

- membantu

- High

- -nya

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- http

- HTTPS

- Manusia

- ratus

- diidentifikasi

- mengenali

- if

- bayangkan

- Segera

- penting

- mustahil

- terkesan

- perbaikan

- in

- Termasuk

- Meningkatkan

- makin

- memang

- menunjukkan

- menunjukkan

- sendiri-sendiri

- Tak terbatas

- ING

- memasukkan

- input

- dalam

- wawasan

- terinspirasi

- sebagai gantinya

- Lembaga

- Intelijen

- tertarik

- Internet

- campur tangan

- ke

- hakiki

- diperkenalkan

- melibatkan

- IT

- NYA

- hanya

- Jenis

- jenis

- Tahu

- bahasa

- besar

- lebih besar

- terbesar

- Terakhir

- kemudian

- Terbaru

- lapisan

- lapisan

- BELAJAR

- pengetahuan

- paling sedikit

- meninggalkan

- berbohong

- 'like'

- Mungkin

- MEMBATASI

- keterbatasan

- batas

- baris

- linear

- baris

- memuat

- Panjang

- Lot

- mesin

- Mesin belajar

- terbuat

- majalah

- sihir

- membuat

- MEMBUAT

- Membuat

- banyak

- besar-besaran

- matematika

- matematis

- hal

- Mungkin..

- gembira

- mungkin

- juta

- model

- model

- lebih

- paling

- bergerak

- banyak

- beberapa

- harus

- Alam

- Perlu

- dibutuhkan

- jaringan

- jaringan

- saraf

- saraf jaringan

- jaringan saraf

- Neuron

- tak pernah

- New

- NY

- berikutnya

- tidak

- mencatat

- sekarang

- jumlah

- nomor

- Oktober

- of

- lepas

- Penawaran

- sering

- on

- ONE

- yang

- hanya

- ke

- Buka

- operasi

- Operasi

- dioptimalkan

- biasa

- Lainnya

- Lainnya

- di luar

- keluaran

- output

- di luar

- lebih

- pasangan

- obat mujarab

- kertas

- Paralel

- parameter

- lulus

- melewati

- lalu

- Kesabaran

- Beijin

- benar-benar

- Melakukan

- prestasi

- mungkin

- Tempat

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- miskin

- positif

- mungkin

- kekuasaan

- kuat

- Praktis

- meramalkan

- memprediksi

- ramalan

- Prediksi

- pendahuluan

- cukup

- sebelumnya

- sebelumnya

- prinsip

- mungkin

- Masalah

- masalah

- Prosedur

- proses

- pengolahan

- prosesor

- menghasilkan

- diprogram

- bukti

- proporsi

- diusulkan

- terbukti

- memberikan

- membuktikan

- murni

- Dorong

- Majalah kuantitas

- terkuantifikasi

- pertanyaan

- Pertanyaan

- segera

- agak

- menonjol

- acak

- jarak

- mencapai

- Bacaan

- nyata

- dunia nyata

- realistis

- Kenyataan

- benar-benar

- baru

- menurunkan

- halus

- relatif

- relevansi

- relevan

- tetap

- menghapus

- BERKALI-KALI

- menggantikan

- mewakili

- membutuhkan

- wajib

- membutuhkan

- penelitian

- peneliti

- peneliti

- Sumber

- Menanggapi

- mengakibatkan

- Hasil

- menggunakan kembali

- mengungkapkan

- benar

- Tersebut

- sama

- Skala

- skala

- pemindaian

- Sekolah

- Ilmu

- Seattle

- Kedua

- tampak

- tampaknya

- terlihat

- melihat

- set

- set

- tujuh

- beberapa

- Segera

- harus

- Menunjukkan

- menunjukkan

- Pertunjukkan

- mirip

- Sederhana

- disederhanakan

- hanya

- serentak

- sejak

- Ukuran

- lebih kecil

- So

- Solusi

- MEMECAHKAN

- Memecahkan

- beberapa

- entah bagaimana

- segera

- khusus

- tertentu

- kecepatan

- penyebaran

- menumpuk

- awal

- Mulai

- Langkah

- Tangga

- Masih

- Penyelarasan

- kekuatan

- struktur

- struktur

- mahasiswa

- belajar

- studi

- Belajar

- Belajar

- selanjutnya

- seperti itu

- menyarankan

- Menyarankan

- sistem

- Berduaan

- tugas

- tim

- tim

- teknik

- teknik

- Template

- teks

- dari

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- teoretis

- teori

- Sana.

- Ini

- mereka

- hal

- hal

- Pikir

- Ketiga

- ini

- itu

- pikir

- Melalui

- waktu

- untuk

- hari ini

- mengambil

- terhadap

- Pelatihan VE

- Pelatihan

- transformatif

- transformator

- transformer

- mengobati

- Triliun

- kesulitan

- mencoba

- turing

- MENGHIDUPKAN

- mencubit

- Tweaks

- Dua kali

- dua

- mengetik

- jenis

- khas

- memahami

- universitas

- kecuali kalau

- menggunakan

- bekas

- berguna

- kegunaan

- menggunakan

- Berharga

- Nilai - Nilai

- versi

- Versi

- sangat

- View

- berjalan

- ingin

- adalah

- Cara..

- cara

- we

- lemah

- jaringan

- webp

- BAIK

- terkenal

- adalah

- Apa

- ketika

- apakah

- yang

- sementara

- seluruh

- yang

- mengapa

- lebar

- Rentang luas

- tersebar luas

- akan

- dengan

- tanpa

- heran

- Word

- susunan kata

- kata

- Kerja

- bekerja

- kerja

- dunia

- akan

- menulis

- penulisan

- tahun

- tahun

- York

- Kamu

- zephyrnet.dll