Organisasi lintas industri seperti ritel, perbankan, keuangan, perawatan kesehatan, manufaktur, dan pinjaman sering kali harus berurusan dengan sejumlah besar dokumen teks tidak terstruktur yang berasal dari berbagai sumber, seperti berita, blog, ulasan produk, saluran dukungan pelanggan, dan media sosial. Dokumen-dokumen ini berisi informasi penting yang merupakan kunci untuk membuat keputusan bisnis yang penting. Ketika sebuah organisasi tumbuh, menjadi tantangan untuk mengekstrak informasi penting dari dokumen-dokumen ini. Dengan kemajuan teknik pemrosesan bahasa alami (NLP) dan pembelajaran mesin (ML), kami dapat mengungkap wawasan dan koneksi berharga dari dokumen tekstual ini dengan cepat dan akurat, sehingga membantu perusahaan membuat keputusan bisnis yang berkualitas tepat waktu. Layanan NLP yang dikelola sepenuhnya juga telah mempercepat penerapan NLP. Amazon Comprehend adalah layanan terkelola sepenuhnya yang memungkinkan Anda membangun model NLP khusus yang spesifik untuk kebutuhan Anda, tanpa memerlukan keahlian ML apa pun.

Dalam postingan ini, kami mendemonstrasikan cara menggunakan teknik ML yang canggih untuk menyelesaikan lima tugas NLP yang berbeda: peringkasan dokumen, klasifikasi teks, menjawab pertanyaan, pengenalan entitas bernama, dan ekstraksi hubungan. Untuk setiap tugas NLP ini, kami mendemonstrasikan cara menggunakannya Amazon SageMaker untuk melakukan tindakan berikut:

- Men-deploy dan menjalankan inferensi pada model terlatih

- Sempurnakan model terlatih pada set data kustom baru

- Tingkatkan lebih lanjut kinerja fine-tuning dengan Tuning model otomatis SageMaker

- Mengevaluasi kinerja model pada data uji tahan dengan berbagai metrik evaluasi

Meskipun kami membahas lima tugas NLP khusus dalam posting ini, Anda dapat menggunakan solusi ini sebagai template untuk menggeneralisasi model pra-pelatihan fine-tuning dengan dataset Anda sendiri, dan selanjutnya menjalankan optimasi hyperparameter untuk meningkatkan akurasi.

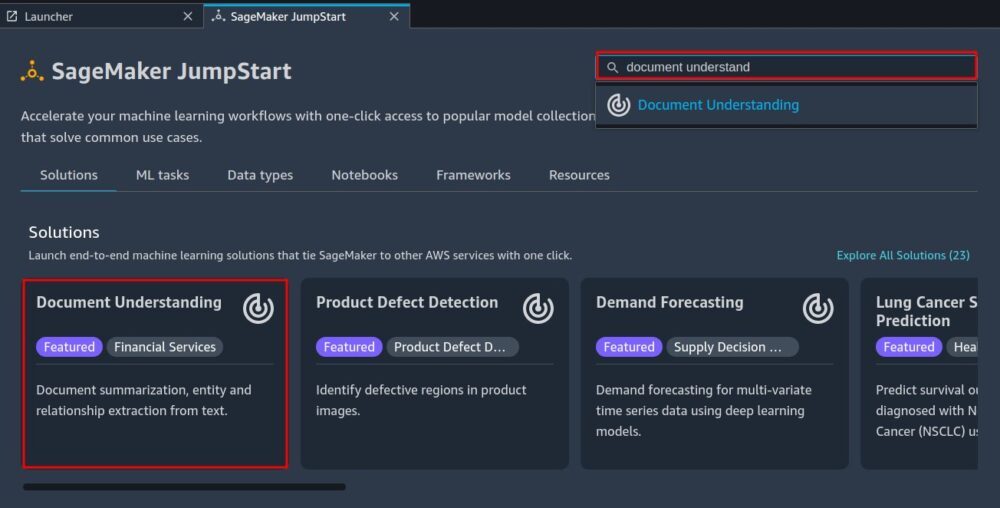

Templat solusi JumpStart

Mulai Lompatan Amazon SageMaker memberikan solusi end-to-end sekali klik untuk banyak kasus penggunaan ML yang umum. Jelajahi kasus penggunaan berikut untuk informasi selengkapnya tentang template solusi yang tersedia:

Template solusi JumpStart mencakup berbagai kasus penggunaan, di mana masing-masing template menawarkan beberapa template solusi yang berbeda (solusi Pemahaman Dokumen ini berada di bawah kasus penggunaan "Mengekstrak dan menganalisis data dari dokumen").

Pilih template solusi yang paling sesuai dengan kasus penggunaan Anda dari halaman arahan JumpStart. Untuk informasi selengkapnya tentang solusi spesifik di bawah setiap kasus penggunaan dan cara meluncurkan solusi JumpStart, lihat Templat Solusi.

Ikhtisar solusi

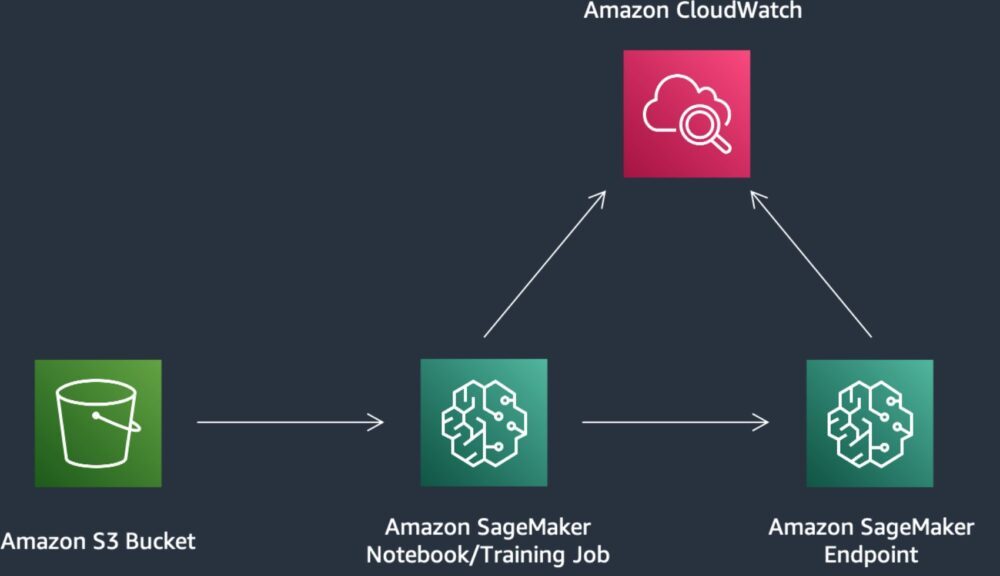

Gambar berikut menunjukkan cara menggunakan solusi ini dengan komponen SageMaker. Tugas pelatihan SageMaker digunakan untuk melatih berbagai model NLP, dan titik akhir SageMaker digunakan untuk menerapkan model di setiap tahap. Kita gunakan Layanan Penyimpanan Sederhana Amazon (Amazon S3) bersama SageMaker untuk menyimpan data pelatihan dan artefak model, dan amazoncloudwatch untuk mencatat keluaran pelatihan dan titik akhir.

Buka solusi Pemahaman Dokumen

Arahkan ke solusi Pemahaman Dokumen di JumpStart.

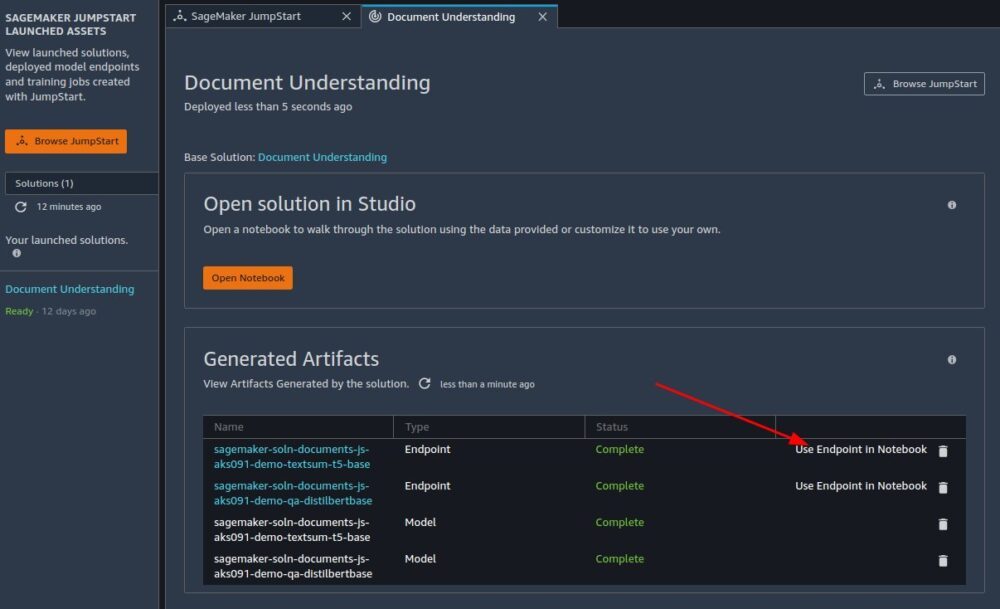

Sekarang kita dapat melihat lebih dekat beberapa aset yang termasuk dalam solusi ini, dimulai dengan notebook demo.

Buku catatan demo

Anda dapat menggunakan buku catatan demo untuk mengirim data contoh ke titik akhir model yang sudah diterapkan untuk tugas peringkasan dokumen dan menjawab pertanyaan. Buku catatan demo dengan cepat memungkinkan Anda mendapatkan pengalaman langsung dengan menanyakan data contoh.

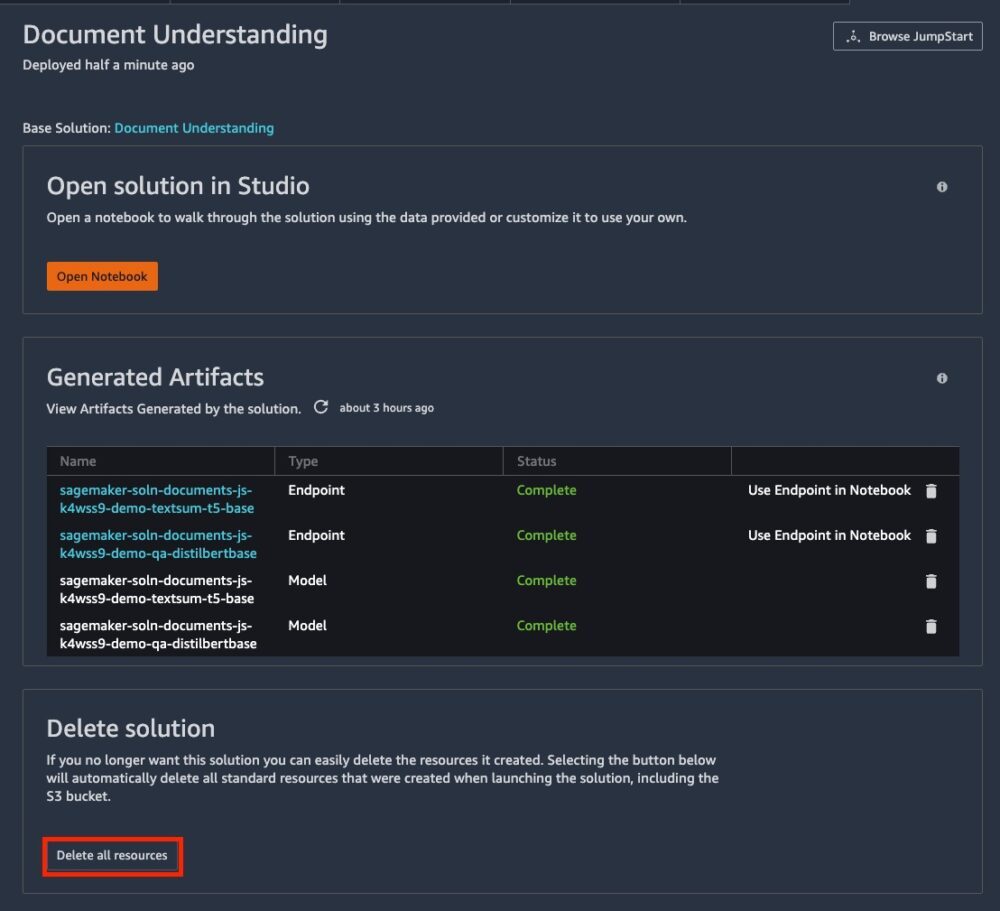

Setelah Anda meluncurkan solusi Pemahaman Dokumen, buka buku catatan demo dengan memilih Gunakan Endpoint di Notebook.

Mari selami lebih dalam masing-masing dari lima notebook utama untuk solusi ini.

Prasyarat

In Studio Amazon SageMaker, pastikan Anda menggunakan PyTorch 1.10 Python 3.8 CPU Optimized image/kernel untuk membuka notebook. Pelatihan menggunakan lima instans ml.g4dn.2xlarge, jadi Anda harus meningkatkan a permintaan kenaikan batas layanan jika akun Anda memerlukan peningkatan batas untuk jenis ini.

Klasifikasi teks

Klasifikasi teks mengacu pada mengklasifikasikan kalimat input ke salah satu label kelas dari dataset pelatihan. Notebook ini mendemonstrasikan cara menggunakan API JumpStart untuk klasifikasi teks.

Men-deploy dan menjalankan inferensi pada model yang telah dilatih sebelumnya

Model klasifikasi teks yang kami pilih untuk digunakan dibangun di atas penyisipan teks (tensorflow-tc-bert-en-uncased-L-12-H-768-A-12-2) model dari Pusat TensorFlow, yang dilatih sebelumnya di kumpulan data Wikipedia dan BookCorpus.

Model yang tersedia untuk penerapan dibuat dengan melampirkan lapisan klasifikasi biner ke keluaran model penyematan teks, lalu menyempurnakan seluruh model pada SST-2 kumpulan data, yang terdiri dari ulasan film positif dan negatif.

Untuk menjalankan inferensi pada model ini, pertama-tama kita perlu mengunduh wadah inferensi (deploy_image_uri), skrip inferensi (deploy_source_uri), dan model terlatih (base_model_uri). Kami kemudian meneruskannya sebagai parameter untuk membuat instance objek model SageMaker, yang kemudian dapat kami terapkan:

Kode berikut menunjukkan respons kami:

Sempurnakan model yang telah dilatih sebelumnya pada kumpulan data khusus

Kami baru saja menjalankan inferensi pada model BERT yang telah dilatih sebelumnya, yang disetel dengan baik pada SST-2 Himpunan data.

Selanjutnya, kita membahas cara menyempurnakan model pada kumpulan data khusus dengan sejumlah kelas. Dataset yang kami gunakan untuk fine-tuning masih SST-2 Himpunan data. Anda dapat mengganti kumpulan data ini dengan kumpulan data apa pun yang Anda minati.

Kami mengambil wadah Docker pelatihan, sumber algoritme pelatihan, dan model pra-pelatihan:

Untuk hyperparameter khusus algoritme, kita mulai dengan mengambil kamus Python dari hyperparameter pelatihan yang diterima algoritme dengan nilai defaultnya. Anda dapat menimpanya dengan nilai khusus, seperti yang ditampilkan dalam kode berikut:

Kumpulan data (SST-2) dibagi menjadi set pelatihan, validasi, dan pengujian, di mana set pelatihan digunakan agar sesuai dengan model, set validasi digunakan untuk menghitung metrik evaluasi yang dapat digunakan untuk HPO, dan set pengujian digunakan sebagai data tahan untuk mengevaluasi kinerja model. Berikutnya, dataset latih dan validasi diunggah ke Amazon S3 dan digunakan untuk meluncurkan tugas pelatihan penyesuaian:

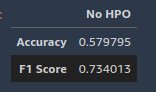

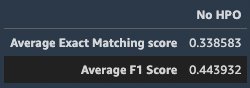

Setelah pekerjaan penyempurnaan selesai, kami menerapkan model, menjalankan inferensi pada kumpulan data uji tahan, dan menghitung metrik evaluasi. Karena ini adalah tugas klasifikasi biner, kami menggunakan skor akurasi dan Skor F1 sebagai metrik evaluasi. Nilai yang lebih besar menunjukkan kinerja yang lebih baik. Tangkapan layar berikut menunjukkan hasil kami.

Tingkatkan lebih lanjut kinerja penyempurnaan dengan penyetelan model otomatis SageMaker

Pada langkah ini, kami mendemonstrasikan bagaimana Anda dapat lebih meningkatkan kinerja model dengan menyempurnakan model dengan penyetelan model otomatis SageMaker. Penyesuaian model otomatis, juga dikenal sebagai pengoptimalan hiperparameter (HPO), menemukan versi terbaik model dengan menjalankan beberapa tugas pelatihan pada kumpulan data Anda dengan rentang hiperparameter yang Anda tentukan. Kemudian memilih nilai hyperparameter yang menghasilkan model yang berperforma terbaik, sebagaimana diukur dengan metrik yang Anda pilih, pada kumpulan data validasi.

Pertama, kami menetapkan tujuan sebagai skor akurasi pada data validasi (val_accuracy) dan menentukan metrik untuk tugas penyetelan dengan menentukan nama metrik tujuan dan ekspresi reguler (regex). Ekspresi reguler digunakan untuk mencocokkan keluaran log algoritme dan menangkap nilai numerik metrik. Selanjutnya, kami menentukan rentang hyperparameter untuk memilih nilai hyperparameter terbaik. Kami menetapkan jumlah total pekerjaan penyetelan sebagai enam dan mendistribusikan pekerjaan ini pada tiga pekerjaan yang berbeda Cloud komputasi elastis Amazon (Amazon EC2) untuk menjalankan tugas penyetelan paralel. Lihat kode berikut:

Kami meneruskan nilai tersebut untuk membuat instance objek SageMaker Estimator, serupa dengan yang kami lakukan di langkah penyempurnaan sebelumnya. Alih-alih memanggil fit fungsi dari Estimator objek, kami melewati Estimator objek sebagai parameter ke Hyperparameter Tuner konstruktor dan memanggil fit fungsinya untuk meluncurkan pekerjaan penyetelan:

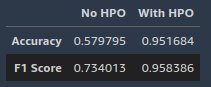

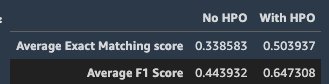

Setelah tugas penyetelan selesai, kami menerapkan model yang memberikan skor metrik evaluasi terbaik pada set data validasi, melakukan inferensi pada set data uji tahan yang sama seperti yang kami lakukan di bagian sebelumnya, dan menghitung metrik evaluasi.

Hasilnya menunjukkan bahwa model yang dipilih dengan penyetelan model otomatis secara signifikan mengungguli model yang disetel halus di bagian sebelumnya pada kumpulan data uji tahan.

Pengakuan entitas yang dinamai

Pengenalan entitas bernama (NER) adalah proses mendeteksi dan mengklasifikasikan entitas bernama ke dalam kategori yang telah ditentukan sebelumnya, seperti nama orang, organisasi, lokasi, dan jumlah. Ada banyak kasus penggunaan NER di dunia nyata, seperti mesin rekomendasi, mengkategorikan dan menugaskan tiket dukungan pelanggan ke departemen yang tepat, mengekstraksi informasi penting dari laporan pasien di layanan kesehatan, dan klasifikasi konten dari berita dan blog.

Men-deploy dan menjalankan inferensi pada model yang telah dilatih sebelumnya

Kami menyebarkan En_core_web_md model dari spaCy Perpustakaan. spaCy adalah pustaka NLP sumber terbuka yang dapat digunakan untuk berbagai tugas, dan memiliki metode bawaan untuk NER. Kami menggunakan AWS PyTorch Deep Learning Container (DLC) dengan mode skrip dan menginstal pustaka spaCy sebagai dependensi di atas container.

Selanjutnya, titik masuk untuk skrip (argument entry_point.py) ditentukan, berisi semua kode untuk mengunduh dan memuat En_core_web_md model dan melakukan inferensi pada data yang dikirim ke titik akhir. Akhirnya, kita masih perlu menyediakan model_data sebagai model terlatih untuk inferensi. Karena pra-dilatih En_core_web_md model diunduh dengan cepat, yang ditentukan dalam skrip entri, kami menyediakan file arsip kosong. Setelah titik akhir diterapkan, Anda dapat memanggil titik akhir langsung dari notebook menggunakan SageMaker Python SDK Predictor. Lihat kode berikut:

Data input untuk model adalah dokumen tekstual. Model entitas bernama mengekstrak potongan kata benda dan entitas bernama dalam dokumen tekstual dan mengklasifikasikannya ke dalam beberapa jenis yang berbeda (seperti orang, tempat, dan organisasi). Contoh input dan output ditunjukkan dalam kode berikut. Itu start_char parameter menunjukkan offset karakter untuk awal rentang, dan end_char menunjukkan akhir bentang.

Sempurnakan model yang telah dilatih sebelumnya pada kumpulan data khusus

Pada langkah ini, kami mendemonstrasikan cara menyempurnakan model bahasa terlatih untuk NER pada kumpulan data Anda sendiri. Langkah penyempurnaan memperbarui parameter model untuk menangkap karakteristik data Anda sendiri dan meningkatkan akurasi. Kami menggunakan WikiANN (PAN-X) dataset untuk menyempurnakan DistiBERT-base-uncased Model transformer dari Hugging Face.

Dataset dibagi menjadi set pelatihan, validasi, dan pengujian.

Selanjutnya, kami menentukan hyperparameter model, dan menggunakan DLC AWS Hugging Face dengan mode skrip (argumen entry_point) untuk memicu tugas fine-tuning:

Setelah pekerjaan penyempurnaan selesai, kami menerapkan titik akhir dan kueri titik akhir tersebut dengan data uji tahan. Untuk mengkueri titik akhir, setiap string teks perlu diberi token menjadi satu atau beberapa token dan dikirim ke model transformator. Setiap token mendapatkan tag entitas bernama yang diprediksi. Karena setiap string teks dapat dipatok menjadi satu atau beberapa token, kita perlu menduplikasi tag entitas bernama kebenaran dasar dari string ke semua token yang terkait dengannya. Buku catatan yang disediakan memandu Anda melalui langkah-langkah untuk mencapainya.

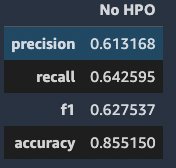

Terakhir, kami menggunakan metrik evaluasi bawaan Hugging Face berurutan untuk menghitung skor evaluasi pada data tes bertahan. Metrik evaluasi yang digunakan adalah overall precision, overall recall, overall F1, dan akurasi. Tangkapan layar berikut menunjukkan hasil kami.

Tingkatkan lebih lanjut kinerja penyempurnaan dengan penyetelan model otomatis SageMaker

Mirip dengan klasifikasi teks, kami mendemonstrasikan bagaimana Anda dapat lebih meningkatkan kinerja model dengan menyempurnakan model dengan penyetelan model otomatis SageMaker. Untuk menjalankan tugas penyetelan, kita perlu menentukan metrik objektif yang ingin kita gunakan untuk mengevaluasi kinerja model pada dataset validasi (skor F1 dalam kasus ini), rentang hyperparameter untuk memilih nilai hyperparameter terbaik, serta konfigurasi tugas penyetelan seperti jumlah maksimum tugas penyetelan dan jumlah tugas paralel yang akan diluncurkan sekaligus:

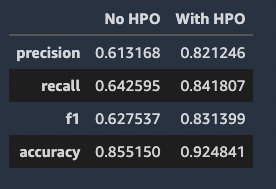

Setelah tugas penyetelan selesai, kami menerapkan model yang memberikan skor metrik evaluasi terbaik pada set data validasi, melakukan inferensi pada set data uji tahan yang sama seperti yang kami lakukan di bagian sebelumnya, dan menghitung metrik evaluasi.

Kita dapat melihat bahwa model dengan HPO mencapai kinerja yang jauh lebih baik di semua metrik.

Menjawab pertanyaan

Menjawab pertanyaan berguna saat Anda ingin meminta sejumlah besar teks untuk informasi tertentu. Ini memungkinkan pengguna untuk mengungkapkan pertanyaan dalam bahasa alami dan mendapatkan tanggapan langsung dan singkat. Sistem penjawab pertanyaan yang didukung oleh NLP dapat digunakan di mesin pencari dan antarmuka percakapan telepon.

Men-deploy dan menjalankan inferensi pada model yang telah dilatih sebelumnya

Model pra-pelatihan kami adalah model penjawab pertanyaan ekstraktif (EQA). bert-besar-uncased-whole-word-masking-finetuned-squad dibangun di atas model Transformer dari Hugging Face. Kami menggunakan DLC AWS PyTorch dengan mode skrip dan menginstal transformer perpustakaan sebagai ketergantungan di atas wadah. Mirip dengan tugas NER, kami menyediakan file arsip kosong di argumen model_data karena model pra-pelatihan diunduh dengan cepat. Setelah titik akhir diterapkan, Anda dapat memanggil titik akhir langsung dari notebook menggunakan SageMaker Python SDK Predictor. Lihat kode berikut:

Yang perlu kita lakukan hanyalah membuat objek kamus dengan dua kunci. context adalah teks yang ingin kita ambil informasinya. question adalah kueri bahasa alami yang menentukan informasi apa yang ingin kami ekstrak. Kami memanggil predict pada prediktor kami, dan kami harus mendapatkan respons dari titik akhir yang berisi jawaban yang paling mungkin:

Kami memiliki jawabannya, dan kami dapat mencetak jawaban yang paling mungkin yang telah diambil dari teks sebelumnya. Setiap jawaban memiliki skor keyakinan yang digunakan untuk peringkat (namun skor ini tidak boleh ditafsirkan sebagai probabilitas sebenarnya). Selain jawaban kata demi kata, Anda juga mendapatkan indeks karakter awal dan akhir jawaban dari konteks aslinya:

Sekarang kami menyempurnakan model ini dengan kumpulan data khusus kami sendiri untuk mendapatkan hasil yang lebih baik.

Sempurnakan model yang telah dilatih sebelumnya pada kumpulan data khusus

Pada langkah ini, kami mendemonstrasikan cara menyempurnakan model bahasa terlatih untuk EQA pada kumpulan data Anda sendiri. Langkah penyempurnaan memperbarui parameter model untuk menangkap karakteristik data Anda sendiri dan meningkatkan akurasi. Kami menggunakan SQuAD2.0 dataset untuk menyempurnakan model penyisipan teks bert-base-tanpa casing dari Memeluk Wajah. Model yang tersedia untuk fine-tuning melampirkan lapisan ekstraksi jawaban ke model penyisipan teks dan menginisialisasi parameter lapisan ke nilai acak. Langkah penyempurnaan menyempurnakan semua parameter model untuk meminimalkan kesalahan prediksi pada data masukan dan mengembalikan model yang telah disempurnakan.

Mirip dengan tugas klasifikasi teks, dataset (SQuAD2.0) dibagi menjadi set pelatihan, validasi, dan pengujian.

Selanjutnya, kami menentukan hyperparameter model, dan menggunakan API JumpStart untuk memicu pekerjaan fine-tuning:

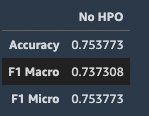

Setelah pekerjaan penyempurnaan selesai, kami menerapkan model, menjalankan inferensi pada kumpulan data uji tahan, dan menghitung metrik evaluasi. Metrik evaluasi yang digunakan adalah rata-rata skor pencocokan tepat dan rata-rata skor F1. Tangkapan layar berikut menunjukkan hasilnya.

Tingkatkan lebih lanjut kinerja penyempurnaan dengan penyetelan model otomatis SageMaker

Mirip dengan bagian sebelumnya, kami menggunakan a HyperparameterTuner objek untuk meluncurkan pekerjaan penyetelan:

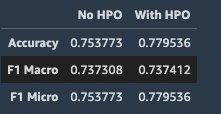

Setelah tugas penyetelan selesai, kami menerapkan model yang memberikan skor metrik evaluasi terbaik pada set data validasi, melakukan inferensi pada set data uji tahan yang sama seperti yang kami lakukan di bagian sebelumnya, dan menghitung metrik evaluasi.

Kita dapat melihat bahwa model dengan HPO menunjukkan kinerja yang jauh lebih baik pada data uji bertahan.

Ekstraksi hubungan

Ekstraksi hubungan adalah tugas mengekstraksi hubungan semantik dari teks, yang biasanya terjadi antara dua entitas atau lebih. Ekstraksi hubungan memainkan peran penting dalam mengekstraksi informasi terstruktur dari sumber tidak terstruktur seperti teks mentah. Dalam buku catatan ini, kami mendemonstrasikan dua kasus penggunaan ekstraksi relasi.

Sempurnakan model yang telah dilatih sebelumnya pada kumpulan data khusus

Kami menggunakan model ekstraksi hubungan yang dibangun di atas a BERT-basis-tanpa casing model menggunakan transformer dari Memeluk Transformer Wajah Perpustakaan. Model untuk penyempurnaan melampirkan lapisan klasifikasi linier yang mengambil sepasang penyematan token yang dihasilkan oleh model penyematan teks dan menginisialisasi parameter lapisan ke nilai acak. Langkah penyempurnaan menyempurnakan semua parameter model untuk meminimalkan kesalahan prediksi pada data masukan dan mengembalikan model yang telah disempurnakan.

Dataset yang kami sempurnakan adalah modelnya SemEval-2010 Tugas 8. Model yang dikembalikan dengan fine-tuning dapat digunakan lebih lanjut untuk inferensi.

Dataset berisi set pelatihan, validasi, dan pengujian.

Kami menggunakan AWS PyTorch DLC dengan mode skrip dari SageMaker Python SDK, di mana transformers perpustakaan diinstal sebagai ketergantungan di atas wadah. Kami mendefinisikan SageMaker PyTorch estimator dan satu set hyperparameter seperti model pra-terlatih, kecepatan pembelajaran, dan nomor zaman untuk melakukan penyetelan halus. Kode untuk menyempurnakan model ekstraksi hubungan didefinisikan dalam entry_point.py. Lihat kode berikut:

Tingkatkan lebih lanjut kinerja penyempurnaan dengan penyetelan model otomatis SageMaker

Mirip dengan bagian sebelumnya, kami menggunakan a HyperparameterTuner objek untuk berinteraksi dengan API penyetelan hyperparameter SageMaker. Kita dapat memulai pekerjaan penyetelan hyperparameter dengan memanggil fit Metode:

Saat pekerjaan penyetelan hyperparameter selesai, kami melakukan inferensi dan memeriksa skor evaluasi.

Kita dapat melihat bahwa model dengan HPO menunjukkan performa yang lebih baik pada data uji hold-out.

Ringkasan dokumen

Peringkasan dokumen atau teks adalah tugas memadatkan data teks dalam jumlah besar menjadi subkumpulan kalimat bermakna yang lebih kecil yang mewakili informasi paling penting atau relevan dalam konten aslinya. Peringkasan dokumen adalah teknik yang berguna untuk menyaring informasi penting dari sejumlah besar data teks menjadi beberapa kalimat. Peringkasan teks digunakan dalam banyak kasus penggunaan, seperti pemrosesan dokumen dan penggalian informasi dari blog, artikel, dan berita.

Notebook ini mendemonstrasikan penerapan model peringkasan dokumen basis T5 dari Memeluk Transformer Wajah Perpustakaan. Kami juga menguji titik akhir yang diterapkan menggunakan artikel teks dan mengevaluasi hasilnya menggunakan metrik evaluasi bawaan Hugging Face RED.

Mirip dengan menjawab pertanyaan dan buku catatan NER, kami menggunakan PyTorchModel dari SageMaker Python SDK bersama dengan entry_point.py skrip untuk memuat model berbasis T5 ke titik akhir HTTPS. Setelah titik akhir berhasil diterapkan, kami dapat mengirimkan artikel teks ke titik akhir untuk mendapatkan respons prediksi:

Selanjutnya, kami mengevaluasi dan membandingkan artikel teks dan hasil ringkasan menggunakan metrik ROUGE. Tiga metrik evaluasi dihitung: rougeN, rougeL, dan rougeLsum. rougeN mengukur jumlah pencocokan n-grams antara teks yang dihasilkan model (hasil peringkasan) dan a reference (Masukkan teks). Metrik rougeL dan rougeLsum mengukur urutan kata yang paling cocok dengan mencari substring umum terpanjang dalam ringkasan yang dihasilkan dan referensi. Untuk setiap metrik, interval kepercayaan untuk skor presisi, daya ingat, dan F1 dihitung. Lihat kode berikut:

Membersihkan

Sumber daya yang dibuat untuk solusi ini dapat dihapus menggunakan Hapus semua sumber daya tombol dari SageMaker Studio IDE. Setiap notebook juga menyediakan bagian pembersihan dengan kode untuk menghapus titik akhir.

Kesimpulan

Dalam postingan ini, kami mendemonstrasikan cara menggunakan teknik ML yang canggih untuk menyelesaikan lima tugas NLP yang berbeda: peringkasan dokumen, klasifikasi teks, tanya jawab, pengenalan entitas bernama, dan ekstraksi hubungan menggunakan Jumpstart. Mulailah dengan Jumpstart sekarang!

Tentang Penulis

Dr Xin Huang adalah Ilmuwan Terapan untuk Amazon SageMaker JumpStart dan algoritma bawaan Amazon SageMaker. Dia berfokus pada pengembangan algoritme pembelajaran mesin yang dapat diskalakan. Minat penelitiannya adalah di bidang pemrosesan bahasa alami, pembelajaran mendalam yang dapat dijelaskan pada data tabular, dan analisis yang kuat dari pengelompokan ruang-waktu non-parametrik. Dia telah menerbitkan banyak makalah di ACL, ICDM, konferensi KDD, dan jurnal Royal Statistical Society: Series A.

Dr Xin Huang adalah Ilmuwan Terapan untuk Amazon SageMaker JumpStart dan algoritma bawaan Amazon SageMaker. Dia berfokus pada pengembangan algoritme pembelajaran mesin yang dapat diskalakan. Minat penelitiannya adalah di bidang pemrosesan bahasa alami, pembelajaran mendalam yang dapat dijelaskan pada data tabular, dan analisis yang kuat dari pengelompokan ruang-waktu non-parametrik. Dia telah menerbitkan banyak makalah di ACL, ICDM, konferensi KDD, dan jurnal Royal Statistical Society: Series A.

Vivek Gangasani adalah Arsitek Solusi Pembelajaran Mesin Senior di Amazon Web Services. Dia membantu Startups membangun dan mengoperasionalkan aplikasi AI/ML. Dia saat ini fokus untuk menggabungkan latar belakangnya di Containers dan Machine Learning untuk memberikan solusi pada MLOps, Inferensi ML, dan ML kode rendah. Di waktu luangnya, dia menikmati mencoba restoran baru dan menjelajahi tren yang muncul dalam AI dan pembelajaran mendalam.

Vivek Gangasani adalah Arsitek Solusi Pembelajaran Mesin Senior di Amazon Web Services. Dia membantu Startups membangun dan mengoperasionalkan aplikasi AI/ML. Dia saat ini fokus untuk menggabungkan latar belakangnya di Containers dan Machine Learning untuk memberikan solusi pada MLOps, Inferensi ML, dan ML kode rendah. Di waktu luangnya, dia menikmati mencoba restoran baru dan menjelajahi tren yang muncul dalam AI dan pembelajaran mendalam.

Geremy Cohen adalah Arsitek Solusi dengan AWS di mana dia membantu pelanggan membangun solusi mutakhir berbasis cloud. Di waktu luangnya, ia menikmati jalan-jalan singkat di pantai, menjelajahi daerah teluk bersama keluarganya, memperbaiki barang-barang di sekitar rumah, memecahkan barang-barang di sekitar rumah, dan BBQing.

Geremy Cohen adalah Arsitek Solusi dengan AWS di mana dia membantu pelanggan membangun solusi mutakhir berbasis cloud. Di waktu luangnya, ia menikmati jalan-jalan singkat di pantai, menjelajahi daerah teluk bersama keluarganya, memperbaiki barang-barang di sekitar rumah, memecahkan barang-barang di sekitar rumah, dan BBQing.

Neelam Koshiya adalah arsitek solusi perusahaan di AWS. Fokusnya saat ini adalah membantu pelanggan perusahaan dengan perjalanan adopsi cloud mereka untuk hasil bisnis strategis. Di waktu luangnya, ia menikmati membaca dan berada di luar.

Neelam Koshiya adalah arsitek solusi perusahaan di AWS. Fokusnya saat ini adalah membantu pelanggan perusahaan dengan perjalanan adopsi cloud mereka untuk hasil bisnis strategis. Di waktu luangnya, ia menikmati membaca dan berada di luar.

- Lanjutan (300)

- AI

- ai seni

- generator seni ai

- punya robot

- Amazon SageMaker

- Mulai Lompatan Amazon SageMaker

- kecerdasan buatan

- sertifikasi kecerdasan buatan

- kecerdasan buatan dalam perbankan

- robot kecerdasan buatan

- robot kecerdasan buatan

- perangkat lunak kecerdasan buatan

- Pembelajaran Mesin AWS

- blockchain

- konferensi blockchain

- kecerdasan

- kecerdasan buatan percakapan

- konferensi kripto

- dall's

- belajar mendalam

- Ahli (400)

- google itu

- Mesin belajar

- plato

- plato ai

- Kecerdasan Data Plato

- Permainan Plato

- Data Plato

- permainan plato

- skala ai

- sintaksis

- zephyrnet.dll