ML Otomatis memungkinkan Anda memperoleh wawasan umum dan cepat dari data Anda tepat di awal siklus hidup proyek pembelajaran mesin (ML). Memahami terlebih dahulu teknik prapemrosesan dan jenis algoritme mana yang memberikan hasil terbaik akan mengurangi waktu untuk mengembangkan, melatih, dan menerapkan model yang tepat. Hal ini memainkan peran penting dalam setiap proses pengembangan model dan memungkinkan data scientist untuk fokus pada teknik ML yang paling menjanjikan. Selain itu, AutoML menyediakan performa model dasar yang dapat berfungsi sebagai titik referensi bagi tim ilmu data.

Alat AutoML menerapkan kombinasi berbagai algoritme dan berbagai teknik prapemrosesan pada data Anda. Misalnya, dapat menskalakan data, melakukan pemilihan fitur univariat, melakukan PCA pada tingkat ambang batas varians yang berbeda, dan menerapkan pengelompokan. Teknik pra-pemrosesan tersebut dapat diterapkan secara individual atau digabungkan dalam satu saluran pipa. Selanjutnya, alat AutoML akan melatih jenis model yang berbeda, seperti Regresi Linier, Elastic-Net, atau Random Forest, pada versi berbeda dari kumpulan data Anda yang telah diproses sebelumnya dan melakukan pengoptimalan hyperparameter (HPO). Autopilot Amazon SageMaker menghilangkan beban berat dalam membangun model ML. Setelah menyediakan kumpulan data, SageMaker Autopilot secara otomatis mengeksplorasi berbagai solusi untuk menemukan model terbaik. Namun bagaimana jika Anda ingin menerapkan versi alur kerja AutoML yang disesuaikan?

Posting ini menunjukkan cara membuat alur kerja AutoML yang dibuat khusus Amazon SageMaker menggunakan Penyetelan Model Otomatis Amazon SageMaker dengan kode sampel tersedia di a Repo GitHub.

Ikhtisar solusi

Untuk kasus penggunaan ini, anggaplah Anda adalah bagian dari tim ilmu data yang mengembangkan model dalam domain khusus. Anda telah mengembangkan serangkaian teknik prapemrosesan khusus dan memilih sejumlah algoritme yang biasanya Anda harapkan dapat berfungsi dengan baik untuk masalah ML Anda. Saat mengerjakan kasus penggunaan ML baru, Anda ingin menjalankan AutoML terlebih dahulu menggunakan teknik dan algoritme prapemrosesan untuk mempersempit cakupan solusi potensial.

Untuk contoh ini, Anda tidak menggunakan kumpulan data khusus; sebagai gantinya, Anda bekerja dengan kumpulan data Perumahan California tempat Anda akan mengimpor Layanan Penyimpanan Sederhana Amazon (Amazon S3). Fokusnya adalah mendemonstrasikan implementasi teknis dari solusi tersebut menggunakan SageMaker HPO, yang nantinya dapat diterapkan pada kumpulan data dan domain apa pun.

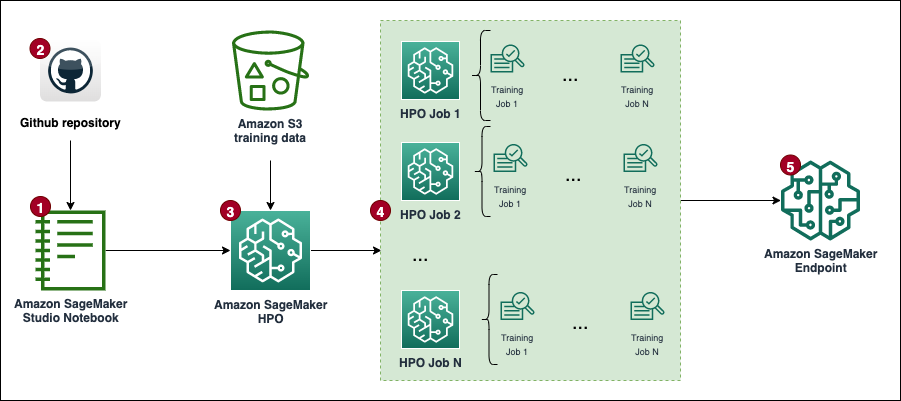

Diagram berikut menyajikan alur kerja solusi secara keseluruhan.

Prasyarat

Berikut ini adalah prasyarat untuk menyelesaikan panduan dalam posting ini:

Terapkan solusinya

Kode lengkap tersedia di GitHub repo.

Langkah-langkah untuk mengimplementasikan solusi tersebut (seperti tercantum dalam diagram alur kerja) adalah sebagai berikut:

- Buat instance notebook dan tentukan hal berikut:

- Untuk Jenis instance notebook, pilih ml.t3.medium.

- Untuk Inferensi Elastis, pilih tak satupun.

- Untuk Pengidentifikasi platform, pilih Amazon Linux 2, Lab Jupyter 3.

- Untuk Peran IAM, pilih default

AmazonSageMaker-ExecutionRole. Jika tidak ada, buat yang baru Identitas AWS dan Manajemen Akses (IAM) peran dan lampirkan Kebijakan IAM AmazonSageMakerFullAccess.

Perhatikan bahwa Anda harus membuat peran dan kebijakan eksekusi dengan cakupan minimal dalam produksi.

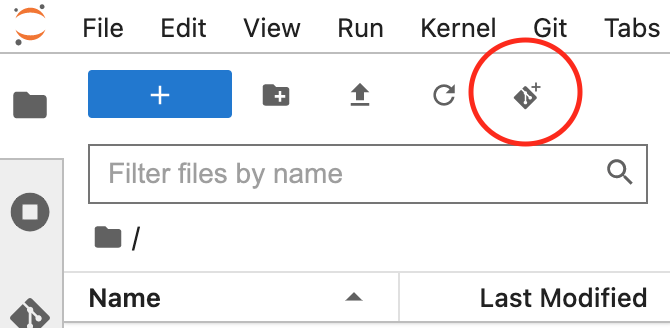

- Buka antarmuka JupyterLab untuk instans notebook Anda dan kloning repo GitHub.

Anda dapat melakukannya dengan memulai sesi terminal baru dan menjalankan git clone <REPO> perintah atau dengan menggunakan fungsionalitas UI, seperti yang ditunjukkan pada tangkapan layar berikut.

- Buka

automl.ipynbfile buku catatan, pilihconda_python3kernel, dan ikuti instruksi untuk memicu a kumpulan pekerjaan HPO.

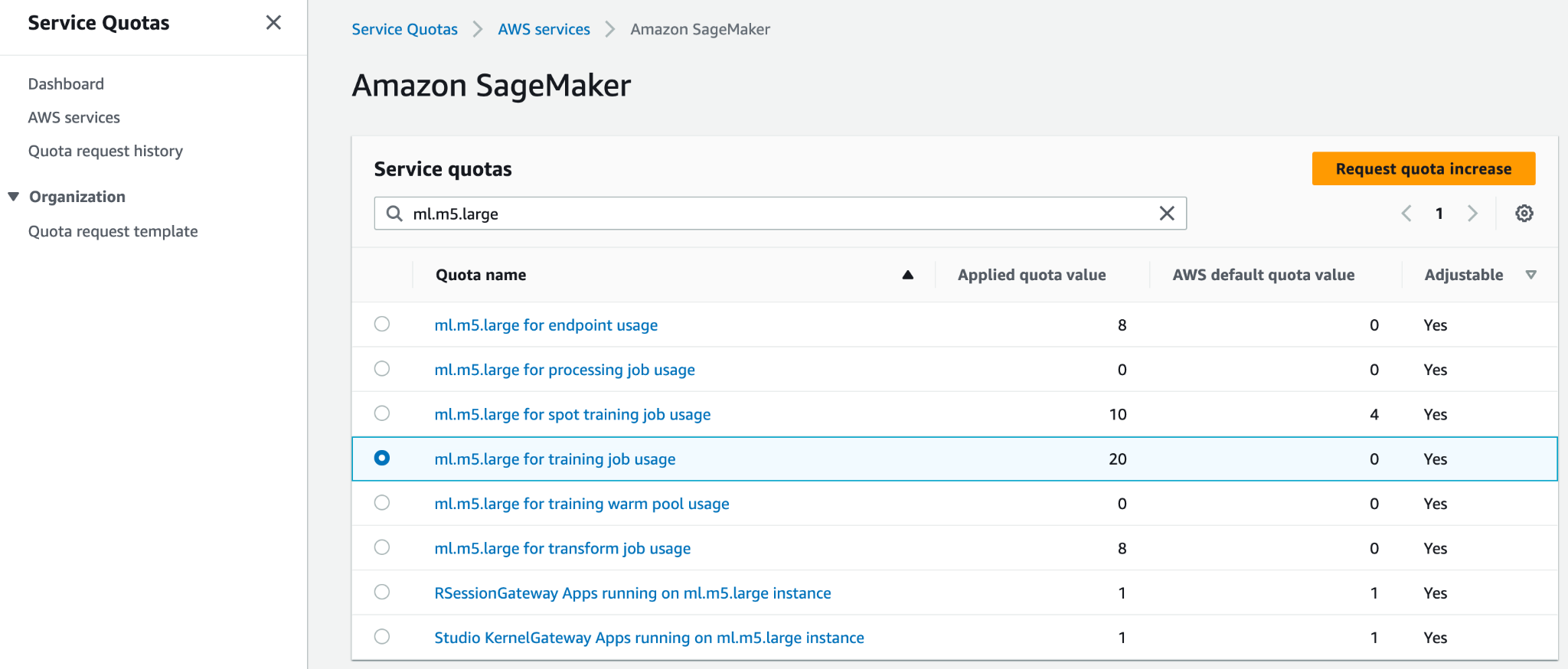

Untuk menjalankan kode tanpa perubahan apa pun, Anda perlu menambah kuota layanan ml.m5.large untuk penggunaan pekerjaan pelatihan dan Jumlah instance di semua tugas pelatihan. AWS secara default hanya mengizinkan 20 tugas pelatihan SageMaker paralel untuk kedua kuota. Anda perlu meminta penambahan kuota menjadi 30 untuk keduanya. Kedua perubahan kuota tersebut biasanya akan disetujui dalam beberapa menit. Mengacu pada Meminta penambahan kuota for more information.

Jika tidak ingin mengubah kuota, Anda cukup mengubah nilai kuotanya MAX_PARALLEL_JOBS variabel dalam skrip (misalnya, ke 5).

- Setiap pekerjaan HPO akan menyelesaikan satu set pekerjaan pelatihan uji coba dan menunjukkan model dengan hyperparameter optimal.

- Analisis hasil dan menerapkan model dengan kinerja terbaik.

Solusi ini akan menimbulkan biaya di akun AWS Anda. Biaya solusi ini akan bergantung pada jumlah dan durasi pekerjaan pelatihan HPO. Jika hal ini meningkat, maka biayanya juga akan meningkat. Anda dapat mengurangi biaya dengan membatasi waktu pelatihan dan konfigurasi TuningJobCompletionCriteriaConfig sesuai dengan instruksi yang dibahas nanti di posting ini. Untuk informasi harga, lihat Harga Amazon SageMaker.

Pada bagian berikut, kita membahas notebook secara lebih rinci dengan contoh kode dan langkah-langkah untuk menganalisis hasil dan memilih model terbaik.

Pengaturan awal

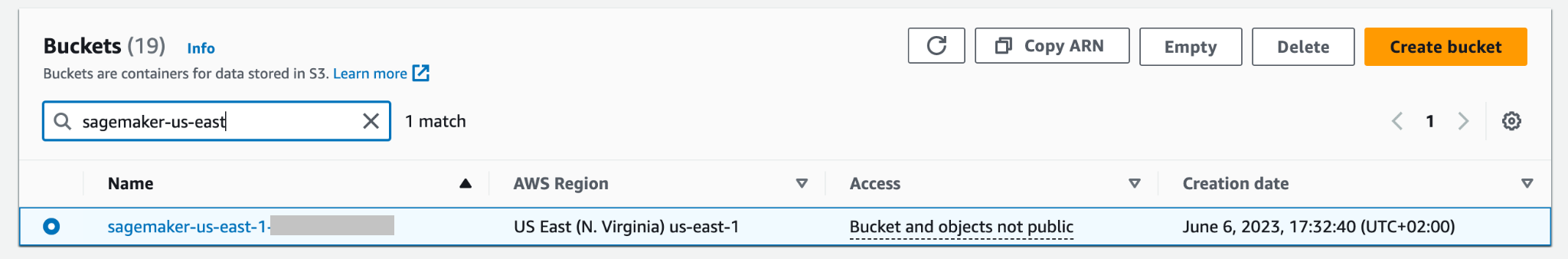

Mari kita mulai dengan menjalankan Impor & Pengaturan bagian di custom-automl.ipynb buku catatan. Ini menginstal dan mengimpor semua dependensi yang diperlukan, membuat instance sesi dan klien SageMaker, dan menetapkan Wilayah default dan bucket S3 untuk menyimpan data.

Persiapan data

Unduh kumpulan data Perumahan California dan persiapkan dengan menjalankan Download Data bagian buku catatan. Himpunan data dibagi menjadi bingkai data pelatihan dan pengujian dan diunggah ke bucket S3 default sesi SageMaker.

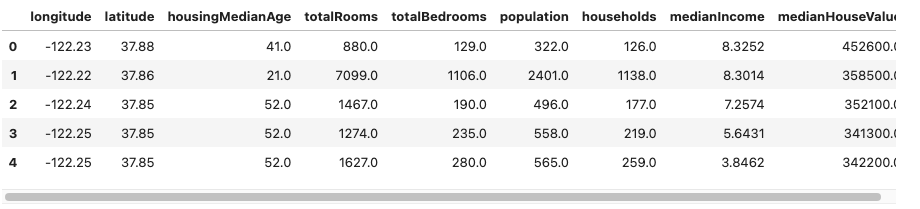

Seluruh kumpulan data memiliki total 20,640 catatan dan 9 kolom, termasuk target. Tujuannya adalah untuk memprediksi nilai median sebuah rumah (medianHouseValue kolom). Tangkapan layar berikut menunjukkan baris teratas kumpulan data.

Templat skrip pelatihan

Alur kerja AutoML dalam postingan ini didasarkan pada scikit-belajar pipeline dan algoritma pra-pemrosesan. Tujuannya adalah untuk menghasilkan kombinasi besar alur dan algoritme prapemrosesan yang berbeda untuk menemukan penyiapan dengan kinerja terbaik. Mari kita mulai dengan membuat skrip pelatihan umum, yang disimpan secara lokal pada instance notebook. Dalam skrip ini, ada dua blok komentar kosong: satu untuk memasukkan hyperparameter dan yang lainnya untuk objek pipa model prapemrosesan. Mereka akan disuntikkan secara dinamis untuk setiap kandidat model prapemrosesan. Tujuan memiliki satu skrip umum adalah untuk menjaga implementasinya KERING (jangan ulangi).

Buat kombinasi pra-pemrosesan dan model

Grafik preprocessors kamus berisi spesifikasi teknik pra-pemrosesan yang diterapkan pada semua fitur masukan model. Setiap resep didefinisikan menggunakan a Pipeline atau FeatureUnion objek dari scikit-learn, yang menyatukan transformasi data individual dan menumpuknya bersama-sama. Misalnya, mean-imp-scale adalah resep sederhana yang memastikan bahwa nilai yang hilang diperhitungkan menggunakan nilai rata-rata kolom masing-masing dan semua fitur diskalakan menggunakan Penskala Standar. Sebaliknya, mean-imp-scale-pca rangkaian resep bersama-sama beberapa operasi lagi:

- Hitung nilai yang hilang di kolom dengan meannya.

- Terapkan penskalaan fitur menggunakan mean dan deviasi standar.

- Hitung PCA di atas data masukan pada nilai ambang batas varians tertentu dan gabungkan bersama dengan fitur masukan yang diperhitungkan dan diskalakan.

Dalam postingan ini, semua fitur input bersifat numerik. Jika Anda memiliki lebih banyak tipe data dalam kumpulan data masukan, Anda harus menentukan alur yang lebih rumit di mana cabang pemrosesan awal yang berbeda diterapkan ke kumpulan tipe fitur yang berbeda.

Grafik models kamus berisi spesifikasi algoritme berbeda yang sesuai dengan kumpulan data Anda. Setiap tipe model dilengkapi dengan spesifikasi berikut dalam kamus:

- skrip_output – Menunjuk ke lokasi skrip pelatihan yang digunakan oleh estimator. Bidang ini diisi secara dinamis ketika

modelskamus digabungkan denganpreprocessorskamus. - sisipan – Mendefinisikan kode yang akan dimasukkan ke dalam

script_draft.pydan kemudian disimpan di bawahscript_output. Kunci“preprocessor”sengaja dikosongkan karena lokasi ini diisi dengan salah satu praprosesor untuk membuat beberapa kombinasi model-praprosesor. - hiperparameter – Satu set hyperparameter yang dioptimalkan oleh pekerjaan HPO.

- sertakan_cls_metadata – Detail konfigurasi lebih lanjut diperlukan oleh SageMaker

Tunerkelas.

Contoh lengkap dari models kamus tersedia di repositori GitHub.

Selanjutnya, mari kita mengulanginya preprocessors dan models kamus dan buat semua kemungkinan kombinasi. Misalnya, jika Anda preprocessors kamus berisi 10 resep dan Anda memiliki 5 definisi model di dalamnya models kamus, kamus pipeline yang baru dibuat berisi 50 pipeline model praprosesor yang dievaluasi selama HPO. Perhatikan bahwa skrip alur individual belum dibuat pada saat ini. Blok kode berikutnya (sel 9) dari notebook Jupyter melakukan iterasi melalui semua objek model praprosesor di pipelines kamus, menyisipkan semua potongan kode yang relevan, dan mempertahankan versi skrip khusus saluran secara lokal di buku catatan. Skrip tersebut digunakan pada langkah berikutnya saat membuat estimator individual yang Anda masukkan ke pekerjaan HPO.

Tentukan penduga

Anda sekarang dapat berupaya menentukan Estimator SageMaker yang digunakan pekerjaan HPO setelah skrip siap. Mari kita mulai dengan membuat kelas wrapper yang mendefinisikan beberapa properti umum untuk semua estimator. Itu mewarisi dari SKLearn kelas dan menentukan peran, jumlah instance, dan tipe, serta kolom mana yang digunakan oleh skrip sebagai fitur dan target.

Mari kita membangun estimators kamus dengan mengulangi semua skrip yang dihasilkan sebelumnya dan terletak di scripts direktori. Anda membuat instance estimator baru menggunakan SKLearnBase kelas, dengan nama estimator unik, dan salah satu skrip. Perhatikan bahwa estimators kamus memiliki dua tingkatan: tingkat atas mendefinisikan a pipeline_family. Ini adalah pengelompokan logis berdasarkan jenis model yang akan dievaluasi dan sama dengan panjangnya models kamus. Tingkat kedua berisi tipe praprosesor individual yang digabungkan dengan yang diberikan pipeline_family. Pengelompokan logis ini diperlukan saat membuat pekerjaan HPO.

Tentukan argumen tuner HPO

Untuk mengoptimalkan penyampaian argumen ke HPO Tuner kelas, itu HyperparameterTunerArgs kelas data diinisialisasi dengan argumen yang dibutuhkan oleh kelas HPO. Muncul dengan serangkaian fungsi, yang memastikan argumen HPO dikembalikan dalam format yang diharapkan saat menerapkan beberapa definisi model sekaligus.

Blok kode berikutnya menggunakan yang diperkenalkan sebelumnya HyperparameterTunerArgs kelas data. Anda membuat kamus lain yang disebut hp_args dan menghasilkan sekumpulan parameter masukan khusus untuk masing-masing parameter estimator_family dari estimators kamus. Argumen ini digunakan pada langkah berikutnya saat menginisialisasi pekerjaan HPO untuk setiap rangkaian model.

Buat objek tuner HPO

Pada langkah ini, Anda membuat tuner individual untuk setiap tuner estimator_family. Mengapa Anda membuat tiga pekerjaan HPO terpisah alih-alih meluncurkan hanya satu pekerjaan di semua estimator? Itu HyperparameterTuner kelas dibatasi pada 10 definisi model yang menyertainya. Oleh karena itu, setiap HPO bertanggung jawab untuk menemukan praprosesor yang berkinerja terbaik untuk kelompok model tertentu dan menyesuaikan hyperparameter keluarga model tersebut.

Berikut adalah beberapa poin lagi mengenai pengaturan:

- Strategi pengoptimalannya adalah Bayesian, yang berarti HPO secara aktif memantau kinerja semua uji coba dan mengarahkan pengoptimalan menuju kombinasi hyperparameter yang lebih menjanjikan. Penghentian awal harus diatur ke Off or Mobil ketika bekerja dengan strategi Bayesian, yang menangani logika itu sendiri.

- Setiap pekerjaan HPO dijalankan maksimal 100 pekerjaan dan menjalankan 10 pekerjaan secara paralel. Jika Anda berurusan dengan kumpulan data yang lebih besar, Anda mungkin ingin menambah jumlah total pekerjaan.

- Selain itu, Anda mungkin ingin menggunakan pengaturan yang mengontrol berapa lama pekerjaan berjalan dan berapa banyak pekerjaan yang dipicu oleh HPO Anda. Salah satu cara untuk melakukannya adalah dengan menyetel waktu proses maksimum dalam hitungan detik (untuk postingan ini, kami menyetelnya menjadi 1 jam). Cara lainnya adalah dengan menggunakan yang baru dirilis

TuningJobCompletionCriteriaConfig. Ini menawarkan serangkaian pengaturan yang memantau kemajuan pekerjaan Anda dan memutuskan apakah semakin banyak pekerjaan akan meningkatkan hasilnya. Dalam postingan ini, kami menetapkan jumlah maksimum pekerjaan pelatihan yang tidak meningkat menjadi 20. Dengan demikian, jika skornya tidak meningkat (misalnya, dari uji coba keempat puluh), Anda tidak perlu membayar untuk sisa uji coba hinggamax_jobstercapai.

Sekarang mari kita mengulanginya tuners dan hp_args kamus dan memicu semua pekerjaan HPO di SageMaker. Perhatikan penggunaan argumen tunggu yang disetel ke False, yang berarti kernel tidak akan menunggu hingga hasilnya selesai dan Anda dapat memicu semua pekerjaan sekaligus.

Kemungkinan besar tidak semua pekerjaan pelatihan akan selesai dan beberapa di antaranya mungkin dihentikan oleh pekerjaan HPO. Alasannya adalah TuningJobCompletionCriteriaConfig—pengoptimalan selesai jika salah satu kriteria yang ditentukan terpenuhi. Dalam kasus ini, ketika kriteria pengoptimalan tidak membaik selama 20 pekerjaan berturut-turut.

Analisis hasil

Sel 15 buku catatan memeriksa apakah semua pekerjaan HPO telah selesai dan menggabungkan semua hasil dalam bentuk bingkai data pandas untuk analisis lebih lanjut. Sebelum menganalisis hasilnya secara mendetail, mari kita lihat konsol SageMaker secara mendalam.

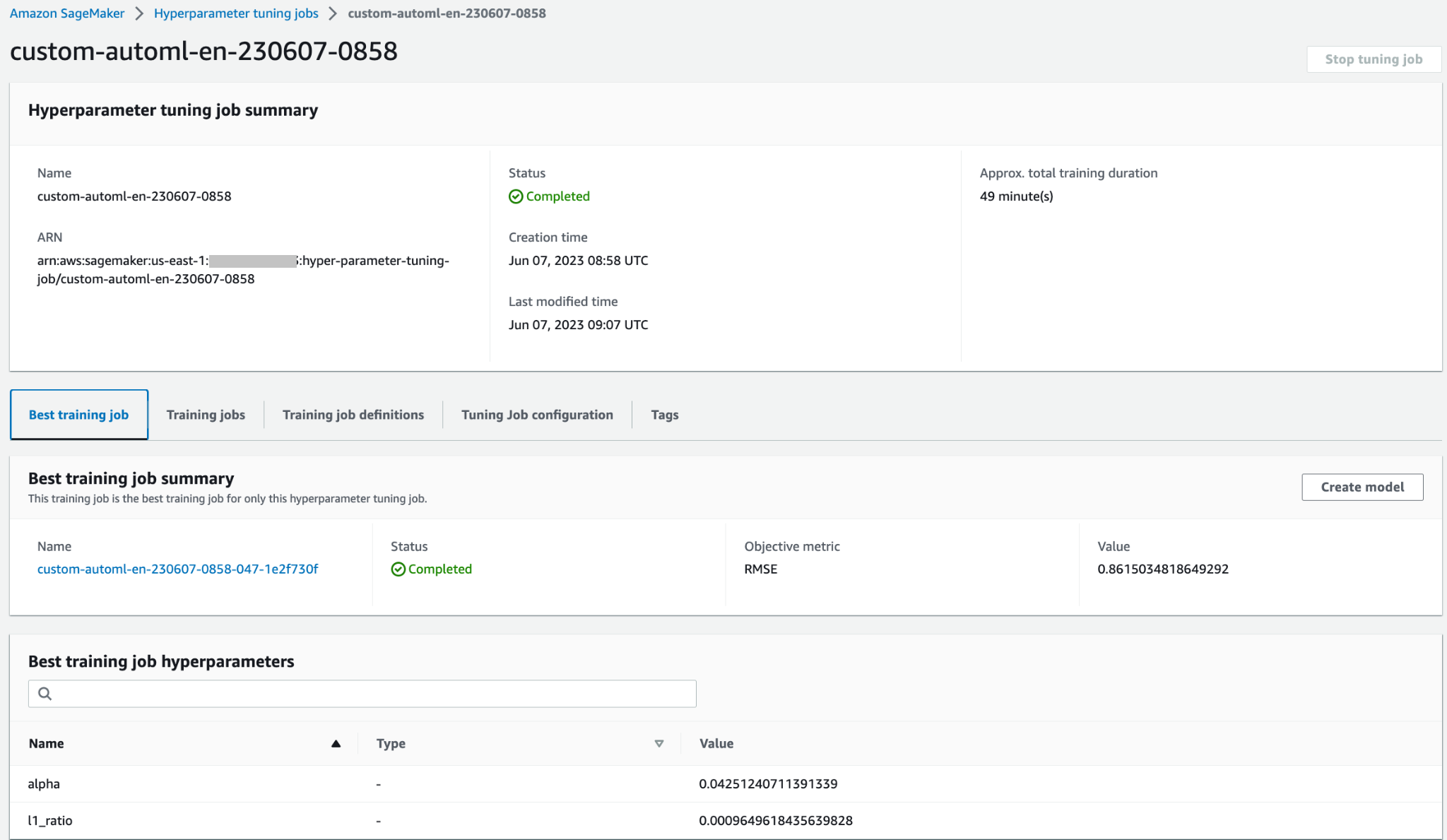

Di bagian atas Pekerjaan penyetelan hyperparameter halaman, Anda dapat melihat tiga pekerjaan HPO yang Anda luncurkan. Semuanya selesai lebih awal dan tidak melakukan semua 100 pekerjaan pelatihan. Pada tangkapan layar berikut, Anda dapat melihat bahwa rangkaian model Elastic-Net menyelesaikan jumlah uji coba terbanyak, sedangkan rangkaian model lainnya tidak memerlukan begitu banyak tugas pelatihan untuk menemukan hasil terbaik.

Anda dapat membuka pekerjaan HPO untuk mengakses detail lebih lanjut, seperti pekerjaan pelatihan individual, konfigurasi pekerjaan, serta informasi dan kinerja pekerjaan pelatihan terbaik.

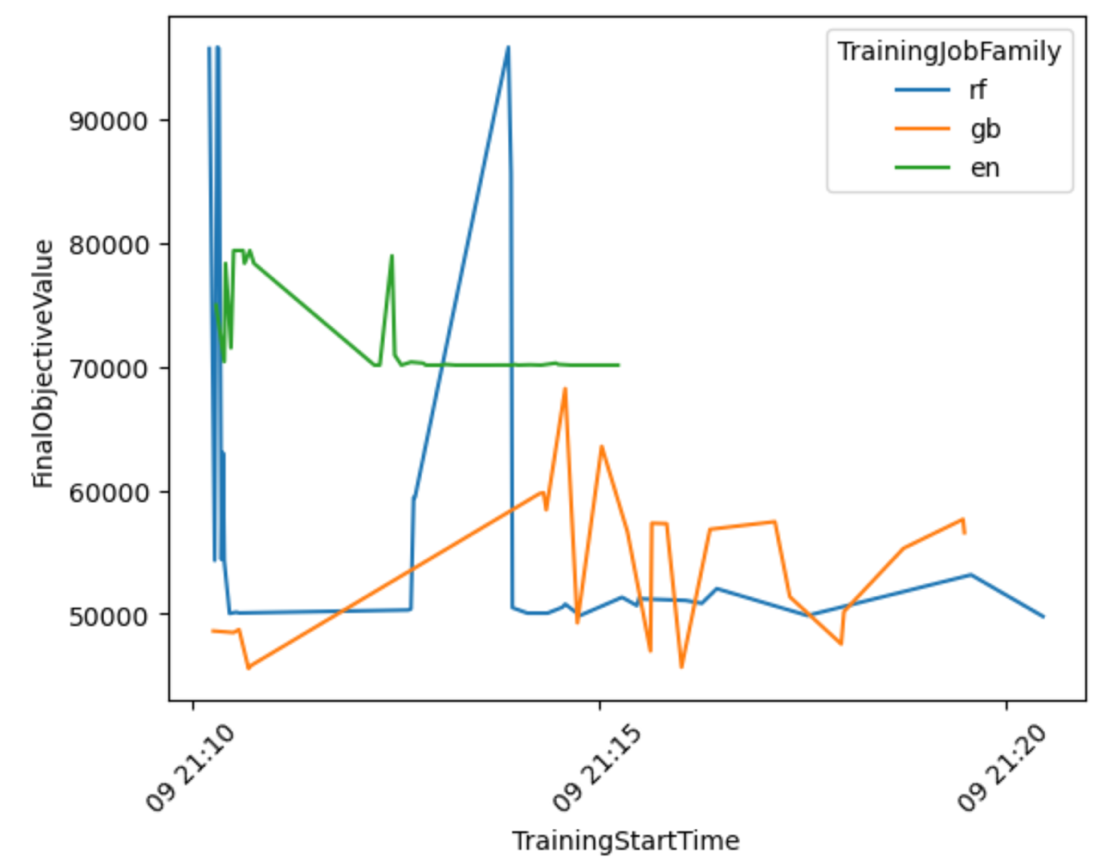

Mari buat visualisasi berdasarkan hasil untuk mendapatkan lebih banyak wawasan tentang performa alur kerja AutoML di semua kelompok model.

Dari grafik berikut dapat disimpulkan bahwa Elastic-Net performa model berkisar antara 70,000 dan 80,000 RMSE dan akhirnya terhenti, karena algoritme tidak dapat meningkatkan performanya meskipun telah mencoba berbagai teknik prapemrosesan dan nilai hyperparameter. Tampaknya juga demikian RandomForest kinerjanya sangat bervariasi tergantung pada kumpulan hyperparameter yang dieksplorasi oleh HPO, namun meskipun telah dilakukan banyak percobaan, kinerjanya tidak dapat mencapai kesalahan di bawah 50,000 RMSE. GradientBoosting mencapai kinerja terbaik sejak awal di bawah 50,000 RMSE. HPO mencoba meningkatkan hasil tersebut lebih lanjut tetapi tidak mampu mencapai kinerja yang lebih baik di seluruh kombinasi hyperparameter lainnya. Kesimpulan umum untuk semua pekerjaan HPO adalah bahwa tidak banyak pekerjaan yang diperlukan untuk menemukan kumpulan hyperparameter dengan kinerja terbaik untuk setiap algoritme. Untuk lebih meningkatkan hasilnya, Anda perlu bereksperimen dengan membuat lebih banyak fitur dan melakukan rekayasa fitur tambahan.

Anda juga dapat memeriksa tampilan lebih detail tentang kombinasi model-praprosesor untuk menarik kesimpulan tentang kombinasi yang paling menjanjikan.

Pilih model terbaik dan terapkan

Cuplikan kode berikut memilih model terbaik berdasarkan nilai tujuan terendah yang dicapai. Anda kemudian dapat menerapkan model tersebut sebagai titik akhir SageMaker.

Membersihkan

Untuk mencegah biaya yang tidak diinginkan ke akun AWS Anda, sebaiknya hapus sumber daya AWS yang Anda gunakan dalam postingan ini:

- Di konsol Amazon S3, kosongkan data dari bucket S3 tempat data pelatihan disimpan.

- Di konsol SageMaker, hentikan instans notebook.

- Hapus titik akhir model jika Anda menerapkannya. Titik akhir harus dihapus bila tidak lagi digunakan, karena titik akhir ditagih berdasarkan waktu penerapan.

Kesimpulan

Dalam postingan ini, kami memamerkan cara membuat pekerjaan HPO khusus di SageMaker menggunakan pilihan algoritma dan teknik pra-pemrosesan khusus. Secara khusus, contoh ini menunjukkan cara mengotomatiskan proses pembuatan banyak skrip pelatihan dan cara menggunakan struktur pemrograman Python untuk penerapan beberapa pekerjaan pengoptimalan paralel secara efisien. Kami berharap solusi ini akan menjadi landasan bagi setiap pekerjaan penyetelan model kustom yang akan Anda terapkan menggunakan SageMaker untuk mencapai performa lebih tinggi dan mempercepat alur kerja ML Anda.

Lihat sumber daya berikut untuk lebih memperdalam pengetahuan Anda tentang cara menggunakan SageMaker HPO:

Tentang Penulis

Konrad Semsch adalah Arsitek Solusi ML Senior di Tim Lab Data Amazon Web Services. Dia membantu pelanggan menggunakan pembelajaran mesin untuk memecahkan tantangan bisnis mereka dengan AWS. Dia senang menciptakan dan menyederhanakan untuk memungkinkan pelanggan mendapatkan solusi sederhana dan pragmatis untuk proyek AI/ML mereka. Dia paling tertarik dengan MlOps dan ilmu data tradisional. Di luar pekerjaan, dia adalah penggemar berat selancar angin dan selancar layang.

Konrad Semsch adalah Arsitek Solusi ML Senior di Tim Lab Data Amazon Web Services. Dia membantu pelanggan menggunakan pembelajaran mesin untuk memecahkan tantangan bisnis mereka dengan AWS. Dia senang menciptakan dan menyederhanakan untuk memungkinkan pelanggan mendapatkan solusi sederhana dan pragmatis untuk proyek AI/ML mereka. Dia paling tertarik dengan MlOps dan ilmu data tradisional. Di luar pekerjaan, dia adalah penggemar berat selancar angin dan selancar layang.

Tuna Ersoy adalah Arsitek Solusi Senior di AWS. Fokus utamanya adalah membantu pelanggan Sektor Publik mengadopsi teknologi cloud untuk beban kerja mereka. Dia memiliki latar belakang dalam pengembangan aplikasi, arsitektur perusahaan, dan teknologi pusat kontak. Minatnya meliputi arsitektur tanpa server dan AI/ML.

Tuna Ersoy adalah Arsitek Solusi Senior di AWS. Fokus utamanya adalah membantu pelanggan Sektor Publik mengadopsi teknologi cloud untuk beban kerja mereka. Dia memiliki latar belakang dalam pengembangan aplikasi, arsitektur perusahaan, dan teknologi pusat kontak. Minatnya meliputi arsitektur tanpa server dan AI/ML.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Sanggup

- Tentang Kami

- mengakses

- Menurut

- Akun

- Mencapai

- dicapai

- di seluruh

- aktif

- Tambahan

- Selain itu

- mengambil

- Setelah

- AI / ML

- tujuan

- algoritma

- algoritma

- Semua

- Membiarkan

- memungkinkan

- sudah

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analisis

- menganalisa

- menganalisis

- dan

- Lain

- Apa pun

- Aplikasi

- Pengembangan Aplikasi

- terapan

- berlaku

- Mendaftar

- disetujui

- arsitektur

- ADALAH

- argumen

- argumen

- AS

- menganggap

- At

- melampirkan

- mobil

- mengotomatisasikan

- secara otomatis

- secara otomatis

- ML Otomatis

- tersedia

- AWS

- latar belakang

- mendasarkan

- berdasarkan

- Dasar

- Bayesian

- BE

- karena

- sebelum

- Awal

- di bawah

- TERBAIK

- Lebih baik

- antara

- Besar

- Memblokir

- Blok

- kedua

- cabang

- membangun

- Bangunan

- bisnis

- tapi

- tombol

- by

- california

- panggilan

- bernama

- CAN

- calon

- kasus

- kasus

- pusat

- rantai

- tantangan

- perubahan

- Perubahan

- beban

- Cek

- Pilih

- kelas

- CLF

- klien

- awan

- Kelompok

- kekelompokan

- kode

- Kolom

- Kolom

- kombinasi

- kombinasi

- bergabung

- menggabungkan

- datang

- komentar

- Umum

- lengkap

- Lengkap

- menyelesaikan

- rumit

- menyimpulkan

- kesimpulan

- Mengadakan

- konfigurasi

- berturut-turut

- konsul

- kontak

- contact center

- mengandung

- kontras

- kontrol

- Biaya

- Biaya

- bisa

- membuat

- dibuat

- membuat

- kriteria

- sangat penting

- Sekarang

- adat

- pelanggan

- data

- ilmu data

- kumpulan data

- berurusan

- memutuskan

- Memperdalam

- Default

- didefinisikan

- Mendefinisikan

- mendefinisikan

- definisi

- mendemonstrasikan

- menunjukkan

- tergantung

- ketergantungan

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- memperoleh

- Meskipun

- rinci

- terperinci

- rincian

- mengembangkan

- dikembangkan

- Pengembangan

- mengembangkan

- penyimpangan

- DICT

- berbeda

- direktori

- membahas

- dibahas

- do

- Tidak

- domain

- Dont

- turun

- seri

- kering

- lamanya

- selama

- dinamis

- setiap

- Awal

- efisien

- menghilangkan

- aktif

- Titik akhir

- Teknik

- memastikan

- Memastikan

- Enterprise

- Seluruh

- sepenuhnya

- sama

- kesalahan

- mengevaluasi

- dievaluasi

- akhirnya

- Setiap

- memeriksa

- contoh

- contoh

- eksekusi

- ada

- mengharapkan

- diharapkan

- eksperimen

- menjelaskan

- Dieksplorasi

- mengeksplorasi

- palsu

- keluarga

- keluarga

- kipas

- Fitur

- Fitur

- beberapa

- bidang

- File

- terisi

- Menemukan

- temuan

- Pertama

- cocok

- lima

- Fokus

- mengikuti

- berikut

- berikut

- Untuk

- hutan

- bentuk

- format

- FRAME

- dari

- depan

- penuh

- fungsi

- fungsi

- fungsi

- lebih lanjut

- Umum

- menghasilkan

- dihasilkan

- menghasilkan

- mendapatkan

- pergi

- GitHub

- diberikan

- Go

- tujuan

- akan

- grafik

- tangan

- Menangani

- Memiliki

- memiliki

- he

- berat

- angkat berat

- membantu

- membantu

- dia

- tingkat tinggi

- lebih tinggi

- paling tinggi

- berharap

- jam

- Rumah

- rumah tangga

- perumahan

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- http

- HTTPS

- Optimalisasi Hyperparameter

- Penyesuaian Hyperparameter

- identitas

- if

- melaksanakan

- implementasi

- mengimpor

- impor

- memperbaiki

- meningkatkan

- in

- memasukkan

- Termasuk

- Meningkatkan

- menunjukkan

- sendiri-sendiri

- Secara individual

- informasi

- memasukkan

- input

- Sisipan

- wawasan

- contoh

- sebagai gantinya

- instruksi

- integrasi

- dengan sengaja

- kepentingan

- Antarmuka

- ke

- diperkenalkan

- IT

- NYA

- Diri

- Pekerjaan

- Jobs

- jpg

- hanya

- hanya satu

- Menjaga

- kunci

- pengetahuan

- laboratorium

- besar

- lebih besar

- kemudian

- diluncurkan

- peluncuran

- pengetahuan

- meninggalkan

- Panjang

- Tingkat

- adalah ide yang bagus

- siklus hidup

- pengangkatan

- 'like'

- Mungkin

- membatasi

- linux

- memuat

- lokal

- terletak

- tempat

- logika

- logis

- Panjang

- lagi

- melihat

- Lot

- terendah

- mesin

- Mesin belajar

- banyak

- maksimum

- Mungkin..

- berarti

- cara

- Bergabung

- bertemu

- Metrik

- mungkin

- menit

- hilang

- ML

- MLOps

- model

- model

- memodifikasi

- Memantau

- monitor

- lebih

- paling

- beberapa

- nama

- sempit

- menavigasi

- Perlu

- New

- baru saja

- berikutnya

- tidak

- None

- buku catatan

- terkenal

- sekarang

- jumlah

- mati rasa

- obyek

- tujuan

- objek

- of

- lepas

- Penawaran

- on

- sekali

- ONE

- hanya

- Buka

- Operasi

- optimal

- optimasi

- Optimize

- dioptimalkan

- or

- urutan

- OS

- Lainnya

- Lainnya

- di luar

- keluaran

- di luar

- lebih

- secara keseluruhan

- halaman

- panda

- Paralel

- parameter

- bagian

- tertentu

- Lewat

- bergairah

- path

- Membayar

- Melakukan

- prestasi

- melakukan

- terus berlanjut

- potongan-potongan

- pipa saluran

- plato

- Kecerdasan Data Plato

- Data Plato

- memainkan

- steker

- Titik

- poin

- kebijaksanaan

- populasi

- mungkin

- Pos

- potensi

- pragmatis

- meramalkan

- Predictor

- Mempersiapkan

- prasyarat

- hadiah

- mencegah

- sebelumnya

- di harga

- primer

- Mencetak

- Masalah

- proses

- menghasilkan

- Produksi

- Pemrograman

- Kemajuan

- proyek

- memprojeksikan

- menjanjikan

- properties

- memberikan

- menyediakan

- menyediakan

- publik

- tujuan

- Ular sanca

- acak

- cepat

- tercapai

- siap

- alasan

- baru-baru ini

- resep

- sarankan

- arsip

- menurunkan

- mengurangi

- lihat

- referensi

- mengenai

- regex

- wilayah

- dirilis

- relevan

- yang tersisa

- menghapus

- ulangi

- gudang

- permintaan

- membutuhkan

- wajib

- Sumber

- itu

- tanggung jawab

- terbatas

- mengakibatkan

- Hasil

- kembali

- benar

- Peran

- Run

- berjalan

- berjalan

- runtime

- pembuat bijak

- Penyetelan Model Otomatis SageMaker

- disimpan

- Skala

- skala

- Ilmu

- ilmuwan

- scikit-belajar

- cakupan

- skor

- naskah

- script

- Kedua

- detik

- Bagian

- bagian

- sektor

- melihat

- tampaknya

- terpilih

- seleksi

- DIRI

- senior

- terpisah

- melayani

- Tanpa Server

- layanan

- Layanan

- Sidang

- set

- set

- pengaturan

- penyiapan

- dia

- harus

- dipamerkan

- ditunjukkan

- Pertunjukkan

- Sederhana

- menyederhanakan

- hanya

- potongan

- So

- larutan

- Solusi

- MEMECAHKAN

- beberapa

- khusus

- tertentu

- spesifikasi

- spesifikasi

- ditentukan

- kecepatan

- membagi

- tumpukan

- standar

- awal

- Mulai

- Status

- Langkah

- Tangga

- berhenti

- terhenti

- henti

- penyimpanan

- tersimpan

- menyimpan

- Penyelarasan

- struktur

- struktur

- Kemudian

- seperti itu

- Didukung

- tabel

- disesuaikan

- Mengambil

- target

- tim

- Teknis

- teknik

- Teknologi

- terminal

- uji

- pengujian

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- Sana.

- karena itu

- Ini

- mereka

- ini

- itu

- tiga

- ambang

- Melalui

- waktu

- untuk

- bersama

- alat

- puncak

- Total

- terhadap

- tradisional

- Pelatihan VE

- Pelatihan

- transformasi

- percobaan

- uji

- mencoba

- memicu

- dipicu

- memicu

- mencoba

- menyetel

- dua

- mengetik

- jenis

- khas

- ui

- bawah

- pemahaman

- unik

- sampai

- tidak diinginkan

- upload

- penggunaan

- menggunakan

- gunakan case

- bekas

- kegunaan

- menggunakan

- MENGESAHKAN

- nilai

- Nilai - Nilai

- variabel

- bervariasi

- berbagai

- versi

- Versi

- View

- visualisasi

- W

- menunggu

- walkthrough

- ingin

- adalah

- Cara..

- we

- jaringan

- layanan web

- BAIK

- adalah

- Apa

- ketika

- sedangkan

- apakah

- yang

- mengapa

- akan

- dengan

- dalam

- tanpa

- Kerja

- alur kerja

- Alur kerja

- kerja

- akan

- menulis

- namun

- Kamu

- Anda

- diri

- zephyrnet.dll