Perusahaan KT adalah salah satu penyedia telekomunikasi terbesar di Korea Selatan, yang menawarkan berbagai layanan termasuk telepon saluran tetap, komunikasi seluler, dan internet, serta layanan AI. AI Food Tag dari KT adalah solusi manajemen diet berbasis AI yang mengidentifikasi jenis dan kandungan nutrisi makanan dalam foto menggunakan model visi komputer. Model visi yang dikembangkan oleh KT ini mengandalkan model yang telah dilatih sebelumnya dengan sejumlah besar data gambar tak berlabel untuk menganalisis kandungan nutrisi dan informasi kalori berbagai makanan. AI Food Tag dapat membantu pasien dengan penyakit kronis seperti diabetes mengatur pola makan mereka. KT menggunakan AWS dan Amazon SageMaker untuk melatih model AI Food Tag ini 29 kali lebih cepat dari sebelumnya dan mengoptimalkannya untuk penerapan produksi dengan teknik distilasi model. Dalam postingan ini, kami menjelaskan perjalanan dan kesuksesan pengembangan model KT menggunakan SageMaker.

Memperkenalkan proyek KT dan mendefinisikan masalahnya

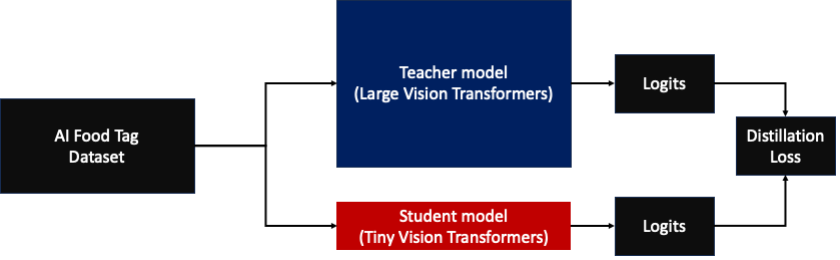

Model AI Food Tag yang dilatih sebelumnya oleh KT didasarkan pada arsitektur vision transformer (ViT) dan memiliki lebih banyak parameter model dibandingkan model vision sebelumnya untuk meningkatkan akurasi. Untuk memperkecil ukuran model untuk produksi, KT menggunakan teknik penyulingan pengetahuan (KD) untuk mengurangi jumlah parameter model tanpa berdampak signifikan terhadap akurasi. Dengan penyulingan pengetahuan, model terlatih disebut a model guru, dan model keluaran ringan dilatih sebagai a model siswa, seperti yang diilustrasikan pada gambar berikut. Model siswa yang ringan memiliki parameter model yang lebih sedikit dibandingkan model pengajar, sehingga mengurangi kebutuhan memori dan memungkinkan penerapan pada instance yang lebih kecil dan lebih murah. Siswa mempertahankan akurasi yang dapat diterima meskipun lebih kecil dengan belajar dari keluaran model guru.

Model guru tetap tidak berubah selama KD, namun model siswa dilatih menggunakan logit keluaran model guru sebagai label untuk menghitung kerugian. Dengan paradigma KD ini, baik guru maupun siswa harus menggunakan satu memori GPU untuk pelatihan. KT awalnya menggunakan dua GPU (A100 80 GB) di lingkungan internal lokalnya untuk melatih model siswa, namun prosesnya memerlukan waktu sekitar 40 hari untuk mencakup 300 periode. Untuk mempercepat pelatihan dan menghasilkan model siswa dalam waktu yang lebih singkat, KT bermitra dengan AWS. Bersama-sama, tim mengurangi waktu pelatihan model secara signifikan. Posting ini menjelaskan bagaimana tim menggunakan Pelatihan Amazon SageMaker, yang Pustaka Paralelisme Data SageMaker, Debugger Amazon SageMaker, dan Profiler Amazon SageMaker untuk berhasil mengembangkan model AI Food Tag yang ringan.

Membangun lingkungan pelatihan terdistribusi dengan SageMaker

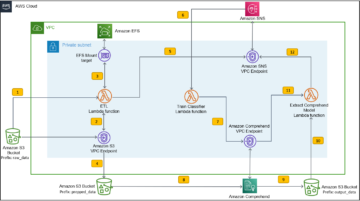

Pelatihan SageMaker adalah lingkungan pelatihan pembelajaran mesin (ML) terkelola di AWS yang menyediakan serangkaian fitur dan alat untuk menyederhanakan pengalaman pelatihan dan dapat berguna dalam komputasi terdistribusi, seperti yang diilustrasikan dalam diagram berikut.

Pelanggan SageMaker juga dapat mengakses image Docker bawaan dengan berbagai kerangka pembelajaran mendalam yang telah diinstal sebelumnya dan paket Linux, NCCL, dan Python yang diperlukan untuk pelatihan model. Ilmuwan data atau insinyur ML yang ingin menjalankan pelatihan model dapat melakukannya tanpa beban mengonfigurasi infrastruktur pelatihan atau mengelola Docker dan kompatibilitas perpustakaan yang berbeda.

Selama lokakarya 1 hari, kami dapat menyiapkan konfigurasi pelatihan terdistribusi berdasarkan SageMaker dalam akun AWS KT, mempercepat skrip pelatihan KT menggunakan perpustakaan SageMaker Distributed Data Parallel (DDP), dan bahkan menguji tugas pelatihan menggunakan dua ml. p4d.24xlarge contoh. Di bagian ini, kami menjelaskan pengalaman KT bekerja dengan tim AWS dan menggunakan SageMaker untuk mengembangkan model mereka.

Sebagai bukti konsep, kami ingin mempercepat pekerjaan pelatihan dengan menggunakan perpustakaan DDP SageMaker, yang dioptimalkan untuk infrastruktur AWS selama pelatihan terdistribusi. Untuk mengubah dari PyTorch DDP ke SageMaker DDP, Anda hanya perlu mendeklarasikan torch_smddp paket dan ubah backend menjadi smddp, seperti yang ditunjukkan pada kode berikut:

Untuk mempelajari lebih lanjut tentang perpustakaan DDP SageMaker, lihat Perpustakaan Paralelisme Data SageMaker.

Menganalisis penyebab lambatnya kecepatan pelatihan dengan SageMaker Debugger dan Profiler

Langkah pertama dalam mengoptimalkan dan mempercepat beban kerja pelatihan melibatkan pemahaman dan diagnosis di mana kemacetan terjadi. Untuk tugas pelatihan KT, kami mengukur waktu pelatihan per iterasi pemuat data, penerusan maju, dan penerusan mundur:

| 1 kali iter – dataloader : 0.00053 detik, maju : 7.77474 detik, mundur: 1.58002 detik |

| 2 kali iter – dataloader : 0.00063 detik, maju : 0.67429 detik, mundur: 24.74539 detik |

| 3 kali iter – dataloader : 0.00061 detik, maju : 0.90976 detik, mundur: 8.31253 detik |

| 4 kali iter – dataloader : 0.00060 detik, maju : 0.60958 detik, mundur: 30.93830 detik |

| 5 kali iter – dataloader : 0.00080 detik, maju : 0.83237 detik, mundur: 8.41030 detik |

| 6 kali iter – dataloader : 0.00067 detik, maju : 0.75715 detik, mundur: 29.88415 detik |

Melihat waktu dalam keluaran standar untuk setiap iterasi, kami melihat bahwa waktu proses backward pass berfluktuasi secara signifikan dari iterasi ke iterasi. Variasi ini tidak biasa dan dapat mempengaruhi total waktu pelatihan. Untuk menemukan penyebab kecepatan pelatihan yang tidak konsisten ini, pertama-tama kami mencoba mengidentifikasi kemacetan sumber daya dengan memanfaatkan Monitor Sistem (SageMaker Debugger UI), yang memungkinkan Anda men-debug tugas pelatihan di Pelatihan SageMaker dan melihat status sumber daya seperti platform pelatihan terkelola. CPU, GPU, jaringan, dan I/O dalam beberapa detik tertentu.

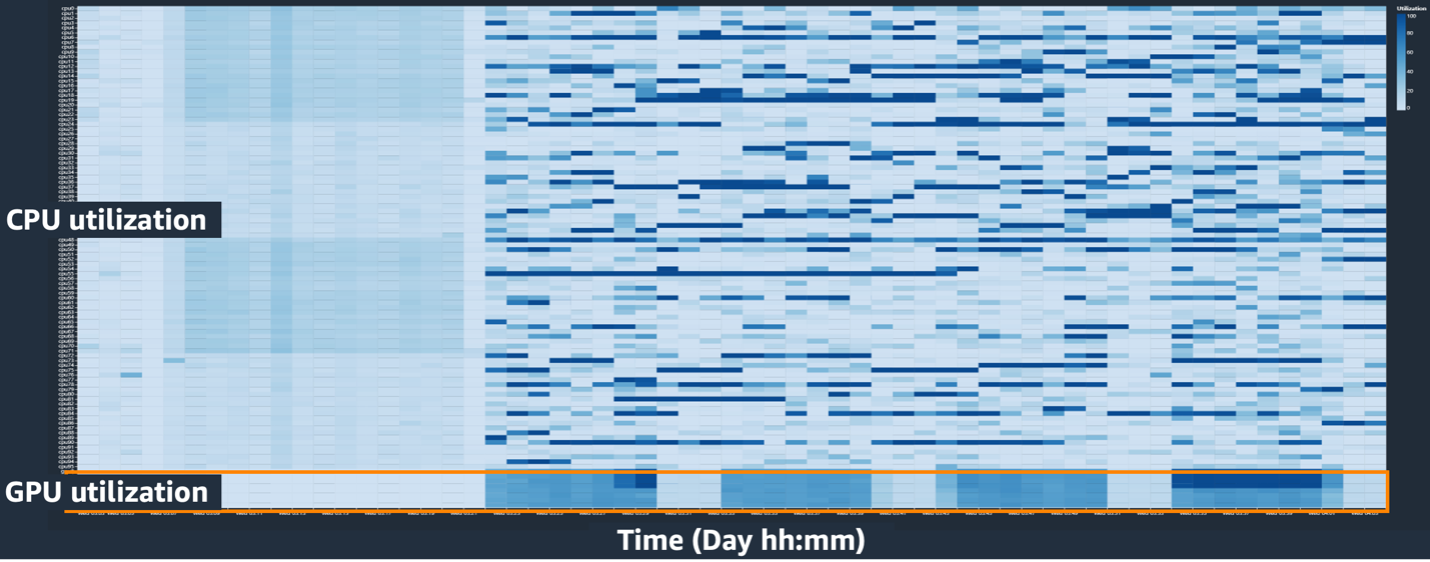

UI Debugger SageMaker menyediakan data terperinci dan penting yang dapat membantu mengidentifikasi dan mendiagnosis kemacetan dalam pekerjaan pelatihan. Secara khusus, diagram garis pemanfaatan CPU dan peta panas pemanfaatan CPU/GPU per tabel instans menarik perhatian kami.

Pada diagram garis pemanfaatan CPU, kami memperhatikan bahwa beberapa CPU digunakan 100%.

Dalam peta panas (di mana warna yang lebih gelap menunjukkan pemanfaatan yang lebih tinggi), kami mencatat bahwa beberapa inti CPU memiliki pemanfaatan yang tinggi selama pelatihan, sedangkan pemanfaatan GPU tidak selalu tinggi dari waktu ke waktu.

Dari sini, kami mulai curiga bahwa salah satu penyebab lambatnya kecepatan pelatihan adalah kemacetan CPU. Kami meninjau kode skrip pelatihan untuk melihat apakah ada yang menyebabkan kemacetan CPU. Bagian yang paling mencurigakan adalah nilainya yang besar num_workers di pemuat data, jadi kami mengubah nilai ini menjadi 0 atau 1 untuk mengurangi penggunaan CPU. Kami kemudian menjalankan pekerjaan pelatihan lagi dan memeriksa hasilnya.

Tangkapan layar berikut menunjukkan diagram garis pemanfaatan CPU, pemanfaatan GPU, dan peta panas setelah memitigasi kemacetan CPU.

Dengan hanya mengubah num_workers, kami melihat penurunan penggunaan CPU yang signifikan dan peningkatan penggunaan GPU secara keseluruhan. Ini adalah perubahan penting yang meningkatkan kecepatan latihan secara signifikan. Namun, kami ingin melihat di mana kami dapat mengoptimalkan penggunaan GPU. Untuk ini, kami menggunakan SageMaker Profiler.

SageMaker Profiler membantu mengidentifikasi petunjuk pengoptimalan dengan memberikan visibilitas ke dalam pemanfaatan berdasarkan operasi, termasuk melacak metrik pemanfaatan GPU dan CPU serta konsumsi kernel GPU/CPU dalam skrip pelatihan. Ini membantu pengguna memahami operasi mana yang menghabiskan sumber daya. Pertama, untuk menggunakan SageMaker Profiler, Anda perlu menambahkan ProfilerConfig ke fungsi yang memanggil tugas pelatihan menggunakan SageMaker SDK, seperti yang ditunjukkan dalam kode berikut:

Di SageMaker Python SDK, Anda memiliki fleksibilitas untuk menambahkan annotate berfungsi untuk SageMaker Profiler untuk memilih kode atau langkah-langkah dalam skrip pelatihan yang memerlukan pembuatan profil. Berikut ini adalah contoh kode yang harus Anda deklarasikan untuk SageMaker Profiler dalam skrip pelatihan:

Setelah menambahkan kode sebelumnya, jika Anda menjalankan tugas pelatihan menggunakan skrip pelatihan, Anda bisa mendapatkan informasi tentang operasi yang digunakan oleh kernel GPU (seperti yang ditunjukkan pada gambar berikut) setelah pelatihan berjalan selama jangka waktu tertentu. Dalam kasus skrip pelatihan KT, kami menjalankannya selama satu periode dan mendapatkan hasil sebagai berikut.

Ketika kami memeriksa lima waktu konsumsi operasi teratas kernel GPU di antara hasil SageMaker Profiler, kami menemukan bahwa untuk skrip pelatihan KT, waktu paling banyak dikonsumsi oleh operasi produk matriks, yang merupakan operasi perkalian matriks umum (GEMM). pada GPU. Dengan wawasan penting dari SageMaker Profiler ini, kami mulai menyelidiki cara untuk mempercepat operasi ini dan meningkatkan pemanfaatan GPU.

Mempercepat waktu pelatihan

Kami meninjau berbagai cara untuk mengurangi waktu komputasi perkalian matriks dan menerapkan dua fungsi PyTorch.

Status pengoptimal shard dengan ZeroRedundancyOptimizer

Jika Anda melihat Pengoptimal Nol Redundansi (ZeRO), teknik DeepSpeed/ZeRO memungkinkan pelatihan model besar secara efisien dengan kecepatan pelatihan yang lebih baik dengan menghilangkan redundansi dalam memori yang digunakan oleh model. ZeroRedundancyOptimizer di PyTorch menggunakan teknik sharding status pengoptimal untuk mengurangi penggunaan memori per proses dalam Distributed Data Parallel (DDP). DDP menggunakan gradien yang disinkronkan dalam backward pass sehingga semua replika pengoptimal melakukan iterasi pada parameter dan nilai gradien yang sama, namun alih-alih memiliki semua parameter model, setiap status pengoptimal dipertahankan dengan sharding hanya untuk proses DDP yang berbeda guna mengurangi penggunaan memori.

Untuk menggunakannya, Anda dapat membiarkan Pengoptimal yang ada tetap aktif optimizer_class dan nyatakan a ZeroRedundancyOptimizer dengan parameter model lainnya dan kecepatan pemelajaran sebagai parameter.

Presisi campuran otomatis

Presisi campuran otomatis (AMP) menggunakan tipe data torch.float32 untuk beberapa operasi dan obor.bfloat16 atau torch.float16 untuk yang lainnya, untuk kenyamanan komputasi yang cepat dan mengurangi penggunaan memori. Secara khusus, karena model pembelajaran mendalam biasanya lebih sensitif terhadap bit eksponen daripada bit pecahan dalam komputasinya, torch.bfloat16 setara dengan bit eksponen torch.float32, sehingga memungkinkan model tersebut belajar dengan cepat dengan kerugian minimal. torch.bfloat16 hanya berjalan pada instans dengan arsitektur NVIDIA A100 (Ampere) atau lebih tinggi, seperti ml.p4d.24xlarge, ml.p4de.24xlarge, dan ml.p5.48xlarge.

Untuk menerapkan AMP, Anda dapat mendeklarasikannya torch.cuda.amp.autocast dalam skrip pelatihan seperti yang ditunjukkan pada kode di atas dan deklarasikan dtype sebagai obor.bfloat16.

Hasil di SageMaker Profiler

Setelah menerapkan kedua fungsi tersebut ke skrip pelatihan dan menjalankan tugas pelatihan selama satu periode lagi, kami memeriksa lima waktu konsumsi operasi teratas untuk kernel GPU di SageMaker Profiler. Gambar berikut menunjukkan hasil kami.

Kita dapat melihat bahwa operasi GEMM, yang berada di urutan teratas sebelum menerapkan dua fungsi Torch, telah menghilang dari lima operasi teratas, digantikan oleh operasi ReduceScatter, yang biasanya terjadi dalam pelatihan terdistribusi.

Hasil kecepatan pelatihan model sulingan KT

Kami meningkatkan ukuran batch pelatihan sebesar 128 lebih besar untuk memperhitungkan penghematan memori dari penerapan dua fungsi Torch, sehingga menghasilkan ukuran batch akhir sebesar 1152, bukan 1024. Pelatihan model siswa akhir mampu menjalankan 210 epoch per 1 hari ; waktu pelatihan dan kecepatan antara lingkungan pelatihan internal KT dan SageMaker dirangkum dalam tabel berikut.

| Lingkungan Pelatihan | Pelatihan spesifikasi GPU. | Jumlah GPU | Waktu Pelatihan (jam) | Jaman | Jam per Zaman | Rasio reduksi |

| Lingkungan pelatihan internal KT | A100 (80GB) | 2 | 960 | 300 | 3.20 | 29 |

| Amazon SageMaker | A100 (40GB) | 32 | 24 | 210 | 0.11 | 1 |

Skalabilitas AWS memungkinkan kami menyelesaikan tugas pelatihan 29 kali lebih cepat dibandingkan sebelumnya menggunakan 32 GPU, bukan 2 GPU lokal. Hasilnya, penggunaan lebih banyak GPU di SageMaker akan mengurangi waktu pelatihan secara signifikan tanpa perbedaan dalam biaya pelatihan secara keseluruhan.

Kesimpulan

Park Sang-min (Ketua Tim Teknologi Pelayanan Vision AI) dari Lab AI2XL di Pusat Teknologi Konvergensi KT mengomentari kolaborasi dengan AWS untuk mengembangkan model AI Food Tag:

“Baru-baru ini, seiring dengan semakin banyaknya model berbasis transformator di bidang penglihatan, parameter model dan memori GPU yang dibutuhkan semakin meningkat. Kami menggunakan teknologi ringan untuk mengatasi masalah ini, dan dibutuhkan banyak waktu, sekitar satu bulan untuk mempelajarinya sekali. Melalui PoC dengan AWS ini, kami dapat mengidentifikasi kemacetan sumber daya dengan bantuan SageMaker Profiler dan Debugger, mengatasinya, lalu menggunakan pustaka paralelisme data SageMaker untuk menyelesaikan pelatihan dalam waktu sekitar satu hari dengan kode model yang dioptimalkan pada empat ml.p4d. 24x salinan besar.”

SageMaker membantu menghemat waktu berminggu-minggu tim Sang-min dalam pelatihan dan pengembangan model.

Berdasarkan kolaborasi model visi ini, AWS dan tim SageMaker akan terus berkolaborasi dengan KT dalam berbagai proyek penelitian AI/ML untuk meningkatkan pengembangan model dan produktivitas layanan melalui penerapan kemampuan SageMaker.

Untuk mempelajari lebih lanjut tentang fitur terkait di SageMaker, lihat yang berikut:

Tentang penulis

Youngjoon Choi, AI/ML Expert SA, memiliki pengalaman di bidang TI perusahaan di berbagai industri seperti manufaktur, teknologi tinggi, dan keuangan sebagai pengembang, arsitek, dan ilmuwan data. Dia melakukan penelitian tentang pembelajaran mesin dan pembelajaran mendalam, khususnya pada topik seperti pengoptimalan hyperparameter dan adaptasi domain, serta menyajikan algoritme dan makalah. Di AWS, ia berspesialisasi dalam AI/ML di seluruh industri, memberikan validasi teknis menggunakan layanan AWS untuk pelatihan terdistribusi/model skala besar dan membangun MLOps. Dia mengusulkan dan meninjau arsitektur, yang bertujuan untuk berkontribusi pada perluasan ekosistem AI/ML.

Youngjoon Choi, AI/ML Expert SA, memiliki pengalaman di bidang TI perusahaan di berbagai industri seperti manufaktur, teknologi tinggi, dan keuangan sebagai pengembang, arsitek, dan ilmuwan data. Dia melakukan penelitian tentang pembelajaran mesin dan pembelajaran mendalam, khususnya pada topik seperti pengoptimalan hyperparameter dan adaptasi domain, serta menyajikan algoritme dan makalah. Di AWS, ia berspesialisasi dalam AI/ML di seluruh industri, memberikan validasi teknis menggunakan layanan AWS untuk pelatihan terdistribusi/model skala besar dan membangun MLOps. Dia mengusulkan dan meninjau arsitektur, yang bertujuan untuk berkontribusi pada perluasan ekosistem AI/ML.

Jung Hoon Kim adalah akun SA AWS Korea. Berdasarkan pengalaman dalam desain arsitektur aplikasi, pengembangan, dan pemodelan sistem di berbagai industri seperti teknologi tinggi, manufaktur, keuangan, dan sektor publik, ia mengerjakan perjalanan AWS Cloud dan optimalisasi beban kerja di AWS untuk pelanggan perusahaan.

Jung Hoon Kim adalah akun SA AWS Korea. Berdasarkan pengalaman dalam desain arsitektur aplikasi, pengembangan, dan pemodelan sistem di berbagai industri seperti teknologi tinggi, manufaktur, keuangan, dan sektor publik, ia mengerjakan perjalanan AWS Cloud dan optimalisasi beban kerja di AWS untuk pelanggan perusahaan.

Batu Sakong adalah peneliti di KT R&D. Beliau telah melakukan penelitian dan pengembangan vision AI di berbagai bidang dan terutama melakukan atribut wajah (gender/kacamata, topi, dll)/teknologi pengenalan wajah yang berkaitan dengan wajah. Saat ini, dia sedang mengerjakan teknologi ringan untuk model vision.

Batu Sakong adalah peneliti di KT R&D. Beliau telah melakukan penelitian dan pengembangan vision AI di berbagai bidang dan terutama melakukan atribut wajah (gender/kacamata, topi, dll)/teknologi pengenalan wajah yang berkaitan dengan wajah. Saat ini, dia sedang mengerjakan teknologi ringan untuk model vision.

Manoj Ravi adalah Manajer Produk Senior untuk Amazon SageMaker. Dia bersemangat membangun produk AI generasi berikutnya dan mengerjakan perangkat lunak serta alat untuk membuat pembelajaran mesin skala besar lebih mudah bagi pelanggan. Beliau meraih gelar MBA dari Haas School of Business dan Magister Manajemen Sistem Informasi dari Carnegie Mellon University. Di waktu luangnya, Manoj senang bermain tenis dan menekuni fotografi lanskap.

Manoj Ravi adalah Manajer Produk Senior untuk Amazon SageMaker. Dia bersemangat membangun produk AI generasi berikutnya dan mengerjakan perangkat lunak serta alat untuk membuat pembelajaran mesin skala besar lebih mudah bagi pelanggan. Beliau meraih gelar MBA dari Haas School of Business dan Magister Manajemen Sistem Informasi dari Carnegie Mellon University. Di waktu luangnya, Manoj senang bermain tenis dan menekuni fotografi lanskap.

Robert Van Dusen adalah Manajer Produk Senior di Amazon SageMaker. Dia memimpin kerangka kerja, kompiler, dan teknik pengoptimalan untuk pelatihan pembelajaran mendalam.

Robert Van Dusen adalah Manajer Produk Senior di Amazon SageMaker. Dia memimpin kerangka kerja, kompiler, dan teknik pengoptimalan untuk pelatihan pembelajaran mendalam.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/kts-journey-to-reduce-training-time-for-a-vision-transformers-model-using-amazon-sagemaker/

- :memiliki

- :adalah

- :Di mana

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 15%

- 22

- 29

- 32

- 378

- 40

- 7

- 710

- 80

- a

- Sanggup

- Tentang Kami

- atas

- mempercepat

- mempercepat

- diterima

- mengakses

- Akun

- ketepatan

- di seluruh

- adaptasi

- menambahkan

- menambahkan

- Setelah

- lagi

- AI

- Layanan AI

- AI / ML

- Bertujuan

- algoritma

- Semua

- diizinkan

- Membiarkan

- memungkinkan

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- antara

- jumlah

- amp

- an

- menganalisa

- dan

- apa saja

- aplikasi

- terapan

- Mendaftar

- Menerapkan

- arsitektur

- ADALAH

- AS

- At

- atribut

- AWS

- Backend

- berdasarkan

- BE

- karena

- sebelum

- mulai

- makhluk

- Lebih baik

- antara

- kedua

- kemacetan

- Bangunan

- built-in

- beban

- bisnis

- tapi

- by

- menghitung

- bernama

- CAN

- Bisa Dapatkan

- kemampuan

- Carnegie Mellon

- kasus

- tertangkap

- Menyebabkan

- penyebab

- menyebabkan

- pusat

- perubahan

- berubah

- mengubah

- Grafik

- memeriksa

- diperiksa

- awan

- kode

- Berkolaborasi

- kolaborasi

- berkomentar

- Komunikasi

- kesesuaian

- lengkap

- komputasi

- perhitungan

- komputer

- Visi Komputer

- komputasi

- konsep

- dilakukan

- konfigurasi

- secara konsisten

- dikonsumsi

- memakan

- konsumsi

- Konten

- terus

- menyumbang

- kenyamanan

- Konvergensi

- Biaya

- bisa

- menutupi

- Sekarang

- pelanggan

- gelap

- data

- ilmuwan data

- hari

- Hari

- DDP

- mengurangi

- mendalam

- belajar mendalam

- mendefinisikan

- penyebaran

- menggambarkan

- Mendesain

- terperinci

- mengembangkan

- dikembangkan

- Pengembang

- Pengembangan

- Diabetes

- mendiagnosis

- perbedaan

- berbeda

- penyakit

- didistribusikan

- komputasi terdistribusi

- pelatihan terdistribusi

- do

- Buruh pelabuhan

- domain

- selama

- setiap

- mudah

- ekosistem

- efisien

- menghilangkan

- diaktifkan

- memungkinkan

- Insinyur

- Enterprise

- Lingkungan Hidup

- masa

- zaman

- Setara

- penting

- dll

- Bahkan

- contoh

- ada

- perluasan

- mahal

- pengalaman

- berpengalaman

- Pengalaman

- ahli

- mata

- Menghadapi

- wajah

- FAST

- lebih cepat

- Fitur

- beberapa

- sedikit

- bidang

- Fields

- Angka

- terakhir

- keuangan

- Menemukan

- Pertama

- lima

- keluwesan

- berfluktuasi

- berikut

- makanan

- makanan

- Untuk

- Depan

- ditemukan

- empat

- pecahan

- kerangka

- dari

- fungsi

- fungsi

- Umum

- menghasilkan

- mendapatkan

- mendapat

- GPU

- GPU

- gradien

- memiliki

- Memiliki

- memiliki

- he

- membantu

- membantu

- membantu

- di sini

- hi-tech

- High

- lebih tinggi

- -nya

- memegang

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTML

- HTTPS

- Optimalisasi Hyperparameter

- mengidentifikasi

- mengenali

- mengidentifikasi

- if

- gambar

- gambar

- Dampak

- mengimpor

- penting

- memperbaiki

- ditingkatkan

- in

- Termasuk

- Meningkatkan

- Pada meningkat

- meningkatkan

- menunjukkan

- industri

- informasi

- Sistem Informasi

- Infrastruktur

- mulanya

- wawasan

- contoh

- sebagai gantinya

- intern

- Internet

- ke

- menyelidiki

- memanggil

- isu

- IT

- perulangan

- Pekerjaan

- Jobs

- perjalanan

- pengetahuan

- Korea

- laboratorium

- Label

- pemandangan

- besar

- besar-besaran

- terbesar

- pemimpin

- Memimpin

- BELAJAR

- pengetahuan

- Meninggalkan

- kurang

- perpustakaan

- Perpustakaan

- ringan

- 'like'

- baris

- linux

- Daftar

- pemuat

- melihat

- lepas

- Lot

- mesin

- Mesin belajar

- terutama

- mempertahankan

- membuat

- mengelola

- berhasil

- pengelolaan

- Solusi Manajemen

- manajer

- pelaksana

- pabrik

- peta

- Matriks

- Mellon

- Memori

- Metrik

- minimal

- meringankan

- campur aduk

- ML

- MLOps

- mobil

- model

- pemodelan

- model

- Memantau

- Bulan

- lebih

- paling

- perlu

- Perlu

- kebutuhan

- jaringan

- tidak

- terkenal

- jumlah

- gizi

- Nvidia

- of

- menawarkan

- on

- sekali

- ONE

- hanya

- operasi

- Operasi

- optimasi

- Optimize

- dioptimalkan

- mengoptimalkan

- or

- Lainnya

- kami

- di luar

- keluaran

- output

- lebih

- secara keseluruhan

- paket

- paket

- dokumen

- pola pikir

- Paralel

- parameter

- bagian

- tertentu

- bermitra

- lulus

- bergairah

- pasien

- untuk

- periode

- fotografi

- Foto

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- bermain

- PoC

- Pos

- Ketelitian

- sebelumnya

- Masalah

- proses

- proses

- Produk

- manajer produk

- Produksi

- produktifitas

- Produk

- profil

- proyek

- memprojeksikan

- bukti

- bukti konsep

- mengusulkan

- penyedia

- menyediakan

- menyediakan

- publik

- Ular sanca

- pytorch

- segera

- R & D

- jarak

- peringkat

- Penilaian

- alasan

- pengakuan

- menurunkan

- mengurangi

- mengurangi

- lihat

- terkait

- sisa

- diganti

- wajib

- Persyaratan

- penelitian

- penelitian dan pengembangan

- peneliti

- menyelesaikan

- sumber

- Sumber

- ISTIRAHAT

- mengakibatkan

- dihasilkan

- Hasil

- review jurnal

- Review

- Run

- berjalan

- berjalan

- SA

- pembuat bijak

- sama

- Save

- Tabungan

- melihat

- Skalabilitas

- Skala

- Sekolah

- ilmuwan

- ilmuwan

- screenshot

- naskah

- script

- SDK

- SEC

- detik

- Bagian

- sektor

- melihat

- senior

- peka

- layanan

- Layanan

- porsi

- set

- sharding

- harus

- Menunjukkan

- ditunjukkan

- Pertunjukkan

- penting

- signifikan

- menyederhanakan

- hanya

- tunggal

- Ukuran

- lambat

- lebih kecil

- So

- Perangkat lunak

- larutan

- MEMECAHKAN

- beberapa

- Selatan

- Korea Selatan

- spesialisasi

- Secara khusus

- kecepatan

- menghabiskan

- standar

- Negara

- Negara

- Status

- Langkah

- Tangga

- Masih

- mahasiswa

- sukses

- berhasil

- seperti itu

- rangkaian

- mencurigakan

- sistem

- sistem

- tabel

- MENANDAI

- Dibutuhkan

- target

- tim

- tim

- Teknis

- teknik

- teknik

- Teknologi

- telekomunikasi

- uji

- dari

- bahwa

- Grafik

- Matrix

- mereka

- Mereka

- kemudian

- Sana.

- Ini

- ini

- meskipun?

- Melalui

- di seluruh

- waktu

- kali

- untuk

- bersama

- mengambil

- alat

- puncak

- Topik

- obor

- Total

- Pelacakan

- Pelatihan VE

- terlatih

- Pelatihan

- transformer

- mencoba

- benar

- dua

- mengetik

- khas

- ui

- memahami

- pemahaman

- universitas

- us

- penggunaan

- menggunakan

- bekas

- Pengguna

- kegunaan

- menggunakan

- Memanfaatkan

- pengesahan

- nilai

- Nilai - Nilai

- berbagai

- View

- jarak penglihatan

- penglihatan

- ingin

- ingin

- adalah

- cara

- we

- jaringan

- layanan web

- minggu

- adalah

- sedangkan

- yang

- SIAPA

- lebar

- Rentang luas

- Wikipedia

- akan

- dengan

- dalam

- tanpa

- kerja

- bekerja

- bengkel

- akan

- Kamu

- Anda

- zephyrnet.dll

- nol