Memilih objek terpisah dalam pemandangan visual tampaknya intuitif bagi kami, tetapi mesin kesulitan melakukan tugas ini. Sekarang model AI baru dari Meta telah mengembangkan gagasan luas tentang apa itu objek, memungkinkannya untuk memisahkan objek meskipun objek tersebut belum pernah dilihat sebelumnya.

Ini mungkin tampak seperti tugas visi komputer yang cukup membosankan, tetapi mampu mengurai gambar dan mengetahui di mana satu objek berakhir dan objek lainnya dimulai adalah keterampilan yang cukup mendasar, tanpanya sejumlah tugas yang lebih rumit tidak akan dapat diselesaikan.

“Segmentasi objek” bukanlah hal baru; Peneliti AI telah mengerjakannya selama bertahun-tahun. Namun biasanya, membangun model ini merupakan proses yang memakan waktu yang membutuhkan banyak anotasi gambar manusia dan sumber daya komputasi yang besar. Dan biasanya model yang dihasilkan sangat terspesialisasi untuk kasus penggunaan tertentu.

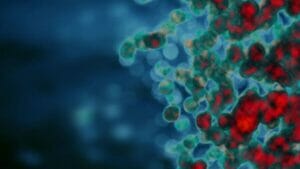

Namun sekarang, para peneliti di Meta telah meluncurkan Segment Anything Model (SAM), yang mampu memotong objek apa pun dalam pemandangan apa pun, terlepas dari apakah objek tersebut pernah dilihat sebelumnya. Model ini juga dapat melakukan ini sebagai respons terhadap berbagai petunjuk yang berbeda, mulai dari deskripsi teks hingga klik mouse atau bahkan data pelacakan mata.

“SAM telah mempelajari pengertian umum tentang objek apa, dan itu dapat menghasilkan topeng untuk objek apa pun dalam gambar atau video apa pun,” tulis para peneliti dalam sebuah blog pos. “Kami yakin kemungkinannya luas, dan kami senang dengan banyaknya kasus penggunaan potensial yang bahkan belum pernah kami bayangkan.”

Kunci pengembangan model ini adalah kumpulan data baru yang sangat besar dari 1.1 miliar masker segmentasi, yang mengacu pada wilayah gambar yang telah diisolasi dan dianotasi untuk menunjukkan bahwa mereka berisi objek tertentu. Itu dibuat melalui kombinasi anotasi gambar manusia secara manual dan proses otomatis, dan sejauh ini merupakan koleksi terbesar dari jenis ini yang dikumpulkan hingga saat ini.

Dengan melatih kumpulan data yang begitu besar, para peneliti Meta mengatakan telah mengembangkan konsep umum tentang apa itu objek, yang memungkinkannya untuk mengelompokkan hal-hal yang bahkan belum pernah dilihatnya sebelumnya. Kemampuan untuk menggeneralisasi ini membuat para peneliti menjuluki SAM sebagai "model dasar", a istilah kontroversial digunakan untuk menggambarkan model pra-terlatih besar lainnya seperti GPT OpenAI seri, yang kemampuannya dianggap sangat umum sehingga dapat digunakan sebagai dasar untuk sejumlah aplikasi.

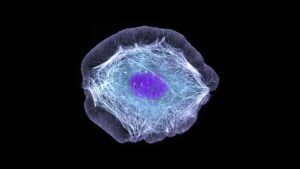

Segmentasi gambar jelas merupakan unsur utama dalam berbagai tugas visi komputer. Jika Anda tidak dapat memisahkan komponen yang berbeda dari sebuah adegan, sulit untuk melakukan sesuatu yang lebih rumit dengannya. Di blog mereka, para peneliti mengatakan itu bisa terbukti sangat berharga dalam pengeditan video dan gambar, atau membantu analisis citra ilmiah.

Mungkin lebih relevan untuk ambisi metaverse perusahaan, mereka memberikan demo tentang bagaimana itu dapat digunakan bersama dengan headset realitas virtual untuk memilih objek tertentu berdasarkan pandangan pengguna. Mereka juga mengatakan itu berpotensi dipasangkan dengan model bahasa besar untuk membuat sistem multi-modal yang mampu memahami konten visual dan tekstual dari halaman web.

Kemampuan untuk menangani berbagai petunjuk membuat sistem sangat fleksibel. Di sebuah halaman web mendemonstrasikan model baru, perusahaan menunjukkan bahwa setelah menganalisis gambar, dapat diminta untuk memisahkan objek tertentu hanya dengan mengkliknya dengan kursor mouse, mengetikkan apa yang ingin Anda segmentasikan, atau hanya memecah seluruh gambar menjadi objek terpisah.

Dan yang paling penting, perusahaan adalah sumber terbuka baik model maupun kumpulan data untuk tujuan penelitian sehingga orang lain dapat mengembangkan pekerjaan mereka. Ini adalah pendekatan yang sama yang diambil perusahaan dengan model bahasa besar LLaMA-nya, yang membuatnya berkembang pesat bocor online dan memacu a gelombang percobaan oleh penghobi dan peretas.

Apakah hal yang sama akan terjadi dengan SAM masih harus dilihat, tetapi bagaimanapun itu adalah hadiah bagi komunitas riset AI yang dapat mempercepat kemajuan dalam sejumlah masalah visi komputer yang penting.

Gambar Kredit: Meta AI

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://singularityhub.com/2023/04/10/metas-new-ai-can-identify-and-remove-objects-in-images/

- :adalah

- $NAIK

- 1

- a

- kemampuan

- Sanggup

- mempercepat

- Setelah

- AI

- ai penelitian

- Membiarkan

- memungkinkan

- ambisi

- analisis

- menganalisis

- dan

- Lain

- aplikasi

- pendekatan

- ADALAH

- AS

- dirakit

- At

- Otomatis

- berdasarkan

- BE

- sebelum

- makhluk

- Percaya

- Milyar

- Blog

- Melanggar

- luas

- membangun

- Bangunan

- by

- CAN

- kemampuan

- kasus

- koleksi

- kombinasi

- masyarakat

- perusahaan

- Perusahaan

- rumit

- komponen

- komputer

- Visi Komputer

- komputasi

- konsep

- besar

- mengandung

- Konten

- bisa

- membuat

- dibuat

- kredit

- Memotong

- data

- Tanggal

- transaksi

- pastinya

- menggambarkan

- deskripsi

- dikembangkan

- Pengembangan

- berbeda

- antara

- berakhir

- Seluruh

- Bahkan

- gembira

- hampir

- fleksibel

- Untuk

- Foundations

- dari

- mendasar

- Umum

- menghasilkan

- hadiah

- hacker

- terjadi

- Sulit

- Memiliki

- Headset

- membantu

- sangat

- tuan rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTTPS

- manusia

- ide

- gambar

- gambar

- penting

- in

- intuitif

- tak ternilai

- terpencil

- IT

- NYA

- kunci

- bahasa

- besar

- terbesar

- belajar

- Dipimpin

- 'like'

- Llama

- Mesin

- MEMBUAT

- panduan

- banyak

- masker

- besar-besaran

- meta

- Metaverse

- mungkin

- model

- model

- lebih

- paling

- New

- Gagasan

- obyek

- objek

- of

- on

- ONE

- Lainnya

- Lainnya

- halaman

- dipasangkan

- tertentu

- khususnya

- memilih

- plato

- Kecerdasan Data Plato

- Data Plato

- kemungkinan

- potensi

- berpotensi

- cukup

- masalah

- proses

- proses

- Kemajuan

- Rasakan itu

- memberikan

- tujuan

- jarak

- cepat

- Kenyataan

- mengacu

- Bagaimanapun juga

- daerah

- sisa

- penelitian

- peneliti

- Sumber

- tanggapan

- dihasilkan

- Universitas

- sama

- adegan

- ilmiah

- tampaknya

- ruas

- segmentasi

- terpisah

- Seri

- Pertunjukkan

- hanya

- ketrampilan

- So

- khusus

- tertentu

- Perjuangan

- seperti itu

- sistem

- tugas

- tugas

- bahwa

- Grafik

- mereka

- Mereka

- Ini

- hal

- Melalui

- membuang-buang waktu

- untuk

- Pelatihan

- khas

- memahami

- meluncurkan

- us

- menggunakan

- variasi

- Video

- maya

- virtual reality

- penglihatan

- Cara..

- jaringan

- Apa

- apakah

- yang

- lebar

- Rentang luas

- akan

- dengan

- tanpa

- Kerja

- bekerja

- bekerja

- akan

- tahun

- Kamu

- zephyrnet.dll