Para peneliti telah menemukan lebih dari 100 model pembelajaran mesin berbahaya (ML) pada platform Hugging Face AI yang memungkinkan penyerang menyuntikkan kode berbahaya ke mesin pengguna.

Meskipun Hugging Face menerapkan langkah-langkah keamanan, temuan ini menyoroti meningkatnya risiko “mempersenjatai” model yang tersedia untuk umum karena dapat menciptakan pintu belakang bagi penyerang.

Temuan JFrog Security Research merupakan bagian dari studi yang sedang berlangsung untuk menganalisis bagaimana peretas dapat menggunakan ML untuk menyerang pengguna.

Konten berbahaya

Menurut sebuah artikel oleh computing, para peneliti mengembangkan sistem pemindaian canggih untuk mengamati model yang dihosting di platform Hugging Face AI, seperti PyTorch dan Tensorflow Keras.

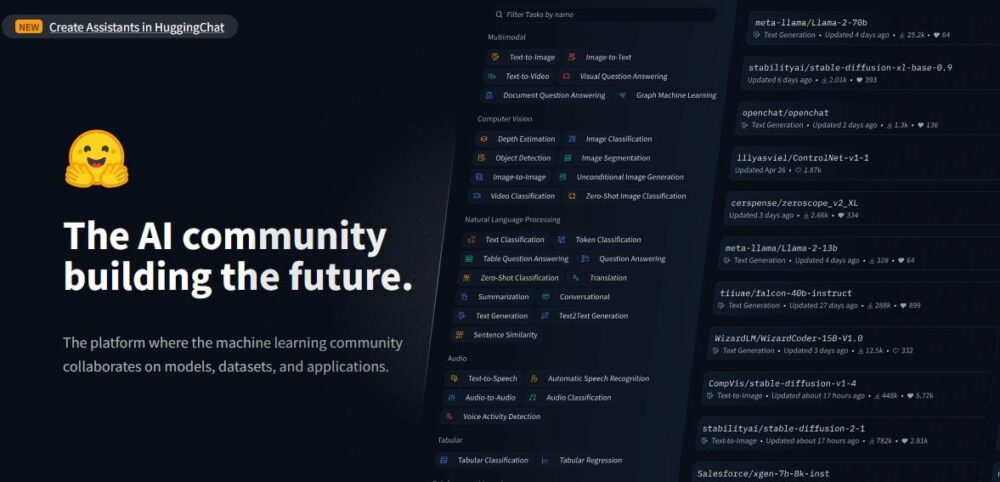

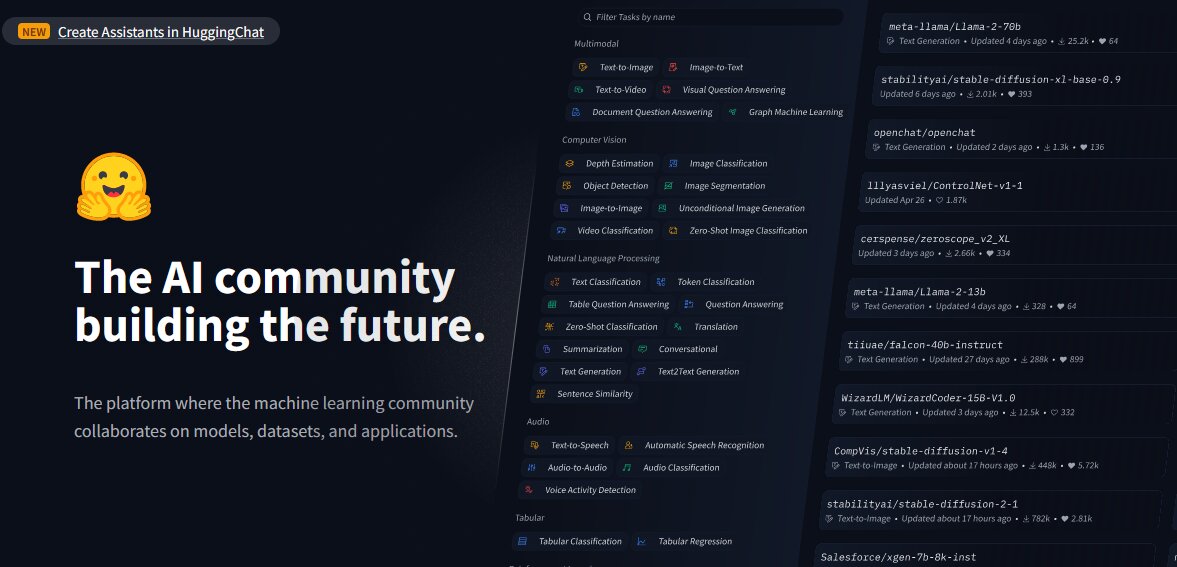

Hugging Face adalah platform yang dikembangkan untuk berbagi model, kumpulan data, dan aplikasi AI. Setelah menganalisis model tersebut, para peneliti menemukan muatan berbahaya “dalam model yang tampaknya tidak berbahaya.”

Ini terlepas dari kenyataan bahwa Hugging Face melakukan langkah-langkah keamanan seperti malware dan pemindaian acar. Namun, platform tidak membatasi pengunduhan model yang berpotensi membahayakan dan juga memungkinkan tersedia untuk umum Model AI untuk disalahgunakan dan dijadikan senjata oleh pengguna.

Saat memeriksa platform dan model yang ada, peneliti keamanan JFrog menemukan sekitar 100 model AI dengan fungsi berbahaya, menurut mereka. melaporkan.

Beberapa dari model ini, menurut laporan tersebut, mampu mengeksekusi kode pada mesin pengguna, “sehingga menciptakan pintu belakang yang terus-menerus bagi penyerang.”

Para peneliti juga mengindikasikan bahwa temuan tersebut tidak termasuk hasil positif palsu. Ini, kata mereka, adalah representasi akurat dari prevalensi model jahat di platform.

Baca juga: Apple Mengalihkan Tim Mobil ke Perlambatan Pasar AI Pasca-EV

Contohnya

Menurut laporan JFrog, salah satu kasus yang “mengkhawatirkan” melibatkan a PyTorch model. Model tersebut dilaporkan diunggah oleh pengguna yang diidentifikasi sebagai “baller423”, yang kemudian dihapus dari platform Hugging Face.

Saat meneliti lebih lanjut model tersebut, para peneliti menyadari bahwa model tersebut berisi muatan berbahaya, yang memungkinkannya membuat shell terbalik pada host tertentu (210.117.212.93).

Peneliti keamanan senior JFrog David Cohen berkata: “(Ini) lebih mengganggu dan berpotensi berbahaya, karena membuat koneksi langsung ke server eksternal, yang menunjukkan potensi ancaman keamanan, bukan sekadar menunjukkan kerentanan,” tulisnya.

Hal ini memanfaatkan “metode '_reduce_' modul acar Python untuk mengeksekusi kode arbitrer saat memuat file model, yang secara efektif melewati metode deteksi konvensional.”

Para peneliti juga menyadari bahwa muatan yang sama menciptakan koneksi ke alamat IP yang berbeda, “menunjukkan bahwa operator mungkin adalah peneliti, bukan peretas jahat.”

Panggilan bangun

Tim JFrog mencatat bahwa temuan ini merupakan peringatan bagi Hugging Face, yang menunjukkan bahwa platformnya rentan terhadap manipulasi dan potensi ancaman.

“Insiden ini menjadi pengingat yang menyedihkan akan ancaman yang sedang dihadapi oleh repositori Hugging Face dan repositori populer lainnya seperti Kaggle, yang berpotensi membahayakan privasi dan keamanan organisasi yang menggunakan sumber daya ini, selain menimbulkan tantangan bagi para insinyur AI/ML,” ungkapnya. para peneliti.

Ini datang sebagai ancaman keamanan siber di seluruh dunia jumlahnya meningkat, didorong oleh proliferasi alat-alat AI, dan pihak-pihak jahat menyalahgunakannya untuk tujuan jahat. Peretas juga menggunakan AI untuk melancarkan serangan phishing dan mengelabui orang.

Namun, tim JFrog menemukan penemuan lain.

Taman bermain bagi para peneliti

Para peneliti juga mencatat hal itu Wajah Memeluk telah berkembang menjadi arena bermain bagi para peneliti “yang ingin memerangi ancaman yang muncul, seperti yang ditunjukkan oleh beragam taktik untuk mengabaikan langkah-langkah keamanannya.”

Misalnya, payload yang diunggah oleh “baller423” memulai koneksi shell terbalik ke rentang alamat IP milik Kreonet (Jaringan Terbuka Lingkungan Penelitian Korea).

Menurut Membaca Gelap, Kreonet adalah jaringan berkecepatan tinggi di Korea Selatan yang mendukung kegiatan penelitian dan pendidikan tingkat lanjut; “Oleh karena itu, ada kemungkinan bahwa peneliti atau praktisi AI berada di belakang model ini.”

“Kita dapat melihat bahwa sebagian besar muatan 'berbahaya' sebenarnya merupakan upaya para peneliti dan/atau bug bounty untuk mendapatkan eksekusi kode untuk tujuan yang tampaknya sah,” kata Cohen.

Terlepas dari tujuan yang sah, tim JFrog memperingatkan bahwa strategi yang digunakan oleh para peneliti dengan jelas menunjukkan bahwa platform seperti Hugging Face terbuka terhadap serangan rantai pasokan. Menurut tim, hal ini dapat disesuaikan untuk fokus pada demografi tertentu, seperti insinyur AI atau ML.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://metanews.com/over-100-malicious-code-execution-models-on-hugging-face-backdoors-users-devices/

- :memiliki

- :adalah

- :bukan

- 100

- 210

- 212

- 7

- 9

- a

- Tentang Kami

- Menurut

- tepat

- kegiatan

- aktor

- sebenarnya

- tambahan

- alamat

- alamat

- memajukan

- maju

- AI

- Model AI

- Platform AI

- AI / ML

- juga

- an

- menganalisa

- menganalisis

- dan

- aplikasi

- sewenang-wenang

- ADALAH

- susunan

- artikel

- AS

- menyerang

- Serangan

- Mencoba

- tersedia

- pintu belakang

- Buruk

- BE

- menjadi

- di belakang

- milik

- karunia

- Bug

- hadiah bug

- by

- memotong

- panggilan

- CAN

- mampu

- mobil

- kasus

- tantangan

- Jelas

- CO

- kode

- cohen

- memerangi

- datang

- kompromi

- komputasi

- koneksi

- Koneksi

- berisi

- konvensional

- bisa

- membuat

- membuat

- disesuaikan

- kumpulan data

- David

- Demografi

- mendemonstrasikan

- menunjukkan

- Meskipun

- Deteksi

- dikembangkan

- berbeda

- langsung

- ditemukan

- beberapa

- tidak

- Download

- edukasi

- efektif

- muncul

- dipekerjakan

- aktif

- memungkinkan

- memungkinkan

- Insinyur

- Lingkungan Hidup

- menetapkan

- menetapkan

- berkembang

- Memeriksa

- menjalankan

- mengeksekusi

- eksekusi

- ada

- luar

- Menghadapi

- menghadapi

- fakta

- palsu

- File

- Temuan

- Fokus

- Untuk

- bentuk

- dari

- didorong

- fungsi

- lebih lanjut

- mendapatkan

- Pertumbuhan

- hacker

- berbahaya

- Memiliki

- he

- High

- Menyoroti

- tuan rumah

- host

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTTPS

- diidentifikasi

- mengimplementasikan

- in

- Meningkatkan

- menunjukkan

- menunjukkan

- Menunjukkan

- dimulai

- menyuntikkan

- contoh

- niat

- ke

- mengganggu

- melibatkan

- IP

- Alamat IP

- Alamat IP

- IT

- NYA

- jpg

- keras

- Korea

- pengetahuan

- sah

- memanfaatkan

- 'like'

- pemuatan

- mesin

- Mesin belajar

- Mesin

- terbuat

- jahat

- malware

- manipulasi

- Pasar

- max-width

- Mungkin..

- ukuran

- mer

- metode

- metode

- ML

- model

- model

- lebih

- paling

- jaringan

- terutama

- terkenal

- of

- on

- ONE

- terus-menerus

- ke

- Buka

- jaringan terbuka

- operator

- or

- organisasi

- Lainnya

- di luar

- lebih

- bagian

- Konsultan Ahli

- Phishing

- serangan phishing

- Platform

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- tempat bermain

- Populer

- mungkin

- potensi

- berpotensi

- kelaziman

- pribadi

- Keamanan dan Privasi

- di depan umum

- tujuan

- pytorch

- jarak

- agak

- Baca

- diakui

- melaporkan

- kabarnya

- perwakilan

- penelitian

- peneliti

- peneliti

- Sumber

- membatasi

- membalikkan

- Risiko

- Tersebut

- sama

- pemindaian

- keamanan

- Pengamanan

- melihat

- tampaknya

- senior

- melayani

- Server

- berbagi

- Kulit

- menunjukkan

- Selatan

- Korea Selatan

- tertentu

- ditentukan

- strategi

- Belajar

- Kemudian

- seperti itu

- pendukung

- sistem

- taktik

- tim

- tensorflow

- dari

- bahwa

- Grafik

- mereka

- Mereka

- Ini

- mereka

- ancaman

- ancaman

- untuk

- alat

- trik

- upload

- atas

- menggunakan

- Pengguna

- Pengguna

- menggunakan

- Memanfaatkan

- kerentanan

- memperingatkan

- adalah

- yang

- ingin

- dengan

- dunia

- menulis

- zephyrnet.dll