Pengantar

Dalam pembelajaran mesin, trade-off bias-varians adalah konsep fundamental yang memengaruhi kinerja model prediktif apa pun. Ini mengacu pada keseimbangan halus antara kesalahan bias dan kesalahan varians suatu model, karena tidak mungkin untuk meminimalkan keduanya secara bersamaan. Mencapai keseimbangan yang tepat sangat penting untuk mencapai performa model yang optimal.

Dalam artikel singkat ini, kami akan mendefinisikan bias dan varians, menjelaskan pengaruhnya terhadap model pembelajaran mesin, dan memberikan beberapa saran praktis tentang cara menghadapinya dalam praktik.

Memahami Bias dan Varians

Sebelum menyelami hubungan antara bias dan varians, mari kita tentukan apa yang diwakili istilah-istilah ini dalam pembelajaran mesin.

Kesalahan bias mengacu pada perbedaan antara prediksi model dan nilai yang benar yang coba diprediksi (kebenaran dasar). Dengan kata lain, bias adalah kesalahan yang dilakukan model karena asumsi yang salah tentang distribusi data yang mendasarinya. Model bias tinggi seringkali terlalu sederhana, gagal menangkap kompleksitas data, yang menyebabkan underfitting.

Kesalahan varians, di sisi lain, mengacu pada kepekaan model terhadap fluktuasi kecil dalam data pelatihan. Model varians tinggi terlalu kompleks dan cenderung menyesuaikan kebisingan dalam data, daripada pola yang mendasarinya, yang menyebabkan overfitting. Ini menghasilkan kinerja yang buruk pada data baru yang tidak terlihat.

Bias yang tinggi dapat menyebabkan underfitting, di mana model terlalu sederhana untuk menangkap kompleksitas data. Itu membuat asumsi yang kuat tentang data dan gagal menangkap hubungan sebenarnya antara variabel input dan output. Di sisi lain, varians yang tinggi dapat menyebabkan overfitting, di mana modelnya terlalu rumit dan mempelajari noise dalam data daripada hubungan mendasar antara variabel input dan output. Dengan demikian, model overfitting cenderung menyesuaikan data pelatihan terlalu dekat dan tidak akan menggeneralisasi data baru dengan baik, sedangkan model underfitting bahkan tidak dapat menyesuaikan data pelatihan secara akurat.

Seperti disebutkan sebelumnya, bias dan varians saling terkait, dan model yang baik menyeimbangkan antara kesalahan bias dan kesalahan varians. Pertukaran bias-varians adalah proses menemukan keseimbangan optimal antara dua sumber kesalahan ini. Model dengan bias rendah dan varians rendah kemungkinan besar akan bekerja dengan baik pada pelatihan dan data baru, meminimalkan kesalahan total.

Trade-Off Bias-Varians

Mencapai keseimbangan antara kompleksitas model dan kemampuannya untuk menggeneralisasi data yang tidak diketahui adalah inti dari pertukaran bias-varians. Secara umum, model yang lebih kompleks akan memiliki bias yang lebih rendah tetapi varian yang lebih tinggi, sedangkan model yang lebih sederhana akan memiliki bias yang lebih tinggi tetapi varian yang lebih rendah.

Karena tidak mungkin meminimalkan bias dan varians secara bersamaan, menemukan keseimbangan optimal di antara keduanya sangat penting dalam membangun model pembelajaran mesin yang kuat. Misalnya, saat kami meningkatkan kompleksitas model, kami juga meningkatkan variansnya. Hal ini karena model yang lebih kompleks lebih cocok dengan noise dalam data pelatihan, yang akan menyebabkan overfitting.

Di sisi lain, jika kita membuat model terlalu sederhana, kita akan meningkatkan bias. Ini karena model yang lebih sederhana tidak akan mampu menangkap hubungan yang mendasari data, yang akan menyebabkan underfitting.

Tujuannya adalah untuk melatih model yang cukup kompleks untuk menangkap hubungan yang mendasarinya dalam data pelatihan, namun tidak terlalu rumit sehingga cocok dengan noise di data pelatihan.

Bias-Variance Trade-Off dalam Praktek

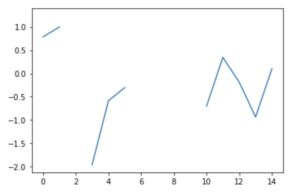

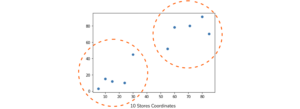

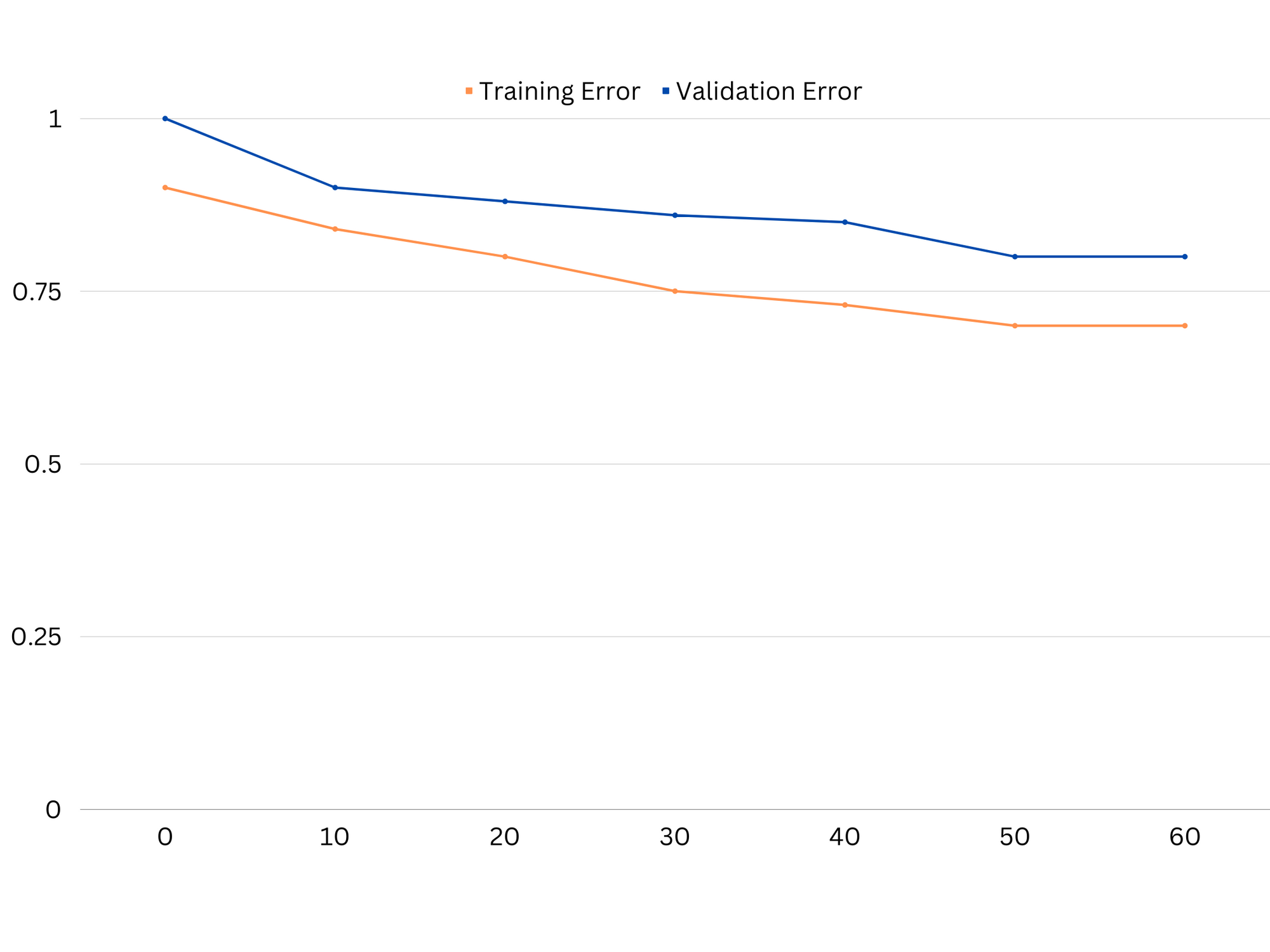

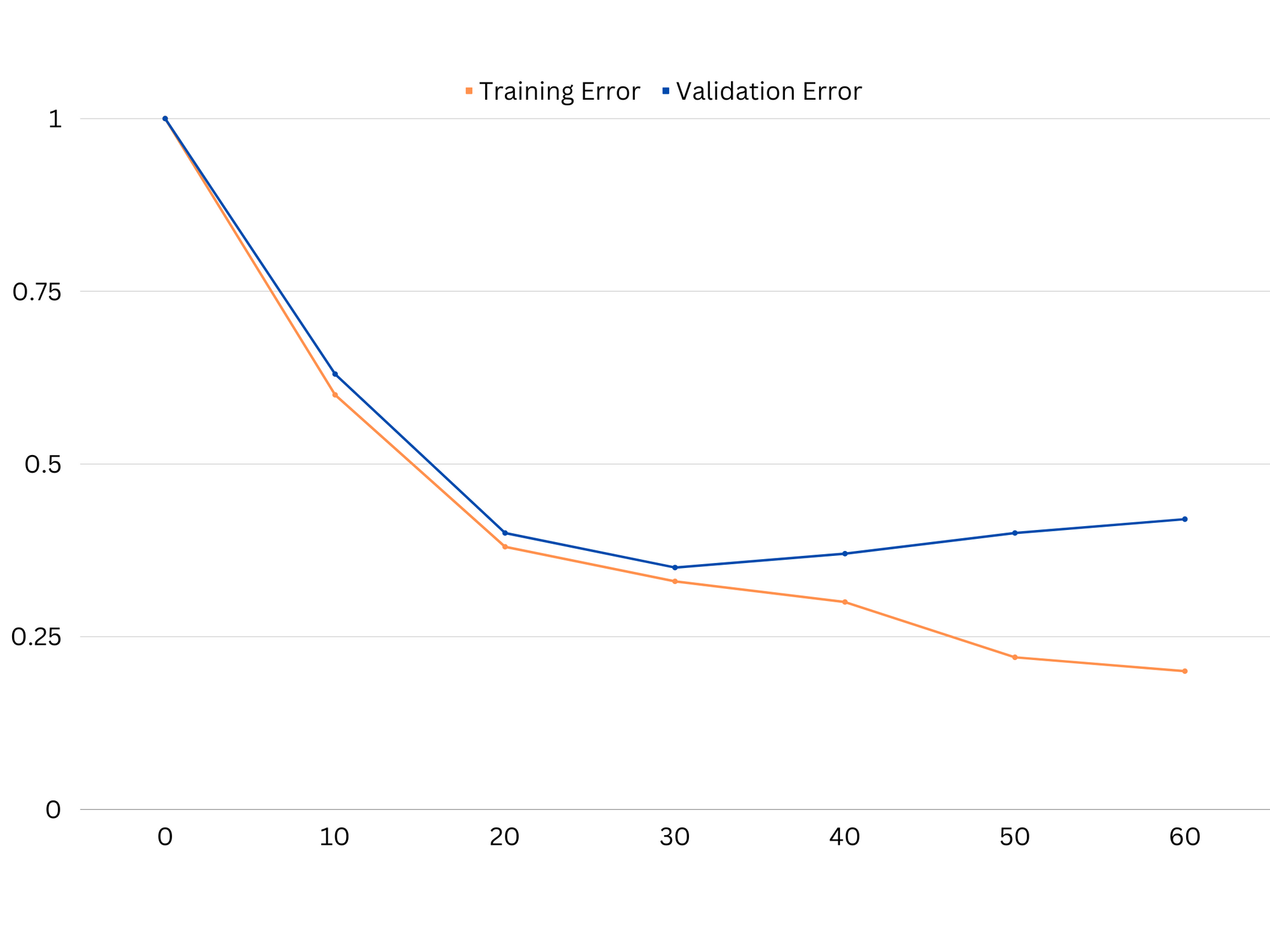

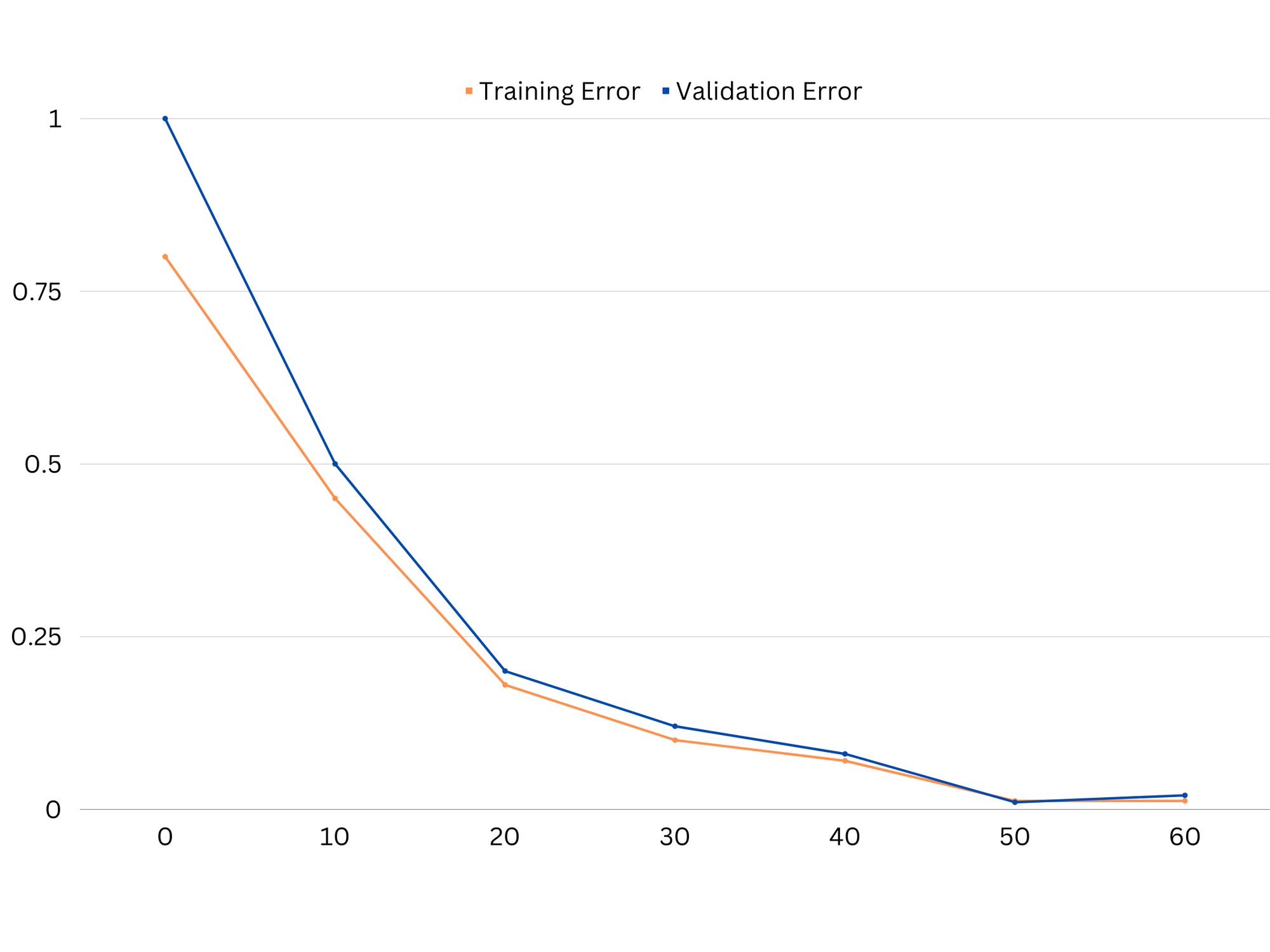

Untuk mendiagnosis kinerja model, kami biasanya menghitung dan membandingkan kesalahan pelatihan dan validasi. Alat yang berguna untuk memvisualisasikan ini adalah plot kurva pembelajaran, yang menampilkan kinerja model pada data pelatihan dan validasi selama proses pelatihan. Dengan memeriksa kurva ini, kita dapat menentukan apakah suatu model overfitting (varians tinggi), underfitting (bias tinggi), atau pas (keseimbangan optimal antara bias dan varians).

Contoh kurva pembelajaran model underfitting. Kesalahan kereta dan kesalahan validasi tinggi.

Dalam praktiknya, kinerja yang rendah pada data pelatihan dan validasi menunjukkan bahwa model tersebut terlalu sederhana, yang mengarah ke underfitting. Di sisi lain, jika model bekerja dengan sangat baik pada data pelatihan tetapi buruk pada data uji, kompleksitas model mungkin terlalu tinggi, sehingga terjadi overfitting. Untuk mengatasi underfitting, kita dapat mencoba meningkatkan kompleksitas model dengan menambahkan lebih banyak fitur, mengubah algoritme pembelajaran, atau memilih hyperparameter yang berbeda. Dalam kasus overfitting, kita harus mempertimbangkan untuk mengatur model atau menggunakan teknik seperti validasi silang untuk meningkatkan kemampuan generalisasinya.

Contoh kurva pembelajaran model overfitting. Kesalahan kereta berkurang sementara kesalahan validasi mulai meningkat. Model tidak dapat menggeneralisasi.

Regularisasi adalah teknik yang dapat digunakan untuk mengurangi kesalahan varians dalam model pembelajaran mesin, membantu mengatasi pertukaran bias-varians. Ada sejumlah teknik regularisasi yang berbeda, masing-masing dengan kelebihan dan kekurangannya sendiri. Beberapa teknik regularisasi yang populer termasuk regresi ridge, regresi laso, dan regularisasi jaringan elastis. Semua teknik ini membantu mencegah overfitting dengan menambahkan istilah penalti ke fungsi tujuan model, yang mencegah nilai parameter ekstrim dan mendorong model yang lebih sederhana.

Regresi punggungan, juga dikenal sebagai regularisasi L2, menambahkan istilah penalti yang proporsional dengan kuadrat parameter model. Teknik ini cenderung menghasilkan model dengan nilai parameter yang lebih kecil, yang dapat mengurangi varians dan meningkatkan generalisasi. Namun, itu tidak melakukan pemilihan fitur, jadi semua fitur tetap ada di model.

Lihat panduan praktis dan praktis kami untuk mempelajari Git, dengan praktik terbaik, standar yang diterima industri, dan termasuk lembar contekan. Hentikan perintah Googling Git dan sebenarnya belajar itu!

Regresi Lasso, atau regularisasi L1, menambahkan istilah penalti yang sebanding dengan nilai absolut dari parameter model. Teknik ini dapat menghasilkan model dengan nilai parameter yang jarang, secara efektif melakukan pemilihan fitur dengan menyetel beberapa parameter ke nol. Ini dapat menghasilkan model yang lebih sederhana yang lebih mudah diinterpretasikan.

Regularisasi jaring elastis adalah kombinasi dari regularisasi L1 dan L2, memungkinkan keseimbangan antara regresi ridge dan laso. Dengan mengontrol rasio antara dua istilah penalti, jaring elastis dapat mencapai keuntungan dari kedua teknik, seperti peningkatan generalisasi dan pemilihan fitur.

Contoh kurva pembelajaran model pemasangan yang baik.

Kesimpulan

Pertukaran bias-varians adalah konsep penting dalam pembelajaran mesin yang menentukan keefektifan dan kebaikan suatu model. Sementara bias yang tinggi menyebabkan underfitting dan varians yang tinggi menyebabkan overfitting, menemukan keseimbangan optimal antara keduanya diperlukan untuk membangun model yang kuat yang menggeneralisasi dengan baik ke data baru.

Dengan bantuan kurva pembelajaran, dimungkinkan untuk mengidentifikasi masalah overfitting atau underfitting, dan dengan menyesuaikan kompleksitas model atau menerapkan teknik regularisasi, kinerja pada data pelatihan dan validasi, serta data pengujian, dapat ditingkatkan.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Beli dan Jual Saham di Perusahaan PRE-IPO dengan PREIPO®. Akses Di Sini.

- Sumber: https://stackabuse.com/the-bias-variance-trade-off-in-machine-learning/

- :adalah

- :bukan

- :Di mana

- 1

- 12

- 20

- 8

- a

- kemampuan

- Sanggup

- Tentang Kami

- Mutlak

- akurat

- Mencapai

- mencapai

- sebenarnya

- menambahkan

- alamat

- Menambahkan

- keuntungan

- nasihat

- mempengaruhi

- mempengaruhi

- algoritma

- Semua

- Membiarkan

- juga

- an

- dan

- Apa pun

- ADALAH

- artikel

- AS

- Saldo

- saldo

- BE

- karena

- Manfaat

- antara

- prasangka

- batas

- kedua

- Bangunan

- tapi

- by

- menghitung

- CAN

- kemampuan

- menangkap

- kasus

- mengubah

- memilih

- rapat

- kombinasi

- membandingkan

- kompleks

- kompleksitas

- konsep

- Mempertimbangkan

- mengendalikan

- Core

- benar

- sangat penting

- data

- transaksi

- menurun

- Menentukan

- ditentukan

- perbedaan

- berbeda

- menampilkan

- distribusi

- tidak

- dua

- setiap

- Terdahulu

- mudah

- efektif

- efektivitas

- mendorong

- cukup

- kesalahan

- kesalahan

- Bahkan

- Memeriksa

- contoh

- Menjelaskan

- ekstrim

- kegagalan

- gagal

- Fitur

- Fitur

- temuan

- cocok

- sesuai

- fluktuasi

- Fokus

- Untuk

- fungsi

- mendasar

- Umum

- pergi

- tujuan

- baik

- Tanah

- membimbing

- tangan

- hands-on

- Memiliki

- membantu

- membantu

- High

- lebih tinggi

- melayang-layang

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTTPS

- mengenali

- if

- mengimplementasikan

- mustahil

- memperbaiki

- ditingkatkan

- in

- Di lain

- memasukkan

- termasuk

- Meningkatkan

- meningkatkan

- memasukkan

- ke

- Pengantar

- IT

- NYA

- Menjaga

- dikenal

- L1

- l2

- memimpin

- terkemuka

- Memimpin

- pengetahuan

- membiarkan

- LG

- 'like'

- Mungkin

- ll

- Rendah

- menurunkan

- mesin

- Mesin belajar

- MEMBUAT

- tersebut

- meminimalkan

- model

- model

- lebih

- perlu

- bersih

- New

- Kebisingan

- jumlah

- tujuan

- of

- sering

- on

- optimal

- or

- Lainnya

- kami

- di luar

- keluaran

- sendiri

- parameter

- parameter

- pola

- Melakukan

- prestasi

- melakukan

- melakukan

- plato

- Kecerdasan Data Plato

- Data Plato

- miskin

- Populer

- mungkin

- Praktis

- praktek

- meramalkan

- ramalan

- mencegah

- masalah

- proses

- memberikan

- agak

- perbandingan

- menurunkan

- mengurangi

- mengacu

- terkait

- hubungan

- Hubungan

- tinggal

- mewakili

- mengakibatkan

- dihasilkan

- Hasil

- benar

- Cincin

- kuat

- s

- seleksi

- Kepekaan

- pengaturan

- bayangan

- lembar

- Pendek

- harus

- Sederhana

- serentak

- kecil

- lebih kecil

- So

- beberapa

- sumber

- kotak

- penyalahgunaan

- standar

- berhenti

- kuat

- seperti itu

- Menyarankan

- teknik

- istilah

- istilah

- uji

- dari

- bahwa

- Grafik

- mereka

- Mereka

- Sana.

- Ini

- mereka

- ini

- di seluruh

- untuk

- terlalu

- alat

- Total

- Pelatihan VE

- Pelatihan

- transisi

- benar

- kebenaran

- mencoba

- dua

- khas

- tidak mampu

- pokok

- tidak dikenal

- bekas

- menggunakan

- pengesahan

- nilai

- Nilai - Nilai

- sangat

- we

- BAIK

- Apa

- apakah

- yang

- sementara

- akan

- dengan

- kata

- zephyrnet.dll

- nol