Ketika pelanggan mempercepat migrasi mereka ke cloud dan mentransformasi bisnis mereka, beberapa pelanggan mendapati diri mereka berada dalam situasi di mana mereka harus mengelola operasi TI di lingkungan multicloud. Misalnya, Anda mungkin telah mengakuisisi perusahaan yang sudah berjalan di penyedia cloud berbeda, atau Anda mungkin memiliki beban kerja yang menghasilkan nilai dari kemampuan unik yang disediakan oleh AWS. Contoh lainnya adalah vendor perangkat lunak independen (ISV) yang menyediakan produk dan layanan mereka di berbagai platform cloud untuk memberi manfaat bagi pelanggan akhir mereka. Atau suatu organisasi mungkin beroperasi di Wilayah di mana penyedia cloud utama tidak tersedia, dan untuk memenuhi persyaratan kedaulatan data atau residensi data, mereka dapat menggunakan penyedia cloud sekunder.

Dalam skenario ini, saat Anda mulai menerapkan teknologi AI generatif, model bahasa besar (LLM), dan pembelajaran mesin (ML) sebagai bagian inti dari bisnis Anda, Anda mungkin mencari opsi untuk memanfaatkannya. AWS AI dan ML kemampuan di luar AWS dalam lingkungan multicloud. Misalnya, Anda mungkin ingin memanfaatkan Amazon SageMaker untuk membangun dan melatih model ML, atau menggunakan Jumpstart Amazon SageMaker untuk menerapkan model ML dasar atau model ML pihak ketiga yang telah dibuat sebelumnya, yang dapat Anda terapkan hanya dengan mengklik beberapa tombol. Atau Anda mungkin ingin memanfaatkannya Batuan Dasar Amazon untuk membangun dan menskalakan aplikasi AI generatif, atau Anda dapat memanfaatkannya Layanan AI terlatih AWS, yang tidak mengharuskan Anda mempelajari keterampilan pembelajaran mesin. AWS memberikan dukungan untuk skenario yang diinginkan organisasi membawa model mereka sendiri ke Amazon SageMaker or ke dalam Amazon SageMaker Canvas untuk prediksi.

Dalam postingan ini, kami mendemonstrasikan salah satu dari banyak opsi yang Anda miliki untuk memanfaatkan rangkaian kemampuan AI/ML AWS yang terluas dan terdalam di lingkungan multicloud. Kami menunjukkan bagaimana Anda dapat membangun dan melatih model ML di AWS dan menerapkan model tersebut di platform lain. Kami melatih model menggunakan Amazon SageMaker, menyimpan artefak model di dalamnya Layanan Penyimpanan Sederhana Amazon (Amazon S3), dan menyebarkan serta menjalankan model di Azure. Pendekatan ini bermanfaat jika Anda menggunakan layanan AWS untuk ML karena rangkaian fiturnya yang paling komprehensif, namun Anda perlu menjalankan model Anda di penyedia cloud lain dalam salah satu situasi yang telah kita diskusikan.

Konsep kunci

Studio Amazon SageMaker adalah lingkungan pengembangan terintegrasi (IDE) berbasis web untuk pembelajaran mesin. SageMaker Studio memungkinkan ilmuwan data, teknisi ML, dan teknisi data menyiapkan data, membangun, melatih, dan menerapkan model ML pada satu antarmuka web. Dengan SageMaker Studio, Anda dapat mengakses alat yang dibuat khusus untuk setiap tahap siklus hidup pengembangan ML, mulai dari persiapan data hingga pembuatan, pelatihan, dan penerapan model ML Anda, sehingga meningkatkan produktivitas tim ilmu data hingga sepuluh kali lipat. Buku catatan SageMaker Studio adalah notebook kolaboratif yang dapat dijalankan dengan cepat dan terintegrasi dengan alat ML yang dibuat khusus di SageMaker dan layanan AWS lainnya.

SageMaker adalah layanan ML komprehensif yang memungkinkan analis bisnis, ilmuwan data, dan teknisi MLOps membangun, melatih, dan menerapkan model ML untuk kasus penggunaan apa pun, apa pun keahlian ML-nya.

AWS menyediakan Wadah Pembelajaran Mendalam (DLC) untuk framework ML populer seperti PyTorch, TensorFlow, dan Apache MXNet, yang dapat Anda gunakan dengan SageMaker untuk pelatihan dan inferensi. DLC tersedia sebagai image Docker di Registry Kontainer Elastis Amazon (Amazon ECR). Gambar Docker sudah diinstal sebelumnya dan diuji dengan versi terbaru kerangka pembelajaran mendalam yang populer serta dependensi lain yang diperlukan untuk pelatihan dan inferensi. Untuk daftar lengkap image Docker bawaan yang dikelola oleh SageMaker, lihat Jalur Registri Docker dan Kode Contoh. Amazon ECR mendukung pemindaian keamanan, dan terintegrasi dengan Inspektur Amazon layanan manajemen kerentanan untuk memenuhi persyaratan keamanan kepatuhan gambar organisasi Anda, dan untuk mengotomatisasi pemindaian penilaian kerentanan. Organisasi juga dapat menggunakan Pelatihan AWS dan Inferensi AWS untuk performa harga yang lebih baik dalam menjalankan tugas pelatihan atau inferensi ML.

Ikhtisar solusi

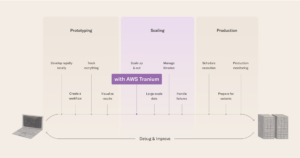

Di bagian ini, kami menjelaskan cara membangun dan melatih model menggunakan SageMaker dan menyebarkan model ke Azure Functions. Kami menggunakan notebook SageMaker Studio untuk membuat, melatih, dan menerapkan model. Kami melatih model di SageMaker menggunakan image Docker yang sudah dibuat sebelumnya untuk PyTorch. Meskipun kami menerapkan model terlatih ke Azure dalam kasus ini, Anda dapat menggunakan pendekatan yang sama untuk menerapkan model pada platform lain seperti platform lokal atau cloud lainnya.

Saat kami membuat tugas pelatihan, SageMaker meluncurkan instance komputasi ML dan menggunakan kode pelatihan serta kumpulan data pelatihan untuk melatih model. Ini menyimpan artefak model yang dihasilkan dan keluaran lainnya dalam bucket S3 yang kita tentukan sebagai masukan untuk tugas pelatihan. Ketika pelatihan model selesai, kami menggunakan Buka Pertukaran Jaringan Saraf (ONNX) perpustakaan runtime untuk mengekspor model PyTorch sebagai model ONNX.

Terakhir, kami menerapkan model ONNX bersama dengan kode inferensi khusus yang ditulis dengan Python ke Azure Functions menggunakan Azure CLI. ONNX mendukung sebagian besar kerangka kerja dan alat ML yang umum digunakan. Satu hal yang perlu diperhatikan adalah mengonversi model ML ke ONNX berguna jika Anda ingin menggunakan framework penerapan target yang berbeda, seperti PyTorch ke TensorFlow. Jika Anda menggunakan kerangka kerja yang sama pada sumber dan target, Anda tidak perlu mengonversi model ke format ONNX.

Diagram berikut menggambarkan arsitektur pendekatan ini.

Kami menggunakan notebook SageMaker Studio bersama dengan SDK Python SageMaker untuk membangun dan melatih model kami. SageMaker Python SDK adalah perpustakaan sumber terbuka untuk pelatihan dan penerapan model ML di SageMaker. Untuk lebih jelasnya, lihat Buat atau Buka Notebook Amazon SageMaker Studio.

Cuplikan kode di bagian berikut telah diuji di lingkungan notebook SageMaker Studio menggunakan gambar Data Science 3.0 dan kernel Python 3.0.

Dalam solusi ini, kami mendemonstrasikan langkah-langkah berikut:

- Latih model PyTorch.

- Ekspor model PyTorch sebagai model ONNX.

- Kemas model dan kode inferensi.

- Terapkan model ke Azure Functions.

Prasyarat

Anda harus memiliki prasyarat berikut:

- Akun AWS.

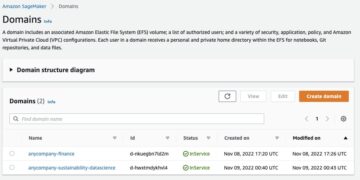

- Domain SageMaker dan pengguna SageMaker Studio. Untuk petunjuk pembuatannya, lihat Onboard ke Domain Amazon SageMaker Menggunakan Pengaturan cepat.

- Azure CLI.

- Akses ke Azure dan kredensial untuk perwakilan layanan yang memiliki izin untuk membuat dan mengelola Azure Functions.

Latih model dengan PyTorch

Di bagian ini, kami merinci langkah-langkah untuk melatih model PyTorch.

Instal dependensi

Instal perpustakaan untuk menjalankan langkah-langkah yang diperlukan untuk pelatihan model dan penerapan model:

pip install torchvision onnx onnxruntimeSelesaikan pengaturan awal

Kami mulai dengan mengimpor AWS SDK untuk Python (Boto3) dan SDK Python SageMaker. Sebagai bagian dari penyiapan, kami mendefinisikan hal berikut:

- Objek sesi yang menyediakan metode kemudahan dalam konteks SageMaker dan akun kita sendiri.

- ARN peran SageMaker yang digunakan untuk mendelegasikan izin ke layanan pelatihan dan hosting. Kami memerlukan ini agar layanan ini dapat mengakses bucket S3 tempat data dan model kami disimpan. Untuk petunjuk tentang cara membuat peran yang memenuhi kebutuhan bisnis Anda, lihat Peran SageMaker. Untuk postingan ini, kami menggunakan peran eksekusi yang sama dengan instance notebook Studio kami. Kami mendapatkan peran ini dengan menelepon

sagemaker.get_execution_role(). - Wilayah default tempat tugas pelatihan kami akan dijalankan.

- Bucket default dan awalan yang kami gunakan untuk menyimpan keluaran model.

Lihat kode berikut:

import sagemaker

import boto3

import os execution_role = sagemaker.get_execution_role()

region = boto3.Session().region_name

session = sagemaker.Session()

bucket = session.default_bucket()

prefix = "sagemaker/mnist-pytorch"Buat kumpulan data pelatihan

Kami menggunakan kumpulan data yang tersedia di keranjang publik sagemaker-example-files-prod-{region}. Kumpulan data berisi file berikut:

- kereta-gambar-idx3-ubyte.gz – Berisi gambar set pelatihan

- kereta-label-idx1-ubyte.gz – Berisi label set pelatihan

- t10k-images-idx3-ubyte.gz – Berisi gambar set pengujian

- t10k-labels-idx1-ubyte.gz – Berisi label set pengujian

Kami menggunakantorchvision.datasets modul untuk mengunduh data dari keranjang publik secara lokal sebelum mengunggahnya ke keranjang data pelatihan kami. Kami meneruskan lokasi bucket ini sebagai masukan untuk tugas pelatihan SageMaker. Skrip pelatihan kami menggunakan lokasi ini untuk mengunduh dan menyiapkan data pelatihan, lalu melatih modelnya. Lihat kode berikut:

MNIST.mirrors = [ f"https://sagemaker-example-files-prod-{region}.s3.amazonaws.com/datasets/image/MNIST/"

] MNIST( "data", download=True, transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))] ),

)

Buat skrip pelatihan

Dengan SageMaker, Anda dapat menggunakan model Anda sendiri mode skrip. Dengan mode skrip, Anda dapat menggunakan kontainer SageMaker yang telah dibuat sebelumnya dan menyediakan skrip pelatihan Anda sendiri, yang memiliki definisi model, beserta pustaka dan dependensi kustom apa pun. Itu SDK Python SageMaker meneruskan skrip kami sebagai entry_point ke container, yang memuat dan menjalankan fungsi train dari skrip yang disediakan untuk melatih model kita.

Saat pelatihan selesai, SageMaker menyimpan output model di bucket S3 yang kami sediakan sebagai parameter untuk tugas pelatihan.

Kode pelatihan kami diadaptasi dari berikut ini Contoh skrip PyTorch. Kutipan kode berikut menunjukkan definisi model dan fungsi kereta:

# define network class Net(nn.Module): def __init__(self): super(Net, self).__init__() self.conv1 = nn.Conv2d(1, 32, 3, 1) self.conv2 = nn.Conv2d(32, 64, 3, 1) self.dropout1 = nn.Dropout(0.25) self.dropout2 = nn.Dropout(0.5) self.fc1 = nn.Linear(9216, 128) self.fc2 = nn.Linear(128, 10) def forward(self, x): x = self.conv1(x) x = F.relu(x) x = self.conv2(x) x = F.relu(x) x = F.max_pool2d(x, 2) x = self.dropout1(x) x = torch.flatten(x, 1) x = self.fc1(x) x = F.relu(x) x = self.dropout2(x) x = self.fc2(x) output = F.log_softmax(x, dim=1) return output# train def train(args, model, device, train_loader, optimizer, epoch): model.train() for batch_idx, (data, target) in enumerate(train_loader): data, target = data.to(device), target.to(device) optimizer.zero_grad() output = model(data) loss = F.nll_loss(output, target) loss.backward() optimizer.step() if batch_idx % args.log_interval == 0: print('Train Epoch: {} [{}/{} ({:.0f}%)]tLoss: {:.6f}'.format( epoch, batch_idx * len(data), len(train_loader.dataset), 100. * batch_idx / len(train_loader), loss.item())) if args.dry_run: breakLatih modelnya

Sekarang setelah kita menyiapkan lingkungan dan membuat kumpulan data masukan dan skrip pelatihan khusus, kita dapat memulai pelatihan model menggunakan SageMaker. Kami menggunakan estimator PyTorch di SageMaker Python SDK untuk memulai pekerjaan pelatihan di SageMaker. Kami meneruskan parameter yang diperlukan ke estimator dan memanggil metode fit. Saat kami memanggil fit pada estimator PyTorch, SageMaker memulai tugas pelatihan menggunakan skrip kami sebagai kode pelatihan:

from sagemaker.pytorch import PyTorch output_location = f"s3://{bucket}/{prefix}/output"

print(f"training artifacts will be uploaded to: {output_location}") hyperparameters={ "batch-size": 100, "epochs": 1, "lr": 0.1, "gamma": 0.9, "log-interval": 100

} instance_type = "ml.c4.xlarge"

estimator = PyTorch( entry_point="train.py", source_dir="code", # directory of your training script role=execution_role, framework_version="1.13", py_version="py39", instance_type=instance_type, instance_count=1, volume_size=250, output_path=output_location, hyperparameters=hyperparameters

) estimator.fit(inputs = { 'training': f"{inputs}", 'testing': f"{inputs}"

})Ekspor model terlatih sebagai model ONNX

Setelah pelatihan selesai dan model kami disimpan ke lokasi yang telah ditentukan sebelumnya di Amazon S3, kami mengekspor model tersebut ke model ONNX menggunakan runtime ONNX.

Kami menyertakan kode untuk mengekspor model kami ke ONNX dalam skrip pelatihan kami untuk dijalankan setelah pelatihan selesai.

PyTorch mengekspor model ke ONNX dengan menjalankan model menggunakan masukan kami dan mencatat jejak operator yang digunakan untuk menghitung keluaran. Kami menggunakan input acak dari tipe yang tepat dengan PyTorch torch.onnx.export berfungsi untuk mengekspor model ke ONNX. Kami juga menentukan dimensi pertama dalam masukan kami sebagai dinamis sehingga model kami menerima variabel batch_size masukan selama inferensi.

def export_to_onnx(model, model_dir, device): logger.info("Exporting the model to onnx.") dummy_input = torch.randn(1, 1, 28, 28).to(device) input_names = [ "input_0" ] output_names = [ "output_0" ] path = os.path.join(model_dir, 'mnist-pytorch.onnx') torch.onnx.export(model, dummy_input, path, verbose=True, input_names=input_names, output_names=output_names, dynamic_axes={'input_0' : {0 : 'batch_size'}, # variable length axes 'output_0' : {0 : 'batch_size'}})ONNX adalah format standar terbuka untuk model pembelajaran mendalam yang memungkinkan interoperabilitas antara kerangka pembelajaran mendalam seperti PyTorch, Microsoft Cognitive Toolkit (CNTK), dan banyak lagi. Ini berarti Anda dapat menggunakan salah satu kerangka kerja ini untuk melatih model dan kemudian mengekspor model yang telah dilatih sebelumnya dalam format ONNX. Dengan mengekspor model ke ONNX, Anda mendapatkan manfaat dari pilihan perangkat dan platform penerapan yang lebih luas.

Unduh dan ekstrak artefak model

Model ONNX yang skrip pelatihan kami simpan telah disalin oleh SageMaker ke Amazon S3 di lokasi output yang kami tentukan saat kami memulai tugas pelatihan. Artefak model disimpan sebagai file arsip terkompresi yang disebut model.tar.gz. Kami mengunduh file arsip ini ke direktori lokal di instance notebook Studio kami dan mengekstrak artefak model, yaitu model ONNX.

import tarfile local_model_file = 'model.tar.gz'

model_bucket,model_key = estimator.model_data.split('/',2)[-1].split('/',1)

s3 = boto3.client("s3")

s3.download_file(model_bucket,model_key,local_model_file) model_tar = tarfile.open(local_model_file)

model_file_name = model_tar.next().name

model_tar.extractall('.')

model_tar.close()Validasi model ONNX

Model ONNX diekspor ke file bernama mnist-pytorch.onnx dengan skrip pelatihan kami. Setelah kami mengunduh dan mengekstrak file ini, kami dapat memvalidasi model ONNX secara opsional menggunakan onnx.checker modul. NS check_model fungsi dalam modul ini memeriksa konsistensi model. Pengecualian dimunculkan jika pengujian gagal.

import onnx onnx_model = onnx.load("mnist-pytorch.onnx")

onnx.checker.check_model(onnx_model)Kemas model dan kode inferensi

Untuk postingan ini, kami menggunakan penerapan .zip untuk Azure Functions. Dalam metode ini, kami mengemas model kami, kode yang menyertainya, dan pengaturan Azure Functions dalam file .zip dan mempublikasikannya ke Azure Functions. Kode berikut menunjukkan struktur direktori paket penerapan kami:

mnist-onnx├── function_app.py├── model│ └── mnist-pytorch.onnx└── requirements.txt

Daftar dependensi

Kami mencantumkan dependensi untuk kode inferensi kami di requirements.txt file di root paket kami. File ini digunakan untuk membangun lingkungan Azure Functions saat kami menerbitkan paket.

azure-functionsnumpyonnxruntime

Tulis kode inferensi

Kami menggunakan Python untuk menulis kode inferensi berikut, menggunakan pustaka ONNX Runtime untuk memuat model kami dan menjalankan inferensi. Ini menginstruksikan aplikasi Azure Functions untuk membuat titik akhir tersedia di /classify Jalur relatif.

import logging

import azure.functions as func

import numpy as np

import os

import onnxruntime as ort

import json app = func.FunctionApp() def preprocess(input_data_json): # convert the JSON data into the tensor input return np.array(input_data_json['data']).astype('float32') def run_model(model_path, req_body): session = ort.InferenceSession(model_path) input_data = preprocess(req_body) logging.info(f"Input Data shape is {input_data.shape}.") input_name = session.get_inputs()[0].name # get the id of the first input of the model try: result = session.run([], {input_name: input_data}) except (RuntimeError) as e: print("Shape={0} and error={1}".format(input_data.shape, e)) return result[0] def get_model_path(): d=os.path.dirname(os.path.abspath(__file__)) return os.path.join(d , './model/mnist-pytorch.onnx') @app.function_name(name="mnist_classify")

@app.route(route="classify", auth_level=func.AuthLevel.ANONYMOUS)

def main(req: func.HttpRequest) -> func.HttpResponse: logging.info('Python HTTP trigger function processed a request.') # Get the img value from the post. try: req_body = req.get_json() except ValueError: pass if req_body: # run model result = run_model(get_model_path(), req_body) # map output to integer and return result string. digits = np.argmax(result, axis=1) logging.info(type(digits)) return func.HttpResponse(json.dumps({"digits": np.array(digits).tolist()})) else: return func.HttpResponse( "This HTTP triggered function successfully.", status_code=200 )Terapkan model ke Azure Functions

Sekarang setelah kode dikemas ke dalam format .zip yang diperlukan, kami siap menerbitkannya ke Azure Functions. Kami melakukannya menggunakan Azure CLI, utilitas baris perintah untuk membuat dan mengelola sumber daya Azure. Instal Azure CLI dengan kode berikut:

!pip install -q azure-cliKemudian selesaikan langkah-langkah berikut:

- Masuk ke Azure:

!az login - Siapkan parameter pembuatan sumber daya:

import random random_suffix = str(random.randint(10000,99999)) resource_group_name = f"multicloud-{random_suffix}-rg" storage_account_name = f"multicloud{random_suffix}" location = "ukwest" sku_storage = "Standard_LRS" functions_version = "4" python_version = "3.9" function_app = f"multicloud-mnist-{random_suffix}" - Gunakan perintah berikut untuk membuat aplikasi Azure Functions bersama dengan sumber daya prasyarat:

!az group create --name {resource_group_name} --location {location} !az storage account create --name {storage_account_name} --resource-group {resource_group_name} --location {location} --sku {sku_storage} !az functionapp create --name {function_app} --resource-group {resource_group_name} --storage-account {storage_account_name} --consumption-plan-location "{location}" --os-type Linux --runtime python --runtime-version {python_version} --functions-version {functions_version} - Siapkan Azure Functions sehingga saat kita menyebarkan paket Functions,

requirements.txtfile digunakan untuk membangun dependensi aplikasi kita:!az functionapp config appsettings set --name {function_app} --resource-group {resource_group_name} --settings @./functionapp/settings.json - Konfigurasikan aplikasi Functions untuk menjalankan model Python v2 dan melakukan build pada kode yang diterimanya setelah penerapan .zip:

{ "AzureWebJobsFeatureFlags": "EnableWorkerIndexing", "SCM_DO_BUILD_DURING_DEPLOYMENT": true } - Setelah kita memiliki grup sumber daya, kontainer penyimpanan, dan aplikasi Functions dengan konfigurasi yang tepat, publikasikan kode ke aplikasi Functions:

!az functionapp deployment source config-zip -g {resource_group_name} -n {function_app} --src {function_archive} --build-remote true

Uji modelnya

Kami telah menerapkan model ML ke Azure Functions sebagai pemicu HTTP, yang berarti kami dapat menggunakan URL aplikasi Functions untuk mengirim permintaan HTTP ke fungsi tersebut guna memanggil fungsi dan menjalankan model.

Untuk mempersiapkan masukan, unduh file gambar uji dari keranjang file contoh SageMaker dan siapkan satu set sampel ke format yang diperlukan oleh model:

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

import matplotlib.pyplot as plt transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))]

) test_dataset = datasets.MNIST(root='../data', download=True, train=False, transform=transform)

test_loader = DataLoader(test_dataset, batch_size=16, shuffle=True) test_features, test_labels = next(iter(test_loader))Gunakan perpustakaan permintaan untuk mengirim permintaan posting ke titik akhir inferensi dengan input sampel. Titik akhir inferensi mengambil format seperti yang ditunjukkan dalam kode berikut:

import requests, json def to_numpy(tensor): return tensor.detach().cpu().numpy() if tensor.requires_grad else tensor.cpu().numpy() url = f"https://{function_app}.azurewebsites.net/api/classify"

response = requests.post(url, json.dumps({"data":to_numpy(test_features).tolist()}) )

predictions = json.loads(response.text)['digits']Membersihkan

Setelah Anda selesai menguji model, hapus grup sumber daya beserta sumber daya yang ada di dalamnya, termasuk kontainer penyimpanan dan aplikasi Functions:

!az group delete --name {resource_group_name} --yesSelain itu, disarankan untuk mematikan sumber daya yang menganggur dalam SageMaker Studio untuk mengurangi biaya. Untuk informasi lebih lanjut, lihat Hemat biaya dengan secara otomatis mematikan sumber daya yang tidak digunakan dalam Amazon SageMaker Studio.

Kesimpulan

Dalam postingan ini, kami menunjukkan bagaimana Anda dapat membangun dan melatih model ML dengan SageMaker dan menerapkannya ke penyedia cloud lain. Dalam solusinya, kami menggunakan notebook SageMaker Studio, namun untuk beban kerja produksi, kami merekomendasikan penggunaan MLOps untuk membuat alur kerja pelatihan berulang guna mempercepat pengembangan dan penerapan model.

Postingan ini tidak menunjukkan semua kemungkinan cara untuk menerapkan dan menjalankan model di lingkungan multicloud. Misalnya, Anda juga dapat mengemas model Anda ke dalam gambar kontainer bersama dengan kode inferensi dan pustaka ketergantungan untuk menjalankan model sebagai aplikasi dalam kontainer di platform apa pun. Untuk informasi lebih lanjut tentang pendekatan ini, lihat Terapkan aplikasi kontainer di lingkungan multicloud menggunakan Amazon CodeCatalyst. Tujuan dari postingan ini adalah untuk menunjukkan bagaimana organisasi dapat menggunakan kemampuan AWS AI/ML di lingkungan multicloud.

Tentang penulis

Raja Vaidyanathan adalah Arsitek Solusi di AWS yang mendukung pelanggan layanan keuangan global. Raja bekerja dengan pelanggan untuk merancang solusi terhadap masalah kompleks dengan dampak positif jangka panjang pada bisnis mereka. Dia adalah seorang profesional teknik yang ahli dalam strategi TI, manajemen data perusahaan, dan arsitektur aplikasi, dengan minat khusus dalam analitik dan pembelajaran mesin.

Raja Vaidyanathan adalah Arsitek Solusi di AWS yang mendukung pelanggan layanan keuangan global. Raja bekerja dengan pelanggan untuk merancang solusi terhadap masalah kompleks dengan dampak positif jangka panjang pada bisnis mereka. Dia adalah seorang profesional teknik yang ahli dalam strategi TI, manajemen data perusahaan, dan arsitektur aplikasi, dengan minat khusus dalam analitik dan pembelajaran mesin.

Amandeep Bajwa adalah Arsitek Solusi Senior di AWS yang mendukung perusahaan jasa keuangan. Dia membantu organisasi mencapai hasil bisnis mereka dengan mengidentifikasi strategi transformasi cloud yang tepat berdasarkan tren industri dan prioritas organisasi. Beberapa bidang yang menjadi konsultasi Amandeep adalah migrasi cloud, strategi cloud (termasuk hybrid dan multicloud), transformasi digital, data dan analitik, serta teknologi secara umum.

Amandeep Bajwa adalah Arsitek Solusi Senior di AWS yang mendukung perusahaan jasa keuangan. Dia membantu organisasi mencapai hasil bisnis mereka dengan mengidentifikasi strategi transformasi cloud yang tepat berdasarkan tren industri dan prioritas organisasi. Beberapa bidang yang menjadi konsultasi Amandeep adalah migrasi cloud, strategi cloud (termasuk hybrid dan multicloud), transformasi digital, data dan analitik, serta teknologi secara umum.

Prema Iyer adalah Manajer Akun Teknis Senior untuk AWS Enterprise Support. Dia bekerja dengan pelanggan eksternal di berbagai proyek, membantu mereka meningkatkan nilai solusi mereka saat menggunakan AWS.

Prema Iyer adalah Manajer Akun Teknis Senior untuk AWS Enterprise Support. Dia bekerja dengan pelanggan eksternal di berbagai proyek, membantu mereka meningkatkan nilai solusi mereka saat menggunakan AWS.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/train-and-deploy-ml-models-in-a-multicloud-environment-using-amazon-sagemaker/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 13

- 25

- 28

- 32

- 7

- 9

- a

- Tentang Kami

- mempercepat

- Menerima

- mengakses

- Akun

- Mencapai

- diperoleh

- Keuntungan

- Setelah

- AI

- AI / ML

- Semua

- memungkinkan

- sepanjang

- sudah

- juga

- Meskipun

- Amazon

- Amazon SageMaker

- Kanvas Amazon SageMaker

- Studio Amazon SageMaker

- Amazon Web Services

- an

- Analis

- analisis

- dan

- Anonim

- Lain

- Apa pun

- Apache

- aplikasi

- Aplikasi

- aplikasi

- pendekatan

- sesuai

- arsitektur

- arsip

- ADALAH

- daerah

- AS

- penilaian

- At

- mengotomatisasikan

- secara otomatis

- tersedia

- AWS

- kapak

- Biru langit

- berdasarkan

- BE

- menjadi

- sebelum

- mulai

- bermanfaat

- manfaat

- Lebih baik

- antara

- kedua

- membawa

- lebih luas

- membangun

- Bangunan

- bisnis

- tapi

- by

- panggilan

- bernama

- panggilan

- CAN

- kanvas

- kemampuan

- membawa

- kasus

- Cek

- kelas

- Klasifikasi

- Klik

- awan

- kode

- kognitif

- kolaboratif

- perusahaan

- lengkap

- kompleks

- pemenuhan

- luas

- menghitung

- konfigurasi

- berisi

- Wadah

- Wadah

- mengandung

- konteks

- kenyamanan

- mengubah

- mengkonversi

- Core

- Biaya

- bisa

- membuat

- dibuat

- membuat

- penciptaan

- Surat kepercayaan

- adat

- pelanggan

- data

- manajemen data

- Persiapan data

- ilmu data

- kumpulan data

- mendalam

- belajar mendalam

- terdalam

- Default

- menetapkan

- definisi

- mendemonstrasikan

- ketergantungan

- Ketergantungan

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- menggambarkan

- rinci

- rincian

- Pengembangan

- alat

- Devices

- berbeda

- digital

- Transformasi digital

- digit

- Dimensi

- dibahas

- do

- Buruh pelabuhan

- domain

- dilakukan

- Dont

- turun

- Download

- selama

- dinamis

- e

- lain

- merangkul

- memungkinkan

- memungkinkan

- akhir

- Titik akhir

- Teknik

- Insinyur

- Enterprise

- perusahaan

- Lingkungan Hidup

- masa

- zaman

- Setiap

- contoh

- Kecuali

- pengecualian

- eksekusi

- keahlian

- ekspor

- ekspor

- luar

- ekstrak

- gagal

- Fitur

- beberapa

- File

- File

- keuangan

- jasa keuangan

- Menemukan

- Pertama

- cocok

- berikut

- Untuk

- format

- Prinsip Dasar

- Kerangka

- kerangka

- dari

- fungsi

- fungsi

- Umum

- menghasilkan

- generatif

- AI generatif

- mendapatkan

- Aksi

- keuangan global

- Kelompok

- Memiliki

- he

- membantu

- membantu

- tuan

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- http

- HTTPS

- Hibrida

- ID

- mengidentifikasi

- Siaga

- if

- menggambarkan

- gambar

- gambar

- Dampak

- mengimpor

- pengimporan

- memperbaiki

- meningkatkan

- in

- memasukkan

- Termasuk

- independen

- industri

- informasi

- mulanya

- memasukkan

- input

- install

- contoh

- instruksi

- mengintegrasikan

- terpadu

- maksud

- kepentingan

- Antarmuka

- Interoperabilitas

- ke

- IT

- NYA

- Pekerjaan

- Jobs

- jpg

- json

- bahasa

- besar

- Terbaru

- meluncurkan

- BELAJAR

- pengetahuan

- Panjang

- Leverage

- perpustakaan

- Perpustakaan

- siklus hidup

- baris

- linux

- Daftar

- memuat

- beban

- lokal

- lokal

- tempat

- penebangan

- jangka panjang

- mencari

- lepas

- mesin

- Mesin belajar

- membuat

- mengelola

- berhasil

- pengelolaan

- manajer

- banyak

- peta

- matplotlib.dll

- Mungkin..

- cara

- Pelajari

- Memenuhi

- metode

- metode

- Microsoft

- mungkin

- migrasi

- ML

- MLOps

- mode

- model

- model

- Modul

- lebih

- paling

- nama

- Bernama

- yaitu

- Perlu

- dibutuhkan

- kebutuhan

- bersih

- jaringan

- saraf

- saraf jaringan

- buku catatan

- mati rasa

- obyek

- of

- on

- ONE

- Buka

- open source

- operasi

- Operasi

- operator

- Opsi

- or

- urutan

- organisasi

- organisatoris

- organisasi

- OS

- Lainnya

- kami

- di luar

- hasil

- keluaran

- di luar

- sendiri

- paket

- dikemas

- parameter

- parameter

- bagian

- tertentu

- pihak

- lulus

- melewati

- path

- Melakukan

- Izin

- Platform

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Populer

- positif

- mungkin

- Pos

- Prediksi

- persiapan

- Mempersiapkan

- prasyarat

- primer

- Utama

- masalah

- Diproses

- Produksi

- produktifitas

- Produk

- profesional

- memprojeksikan

- memberikan

- disediakan

- pemberi

- menyediakan

- publik

- menerbitkan

- Ular sanca

- pytorch

- Cepat

- menonjol

- acak

- siap

- menerima

- direkomendasikan

- rekaman

- menurunkan

- lihat

- Bagaimanapun juga

- wilayah

- pendaftaran

- relatif

- berulang

- permintaan

- permintaan

- membutuhkan

- wajib

- Persyaratan

- sumber

- Sumber

- tanggapan

- mengakibatkan

- dihasilkan

- kembali

- benar

- Peran

- akar

- Run

- berjalan

- berjalan

- pembuat bijak

- sama

- disimpan

- Skala

- pemindaian

- skenario

- Ilmu

- ilmuwan

- naskah

- SDK

- sekunder

- Bagian

- bagian

- keamanan

- melihat

- seleksi

- DIRI

- mengirim

- senior

- layanan

- Layanan

- Sidang

- set

- pengaturan

- penyiapan

- Bentuknya

- dia

- harus

- Menunjukkan

- menunjukkan

- ditunjukkan

- Pertunjukkan

- menutup

- mematikan

- Sederhana

- situasi

- terampil

- keterampilan

- So

- Perangkat lunak

- larutan

- Solusi

- beberapa

- sumber

- kedaulatan

- ditentukan

- Tahap

- standar

- awal

- mulai

- dimulai

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- Penyelarasan

- Tali

- kuat

- struktur

- studio

- Kemudian

- berhasil

- seperti itu

- mendukung

- pendukung

- Mendukung

- Mengambil

- Dibutuhkan

- target

- tim

- Teknis

- Teknologi

- Teknologi

- sepuluh

- tensorflow

- uji

- diuji

- pengujian

- teks

- bahwa

- Grafik

- Sumber

- mereka

- Mereka

- diri

- kemudian

- Ini

- mereka

- hal

- Ketiga

- ini

- kali

- untuk

- toolkit

- alat

- obor

- Penglihatan obor

- Jejak

- Pelatihan VE

- terlatih

- Pelatihan

- Mengubah

- Transformasi

- Strategi Transformasi

- transformasi

- Tren

- memicu

- dipicu

- benar

- mencoba

- mengetik

- unik

- upload

- Mengunggah

- URL

- menggunakan

- gunakan case

- bekas

- Pengguna

- kegunaan

- menggunakan

- kegunaan

- MENGESAHKAN

- nilai

- variabel

- variasi

- vendor

- Versi

- kerentanan

- ingin

- adalah

- cara

- we

- jaringan

- layanan web

- berbasis web

- BAIK

- ketika

- yang

- akan

- dengan

- dalam

- Alur kerja

- bekerja

- menulis

- tertulis

- X

- namun

- Kamu

- Anda

- zephyrnet.dll

- Zip