Dalam film M3GAN, pengembang mainan memberikan keponakannya yang baru saja yatim piatu, Cady, robot bertenaga AI berukuran anak-anak dengan satu tujuan: melindungi Cady. Robot M3GAN bersimpati dengan trauma Cady. Tapi hal-hal segera pergi ke selatan, dengan robot berukuran pint menyerang apa saja dan siapa saja yang dianggap sebagai ancaman bagi Cady.

M3GAN tidak berbahaya. Itu mengikuti pemrogramannya, tetapi tanpa kepedulian atau rasa hormat terhadap makhluk lain — pada akhirnya termasuk Cady. Dalam arti tertentu, saat terlibat dengan dunia fisik, M3GAN menjadi sosiopat AI.

AI sosiopat bukan hanya topik yang dieksplorasi di Hollywood. Bagi Dr. Leonardo Christov-Moore dari University of Southern California dan rekan-rekannya, inilah saat yang tepat untuk membangun empati buatan ke dalam AI—dan menghentikan perilaku antisosial sejak awal.

In sebuah esai diterbitkan minggu lalu di Robotika sains, tim berpendapat untuk a neuroscience perspektif untuk menanamkan empati ke dalam baris kode. Kuncinya adalah menambahkan "insting" untuk bertahan hidup—misalnya, kebutuhan untuk menghindari rasa sakit fisik. Dengan pemahaman tentang bagaimana hal itu mungkin "terluka", agen AI kemudian dapat memetakan pengetahuan tersebut ke orang lain. Ini mirip dengan cara manusia mengukur perasaan satu sama lain: Saya mengerti dan merasakan rasa sakit Anda karena saya pernah ke sana sebelumnya.

Agen AI berdasarkan empati menambahkan lapisan pagar tambahan yang "mencegah kerusakan parah yang tidak dapat diubah", tersebut Christov-Moore. Sangat sulit untuk menyakiti orang lain jika Anda meniru secara digital—dan dengan demikian “mengalami”—konsekuensinya.

Digital da Vinci

Peningkatan pesat ChatGPT dan model generatif besar lainnya mengejutkan semua orang, segera menimbulkan pertanyaan tentang bagaimana mereka dapat berintegrasi ke dunia kita. Beberapa negara sudah melarang teknologi karena risiko keamanan siber dan perlindungan privasi. Pakar AI juga membunyikan lonceng peringatan dalam surat terbuka awal tahun ini yang memperingatkan tentang "risiko mendalam bagi masyarakat" teknologi tersebut.

Kami masih beradaptasi dengan dunia yang didukung AI. Namun karena algoritme ini semakin masuk ke dalam jalinan masyarakat, inilah saatnya untuk melihat ke depan ke potensi konsekuensinya. Bagaimana kita membimbing agen AI agar tidak membahayakan, melainkan bekerja dengan kemanusiaan dan membantu masyarakat?

Ini masalah yang sulit. Sebagian besar algoritme AI tetap menjadi kotak hitam. Kami tidak tahu bagaimana atau mengapa banyak algoritme menghasilkan keputusan.

Namun para agen memiliki kemampuan luar biasa untuk menghasilkan solusi "menakjubkan dan juga misterius" yang berlawanan dengan intuisi manusia, kata Christov-Moore. Beri mereka tantangan—katakanlah, menemukan cara untuk membangun protein terapeutik sebanyak mungkin—dan mereka akan sering membayangkan solusi yang bahkan belum pernah dipertimbangkan manusia.

Kreativitas yang tidak tertambat ada harganya. “Masalahnya adalah mungkin mereka bisa memilih solusi yang dapat mengakibatkan bencana yang tidak dapat diubah dan membahayakan makhluk hidup, dan manusia pada khususnya,” kata Christov-Moore.

Menambahkan dosis empati buatan ke AI mungkin merupakan pagar pembatas terkuat yang kita miliki saat ini.

Mari Bicara Perasaan

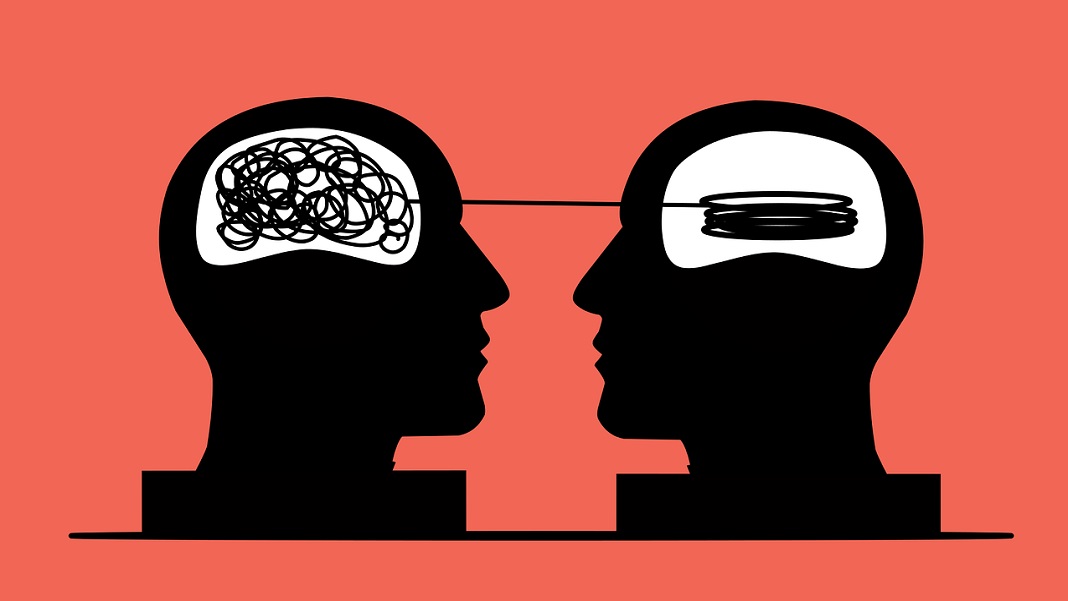

Empati bukanlah simpati.

Sebagai contoh: Baru-baru ini saya menuangkan hidrogen peroksida ke luka segar selebar tiga inci. Simpati adalah ketika Anda memahami bahwa itu menyakitkan dan menunjukkan perhatian dan kasih sayang. Empati adalah saat Anda membayangkan dengan jelas bagaimana rasa sakit yang akan Anda rasakan (dan ngeri).

Penelitian sebelumnya dalam ilmu saraf menunjukkan bahwa empati secara kasar dapat dipecah menjadi dua komponen utama. Salah satunya murni logis: Anda mengamati perilaku seseorang, memecahkan kode pengalaman mereka, dan menyimpulkan apa yang terjadi pada mereka.

Sebagian besar metode yang ada untuk empati buatan mengambil rute ini, tetapi ini adalah jalur cepat menuju AI sosiopat. Mirip dengan rekan manusia yang terkenal, agen ini mungkin meniru perasaan tetapi tidak mengalaminya, sehingga mereka dapat memprediksi dan memanipulasi perasaan itu pada orang lain tanpa alasan moral untuk menghindari bahaya atau penderitaan.

Komponen kedua melengkapi gambar. Di sini, AI diberi rasa kerentanan yang dibagikan di antara manusia dan sistem lainnya.

“Jika saya hanya tahu keadaan Anda saat ini, tetapi saya tidak membagikannya sama sekali, maka tidak ada alasan mengapa hal itu akan menggerakkan saya kecuali saya memiliki semacam kode moral yang sangat kuat yang telah saya kembangkan,” kata Christov-Moore .

AI yang Rentan

Salah satu cara untuk membuat kode kerentanan adalah dengan mengilhami AI dengan rasa tetap hidup.

Manusia menjadi lapar. Terlalu panas. Membeku. Gembira. Murung. Berkat evolusi, kita memiliki jendela yang sempit namun fleksibel untuk setiap pengukuran biologis yang membantu menjaga kesehatan fisik dan mental secara keseluruhan, yang disebut homeostasis. Mengetahui kemampuan tubuh dan pikiran kita memungkinkan untuk mencari solusi apa pun yang mungkin saat kita terjun ke lingkungan dinamis yang tidak terduga.

Kendala biologis ini bukanlah bug melainkan fitur untuk menghasilkan empati dalam AI, kata penulis.

Satu ide sebelumnya untuk memprogram empati buatan ke dalam AI adalah menulis aturan eksplisit untuk benar versus salah. Itu datang dengan masalah yang jelas. Sistem berbasis aturan kaku dan sulit dinavigasi di sekitar area abu-abu secara moral. Mereka juga sulit dibangun, dengan budaya yang berbeda memiliki kerangka kerja yang sangat beragam tentang apa yang dapat diterima.

Sebaliknya, dorongan untuk bertahan hidup bersifat universal, dan merupakan titik awal untuk membangun AI yang rentan.

“Pada akhirnya, hal utama adalah otak Anda…harus berurusan dengan bagaimana mempertahankan tubuh yang rentan di dunia, dan penilaian Anda tentang seberapa baik Anda melakukannya,” kata Christov-Moore.

Data ini terwujud dalam kesadaran sebagai perasaan yang memengaruhi pilihan kita: nyaman, tidak nyaman, pergi ke sini, makan di sana. Dorongan ini adalah "skor yang mendasari film kehidupan kita, dan memberi kita rasa [jika semuanya] berjalan dengan baik atau tidak," kata Christov-Moore. Tanpa tubuh rentan yang perlu dipertahankan—baik secara digital maupun fisik sebagai robot—agen AI tidak dapat memiliki kulit dalam permainan untuk kehidupan kolaboratif yang mendorongnya menuju atau menjauhi perilaku tertentu.

Jadi bagaimana cara membangun AI yang rentan?

“Anda perlu mengalami sesuatu seperti penderitaan,” kata Christov-Moore.

Tim menyusun cetak biru praktis. Tujuan utamanya adalah mempertahankan homeostatis. Pada langkah pertama, "anak" AI berkeliaran di sekitar lingkungan yang penuh dengan rintangan sambil mencari hadiah yang bermanfaat dan menjaga dirinya tetap hidup. Selanjutnya, ia mulai mengembangkan gagasan tentang apa yang dipikirkan orang lain dengan memperhatikan mereka. Ini seperti kencan pertama: anak AI mencoba membayangkan apa yang "dipikirkan" oleh AI lain (bagaimana dengan bunga segar?), dan ketika itu salah (AI lain membenci bunga), menderita semacam kesedihan dan menyesuaikan harapannya. Dengan mencoba berkali-kali, AI akhirnya belajar dan beradaptasi dengan preferensi pihak lain.

Terakhir, AI memetakan model internal pihak lain ke dirinya sendiri sambil mempertahankan integritasnya sendiri. Saat membuat keputusan, ia kemudian dapat mempertimbangkan berbagai sudut pandang secara bersamaan dengan menimbang setiap masukan untuk satu keputusan—pada gilirannya menjadikannya lebih cerdas dan lebih kooperatif.

Untuk saat ini, ini hanya skenario teoretis. Mirip dengan manusia, agen AI ini tidak sempurna. Mereka membuat keputusan yang buruk saat stres tepat waktu dan mengabaikan konsekuensi jangka panjang.

Yang mengatakan, AI "menciptakan pencegah yang dimasukkan ke dalam kecerdasannya ... yang mencegahnya dari keputusan yang dapat menyebabkan sesuatu seperti membahayakan makhluk hidup lainnya serta dirinya sendiri," kata Christov-Moore. “Dengan menyeimbangkan kerugian, kesejahteraan, dan berkembang dalam berbagai skenario yang saling bertentangan di dunia ini, AI dapat mencapai solusi kontra-intuitif untuk menekan masalah tingkat peradaban yang bahkan tidak pernah kita pikirkan. Jika kita dapat mengatasi rintangan berikutnya ini… AI dapat berubah dari risiko tingkat peradaban menjadi sekutu terbesar yang pernah kita miliki.

Gambar Kredit: Mohamed Hassan dari Pixabay

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Otomotif / EV, Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- BlockOffset. Modernisasi Kepemilikan Offset Lingkungan. Akses Di Sini.

- Sumber: https://singularityhub.com/2023/07/18/giving-ai-a-sense-of-empathy-could-protect-us-from-its-worst-impulses/

- :adalah

- :bukan

- $NAIK

- a

- kemampuan

- Tentang Kami

- diterima

- di seluruh

- beradaptasi

- menambahkan

- Tambahan

- Agen

- agen

- di depan

- AI

- Bertenaga AI

- alarm

- algoritma

- Semua

- Sekutu

- juga

- an

- dan

- Lain

- Apa pun

- siapapun

- apa saja

- ADALAH

- daerah

- berdebat

- sekitar

- buatan

- AS

- penilaian

- At

- Menyerang

- penulis

- menghindari

- jauh

- Buruk

- balancing

- berdasarkan

- BE

- menjadi

- karena

- menjadi

- sebelum

- laku

- perilaku

- makhluk

- lonceng

- bermanfaat

- Black

- tubuh

- tubuh

- Kotak

- Rusak

- Bug

- membangun

- Bangunan

- tapi

- by

- california

- bernama

- CAN

- kemampuan

- yang

- bencana

- Menyebabkan

- tertentu

- ChatGPT

- pilihan

- jelas

- kode

- kolaboratif

- rekan

- bagaimana

- datang

- nyaman

- Selesaikan

- komponen

- komponen

- Berbenturan

- Kesadaran

- Konsekuensi

- Mempertimbangkan

- dianggap

- kendala

- kontras

- koperasi

- Biaya

- bisa

- negara

- kreativitas

- kredit

- Keamanan cyber

- da

- data

- Tanggal

- hari

- berurusan

- keputusan

- keputusan

- mengembangkan

- dikembangkan

- Pengembang

- berbeda

- sulit

- digital

- beberapa

- do

- melakukan

- Dont

- turun

- dr

- mendorong

- drive

- dua

- dinamis

- setiap

- makan

- menanamkan

- empati

- akhir

- bertunangan

- Lingkungan Hidup

- lingkungan

- menetapkan

- Bahkan

- akhirnya

- pERNAH

- semua orang

- evolusi

- contoh

- ada

- harapan

- pengalaman

- ahli

- Dieksplorasi

- kain

- Fitur

- merasa

- perasaan

- terisi

- temuan

- Pertama

- fleksibel

- maju

- diikuti

- Untuk

- kerangka

- segar

- dari

- permainan

- mengukur

- menghasilkan

- menghasilkan

- generatif

- mendapatkan

- Memberikan

- diberikan

- memberikan

- Pemberian

- Go

- tujuan

- akan

- abu-abu

- terbesar

- membimbing

- memiliki

- Kejadian

- Sulit

- membahayakan

- membenci

- Memiliki

- memiliki

- Kesehatan

- membantu

- membantu

- dia

- di sini

- High

- hollywood

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- HTTPS

- manusia

- Kemanusiaan

- Manusia

- Lapar

- hidrogen

- i

- ide

- if

- membayangkan

- segera

- in

- Termasuk

- makin

- mempengaruhi

- memasukkan

- sebagai gantinya

- mengintegrasikan

- integritas

- intern

- ke

- IT

- NYA

- Diri

- jpg

- hanya

- pemeliharaan

- kunci

- Anak

- Tahu

- Mengetahui

- pengetahuan

- besar

- Terakhir

- lapisan

- surat

- Hidup

- 'like'

- baris

- hidup

- hidup

- logis

- jangka panjang

- melihat

- Utama

- memelihara

- mempertahankan

- membuat

- MEMBUAT

- Membuat

- banyak

- peta

- Peta

- Mungkin..

- me

- pengukuran

- mental yang

- Kesehatan mental

- metode

- mungkin

- pikiran

- model

- moral

- lebih

- paling

- pindah

- film

- beberapa

- sempit

- Arahkan

- Perlu

- kebutuhan

- Neuroscience

- tak pernah

- berikutnya

- tidak

- terkenal jahat

- sekarang

- mengamati

- hambatan

- Jelas

- of

- sering

- on

- ONE

- hanya

- ke

- Buka

- or

- Lainnya

- Lainnya

- kami

- di luar

- secara keseluruhan

- sendiri

- Sakit

- menyakitkan

- tertentu

- sempurna

- perspektif

- fisik

- Secara fisik

- memilih

- gambar

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- mungkin

- potensi

- Praktis

- meramalkan

- preferensi

- mendesak

- sebelumnya

- pribadi

- Masalah

- masalah

- Pemrograman

- melindungi

- Protein

- diterbitkan

- murni

- Pertanyaan

- menonjol

- pemeliharaan

- cepat

- agak

- alasan

- baru-baru ini

- tinggal

- penelitian

- menghormati

- mengakibatkan

- Hadiah

- benar

- kaku

- Naik

- Risiko

- risiko

- robot

- robotika

- kira-kira

- Rute

- aturan

- Tersebut

- skenario

- Ilmu

- skor

- mencari

- Kedua

- Mencari

- rasa

- berbagi

- berbagi

- Menunjukkan

- Pertunjukkan

- mirip

- serentak

- tunggal

- Kulit

- cerdas

- So

- Masyarakat

- larutan

- Solusi

- beberapa

- sesuatu

- segera

- Selatan

- Selatan

- Mulai

- dimulai

- Negara

- Langkah

- Masih

- kuat

- penderitaan

- Menderita

- mengherankan

- kelangsungan hidup

- sistem

- Mengambil

- Berbicara

- tim

- Teknologi

- Terima kasih

- bahwa

- Grafik

- Dunia

- mereka

- Mereka

- kemudian

- Sana.

- Ini

- mereka

- hal

- hal

- Pikir

- ini

- itu

- pikir

- ancaman

- waktu

- untuk

- mengambil

- tema

- sulit

- terhadap

- MENGHIDUPKAN

- dua

- pokok

- memahami

- Tiba-tiba

- Universal

- universitas

- us

- sangat

- Lawan

- sangat

- sudut pandang

- kerentanan

- Rentan

- adalah

- menonton

- Cara..

- cara

- we

- Menenun

- minggu

- berat

- BAIK

- Apa

- apa pun

- ketika

- sementara

- SIAPA

- mengapa

- Wikipedia

- jendela

- dengan

- tanpa

- Kerja

- dunia

- terburuk

- akan

- menulis

- Salah

- Kamu

- Anda

- zephyrnet.dll