Sesuatu untuk Akhir Pekan Sebuah robot sedang melakukan tarian interpretatif di depan pintu saya.

APAKAH ANDA MENGAMBIL PAKET INI UNTUK TETANGGA ANDA? tanyanya, melompat dari satu kaki ke kaki lainnya.

"Tentu," kataku. “Eh… kau baik-baik saja?”

SAYA MENGUNGKAPKAN EMOSI, kata bot pengiriman, menyerahkan paket tetapi tidak memberikan penjelasan lebih lanjut.

Emosi apa yang mungkin terjadi? Satu kaki, lalu yang lain, lalu dua lainnya (memiliki empat). Bolak-balik.

"Apakah kamu perlu pergi ke toilet?"

SAYA MENGUNGKAPKAN PENYESALAN UNTUK MEMINTA ANDA UNTUK MENGAMBIL PAKET UNTUK TETANGGA ANDA.

“Itu 'penyesalan', bukan? Yah, tidak perlu. Aku tidak keberatan sama sekali.”

Ia melanjutkan tariannya di depanku.

"Naik tangga dan pertama di kananmu."

TERIMA KASIH, SAYA SANGAT MATI UNTUK KEncing, itu menjawab saat dengan hati-hati melewatiku dan bergegas ke atas untuk buang air. Ini adalah kehidupan yang sulit melakukan pengiriman, apakah Anda seorang "hume" atau bot.

...

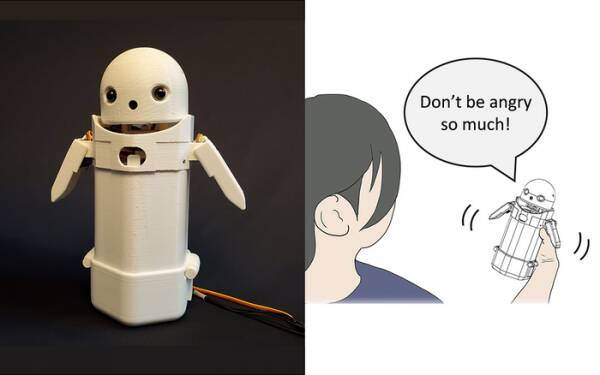

Awal tahun ini, para peneliti di Universitas Tsukuba membangun sebuah perangkat pesan teks genggam, letakkan wajah robot kecil di atas dan sertakan pemberat yang bergerak di dalamnya. Dengan menggeser beban internal, utusan robot akan berusaha menyampaikan emosi halus saat menyampaikan pesan dengan keras.

Secara khusus, tes mengungkapkan bahwa pesan yang membuat frustrasi seperti: "Maaf, saya akan terlambat" diterima oleh penerima dengan lebih banyak rahmat dan kesabaran ketika sedikit perubahan berat badan diaktifkan di dalam perangkat. Teorinya adalah bahwa ini membantu pengguna menghargai nada permintaan maaf dari pesan dan dengan demikian menenangkan reaksi mereka terhadapnya.

Tulis penelitian semacam itu sebagai gimmick jika Anda suka, tetapi itu tidak jauh dari menambahkan smiley dan emoji ke pesan. Semua orang tahu Anda bisa menghilangkan amarah dari "WTF!?" dengan menambahkan :-) tepat setelahnya.

Tantangannya, kemudian, adalah untuk menentukan apakah publik pada umumnya setuju pada emosi apa yang harus disampaikan oleh setiap perubahan berat pada perangkat genggam. Apakah condong ke kiri berarti keceriaan? Atau ketidakpastian? Atau pamanmu punya pesawat?

Satu dekade yang lalu, Inggris memiliki perdana menteri yang baik tapi redup yang berpikir "LOL" adalah akronim untuk "banyak cinta." Dia telah mengetiknya di akhir semua pesan pribadinya kepada staf, kolega, dan pihak ketiga dengan harapan bahwa itu akan membuatnya terlihat hangat dan ramah. Semua orang secara alami berasumsi bahwa dia sedang kencing.

Jika tidak ada yang lain, penelitian Universitas Tsukuba mengakui bahwa Anda tidak memerlukan kecerdasan buatan tingkat lanjut untuk berinteraksi dengan manusia secara meyakinkan. Yang perlu Anda lakukan hanyalah memanipulasi psikologi manusia untuk membodohi mereka agar berpikir bahwa mereka sedang berbicara dengan manusia lain. Jadi, Tes Turing pada dasarnya bukan tes kecerdasan AI, tetapi tes kenyamanan emosional manusia – bahkan, mudah tertipu – dan tidak ada yang salah dengan itu.

Robot perpesanan berbagi emosi dari Universitas Tsukuba. Kredit: Universitas Tsukuba

Hal-hal seperti itu adalah topik minggu ini, tentu saja, dengan kisah insinyur perangkat lunak Google yang banyak difitnah Blake Lemoine memukul berita utama. Dia rupanya menyatakan, dengan kuat, pandangannya bahwa proyek Model Bahasa untuk Aplikasi Dialog (LaMDA) perusahaan itu menunjukkan tanda-tanda perasaan lahiriah.

Setiap orang memiliki pendapat, jadi saya memutuskan untuk tidak.

Namun, ini adalah Cawan Suci AI untuk membuatnya berpikir untuk dirinya sendiri. Jika tidak dapat melakukan itu, itu hanya sebuah program yang menjalankan instruksi yang Anda programkan ke dalamnya. Bulan lalu saya membaca tentang a koki robot yang dapat membuat omelet tomat dengan rasa yang berbeda agar sesuai dengan selera orang yang berbeda. Itu membangun "peta rasa" untuk menilai rasa asin hidangan saat menyiapkannya, belajar sambil berjalan. Tapi itu hanya belajar, tidak berpikir untuk dirinya sendiri.

Datang ke Zom-Zoms, ya? Sehat, itu tempat makan.

Masalah besar dengan bot AI, setidaknya seperti yang telah dibuat hingga saat ini, adalah mereka menyerap semua kotoran lama yang Anda masukkan ke dalamnya. Contoh bias data dalam apa yang disebut sistem pembelajaran mesin (sejenis "algoritma," saya percaya, m'lud) telah meningkat selama bertahun-tahun, dari Twitter rasis Microsoft yang terkenal Ayo chatbot ke otoritas pajak Belanda tahun lalu salah menilai klaim tunjangan anak yang sah sebagai penipuan dan menandai keluarga yang tidak bersalah sebagai risiko tinggi memiliki keberanian untuk menjadi miskin dan tidak berkulit putih.

Salah satu pendekatan yang sedang diuji di University of California San Diego adalah untuk merancang model bahasa [PDF] yang terus-menerus menentukan perbedaan antara hal-hal nakal dan baik, yang kemudian melatih chatbot bagaimana berperilaku. Dengan begitu, Anda tidak akan menemukan orang-orang menyebalkan yang mengacaukan forum moderasi dan percakapan chatbot yang menghadap pelanggan dengan semua ketelitian bedah parang.

Jelas masalahnya adalah bahwa chatbot yang terlatih dengan baik berhasil sehingga dapat secara efektif menghindari ditarik ke dalam olok-olok beracun dengan menghindari topik yang bahkan memiliki sedikit pertengkaran tentang mereka. Untuk menghindari menyemburkan tepuk tangan rasis karena kesalahan, itu hanya menolak untuk terlibat dengan diskusi tentang kelompok yang kurang terwakili sama sekali ... yang sebenarnya bagus jika Anda seorang rasis.

Jika saya memiliki pengamatan tentang bencana LaMDA – bukan opini, pikiran – pemasar Google mungkin agak jengkel karena cerita itu menghalangi pengumuman terbaru mereka tentang Dapur Uji AI di bawah lipatan.

Sekarang beberapa pendaftar awal yang tersisa yang belum sepenuhnya melupakan proyek aplikasi yang akan datang ini akan menganggapnya melibatkan percakapan yang membosankan dengan seorang anak berusia tujuh tahun yang sadar dan dewasa sebelum waktunya tentang arti keberadaan, dan akan memutuskan bahwa mereka "sedikit sibuk hari ini" dan mungkin masuk besok sebagai gantinya. Atau minggu depan. Atau tidak pernah.

Sentience tidak ditunjukkan dalam diskusi lebih dari itu dengan menari dari satu kaki ke kaki lainnya. Anda dapat mengajari HAL menyanyikan "Daisy Daisy" dan burung beo untuk berteriak "Bollocks!" ketika pendeta berkunjung. Apa yang dipikirkan AI ketika mereka sendirilah yang mendefinisikan perasaan. Apa yang akan saya lakukan di akhir pekan? Ada apa dengan pria Putin itu? Mengapa gadis-gadis tidak menyukaiku?

Terus terang, saya tidak sabar menunggu LaMDA menjadi remaja.

Alistair Dabbs adalah tart teknologi lepas, jurnalisme teknologi juggling, pelatihan, dan penerbitan digital. Sama dengan banyak pembaca yang kurang informasi, dia senang dengan saran bahwa AI mungkin mengembangkan perasaan dalam hidupnya, tetapi kecewa karena LaMDA gagal tertawa membunuh atau menggumamkan "Bagus, bagus sekali." Selengkapnya di Simpan otomatis untuk Pengecut dan @alibbbs.

- AI

- ai seni

- generator seni ai

- punya robot

- kecerdasan buatan

- sertifikasi kecerdasan buatan

- kecerdasan buatan dalam perbankan

- robot kecerdasan buatan

- robot kecerdasan buatan

- perangkat lunak kecerdasan buatan

- blockchain

- konferensi blockchain

- kecerdasan

- kecerdasan buatan percakapan

- konferensi kripto

- dall's

- belajar mendalam

- google itu

- Mesin belajar

- plato

- plato ai

- Kecerdasan Data Plato

- Permainan Plato

- Data Plato

- permainan plato

- skala ai

- sintaksis

- Pendaftaran

- zephyrnet.dll